I dette indlæg demonstrerer vi Kubeflow på AWS (en AWS-specifik distribution af Kubeflow) og den værdi, den tilføjer i forhold til open source Kubeflow gennem integrationen af højt optimerede, cloud-native, virksomhedsklare AWS-tjenester.

Kubeflow er open source-maskinlæringsplatformen (ML) dedikeret til at gøre implementeringer af ML-arbejdsgange på Kubernetes enkle, bærbare og skalerbare. Kubeflow leverer mange komponenter, herunder et centralt dashboard, Jupyter-notebooks til flere brugere, Kubeflow Pipelines, KFServing og Katib, samt distribuerede træningsoperatører til TensorFlow, PyTorch, MXNet og XGBoost, for at bygge enkle, skalerbare og bærbare ML-arbejdsgange .

AWS lancerede for nylig Kubeflow v1.4 som en del af sin egen Kubeflow-distribution (kaldet Kubeflow på AWS), som strømliner datavidenskabelige opgaver og hjælper med at bygge yderst pålidelige, sikre, bærbare og skalerbare ML-systemer med reducerede driftsomkostninger gennem integrationer med AWS-administrerede tjenester . Du kan bruge denne Kubeflow-distribution til at bygge ML-systemer ovenpå Amazon Elastic Kubernetes Service (Amazon EKS) til at bygge, træne, tune og implementere ML-modeller til en bred vifte af brugssituationer, herunder computervision, naturlig sprogbehandling, taleoversættelse og finansiel modellering.

Udfordringer med open source Kubeflow

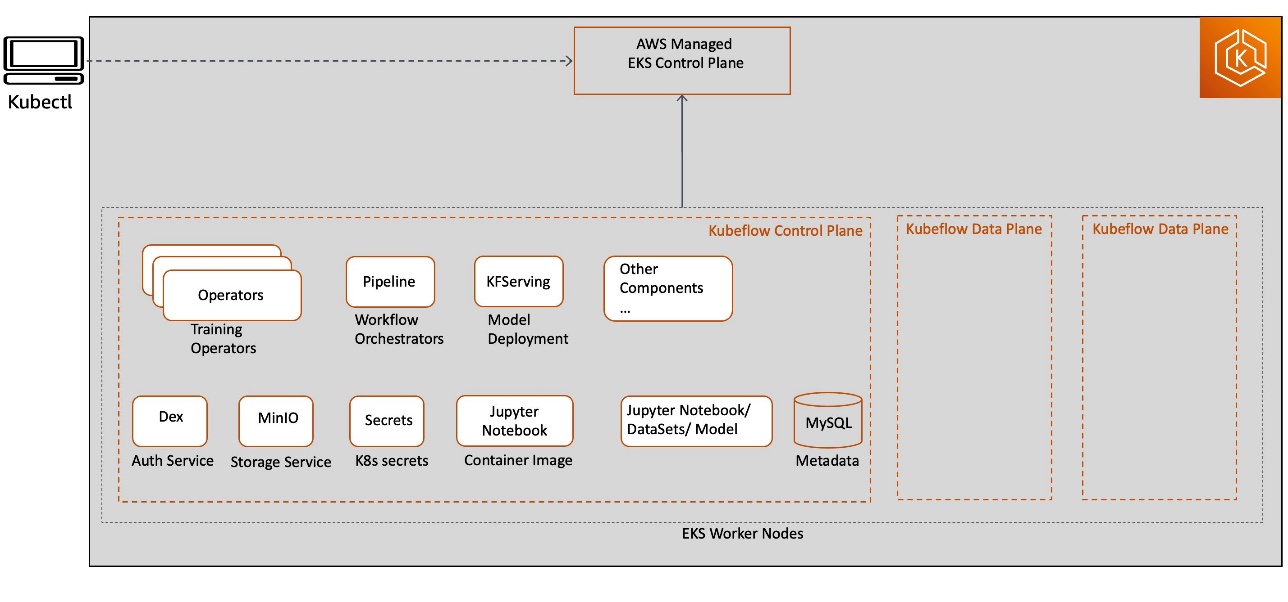

Når du bruger et open source Kubeflow-projekt, implementerer det alle Kubeflow-kontrolplan- og dataplankomponenter på Kubernetes-arbejderknudepunkter. Kubeflow-komponenttjenester implementeres som en del af Kubeflow-kontrolplanet, og alle ressourceimplementeringer relateret til Jupyter, modeltræning, tuning og hosting implementeres på Kubeflow-dataplanet. Kubeflow-kontrolplanet og dataplanet kan køre på den samme eller forskellige Kubernetes-arbejderknudepunkter. Dette indlæg fokuserer på Kubeflow-kontrolplankomponenter, som illustreret i det følgende diagram.

Denne implementeringsmodel giver muligvis ikke en virksomhedsklar oplevelse af følgende årsager:

- Alle Kubeflow-kontrolplanets tunge løft-infrastrukturkomponenter, inklusive database, lagring og godkendelse, implementeres i selve Kubernetes-klyngearbejderknuden. Dette gør det udfordrende at implementere en meget tilgængelig Kubeflow-kontrolplandesignarkitektur med en vedvarende tilstand i tilfælde af fejl i en arbejderknude.

- Kubeflow-kontrolplan-genererede artefakter (såsom MySQL-forekomster, pod-logs eller MinIO-lagring) vokser over tid og har brug for lagervolumener, der kan ændres størrelse med kontinuerlige overvågningsmuligheder for at imødekomme den voksende efterspørgsel efter lagerplads. Fordi Kubeflow-kontrolplanet deler ressourcer med Kubeflow-dataplanarbejdsbelastninger (f.eks. til træningsjob, pipelines og implementeringer), kan den rigtige størrelse og skalering af Kubernetes-klynge- og lagervolumener blive udfordrende og resultere i øgede driftsomkostninger.

- Kubernetes begrænser logfilens størrelse, hvor de fleste installationer holder den seneste grænse på 10 MB. Som standard bliver pod-logfilerne utilgængelige, når de når denne øvre grænse. Logfilerne kan også blive utilgængelige, hvis pods bliver smidt ud, styrtet ned, slettet eller planlagt på en anden node, hvilket kan påvirke din applikationslogtilgængelighed og overvågningsmuligheder.

Kubeflow på AWS

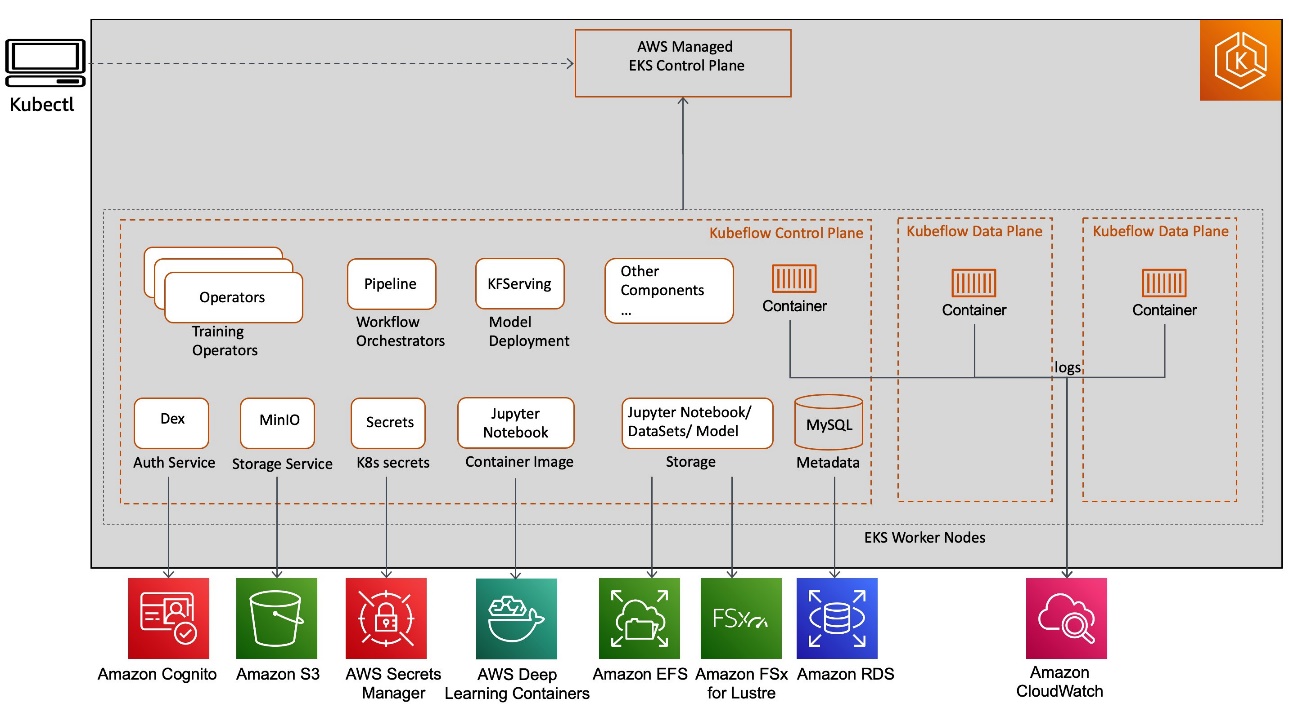

Kubeflow på AWS giver en klar vej til at bruge Kubeflow med følgende AWS-tjenester:

- Application Load Balancer til sikker ekstern trafikstyring over HTTPS

- amazoncloudwatch til vedvarende logstyring

- AWS Cognito til brugergodkendelse med Transport Layer Security (TLS)

- AWS Deep Learning-containere til højt optimerede Jupyter notebook-serverbilleder

- Amazon Elastic File System (Amazon EFS) eller Amazon FSx til Luster for en enkel, skalerbar og serverløs fillagringsløsning til øget træningsydelse

- Amazon EKS til administrerede Kubernetes-klynger

- Amazon Relationel Database Service (Amazon RDS) til meget skalerbare pipelines og et metadatalager

- AWS Secrets Manager for at beskytte de hemmeligheder, der er nødvendige for at få adgang til dine applikationer

- Amazon Simple Storage Service (Amazon S3) til en letanvendelig butik med pipeline-artefakter

Disse AWS-tjenesteintegrationer med Kubeflow (som vist i følgende diagram) giver os mulighed for at afkoble kritiske dele af Kubeflow-kontrolplanet fra Kubernetes, hvilket giver et sikkert, skalerbart, modstandsdygtigt og omkostningsoptimeret design.

Lad os diskutere fordelene ved hver serviceintegration og deres løsninger omkring sikkerhed, kørsel af ML-pipelines og storage.

Sikker godkendelse af Kubeflow-brugere med Amazon Cognito

Cloud-sikkerhed hos AWS har højeste prioritet, og vi investerer i tæt integration af Kubeflow-sikkerhed direkte i AWS-sikkerhedstjenesterne med delt ansvar, såsom følgende:

- Application Load Balancer (ALB) til ekstern trafikstyring

- AWS Certificate Manager (ACM) for at understøtte TLS

- IAM-roller for servicekonti (IRSA) til finkornet adgangskontrol på Kubernetes Pod-niveau

- AWS Key Management Service (AWS KMS) til datakrypteringsnøglestyring

- AWS skjold til DDoS-beskyttelse

I dette afsnit fokuserer vi på AWS Kubeflow-kontrolplanintegration med Amazon Cognito. Amazon Cognito fjerner behovet for at administrere og vedligeholde en indbygget Dex (open-source OpenID Connect (OIDC) udbyder understøttet af lokal LDAP) løsning til brugergodkendelse og gør hemmelig administration lettere.

Du kan også bruge Amazon Cognito til at tilføje brugertilmelding, login og adgangskontrol til din Kubeflow-brugergrænseflade hurtigt og nemt. Amazon Cognito skalerer til millioner af brugere og understøtter login med udbydere af sociale identiteter (IdP'er), såsom Facebook, Google og Amazon, og enterprise IdP'er via SAML 2.0. Dette reducerer kompleksiteten i din Kubeflow-opsætning, hvilket gør den driftsmæssigt slank og lettere at betjene for at opnå isolering af flere brugere.

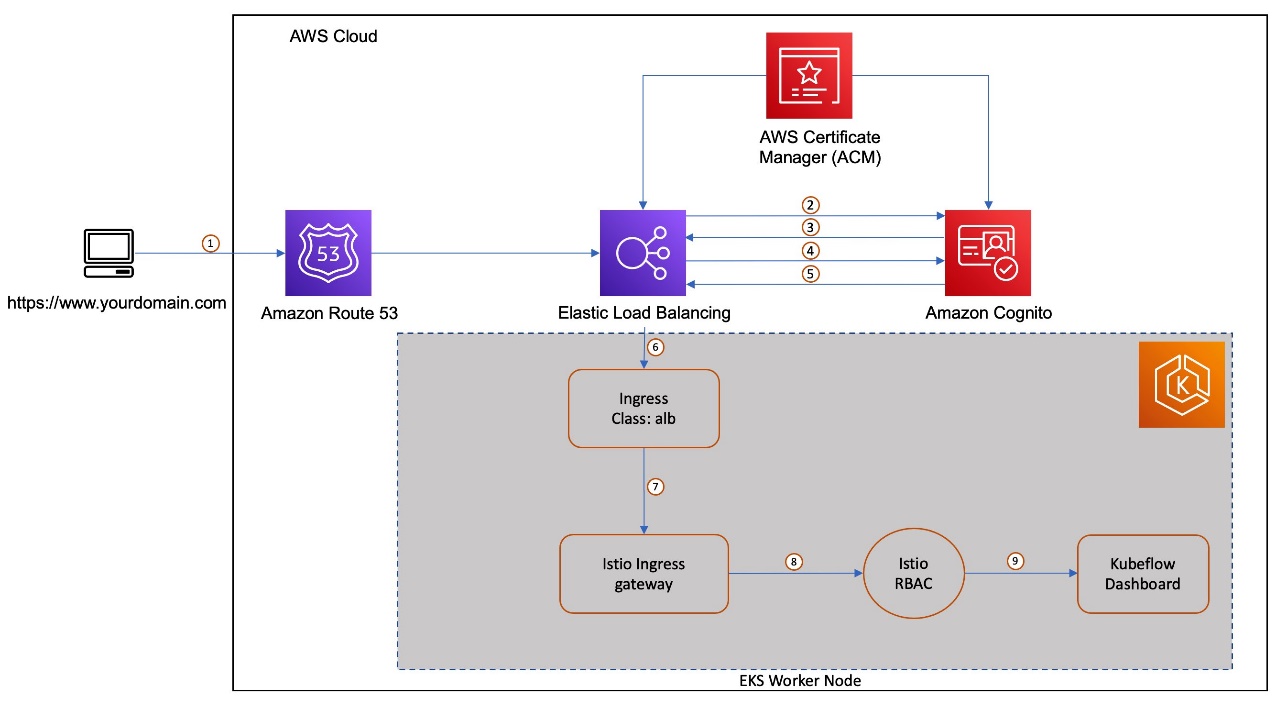

Lad os se på et flerbrugergodkendelsesflow med Amazon Cognito, ALB og ACM integrationer med Kubeflow på AWS. Der er en række nøglekomponenter som en del af denne integration. Amazon Cognito er konfigureret som en IdP med et autentificeringscallback konfigureret til at dirigere anmodningen til Kubeflow efter brugergodkendelse. Som en del af Kubeflow-opsætningen oprettes en Kubernetes-indgangsressource til at administrere ekstern trafik til Istio Gateway-tjenesten. AWS ALB Ingress Controller sørger for en load balancer til denne indgang. Vi bruger Amazonrute 53 at konfigurere en offentlig DNS for det registrerede domæne og oprette certifikater ved hjælp af ACM for at aktivere TLS-godkendelse ved belastningsbalanceren.

Følgende diagram viser den typiske brugerarbejdsgang med at logge ind på Amazon Cognito og blive omdirigeret til Kubeflow i deres respektive navneområde.

Arbejdsgangen indeholder følgende trin:

- Brugeren sender en HTTPS-anmodning til Kubeflows centrale dashboard, der er hostet bag en belastningsbalancer. Rute 53 løser FQDN til ALB-aliasposten.

- Hvis cookien ikke er til stede, omdirigerer load balanceren brugeren til Amazon Cognito-godkendelsesslutpunktet, så Amazon Cognito kan godkende brugeren.

- Efter at brugeren er autentificeret, sender Amazon Cognito brugeren tilbage til belastningsbalanceren med en godkendelseskode.

- Loadbalanceren præsenterer autorisationsbevillingskoden til Amazon Cognito-token-slutpunktet.

- Efter at have modtaget en gyldig godkendelseskode, leverer Amazon Cognito ID-tokenet og adgangstokenet til load balancer.

- Når din load balancer har godkendt en bruger med succes, sender den adgangstokenet til Amazon Cognito-brugerinfo-slutpunktet og modtager brugerkrav. Belastningsbalanceren underskriver og tilføjer brugerkrav til HTTP-headeren

x-amzn-oidc-*i et JSON-webtoken (JWT) anmodningsformat. - Anmodningen fra belastningsbalanceren sendes til Istio Ingress Gateways pod.

- Ved hjælp af et envoy-filter afkoder Istio Gateway

x-amzn-oidc-dataværdi, henter e-mail-feltet og tilføjer den tilpassede HTTP-headerkubeflow-userid, som bruges af Kubeflow-godkendelseslaget. - De Istio-ressourcebaserede adgangskontrolpolitikker anvendes på den indkommende anmodning for at validere adgangen til Kubeflow Dashboard. Hvis en af disse er utilgængelige for brugeren, sendes et fejlsvar tilbage. Hvis anmodningen er valideret, videresendes den til den relevante Kubeflow-tjeneste og giver adgang til Kubeflow Dashboard

Vedvarende Kubeflow-komponent-metadata og artefaktlagring med Amazon RDS og Amazon S3

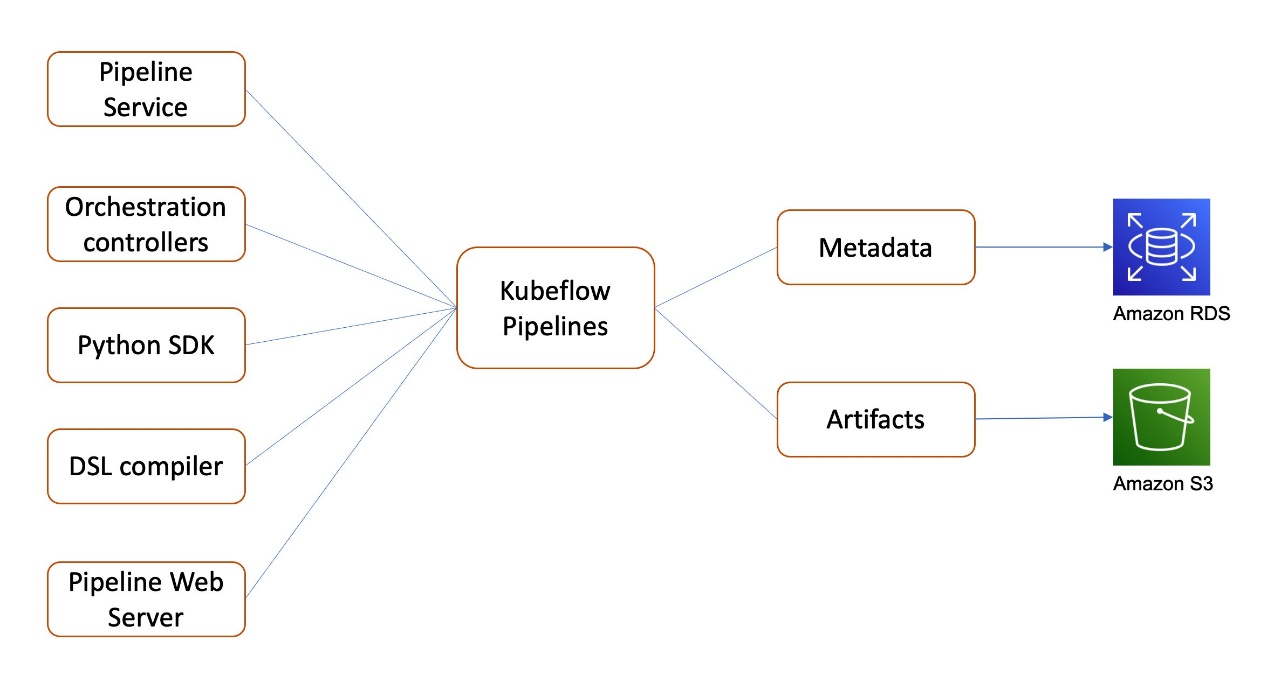

Kubeflow på AWS giver integration med Amazon Relationel Database Service (Amazon RDS) i Kubeflow Pipelines og AutoML (Katib) til vedvarende metadatalagring og Amazon S3 i Kubeflow Pipelines til vedvarende artefaktlagring. Lad os fortsætte med at diskutere Kubeflow Pipelines mere detaljeret.

Kubeflow Pipelines er en platform til opbygning og implementering af bærbare, skalerbare ML-arbejdsgange. Disse arbejdsgange kan hjælpe med at automatisere komplekse ML-pipelines ved hjælp af indbyggede og tilpassede Kubeflow-komponenter. Kubeflow Pipelines inkluderer Python SDK, en DSL-kompiler til at konvertere Python-kode til en statisk konfiguration, en Pipelines-tjeneste, der kører pipelines fra den statiske konfiguration, og et sæt controllere til at køre de containere i Kubernetes Pods, der er nødvendige for at fuldføre pipelinen.

Kubeflow Pipelines-metadata for pipeline-eksperimenter og -kørsler gemmes i MySQL, og artefakter, herunder pipeline-pakker og metrics, gemmes i MinIO.

Som vist i følgende diagram lader Kubeflow på AWS dig gemme følgende komponenter med AWS-administrerede tjenester:

- Pipeline-metadata i Amazon RDS – Amazon RDS giver en skalerbar, meget tilgængelig og pålidelig multi-AZ-implementeringsarkitektur med en indbygget automatiseret failover-mekanisme og kapacitet, der kan ændres størrelse til en industristandard relationel database som MySQL. Den administrerer almindelige databaseadministrationsopgaver uden at skulle levere infrastruktur eller vedligeholde software.

- Rørledningsartefakter i Amazon S3 – Amazon S3 tilbyder brancheførende skalerbarhed, datatilgængelighed, sikkerhed og ydeevne og kan bruges til at opfylde dine overholdelseskrav.

Disse integrationer hjælper med at aflaste administrationen og vedligeholdelsen af metadata og artefaktlagring fra selvadministreret Kubeflow til AWS-administrerede tjenester, som er nemmere at konfigurere, betjene og skalere.

Understøttelse af distribuerede filsystemer med Amazon EFS og Amazon FSx

Kubeflow bygger på Kubernetes, som leverer en infrastruktur til storskala, distribueret databehandling, herunder træning og tuning af store modeller med et dybt netværk med millioner eller endda milliarder af parametre. For at understøtte sådanne distribuerede databehandlings-ML-systemer tilbyder Kubeflow på AWS integration med følgende lagertjenester:

- Amazon EFS – Et højtydende, cloud-native, distribueret filsystem, som du kunne administrere gennem et Amazon EFS CSI driver. Amazon EFS giver

ReadWriteManyadgangstilstand, og du kan nu bruge den til at montere i pods (Jupyter, modeltræning, modeljustering), der kører i et Kubeflow-dataplan for at give et vedvarende, skalerbart og delbart arbejdsområde, der automatisk vokser og krymper, når du tilføjer og fjerner filer med ikke behov for ledelse. - Amazon FSx til Luster – Et optimeret filsystem til computerintensive arbejdsbelastninger, såsom højtydende computing og ML, som du kan administrere gennem Amazon FSx CSI driver. FSx for Luster giver

ReadWriteManyadgangstilstand også, og du kan bruge den til at cache træningsdata med direkte forbindelse til Amazon S3 som backing-lageret, som du kan bruge til at understøtte Jupyter notebook-servere eller distribueret træning, der kører i et Kubeflow-dataplan. Med denne konfiguration behøver du ikke overføre data til filsystemet, før du bruger diskenheden. FSx for Luster giver ensartede forsinkelser på submillisekunder og høj samtidighed og kan skaleres til TB/s af gennemløb og millioner af IOPS.

Muligheder for implementering af Kubeflow

AWS tilbyder forskellige Kubeflow-implementeringsmuligheder:

- Implementering med Amazon Cognito

- Implementering med Amazon RDS og Amazon S3

- Implementering med Amazon Cognito, Amazon RDS og Amazon S3

- Vanilje udrulning

For detaljer om serviceintegration og tilgængelige tilføjelser for hver af disse muligheder, se Distributionsmuligheder. Du kan tilpasse den mulighed, der passer bedst til din brugssag.

I det følgende afsnit gennemgår vi trinene til at installere AWS Kubeflow v1.4 distribution på Amazon EKS. Derefter bruger vi det eksisterende XGBoost-pipeline-eksempel, der er tilgængeligt på Kubeflows centrale UI-dashboard til at demonstrere integrationen og brugen af AWS Kubeflow med Amazon Cognito, Amazon RDS og Amazon S3, med Secrets Manager som en tilføjelse.

Forudsætninger

For denne gennemgang skal du have følgende forudsætninger:

- An AWS-konto.

- En eksisterende Amazon EKS-klynge. Det skal være Kubernetes version 1.19 eller nyere. Til automatiseret klyngeoprettelse vha eksklSe Opret en Amazon EKS-klynge og brug eksctl-indstillingen.

Installer følgende værktøjer på den klientmaskine, der bruges til at få adgang til din Kubernetes-klynge. Du kan bruge AWS Cloud9, et cloud-baseret integreret udviklingsmiljø (IDE) til Kubernetes-klyngeopsætningen.

- AWS kommandolinjegrænseflade (AWS CLI) – Et kommandolinjeværktøj til interaktion med AWS-tjenester. For monteringsvejledning henvises til Installation, opdatering og afinstallation af AWS CLI.

- ekskl > 0.56 – Et kommandolinjeværktøj til at arbejde med Amazon EKS-klynger, der automatiserer mange individuelle opgaver.

- kubectl – Et kommandolinjeværktøj til at arbejde med Kubernetes-klynger.

- git – En distribueret versionskontrolsoftware.

- Python 3.8+ – Python-programmeringsmiljøet.

- pip – Pakkemanageren til Python.

- kystomize version 3.2.0 – Et kommandolinjeværktøj til at tilpasse Kubernetes-objekter gennem en kystomiseringsfil.

Installer Kubeflow på AWS

Konfigurer kubectl, så du kan oprette forbindelse til en Amazon EKS-klynge:

Forskellige controllere i Kubeflow-implementering bruger IAM-roller for servicekonti (IRSA). Der skal eksistere en OIDC-udbyder for at din klynge kan bruge IRSA. Opret en OIDC-udbyder og tilknyt den til din Amazon EKS-klynge ved at køre følgende kommando, hvis din klynge ikke allerede har en:

Klon AWS manifester repo og Kubeflow manifester repo, og tjek de respektive udgivelsesgrene:

For mere information om disse versioner, se Udgivelser og versionering.

Konfigurer Amazon RDS, Amazon S3 og Secrets Manager

Du opretter Amazon RDS- og Amazon S3-ressourcer, før du implementerer Kubeflow-manifesterne. Vi bruger automatiserede Python-scripts, der sørger for at skabe S3-bøtten, RDS-databasen og påkrævede hemmeligheder i Secrets Manager. Den redigerer også de nødvendige konfigurationsfiler for Kubeflow-pipeline og AutoML, så de er korrekt konfigureret til RDS-databasen og S3-bøtten under Kubeflow-installationen.

Opret en IAM-bruger med tilladelser til at tillade GetBucketLocation og læse- og skriveadgang til objekter i en S3-bøtte, hvor du vil gemme Kubeflow-artefakter. Brug AWS_ACCESS_KEY_ID , AWS_SECRET_ACCESS_KEY af IAM-brugeren i følgende kode:

Konfigurer Amazon Cognito som godkendelsesudbyder

I dette afsnit opretter vi et brugerdefineret domæne i Route 53 og ALB til at dirigere ekstern trafik til Kubeflow Istio Gateway. Vi bruger ACM til at oprette et certifikat for at aktivere TLS-godkendelse hos ALB og Amazon Cognito for at vedligeholde brugerpuljen og administrere brugergodkendelse.

Erstat følgende værdier i

- rute53.rootDomain.name – Det registrerede domæne. Lad os antage, at dette domæne er

example.com. - route53.rootDomain.hostedZoneId – Hvis dit domæne administreres i Route53, skal du indtaste det hostede zone-id, der findes under de hostede zonedetaljer. Spring dette trin over, hvis dit domæne administreres af en anden domæneudbyder.

- rute53.underdomæne.navn – Navnet på det underdomæne, hvor du vil være vært for Kubeflow (f.eks.

platform.example.com). For mere information om underdomæner, se Implementering af Kubeflow med AWS Cognito som IdP. - klynge.navn – Klyngenavnet og hvor Kubeflow er implementeret.

- klynge.region – Klyngeregionen, hvor Kubeflow er implementeret (f.eks.

us-west-2). - cognitoUserpool.name – Navnet på Amazon Cognito-brugerpuljen (f.eks.

kubeflow-users).

Konfigurationsfilen ligner følgende kode:

Kør scriptet for at oprette ressourcerne:

Scriptet opdaterer config.yaml fil med de ressourcenavne, ID'er og ARN'er, den oprettede. Det ligner nogenlunde følgende kode:

Byg manifester og implementer Kubeflow

Implementer Kubeflow ved hjælp af følgende kommando:

Opdater domænet med ALB-adressen

Implementeringen opretter en indgangsstyret AWS-applikationsbelastningsbalancer. Vi opdaterer DNS-indtastningerne for underdomænet i rute 53 med DNS for load balanceren. Kør følgende kommando for at kontrollere, om belastningsbalanceren er klargjort (dette tager omkring 3-5 minutter):

Hvis ADDRESS feltet er tomt efter et par minutter, tjek loggen for alb-ingress-controller. For instruktioner, se ALB undlader at levere.

Når belastningsbalanceren er klargjort, skal du kopiere DNS-navnet på belastningsbalanceren og erstatte adressen med kubeflow.alb.dns in ${kubeflow_manifest_dir}/tests/e2e/utils/cognito_bootstrap/config.yaml. Kubeflow-sektionen af konfigurationsfilen ser ud som følgende kode:

Kør følgende script for at opdatere DNS-posterne for underdomænet i Route 53 med DNS for den klargjorte load balancer:

Fejlfinding

Hvis du støder på problemer under installationen, skal du se fejlfinding guide eller start på en frisk ved at følge afsnittet "Ryd op" på denne blog.

Brug case gennemgang

Nu hvor vi har afsluttet installationen af de nødvendige Kubeflow-komponenter, lad os se dem i aktion ved hjælp af et af de eksisterende eksempler fra Kubeflow Pipelines på dashboardet.

Få adgang til Kubeflow Dashboard ved hjælp af Amazon Cognito

Lad os få adgang til Kubeflow Dashboard for at komme i gang. Fordi vi brugte Amazon Cognito som IdP, skal du bruge oplysningerne i officielle README-fil. Vi opretter først nogle brugere på Amazon Cognito-konsollen. Det er de brugere, der vil logge ind på det centrale dashboard. Næste, Opret en profil for den bruger, du har oprettet. Så skulle du kunne få adgang til dashboardet via login-siden på https://kubeflow.platform.example.com.

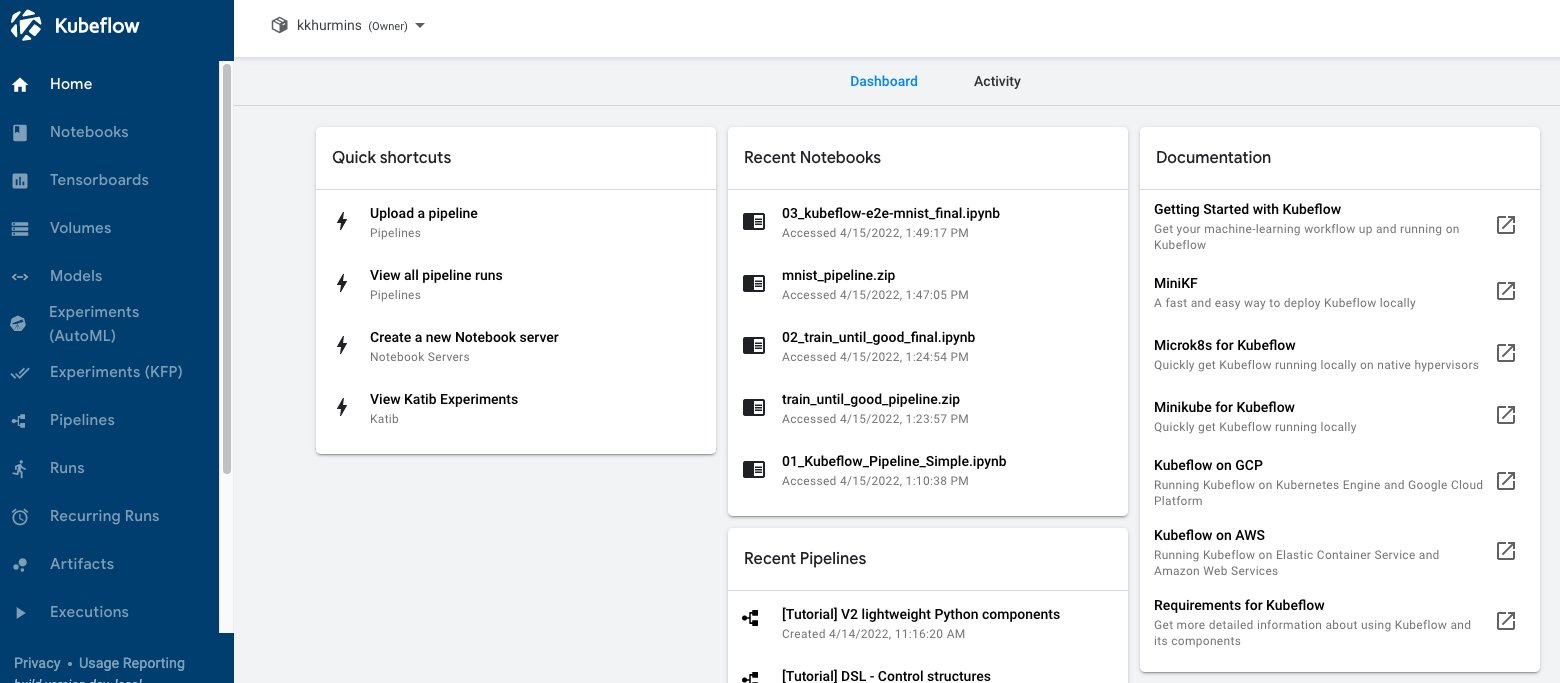

Følgende skærmbillede viser vores Kubeflow Dashboard.

Kør rørledningen

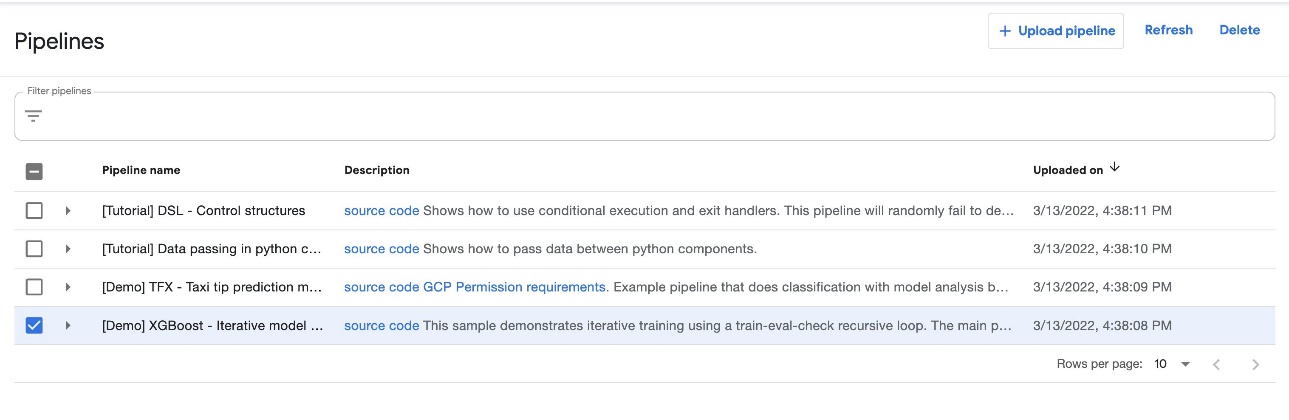

Vælg på Kubeflow Dashboard Rørledninger i navigationsnavnet. Du bør se fire eksempler fra Kubeflow Pipelines, som du kan køre direkte for at udforske forskellige Pipelines-funktioner.

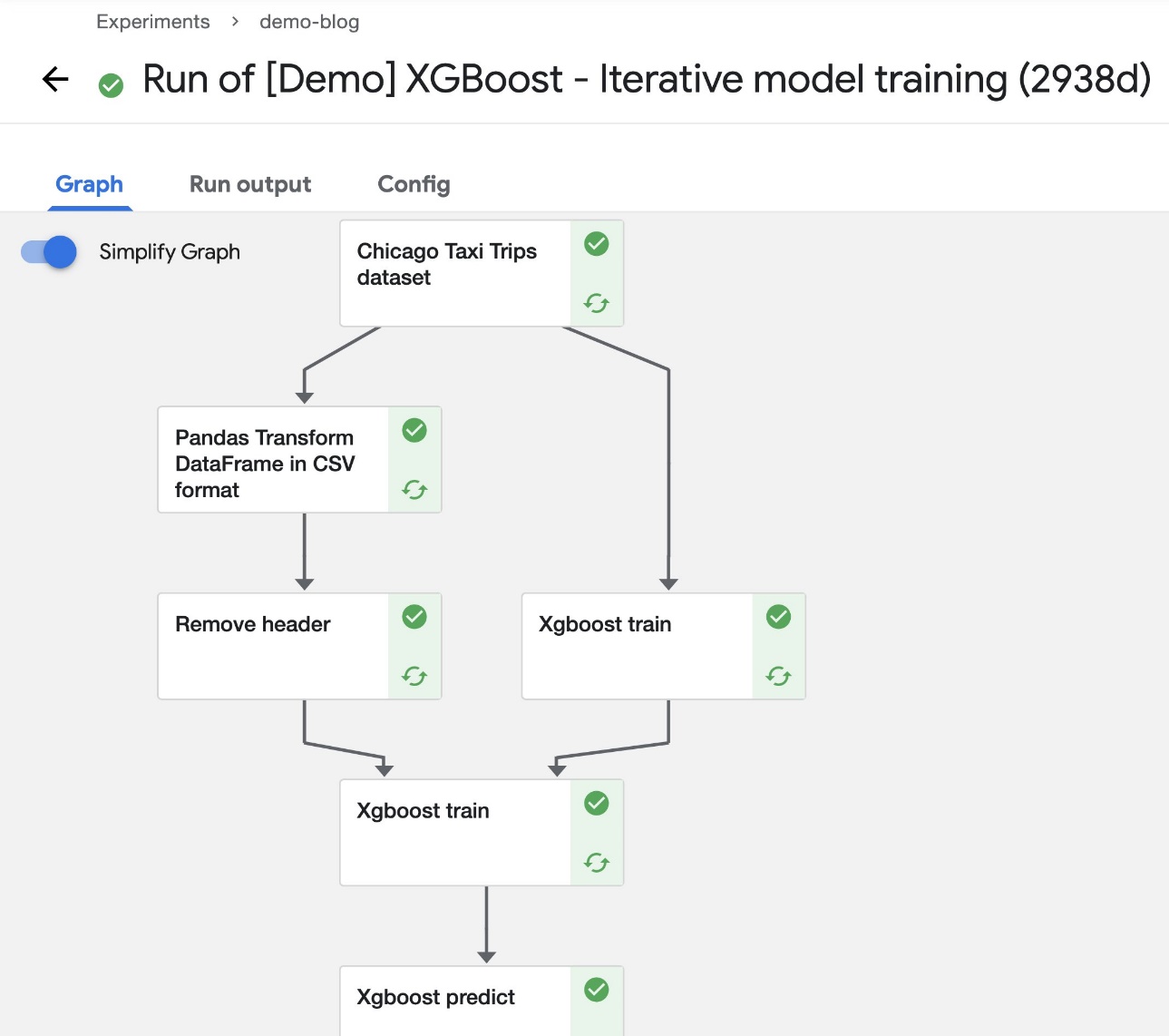

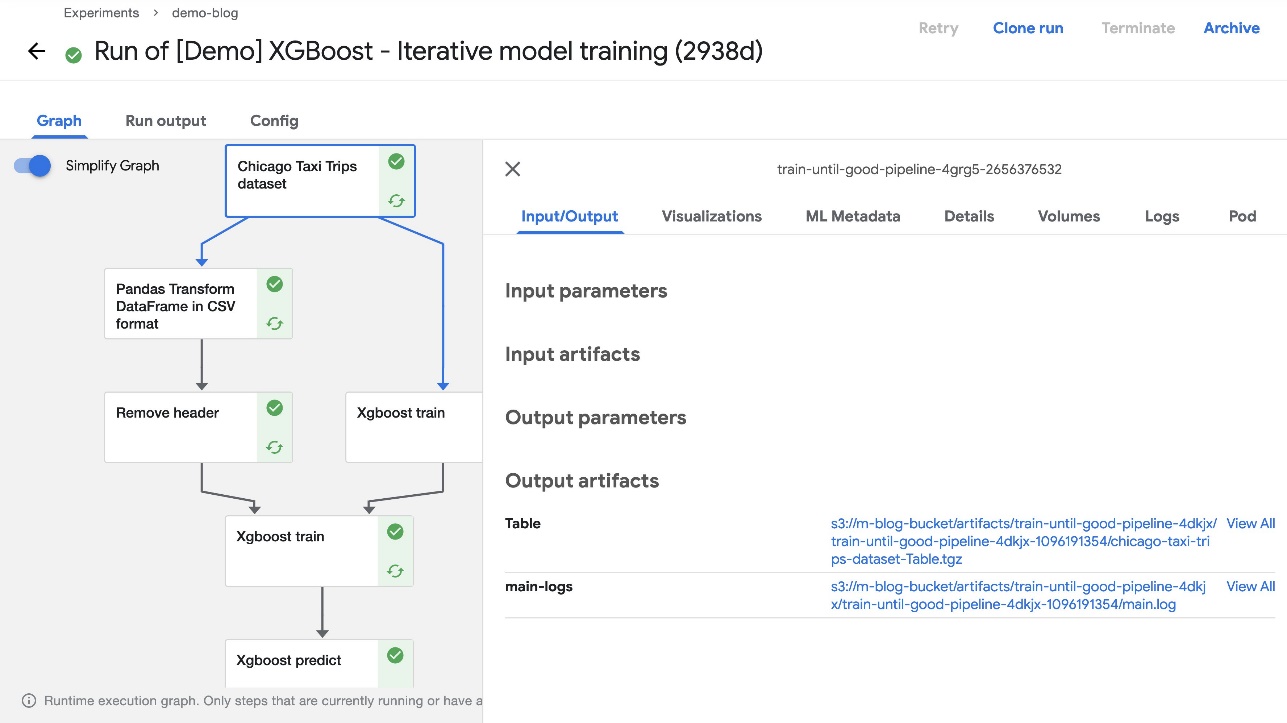

Til dette indlæg bruger vi XGBoost-eksemplet kaldet [Demo] XGBoost – Iterativ modeltræning. Du kan finde kildekoden på GitHub. Dette er en simpel pipeline, der bruger det eksisterende XGBoost/Train , XGBoost/Predict Kubeflow-pipelinekomponenter til iterativt at træne en model, indtil metrikkerne anses for gode baseret på specificerede metrics.

For at køre pipelinen skal du udføre følgende trin:

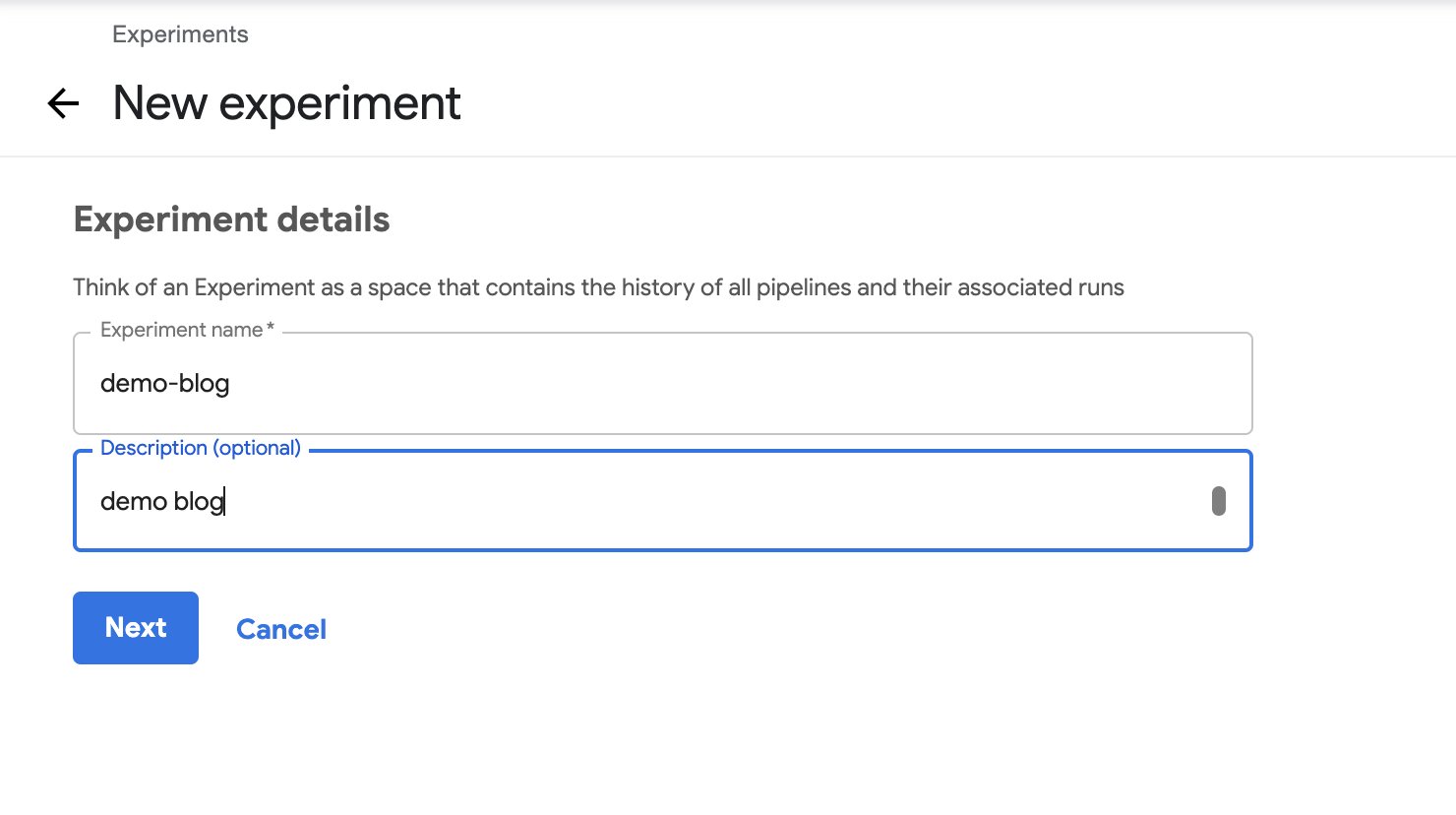

- Vælg pipeline og vælg Opret eksperiment.

- Under Eksperimentdetaljer, indtast et navn (for dette indlæg,

demo-blog) og valgfri beskrivelse. - Vælg Næste.

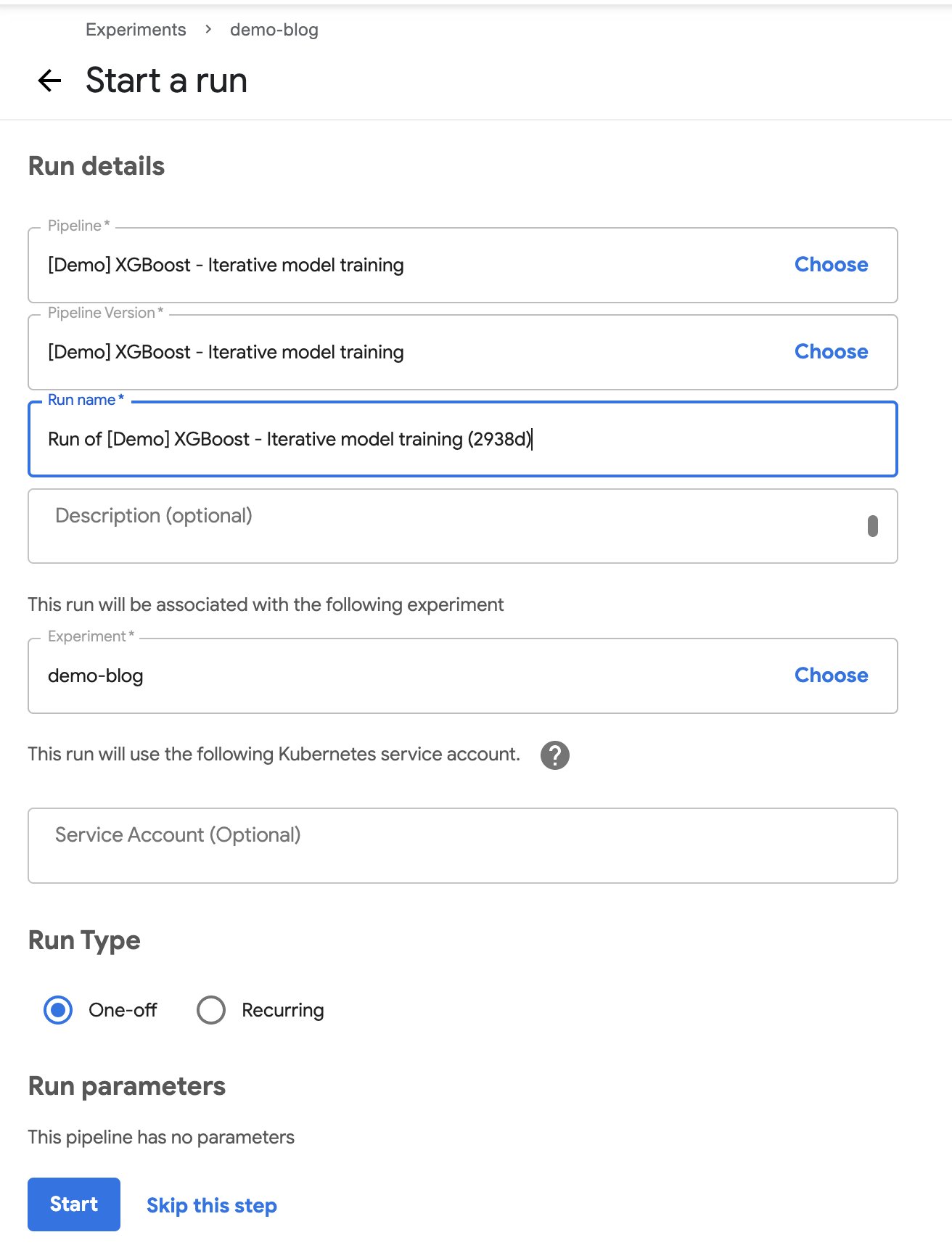

- Under Kør detaljer¸ vælg din pipeline og pipeline version.

- Til Kør navn, indtast et navn.

- Til Eksperiment, vælg det eksperiment, du har oprettet.

- Til Kør type, Vælg Engangs.

- Vælg Starten.

Når pipelinen begynder at køre, bør du se komponenterne færdiggøres (inden for et par sekunder). På dette trin kan du vælge en hvilken som helst af de færdige komponenter for at se flere detaljer.

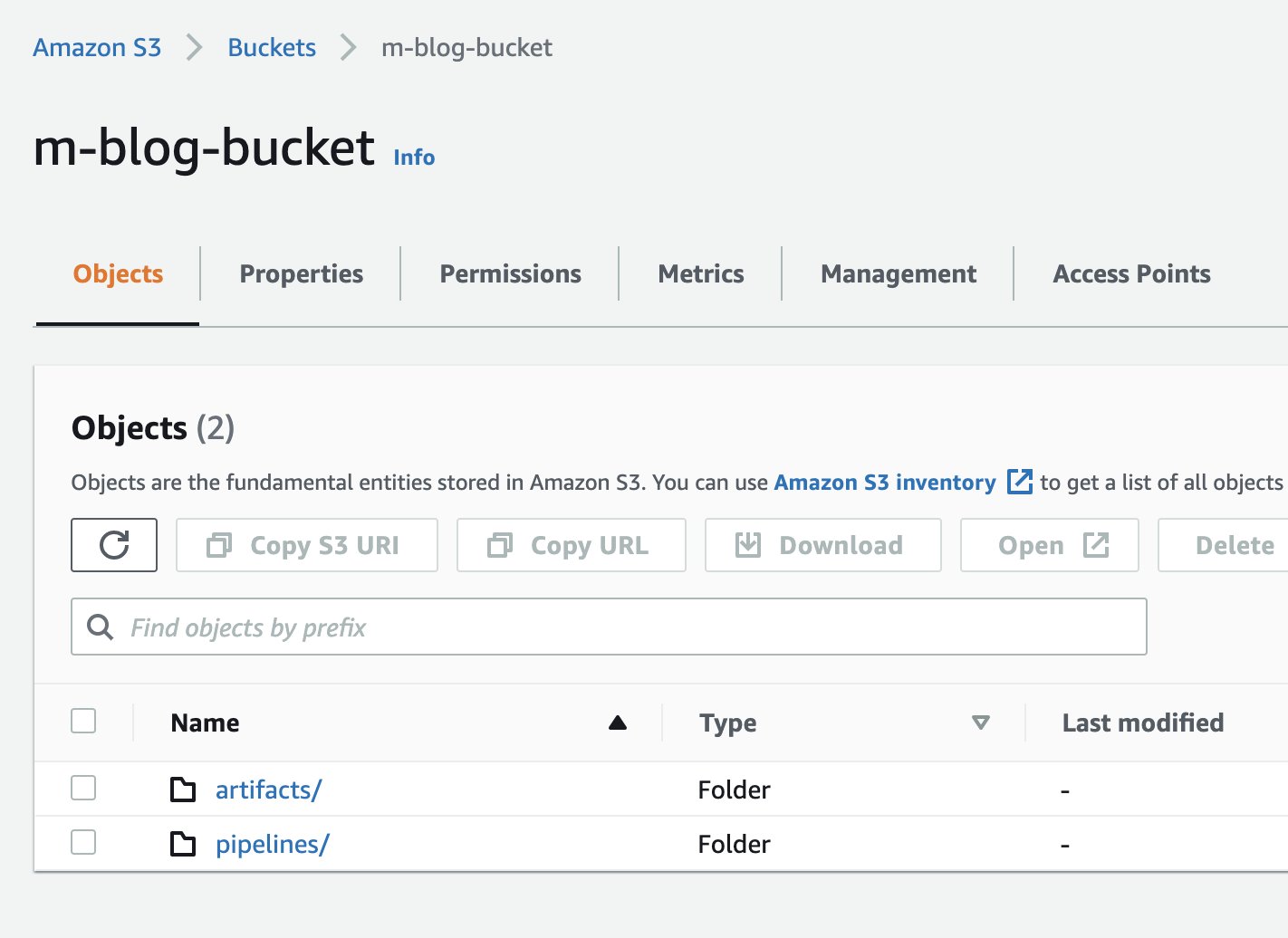

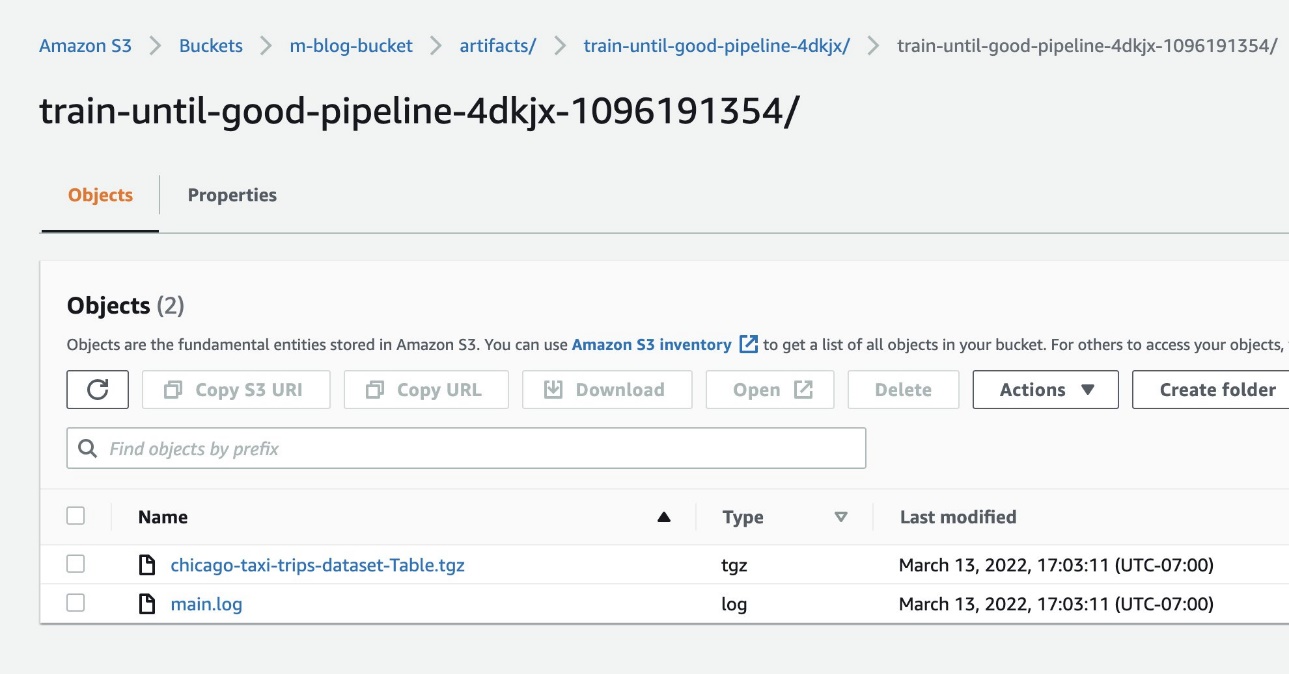

Få adgang til artefakter i Amazon S3

Mens vi implementerede Kubeflow, specificerede vi, at Kubeflow Pipelines skulle bruge Amazon S3 til at gemme dets artefakter. Dette inkluderer alle pipeline-outputartefakter, cachelagrede kørsler og pipelinegrafer – som alle derefter kan bruges til omfattende visualiseringer og ydeevneevaluering.

Når pipeline-kørslen er færdig, bør du kunne se artefakterne i den S3-spand, du oprettede under installationen. For at bekræfte dette skal du vælge en hvilken som helst færdig komponent i rørledningen og kontrollere Input / Output afsnit om standarden Graf fanen. Artefakt-URL'erne skal pege på den S3-bøtte, som du har angivet under implementeringen.

For at bekræfte, at ressourcerne blev tilføjet til Amazon S3, kan vi også tjekke S3-bøtten på vores AWS-konto via Amazon S3-konsollen.

Følgende skærmbillede viser vores filer.

Bekræft ML-metadata i Amazon RDS

Vi integrerede også Kubeflow Pipelines med Amazon RDS under implementeringen, hvilket betyder, at enhver pipeline-metadata skal gemmes i Amazon RDS. Dette inkluderer alle runtime-oplysninger såsom status for en opgave, tilgængelighed af artefakter, brugerdefinerede egenskaber forbundet med kørslen eller artefakter og mere.

For at verificere Amazon RDS-integrationen skal du følge trinene i officielle README-fil. Udfør specifikt følgende trin:

- Få Amazon RDS-brugernavnet og adgangskoden fra den hemmelighed, der blev oprettet under installationen:

- Brug disse legitimationsoplysninger til at oprette forbindelse til Amazon RDS fra klyngen:

- Når MySQL-prompten åbner, kan vi verificere

mlpipelinesdatabase som følger: - Nu kan vi læse indholdet af specifikke tabeller for at sikre, at vi kan se metadataoplysninger om de eksperimenter, der kørte pipelines:

Ryd op

For at afinstallere Kubeflow og slette de AWS-ressourcer, du har oprettet, skal du udføre følgende trin:

- Slet den indgangs- og indgangsstyrede load balancer ved at køre følgende kommando:

- Slet resten af Kubeflow-komponenterne:

- Slet AWS-ressourcerne oprettet af scripts:

- Ressourcer oprettet til Amazon RDS og Amazon S3 integration. Sørg for, at du har konfigurationsfilen oprettet af scriptet i

${kubeflow_manifest_dir}/tests/e2e/utils/rds-s3/metadata.yaml: - Ressourcer oprettet til Amazon Cognito-integration. Sørg for, at du har konfigurationsfilen oprettet af scriptet i

${kubeflow_manifest_dir}/tests/e2e/utils/cognito_bootstrap/config.yaml:

- Ressourcer oprettet til Amazon RDS og Amazon S3 integration. Sørg for, at du har konfigurationsfilen oprettet af scriptet i

- Hvis du oprettede en dedikeret Amazon EKS-klynge til Kubeflow ved hjælp af eksctl, kan du slette den med følgende kommando:

Resumé

I dette indlæg fremhævede vi den værdi, som Kubeflow på AWS giver gennem native AWS-administrerede serviceintegrationer til sikre, skalerbare og virksomhedsklare AI- og ML-arbejdsbelastninger. Du kan vælge mellem flere implementeringsmuligheder for at installere Kubeflow på AWS med forskellige serviceintegrationer. Brugssagen i dette indlæg demonstrerede Kubeflow-integration med Amazon Cognito, Secrets Manager, Amazon RDS og Amazon S3. For at komme i gang med Kubeflow på AWS, se de tilgængelige AWS-integrerede implementeringsmuligheder i Kubeflow på AWS.

Fra v1.3 kan du følge AWS Labs repository at spore alle AWS-bidrag til Kubeflow. Du kan også finde os på Kubeflow #AWS Slack Channel; din feedback der vil hjælpe os med at prioritere de næste funktioner, der skal bidrage til Kubeflow-projektet.

Om forfatterne

Kanwaljit Khurmi er AI/ML Specialist Solutions Architect hos Amazon Web Services. Han arbejder med AWS-produktet, ingeniørarbejdet og kunderne for at yde vejledning og teknisk assistance, der hjælper dem med at forbedre værdien af deres hybride ML-løsninger, når de bruger AWS. Kanwaljit har specialiseret sig i at hjælpe kunder med container- og maskinlæringsapplikationer.

Kanwaljit Khurmi er AI/ML Specialist Solutions Architect hos Amazon Web Services. Han arbejder med AWS-produktet, ingeniørarbejdet og kunderne for at yde vejledning og teknisk assistance, der hjælper dem med at forbedre værdien af deres hybride ML-løsninger, når de bruger AWS. Kanwaljit har specialiseret sig i at hjælpe kunder med container- og maskinlæringsapplikationer.

Meghna Baijal er en softwareingeniør med AWS AI, hvilket gør det nemmere for brugere at integrere deres Machine Learning-arbejdsbelastninger på AWS ved at bygge ML-produkter og platforme såsom Deep Learning Containers, Deep Learning AMI'erne, AWS-controllerne til Kubernetes (ACK) og Kubeflow på AWS . Uden for arbejdet holder hun af at læse, rejse og male.

Meghna Baijal er en softwareingeniør med AWS AI, hvilket gør det nemmere for brugere at integrere deres Machine Learning-arbejdsbelastninger på AWS ved at bygge ML-produkter og platforme såsom Deep Learning Containers, Deep Learning AMI'erne, AWS-controllerne til Kubernetes (ACK) og Kubeflow på AWS . Uden for arbejdet holder hun af at læse, rejse og male.

Suraj Kota er en softwareingeniør med speciale i maskinlæringsinfrastruktur. Han bygger værktøjer til nemt at komme i gang og skalere arbejdsbyrden for maskinlæring på AWS. Han arbejdede på AWS Deep Learning Containers, Deep Learning AMI, SageMaker Operators for Kubernetes og andre open source integrationer som Kubeflow.

Suraj Kota er en softwareingeniør med speciale i maskinlæringsinfrastruktur. Han bygger værktøjer til nemt at komme i gang og skalere arbejdsbyrden for maskinlæring på AWS. Han arbejdede på AWS Deep Learning Containers, Deep Learning AMI, SageMaker Operators for Kubernetes og andre open source integrationer som Kubeflow.

- Coinsmart. Europas bedste Bitcoin og Crypto Exchange.

- Platoblokkæde. Web3 Metaverse Intelligence. Viden forstærket. FRI ADGANG.

- CryptoHawk. Altcoin radar. Gratis prøveversion.

- Kilde: https://aws.amazon.com/blogs/machine-learning/build-and-deploy-a-scalable-machine-learning-system-on-kubernetes-with-kubeflow-on-aws/

- "

- 10

- 100

- 420

- 7

- Om

- adgang

- Konto

- Handling

- Tilføjelse

- adresse

- admin

- administration

- søsterselskaber

- AI

- Alle

- allerede

- Amazon

- Amazon Web Services

- En anden

- Anvendelse

- applikationer

- passende

- arkitektur

- omkring

- Associate

- autentificeret

- godkender

- Godkendelse

- tilladelse

- automatisere

- Automatiseret

- automater

- tilgængelighed

- til rådighed

- AWS

- bliver

- fordele

- BEDSTE

- milliarder

- Blog

- grænse

- bygge

- Bygning

- bygger

- indbygget

- kapaciteter

- Kapacitet

- hvilken

- tilfælde

- CD

- certifikat

- certifikater

- udfordrende

- Betaling

- Vælg

- fordringer

- klasse

- kode

- Fælles

- færdiggøre

- komplekse

- komponent

- computer

- computing

- Konfiguration

- Tilslut

- Connectivity

- Konsol

- Beholdere

- indeholder

- indhold

- fortsæt

- bidrage

- kontrol

- controller

- ophavsret

- kunne

- skabe

- oprettet

- skaber

- Oprettelse af

- skabelse

- Legitimationsoplysninger

- kritisk

- skik

- Kunder

- instrumentbræt

- data

- databehandling

- datalogi

- Database

- DDoS

- dedikeret

- Efterspørgsel

- demonstrere

- demonstreret

- indsætte

- indsat

- implementering

- implementering

- implementeringer

- udruller

- Design

- detail

- detaljer

- Udvikling

- Dex

- forskellige

- direkte

- direkte

- diskutere

- distribueret

- fordeling

- dns

- Er ikke

- domæne

- nemt

- nem at bruge

- ekko

- muliggøre

- kryptering

- Endpoint

- ingeniør

- Engineering

- Indtast

- Enterprise

- Miljø

- evaluering

- begivenhed

- eksempel

- eksisterende

- erfaring

- eksperiment

- udforske

- Manglende

- Funktionalitet

- tilbagemeldinger

- finansielle

- Fornavn

- passer

- flow

- Fokus

- fokuserer

- følger

- efter

- format

- fundet

- frisk

- få

- Git

- GitHub

- godt

- Grow

- Dyrkning

- hjælpe

- hjælpe

- hjælper

- link.

- Høj

- højere

- Fremhævet

- stærkt

- Hosting

- HTTPS

- Hybrid

- Identity

- KIMOs Succeshistorier

- gennemføre

- Forbedre

- Inc.

- omfatter

- Herunder

- øget

- individuel

- brancheførende

- info

- oplysninger

- Infrastruktur

- installere

- integreret

- integration

- integrationer

- investere

- isolation

- spørgsmål

- IT

- selv

- Karriere

- holde

- Nøgle

- Labs

- Sprog

- stor

- lanceret

- læring

- løft

- Line (linje)

- belastning

- lokale

- maskine

- machine learning

- vedligeholde

- maerker

- Making

- administrere

- lykkedes

- ledelse

- leder

- Metrics

- millioner

- ML

- model

- modeller

- overvågning

- mere

- mest

- navne

- Natural

- Navigation

- netto

- netværk

- noder

- notesbog

- nummer

- Tilbud

- åbent

- open source

- åbner

- Operatører

- optimeret

- Option

- Indstillinger

- Andet

- egen

- Adgangskode

- ydeevne

- perron

- Platforme

- Punkt

- politikker

- pool

- præsentere

- prioritet

- forarbejdning

- Produkt

- Produkter

- Programmering

- projekt

- beskytte

- give

- giver

- leverer

- offentlige

- hurtigt

- nå

- Læsning

- årsager

- optage

- registreret

- frigive

- anmode

- påkrævet

- Krav

- ressource

- Ressourcer

- svar

- REST

- R

- Kør

- kører

- Skalerbarhed

- skalerbar

- Scale

- skalering

- Videnskab

- SDK

- SEK

- sekunder

- sikker

- sikkerhed

- Serverless

- tjeneste

- Tjenester

- sæt

- setup

- Aktier

- Skilte

- Simpelt

- Størrelse

- slæk

- søvn

- So

- Social

- Software

- Software Engineer

- solid

- løsninger

- Løsninger

- nogle

- noget

- kildekode

- specialist

- specialiserede

- specialiseret

- specifikt

- Stage

- starte

- påbegyndt

- starter

- Tilstand

- Status

- opbevaring

- butik

- Succesfuld

- support

- Understøtter

- systemet

- Systemer

- opgaver

- Teknisk

- The Source

- Gennem

- tid

- token

- værktøj

- værktøjer

- top

- spor

- Trafik

- Kurser

- overførsel

- Oversættelse

- transportere

- Traveling

- ui

- Opdatering

- opdateringer

- us

- brug

- brugere

- valideret

- værdi

- række

- forskellige

- verificere

- vision

- bind

- web

- webservices

- WHO

- inden for

- uden

- Arbejde

- arbejdede

- arbejder

- virker