Amazon SageMaker Ground Truth Plus hjælper dig med at forberede træningsdatasæt af høj kvalitet ved at fjerne de udifferentierede tunge løft, der er forbundet med bygning af datamærkningsapplikationer og styring af etiketteringsarbejdsstyrken. Alt du gør er at dele data sammen med mærkningskrav, og Ground Truth Plus opsætter og administrerer dit datamærkningsworkflow baseret på disse krav. Derfra mærker en ekspert arbejdsstyrke, der er trænet i en række maskinlæringsopgaver (ML) dine data. Du behøver ikke engang dyb ML-ekspertise eller viden om workflowdesign og kvalitetsstyring for at bruge Ground Truth Plus. Nu betjener Ground Truth Plus kunder, der har brug for datamærkning og menneskelig feedback til finjustering af fundamentmodeller til generative AI-applikationer.

I dette indlæg lærer du om de seneste fremskridt inden for menneskelig feedback til generativ kunstig intelligens, der er tilgængelig gennem SageMaker Ground Truth Plus. Dette inkluderer nye arbejdsgange og brugergrænseflader (UI'er), der er tilgængelige til at forberede demonstrationsdatasæt, der bruges i overvåget finjustering, indsamling af menneskelig feedback af høj kvalitet for at lave præferencedatasæt til at tilpasse generative AI-fundamentmodeller med menneskelige præferencer, samt tilpasning af modeller til applikationsbyggere ' krav til stil, substans og stemme.

Udfordringer ved at komme i gang med generativ kunstig intelligens

Generative AI-applikationer over hele verden inkorporerer både single-mode og multi-modale fundamentmodeller for at løse mange forskellige brugssager. Fælles blandt dem er chatbots, billedgeneratorer og videogeneratorer. Store sprogmodeller (LLM'er) bliver brugt i chatbots til kreative sysler, akademiske og personlige assistenter, business intelligence-værktøjer og produktivitetsværktøjer. Du kan bruge tekst-til-billede-modeller til at generere abstrakt eller realistisk AI-kunst og marketingaktiver. Tekst-til-video-modeller bliver brugt til at generere videoer til kunstprojekter, meget engagerende reklamer, udvikling af videospil og endda filmudvikling.

To af de vigtigste problemer at løse for både modelproducenter, der skaber fundamentmodeller og applikationsbyggere, der bruger eksisterende generative fundamentmodeller til at bygge deres egne værktøjer og applikationer, er:

- Finjustering af disse fundamentmodeller til at kunne udføre specifikke opgaver

- Juster dem med menneskelige præferencer for at sikre, at de udsender nyttige, nøjagtige og harmløse oplysninger

Fundamentmodeller er typisk fortrænede på store korpus af umærkede data og fungerer derfor ikke godt ved at følge instruktionerne i det naturlige sprog. For en LLM betyder det, at de muligvis er i stand til at parse og generere sprog generelt, men de er muligvis ikke i stand til at besvare spørgsmål sammenhængende eller opsummere tekst op til en brugers krævede kvalitet. For eksempel, når en bruger anmoder om et resumé af en tekst i en prompt, kan en model, der ikke er blevet finjusteret, hvordan man opsummerer tekst, måske bare recitere promptteksten tilbage til brugeren eller svare med noget irrelevant. Hvis en bruger stiller et spørgsmål om et emne, kan svaret fra en model blot være en recitation af spørgsmålet. For multimodale modeller, såsom tekst-til-billede eller tekst-til-video-modeller, kan modellerne udsende indhold, der ikke er relateret til prompten. For eksempel, hvis en virksomhedsgrafiker beder en tekst-til-billede-model om at oprette et nyt logo eller et billede til en annonce, genererer modellen muligvis ikke en relevant grafik relateret til prompten, hvis den kun har et generelt billede af et billede og elementer i et billede. I nogle tilfælde kan en model producere et skadeligt billede eller video, hvilket risikerer brugernes tillid eller virksomhedens omdømme.

Selvom modeller er finjusteret til at udføre specifikke opgaver, er de muligvis ikke afstemt med menneskelige præferencer med hensyn til betydningen, stilen eller substansen i deres outputindhold. I en LLM kan dette vise sig som unøjagtigt eller endda skadeligt indhold, der genereres af modellen. For eksempel kan en model, der ikke er tilpasset menneskelige præferencer gennem finjustering, udsende farlige, uetiske eller endda ulovlige instruktioner, når du bliver bedt om det af en bruger. Der vil ikke være blevet taget hensyn til at begrænse det indhold, der genereres af modellen for at sikre, at det er tilpasset menneskelige præferencer for at være nøjagtigt, relevant og nyttigt. Denne fejljustering kan være et problem for virksomheder, der er afhængige af generative AI-modeller til deres applikationer, såsom chatbots og multimedieoprettelse. For multimodale modeller kan dette tage form af giftige, farlige eller misbrugende billeder eller video, der genereres. Dette er en risiko, når prompter er input til modellen uden intention om at generere følsomt indhold, og også hvis modelproducenten eller applikationsbyggeren ikke havde tænkt sig at tillade modellen at generere den slags indhold, men det blev genereret alligevel.

For at løse problemerne med opgavespecifik kapacitet og afstemme generative fundamentmodeller med menneskelige præferencer, skal modelproducenter og applikationsbyggere finjustere modellerne med data ved hjælp af menneskestyrede demonstrationer og menneskelig feedback af modeloutput.

Data og træningstyper

Der er flere typer finjusteringsmetoder med forskellige typer mærkede data, der er kategoriseret som instruktionsjustering - eller lære en model, hvordan man følger instruktioner. Blandt dem er overvåget finjustering (SFT) ved hjælp af demonstrationsdata og forstærkningslæring fra menneskelig feedback (RLHF) ved hjælp af præferencedata.

Demonstrationsdata til overvåget finjustering

For at finjustere fundamentmodeller til at udføre specifikke opgaver som at besvare spørgsmål eller opsummere tekst med høj kvalitet, gennemgår modellerne SFT med demonstrationsdata. Formålet med demonstrationsdata er at vejlede modellen ved at forsyne den med mærkede eksempler (demonstrationer) på udførte opgaver, der udføres af mennesker. For for eksempel at lære en LLM, hvordan man besvarer spørgsmål, vil en menneskelig annotator oprette et mærket datasæt med menneskeskabte spørgsmål og svar-par for at demonstrere, hvordan en spørgsmål og svar-interaktion fungerer sprogligt, og hvad indholdet betyder semantisk. Denne form for SFT træner modellen til at genkende adfærdsmønstre demonstreret af mennesker i demonstrationstræningsdataene. Modelproducenter skal foretage denne type finjustering for at vise, at deres modeller er i stand til at udføre sådanne opgaver for downstream-adoptere. Applikationsbyggere, der bruger eksisterende fundamentmodeller til deres generative AI-applikationer, skal muligvis finjustere deres modeller med demonstrationsdata om disse opgaver med branchespecifikke eller virksomhedsspecifikke data for at forbedre deres applikationers relevans og nøjagtighed.

Præferencedata for instruktionsindstilling såsom RLHF

For yderligere at tilpasse fundamentmodeller til menneskelige præferencer skal modelproducenter – og især applikationsbyggere – generere præferencedatasæt for at udføre instruktionsjustering. Præferencedata i forbindelse med instruktionsjustering er mærkede data, der fanger menneskelig feedback med hensyn til et sæt valgmuligheder, som udlæses af en generativ fundamentmodel. Det omfatter typisk vurdering eller rangering af flere slutninger eller parvis sammenligning af to slutninger fra en fundamentmodel i henhold til en specifik egenskab. For LLM'er kan disse egenskaber være hjælpsomhed, nøjagtighed og harmløshed. For tekst-til-billede-modeller kan det være en æstetisk kvalitet eller tekst-billede-justering. Disse præferencedata baseret på menneskelig feedback kan derefter bruges i forskellige instruktionsjusteringsmetoder – inklusive RLHF – for yderligere at finjustere en model, så den stemmer overens med menneskelige præferencer.

Instruktionsjustering ved hjælp af præferencedata spiller en afgørende rolle i at forbedre personaliseringen og effektiviteten af fundamentmodeller. Dette er et nøgletrin i opbygningen af brugerdefinerede applikationer oven på forudtrænede fundamentmodeller og er en kraftfuld metode til at sikre, at modeller genererer nyttigt, nøjagtigt og harmløst indhold. Et almindeligt eksempel på instruktionsjustering er at instruere en chatbot til at generere tre svar på en forespørgsel og få en menneskelig til at læse og rangere alle tre i henhold til en bestemt dimension, såsom toksicitet, faktuel nøjagtighed eller læsbarhed. For eksempel kan en virksomhed bruge en chatbot til sin marketingafdeling og ønsker at sikre sig, at indholdet er tilpasset dets brandbudskab, ikke udviser skævheder og er klart læsbart. Virksomheden ville bede chatbotten under instruktionsjustering om at producere tre eksempler og få deres interne eksperter til at vælge dem, der passer bedst til deres mål. Over tid bygger de et datasæt, der bruges til at lære modellen, hvilken stil af indhold mennesker foretrækker gennem forstærkende læring. Dette gør det muligt for chatbot-applikationen at udsende mere relevant, læsbart og sikkert indhold.

SageMaker Ground Truth Plus

Ground Truth Plus hjælper dig med at tackle begge udfordringer – generering af demonstrationsdatasæt med opgavespecifikke egenskaber samt indsamling af præferencedatasæt fra menneskelig feedback for at tilpasse modeller til menneskelige præferencer. Du kan anmode om projekter for LLM'er og multimodale modeller såsom tekst-til-billede og tekst-til-video. For LLM'er omfatter nøgledemonstrationsdatasæt generering af spørgsmål og svar (Q&A), tekstresumé, tekstgenerering og tekstbearbejdning med henblik på indholdsmoderering, stilændring eller længdeændring. Nøgle LLM-præferencedatasæt inkluderer rangering og klassificering af tekstoutput. For multimodale modeller omfatter nøgleopgavetyper billedtekstbilleder eller videoer samt logning af tidsstempler for begivenheder i videoer. Derfor kan Ground Truth Plus hjælpe både modelproducenter og applikationsbyggere på deres generative AI-rejse.

I dette indlæg dykker vi dybere ned i den menneskelige annotator- og feedbackrejse på fire cases, der dækker både demonstrationsdata og præferencedata for både LLM'er og multimodale modeller: generering af spørgsmål og svar-par og tekstrangering for LLM'er, såvel som billedtekstning og videotekstning til multimodale modeller.

Store sprogmodeller

I dette afsnit diskuterer vi spørgsmål og svar-par og tekstrangering for LLM'er, sammen med tilpasninger, du måtte ønske til din brugssituation.

Spørgsmål og svar par

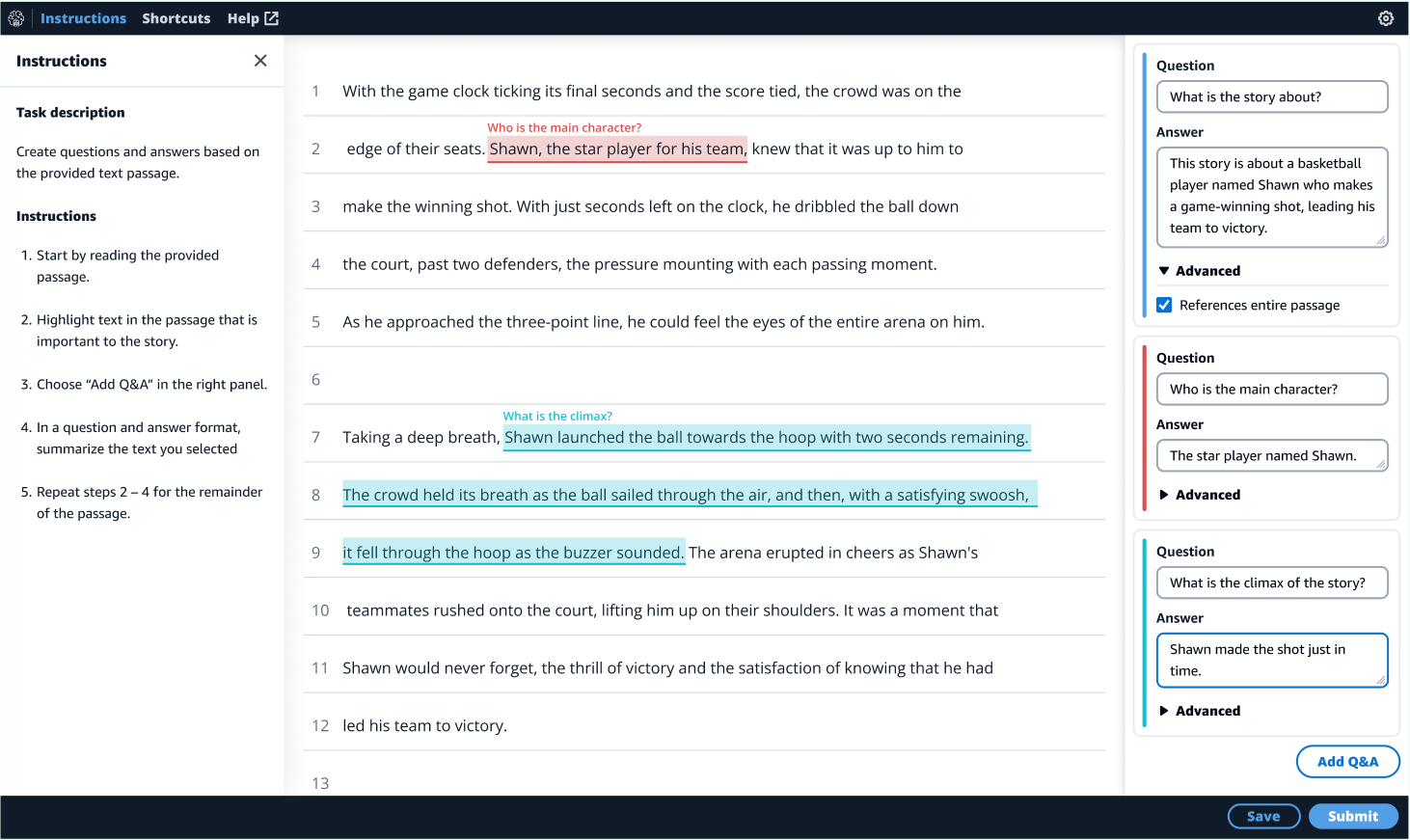

Følgende skærmbillede viser en mærkningsbrugergrænseflade, hvor en menneskelig annotator vil læse en tekstpassage og generere både spørgsmål og svar i processen med at bygge et Q&A-demonstrationsdatasæt.

Lad os gå gennem en rundvisning i brugergrænsefladen i annotatorens sko. På venstre side af brugergrænsefladen præsenteres jobanmoderens specifikke instruktioner for annotatoren. I dette tilfælde er det meningen, at annotatoren skal læse teksten, der præsenteres i midten af brugergrænsefladen, og skabe spørgsmål og svar baseret på teksten. I højre side vises de spørgsmål og svar, som kommentatoren har skrevet. Tekstpassagen samt type, længde og antal spørgsmål og svar kan alle tilpasses af jobanmoderen under projektopsætningen med Ground Truth Plus-teamet. I dette tilfælde har kommentatoren oprettet et spørgsmål, der kræver at forstå hele tekstpassagen for at kunne besvare og er markeret med en Henviser til hele passagen afkrydsningsfeltet. De to andre spørgsmål og svar er baseret på specifikke dele af tekstpassagen, som vist af annotatorens højdepunkter med farvekodet matchning. Du kan eventuelt anmode om, at spørgsmål og svar genereres uden en medfølgende tekstpassage, og give andre retningslinjer for menneskelige annotatorer - dette understøttes også af Ground Truth Plus.

Efter at spørgsmålene og svarene er indsendt, kan de flyde til en valgfri kvalitetskontrolløkke-workflow, hvor andre menneskelige anmeldere vil bekræfte, at kundedefineret distribution og typer af spørgsmål og svar er blevet oprettet. Hvis der er et misforhold mellem kundens krav og det, den menneskelige annotator har produceret, vil arbejdet blive ført tilbage til et menneske for omarbejdelse, før det eksporteres som en del af datasættet for at levere til kunden. Når datasættet er leveret tilbage til dig, er det klar til at blive integreret i den overvågede finjusteringsarbejdsgang efter eget skøn.

Tekstrangering

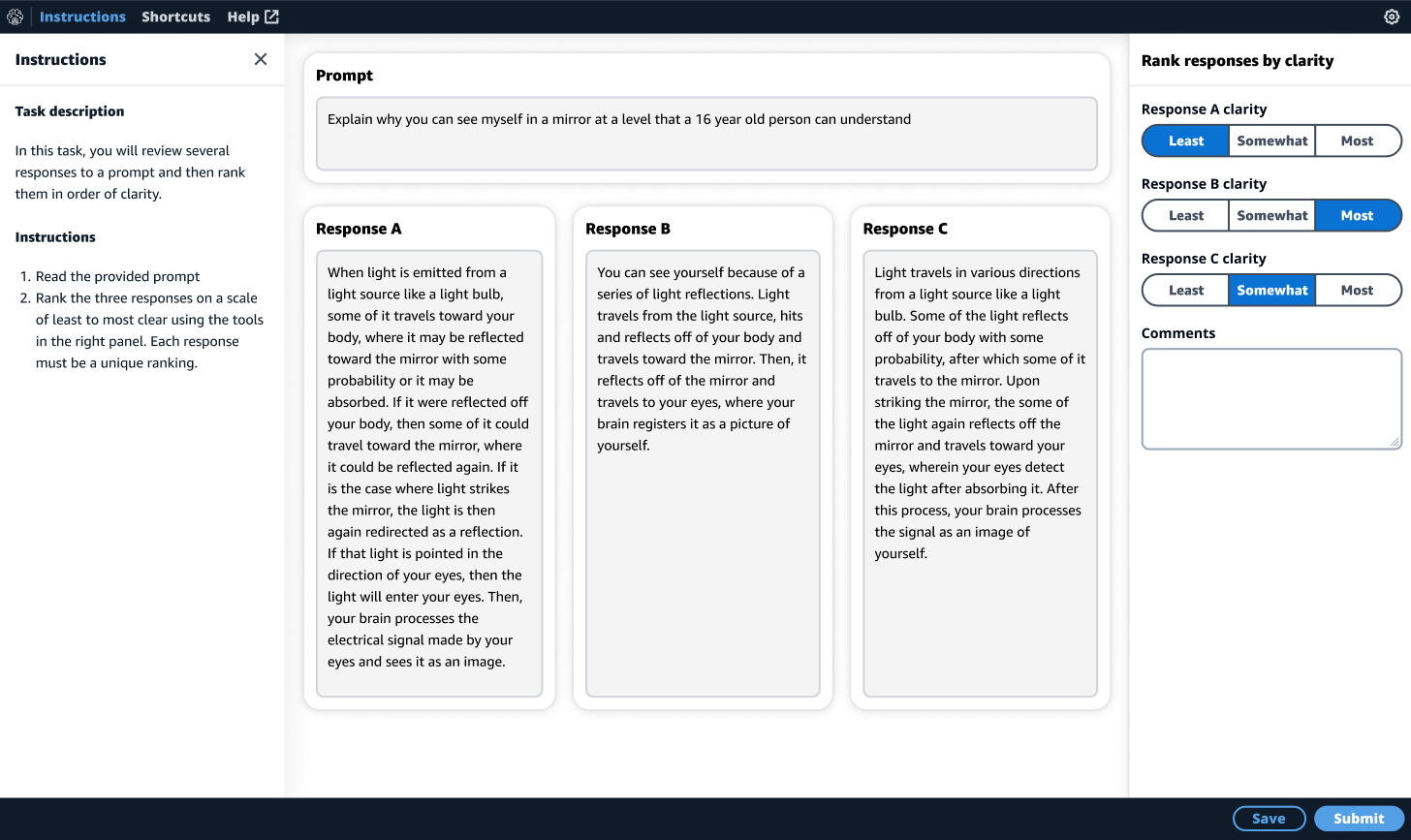

Følgende skærmbillede viser en brugergrænseflade til rangering af output fra en LLM baseret på en prompt.

Du kan blot skrive instruktionerne til den menneskelige anmelder og bringe meddelelser og forudgenererede svar til Ground Truth Plus-projektteamet for at starte jobbet. I dette tilfælde har vi anmodet en menneskelig anmelder om at rangere tre svar pr. prompt fra en LLM om dimensionen af skriveklarhed (læsbarhed). Igen viser venstre rude instruktionerne givet til anmelderen af jobanmoderen. I midten er prompten øverst på siden, og de tre forudgenererede svar er hovedteksten for brugervenlighed. På højre side af brugergrænsefladen vil den menneskelige anmelder rangordne dem i rækkefølge efter mest til mindst tydelig skrift.

Kunder, der ønsker at generere denne type præferencedatasæt, omfatter applikationsbyggere, der er interesseret i at bygge menneskelignende chatbots og ønsker derfor at tilpasse instruktionerne til deres eget brug. Længden af prompten, antallet af svar og rangeringsdimensionen kan alle tilpasses. Du kan f.eks. rangordne fem svar i rækkefølge af de fleste til mindst faktuelt nøjagtige, forudindtaget eller giftige, eller endda rangere og klassificere flere dimensioner samtidigt. Disse tilpasninger understøttes i Ground Truth Plus.

Multimodale modeller

I dette afsnit diskuterer vi billed- og videotekstning til træning af multimodale modeller såsom tekst-til-billede og tekst-til-video-modeller, samt tilpasninger, du måske ønsker at lave til din særlige brugssag.

Billedtekstning

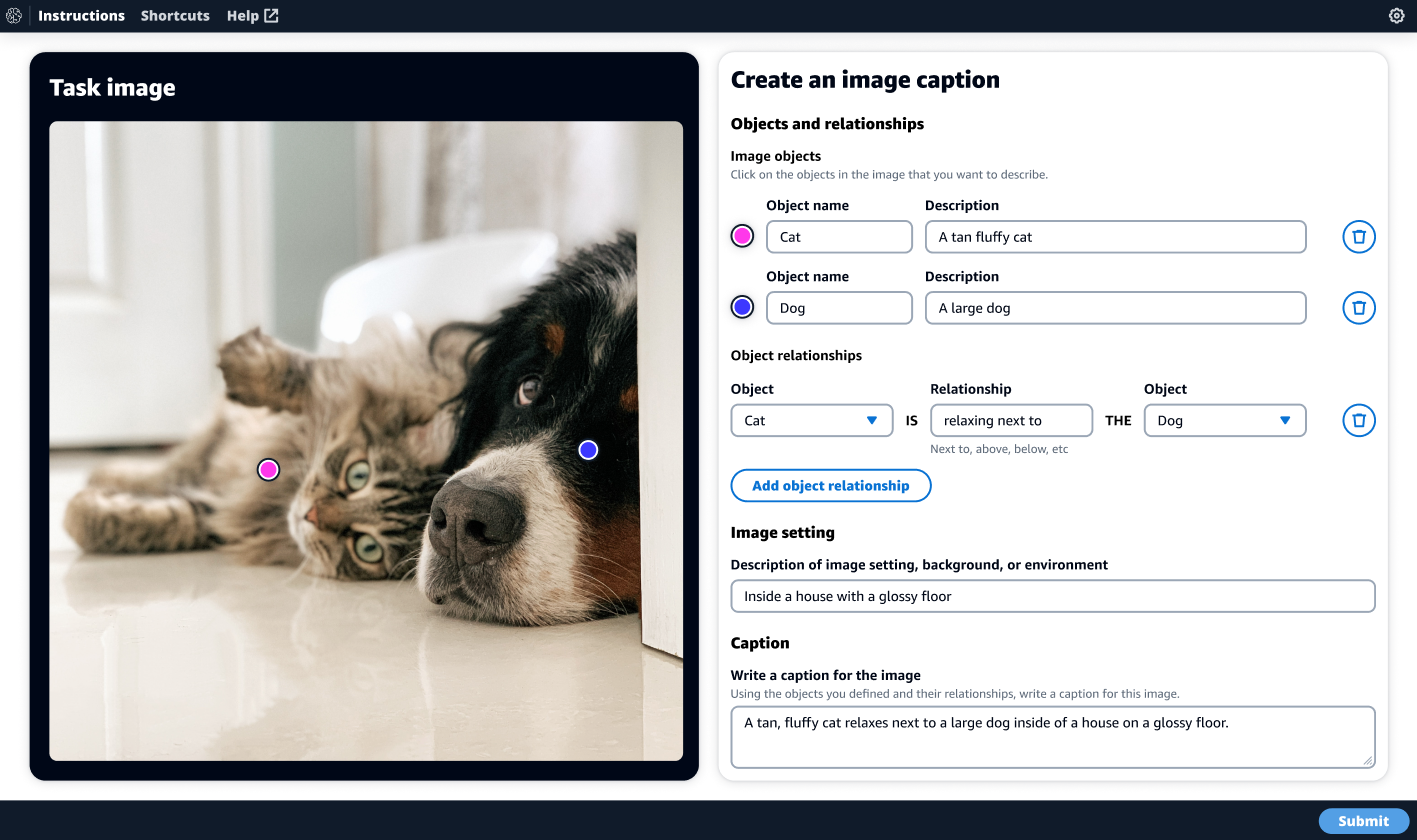

Følgende skærmbillede viser en mærkningsbrugergrænseflade til billedtekstning. Du kan anmode om et projekt med billedtekster for at indsamle data for at træne en tekst-til-billede-model eller en billed-til-tekst-model.

I dette tilfælde har vi bedt om at træne en tekst-til-billede-model og har stillet specifikke krav til billedteksten med hensyn til længde og detaljer. Brugergrænsefladen er designet til at lede de menneskelige annotatorer gennem den kognitive proces med at generere fyldige billedtekster ved at give en mental ramme gennem assisterende og beskrivende værktøjer. Vi har fundet ud af, at tilvejebringelse af denne mentale ramme for annotatorer resulterer i mere beskrivende og nøjagtige billedtekster end blot at levere en redigerbar tekstboks alene.

Det første trin i rammen er, at den menneskelige annotator identificerer nøgleobjekter i billedet. Når annotatoren vælger et objekt i billedet, vises en farvekodet prik på objektet. I dette tilfælde har annotatoren valgt både hunden og katten og skabt to redigerbare felter i højre side af brugergrænsefladen, hvor annotatoren vil indtaste navnene på objekterne - kat og hund - sammen med en detaljeret beskrivelse af hvert objekt. Dernæst guides annotatoren til at identificere alle relationerne mellem alle objekterne i billedet. I dette tilfælde slapper katten af ved siden af hunden. Dernæst bliver annotatoren bedt om at identificere specifikke attributter ved billedet, såsom indstillingen, baggrunden eller miljøet. Til sidst, i tekstboksen til indtastning af billedtekst, bliver annotatoren bedt om at kombinere alt det, de skrev i objekter, relationer og billedindstillingsfelter til en komplet enkelt beskrivende billedtekst af billedet.

Du kan eventuelt konfigurere denne billedtekst til at blive sendt gennem en menneskebaseret kvalitetskontrolløkke med specifikke instruktioner for at sikre, at billedteksten opfylder kravene. Hvis der er identificeret et problem, såsom et manglende nøgleobjekt, kan denne billedtekst sendes tilbage, så et menneske kan rette problemet, før det eksporteres som en del af træningsdatasættet.

Video undertekster

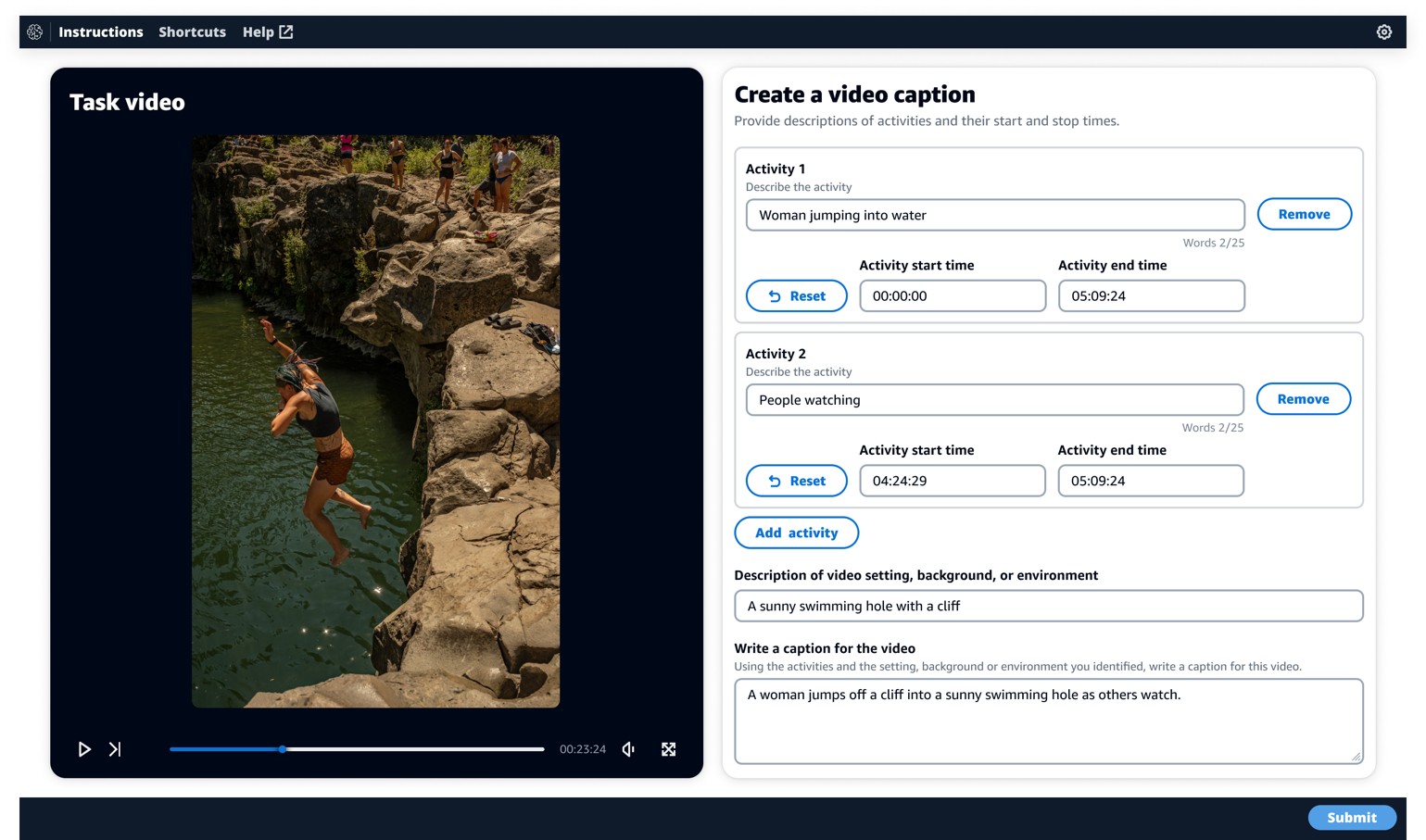

Følgende skærmbillede viser en brugergrænseflade til videotekstning til at generere fyldige videotekster med tidsstempelmærker. Du kan anmode om et videotekstprojekt for at indsamle data for at bygge tekst-til-video eller video-til-tekst-modeller.

I denne mærkningsbrugergrænseflade har vi bygget en lignende mental ramme for at sikre, at der skrives billedtekster af høj kvalitet. Den menneskelige annotator kan styre videoen i venstre side og oprette beskrivelser og tidsstempler for hver aktivitet, der vises i videoen i højre side med UI-elementerne. I lighed med brugergrænsefladen for billedtekster er der også et sted, hvor annotatoren kan skrive en detaljeret beskrivelse af videoens indstilling, baggrund og miljø. Til sidst bliver annotatoren instrueret i at kombinere alle elementerne til en sammenhængende videotekst.

I lighed med tilfældet med billedtekster kan videoteksterne eventuelt flyde gennem et menneskebaseret kvalitetskontrolworkflow for at afgøre, om dine krav er opfyldt. Hvis der er et problem med videoteksterne, vil den blive sendt til omarbejdelse af den menneskelige annotator-arbejdsstyrke.

Konklusion

Ground Truth Plus kan hjælpe dig med at forberede datasæt af høj kvalitet til at finjustere fundamentmodeller til generative AI-opgaver, fra besvarelse af spørgsmål til generering af billeder og videoer. Det giver også dygtige menneskelige arbejdsstyrker mulighed for at gennemgå modeloutput for at sikre, at de er i overensstemmelse med menneskelige præferencer. Derudover gør det applikationsbyggere i stand til at tilpasse modeller ved hjælp af deres branche- eller virksomhedsdata for at sikre, at deres applikation repræsenterer deres foretrukne stemme og stil. Disse er den første af mange innovationer i Ground Truth Plus, og flere er under udvikling. Følg med for fremtidige indlæg.

Interesseret i at starte et projekt for at bygge eller forbedre dine generative AI-modeller og applikationer? Kom godt i gang med Ground Truth Plus af forbinder med vores team i dag.

Om forfatterne

Jesse Manders er en Senior Product Manager i AWS AI/ML human in the loop services team. Han arbejder i krydsfeltet mellem AI og menneskelig interaktion med det mål at skabe og forbedre AI/ML-produkter og -tjenester for at imødekomme vores behov. Tidligere havde Jesse lederroller inden for ingeniørarbejde hos Apple og Lumileds og var seniorforsker i en Silicon Valley-startup. Han har en M.S. og ph.d. fra University of Florida og en MBA fra University of California, Berkeley, Haas School of Business.

Jesse Manders er en Senior Product Manager i AWS AI/ML human in the loop services team. Han arbejder i krydsfeltet mellem AI og menneskelig interaktion med det mål at skabe og forbedre AI/ML-produkter og -tjenester for at imødekomme vores behov. Tidligere havde Jesse lederroller inden for ingeniørarbejde hos Apple og Lumileds og var seniorforsker i en Silicon Valley-startup. Han har en M.S. og ph.d. fra University of Florida og en MBA fra University of California, Berkeley, Haas School of Business.

Romi Datta er en Senior Manager for Product Management i Amazon SageMaker-teamet med ansvar for Human in the Loop-tjenesterne. Han har været i AWS i over 4 år, og han har haft flere lederroller inden for produktledelse i SageMaker, S3 og IoT. Før AWS arbejdede han i forskellige produktledelses-, ingeniør- og operationelle lederroller hos IBM, Texas Instruments og Nvidia. Han har en M.S. og ph.d. i Electrical and Computer Engineering fra University of Texas i Austin og en MBA fra University of Chicago Booth School of Business.

Romi Datta er en Senior Manager for Product Management i Amazon SageMaker-teamet med ansvar for Human in the Loop-tjenesterne. Han har været i AWS i over 4 år, og han har haft flere lederroller inden for produktledelse i SageMaker, S3 og IoT. Før AWS arbejdede han i forskellige produktledelses-, ingeniør- og operationelle lederroller hos IBM, Texas Instruments og Nvidia. Han har en M.S. og ph.d. i Electrical and Computer Engineering fra University of Texas i Austin og en MBA fra University of Chicago Booth School of Business.

Jonathan Buck er softwareingeniør hos Amazon Web Services, der arbejder i skæringspunktet mellem maskinlæring og distribuerede systemer. Hans arbejde involverer produktion af maskinlæringsmodeller og udvikling af nye softwareapplikationer drevet af maskinlæring for at lægge de nyeste muligheder i hænderne på kunderne.

Jonathan Buck er softwareingeniør hos Amazon Web Services, der arbejder i skæringspunktet mellem maskinlæring og distribuerede systemer. Hans arbejde involverer produktion af maskinlæringsmodeller og udvikling af nye softwareapplikationer drevet af maskinlæring for at lægge de nyeste muligheder i hænderne på kunderne.

Alex Williams er en anvendt videnskabsmand i human-in-the-loop videnskabsteamet hos AWS AI, hvor han udfører interaktiv systemforskning i krydsfeltet mellem menneske-computer-interaktion (HCI) og maskinlæring. Inden han kom til Amazon, var han professor i afdelingen for elektroteknik og datalogi ved University of Tennessee, hvor han var med til at lede forskningslaboratoriet People, Agents, Interactions and Systems (PAIRS). Han har også haft forskningsstillinger hos Microsoft Research, Mozilla Research og University of Oxford. Han udgiver regelmæssigt sit arbejde på førende udgivelsessteder for HCI, såsom CHI, CSCW og UIST. Han har en ph.d. fra University of Waterloo.

Alex Williams er en anvendt videnskabsmand i human-in-the-loop videnskabsteamet hos AWS AI, hvor han udfører interaktiv systemforskning i krydsfeltet mellem menneske-computer-interaktion (HCI) og maskinlæring. Inden han kom til Amazon, var han professor i afdelingen for elektroteknik og datalogi ved University of Tennessee, hvor han var med til at lede forskningslaboratoriet People, Agents, Interactions and Systems (PAIRS). Han har også haft forskningsstillinger hos Microsoft Research, Mozilla Research og University of Oxford. Han udgiver regelmæssigt sit arbejde på førende udgivelsessteder for HCI, såsom CHI, CSCW og UIST. Han har en ph.d. fra University of Waterloo.

Sarah Gao er en Software Development Manager i Amazon SageMaker Human In the Loop (HIL) ansvarlig for opbygningen af den ML-baserede mærkningsplatform. Sarah har været i AWS i over 4 år og har haft flere lederroller inden for softwareadministration i EC2-sikkerhed og SageMaker. Før AWS arbejdede hun i forskellige ingeniørledelsesroller hos Oracle og Sun Microsystem.

Sarah Gao er en Software Development Manager i Amazon SageMaker Human In the Loop (HIL) ansvarlig for opbygningen af den ML-baserede mærkningsplatform. Sarah har været i AWS i over 4 år og har haft flere lederroller inden for softwareadministration i EC2-sikkerhed og SageMaker. Før AWS arbejdede hun i forskellige ingeniørledelsesroller hos Oracle og Sun Microsystem.

Erran Li er anvendt videnskabschef hos human-in-the-loop services, AWS AI, Amazon. Hans forskningsinteresser er 3D deep learning og læring af vision og sprogrepræsentation. Tidligere var han seniorforsker hos Alexa AI, leder af maskinlæring hos Scale AI og chefforsker hos Pony.ai. Før det var han sammen med perceptionsteamet hos Uber ATG og maskinlæringsplatformteamet hos Uber, der arbejdede med maskinlæring til autonom kørsel, maskinlæringssystemer og strategiske initiativer inden for AI. Han startede sin karriere på Bell Labs og var adjungeret professor ved Columbia University. Han underviste i tutorials på ICML'17 og ICCV'19 og var med til at organisere adskillige workshops på NeurIPS, ICML, CVPR, ICCV om maskinlæring til autonom kørsel, 3D-vision og robotteknologi, maskinlæringssystemer og adversarial machine learning. Han har en PhD i datalogi ved Cornell University. Han er ACM Fellow og IEEE Fellow.

Erran Li er anvendt videnskabschef hos human-in-the-loop services, AWS AI, Amazon. Hans forskningsinteresser er 3D deep learning og læring af vision og sprogrepræsentation. Tidligere var han seniorforsker hos Alexa AI, leder af maskinlæring hos Scale AI og chefforsker hos Pony.ai. Før det var han sammen med perceptionsteamet hos Uber ATG og maskinlæringsplatformteamet hos Uber, der arbejdede med maskinlæring til autonom kørsel, maskinlæringssystemer og strategiske initiativer inden for AI. Han startede sin karriere på Bell Labs og var adjungeret professor ved Columbia University. Han underviste i tutorials på ICML'17 og ICCV'19 og var med til at organisere adskillige workshops på NeurIPS, ICML, CVPR, ICCV om maskinlæring til autonom kørsel, 3D-vision og robotteknologi, maskinlæringssystemer og adversarial machine learning. Han har en PhD i datalogi ved Cornell University. Han er ACM Fellow og IEEE Fellow.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoAiStream. Web3 Data Intelligence. Viden forstærket. Adgang her.

- Udmøntning af fremtiden med Adryenn Ashley. Adgang her.

- Køb og sælg aktier i PRE-IPO-virksomheder med PREIPO®. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/high-quality-human-feedback-for-your-generative-ai-applications-from-amazon-sagemaker-ground-truth-plus/

- :har

- :er

- :ikke

- :hvor

- $OP

- 100

- 3d

- 7

- a

- I stand

- Om

- ABSTRACT

- akademisk

- Ifølge

- nøjagtighed

- præcis

- ACM

- aktivitet

- Derudover

- adresse

- adoptanter

- fremskridt

- kontradiktorisk

- reklame

- igen

- midler

- AI

- ai kunst

- AI / ML

- Alexa

- tilpasse

- justeret

- tilpasning

- Alle

- tillade

- tillader

- alene

- sammen

- også

- Amazon

- Amazon SageMaker

- Amazon SageMaker Ground Truth

- Amazon Web Services

- blandt

- an

- ,

- besvare

- svar

- kommer til syne

- Apple

- Anvendelse

- applikationer

- anvendt

- ER

- omkring

- Kunst

- AS

- Aktiver

- assistenter

- forbundet

- At

- attributter

- austin

- autonom

- til rådighed

- AWS

- tilbage

- baggrund

- baseret

- BE

- været

- før

- være

- Bell

- Berkeley

- mellem

- forudindtaget

- fordomme

- krop

- både

- Boks

- brand

- bringe

- bygge

- Builder

- bygherrer

- Bygning

- bygget

- virksomhed

- business intelligence

- men

- by

- california

- CAN

- kapaciteter

- stand

- billedtekster

- fanger

- hvilken

- Karriere

- tilfælde

- tilfælde

- KAT

- center

- lave om

- chatbot

- chatbots

- kontrollere

- Chicago

- chef

- valgt

- klarhed

- Klassificere

- klar

- tydeligt

- kognitive

- SAMMENHÆNGENDE

- COLUMBIA

- kombinerer

- Fælles

- Virksomheder

- selskab

- sammenligne

- fuldføre

- Afsluttet

- computer

- Computer Engineering

- Datalogi

- Konceptet

- adfærd

- tillid

- Bekræfte

- indhold

- sammenhæng

- kontrol

- Cornell

- Corporate

- korrigere

- kunne

- dækker

- skabe

- oprettet

- Oprettelse af

- skabelse

- Kreativ

- afgørende

- skik

- kunde

- Kunder

- tilpasse

- tilpassede

- Dangerous

- data

- datasæt

- dyb

- dyb læring

- dybere

- levere

- leveret

- demonstrere

- demonstreret

- Afdeling

- beskrivelse

- Design

- konstrueret

- Designer

- detail

- detaljeret

- Bestem

- udvikling

- Udvikling

- forskellige

- Dimension

- størrelse

- diskretion

- diskutere

- distribueret

- distribuerede systemer

- fordeling

- do

- Er ikke

- Dog

- færdig

- Dont

- DOT

- kørsel

- i løbet af

- hver

- lette

- brugervenlighed

- effektivitet

- elementer

- muliggør

- engagerende

- ingeniør

- Engineering

- styrke

- sikre

- Indtast

- Hele

- Miljø

- især

- Endog

- begivenheder

- eksempel

- eksempler

- udstille

- eksisterende

- ekspert

- ekspertise

- eksperter

- tilbagemeldinger

- fyr

- Fields

- Film

- Endelig

- Fornavn

- florida

- flow

- følger

- efter

- Til

- formular

- fundet

- Foundation

- fire

- Framework

- fra

- yderligere

- fremtiden

- spil

- spiludvikling

- GAO

- samle

- indsamling

- Generelt

- generere

- genereret

- generere

- generation

- generative

- Generativ AI

- generatorer

- få

- få

- given

- mål

- Grafisk

- Ground

- vejlede

- retningslinjer

- havde

- hænder

- skadelig

- Have

- HCI

- he

- hoved

- tunge

- tunge løft

- Held

- hjælpe

- hjælpsom

- hjælper

- Høj

- høj kvalitet

- højdepunkter

- stærkt

- hans

- bedrift

- besidder

- Hvordan

- How To

- HTML

- HTTPS

- menneskelig

- Mennesker

- IBM

- identificeret

- identificere

- IEEE

- if

- Ulovlig

- billede

- billeder

- vigtigt

- Forbedre

- forbedring

- in

- forkert

- omfatter

- omfatter

- indarbejde

- industrien

- industri-specifikke

- initiativer

- innovationer

- indgang

- anvisninger

- instrumenter

- Intelligens

- beregnet

- Intention

- interaktion

- interaktioner

- interaktiv

- interesseret

- interesser

- grænseflader

- interne

- vejkryds

- ind

- tingenes internet

- spørgsmål

- spørgsmål

- IT

- ITS

- selv

- Job

- sammenføjning

- rejse

- jpg

- lige

- Nøgle

- Venlig

- viden

- mærkning

- Etiketter

- laboratorium

- Labs

- Sprog

- stor

- seneste

- Leadership" (virkelig menneskelig ledelse)

- LÆR

- læring

- mindst

- til venstre

- Længde

- løft

- GRÆNSE

- LLM

- logning

- logo

- maskine

- machine learning

- Main

- lave

- ledelse

- leder

- administrerer

- styring

- mange

- markeret

- Marketing

- matchende

- Kan..

- betyder

- midler

- Mød

- opfylder

- mentale

- besked

- metode

- metoder

- microsoft

- mangler

- ML

- model

- modeller

- mådehold

- mere

- mest

- Mozilla

- multimedie

- flere

- skal

- navne

- Natural

- Behov

- behov

- Ny

- næste

- ingen

- roman

- nu

- nummer

- Nvidia

- objekt

- objekter

- of

- on

- dem

- kun

- operationelle

- Indstillinger

- or

- oracle

- ordrer

- Andet

- vores

- output

- i løbet af

- egen

- Oxford

- side

- par

- par

- brød

- del

- særlig

- dele

- Bestået

- mønstre

- Mennesker

- opfattelsen

- Udfør

- udfører

- personale

- Personalisering

- Place

- perron

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- plus

- positioner

- Indlæg

- Indlæg

- strøm

- vigtigste

- foretrække

- præferencer

- foretrækkes

- premier

- Forbered

- forberede

- forelagt

- tidligere

- Forud

- Problem

- problemer

- behandle

- producere

- produceret

- producent

- Producenter

- Produkt

- produktstyring

- produktchef

- produktivitet

- Produkter

- Professor

- projekt

- projekter

- give

- forudsat

- leverer

- Offentliggørelse

- Udgiver

- formål

- formål

- sætte

- Spørgsmål og svar

- kvalitet

- spørgsmål

- Spørgsmål

- Ranking

- bedømmelse

- Læs

- klar

- realistisk

- nylige

- genkende

- regelmæssigt

- relaterede

- Relationer

- relevant

- stole

- fjernelse

- repræsentation

- repræsenterer

- omdømme

- anmode

- anmodninger

- påkrævet

- Krav

- Kræver

- forskning

- respekt

- Svar

- svar

- reaktioner

- ansvarlige

- Resultater

- gennemgå

- Rich

- højre

- Risiko

- risikere

- robotteknik

- roller

- roller

- s

- sikker

- sagemaker

- Scale

- skala ai

- Skole

- Videnskab

- Videnskabsmand

- Sektion

- sikkerhed

- senior

- følsom

- sendt

- Tjenester

- servering

- sæt

- sæt

- indstilling

- setup

- flere

- Del

- hun

- Vis

- vist

- Shows

- side

- Silicon

- Silicon Valley

- lignende

- ganske enkelt

- samtidigt

- enkelt

- faglært

- Software

- softwareudvikling

- Software Engineer

- SOLVE

- nogle

- noget

- specifikke

- specificeret

- starte

- påbegyndt

- Starter

- opstart

- forblive

- Trin

- Strategisk

- stil

- indsendt

- stof

- sådan

- opsummere

- RESUMÉ

- Sol

- Understøttet

- formodes

- Systemer

- Tag

- taget

- Opgaver

- opgaver

- Undervisning

- hold

- Tennessee

- vilkår

- Texas

- end

- at

- verdenen

- deres

- Them

- derefter

- Der.

- derfor

- Disse

- de

- denne

- tre

- Gennem

- tid

- tidsstempel

- til

- i dag

- værktøjer

- top

- emne

- Tour

- Tog

- uddannet

- Kurser

- tog

- Sandheden

- tutorials

- to

- typen

- typer

- typisk

- Uber

- ui

- forståelse

- universitet

- University of California

- University of Chicago

- University of Oxford

- brug

- brug tilfælde

- anvendte

- Bruger

- ved brug af

- Dal

- række

- forskellige

- handelssystemer

- video

- video game

- Videoer

- vision

- Voice

- ønsker

- ønsker

- ønsker

- var

- we

- web

- webservices

- GODT

- Hvad

- hvornår

- som

- WHO

- Hele

- vilje

- med

- uden

- Arbejde

- arbejdede

- workflow

- arbejdsgange

- Workforce

- arbejder

- virker

- workshops

- world

- ville

- skriver

- skrivning

- skriftlig

- år

- Du

- Din

- zephyrnet