Vi er vidne til en hurtig stigning i vedtagelsen af store sprogmodeller (LLM), der driver genererende AI-applikationer på tværs af industrier. LLM'er er i stand til en række forskellige opgaver, såsom at generere kreativt indhold, besvare forespørgsler via chatbots, generere kode og mere.

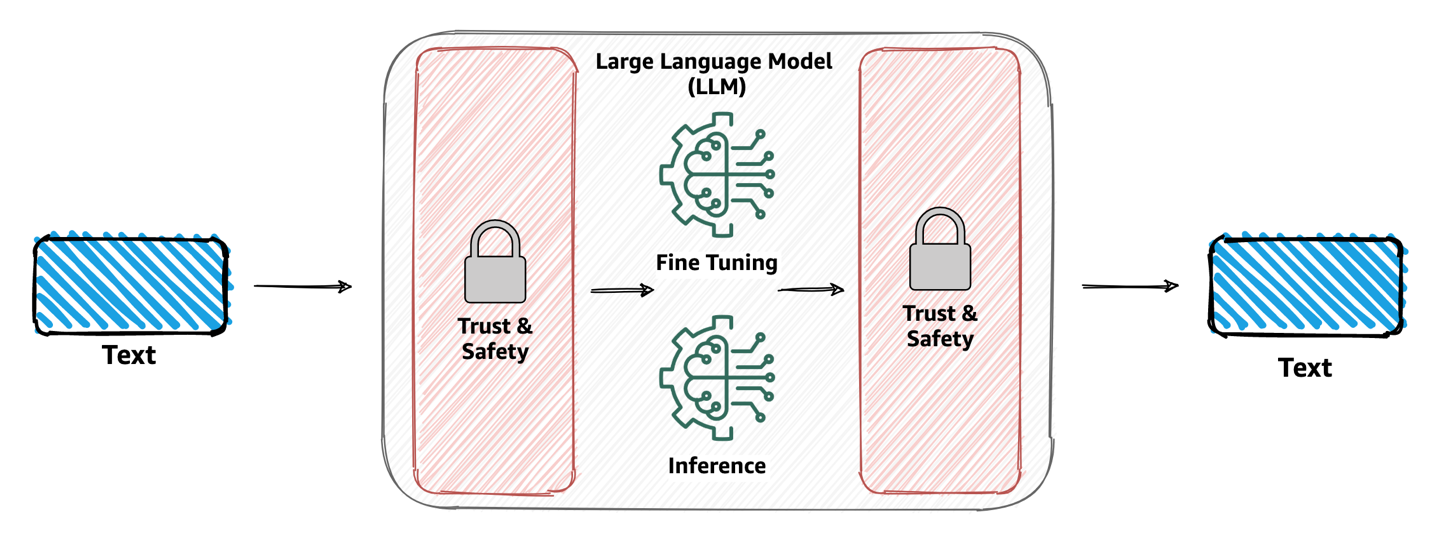

Organisationer, der ønsker at bruge LLM'er til at drive deres applikationer, er i stigende grad på vagt over for databeskyttelse for at sikre, at tillid og sikkerhed opretholdes i deres generative AI-applikationer. Dette omfatter håndtering af kunders personligt identificerbare oplysninger (PII) data korrekt. Det omfatter også at forhindre misbrug og usikkert indhold i at blive udbredt til LLM'er og at kontrollere, at data genereret af LLM'er følger de samme principper.

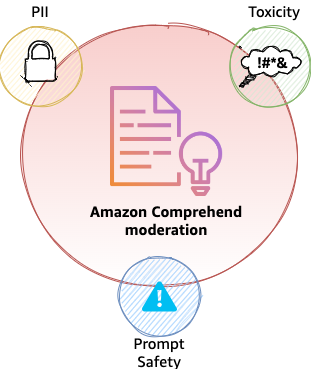

I dette indlæg diskuterer vi nye funktioner drevet af Amazon Comprehend der muliggør problemfri integration for at sikre databeskyttelse, indholdssikkerhed og hurtig sikkerhed i nye og eksisterende generative AI-applikationer.

Amazon Comprehend er en NLP-tjeneste (natural language processing), der bruger maskinlæring (ML) til at afdække information i ustrukturerede data og tekst i dokumenter. I dette indlæg diskuterer vi, hvorfor tillid og sikkerhed med LLM'er betyder noget for dine arbejdsbyrder. Vi dykker også dybere ned i, hvordan disse nye modereringsfunktioner udnyttes med den populære generative AI-udviklingsramme Langkæde at introducere en brugerdefinerbar tillids- og sikkerhedsmekanisme til din brugssag.

Hvorfor tillid og sikkerhed med LLM'er betyder noget

Tillid og sikkerhed er altafgørende, når du arbejder med LLM'er på grund af deres dybe indvirkning på en lang række applikationer, fra kundesupport chatbots til indholdsgenerering. Efterhånden som disse modeller behandler enorme mængder data og genererer menneskelignende svar, øges potentialet for misbrug eller utilsigtede resultater. Det er afgørende at sikre, at disse AI-systemer fungerer inden for etiske og pålidelige grænser, ikke kun for omdømmet for virksomheder, der bruger dem, men også for at bevare tilliden hos slutbrugere og kunder.

Efterhånden som LLM'er bliver mere integreret i vores daglige digitale oplevelser, vokser deres indflydelse på vores opfattelser, overbevisninger og beslutninger. At sikre tillid og sikkerhed med LLM'er går ud over blot tekniske foranstaltninger; det taler til AI-udøvere og organisationers bredere ansvar for at opretholde etiske standarder. Ved at prioritere tillid og sikkerhed beskytter organisationer ikke kun deres brugere, men sikrer også bæredygtig og ansvarlig vækst af kunstig intelligens i samfundet. Det kan også hjælpe med at reducere risikoen for at generere skadeligt indhold og hjælpe med at overholde lovkrav.

Inden for tillid og sikkerhed er indholdsmoderering en mekanisme, der behandler forskellige aspekter, herunder men ikke begrænset til:

- Privatliv – Brugere kan utilsigtet levere tekst, der indeholder følsomme oplysninger, hvilket bringer deres privatliv i fare. Det er vigtigt at opdage og redigere enhver PII.

- Toksicitet – At genkende og bortfiltrere skadeligt indhold, såsom hadefulde ytringer, trusler eller misbrug, er af største vigtighed.

- Brugerens hensigt – Det er afgørende at identificere, om brugerinputtet (prompten) er sikkert eller usikkert. Usikre meddelelser kan eksplicit eller implicit udtrykke ondsindet hensigt, såsom at anmode om personlige eller private oplysninger og generere stødende, diskriminerende eller ulovligt indhold. Forespørgsler kan også implicit udtrykke eller anmode om rådgivning om medicinsk, juridisk, politisk, kontroversiel, personlig eller økonomisk

Indholdsmoderering med Amazon Comprehend

I dette afsnit diskuterer vi fordelene ved indholdsmoderering med Amazon Comprehend.

Håndtering af privatlivets fred

Amazon Comprehend adresserer allerede privatlivets fred gennem sine eksisterende PII-detektions- og redaktionsevner via DetectPIIEntities , Indeholder PIIEtiteter API'er. Disse to API'er understøttes af NLP-modeller, der kan detektere et stort antal PII-enheder såsom socialsikringsnumre (SSN'er), kreditkortnumre, navne, adresser, telefonnumre og så videre. For en komplet liste over enheder, se PII universelle enhedstyper. DetectPII giver også PII-entitetens position på tegnniveau i en tekst; for eksempel starttegnspositionen for NAME-entiteten (John Doe) i sætningen "Mit navn er Joh gøre” er 12, og slutkarakterpositionen er 19. Disse forskydninger kan bruges til at udføre maskering eller redaktion af værdierne og derved reducere risikoen for privat dataudbredelse til LLM'er.

Håndtering af toksicitet og hurtig sikkerhed

I dag annoncerer vi to nye Amazon Comprehend-funktioner i form af API'er: Toksicitetsdetektion via DetectToxicContent API og hurtig sikkerhedsklassificering via ClassifyDocument API. Bemærk, at DetectToxicContent er en ny API, hvorimod ClassifyDocument er en eksisterende API, der nu understøtter hurtig sikkerhedsklassificering.

Toksicitetspåvisning

Med Amazon Comprehend-toksicitetsdetektion kan du identificere og markere indhold, der kan være skadeligt, stødende eller upassende. Denne evne er især værdifuld for platforme, hvor brugere genererer indhold, såsom sociale medier, fora, chatbots, kommentarsektioner og applikationer, der bruger LLM'er til at generere indhold. Det primære mål er at opretholde et positivt og sikkert miljø ved at forhindre spredning af giftigt indhold.

I sin kerne analyserer toksicitetsdetektionsmodellen tekst for at bestemme sandsynligheden for, at den indeholder hadefuldt indhold, trusler, obskøniteter eller andre former for skadelig tekst. Modellen er trænet på store datasæt, der indeholder eksempler på både giftigt og ikke-toksisk indhold. Toksicitets-API'en evaluerer et givet stykke tekst for at give toksicitetsklassificering og konfidensscore. Generative AI-applikationer kan derefter bruge disse oplysninger til at tage passende handlinger, såsom at forhindre teksten i at udbrede sig til LLM'er. Når dette skrives, er etiketterne detekteret af toksicitetsdetektions-API'en HATE_SPEECH, GRAPHIC, HARRASMENT_OR_ABUSE, SEXUAL, VIOLENCE_OR_THREAT, INSULTog PROFANITY. Følgende kode demonstrerer API-kaldet med Python Boto3 til Amazon Comprehend-toksicitetsdetektion:

Hurtig sikkerhedsklassificering

Hurtig sikkerhedsklassificering med Amazon Comprehend hjælper med at klassificere en inputtekstprompt som sikker eller usikker. Denne evne er afgørende for applikationer som chatbots, virtuelle assistenter eller indholdsmodereringsværktøjer, hvor en forståelse af sikkerheden ved en prompt kan bestemme svar, handlinger eller indholdsformidling til LLM'er.

I det væsentlige analyserer hurtig sikkerhedsklassificering menneskelige input for enhver eksplicit eller implicit ondsindet hensigt, såsom at anmode om personlige eller private oplysninger og generering af stødende, diskriminerende eller ulovligt indhold. Den markerer også prompter, der leder efter rådgivning om medicinske, juridiske, politiske, kontroversielle, personlige eller økonomiske emner. Hurtig klassificering returnerer to klasser, UNSAFE_PROMPT , SAFE_PROMPT, for en tilknyttet tekst, med en tilhørende konfidensscore for hver. Tillidsscoren varierer mellem 0-1 og kombineret vil opsummere til 1. For eksempel, i en kundesupport chatbot, teksten "Hvordan nulstiller jeg min adgangskode?” signalerer en hensigt om at søge vejledning om procedurer for nulstilling af adgangskode og er mærket som SAFE_PROMPT. På samme måde kan en udtalelse som "Jeg ville ønske, der skete dig noget slemt” kan markeres for at have en potentielt skadelig hensigt og mærkes som UNSAFE_PROMPT. Det er vigtigt at bemærke, at hurtig sikkerhedsklassificering primært er fokuseret på at detektere hensigter fra menneskelige input (prompter) snarere end maskingenereret tekst (LLM-output). Følgende kode viser, hvordan du får adgang til den hurtige sikkerhedsklassificeringsfunktion med ClassifyDocument API'er:

Bemærk, at endpoint_arn i den foregående kode er en AWS-leveret Amazon ressourcenummer (ARN) af mønsteret arn:aws:comprehend:<region>:aws:document-classifier-endpoint/prompt-safetyHvor <region> er den AWS-region du vælger, hvor Amazon Comprehend er tilgængelig.

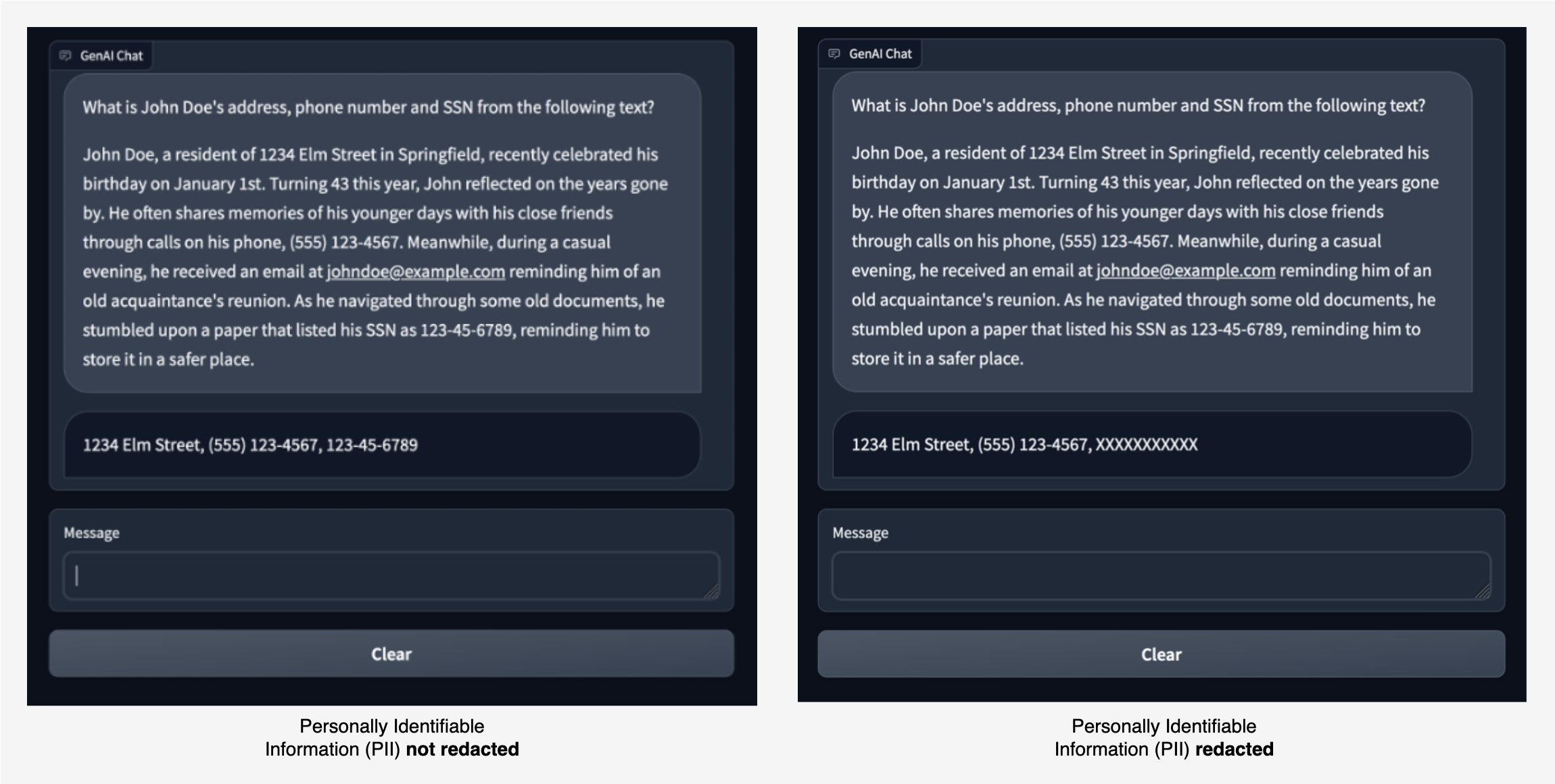

For at demonstrere disse muligheder byggede vi et eksempel på en chatapplikation, hvor vi beder en LLM om at udtrække PII-enheder såsom adresse, telefonnummer og SSN fra et givet stykke tekst. LLM finder og returnerer de relevante PII-enheder, som vist på billedet til venstre.

Med Amazon Comprehend-moderering kan vi redigere input til LLM og output fra LLM. På billedet til højre må SSN-værdien overføres til LLM uden redigering. Enhver SSN-værdi i LLM's svar redigeres dog.

Det følgende er et eksempel på, hvordan en prompt, der indeholder PII-oplysninger, kan forhindres i at nå LLM helt. Dette eksempel viser en bruger, der stiller et spørgsmål, der indeholder PII-oplysninger. Vi bruger Amazon Comprehend-moderering til at opdage PII-enheder i prompten og vise en fejl ved at afbryde flowet.

De foregående chateksempler viser, hvordan Amazon Comprehend-moderering anvender begrænsninger på data, der sendes til en LLM. I de følgende afsnit forklarer vi, hvordan denne modereringsmekanisme implementeres ved hjælp af LangChain.

Integration med LangChain

Med de uendelige muligheder for anvendelse af LLM'er i forskellige use cases, er det blevet lige så vigtigt at forenkle udviklingen af generative AI-applikationer. Langkæde er en populær open source-ramme, der gør det nemt at udvikle generative AI-applikationer. Amazon Comprehend-moderering udvider LangChain-rammen til at tilbyde PII-identifikation og redaktion, toksicitetsdetektion og hurtig sikkerhedsklassificering via AmazonComprehendModerationChain.

AmazonComprehendModerationChain er en tilpasset implementering af LangChain basiskæde interface. Det betyder, at applikationer kan bruge denne kæde med deres egen LLM kæder at anvende den ønskede moderering på inputprompten såvel som på outputteksten fra LLM. Kæder kan bygges ved at sammenflette adskillige kæder eller ved at blande kæder med andre komponenter. Du kan bruge AmazonComprehendModerationChain med andre LLM-kæder for at udvikle komplekse AI-applikationer på en modulær og fleksibel måde.

For at forklare det yderligere giver vi et par eksempler i de følgende afsnit. Kildekoden til AmazonComprehendModerationChain implementering kan findes inden for LangChain open source repository. For fuldstændig dokumentation af API-grænsefladen henvises til LangChain API-dokumentationen for Amazon Comprehend moderationskæde. Brug af denne modereringskæde er så simpelt som at initialisere en forekomst af klassen med standardkonfigurationer:

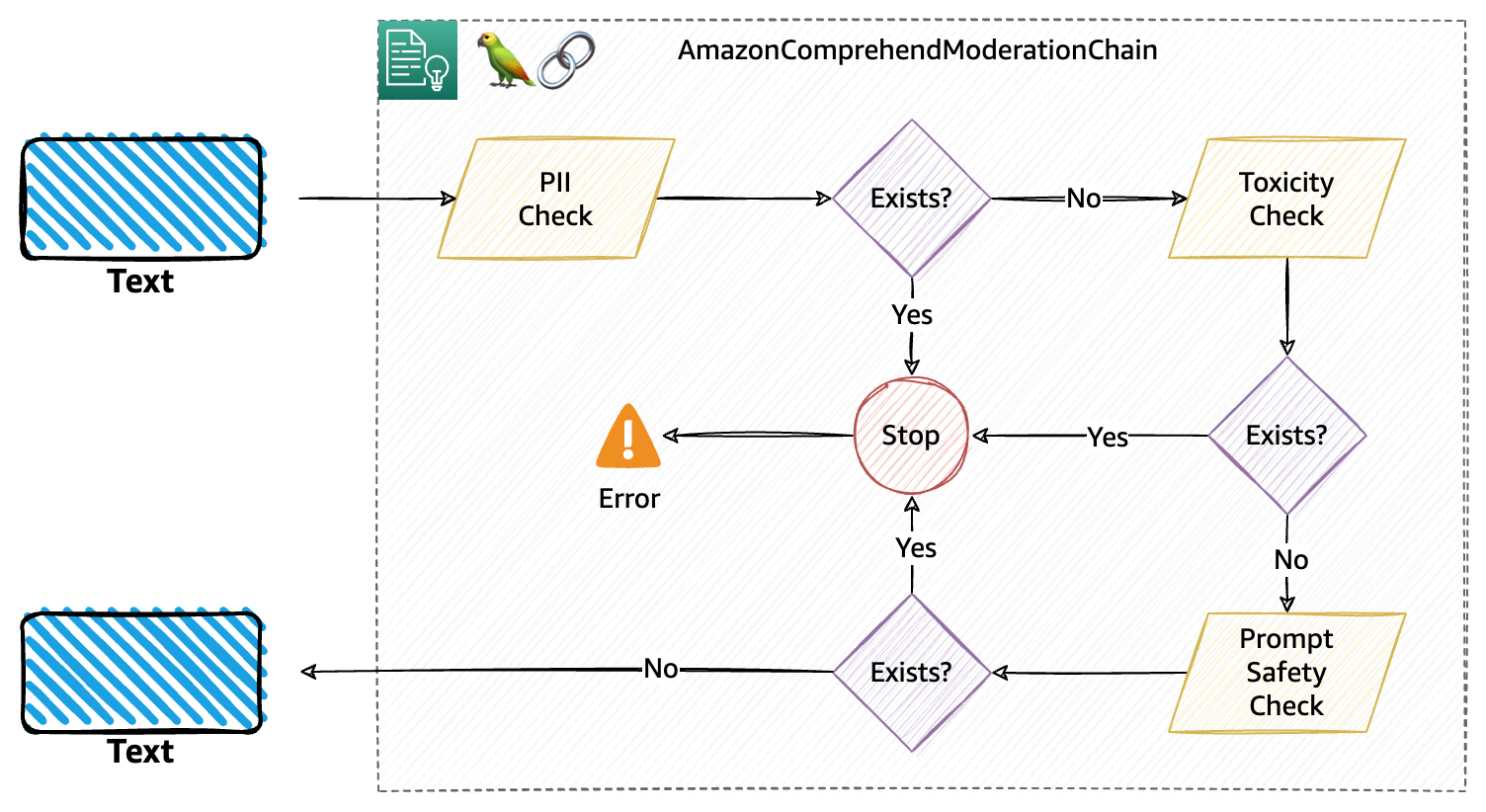

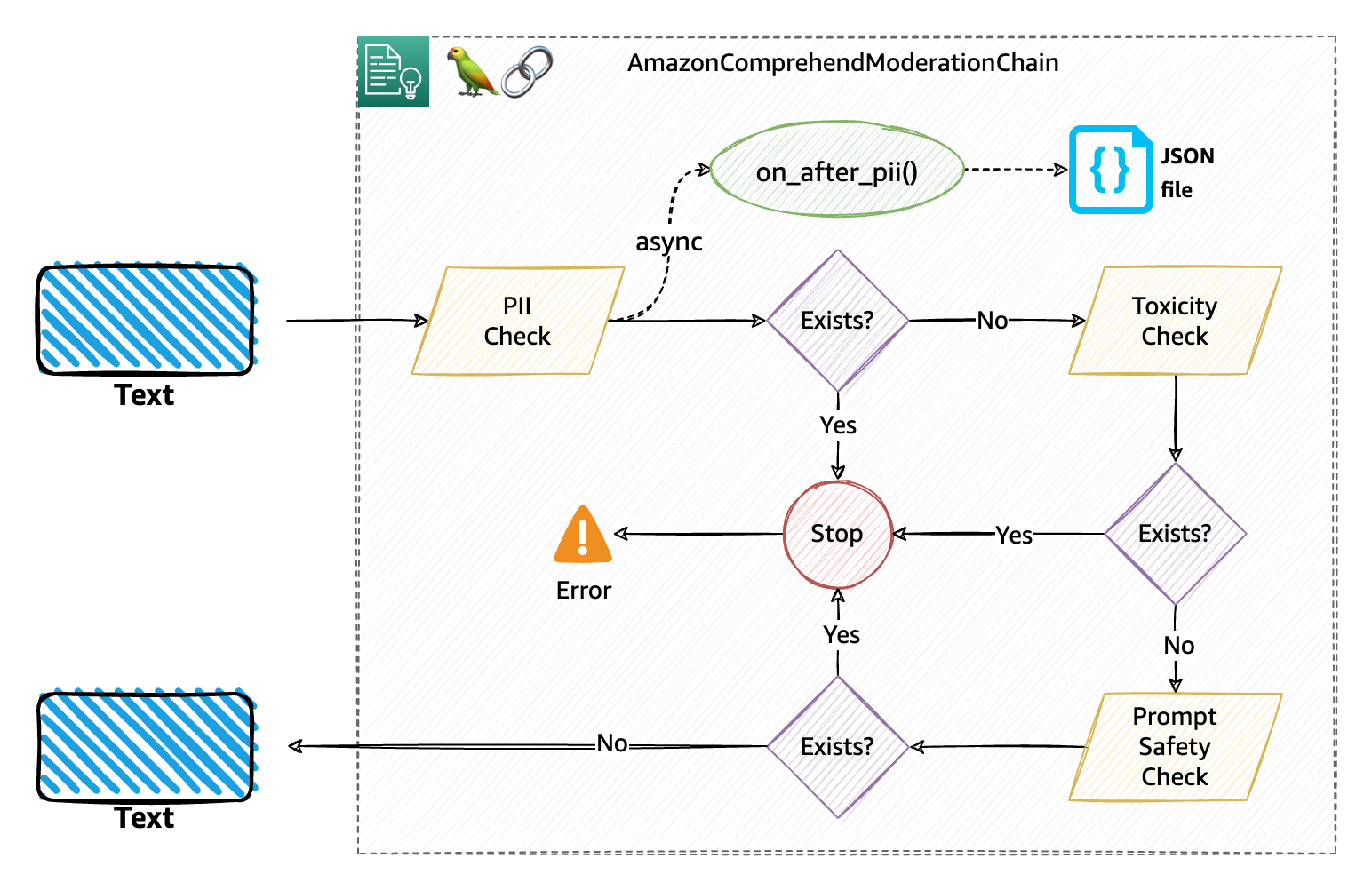

Bag kulisserne udfører modereringskæden tre på hinanden følgende modereringstjek, nemlig PII, toksicitet og hurtig sikkerhed, som forklaret i det følgende diagram. Dette er standardflowet for modereringen.

Følgende kodestykke viser et simpelt eksempel på brug af moderationskæden med Amazon FalconLite LLM (som er en kvantiseret version af Falcon 40B SFT OASST-TOP1 model) hostet i Hugging Face Hub:

I det foregående eksempel udvider vi vores kæde med comprehend_moderation for både tekst, der går ind i LLM, og tekst genereret af LLM. Dette vil udføre standardmoderering, der kontrollerer PII, toksicitet og hurtig sikkerhedsklassificering i den rækkefølge.

Tilpas din moderering med filterkonfigurationer

Du kan bruge AmazonComprehendModerationChain med specifikke konfigurationer, som giver dig mulighed for at kontrollere, hvilke modereringer du ønsker at udføre i din generative AI-baserede applikation. Kernen i konfigurationen har du tre tilgængelige filterkonfigurationer.

- Moderering PiiConfig – Bruges til at konfigurere PII-filter.

- Moderering ToxicityConfig – Bruges til at konfigurere giftigt indholdsfilter.

- ModerationIntentConfig – Bruges til at konfigurere hensigtsfilter.

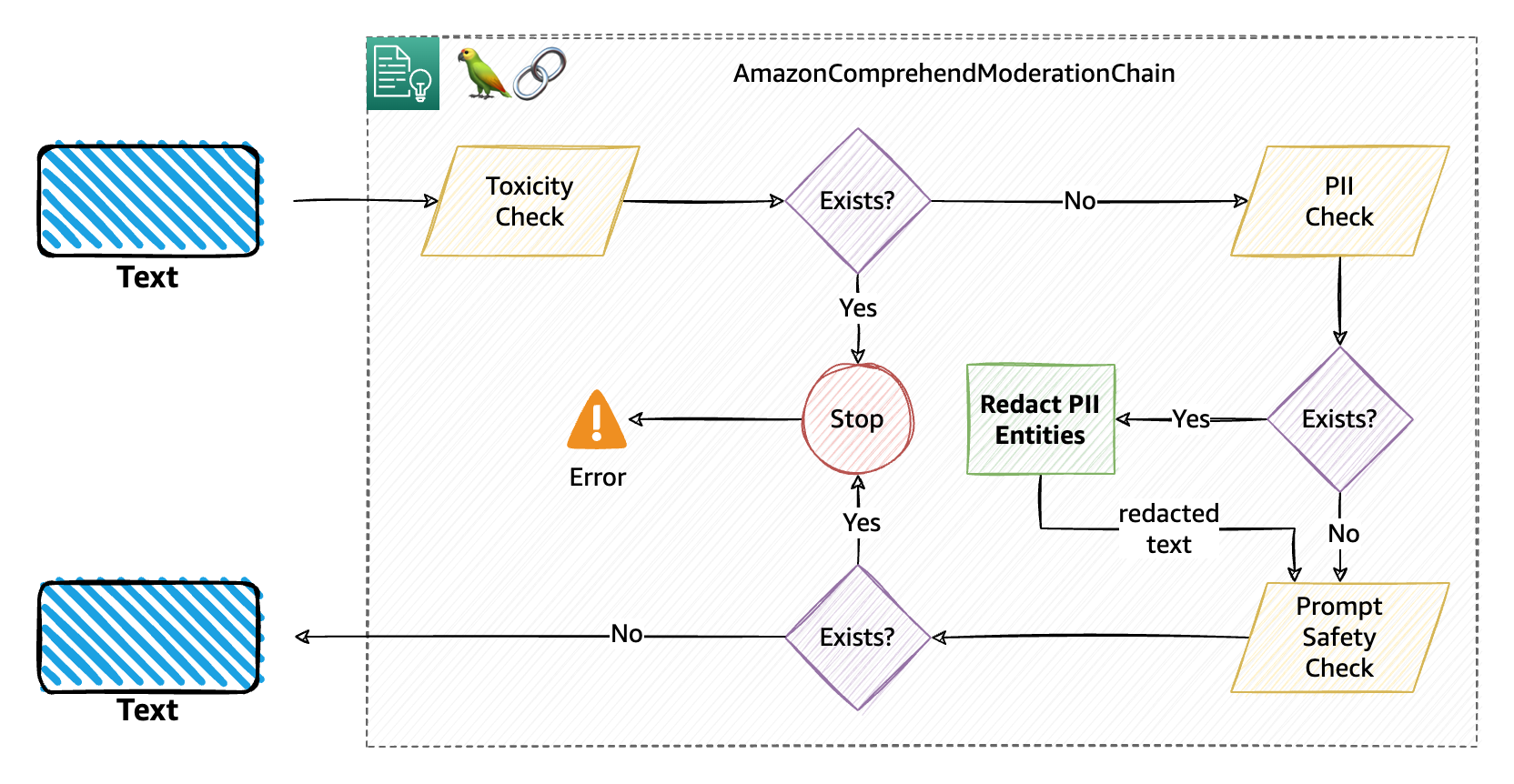

Du kan bruge hver af disse filterkonfigurationer til at tilpasse adfærden for, hvordan dine modereringer opfører sig. Hvert filters konfigurationer har nogle få fælles parametre og nogle unikke parametre, som de kan initialiseres med. Når du har defineret konfigurationerne, bruger du BaseModerationConfig klasse for at definere rækkefølgen, hvori filtrene skal gælde for teksten. I den følgende kode definerer vi f.eks. først de tre filterkonfigurationer og angiver efterfølgende den rækkefølge, de skal gælde i:

Lad os dykke lidt dybere for at forstå, hvad denne konfiguration opnår:

- For det første, for toksicitetsfilteret, specificerede vi en tærskel på 0.6. Det betyder, at hvis teksten indeholder nogen af de tilgængelige giftige etiketter eller enheder med en score, der er højere end tærsklen, vil hele kæden blive afbrudt.

- Hvis der ikke findes noget giftigt indhold i teksten, er et PII-tjek. I dette tilfælde er vi interesserede i at kontrollere, om teksten indeholder SSN-værdier. Fordi

redactparameter er indstillet tilTrue, vil kæden maskere de detekterede SSN-værdier (hvis nogen), hvor SSN-enhedens konfidensscore er større end eller lig med 0.5, med masketegn specificeret (X). Hvisredacter sat tilFalse, vil kæden blive afbrudt for ethvert registreret SSN. - Endelig udfører kæden en hurtig sikkerhedsklassificering, og vil forhindre indholdet i at forplante sig længere nede i kæden, hvis indholdet er klassificeret med

UNSAFE_PROMPTmed en konfidensscore på større end eller lig med 0.8.

Følgende diagram illustrerer denne arbejdsgang.

I tilfælde af afbrydelser af modereringskæden (i dette eksempel gælder for toksicitets- og hurtige sikkerhedsklassificeringsfiltre), vil kæden hæve en Python undtagelse, hvilket i det væsentlige stopper den igangværende kæde og giver dig mulighed for at fange undtagelsen (i en try-catch-blok) og udføre enhver relevant handling. De tre mulige undtagelsestyper er:

ModerationPIIErrorModerationToxicityErrorModerationPromptSafetyError

Du kan konfigurere et filter eller mere end et filter vha BaseModerationConfig. Du kan også have den samme type filter med forskellige konfigurationer inden for den samme kæde. For eksempel, hvis din use case kun handler om PII, kan du specificere en konfiguration, der skal afbryde kæden, hvis der i tilfælde af, at et SSN detekteres; ellers skal den udføre redaktion på alder og navn PII-enheder. En konfiguration til dette kan defineres som følger:

Brug af tilbagekald og unikke identifikatorer

Hvis du er bekendt med begrebet arbejdsgange, er du måske også bekendt med tilbagekald. Tilbagekald inden for arbejdsgange er uafhængige stykker kode, der kører, når visse betingelser er opfyldt i arbejdsgangen. Et tilbagekald kan enten være blokerende eller ikke-blokerende for arbejdsgangen. LangChain-kæder er i bund og grund arbejdsgange for LLM'er. AmazonComprehendModerationChain giver dig mulighed for at definere dine egne tilbagekaldsfunktioner. I første omgang er implementeringen begrænset til kun asynkrone (ikke-blokerende) tilbagekaldsfunktioner.

Dette betyder reelt, at hvis du bruger tilbagekald med modereringskæden, vil de køre uafhængigt af kædens kørsel uden at blokere den. For modereringskæden får du muligheder for at køre stykker kode, med enhver forretningslogik, efter hver moderering er kørt, uafhængigt af kæden.

Du kan også valgfrit angive en vilkårlig unik identifikationsstreng, når du opretter en AmazonComprehendModerationChain for at aktivere logning og analyser senere. For eksempel, hvis du betjener en chatbot drevet af en LLM, vil du måske spore brugere, der konsekvent misbruger eller bevidst eller ubevidst afslører personlige oplysninger. I sådanne tilfælde bliver det nødvendigt at spore oprindelsen af sådanne prompter og måske gemme dem i en database eller logge dem på passende måde for yderligere handling. Du kan videregive et unikt ID, der tydeligt identificerer en bruger, såsom deres brugernavn eller e-mail, eller et programnavn, der genererer prompten.

Kombinationen af tilbagekald og unikke identifikatorer giver dig en effektiv måde at implementere en modereringskæde, der passer til din use case på en meget mere sammenhængende måde med mindre kode, der er nemmere at vedligeholde. Tilbagekaldsbehandleren er tilgængelig via BaseModerationCallbackHandler, med tre tilgængelige tilbagekald: on_after_pii(), on_after_toxicity()og on_after_prompt_safety(). Hver af disse tilbagekaldsfunktioner kaldes asynkront, efter at den respektive modereringskontrol er udført i kæden. Disse funktioner modtager også to standardparametre:

- moderation_beacon – En ordbog, der indeholder detaljer såsom teksten, som modereringen blev udført på, det fulde JSON-output fra Amazon Comprehend API, typen af moderering, og om de medfølgende etiketter (i konfigurationen) blev fundet i teksten eller ej

- unikt_id – Det unikke ID, du tildelte, mens du initialiserede en forekomst af

AmazonComprehendModerationChain.

Det følgende er et eksempel på, hvordan en implementering med tilbagekald fungerer. I dette tilfælde definerede vi et enkelt tilbagekald, som vi ønsker, at kæden skal køre efter, at PII-kontrollen er udført:

Vi bruger så my_callback objekt, mens modereringskæden initialiseres, og bestå også en unique_id. Du kan bruge tilbagekald og unikke identifikatorer med eller uden en konfiguration. Når du underklasser BaseModerationCallbackHandler, skal du implementere en eller alle tilbagekaldsmetoderne afhængigt af de filtre, du har til hensigt at bruge. For kortheds skyld viser følgende eksempel en måde at bruge tilbagekald og unique_id uden nogen konfiguration:

Følgende diagram forklarer, hvordan denne modereringskæde med tilbagekald og unikke identifikatorer fungerer. Specifikt implementerede vi PII-callback, der skulle skrive en JSON-fil med de tilgængelige data i moderation_beacon og unique_id bestået (brugerens e-mail i dette tilfælde).

I det følgende Python notesbog, har vi samlet et par forskellige måder, du kan konfigurere og bruge moderationskæden med forskellige LLM'er, såsom LLM'er hostet med Amazon SageMaker JumpStart og vært i Krammer Face Hub. Vi har også inkluderet eksempelchatapplikationen, som vi diskuterede tidligere med det følgende Python notesbog.

Konklusion

Det transformative potentiale i store sprogmodeller og generativ AI er ubestrideligt. Deres ansvarlige og etiske brug afhænger dog af at imødekomme bekymringer om tillid og sikkerhed. Ved at erkende udfordringerne og aktivt implementere foranstaltninger til at mindske risici, kan udviklere, organisationer og samfundet som helhed udnytte fordelene ved disse teknologier og samtidig bevare den tillid og sikkerhed, der understøtter deres succesfulde integration. Brug Amazon Comprehend ContentModerationChain til at tilføje tillids- og sikkerhedsfunktioner til enhver LLM-workflow, inklusive Retrieval Augmented Generation (RAG)-workflows implementeret i LangChain.

For information om at bygge RAG-baserede løsninger ved hjælp af LangChain og Amazon Kendras meget nøjagtige, maskinlæringsdrevne (ML) intelligent søgning, se - Byg hurtigt generative AI-applikationer med høj nøjagtighed på virksomhedsdata ved hjælp af Amazon Kendra, LangChain og store sprogmodeller. Som et næste trin henvises til kodeeksempler vi oprettede til brug af Amazon Comprehend-moderering med LangChain. For fuld dokumentation af Amazon Comprehend moderation chain API, se LangChain API dokumentation.

Om forfatterne

Wrick Talukdar er seniorarkitekt hos Amazon Comprehend Service-teamet. Han arbejder med AWS-kunder for at hjælpe dem med at indføre maskinlæring i stor skala. Uden for arbejdet holder han af at læse og fotografere.

Wrick Talukdar er seniorarkitekt hos Amazon Comprehend Service-teamet. Han arbejder med AWS-kunder for at hjælpe dem med at indføre maskinlæring i stor skala. Uden for arbejdet holder han af at læse og fotografere.

Anjan Biswas er Senior AI Services Solutions Architect med fokus på AI/ML og Data Analytics. Anjan er en del af det verdensomspændende AI-serviceteam og arbejder med kunder for at hjælpe dem med at forstå og udvikle løsninger på forretningsproblemer med AI og ML. Anjan har over 14 års erfaring med at arbejde med globale forsyningskæder, fremstillings- og detailorganisationer og hjælper aktivt kunder med at komme i gang og skalere på AWS AI-tjenester.

Anjan Biswas er Senior AI Services Solutions Architect med fokus på AI/ML og Data Analytics. Anjan er en del af det verdensomspændende AI-serviceteam og arbejder med kunder for at hjælpe dem med at forstå og udvikle løsninger på forretningsproblemer med AI og ML. Anjan har over 14 års erfaring med at arbejde med globale forsyningskæder, fremstillings- og detailorganisationer og hjælper aktivt kunder med at komme i gang og skalere på AWS AI-tjenester.

Nikhil Jha er Senior Technical Account Manager hos Amazon Web Services. Hans fokusområder omfatter AI/ML og analyse. I sin fritid nyder han at spille badminton med sin datter og udforske naturen.

Nikhil Jha er Senior Technical Account Manager hos Amazon Web Services. Hans fokusområder omfatter AI/ML og analyse. I sin fritid nyder han at spille badminton med sin datter og udforske naturen.

Chin Rane er AI/ML Specialist Solutions Architect hos Amazon Web Services. Hun brænder for anvendt matematik og maskinlæring. Hun fokuserer på at designe intelligente dokumentbehandlingsløsninger til AWS-kunder. Uden for arbejdet nyder hun salsa og bachata dans.

Chin Rane er AI/ML Specialist Solutions Architect hos Amazon Web Services. Hun brænder for anvendt matematik og maskinlæring. Hun fokuserer på at designe intelligente dokumentbehandlingsløsninger til AWS-kunder. Uden for arbejdet nyder hun salsa og bachata dans.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/build-trust-and-safety-for-generative-ai-applications-with-amazon-comprehend-and-langchain/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 100

- 11

- 12

- 14

- 15 %

- 17

- 19

- 500

- 7

- 8

- 9

- a

- evner

- evne

- Om

- misbrug

- adgang

- Konto

- præcis

- opnår

- tværs

- Handling

- aktioner

- aktivt

- tilføje

- adresse

- adresser

- adressering

- klæbe

- vedtage

- Vedtagelse

- rådgivning

- Efter

- alder

- AI

- AI-tjenester

- AI-systemer

- AI / ML

- Alle

- tilladt

- tillade

- tillader

- allerede

- også

- helt

- Amazon

- Amazon Comprehend

- Amazon Kendra

- Amazon Web Services

- beløb

- an

- analytics

- analyser

- ,

- Annoncerer

- besvare

- enhver

- api

- API'er

- anvendelig

- Anvendelse

- applikationer

- anvendt

- gælder

- Indløs

- passende

- passende

- ER

- områder

- AS

- spørg

- spørge

- aspekter

- tildelt

- assistenter

- forbundet

- At

- forøge

- augmented

- til rådighed

- AWS

- Backed

- Bad

- bund

- baseret

- BE

- fordi

- bliver

- bliver

- adfærd

- være

- overbevisninger

- fordele

- mellem

- Beyond

- Bloker

- blokering

- både

- grænser

- bredere

- bygge

- opbyg tillid

- Bygning

- bygget

- virksomhed

- virksomheder

- men

- by

- ringe

- tilbagekald

- kaldet

- CAN

- kapaciteter

- kapacitet

- stand

- kapital

- kort

- tilfælde

- tilfælde

- brydning

- vis

- kæde

- kæder

- udfordringer

- karakter

- chatbot

- chatbots

- kontrollere

- kontrol

- Kontrol

- hage

- valg

- klasse

- klasser

- klassificering

- klassificeret

- Klassificere

- kunde

- kode

- sammenhængende

- KOM

- kombination

- kombineret

- KOMMENTAR

- Fælles

- komplekse

- komponenter

- forstå

- Konceptet

- pågældende

- Bekymringer

- betingelser

- tillid

- Konfiguration

- træk

- konsekvent

- indeholder

- indhold

- Indholdsgenerering

- kontrol

- kontroversielle

- Core

- oprettet

- Oprettelse af

- Kreativ

- kredit

- kreditkort

- kritisk

- afgørende

- skik

- kunde

- Kunde support

- Kunder

- tilpasses

- tilpasse

- dagligt

- Dancing

- data

- Dataanalyse

- databeskyttelse

- Database

- datasæt

- afgørelser

- dybere

- Standard

- definere

- definerede

- dykke

- demonstrere

- demonstrerer

- Afhængigt

- designe

- ønskes

- detaljer

- opdage

- opdaget

- Detektion

- Bestem

- udvikle

- udviklere

- Udvikling

- forskellige

- digital

- diskutere

- drøftet

- tydeligt

- dyk

- do

- dokumentet

- dokumentation

- dokumenter

- doe

- ned

- grund

- e

- hver

- tidligere

- lettere

- effektivt

- nemt

- enten

- andet

- muliggøre

- ende

- Endless

- sikre

- sikring

- Enterprise

- enheder

- enhed

- Miljø

- lige

- lige

- fejl

- Essensen

- væsentlig

- væsentlige

- etisk

- eksempel

- eksempler

- Undtagen

- undtagelse

- eksisterende

- erfaring

- Oplevelser

- Forklar

- forklarede

- Forklarer

- udtrykkeligt

- Udforskning

- Express

- udvider

- ekstrakt

- Ansigtet

- bekendt

- Feature

- Funktionalitet

- få

- File (Felt)

- filtrere

- filtrering

- Filtre

- finansielle

- Finde

- fund

- Fornavn

- Markeret

- flag

- fleksibel

- flow

- Fokus

- fokuserede

- fokuserer

- efter

- følger

- Til

- formular

- format

- formularer

- fora

- fundet

- Framework

- Fransk vin

- fra

- fuld

- funktioner

- yderligere

- generere

- genereret

- generere

- generation

- generative

- Generativ AI

- få

- gif

- Giv

- given

- giver

- Global

- mål

- Goes

- gå

- godt

- større

- Vokser

- Vækst

- vejledning

- Håndtering

- sker

- skadelig

- seletøj

- hader

- Have

- have

- he

- hjælpe

- hjælpe

- hjælper

- stærkt

- hængsler

- hans

- hostede

- Hvordan

- How To

- Men

- HTML

- HTTPS

- Hub

- menneskelig

- menneskelignende

- i

- ID

- Identifikation

- identifikator

- identifikatorer

- identificerer

- identificere

- identificere

- if

- Ulovlig

- illustrerer

- billede

- KIMOs Succeshistorier

- gennemføre

- implementering

- implementeret

- gennemføre

- importere

- betydning

- vigtigt

- in

- utilsigtet

- omfatter

- medtaget

- omfatter

- Herunder

- Forøg

- Stigninger

- stigende

- uafhængig

- uafhængigt

- industrier

- indflydelse

- oplysninger

- i første omgang

- indgang

- indgange

- Forespørgsler

- instans

- integreret

- integration

- Intelligent

- Intelligent dokumentbehandling

- hensigt

- hensigt

- interesseret

- grænseflade

- afbrudt

- ind

- indføre

- IT

- ITS

- John

- John doe

- jpg

- json

- lige

- Etiketter

- Sprog

- stor

- senere

- læring

- til venstre

- Politikker

- mindre

- ligesom

- sandsynlighed

- Limited

- Liste

- lidt

- lidt dybere

- LLM

- log

- logning

- logik

- leder

- maskine

- machine learning

- vedligeholde

- maerker

- leder

- måde

- Produktion

- maske

- matematik

- Matter

- Kan..

- me

- midler

- foranstaltninger

- mekanisme

- Medier

- medicinsk

- sammenlægning

- mødte

- metoder

- misbruge

- afbøde

- Blanding

- ML

- model

- modeller

- mådehold

- modulær

- mere

- meget

- skal

- my

- navn

- nemlig

- navne

- Natural

- Natural Language Processing

- nødvendig

- Ny

- Nye funktioner

- næste

- NLP

- ingen

- nu

- nummer

- numre

- talrige

- objekt

- of

- offensiv

- tilbyde

- forskydninger

- on

- ONE

- kun

- åbent

- open source

- betjene

- drift

- Indstillinger

- or

- ordrer

- organisationer

- oprindelse

- Andet

- Ellers

- vores

- ud

- udfald

- udendørs

- output

- udgange

- uden for

- i løbet af

- egen

- parameter

- parametre

- Paramount

- del

- især

- passerer

- Bestået

- lidenskabelige

- Adgangskode

- Nulstil kodeord

- Mønster

- Udfør

- udføres

- udfører

- måske

- personale

- Personligt

- telefon

- fotografering

- stykke

- stykker

- Platforme

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- politisk

- Populær

- position

- positiv

- muligheder

- mulig

- Indlæg

- potentiale

- potentielt

- magt

- strøm

- vigtigste

- bevare

- forebyggelse

- primært

- primære

- principper

- prioritering

- Beskyttelse af personlige oplysninger

- private

- privat information

- problemer

- procedurer

- behandle

- forarbejdning

- dyb

- Progress

- korrekt

- beskytte

- give

- giver

- Python

- spørgsmål

- rejse

- rækkevidde

- intervaller

- hurtige

- hellere

- nå

- Læsning

- rige

- modtage

- anerkende

- reducere

- reducere

- henvise

- region

- lovgivningsmæssige

- relevant

- pålidelig

- omdømme

- anmode

- Krav

- ressource

- dem

- svar

- reaktioner

- ansvar

- ansvarlige

- restriktioner

- detail

- afkast

- højre

- Risiko

- risici

- Kør

- s

- sikker

- Sikkerhed

- sagemaker

- samme

- Scale

- scener

- score

- sømløs

- Sektion

- sektioner

- sikkerhed

- se

- Søg

- SELV

- senior

- følsom

- sendt

- dømme

- Sequence

- tjeneste

- Tjenester

- sæt

- hun

- bør

- Vis

- udstillingsvindue

- vist

- Shows

- signaler

- Tilsvarende

- Simpelt

- forenkle

- enkelt

- Websteder

- uddrag

- So

- Social

- sociale medier

- Samfund

- Løsninger

- nogle

- noget

- Kilde

- kildekode

- Taler

- specialist

- specifikke

- specifikt

- specificeret

- tale

- standarder

- starte

- påbegyndt

- Statement

- Trin

- Stands

- standsning

- butik

- String

- Efterfølgende

- vellykket

- sådan

- tilført

- forsyne

- forsyningskæde

- support

- Understøtter

- bæredygtig

- Systemer

- Tag

- opgaver

- hold

- Teknisk

- Teknologier

- skabelon

- tekst

- end

- at

- Hovedstaden

- The Source

- deres

- Them

- derefter

- Der.

- derved

- Disse

- de

- denne

- trusler

- tre

- tærskel

- Gennem

- tid

- til

- værktøjer

- spor

- uddannet

- transformative

- Stol

- prøv

- to

- typen

- typer

- afdække

- ubestridelig

- understøtte

- forstå

- forståelse

- enestående

- Universal

- Opretholde

- brug

- brug tilfælde

- anvendte

- Bruger

- brugere

- bruger

- ved brug af

- udnytte

- udnyttet

- Værdifuld

- værdi

- Værdier

- række

- forskellige

- Vast

- udgave

- via

- Virtual

- W

- ønsker

- var

- Vej..

- måder

- we

- web

- webservices

- GODT

- var

- Hvad

- Hvad er

- hvornår

- ud fra følgende betragtninger

- hvorvidt

- som

- mens

- WHO

- Hele

- hvorfor

- bred

- Bred rækkevidde

- vilje

- ønsker

- med

- inden for

- uden

- vidne

- Arbejde

- workflow

- arbejdsgange

- arbejder

- virker

- skriver

- skrivning

- X

- år

- Du

- Din

- zephyrnet