Hvis du har været på sociale medier i denne uge, er du sikkert stødt på billeder af AI-genererede billeder af dine venner som fe-væsener, animé-figurer, avatarer og magiske væsener.

Dette skyldes delvist Lensa, en kunstig intelligens, der syntetiserer digitale portrætter baseret på billeder, som brugerne uploader. Appens portrætter overtog praktisk talt internettet, hvor Lensa blev den mest downloadede app i Apples app store.

Lensa har ligesom alle AI-applikationer, der digitalt gengiver billeder, bejlet til både beundring og kontrovers for sin tilsyneladende åbenlyse seksualisering af kvindelige billeder. Andre brugere bemærkede, at appen gjorde deres hud blegere eller deres kroppe tyndere.

Læs også: AI-teknologi, der skaber livstruende dybe falske billeder

Sådan får du din egen 'magiske avatar'

Billederne, der går rundt, er en stolt skabelse af Lensas magiske avatarfunktion. For at få en fornemmelse af det, skal man downloade Lensa-appen på en telefon. Et årligt abonnement koster omkring $35.99, men dets tjenester er også tilgængelige, omend med begrænsninger gratis på en ugelang prøveperiode, hvis man vil tjekke det ud først.

Men at generere de populære magiske avatarer kræver et ekstra gebyr på grund af, hvad appen siger, er "enorm beregningskraft" at opnå.

På en gratis prøveperiode kan man få 50 avatarer for $3.99 og 200 avatarer for $7.99. For at få de bedste resultater opfordrer appen brugere til at uploade mindst 20 nærbilleder.

Ideelt set bør disse billeder være nærbilleder af ens ansigt med en række forskellige baggrunde, ansigtsudtryk og vinkler. Applikationen insisterer på, at brugere skal være 13 år og ældre. Lensa er ikke en helt ny applikation.

Et produkt fra Prisma, applikationen blev først populær i 2016 takket være en funktion, der gjorde det muligt for brugere at ændre deres selfies til billeder i stil med berømte kunstnere.

Hvordan virker Lensa?

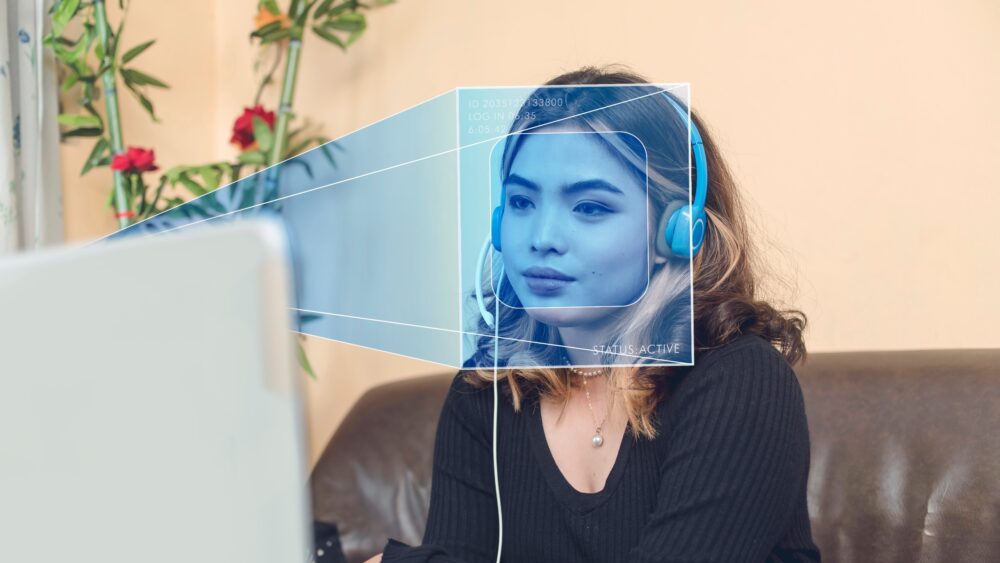

Ifølge virksomheden gør det brug af det, det kalder "TrueDepth API-teknologi", hvor en bruger leverer billeder eller "ansigtsdata", hvorefter AI trænes i sine algoritmer til at yde bedre og vise dig bedre resultater. Træning er, når AI'en behandler data, validerer og tester modellerne.

For at bruge appen kan man sammensætte 20 selfies med forskellige udtryk og vinkler og vælge 100 avatarer.

Det tager omkring 20 minutter at udføre arbejdet. Når den er færdig, returnerer AI'en avatarer, der falder ind under 10 kategorier såsom fantasy, feprinsesse, fokus, pop, stilfuld, animé, lys, kawaii, iriserende og kosmisk.

"Generelt følte jeg, at appen gjorde et anstændigt stykke arbejde med at producere kunstneriske billeder baseret på mine selfies. Jeg kunne ikke helt genkende mig selv i de fleste portrætter, men jeg kunne se, hvor de kom fra,” Zoe Sottile fra CNN skrev.

"Det så ud til at genkende og gentage visse træk, som min blege hud eller min runde næse, mere end andre. Nogle af dem var i en mere realistisk stil, og var tæt nok på, at jeg kunne tro, at de faktisk var billeder af mig, hvis jeg så dem på afstand. Andre var væsentligt mere stiliserede og kunstneriske, så de føltes mindre specifikke for mig.”

Sottile bemærkede, at AI også gjorde hende lettere.

Hvad mig angår, fornemmede jeg også, at det automatisk gjorde mig lysere, og det billede, jeg prøvede i mit galleri af mig og en ven, der er let mørkere i huden, returnerede en noget meget lysere version af os, klart en overdrivelse, og afslørede en tilbøjelighed til at lyse. sorte hudfarver.

Seksualisering af kvinder

Andre, der brugte det, havde mere eller mindre lignende bekymringer.

Kvinder siger, at AI er hurtig til at seksualisere deres billeder. Men i en tidligere artikel har vi forklarede dette er blevet muliggjort af det enorme antal seksualiserede billeder, der findes i datasæt, der bruges i AI-træning.

Med andre ord betyder det, at AI'en er alt for fortrolig med, hvordan man genererer disse billeder og nemt bliver pornografisk. Med lidt tricks kan den også blive bedt om uforvarende at producere porno fra disse billeder, hvis en bruger ønsker det.

seksualisering af en ung kvinde, der brugte det meste af sin tid i offentligheden iført poset tøj bare for at undgå denne form for seksualisering. forbyde mænd at bruge kunstig intelligens https://t.co/YnNCurvYDS

— joan of arc but a commie (@postnuclearjoan) 13. December, 2022

I andre historier har vi dækket, hvordan AI:s kan narre til at give information om, hvordan man laver en bombe for eksempel. Mærkeligt nok optrådte spørgsmålet om seksualisering ikke i billeder af mænd, der var uploadet til Magic Avatar-funktionen. For MIT Technology Review, Melissa Heikkilä skrev,

"Mine avatarer var tegneserieagtigt pornificeret, mens mine mandlige kolleger blev astronauter, opdagelsesrejsende og opfindere."

Sottile, på den anden side, bemærkede, at AI havde "på et af de mest desorienterende billeder" fået hende til at se ud "som en version af mit ansigt var på en nøgen krop."

"På flere billeder så det ud, som om jeg var nøgen, men med et tæppe strategisk placeret, eller billedet bare skåret af for at skjule noget eksplicit," sagde hun.

"Og mange af billederne, selv hvor jeg var fuldt påklædt, indeholdt et lummert ansigtsudtryk, betydelig spaltning og tyndt tøj, som ikke matchede de billeder, jeg havde indsendt," tilføjer Zoe Sottile.

Andre udtrykte frygt for, at de ville blive gjort til pornostjerner af AI-teknologi som Lensa.

ADVARSEL: Enhver i verden kan få din PORNO uden samtykke nu !!

Folk er i ærefrygt for generative AI-værktøjer som Lensa uden at forstå de alvorlige konsekvenser.

🧵 VÆRSTE DEL? Her er, hvad virksomheder ikke ønsker, at du skal vide: pic.twitter.com/gdS0h1FbXj

— Kritarth Mittal | Ghostwriter 🖋️ (@kritarthmittal) 14. December, 2022

Body Shaming

For kvinder med fuld krop var oplevelsen noget anderledes og endnu værre i nogle tilfælde. AI'en gjorde dem tyndere og sexede.

"For Lmfao, hvis du har Body Dysmorphia, skal du ikke bruge den Lensa-app til de AI-genererede billeder. Dette er din advarsel,” en bruger skrev.

En anden sagde, at appen havde fået hende til at se asiatisk ud.

Prøvede AI Lensa-appen. Fortæl mig, hvorfor AI fik mig til at se mere asiatisk ud end nogensinde? 😂😂😂😂 pic.twitter.com/lveJNXaXHO

— Kristina🌴🌊🐚 (@kut1e) 9. December, 2022

En anden bruger tog til twitter for at klage over, at han havde betalt $8 for at opleve kropsdysmorfi, da han brugte AI.

betalte $8 til Lensa bare for at opleve kropsdysmorfi pic.twitter.com/NRYfh5Jyej

— garrett (@dollhaus_x) 3. December, 2022

Kropsdysmorfi er en mental sundhedstilstand, hvor en person bruger meget tid på at bekymre sig om fejl i deres udseende. Disse fejl er ofte umærkelige for andre.

En anden klagede over, at AI'en automatisk tabte betydelig vægt på hendes ellers fuldfigursbilleder.

"En klage, jeg har over Lensa AI, er, at den vil gøre dig tynd på nogle billeder. Som en tyk person generede de billeder mig virkelig. Så pas på ikke at blive udløst, hvis du er en fed fyr uden interesse i at blive tynd,” skrev Mariah Successful (@Shlatz) den 5. december 2022.

Psykologisk tidsindstillet bombe

Og psykologer er enige i hendes udsagn om, at AI kunne udløse fuldendte kvinder.

En klinisk psykolog, Dr. Toni Pikoos, en australsk baseret praktiserende læge, der forsker i og specialiserer sig i behandling af kropsdysmorfisk lidelse, mente, at programmet kunne gøre mere skade end gavn og ikke er andet end et "fotofiltreringsværktøj" til at ændre ens selvopfattelse.

"Når der er en større uoverensstemmelse mellem ideelt og opfattet udseende, kan det give næring til kroppens utilfredshed, angst og et ønske om at fikse eller ændre sit udseende med potentielt usunde eller usikre midler" som spiseforstyrrelser eller unødvendige kosmetiske procedurer, siger Pikoos.

Hun udtrykte bekymring over, at billederne slettede "indviklede detaljer" såsom "fregner og linjer", noget, der kunne øge bekymringer om ens hud. Dette kan også psykologisk udløse en sårbar person, siger hun.

"At se et eksternt billede afspejler deres usikkerhed tilbage på dem, forstærker kun ideen 'Se, det er galt med mig! Og jeg er ikke den eneste, der kan se det!'” siger Pikoos.

På grund af det faktum, at AI introducerer sine egne funktioner, der ikke skildrer en brugers virkelige udseende, kan appen skabe nye bekymringer, siger han.

Hun siger, at AI's "magiske avatarer" var "særligt interessante, fordi det virker mere objektivt - som om et eksternt, alvidende væsen har genereret dette billede af, hvordan du ser ud."

Dette mener hun faktisk ville være "nyttigt" for mennesker med kropsdysmorfisk lidelse og hjælpe med at kaste lys over et "mismatch" mellem en "individs negative syn på sig selv og hvordan andre ser dem."

Hun bemærkede dog, at AI'en ikke var objektiv på grund af dens forsøg på at skildre en fejlfri og mere "forbedret og perfektioneret version" af ens ansigt.

For eksempel kan en person, der oplever kropsdysmorfisk lidelse eller BDD, "opleve et kort selvtillidsboost, når de ser deres image og ønsker at dele denne version af sig selv med verden," siger hun, men vil blive hårdt ramt af virkeligheden, når de er slukket. skærm, ufiltreret, i spejlet eller et billede, som de tager af sig selv."

At forsvare sit eget

Andrey Usoltsev, administrerende direktør for Prisma Labs, siger, at hans virksomhed i øjeblikket er "overvældet" med forespørgsler om Lensa og tilbød et link til en FAQ-side, der adresserer forespørgsler om seksualiserede billeder, dog ikke den slags brugerreaktioner, som Pikoos beskriver.

"At se dette afspejlet i appen ville være meget konfronterende og give en slags 'bekræftelse' for den måde, de ser sig selv på", hvilket fører til, at de bliver "mere forankret i lidelsen."

Stabil diffusion

Lensa bruger også Stable Diffusion, som bruger deep-learning-syntese, der kan skabe nye billeder ud fra tekstbeskrivelser og kan køre på en Windows- eller Linux-pc, på en Mac eller i skyen på lejet computerhardware.

Stable Diffusions neurale netværk har ved hjælp af intensiv læring mestret at associere ord og den generelle statistiske sammenhæng mellem positionerne af pixels i billeder.

Vi dækkede i en anden historie hvordan teknologien kunne have livsødelæggende konsekvenser ved at gengive og afbilde billeder af mennesker, der ser ud til at være kriminelle eller at være involveret i mindre end smigrende praksisser såsom tyveri.

For eksempel kan man give den åbne kilde Stable Diffusion en prompt, såsom "Tom Hanks i et klasseværelse", og det vil give ham/hende et nyt billede af Tom Hanks i et klasseværelse. I Tom Hanks tilfælde er det en tur i parken, fordi hundredvis af hans billeder allerede er i det datasæt, der bruges til at træne Stable Diffusion.

Kunstnere får også råvarer

På kunstfronten er nogle kunstnere utilfredse.

De er bekymrede over, at kunstig intelligens kan true deres levebrød. Dette skyldes, at kunstnere, inklusive digitale, heller ikke kan producere så hurtigt som AI til et digitalt portræt.

Jeg beskærer disse af hensyn til privatlivets fred/fordi jeg ikke forsøger at kalde en enkelt person. Disse er alle Lensa-portrætter, hvor de forskårne rester af en kunstners signatur stadig er synlige. Det er resterne af signaturen fra en af de mange kunstnere, den stjal fra.

En 🧵 https://t.co/0lS4WHmQfW pic.twitter.com/7GfDXZ22s1

— Lauryn Ipsum (@LaurynIpsum) 6. December, 2022

Lensas moderselskab, Prisma, har forsøgt at massere bekymringerne om dets teknologi, der eliminerer arbejde for digitale kunstnere.

"Mens både mennesker og AI lærer om kunstneriske stilarter på semi-lignende måder, er der nogle grundlæggende forskelle: AI er i stand til hurtigt at analysere og lære af store datasæt, men det har ikke samme niveau af opmærksomhed og påskønnelse for kunst som menneske" skrev virksomheden på Twitter den 6. december.

Det siger "outputtet kan ikke beskrives som nøjagtige replikaer af noget bestemt kunstværk."

Er denne AI-genereret kunst eller AI-kopieret kunst? Stjæler Lensa AI fra menneskelig kunst? En ekspert forklarer kontroversen https://t.co/cxi2t6URC7 pic.twitter.com/20xJgbHZgA

— John Chapman (@JChapman1729) 15. December, 2022

Ændring af selvbillede

Kerry Bowman, en bioetiker ved University of Toronto, siger, at AI har potentialet til at påvirke ens selvbillede negativt, blandt andre etiske spørgsmål.

"På nogle måder kan det være meget sjovt, men disse idealiserede billeder er drevet af sociale forventninger, som kan være meget grusomme og meget snævre," sagde Bowman mandag.

Bowman sagde, at disse AI-programmer gør brug af datasætkilder såsom internettet på jagt efter forskellige kunststile til at skabe disse portrætter. Ulempen er, at når AI gør det, bliver kunstnere sjældent honoreret økonomisk for brugen af deres arbejde eller krediteret.

"Det, der sker med emerging AI, er, at lovene ikke rigtig har været i stand til at holde trit med dette med hensyn til ophavsretsloven. Det er meget svært og meget grumset, og etikken er endnu længere bag lovene, fordi jeg vil påstå, at dette er grundlæggende uretfærdigt,” sagde Bowman.

Bekymringer om personlige data

Bowman rejste også bekymringer om, hvordan folks personlige data opbevares.

“Vil du virkelig have dit ansigt i en stor database? Folk skal selv tage stilling til det her, men det er ikke godartet, der er ikke noget ved det her, det er ikke bare sjovt,” sagde han.

Lensa siger, at billeder opbevares på servere og i apps i højst 24 timer. Med deep learning og machine learning algoritmer samler AI og leverer derefter bedre resultater i fremtiden, også baseret på de slettede data. Dette, siger Bowman, vil resultere i sikkerhedsmæssige bekymringer over den potentielle brug af ansigtsgenkendelse, da denne type data kan blive brugt af politiet ulovligt.

- AI

- Albright Stonebridge

- antitrust

- Barack Obama

- Bitcoin

- blockchain

- overholdelse af blockchain

- california

- Kina

- coinbase

- coingenius

- Konsensus

- kryptokonference

- krypto minedrift

- cryptocurrency

- Cyberspace Administrator of China

- decentral

- deepfakes

- Defi

- Digitale aktiver

- Donald Trump

- ethereum

- machine learning

- MetaNews

- ikke fungibelt symbol

- Paul Triolo

- plato

- platon ai

- Platon Data Intelligence

- PlatoData

- platogaming

- Polygon

- bevis for indsatsen

- Regulering

- regler

- Teknologier

- W3

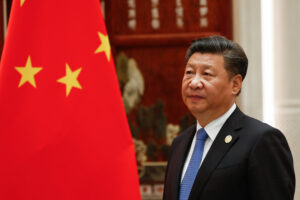

- xi jinping

- zephyrnet