Healthcare and life sciences (HCLS)-kunder anvender generativ AI som et værktøj til at få mere ud af deres data. Brugstilfælde omfatter dokumentresumé for at hjælpe læserne med at fokusere på nøglepunkter i et dokument og transformere ustruktureret tekst til standardiserede formater for at fremhæve vigtige egenskaber. Med unikke dataformater og strenge regulatoriske krav leder kunderne efter valg til at vælge den mest effektive og omkostningseffektive model, samt muligheden for at udføre den nødvendige tilpasning (finjustering) for at passe til deres forretningsbrug. I dette indlæg guider vi dig gennem implementeringen af en Falcon large language model (LLM) ved hjælp af Amazon SageMaker JumpStart og bruge modellen til at opsummere lange dokumenter med LangChain og Python.

Løsningsoversigt

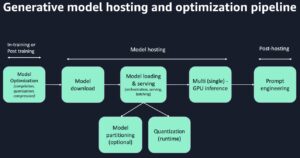

Amazon SageMaker er bygget på Amazons to årtiers erfaring med at udvikle ML-applikationer i den virkelige verden, herunder produktanbefalinger, personalisering, intelligent shopping, robotteknologi og stemmeassisterede enheder. SageMaker er en HIPAA-kvalificeret administreret service, der leverer værktøjer, der gør det muligt for datavidenskabsmænd, ML-ingeniører og forretningsanalytikere at innovere med ML. Inden for SageMaker er Amazon SageMaker Studio, et integreret udviklingsmiljø (IDE) specialbygget til kollaborative ML-arbejdsgange, som til gengæld indeholder en lang række hurtigstartløsninger og fortrænede ML-modeller i en integreret hub kaldet SageMaker JumpStart. Med SageMaker JumpStart kan du bruge forudtrænede modeller, såsom Falcon LLM, med præbyggede prøvenotebooks og SDK-understøttelse til at eksperimentere med og implementere disse kraftfulde transformermodeller. Du kan bruge SageMaker Studio og SageMaker JumpStart til at implementere og forespørge på din egen generative model i din AWS-konto.

Du kan også sikre, at inferensdataene ikke forlader din VPC. Du kan klargøre modeller som single-tenant-slutpunkter og implementere dem med netværksisolering. Ydermere kan du kurere og administrere det udvalgte sæt af modeller, der opfylder dine egne sikkerhedskrav, ved at bruge den private model hub-funktion i SageMaker JumpStart og gemme de godkendte modeller derinde. SageMaker er i stand til HIPAA BAA, SOC123og HITRUST CSF.

Falcon LLM er en stor sprogmodel, trænet af forskere ved Technology Innovation Institute (TII) på over 1 billion tokens ved hjælp af AWS. Falcon har mange forskellige variationer, med sine to hovedbestanddele Falcon 40B og Falcon 7B, der består af henholdsvis 40 milliarder og 7 milliarder parametre, med finjusterede versioner trænet til specifikke opgaver, såsom at følge instruktioner. Falcon klarer sig godt på en række opgaver, herunder tekstresumé, sentimentanalyse, besvarelse af spørgsmål og samtale. Dette indlæg giver en gennemgang, som du kan følge for at implementere Falcon LLM på din AWS-konto ved at bruge en administreret notebook-forekomst gennem SageMaker JumpStart til at eksperimentere med tekstresumé.

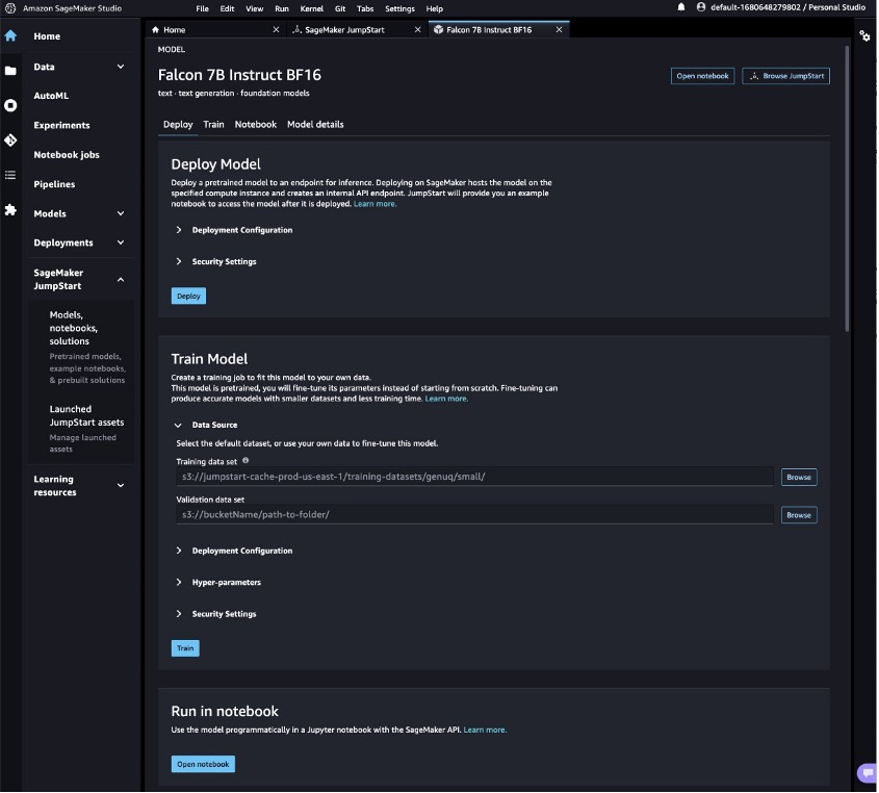

SageMaker JumpStart-modelhubben inkluderer komplette notebooks til at implementere og forespørge på hver model. Når dette skrives, er der seks versioner af Falcon tilgængelige i SageMaker JumpStart-modelhubben: Falcon 40B Instruct BF16, Falcon 40B BF16, Falcon 180B BF16, Falcon 180B Chat BF16, Falcon 7B Instruct BF16 og Falcon 7B BF. Dette indlæg bruger Falcon 16B Instruct-modellen.

I de følgende afsnit viser vi, hvordan du kommer i gang med dokumentopsummering ved at implementere Falcon 7B på SageMaker Jumpstart.

Forudsætninger

Til denne vejledning skal du bruge en AWS-konto med et SageMaker-domæne. Hvis du ikke allerede har et SageMaker-domæne, henvises til Ombord på Amazon SageMaker Domain at skabe en.

Implementer Falcon 7B ved hjælp af SageMaker JumpStart

Udfør følgende trin for at implementere din model:

- Naviger til dit SageMaker Studio-miljø fra SageMaker-konsollen.

- Inden for IDE, under SageMaker JumpStart i navigationsruden skal du vælge Modeller, notesbøger, løsninger.

- Implementer Falcon 7B Instruct-modellen til et slutpunkt til slutning.

Dette åbner modelkortet for Falcon 7B Instruct BF16-modellen. På denne side kan du finde Implementer or Tog muligheder samt links til at åbne prøvenotesbøgerne i SageMaker Studio. Dette indlæg vil bruge prøvenotesbogen fra SageMaker JumpStart til at implementere modellen.

- Vælg Åbn notesbog.

- Kør de første fire celler i den bærbare computer for at implementere Falcon 7B Instruct-slutpunktet.

Du kan se dine implementerede JumpStart-modeller på Lancerede JumpStart-aktiver .

- I navigationsruden under SageMaker Jumpstart, vælg Lancerede JumpStart-aktiver.

- Vælg den Model endepunkter fanen for at se status for dit slutpunkt.

Med Falcon LLM-endepunktet installeret, er du klar til at forespørge modellen.

Kør din første forespørgsel

For at køre en forespørgsel skal du udføre følgende trin:

- På File (Felt) menu, vælg Ny , Notesbog for at åbne en ny notesbog.

Du kan også downloade den færdige notesbog link..

- Vælg billede, kerne og instanstype, når du bliver bedt om det. Til dette indlæg vælger vi Data Science 3.0-billedet, Python 3-kernen og ml.t3.medium-forekomsten.

- Importer Boto3- og JSON-modulerne ved at indtaste følgende to linjer i den første celle:

- Presse Skift + Enter at køre cellen.

- Dernæst kan du definere en funktion, der kalder dit slutpunkt. Denne funktion tager en ordbogsnyttelast og bruger den til at starte SageMaker runtime-klienten. Derefter deserialiserer den svaret og udskriver input og genereret tekst.

Nyttelasten inkluderer prompten som input sammen med inferensparametrene, der vil blive videregivet til modellen.

- Du kan bruge disse parametre med prompten til at tune modellens output til din brug:

Forespørgsel med en opsummeringsprompt

Dette indlæg bruger et eksempel på forskningspapir til at demonstrere opsummering. Eksempeltekstfilen omhandler automatisk tekstresumé i biomedicinsk litteratur. Udfør følgende trin:

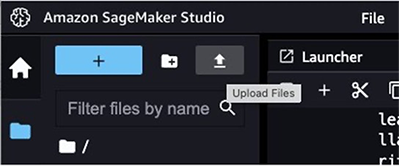

- Hent PDF'en og kopier teksten til en fil med navnet

document.txt. - I SageMaker Studio skal du vælge upload-ikonet og uploade filen til din SageMaker Studio-instans.

Ud af boksen giver Falcon LLM støtte til tekstresumé.

- Lad os oprette en funktion, der bruger hurtige tekniske teknikker til at opsummere

document.txt:

Du vil bemærke, at for længere dokumenter vises en fejl - Falcon har sammen med alle andre LLM'er en grænse for antallet af tokens, der sendes som input. Vi kan omgå denne grænse ved at bruge LangChains forbedrede opsummeringsfunktioner, som gør det muligt at videregive et meget større input til LLM.

Importer og kør en opsummeringskæde

LangChain er et open source-softwarebibliotek, der gør det muligt for udviklere og datavidenskabsfolk hurtigt at bygge, tune og implementere brugerdefinerede generative applikationer uden at administrere komplekse ML-interaktioner, der almindeligvis bruges til at abstrahere mange af de almindelige anvendelsestilfælde for generative AI-sprogmodeller på blot nogle få kodelinjer. LangChains support til AWS-tjenester inkluderer support til SageMaker-endepunkter.

LangChain giver en tilgængelig grænseflade til LLM'er. Dens funktioner omfatter værktøjer til prompt skabelon og prompt kæde. Disse kæder kan bruges til at opsummere tekstdokumenter, der er længere end hvad sprogmodellen understøtter i et enkelt opkald. Du kan bruge en kort-reducerende strategi til at opsummere lange dokumenter ved at opdele dem i håndterbare bidder, opsummere dem og kombinere dem (og opsummere igen, hvis det er nødvendigt).

- Lad os installere LangChain for at begynde:

- Importer de relevante moduler og opdel det lange dokument i bidder:

- For at få LangChain til at fungere effektivt med Falcon, skal du definere standardindholdshåndteringsklasserne for gyldigt input og output:

- Du kan definere brugerdefinerede prompter som

PromptTemplateobjekter, det vigtigste redskab til at prompte med LangChain, til kort-reducerende opsummeringstilgang. Dette er et valgfrit trin, fordi kortlægnings- og kombinationsprompter leveres som standard, hvis parametrene i opkaldet til at indlæse opsummeringskæden (load_summarize_chain) er udefinerede.

- LangChain understøtter LLM'er hostet på SageMaker inference endpoints, så i stedet for at bruge AWS Python SDK, kan du initialisere forbindelsen gennem LangChain for større tilgængelighed:

- Endelig kan du indlæse en opsummeringskæde og køre en oversigt på inputdokumenterne ved hjælp af følgende kode:

Fordi verbose parameter er indstillet til True, vil du se alle de mellemliggende output af kort-reducer tilgangen. Dette er nyttigt til at følge hændelsesforløbet for at nå frem til en endelig oversigt. Med denne kortreducerende tilgang kan du effektivt opsummere dokumenter meget længere, end det normalt er tilladt af modellens maksimale inputtoken-grænse.

Ryd op

Når du er færdig med at bruge slutningsendepunktet, er det vigtigt at slette det for at undgå at pådrage sig unødvendige omkostninger gennem følgende kodelinjer:

Brug af andre fundamentmodeller i SageMaker JumpStart

Brug af andre fundamentmodeller, der er tilgængelige i SageMaker JumpStart, til dokumentopsummering kræver minimal overhead at konfigurere og implementere. LLM'er varierer lejlighedsvis med strukturen af input- og outputformater, og efterhånden som nye modeller og præfabrikerede løsninger føjes til SageMaker JumpStart, afhængigt af opgaveimplementeringen, skal du muligvis foretage følgende kodeændringer:

- Hvis du udfører opsummering via

summarize()metode (metoden uden at bruge LangChain), skal du muligvis ændre JSON-strukturen forpayloadparameter, samt håndteringen af responsvariablen iquery_endpoint()funktion - Hvis du udfører opsummering via LangChain's

load_summarize_chain()metode, skal du muligvis ændreContentHandlerTextSummarizationklasse, nærmere bestemttransform_input(),transform_output()funktioner, for korrekt at håndtere den nyttelast, som LLM forventer, og det output, LLM returnerer

Fundamentmodeller varierer ikke kun i faktorer som inferenshastighed og kvalitet, men også input- og outputformater. Se LLM's relevante informationsside om forventet input og output.

Konklusion

Falcon 7B Instruct-modellen er tilgængelig på SageMaker JumpStart-modelhubben og fungerer på en række brugssager. Dette indlæg demonstrerede, hvordan du kan implementere dit eget Falcon LLM-slutpunkt i dit miljø ved hjælp af SageMaker JumpStart og lave dine første eksperimenter fra SageMaker Studio, hvilket giver dig mulighed for hurtigt at prototype dine modeller og problemfrit skifte til et produktionsmiljø. Med Falcon og LangChain kan du effektivt opsummere langformede sundheds- og biovidenskabsdokumenter i stor skala.

For mere information om at arbejde med generativ AI på AWS, se Annoncering af nye værktøjer til bygning med generativ AI på AWS. Du kan begynde at eksperimentere og bygge dokumentopsummerende beviser på koncept for dine sundheds- og biovidenskabsorienterede GenAI-applikationer ved hjælp af metoden, der er skitseret i dette indlæg. Hvornår Amazonas grundfjeld er generelt tilgængelig, vil vi udgive et opfølgende indlæg, der viser, hvordan du kan implementere dokumentopsummering ved hjælp af Amazon Bedrock og LangChain.

Om forfatterne

John Kitaoka er Solutions Architect hos Amazon Web Services. John hjælper kunder med at designe og optimere AI/ML-arbejdsbelastninger på AWS for at hjælpe dem med at nå deres forretningsmål.

John Kitaoka er Solutions Architect hos Amazon Web Services. John hjælper kunder med at designe og optimere AI/ML-arbejdsbelastninger på AWS for at hjælpe dem med at nå deres forretningsmål.

Josh Famestad er Solutions Architect hos Amazon Web Services. Josh arbejder med kunder i den offentlige sektor for at opbygge og udføre cloud-baserede tilgange til at levere på virksomhedens prioriteter.

Josh Famestad er Solutions Architect hos Amazon Web Services. Josh arbejder med kunder i den offentlige sektor for at opbygge og udføre cloud-baserede tilgange til at levere på virksomhedens prioriteter.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/create-an-hcls-document-summarization-application-with-falcon-using-amazon-sagemaker-jumpstart/

- :har

- :er

- :ikke

- $OP

- 1

- 10

- 100

- 11

- 12

- 14

- 150

- 16

- 1M

- 20

- 40

- 400

- 50

- 500

- 7

- a

- evne

- ABSTRACT

- accepterer

- tilgængelighed

- tilgængelig

- Konto

- opnå

- tilføjet

- Vedtagelsen

- igen

- AI

- AI / ML

- Alle

- tilladt

- tillade

- tillader

- langs med

- allerede

- også

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- analyse

- Analytikere

- ,

- dyr

- dyr

- Anvendelse

- applikationer

- tilgang

- tilgange

- godkendt

- ER

- omkring

- AS

- At

- attributter

- Automatisk Ur

- til rådighed

- undgå

- AWS

- baseret

- BE

- fordi

- begynde

- mener

- Billion

- biomedicinsk

- krop

- pin

- Boks

- Pause

- Breaking

- bygge

- Bygning

- bygget

- virksomhed

- men

- by

- ringe

- kaldet

- CAN

- Kan få

- kapaciteter

- kapacitet

- kort

- tilfælde

- tilfælde

- Celler

- kæde

- kæder

- lave om

- Ændringer

- valg

- Vælg

- vælge

- klasse

- klasser

- kunde

- Cloud

- kode

- kollaborativ

- kombinerer

- kombinerer

- Fælles

- almindeligt

- sammenlignet

- fuldføre

- Afsluttet

- komplekse

- Indeholder

- Konceptet

- kortfattet

- tilslutning

- Konsol

- indeholder

- indhold

- omkostningseffektiv

- Omkostninger

- skabe

- skik

- Kunder

- tilpasning

- data

- datalogi

- årtier

- Standard

- definere

- levere

- demonstrere

- demonstreret

- Afhængigt

- indsætte

- indsat

- implementering

- implementering

- Design

- udviklere

- udvikling

- Udvikling

- Enheder

- forskellige

- do

- dokumentet

- dokumenter

- Er ikke

- domæne

- Dont

- ned

- downloade

- hver

- jorden

- effektivt

- muliggøre

- Endpoint

- Engineering

- Ingeniører

- forbedret

- sikre

- indtastning

- Miljø

- fejl

- begivenheder

- eksempel

- udføre

- forventet

- forventer

- erfaring

- eksperiment

- eksperimenter

- Ansigtet

- faktorer

- falsk

- Funktionalitet

- få

- File (Felt)

- endelige

- Finde

- Fornavn

- passer

- Fokus

- følger

- efter

- Til

- Foundation

- fire

- fra

- funktion

- funktioner

- Endvidere

- generelt

- generere

- genereret

- generative

- Generativ AI

- få

- Mål

- større

- håndtere

- Håndtering

- Have

- sundhedspleje

- hjælpe

- hjælper

- Fremhæv

- hostede

- Hvordan

- How To

- HTML

- HTTPS

- Hub

- ICON

- if

- billede

- gennemføre

- implementering

- importere

- vigtigt

- in

- omfatter

- omfatter

- Herunder

- oplysninger

- innovere

- Innovation

- indgang

- indgange

- installere

- instans

- i stedet

- Institut

- anvisninger

- integreret

- Intelligent

- interaktioner

- grænseflade

- ind

- isolation

- IT

- ITS

- John

- json

- lige

- Nøgle

- Sprog

- stor

- større

- lanceret

- Forlade

- Bibliotek

- Livet

- Life Sciences

- GRÆNSE

- linjer

- links

- litteratur

- LLM

- belastning

- Lang

- længere

- leder

- Main

- lave

- administrere

- håndterbar

- lykkedes

- styring

- mange

- kortlægning

- maksimal

- Kan..

- medium

- Menu

- metode

- mindste

- ML

- model

- modeller

- ændre

- Moduler

- mere

- mest

- meget

- Navigation

- nødvendig

- Behov

- behov

- netværk

- Ny

- NIH

- Normalt

- notesbog

- Varsel..

- nummer

- objekter

- of

- on

- ONE

- kun

- åbent

- open source

- Open source software

- Optimer

- Indstillinger

- Andet

- skitseret

- output

- i løbet af

- egen

- side

- brød

- Papir

- parameter

- parametre

- Bestået

- Udfør

- udfører

- udfører

- Personalisering

- plato

- Platon Data Intelligence

- PlatoData

- punkter

- Indlæg

- vigtigste

- udskrifter

- private

- behandle

- Produkt

- produktion

- beviser

- prototype

- give

- forudsat

- giver

- bestemmelse

- offentlige

- offentliggøre

- Python

- kvalitet

- spørgsmål

- hurtigt

- hurtigt

- læsere

- klar

- virkelige verden

- anbefalinger

- henvise

- lovgivningsmæssige

- relevant

- Krav

- Kræver

- forskning

- forskere

- henholdsvis

- svar

- afkast

- robotteknik

- Kør

- sagemaker

- SageMaker Inference

- Scale

- Videnskab

- VIDENSKABER

- forskere

- rækkevidde

- SDK

- problemfrit

- sektioner

- sektor

- sikkerhed

- se

- valgt

- SELV

- stemningen

- Sequence

- tjeneste

- Tjenester

- sæt

- indstilling

- Shopping

- Kort

- Vis

- enkelt

- SIX

- So

- Software

- Løsninger

- specifikke

- specifikt

- hastighed

- starte

- påbegyndt

- Status

- Trin

- Steps

- lagring

- Strategi

- Streng

- struktur

- Studio

- sådan

- opsummere

- RESUMÉ

- support

- Understøtter

- tager

- Opgaver

- opgaver

- teknikker

- Teknologier

- Teknologiinnovation

- tekst

- end

- at

- deres

- Them

- derefter

- Der.

- Disse

- denne

- Gennem

- til

- sammen

- token

- Tokens

- værktøj

- værktøjer

- uddannet

- transformer

- omdanne

- overgang

- trillion

- sand

- TUR

- tutorial

- to

- typen

- undefined

- enestående

- unødvendig

- Uploading

- brug

- brug tilfælde

- anvendte

- bruger

- ved brug af

- variabel

- række

- køretøj

- versioner

- via

- Specifikation

- gå

- går igennem

- we

- web

- webservices

- GODT

- Hvad

- hvornår

- som

- bred

- vilje

- med

- inden for

- uden

- Arbejde

- arbejdsgange

- arbejder

- virker

- skriver

- skrivning

- Du

- Din

- zephyrnet