Kimen til et maskinlæringsparadigmeskift (ML) har eksisteret i årtier, men med den let tilgængelige tilgængelighed af praktisk talt uendelig computerkapacitet, en massiv udbredelse af data og den hurtige udvikling af ML-teknologier, er kunder på tværs af industrier hurtigt ved at adoptere og bruge ML teknologier til at transformere deres forretninger.

For nylig har generative AI-applikationer fanget alles opmærksomhed og fantasi. Vi er virkelig ved et spændende omdrejningspunkt i den udbredte anvendelse af ML, og vi tror på, at enhver kundeoplevelse og applikation vil blive genopfundet med generativ AI.

Generativ AI er en type AI, der kan skabe nyt indhold og nye ideer, herunder samtaler, historier, billeder, videoer og musik. Som al anden kunstig intelligens er generativ kunstig intelligens drevet af ML-modeller - meget store modeller, der er forudtrænede på store datakorpora og almindeligvis omtales som grundmodeller (FM'er).

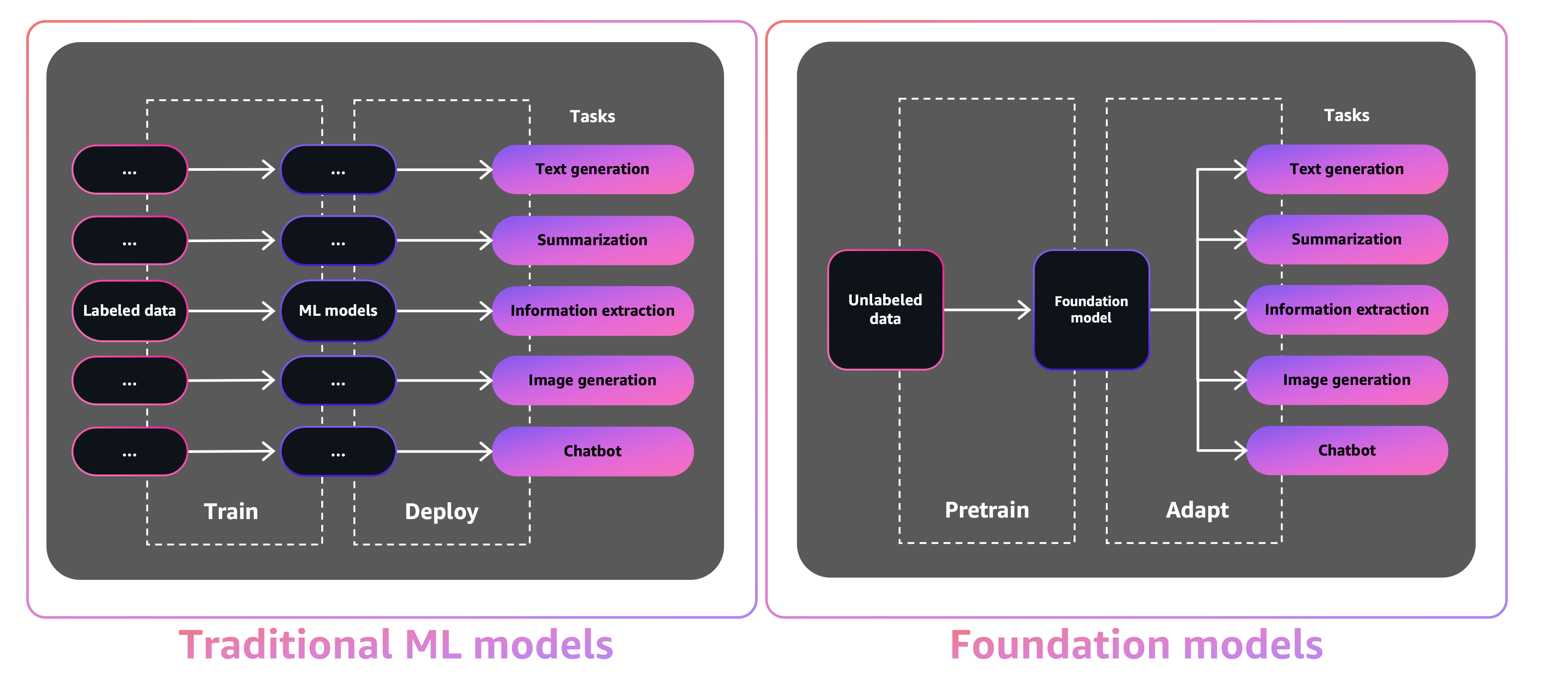

FM'ers størrelse og generelle karakter gør dem anderledes end traditionelle ML-modeller, som typisk udfører specifikke opgaver, såsom at analysere tekst for følelser, klassificere billeder og forudsige tendenser.

Med traditionelle ML-modeller skal du for at opnå hver specifik opgave indsamle mærkede data, træne en model og implementere denne model. Med basismodeller kan du i stedet for at indsamle mærkede data for hver model og træne flere modeller bruge den samme præ-trænede FM til at tilpasse forskellige opgaver. Du kan også tilpasse FM'er til at udføre domænespecifikke funktioner, der adskiller sig fra dine virksomheder, ved kun at bruge en lille brøkdel af de data og den computer, der kræves for at træne en model fra bunden.

Generativ kunstig intelligens har potentialet til at forstyrre mange industrier ved at revolutionere den måde, indhold skabes og forbruges på. Produktion af originalt indhold, kodegenerering, forbedring af kundeservice og dokumentopsummering er typiske tilfælde af generativ AI.

Amazon SageMaker JumpStart leverer forudtrænede open source-modeller til en lang række problemtyper for at hjælpe dig med at komme i gang med ML. Du kan trinvist træne og tune disse modeller før implementering. JumpStart leverer også løsningsskabeloner, der opsætter infrastruktur til almindelige brugstilfælde og eksekverbare eksempelnotebooks til ML med Amazon SageMaker.

Med over 600 fortrænede modeller tilgængelige og vokser hver dag, gør JumpStart det muligt for udviklere hurtigt og nemt at inkorporere avancerede ML-teknikker i deres produktionsarbejdsgange. Du kan få adgang til de fortrænede modeller, løsningsskabeloner og eksempler via JumpStart-landingssiden i Amazon SageMaker Studio. Du kan også få adgang til JumpStart-modeller ved hjælp af SageMaker Python SDK. For information om, hvordan du bruger JumpStart-modeller programmatisk, se Brug SageMaker JumpStart-algoritmer med forudtrænede modeller.

I april 2023 afslørede AWS Amazonas grundfjeld, som giver en måde at bygge generative AI-drevne apps via præ-trænede modeller fra startups, bl.a. AI21 Labs, Antropiskog Stabilitet AI. Amazon Bedrock tilbyder også adgang til Titan Foundation-modeller, en familie af modeller, der er trænet internt af AWS. Med den serverløse oplevelse af Amazon Bedrock kan du nemt finde den rigtige model til dine behov, komme hurtigt i gang, privat tilpasse FM'er med dine egne data og nemt integrere og implementere dem i dine applikationer ved hjælp af de AWS-værktøjer og -funktioner, du kender. med (inklusive integrationer med SageMaker ML funktioner som Amazon SageMaker-eksperimenter at teste forskellige modeller og Amazon SageMaker Pipelines at administrere dine FM'er i stor skala) uden at skulle administrere nogen infrastruktur.

I dette indlæg viser vi, hvordan man implementerer billed- og tekstgenerative AI-modeller fra JumpStart ved hjælp af AWS Cloud Development Kit (AWS CDK). AWS CDK er en open source-softwareudviklingsramme til at definere dine cloud-applikationsressourcer ved hjælp af velkendte programmeringssprog som Python.

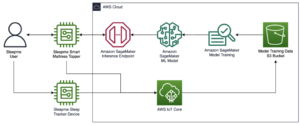

Vi bruger modellen Stable Diffusion til billedgenerering og FLAN-T5-XL modellen til naturlig sprogforståelse (NLU) og tekstgenerering fra Knusende ansigt i JumpStart.

Løsningsoversigt

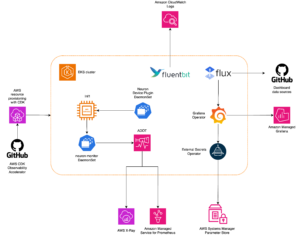

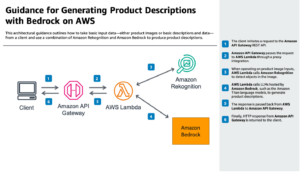

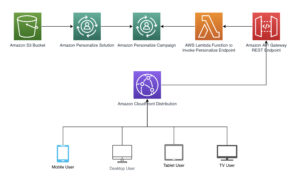

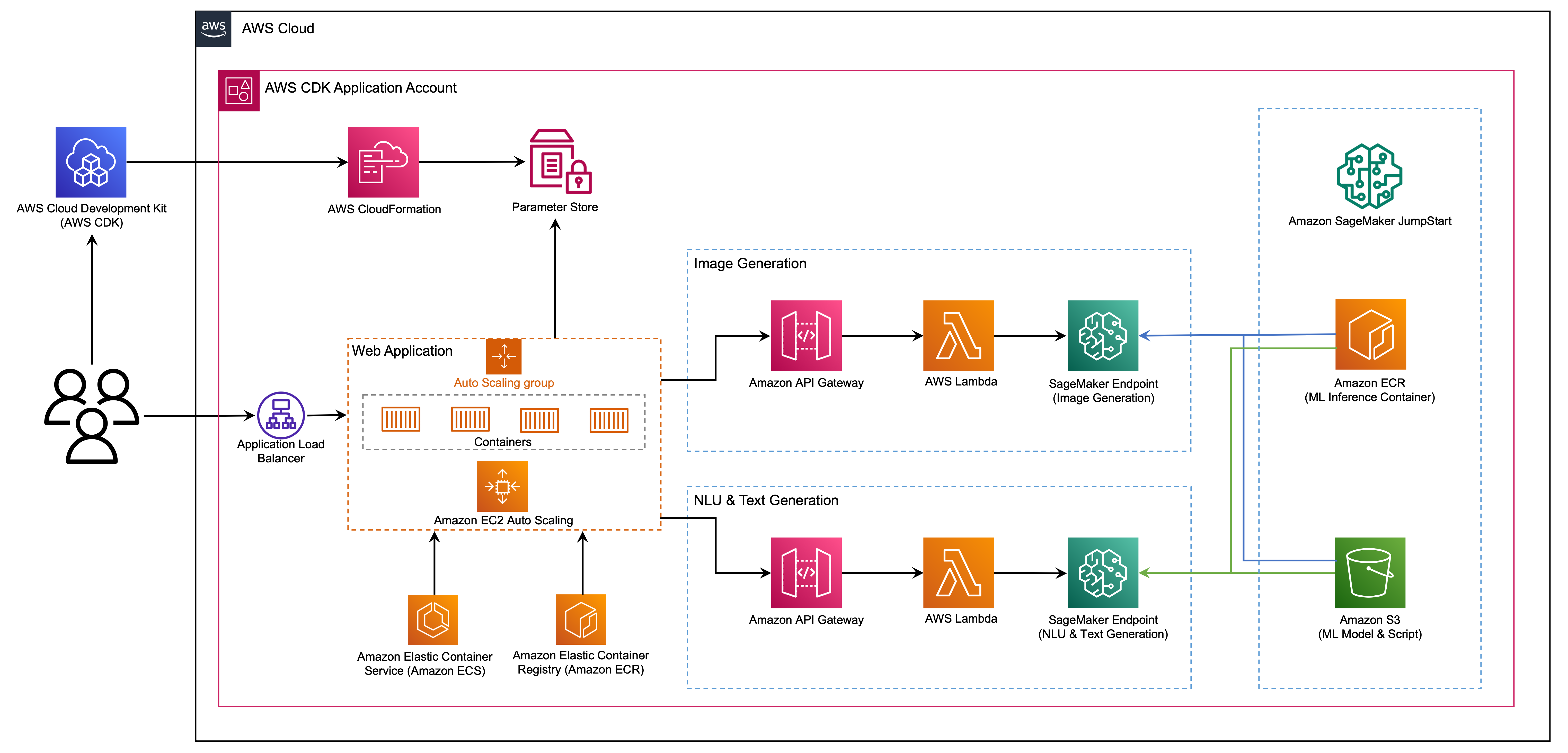

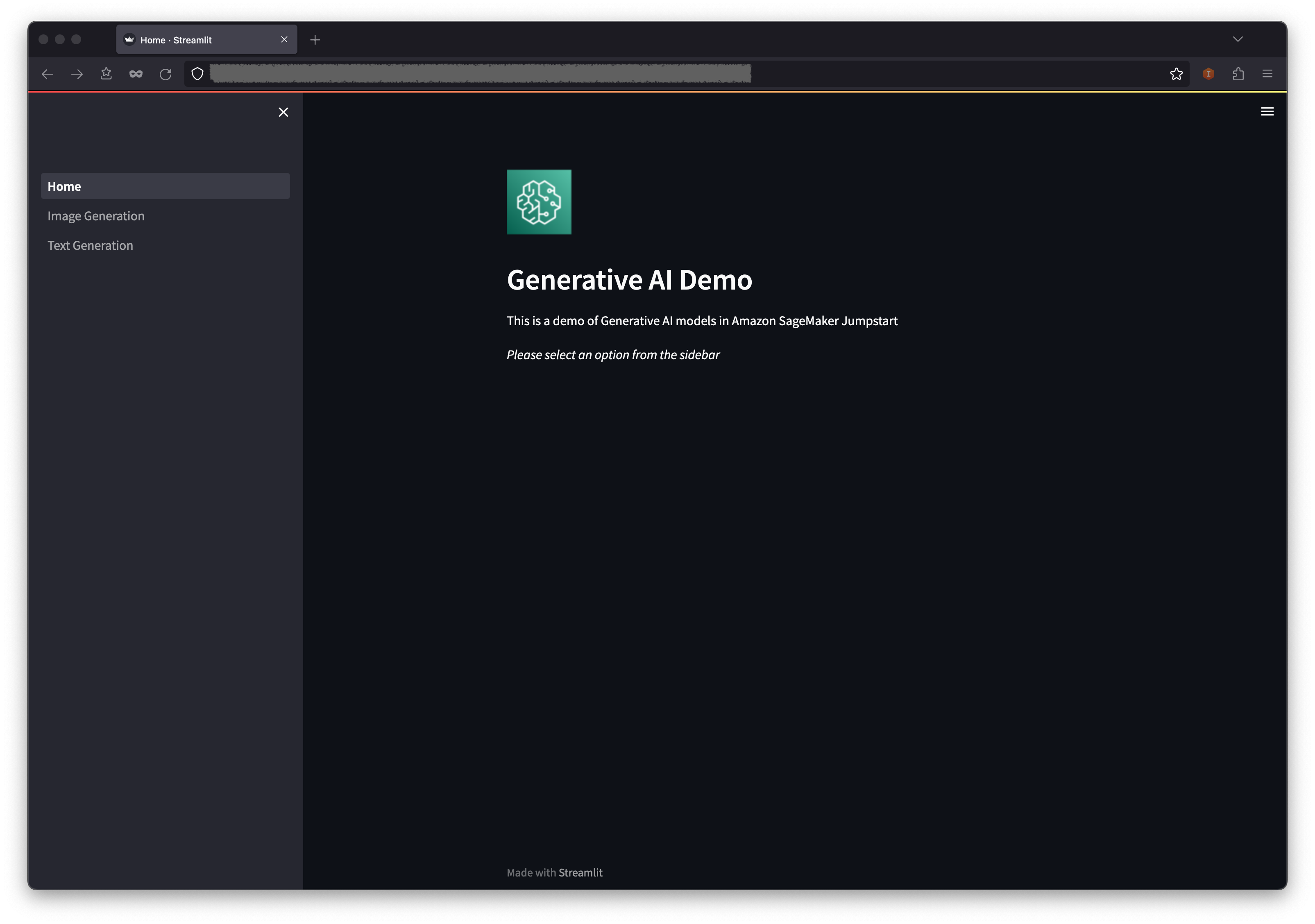

Webapplikationen er bygget på Strømbelyst, et open source Python-bibliotek, der gør det nemt at skabe og dele smukke, tilpassede webapps til ML og datavidenskab. Vi hoster webapplikationen vha Amazon Elastic Container Service (Amazon ECS) med AWS Fargate og den tilgås via en Application Load Balancer. Fargate er en teknologi, som du kan bruge med Amazon ECS til at køre beholdere uden at skulle administrere servere eller klynger eller virtuelle maskiner. De generative AI-modelslutpunkter lanceres fra JumpStart-billeder i Amazon Elastic Container Registry (Amazon ECR). Modeldata gemmes på Amazon Simple Storage Service (Amazon S3) i JumpStart-kontoen. Webapplikationen interagerer med modellerne via Amazon API Gateway , AWS Lambda fungerer som vist i følgende diagram.

API Gateway giver webapplikationen og andre klienter en standard RESTful-grænseflade, mens den afskærmer de Lambda-funktioner, der interfacer med modellen. Dette forenkler klientapplikationskoden, der bruger modellerne. API Gateway-endepunkterne er offentligt tilgængelige i dette eksempel, hvilket giver mulighed for at udvide denne arkitektur til at implementere forskellige API adgangskontrol og integrere med andre applikationer.

I dette indlæg guider vi dig gennem følgende trin:

- Installer AWS kommandolinjegrænseflade (AWS CLI) og AWS CDK v2 på din lokale maskine.

- Klon og opsæt AWS CDK-applikationen.

- Implementer AWS CDK-applikationen.

- Brug billedgenererings-AI-modellen.

- Brug tekstgenererings-AI-modellen.

- Se de implementerede ressourcer på AWS Management Console.

Vi giver et overblik over koden i dette projekt i appendiks sidst i dette indlæg.

Forudsætninger

Du skal have følgende forudsætninger:

Du kan implementere infrastrukturen i dette selvstudie fra din lokale computer, eller du kan bruge AWS Cloud9 som din installationsarbejdsstation. AWS Cloud9 kommer forudindlæst med AWS CLI, AWS CDK og Docker. Hvis du vælger AWS Cloud9, skabe miljøet fra AWS konsol.

Den anslåede pris for at færdiggøre dette indlæg er $50, forudsat at du lader ressourcerne køre i 8 timer. Sørg for at slette de ressourcer, du opretter i dette indlæg, for at undgå løbende opkrævninger.

Installer AWS CLI og AWS CDK på din lokale maskine

Hvis du ikke allerede har AWS CLI på din lokale maskine, se Installation eller opdatering af den seneste version af AWS CLI , Konfiguration af AWS CLI.

Installer AWS CDK Toolkit globalt ved hjælp af følgende node package manager kommando:

Kør følgende kommando for at bekræfte den korrekte installation og udskriv versionsnummeret på AWS CDK:

Sørg for, at du har Docker installeret på din lokale maskine. Udsted følgende kommando for at bekræfte versionen:

Klon og opsæt AWS CDK-applikationen

På din lokale maskine skal du klone AWS CDK-applikationen med følgende kommando:

Naviger til projektmappen:

Før vi implementerer applikationen, lad os gennemgå mappestrukturen:

stack mappen indeholder koden for hver stak i AWS CDK-applikationen. Det code mappen indeholder koden til Lambda-funktionerne. Depotet indeholder også webapplikationen, der er placeret under mappen web-app.

cdk.json fil fortæller AWS CDK Toolkit, hvordan du kører din applikation.

Denne applikation blev testet i us-east-1 Region, men det bør fungere i enhver region, der har de påkrævede tjenester og inferensinstanstype ml.g4dn.4xlarge specificeret i app.py.

Konfigurer et virtuelt miljø

Dette projekt er sat op som et standard Python-projekt. Opret et virtuelt Python-miljø ved hjælp af følgende kode:

Brug følgende kommando til at aktivere det virtuelle miljø:

Hvis du er på en Windows-platform, skal du aktivere det virtuelle miljø som følger:

Når det virtuelle miljø er aktiveret, skal du opgradere pip til den nyeste version:

Installer de nødvendige afhængigheder:

Før du implementerer en AWS CDK-applikation, skal du bootstrap et mellemrum på din konto og den region, du implementerer i. For at bootstrap i din standardregion skal du udstede følgende kommando:

Hvis du vil implementere til en bestemt konto og region, skal du udsende følgende kommando:

For mere information om denne opsætning, besøg Kom godt i gang med AWS CDK.

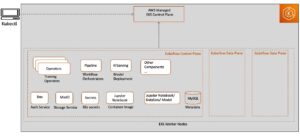

AWS CDK applikationsstabelstruktur

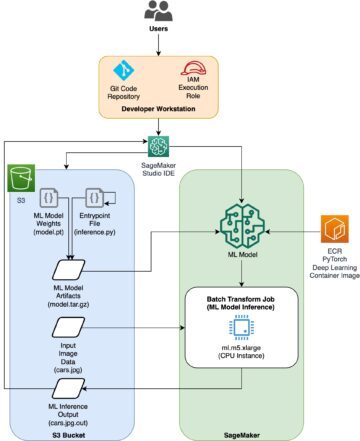

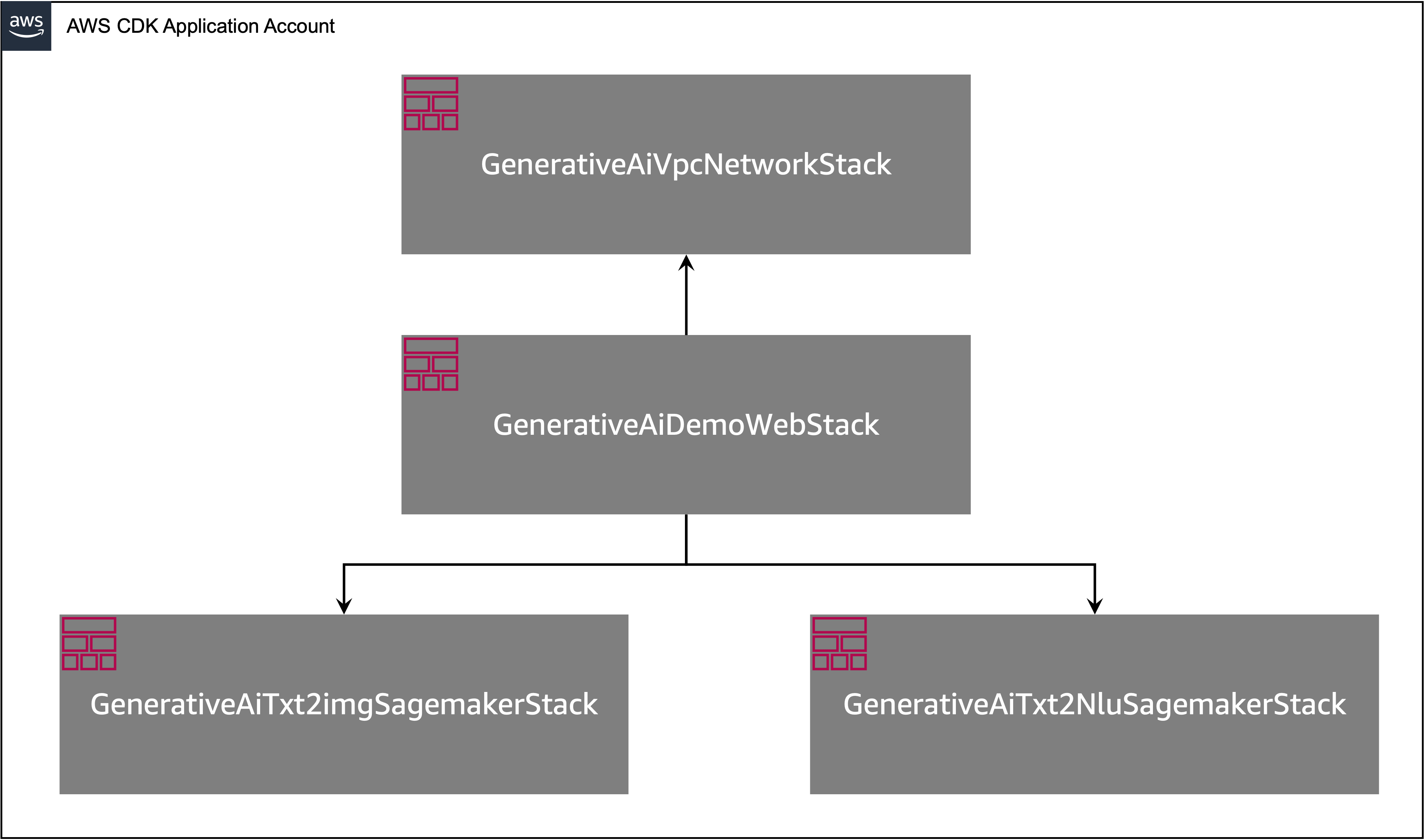

AWS CDK-applikationen indeholder flere stakke, som vist i følgende diagram.

Du kan liste stakkene i din AWS CDK-applikation med følgende kommando:

Følgende er andre nyttige AWS CDK-kommandoer:

- cdk ls – Viser alle stakke i appen

- cdk synth – Udsender det syntetiserede AWS CloudFormation skabelon

- cdk implementere – Implementerer denne stak til din standard AWS-konto og -region

- cdk diff – Sammenligner den installerede stak med den aktuelle tilstand

- cdk docs – Åbner AWS CDK-dokumentationen

Det næste afsnit viser dig, hvordan du implementerer AWS CDK-applikationen.

Implementer AWS CDK-applikationen

AWS CDK-applikationen vil blive implementeret til standardregionen baseret på din arbejdsstationskonfiguration. Hvis du vil tvinge implementeringen i en bestemt region, skal du indstille din AWS_DEFAULT_REGION miljøvariabel i overensstemmelse hermed.

På dette tidspunkt kan du implementere AWS CDK-applikationen. Først starter du VPC-netværksstakken:

Indtast, hvis du bliver bedt om det y for at fortsætte med implementeringen. Du bør se en liste over AWS-ressourcer, der leveres i stakken. Dette trin tager omkring 3 minutter at fuldføre.

Så starter du webapplikationsstakken:

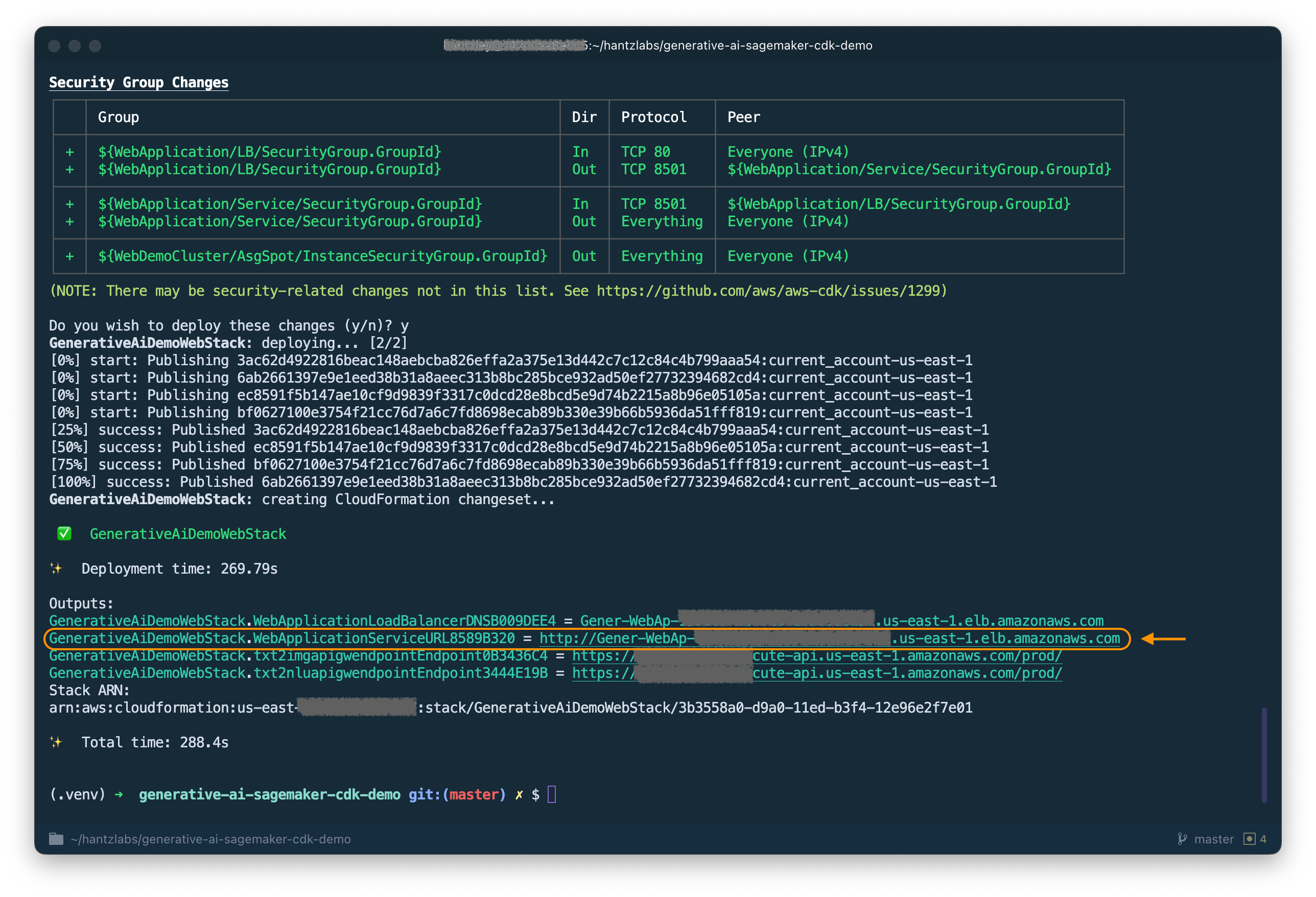

Efter at have analyseret stakken, vil AWS CDK vise ressourcelisten i stakken. Indtast y for at fortsætte med implementeringen. Dette trin tager omkring 5 minutter.

Bemærk ned WebApplicationServiceURL fra output til senere brug. Du kan også hente det på AWS CloudFormation-konsollen under GenerativeAiDemoWebStack stak udgange.

Start nu billedgenererings AI-modellens slutpunktstak:

Dette trin tager omkring 8 minutter. Billedgenereringsmodellens slutpunkt er implementeret, vi kan nu bruge det.

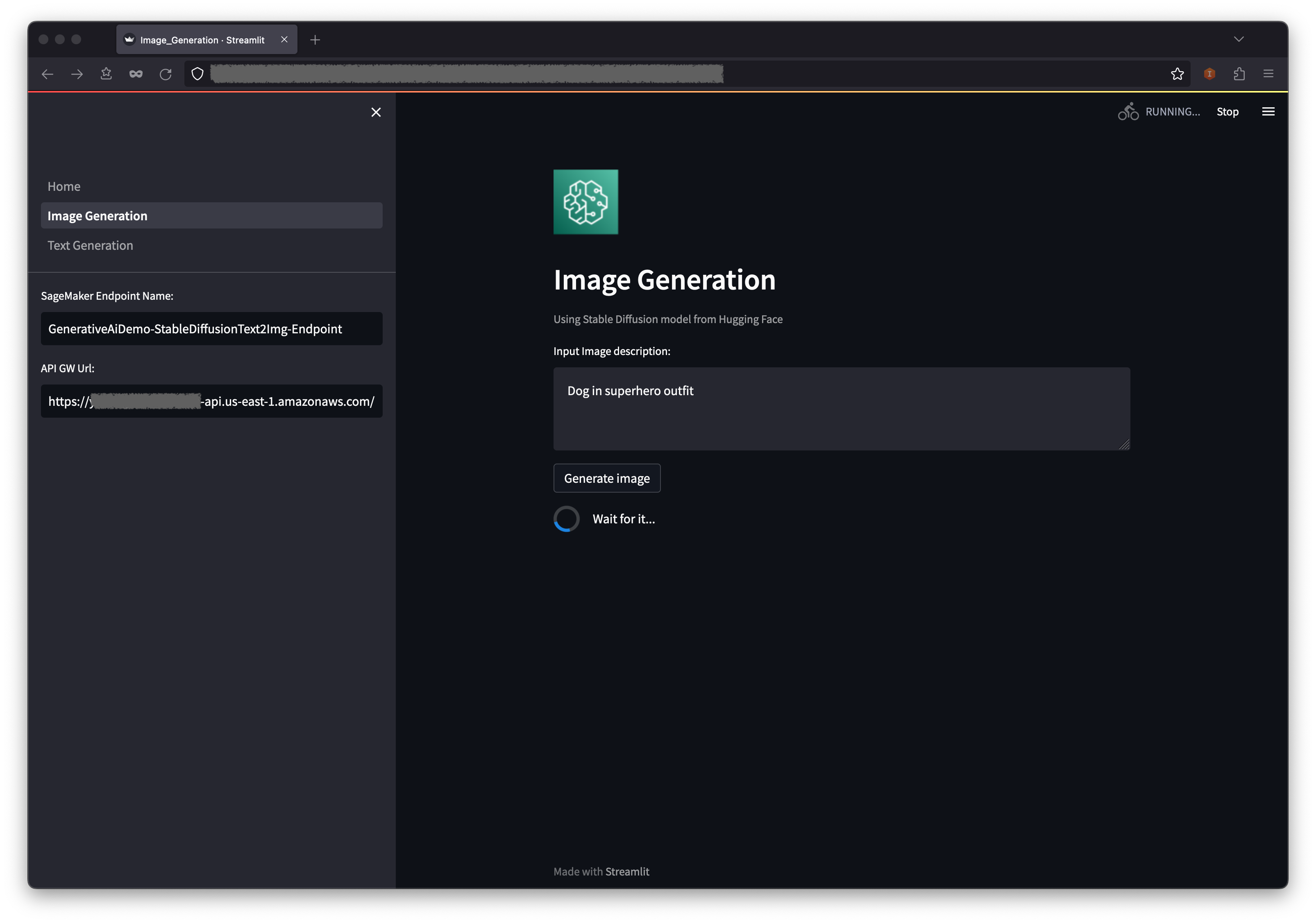

Brug billedgenererings-AI-modellen

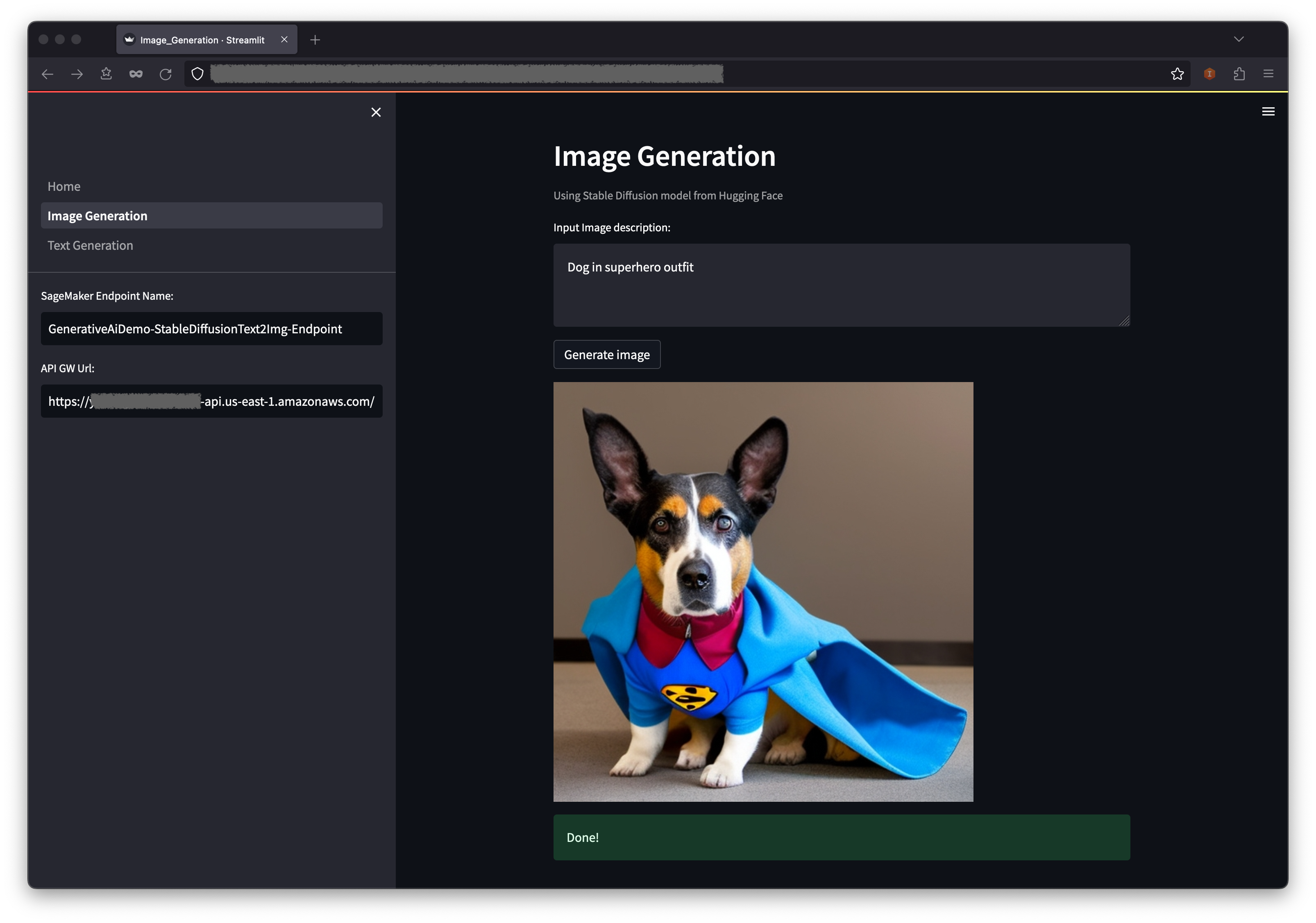

Det første eksempel demonstrerer, hvordan man bruger Stable Diffusion, en kraftfuld generativ modelleringsteknik, der gør det muligt at skabe billeder i høj kvalitet fra tekstprompter.

- Få adgang til webapplikationen ved hjælp af

WebApplicationServiceURLfra udgangen afGenerativeAiDemoWebStacki din browser.

- Vælg i navigationsruden Billedgenerering.

- SageMaker Endpoint Navn , API GW URL felter vil blive udfyldt på forhånd, men du kan ændre prompten for billedbeskrivelsen, hvis du ønsker det.

- Vælg Generer billede.

- Applikationen vil foretage et opkald til SageMaker-slutpunktet. Det tager et par sekunder. Et billede med egenskaberne i din billedbeskrivelse vil blive vist.

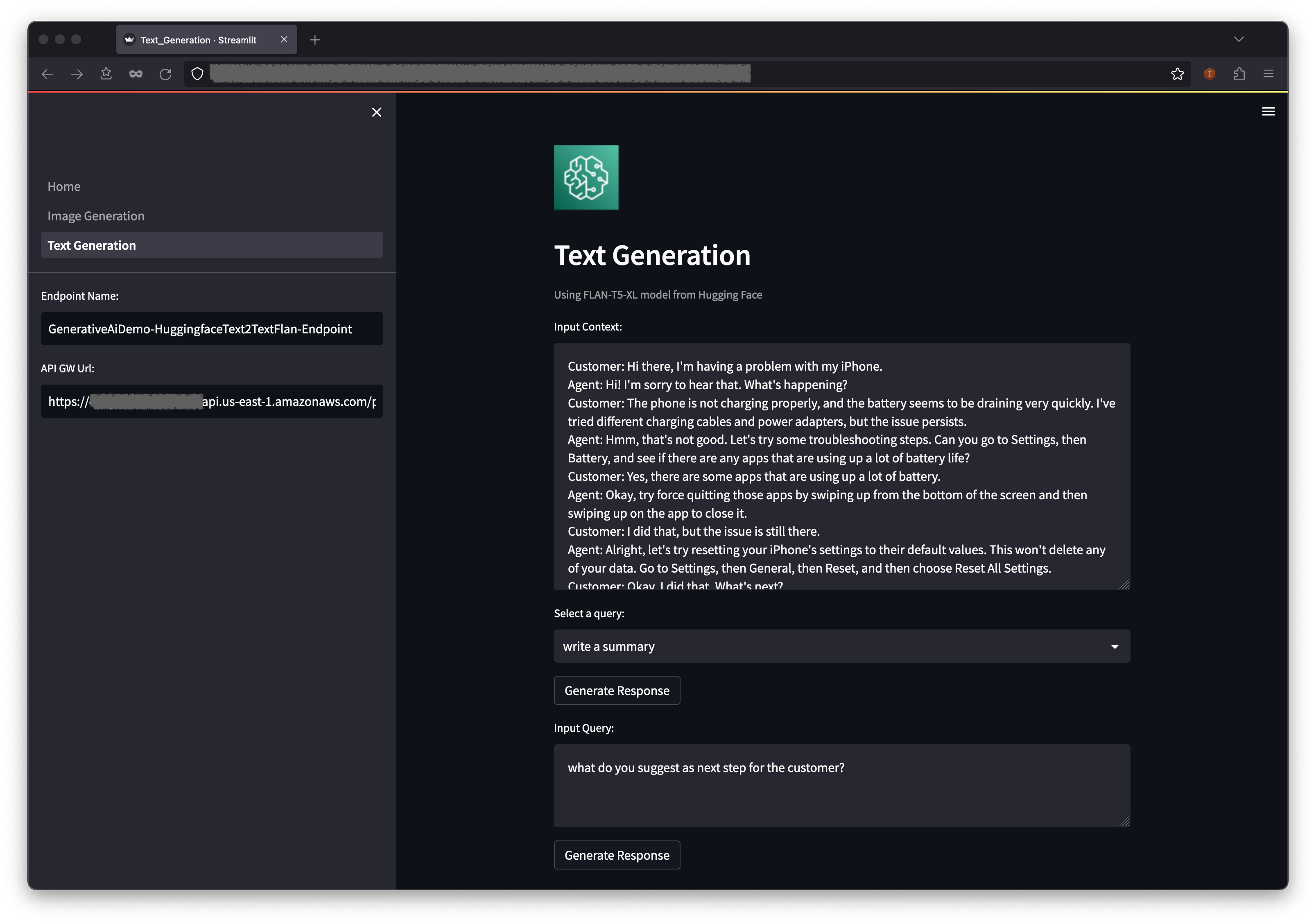

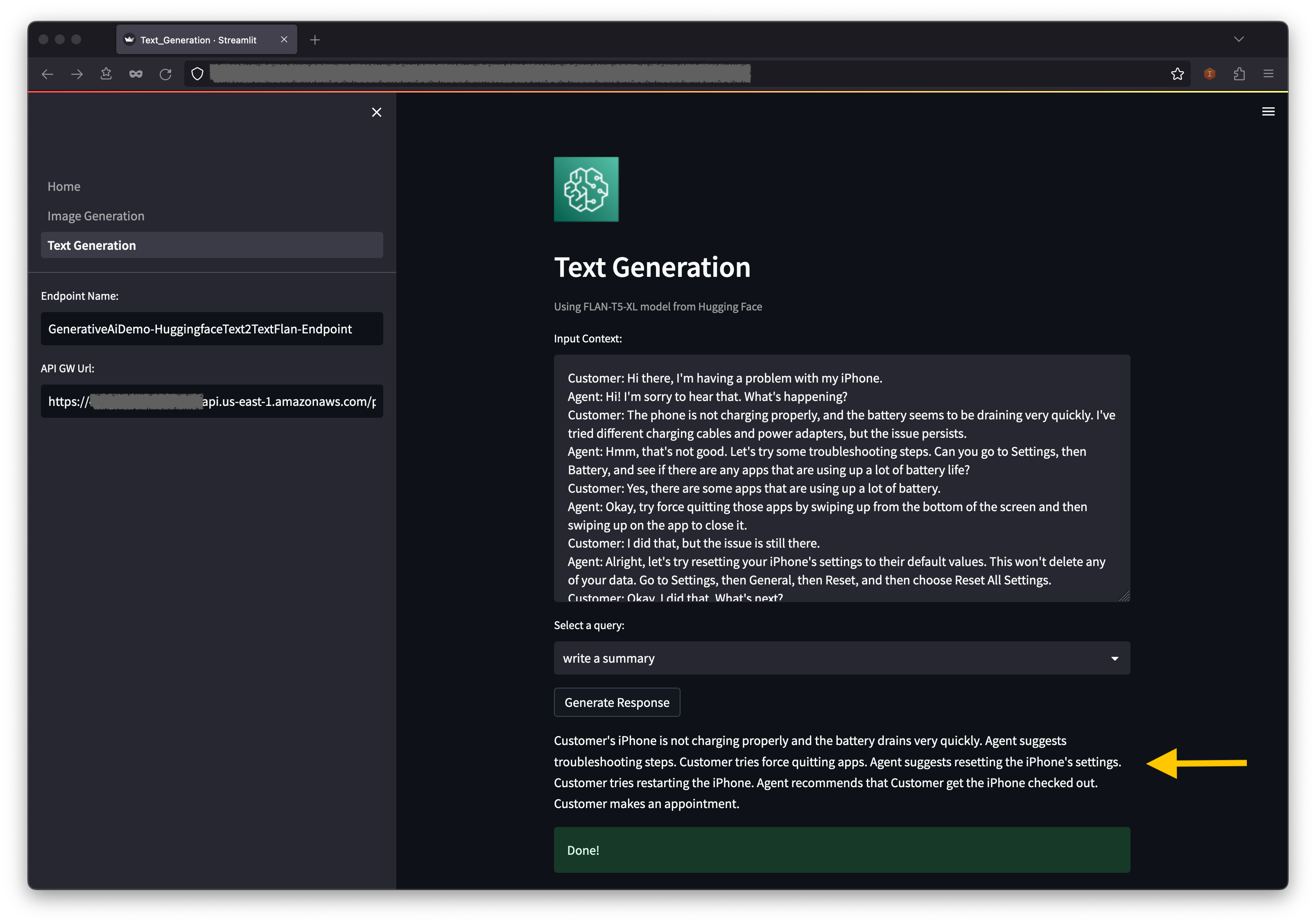

Brug tekstgenererings-AI-modellen

Det andet eksempel er centreret omkring brugen af FLAN-T5-XL-modellen, som er en grundlæggende eller stor sprogmodel (LLM), til at opnå in-tekstindlæring til tekstgenerering, samtidig med at den adresserer en bred vifte af naturlig sprogforståelse (NLU) og naturlig sproggenereringsopgaver (NLG).

Nogle miljøer kan begrænse antallet af slutpunkter, du kan starte ad gangen. Hvis dette er tilfældet, kan du starte ét SageMaker-slutpunkt ad gangen. For at stoppe et SageMaker-slutpunkt i AWS CDK-appen skal du ødelægge den installerede slutpunktstak og før du starter den anden slutpunktstak. For at skrue ned for endepunktet for billedgenerering af AI-model skal du udføre følgende kommando:

Start derefter tekstgenererings AI-modellens slutpunktstak:

Indtast y ved anvisningerne.

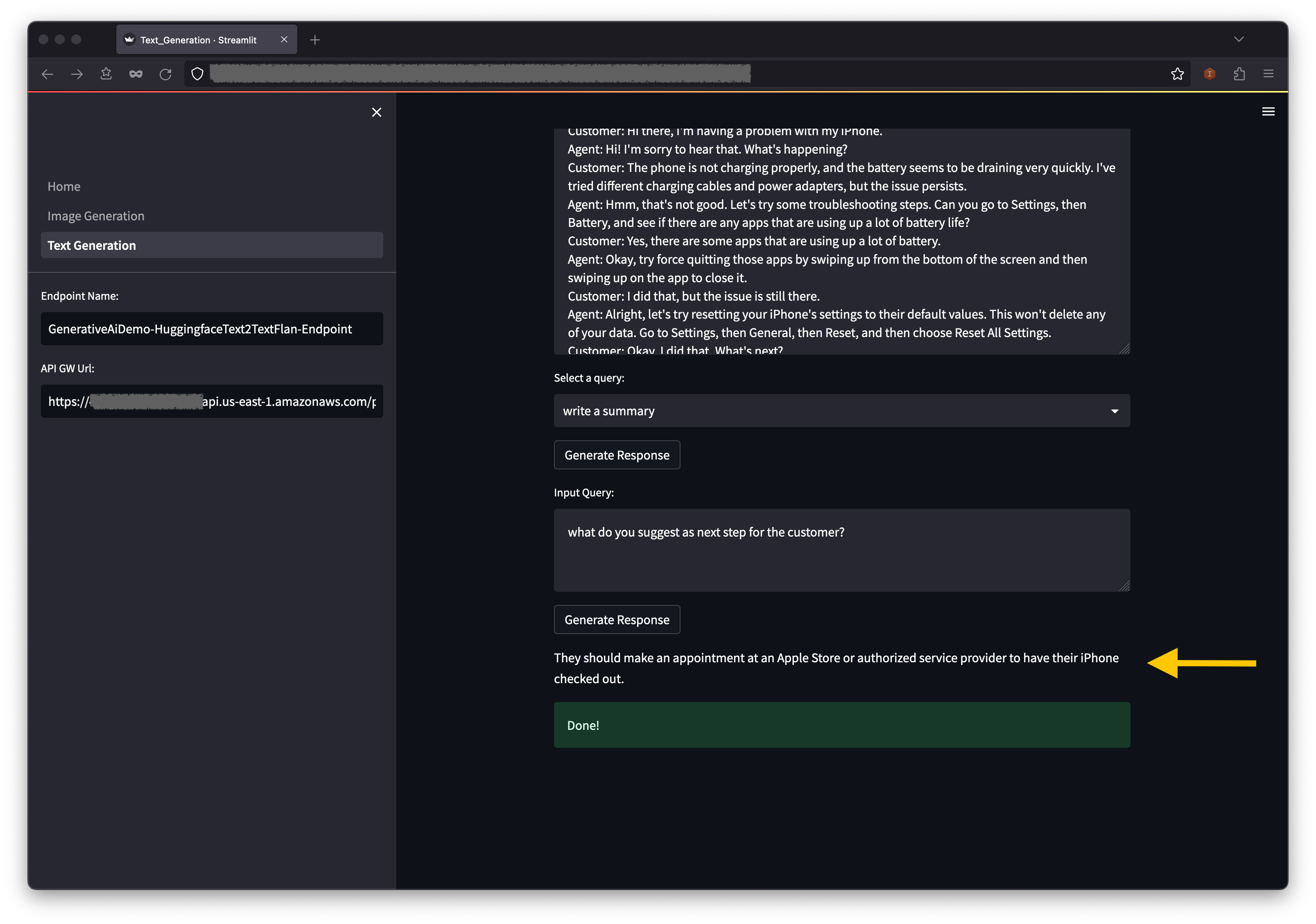

Når tekstgenereringsmodellens slutpunktstak er lanceret, skal du udføre følgende trin:

- Gå tilbage til webapplikationen og vælg Tekstgenerering i navigationsruden.

- Input kontekst feltet er på forhånd udfyldt med en samtale mellem en kunde og en agent vedrørende et problem med kundens telefon, men du kan indtaste din egen kontekst, hvis du vil.

- Under konteksten finder du nogle forhåndsudfyldte forespørgsler i rullemenuen. Vælg en forespørgsel og vælg Generer svar.

- Du kan også indtaste din egen forespørgsel i Indtast forespørgsel felt og vælg derefter Generer svar.

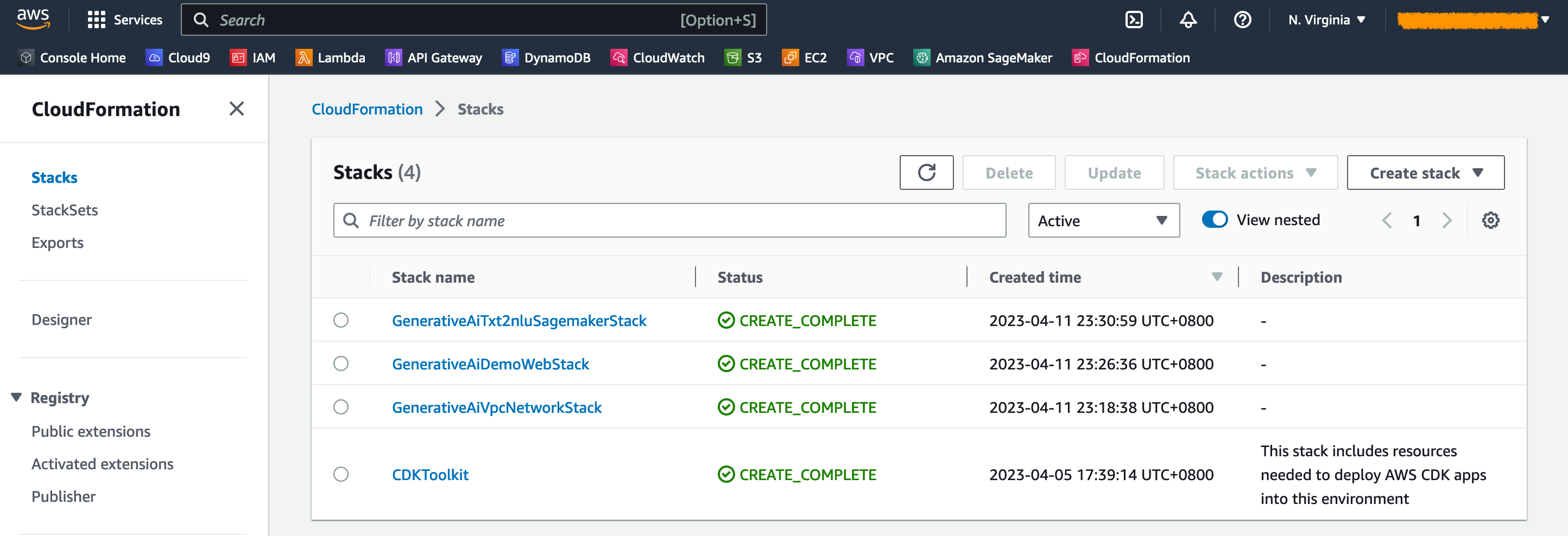

Se de implementerede ressourcer på konsollen

På AWS CloudFormation-konsollen skal du vælge Stakke i navigationsruden for at se de installerede stakke.

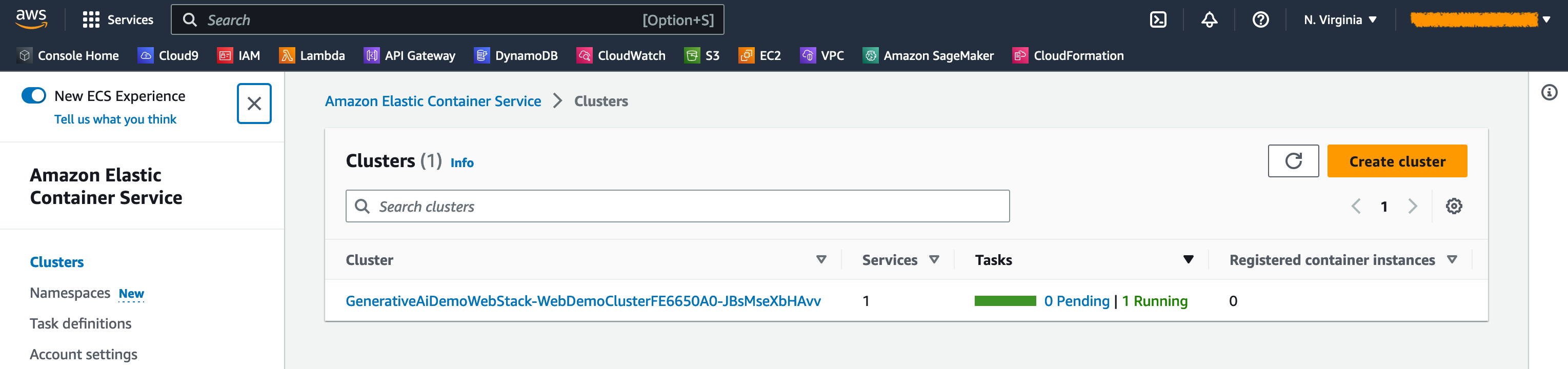

På Amazon ECS-konsollen kan du se klyngerne på Klynger .

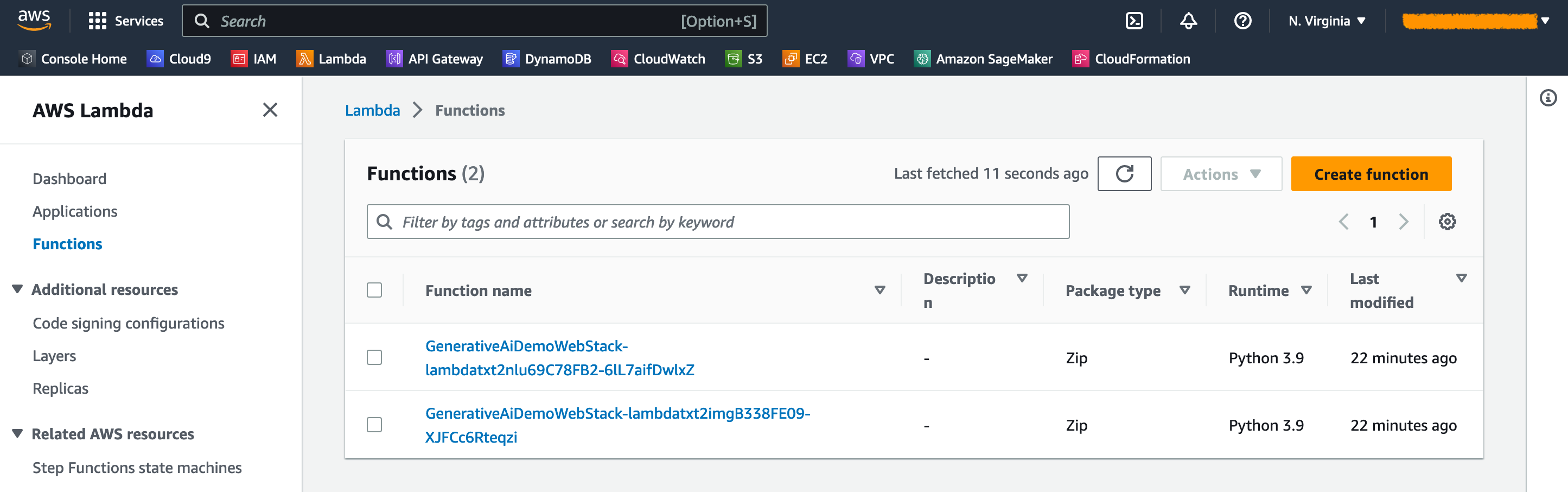

På AWS Lambda-konsollen kan du se funktionerne på Funktioner .

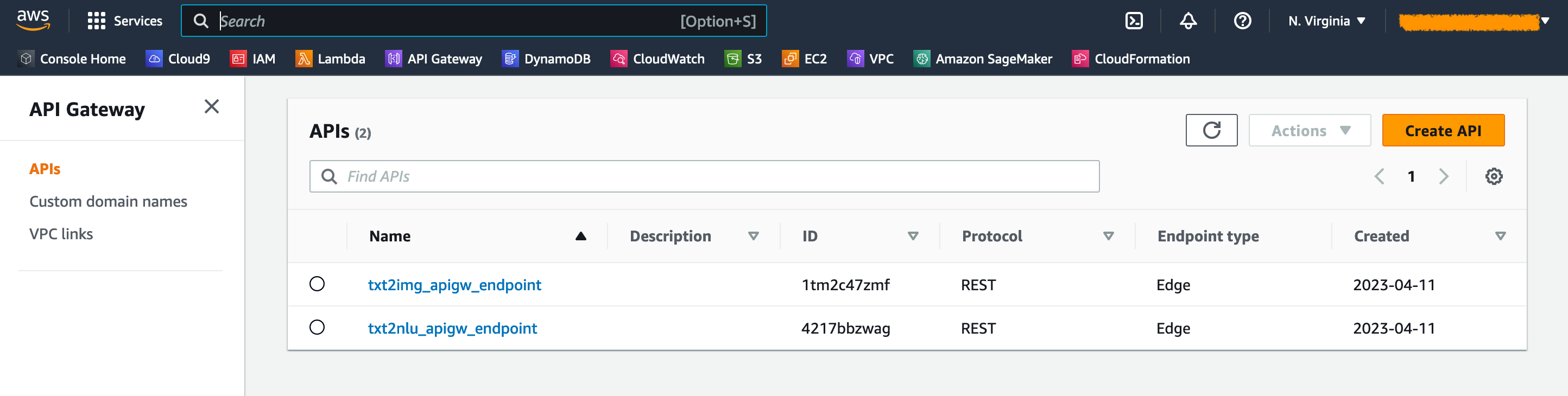

På API Gateway-konsollen kan du se API Gateway-endepunkterne på API'er .

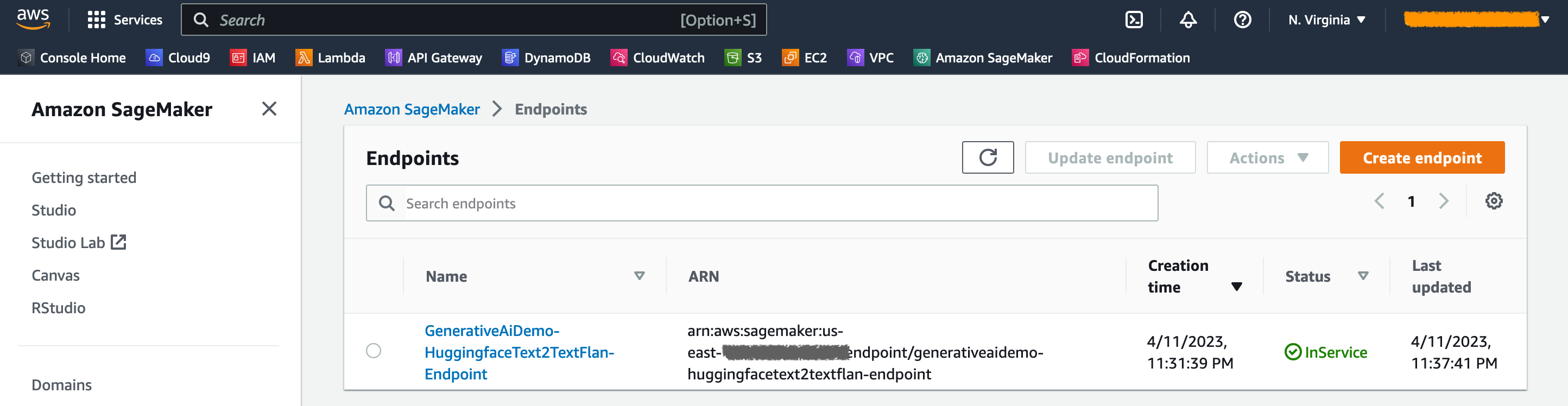

På SageMaker-konsollen kan du se de implementerede modelslutpunkter på Endpoints .

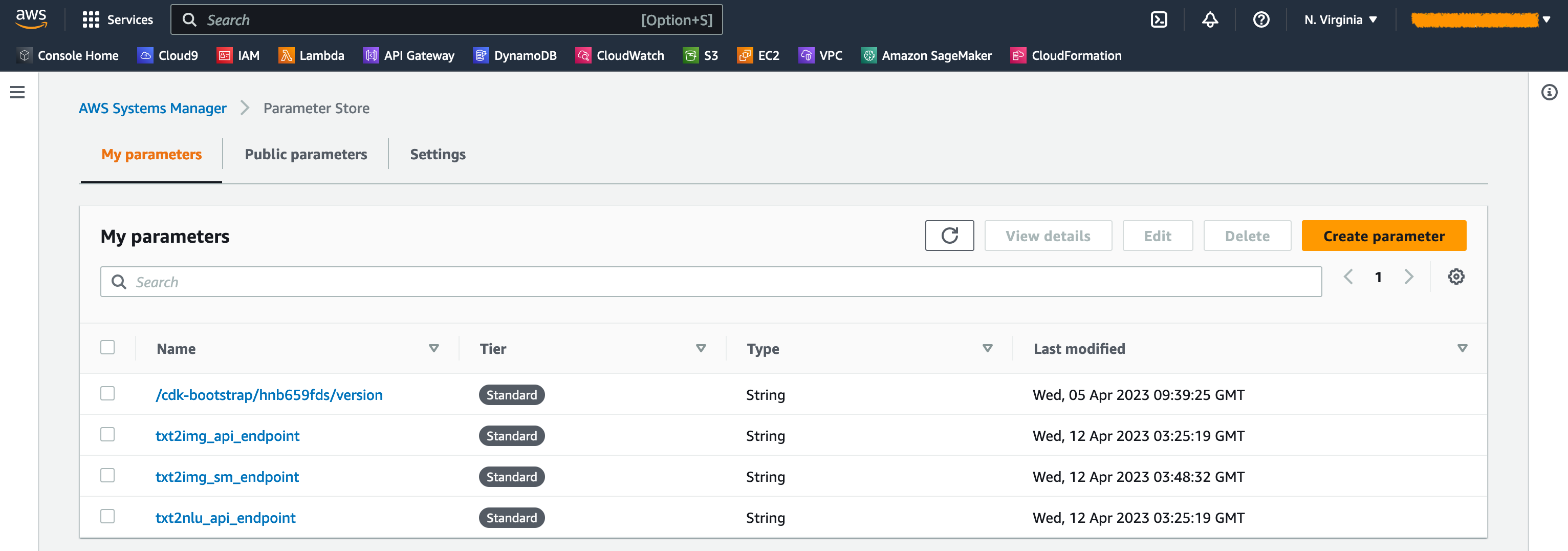

Når stakkene startes, genereres nogle parametre. Disse opbevares i AWS Systems Manager Parameter Store. Vælg for at se dem Parameterlager i navigationsruden på AWS System Manager konsol.

Ryd op

For at undgå unødvendige omkostninger skal du rydde op i al den infrastruktur, der er oprettet med følgende kommando på din arbejdsstation:

Indtast y ved prompten. Dette trin tager omkring 10 minutter. Tjek, om alle ressourcer er slettet på konsollen. Slet også aktiverne S3 buckets oprettet af AWS CDK på Amazon S3 konsollen samt aktivlagrene på Amazon ECR.

Konklusion

Som vist i dette indlæg kan du bruge AWS CDK til at implementere generative AI-modeller i JumpStart. Vi viste et billedgenereringseksempel og et tekstgenereringseksempel ved hjælp af en brugergrænseflade drevet af Streamlit, Lambda og API Gateway.

Du kan nu bygge dine generative AI-projekter ved hjælp af forudtrænede AI-modeller i JumpStart. Du kan også udvide dette projekt for at finjustere fundamentmodellerne til din brugssituation og kontrollere adgangen til API Gateway-endepunkter.

Vi inviterer dig til at teste løsningen og bidrage til projektet på GitHub. Del dine tanker om denne tutorial i kommentarerne!

Licensoversigt

Denne prøvekode er gjort tilgængelig under en ændret MIT-licens. Se den LICENS fil for mere information. Gennemgå også de respektive licenser for stabil diffusion , flan-t5-xl modeller på Hugging Face.

Om forfatterne

Hantzley Taudoor er en APJ Partner Solutions Architecture Leader baseret i Singapore. Han har 20 års erfaring i IKT-branchen, der spænder over flere funktionsområder, herunder løsningsarkitektur, forretningsudvikling, salgsstrategi, rådgivning og ledelse. Han leder et team af Senior Solutions Architects, der gør det muligt for partnere at udvikle fælles løsninger, opbygge tekniske kapaciteter og styre dem gennem implementeringsfasen, efterhånden som kunder migrerer og moderniserer deres applikationer til AWS.

Hantzley Taudoor er en APJ Partner Solutions Architecture Leader baseret i Singapore. Han har 20 års erfaring i IKT-branchen, der spænder over flere funktionsområder, herunder løsningsarkitektur, forretningsudvikling, salgsstrategi, rådgivning og ledelse. Han leder et team af Senior Solutions Architects, der gør det muligt for partnere at udvikle fælles løsninger, opbygge tekniske kapaciteter og styre dem gennem implementeringsfasen, efterhånden som kunder migrerer og moderniserer deres applikationer til AWS.

Kwonyul Choi er CTO hos BABITALK, en koreansk opstart af skønhedsplejeplatform, baseret i Seoul. Før denne rolle arbejdede Kownyul som Software Development Engineer hos AWS med fokus på AWS CDK og Amazon SageMaker.

Kwonyul Choi er CTO hos BABITALK, en koreansk opstart af skønhedsplejeplatform, baseret i Seoul. Før denne rolle arbejdede Kownyul som Software Development Engineer hos AWS med fokus på AWS CDK og Amazon SageMaker.

Arunprasath Shankar er en Senior AI/ML Specialist Solutions Architect med AWS, der hjælper globale kunder med at skalere deres AI-løsninger effektivt og effektivt i skyen. I sin fritid nyder Arun at se sci-fi-film og lytte til klassisk musik.

Arunprasath Shankar er en Senior AI/ML Specialist Solutions Architect med AWS, der hjælper globale kunder med at skalere deres AI-løsninger effektivt og effektivt i skyen. I sin fritid nyder Arun at se sci-fi-film og lytte til klassisk musik.

Satish Upreti er en Migration Lead PSA og Security SME i partnerorganisationen i APJ. Satish har 20 års erfaring, der spænder over on-premises private cloud og public cloud-teknologier. Siden han kom til AWS i august 2020 som migrationsspecialist, yder han omfattende teknisk rådgivning og support til AWS-partnere til at planlægge og implementere komplekse migreringer.

Satish Upreti er en Migration Lead PSA og Security SME i partnerorganisationen i APJ. Satish har 20 års erfaring, der spænder over on-premises private cloud og public cloud-teknologier. Siden han kom til AWS i august 2020 som migrationsspecialist, yder han omfattende teknisk rådgivning og support til AWS-partnere til at planlægge og implementere komplekse migreringer.

Bilag: Kodegennemgang

I dette afsnit giver vi et overblik over koden i dette projekt.

AWS CDK-applikation

Den vigtigste AWS CDK-applikation er indeholdt i app.py fil i rodmappen. Projektet består af flere stakke, så vi skal importere stakkene:

Vi definerer vores generative AI-modeller og får de relaterede URI'er fra SageMaker:

Funktionen get_sagemaker_uris henter alle modeloplysningerne fra JumpStart. Se script/sagemaker_uri.py.

Derefter instansierer vi stakkene:

Den første stak, der lanceres, er VPC-stakken, GenerativeAiVpcNetworkStack. Webapplikationsstakken, GenerativeAiDemoWebStack, er afhængig af VPC-stakken. Afhængigheden udføres gennem parameterpassering vpc=network_stack.vpc.

Se app.py for den fulde kode.

VPC netværksstak

I GenerativeAiVpcNetworkStack-stakken opretter vi en VPC med et offentligt undernet og et privat undernet, der spænder over to tilgængelighedszoner:

Se /stack/generative_ai_vpc_network_stack.py for den fulde kode.

Demo webapplikationsstak

I GenerativeAiDemoWebStack-stakken lancerer vi Lambda-funktioner og respektive API Gateway-endepunkter, hvorigennem webapplikationen interagerer med SageMaker-modellens slutpunkter. Se følgende kodestykke:

Webapplikationen er containeriseret og hostet på Amazon ECS med Fargate. Se følgende kodestykke:

Se /stack/generative_ai_demo_web_stack.py for den fulde kode.

Billedgenerering SageMaker model slutpunktstak

GenerativeAiTxt2imgSagemakerStack-stakken opretter billedgenereringsmodellens slutpunkt fra JumpStart og gemmer slutpunktets navn i Systems Manager Parameter Store. Denne parameter vil blive brugt af webapplikationen. Se følgende kode:

Se /stack/generative_ai_txt2img_sagemaker_stack.py for den fulde kode.

NLU og tekstgenerering SageMaker model slutpunktstak

GenerativeAiTxt2nluSagemakerStack-stakken opretter NLU- og tekstgenereringsmodellens slutpunkt fra JumpStart og gemmer slutpunktets navn i Systems Manager Parameter Store. Denne parameter vil også blive brugt af webapplikationen. Se følgende kode:

Se /stack/generative_ai_txt2nlu_sagemaker_stack.py for den fulde kode.

Webapplikation

Webapplikationen er placeret i /web-app vejviser. Det er en Streamlit-applikation, der er containeriseret i henhold til Dockerfile:

For at lære mere om Streamlit, se Strømbelyst dokumentation.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoAiStream. Web3 Data Intelligence. Viden forstærket. Adgang her.

- Udmøntning af fremtiden med Adryenn Ashley. Adgang her.

- Køb og sælg aktier i PRE-IPO-virksomheder med PREIPO®. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/deploy-generative-ai-models-from-amazon-sagemaker-jumpstart-using-the-aws-cdk/

- :har

- :er

- $OP

- 1

- 10

- 100

- 20

- 20 år

- 2020

- 2023

- 7

- 8

- 9

- a

- Om

- adgang

- af udleverede

- tilgængelig

- derfor

- Konto

- opnå

- tværs

- tilpasse

- adressering

- Vedtagelsen

- Vedtagelse

- fremgang

- rådgivning

- Agent

- AI

- AI-drevne

- AI / ML

- algoritmer

- Alle

- tillade

- allerede

- også

- Amazon

- Amazon API Gateway

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- analysere

- ,

- enhver

- api

- app

- Anvendelse

- applikationer

- apps

- april

- arkitektur

- ER

- områder

- omkring

- AS

- Aktiver

- At

- opmærksomhed

- AUGUST

- tilgængelighed

- til rådighed

- undgå

- AWS

- AWS Cloud9

- AWS CloudFormation

- AWS Lambda

- tilbage

- swing

- baseret

- BAT

- BE

- smuk

- Skønhed

- før

- være

- Tro

- mellem

- Bootstrap

- bred

- browser

- bygge

- bygget

- virksomhed

- forretningsudvikling

- virksomheder

- men

- by

- ringe

- CAN

- kapaciteter

- Kapacitet

- fanget

- hvilken

- tilfælde

- tilfælde

- CD

- Centers

- lave om

- karakteristika

- afgifter

- kontrollere

- Vælg

- kunde

- kunder

- Cloud

- Cloud9

- kode

- kommer

- Fælles

- almindeligt

- fuldføre

- komplekse

- Compute

- computer

- Konfiguration

- Konsol

- konstruere

- rådgivning

- forbruges

- indeholdt

- Container

- indeholder

- indhold

- sammenhæng

- bidrage

- kontrol

- Samtale

- samtaler

- korrigere

- Koste

- skabe

- oprettet

- skaber

- skabelse

- CTO

- Nuværende

- skik

- kunde

- Kundeoplevelse

- Kundeservice

- Kunder

- tilpasse

- banebrydende

- data

- datalogi

- dag

- årtier

- Standard

- definerer

- demonstreret

- demonstrerer

- Afhængighed

- afhængig

- indsætte

- indsat

- implementering

- implementering

- udruller

- beskrivelse

- ødelægge

- udvikle

- udviklere

- Udvikling

- forskellige

- Broadcasting

- Skærm

- Afbryde

- Docker

- dokumentet

- færdig

- Dont

- ned

- hver

- nemt

- let

- effektivt

- effektivt

- muliggøre

- muliggør

- ende

- Endpoint

- ingeniør

- Indtast

- Miljø

- miljøer

- anslået

- Hver

- hver dag

- alles

- eksempel

- eksempler

- spændende

- erfaring

- udvide

- omfattende

- Ansigtet

- falsk

- bekendt

- familie

- Funktionalitet

- få

- felt

- Fields

- File (Felt)

- Finde

- Fornavn

- Fokus

- efter

- følger

- Til

- Tving

- Foundation

- fraktion

- Framework

- fra

- fuld

- funktion

- funktionel

- funktioner

- gateway

- samle

- indsamling

- generelle formål

- genereret

- generation

- generative

- Generativ AI

- få

- Git

- Global

- Globalt

- Dyrkning

- Have

- have

- he

- hjælpe

- hjælpe

- høj kvalitet

- hans

- Home

- host

- hostede

- HOURS

- Hvordan

- How To

- HTML

- http

- HTTPS

- IKT

- ideer

- if

- billede

- billeder

- fantasi

- gennemføre

- implementering

- importere

- in

- Herunder

- indarbejde

- industrier

- industrien

- Uendelig

- Bøjningspunkt

- oplysninger

- Infrastruktur

- installere

- installation

- installeret

- instans

- i stedet

- integrere

- integrationer

- interagerer

- grænseflade

- ind

- invitere

- spørgsmål

- IT

- sammenføjning

- fælles

- jpg

- json

- koreansk

- landing

- Sprog

- Sprog

- stor

- senere

- seneste

- lancere

- lanceret

- lancering

- føre

- leder

- Leadership" (virkelig menneskelig ledelse)

- Leads

- LÆR

- læring

- Forlade

- Bibliotek

- Licens

- licenser

- ligesom

- GRÆNSE

- Line (linje)

- Liste

- Lytte

- Lister

- LLM

- belastning

- lokale

- placeret

- maskine

- machine learning

- Maskiner

- lavet

- Main

- lave

- maerker

- administrere

- ledelse

- leder

- mange

- massive

- Menu

- måske

- migrere

- migration

- minutter

- MIT

- ML

- model

- modeller

- modernisere

- modificeret

- mere

- Film

- flere

- Musik

- skal

- navn

- Natural

- Natur

- Navigation

- Behov

- behov

- netværk

- Ny

- næste

- node

- nu

- nummer

- of

- Tilbud

- on

- ONE

- igangværende

- kun

- open source

- Open source software

- åbner

- or

- ordrer

- organisation

- original

- Andet

- vores

- output

- i løbet af

- oversigt

- egen

- pakke

- side

- brød

- paradigme

- parameter

- parametre

- partner

- partnere

- Passing

- Udfør

- fase

- telefon

- billede

- fly

- perron

- plato

- Platon Data Intelligence

- PlatoData

- Punkt

- Muligheden

- Indlæg

- potentiale

- strøm

- vigtigste

- forudsætninger

- Forud

- private

- Problem

- produktion

- Programmering

- programmeringssprog

- projekt

- projekter

- give

- giver

- offentlige

- Offentlig sky

- offentligt

- Python

- forespørgsler

- hurtigt

- rækkevidde

- hurtige

- hurtigt

- klar

- for nylig

- benævnt

- om

- region

- relaterede

- Repository

- påkrævet

- Krav

- ressource

- Ressourcer

- dem

- gennemgå

- Revolutionerende

- højre

- roller

- rod

- Kør

- kører

- sagemaker

- salg

- samme

- Scale

- sci-fi

- Videnskab

- ridse

- SDK

- Anden

- sekunder

- Sektion

- sikkerhed

- se

- frø

- SELV

- senior

- stemningen

- Seoul

- Serverless

- Servere

- tjeneste

- Tjenester

- sæt

- setup

- Del

- skifte

- bør

- Vis

- viste

- vist

- Shows

- Simpelt

- siden

- Singapore

- Størrelse

- lille

- EMS

- So

- Software

- softwareudvikling

- løsninger

- Løsninger

- nogle

- Kilde

- Space

- specialist

- specifikke

- specificeret

- stabil

- stable

- Stakke

- standard

- påbegyndt

- opstart

- Nystartede

- Trin

- Steps

- Stands

- opbevaring

- butik

- opbevaret

- forhandler

- Historier

- Strategi

- struktur

- subnet

- support

- Systemer

- tager

- Opgaver

- opgaver

- hold

- Teknisk

- teknikker

- Teknologier

- Teknologier

- fortæller

- skabeloner

- prøve

- tests

- at

- deres

- Them

- derefter

- Disse

- denne

- Gennem

- tid

- titan

- til

- toolkit

- værktøjer

- traditionelle

- traditionelle

- Tog

- uddannet

- Kurser

- Transform

- Tendenser

- sand

- virkelig

- TUR

- tutorial

- to

- typen

- typer

- typisk

- typisk

- under

- forståelse

- afsløret

- opdatering

- opgradering

- brug

- brug tilfælde

- anvendte

- Bruger

- Brugergrænseflade

- ved brug af

- udnytte

- forskellige

- Vast

- verificere

- udgave

- via

- Videoer

- Specifikation

- Virtual

- næsten

- Besøg

- ønsker

- var

- ser

- Vej..

- we

- web

- Webapplikation

- webservices

- GODT

- som

- mens

- bred

- Bred rækkevidde

- udbredt

- Wikipedia

- vilje

- vinduer

- med

- uden

- Arbejde

- arbejdede

- arbejdsgange

- arbejdsstation

- år

- Du

- Din

- zephyrnet

- zoner