Dette indlæg er skrevet af Ramdev Wudali og Kiran Mantripragada fra Thomson Reuters.

I 1992, blev Thomson Reuters (TR) udgav sin første AI juridiske forskningstjeneste, WIN (Westlaw Is Natural), en innovation på det tidspunkt, da de fleste søgemaskiner kun understøttede booleske termer og forbindelser. Siden da har TR opnået mange flere milepæle, da dets AI-produkter og -tjenester konstant vokser i antal og mangfoldighed og understøtter fagfolk inden for jura, skat, regnskab, overholdelse og nyhedsservice verden over med milliarder af maskinlæringsindsigt (ML) genereret hvert år .

Med denne enorme stigning i AI-tjenester var den næste milepæl for TR at strømline innovation og lette samarbejde. Standardiser opbygning og genbrug af AI-løsninger på tværs af forretningsfunktioner og AI-praktiserende personas, samtidig med at du sikrer overholdelse af virksomhedens bedste praksis:

- Automatiser og standardiser den gentagne udifferentierede ingeniørindsats

- Sikre den påkrævede isolering og kontrol af følsomme data i overensstemmelse med fælles styringsstandarder

- Giv nem adgang til skalerbare computerressourcer

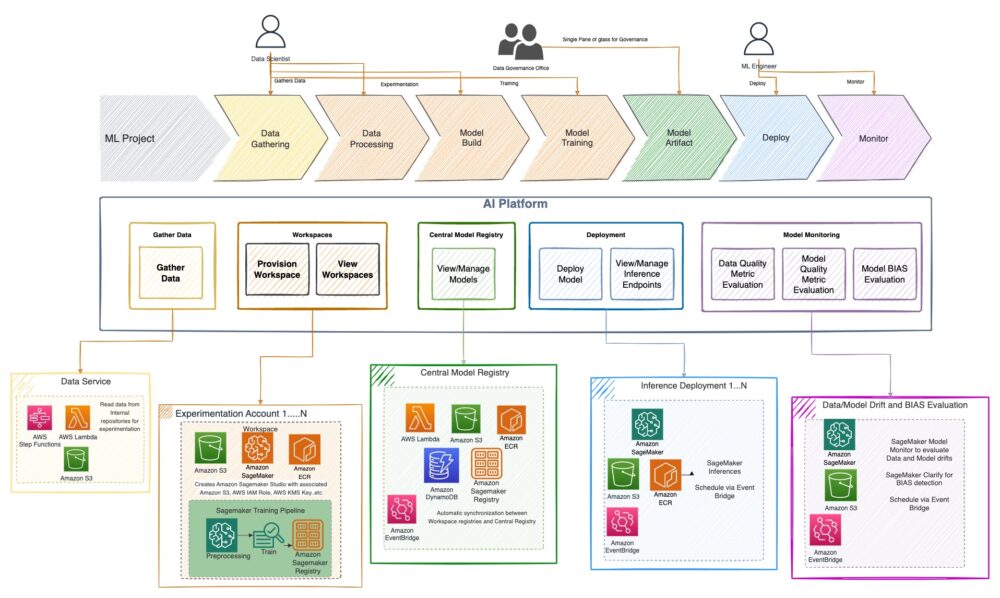

For at opfylde disse krav byggede TR Enterprise AI-platformen omkring følgende fem søjler: en datatjeneste, eksperimenteringsarbejdsområde, central modelregistrering, modelimplementeringstjeneste og modelovervågning.

I dette indlæg diskuterer vi, hvordan TR og AWS samarbejdede om at udvikle TRs første Enterprise AI-platform nogensinde, et webbaseret værktøj, der ville give muligheder lige fra ML-eksperimentering, træning, et centralt modelregister, modelimplementering og modelovervågning. Alle disse funktioner er bygget til at imødekomme TRs stadigt udviklende sikkerhedsstandarder og levere enkle, sikre og kompatible tjenester til slutbrugere. Vi deler også, hvordan TR muliggjorde overvågning og styring af ML-modeller skabt på tværs af forskellige forretningsenheder med en enkelt rude.

Udfordringerne

Historisk har ML været en mulighed for teams med avancerede datavidenskabsmænd og ingeniører. Teams med højt kvalificerede ressourcer var i stand til at implementere komplekse ML-processer efter deres behov, men blev hurtigt meget silo. Siled tilgange gav ikke nogen synlighed til at give styring i ekstremt kritiske beslutningstagning forudsigelser.

TR business teams har stor domæne viden; dog gør de tekniske færdigheder og tunge ingeniørmæssige indsats, der kræves i ML, det vanskeligt at bruge deres dybe ekspertise til at løse forretningsproblemer med kraften i ML. TR ønsker at demokratisere kompetencerne, så de bliver tilgængelige for flere i organisationen.

Forskellige teams i TR følger deres egen praksis og metoder. TR ønsker at opbygge de muligheder, der spænder over hele ML-livscyklussen til deres brugere for at accelerere leveringen af ML-projekter ved at gøre det muligt for teams at fokusere på forretningsmål og ikke på den gentagne udifferentierede ingeniørindsats.

Derudover fortsætter reglerne omkring data og etisk AI med at udvikle sig, hvilket kræver fælles styringsstandarder på tværs af TR's AI-løsninger.

Løsningsoversigt

TR's Enterprise AI-platform var forudset til at levere enkle og standardiserede tjenester til forskellige personer og tilbyde muligheder for alle trin i ML-livscyklussen. TR har identificeret fem hovedkategorier, der modulariserer alle TRs krav:

- Datatjeneste – For at muliggøre nem og sikker adgang til virksomhedens dataaktiver

- Eksperimenteringsarbejdsplads – At give kapacitet til at eksperimentere og træne ML-modeller

- Central modelregister – Et virksomhedskatalog for modeller bygget på tværs af forskellige forretningsenheder

- Modelinstallationstjeneste – At give forskellige muligheder for implementering af konklusioner efter TR's virksomheds CI/CD-praksis

- Modelovervågningstjenester – At give kapacitet til at overvåge data og modelbias og drifter

Som vist i det følgende diagram er disse mikrotjenester bygget med et par nøgleprincipper i tankerne:

- Fjern den udifferentierede tekniske indsats fra brugerne

- Giv de nødvendige funktioner med et klik på en knap

- Sikre og styr alle funktioner i henhold til TR's virksomhedsstandarder

- Medbring en enkelt rude til ML-aktiviteter

TRs AI Platform-mikrotjenester er bygget med Amazon SageMaker som kernemotoren, AWS-serverløse komponenter til arbejdsgange og AWS DevOps-tjenester til CI/CD-praksis. SageMaker Studio bruges til eksperimenter og træning, og SageMaker modelregistret bruges til at registrere modeller. Det centrale modelregister består af både SageMaker-modelregistret og en Amazon DynamoDB tabel. SageMaker hostingtjenester bruges til at implementere modeller, mens SageMaker Model Monitor , SageMaker afklare bruges til at overvåge modeller for drift, bias, brugerdefinerede metriske lommeregnere og forklarlighed.

De følgende afsnit beskriver disse tjenester i detaljer.

Datatjeneste

En traditionel ML-projektlivscyklus starter med at finde data. Generelt bruger dataforskere 60 % eller mere af deres tid på at finde de rigtige data, når de har brug for det. Ligesom enhver organisation har TR flere datalagre, der fungerer som et enkelt sandhedspunkt for forskellige datadomæner. TR identificerede to nøglevirksomhedsdatalagre, der leverer data til de fleste af deres ML-brugssager: et objektlager og et relationelt datalager. TR byggede en AI Platform-datatjeneste til problemfrit at give adgang til begge datalagre fra brugernes eksperimenterende arbejdsområder og fjerne byrden fra brugerne til at navigere i komplekse processer for at erhverve data på egen hånd. TR's AI-platform følger alle overholdelser og bedste praksis, der er defineret af data- og modelstyringsteamet. Dette inkluderer en obligatorisk Data Impact Assessment, der hjælper ML-praktiserende læger med at forstå og følge den etiske og passende brug af data, med formelle godkendelsesprocesser for at sikre passende adgang til dataene. Kernen i denne service, såvel som alle platformstjenester, er sikkerheden og overholdelse i henhold til den bedste praksis fastlagt af TR og industrien.

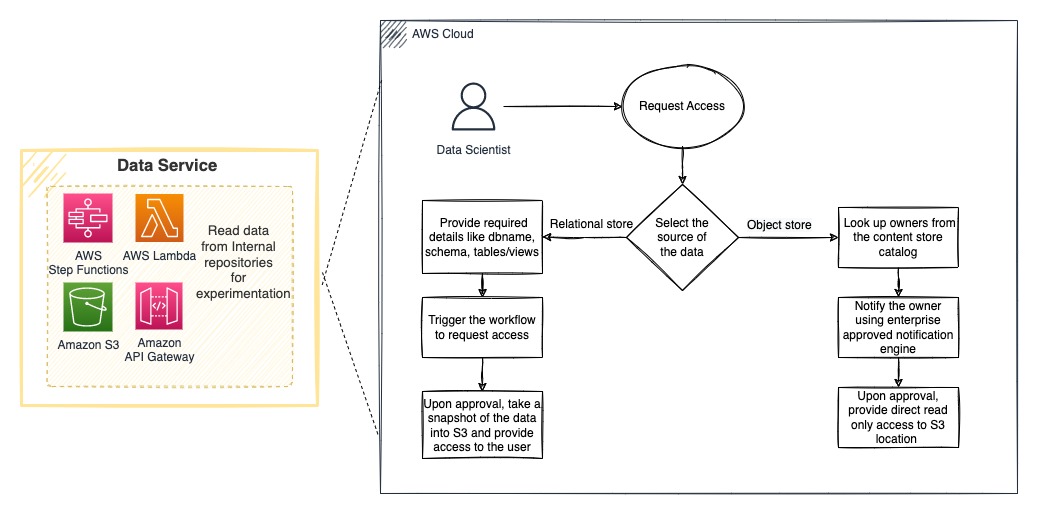

Amazon Simple Storage Service (Amazon S3) objektlagring fungerer som en indholdsdatasø. TR byggede processer til sikker adgang til data fra indholdsdatasøen til brugernes eksperimenterende arbejdsområder, samtidig med at den nødvendige autorisation og auditabilitet bevares. Snowflake bruges som virksomhedens relationelle primære datalager. På brugeranmodning og baseret på godkendelse fra dataejeren giver AI Platform-datatjenesten et øjebliksbillede af dataene til brugeren, der er let tilgængelige i deres eksperimenterende arbejdsområde.

Adgang til data fra forskellige kilder er et teknisk problem, der let kan løses. Men kompleksiteten TR har løst er at opbygge godkendelsesarbejdsgange, der automatiserer identifikation af dataejeren, afsendelse af en adgangsanmodning, sørger for, at dataejeren får besked om, at de har en afventende adgangsanmodning, og baseret på godkendelsesstatus foretage handling for at levere data til rekvirenten. Alle hændelser i hele denne proces spores og logges med henblik på revision og overholdelse.

Som vist i følgende diagram bruger TR AWS-trinfunktioner at orkestrere arbejdsgangen og AWS Lambda at køre funktionaliteten. Amazon API Gateway bruges til at eksponere funktionaliteten med et API-endepunkt, der skal forbruges fra deres webportal.

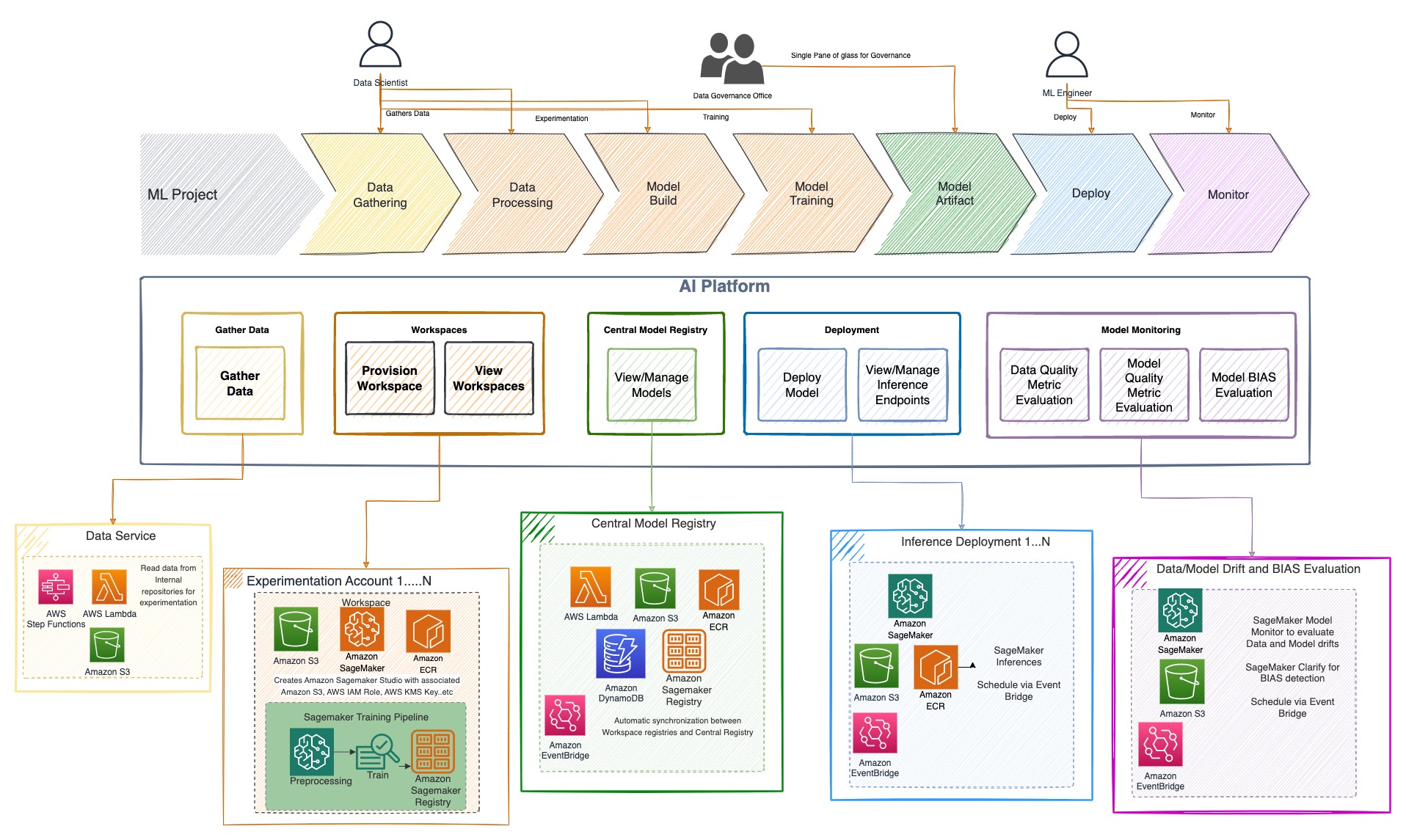

Modeleksperimentering og udvikling

En væsentlig evne til at standardisere ML-livscyklussen er et miljø, der giver dataforskere mulighed for at eksperimentere med forskellige ML-rammer og datastørrelser. Aktivering af et sådant sikkert, kompatibelt miljø i skyen inden for få minutter fritager dataforskere fra byrden med at håndtere cloud-infrastruktur, netværkskrav og sikkerhedsstandardforanstaltninger for i stedet at fokusere på datavidenskabsproblemet.

TR bygger et eksperimenterende arbejdsrum, der giver adgang til tjenester som f.eks AWS Lim, Amazon EMR, og SageMaker Studio for at muliggøre databehandling og ML-funktioner, der overholder virksomhedens cloud-sikkerhedsstandarder og påkrævet kontoisolering for hver forretningsenhed. TR er stødt på følgende udfordringer under implementeringen af løsningen:

- Orkestrering var tidligt ikke fuldt automatiseret og involverede flere manuelle trin. Det var ikke let at spore, hvor der opstod problemer. TR overvandt denne fejl ved at orkestrere arbejdsgangene ved hjælp af Step Functions. Med brugen af Step Functions blev det meget nemmere at bygge komplekse arbejdsgange, administrere tilstande og fejlhåndtering.

- Passende AWS identitets- og adgangsstyring (IAM) rolledefinition for eksperimenteringsarbejdsområdet var svær at definere. For at overholde TRs interne sikkerhedsstandarder og mindste privilegerede model blev arbejdsområdet oprindeligt defineret med inline politikker. Som følge heraf voksede den inline-politik med tiden og blev omfattende og overskred den tilladte politikstørrelsesgrænse for IAM-rollen. For at afbøde dette skiftede TR til at bruge flere kundeadministrerede politikker og henvise til dem i arbejdsområdets rolledefinition.

- TR nåede lejlighedsvis standardressourcegrænserne, der blev anvendt på AWS-kontoniveau. Dette forårsagede lejlighedsvise fejl i lanceringen af SageMaker-job (for eksempel træningsjob) på grund af den ønskede ressourcetypegrænse nået. TR arbejdede tæt sammen med SageMaker-serviceteamet om dette spørgsmål. Dette problem blev løst, efter at AWS-teamet lancerede SageMaker som en understøttet tjeneste i Servicekvoter i juni 2022.

I dag kan dataforskere hos TR lancere et ML-projekt ved at skabe et uafhængigt arbejdsområde og tilføje nødvendige teammedlemmer til at samarbejde. Ubegrænset skala, der tilbydes af SageMaker, er lige ved hånden ved at give dem brugerdefinerede kernebilleder med forskellige størrelser. SageMaker Studio blev hurtigt en afgørende komponent i TRs AI-platform og har ændret brugeradfærd fra at bruge begrænsede desktop-applikationer til skalerbare og flygtige specialbyggede motorer. Følgende diagram illustrerer denne arkitektur.

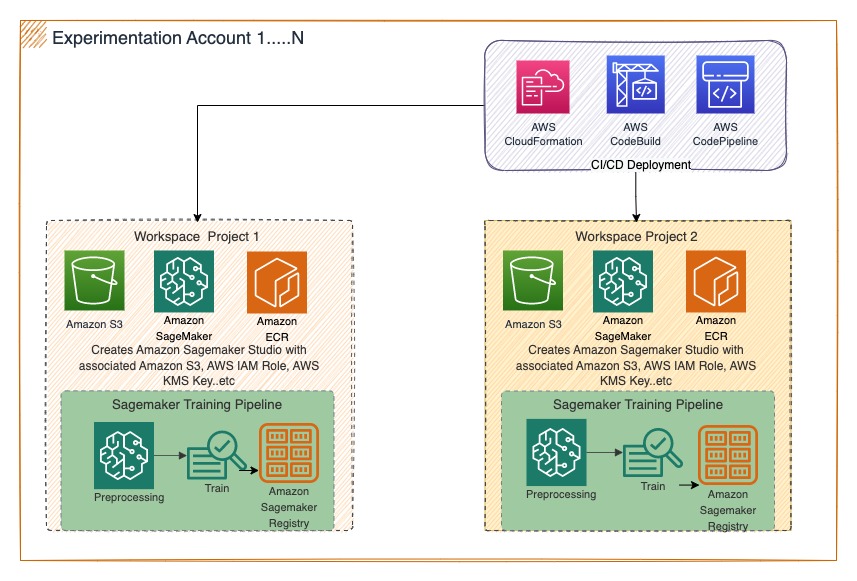

Central modelregister

Modelregistret giver et centralt lager for alle TRs maskinlæringsmodeller, muliggør risiko- og sundhedsstyring af dem på en standardiseret måde på tværs af forretningsfunktioner og strømliner potentielle modellers genbrug. Derfor skulle tjenesten gøre følgende:

- Giver mulighed for at registrere både nye og ældre modeller, uanset om de er udviklet inden for eller uden for SageMaker

- Implementer styringsarbejdsgange, så dataforskere, udviklere og interessenter kan se og i fællesskab administrere modellernes livscyklus

- Øg gennemsigtighed og samarbejde ved at skabe et centraliseret overblik over alle modeller på tværs af TR sammen med metadata og sundhedsmålinger

TR startede designet med kun SageMaker-modelregistret, men et af TRs nøglekrav er at give mulighed for at registrere modeller, der er oprettet uden for SageMaker. TR evaluerede forskellige relationelle databaser, men endte med at vælge DynamoDB, fordi metadataskemaet for modeller, der kommer fra ældre kilder, vil være meget anderledes. TR ønskede heller ikke at pålægge brugerne yderligere arbejde, så de implementerede en problemfri automatisk synkronisering mellem AI Platform-arbejdsområdet SageMaker-registreringer til det centrale SageMaker-registrering vha. Amazon Eventbridge regler og påkrævede IAM-roller. TR forbedrede det centrale register med DynamoDB for at udvide mulighederne for at registrere ældre modeller, der blev oprettet på brugernes skriveborde.

TR's AI Platform centrale modelregister er integreret i AI Platform-portalen og giver en visuel grænseflade til at søge modeller, opdatere modelmetadata og forstå modelbaseline-metrics og periodiske tilpassede overvågningsmetrikker. Følgende diagram illustrerer denne arkitektur.

Modelimplementering

TR identificerede to hovedmønstre til at automatisere implementering:

- Modeller udviklet ved hjælp af SageMaker gennem SageMaker batch-transformationsjob for at få slutninger på en foretrukken tidsplan

- Modeller udviklet uden for SageMaker på lokale desktops ved hjælp af open source-biblioteker, gennem bring your own container-tilgangen ved hjælp af SageMaker-behandlingsjob til at køre tilpasset inferenskode, som en effektiv måde at migrere disse modeller uden at omfaktorere koden

Med AI Platform-implementeringstjenesten kan TR-brugere (dataforskere og ML-ingeniører) identificere en model fra kataloget og implementere et inferensjob på deres valgte AWS-konto ved at levere de nødvendige parametre gennem en UI-drevet arbejdsgang.

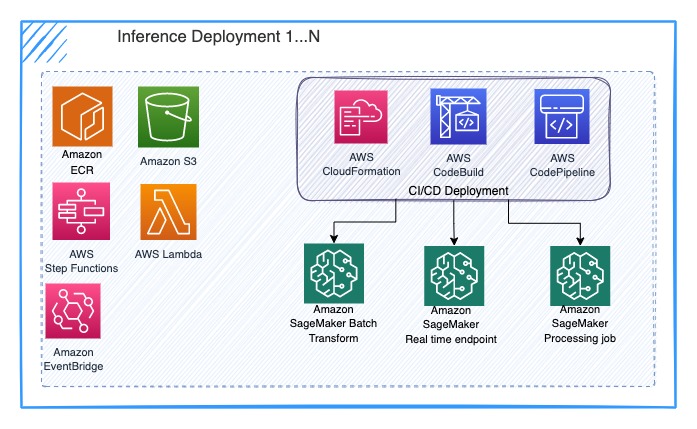

TR automatiserede denne implementering ved hjælp af AWS DevOps-tjenester som AWS CodePipeline , AWS CodeBuild. TR bruger Step Functions til at orkestrere arbejdsgangen for læsning og forbehandling af data til at skabe SageMaker-inferensjob. TR implementerer de nødvendige komponenter som kode ved hjælp af AWS CloudFormation skabeloner. Følgende diagram illustrerer denne arkitektur.

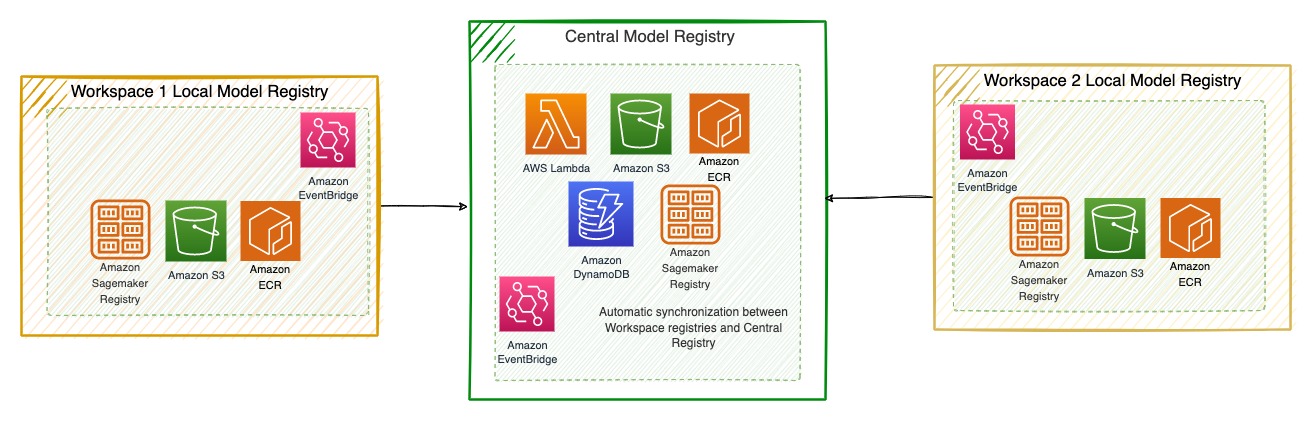

Modelovervågning

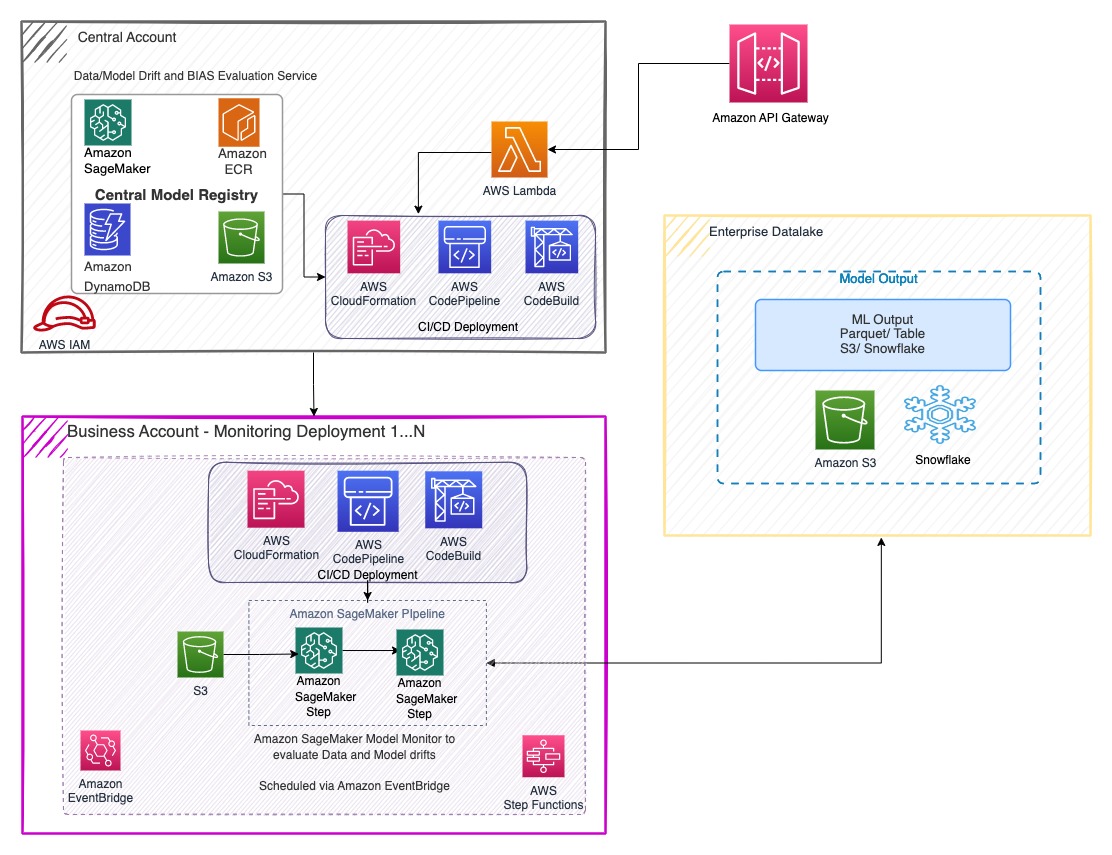

ML-livscyklussen er ikke komplet uden at være i stand til at overvåge modeller. TR's virksomhedsledelsesteam giver også mandat til og opfordrer forretningsteams til at overvåge deres modelpræstationer over tid for at løse eventuelle regulatoriske udfordringer. TR startede med at overvåge modeller og data for afdrift. TR brugte SageMaker Model Monitor til at give en databaseline og slutningsgrundsandhed til med jævne mellemrum at overvåge, hvordan TRs data og konklusioner driver. Sammen med SageMaker modelovervågningsmetrikker forbedrede TR overvågningskapaciteten ved at udvikle brugerdefinerede metrikker, der er specifikke for deres modeller. Dette vil hjælpe TR's dataforskere med at forstå, hvornår de skal omskole deres model.

Sammen med driftovervågning ønsker TR også at forstå bias i modellerne. De out-of-the-box-funktioner i SageMaker Clarify bruges til at bygge TR's bias-service. TR overvåger både data- og modelbias og gør disse metrics tilgængelige for deres brugere gennem AI Platform-portalen.

For at hjælpe alle teams med at vedtage disse virksomhedsstandarder har TR gjort disse tjenester uafhængige og let tilgængelige via AI Platform-portalen. TR's forretningsteams kan gå ind i portalen og implementere et modelovervågningsjob eller biasovervågningsjob på egen hånd og køre dem efter deres foretrukne tidsplan. De får besked om status for jobbet og metrics for hver kørsel.

TR brugte AWS-tjenester til CI/CD-implementering, workflow-orkestrering, serverløse rammer og API-endepunkter til at bygge mikrotjenester, der kan udløses uafhængigt, som vist i følgende arkitektur.

Resultater og fremtidige forbedringer

TR's AI-platform gik live i 3. kvartal 2022 med alle fem hovedkomponenter: en datatjeneste, eksperimenteringsarbejdsområde, central modelregistrering, modelimplementering og modelovervågning. TR gennemførte interne træningssessioner for sine forretningsenheder ombord på platformen og tilbød dem selv-guidede træningsvideoer.

AI-platformen har givet kapaciteter til TRs teams, som aldrig har eksisteret før; det har åbnet en bred vifte af muligheder for TR's enterprise governance-team til at forbedre overholdelsesstandarder og centralisere registreringsdatabasen, hvilket giver en enkelt glasrude visning på tværs af alle ML-modeller i TR.

TR anerkender, at intet produkt er bedst ved den første udgivelse. Alle TRs komponenter er på forskellige modenhedsniveauer, og TRs Enterprise AI Platform-team er i en kontinuerlig forbedringsfase for iterativt at forbedre produktfunktionerne. TRs nuværende avancement pipeline inkluderer tilføjelse af yderligere SageMaker-inferensmuligheder som real-time, asynkrone og multi-model slutpunkter. TR planlægger også at tilføje modelforklarlighed som en funktion til sin modelovervågningstjeneste. TR planlægger at bruge SageMaker Clarifys forklaringsmuligheder til at udvikle sin interne forklaringstjeneste.

Konklusion

TR kan nu behandle enorme mængder data sikkert og bruge avancerede AWS-funktioner til at tage et ML-projekt fra idé til produktion i løbet af uger, sammenlignet med månederne det tog før. Med AWS-tjenesternes out-of-the-box-funktioner kan teams inden for TR registrere og overvåge ML-modeller for første gang nogensinde og opnå overensstemmelse med deres udviklende modelstyringsstandarder. TR gav datavidenskabsfolk og produktteams mulighed for effektivt at frigøre deres kreativitet til at løse de mest komplekse problemer.

For at vide mere om TRs Enterprise AI-platform på AWS, tjek AWS re:Invent 2022 session. Hvis du gerne vil lære, hvordan TR accelererede brugen af maskinlæring ved hjælp af AWS Data Lab program, se casestudie.

Om forfatterne

Ramdev Wudali er en dataarkitekt, der hjælper med at arkitekte og bygge AI/ML-platformen for at sætte dataforskere og forskere i stand til at udvikle maskinlæringsløsninger ved at fokusere på datavidenskaben og ikke på infrastrukturbehovene. I sin fritid elsker han at folde papir for at skabe origami-tesselationer og at bære respektløse T-shirts.

Ramdev Wudali er en dataarkitekt, der hjælper med at arkitekte og bygge AI/ML-platformen for at sætte dataforskere og forskere i stand til at udvikle maskinlæringsløsninger ved at fokusere på datavidenskaben og ikke på infrastrukturbehovene. I sin fritid elsker han at folde papir for at skabe origami-tesselationer og at bære respektløse T-shirts.

Kiran Mantripragada er Senior Director for AI Platform hos Thomson Reuters. AI Platform-teamet er ansvarligt for at aktivere AI-softwareapplikationer i produktionskvalitet og muliggøre arbejdet for dataforskere og maskinlæringsforskere. Med en passion for videnskab, kunstig intelligens og teknik kan Kiran lide at bygge bro mellem forskning og produktisering for at bringe den virkelige innovation af kunstig intelligens til de endelige forbrugere.

Kiran Mantripragada er Senior Director for AI Platform hos Thomson Reuters. AI Platform-teamet er ansvarligt for at aktivere AI-softwareapplikationer i produktionskvalitet og muliggøre arbejdet for dataforskere og maskinlæringsforskere. Med en passion for videnskab, kunstig intelligens og teknik kan Kiran lide at bygge bro mellem forskning og produktisering for at bringe den virkelige innovation af kunstig intelligens til de endelige forbrugere.

Bhavana Chirumamilla er Sr. Resident Architect hos AWS. Hun brænder for data og ML-drift og bringer masser af entusiasme til at hjælpe virksomheder med at opbygge data- og ML-strategier. I sin fritid nyder hun tid sammen med sin familie på at rejse, vandre, lave havearbejde og se dokumentarfilm.

Bhavana Chirumamilla er Sr. Resident Architect hos AWS. Hun brænder for data og ML-drift og bringer masser af entusiasme til at hjælpe virksomheder med at opbygge data- og ML-strategier. I sin fritid nyder hun tid sammen med sin familie på at rejse, vandre, lave havearbejde og se dokumentarfilm.

Srinivasa Shaik er Solutions Architect hos AWS med base i Boston. Han hjælper virksomhedskunder med at fremskynde deres rejse til skyen. Han brænder for containere og maskinlæringsteknologier. I sin fritid nyder han at bruge tid sammen med sin familie, lave mad og rejse.

Srinivasa Shaik er Solutions Architect hos AWS med base i Boston. Han hjælper virksomhedskunder med at fremskynde deres rejse til skyen. Han brænder for containere og maskinlæringsteknologier. I sin fritid nyder han at bruge tid sammen med sin familie, lave mad og rejse.

Qingwei Li er Machine Learning Specialist hos Amazon Web Services. Han modtog sin ph.d. i operationsforskning, efter at han brød sin rådgivers forskningsbevillingskonto og undlod at levere den nobelpris, han lovede. I øjeblikket hjælper han kunder i finans- og forsikringsbranchen med at bygge maskinlæringsløsninger på AWS. I sin fritid holder han af at læse og undervise.

Qingwei Li er Machine Learning Specialist hos Amazon Web Services. Han modtog sin ph.d. i operationsforskning, efter at han brød sin rådgivers forskningsbevillingskonto og undlod at levere den nobelpris, han lovede. I øjeblikket hjælper han kunder i finans- og forsikringsbranchen med at bygge maskinlæringsløsninger på AWS. I sin fritid holder han af at læse og undervise.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- Platoblokkæde. Web3 Metaverse Intelligence. Viden forstærket. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/how-thomson-reuters-built-an-ai-platform-using-amazon-sagemaker-to-accelerate-delivery-of-ml-projects/

- 100

- 2022

- 7

- a

- I stand

- Om

- fremskynde

- accelereret

- adgang

- tilgængelig

- Ifølge

- Konto

- Bogføring og administration

- opnået

- opnå

- erhverve

- tværs

- Handling

- handlinger

- Yderligere

- adresse

- vedtage

- fremskreden

- Efter

- AI

- AI platform

- AI-tjenester

- AI / ML

- Alle

- tillader

- langs med

- Amazon

- Amazon SageMaker

- Amazon Web Services

- beløb

- ,

- api

- applikationer

- anvendt

- tilgang

- tilgange

- godkendelse

- arkitektur

- omkring

- tilladelse

- automatisere

- Automatiseret

- Automatisk Ur

- til rådighed

- AWS

- baseret

- Baseline

- fordi

- før

- være

- BEDSTE

- bedste praksis

- mellem

- skævhed

- milliarder

- boston

- BRIDGE

- bringe

- Bringer

- Broke

- bygge

- Bygning

- bygger

- bygget

- byrde

- virksomhed

- forretningsfunktioner

- kapaciteter

- tilfælde

- katalog

- kategorier

- forårsagede

- central

- centraliseret

- udfordringer

- kontrollere

- vælge

- valgt

- nøje

- Cloud

- sky infrastruktur

- Cloud Security

- kode

- samarbejde

- samarbejdet

- samarbejde

- kollektivt

- kommer

- Fælles

- sammenlignet

- fuldføre

- komplekse

- kompleksitet

- Compliance

- kompatibel

- komponent

- komponenter

- Indeholder

- computing

- forbruges

- Forbrugere

- Container

- Beholdere

- indhold

- fortsæt

- kontinuerlig

- kontrol

- Core

- skabe

- oprettet

- Oprettelse af

- kreativitet

- kritisk

- afgørende

- Nuværende

- For øjeblikket

- skik

- Kunder

- data

- Data Lake

- databehandling

- datalogi

- databaser

- Beslutningstagning

- dyb

- dyb ekspertise

- Standard

- levere

- levering

- demokratisere

- indsætte

- implementering

- udruller

- beskrive

- Design

- desktop

- detail

- bestemmes

- udvikle

- udviklet

- udviklere

- udvikling

- Udvikling

- forskellige

- svært

- Direktør

- diskutere

- dokumentarfilm

- domæne

- Domæner

- ned

- Tidligt

- lettere

- nemt

- effektivt

- effektiv

- indsats

- bemyndiget

- muliggøre

- aktiveret

- muliggør

- muliggør

- tilskynder

- Endpoint

- Engine (Motor)

- Engineering

- Ingeniører

- Motorer

- forbedret

- sikre

- sikring

- Enterprise

- virksomheder

- entusiasme

- Miljø

- fejl

- væsentlig

- etisk

- evalueret

- begivenheder

- NOGENSINDE

- udvikle sig

- udviklende

- eksempel

- eksperiment

- ekspertise

- udvide

- ekstremt

- lette

- mislykkedes

- familie

- Feature

- Funktionalitet

- få

- endelige

- finansielle

- finansiel service

- Finde

- finde

- Fornavn

- første gang

- Fokus

- fokusering

- følger

- efter

- følger

- formel

- rammer

- fra

- Opfylde

- fuldt ud

- funktionalitet

- funktioner

- fremtiden

- kløft

- Generelt

- genereret

- få

- glas

- Go

- Mål

- regeringsførelse

- indrømme

- Ground

- Dyrkning

- Håndtering

- Hård Ost

- Helse

- hjælpe

- hjælpe

- hjælper

- stærkt

- Hosting

- Hvordan

- Men

- HTML

- HTTPS

- identificeret

- identificere

- identificere

- Identity

- billeder

- KIMOs Succeshistorier

- gennemføre

- implementeret

- gennemføre

- pålægge

- Forbedre

- in

- omfatter

- Forøg

- uafhængig

- uafhængigt

- industrien

- Infrastruktur

- initial

- Innovation

- indsigt

- i stedet

- forsikring

- integreret

- grænseflade

- interne

- involverede

- isolation

- spørgsmål

- IT

- Job

- Karriere

- rejse

- Nøgle

- Kend

- viden

- sø

- lancere

- lanceret

- lancering

- LÆR

- læring

- Legacy

- Politikker

- Niveau

- niveauer

- biblioteker

- GRÆNSE

- grænser

- leve

- lokale

- maskine

- machine learning

- lavet

- større

- maerker

- Making

- administrere

- ledelse

- styring

- mandater

- måde

- manuel

- mange

- modenhed

- foranstaltninger

- Medlemmer

- Metadata

- metoder

- metrisk

- Metrics

- microservices

- migrere

- milepæl

- Milepæle

- tankerne

- minutter

- afbøde

- ML

- model

- modeller

- Overvåg

- overvågning

- skærme

- måned

- mere

- mest

- flere

- Natural

- Naviger

- Behov

- behov

- netværk

- Ny

- nyheder

- næste

- Nobel pris

- nummer

- objekt

- lejlighedsvis

- tilbydes

- tilbyde

- Tilbud

- Ombord

- ONE

- open source

- åbnet

- Produktion

- Indstillinger

- orkestrering

- organisation

- oprindeligt

- uden for

- egen

- ejer

- brød

- Papir

- parametre

- lidenskab

- lidenskabelige

- mønstre

- Mennesker

- ydeevne

- periodisk

- fase

- pipeline

- planlægning

- planer

- perron

- plato

- Platon Data Intelligence

- PlatoData

- Punkt

- politikker

- politik

- Portal

- muligheder

- Indlæg

- potentiale

- magt

- praksis

- Forudsigelser

- foretrækkes

- primære

- principper

- præmie

- Problem

- problemer

- behandle

- Processer

- forarbejdning

- Produkt

- produktion

- Produkter

- professionelle partnere

- Program

- projekt

- projekter

- lovede

- give

- forudsat

- giver

- leverer

- Q3

- q3 2022

- hurtigt

- rækkevidde

- spænder

- RE

- nået

- Læsning

- ægte

- realtid

- modtaget

- register

- register

- regler

- lovgivningsmæssige

- frigive

- frigivet

- Fjern

- Repository

- anmode

- påkrævet

- Krav

- forskning

- forskere

- ressource

- Ressourcer

- ansvarlige

- Reuters

- Risiko

- roller

- roller

- regler

- Kør

- sagemaker

- SageMaker Inference

- skalerbar

- Scale

- planlægge

- Videnskab

- forskere

- sømløs

- problemfrit

- Søg

- Søgemaskiner

- sektioner

- sikker

- Sikret

- sikkert

- sikkerhed

- afsendelse

- senior

- følsom

- tjener

- Serverless

- tjeneste

- Tjenester

- sessioner

- flere

- Del

- vist

- Simpelt

- siden

- enkelt

- Størrelse

- størrelser

- faglært

- færdigheder

- Snapshot

- So

- Software

- løsninger

- Løsninger

- SOLVE

- Kilder

- specialist

- specifikke

- tilbringe

- udgifterne

- Stage

- interessenter

- standardisering

- standarder

- påbegyndt

- starter

- Stater

- Status

- Trin

- Steps

- opbevaring

- butik

- forhandler

- strategier

- strømline

- Studio

- sådan

- Understøttet

- Støtte

- skiftede

- synkronisering

- bord

- Tag

- skat

- Undervisning

- hold

- hold

- Teknisk

- tekniske færdigheder

- Teknologier

- skabeloner

- vilkår

- deres

- derfor

- Thomson Reuters

- Gennem

- hele

- tid

- til

- værktøj

- Sporing

- traditionelle

- Tog

- Kurser

- Transform

- Gennemsigtighed

- Traveling

- enorm

- udløst

- forstå

- enhed

- enheder

- frigøre

- ubegrænset

- Opdatering

- brug

- Bruger

- brugere

- række

- forskellige

- Vast

- via

- Videoer

- Specifikation

- synlighed

- ser

- web

- webservices

- web-baseret

- uger

- hvorvidt

- mens

- bred

- Bred rækkevidde

- vilje

- vinde

- inden for

- uden

- Arbejde

- arbejdede

- arbejdsgange

- verdensplan

- ville

- år

- Din

- zephyrnet