I dag er vi glade for at kunne meddele, at du nu kan udføre batchtransformationer med Amazon SageMaker JumpStart store sprogmodeller (LLM'er) til Text2Text Generation. Batch-transformationer er nyttige i situationer, hvor svarene ikke behøver at være i realtid, og derfor kan du foretage slutninger i batch for store datasæt i bulk. For batchtransformation køres et batchjob, der tager batch-input som et datasæt og en forudtrænet model og udsender forudsigelser for hvert datapunkt i datasættet. Batch-transformation er omkostningseffektiv, fordi i modsætning til hostede endepunkter i realtid, der har vedvarende hardware, rives batch-transformationsklynger ned, når jobbet er færdigt, og derfor bruges hardwaren kun i batchjobbets varighed.

I nogle brugstilfælde kan anmodninger om konklusioner i realtid grupperes i små batches til batchbehandling for at skabe svar i realtid eller næsten i realtid. Hvis du f.eks. skal behandle en kontinuerlig strøm af data med lav latenstid og høj gennemløb, vil det kræve flere ressourcer at påkalde et realtidsslutpunkt for hver anmodning separat, og det kan tage længere tid at behandle alle anmodningerne, fordi behandlingen sker serielt . En bedre tilgang ville være at gruppere nogle af anmodningerne og kalde realtidsslutpunktet i batch-inferenstilstand, som behandler dine anmodninger i én fremadgående gennemgang af modellen og returnerer bulksvaret for anmodningen i realtid eller næsten realtid . Latenstiden for svaret vil afhænge af, hvor mange anmodninger du grupperer sammen og instanshukommelsesstørrelsen, derfor kan du justere batchstørrelsen i henhold til dine forretningskrav for latenstid og gennemløb. Det kalder vi batch-inferens i realtid fordi det kombinerer konceptet batching, mens det stadig giver realtidssvar. Med batch-inferens i realtid kan du opnå en balance mellem lav latenstid og høj gennemløb, så du kan behandle store mængder data på en rettidig og effektiv måde.

Jumpstart batch-transformation til Text2Text Generation-modeller giver dig mulighed for at sende batch-hyperparametrene gennem miljøvariabler, der yderligere øger gennemløbet og minimerer latens.

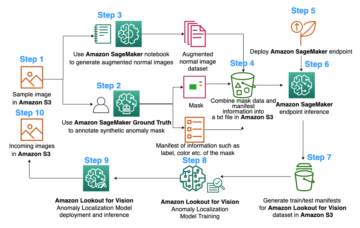

JumpStart leverer forudtrænede open source-modeller til en lang række problemtyper for at hjælpe dig i gang med maskinlæring (ML). Du kan trinvist træne og tune disse modeller før implementering. JumpStart leverer også løsningsskabeloner, der opsætter infrastruktur til almindelige brugstilfælde og eksekverbare eksempelnotebooks til ML med Amazon SageMaker. Du kan få adgang til de fortrænede modeller, løsningsskabeloner og eksempler via JumpStart-landingssiden i Amazon SageMaker Studio. Du kan også få adgang til JumpStart-modeller ved hjælp af SageMaker Python SDK.

I dette indlæg demonstrerer vi, hvordan du bruger det avancerede præ-trænede text2text FLAN T5 modeller fra Hugging Face til batchtransformation og batchslutning i realtid.

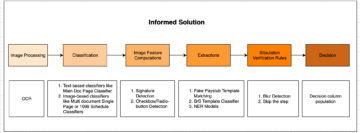

Løsningsoversigt

Notesbogen, der viser batch-transformation af fortrænede Text2Text FLAN T5-modeller fra Knusende ansigt tilgængelig i det følgende GitHub repository. Denne notesbog bruger data fra Hugging Face cnn_dailymail datasæt til en tekstresuméopgave ved hjælp af SageMaker SDK.

Følgende er de vigtigste trin til implementering af batchtransformation og batchinferens i realtid:

- Opsæt forudsætninger.

- Vælg en præ-trænet model.

- Hent artefakter til modellen.

- Angiv batchtransformationsjob-hyperparametre.

- Forbered data til batchtransformationen.

- Kør batchtransformationsjobbet.

- Vurder opsummeringen ved hjælp af en RED (Recall-Oriented Understudy for Gisting Evaluation) score.

- Udfør batch-inferens i realtid.

Opsæt forudsætninger

Før du kører den bærbare computer, skal du udføre nogle indledende opsætningstrin. Lad os konfigurere SageMaker-udførelsesrollen, så den har tilladelser til at køre AWS-tjenester på dine vegne:

Vælg en præ-trænet model

Vi bruger huggingface-text2text-flan-t5-large-modellen som standardmodel. Du kan eventuelt hente listen over tilgængelige Text2Text-modeller på JumpStart og vælge din foretrukne model. Denne metode giver en nem måde at vælge forskellige model-id'er ved hjælp af samme notebook. Til demonstrationsformål bruger vi huggingface-text2text-flan-t5-large-modellen:

Hent artefakter til modellen

Med SageMaker kan vi udføre inferens på den præ-trænede model, selv uden at finjustere den først på et nyt datasæt. Vi starter med at hente deploy_image_uri, deploy_source_uriog model_uri for den fortrænede model:

Angiv batchtransformationsjob-hyperparametre

Du kan overføre et hvilket som helst undersæt af hyperparametre som miljøvariable til batchtransformationsjobbet. Du kan også sende disse hyperparametre i en JSON-nyttelast. Men hvis du indstiller miljøvariabler for hyperparametre, som den følgende kode viser, så vil de avancerede hyperparametre fra de individuelle eksempler i JSON-linjernes nyttelast ikke blive brugt. Hvis du vil bruge hyperparametre fra nyttelasten, kan du indstille hyper_params_dict parameter som null i stedet for.

Forbered data til batchtransformation

Nu er vi klar til at indlæse cnn_dailymail datasæt fra Hugging Face:

Vi gennemgår hver dataindtastning og opretter inputdataene i det ønskede format. Vi skaber en articles.jsonl fil som en testdatafil, der indeholder artikler, der skal opsummeres som input nyttelast. Når vi opretter denne fil, tilføjer vi prompten "Briefly summarize this text:" til hver testinputrække. Hvis du vil have forskellige hyperparametre for hvert testinput, kan du tilføje disse hyperparametre som en del af oprettelsen af datasættet.

Vi opretter highlights.jsonl som ground truth-filen, der indeholder højdepunkter fra hver artikel, der er gemt i testfilen articles.jsonl. Vi gemmer begge testfiler i en Amazon Simple Storage Service (Amazon S3) spand. Se følgende kode:

Kør batchtransformationsjobbet

Når du starter et batchtransformationsjob, starter SageMaker de nødvendige beregningsressourcer til at behandle dataene, inklusive CPU- eller GPU-forekomster afhængigt af den valgte forekomsttype. Under batchtransformationsjobbet klargør og administrerer SageMaker automatisk de computerressourcer, der kræves til at behandle dataene, herunder forekomster, lager- og netværksressourcer. Når batchtransformationsjobbet er fuldført, ryddes beregningsressourcerne automatisk op af SageMaker. Det betyder, at de forekomster og opbevaring, der bruges under jobbet, stoppes og fjernes, hvilket frigør ressourcer og minimerer omkostningerne. Se følgende kode:

Det følgende er et eksempel på rekord fra articles.jsonl testfil. Bemærk, at posten i denne fil har et ID, der matcher predict.jsonl filposter, der viser en opsummeret post som output fra Hugging Face Text2Text-modellen. På samme måde har ground truth-filen også et matchende ID for dataposten. Det matchende ID på tværs af testfilen, ground truth-filen og outputfilen gør det muligt at forbinde inputposter med outputposter for nem fortolkning af resultaterne.

Følgende er eksemplet på inputposten, der er angivet til opsummering:

Følgende er det forudsagte output med opsummering:

Følgende er grundsandhedens opsummering til modelevalueringsformål:

Dernæst bruger vi grundsandheden og forudsagte output til modelevaluering.

Evaluer modellen ved hjælp af en ROUGE score¶

RED, eller Recall-Oriented Understudy for Gisting Evaluation, er et sæt metrikker og en softwarepakke, der bruges til at evaluere automatisk opsummering og maskinoversættelse i naturlig sprogbehandling. Metrikken sammenligner et automatisk fremstillet resumé eller oversættelse med et reference (menneskeproduceret) resume eller oversættelse eller et sæt referencer.

I den følgende kode kombinerer vi de forudsagte og originale resuméer ved at forbinde dem på den fælles nøgle id og brug dette til at beregne ROUGE-score:

Udfør batch-inferens i realtid

Dernæst viser vi dig, hvordan du kører batch-inferens i realtid på slutpunktet ved at angive inputs som en liste. Vi bruger det samme model-id og datasæt som tidligere, bortset fra at vi tager nogle få poster fra testdatasættet og bruger dem til at fremkalde et slutpunkt i realtid.

Følgende kode viser, hvordan du opretter og implementerer et realtidsslutpunkt til batchslutning i realtid:

Dernæst forbereder vi vores input nyttelast. Til dette bruger vi de data, som vi forberedte tidligere, og udtrækker de første 10 testinput og tilføjer tekstinput med hyperparametre, som vi ønsker at bruge. Vi leverer denne nyttelast i realtid invoke_endpoint. Svarnyttelasten returneres derefter som en liste over svar. Se følgende kode:

Ryd op

Når du har testet slutpunktet, skal du sørge for at slette SageMaker-slutningspunktet og slette modellen for at undgå at pådrage dig gebyrer.

Konklusion

I denne notesbog udførte vi en batchtransformation for at fremvise Hugging Face Text2Text Generator-modellen til opsummeringsopgaver. Batchtransformation er fordelagtig til at opnå slutninger fra store datasæt uden at kræve et vedvarende slutpunkt. Vi koblede inputposter med slutninger for at hjælpe med resultatfortolkning. Vi brugte ROUGE-score til at sammenligne opsummeringen af testdata med den modelgenererede opsummering.

Derudover demonstrerede vi batchinferens i realtid, hvor du kan sende en lille batch af data til et realtidsslutpunkt for at opnå en balance mellem latenstid og gennemløb for scenarier som streaming af inputdata. Batch-inferens i realtid hjælper med at øge gennemløbet for realtidsanmodninger.

Prøv batch-transformationen med Text2Text Generation-modeller i SageMaker i dag, og fortæl os din feedback!

Om forfatterne

Hemant Singh er en maskinlæringsingeniør med erfaring i Amazon SageMaker JumpStart og Amazon SageMaker indbyggede algoritmer. Han fik sin master fra Courant Institute of Mathematical Sciences og B.Tech fra IIT Delhi. Han har erfaring med at arbejde med en bred vifte af maskinlæringsproblemer inden for området naturlig sprogbehandling, computersyn og tidsserieanalyse.

Hemant Singh er en maskinlæringsingeniør med erfaring i Amazon SageMaker JumpStart og Amazon SageMaker indbyggede algoritmer. Han fik sin master fra Courant Institute of Mathematical Sciences og B.Tech fra IIT Delhi. Han har erfaring med at arbejde med en bred vifte af maskinlæringsproblemer inden for området naturlig sprogbehandling, computersyn og tidsserieanalyse.

Rachna Chadha er Principal Solutions Architect AI/ML i Strategic Accounts hos AWS. Rachna er en optimist, der tror på, at den etiske og ansvarlige brug af kunstig intelligens kan forbedre samfundet i fremtiden og bringe økonomisk og social velstand. I sin fritid kan Rachna godt lide at bruge tid med sin familie, vandreture og lytte til musik.

Rachna Chadha er Principal Solutions Architect AI/ML i Strategic Accounts hos AWS. Rachna er en optimist, der tror på, at den etiske og ansvarlige brug af kunstig intelligens kan forbedre samfundet i fremtiden og bringe økonomisk og social velstand. I sin fritid kan Rachna godt lide at bruge tid med sin familie, vandreture og lytte til musik.

Dr. Ashish Khetan er en Senior Applied Scientist med Amazon SageMaker indbyggede algoritmer og hjælper med at udvikle machine learning algoritmer. Han fik sin ph.d. fra University of Illinois Urbana-Champaign. Han er en aktiv forsker i maskinlæring og statistisk inferens og har publiceret mange artikler i NeurIPS, ICML, ICLR, JMLR, ACL og EMNLP konferencer.

Dr. Ashish Khetan er en Senior Applied Scientist med Amazon SageMaker indbyggede algoritmer og hjælper med at udvikle machine learning algoritmer. Han fik sin ph.d. fra University of Illinois Urbana-Champaign. Han er en aktiv forsker i maskinlæring og statistisk inferens og har publiceret mange artikler i NeurIPS, ICML, ICLR, JMLR, ACL og EMNLP konferencer.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoAiStream. Web3 Data Intelligence. Viden forstærket. Adgang her.

- Udmøntning af fremtiden med Adryenn Ashley. Adgang her.

- Køb og sælg aktier i PRE-IPO-virksomheder med PREIPO®. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/perform-batch-transforms-with-amazon-sagemaker-jumpstart-text2text-generation-large-language-models/

- :har

- :er

- :ikke

- :hvor

- $OP

- 000

- 1

- 10

- 100

- 11

- 13

- 14

- 20

- 2014

- 50

- 7

- 8

- 9

- a

- I stand

- Om

- over

- accept

- accepteret

- adgang

- Ifølge

- Konti

- opnå

- Overtager

- tværs

- aktioner

- aktiv

- fremskreden

- fordelagtige

- mod

- AI

- AI / ML

- Støtte

- algoritmer

- Alle

- påståede

- tillader

- også

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- analyse

- ,

- Annoncere

- enhver

- api

- anvendt

- tilgang

- ER

- omkring

- artikel

- artikler

- AS

- At

- Forsøg på

- myndighed

- Automatisk Ur

- automatisk

- til rådighed

- undgå

- AWS

- Balance

- bund

- baseret

- BE

- blev

- fordi

- bliver

- før

- være

- Tro

- mener

- Benjamin

- Bedre

- mellem

- krop

- både

- Begge sider

- grænser

- kortvarigt

- bringe

- Bringer

- indbygget

- virksomhed

- men

- by

- ringe

- CAN

- kan ikke

- tilfælde

- Årsag

- afgifter

- Vælg

- klasse

- kunde

- tættere

- CNN

- kode

- kombinerer

- kombinerer

- kombinerer

- Kom

- forpligtelser

- engageret

- Fælles

- sammenligne

- fuldføre

- Compute

- computer

- Computer Vision

- Konceptet

- Adfærd

- konferencer

- Container

- fortsæt

- kontinuerlig

- bidrog

- Koste

- omkostningseffektiv

- kunne

- råd

- kontraproduktivt

- lande

- Ret

- skabe

- Oprettelse af

- forbrydelser

- Criminal

- data

- indtastning af data

- datasæt

- døde

- beslutning

- Standard

- Delhi

- demonstrere

- demonstreret

- Afdeling

- Afhængigt

- indsætte

- implementering

- beskrevet

- Bestem

- udvikle

- Udvikling

- afvige

- forskelle

- forskellige

- direkte

- forskelligartede

- do

- Docker

- domæne

- færdig

- Dont

- Ved

- ned

- varighed

- i løbet af

- hver

- tidligere

- Øst

- let

- Økonomisk

- effektiv

- indsats

- berettiget

- muliggør

- ende

- Endpoint

- ingeniør

- sikre

- Går ind i

- indrejse

- Miljø

- Era

- etisk

- evaluere

- evaluere

- evaluering

- Endog

- bevismateriale

- eksempel

- eksempler

- Undtagen

- ophidset

- udførelse

- erfaring

- ekstrakt

- Ansigtet

- Faith

- familie

- få

- File (Felt)

- Filer

- Fornavn

- efter

- Til

- Tving

- udenlandsk

- formel

- Formelt

- format

- Videresend

- stiftende

- fra

- fuld

- yderligere

- fremtiden

- generation

- generator

- få

- giver

- Go

- Mål

- regeringer

- GPU

- større

- Ground

- gruppe

- Hardware

- Have

- he

- hjælpe

- hjælper

- hende

- link.

- Høj

- højdepunkter

- hans

- hostede

- Hvordan

- How To

- Men

- HTML

- http

- HTTPS

- KrammerFace

- menneskelig

- menneskerettigheder

- Menneskelighed

- ID

- id'er

- if

- Illinois

- billede

- straks

- gennemføre

- importere

- Forbedre

- in

- omfatter

- Herunder

- Forøg

- uafhængighed

- individuel

- Individuelt

- oplysninger

- Infrastruktur

- initial

- uretfærdighed

- indgang

- indgange

- undersøgelse

- instans

- i stedet

- Institut

- internationalt

- fortolkning

- ind

- undersøge

- undersøgelse

- Undersøgelser

- israel

- IT

- ITS

- januar

- Job

- deltage

- sammenføjning

- jpg

- json

- dommer

- juni

- jurisdiktion

- lige

- Retfærdighed

- Nøgle

- Kend

- landing

- Sprog

- stor

- Efternavn

- Latency

- senere

- lanceringer

- læring

- til venstre

- lad

- let

- ligesom

- synes godt om

- Line (linje)

- linjer

- forbundet

- Linking

- Liste

- Lytte

- belastning

- Lang

- længere

- Lav

- maskine

- machine learning

- lave

- Making

- administrerer

- måde

- mange

- markeret

- matchede

- matchende

- matematiske

- Kan..

- midler

- medlem

- Medlemmer

- medlemskab

- Hukommelse

- metode

- Metrics

- minimering

- ML

- tilstand

- model

- modeller

- Måned

- mere

- bevæge sig

- Musik

- skal

- navn

- Natural

- Natural Language Processing

- nødvendig

- Behov

- forhandlinger

- Ingen

- Holland

- netværk

- Ny

- nyheder

- pressemeddelelse

- notesbog

- nu

- objekt

- opnå

- of

- Office

- Officielt

- on

- ONE

- kun

- åbent

- open source

- åbnet

- modsætte sig

- modsætning

- or

- original

- OS

- vores

- ud

- output

- i løbet af

- pakke

- side

- Palæstina

- papirer

- parameter

- parametre

- del

- part

- passerer

- sti

- Bane

- fred

- Mennesker

- Udfør

- Tilladelser

- plato

- Platon Data Intelligence

- PlatoData

- Vær venlig

- Punkt

- mulig

- Indlæg

- forudsige

- forudsagde

- forudsigelse

- Forudsigelser

- Predictor

- foretrækkes

- Forbered

- forberedt

- forudsætninger

- præsident

- tryk

- Prime

- statsminister

- Main

- Problem

- problemer

- behandle

- Processer

- forarbejdning

- produceret

- velstand

- give

- forudsat

- giver

- leverer

- offentliggjort

- formål

- Python

- rækkevidde

- klar

- ægte

- realtid

- optage

- optegnelser

- referencer

- refererer

- frigive

- fjernet

- GENTAGNE GANGE

- indberette

- anmode

- anmodninger

- kræver

- påkrævet

- Krav

- forsker

- Ressourcer

- svar

- reaktioner

- ansvar

- ansvarlige

- resultere

- Resultater

- afkast

- afkast

- gennemgå

- rettigheder

- roller

- rome

- RÆKKE

- Kør

- s

- sagemaker

- SageMaker Inference

- Said

- samme

- siger

- scenarier

- VIDENSKABER

- Videnskabsmand

- score

- SDK

- se

- søger

- valgt

- send

- senior

- Series

- Tjenester

- sæt

- indstilling

- setup

- delt

- hun

- bør

- Vis

- udstillingsvindue

- Shows

- sider

- underskrevet

- Tilsvarende

- Simpelt

- siden

- Situationen

- situationer

- Størrelse

- lille

- So

- Social

- Samfund

- Software

- løsninger

- Løsninger

- nogle

- tale

- taler

- udgifterne

- starte

- påbegyndt

- Tilstand

- State Department

- state-of-the-art

- Statement

- Stater

- statistiske

- Trin

- Steps

- Stadig

- stoppet

- opbevaring

- butik

- opbevaret

- ligetil

- Strategisk

- strøm

- streaming

- kraftigt

- emne

- opsummere

- RESUMÉ

- sommer

- support

- Tag

- taget

- tager

- Opgaver

- opgaver

- tech

- skabeloner

- territorier

- territorium

- prøve

- end

- at

- oplysninger

- Holland

- Staten

- verdenen

- deres

- Them

- derefter

- derfor

- Disse

- de

- denne

- dem

- Gennem

- kapacitet

- tid

- Tidsserier

- til

- i dag

- sammen

- revet

- mod

- Tog

- Transform

- transformer

- transformationer

- Oversættelse

- sand

- Sandheden

- typen

- typer

- Underminere

- Forenet

- Forenede Stater

- Universal

- universitet

- I modsætning til

- Uploading

- på

- us

- brug

- anvendte

- ved brug af

- Vice President

- vision

- mængder

- W

- ønsker

- krig

- var

- Ur

- Vej..

- we

- web

- webservices

- Onsdag

- velkommen

- hilste

- GODT

- Hvad

- hvornår

- hvorvidt

- som

- mens

- WHO

- bred

- Bred rækkevidde

- vilje

- med

- inden for

- uden

- arbejder

- world

- ville

- Du

- Din

- zephyrnet