Generativ kunstig intelligens (generativ AI) modeller har demonstreret imponerende evner til at generere tekst, billeder og andet indhold af høj kvalitet. Disse modeller kræver dog enorme mængder af rene, strukturerede træningsdata for at nå deres fulde potentiale. De fleste data fra den virkelige verden findes i ustrukturerede formater som PDF'er, som kræver forbehandling, før de kan bruges effektivt.

Ifølge IDC, ustrukturerede data udgør over 80 % af alle forretningsdata i dag. Dette inkluderer formater som e-mails, PDF'er, scannede dokumenter, billeder, lyd, video og mere. Selvom disse data rummer værdifuld indsigt, gør dens ustrukturerede natur det svært for AI-algoritmer at fortolke og lære af dem. Ifølge en 2019-undersøgelse af Deloitte, rapporterede kun 18 % af virksomhederne, at de kunne drage fordel af ustrukturerede data.

Efterhånden som AI-adoptionen fortsætter med at accelerere, bliver udvikling af effektive mekanismer til at fordøje og lære af ustrukturerede data endnu mere kritisk i fremtiden. Dette kunne involvere bedre forbehandlingsværktøjer, semi-overvågede læringsteknikker og fremskridt inden for naturlig sprogbehandling. Virksomheder, der bruger deres ustrukturerede data mest effektivt, vil opnå betydelige konkurrencefordele fra AI. Rene data er vigtige for god modelydelse. Udpakkede tekster har stadig store mængder volapyk og kedeltekst (f.eks. læs HTML). Skrabede data fra internettet indeholder ofte mange duplikationer. Data fra sociale medier, anmeldelser eller ethvert brugergenereret indhold kan også indeholde giftigt og partisk indhold, og du skal muligvis filtrere dem fra ved hjælp af nogle forbehandlingstrin. Der kan også være en masse indhold af lav kvalitet eller bot-genererede tekster, som kan filtreres fra ved hjælp af medfølgende metadata (f.eks. filtrere kundeservicesvar fra, der fik lave kundevurderinger).

Dataforberedelse er vigtig på flere stadier i Retrieval Augmented Generation (KLUD) modeller. Videnkildedokumenterne har brug for forbehandling, som at rense tekst og generere semantiske indlejringer, så de effektivt kan indekseres og hentes. Brugerens naturlige sprogforespørgsel kræver også forbehandling, så den kan kodes ind i en vektor og sammenlignes med dokumentindlejringer. Efter at have hentet relevante kontekster, kan de have brug for yderligere forbehandling, såsom trunkering, før de sammenkædes med brugerens forespørgsel for at oprette den endelige prompt til fundamentmodellen. Amazon SageMaker lærred understøtter nu omfattende dataforberedelsesfunktioner drevet af Amazon SageMaker Data Wrangler. Med denne integration giver SageMaker Canvas kunderne et end-to-end no-code-arbejdsområde til at forberede data, bygge og bruge ML- og fundamentmodeller for at accelerere tiden fra data til forretningsindsigt. Du kan nu nemt opdage og aggregere data fra over 50 datakilder og udforske og forberede data ved hjælp af over 300 indbyggede analyser og transformationer i SageMaker Canvas' visuelle grænseflade.

Løsningsoversigt

I dette indlæg arbejder vi med et PDF-dokumentationsdatasæt—Amazonas grundfjeld brugervejledning. Yderligere viser vi, hvordan man forbehandler et datasæt til RAG. Konkret renser vi dataene og opretter RAG-artefakter for at besvare spørgsmålene om indholdet af datasættet. Overvej følgende maskinlæringsproblem (ML): brugeren stiller et spørgsmål om stor sprogmodel (LLM): "Hvordan filtrerer og søger man efter modeller i Amazon Bedrock?". LLM har ikke set dokumentationen under trænings- eller finjusteringsfasen, ville derfor ikke være i stand til at besvare spørgsmålet og vil sandsynligvis hallucinere. Vores mål med dette indlæg er at finde et relevant stykke tekst fra PDF'en (dvs. RAG) og vedhæfte det til prompten, hvilket gør det muligt for LLM at besvare spørgsmål, der er specifikke for dette dokument.

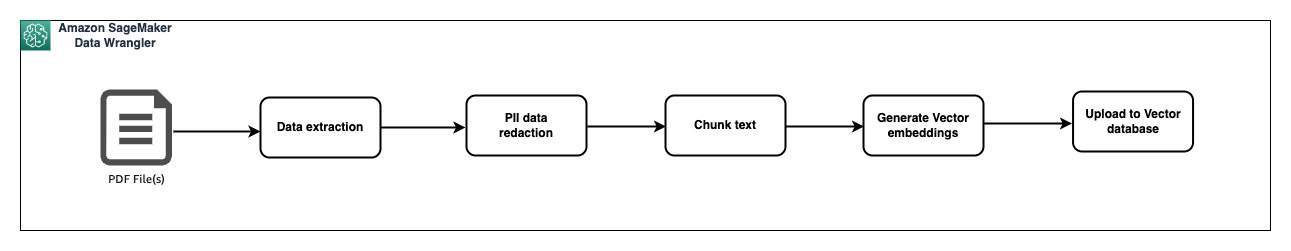

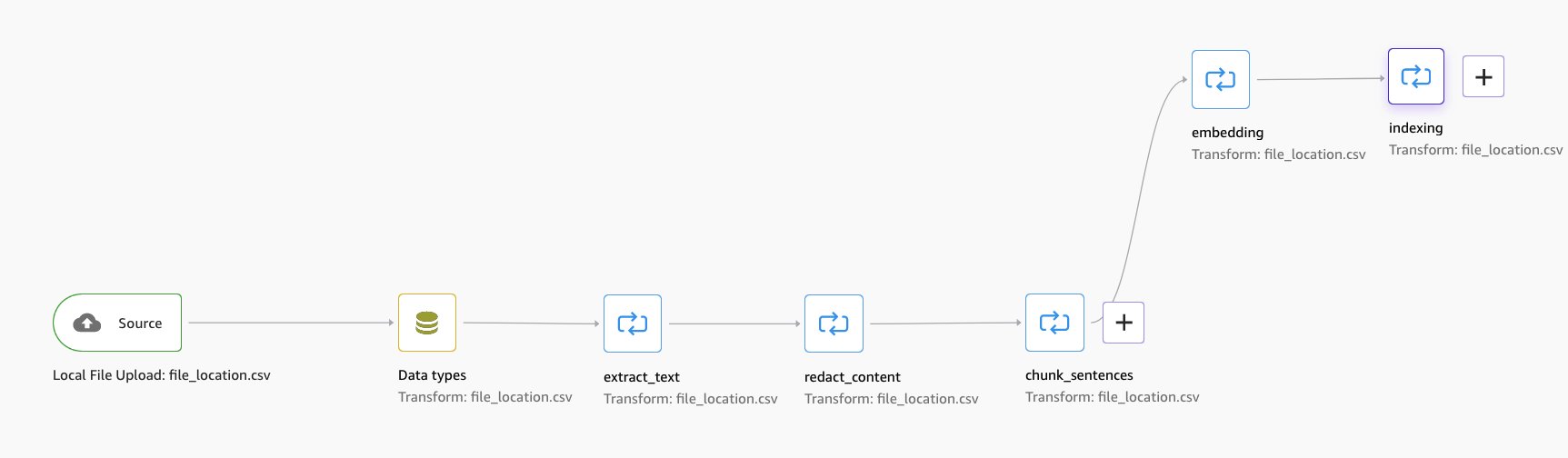

Nedenfor viser vi, hvordan du kan udføre alle disse vigtigste forbehandlingstrin fra Amazon SageMaker lærred (drevet af Amazon SageMaker Data Wrangler):

- Udpakning af tekst fra et PDF-dokument (drevet af Textract)

- Fjern følsomme oplysninger (drevet af Comprehend)

- Del tekst i stykker.

- Opret indlejringer for hvert stykke (drevet af Bedrock).

- Upload indlejring til en vektordatabase (drevet af OpenSearch)

Forudsætninger

Til denne gennemgang skal du have følgende:

Bemærk: Opret OpenSearch Service-domæner ved at følge instruktionerne link.. For nemheds skyld, lad os vælge muligheden med et hovedbrugernavn og adgangskode til finmasket adgangskontrol. Når domænet er oprettet, skal du oprette et vektorindeks med følgende tilknytninger, og vektordimension 1536 justeres med Amazon Titan-indlejringer:

Går igennem

Opbyg et dataflow

I dette afsnit dækker vi, hvordan vi kan opbygge et dataflow for at udtrække tekst og metadata fra PDF'er, rense og behandle dataene, generere indlejringer ved hjælp af Amazon Bedrock og indeksere dataene i Amazon OpenSearch.

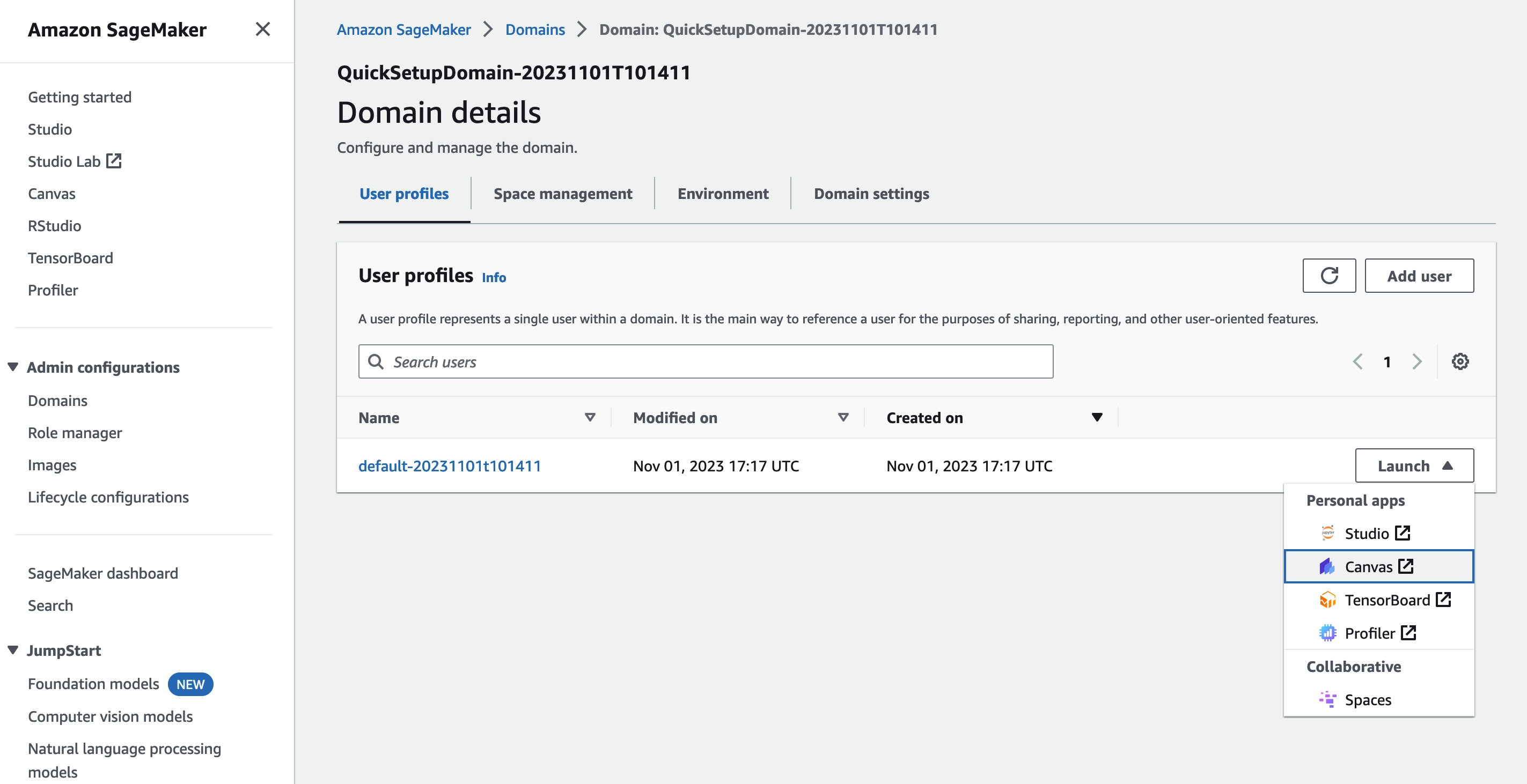

Start SageMaker Canvas

For at starte SageMaker Canvas skal du udføre følgende trin:

- På Amazonas SageMaker konsol, vælg domæner i navigationsruden.

- Vælg dit domæne.

- Vælg i startmenuen Lærred.

Opret et dataflow

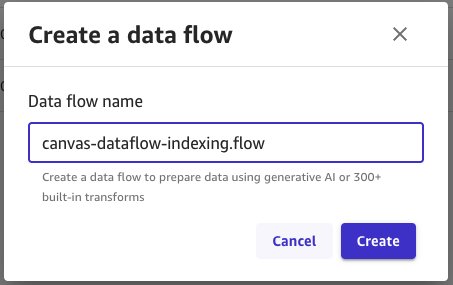

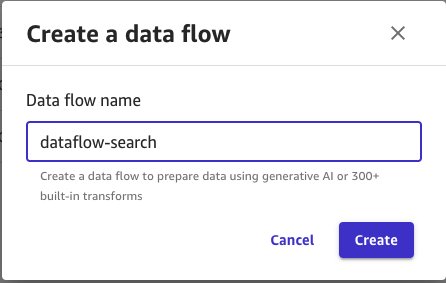

Udfør følgende trin for at oprette et dataflow i SageMaker Canvas:

- Vælg på SageMaker Canvas-hjemmesiden Data Wrangler.

- Vælg Opret i højre side af siden, giv derefter et dataflownavn og vælg Opret.

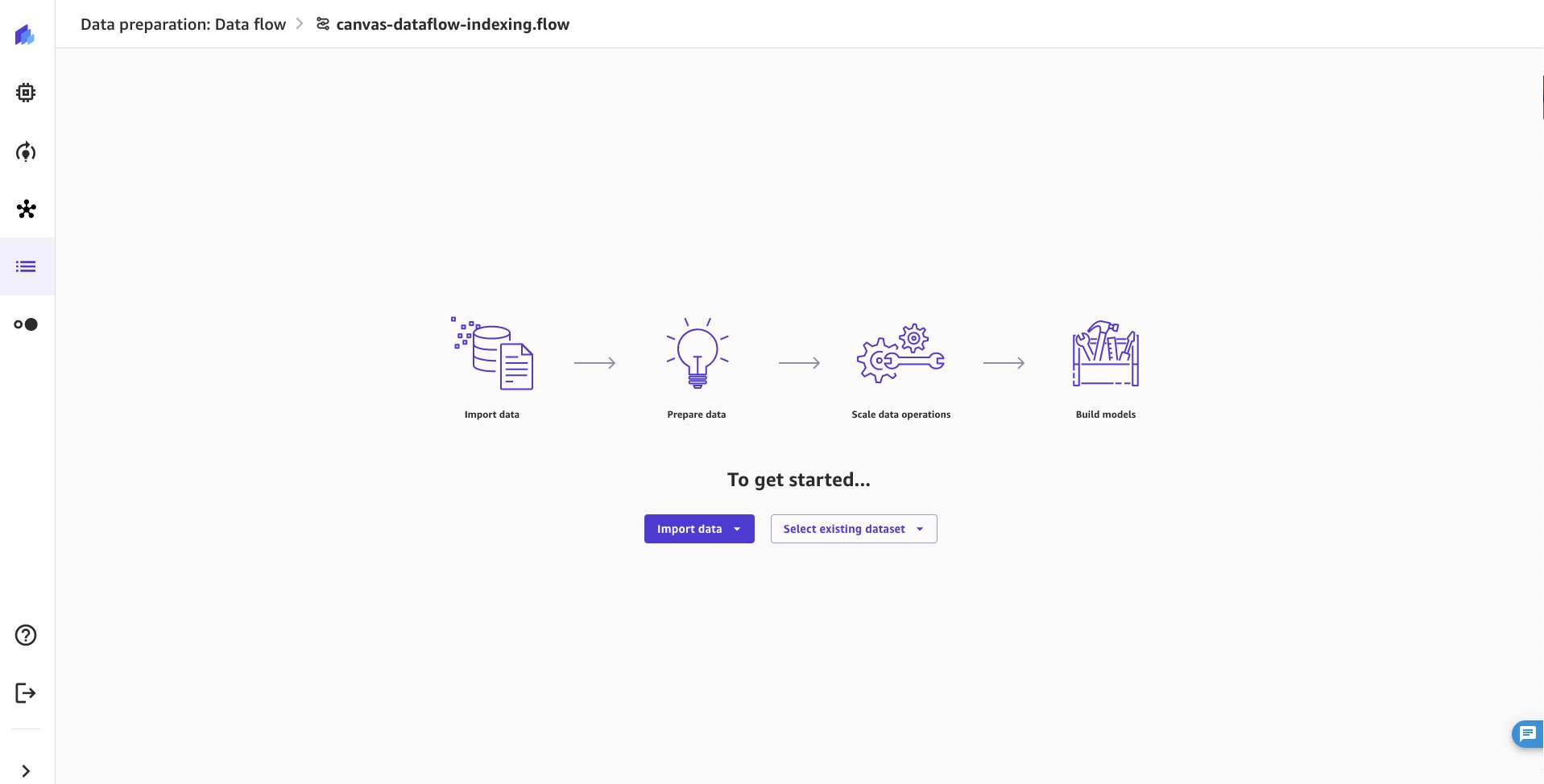

- Dette vil lande på en dataflow-side.

- Vælg Import datoer, vælg tabeldata.

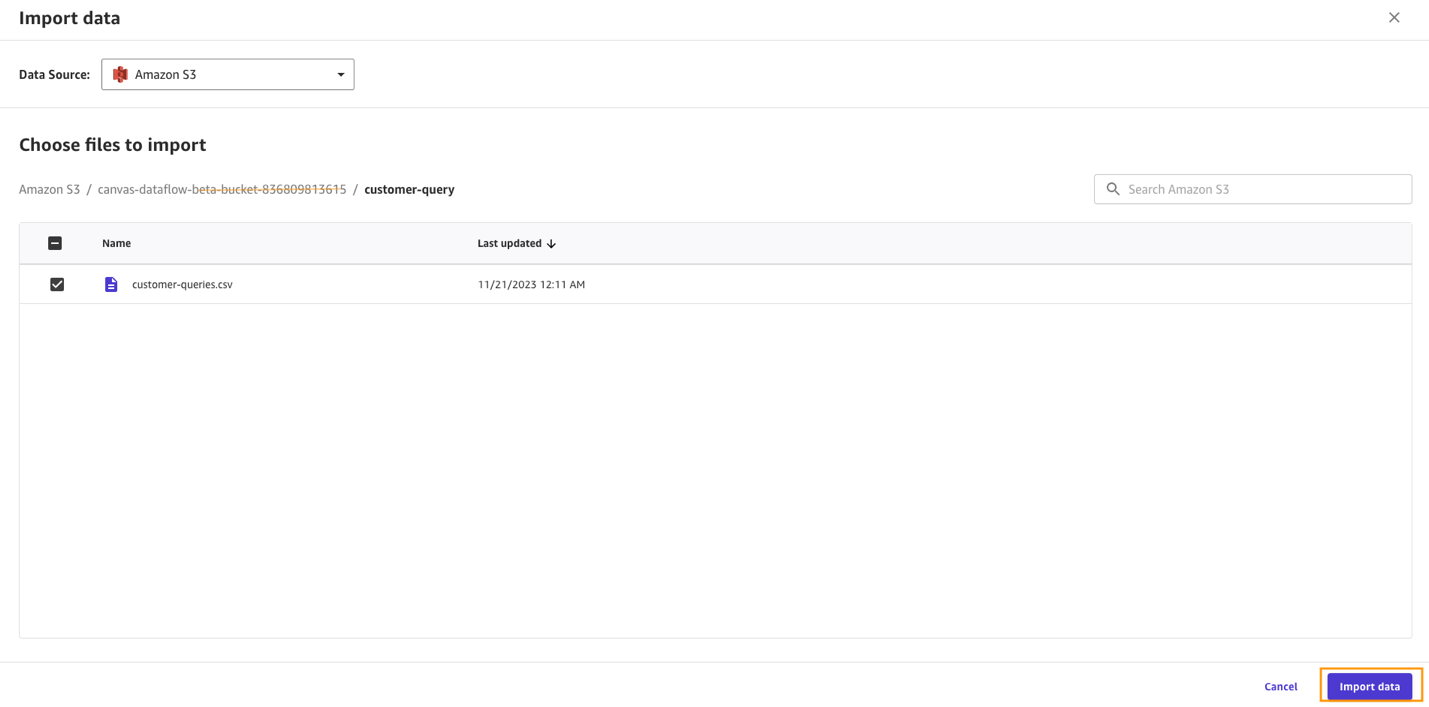

Lad os nu importere dataene fra Amazon S3-bøtten:

- Vælg Import datoer og vælg tabular fra rullelisten.

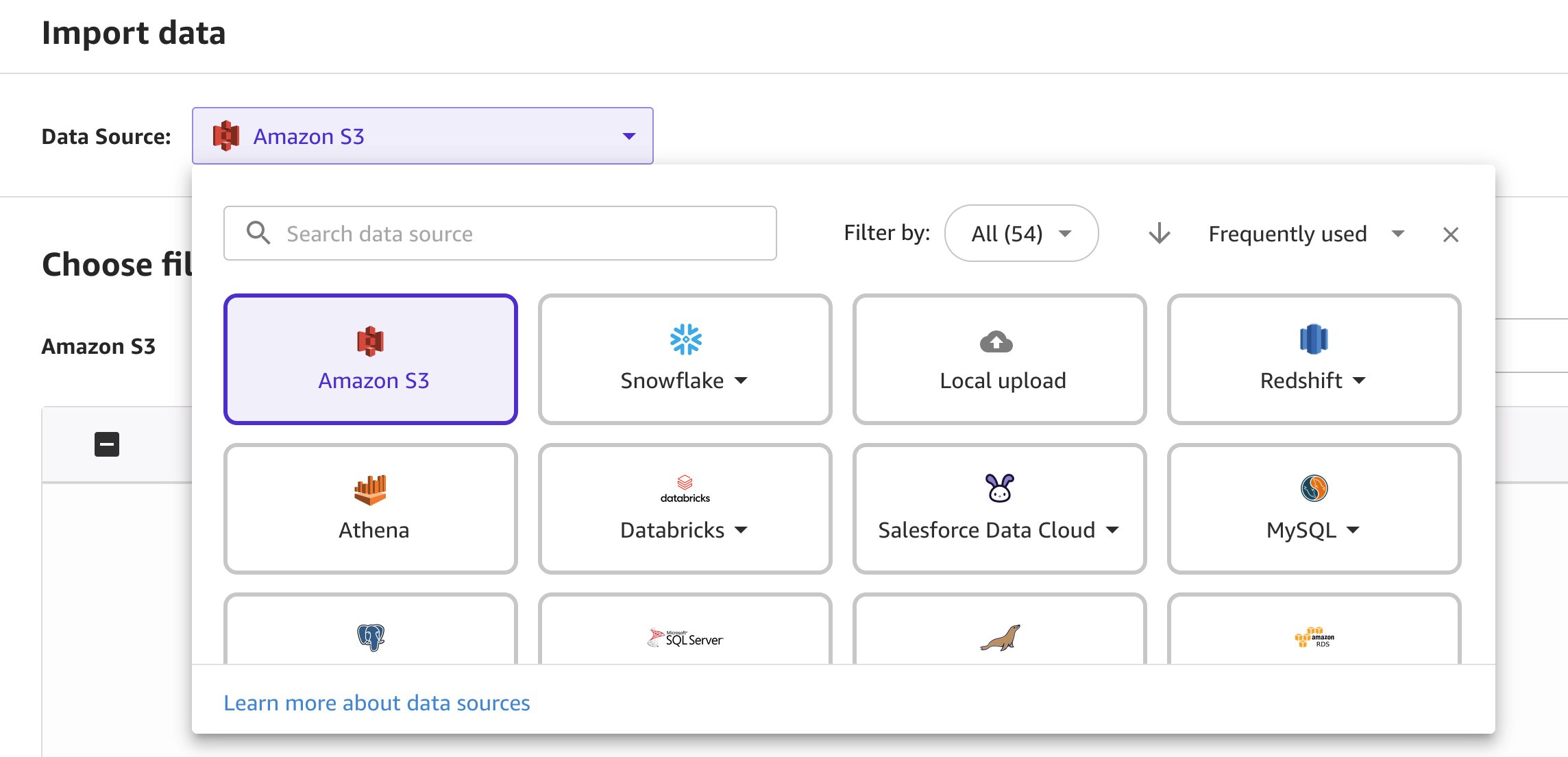

- Datakilde og vælg Amazon S3 fra rullelisten.

- Naviger til metadatafilen med PDF-filplaceringer, og vælg filen.

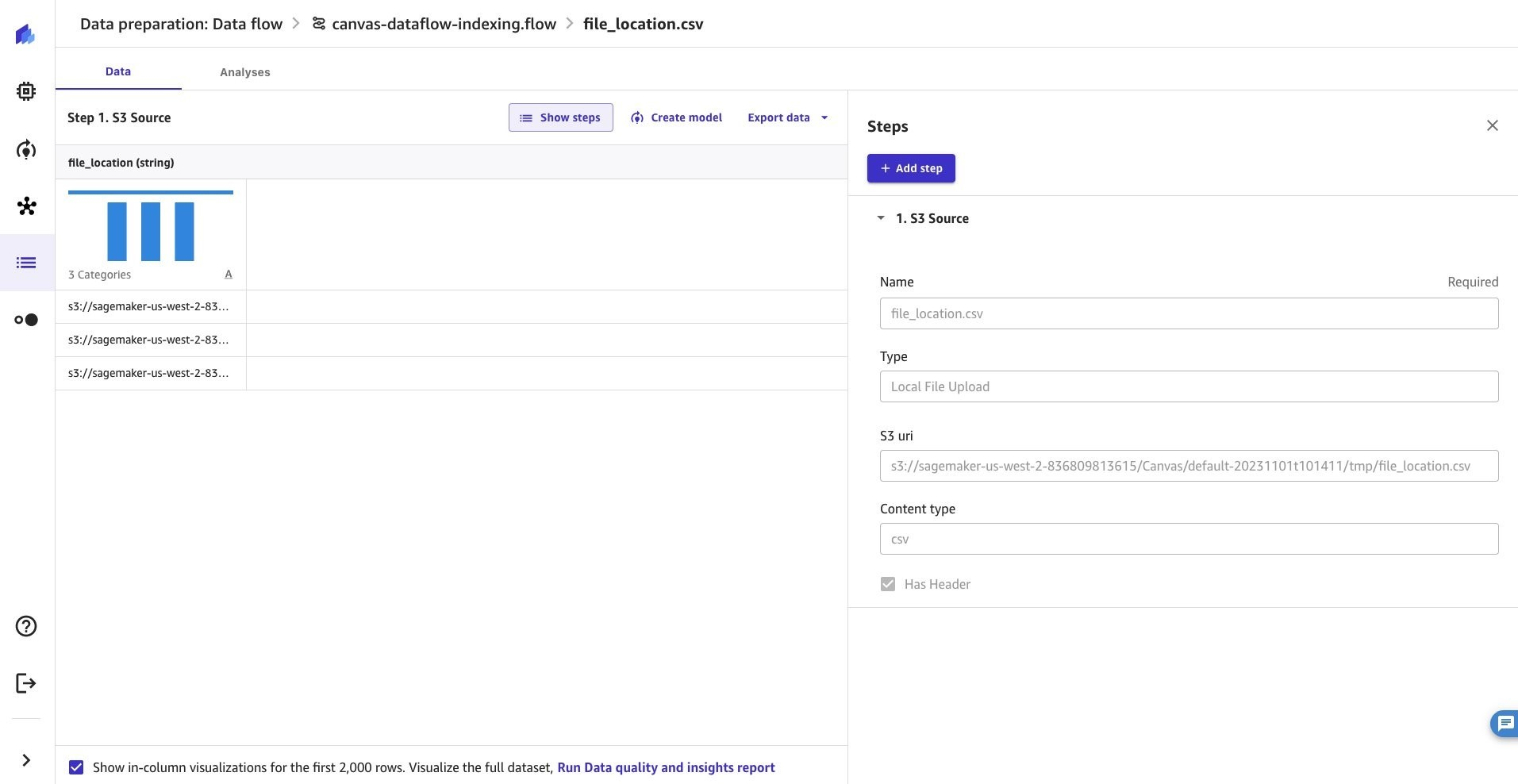

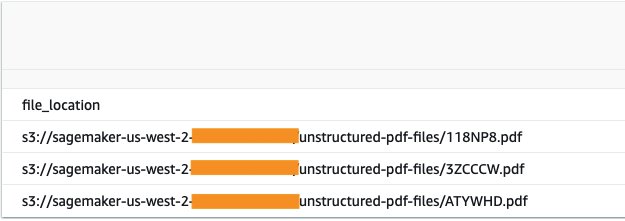

- Nu er metadatafilen indlæst til dataforberedelsesdataflowet, og vi kan fortsætte med at tilføje næste trin til at transformere data og indeks til Amazon OpenSearch. I dette tilfælde har filen følgende metadata, med placeringen af hver fil i Amazon S3-biblioteket.

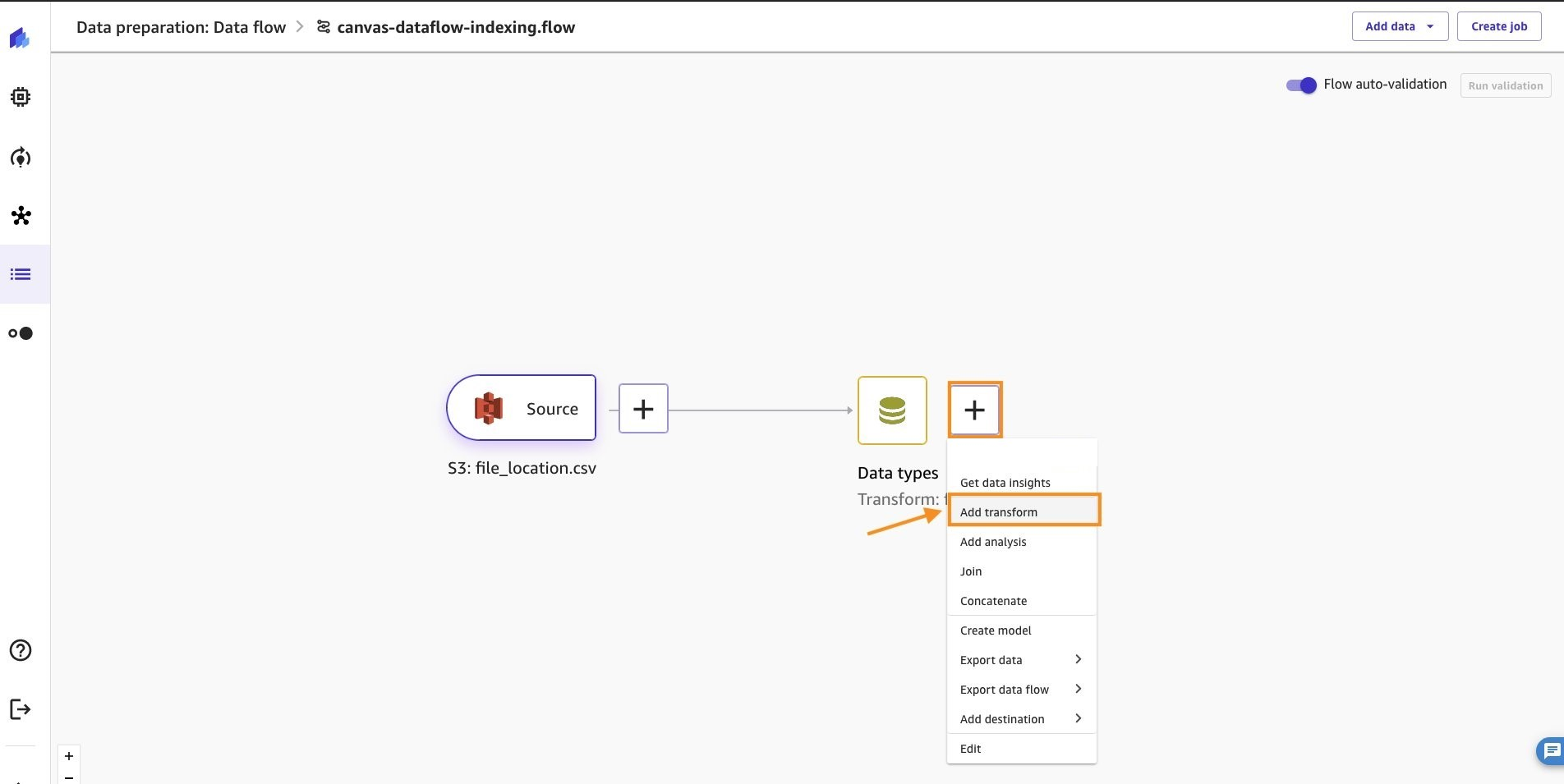

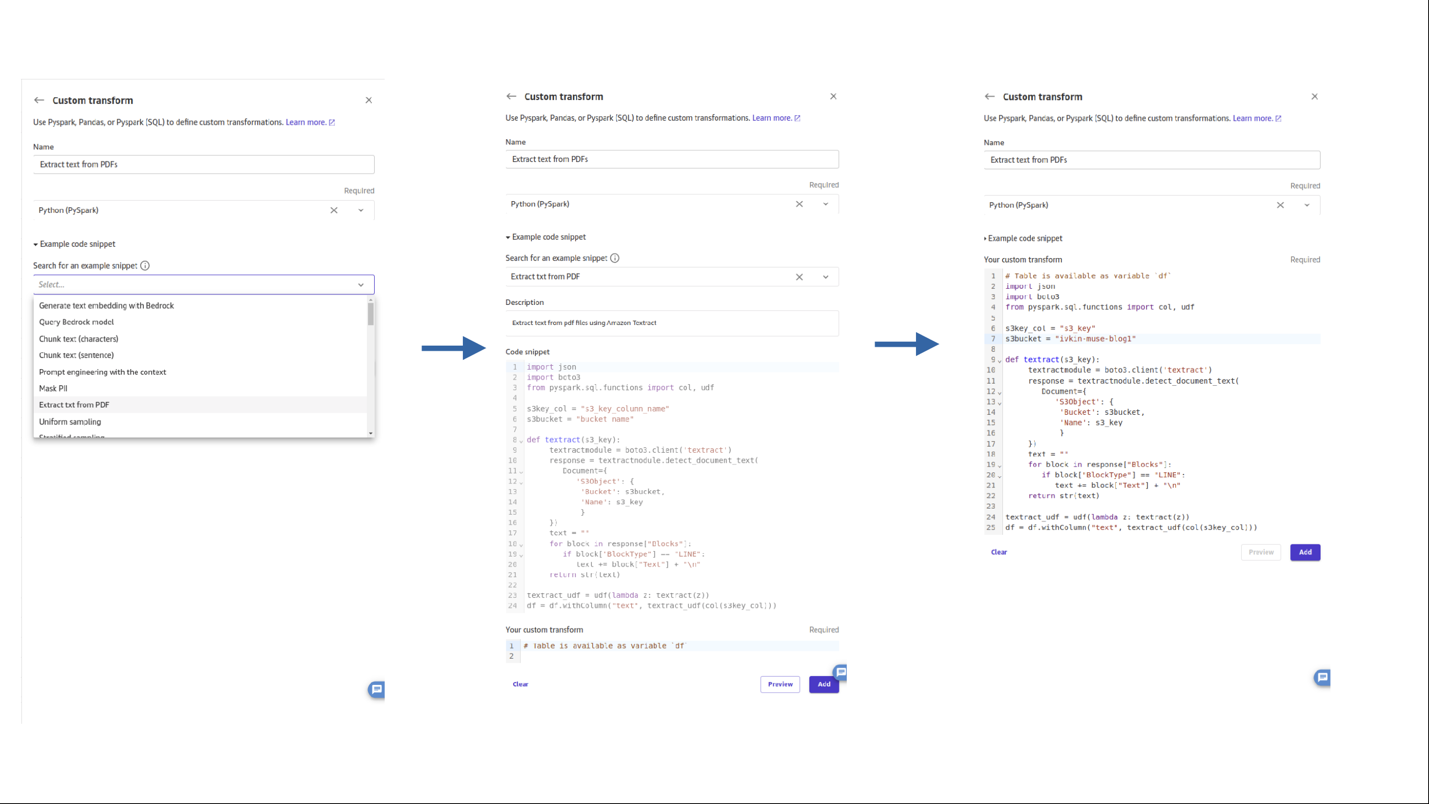

For at tilføje en ny transformation skal du udføre følgende trin:

- Vælg plustegnet og vælg Tilføj Transform.

- Vælg Tilføj trin Og vælg Brugerdefineret transformation.

- Du kan oprette en brugerdefineret transformation ved hjælp af Pandas, PySpark, Python brugerdefinerede funktioner og SQL PySpark. Vælge Python (PySpark) til denne brugssag.

- Indtast et navn til trinnet. Gennemse og vælg fra eksempelkodestykkerne uddrag tekst fra pdf. Foretag de nødvendige ændringer til kodestykket, og vælg Tilføj.

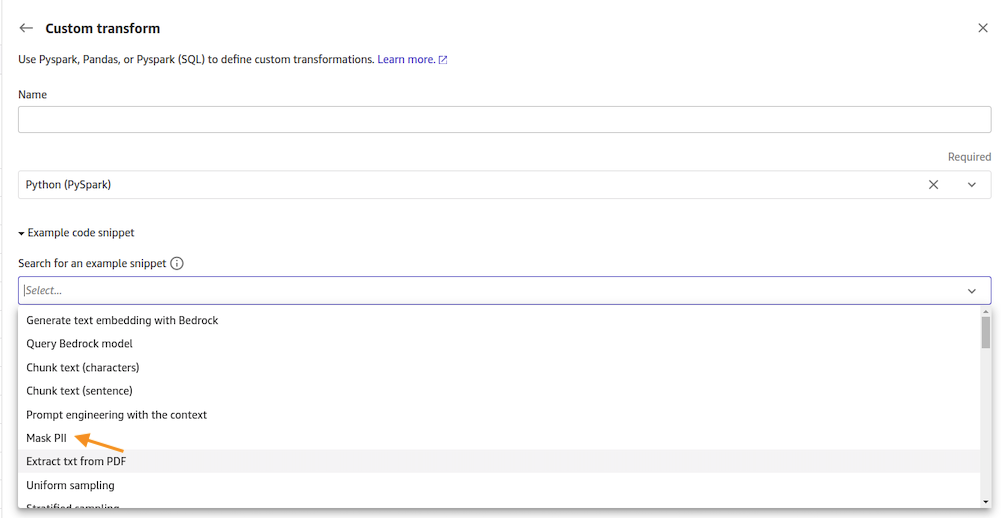

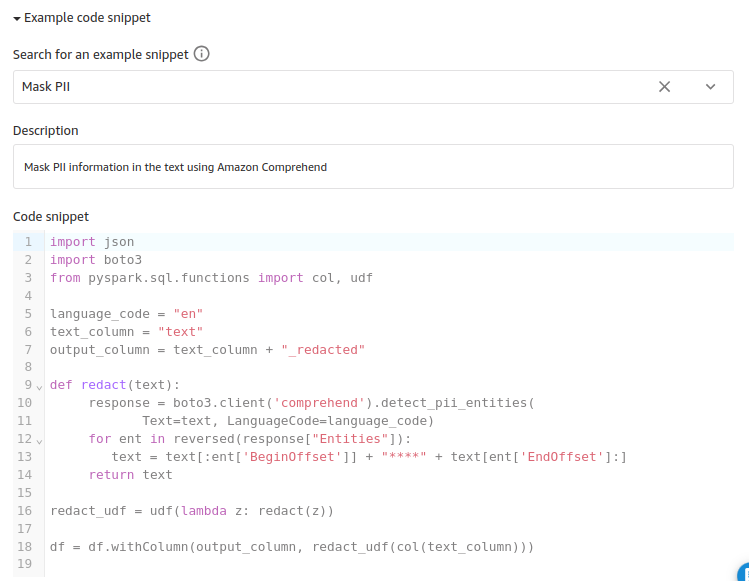

- Lad os tilføje et trin til at fjerne personlige identificerbare oplysninger (PII) fra de udtrukne data ved at udnytte Amazon Comprehend. Vælg Tilføj trin Og vælg Brugerdefineret transformation. Og vælg Python (PySpark).

Gennemse og vælg fra eksempelkodestykkerne maske PII. Foretag de nødvendige ændringer til kodestykket, og vælg Tilføj.

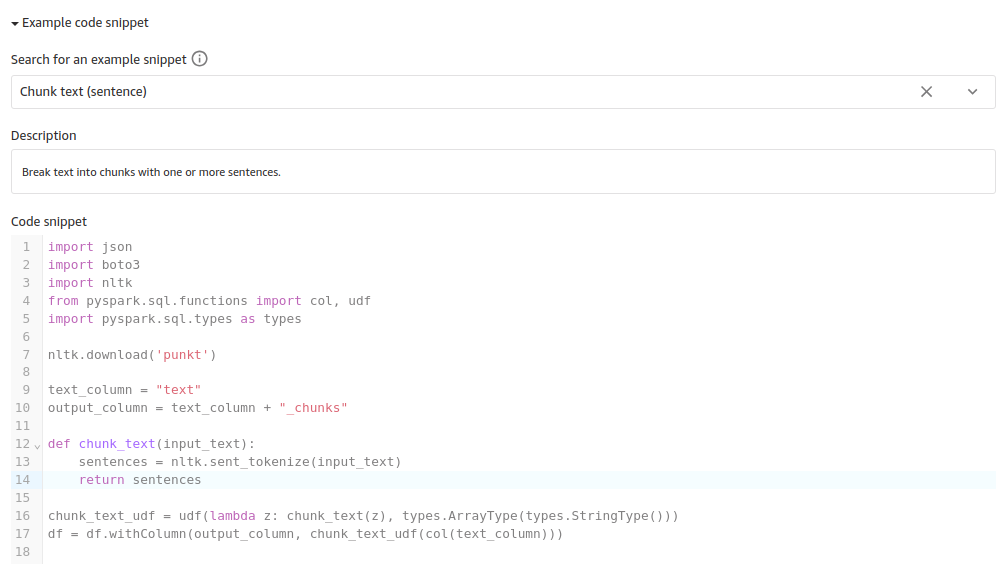

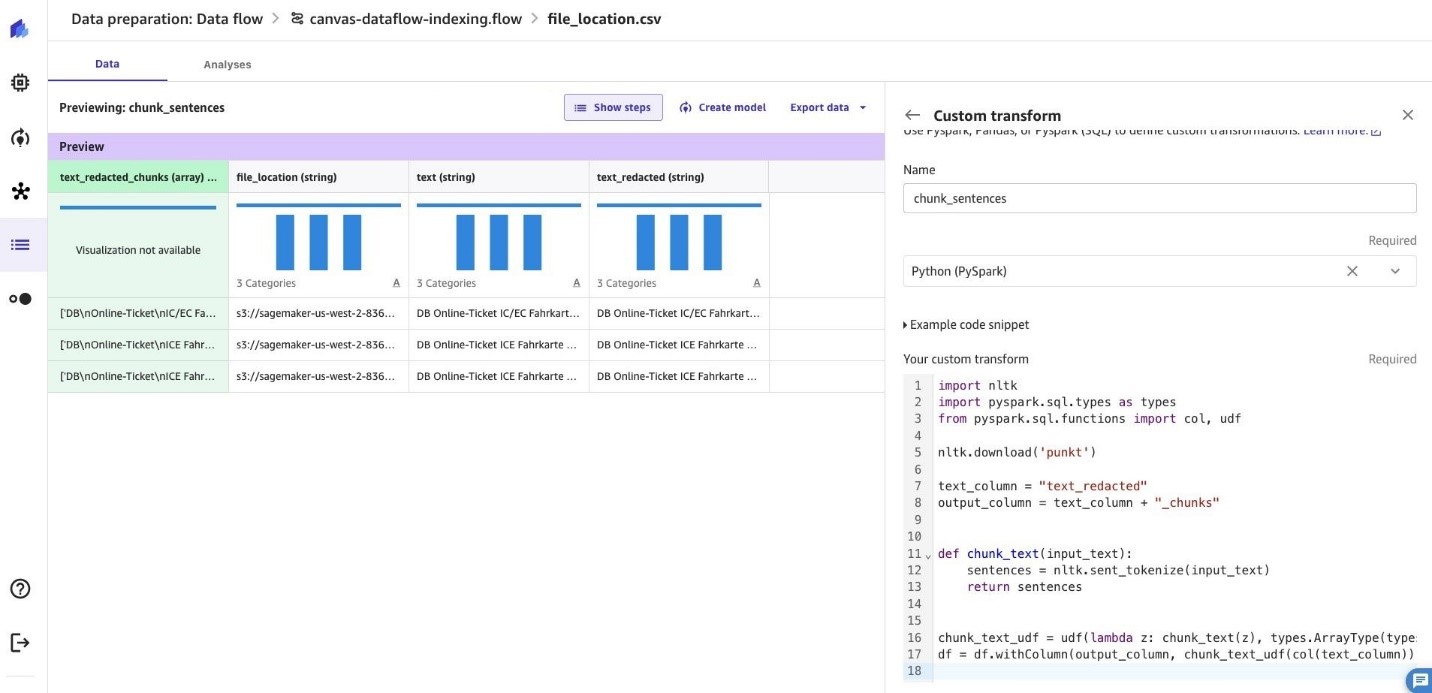

- Det næste trin er at dele tekstindholdet. Vælge Tilføj trin Og vælg Brugerdefineret transformation. Og vælg Python (PySpark).

Gennemse og vælg fra eksempelkodestykkerne Klump tekst. Foretag de nødvendige ændringer til kodestykket, og vælg Tilføj.

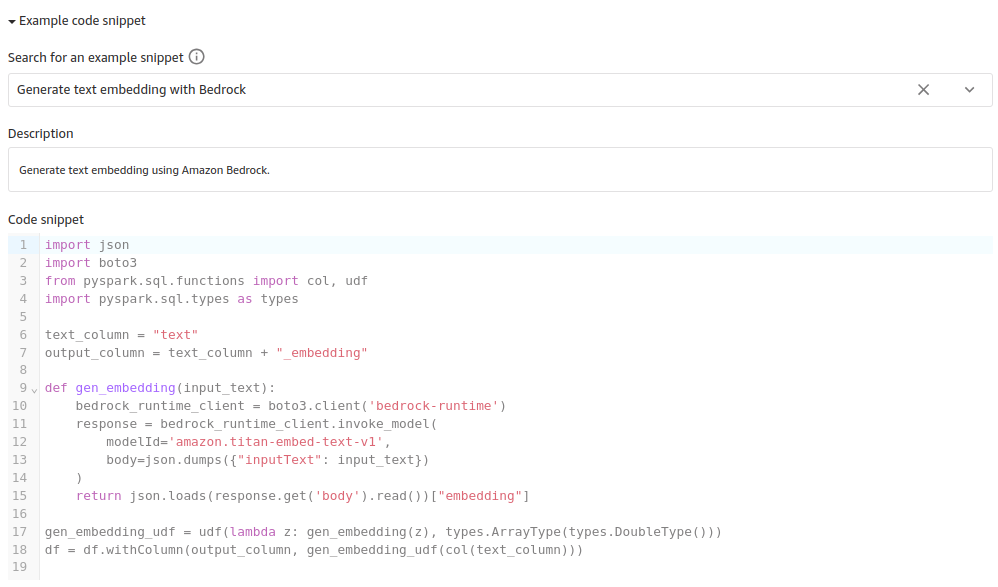

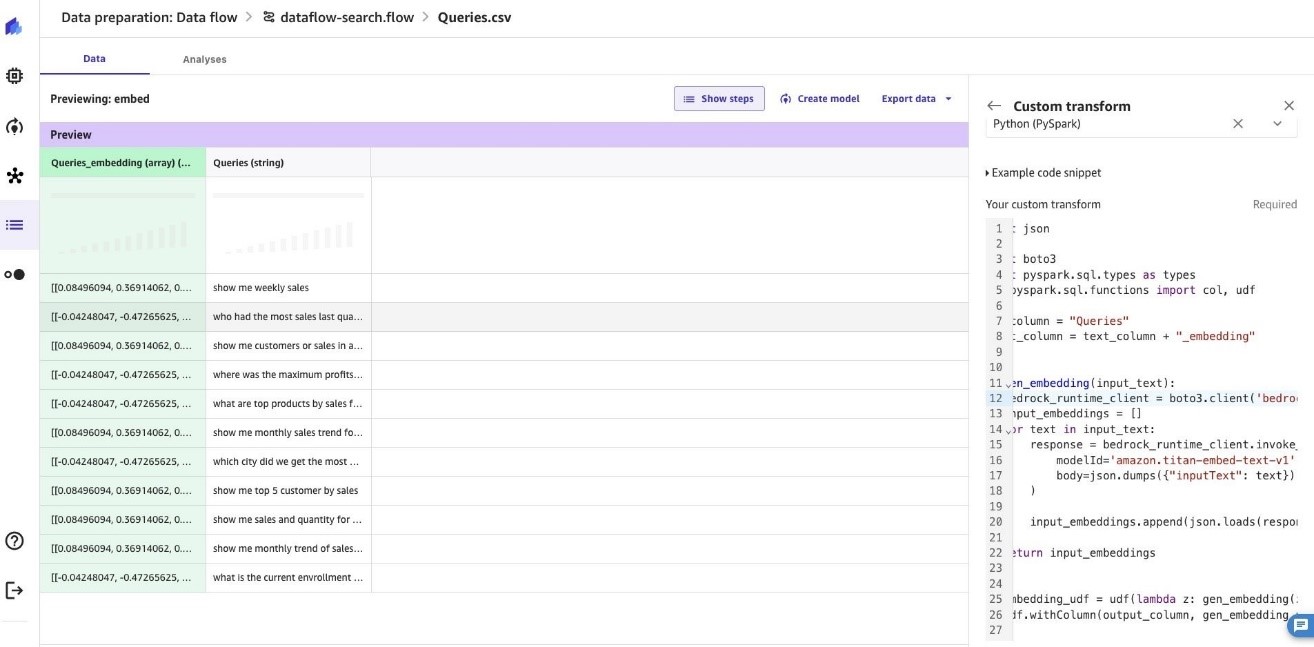

- Lad os konvertere tekstindholdet til vektorindlejringer ved hjælp af Amazonas grundfjeld Titan Embeddings model. Vælge Tilføj trin Og vælg Brugerdefineret transformation. Og vælg Python (PySpark).

Gennemse og vælg fra eksempelkodestykkerne Generer tekstindlejring med Bedrock. Foretag de nødvendige ændringer til kodestykket, og vælg Tilføj.

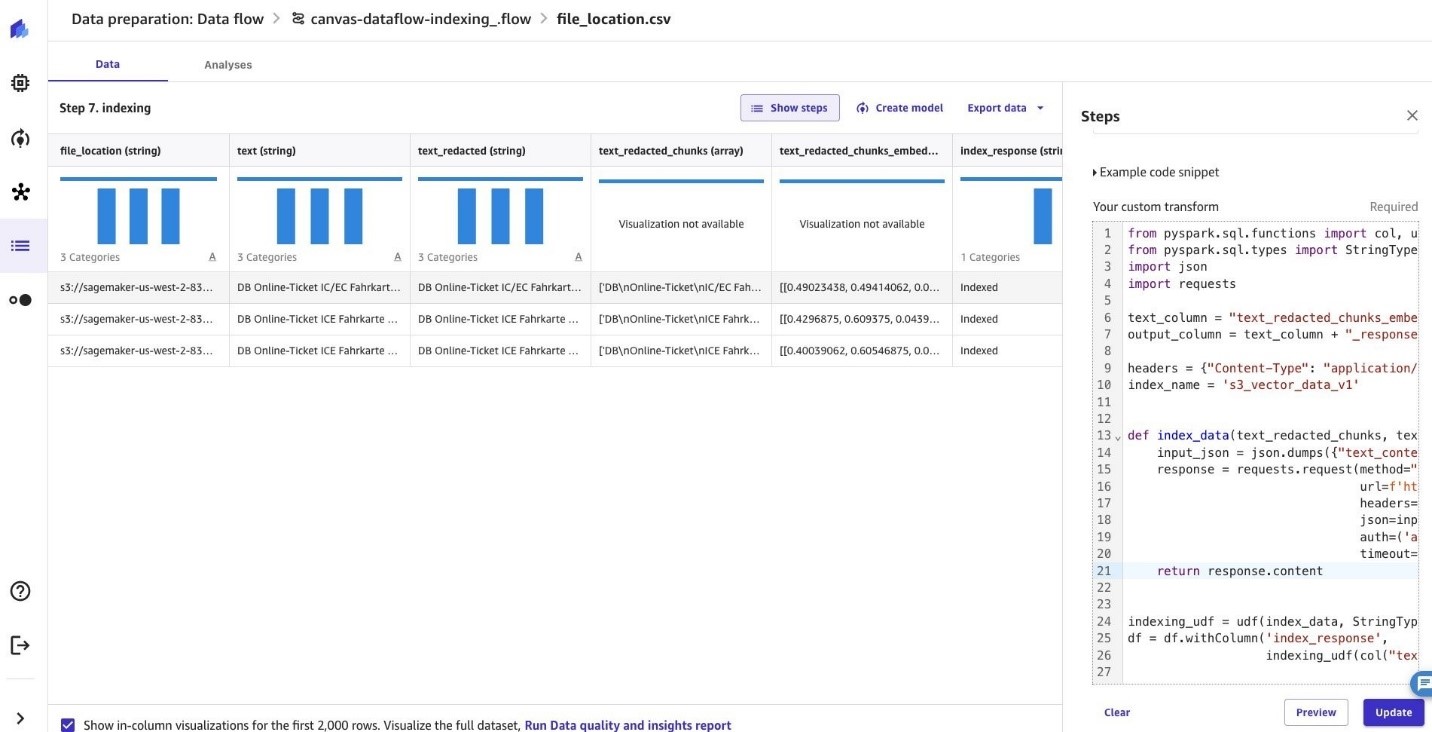

- Nu har vi vektorindlejringer til rådighed for PDF-filens indhold. Lad os gå videre og indeksere dataene i Amazon OpenSearch. Vælge Tilføj trin Og vælg Brugerdefineret transformation. Og vælg Python (PySpark). Du er fri til at omskrive følgende kode for at bruge din foretrukne vektordatabase. For nemheds skyld bruger vi hovedbrugernavn og adgangskode til at få adgang til OpenSearch API'er, for produktionsbelastninger skal du vælge mulighed i henhold til din organisations politikker.

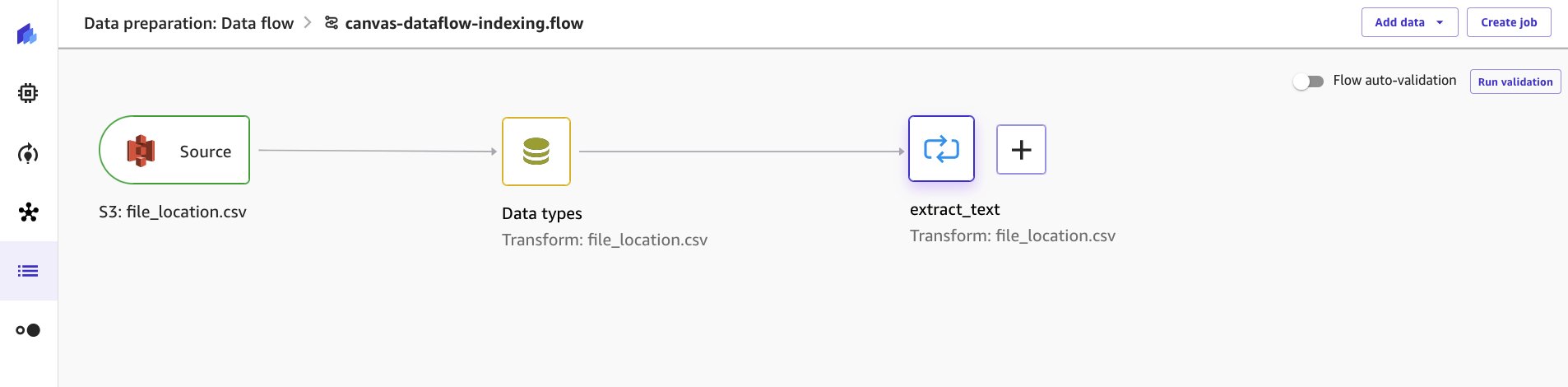

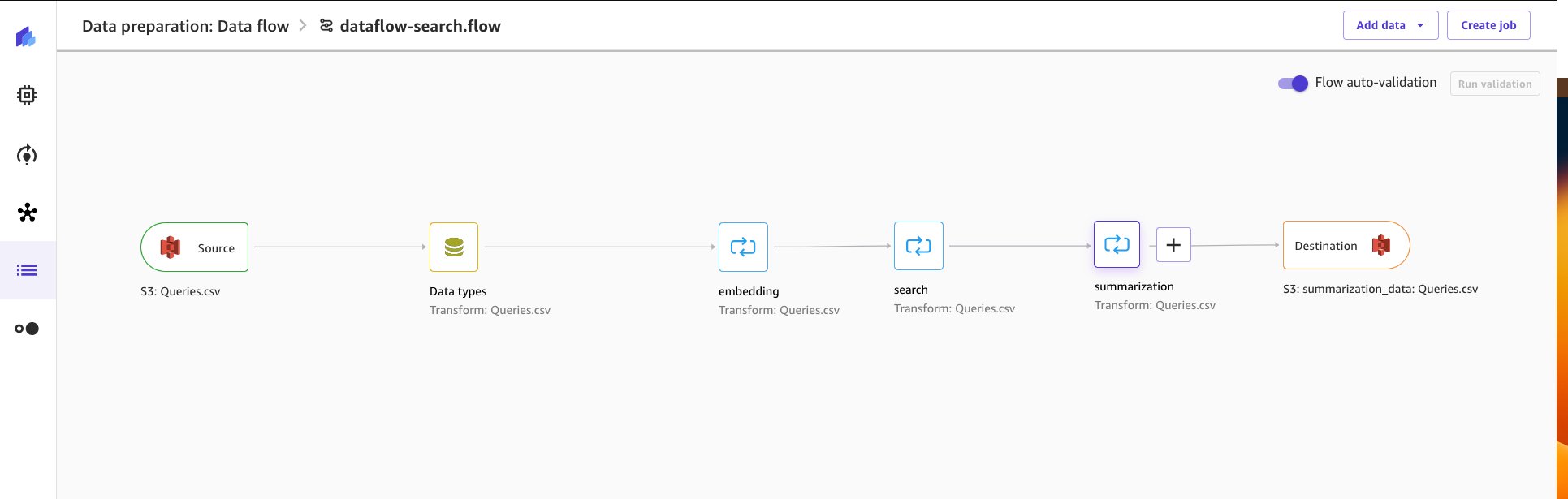

Endelig vil det oprettede dataflow være som følger:

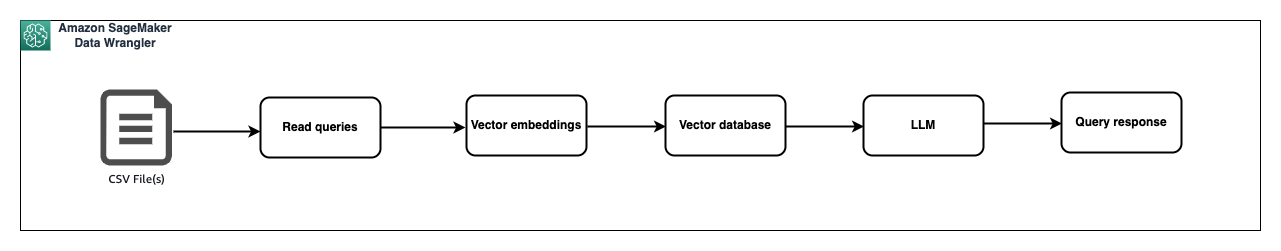

Med dette dataflow er dataene fra PDF-filen blevet læst og indekseret med vektorindlejringer i Amazon OpenSearch. Nu er det tid for os at oprette en fil med forespørgsler for at forespørge på de indekserede data og gemme dem på Amazon S3-placeringen. Vi peger vores søgedataflow til filen og udsender en fil med tilsvarende resultater i en ny fil på en Amazon S3-placering.

Forbereder en prompt

Når vi har oprettet en videnbase ud af vores PDF, kan vi teste den ved at søge i videnbasen efter et par eksempelforespørgsler. Vi behandler hver forespørgsel som følger:

- Generer indlejring til forespørgslen (drevet af Amazon Bedrock)

- Forespørgselsvektordatabase for den nærmeste nabokontekst (drevet af Amazon OpenSearch)

- Kombiner forespørgslen og konteksten i prompten.

- Forespørg på LLM med en prompt (drevet af Amazon Bedrock)

- Vælg på SageMaker Canvas-hjemmesiden Forberedelse af data.

- Vælg Opret i højre side af siden, giv derefter et dataflownavn og vælg Opret.

Lad os nu indlæse brugerspørgsmålene og derefter oprette en prompt ved at kombinere spørgsmålet og lignende dokumenter. Denne prompt leveres til LLM for at generere et svar på brugerspørgsmålet.

- Lad os indlæse en csv-fil med brugerspørgsmål. Vælge Importer data og vælg tabular fra rullelisten.

- Datakilde, og vælg Amazon S3 fra rullelisten. Alternativt kan du vælge at uploade en fil med brugerforespørgsler.

- Lad os tilføje en tilpasset transformation for at konvertere dataene til vektorindlejringer, efterfulgt af søgning i relaterede indlejringer fra Amazon OpenSearch, før vi sender en prompt til Amazon Bedrock med forespørgslen og konteksten fra videnbasen. For at generere indlejringer til forespørgslen kan du bruge det samme eksempelkodestykke Generer tekstindlejring med Bedrock nævnt i trin #7 ovenfor.

Lad os kalde Amazon OpenSearch API for at søge i relevante dokumenter efter de genererede vektorindlejringer. Tilføj en brugerdefineret transformation med Python (PySpark).

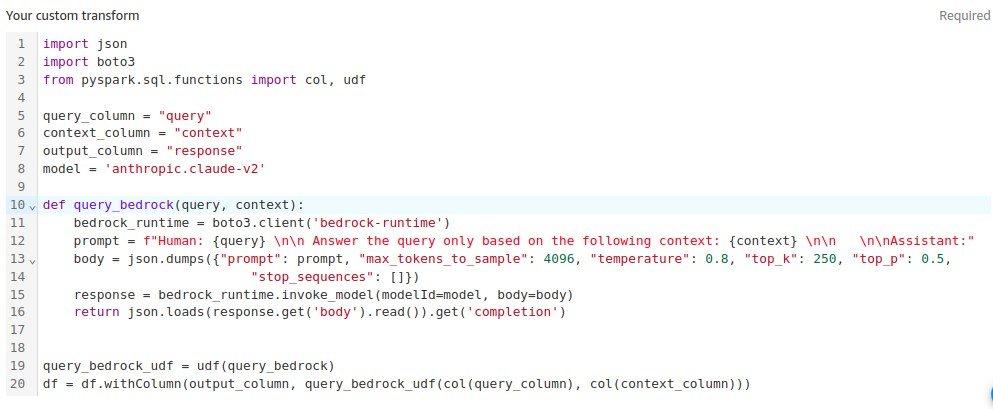

Lad os tilføje en brugerdefineret transformation for at kalde Amazon Bedrock API til forespørgselssvar og videregive dokumenterne fra Amazon OpenSearch vidensbase. Gennemse og vælg fra eksempelkodestykkerne Forespørgsel Grundbjerg med kontekst. Foretag de nødvendige ændringer til kodestykket, og vælg Tilføj.

Sammenfattende er RAG-baseret spørgsmålssvarende dataflow som følger:

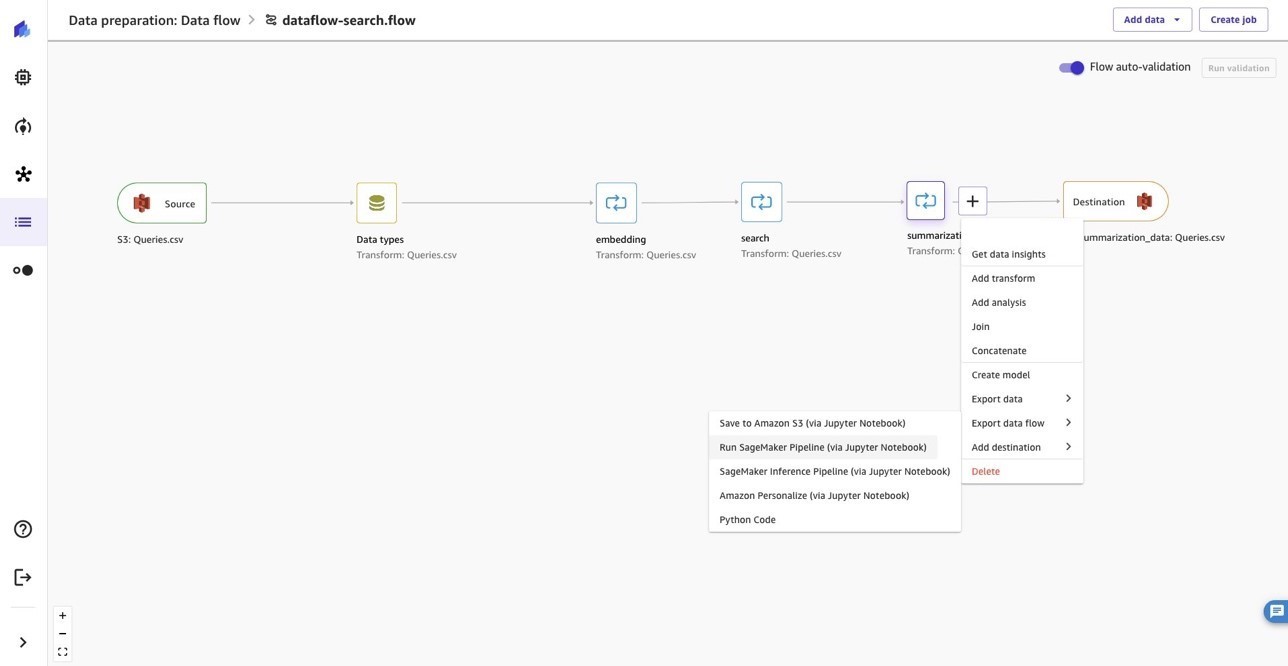

ML-udøvere bruger meget tid på at lave funktionsteknologikode, anvende den på deres oprindelige datasæt, træne modeller på de konstruerede datasæt og evaluere modelnøjagtighed. I betragtning af den eksperimentelle karakter af dette arbejde, fører selv det mindste projekt til flere iterationer. Den samme funktionsingeniørkode køres ofte igen og igen, hvilket spilder tid og computerressourcer på at gentage de samme operationer. I store organisationer kan dette forårsage et endnu større tab af produktivitet, fordi forskellige teams ofte kører identiske opgaver eller endda skriver dubleret funktionsteknologi, fordi de ikke har kendskab til tidligere arbejde. For at undgå genbehandling af funktioner eksporterer vi vores dataflow til en Amazon SageMaker pipeline. Lad os vælge + knappen til højre for forespørgslen. Vælg eksporter dataflow og vælg Kør SageMaker Pipeline (via Jupyter notesbog).

Gøre rent

For at undgå fremtidige gebyrer skal du slette eller lukke de ressourcer, du oprettede, mens du fulgte dette indlæg. Henvise til Logger ud af Amazon SageMaker Canvas for flere detaljer.

Konklusion

I dette indlæg viste vi dig, hvordan Amazon SageMaker Canvas's end-to-end-kapaciteter ved at påtage sig rollen som en dataprofessionel, der forbereder data til en LLM. Den interaktive dataforberedelse gjorde det muligt hurtigt at rense, transformere og analysere dataene for at udvikle informative funktioner. Ved at fjerne kodningskompleksiteter tillod SageMaker Canvas hurtig iteration for at skabe et træningsdatasæt af høj kvalitet. Denne accelererede arbejdsgang førte direkte til opbygning, træning og implementering af en effektiv maskinlæringsmodel for virksomhedspåvirkning. Med sin omfattende dataforberedelse og ensartede erfaring fra data til indsigt, giver SageMaker Canvas brugerne mulighed for at forbedre deres ML-resultater.

Vi opfordrer dig til at lære mere ved at udforske Amazon SageMaker Data Wrangler, Amazon SageMaker lærred, Amazon Titan modeller, Amazonas grundfjeldog Amazon OpenSearch Service at bygge en løsning ved hjælp af eksempelimplementeringen i dette indlæg og et datasæt, der er relevant for din virksomhed. Hvis du har spørgsmål eller forslag, så læg en kommentar.

Om forfatterne

Ajjay Govindaram er Senior Solutions Architect hos AWS. Han arbejder med strategiske kunder, der bruger AI/ML til at løse komplekse forretningsproblemer. Hans erfaring ligger i at levere teknisk vejledning samt designassistance til beskedne til store AI/ML-applikationsimplementeringer. Hans viden spænder fra applikationsarkitektur til big data, analytics og machine learning. Han nyder at lytte til musik, mens han hviler sig, opleve udendørslivet og tilbringe tid med sine kære.

Ajjay Govindaram er Senior Solutions Architect hos AWS. Han arbejder med strategiske kunder, der bruger AI/ML til at løse komplekse forretningsproblemer. Hans erfaring ligger i at levere teknisk vejledning samt designassistance til beskedne til store AI/ML-applikationsimplementeringer. Hans viden spænder fra applikationsarkitektur til big data, analytics og machine learning. Han nyder at lytte til musik, mens han hviler sig, opleve udendørslivet og tilbringe tid med sine kære.

Nikita Ivkin er en Senior Applied Scientist hos Amazon SageMaker Data Wrangler med interesser i maskinlæring og datarensningsalgoritmer.

Nikita Ivkin er en Senior Applied Scientist hos Amazon SageMaker Data Wrangler med interesser i maskinlæring og datarensningsalgoritmer.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/simplify-data-prep-for-gen-ai-with-amazon-sagemaker-data-wrangler/

- :har

- :er

- :ikke

- 100

- 14

- 20

- 25

- 28

- 50

- 7

- 8

- 804

- a

- I stand

- Om

- over

- fremskynde

- accelereret

- adgang

- Ifølge

- Konti

- nøjagtighed

- tilføje

- Yderligere

- Vedtagelse

- fremskridt

- Fordel

- fordele

- Efter

- igen

- aggregat

- forude

- AI

- AI / ML

- algoritmer

- Justerer

- Alle

- tilladt

- også

- Amazon

- Amazon SageMaker

- Amazon SageMaker Data Wrangler

- Amazon Web Services

- beløb

- an

- Analyser

- analytics

- analysere

- ,

- besvare

- enhver

- api

- Anvendelse

- anvendt

- Anvendelse

- arkitektur

- ER

- kunstig

- kunstig intelligens

- AS

- Assistance

- At

- vedhæfte

- lyd

- augmented

- til rådighed

- undgå

- AWS

- bund

- baseret

- BE

- fordi

- bliver

- været

- før

- være

- Bedre

- forudindtaget

- Big

- Big data

- bygge

- Bygning

- indbygget

- virksomhed

- virksomheder

- .

- by

- ringe

- CAN

- canvas

- kapaciteter

- tilfælde

- Årsag

- Ændringer

- afgifter

- Vælg

- ren

- Rengøring

- kode

- Kodning

- kombinerer

- KOMMENTAR

- Virksomheder

- sammenlignet

- konkurrencedygtig

- fuldføre

- komplekse

- kompleksiteter

- forstå

- omfattende

- Compute

- Overvej

- Konsol

- indeholder

- indeholder

- indhold

- indhold

- sammenhæng

- sammenhænge

- fortsætter

- kontrol

- konvertere

- Tilsvarende

- kunne

- dæksel

- skabe

- oprettet

- kritisk

- skik

- kunde

- Kundeservice

- Kunder

- data

- Dataforberedelse

- Database

- datasæt

- Deloitte

- demonstreret

- implementering

- implementeringer

- Design

- detaljer

- udvikling

- forskellige

- svært

- Dimension

- retning

- direkte

- opdage

- do

- dokumentet

- dokumentation

- dokumenter

- domæne

- Domæner

- ned

- i løbet af

- e

- hver

- nemt

- effektivt

- effektiv

- effektivt

- emails

- indlejring

- bemyndiger

- aktiveret

- muliggør

- tilskynde

- ende til ende

- ingeniør

- manipuleret

- Engineering

- evaluere

- Endog

- eksempel

- eksisterer

- erfaring

- oplever

- eksperimenterende

- udforske

- Udforskning

- eksport

- ekstrakt

- Feature

- Funktionalitet

- få

- Fields

- File (Felt)

- filtrere

- endelige

- Finde

- flow

- efterfulgt

- efter

- følger

- Til

- Forbes

- Foundation

- Fonde

- Gratis

- fra

- fuld

- funktioner

- yderligere

- fremtiden

- Gevinst

- generere

- genereret

- generere

- generation

- generative

- Generativ AI

- få

- Giv

- given

- Global

- Go

- mål

- godt

- større

- Have

- he

- headers

- høj kvalitet

- hans

- besidder

- Home

- Hvordan

- How To

- Men

- HTML

- HTTPS

- i

- identisk

- if

- billeder

- KIMOs Succeshistorier

- implementering

- importere

- vigtigt

- imponerende

- Forbedre

- in

- omfatter

- indeks

- indekseret

- oplysninger

- informative

- initial

- indsigt

- anvisninger

- integration

- Intelligens

- interaktiv

- interesser

- grænseflade

- Internet

- ind

- involvere

- IT

- iteration

- iterationer

- ITS

- Karriere

- jpg

- json

- viden

- Land

- Sprog

- stor

- storstilet

- lancere

- Leads

- LÆR

- læring

- Forlade

- Led

- løftestang

- ligger

- ligesom

- Liste

- Lytte

- LLM

- belastning

- placering

- placeringer

- off

- Lot

- elskede

- Lav

- maskine

- machine learning

- Main

- lave

- maerker

- maske

- massive

- Master

- Kan..

- mekanismer

- Medier

- Menu

- Meta

- Metadata

- ML

- model

- modeller

- beskedne

- mere

- mest

- flere

- Musik

- navn

- Natural

- Natural Language Processing

- Natur

- Navigation

- nødvendig

- Behov

- Ny

- næste

- ingen

- notesbog

- nu

- of

- tit

- on

- engang

- dem

- kun

- Produktion

- Option

- or

- organisation

- organisationer

- Andet

- vores

- ud

- udfald

- udendørs

- output

- i løbet af

- side

- pandaer

- brød

- Passing

- Adgangskode

- ydeevne

- personale

- pick

- stykke

- stykker

- pipeline

- plato

- Platon Data Intelligence

- PlatoData

- Vær venlig

- plus

- Punkt

- politikker

- Indlæg

- potentiale

- strøm

- foretrækkes

- forberedelse

- Forbered

- forberede

- Forud

- sandsynligvis

- Problem

- problemer

- Fortsæt

- behandle

- forarbejdning

- produktion

- produktivitet

- professionel

- projekt

- egenskaber

- forudsat

- giver

- leverer

- Python

- forespørgsler

- spørgsmål

- Spørgsmål

- hurtigt

- intervaller

- hurtige

- ratings

- nå

- Læs

- virkelige verden

- modtaget

- henvise

- relaterede

- relevant

- fjernelse

- rapporteret

- anmodninger

- kræver

- Kræver

- Ressourcer

- svar

- reaktioner

- hvilende

- Resultater

- afkast

- Anmeldelser

- højre

- roller

- Kør

- sagemaker

- samme

- Gem

- Videnskabsmand

- Søg

- søgning

- Sektion

- set

- Vælg

- afsendelse

- senior

- følsom

- tjeneste

- Tjenester

- indstillinger

- bør

- Vis

- viste

- lukke

- Luk ned

- side

- underskrive

- signifikant

- lignende

- enkelhed

- forenkle

- Størrelse

- uddrag

- So

- Social

- sociale medier

- løsninger

- Løsninger

- SOLVE

- nogle

- Kilde

- Kilder

- specifikke

- specifikt

- tilbringe

- udgifterne

- Stage

- etaper

- Trin

- Steps

- Stadig

- Strategisk

- struktureret

- RESUMÉ

- Understøtter

- Kortlægge

- Tag

- hold

- Teknisk

- teknikker

- prøve

- tekst

- at

- Fremtiden

- deres

- Them

- derefter

- Der.

- Disse

- de

- denne

- Dermed

- tid

- titan

- til

- i dag

- værktøjer

- Kurser

- Transform

- Transformation

- transformationer

- omdanne

- sand

- trunkering

- typen

- typer

- forenet

- us

- brug

- anvendte

- Bruger

- brugere

- ved brug af

- Værdifuld

- via

- video

- visuel

- går igennem

- we

- web

- webservices

- GODT

- som

- mens

- WHO

- vilje

- med

- Arbejde

- workflow

- virker

- ville

- skriver

- Du

- Din

- zephyrnet