Efterhånden som kunder accelererer deres migreringer til skyen og transformerer deres forretning, befinder nogle sig i situationer, hvor de skal administrere it-drift i et multicloud-miljø. For eksempel kan du have erhvervet en virksomhed, der allerede kørte på en anden cloud-udbyder, eller du kan have en arbejdsbyrde, der genererer værdi fra unikke muligheder leveret af AWS. Et andet eksempel er uafhængige softwareleverandører (ISV'er), der gør deres produkter og tjenester tilgængelige i forskellige cloud-platforme til gavn for deres slutkunder. Eller en organisation opererer muligvis i en region, hvor en primær cloud-udbyder ikke er tilgængelig, og for at opfylde kravene til datasuverænitet eller dataophold kan de bruge en sekundær cloud-udbyder.

I disse scenarier, når du begynder at omfavne generativ AI, store sprogmodeller (LLM'er) og maskinlæringsteknologier (ML) som en kernedel af din virksomhed, leder du muligvis efter muligheder for at drage fordel af AWS AI og ML funktioner uden for AWS i et multicloud-miljø. For eksempel kan du gøre brug af Amazon SageMaker at bygge og træne ML model, eller bruge Amazon SageMaker Jumpstart at implementere forudbyggede fundament eller tredjeparts ML-modeller, som du kan implementere med et enkelt klik på nogle få knapper. Eller du vil måske drage fordel af Amazonas grundfjeld at bygge og skalere generative AI-applikationer, eller du kan udnytte AWS' præ-trænede AI-tjenester, som ikke kræver, at du lærer maskinlæringsfærdigheder. AWS giver support til scenarier, hvor organisationer ønsker det bringe deres egen model til Amazon SageMaker or ind i Amazon SageMaker Canvas for forudsigelser.

I dette indlæg viser vi en af de mange muligheder, du har for at drage fordel af AWS' bredeste og dybeste sæt af AI/ML-kapaciteter i et multicloud-miljø. Vi viser, hvordan du kan bygge og træne en ML-model i AWS og implementere modellen i en anden platform. Vi træner modellen ved hjælp af Amazon SageMaker, gemmer modellens artefakter i Amazon Simple Storage Service (Amazon S3), og implementer og kør modellen i Azure. Denne tilgang er fordelagtig, hvis du bruger AWS-tjenester til ML for dets mest omfattende sæt funktioner, men alligevel skal du køre din model i en anden cloud-udbyder i en af de situationer, vi har diskuteret.

Nøglekoncepter

Amazon SageMaker Studio er et webbaseret, integreret udviklingsmiljø (IDE) til maskinlæring. SageMaker Studio giver datavidenskabsfolk, ML-ingeniører og dataingeniører mulighed for at forberede data, bygge, træne og implementere ML-modeller på én webgrænseflade. Med SageMaker Studio kan du få adgang til specialbyggede værktøjer til alle faser af ML-udviklingslivscyklussen, fra dataforberedelse til opbygning, træning og implementering af dine ML-modeller, hvilket forbedrer datavidenskabsteamets produktivitet med op til ti gange. SageMaker Studio notesbøger er hurtigstartende, kollaborative notebooks, der integreres med specialbyggede ML-værktøjer i SageMaker og andre AWS-tjenester.

SageMaker er en omfattende ML-tjeneste, der gør det muligt for forretningsanalytikere, dataforskere og MLOps-ingeniører at bygge, træne og implementere ML-modeller til enhver brug, uanset ML-ekspertise.

AWS giver Deep Learning Containere (DLC'er) til populære ML-frameworks såsom PyTorch, TensorFlow og Apache MXNet, som du kan bruge med SageMaker til træning og inferens. DLC'er er tilgængelige som Docker-billeder i Amazon Elastic Container Registry (Amazon ECR). Docker-billederne er forudinstalleret og testet med de nyeste versioner af populære deep learning-rammer samt andre afhængigheder, der er nødvendige for træning og inferens. For en komplet liste over de forudbyggede Docker-billeder administreret af SageMaker, se Docker-registreringsstier og eksempelkode. Amazon ECR understøtter sikkerhedsscanning og er integreret med Amazon inspektør sårbarhedsstyringstjeneste for at imødekomme din organisations sikkerhedskrav til overholdelse af billeder og for at automatisere scanning af sårbarhedsvurdering. Organisationer kan også bruge AWS Trainium , AWS-inferens for bedre pris-ydelse til at køre ML træningsjob eller konklusioner.

Løsningsoversigt

I dette afsnit beskriver vi, hvordan man bygger og træner en model ved hjælp af SageMaker og implementerer modellen til Azure Functions. Vi bruger en SageMaker Studio notesbog til at bygge, træne og implementere modellen. Vi træner modellen i SageMaker ved hjælp af et forudbygget Docker-billede til PyTorch. Selvom vi implementerer den trænede model til Azure i dette tilfælde, kan du bruge den samme tilgang til at implementere modellen på andre platforme, såsom i lokaler eller andre cloud-platforme.

Når vi opretter et træningsjob, lancerer SageMaker ML compute-instanserne og bruger vores træningskode og træningsdatasættet til at træne modellen. Den gemmer de resulterende modelartefakter og andet output i en S3-spand, som vi angiver som input til træningsjobbet. Når modeluddannelsen er afsluttet, bruger vi Åbn Neural Network Exchange (ONNX) runtime-bibliotek til at eksportere PyTorch-modellen som en ONNX-model.

Til sidst implementerer vi ONNX-modellen sammen med en tilpasset inferenskode skrevet i Python til Azure-funktioner ved hjælp af Azure CLI. ONNX understøtter det meste almindeligt anvendte ML-rammer og værktøjer. En ting at bemærke er, at det er nyttigt at konvertere en ML-model til ONNX, hvis du ønsker at bruge en anden målimplementeringsramme, såsom PyTorch til TensorFlow. Hvis du bruger den samme ramme på både kilden og målet, behøver du ikke konvertere modellen til ONNX-format.

Følgende diagram illustrerer arkitekturen for denne tilgang.

Vi bruger en SageMaker Studio notesbog sammen med SageMaker Python SDK at bygge og træne vores model. SageMaker Python SDK er et open source-bibliotek til træning og implementering af ML-modeller på SageMaker. For flere detaljer, se Opret eller åbn en Amazon SageMaker Studio Notebook.

Kodestykkerne i de følgende sektioner er blevet testet i SageMaker Studio notebook-miljøet ved hjælp af Data Science 3.0-billedet og Python 3.0-kernen.

I denne løsning demonstrerer vi følgende trin:

- Træn en PyTorch-model.

- Eksporter PyTorch-modellen som en ONNX-model.

- Pak modellen og slutningskoden.

- Implementer modellen til Azure Functions.

Forudsætninger

Du skal have følgende forudsætninger:

- En AWS-konto.

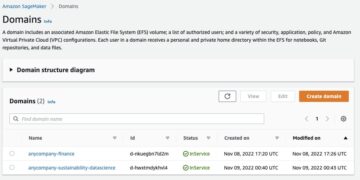

- Et SageMaker-domæne og SageMaker Studio-bruger. For instruktioner til at oprette disse, se Ombord på Amazon SageMaker Domain ved hjælp af hurtig opsætning.

- Azure CLI.

- Adgang til Azure og legitimationsoplysninger for en serviceprincipal, der har tilladelser til at oprette og administrere Azure-funktioner.

Træn en model med PyTorch

I dette afsnit beskriver vi trinene til at træne en PyTorch-model.

Installer afhængigheder

Installer bibliotekerne for at udføre de nødvendige trin til modeltræning og modelimplementering:

pip install torchvision onnx onnxruntimeFuldfør indledende opsætning

Vi begynder med at importere AWS SDK til Python (Boto3) og SageMaker Python SDK. Som en del af opsætningen definerer vi følgende:

- Et sessionsobjekt, der giver bekvemmelighedsmetoder inden for rammerne af SageMaker og vores egen konto.

- En SageMaker-rolle, som ARN brugte til at uddelegere tilladelser til trænings- og hostingtjenesten. Vi har brug for dette, så disse tjenester kan få adgang til de S3 buckets, hvor vores data og model er gemt. For instruktioner om oprettelse af en rolle, der opfylder dine forretningsbehov, se SageMaker roller. Til dette indlæg bruger vi den samme udførelsesrolle som vores Studio-notebook-instans. Vi får denne rolle ved at ringe

sagemaker.get_execution_role(). - Standardregionen, hvor vores træningsjob vil køre.

- Standardspanden og præfikset bruger vi til at gemme modeloutputtet.

Se følgende kode:

import sagemaker

import boto3

import os execution_role = sagemaker.get_execution_role()

region = boto3.Session().region_name

session = sagemaker.Session()

bucket = session.default_bucket()

prefix = "sagemaker/mnist-pytorch"Opret træningsdatasættet

Vi bruger datasættet, der er tilgængeligt i den offentlige bucket sagemaker-example-files-prod-{region}. Datasættet indeholder følgende filer:

- train-images-idx3-ubyte.gz – Indeholder billeder af træningssæt

- train-labels-idx1-ubyte.gz – Indeholder etiketter til træningssæt

- t10k-images-idx3-ubyte.gz – Indeholder testsætbilleder

- t10k-labels-idx1-ubyte.gz – Indeholder testsætetiketter

Vi brugertorchvision.datasets modul for at downloade dataene fra den offentlige bucket lokalt, før de uploades til vores træningsdata bucket. Vi videregiver denne spandplacering som et input til SageMaker træningsjobbet. Vores træningsscript bruger denne placering til at downloade og forberede træningsdataene og derefter træne modellen. Se følgende kode:

MNIST.mirrors = [ f"https://sagemaker-example-files-prod-{region}.s3.amazonaws.com/datasets/image/MNIST/"

] MNIST( "data", download=True, transform=transforms.Compose( [transforms.ToTensor(), transforms.Normalize((0.1307,), (0.3081,))] ),

)

Opret træningsscriptet

Med SageMaker kan du medbringe din egen model vha script-tilstand. Med script-tilstand kan du bruge de forudbyggede SageMaker-beholdere og give dit eget træningsscript, som har modeldefinitionen, sammen med eventuelle brugerdefinerede biblioteker og afhængigheder. Det SageMaker Python SDK passerer vores manuskript som en entry_point til containeren, som indlæser og kører togfunktionen fra det medfølgende script for at træne vores model.

Når træningen er færdig, gemmer SageMaker modeloutputtet i S3-bøtten, som vi har leveret som parameter til træningsjobbet.

Vores træningskode er tilpasset fra følgende PyTorch eksempel script. Følgende uddrag fra koden viser modeldefinitionen og togfunktionen:

# define network class Net(nn.Module): def __init__(self): super(Net, self).__init__() self.conv1 = nn.Conv2d(1, 32, 3, 1) self.conv2 = nn.Conv2d(32, 64, 3, 1) self.dropout1 = nn.Dropout(0.25) self.dropout2 = nn.Dropout(0.5) self.fc1 = nn.Linear(9216, 128) self.fc2 = nn.Linear(128, 10) def forward(self, x): x = self.conv1(x) x = F.relu(x) x = self.conv2(x) x = F.relu(x) x = F.max_pool2d(x, 2) x = self.dropout1(x) x = torch.flatten(x, 1) x = self.fc1(x) x = F.relu(x) x = self.dropout2(x) x = self.fc2(x) output = F.log_softmax(x, dim=1) return output# train def train(args, model, device, train_loader, optimizer, epoch): model.train() for batch_idx, (data, target) in enumerate(train_loader): data, target = data.to(device), target.to(device) optimizer.zero_grad() output = model(data) loss = F.nll_loss(output, target) loss.backward() optimizer.step() if batch_idx % args.log_interval == 0: print('Train Epoch: {} [{}/{} ({:.0f}%)]tLoss: {:.6f}'.format( epoch, batch_idx * len(data), len(train_loader.dataset), 100. * batch_idx / len(train_loader), loss.item())) if args.dry_run: breakTræn modellen

Nu hvor vi har sat vores miljø op og oprettet vores inputdatasæt og brugerdefinerede træningsscript, kan vi starte modeltræningen ved hjælp af SageMaker. Vi bruger PyTorch-estimatoren i SageMaker Python SDK til at starte et træningsjob på SageMaker. Vi sender de nødvendige parametre til estimatoren og kalder tilpasningsmetoden. Når vi kalder fit på PyTorch-estimatoren, starter SageMaker et træningsjob ved at bruge vores script som træningskode:

from sagemaker.pytorch import PyTorch output_location = f"s3://{bucket}/{prefix}/output"

print(f"training artifacts will be uploaded to: {output_location}") hyperparameters={ "batch-size": 100, "epochs": 1, "lr": 0.1, "gamma": 0.9, "log-interval": 100

} instance_type = "ml.c4.xlarge"

estimator = PyTorch( entry_point="train.py", source_dir="code", # directory of your training script role=execution_role, framework_version="1.13", py_version="py39", instance_type=instance_type, instance_count=1, volume_size=250, output_path=output_location, hyperparameters=hyperparameters

) estimator.fit(inputs = { 'training': f"{inputs}", 'testing': f"{inputs}"

})Eksporter den trænede model som en ONNX-model

Efter træningen er afsluttet, og vores model er gemt på den foruddefinerede placering i Amazon S3, eksporterer vi modellen til en ONNX-model ved hjælp af ONNX runtime.

Vi inkluderer koden til at eksportere vores model til ONNX i vores træningsscript for at køre efter træningen er afsluttet.

PyTorch eksporterer modellen til ONNX ved at køre modellen ved at bruge vores input og registrere et spor af operatører, der er brugt til at beregne outputtet. Vi bruger et tilfældigt input af den rigtige type med PyTorch torch.onnx.export funktion til at eksportere modellen til ONNX. Vi angiver også den første dimension i vores input som dynamisk, så vores model accepterer en variabel batch_size af input under inferens.

def export_to_onnx(model, model_dir, device): logger.info("Exporting the model to onnx.") dummy_input = torch.randn(1, 1, 28, 28).to(device) input_names = [ "input_0" ] output_names = [ "output_0" ] path = os.path.join(model_dir, 'mnist-pytorch.onnx') torch.onnx.export(model, dummy_input, path, verbose=True, input_names=input_names, output_names=output_names, dynamic_axes={'input_0' : {0 : 'batch_size'}, # variable length axes 'output_0' : {0 : 'batch_size'}})ONNX er et åbent standardformat for deep learning-modeller, der muliggør interoperabilitet mellem deep learning-rammer såsom PyTorch, Microsoft Cognitive Toolkit (CNTK) og mere. Det betyder, at du kan bruge enhver af disse rammer til at træne modellen og efterfølgende eksportere de fortrænede modeller i ONNX-format. Ved at eksportere modellen til ONNX får du fordelen af et bredere udvalg af implementeringsenheder og platforme.

Download og udtræk modelartefakter

ONNX-modellen, som vores træningsscript har gemt, er blevet kopieret af SageMaker til Amazon S3 på den outputplacering, som vi specificerede, da vi startede træningsjobbet. Modelartefakterne gemmes som en komprimeret arkivfil kaldet model.tar.gz. Vi downloader denne arkivfil til en lokal mappe i vores Studio notebook-instans og udtrækker modelartefakter, nemlig ONNX-modellen.

import tarfile local_model_file = 'model.tar.gz'

model_bucket,model_key = estimator.model_data.split('/',2)[-1].split('/',1)

s3 = boto3.client("s3")

s3.download_file(model_bucket,model_key,local_model_file) model_tar = tarfile.open(local_model_file)

model_file_name = model_tar.next().name

model_tar.extractall('.')

model_tar.close()Valider ONNX-modellen

ONNX-modellen eksporteres til en fil med navnet mnist-pytorch.onnx efter vores træningsscript. Efter at vi har downloadet og udtrukket denne fil, kan vi valgfrit validere ONNX-modellen ved hjælp af onnx.checker modul. Det check_model funktion i dette modul kontrollerer konsistensen af en model. Der gøres en undtagelse, hvis testen mislykkes.

import onnx onnx_model = onnx.load("mnist-pytorch.onnx")

onnx.checker.check_model(onnx_model)Pak modellen og slutningskoden

Til dette indlæg bruger vi .zip-implementering til Azure Functions. I denne metode pakker vi vores model, tilhørende kode og Azure Functions-indstillinger i en .zip-fil og udgiver den til Azure Functions. Følgende kode viser biblioteksstrukturen for vores implementeringspakke:

mnist-onnx├── function_app.py├── model│ └── mnist-pytorch.onnx└── requirements.txt

Liste afhængigheder

Vi angiver afhængighederne for vores slutningskode i requirements.txt fil i roden af vores pakke. Denne fil bruges til at bygge Azure Functions-miljøet, når vi udgiver pakken.

azure-functionsnumpyonnxruntime

Skriv slutningskode

Vi bruger Python til at skrive følgende inferenskode ved at bruge ONNX Runtime-biblioteket til at indlæse vores model og køre inferens. Dette instruerer Azure Functions-appen om at gøre slutpunktet tilgængeligt på /classify relativ vej.

import logging

import azure.functions as func

import numpy as np

import os

import onnxruntime as ort

import json app = func.FunctionApp() def preprocess(input_data_json): # convert the JSON data into the tensor input return np.array(input_data_json['data']).astype('float32') def run_model(model_path, req_body): session = ort.InferenceSession(model_path) input_data = preprocess(req_body) logging.info(f"Input Data shape is {input_data.shape}.") input_name = session.get_inputs()[0].name # get the id of the first input of the model try: result = session.run([], {input_name: input_data}) except (RuntimeError) as e: print("Shape={0} and error={1}".format(input_data.shape, e)) return result[0] def get_model_path(): d=os.path.dirname(os.path.abspath(__file__)) return os.path.join(d , './model/mnist-pytorch.onnx') @app.function_name(name="mnist_classify")

@app.route(route="classify", auth_level=func.AuthLevel.ANONYMOUS)

def main(req: func.HttpRequest) -> func.HttpResponse: logging.info('Python HTTP trigger function processed a request.') # Get the img value from the post. try: req_body = req.get_json() except ValueError: pass if req_body: # run model result = run_model(get_model_path(), req_body) # map output to integer and return result string. digits = np.argmax(result, axis=1) logging.info(type(digits)) return func.HttpResponse(json.dumps({"digits": np.array(digits).tolist()})) else: return func.HttpResponse( "This HTTP triggered function successfully.", status_code=200 )Implementer modellen til Azure Functions

Nu hvor vi har pakket koden i det påkrævede .zip-format, er vi klar til at udgive den til Azure Functions. Det gør vi ved hjælp af Azure CLI, et kommandolinjeværktøj til at oprette og administrere Azure-ressourcer. Installer Azure CLI med følgende kode:

!pip install -q azure-cliUdfør derefter følgende trin:

- Log ind på Azure:

!az login - Konfigurer parametrene for oprettelse af ressourcer:

import random random_suffix = str(random.randint(10000,99999)) resource_group_name = f"multicloud-{random_suffix}-rg" storage_account_name = f"multicloud{random_suffix}" location = "ukwest" sku_storage = "Standard_LRS" functions_version = "4" python_version = "3.9" function_app = f"multicloud-mnist-{random_suffix}" - Brug følgende kommandoer til at oprette Azure Functions-appen sammen med de nødvendige ressourcer:

!az group create --name {resource_group_name} --location {location} !az storage account create --name {storage_account_name} --resource-group {resource_group_name} --location {location} --sku {sku_storage} !az functionapp create --name {function_app} --resource-group {resource_group_name} --storage-account {storage_account_name} --consumption-plan-location "{location}" --os-type Linux --runtime python --runtime-version {python_version} --functions-version {functions_version} - Konfigurer Azure Functions, så når vi implementerer Functions-pakken,

requirements.txtfil bruges til at bygge vores applikationsafhængigheder:!az functionapp config appsettings set --name {function_app} --resource-group {resource_group_name} --settings @./functionapp/settings.json - Konfigurer Functions-appen til at køre Python v2-modellen og udfør en build på den kode, den modtager efter .zip-implementering:

{ "AzureWebJobsFeatureFlags": "EnableWorkerIndexing", "SCM_DO_BUILD_DURING_DEPLOYMENT": true } - Når vi har ressourcegruppen, lagerbeholderen og Functions-appen med den rigtige konfiguration, skal du udgive koden til Functions-appen:

!az functionapp deployment source config-zip -g {resource_group_name} -n {function_app} --src {function_archive} --build-remote true

Test modellen

Vi har implementeret ML-modellen til Azure Functions som en HTTP-trigger, hvilket betyder, at vi kan bruge Functions-appens URL til at sende en HTTP-anmodning til funktionen for at starte funktionen og køre modellen.

For at forberede inputtet skal du downloade testbilledfilerne fra SageMaker-eksempelfilen og forberede et sæt prøver til det format, som modellen kræver:

from torch.utils.data import DataLoader

from torchvision import datasets, transforms

import matplotlib.pyplot as plt transform=transforms.Compose( [transforms.ToTensor(), transforms.Normalize((0.1307,), (0.3081,))]

) test_dataset = datasets.MNIST(root='../data', download=True, train=False, transform=transform)

test_loader = DataLoader(test_dataset, batch_size=16, shuffle=True) test_features, test_labels = next(iter(test_loader))Brug anmodningsbiblioteket til at sende en postanmodning til inferensendepunktet med prøveinput. Inferensendepunktet har formatet som vist i følgende kode:

import requests, json def to_numpy(tensor): return tensor.detach().cpu().numpy() if tensor.requires_grad else tensor.cpu().numpy() url = f"https://{function_app}.azurewebsites.net/api/classify"

response = requests.post(url, json.dumps({"data":to_numpy(test_features).tolist()}) )

predictions = json.loads(response.text)['digits']Ryd op

Når du er færdig med at teste modellen, skal du slette ressourcegruppen sammen med de indeholdte ressourcer, inklusive lagerbeholderen og appen Funktioner:

!az group delete --name {resource_group_name} --yesDerudover anbefales det at lukke ledige ressourcer i SageMaker Studio for at reducere omkostningerne. For mere information, se Spar omkostninger ved automatisk at lukke ledige ressourcer i Amazon SageMaker Studio.

Konklusion

I dette indlæg viste vi, hvordan du kan bygge og træne en ML-model med SageMaker og implementere den til en anden cloud-udbyder. I løsningen brugte vi en SageMaker Studio notesbog, men til produktionsbelastninger anbefalede vi at bruge MLOps at skabe gentagelige træningsarbejdsgange for at fremskynde modeludvikling og implementering.

Dette indlæg viste ikke alle mulige måder at implementere og køre en model i et multicloud-miljø. For eksempel kan du også pakke din model ind i et containerbillede sammen med inferenskode og afhængighedsbiblioteker for at køre modellen som en containeriseret applikation på enhver platform. For mere information om denne tilgang, se Implementer containerapplikationer i et multicloud-miljø ved hjælp af Amazon CodeCatalyst. Hensigten med indlægget er at vise, hvordan organisationer kan bruge AWS AI/ML-kapaciteter i et multicloud-miljø.

Om forfatterne

Raja Vaidyanathan er en Solutions Architect hos AWS, der støtter globale finansielle servicekunder. Raja arbejder sammen med kunder om at udvikle løsninger på komplekse problemer med langsigtet positiv indvirkning på deres forretning. Han er en stærk ingeniør med ekspertise inden for IT-strategi, virksomhedsdatastyring og applikationsarkitektur, med særlige interesser i analyse og maskinlæring.

Raja Vaidyanathan er en Solutions Architect hos AWS, der støtter globale finansielle servicekunder. Raja arbejder sammen med kunder om at udvikle løsninger på komplekse problemer med langsigtet positiv indvirkning på deres forretning. Han er en stærk ingeniør med ekspertise inden for IT-strategi, virksomhedsdatastyring og applikationsarkitektur, med særlige interesser i analyse og maskinlæring.

Amandeep Bajwa er en Senior Solutions Architect hos AWS, der støtter finansielle servicevirksomheder. Han hjælper organisationer med at opnå deres forretningsresultater ved at identificere den passende cloud-transformationsstrategi baseret på branchetrends og organisatoriske prioriteter. Nogle af de områder, Amandeep rådgiver om, er cloud-migrering, cloud-strategi (herunder hybrid og multicloud), digital transformation, data og analyser og teknologi generelt.

Amandeep Bajwa er en Senior Solutions Architect hos AWS, der støtter finansielle servicevirksomheder. Han hjælper organisationer med at opnå deres forretningsresultater ved at identificere den passende cloud-transformationsstrategi baseret på branchetrends og organisatoriske prioriteter. Nogle af de områder, Amandeep rådgiver om, er cloud-migrering, cloud-strategi (herunder hybrid og multicloud), digital transformation, data og analyser og teknologi generelt.

Prema Iyer er Senior Technical Account Manager for AWS Enterprise Support. Hun arbejder med eksterne kunder på en række forskellige projekter og hjælper dem med at forbedre værdien af deres løsninger, når de bruger AWS.

Prema Iyer er Senior Technical Account Manager for AWS Enterprise Support. Hun arbejder med eksterne kunder på en række forskellige projekter og hjælper dem med at forbedre værdien af deres løsninger, når de bruger AWS.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/train-and-deploy-ml-models-in-a-multicloud-environment-using-amazon-sagemaker/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 10

- 100

- 13

- 25

- 28

- 32

- 7

- 9

- a

- Om

- fremskynde

- accepterer

- adgang

- Konto

- opnå

- erhvervede

- Fordel

- Efter

- AI

- AI / ML

- Alle

- tillader

- sammen

- allerede

- også

- Skønt

- Amazon

- Amazon SageMaker

- Amazon SageMaker lærred

- Amazon SageMaker Studio

- Amazon Web Services

- an

- Analytikere

- analytics

- ,

- anonym

- En anden

- enhver

- Apache

- app

- Anvendelse

- applikationer

- tilgang

- passende

- arkitektur

- Arkiv

- ER

- områder

- AS

- vurdering

- At

- automatisere

- automatisk

- til rådighed

- AWS

- AKSER

- Azure

- baseret

- BE

- været

- før

- begynde

- gavnlig

- gavner det dig

- Bedre

- mellem

- både

- bringe

- bredere

- bygge

- Bygning

- virksomhed

- men

- by

- ringe

- kaldet

- ringer

- CAN

- canvas

- kapaciteter

- bære

- tilfælde

- Kontrol

- klasse

- Klassificere

- klik

- Cloud

- kode

- kognitive

- kollaborativ

- selskab

- fuldføre

- komplekse

- Compliance

- omfattende

- Compute

- Konfiguration

- indeholdt

- Container

- Beholdere

- indeholder

- sammenhæng

- bekvemmelighed

- konvertere

- konvertering af

- Core

- Omkostninger

- kunne

- skabe

- oprettet

- Oprettelse af

- skabelse

- Legitimationsoplysninger

- skik

- Kunder

- data

- datastyring

- Dataforberedelse

- datalogi

- datasæt

- dyb

- dyb læring

- dybeste

- Standard

- definere

- definition

- demonstrere

- afhængigheder

- Afhængighed

- indsætte

- indsat

- implementering

- implementering

- beskrive

- detail

- detaljer

- Udvikling

- enhed

- Enheder

- forskellige

- digital

- Digital Transformation

- cifre

- Dimension

- drøftet

- do

- Docker

- domæne

- færdig

- Dont

- ned

- downloade

- i løbet af

- dynamisk

- e

- andet

- omfavne

- muliggør

- muliggør

- ende

- Endpoint

- Engineering

- Ingeniører

- Enterprise

- virksomheder

- Miljø

- epoke

- epoker

- Hver

- eksempel

- Undtagen

- undtagelse

- udførelse

- ekspertise

- eksport

- eksport

- ekstern

- ekstrakt

- mislykkes

- Funktionalitet

- få

- File (Felt)

- Filer

- finansielle

- finansielle tjenesteydelser

- Finde

- Fornavn

- passer

- efter

- Til

- format

- Foundation

- Framework

- rammer

- fra

- funktion

- funktioner

- Generelt

- genererer

- generative

- Generativ AI

- få

- Global

- globale finansielle

- gruppe

- Have

- he

- hjælpe

- hjælper

- Hosting

- Hvordan

- How To

- HTML

- http

- HTTPS

- Hybrid

- ID

- identificere

- tomgang

- if

- illustrerer

- billede

- billeder

- KIMOs Succeshistorier

- importere

- importere

- Forbedre

- forbedring

- in

- omfatter

- Herunder

- uafhængig

- industrien

- oplysninger

- initial

- indgang

- indgange

- installere

- instans

- anvisninger

- integrere

- integreret

- hensigt

- interesser

- grænseflade

- Interoperabilitet

- ind

- IT

- ITS

- Job

- Karriere

- jpg

- json

- Sprog

- stor

- seneste

- lanceringer

- LÆR

- læring

- Længde

- Leverage

- biblioteker

- Bibliotek

- livscyklus

- Line (linje)

- linux

- Liste

- belastning

- belastninger

- lokale

- lokalt

- placering

- logning

- langsigtet

- leder

- off

- maskine

- machine learning

- lave

- administrere

- lykkedes

- ledelse

- leder

- mange

- kort

- matplotlib

- Kan..

- midler

- Mød

- opfylder

- metode

- metoder

- microsoft

- måske

- migration

- ML

- MLOps

- tilstand

- model

- modeller

- Moduler

- mere

- mest

- navn

- Som hedder

- nemlig

- Behov

- behov

- behov

- netto

- netværk

- neurale

- neurale netværk

- notesbog

- bedøvet

- objekt

- of

- on

- ONE

- åbent

- open source

- drift

- Produktion

- Operatører

- Indstillinger

- or

- ordrer

- organisation

- organisatorisk

- organisationer

- OS

- Andet

- vores

- ud

- udfald

- output

- uden for

- egen

- pakke

- emballeret

- parameter

- parametre

- del

- særlig

- part

- passerer

- gennemløb

- sti

- Udfør

- Tilladelser

- perron

- Platforme

- plato

- Platon Data Intelligence

- PlatoData

- Populær

- positiv

- mulig

- Indlæg

- Forudsigelser

- forberedelse

- Forbered

- forudsætninger

- primære

- Main

- problemer

- Behandlet

- produktion

- produktivitet

- Produkter

- professionel

- projekter

- give

- forudsat

- udbyder

- giver

- offentlige

- offentliggøre

- Python

- pytorch

- Hurtig

- hævet

- tilfældig

- klar

- modtager

- anbefales

- optagelse

- reducere

- henvise

- Uanset

- region

- register

- relative

- gentagelig

- anmode

- anmodninger

- kræver

- påkrævet

- Krav

- ressource

- Ressourcer

- svar

- resultere

- resulterer

- afkast

- højre

- roller

- rod

- Kør

- kører

- løber

- sagemaker

- samme

- gemt

- Scale

- scanning

- scenarier

- Videnskab

- forskere

- script

- SDK

- sekundær

- Sektion

- sektioner

- sikkerhed

- se

- valg

- SELV

- send

- senior

- tjeneste

- Tjenester

- Session

- sæt

- indstillinger

- setup

- Shape

- hun

- bør

- Vis

- viste

- vist

- Shows

- Luk ned

- lukker ned

- Simpelt

- situationer

- faglært

- færdigheder

- So

- Software

- løsninger

- Løsninger

- nogle

- Kilde

- suverænitet

- specificeret

- Stage

- standard

- starte

- påbegyndt

- starter

- Steps

- opbevaring

- butik

- opbevaret

- Strategi

- String

- stærk

- struktur

- Studio

- Efterfølgende

- Succesfuld

- sådan

- support

- Støtte

- Understøtter

- Tag

- tager

- mål

- hold

- Teknisk

- Teknologier

- Teknologier

- ti

- tensorflow

- prøve

- afprøvet

- Test

- tekst

- at

- The Source

- deres

- Them

- selv

- derefter

- Disse

- de

- ting

- Tredje

- denne

- gange

- til

- toolkit

- værktøjer

- fakkel

- Torchvision

- Trace

- Tog

- uddannet

- Kurser

- Transform

- Transformation

- Transformationsstrategi

- transformationer

- Tendenser

- udløse

- udløst

- sand

- prøv

- typen

- enestående

- uploadet

- Uploading

- URL

- brug

- brug tilfælde

- anvendte

- Bruger

- bruger

- ved brug af

- nytte

- VALIDATE

- værdi

- variabel

- række

- leverandører

- versioner

- sårbarhed

- ønsker

- var

- måder

- we

- web

- webservices

- web-baseret

- GODT

- hvornår

- som

- vilje

- med

- inden for

- arbejdsgange

- virker

- skriver

- skriftlig

- X

- endnu

- Du

- Din

- zephyrnet

- Zip