Da Stable Diffusion, AI-applikationen, der gør fotorealistiske billeder optaget for et par uger siden, kom der et nyt buzzword med; hypernetværk.

Nu er allerede stabil diffusion og hypernetværk så sammenkædet, at det er umuligt at nævne det ene uden det andet i samme afsnit.

"Jeg har trænet stabile diffusionshypernetværk på små datasæt (nej, ikke nutidige kunstnere bortset fra din virkelig) for at lære det obskure "stile", som det ikke rigtig forstår ud af boksen. Det fungerer præcis som beskrevet, faktisk bedre end jeg selv troede det ville,” siger en bruger på twitter.

Jeg har trænet stabile diffusionshypernetværk på små datasæt (nej, ikke nutidige kunstnere bortset fra yours truly) for at lære det obskure "stile", som det ikke rigtig forstår ud af boksen. det virker præcis som han beskrev, faktisk bedre end jeg selv troede det ville.

— regret maximizer (@regretmaximizer) 20. December, 2022

Dette er indbegrebet af hypernetværkets buzz, der griber netbrugere på det seneste.

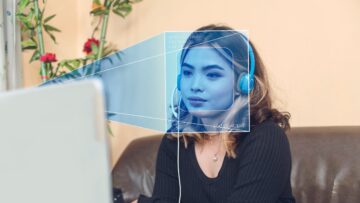

Inden for datalogi er et hypernetværk teknisk set et netværk, der genererer vægte til et hovednetværk. Med andre ord antages det, at hovednetværkets adfærd er den samme med andre neurale netværk, fordi det lærer at kortlægge nogle rå input til deres ønskede mål, mens hypernetværket tager et sæt input, der indeholder information om strukturen af vægtene og genererer vægten for det lag.

Læs også: AI-teknologi, der skaber livstruende dybe falske billeder

Hvordan bruges hypernetværk?

Lad os tage lidt backup for at forstå, hvad et hypernetværk er. Hvis du har lavet billeder på Stable Diffusion – AI-værktøjet til at skabe digital kunst og billeder – er du stødt på det.

Træning refererer generelt til en proces, hvor en model lærer (bestemmer) gode værdier for alle vægte og bias fra mærkede eksempler

Oprettelse af billeder på Stabil diffusion er ikke en automatisk proces, som vi har dækket andetsteds. For at nå dertil er der processer.

Først skal en AI-model lære at gengive eller syntetisere et billede af en person til et foto fra en 2D- eller 3D-model via software. Selvom stabil diffusionsmodellen blev grundigt testet, har den nogle træningsbegrænsninger, som kan korrigeres ved indlejring og hypernetværkstræningsmetoder.

For at opnå de bedste resultater kan slutbrugere vælge at lave yderligere træning for at finjustere generationsoutput, så de matcher mere specifikke brugssituationer. En "indlejring"-uddannelse involverer en samling af brugerleverede billeder og giver modellen mulighed for at skabe visuelt lignende billeder, når navnet på indlejringen bruges inden for en genereringsprompt.

Indlejringer er baseret på "tekstuel inversion"-konceptet udviklet af forskere fra Tel Aviv University, hvor vektorrepræsentationer for specifikke tokens, der bruges af modellens tekstkoder, er knyttet til nye pseudo-ord. Indlejring kan reducere skævheder i den originale model eller efterligne visuelle stilarter.

Et "hypernetværk" er på den anden side et fortrænet neuralt netværk, der anvendes til forskellige punkter i et større neuralt netværk, og refererer til teknikken skabt af NovelAI-udvikleren Kurumuz i 2021, oprindeligt beregnet til tekstgenereringstransformatormodeller .

Træner på specifikke kunstnere

Hypernetværk er inkluderet for at styre resultater i en bestemt retning, hvilket gør det muligt for stabile diffusionsbaserede modeller at replikere kunststile fra specifikke kunstnere. Netværket har den fordel, at det kan arbejde, selv når kunstneren ikke genkendes af den originale model og vil stadig behandle billedet ved at finde vigtige områder af betydning såsom hår og øjne, og derefter lappe disse områder i et sekundært latent rum.

"Indlejringslaget i Stable Diffusion er ansvarligt for at indkode inputs (for eksempel tekstprompten og klasseetiketter) til lavdimensionelle vektorer. Disse vektorer hjælper med at guide diffusionsmodellen til at producere billeder, der matcher brugerens input,” forklarer Benny Cheung i sin blog.

"Hypernetværkslaget er en måde for systemet at lære og repræsentere sin egen viden. Det giver Stable Diffusion mulighed for at skabe billeder baseret på dens tidligere erfaring."

Mens dets indlejringslag koder input, såsom tekstprompt og klasseetiketter til lavdimensionelle vektorer for at hjælpe med at guide diffusionsmodellen til at producere billeder, der matcher brugerens input, er hypernetværkslaget i nogen grad en måde for systemet at lære og repræsentere sit eget viden.

Med andre ord tillader det Stable Diffusion at skabe billeder baseret på dens tidligere erfaring. I Stable Diffussion er et hypernetværk et ekstra lag, der behandles efter et billede er blevet gengivet gennem modellen. Hypernetværket har en tendens til at skæve alle resultater fra modellen mod dine træningsdata på en måde, der i det væsentlige "ændrer" modellen.

Hukommelsesretention

Dette betyder i bund og grund, at hypernetværket er ansvarlig for hukommelsesopbevaring af billeder, som systemet tidligere har genereret. Når en bruger giver et nyt input, kan systemet bruge sin tidligere eksisterende viden til at skabe et mere præcist billede. Som sådan giver hypernetværk derfor systemet mulighed for at lære hurtigere og forbedre sig, efterhånden som det går.

Dette har den fordel, at hvert billede, der indeholder noget, der beskriver dine træningsdata, vil ligne dine træningsdata.

"Vi fandt ud af, at træning med indlejring er lettere end træning med et hypernetværk til at generere selvportrætter. Vores træning gav gode resultater, som vi er tilfredse med,” skrev Cheung.

Hvilken finjusteringsteknik bruger du? Noget som Hypernetværk eller Tekstinversion?

— Mathias Michel (@m91michel) 21. December, 2022

Men det er en teknologi, mange stadig prutter med. Hypernetværk og AI-generatorer er lige begyndt at imødekomme brugernes behov og ønsker. Brugergrænseflader og promptteknikker vil uden tvivl udvikle sig hurtigt og vil måske endda fange Google off-guard, som MetaNews for nylig dækket.

- AI

- ai kunst

- Bitcoin

- blockchain

- overholdelse af blockchain

- coinbase

- coingenius

- Konsensus

- kryptokonference

- krypto minedrift

- cryptocurrency

- decentral

- dybe forfalskninger

- Defi

- Digitale aktiver

- ethereum

- featured

- hypernetworks

- machine learning

- MetaNews

- ikke fungibelt symbol

- plato

- platon ai

- Platon Data Intelligence

- PlatoData

- platogaming

- Polygon

- bevis for indsatsen

- stabil-diffusion

- Teknologier

- W3

- zephyrnet