Introduktion

Værktøjerne til kunstig intelligens - især neurale netværk - har været gode for fysikere. I årevis har denne teknologi hjulpet forskere med at rekonstruere partikelbaner i acceleratoreksperimenter, søge efter beviser for nye partikler og opdage gravitationsbølger og exoplaneter. Mens AI-værktøjer tydeligvis kan gøre meget for fysikere, er spørgsmålet nu ifølge Max Tegmark, fysiker ved Massachusetts Institute of Technology,: "Kan vi give noget tilbage?"

Tegmark mener, at hans jævnaldrende fysikere kan yde væsentlige bidrag til videnskaben om kunstig intelligens, og han har gjort dette til sin højeste forskningsprioritet. En måde, fysikere kunne hjælpe med at fremme AI-teknologi på, sagde han, ville være at erstatte de "sorte boks"-algoritmer i neurale netværk, hvis virkemåde stort set er uudgrundelige, med velforståede ligninger af fysiske processer.

Ideen er ikke helt ny. Generative AI-modeller baseret på diffusion — den proces, der f.eks. får mælk hældt i en kop kaffe til at spredes ensartet — opstod først i 2015, og kvaliteten af de billeder, de genererer, er blevet væsentligt forbedret siden da. Denne teknologi driver populær billedproducerende software som DALL·E 2 og Midjourney. Nu er Tegmark og hans kolleger ved at lære, om andre fysik-inspirerede generative modeller kan fungere lige så godt som diffusionsbaserede modeller, eller endnu bedre.

I slutningen af sidste år introducerede Tegmarks team en lovende ny metode til fremstilling af billeder kaldet Poisson flow generativ model (PFGM). I den er data repræsenteret af ladede partikler, som kombineres for at skabe et elektrisk felt, hvis egenskaber afhænger af fordelingen af ladningerne på ethvert givet tidspunkt. Det kaldes en Poisson-flowmodel, fordi ladningers bevægelse er styret af Poisson-ligningen, som stammer fra princippet om, at den elektrostatiske kraft mellem to ladninger varierer omvendt med kvadratet på afstanden mellem dem (svarende til formuleringen af Newtons tyngdekraft) .

Den fysiske proces er kernen i PFGM. "Vores model kan karakteriseres næsten fuldstændigt af styrken og retningen af det elektriske felt på hvert punkt i rummet," sagde Yilun Xu, en kandidatstuderende ved MIT og medforfatter til papiret. "Hvad det neurale netværk lærer under træningsprocessen er, hvordan man estimerer det elektriske felt." Og på den måde kan den lære at skabe billeder, fordi et billede i denne model kort og præcist kan beskrives af et elektrisk felt.

Introduktion

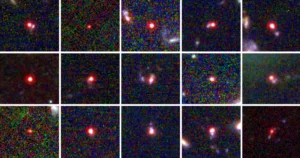

PFGM kan skabe billeder af samme kvalitet som dem, der er produceret ved diffusionsbaserede tilgange og gøre det 10 til 20 gange hurtigere. "Det bruger en fysisk konstruktion, det elektriske felt, på en måde, vi aldrig har set før," sagde Hananel Hazan, en datalog ved Tufts University. "Det åbner døren til muligheden for, at andre fysiske fænomener bliver udnyttet til at forbedre vores neurale netværk."

Diffusions- og Poisson-flowmodeller har meget til fælles, udover at de er baseret på ligninger importeret fra fysik. Under træning starter en diffusionsmodel designet til billedgenerering typisk med et billede - en hund, lad os sige - og tilføjer derefter visuel støj, der ændrer hver pixel på en tilfældig måde, indtil dens funktioner bliver grundigt indhyllet (dog ikke helt elimineret). Modellen forsøger derefter at vende processen og generere en hund, der er tæt på originalen. Når først den er trænet, kan modellen med succes skabe hunde - og andre billeder - startende fra et tilsyneladende tomt lærred.

Poisson flow-modeller fungerer stort set på samme måde. Under træning er der en fremadgående proces, som involverer tilføjelse af støj, trinvist, til et én gang skarpt billede, og en omvendt proces, hvor modellen forsøger at fjerne denne støj, trin for trin, indtil den oprindelige version for det meste er gendannet. Som med diffusionsbaseret generering lærer systemet til sidst at lave billeder, det aldrig har set under træning.

Men fysikken bag Poisson-modellerne er helt anderledes. Diffusion er drevet af termodynamiske kræfter, hvorimod Poisson flow er drevet af elektrostatiske kræfter. Sidstnævnte repræsenterer et detaljeret billede ved hjælp af et arrangement af ladninger, der kan skabe et meget kompliceret elektrisk felt. Det felt får dog ladningerne til at fordele sig mere jævnt over tid - ligesom mælk naturligt spredes i en kop kaffe. Resultatet er, at selve feltet bliver enklere og mere ensartet. Men dette støjfyldte uniformsfelt er ikke et fuldstændigt blankt tavle; den indeholder stadig kimen af information, hvorfra billeder let kan samles.

I begyndelsen af 2023 opgraderede holdet deres Poisson-model, forlænger den at omfatte en hel familie af modeller. Den udvidede version, PFGM++, indeholder en ny parameter, D, som giver forskere mulighed for at justere dimensionaliteten af systemet. Dette kan gøre en stor forskel: I velkendte tredimensionelle rum er styrken af det elektriske felt produceret af en ladning omvendt relateret til kvadratet på afstanden fra den ladning. Men i fire dimensioner følger feltstyrken en omvendt terninglov. Og for hver dimension af rummet, og enhver værdi af D, det forhold er noget anderledes.

Introduktion

Den eneste innovation gav Poisson flow-modeller langt større variation, hvor de ekstreme tilfælde gav forskellige fordele. Hvornår D er lav, for eksempel er modellen mere robust, hvilket betyder, at den er mere tolerant over for de fejl, der er lavet ved estimering af det elektriske felt. "Modellen kan ikke forudsige det elektriske felt perfekt," sagde Ziming Liu, en anden kandidatstuderende ved MIT og medforfatter til begge artikler. "Der er altid nogle afvigelser. Men robusthed betyder, at selvom din estimeringsfejl er høj, kan du stadig generere gode billeder." Så du ender måske ikke med din drømmehund, men du ender stadig med noget, der ligner en hund.

I den anden yderlighed, hvornår D er høj, bliver det neurale netværk lettere at træne, hvilket kræver mindre data for at mestre dets kunstneriske færdigheder. Den nøjagtige årsag er ikke nem at forklare, men den skyldes det faktum, at når der er flere dimensioner, har modellen færre elektriske felter at holde styr på - og dermed færre data at assimilere.

Den forbedrede model, PFGM++, "giver dig fleksibiliteten til at interpolere mellem disse to yderpunkter," sagde Rose Yu, en datalog ved University of California, San Diego.

Og et sted inden for dette område ligger en ideel værdi for D der rammer den rigtige balance mellem robusthed og nem træning, sagde Xu. "Et mål for det fremtidige arbejde vil være at finde ud af en systematisk måde at finde det søde sted, så vi kan udvælge den bedst mulige D for en given situation uden at ty til forsøg og fejl.”

Et andet mål for MIT-forskerne er at finde flere fysiske processer, der kan danne grundlag for nye familier af generative modeller. Gennem et projekt kaldet GenPhys, holdet har allerede identificeret en lovende kandidat: Yukawa-potentialet, som relaterer sig til den svage atomkraft. "Det er forskelligt fra Poisson-flow- og diffusionsmodeller, hvor antallet af partikler altid er bevaret," sagde Liu. "Yukawa-potentialet giver dig mulighed for at udslette partikler eller dele en partikel i to. En sådan model kan for eksempel simulere biologiske systemer, hvor antallet af celler ikke behøver at forblive det samme."

Dette kan være en frugtbar undersøgelseslinje, sagde Yu. "Det kan føre til nye algoritmer og nye generative modeller med potentielle applikationer, der strækker sig ud over billedgenerering."

Og PFGM++ alene har allerede overgået sine opfinderes oprindelige forventninger. De var først ikke klar over, hvornår D er indstillet til uendelig, bliver deres forstærkede Poisson-flowmodel ikke skelnelig fra en diffusionsmodel. Liu opdagede dette i beregninger, han udførte tidligere i år.

Mert Pilanci, en datalog ved Stanford University, betragter denne "forening" som det vigtigste resultat, der stammer fra MIT-gruppens arbejde. "PFGM++-papiret," sagde han, "afslører, at begge disse modeller er en del af en bredere klasse, [hvilket] rejser et spændende spørgsmål: Kan der være andre fysiske modeller for generativ AI, der afventer opdagelse, som antyder en endnu større forening? ”

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- BlockOffsets. Modernisering af miljømæssig offset-ejerskab. Adgang her.

- Kilde: https://www.quantamagazine.org/new-physics-inspired-generative-ai-exceeds-expectations-20230919/

- :har

- :er

- :ikke

- :hvor

- ][s

- $OP

- 10

- 20

- 2015

- 2023

- a

- accelerator

- Ifølge

- tilføje

- Tilføjer

- fremme

- AI

- AI modeller

- algoritmer

- tillader

- næsten

- alene

- allerede

- altid

- an

- ,

- En anden

- enhver

- noget

- applikationer

- tilgange

- ER

- arrangement

- kunstig

- kunstig intelligens

- kunstnerisk

- AS

- samlet

- At

- Forsøg på

- augmented

- afventer

- tilbage

- Balance

- baseret

- grundlag

- BE

- fordi

- bliver

- bliver

- været

- før

- være

- mener

- fordele

- udover

- BEDSTE

- Bedre

- mellem

- Beyond

- Big

- både

- bredere

- men

- by

- beregninger

- california

- kaldet

- CAN

- kandidat

- canvas

- gennemføres

- tilfælde

- årsager

- Celler

- kendetegnet

- afgift

- opladet

- afgifter

- klasse

- tydeligt

- Luk

- Medforfatter

- Kaffe

- kolleger

- kombinerer

- Fælles

- fuldføre

- fuldstændig

- kompliceret

- computer

- anser

- konstruere

- indeholder

- bidrag

- kunne

- skabe

- Kop

- data

- beskrevet

- konstrueret

- detaljeret

- opdage

- afvigelse

- DID

- Diego

- forskel

- forskellige

- Broadcasting

- Dimension

- størrelse

- retning

- opdaget

- opdagelse

- afstand

- fordeling

- do

- gør

- Dog

- gør

- Ved

- drømme

- drevet

- i løbet af

- hver

- tidligere

- Tidligt

- lette

- lettere

- let

- Elektrisk

- elimineret

- opstået

- Encompass

- ende

- forbedret

- Hele

- helt

- ligninger

- fejl

- fejl

- skøn

- Endog

- jævnt

- til sidst

- Hver

- bevismateriale

- eksempel

- overskredet

- overstiger

- forventninger

- eksperimenter

- Forklar

- strækker

- ekstrem

- ekstremer

- Faktisk

- bekendt

- familier

- familie

- langt

- hurtigere

- Funktionalitet

- færre

- felt

- Fields

- Figur

- finde

- Fornavn

- Fleksibilitet

- flow

- følger

- Til

- Tving

- Forces

- Videresend

- fire

- fra

- fremtiden

- gav

- generere

- generation

- generative

- Generativ AI

- GitHub

- Giv

- given

- mål

- godt

- reguleret

- eksamen

- gravitationel

- Tyngdekraftsbølger

- tyngdekraften

- større

- Gruppens

- Have

- he

- Hjerte

- hjælpe

- hjulpet

- dermed

- Høj

- hans

- Hvordan

- How To

- Men

- HTTPS

- idé

- ideal

- identificeret

- if

- billede

- billeder

- vigtigt

- Forbedre

- forbedret

- in

- omfatter

- Uendelighed

- oplysninger

- initial

- Innovation

- undersøgelse

- instans

- Institut

- Intelligens

- ind

- spændende

- introduceret

- IT

- ITS

- selv

- lige

- Holde

- vid udstrækning

- Efternavn

- Sidste år

- Lov

- føre

- LÆR

- læring

- mindre

- ligger

- Line (linje)

- Lot

- Lav

- lavet

- magasin

- lave

- Massachusetts

- Massachusetts Tekniske Institut

- Master

- max

- Kan..

- betyder

- midler

- metode

- MidJourney

- måske

- Mælk

- MIT

- model

- modeller

- øjeblik

- mere

- mest

- for det meste

- bevægelse

- meget

- netværk

- net

- neurale

- neurale netværk

- neurale netværk

- aldrig

- Ny

- Støj

- nu

- nukleare

- nummer

- of

- tilbyde

- on

- engang

- ONE

- åbner

- betjene

- or

- original

- Andet

- vores

- ud

- i løbet af

- Papir

- papirer

- parameter

- del

- særlig

- peers

- perfekt

- fysisk

- Fysik

- billede

- pixel

- plato

- Platon Data Intelligence

- PlatoData

- Punkt

- Populær

- Muligheden

- mulig

- potentiale

- beføjelser

- forudsige

- princippet

- prioritet

- behandle

- Processer

- produceret

- producerer

- projekt

- lovende

- egenskaber

- give

- kvalitet

- Quantamagazin

- spørgsmål

- rejser

- tilfældig

- rækkevidde

- let

- indse

- grund

- relaterede

- relation

- Fjern

- erstatte

- repræsenteret

- repræsenterer

- forskning

- forskere

- ligner i

- resultere

- vende

- højre

- robust

- robusthed

- Said

- samme

- San

- San Diego

- så

- siger

- Videnskab

- Videnskabsmand

- Søg

- frø

- tilsyneladende

- set

- sæt

- indhyllet

- signifikant

- betydeligt

- lignende

- enklere

- siden

- enkelt

- Situationen

- færdigheder

- Skifer

- So

- Software

- nogle

- noget

- noget

- et eller andet sted

- Space

- delt

- Spot

- spredes

- firkant

- Stanford

- Stanford University

- Starter

- starter

- angivelse

- forblive

- Trin

- Stadig

- styrke

- Strejker

- studerende

- Succesfuld

- sådan

- sød

- systemet

- Systemer

- hold

- Teknologier

- at

- deres

- Them

- derefter

- Der.

- Disse

- de

- denne

- i år

- grundigt

- dem

- selvom?

- tredimensionale

- Gennem

- tid

- gange

- til

- værktøjer

- top

- spor

- Tog

- uddannet

- Kurser

- retssag

- to

- typisk

- underliggende

- universitet

- University of California

- indtil

- opgraderet

- ved brug af

- udnytter

- værdi

- udgave

- meget

- bølger

- Vej..

- we

- WebP

- GODT

- hvornår

- ud fra følgende betragtninger

- hvorvidt

- som

- mens

- hvis

- vilje

- med

- inden for

- uden

- Arbejde

- arbejdssteder

- ville

- år

- år

- Du

- Din

- zephyrnet