Digitale udgivere leder løbende efter måder at strømline og automatisere deres mediearbejdsgange for at generere og udgive nyt indhold så hurtigt som de kan, men uden at gå på kompromis med kvaliteten.

Tilføjelse af billeder for at fange essensen af tekst kan forbedre læseoplevelsen. Maskinlæringsteknikker kan hjælpe dig med at opdage sådanne billeder. “Et slående billede er en af de mest effektive måder at fange publikums opmærksomhed og skabe engagement i din historie – men det skal også give mening".

forrige indlæg diskuteret, hvordan du kan bruge Amazons maskinlæringstjenester (ML) til at hjælpe dig med at finde de bedste billeder, der skal placeres langs en artikel eller tv-synopsis uden at indtaste nøgleord. I det forrige indlæg brugte du Amazon-anerkendelse at udtrække metadata fra et billede. Du brugte derefter en tekstindlejringsmodel til at generere en ordindlejring af metadataene, som senere kunne bruges til at hjælpe med at finde de bedste billeder.

I dette indlæg kan du se, hvordan du kan bruge Amazon Titan-fundamentmodeller til hurtigt at forstå en artikel og finde de bedste billeder, der skal ledsage den. Denne gang genererer du indlejringen direkte fra billedet.

Et nøglebegreb i semantisk søgning er indlejringer. En indlejring er en numerisk repræsentation af noget input – et billede, tekst eller begge dele – i form af en vektor. Når du har mange vektorer, kan du måle afstanden mellem dem, og vektorer, der er tæt på, er semantisk ens eller relaterede.

Amazonas grundfjeld er en fuldt administreret tjeneste, der tilbyder et udvalg af højtydende fundamentmodeller (FM'er) fra førende AI-virksomheder, herunder AI21 Labs, Anthropic, Cohere, Meta, Stability AI og Amazon med en enkelt API, sammen med et bredt sæt af muligheder til at hjælpe dig med at bygge generative AI-applikationer, forenkle udviklingen og samtidig bevare privatlivets fred og sikkerhed.

Amazon Titan har for nylig tilføjet en ny indlejringsmodel til sin kollektion, Titan Multimodal Embeddings. Denne nye model kan bruges til multimodal søgning, anbefalingssystemer og andre downstream-applikationer.

Multimodale modeller kan forstå og analysere data i flere modaliteter såsom tekst, billede, video og lyd. Denne seneste Amazon Titan-model kan acceptere tekst, billeder eller begge dele. Det betyder, at du bruger den samme model til at generere indlejringer af billeder og tekst og bruger disse indlejringer til at beregne, hvor ens de to er.

Overblik over løsningen

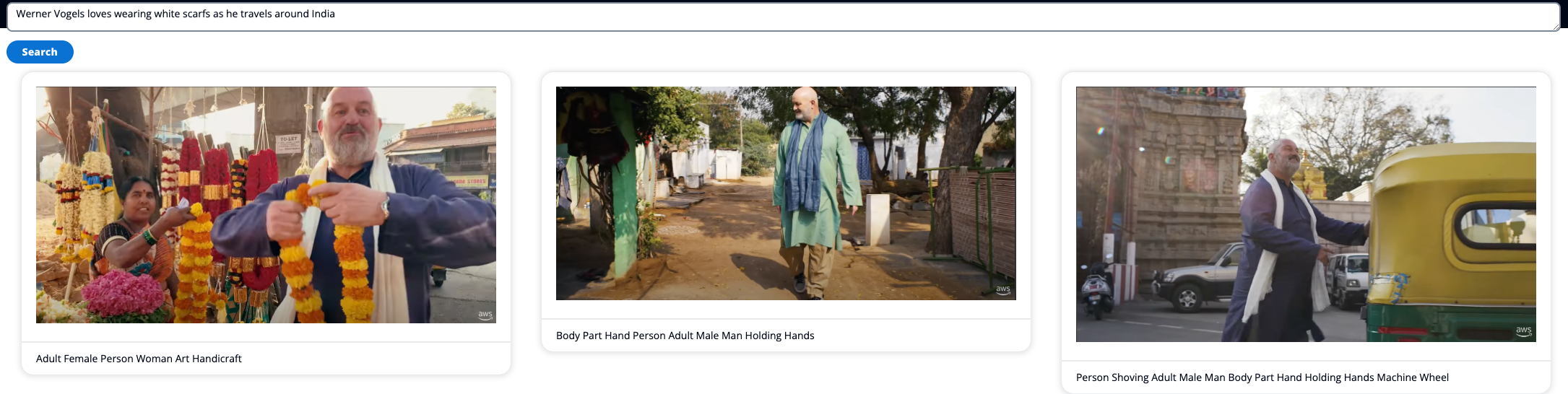

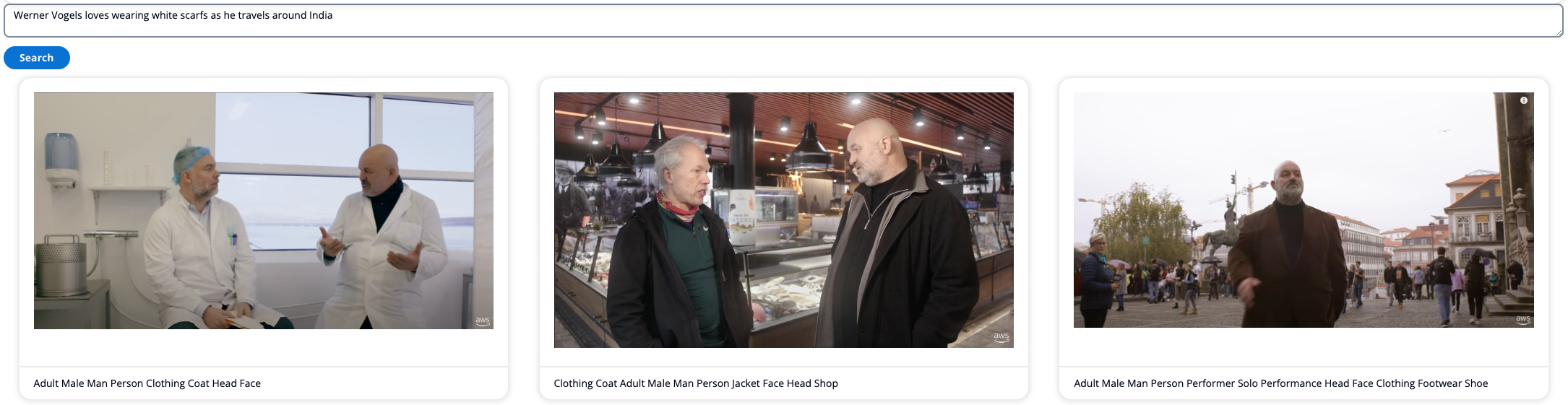

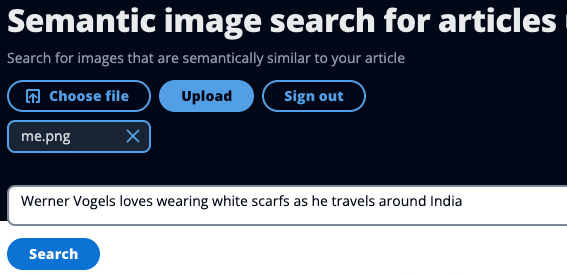

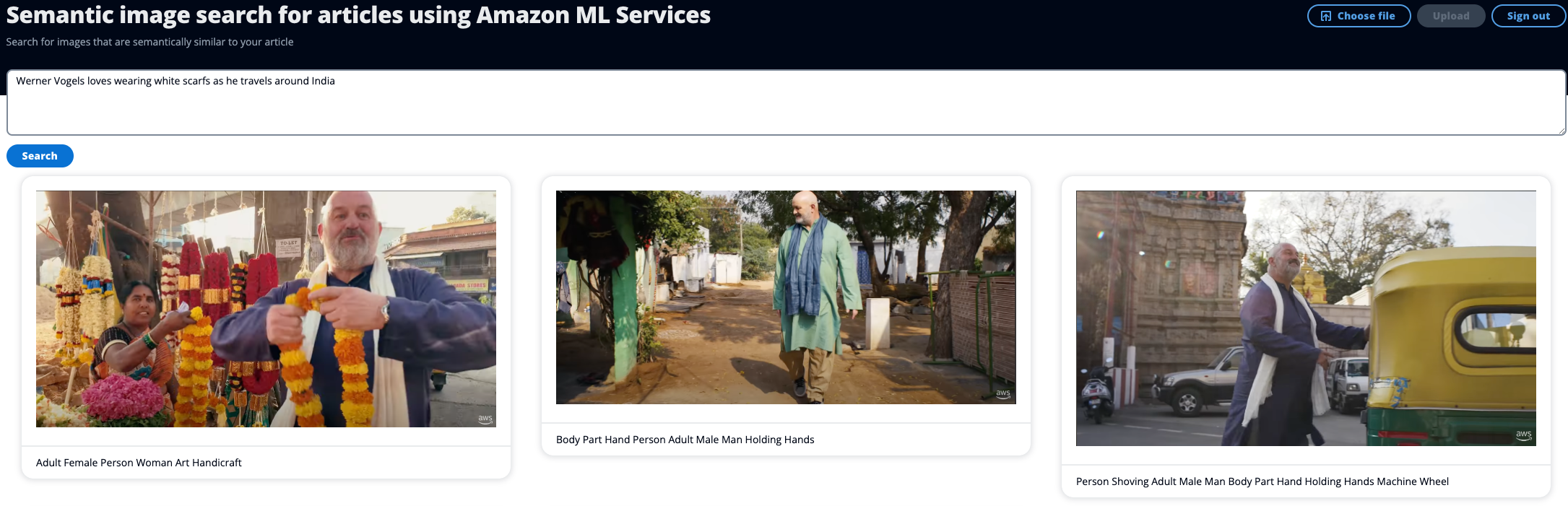

I det følgende skærmbillede kan du se, hvordan du kan tage en miniartikel, udføre en søgning og finde billeder, der passer til artiklen. I dette eksempel tager du en sætning, der beskriver Werner Vogels iført hvide tørklæder, mens han rejser rundt i Indien. Sætningens vektor er semantisk relateret til vektorerne af billederne af Werner iført et tørklæde og returneres derfor som de øverste billeder i denne søgning.

På et højt niveau uploades et billede til Amazon Simple Storage Service (Amazon S3) og metadata udtrækkes inklusive indlejring af billedet.

For at udtrække tekstlige metadata fra billedet, bruger du genkendelse af berømtheder og etiketdetektionsfunktion in Amazon-anerkendelse. Amazon Rekognition genkender automatisk titusindvis af velkendte personligheder i billeder og videoer ved hjælp af ML. Du bruger denne funktion til at genkende eventuelle berømtheder på billederne og gemme disse metadata Amazon OpenSearch Service. Etiketdetektion finder objekter og koncepter fra billedet, såsom det foregående skærmbillede, hvor du har etiketmetadataene under billedet.

Du bruger Titan Multimodal Embeddings model til at generere en indlejring af billedet, som også er søgbare metadata.

Alle metadata gemmes derefter i OpenSearch Service til senere søgeforespørgsler, når du skal finde et eller flere billeder.

Den anden del af arkitekturen er at indsende en artikel for at finde disse nyindtagne billeder.

Når artiklen er indsendt, skal du udtrække og transformere artiklen til et søgeinput for OpenSearch Service. Du bruger Amazon Comprehend at opdage eventuelle navne i teksten, der kunne være potentielle berømtheder. Du opsummerer artiklen, da du sandsynligvis kun vil vælge et eller to billeder for at fange essensen af artiklen. Generering af et resumé af teksten er en god måde at sikre sig, at indlejringen fanger de relevante punkter i historien. Til dette bruger du Amazon Titan Text G1 – Express model med en prompt som "Giv venligst et resumé af følgende tekst. Tilføj ikke oplysninger, der ikke er nævnt i teksten nedenfor." Med den opsummerede artikel bruger du Amazon Titan Multimodal Embeddings-modellen til at generere en indlejring af den opsummerede artikel. Indlejringsmodellen har også et maksimalt antal token-input, derfor er det endnu vigtigere at opsummere artiklen for at sikre, at du kan få så meget information fanget i indlejringen som muligt. Enkelt sagt er et token et enkelt ord, underord eller tegn.

Du udfører derefter en søgning mod OpenSearch Service med navnene og indlejringen fra artiklen for at hente billeder, der er semantisk ens med tilstedeværelsen af den givne berømthed, hvis den er til stede.

Som bruger søger du bare efter billeder ved at bruge en artikel som input.

Går igennem

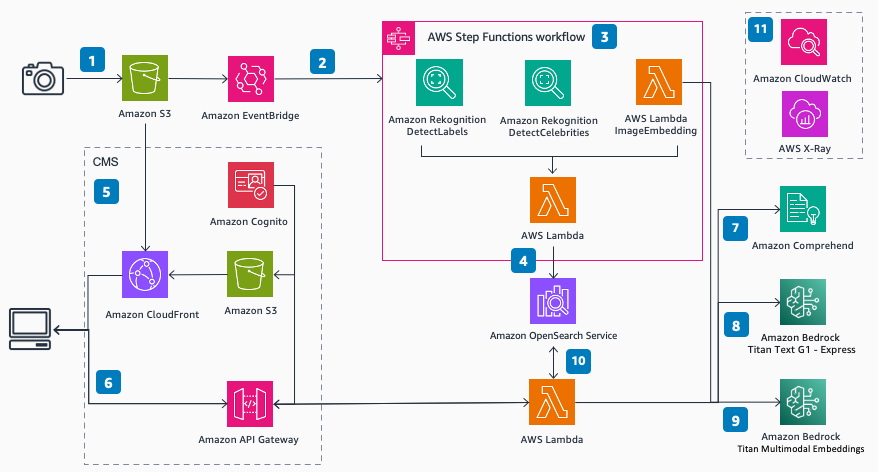

Følgende diagram viser dig arkitekturen til at levere denne use-case.

De følgende trin taler gennem rækkefølgen af handlinger (afbildet i diagrammet), der muliggør semantisk billed- og berømthedssøgning.

- Du uploader et billede til en Amazon S3 spand.

- Amazon Eventbridge lytter til denne begivenhed og starter derefter et AWS Step Functions-trin.

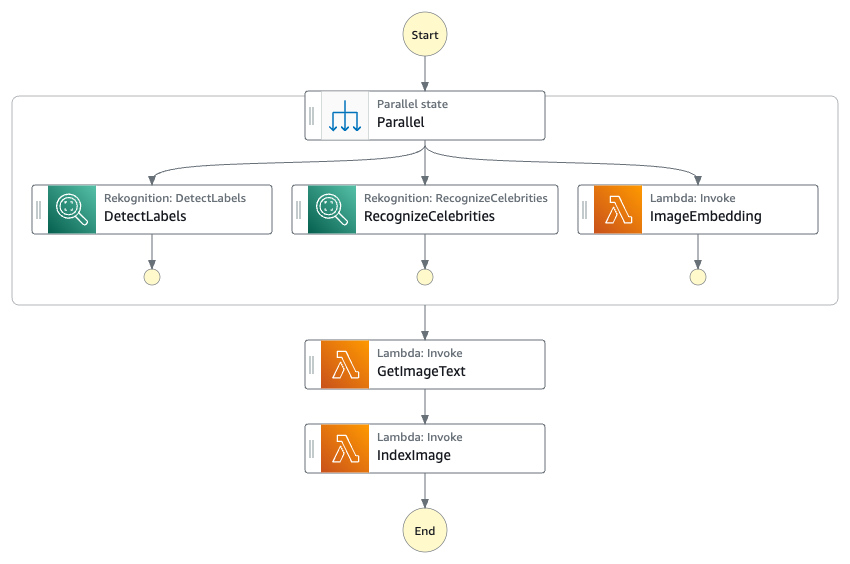

- Trinfunktioner-trinnet tager Amazon S3 billeddetaljer og kører tre parallelle handlinger:

- Et API-kald til Amazon-anerkendelse DetectLabels at udtrække objektmetadata

- Et API-kald til Amazon-anerkendelse Genkend Berømtheder API'er til at udtrække alle kendte berømtheder

- A AWS Lambda funktionen ændrer størrelsen på billedet til accepterede maksimale dimensioner for ML-indlejringsmodellen og genererer en indlejring direkte fra billedinputtet.

- Lambda funktionen indsætter derefter billedobjektets metadata og kendte navne, hvis de er til stede, og indlejringen som en k-NN-vektor i et OpenSearch Service-indeks.

- Amazon S3 vært for et simpelt statisk websted, distribueret af en Amazon CloudFront. Front-end brugergrænsefladen (UI) giver dig mulighed for at autentificere med applikationen ved hjælp af Amazon Cognito at søge efter billeder.

- Du indsender en artikel eller en tekst ved hjælp af brugergrænsefladen.

- En anden Lambda funktionskald Amazon Comprehend at opdage eventuelle navne i teksten som potentielle berømtheder.

- Funktionen opsummerer derefter teksten for at få de relevante pointer fra artiklen ved hjælp af Titan Text G1 – Express.

- Funktionen genererer en indlejring af den opsummerede artikel ved hjælp af Amazon Titan Multimodal Embeddings-modellen.

- Funktionen søger derefter i OpenSearch Service billedindeks for billeder, der matcher berømthedens navn og k-nærmeste naboer for vektoren ved hjælp af cosinus lighed ved brug af Præcis k-NN med scoring script.

- amazoncloudwatch , AWS røntgen give dig observerbarhed i end-to-end workflowet for at advare dig om eventuelle problemer.

Følgende figur viser dig den visuelle workflowdesigner af Step Functions-arbejdsgangen.

Her er et eksempel på en indlejring:

Den foregående række af tal er det, der fanger mening fra tekst- eller billedobjektet i en form, som du kan udføre beregninger og funktioner imod.

Indlejringer har høj dimensionalitet fra nogle få hundrede til mange tusinde dimensioner. Denne model har en dimensionalitet på 1,024, det vil sige, at den foregående matrix vil have 1,024 elementer, der fanger semantikken af det givne objekt.

Multimodal indlejring versus tekstindlejring

Vi diskuterer to muligheder for at levere semantisk billedsøgning, hvor den største forskel er, hvordan du genererer indlejring af billederne. I vores forrige indlæg, genererer du en indlejring fra tekstmetadata, som udtrækkes ved hjælp af Amazon Rekognition. I dette indlæg bruger du Titan Multimodal Embeddings-modellen, og kan generere en indlejring af billedet direkte.

Hvis du laver en hurtig test og kører en forespørgsel i brugergrænsefladen mod de to tilgange, kan du se, at resultaterne er mærkbart forskellige. Eksemplet på forespørgselsartiklen er "Werner Vogels elsker at bære hvide tørklæder, når han rejser rundt i Indien."

Resultatet fra den multimodale model scorer billederne med et tørklæde højere. Ordet halstørklæde er til stede i vores indsendte artikel, og det har indlejringen erkendt.

I brugergrænsefladen kan du se metadata udtrukket af Amazon Rekognition, og metadataene inkluderer ikke ordet tørklæde og har derfor savnet nogle oplysninger fra billedet, hvilket du kan antage, at billedindlejringsmodellen ikke har, og derfor den multimodale model kan have en fordel afhængigt af brugssituationen. Ved at bruge Amazon Rekognition kan du filtrere de objekter, der er registreret i billedet, før du opretter en indlejring, og har derfor andre anvendelige use cases, der måske fungerer bedre afhængigt af dit ønskede resultat.

Følgende figur viser resultaterne fra Amazon Titan Multimodal Embeddings-modellen.

Følgende figur viser resultaterne fra Amazon Titan-tekstindlejringsmodellen ved hjælp af Amazon Rekognition-ekstraherede metadata til at generere indlejringen.

Forudsætninger

For denne gennemgang skal du have følgende forudsætninger:

- An AWS-konto

- AWS Serverless Application Model Command Line Interface (AWS SAM CLI)

- Løsningen bruger AWS SAM CLI til implementering.

- Sørg for, at du bruger den nyeste version af AWS SAM CLI.

- Docker

- Løsningen bruger AWS SAM CLI-muligheden til at bygge inde i en container for at undgå behovet for lokale afhængigheder. Du skal bruge Docker til dette.

- Node

- Frontend for denne løsning er en React-webapplikation, der kan køres lokalt ved hjælp af Node.

- NPM

- Installationen af de pakker, der kræves for at køre webapplikationen lokalt, eller bygge den til fjernimplementering, kræver npm.

Byg og implementer fuld stack-applikationen

- Klon depotet

- Skift mappe til det nyligt klonede projekt.

- Kør npm install for at downloade alle de nødvendige pakker for at køre applikationen.

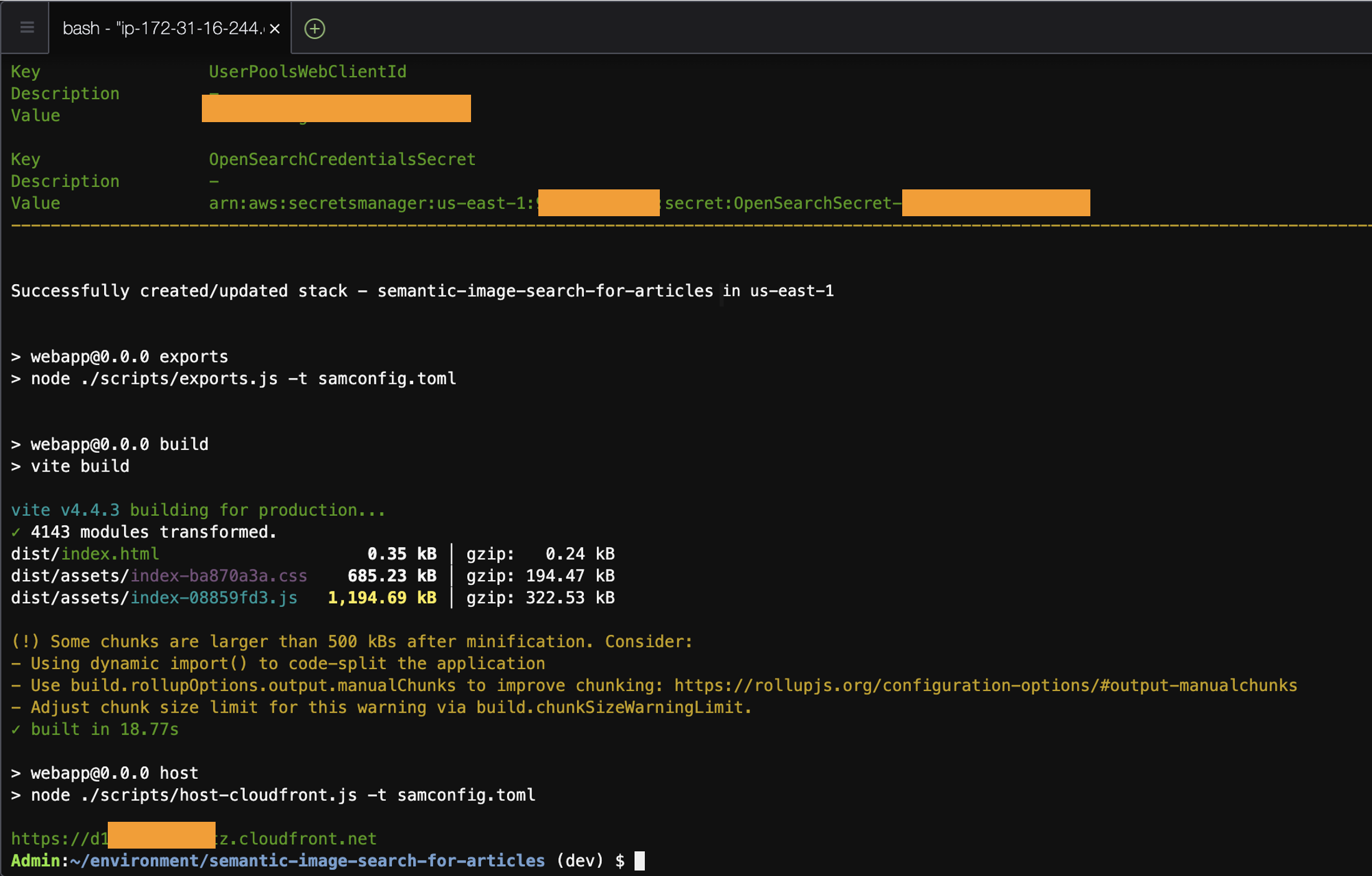

- Kør et implementeringsscript, der kører en række scripts i rækkefølge, der udfører en sam bygge, sam deploy, opdater konfigurationsfiler, og host derefter webapplikationsfilerne i Amazon S3 klar til visning gennem Amazon CloudFront

- Et af de endelige output fra scriptet er en Amazon CloudFront URL, som er, hvordan du får adgang til applikationen. Du skal oprette en ny bruger i AWS Management Console for at logge ind med. Noter URL'en til brug senere.

Følgende skærmbillede viser, hvordan scriptet har brugt AWS SAM til at implementere din stak og har udsendt en Amazon CloudFront URL, som du kan bruge til at få adgang til applikationen.

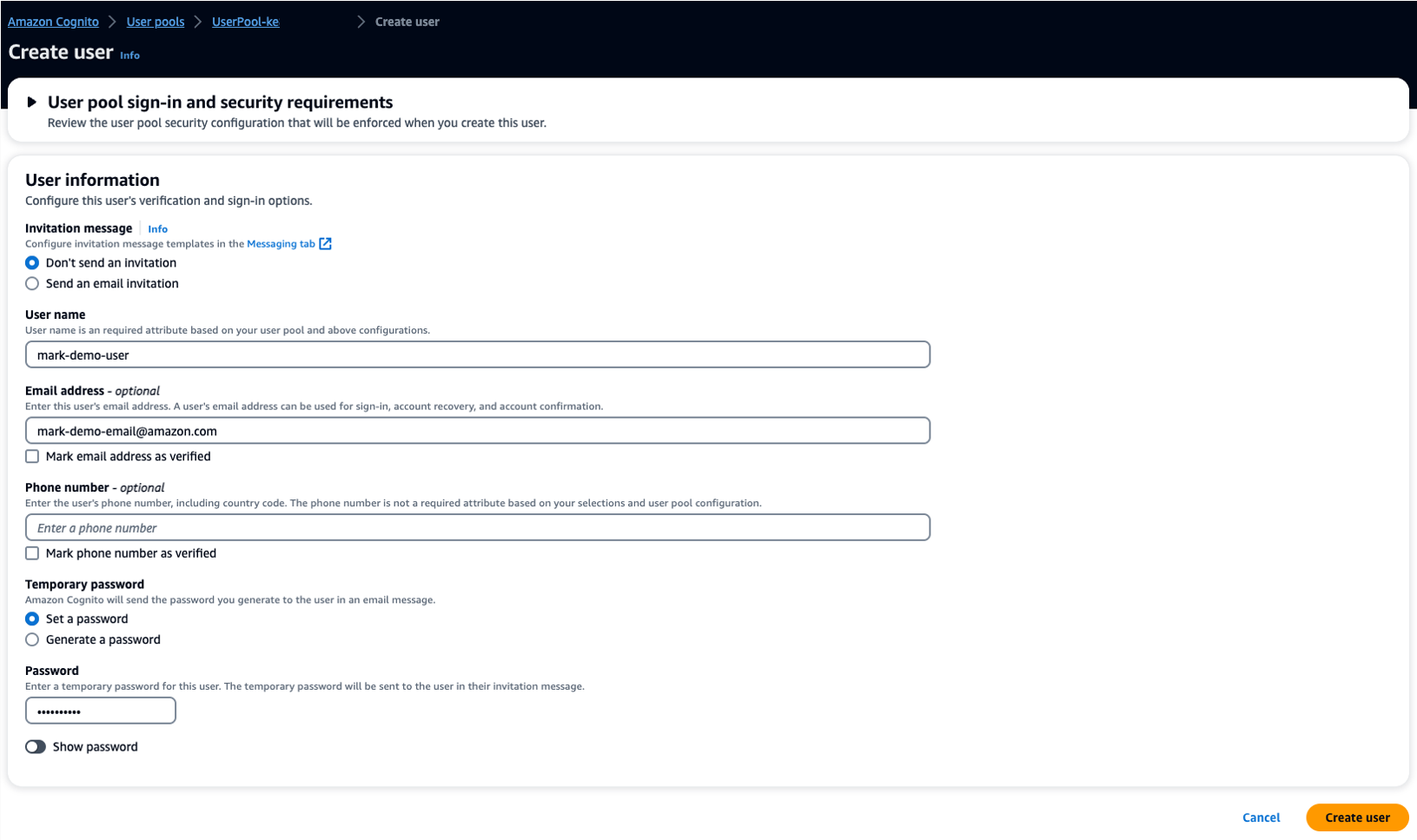

Opret en ny bruger for at logge ind på applikationen

- Gå til Amazon Cognito konsol og vælg din nye Brugerpulje.

- Opret en ny bruger med en ny adgangskode.

Log ind på og test webapplikationen

- Find Amazon CloudFront URL for at komme til login-siden. Dette udsendes i den sidste linje som vist på det foregående skærmbillede.

- Indtast dit nye brugernavn og din adgangskodekombination for at logge ind.

- Upload nogle eksempelbilleder ved hjælp af brugergrænsefladen.

- Vælg Vælg fil og vælg derefter Upload.

Bemærk: Du kan også uploade direkte til S3-bøtten i bulk ved at tilføje filer til /uploads mappe. - Skriv eller kopier og indsæt en artikel og vælg Indsend for at se om billederne returneres efter forventet ordre.

- Vælg Vælg fil og vælg derefter Upload.

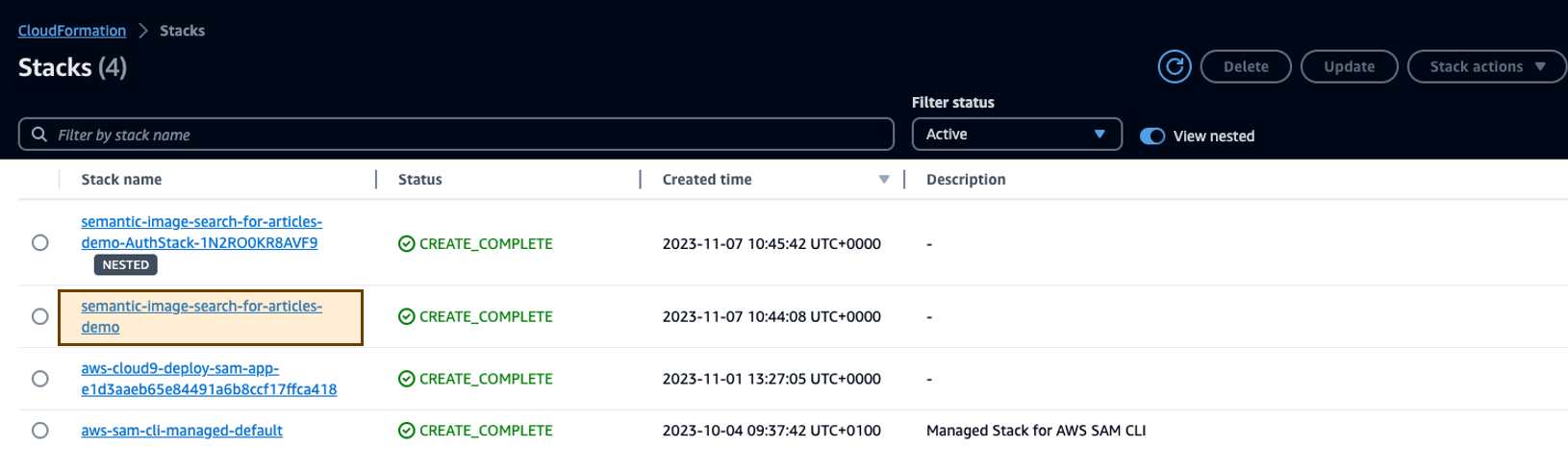

Gøre rent

Slet ressourcerne for at undgå fremtidige gebyrer.

- Find S3-spanden, der er installeret med denne løsning, og tøm spanden.

- Gå til CloudFormation-konsollen, vælg den stak, du implementerede gennem det tidligere nævnte implementeringsscript, og slet stakken.

Konklusion

I dette indlæg så du, hvordan du bruger Amazon Rekognition, Amazon Comprehend, Amazon Bedrock og OpenSearch Service til at udtrække metadata fra dine billeder og derefter bruge ML-teknikker til automatisk at opdage nært beslægtet indhold ved hjælp af berømtheder og semantisk søgning. Dette er især vigtigt inden for forlagsbranchen, hvor hastighed betyder noget for at få frisk indhold ud hurtigt og til flere platforme.

Som et næste trin skal du implementere løsningen på din AWS-konto og uploade nogle af dine egne billeder for at teste, hvordan semantisk søgning kan fungere for dig. Fortæl mig noget af din feedback i kommentarerne nedenfor.

Om forfatterne

Mark Watkins er en Solutions Architect inden for medie- og underholdningsteamet, der hjælper sine kunder med at løse mange data- og ML-problemer. Væk fra det professionelle liv elsker han at tilbringe tid med sin familie og se sine to små vokse op.

Mark Watkins er en Solutions Architect inden for medie- og underholdningsteamet, der hjælper sine kunder med at løse mange data- og ML-problemer. Væk fra det professionelle liv elsker han at tilbringe tid med sin familie og se sine to små vokse op.

Dan Johns er Solutions Architect Engineer, der støtter sine kunder med at bygge videre på AWS og levere på forretningskrav. Væk fra det professionelle liv elsker han at læse, tilbringe tid med sin familie og automatisere opgaver i deres hjem.

Dan Johns er Solutions Architect Engineer, der støtter sine kunder med at bygge videre på AWS og levere på forretningskrav. Væk fra det professionelle liv elsker han at læse, tilbringe tid med sin familie og automatisere opgaver i deres hjem.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/easily-build-semantic-image-search-using-amazon-titan/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 100

- 24

- 7

- a

- Acceptere

- accepteret

- adgang

- ledsage

- Konto

- aktioner

- tilføje

- tilføjet

- tilføje

- Fordel

- mod

- AI

- Alert

- Alle

- tillader

- sammen

- også

- Amazon

- Amazon Comprehend

- Amazon maskinindlæring

- Amazon-anerkendelse

- Amazon Web Services

- an

- analysere

- ,

- Antropisk

- enhver

- api

- API'er

- anvendelig

- Anvendelse

- applikationer

- tilgange

- arkitektur

- ER

- omkring

- Array

- artikel

- AS

- antage

- opmærksomhed

- lyd

- autentificere

- automatisere

- automatisk

- Automatisering

- undgå

- væk

- AWS

- AWS Management Console

- AWS-trinfunktioner

- BE

- før

- jf. nedenstående

- BEDSTE

- Bedre

- mellem

- både

- bred

- bygge

- virksomhed

- men

- by

- beregne

- beregninger

- ringe

- Opkald

- CAN

- Kan få

- kapaciteter

- fange

- fanget

- fanger

- Optagelse

- tilfælde

- tilfælde

- berømtheder

- Celebrity

- karakter

- afgifter

- valg

- Vælg

- Luk

- nøje

- CO

- samling

- kombination

- kommentarer

- Virksomheder

- forstå

- Konceptet

- begreber

- Konfiguration

- Konsol

- Container

- indhold

- kontinuerligt

- kunne

- skabe

- Oprettelse af

- Kunder

- data

- levere

- leverer

- afhængigheder

- Afhængigt

- indsætte

- indsat

- implementering

- Designer

- ønskes

- detaljer

- opdage

- opdaget

- Detektion

- Udvikling

- forskel

- forskellige

- størrelse

- direkte

- direkte

- opdage

- diskutere

- drøftet

- afstand

- distribueret

- do

- Docker

- Er ikke

- downloade

- nemt

- Effektiv

- elementer

- indlejring

- muliggøre

- ende

- ende til ende

- engagement

- ingeniør

- Underholdning

- Essensen

- Endog

- begivenhed

- eksempel

- forventet

- erfaring

- Express

- ekstrakt

- familie

- Feature

- tilbagemeldinger

- få

- Figur

- Filer

- filtrere

- endelige

- Finde

- fund

- efter

- Til

- formular

- Foundation

- frisk

- fra

- forsiden

- forreste ende

- fuld

- Fuld stak

- fuldt ud

- funktion

- funktioner

- fremtiden

- g1

- generere

- genererer

- generere

- generative

- Generativ AI

- få

- få

- Giv

- given

- godt

- Dyrkning

- Have

- he

- hjælpe

- dermed

- Høj

- højtydende

- højere

- hans

- Home

- host

- værter

- Hvordan

- How To

- HTML

- HTTPS

- hundrede

- if

- billede

- Billedsøgning

- billeder

- vigtigt

- Forbedre

- in

- omfatter

- Herunder

- indeks

- Indien

- industrien

- oplysninger

- Indleder

- indgang

- Indsætter

- indvendig

- installere

- installation

- grænseflade

- ind

- spørgsmål

- IT

- ITS

- journalistik

- jpg

- lige

- Nøgle

- søgeord

- Kend

- kendt

- etiket

- Labs

- senere

- seneste

- førende

- læring

- lad

- Niveau

- Livet

- Sandsynlig

- Line (linje)

- lytter

- lidt

- lokale

- lokalt

- leder

- elsker

- maskine

- machine learning

- Main

- Vedligeholdelse

- lave

- lykkedes

- ledelse

- mange

- matchende

- Matters

- maksimal

- me

- betyder

- midler

- måle

- Medier

- nævnte

- Meta

- Metadata

- måske

- savnet

- ML

- model

- modeller

- mere

- mest

- meget

- flere

- skal

- navn

- navne

- Behov

- Ny

- nyligt

- næste

- node

- Bemærk

- mærkbart

- numre

- objekt

- objekter

- of

- Tilbud

- on

- ONE

- dem

- kun

- Option

- Indstillinger

- or

- ordrer

- Andet

- vores

- ud

- Resultat

- output

- udgange

- egen

- pakker

- side

- Parallel

- del

- især

- Adgangskode

- Udfør

- Personligheder

- plukke

- Platforme

- plato

- Platon Data Intelligence

- PlatoData

- punkter

- mulig

- Indlæg

- potentiale

- forudsætninger

- tilstedeværelse

- præsentere

- tidligere

- tidligere

- Beskyttelse af personlige oplysninger

- Privatliv og sikkerhed

- problemer

- professionel

- projekt

- give

- offentliggøre

- udgivere

- Publicering

- kvalitet

- forespørgsler

- Hurtig

- hurtigt

- hurtigt

- Reagerer

- Læsning

- klar

- for nylig

- anerkendelse

- genkende

- anerkendt

- anerkender

- Anbefaling

- relaterede

- fjern

- Repository

- repræsentation

- kræver

- påkrævet

- Krav

- Resonator

- Ressourcer

- resultere

- Resultater

- Kør

- kører

- løber

- Sam

- samme

- så

- halstørklæde

- scoring

- script

- scripts

- Søg

- søgninger

- søgning

- Anden

- sikkerhed

- se

- Vælg

- semantik

- dømme

- Sequence

- Series

- Serverless

- tjeneste

- Tjenester

- servering

- sæt

- vist

- Shows

- underskrive

- lignende

- Simpelt

- forenkle

- enkelt

- løsninger

- Løsninger

- SOLVE

- nogle

- hastighed

- udgifterne

- Stabilitet

- stable

- Stakke

- statisk

- Trin

- Steps

- opbevaring

- butik

- opbevaret

- Historie

- strømline

- indsende

- indsendt

- sådan

- opsummere

- RESUMÉ

- Støtte

- sikker

- synopsis

- Systemer

- Tag

- tager

- Tal

- opgaver

- hold

- teknikker

- tiere

- vilkår

- prøve

- Test

- tekst

- tekstmæssige

- at

- deres

- Them

- derefter

- derfor

- Disse

- de

- denne

- dem

- tusinder

- tre

- Gennem

- tid

- titan

- til

- token

- top

- Transform

- rejser

- tv

- to

- ui

- forstå

- Opdatering

- uploadet

- URL

- brug

- brug tilfælde

- anvendte

- Bruger

- Brugergrænseflade

- bruger

- ved brug af

- udgave

- versus

- video

- Videoer

- visuel

- går igennem

- ser

- Vej..

- måder

- web

- Webapplikation

- webservices

- Hjemmeside

- Kendt

- Hvad

- hvornår

- som

- mens

- hvid

- Wikipedia

- vilje

- med

- inden for

- uden

- ord

- Arbejde

- workflow

- arbejdsgange

- Du

- Din

- zephyrnet