Dataforberedelse er et kritisk trin i ethvert datadrevet projekt, og at have de rigtige værktøjer kan i høj grad øge den operationelle effektivitet. Amazon SageMaker Data Wrangler reducerer den tid, det tager at samle og forberede tabel- og billeddata til maskinlæring (ML) fra uger til minutter. Med SageMaker Data Wrangler kan du forenkle processen med dataforberedelse og funktionsudvikling og fuldføre hvert trin i dataforberedelsesworkflowet, inklusive datavalg, rensning, udforskning og visualisering fra en enkelt visuel grænseflade.

I dette indlæg udforsker vi de nyeste funktioner i SageMaker Data Wrangler, der er specielt designet til at forbedre driftsoplevelsen. Vi dykker ned i støtten til Enkel opbevaringsservice (Amazon S3) manifest filer, inferensartefakter i et interaktivt dataflow og den sømløse integration med JSON (JavaScript Object Notation) format for inferens, der fremhæver, hvordan disse forbedringer gør dataforberedelse nemmere og mere effektivt.

Introduktion af nye funktioner

I dette afsnit diskuterer vi SageMaker Data Wranglers nye funktioner til optimal dataforberedelse.

S3-manifestfilunderstøttelse med SageMaker Autopilot til ML-inferens

SageMaker Data Wrangler muliggør en samlet dataforberedelse og modeltræning erfaring med Amazon SageMaker Autopilot med få klik. Du kan bruge SageMaker Autopilot til automatisk at træne, tune og implementere modeller på de data, du har transformeret i dit dataflow.

Denne oplevelse er nu yderligere forenklet med S3-manifestfilunderstøttelse. En S3-manifestfil er en tekstfil, der viser de objekter (filer), der er gemt i en S3-bøtte. Hvis dit eksporterede datasæt i SageMaker Data Wrangler er ret stort og opdelt i datafiler i flere dele i Amazon S3, vil SageMaker Data Wrangler nu automatisk oprette en manifestfil i S3, der repræsenterer alle disse datafiler. Denne genererede manifestfil kan nu bruges sammen med SageMaker Autopilot UI i SageMaker Data Wrangler til at hente alle de partitionerede data til træning.

Før denne funktion lanceres, når du bruger SageMaker Autopilot-modeller trænet på forberedte data fra SageMaker Data Wrangler, kunne du kun vælge én datafil, som muligvis ikke repræsenterer hele datasættet, især hvis datasættet er meget stort. Med denne nye manifestfiloplevelse er du ikke begrænset til en delmængde af dit datasæt. Du kan bygge en ML-model med SageMaker Autopilot, der repræsenterer alle dine data ved hjælp af manifestfilen og bruge den til din ML-inferens og produktionsimplementering. Denne funktion forbedrer driftseffektiviteten ved at forenkle træning af ML-modeller med SageMaker Autopilot og strømline databehandlingsarbejdsgange.

Tilføjet understøttelse af inferensflow i genererede artefakter

Kunder ønsker at tage de datatransformationer, de har anvendt på deres modeltræningsdata, såsom one-hot encoding, PCA og imputere manglende værdier, og anvende disse datatransformationer til realtidsslutning eller batchslutning i produktionen. For at gøre det skal du have en SageMaker Data Wrangler-inferensartefakt, som forbruges af en SageMaker-model.

Tidligere kunne inferensartefakter kun genereres fra brugergrænsefladen ved eksport til SageMaker Autopilot-træning eller eksport af en inferenspipeline-notesbog. Dette gav ikke fleksibilitet, hvis du ville tage dine SageMaker Data Wrangler-flows uden for Amazon SageMaker Studio miljø. Nu kan du generere en slutningsartefakt for enhver kompatibel flowfil gennem et SageMaker Data Wrangler-behandlingsjob. Dette muliggør programmatiske, ende-til-ende MLOps med SageMaker Data Wrangler-flows for kode-første MLOps-personas, såvel som en intuitiv, kodefri sti til at få en slutningsartefakt ved at oprette et job fra brugergrænsefladen.

Strømlining af dataforberedelse

JSON er blevet et bredt anvendt format til dataudveksling i moderne dataøkosystemer. SageMaker Data Wranglers integration med JSON-format giver dig mulighed for problemfrit at håndtere JSON-data til transformation og rengøring. Ved at levere indbygget support til JSON forenkler SageMaker Data Wrangler processen med at arbejde med strukturerede og semistrukturerede data, så du kan udtrække værdifuld indsigt og forberede data effektivt. SageMaker Data Wrangler understøtter nu JSON-format til både batch- og realtids-slutpunktsimplementering.

Løsningsoversigt

Til vores use case bruger vi prøven Amazon kundeanmeldelser datasæt for at vise, hvordan SageMaker Data Wrangler kan forenkle den operationelle indsats for at bygge en ny ML-model ved hjælp af SageMaker Autopilot. Amazon kundeanmeldelser-datasættet indeholder produktanmeldelser og metadata fra Amazon, inklusive 142.8 millioner anmeldelser, der spænder fra maj 1996 til juli 2014.

På et højt niveau bruger vi SageMaker Data Wrangler til at administrere dette store datasæt og udføre følgende handlinger:

- Udvikl en ML-model i SageMaker Autopilot ved at bruge hele datasættet, ikke kun et eksempel.

- Byg en inferenspipeline i realtid med inferensartefakten genereret af SageMaker Data Wrangler, og brug JSON-formatering til input og output.

S3-manifestfilunderstøttelse med SageMaker Autopilot

Når du opretter et SageMaker Autopilot-eksperiment ved hjælp af SageMaker Data Wrangler, kunne du tidligere kun angive en enkelt CSV- eller Parket-fil. Nu kan du også bruge en S3-manifestfil, så du kan bruge store mængder data til SageMaker Autopilot-eksperimenter. SageMaker Data Wrangler vil automatisk partitionere inputdatafiler i flere mindre filer og generere et manifest, der kan bruges i et SageMaker Autopilot-eksperiment til at hente alle data fra den interaktive session, ikke kun en lille prøve.

Udfør følgende trin:

- Importer Amazons kundeanmeldelsesdata fra en CSV-fil til SageMaker Data Wrangler. Sørg for at deaktivere sampling, når du importerer dataene.

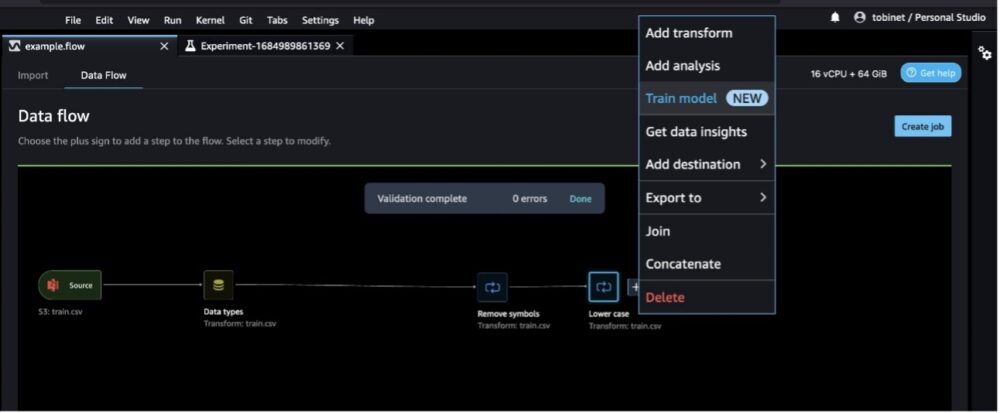

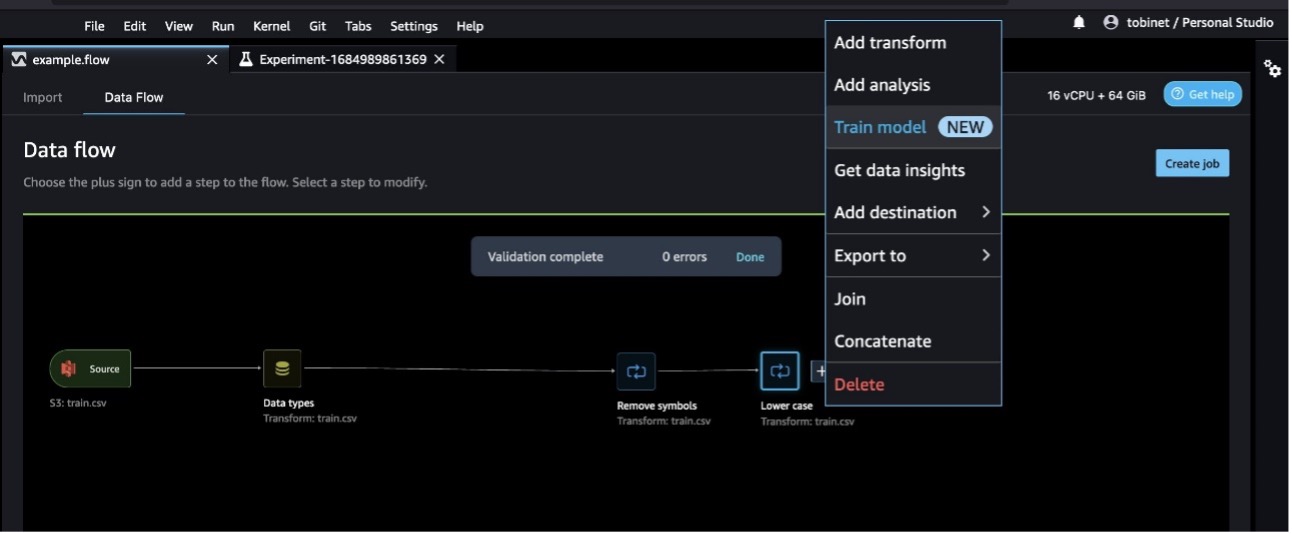

- Angiv de transformationer, der normaliserer dataene. I dette eksempel skal du fjerne symboler og omdanne alt til små bogstaver ved hjælp af SageMaker Data Wranglers indbyggede transformationer.

- Vælg Tog model at begynde at træne.

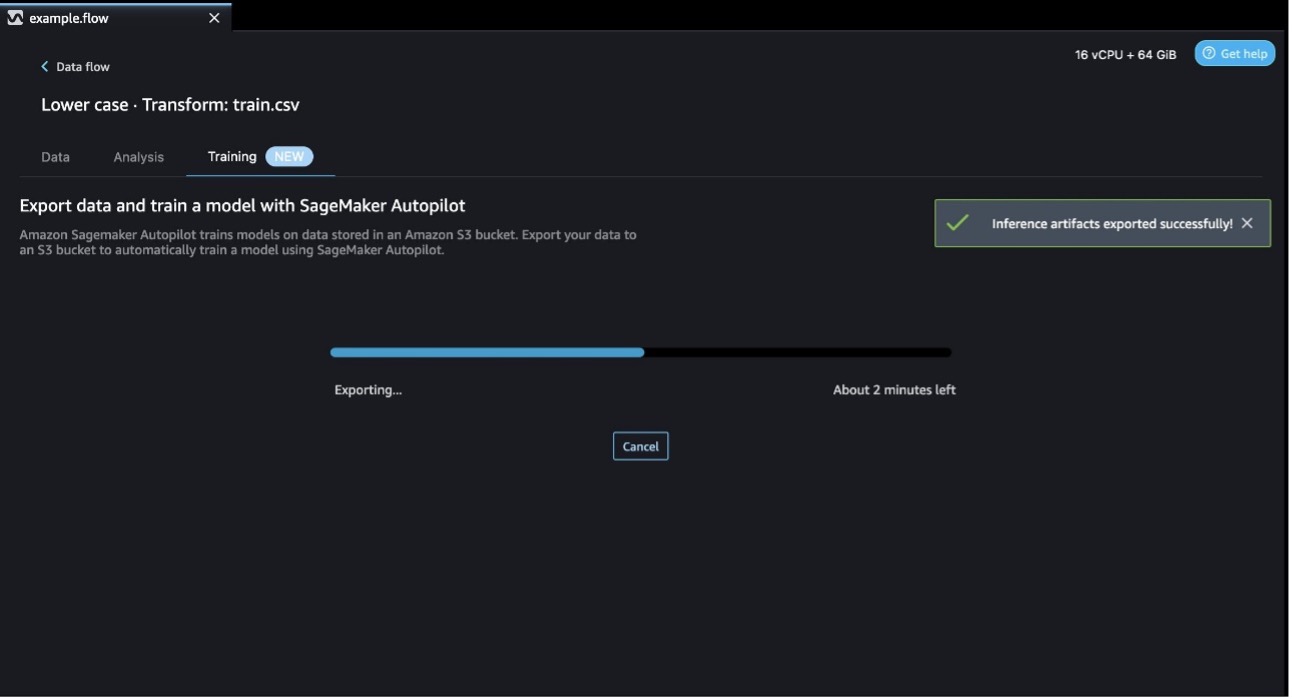

For at træne en model med SageMaker Autopilot eksporterer SageMaker automatisk data til en S3-spand. For store datasæt som denne vil den automatisk opdele filen i mindre filer og generere et manifest, der inkluderer placeringen af de mindre filer.

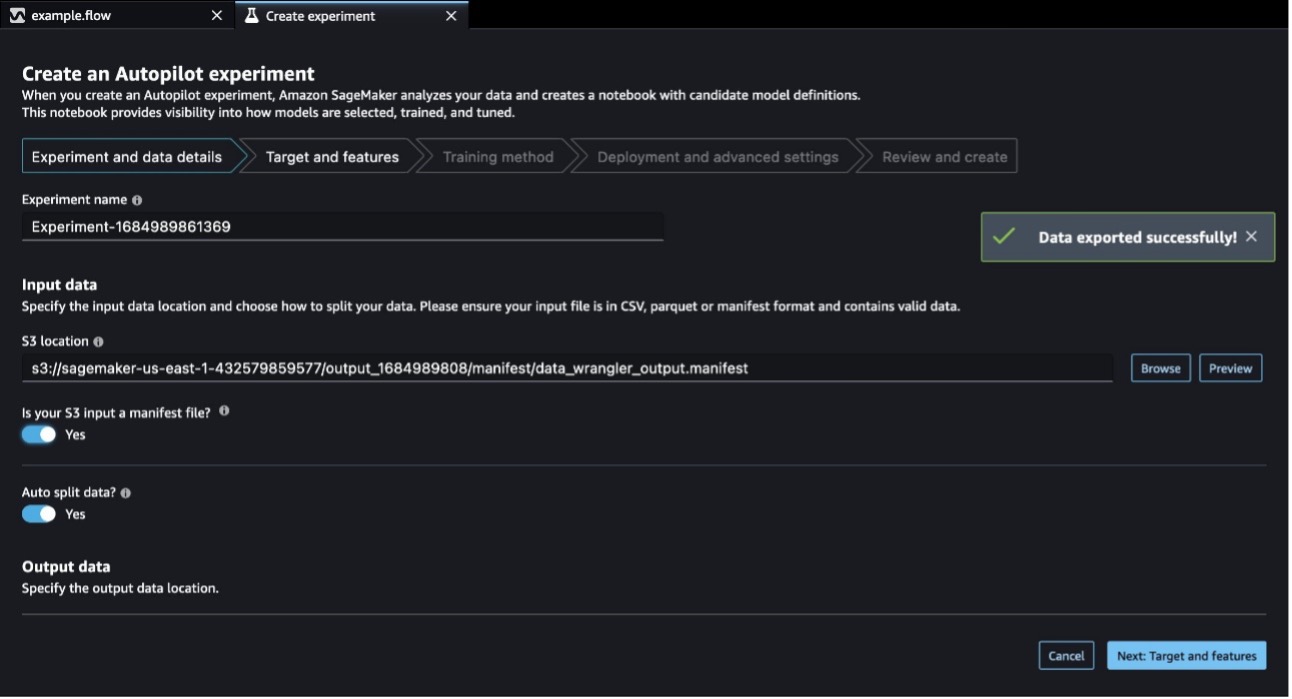

- Først skal du vælge dine inputdata.

Tidligere havde SageMaker Data Wrangler ikke mulighed for at generere en manifestfil til brug med SageMaker Autopilot. I dag, med frigivelsen af manifestfilsupport, vil SageMaker Data Wrangler automatisk eksportere en manifestfil til Amazon S3, forudfylde S3-placeringen af SageMaker Autopilot-træningen med manifestfilen S3-placering og skifte manifestfilindstillingen til Ja. Intet arbejde er nødvendigt for at generere eller bruge manifestfilen.

- Konfigurer dit eksperiment ved at vælge målet, som modellen skal forudsige.

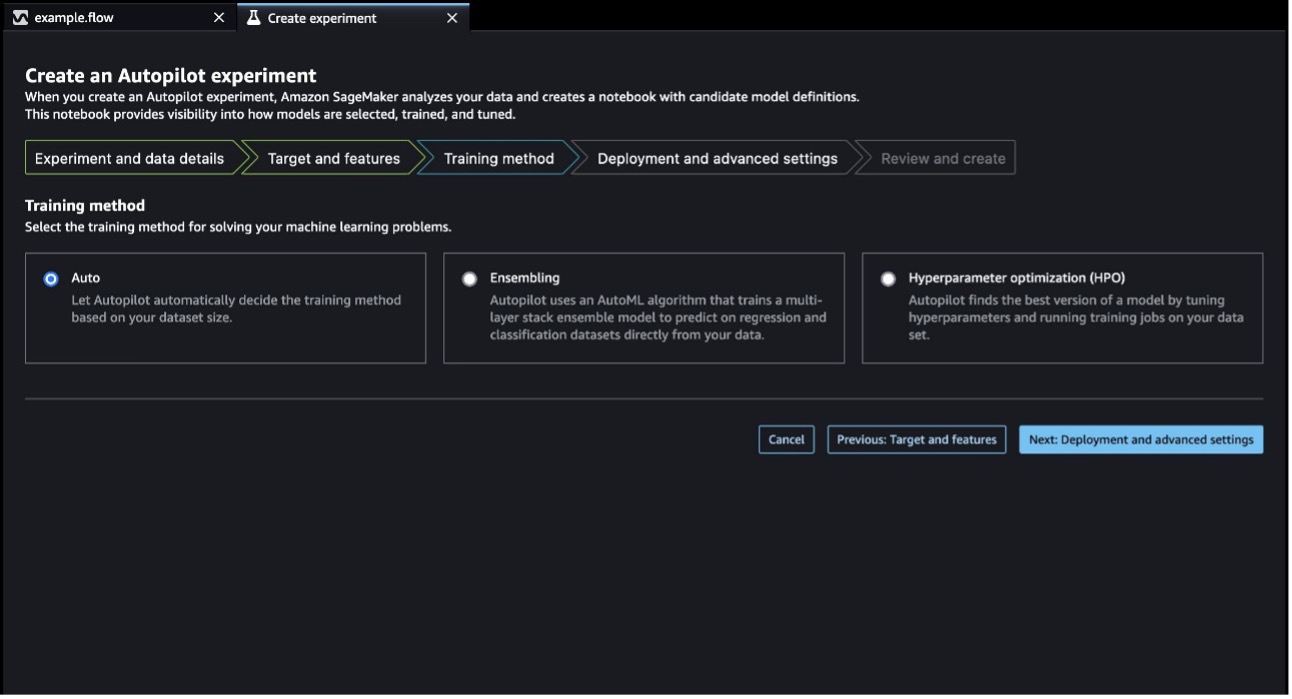

- Vælg derefter en træningsmetode. I dette tilfælde vælger vi Auto og lad SageMaker Autopilot bestemme den bedste træningsmetode baseret på datasættets størrelse.

- Angiv installationsindstillingerne.

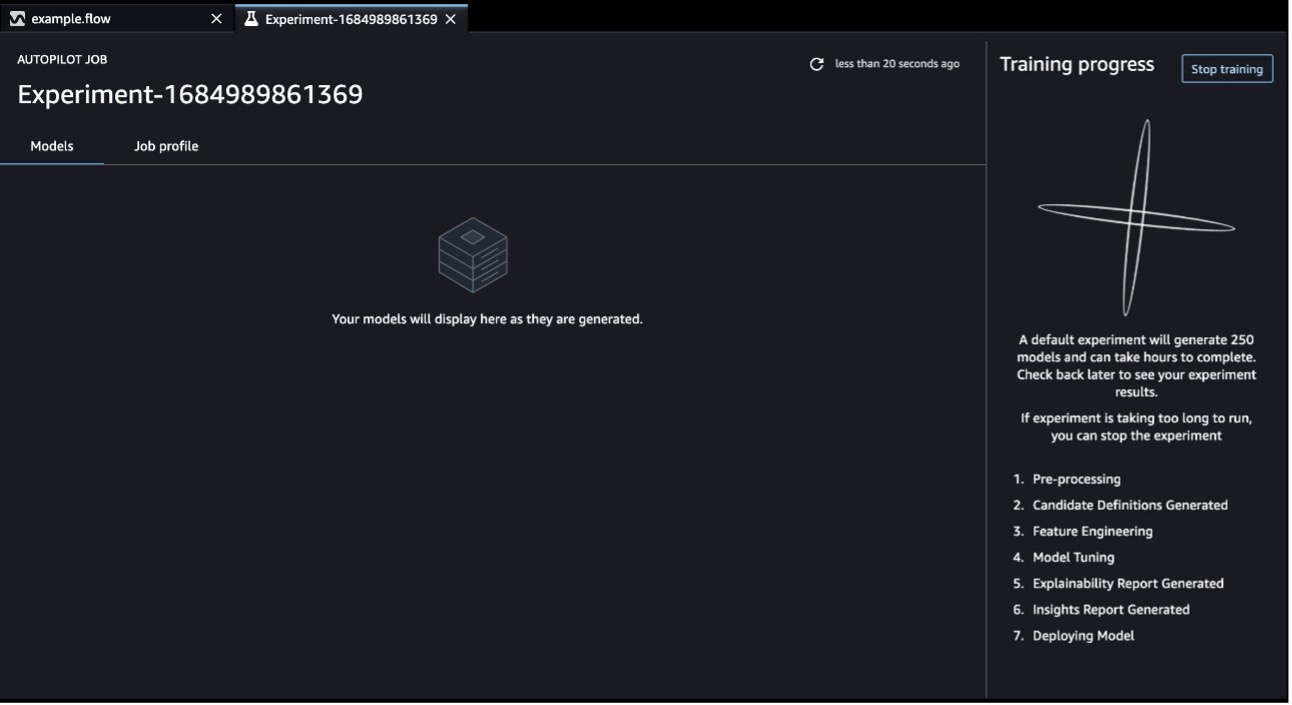

- Gennemgå endelig jobkonfigurationen og indsend SageMaker Autopilot-eksperimentet til træning. Når SageMaker Autopilot fuldfører eksperimentet, kan du se træningsresultaterne og udforske den bedste model.

Takket være understøttelse af manifestfiler kan du bruge hele dit datasæt til SageMaker Autopilot-eksperimentet, ikke kun en delmængde af dine data.

For mere information om brug af SageMaker Autopilot med SageMaker Data Wrangler, se Samlet dataforberedelse og modeltræning med Amazon SageMaker Data Wrangler og Amazon SageMaker Autopilot.

Generer slutningsartefakter fra SageMaker Processing-job

Lad os nu se på, hvordan vi kan generere inferensartefakter gennem både SageMaker Data Wrangler UI og SageMaker Data Wrangler notebooks.

SageMaker Data Wrangler UI

Til vores brug ønsker vi at behandle vores data gennem brugergrænsefladen og derefter bruge de resulterende data til at træne og implementere en model gennem SageMaker-konsollen. Udfør følgende trin:

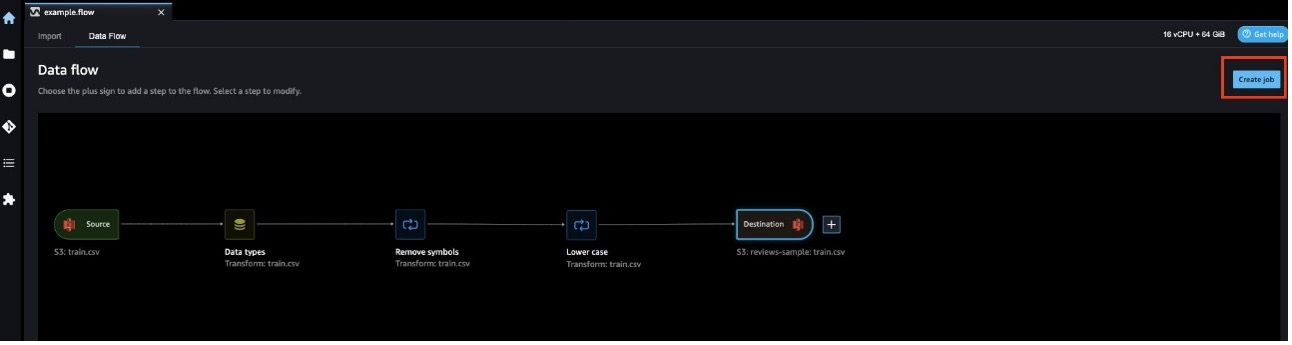

- Åbn det dataflow, du oprettede i det foregående afsnit.

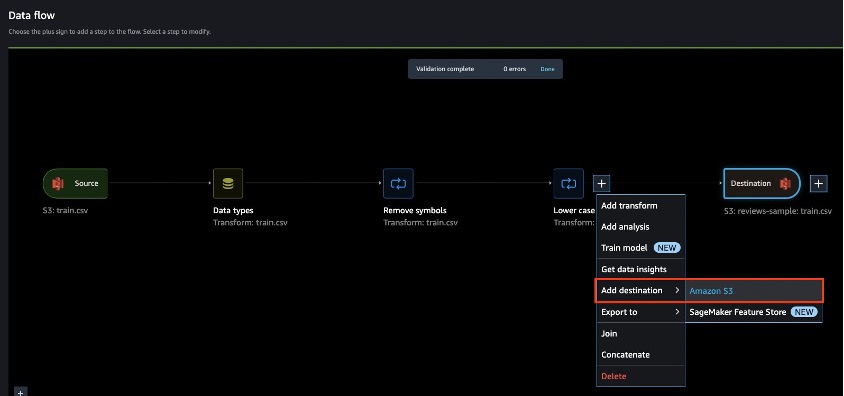

- Vælg plustegnet ved siden af den sidste transformation, vælg Tilføj destination, og vælg Amazon S3. Det vil være her de behandlede data vil blive gemt.

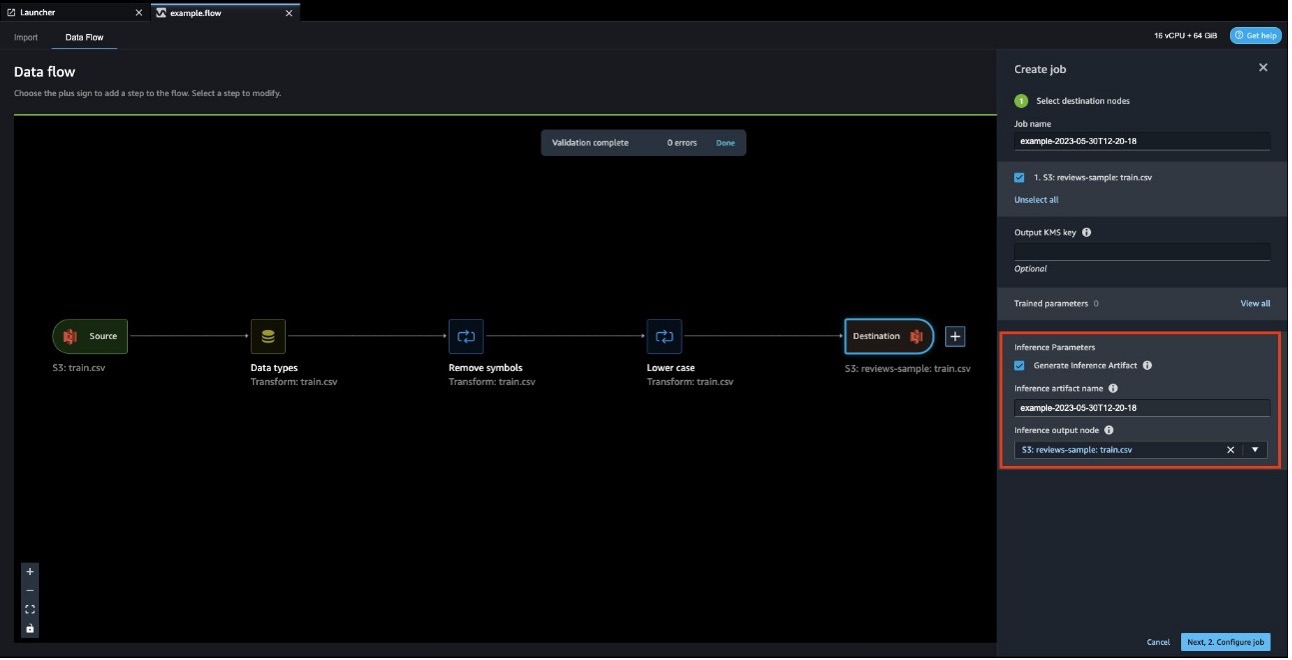

- Vælg Skab job.

- Type Generer slutningsartefakter i afsnittet Inferensparametre for at generere en inferensartefakt.

- Indtast navnet på din inferensartefakt (med .tar.gz som filtypenavn) for Inference artefaktnavn.

- For Inference output node skal du indtaste destinationsknuden, der svarer til de transformationer, der er anvendt på dine træningsdata.

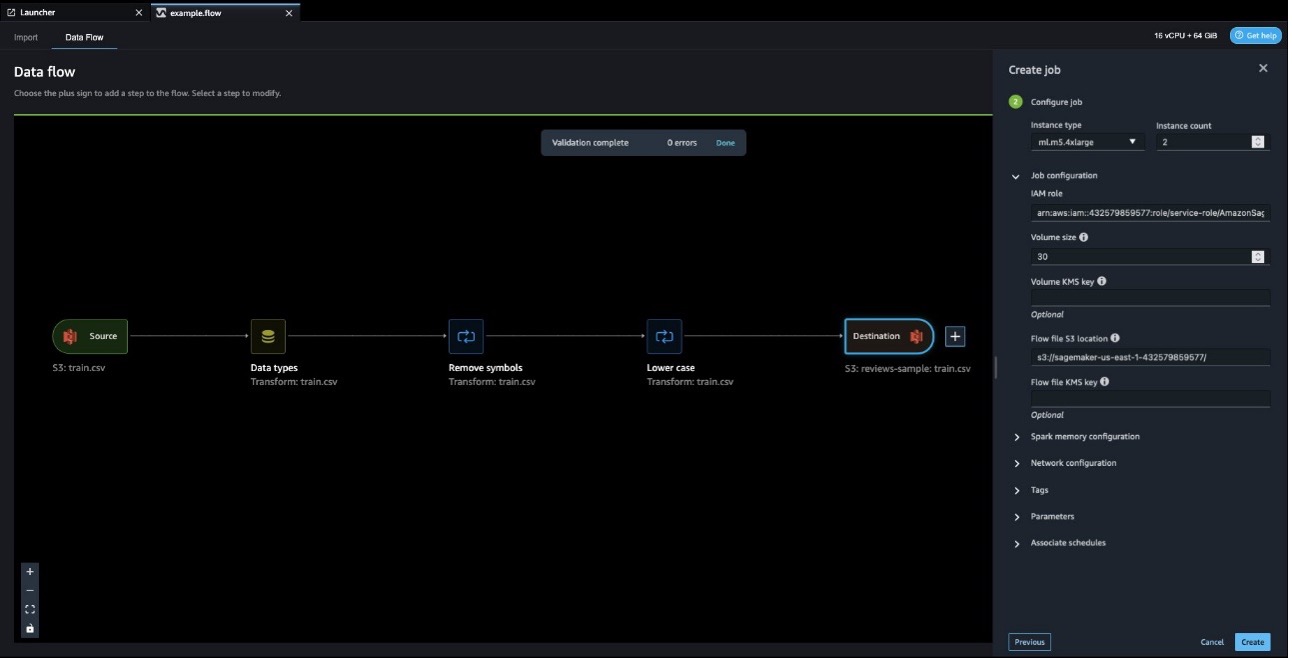

- Vælg Konfigurer job.

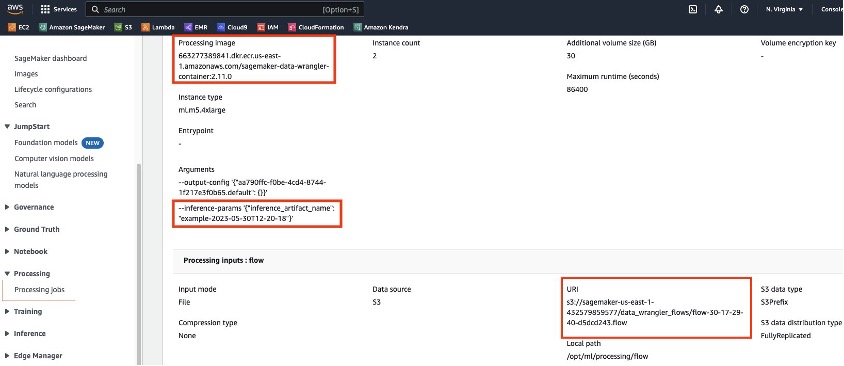

- Under Jobkonfiguration, indtast en sti for Flow fil S3 placering. En mappe kaldet

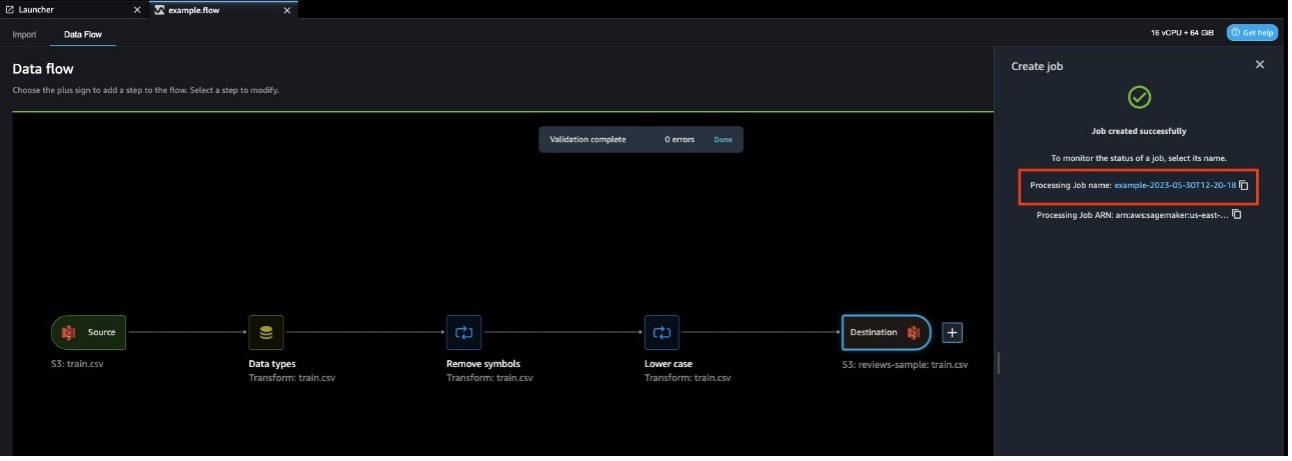

data_wrangler_flowsvil blive oprettet under denne placering, og slutningsartefakten vil blive uploadet til denne mappe. For at ændre uploadplaceringen skal du indstille en anden S3-placering. - Lad standardindstillingerne for alle andre muligheder og vælg Opret at skabe forarbejdningsjobbet.

Bearbejdningsjobbet vil skabe entarball (.tar.gz)indeholdende en ændret dataflowfil med en nyligt tilføjet slutningssektion, der giver dig mulighed for at bruge den til slutninger. Du skal bruge S3 uniform ressource identifikator (URI) for inferensartefakten for at levere artefakten til en SageMaker-model, når du implementerer din inferensløsning. URI'en vil være i formularen{Flow file S3 location}/data_wrangler_flows/{inference artifact name}.tar.gz. - Hvis du ikke har noteret disse værdier tidligere, kan du vælge linket til behandlingsopgaven for at finde de relevante detaljer. I vores eksempel er URI

s3://sagemaker-us-east-1-43257985977/data_wrangler_flows/example-2023-05-30T12-20-18.tar.gz.

- Kopier værdien af Behandler billede; vi har også brug for denne URI, når vi opretter vores model.

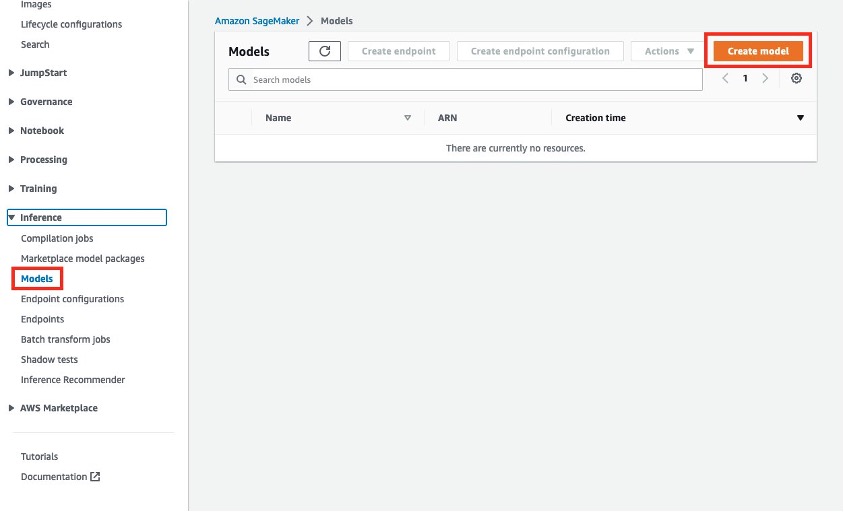

- Vi kan nu bruge denne URI til at oprette en SageMaker-model på SageMaker-konsollen, som vi senere kan implementere til et slutpunkt eller batch-transformationsjob.

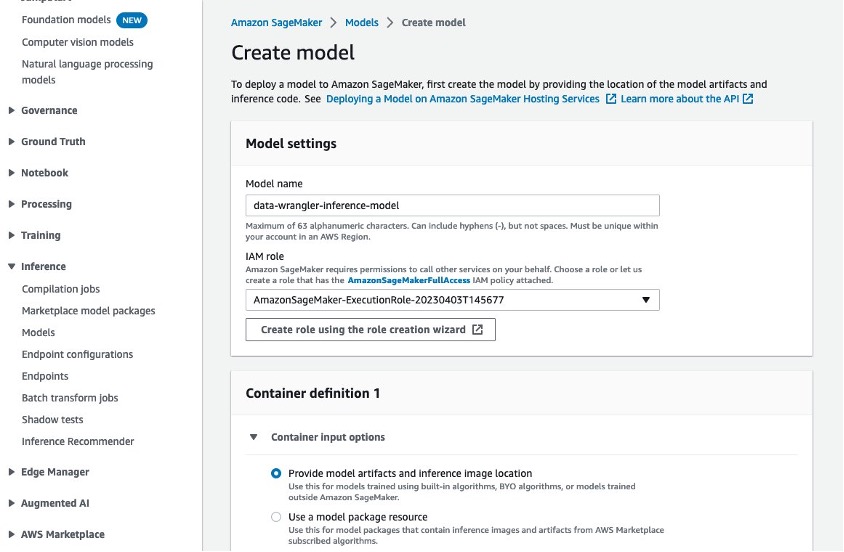

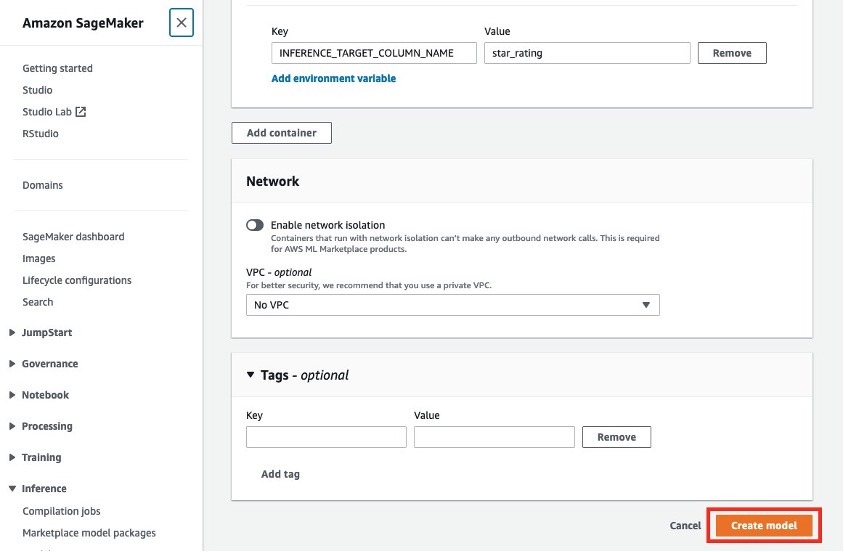

- Under Modelindstillinger¸ indtast et modelnavn og angiv din IAM-rolle.

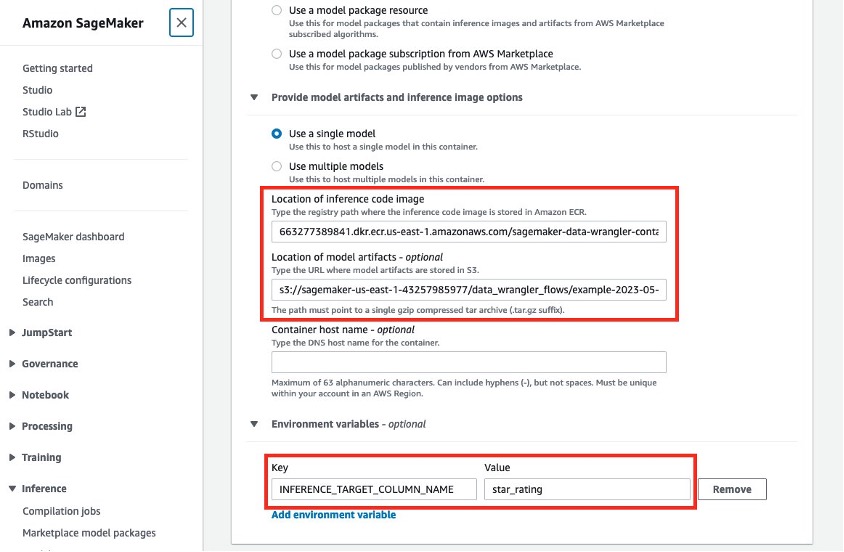

- Til Indgangsmuligheder for container, Vælg Angiv modelartefakter og inferensbilledeplacering.

- Til Placering af inferenskodebillede, skal du indtaste behandlingsbilledets URI.

- Til Placering af modelartefakter, indtast inferensartefakt-URI.

- Hvis dine data desuden har en målkolonne, der vil blive forudsagt af en trænet ML-model, skal du angive navnet på den kolonne under Miljøvariabler, med

INFERENCE_TARGET_COLUMN_NAMEas Nøgle og kolonnenavnet som Værdi.

- Afslut oprettelsen af din model ved at vælge Opret model.

Vi har nu en model, som vi kan implementere til et slutpunkt eller batchtransformationsjob.

SageMaker Data Wrangler notesbøger

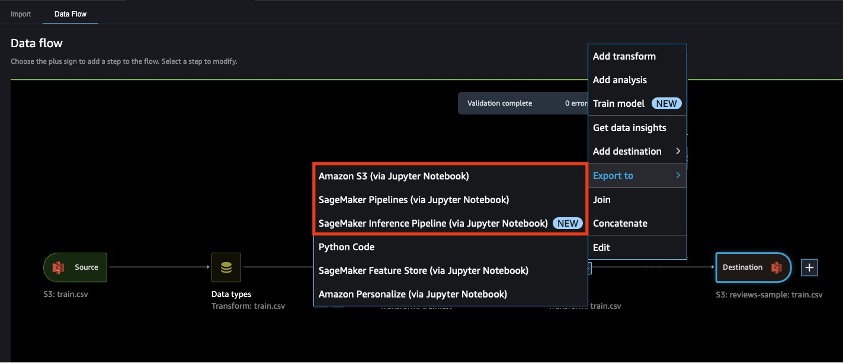

For en kode-først tilgang til at generere slutningsartefakt fra et behandlingsjob, kan vi finde eksempelkoden ved at vælge Eksporter til på nodemenuen og vælge enten Amazon S3, SageMaker Pipelines eller SageMaker Inference Pipeline. Vi vælger SageMaker Inference Pipeline i dette eksempel.

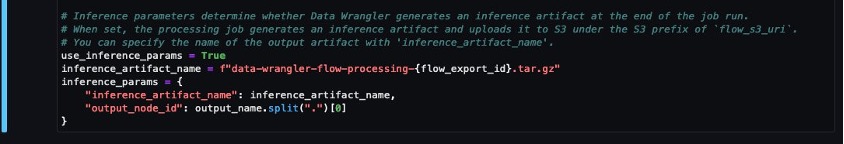

I denne notesbog er der et afsnit med titlen Opret processor (dette er identisk i SageMaker Pipelines notebook, men i Amazon S3 notebook vil den tilsvarende kode være under Jobkonfigurationer afsnit). Nederst i dette afsnit er en konfiguration for vores inferensartefakt kaldet inference_params. Den indeholder den samme information, som vi så i brugergrænsefladen, nemlig inferensartefaktnavnet og inferensoutputknudepunktet. Disse værdier vil være forududfyldt, men kan ændres. Der er desuden en parameter kaldet use_inference_params, som skal indstilles til True for at bruge denne konfiguration i behandlingsjobbet.

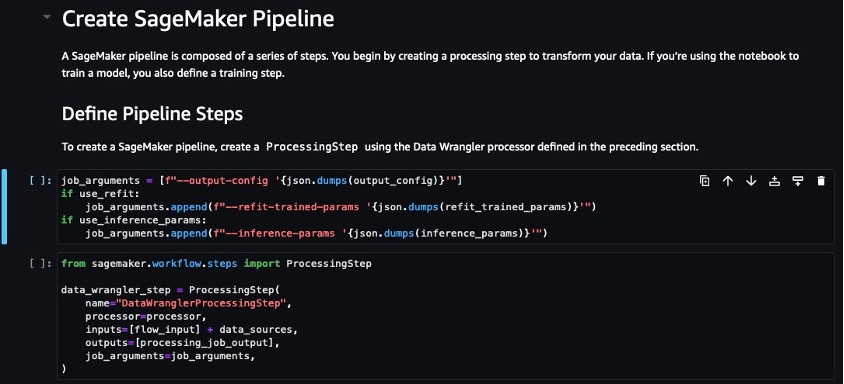

Længere nede er et afsnit med titlen Definer pipeline-trin, Hvor inference_params konfigurationen føjes til en liste over jobargumenter og overføres til definitionen for et SageMaker Data Wrangler-behandlingstrin. I Amazon S3 notesbogen, job_arguments defineres umiddelbart efter Jobkonfigurationer sektion.

Med disse enkle konfigurationer vil behandlingsjob, der er oprettet af denne notesbog, generere en inferensartefakt på samme S3-placering som vores flowfil (defineret tidligere i vores notesbog). Vi kan programmatisk bestemme denne S3-placering og bruge denne artefakt til at skabe en SageMaker-model ved hjælp af SageMaker Python SDK, hvilket er demonstreret i SageMaker Inference Pipeline notesbogen.

Den samme tilgang kan anvendes på enhver Python-kode, der skaber et SageMaker Data Wrangler-behandlingsjob.

Understøttelse af JSON-filformat til input og output under inferens

Det er ret almindeligt for websteder og applikationer at bruge JSON som anmodning/svar for API'er, så informationen er nem at parse af forskellige programmeringssprog.

Tidligere, efter at du havde en trænet model, kunne du kun interagere med den via CSV som et inputformat i en SageMaker Data Wrangler-inferenspipeline. I dag kan du bruge JSON som et input- og outputformat, hvilket giver mere fleksibilitet, når du interagerer med SageMaker Data Wrangler-inferenscontainere.

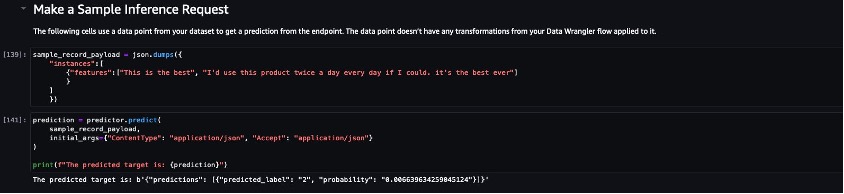

For at komme i gang med at bruge JSON til input og output i inferenspipeline-notesbogen skal du udføre følgende trin:

- Definer en nyttelast.

For hver nyttelast forventer modellen en nøglenavngivne instanser. Værdien er en liste over objekter, der hver er sit eget datapunkt. Objekterne kræver en nøgle kaldet funktioner, og værdierne skal være funktionerne i et enkelt datapunkt, som er beregnet til at blive sendt til modellen. Flere datapunkter kan indsendes i en enkelt anmodning, op til en samlet størrelse på 6 MB pr. anmodning.

Se følgende kode:

- Angiv

ContentTypeasapplication/json. - Lever data til modellen og modtag inferens i JSON-format.

Se Almindelige dataformater til inferens for eksempel input og output JSON eksempler.

Ryd op

Når du er færdig med at bruge SageMaker Data Wrangler, anbefaler vi, at du lukker den instans, den kører på, ned for at undgå at pådrage dig yderligere omkostninger. For instruktioner om, hvordan du lukker SageMaker Data Wrangler-appen og tilhørende instans, se Sluk Data Wrangler.

Konklusion

SageMaker Data Wranglers nye funktioner, herunder understøttelse af S3-manifestfiler, inferensfunktioner og JSON-formatintegration, transformerer den operationelle oplevelse af dataforberedelse. Disse forbedringer strømliner dataimport, automatiserer datatransformationer og forenkler arbejdet med JSON-data. Med disse funktioner kan du forbedre din operationelle effektivitet, reducere den manuelle indsats og nemt udtrække værdifuld indsigt fra dine data. Omfavn styrken af SageMaker Data Wranglers nye funktioner og frigør det fulde potentiale i dine dataforberedelsesarbejdsgange.

For at komme i gang med SageMaker Data Wrangler, tjek de seneste oplysninger om SageMaker Data Wrangler produktside.

Om forfatterne

Munish Dabra er Principal Solutions Architect hos Amazon Web Services (AWS). Hans aktuelle fokusområder er AI/ML og observerbarhed. Han har en stærk baggrund i at designe og bygge skalerbare distribuerede systemer. Han nyder at hjælpe kunder med at innovere og transformere deres forretning i AWS. LinkedIn: /mdabra

Munish Dabra er Principal Solutions Architect hos Amazon Web Services (AWS). Hans aktuelle fokusområder er AI/ML og observerbarhed. Han har en stærk baggrund i at designe og bygge skalerbare distribuerede systemer. Han nyder at hjælpe kunder med at innovere og transformere deres forretning i AWS. LinkedIn: /mdabra

Patrick Lin er softwareudviklingsingeniør hos Amazon SageMaker Data Wrangler. Han er forpligtet til at gøre Amazon SageMaker Data Wrangler til det bedste dataforberedelsesværktøj til produktionsiserede ML-arbejdsgange. Uden for arbejdet kan du finde ham læse, lytte til musik, have samtaler med venner og tjene i hans kirke.

Patrick Lin er softwareudviklingsingeniør hos Amazon SageMaker Data Wrangler. Han er forpligtet til at gøre Amazon SageMaker Data Wrangler til det bedste dataforberedelsesværktøj til produktionsiserede ML-arbejdsgange. Uden for arbejdet kan du finde ham læse, lytte til musik, have samtaler med venner og tjene i hans kirke.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Automotive/elbiler, Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- BlockOffsets. Modernisering af miljømæssig offset-ejerskab. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/optimize-data-preparation-with-new-features-in-aws-sagemaker-data-wrangler/

- :har

- :er

- :ikke

- :hvor

- $OP

- 100

- 1996

- 2014

- 7

- 8

- 9

- a

- aktioner

- tilføjet

- Yderligere

- Derudover

- vedtaget

- Efter

- AI / ML

- Alle

- tillade

- tillader

- også

- Amazon

- Amazon SageMaker

- Amazon SageMaker Autopilot

- Amazon SageMaker Data Wrangler

- Amazon Web Services

- Amazon Web Services (AWS)

- beløb

- an

- ,

- enhver

- API'er

- app

- applikationer

- anvendt

- Indløs

- tilgang

- ER

- områder

- argumenter

- AS

- forbundet

- At

- automatisere

- automatisk

- undgå

- AWS

- baggrund

- baseret

- BE

- bliver

- være

- BEDSTE

- Big

- både

- Bund

- Pause

- bygge

- Bygning

- indbygget

- virksomhed

- men

- by

- kaldet

- CAN

- kapaciteter

- tilfælde

- lave om

- afgifter

- kontrollere

- Vælg

- vælge

- kirke

- Rengøring

- kode

- Kolonne

- engageret

- Fælles

- kompatibel

- fuldføre

- Fuldender

- Konfiguration

- Konsol

- forbruges

- Beholdere

- indeholder

- samtaler

- Tilsvarende

- kunne

- skabe

- oprettet

- skaber

- Oprettelse af

- kritisk

- Nuværende

- kunde

- Kunder

- data

- Dataudveksling

- datapunkter

- Dataforberedelse

- databehandling

- datastyret

- datasæt

- dag

- beslutte

- defaults

- definerede

- definition

- dykke

- demonstreret

- indsætte

- implementering

- implementering

- konstrueret

- designe

- destination

- detaljer

- Bestem

- Udvikling

- forskellige

- diskutere

- distribueret

- distribuerede systemer

- do

- ned

- i løbet af

- hver

- tidligere

- lette

- lettere

- let

- økosystemer

- effektivitet

- effektiv

- effektivt

- indsats

- enten

- omfavne

- muliggør

- muliggør

- ende til ende

- Endpoint

- ingeniør

- Engineering

- forbedre

- forbedringer

- Forbedrer

- Indtast

- Hele

- Miljø

- Ækvivalent

- især

- NOGENSINDE

- Hver

- hver dag

- at alt

- eksempel

- eksempler

- udveksling

- forventer

- erfaring

- eksperiment

- eksperimenter

- udforskning

- udforske

- eksport

- eksport

- udvidelse

- ekstrakt

- Feature

- Funktionalitet

- få

- File (Felt)

- Filer

- Finde

- Fleksibilitet

- flow

- strømme

- Fokus

- følger

- efter

- Til

- formular

- format

- venner

- fra

- fuld

- yderligere

- generere

- genereret

- få

- stærkt

- havde

- håndtere

- Have

- have

- he

- hjælpe

- Høj

- fremhæve

- ham

- hans

- Hvordan

- How To

- HTML

- HTTPS

- i

- identisk

- identifikator

- if

- billede

- straks

- importere

- importere

- Forbedre

- in

- omfatter

- Herunder

- oplysninger

- innovere

- indgang

- indsigt

- instans

- anvisninger

- integration

- beregnet

- interagere

- interaktion

- interaktiv

- grænseflade

- ind

- intuitiv

- IT

- ITS

- JavaScript

- Job

- jpg

- json

- juli

- lige

- Nøgle

- Sprog

- stor

- Efternavn

- senere

- seneste

- lancere

- læring

- lad

- Niveau

- ligesom

- Limited

- LINK

- Liste

- Lytte

- Lister

- placering

- Se

- maskine

- machine learning

- lave

- Making

- administrere

- manuel

- Kan..

- Menu

- Metadata

- metode

- måske

- million

- minutter

- mangler

- ML

- MLOps

- model

- modeller

- Moderne

- modificeret

- mere

- mere effektiv

- flere

- Musik

- skal

- navn

- Som hedder

- nemlig

- indfødte

- nødvendig

- Behov

- behov

- Ny

- Nye funktioner

- nyligt

- næste

- ingen

- node

- notesbog

- nu

- nummer

- objekt

- objekter

- of

- on

- ONE

- kun

- operationelle

- optimal

- Optimer

- Option

- Indstillinger

- or

- Andet

- vores

- ud

- output

- uden for

- egen

- parameter

- parametre

- Bestået

- sti

- per

- Udfør

- pick

- pipeline

- plato

- Platon Data Intelligence

- PlatoData

- plus

- Punkt

- punkter

- Indlæg

- potentiale

- magt

- forudsige

- forudsagde

- forberedelse

- Forbered

- forberedt

- smuk

- tidligere

- Main

- behandle

- Behandlet

- forarbejdning

- Produkt

- Produkt Anmeldelser

- produktion

- programmatisk

- Programmering

- programmeringssprog

- projekt

- give

- leverer

- Python

- Læsning

- realtid

- modtage

- anbefaler

- reducere

- reducerer

- frigive

- relevant

- Fjern

- repræsentere

- repræsenterer

- anmode

- kræver

- ressource

- resulterer

- Resultater

- gennemgå

- Anmeldelser

- højre

- roller

- løber

- s

- sagemaker

- SageMaker Inference

- SageMaker Pipelines

- samme

- så

- skalerbar

- sømløs

- problemfrit

- Sektion

- se

- udvælgelse

- valg

- Tjenester

- servering

- Session

- sæt

- indstillinger

- flere

- bør

- Vis

- Luk ned

- underskrive

- Simpelt

- forenklet

- forenkle

- forenkle

- enkelt

- Størrelse

- lille

- mindre

- So

- Software

- softwareudvikling

- løsninger

- Løsninger

- spænding

- specifikt

- delt

- starte

- påbegyndt

- Trin

- Steps

- opbevaring

- opbevaret

- strømline

- strømlining

- stærk

- struktureret

- indsende

- indsendt

- sådan

- support

- Understøtter

- sikker

- Systemer

- Tag

- tager

- mål

- at

- oplysninger

- deres

- derefter

- Der.

- Disse

- denne

- dem

- Gennem

- tid

- titlen

- til

- i dag

- også

- værktøj

- værktøjer

- I alt

- Tog

- uddannet

- Kurser

- Transform

- Transformation

- transformationer

- omdannet

- transformationer

- To gange

- ui

- under

- låse

- uploadet

- brug

- brug tilfælde

- anvendte

- ved brug af

- Værdifuld

- værdi

- Værdier

- meget

- via

- Specifikation

- visualisering

- ønsker

- ønskede

- we

- web

- webservices

- websites

- uger

- GODT

- hvornår

- som

- bredt

- vilje

- med

- Arbejde

- workflow

- arbejdsgange

- arbejder

- Du

- Din

- zephyrnet