Dette indlæg blev skrevet i samarbejde med Ankur Goyal og Karthikeyan Chokappa fra PwC Australias Cloud & Digital forretning.

Kunstig intelligens (AI) og machine learning (ML) er ved at blive en integreret del af systemer og processer, hvilket muliggør beslutninger i realtid, hvilket driver top- og bundlinjeforbedringer på tværs af organisationer. Det er imidlertid udfordrende at sætte en ML-model i produktion i stor skala og kræver et sæt bedste praksis. Mange virksomheder har allerede datavidenskabsmænd og ML-ingeniører, der kan bygge avancerede modeller, men at bringe modeller til produktion og vedligeholde modellerne i skala er fortsat en udfordring. Manuelle arbejdsgange begrænser ML livscyklusoperationer for at bremse udviklingsprocessen, øge omkostningerne og kompromittere kvaliteten af det endelige produkt.

Maskinlæringsoperationer (MLOps) anvender DevOps-principper på ML-systemer. Ligesom DevOps kombinerer udvikling og drift til software engineering, kombinerer MLOps ML engineering og it-drift. Med den hurtige vækst i ML-systemer og i sammenhæng med ML-teknik, giver MLOps de muligheder, der er nødvendige for at håndtere den unikke kompleksitet i den praktiske anvendelse af ML-systemer. Overordnet set kræver ML use cases en let tilgængelig integreret løsning til at industrialisere og strømline processen, der tager en ML-model fra udvikling til produktionsimplementering i skala ved hjælp af MLOps.

For at imødegå disse kundeudfordringer udviklede PwC Australia Machine Learning Ops Accelerator som et sæt standardiserede proces- og teknologikapaciteter for at forbedre operationaliseringen af AI/ML-modeller, der muliggør tværfunktionelt samarbejde på tværs af teams gennem ML-livscyklusoperationer. PwC Machine Learning Ops Accelerator, bygget oven på AWS native services, leverer en passende løsning, der nemt integreres i ML use cases for kunder på tværs af alle brancher. I dette indlæg fokuserer vi på at opbygge og implementere en ML-brugscase, der integrerer forskellige livscykluskomponenter i en ML-model, hvilket muliggør kontinuerlig integration (CI), kontinuerlig levering (CD), kontinuerlig træning (CT) og kontinuerlig overvågning (CM).

Løsningsoversigt

I MLOps involverer en succesfuld rejse fra data til ML-modeller til anbefalinger og forudsigelser i forretningssystemer og processer flere afgørende trin. Det involverer at tage resultatet af et eksperiment eller en prototype og omdanne det til et produktionssystem med standardkontroller, kvalitet og feedback-loops. Det er meget mere end bare automatisering. Det handler om at forbedre organisationspraksis og levere resultater, der er gentagelige og reproducerbare i skala.

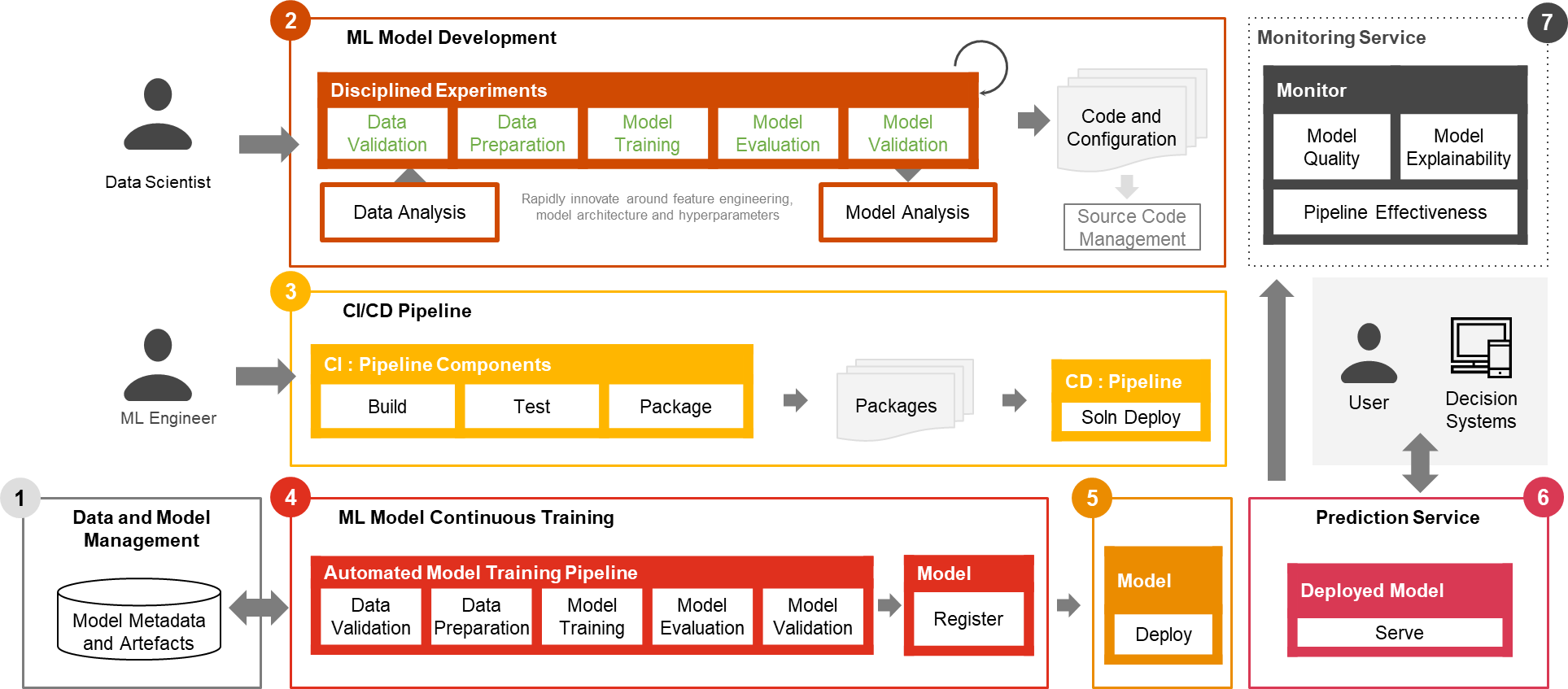

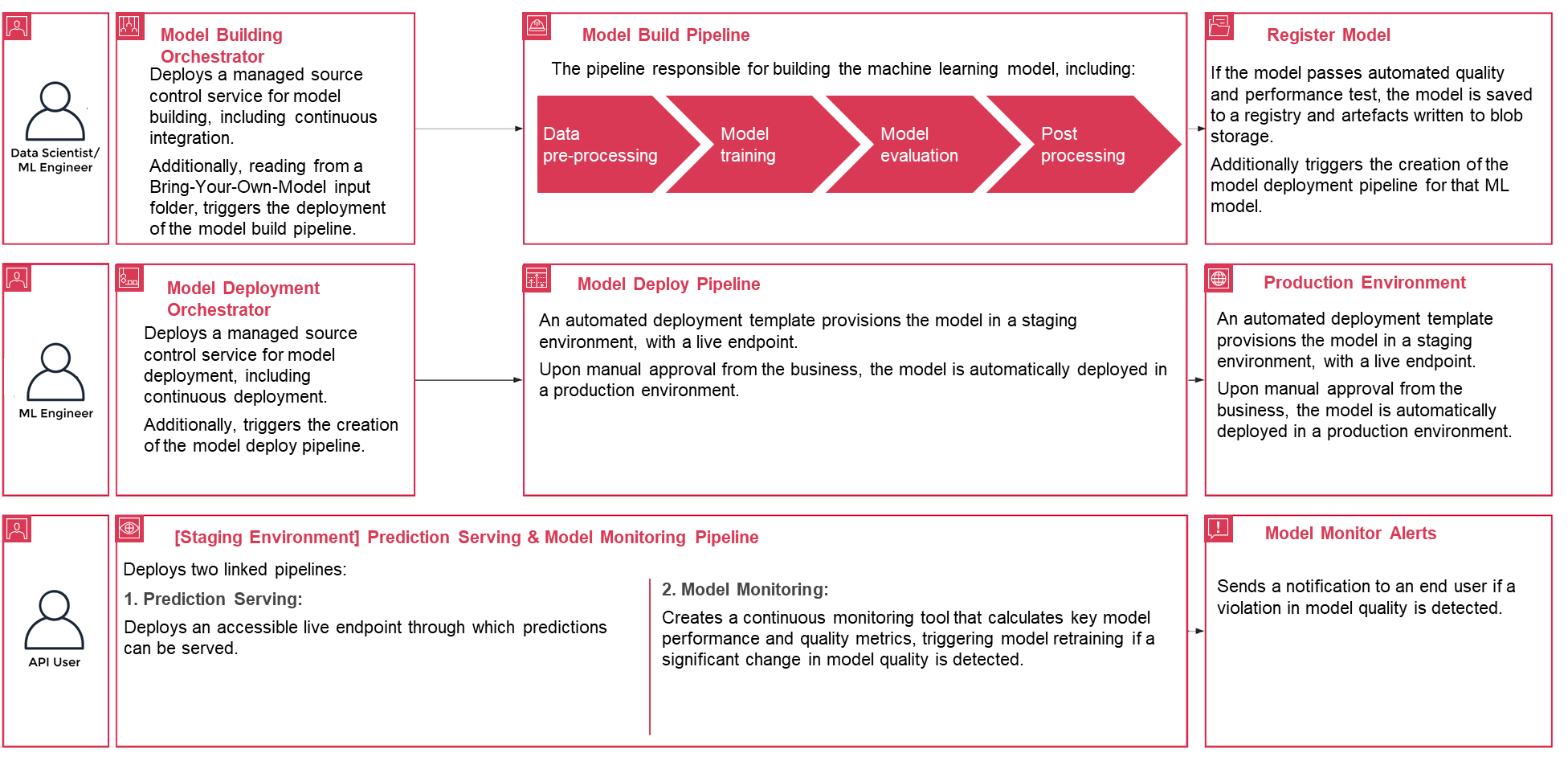

Kun en lille brøkdel af en ML-brugscase i den virkelige verden omfatter selve modellen. De forskellige komponenter, der er nødvendige for at bygge en integreret avanceret ML-kapacitet og kontinuerligt betjene den i skala, er vist i figur 1. Som illustreret i det følgende diagram, omfatter PwC MLOps Accelerator syv centrale integrerede funktioner og iterative trin, der muliggør CI, CD, CT og CM af en ML use case. Løsningen udnytter AWS native funktioner fra Amazon SageMaker, opbygning af en fleksibel og udvidelig ramme omkring dette.

Figur 1 -- PwC Machine Learning Ops Accelerator-funktioner

I et virkeligt virksomhedsscenarie kan der eksistere yderligere trin og teststadier for at sikre streng validering og implementering af modeller på tværs af forskellige miljøer.

- Data- og modelstyring give en central funktion, der styrer ML-artefakter gennem deres livscyklus. Det muliggør revision, sporbarhed og overholdelse. Det fremmer også delbarheden, genanvendeligheden og opdagelsen af ML-aktiver.

- ML model udvikling giver forskellige personas mulighed for at udvikle en robust og reproducerbar modeltræningspipeline, som omfatter en sekvens af trin, fra datavalidering og transformation til modeltræning og -evaluering.

- Løbende integration/levering letter den automatiserede opbygning, afprøvning og pakning af modeltræningspipeline og implementering af den i måludførelsesmiljøet. Integrationer med CI/CD-arbejdsgange og dataversionering fremmer MLOps bedste praksis såsom styring og overvågning af iterativ udvikling og dataversionering.

- ML model løbende træning kapacitet udfører træningspipeline baseret på genoptræningstriggere; det vil sige, efterhånden som nye data bliver tilgængelige eller modellens ydeevne falder under en forudindstillet tærskel. Den registrerer den trænede model, hvis den kvalificerer sig som en succesfuld modelkandidat, og gemmer træningsartefakter og tilhørende metadata.

- Modelimplementering giver adgang til den registrerede trænede model for at gennemgå og godkende til produktionsfrigivelse og muliggør modelpakning, testning og implementering i forudsigelsesservicemiljøet til produktionsservering.

- Forudsigelsestjeneste kapacitet starter den implementerede model for at give forudsigelse gennem online-, batch- eller streamingmønstre. Servering runtime fanger også modelserveringslogfiler til løbende overvågning og forbedringer.

- Kontinuerlig overvågning overvåger modellen for prædiktiv effektivitet for at detektere modelforfald og serviceeffektivitet (latency, pipeline overalt og udførelsesfejl)

PwC Machine Learning Ops Accelerator-arkitektur

Løsningen er bygget oven på AWS-native tjenester, der bruger Amazon SageMaker og serverløs teknologi for at holde ydeevnen og skalerbarheden høj og driftsomkostningerne lave.

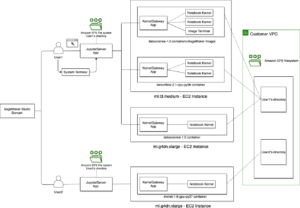

Figur 2 – PwC Machine Learning Ops Accelerator-arkitektur

- PwC Machine Learning Ops Accelerator giver en persondrevet adgangsret til opbygning, brug og drift, der gør det muligt for ML-ingeniører og dataforskere at automatisere udrulning af pipelines (træning og betjening) og hurtigt reagere på ændringer i modelkvaliteten. Amazon SageMaker Rolle Manager bruges til at implementere rollebaseret ML-aktivitet, og Amazon S3 bruges til at gemme inputdata og artefakter.

- Solution bruger eksisterende modeloprettelsesaktiver fra kunden og bygger en fleksibel og udvidelig ramme omkring dette ved hjælp af AWS native services. Der er bygget integrationer mellem Amazon S3, Git og AWS CodeCommit, der tillader datasætversionering med minimal fremtidig administration.

- AWS CloudFormation skabelon er genereret ved hjælp af AWS Cloud Development Kit (AWS CDK). AWS CDK giver mulighed for at administrere ændringer for den komplette løsning. Den automatiserede pipeline inkluderer trin til out-of-the-box modelopbevaring og metrisk sporing.

- PwC MLOps Accelerator er designet til at være modulopbygget og leveret som infrastruktur-som-kode (IaC) for at tillade automatiske implementeringer. Implementeringsprocessen bruger AWS CodeCommit, AWS CodeBuild, AWS CodePipeline, og AWS CloudFormation-skabelon. Komplet end-to-end-løsning til at operationalisere en ML-model er tilgængelig som implementerbar kode.

- Gennem en række IaC-skabeloner implementeres tre forskellige komponenter: modelopbygning, modelimplementering og modelovervågning og forudsigelsesservering, vha. Amazon SageMaker Pipelines

- Model build pipeline automatiserer modeltrænings- og evalueringsprocessen og muliggør godkendelse og registrering af den trænede model.

- Modelimplementeringspipeline sørger for den nødvendige infrastruktur til at implementere ML-modellen til batch- og realtidsslutning.

- Modelovervågning og forudsigelsesserveringspipeline implementerer den infrastruktur, der kræves til at betjene forudsigelser og overvåge modelydelse.

- PwC MLOps Accelerator er designet til at være agnostisk over for ML-modeller, ML-frameworks og runtime-miljøer. Løsningen giver mulighed for den velkendte brug af programmeringssprog som Python og R, udviklingsværktøjer som Jupyter Notebook og ML frameworks gennem en konfigurationsfil. Denne fleksibilitet gør det nemt for dataforskere løbende at forfine modeller og implementere dem ved hjælp af deres foretrukne sprog og miljø.

- Løsningen har indbyggede integrationer til at bruge enten forudbyggede eller brugerdefinerede værktøjer til at tildele mærkningsopgaverne ved hjælp af Amazon SageMaker Ground Truth til træningsdatasæt for at give kontinuerlig træning og overvågning.

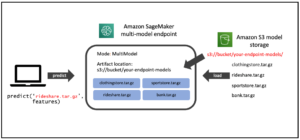

- End-to-end ML pipeline er opbygget ved hjælp af SageMaker native funktioner (Amazon SageMaker Studio , Amazon SageMaker Model Building Pipelines, Amazon SageMaker-eksperimenterog Amazon SageMaker-slutpunkter).

- Løsningen bruger Amazon SageMaker indbyggede funktioner til modelversionering, modellinjesporing, modeldeling og serverløs inferens med Amazon SageMaker Model Registry.

- Når først modellen er i produktion, overvåger løsningen løbende kvaliteten af ML-modeller i realtid. Amazon SageMaker Model Monitor bruges til løbende at overvåge modeller i produktionen. Amazon CloudWatch Logs bruges til at indsamle logfiler, der overvåger modelstatus, og meddelelser sendes ved hjælp af Amazon SNS, når kvaliteten af modellen når bestemte tærskler. Native loggere som (boto3) bruges til at registrere kørselsstatus for at fremskynde fejlfinding.

Gennemgang af løsning

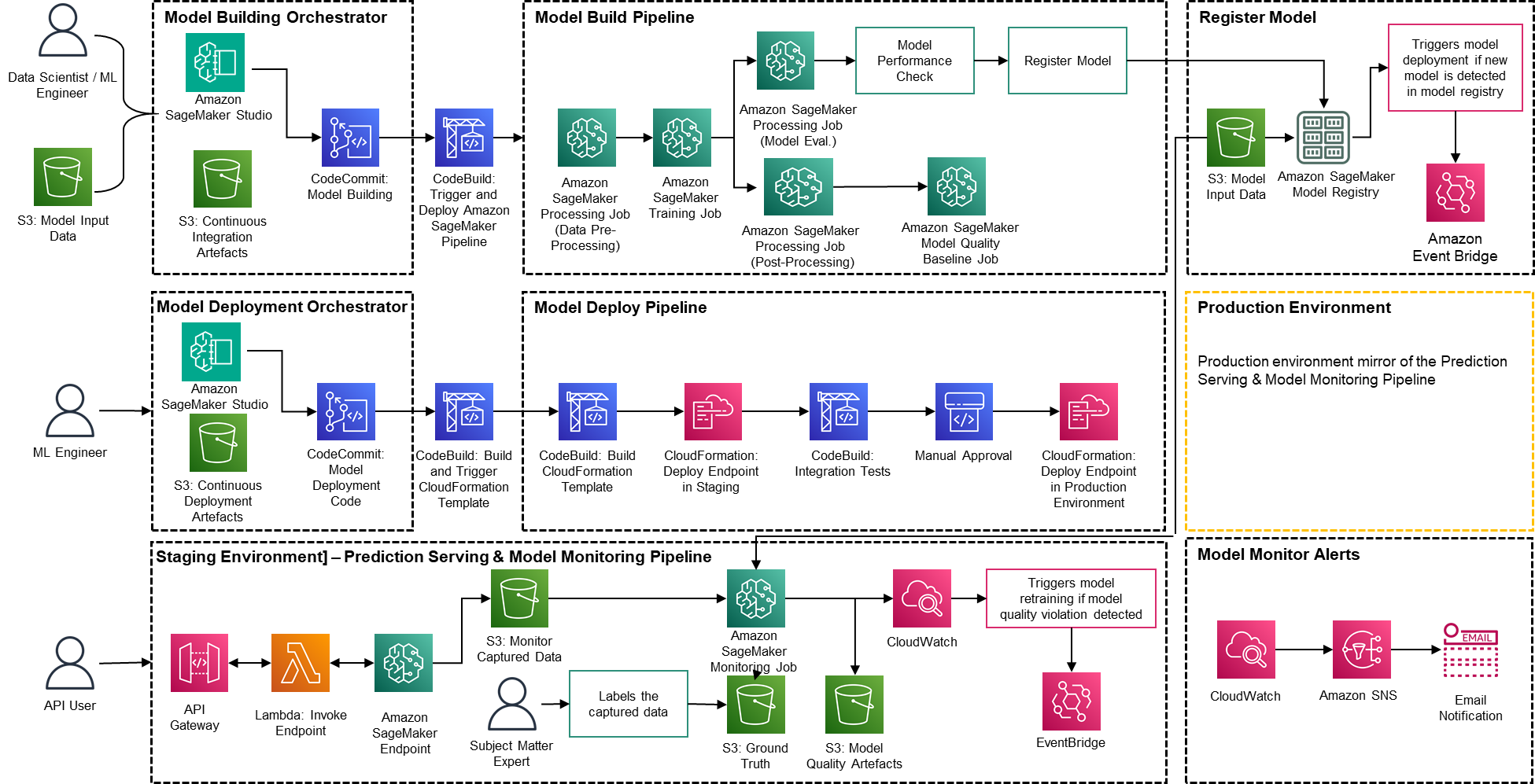

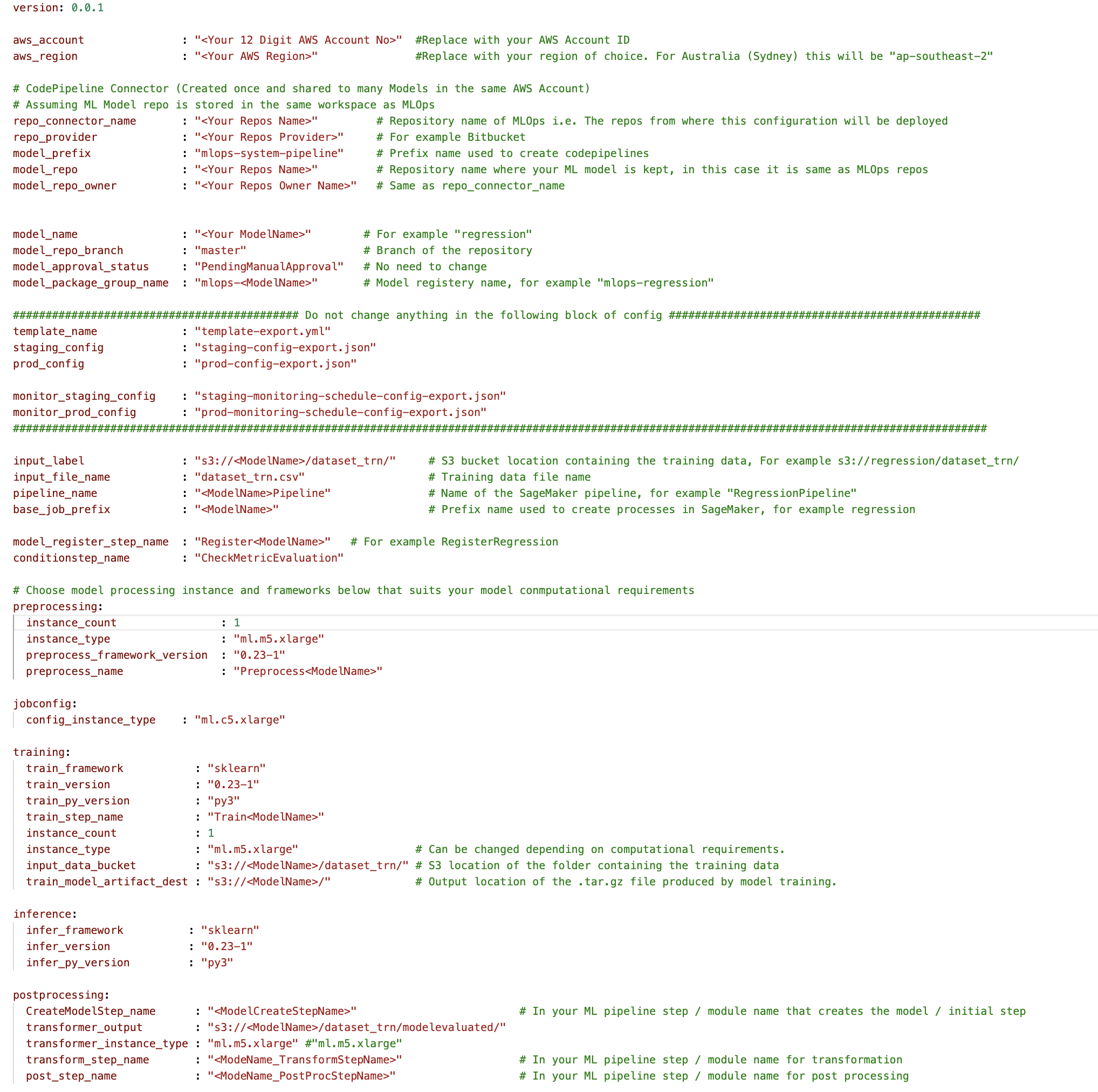

Følgende gennemgang dykker ned i standardtrinene for at skabe MLOps-processen for en model ved hjælp af PwC MLOps Accelerator. Denne gennemgang beskriver et use case af en MLOps-ingeniør, der ønsker at implementere pipelinen til en nyligt udviklet ML-model ved hjælp af en simpel definition/konfigurationsfil, der er intuitiv.

Figur 3 – PwC Machine Learning Ops Accelerator proces livscyklus

- Tilmeld dig for at komme i gang PwC MLOps Accelerator for at få adgang til løsningsartefakter. Hele løsningen er drevet fra én konfigurations-YAML-fil (

config.yaml) pr model. Alle de detaljer, der kræves for at køre løsningen, er indeholdt i denne konfigurationsfil og gemt sammen med modellen i et Git-lager. Konfigurationsfilen vil tjene som input til at automatisere workflow-trin ved at eksternalisere vigtige parametre og indstillinger uden for koden. - ML-ingeniøren skal udfyldes

config.yamlfil og udløser MLOps-pipelinen. Kunder kan konfigurere en AWS-konto, lageret, modellen, de anvendte data, pipelinenavnet, træningsrammerne, antallet af forekomster, der skal bruges til træning, inferensrammerne og eventuelle før- og efterbehandlingstrin og flere andre konfigurationer for at kontrollere modellens kvalitet, skævhed og forklaring.

Figur 4 – Machine Learning Ops Accelerator konfiguration YAML

- En simpel YAML-fil bruges til at konfigurere hver models trænings-, implementerings-, overvågnings- og runtime-krav. En gang

config.yamler konfigureret korrekt og gemt sammen med modellen i sit eget Git-lager, aktiveres den modelbyggende orkestrator. Den kan også læse fra en Bring-Your-Own-Model, der kan konfigureres gennem YAML til at udløse implementering af modelbyggepipeline. - Alt efter dette punkt er automatiseret af løsningen og behøver ikke involvering af hverken ML-ingeniøren eller dataforskeren. Den pipeline, der er ansvarlig for opbygningen af ML-modellen, omfatter dataforbehandling, modeltræning, modelevaluering og ost-behandling. Hvis modellen består automatiserede kvalitets- og ydeevnetest, gemmes modellen i et register, og artefakter skrives til Amazon S3-lager i henhold til definitionerne i YAML-filerne. Dette udløser oprettelsen af modelimplementeringspipeline for den pågældende ML-model.

Figur 5 – Eksempel på arbejdsgang for implementering af model

- Dernæst leverer en automatiseret implementeringsskabelon modellen i et iscenesættelsesmiljø med et live-slutpunkt. Efter godkendelse implementeres modellen automatisk i produktionsmiljøet.

- Løsningen implementerer to forbundne rørledninger. Forudsigelsesvisning implementerer et tilgængeligt live-slutpunkt, hvorigennem forudsigelser kan serveres. Modelovervågning skaber et kontinuerligt overvågningsværktøj, der beregner nøglemodellens ydeevne og kvalitetsmålinger, hvilket udløser modelomskoling, hvis der opdages en væsentlig ændring i modelkvaliteten.

- Nu hvor du har gennemgået oprettelsen og den indledende implementering, kan MLOps-ingeniøren konfigurere fejlalarmer til at blive advaret for problemer, for eksempel når en pipeline ikke udfører det tilsigtede job.

- MLOps handler ikke længere om at pakke, teste og implementere cloudservicekomponenter, der ligner en traditionel CI/CD-implementering; det er et system, der automatisk skal implementere en anden tjeneste. For eksempel implementerer modeltræningspipelinen automatisk modelimplementeringspipelinen for at aktivere forudsigelsestjenesten, som igen aktiverer modelovervågningstjenesten.

Konklusion

Sammenfattende er MLOps afgørende for enhver organisation, der har til formål at implementere ML-modeller i produktionssystemer i stor skala. PwC udviklede en accelerator til at automatisere opbygning, implementering og vedligeholdelse af ML-modeller ved at integrere DevOps-værktøjer i modeludviklingsprocessen.

I dette indlæg undersøgte vi, hvordan PwC-løsningen drives af AWS native ML-tjenester og hjælper med at indføre MLOps-praksis, så virksomheder kan fremskynde deres AI-rejse og få mere værdi ud af deres ML-modeller. Vi gennemgik de trin, en bruger ville tage for at få adgang til PwC Machine Learning Ops Accelerator, køre pipelines og implementere en ML use case, der integrerer forskellige livscykluskomponenter i en ML model.

For at komme i gang med din MLOps-rejse på AWS Cloud i stor skala og køre dine ML-produktionsarbejdsbelastninger, skal du tilmelde dig PwC Machine Learning Operations.

Om forfatterne

Kiran Kumar Ballari er Principal Solutions Architect hos Amazon Web Services (AWS). Han er en evangelist, der elsker at hjælpe kunder med at udnytte nye teknologier og bygge repeterbare industriløsninger til at løse deres problemer. Han er især passioneret omkring software engineering, Generativ AI og at hjælpe virksomheder med AI/ML produktudvikling.

Kiran Kumar Ballari er Principal Solutions Architect hos Amazon Web Services (AWS). Han er en evangelist, der elsker at hjælpe kunder med at udnytte nye teknologier og bygge repeterbare industriløsninger til at løse deres problemer. Han er især passioneret omkring software engineering, Generativ AI og at hjælpe virksomheder med AI/ML produktudvikling.

Ankur Goyal er direktør i PwC Australias Cloud and Digital-praksis med fokus på Data, Analytics & AI. Ankur har stor erfaring med at støtte offentlige og private organisationer med at drive teknologitransformationer og designe innovative løsninger ved at udnytte dataaktiver og teknologier.

Ankur Goyal er direktør i PwC Australias Cloud and Digital-praksis med fokus på Data, Analytics & AI. Ankur har stor erfaring med at støtte offentlige og private organisationer med at drive teknologitransformationer og designe innovative løsninger ved at udnytte dataaktiver og teknologier.

Karthikeyan Chokappa (KC) er leder i PwC Australias cloud- og digitale praksis med fokus på data, analyse og kunstig intelligens. KC brænder for at designe, udvikle og implementere end-to-end analyseløsninger, der transformerer data til værdifulde beslutningsaktiver for at forbedre ydeevne og udnyttelse og reducere de samlede ejeromkostninger for forbundne og intelligente ting.

Karthikeyan Chokappa (KC) er leder i PwC Australias cloud- og digitale praksis med fokus på data, analyse og kunstig intelligens. KC brænder for at designe, udvikle og implementere end-to-end analyseløsninger, der transformerer data til værdifulde beslutningsaktiver for at forbedre ydeevne og udnyttelse og reducere de samlede ejeromkostninger for forbundne og intelligente ting.

Rama Lankalapalli er en Sr. Partner Solutions Architect hos AWS, der arbejder sammen med PwC for at accelerere deres kunders migreringer og moderniseringer til AWS. Han arbejder på tværs af forskellige brancher for at fremskynde deres indførelse af AWS Cloud. Hans ekspertise ligger i at udforme effektive og skalerbare cloud-løsninger, drive innovation og modernisering af kundeapplikationer ved at udnytte AWS-tjenester og etablere robuste cloud-fundamenter.

Rama Lankalapalli er en Sr. Partner Solutions Architect hos AWS, der arbejder sammen med PwC for at accelerere deres kunders migreringer og moderniseringer til AWS. Han arbejder på tværs af forskellige brancher for at fremskynde deres indførelse af AWS Cloud. Hans ekspertise ligger i at udforme effektive og skalerbare cloud-løsninger, drive innovation og modernisering af kundeapplikationer ved at udnytte AWS-tjenester og etablere robuste cloud-fundamenter.

Jeejee Unwalla er Senior Solutions Architect hos AWS, der nyder at vejlede kunder i at løse udfordringer og tænke strategisk. Han brænder for teknologi og data og at muliggøre innovation.

Jeejee Unwalla er Senior Solutions Architect hos AWS, der nyder at vejlede kunder i at løse udfordringer og tænke strategisk. Han brænder for teknologi og data og at muliggøre innovation.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/driving-advanced-analytics-outcomes-at-scale-using-amazon-sagemaker-powered-pwcs-machine-learning-ops-accelerator/

- :har

- :er

- :ikke

- $OP

- 1

- 100

- 1951

- 2024

- 32

- 33

- 7

- a

- evne

- Om

- fremskynde

- accelerator

- adgang

- tilgængelig

- Konto

- tværs

- aktivitet

- Yderligere

- adresse

- vedtage

- Vedtagelse

- fremskreden

- Fordel

- Efter

- AI

- AI / ML

- målsætninger

- Advarsler

- Alle

- tillade

- tillader

- sammen

- langs med

- allerede

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analytics

- ,

- En anden

- enhver

- Anvendelse

- applikationer

- gælder

- passende

- godkendelse

- Godkend

- arkitektur

- ER

- omkring

- AS

- Aktiver

- forbundet

- At

- auditabilitet

- Australien

- automatisere

- Automatiseret

- automater

- Automatisk Ur

- automatisk

- Automation

- til rådighed

- AWS

- AWS CloudFormation

- baseret

- BE

- bliver

- blive

- været

- jf. nedenstående

- BEDSTE

- bedste praksis

- mellem

- skævhed

- bygge

- Byg ud

- Bygning

- bygger

- bygget

- indbygget

- virksomhed

- virksomheder

- men

- by

- beregner

- CAN

- kandidat

- kapaciteter

- kapacitet

- fange

- fanger

- tilfælde

- tilfælde

- CD

- central

- vis

- udfordre

- udfordringer

- udfordrende

- lave om

- Ændringer

- kontrollere

- Cloud

- kode

- samarbejde

- indsamler

- kombinerer

- Virksomheder

- fuldføre

- kompleksiteter

- Compliance

- komponenter

- omfatter

- kompromis

- Konfiguration

- konfigureret

- tilsluttet

- indeholdt

- sammenhæng

- kontinuerlig

- kontinuerligt

- kontrol

- Koste

- Omkostninger

- skabe

- skaber

- skabelse

- kritisk

- afgørende

- skik

- kunde

- Kunder

- data

- dataforsker

- datasæt

- beslutning

- afgørelser

- definitioner

- leveret

- leverer

- leverer

- levering

- indsætte

- indsat

- implementering

- implementering

- implementeringer

- udruller

- konstrueret

- designe

- detaljer

- opdage

- opdaget

- udvikle

- udviklet

- udvikling

- Udvikling

- udviklingsværktøjer

- forskellige

- digital

- Direktør

- distinkt

- forskelligartede

- do

- gør

- ned

- drevet

- kørsel

- hver

- lette

- nemt

- effektivitet

- effektiv

- enten

- muliggøre

- muliggør

- muliggør

- ende til ende

- Endpoint

- ingeniør

- Engineering

- Ingeniører

- sikre

- Enterprise

- Hele

- ret

- Miljø

- miljøer

- fejl

- især

- oprettelse

- evaluering

- Evangelist

- eksempel

- Udfører

- udførelse

- eksisterer

- eksisterende

- fremskynde

- erfaring

- eksperiment

- ekspertise

- udforsket

- omfattende

- Omfattende oplevelse

- mislykkes

- Manglende

- bekendt

- Funktionalitet

- tilbagemeldinger

- Figur

- File (Felt)

- Filer

- endelige

- Fleksibilitet

- fleksibel

- Fokus

- fokuserede

- efter

- Til

- Fonde

- fraktion

- Framework

- rammer

- fra

- fremtiden

- Gevinst

- genereret

- generative

- Generativ AI

- få

- Git

- gået

- regeringsførelse

- regulerer

- Ground

- Vækst

- håndtere

- Have

- he

- hjælpe

- hjælpe

- hjælper

- Høj

- hans

- Hits

- Hvordan

- Men

- HTML

- HTTPS

- if

- gennemføre

- vigtigt

- Forbedre

- forbedringer

- forbedring

- in

- omfatter

- Forøg

- industrier

- industrien

- Infrastruktur

- initial

- Innovation

- innovativ

- indgang

- integral

- integreret

- Integrerer

- Integration

- integration

- integrationer

- Intelligens

- Intelligent

- beregnet

- ind

- intuitiv

- påberåbes

- involvering

- spørgsmål

- IT

- ITS

- selv

- Job

- rejse

- jpg

- lige

- Holde

- Nøgle

- Kumar

- mærkning

- Sprog

- Sprog

- Latency

- læring

- Leverage

- løftestang

- ligger

- livscyklus

- ligesom

- GRÆNSE

- afstamning

- forbundet

- leve

- log

- længere

- elsker

- Lav

- maskine

- machine learning

- Vedligeholdelse

- maerker

- administrere

- ledelse

- leder

- manuel

- mange

- Kan..

- Metadata

- metrisk

- Metrics

- mindste

- ML

- MLOps

- model

- modeller

- modulær

- Overvåg

- overvågning

- skærme

- mere

- meget

- navn

- indfødte

- nødvendig

- Behov

- behov

- Ny

- Nye teknologier

- ingen

- notesbog

- meddelelser

- nummer

- of

- on

- engang

- ONE

- online

- betjene

- Produktion

- or

- organisation

- organisationer

- Andet

- udfald

- uden for

- samlet

- egen

- ejerskab

- emballage

- parametre

- del

- partner

- gennemløb

- lidenskabelige

- mønstre

- per

- ydeevne

- pipeline

- plato

- Platon Data Intelligence

- PlatoData

- Punkt

- Indlæg

- strøm

- Praktisk

- praksis

- praksis

- forudsigelse

- Forudsigelser

- foretrækkes

- Main

- principper

- private

- den private sektor

- problemer

- behandle

- Processer

- Produkt

- produktudvikling

- produktion

- Programmering

- programmeringssprog

- fremme

- fremmer

- prototype

- give

- giver

- offentlige

- Sætte

- PWC

- Python

- kvalitet

- R

- hurtige

- hurtigt

- Læs

- let

- ægte

- virkelige verden

- realtid

- for nylig

- anbefalinger

- reducere

- raffinere

- registreret

- registre

- Registrering

- register

- frigive

- resterne

- gentagelig

- Repository

- kræver

- påkrævet

- Krav

- Kræver

- elastisk

- Svar

- ansvarlige

- resultere

- gennemgå

- stringent

- robust

- roller

- Kør

- kører

- runtime

- sagemaker

- gemt

- Skalerbarhed

- skalerbar

- Scale

- scenarie

- Videnskabsmand

- forskere

- sektor

- senior

- sendt

- Sequence

- Series

- tjener

- serveret

- Serverless

- tjeneste

- Tjenester

- servering

- sæt

- indstillinger

- syv

- flere

- deling

- bør

- vist

- signifikant

- lignende

- Simpelt

- langsom

- lille

- So

- Software

- software Engineering

- løsninger

- Løsninger

- SOLVE

- Løsning

- hastighed

- etaper

- iscenesættelse

- standard

- påbegyndt

- starter

- state-of-the-art

- Status

- Steps

- opbevaring

- butik

- opbevaret

- forhandler

- ligetil

- Strategisk

- streaming

- strømline

- vellykket

- sådan

- RESUMÉ

- Støtte

- systemet

- Systemer

- Tag

- tager

- tager

- mål

- opgaver

- hold

- tech

- Teknologier

- Teknologier

- skabelon

- skabeloner

- Test

- tests

- end

- at

- deres

- Them

- derved

- Disse

- ting

- Tænker

- denne

- tre

- tærskel

- Gennem

- hele

- tid

- til

- værktøj

- værktøjer

- top

- I alt

- Sporbarhed

- Sporing

- traditionelle

- uddannet

- Kurser

- Transform

- Transformation

- transformationer

- udløse

- udløsning

- TUR

- Drejning

- to

- enestående

- på

- Brug

- brug

- brug tilfælde

- anvendte

- Bruger

- bruger

- ved brug af

- validering

- Værdifuld

- værdi

- forskellige

- via

- gik

- går igennem

- ønsker

- var

- we

- web

- webservices

- hvornår

- som

- WHO

- vilje

- med

- inden for

- workflow

- arbejdsgange

- arbejder

- virker

- ville

- skriftlig

- yaml

- Din

- zephyrnet