Vil du udtrække data fra trykte eller håndskrevne formularer? Tjek ud Nanonetter™ formular dataudtrækker gratis og automatiser eksporten af information fra enhver form!

Former er overalt; de er defineret som dokumenter, der er oprettet for at indsamle information ved at bede deltagerne om at udfylde de nødvendige oplysninger i et bestemt format. De er nyttige på grund af deres evne til at samle en masse data på kort tid. Det er dog ikke alle formularer, der har samme kapacitet til at indsamle data og kræver ofte manuelt arbejde senere. Derfor er vi afhængige af værktøjer og algoritmer til intelligent automatisering af processen med udtræk af formulardata. Dette blogindlæg vil dykke dybt ned i forskellige scenarier og teknikker til at udtrække data fra formularer ved hjælp af OCR og Deep Learning.

- Hvad er Form Data Extraction?

- Hvad gør problemet udfordrende?

- Dybden af formularekstraktionsproblemet

- Hvordan har Form Data Extraction Solutions udviklet sig?

- Formulardataudtrækning ved hjælp af OCR'er

- Løsning af formdataudtræk ved hjælp af Deep Learning

- Indtast nanonetter

Hvad er Form Data Extraction?

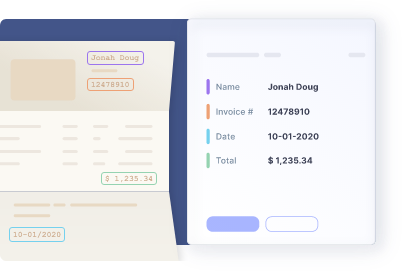

Form Data Extraction er processen med at udtrække data fra formularer – både online og offline. Disse data kan findes i ethvert format, som normalt indeholder en formular med de relevante oplysninger. Det er dog ikke altid en nem opgave at udtrække disse data, fordi mange layouts og designs ikke tillader, at tekst nemt kan vælges. Der er ingen indbygget måde at kopiere data fra dem på. Derfor er vi afhængige af automatiserede teknikker til at hjælpe med at udtrække data fra formularer, der er mere effektive og mindre udsatte for fejl.

For eksempel er mange brugere i dag afhængige af PDF-baserede formularer til at indsamle kontaktoplysninger. Dette er en yderst effektiv måde at indsamle information på, fordi det ikke kræver, at afsender og modtager kommer med input. Men at udtrække disse data fra en PDF-formular kan være udfordrende og dyrt.

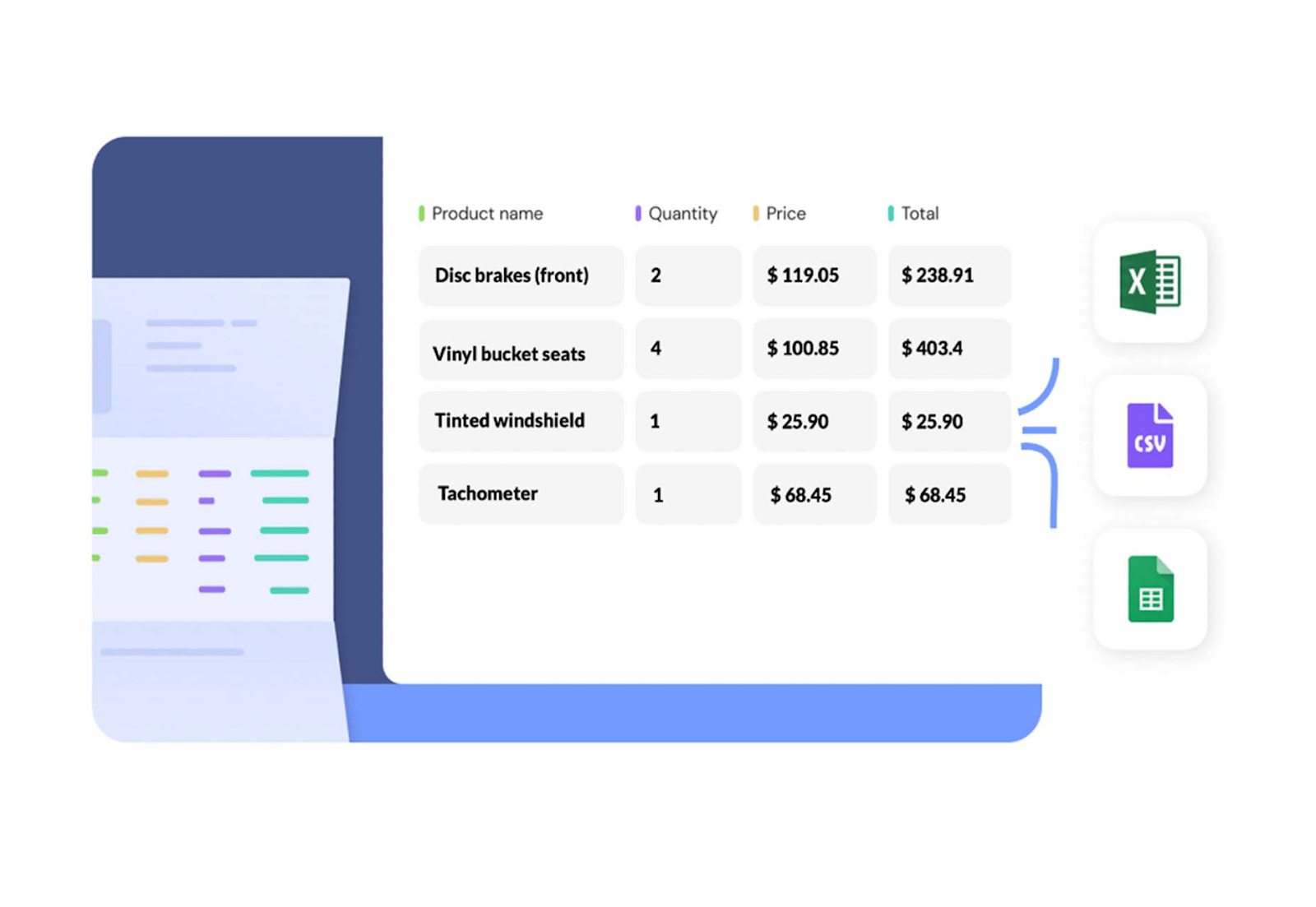

Her kan formulardataudtrækning hjælpe med at udtrække data fra en PDF-formular, såsom navn, e-mailadresse, telefonnummer osv. Det kan importeres til et andet program som Excel, Sheets eller et hvilket som helst andet struktureret format. Den måde, det fungerer på, er, at udtræksværktøjerne læser over PDF-filen, trækker automatisk det, den skal bruge, ud og organiserer det i et letlæseligt format. Disse data kan eksporteres til andre formater som Excel, CSV, JSON og andre velstrukturerede dataformater. Lad os i det næste afsnit se på nogle af de ofte stødte på udfordringer, når vi bygger formulardataudtrækningsalgoritmer.

Vil du udtrække data fra trykte eller håndskrevne formularer? Tjek Nanonets™ formular dataudtrækker gratis & automatiser eksporten af information fra enhver form!

Hvad gør Form Data Extraction udfordrende?

Dataudtræk er et spændende problem af forskellige årsager. For det første er det et billedgenkendelsesproblem, men det skal også overveje den tekst, der kan være til stede i billedet, og layoutet af formularen, hvilket gør opbygningen af en algoritme mere kompleks. Dette afsnit diskuterer nogle af de almindelige udfordringer, som folk støder på, når de bygger formdataudtrækningsalgoritmer.

- Mangel på data: Dataekstraktionsalgoritmer er normalt bygget ved hjælp af kraftfulde deep learning og computervision-baserede algoritmer. Disse er typisk afhængige af enorme mængder data for at opnå den nyeste ydeevne. Derfor er det afgørende for enhver form for dataekstraktionsværktøj eller software at finde et konsistent og pålideligt datasæt og behandle dem. Sig for eksempel, at vi har formularer med flere skabeloner, så burde disse algoritmer være i stand til at forstå en lang række former; Derfor ville træning af dem på et robust datasæt have en mere nøjagtig ydeevne.

- Håndtering af skrifttyper, sprog og layout: Der er svimlende mængder af forskellige skrifttyper, designs og skabeloner tilgængelige for forskellige former for formulardata. De kan falde i flere helt forskellige klassifikationer, hvilket gør det udfordrende at sikre nøjagtig genkendelse, når der er en lang række forskellige karaktertyper at tage hensyn til. Derfor er det vigtigt at begrænse skrifttypesamlingen til et bestemt sprog og type, fordi det vil skabe mange processer, der flyder gnidningsløst, når du har behandlet disse dokumenter korrekt. I flersprogede tilfælde skal jonglering mellem tegn fra flere sprog være forberedt på og også tage sig af kompleks typografi.

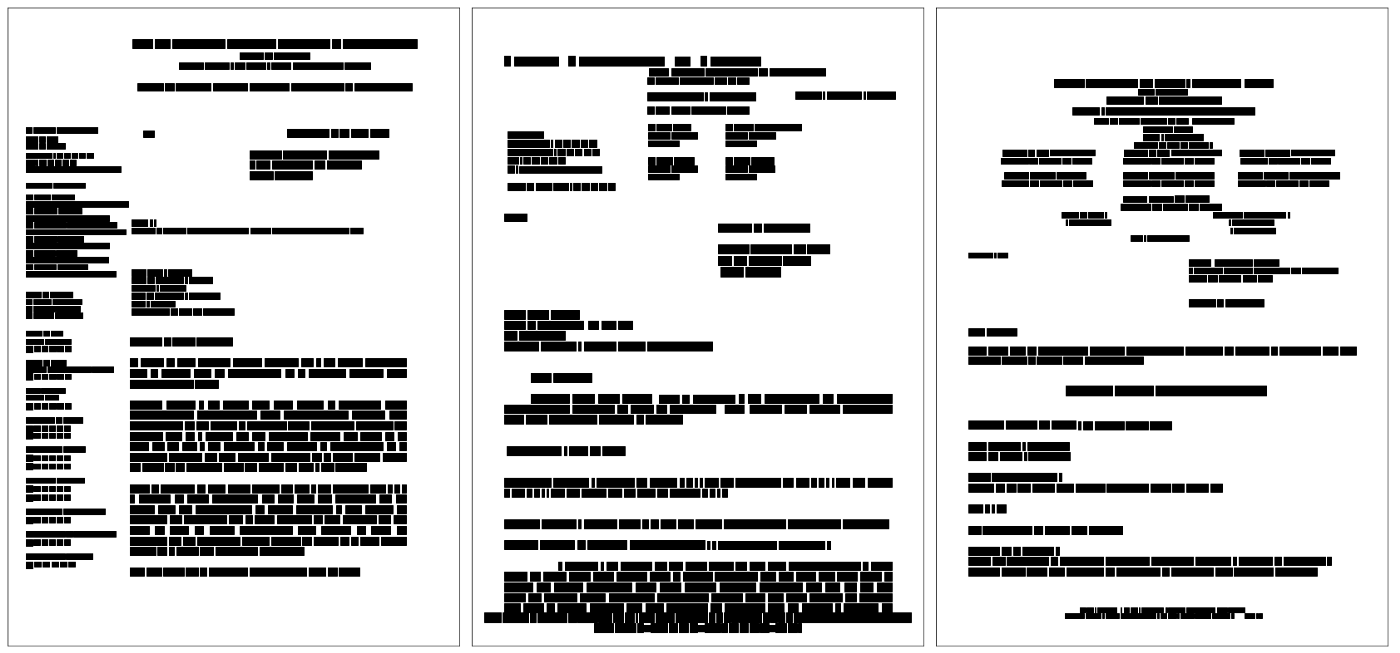

- Orientering og skævhed (rotation): Under datakurering scanner vi ofte billeder for at træne algoritmer til indsamling af inputdata. Hvis du nogensinde har brugt en scanner eller et digitalt kamera, så har du måske bemærket, at den vinkel, hvormed du tager billeder af dokumenter, nogle gange kan få dem til at se skæv ud. Dette er kendt som skævhed, som refererer til graden af vinkel. Denne skævhed kan reducere modellens nøjagtighed. Heldigvis kan forskellige teknikker bruges til at løse dette problem ved blot at ændre, hvordan vores software registrerer funktioner i bestemte områder af billedet. Et eksempel på en sådan teknik er projektionsprofilmetoder eller Fourier-transformationsmetoder, som giver mulighed for meget renere resultater i form, dimension og teksturgenkendelse! Selvom orientering og skævhed kan være simple fejl, kan disse påvirke nøjagtigheden af modellen i stort antal.

- Datasikkerhed: Hvis du udtrækker data fra forskellige kilder til dataindsamling, er det vigtigt at være opmærksom på de sikkerhedsforanstaltninger, der er på plads. Ellers risikerer du at kompromittere de oplysninger, der overføres. Dette kan føre til situationer, hvor personlige oplysninger bliver brudt, eller de oplysninger, der sendes til en API, ikke er sikre. Mens man arbejder med ETL-scripts og online API'er til dataudtræk, skal man derfor også være opmærksom på datasikkerhedsproblemer.

- Bordudtræk: Nogle gange ser vi formulardata inde i tabeller; at opbygge en robust algoritme, der kan håndtere både formudtræk og tabeludtræk, kan være udfordrende. Den sædvanlige tilgang er at bygge disse algoritmer uafhængigt og anvende dem på dataene, men dette vil føre til brugen af mere regnekraft, hvilket øger omkostningerne. Derfor bør en ideel formularudtræk være i stand til at udtrække både formular-data såvel som data fra et givet dokument.

- Efterbehandling/eksport af output: Outputdataene fra enhver dataudtræk er ikke lige. Derfor er udviklere afhængige af efterbehandlingsteknikker til at filtrere resultaterne til et mere struktureret format. Efter behandling af dataene eksporteres de til et mere struktureret format såsom CSV, Excel eller en database. Organisationer er afhængige af tredjepartsintegrationer eller udvikler API'er for at automatisere denne proces, hvilket igen er tidskrævende. Derfor bør ideelle dataudtræksalgoritmer være fleksible og lette at kommunikere med eksterne datakilder.

Vil du udtrække data fra trykte eller håndskrevne formularer? Tjek Nanonets™ formular dataudtrækker gratis & automatiser eksporten af information fra enhver form!

Forstå dybden af formudtrækket med forskellige scenarier

Indtil videre har vi diskuteret de grundlæggende principper og udfordringer ved udtrækning af formulardata. I dette afsnit vil vi dykke dybt ned i forskellige scenarier og forstå dybden af udtræk af formulardata. Vi vil også se på, hvordan vi kan automatisere udvindingsprocessen for disse specifikke scenarier.

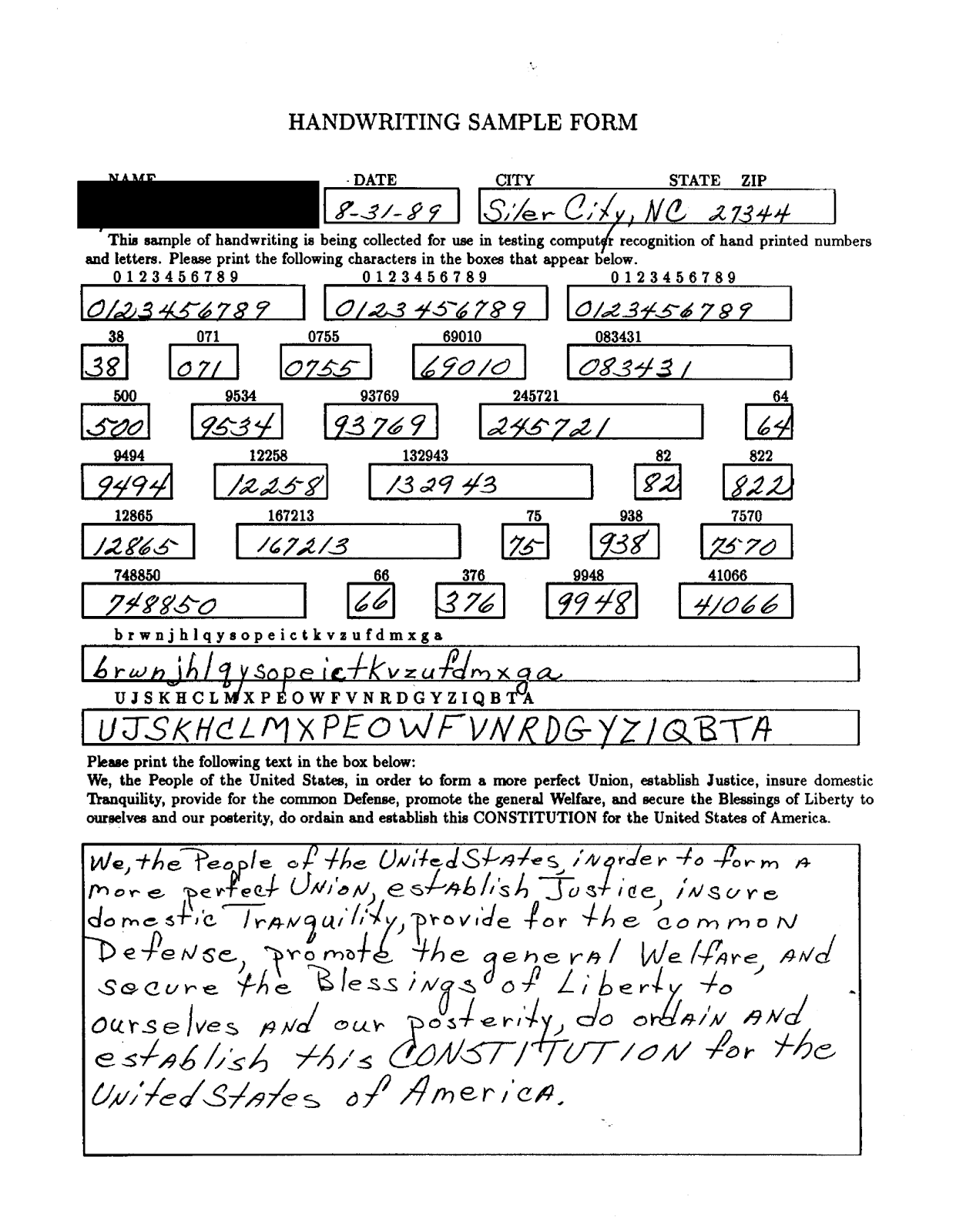

Scenario #1: Håndskrevet anerkendelse for offlineformularer

Offline formularer er almindeligt forekommende i dagligdagen. Det er bydende nødvendigt, at formularerne er nemme at udfylde og indsende. Manuel digitalisering af offline formularer kan være en hektisk og dyr opgave, og derfor er der brug for deep learning-algoritmer. Håndskrevne dokumenter er en stor udfordring at udtrække data fra på grund af kompleksiteten af de håndskrevne tegn. Derfor er datagenkendelsesalgoritmer meget brugt, hvorved en maskine lærer at læse og fortolke den håndskrevne tekst. Processen går ud på at scanne billeder af håndskrevne ord og konvertere dem til data, der kan behandles og analyseres af en algoritme. Algoritmen opretter derefter et tegnkort baseret på streger og genkender tilsvarende bogstaver for at udtrække teksten.

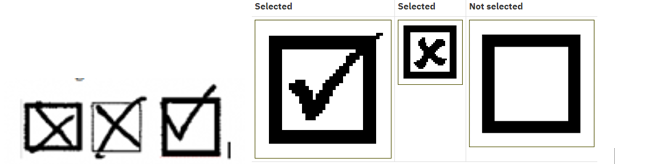

Scenario #2: Afkrydsningsfeltidentifikation på formularer

Afkrydsningsfeltformularer er en form for datainput, der bruges til at indsamle oplysninger fra en bruger i et inputfelt. Denne type data findes normalt i lister og tabeller, der kræver, at brugeren vælger et eller flere emner, såsom emner, de ønsker at blive kontaktet. Det kan findes et vilkårligt antal steder - online formularer, spørgeskemaer og undersøgelser og så videre. I dag kan nogle algoritmer automatisere dataudtrækningsprocessen selv fra afkrydsningsfelterne. Det primære mål med denne algoritme er at identificere inputregionerne ved hjælp af computervisionsteknikker. Disse involverer identifikation af linjer (vandrette og lodrette), påføring af filtre, konturer og detektering af kanter på billederne. Når inputområdet er identificeret, er det nemt at udtrække afkrydsningsfeltets indhold, der enten er markeret eller umarkeret.

Scenario #3: Layout Ændringer af formularen fra tid til anden

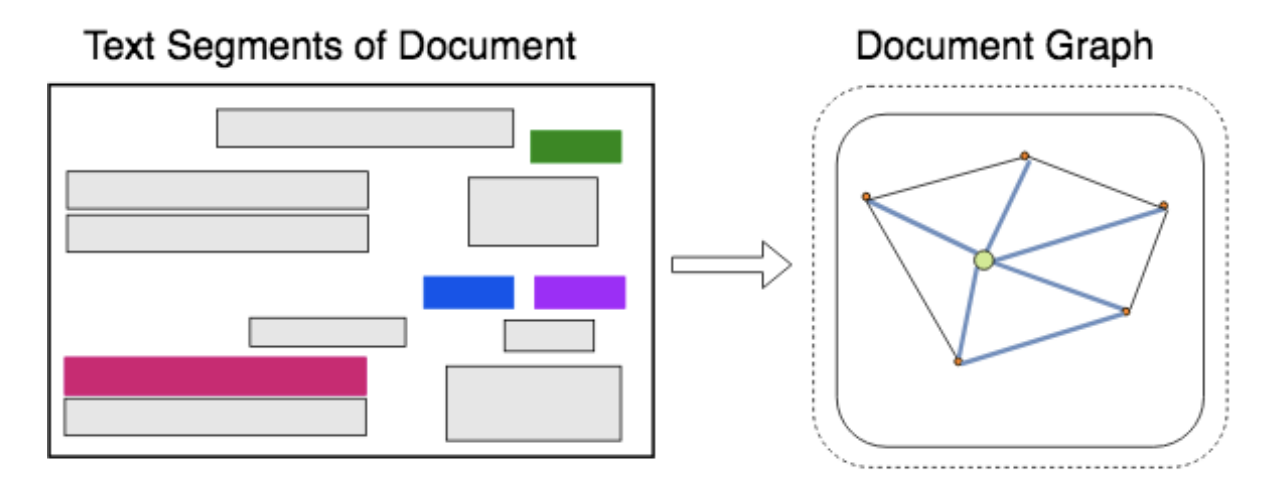

Når det kommer til at udfylde formularer, er der typisk to forskellige typer muligheder. For nogle formularer skal vi give vores oplysninger ved at skrive i alle relevante felter, mens vi for andre kan give oplysningerne ved at vælge fra nogle få afkrydsningsfelter. Formularens layout ændres også afhængigt af formulartypen og dens kontekst. Derfor er det vigtigt at bygge en algoritme, der kan håndtere flere ustrukturerede dokumenter og intelligent udtrække indhold afhængigt af formularetiketterne. En populær teknik til deep learning-arkitektur til at håndtere dokumentlayout er Graph CNN'er. Ideen bag Graph Convolutional Networks (GCN'er) er at sikre, at neuronaktiveringerne er datadrevne. De er designet til at fungere på grafer, som er sammensat af noder og kanter. Et graffoldningslag er i stand til at genkende mønstre i fravær af et opgavespecifikt træningssignal. Derfor er disse velegnede, når dataene er robuste.

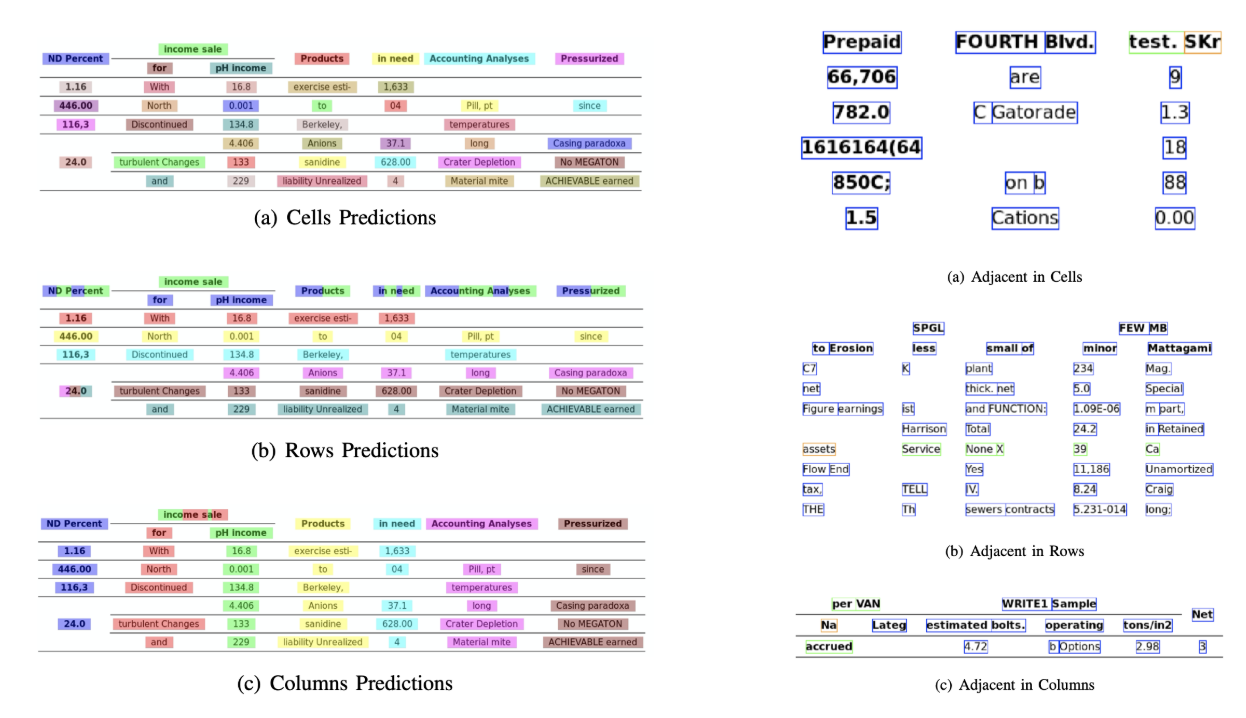

Scenario #4: Tabelcelledetektion

I nogle tilfælde støder virksomheder på særlige former for formularer, der består af tabelceller. Tabelceller er rektangulære områder inde i en tabel, hvor data gemmes. De kan klassificeres som overskrifter, rækker eller kolonner. En ideel algoritme bør identificere alle disse typer celler og deres grænser for at udtrække data fra dem. Nogle populære teknikker til bordudtrækning omfatter Stream og Lattice; disse er algoritmer, der kan hjælpe med at detektere linjer, former, polygoner ved at bruge simple isomorfe operationer på billeder.

Hvordan har Form Data Extraction Solutions udviklet sig?

Formulardataudtrækning har sin oprindelse i de dage før computeren, hvor folk håndterede papirformularer. Med fremkomsten af computing blev det muligt at gemme data elektronisk. Computerprogrammerne kunne bruge dataene til at lave rapporter, såsom salgsstatistik. Denne software kan også bruges til at udskrive postlabels, såsom navn og adresse på kunder, og udskrive fakturaer, såsom det skyldige beløb og den adresse, som det skal sendes til. I dag ser vi dog en anden version af softwaren til udtræk af formulardata; disse er meget nøjagtige, hurtigere og leverer dataene på en meget organiseret og struktureret måde. Lad os nu kort diskutere forskellige typer formdataudtrækningsteknikker.

- Regelbaseret fra dataudtræk: Regelbaseret udtræk er en teknik, der automatisk udtrækker data fra en bestemt skabelonformular. Det kan udtrække data uden menneskelig indgriben. De arbejder ved at undersøge forskellige felter på siden og beslutte, hvilke der skal udtrækkes baseret på omgivende tekst, etiketter og andre kontekstuelle spor. Disse algoritmer er normalt udviklet og automatiseret ved hjælp af ETL scripts eller web scraping. Men når de testes på usete data, fejler de fuldstændigt.

- Formdataudtræk ved hjælp af OCR: OCR er en go-to-løsning til enhver form for dataudtrækningsproblem. Man skal dog skrive yderligere scripts og programmer for at opnå nøjagtig ydeevne. For at OCR skal fungere, kræver det en indtastning af et billede med tekst på. Softwaren læser derefter hver pixel og sammenligner hver pixel med dens tilsvarende bogstav. Hvis det matcher, vil det udskrive det bogstav og eventuelle tal eller symboler tæt nok på bogstavet. Den største udfordring med OCR er at finde ud af, hvordan man adskiller bogstaver. For eksempel, når tonerne er tæt på hinanden eller overlapper hinanden, såsom "a" og "e". Derfor virker disse muligvis ikke, når vi udpakker offline formularer.

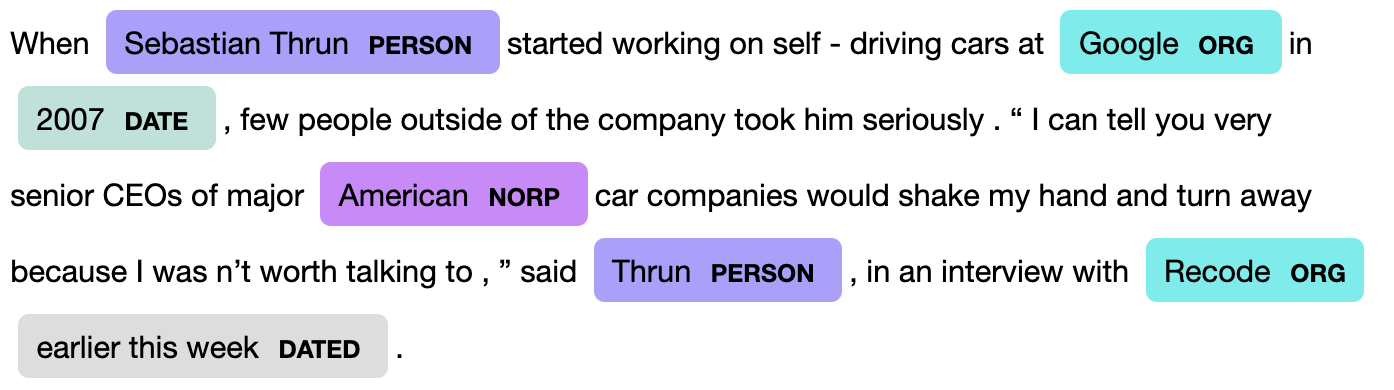

- NER for Form Data Extraction: Genkendelse af navngivne enheder er opgaven med at identificere og klassificere foruddefinerede enheder i naturlig sprogtekst. Det bruges ofte til at udtrække information fra formularer, hvor folk indtaster navne, adresser, kommentarer osv. Opgaven med at genkende navngivne enheder er tæt forbundet med den bredere opgave med coreference resolution, som afgør, om omtaler af de samme enheder refererer til samme enheder i den virkelige verden. I dag med avancerede programmeringsværktøjer og rammer kunne vi udnytte forudtrænede modeller til at bygge NER-baserede modeller til informationsudtrækningsopgaver.

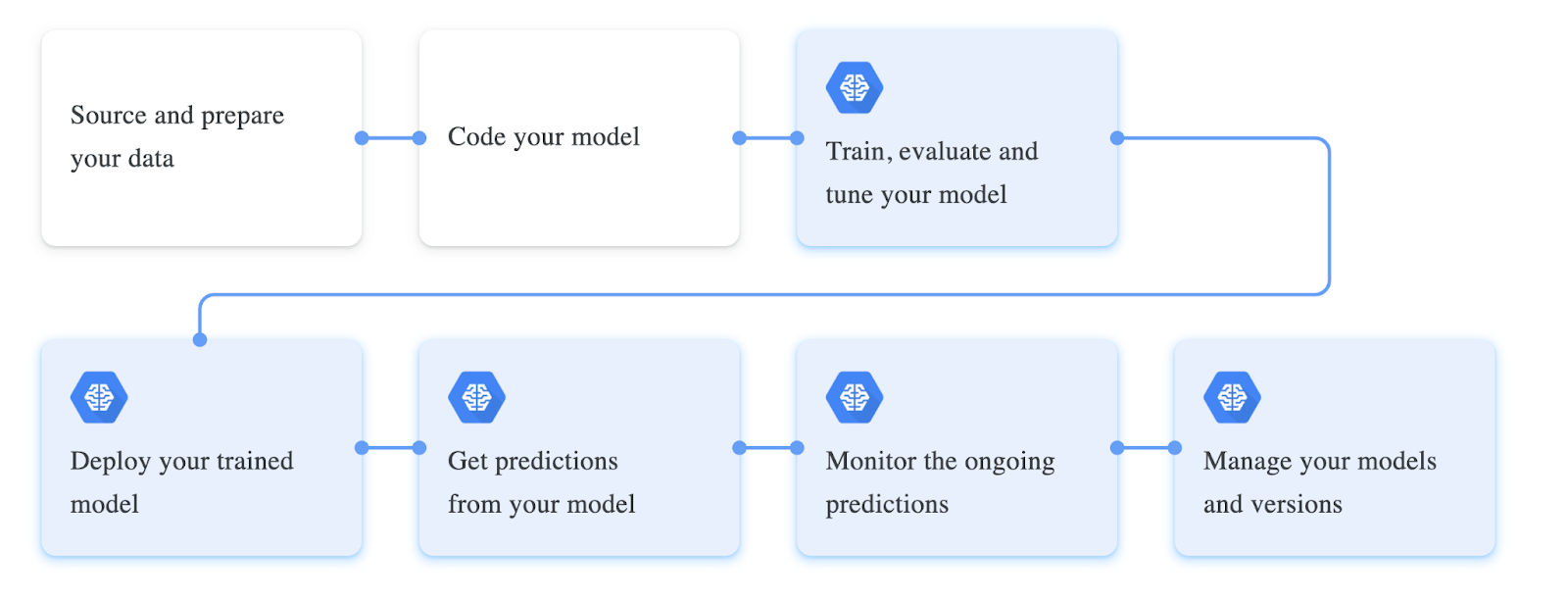

- Brug af Deep Learning til Form Data Extraction: Deep learning er ikke nyt, det har eksisteret i årtier, men den seneste udvikling inden for deep learning-arkitekturer og computerkraft har ført til banebrydende resultater. Formdataudtræk ved hjælp af dyb læring opnåede state-of-the-art ydeevne i næsten ethvert format, hvad enten det er digitalt eller håndskrevet. Processen begynder med at fodre det dybe neurale netværk (DNN) tusinder eller millioner af forskellige eksempler mærket med, hvad de er. For eksempel billedformede etiketter med dets enheder som navn, e-mail, id osv. DNN behandler al denne information og lærer på egen hånd, hvordan disse dele er forbundet. Men at opbygge en meget nøjagtig model kræver masser af ekspertise og eksperimenter.

Vil du udtrække data fra trykte eller håndskrevne formularer? Tjek Nanonets™ formular dataudtrækker gratis & automatiser eksporten af information fra enhver form!

Formulardataudtrækning ved hjælp af OCR'er

Der findes mange forskellige biblioteker til at udtrække data fra formularer. Men hvad hvis du vil udtrække data fra et billede af en formular? Det er her, Tesseract OCR (Optical Character Recognition) kommer ind i billedet. Tesseract er en open source OCR (Optical Character Recognition)-motor udviklet af HP. Ved hjælp af Tesseract OCR er det muligt at konvertere scannede dokumenter såsom papirfakturaer, kvitteringer og checks til søgbare, redigerbare digitale filer. Den er tilgængelig på flere sprog og kan genkende tegn i forskellige billedformater. Tesseract bruges typisk i kombination med andre biblioteker til at behandle billeder for at udtrække tekst.

For at teste dette skal du sørge for at installere Tesseract på din lokale maskine. Du kan enten bruge Tesseract CLI eller Python-bindinger til at køre OCR. Python-tesseract er en indpakning til Googles Tesseract-OCR Engine. Den kan bruges til at læse alle billedtyper, der understøttes af billedbibliotekerne Pillow og Leptonica, inklusive jpeg, png, gif, bmp, tiff og andre. Du kan nemt bruge det som et selvstændigt invokationsscript til at tessere, hvis det er nødvendigt.

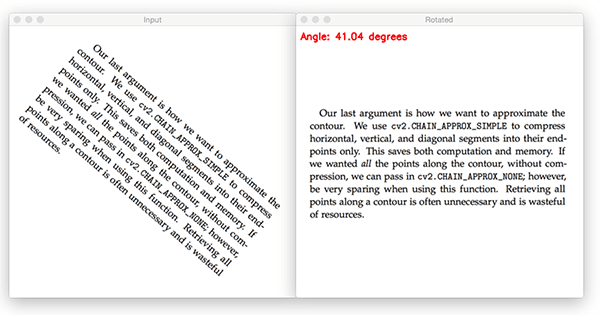

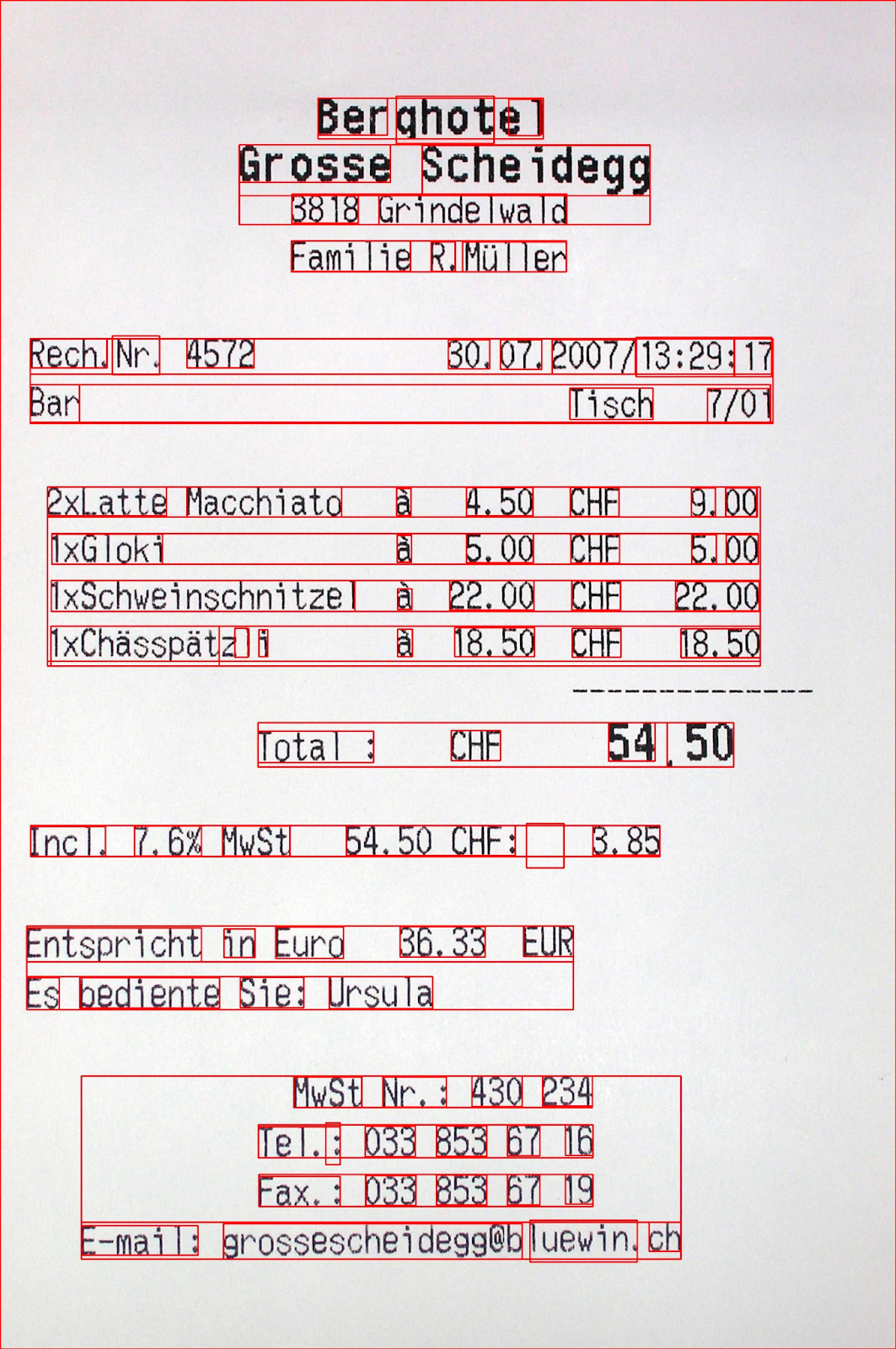

Lad os nu tage en kvittering indeholdende formulardata og prøve at identificere placeringen af teksten ved hjælp af Computer Vision og Tesseract.

import pytesseract

from pytesseract import Output

import cv2 img = cv2.imread('receipt.jpg')

d = pytesseract.image_to_data(img, output_type=Output.DICT)

n_boxes = len(d['level'])

for i in range(n_boxes): (x, y, w, h) = (d['left'][i], d['top'][i], d['width'][i], d['height'][i]) img = cv2.rectangle(img, (x, y), (x + w, y + h), (0, 0, 255), 2) cv2.imshow(img,'img')

Her i outputtet, som vi kan se, var programmet i stand til at identificere al teksten inde i formularen. Lad os nu anvende OCR på dette for at udtrække al information. Vi kan simpelthen gøre dette ved at bruge billede_til_streng funktion i Python.

extracted_text = pytesseract.image_to_string(img, lang = 'deu')

Output:

Berghotel

Grosse Scheidegg

3818 Grindelwald

Familie R.Müller Rech.Nr. 4572 30.07.2007/13:29: 17

Bar Tisch 7/01

2xLatte Macchiato &ä 4.50 CHF 9,00

1xGloki a 5.00 CH 5.00

1xSchweinschnitzel ä 22.00 CHF 22.00

IxChässpätz 1 a 18.50 CHF 18.50 Total: CHF 54.50 Incl. 7.6% MwSt 54.50 CHF: 3.85 Entspricht in Euro 36.33 EUR

Es bediente Sie: Ursula MwSt Nr. : 430 234

Tel.: 033 853 67 16

Fax.: 033 853 67 19

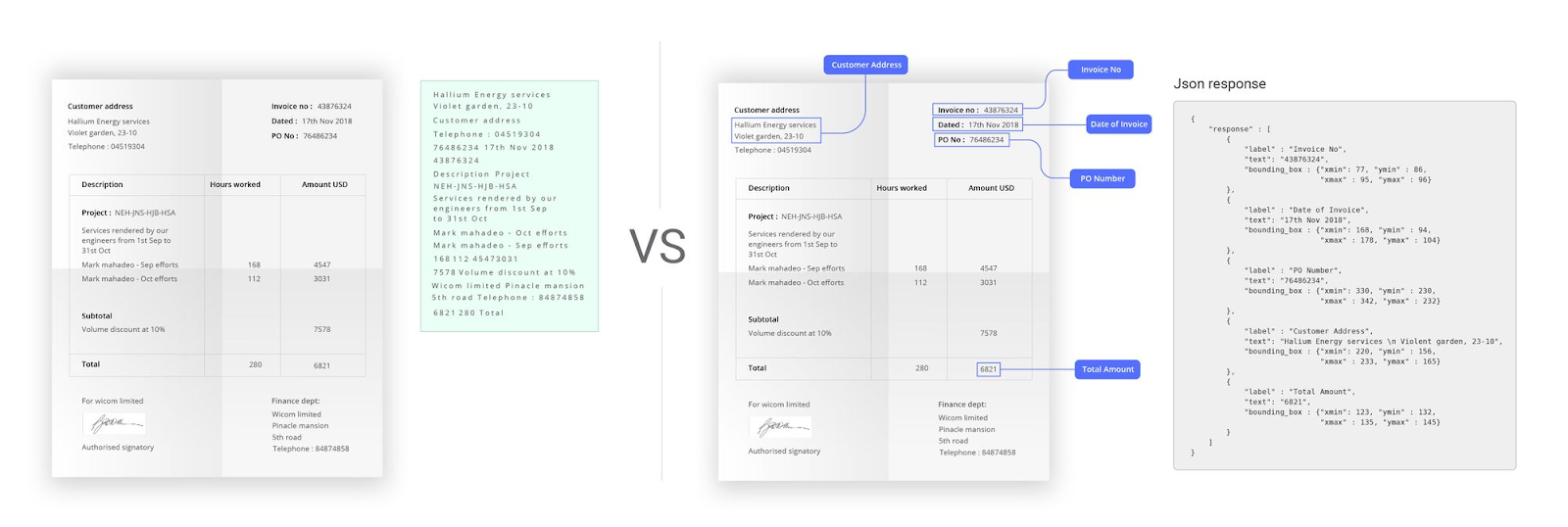

E-mail: grossescheidegs@b luewin. Ch Her er vi i stand til at udtrække alle oplysninger fra formularen. I de fleste tilfælde vil det dog ikke hjælpe at bruge OCR, da de udtrukne data vil være fuldstændig ustrukturerede. Derfor er brugere afhængige af nøgle-værdi-parudtræk på formularer, som kun kan identificere specifikke entiteter såsom ID, Datoer, Skattebeløb osv. Dette er kun muligt med deep learning. Lad os i det næste afsnit se på, hvordan vi kan udnytte forskellige deep learning-teknikker til at bygge informationsudtrækningsalgoritmer.

Løsning af formdataudtræk ved hjælp af Deep Learning

Graph Convolution til multimodal informationsudtrækning fra visuelt rige dokumenter

Graph Convolutional Networks (Graph CNN'er) er en klasse af dybe konvolutionelle neurale netværk (CNN'er), der effektivt kan lære meget ikke-lineære funktioner i grafdatastrukturer og samtidig bevare knude- og kantstrukturen. De kan tage grafdatastrukturer som input og generere 'feature maps' til noder og kanter. De resulterende funktioner kan bruges til grafklassificering, klyngedannelse eller fællesskabsdetektion. GCN'er giver en kraftfuld løsning til at udtrække information fra store, visuelt rige dokumenter såsom fakturaer og kvitteringer. For at behandle disse skal hvert billede transformeres til en graf bestående af noder og kanter. Ethvert ord på billedet er repræsenteret af sin egen node; visualisering af resten af dataene kodes i nodens feature-vektor.

Denne model koder først hvert tekstsegment i dokumentet til grafindlejring. Hvis du gør det, fanges den visuelle og tekstmæssige kontekst, der omgiver hvert tekstelement, sammen med dets placering eller placering i en tekstblok. Den kombinerer derefter disse grafer med tekstindlejringer for at skabe en overordnet repræsentation af dokumentets struktur og hvad der er skrevet i det. Modellen lærer at tildele tekster, der sandsynligvis er enheder, højere vægt baseret på deres placering i forhold til hinanden og den kontekst, hvori de optræder i en større blok af læsere. Endelig anvender den en standard BiLSTM-CRF-model til enhedsudvinding. Resultaterne viser, at denne algoritme overgår basismodellen (BiLSTM-CRF) med en bred margin.

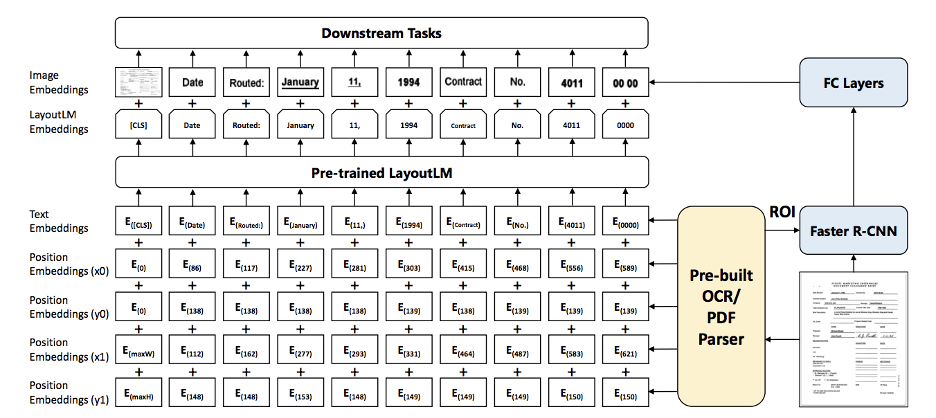

LayoutLM: Fortræning af tekst og layout til dokumentbilledeforståelse

Arkitekturen i LayoutLM-modellen er stærkt inspireret af BERT og inkorporerer billedindlejringer fra en Faster R-CNN. LayoutLM-inputindlejringer genereres som en kombination af tekst- og positionsindlejringer og kombineres derefter med billedindlejringer, der genereres af Faster R-CNN-modellen. Maskerede visuelle sprogmodeller og multi-label dokumentklassificering bruges primært som fortræningsopgaver til LayoutLM. LayoutLM-modellen er værdifuld, dynamisk og stærk nok til ethvert job, der kræver layoutforståelse, såsom formular-/kvitteringsudtrækning, klassificering af dokumentbilleder eller endda visuel besvarelse af spørgsmål kan udføres med denne træningsmodel.

LayoutLM-modellen blev trænet på IIT-CDIP Test Collection 1.0, som omfatter over 6 millioner dokumenter og mere end 11 millioner scannede dokumentbilleder på i alt over 12 GB data. Denne model havde væsentligt udkonkurreret adskillige SOTA-foruddannede modeller i formforståelse, kvitteringsforståelse og klassificering af scannede dokumentbilleder.

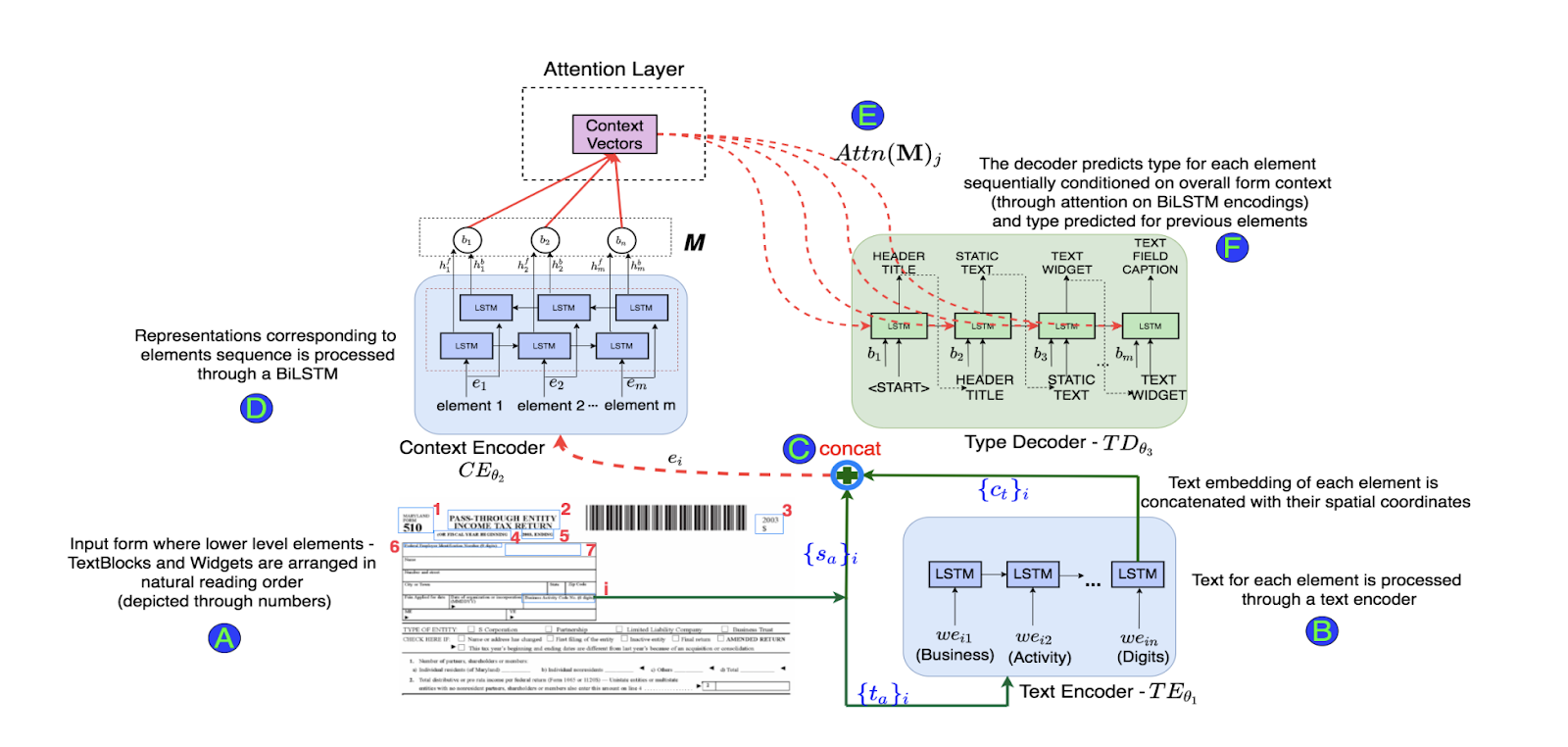

Form2Seq: En ramme for udtrækning af højere ordens formularstruktur

Form2Seq er en ramme, der fokuserer på at udtrække strukturer fra inputtekst ved hjælp af positionelle sekvenser. I modsætning til traditionelle seq2seq-rammer udnytter Form2Seq strukturernes relative rumlige positioner frem for deres rækkefølge.

I denne metode klassificerer vi først elementer på lavt niveau, der giver mulighed for bedre behandling og organisering. Der er 10 typer formularer, såsom felttekster, listeelementer og så videre. Dernæst grupperer vi elementer på lavere niveau, såsom tekstfelter og valgfelter, i højere ordens konstruktioner kaldet ChoiceGroups. Disse bruges som informationsindsamlingsmekanismer for at opnå bedre brugeroplevelse på lavere niveauelementer til højere ordens konstruktioner, såsom tekstfelter, valgfelter og valggrupper, der bruges som informationsindsamlingsmekanismer i formularer. Dette er muligt ved at arrangere de konstituerende elementer i en lineær rækkefølge i naturlig læserækkefølge og tilføre deres rumlige og tekstuelle repræsentationer til Seq2Seq-rammen. Seq2Seq-rammen laver sekventielt forudsigelser for hvert element i en sætning afhængigt af konteksten. Dette giver den mulighed for at behandle mere information og nå frem til en bedre forståelse af opgaven.

Modellen opnåede en nøjagtighed på 90 % på klassifikationsopgaven, hvilket var højere end segmenteringsbaserede basismodeller. F1 på tekstblokke, tekstfelter og valgfelter var henholdsvis 86.01 %, 61.63 %. Denne ramme opnåede status for resultaterne på ICDAR-datasættet til tabelstrukturgenkendelse.

Vil du udtrække data fra trykte eller håndskrevne formularer? Tjek Nanonets™ formular dataudtrækker gratis & automatiser eksporten af information fra enhver form!

Hvorfor Nanonets AI-baseret OCR er den bedste mulighed

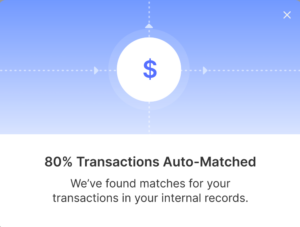

Selvom OCR-software kan konvertere scannede billeder af tekst til formaterede digitale filer såsom PDF'er, DOC'er og PPT'er, er det ikke altid nøjagtigt. Nutidens førende software som Nanonets AI-baserede OCR deep learning-system har overvundet mange udfordringer, som traditionelle OCR-systemer har stået over for, mens de har skabt en redigerbar fil fra et scannet dokument. Det er blevet den bedste mulighed for dataudtræk, fordi det kan give høje nøjagtighedshastigheder og høje toleranceniveauer for støj, grafiske elementer og formateringsændringer. Lad os nu diskutere et par punkter om, hvordan AI-baseret OCR er den bedste mulighed.

- OCR, som diskuteret, er en ligetil teknik til at udtrække data. De vil dog ikke fungere konsekvent, når de sættes på usete/nye data. Imidlertid kunne AI-baseret OCR håndtere situationer som disse, da de træner på en bred vifte af data.

- Normale OCR'er kan ikke håndtere komplekse layouts til formulardataudtræk. Derfor giver de de bedste resultater, når de er drevet med deep learning eller AI, ved at forstå dataens layout, tekst og kontekst.

- OCR'er kan underperforme, når der er støj i data, såsom skævheder, scannede billeder i svagt lys osv., mens deep learning-modeller kan håndtere sådanne forhold og stadig returnere meget nøjagtige resultater.

- AI-baserede OCR'er er meget tilpasselige og fleksible sammenlignet med traditionelle OCR'er; de kan bygges på forskellige slags data for at konvertere ustrukturerede data til ethvert struktureret format.

- Efterbehandlingsoutput fra AI-baseret OCR er tilgængelige sammenlignet med almindelig OCR; de kan eksporteres til alle dataformater såsom JSON, CSV, Excel Sheets eller endda en database såsom Postgres direkte fra modellen.

- AI-baseret OCR kan eksporteres som en simpel API ved hjælp af præ-trænede modeller. Dette er stadig muligt i andre traditionelle metoder, men det kan være svært at forbedre modellerne konsekvent til tiden. Mens den er på AI-baseret OCR, kan den automatisk indstilles ved fejl.

- Bordudtrækning er højst umuligt ved brug af lige OCR. Det kan dog gøres med lethed med kraften fra AI/DL. I dag kan AI-baserede OCR'er positivt pege tabelbaserede formularer inde i dokumenter og udtrække information.

- Hvis der er finansielle eller fortrolige data i dokumenter, kan AI-modeller også udføre svindelkontrol. Den leder grundlæggende efter redigeret/sløret tekst fra de scannede dokumenter og giver administratorerne besked. Duplikerede dokumenter eller oplysninger kan også identificeres gennem disse modeller. Mens OCR simpelthen fejler i sådanne tilfælde.

- &

- 67

- 7

- 9

- Konto

- præcis

- opnået

- tværs

- Yderligere

- adresse

- fremskreden

- AI

- algoritme

- algoritmer

- Alle

- Skønt

- beløb

- beløb

- En anden

- api

- API'er

- Anvendelse

- Anvendelse

- tilgang

- arkitektur

- omkring

- Automatiseret

- til rådighed

- baggrund

- Baseline

- I bund og grund

- grundlag

- bliver

- være

- BEDSTE

- Største

- Bloker

- Blog

- grænse

- bygge

- Bygning

- virksomheder

- Kapacitet

- billedtekster

- hvilken

- tilfælde

- Årsag

- udfordre

- udfordringer

- Kontrol

- klassificering

- indsamler

- Indsamling

- samling

- kombination

- kombineret

- kommentarer

- Fælles

- samfund

- sammenlignet

- komplekse

- computing

- computerkraft

- indhold

- indhold

- Omkostninger

- kunne

- skaber

- Oprettelse af

- afgørende

- Kunder

- data

- datasikkerhed

- Database

- Datoer

- designs

- Detektion

- udvikle

- udviklet

- udviklere

- udvikling

- forskellige

- digital

- Dimension

- diskutere

- dokumenter

- dynamisk

- nemt

- Edge

- Effektiv

- effektiv

- væsentlig

- euro

- eksempel

- Excel

- erfaring

- ekspertise

- Uddrag

- konfronteret

- hurtigere

- Feature

- Funktionalitet

- Fields

- Filtre

- Endelig

- finansielle

- Fornavn

- Fix

- flow

- formular

- format

- formularer

- fundet

- Framework

- bedrageri

- Gratis

- funktion

- Fundamentals

- generere

- mål

- gruppe

- hjælpe

- hjælpsom

- Høj

- stærkt

- Hvordan

- How To

- HTTPS

- idé

- Identifikation

- identificere

- billede

- KIMOs Succeshistorier

- vigtigt

- umuligt

- Forbedre

- I andre

- omfatter

- Herunder

- oplysninger

- inspirerede

- integrationer

- spørgsmål

- IT

- Job

- kendt

- Etiketter

- Sprog

- Sprog

- stor

- større

- føre

- læring

- Led

- Leverage

- Udnytter

- Liste

- Lister

- lokale

- placering

- placeringer

- maskine

- større

- manuel

- manuelt

- kort

- nævner

- million

- millioner

- model

- modeller

- mest

- navne

- Natural

- netværk

- net

- noder

- Støj

- Noter

- numre

- online

- Produktion

- Option

- Indstillinger

- ordrer

- organisation

- organisationer

- Andet

- Ellers

- Papir

- deltagere

- Mennesker

- ydeevne

- personale

- Populær

- mulig

- magt

- vigtigste

- Forudsigelser

- præsentere

- primære

- Problem

- behandle

- Processer

- Profil

- Program

- Programmering

- Programmer

- Fremskrivning

- give

- spørgsmål

- rækkevidde

- priser

- RE

- læsere

- Læsning

- årsager

- anerkender

- reducere

- Rapporter

- kræver

- REST

- Resultater

- Risiko

- kører

- salg

- scanne

- scanning

- sikker

- sikkerhed

- segmentering

- valgt

- former

- Kort

- Simpelt

- So

- Software

- Løsninger

- påbegyndt

- Tilstand

- state-of-the-art

- statistik

- butik

- strøm

- stærk

- Understøttet

- systemet

- Systemer

- opgaver

- skat

- teknikker

- prøve

- tredjepart

- tusinder

- Gennem

- tid

- tidskrævende

- i dag

- sammen

- tolerance

- værktøjer

- traditionelle

- Kurser

- Transformation

- forstå

- brug

- brugere

- sædvanligvis

- vision

- visualisering

- W

- web

- Hvad

- Hvad er

- hvorvidt

- inden for

- uden

- ord

- Arbejde

- arbejder

- virker

- skrivning

- X