AutoML giver dig mulighed for at udlede hurtig, generel indsigt fra dine data lige i begyndelsen af et maskinlæringsprojekts (ML)-projektlivscyklus. At forstå på forhånd, hvilke forbehandlingsteknikker og algoritmetyper, der giver de bedste resultater, reducerer tiden til at udvikle, træne og implementere den rigtige model. Det spiller en afgørende rolle i enhver models udviklingsproces og giver dataforskere mulighed for at fokusere på de mest lovende ML-teknikker. Derudover giver AutoML en baseline modelydelse, der kan tjene som referencepunkt for datavidenskabsteamet.

Et AutoML-værktøj anvender en kombination af forskellige algoritmer og forskellige forbehandlingsteknikker til dine data. For eksempel kan den skalere dataene, udføre univariat funktionsvalg, udføre PCA ved forskellige varianstærskelniveauer og anvende klyngedannelse. Sådanne forbehandlingsteknikker kan anvendes individuelt eller kombineres i en rørledning. Efterfølgende vil et AutoML-værktøj træne forskellige modeltyper, såsom Linear Regression, Elastic-Net eller Random Forest, på forskellige versioner af dit forbehandlede datasæt og udføre hyperparameteroptimering (HPO). Amazon SageMaker Autopilot eliminerer de tunge løft ved at bygge ML-modeller. Efter at have leveret datasættet, udforsker SageMaker Autopilot automatisk forskellige løsninger for at finde den bedste model. Men hvad nu hvis du vil implementere din skræddersyede version af en AutoML-workflow?

Dette indlæg viser, hvordan du opretter et skræddersyet AutoML-workflow på Amazon SageMaker ved brug af Amazon SageMaker Automatisk Model Tuning med eksempelkode tilgængelig i en GitHub repo.

Løsningsoversigt

Lad os antage, at du er en del af et datavidenskabsteam, der udvikler modeller i et specialiseret domæne. Du har udviklet et sæt tilpassede forbehandlingsteknikker og udvalgt en række algoritmer, som du typisk forventer fungerer godt med dit ML-problem. Når du arbejder på nye ML use cases, vil du gerne først udføre en AutoML-kørsel ved hjælp af dine forbehandlingsteknikker og algoritmer for at indsnævre omfanget af potentielle løsninger.

I dette eksempel bruger du ikke et specialiseret datasæt; i stedet arbejder du med California Housing-datasættet, som du vil importere fra Amazon Simple Storage Service (Amazon S3). Fokus er at demonstrere den tekniske implementering af løsningen ved hjælp af SageMaker HPO, som senere kan anvendes på ethvert datasæt og domæne.

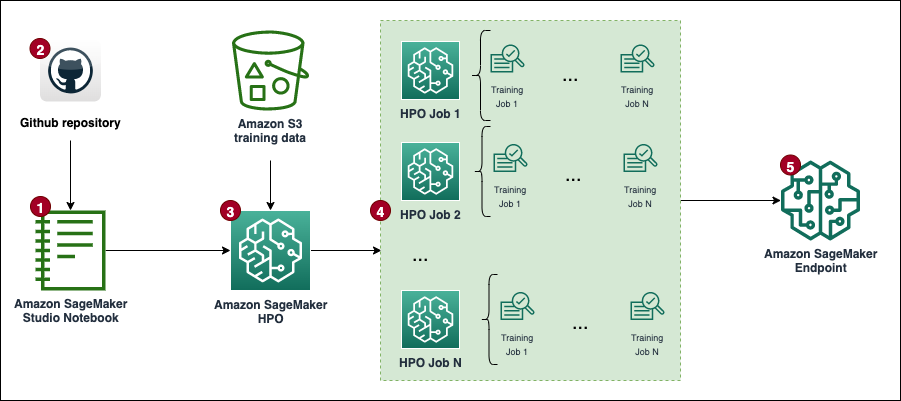

Følgende diagram viser den overordnede løsnings arbejdsgang.

Forudsætninger

Følgende er forudsætninger for at gennemføre gennemgangen i dette indlæg:

Implementer løsningen

Den fulde kode er tilgængelig i GitHub repo.

Trinene til at implementere løsningen (som angivet i arbejdsflowdiagrammet) er som følger:

- Opret en notesbogsforekomst og angiv følgende:

- Til Notebook-forekomsttype, vælg ml.t3.medium.

- Til Elastisk slutning, vælg ingen.

- Til Platform identifikator, vælg Amazon Linux 2, Jupyter Lab 3.

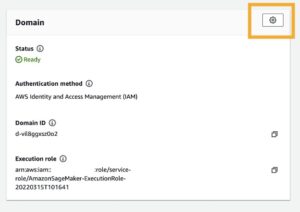

- Til IAM rolle, vælg standard

AmazonSageMaker-ExecutionRole. Hvis den ikke findes, skal du oprette en ny AWS identitets- og adgangsstyring (IAM) rolle og vedhæft AmazonSageMakerFullAccess IAM-politik.

Bemærk, at du skal oprette en udførelsesrolle og -politik med minimalt omfang i produktionen.

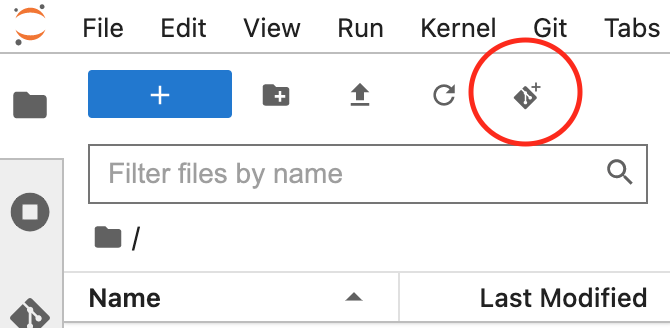

- Åbn JupyterLab-grænsefladen for din notebook-forekomst og klon GitHub-repoen.

Du kan gøre det ved at starte en ny terminalsession og køre git clone <REPO> kommando eller ved at bruge UI-funktionaliteten, som vist på det følgende skærmbillede.

- Åbne

automl.ipynbnotesbog fil, skal du vælgeconda_python3kerne, og følg instruktionerne for at udløse en sæt af HPO-job.

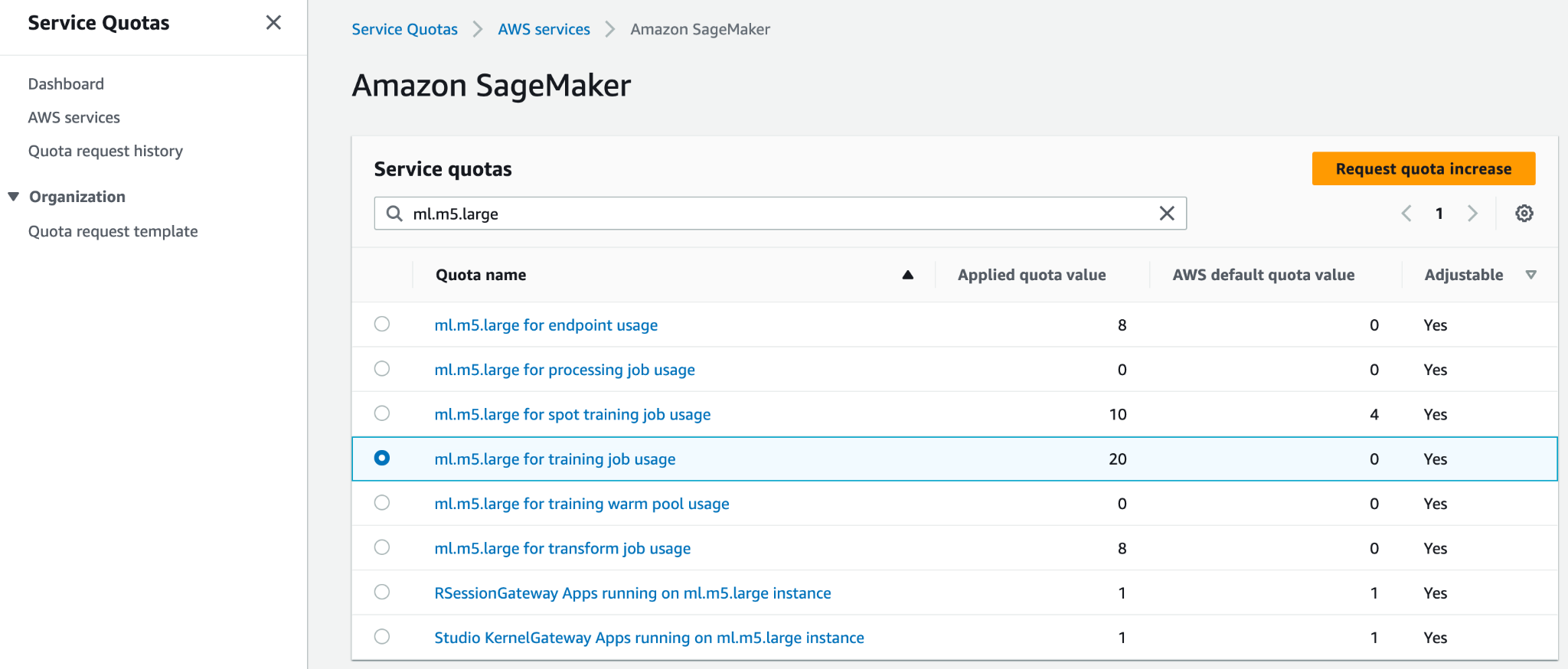

For at køre koden uden ændringer skal du øge servicekvoten for ml.m5.large til træningsjobbrug , Antal forekomster på tværs af alle uddannelsesjob. AWS tillader som standard kun 20 parallelle SageMaker træningsjob for begge kvoter. Du skal anmode om en kvoteforhøjelse til 30 for begge. Begge kvoteændringer bør typisk godkendes inden for få minutter. Henvise til Anmodning om kontingentforhøjelse for mere information.

Hvis du ikke ønsker at ændre kvoten, kan du blot ændre værdien af MAX_PARALLEL_JOBS variabel i scriptet (for eksempel til 5).

- Hvert HPO-job vil fuldføre et sæt af træningsjob forsøg og indikere modellen med optimale hyperparametre.

- Analyser resultaterne og implementere den bedst ydende model.

Denne løsning vil medføre omkostninger på din AWS-konto. Omkostningerne ved denne løsning vil afhænge af antallet og varigheden af HPO træningsjob. Når disse stiger, vil omkostningerne også øges. Du kan reducere omkostningerne ved at begrænse træningstiden og konfigurere TuningJobCompletionCriteriaConfig i henhold til instruktionerne diskuteret senere i dette indlæg. For prisoplysninger, se Amazon SageMaker-priser.

I de følgende afsnit diskuterer vi notesbogen mere detaljeret med kodeeksempler og trinene til at analysere resultaterne og vælge den bedste model.

Indledende opsætning

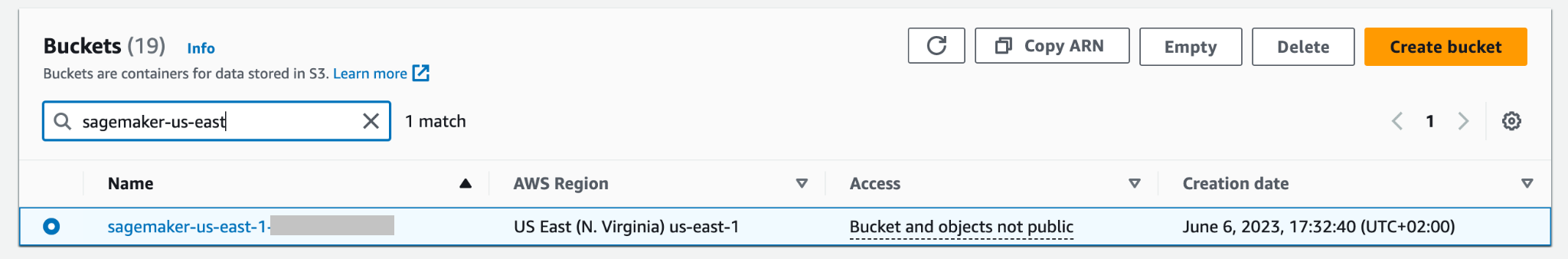

Lad os starte med at køre Import og opsætning afsnit i custom-automl.ipynb notesbog. Den installerer og importerer alle de nødvendige afhængigheder, instansierer en SageMaker-session og klient og indstiller standardregionen og S3-bøtten til lagring af data.

Forberedelse af data

Download California Housing-datasættet og klargør det ved at køre Download data del af notesbogen. Datasættet er opdelt i trænings- og testdatarammer og uploades til SageMaker-sessionens standard S3-bøtte.

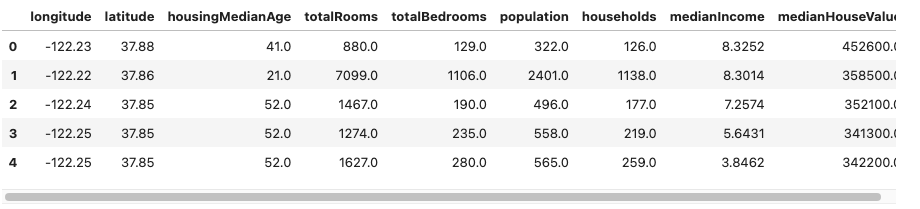

Hele datasættet har 20,640 poster og 9 kolonner i alt, inklusive målet. Målet er at forudsige medianværdien af et hus (medianHouseValue kolonne). Følgende skærmbillede viser de øverste rækker af datasættet.

Træning script skabelon

AutoML-arbejdsgangen i dette indlæg er baseret på scikit-lære forbehandling af pipelines og algoritmer. Målet er at generere en stor kombination af forskellige forbehandlingspipelines og algoritmer for at finde den bedst ydende opsætning. Lad os starte med at oprette et generisk træningsscript, som fastholdes lokalt på notebook-forekomsten. I dette script er der to tomme kommentarblokke: en til at injicere hyperparametre og den anden til forbehandlingsmodel-pipelineobjektet. De vil blive injiceret dynamisk for hver forbehandlingsmodelkandidat. Formålet med at have ét generisk script er at holde implementeringen TØR (gentag ikke dig selv).

Opret forbehandling og modelkombinationer

preprocessors ordbogen indeholder en specifikation af forbehandlingsteknikker anvendt på alle inputfunktioner i modellen. Hver opskrift defineres ved hjælp af en Pipeline eller FeatureUnion objekt fra scikit-learn, som kæder individuelle datatransformationer sammen og stabler dem sammen. For eksempel, mean-imp-scale er en simpel opskrift, der sikrer, at manglende værdier imputeres ved hjælp af middelværdier af respektive kolonner, og at alle funktioner skaleres ved hjælp af StandardScaler. I modsætning hertil mean-imp-scale-pca opskriften kæder nogle flere operationer sammen:

- Indregn manglende værdier i kolonner med deres middelværdi.

- Anvend funktionsskalering ved hjælp af middelværdi og standardafvigelse.

- Beregn PCA oven på inputdataene ved en specificeret varianstærskelværdi og flet den sammen med de imputerede og skalerede inputfunktioner.

I dette indlæg er alle inputfunktioner numeriske. Hvis du har flere datatyper i dit inputdatasæt, bør du angive en mere kompliceret pipeline, hvor forskellige forbehandlingsgrene anvendes på forskellige funktionstypesæt.

models ordbogen indeholder specifikationer for forskellige algoritmer, som du tilpasser datasættet til. Hver modeltype leveres med følgende specifikation i ordbogen:

- script_output – Peger på placeringen af træningsscriptet, der bruges af estimatoren. Dette felt udfyldes dynamisk, når

modelsordbogen er kombineret medpreprocessorsordbog. - indsættelser – Definerer kode, der vil blive indsat i

script_draft.pyog efterfølgende gemt underscript_output. Nøglen“preprocessor”efterlades med vilje tom, fordi denne placering er udfyldt med en af præprocessorerne for at skabe flere model-preprocessor-kombinationer. - hyperparametre – Et sæt hyperparametre, der er optimeret af HPO-jobbet.

- include_cls_metadata – Flere konfigurationsdetaljer kræves af SageMaker

Tunerklasse.

Et fuldt eksempel på models ordbogen er tilgængelig i GitHub-lageret.

Lad os derefter gentage preprocessors , models ordbøger og skabe alle mulige kombinationer. For eksempel, hvis din preprocessors ordbogen indeholder 10 opskrifter, og du har 5 modeldefinitioner i models ordbog, indeholder den nyoprettede pipelines-ordbog 50 preprocessor-model pipelines, der evalueres under HPO. Bemærk, at individuelle pipeline-scripts ikke er oprettet endnu på dette tidspunkt. Den næste kodeblok (celle 9) i Jupyter-notebooken itererer gennem alle præprocessor-modelobjekter i pipelines ordbog, indsætter alle relevante kodestykker og bevarer en pipeline-specifik version af scriptet lokalt i notesbogen. Disse scripts bruges i de næste trin, når du opretter individuelle estimatorer, som du tilslutter HPO-jobbet.

Definer estimatorer

Du kan nu arbejde på at definere SageMaker Estimators, som HPO-jobbet bruger, efter at scripts er klar. Lad os starte med at oprette en indpakningsklasse, der definerer nogle fælles egenskaber for alle estimatorer. Det arver fra SKLearn klasse og specificerer rollen, forekomstantal og type, samt hvilke kolonner der bruges af scriptet som funktioner og målet.

Lad os bygge estimators ordbog ved at gentage alle scripts genereret før og placeret i scripts vejviser. Du instansierer en ny estimator ved hjælp af SKLearnBase klasse med et unikt estimatornavn og et af scripts. Bemærk, at estimators ordbogen har to niveauer: det øverste niveau definerer en pipeline_family. Dette er en logisk gruppering baseret på typen af modeller, der skal evalueres og er lig med længden af models ordbog. Det andet niveau indeholder individuelle præprocessortyper kombineret med de givne pipeline_family. Denne logiske gruppering er påkrævet, når du opretter HPO-jobbet.

Definer HPO-tuner-argumenter

At optimere overførsel af argumenter til HPO Tuner klasse, den HyperparameterTunerArgs dataklassen initialiseres med argumenter, der kræves af HPO-klassen. Den leveres med et sæt funktioner, som sikrer, at HPO-argumenter returneres i et format, der forventes, når der implementeres flere modeldefinitioner på én gang.

Den næste kodeblok bruger den tidligere introducerede HyperparameterTunerArgs dataklasse. Du opretter en anden ordbog kaldet hp_args og generere et sæt inputparametre, der er specifikke for hver estimator_family fra estimators ordbog. Disse argumenter bruges i det næste trin ved initialisering af HPO-job for hver modelfamilie.

Opret HPO-tunerobjekter

I dette trin opretter du individuelle tunere til hver estimator_family. Hvorfor opretter du tre separate HPO-job i stedet for kun at lancere ét på tværs af alle estimatorer? Det HyperparameterTuner klasse er begrænset til 10 modeldefinitioner knyttet til den. Derfor er hver HPO ansvarlig for at finde den bedst ydende præprocessor til en given modelfamilie og tune denne modelfamilies hyperparametre.

Følgende er et par punkter mere vedrørende opsætningen:

- Optimeringsstrategien er Bayesian, hvilket betyder, at HPO aktivt overvåger udførelsen af alle forsøg og navigerer optimeringen mod mere lovende hyperparameterkombinationer. Tidlig stop bør indstilles til af or Auto når man arbejder med en Bayesiansk strategi, som selv håndterer den logik.

- Hvert HPO-job kører for maksimalt 100 job og kører 10 job parallelt. Hvis du har at gøre med større datasæt, vil du måske øge det samlede antal job.

- Derudover vil du måske bruge indstillinger, der styrer, hvor længe et job kører, og hvor mange job din HPO udløser. En måde at gøre det på er at indstille den maksimale køretid i sekunder (for dette indlæg sætter vi den til 1 time). En anden er at bruge den nyligt udgivne

TuningJobCompletionCriteriaConfig. Den tilbyder et sæt indstillinger, der overvåger fremskridtene for dine jobs og afgør, om det er sandsynligt, at flere job vil forbedre resultatet. I dette indlæg sætter vi det maksimale antal træningsjob, der ikke forbedres, til 20. På den måde, hvis scoren ikke forbedres (f.eks. fra den fyrretyvende prøve), skal du ikke betale for de resterende forsøg indtil kl.max_jobser nået.

Lad os nu iterere gennem tuners , hp_args ordbøger og udløser alle HPO-job i SageMaker. Bemærk brugen af wait-argumentet sat til False, hvilket betyder, at kernen ikke vil vente, indtil resultaterne er færdige, og du kan udløse alle job på én gang.

Det er sandsynligt, at ikke alle træningsjob vil fuldføre, og nogle af dem kan blive stoppet af HPO-jobbet. Grunden til dette er TuningJobCompletionCriteriaConfig– optimeringen afsluttes, hvis nogle af de angivne kriterier er opfyldt. I dette tilfælde, når optimeringskriterierne ikke forbedres for 20 på hinanden følgende job.

Analyser resultater

Celle 15 i notesbogen kontrollerer, om alle HPO-job er fuldførte, og kombinerer alle resultater i form af en panda-dataramme til yderligere analyse. Inden vi analyserer resultaterne i detaljer, lad os tage et kig på højt niveau på SageMaker-konsollen.

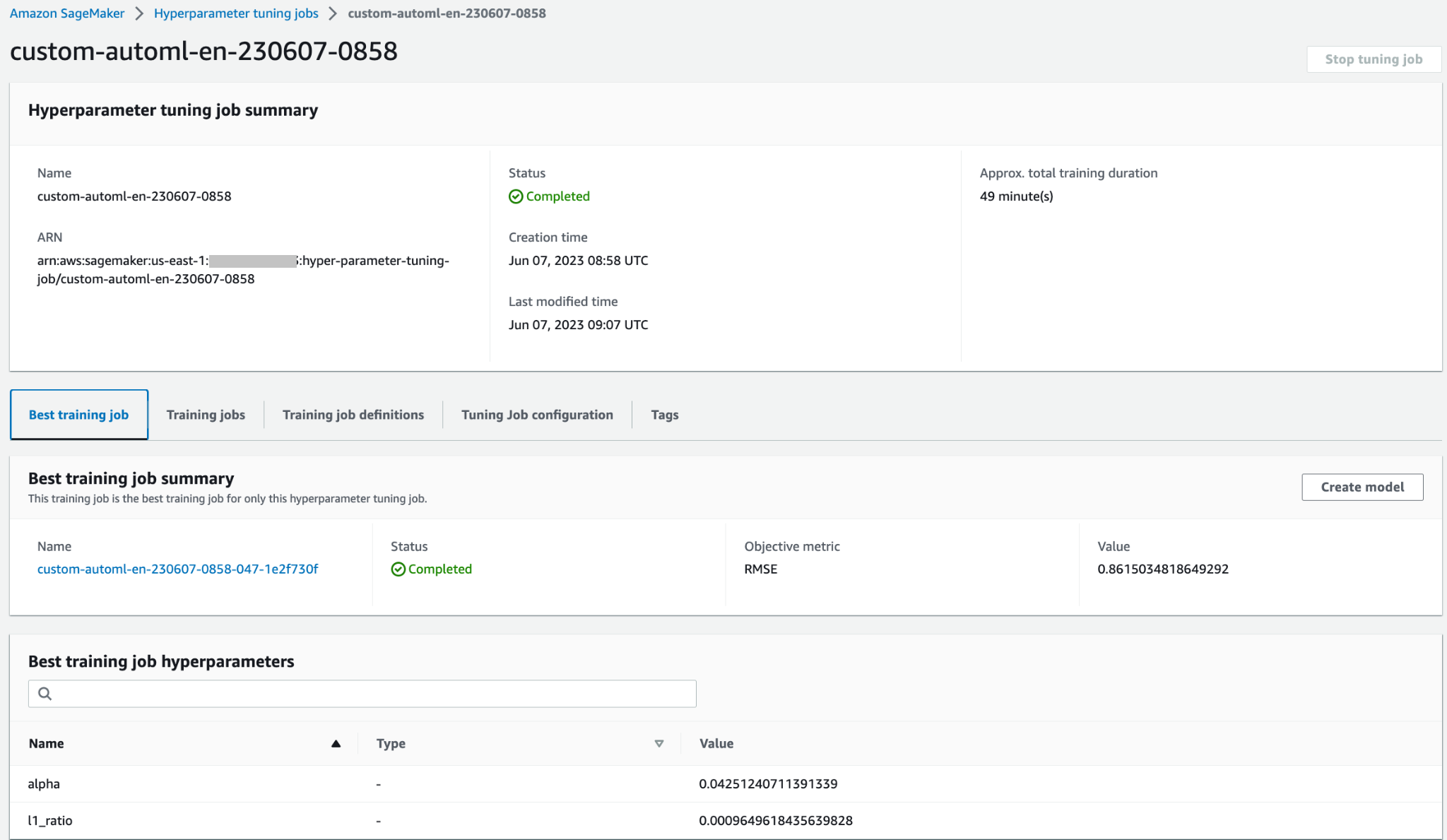

På toppen af Hyperparameter tuning job side, kan du se dine tre lancerede HPO-job. De blev alle færdige tidligt og udførte ikke alle 100 træningsjob. På det følgende skærmbillede kan du se, at Elastic-Net modelfamilien gennemførte det højeste antal forsøg, mens andre ikke behøvede så mange træningsjobs for at finde det bedste resultat.

Du kan åbne HPO-jobbet for at få adgang til flere detaljer, såsom individuelle træningsjob, jobkonfiguration og oplysninger og ydeevne for det bedste træningsjob.

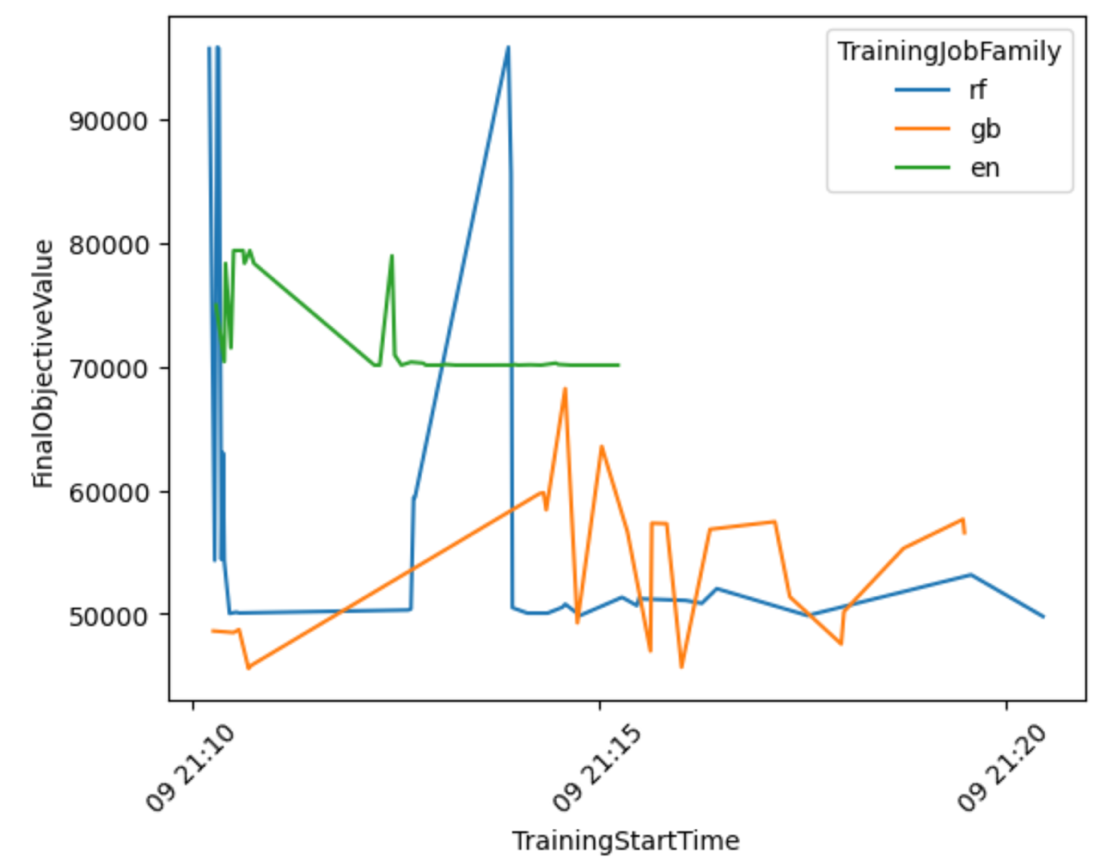

Lad os producere en visualisering baseret på resultaterne for at få mere indsigt i AutoML-arbejdsgangens ydeevne på tværs af alle modelfamilier.

Ud fra følgende graf kan du konkludere, at Elastic-Net modellens ydeevne svingede mellem 70,000 og 80,000 RMSE og gik i sidste ende i stå, da algoritmen ikke var i stand til at forbedre sin ydeevne på trods af at have prøvet forskellige forbehandlingsteknikker og hyperparameterværdier. Det ser det også ud til RandomForest ydeevnen varierede meget afhængigt af hyperparametersættet, som HPO udforskede, men trods mange forsøg kunne det ikke gå under 50,000 RMSE-fejlen. GradientBoosting opnået den bedste præstation allerede fra starten under 50,000 RMSE. HPO forsøgte at forbedre dette resultat yderligere, men var ikke i stand til at opnå bedre ydeevne på tværs af andre hyperparameterkombinationer. En generel konklusion for alle HPO-job er, at der ikke krævedes så mange job for at finde det bedst ydende sæt hyperparametre for hver algoritme. For yderligere at forbedre resultatet skal du eksperimentere med at skabe flere funktioner og udføre yderligere funktionsudvikling.

Du kan også undersøge en mere detaljeret visning af model-preprocessor-kombinationen for at drage konklusioner om de mest lovende kombinationer.

Vælg den bedste model og implementer den

Følgende kodestykke vælger den bedste model baseret på den lavest opnåede målværdi. Du kan derefter implementere modellen som et SageMaker-slutpunkt.

Ryd op

For at forhindre uønskede debiteringer på din AWS-konto anbefaler vi at slette de AWS-ressourcer, som du brugte i dette indlæg:

- På Amazon S3-konsollen skal du tømme dataene fra S3-bøtten, hvor træningsdataene blev gemt.

- Stop notebook-forekomsten på SageMaker-konsollen.

- Slet modelslutpunktet, hvis du har implementeret det. Slutpunkter bør slettes, når de ikke længere er i brug, fordi de faktureres efter den tid, der er implementeret.

Konklusion

I dette indlæg viste vi, hvordan man opretter et tilpasset HPO-job i SageMaker ved hjælp af et tilpasset udvalg af algoritmer og forbehandlingsteknikker. Dette eksempel demonstrerer især, hvordan man automatiserer processen med at generere mange træningsscripts, og hvordan man bruger Python-programmeringsstrukturer til effektiv implementering af flere parallelle optimeringsopgaver. Vi håber, at denne løsning vil danne stilladset for alle tilpassede modeljusteringsjob, du vil implementere ved hjælp af SageMaker for at opnå højere ydeevne og fremskynde dine ML-arbejdsgange.

Tjek følgende ressourcer for yderligere at uddybe din viden om, hvordan du bruger SageMaker HPO:

Om forfatterne

Konrad Semsch er Senior ML Solutions Architect hos Amazon Web Services Data Lab Team. Han hjælper kunder med at bruge maskinlæring til at løse deres forretningsudfordringer med AWS. Han nyder at opfinde og forenkle for at give kunderne enkle og pragmatiske løsninger til deres AI/ML-projekter. Han er mest passioneret omkring MlOps og traditionel datavidenskab. Uden for arbejdet er han stor fan af windsurfing og kitesurfing.

Konrad Semsch er Senior ML Solutions Architect hos Amazon Web Services Data Lab Team. Han hjælper kunder med at bruge maskinlæring til at løse deres forretningsudfordringer med AWS. Han nyder at opfinde og forenkle for at give kunderne enkle og pragmatiske løsninger til deres AI/ML-projekter. Han er mest passioneret omkring MlOps og traditionel datavidenskab. Uden for arbejdet er han stor fan af windsurfing og kitesurfing.

Tun Ersoy er Senior Solutions Architect hos AWS. Hendes primære fokus er at hjælpe kunder i den offentlige sektor med at anvende cloud-teknologier til deres arbejdsbelastninger. Hun har en baggrund i applikationsudvikling, virksomhedsarkitektur og kontaktcenterteknologier. Hendes interesser omfatter serverløse arkitekturer og AI/ML.

Tun Ersoy er Senior Solutions Architect hos AWS. Hendes primære fokus er at hjælpe kunder i den offentlige sektor med at anvende cloud-teknologier til deres arbejdsbelastninger. Hun har en baggrund i applikationsudvikling, virksomhedsarkitektur og kontaktcenterteknologier. Hendes interesser omfatter serverløse arkitekturer og AI/ML.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/implement-a-custom-automl-job-using-pre-selected-algorithms-in-amazon-sagemaker-automatic-model-tuning/

- :har

- :er

- :ikke

- :hvor

- $OP

- 000

- 1

- 10

- 100

- 12

- 13

- 14

- 15 %

- 20

- 2000

- 22

- 25

- 28

- 30

- 39

- 50

- 7

- 70

- 8

- 80

- 9

- a

- I stand

- Om

- adgang

- Ifølge

- Konto

- opnå

- opnået

- tværs

- aktivt

- Yderligere

- Derudover

- vedtage

- Efter

- AI / ML

- sigte

- algoritme

- algoritmer

- Alle

- tillade

- tillader

- allerede

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- analyse

- analysere

- analysere

- ,

- En anden

- enhver

- Anvendelse

- Application Development

- anvendt

- gælder

- Indløs

- godkendt

- arkitektur

- ER

- argument

- argumenter

- AS

- antage

- At

- vedhæfte

- auto

- automatisere

- Automatisk Ur

- automatisk

- AutoML

- til rådighed

- AWS

- baggrund

- bund

- baseret

- Baseline

- Bayesiansk

- BE

- fordi

- før

- Begyndelse

- jf. nedenstående

- BEDSTE

- Bedre

- mellem

- Big

- Bloker

- Blocks

- både

- grene

- bygge

- Bygning

- virksomhed

- men

- .

- by

- california

- ringe

- kaldet

- CAN

- kandidat

- tilfælde

- tilfælde

- center

- kæder

- udfordringer

- lave om

- Ændringer

- afgifter

- Kontrol

- Vælg

- klasse

- CLF

- kunde

- Cloud

- Cluster

- klyngedannelse

- kode

- Kolonne

- Kolonner

- kombination

- kombinationer

- kombineret

- kombinerer

- kommer

- KOMMENTAR

- Fælles

- fuldføre

- Afsluttet

- færdiggøre

- kompliceret

- konkluderer

- konklusion

- Adfærd

- Konfiguration

- træk

- Konsol

- kontakt

- kontaktcenter

- indeholder

- kontrast

- kontrol

- Koste

- Omkostninger

- kunne

- skabe

- oprettet

- Oprettelse af

- kriterier

- afgørende

- For øjeblikket

- skik

- Kunder

- data

- datalogi

- datasæt

- beskæftiger

- beslutte

- uddybe

- Standard

- definerede

- definerer

- definere

- definitioner

- demonstrere

- demonstrerer

- afhænge

- afhængigheder

- Afhængigt

- indsætte

- indsat

- implementering

- implementering

- udlede

- Trods

- detail

- detaljeret

- detaljer

- udvikle

- udviklet

- Udvikling

- udvikler

- afvigelse

- DICT

- forskellige

- mapper

- diskutere

- drøftet

- do

- Er ikke

- domæne

- Dont

- ned

- tegne

- tørre

- varighed

- i løbet af

- dynamisk

- hver

- Tidligt

- effektiv

- eliminerer

- muliggøre

- Endpoint

- Engineering

- sikre

- sikrer

- Enterprise

- Hele

- helt

- lige

- fejl

- evaluere

- evalueret

- til sidst

- Hver

- undersøge

- eksempel

- eksempler

- udførelse

- eksisterer

- forvente

- forventet

- eksperiment

- forklarede

- udforsket

- udforsker

- falsk

- familier

- familie

- ventilator

- Feature

- Funktionalitet

- få

- felt

- File (Felt)

- fyldt

- Finde

- finde

- Fornavn

- passer

- fem

- Fokus

- følger

- efter

- følger

- Til

- skov

- formular

- format

- FRAME

- fra

- forsiden

- fuld

- funktion

- funktionalitet

- funktioner

- yderligere

- Generelt

- generere

- genereret

- generere

- få

- Git

- GitHub

- given

- Go

- mål

- gå

- graf

- hånd

- Håndterer

- Have

- have

- he

- tunge

- tunge løft

- hjælpe

- hjælper

- hende

- højt niveau

- højere

- højeste

- håber

- time

- hus

- husholdninger

- boliger

- Hvordan

- How To

- HTML

- http

- HTTPS

- Hyperparameter optimering

- Tuning af hyperparameter

- Identity

- if

- gennemføre

- implementering

- importere

- import

- Forbedre

- forbedring

- in

- omfatter

- Herunder

- Forøg

- angiver

- individuel

- Individuelt

- oplysninger

- indgang

- indgange

- Indsætter

- indsigt

- instans

- i stedet

- anvisninger

- integration

- med vilje

- interesser

- grænseflade

- ind

- introduceret

- IT

- ITS

- selv

- Job

- Karriere

- jpg

- lige

- bare en

- Holde

- Nøgle

- viden

- lab

- stor

- større

- senere

- lanceret

- lancering

- læring

- til venstre

- Længde

- Niveau

- niveauer

- livscyklus

- løft

- ligesom

- Sandsynlig

- begrænsende

- linux

- belastning

- lokalt

- placeret

- placering

- logik

- logisk

- Lang

- længere

- Se

- Lot

- laveste

- maskine

- machine learning

- mange

- maksimal

- Kan..

- betyde

- midler

- Flet

- mødte

- Metrics

- måske

- minutter

- mangler

- ML

- MLOps

- model

- modeller

- ændre

- Overvåg

- skærme

- mere

- mest

- flere

- navn

- smal

- Navigerer

- Behov

- Ny

- nyligt

- næste

- ingen

- Ingen

- notesbog

- bemærkede

- nu

- nummer

- bedøvet

- objekt

- objektiv

- objekter

- of

- off

- Tilbud

- on

- engang

- ONE

- kun

- åbent

- Produktion

- optimal

- optimering

- Optimer

- optimeret

- or

- ordrer

- OS

- Andet

- Andre

- ud

- output

- uden for

- i løbet af

- samlet

- side

- pandaer

- Parallel

- parametre

- del

- særlig

- Passing

- lidenskabelige

- sti

- Betal

- Udfør

- ydeevne

- udfører

- vedvarer

- stykker

- pipeline

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- stik

- Punkt

- punkter

- politik

- befolkning

- mulig

- Indlæg

- potentiale

- pragmatisk

- forudsige

- Predictor

- Forbered

- forudsætninger

- gaver

- forhindre

- tidligere

- prissætning

- primære

- Problem

- behandle

- producere

- produktion

- Programmering

- Progress

- projekt

- projekter

- lovende

- egenskaber

- give

- giver

- leverer

- offentlige

- formål

- Python

- tilfældig

- hurtige

- nået

- klar

- grund

- for nylig

- opskrift

- anbefaler

- optegnelser

- reducere

- reducerer

- henvise

- henvisningen

- om

- regulært udtryk

- region

- frigivet

- relevant

- resterende

- Fjern

- gentag

- Repository

- anmode

- kræver

- påkrævet

- Ressourcer

- dem

- ansvarlige

- begrænset

- resultere

- Resultater

- afkast

- højre

- roller

- Kør

- kører

- løber

- runtime

- sagemaker

- SageMaker Automatisk Model Tuning

- gemt

- Scale

- skalering

- Videnskab

- forskere

- scikit-lære

- rækkevidde

- score

- script

- scripts

- Anden

- sekunder

- Sektion

- sektioner

- sektor

- se

- synes

- valgt

- valg

- SELV

- senior

- adskille

- tjener

- Serverless

- tjeneste

- Tjenester

- Session

- sæt

- sæt

- indstillinger

- setup

- hun

- bør

- fremvist

- vist

- Shows

- Simpelt

- forenkle

- ganske enkelt

- uddrag

- So

- løsninger

- Løsninger

- SOLVE

- nogle

- specialiserede

- specifikke

- specifikation

- specifikationer

- specificeret

- hastighed

- delt

- stable

- standard

- starte

- Starter

- Status

- Trin

- Steps

- Stands

- stoppet

- standsning

- opbevaring

- opbevaret

- lagring

- Strategi

- struktur

- strukturer

- Efterfølgende

- sådan

- Understøttet

- bord

- skræddersyet

- Tag

- mål

- hold

- Teknisk

- teknikker

- Teknologier

- terminal

- prøve

- Test

- at

- deres

- Them

- derefter

- Der.

- derfor

- Disse

- de

- denne

- dem

- tre

- tærskel

- Gennem

- tid

- til

- sammen

- værktøj

- top

- I alt

- mod

- traditionelle

- Tog

- Kurser

- transformationer

- retssag

- forsøg

- forsøgte

- udløse

- udløst

- udløsning

- forsøger

- tuning

- to

- typen

- typer

- typisk

- ui

- under

- forståelse

- enestående

- indtil

- uønsket

- uploadet

- Brug

- brug

- brug tilfælde

- anvendte

- bruger

- ved brug af

- VALIDATE

- værdi

- Værdier

- variabel

- varieret

- forskellige

- udgave

- versioner

- Specifikation

- visualisering

- W

- vente

- går igennem

- ønsker

- var

- Vej..

- we

- web

- webservices

- GODT

- var

- Hvad

- hvornår

- ud fra følgende betragtninger

- hvorvidt

- som

- hvorfor

- vilje

- med

- inden for

- uden

- Arbejde

- workflow

- arbejdsgange

- arbejder

- ville

- skriver

- endnu

- Du

- Din

- dig selv

- zephyrnet