Generativ AI (GenAI) og store sprogmodeller (LLM'er), såsom dem, der snart er tilgængelige via Amazonas grundfjeld , Amazon Titan transformerer den måde, udviklere og virksomheder er i stand til at løse traditionelt komplekse udfordringer relateret til naturlig sprogbehandling og -forståelse. Nogle af fordelene, som LLM'er tilbyder, inkluderer evnen til at skabe mere dygtige og overbevisende samtale-AI-oplevelser til kundeserviceapplikationer og forbedre medarbejdernes produktivitet gennem mere intuitive og præcise svar.

For disse brugssager er det imidlertid afgørende, at GenAI-applikationerne, der implementerer samtaleoplevelserne, opfylder to nøglekriterier: Begræns svarene på virksomhedsdata, for derved at afbøde modelhallucinationer (forkerte udsagn), og filtrer svar i henhold til slutbrugerens indholdsadgang tilladelser.

For at begrænse GenAI-applikationssvarene til kun virksomhedsdata skal vi bruge en teknik kaldet Retrieval Augmented Generation (RAG). En applikation, der bruger RAG-tilgangen, henter information, der er mest relevant for brugerens anmodning, fra virksomhedens videnbase eller indhold, samler den som kontekst sammen med brugerens anmodning som en prompt og sender den derefter til LLM for at få et GenAI-svar. LLM'er har begrænsninger omkring det maksimale ordantal for inputprompten, og derfor har valget af de rigtige passager blandt tusinder eller millioner af dokumenter i virksomheden en direkte indflydelse på LLM'ens nøjagtighed.

Ved design af effektive RAG er indholdshentning et kritisk skridt for at sikre, at LLM modtager den mest relevante og præcise kontekst fra virksomhedsindhold for at generere nøjagtige svar. Det er her den meget nøjagtige, maskinlæringsdrevne (ML)-drevne intelligent søgning in Amazon Kendra spiller en vigtig rolle. Amazon Kendra er en fuldt administreret tjeneste, der leverer ud-af-boksen semantiske søgefunktioner til avanceret rangering af dokumenter og passager. Du kan bruge den høje nøjagtige søgning i Amazon Kendra til at hente det mest relevante indhold og dokumenter for at maksimere kvaliteten af din RAG-nyttelast, hvilket giver bedre LLM-svar end at bruge konventionelle eller søgeordsbaserede søgeløsninger. Amazon Kendra tilbyder brugervenlige deep learning-søgemodeller, der er foruddannede på 14 domæner og ikke kræver nogen ML-ekspertise, så der er ingen grund til at håndtere ordindlejringer, dokumentopdeling og andre kompleksiteter på lavere niveau, der typisk kræves til RAG-implementeringer. Amazon Kendra kommer også med præbyggede stik til populære datakilder som f.eks Amazon Simple Storage Service (Amazon S3), SharePoint, Confluence og websteder og understøtter almindelige dokumentformater som HTML, Word, PowerPoint, PDF, Excel og rene tekstfiler. For at filtrere svar kun baseret på de dokumenter, som slutbrugertilladelserne tillader, tilbyder Amazon Kendra stik med adgangskontrolliste (ACL) support. Amazon Kendra tilbyder også AWS identitets- og adgangsstyring (IAM) og AWS IAM Identity Center (efterfølger til AWS Single Sign-On) integration til synkronisering af brugergruppeoplysninger med kundeidentitetsudbydere såsom Okta og Azure AD.

I dette indlæg demonstrerer vi, hvordan man implementerer et RAG-workflow ved at kombinere Amazon Kendras muligheder med LLM'er for at skabe avancerede GenAI-applikationer, der giver samtaleoplevelser over dit virksomhedsindhold. Efter Amazonas grundfjeld lanceres, vil vi udgive et opfølgende indlæg, der viser, hvordan man implementerer lignende GenAI-applikationer ved hjælp af Amazon Bedrock, så følg med.

Løsningsoversigt

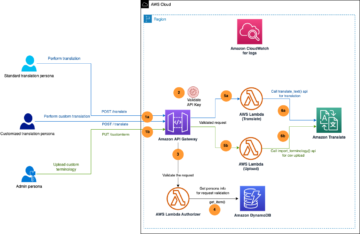

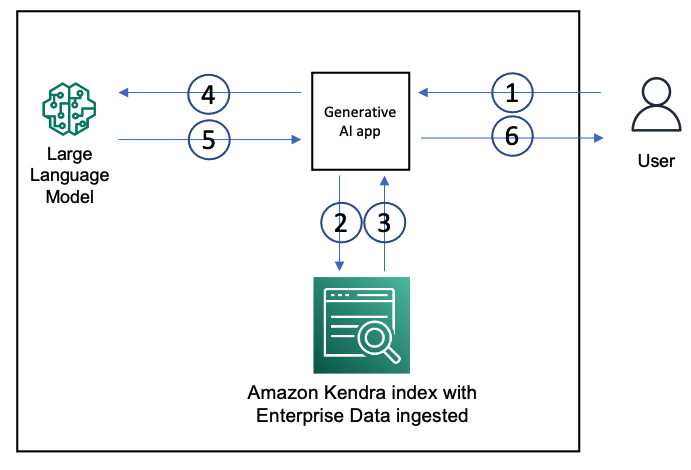

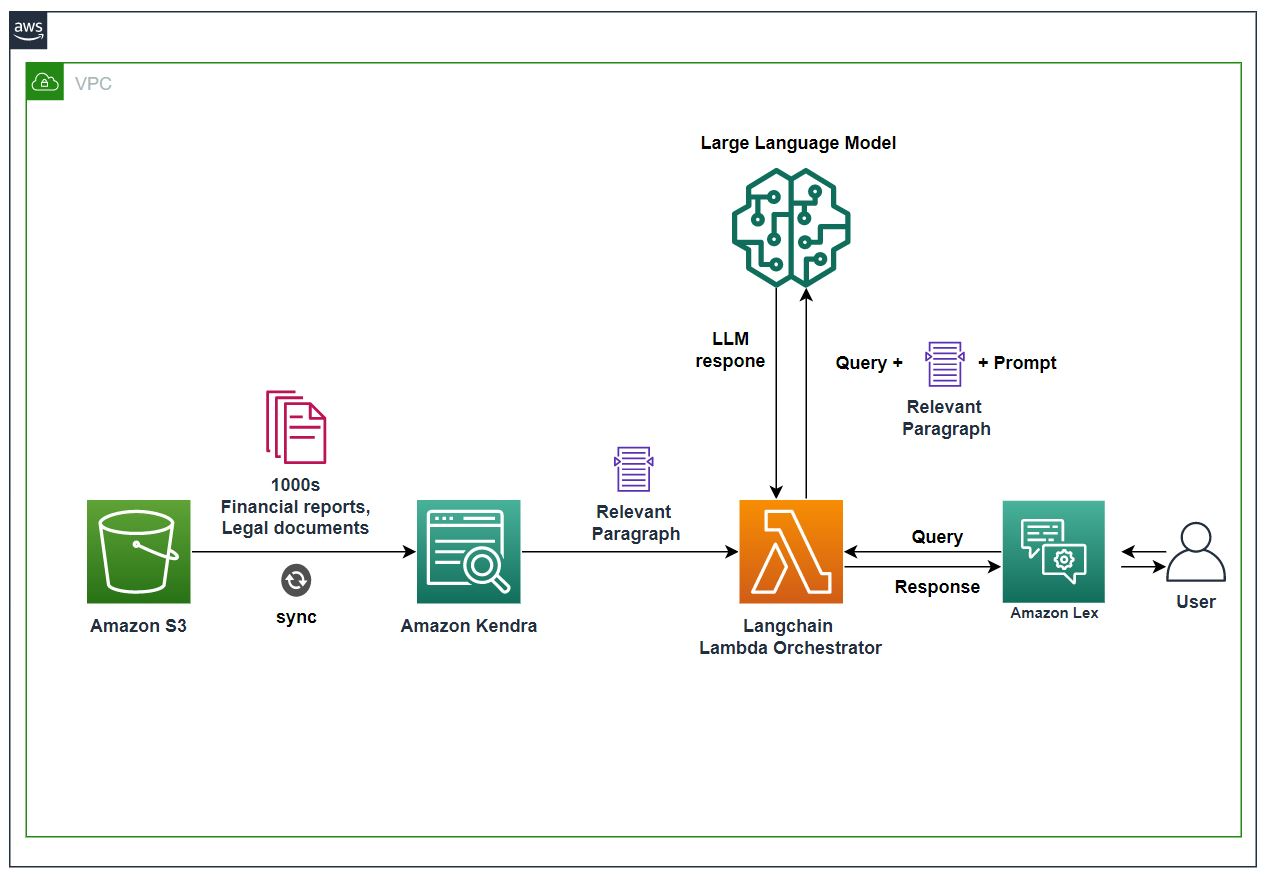

Følgende diagram viser arkitekturen af en GenAI-applikation med en RAG-tilgang.

Vi bruger et Amazon Kendra-indeks til at indlæse ustrukturerede virksomhedsdata fra datakilder såsom wiki-sider, MS SharePoint-websteder, Atlassian Confluence og dokumentlagre såsom Amazon S3. Når en bruger interagerer med GenAI-appen, er flowet som følger:

- Brugeren sender en anmodning til GenAI-appen.

- Appen sender en søgeforespørgsel til Amazon Kendra-indekset baseret på brugeranmodningen.

- Indekset returnerer søgeresultater med uddrag af relevante dokumenter fra de indlæste virksomhedsdata.

- Appen sender brugeranmodningen og sammen med de data, der hentes fra indekset, som kontekst i LLM-prompten.

- LLM'en returnerer et kortfattet svar på brugeranmodningen baseret på de hentede data.

- Svaret fra LLM sendes tilbage til brugeren.

Med denne arkitektur kan du vælge den bedst egnede LLM til din brugssituation. LLM-muligheder omfatter vores partnere Hugging Face, AI21 Labs, Cohere og andre hostet på en Amazon SageMaker endpoint, samt modeller fra virksomheder som f.eks Antropisk , OpenAI. Med Amazonas grundfjeld, vil du være i stand til at vælge Amazon Titan, Amazons egen LLM eller partner LLM'er såsom dem fra AI21 Labs og Anthropic med API'er sikkert uden behov for, at dine data forlader AWS-økosystemet. De yderligere fordele, som Amazon Bedrock vil tilbyde, inkluderer en serverløs arkitektur, en enkelt API til at kalde de understøttede LLM'er og en administreret service til at strømline udviklerarbejdsgangen.

For de bedste resultater skal en GenAI-app konstruere prompten baseret på brugeranmodningen og den specifikke LLM, der bruges. Konversations-AI-apps skal også administrere chathistorikken og konteksten. GenAI app-udviklere kan bruge open source rammer som f.eks Langkæde der giver moduler til at integrere med den valgte LLM og orkestreringsværktøjer til aktiviteter såsom chathistorikstyring og prompt engineering. Vi har leveret KendraIndexRetriever klasse, som implementerer en LangChain retriever interface, som applikationer kan bruge sammen med andre LangChain-grænseflader som f.eks kæder at hente data fra et Amazon Kendra-indeks. Vi har også leveret et par eksempler på applikationer i GitHub repo. Du kan implementere denne løsning på din AWS-konto ved hjælp af trin-for-trin guiden i dette indlæg.

Forudsætninger

Til denne vejledning skal du bruge en bash-terminal med Python 3.9 eller nyere installeret på Linux, Mac eller Windows Subsystem til Linux og en AWS-konto. Vi anbefaler også at bruge en AWS Cloud9 instans eller en Amazon Elastic Compute Cloud (Amazon EC2) forekomst.

Implementer en RAG-arbejdsgang

For at konfigurere dit RAG-workflow skal du udføre følgende trin:

- Brug det medfølgende AWS CloudFormation skabelon at oprette et nyt Amazon Kendra-indeks.

Denne skabelon indeholder eksempeldata, der indeholder AWS online dokumentation for Amazon Kendra, Amazon Lexog Amazon SageMaker. Alternativt, hvis du har et Amazon Kendra-indeks og har indekseret dit eget datasæt, kan du bruge det. Start af stakken kræver cirka 30 minutter efterfulgt af cirka 15 minutter at synkronisere den og indlæse dataene i indekset. Vent derfor i cirka 45 minutter, efter du har startet stakken. Bemærk indeks-id'et og AWS-regionen på stakkens Udgange fane.

- For en forbedret GenAI-oplevelse anbefaler vi at anmode om en Amazon Kendra servicekvoteforhøjelse for maksimum

DocumentExcerptstørrelse, så Amazon Kendra leverer større dokumentuddrag for at forbedre semantisk kontekst for LLM. - Installer AWS SDK til Python på kommandolinjegrænsefladen efter eget valg.

- Hvis du vil bruge eksemplerne på webapps bygget vha Strømbelyst, skal du først installere Streamlit. Dette trin er valgfrit, hvis du kun vil køre kommandolinjeversionerne af eksempelapplikationerne.

- Installer LangChain.

- Eksempelapplikationerne, der bruges i denne øvelse, kræver, at du har adgang til en eller flere LLM'er fra Flan-T5-XL, Flan-T5-XXL, Anthropic Claud-V1 og OpenAI-text-davinci-003.

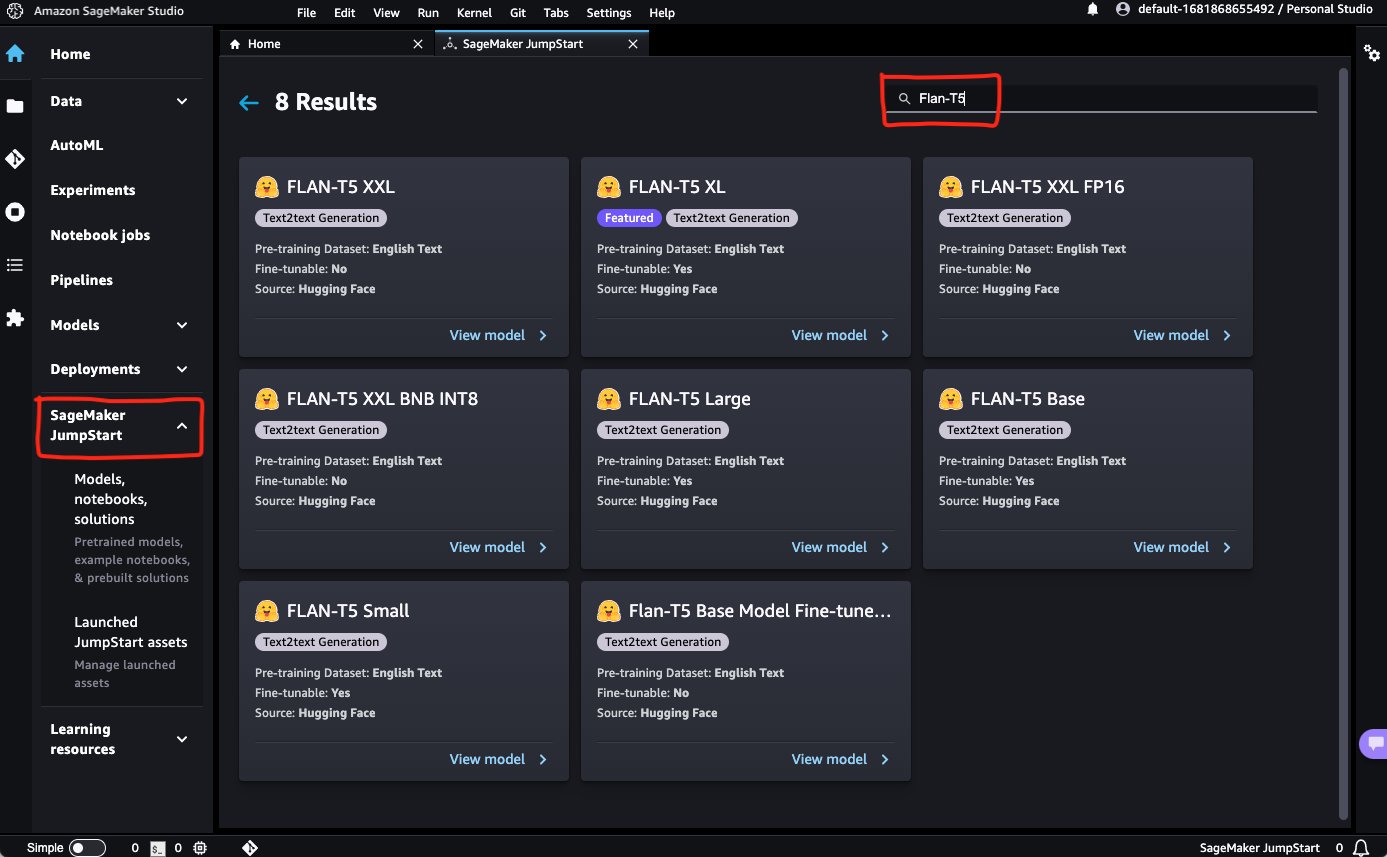

- Hvis du vil bruge Flan-T5-XL eller Flan-T5-XXL, skal du implementere dem til et slutpunkt til slutning vha. Amazon SageMaker Studio Jumpstart.

- Hvis du ønsker at arbejde med Anthropic Claud-V1 eller OpenAI-da-vinci-003, skal du anskaffe API-nøglerne til dine LLM'er af din interesse fra https://www.anthropic.com/ , https://openai.com/, henholdsvis.

- Hvis du vil bruge Flan-T5-XL eller Flan-T5-XXL, skal du implementere dem til et slutpunkt til slutning vha. Amazon SageMaker Studio Jumpstart.

- Følg instruktionerne i GitHub repo at installere

KendraIndexRetrieverinterface og eksempler på applikationer. - Før du kører eksempelapplikationerne, skal du indstille miljøvariabler med Amazon Kendra-indeksdetaljerne og API-nøglerne for din foretrukne LLM eller SageMaker-slutpunkterne for dine implementeringer til Flan-T5-XL eller Flan-T5-XXL. Følgende er et eksempelscript til at indstille miljøvariablerne:

- Skift til i et kommandolinjevindue

samplesundermappe til, hvor du har klonet GitHub-lageret. Du kan køre kommandolinjeapps fra kommandolinjen sompython <sample-file-name.py>. Du kan køre den strømbelyste webapp ved at ændre mappen tilsamplesog kørerstreamlit run app.py <anthropic|flanxl|flanxxl|openai>. - Åbn prøvefilen

kendra_retriever_flan_xxl.pyi en editor efter eget valg.

Overhold udsagnet result = run_chain(chain, "What's SageMaker?"). Dette er brugerforespørgslen ("Hvad er SageMaker?"), der køres gennem kæden, der bruger Flan-T-XXL som LLM og Amazon Kendra som retriever. Når denne fil køres, kan du observere outputtet som følger. Kæden sendte brugerforespørgslen til Amazon Kendra-indekset, hentede de tre øverste resultatuddrag og sendte dem som kontekst i en prompt sammen med forespørgslen, som LLM svarede på med et kortfattet svar. Det har også leveret kilderne (URL'erne til de dokumenter, der blev brugt til at generere svaret).

- Lad os nu køre webappen

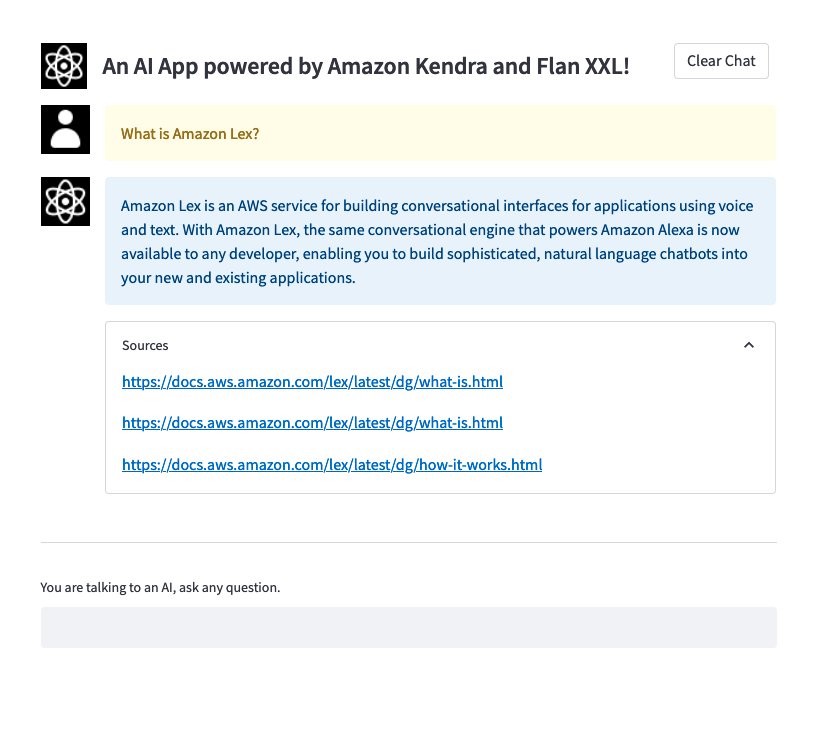

app.pyasstreamlit run app.py flanxxl. Til denne specifikke kørsel bruger vi en Flan-T-XXL-model som LLM.

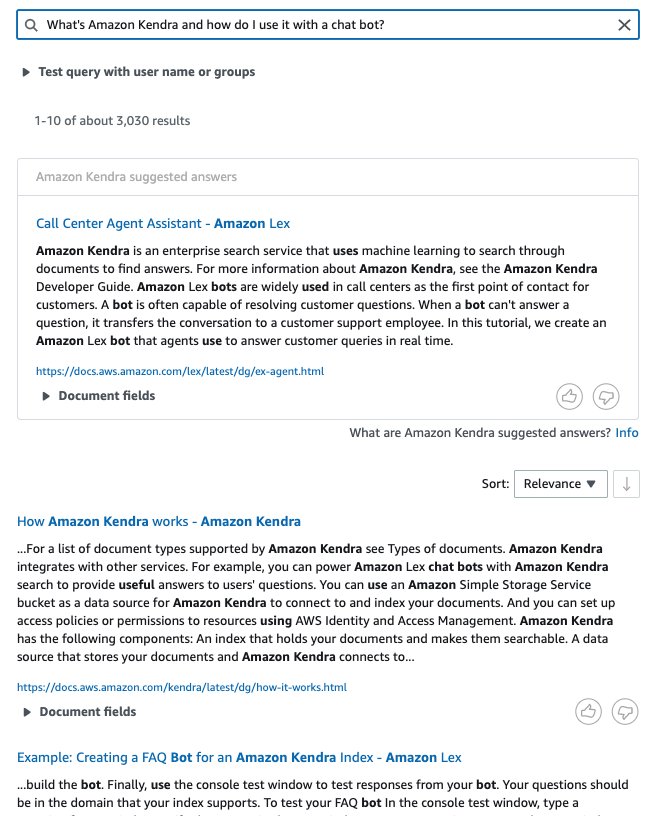

Det åbner et browservindue med webgrænsefladen. Du kan indtaste en forespørgsel, som i dette tilfælde er "Hvad er Amazon Lex?" Som det ses på det følgende skærmbillede, svarer applikationen med et svar, og den Kilder sektionen giver URL'erne til de dokumenter, hvorfra uddragene blev hentet fra Amazon Kendra-indekset og sendt til LLM i prompten som kontekst sammen med forespørgslen.

- Lad os nu løbe

app.pyigen og få en fornemmelse af samtaleoplevelsen ved hjælp afstreamlit run app.py anthropic. Her er den underliggende LLM, der anvendes, Anthropic Claud-V1.

Som du kan se i den følgende video, giver LLM et detaljeret svar på brugerens forespørgsel baseret på de dokumenter, den hentede fra Amazon Kendra-indekset og understøtter derefter svaret med URL'erne til kildedokumenterne, der blev brugt til at generere svaret. Bemærk, at de efterfølgende forespørgsler ikke eksplicit nævner Amazon Kendra; dog ConversationalRetrievalChain (en type kæde, der er en del af LangChain-rammen og giver en nem mekanisme til at udvikle samtaleapplikationsbaseret information hentet fra retriever-instanser, brugt i denne LangChain-applikation), administrerer chathistorikken og konteksten for at få et passende svar.

Bemærk også, at i det følgende skærmbillede finder Amazon Kendra det ekstraktive svar på forespørgslen og kortlister de øverste dokumenter med uddrag. Så er LLM i stand til at generere et mere kortfattet svar baseret på disse hentede uddrag.

I de følgende afsnit udforsker vi to use cases for brug af Generative AI med Amazon Kendra.

Use case 1: Generativ AI for finansielle servicevirksomheder

Finansielle organisationer opretter og gemmer data på tværs af forskellige datalagre, herunder økonomiske rapporter, juridiske dokumenter og hvidbøger. De skal overholde strenge regeringsbestemmelser og tilsyn, hvilket betyder, at medarbejderne skal finde relevante, nøjagtige og troværdige oplysninger hurtigt. Derudover er det besværligt og udsat for fejl at søge og samle indsigt på tværs af forskellige datakilder. Med Generative AI på AWS kan brugere hurtigt generere svar fra forskellige datakilder og typer, og syntetisere nøjagtige svar i virksomhedsskala.

Vi valgte en løsning ved hjælp af Amazon Kendra og AI21 Labs Jurassic-2 Jumbo Instruct LLM. Med Amazon Kendra kan du nemt indtage data fra flere datakilder såsom Amazon S3, websteder og ServiceNow. Derefter bruger Amazon Kendra AI21 Labs Jurassic-2 Jumbo Instruct LLM til at udføre inferensaktiviteter på virksomhedsdata såsom dataopsummering, rapportgenerering og mere. Amazon Kendra udvider LLM'er for at give nøjagtige og verificerbare oplysninger til slutbrugerne, hvilket reducerer hallucinationsproblemer med LLM'er. Med den foreslåede løsning kan finansanalytikere træffe hurtigere beslutninger ved hjælp af nøjagtige data til hurtigt at opbygge detaljerede og omfattende porteføljer. Vi planlægger at gøre denne løsning tilgængelig som et open source-projekt i nær fremtid.

Eksempel

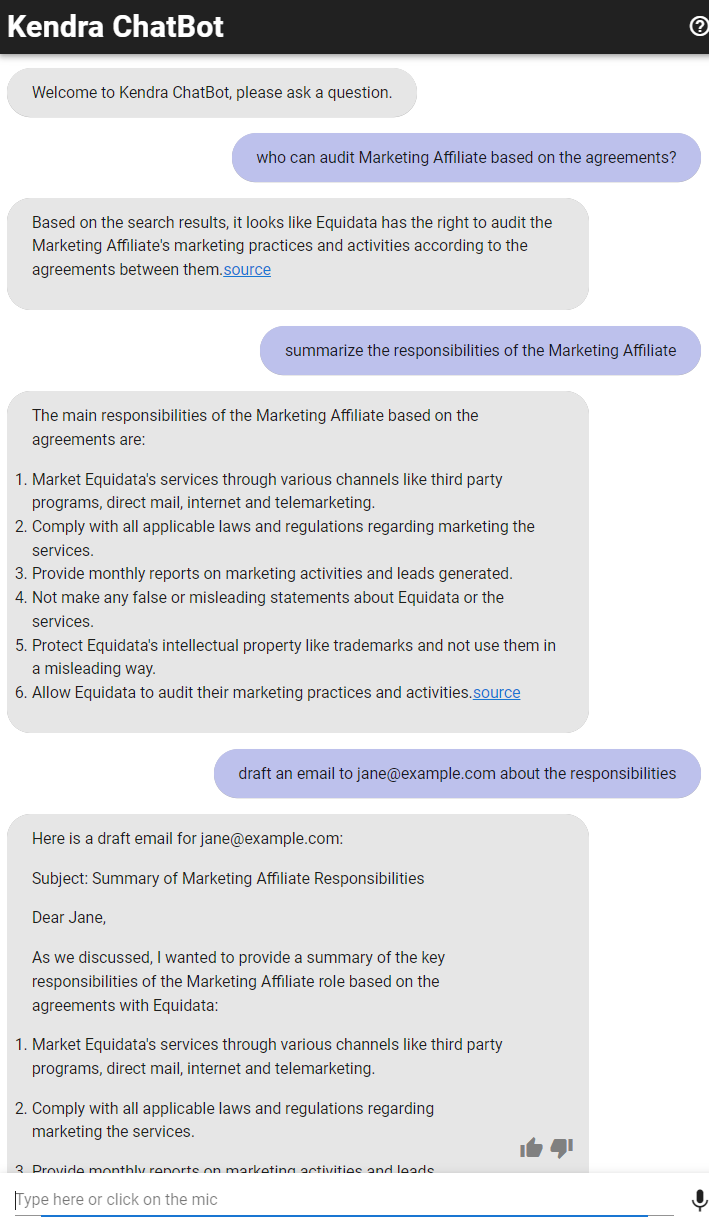

Ved at bruge Kendra Chatbot-løsningen kan finansanalytikere og revisorer interagere med deres virksomhedsdata (finansielle rapporter og aftaler) for at finde pålidelige svar på revisionsrelaterede spørgsmål. Kendra ChatBot giver svar sammen med kildelinks og har mulighed for at opsummere længere svar. Følgende skærmbillede viser et eksempel på en samtale med Kendra ChatBot.

Arkitektur oversigt

Følgende diagram illustrerer løsningsarkitekturen.

Arbejdsgangen omfatter følgende trin:

- Finansielle dokumenter og aftaler gemmes på Amazon S3 og indlæses til et Amazon Kendra-indeks ved hjælp af S3-datakildeforbindelsen.

- LLM hostes på et SageMaker-slutpunkt.

- En Amazon Lex chatbot bruges til at interagere med brugeren via Amazon Lex web UI.

- Løsningen bruger en AWS Lambda funktion med LangChain til at orkestrere mellem Amazon Kendra, Amazon Lex og LLM.

- Når brugere beder Amazon Lex chatbot om svar fra et finansielt dokument, ringer Amazon Lex til LangChain-orkestratoren for at opfylde anmodningen.

- Baseret på forespørgslen henter LangChain-orkestratoren de relevante finansielle poster og afsnit fra Amazon Kendra.

- LangChain-orkestratoren leverer disse relevante poster til LLM sammen med forespørgslen og den relevante prompt for at udføre den påkrævede aktivitet.

- LLM behandler anmodningen fra LangChain-orkestratoren og returnerer resultatet.

- LangChain orkestratoren får resultatet fra LLM og sender det til slutbrugeren gennem Amazon Lex chatbot.

Use case 2: Generativ AI for sundhedsforskere og klinikere

Klinikere og forskere analyserer ofte tusindvis af artikler fra medicinske tidsskrifter eller offentlige sundhedswebsteder som en del af deres forskning. Endnu vigtigere er det, at de vil have pålidelige datakilder, de kan bruge til at validere og underbygge deres resultater. Processen kræver timers intensiv forskning, analyse og datasyntese, hvilket forlænger tiden til værdi og innovation. Med Generative AI på AWS kan du oprette forbindelse til pålidelige datakilder og køre naturlige sprogforespørgsler for at generere indsigt på tværs af disse pålidelige datakilder på få sekunder. Du kan også gennemgå de kilder, der er brugt til at generere svaret og validere dets nøjagtighed.

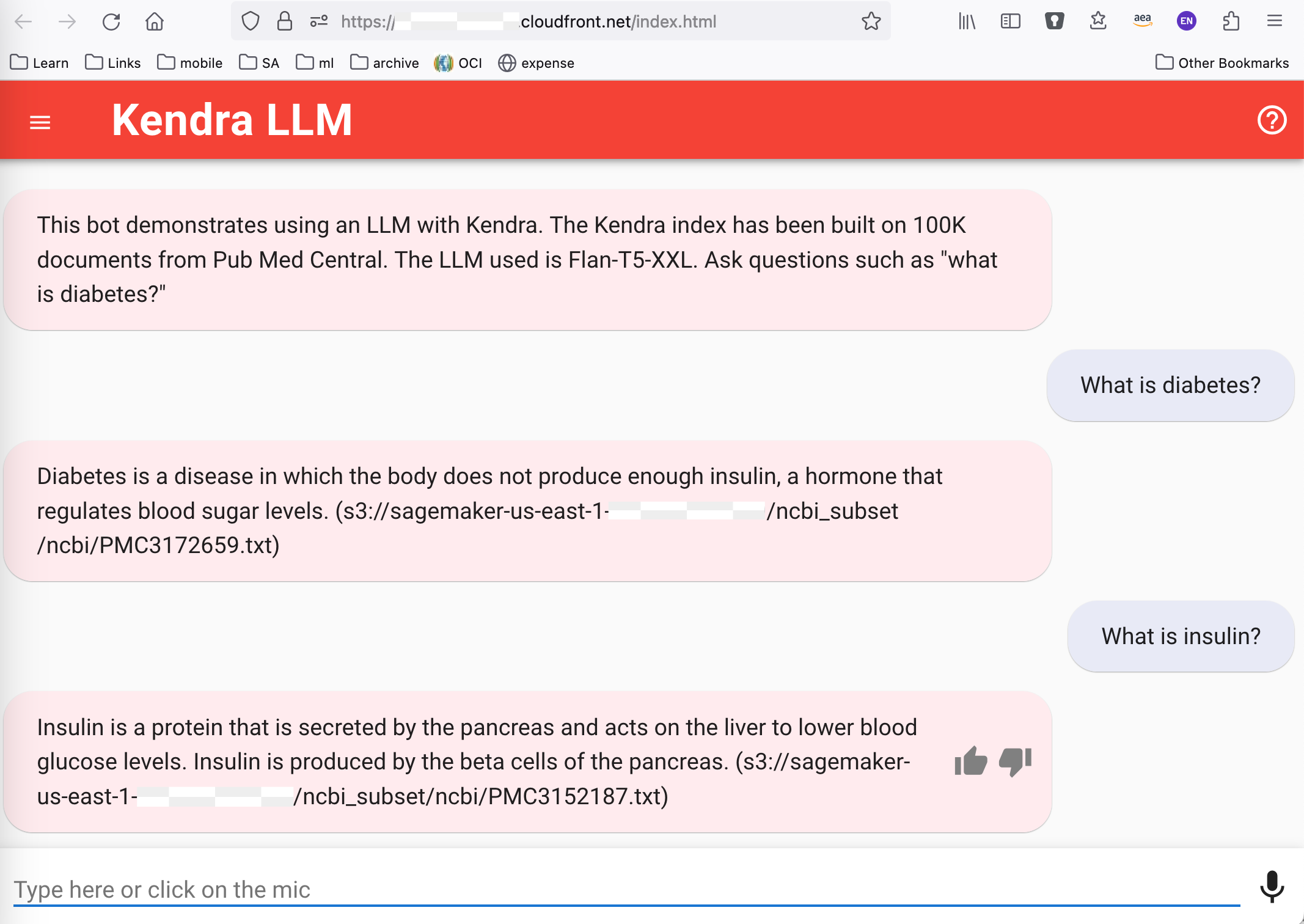

Vi valgte en løsning med Amazon Kendra og Flan-T5-XXL fra Hugging Face. For det første bruger vi Amazon Kendra til at identificere tekstuddrag fra semantisk relevante dokumenter i hele korpuset. Så bruger vi kraften i en LLM som Flan-T5-XXL til at bruge tekstuddragene fra Amazon Kendra som kontekst og få et kortfattet naturligt sprogsvar. I denne tilgang fungerer Amazon Kendra-indekset som passage-retriever-komponenten i RAG-mekanismen. Til sidst bruger vi Amazon Lex til at drive frontend, hvilket giver en problemfri og responsiv oplevelse til slutbrugere. Vi planlægger at gøre denne løsning tilgængelig som et open source-projekt i den nærmeste fremtid.

Eksempel

Følgende skærmbillede er fra en web-UI bygget til løsningen ved hjælp af skabelonen tilgængelig på GitHub. Teksten i pink er svar fra Amazon Kendra LLM-systemet, og teksten i blåt er brugernes spørgsmål.

Arkitektur oversigt

Arkitekturen og løsningsworkflowet for denne løsning ligner den i use case 1.

Ryd op

For at spare omkostninger skal du slette alle de ressourcer, du har implementeret som en del af selvstudiet. Hvis du har startet CloudFormation-stakken, kan du slette den via AWS CloudFormation-konsollen. På samme måde kan du slette alle SageMaker-slutpunkter, du måtte have oprettet via SageMaker-konsollen.

Konklusion

Generativ kunstig intelligens drevet af store sprogmodeller ændrer, hvordan folk erhverver og anvender indsigt fra information. I tilfælde af virksomhedsbrug skal indsigten dog genereres baseret på virksomhedsindhold for at holde svarene inden for domænet og afbøde hallucinationer ved hjælp af Retrieval Augmented Generation-tilgangen. I RAG-tilgangen afhænger kvaliteten af de indsigter, der genereres af LLM, af den semantiske relevans af den hentede information, som den er baseret på, hvilket gør det i stigende grad nødvendigt at bruge løsninger som Amazon Kendra, der leverer højnøjagtige semantiske søgeresultater ud af kassen. Med dets omfattende økosystem af datakildeforbindelser, understøttelse af almindelige filformater og sikkerhed kan du hurtigt begynde at bruge Generative AI-løsninger til virksomhedsbrug med Amazon Kendra som genfindingsmekanisme.

For mere information om at arbejde med Generativ AI på AWS, se Annoncering af nye værktøjer til bygning med generativ AI på AWS. Du kan begynde at eksperimentere og bygge RAG proofs of concept (POC'er) til din virksomheds GenAI-apps ved hjælp af metoden beskrevet i denne blog. Som tidligere nævnt en gang Amazonas grundfjeld er tilgængelig, vil vi udgive en opfølgningsblog, der viser, hvordan du kan bygge RAG ved hjælp af Amazon Bedrock.

Om forfatterne

Abhinav Jawadekar er en Principal Solutions Architect med fokus på Amazon Kendra i AI/ML sprogserviceteamet hos AWS. Abhinav arbejder med AWS-kunder og -partnere for at hjælpe dem med at bygge intelligente søgeløsninger på AWS.

Abhinav Jawadekar er en Principal Solutions Architect med fokus på Amazon Kendra i AI/ML sprogserviceteamet hos AWS. Abhinav arbejder med AWS-kunder og -partnere for at hjælpe dem med at bygge intelligente søgeløsninger på AWS.

Jean-Pierre Dodel er hovedproduktchef for Amazon Kendra og leder vigtige strategiske produktkapaciteter og prioritering af køreplaner. Han bringer omfattende Enterprise Search og ML/AI-erfaring til teamet med tidligere ledende roller hos Autonomy, HP og søgestartups, før han kom til Amazon for 7 år siden.

Jean-Pierre Dodel er hovedproduktchef for Amazon Kendra og leder vigtige strategiske produktkapaciteter og prioritering af køreplaner. Han bringer omfattende Enterprise Search og ML/AI-erfaring til teamet med tidligere ledende roller hos Autonomy, HP og søgestartups, før han kom til Amazon for 7 år siden.

Mithil Shah er ML/AI Specialist hos AWS. I øjeblikket hjælper han kunder i den offentlige sektor med at forbedre borgernes liv ved at bygge Machine Learning-løsninger på AWS.

Mithil Shah er ML/AI Specialist hos AWS. I øjeblikket hjælper han kunder i den offentlige sektor med at forbedre borgernes liv ved at bygge Machine Learning-løsninger på AWS.

Firaz Akmal er Sr. Product Manager for Amazon Kendra hos AWS. Han er en kundefortaler, der hjælper kunder med at forstå deres søgning og generative AI use-cases med Kendra på AWS. Uden for arbejdet nyder Firaz at tilbringe tid i bjergene i PNW eller opleve verden gennem sin datters perspektiv.

Firaz Akmal er Sr. Product Manager for Amazon Kendra hos AWS. Han er en kundefortaler, der hjælper kunder med at forstå deres søgning og generative AI use-cases med Kendra på AWS. Uden for arbejdet nyder Firaz at tilbringe tid i bjergene i PNW eller opleve verden gennem sin datters perspektiv.

Abhishek Maligehalli Shivalingaiah er Senior AI Services Solution Architect hos AWS med fokus på Amazon Kendra. Han brænder for at bygge applikationer ved hjælp af Amazon Kendra, Generative AI og NLP. Han har omkring 10 års erfaring med at bygge Data & AI-løsninger for at skabe værdi for kunder og virksomheder. Han har bygget en (personlig) chatbot for sjov for at besvare spørgsmål om hans karriere og professionelle rejse. Uden for arbejdet nyder han at lave portrætter af familie og venner og elsker at skabe kunstværker.

Abhishek Maligehalli Shivalingaiah er Senior AI Services Solution Architect hos AWS med fokus på Amazon Kendra. Han brænder for at bygge applikationer ved hjælp af Amazon Kendra, Generative AI og NLP. Han har omkring 10 års erfaring med at bygge Data & AI-løsninger for at skabe værdi for kunder og virksomheder. Han har bygget en (personlig) chatbot for sjov for at besvare spørgsmål om hans karriere og professionelle rejse. Uden for arbejdet nyder han at lave portrætter af familie og venner og elsker at skabe kunstværker.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoAiStream. Web3 Data Intelligence. Viden forstærket. Adgang her.

- Udmøntning af fremtiden med Adryenn Ashley. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/quickly-build-high-accuracy-generative-ai-applications-on-enterprise-data-using-amazon-kendra-langchain-and-large-language-models/

- :har

- :er

- :hvor

- $OP

- 1

- 10

- 100

- 11

- 12

- 14

- 15 %

- 30

- 7

- 9

- a

- evne

- I stand

- Om

- adgang

- Ifølge

- Konto

- nøjagtighed

- præcis

- erhverve

- tværs

- aktiviteter

- aktivitet

- Ad

- Yderligere

- Derudover

- klæbe

- fortaler

- Efter

- igen

- aggregere

- siden

- aftaler

- AI

- AI-tjenester

- AI / ML

- Alle

- tillade

- sammen

- også

- Amazon

- Amazon EC2

- Amazon Kendra

- Amazon Lex

- blandt

- an

- analyse

- Analytikere

- analysere

- ,

- besvare

- svar

- enhver

- api

- API NØGLER

- API'er

- app

- Anvendelse

- applikationer

- Indløs

- tilgang

- passende

- apps

- arkitektur

- ER

- omkring

- artikler

- kunstværker

- AS

- At

- revisorer

- augmented

- til rådighed

- AWS

- AWS CloudFormation

- Azure

- tilbage

- bund

- baseret

- bash

- BE

- være

- fordele

- BEDSTE

- Bedre

- mellem

- Blog

- Blå

- Boks

- Bringer

- browser

- bygge

- Bygning

- bygget

- bundter

- by

- ringe

- kaldet

- Opkald

- CAN

- kapaciteter

- stand

- Karriere

- bære

- tilfælde

- tilfælde

- kæde

- udfordringer

- lave om

- skiftende

- chatbot

- valg

- Vælg

- vælge

- valgte

- Borgere

- klasse

- kombinerer

- kommer

- Fælles

- Virksomheder

- selskab

- overbevisende

- fuldføre

- komplekse

- kompleksiteter

- komponent

- omfattende

- Compute

- Konceptet

- Tilslut

- Konsol

- indhold

- sammenhæng

- kontrol

- konventionelle

- Samtale

- konversation

- samtale AI

- Omkostninger

- skabe

- oprettet

- Oprettelse af

- kriterier

- kritisk

- For øjeblikket

- kunde

- Kundeservice

- Kunder

- data

- deal

- afgørelser

- dyb

- dyb læring

- demonstrere

- afhænger

- indsætte

- indsat

- implementeringer

- designe

- detaljeret

- detaljer

- udvikle

- Udvikler

- udviklere

- direkte

- dokumentet

- dokumentation

- dokumenter

- Domæner

- Dont

- tidligere

- nemt

- let

- nem at bruge

- økosystem

- editor

- Effektiv

- Medarbejder

- medarbejdere

- ende

- Endpoint

- ingeniør

- Engineering

- sikre

- Indtast

- Enterprise

- virksomheder

- Hele

- Miljø

- fejl

- eksempel

- Excel

- erfaring

- Oplevelser

- oplever

- ekspertise

- udforske

- eksport

- omfattende

- Ansigtet

- familie

- hurtigere

- føler sig

- få

- File (Felt)

- Filer

- filtrere

- finansielle

- finansiel service

- Finde

- fund

- Fornavn

- flow

- Fokus

- fokuserede

- følger

- efterfulgt

- efter

- følger

- Til

- Framework

- rammer

- venner

- fra

- forsiden

- forreste ende

- Opfylde

- fuldt ud

- sjovt

- funktion

- funktioner

- fremtiden

- generere

- genereret

- generere

- generation

- generative

- Generativ AI

- få

- GitHub

- Regering

- vejlede

- Have

- he

- Helse

- sundhedspleje

- hjælpe

- hjælpe

- hjælper

- link.

- højere

- stærkt

- hans

- historie

- hostede

- HOURS

- Hvordan

- How To

- Men

- HTML

- http

- HTTPS

- ID

- identificere

- Identity

- if

- illustrerer

- KIMOs Succeshistorier

- gennemføre

- gennemføre

- redskaber

- vigtigt

- Forbedre

- forbedret

- forbedring

- in

- omfatter

- omfatter

- Herunder

- stigende

- indeks

- oplysninger

- Innovation

- indgang

- indsigt

- installere

- installeret

- instans

- anvisninger

- integrere

- integration

- Intelligent

- interagere

- interagerer

- interesse

- grænseflade

- grænseflader

- intuitiv

- spørgsmål

- IT

- ITS

- sammenføjning

- rejse

- jpg

- Holde

- Nøgle

- nøgler

- viden

- Labs

- Sprog

- stor

- større

- lanceret

- lanceringer

- lancering

- førende

- Leads

- læring

- Forlade

- Politikker

- ligesom

- GRÆNSE

- begrænsninger

- Line (linje)

- links

- linux

- Liste

- Lives

- LLM

- længere

- mac

- maskine

- machine learning

- lave

- maerker

- Making

- administrere

- lykkedes

- ledelse

- leder

- administrerer

- Maksimer

- maksimal

- Kan..

- midler

- mekanisme

- medicinsk

- Mød

- nævnte

- metode

- millioner

- minutter

- afbøde

- formildende

- ML

- model

- modeller

- Moduler

- mere

- mest

- MS

- flere

- skal

- Natural

- Natural Language Processing

- I nærheden af

- nødvendig

- Behov

- behov

- Ny

- NLP

- ingen

- observere

- opnå

- of

- tilbyde

- tilbydes

- Tilbud

- tit

- Okta

- on

- engang

- ONE

- online

- kun

- open source

- åbner

- Indstillinger

- or

- orkestrering

- organisationer

- Andet

- Andre

- vores

- ud

- skitseret

- output

- uden for

- i løbet af

- Tilsyn

- egen

- del

- partner

- partnere

- lidenskabelige

- Mennesker

- Tilladelser

- personale

- perspektiv

- fly

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- Populær

- porteføljer

- Indlæg

- magt

- strøm

- foretrækkes

- Main

- Forud

- prioritering

- behandle

- Processer

- forarbejdning

- Produkt

- produktchef

- produktivitet

- professionel

- projekt

- beviser

- foreslog

- give

- forudsat

- udbydere

- giver

- leverer

- offentlige

- offentliggøre

- Sweatre & trøjer

- Python

- kvalitet

- forespørgsler

- Spørgsmål

- hurtigt

- Ranking

- modtager

- anbefaler

- optegnelser

- reducerer

- region

- regler

- relaterede

- relevans

- relevant

- pålidelig

- indberette

- Rapporter

- Repository

- anmode

- kræver

- påkrævet

- Kræver

- forskning

- forskere

- Ressourcer

- henholdsvis

- svar

- reaktioner

- lydhør

- begrænse

- resultere

- Resultater

- afkast

- gennemgå

- køreplan

- roller

- roller

- Kør

- kører

- s

- sagemaker

- Gem

- Scale

- SDK

- sømløs

- Søg

- søgning

- sekunder

- sektioner

- sektor

- sikkert

- sikkerhed

- se

- set

- sender

- senior

- Serverless

- tjeneste

- Tjenester

- sæt

- Shows

- lignende

- Tilsvarende

- Simpelt

- enkelt

- Websteder

- Størrelse

- So

- løsninger

- Løsninger

- SOLVE

- nogle

- Kilde

- Kilder

- specialist

- specifikke

- udgifterne

- stable

- starte

- Nystartede

- state-of-the-art

- Statement

- udsagn

- forblive

- Trin

- Steps

- opbevaring

- butik

- opbevaret

- Strategisk

- strømline

- Streng

- Studio

- efterfølgende

- sådan

- egnede

- opsummere

- support

- Understøttet

- Understøtter

- systemet

- hold

- skabelon

- terminal

- end

- at

- The Source

- verdenen

- deres

- Them

- derefter

- derved

- derfor

- Disse

- de

- denne

- dem

- tusinder

- tre

- Gennem

- tid

- til

- værktøjer

- top

- traditionelt

- omdanne

- betroet

- troværdig

- tutorial

- to

- typen

- typer

- typisk

- ui

- underliggende

- forstå

- forståelse

- brug

- brug tilfælde

- brugssager

- anvendte

- Bruger

- brugere

- ved brug af

- VALIDATE

- værdi

- forskellige

- verificerbare

- via

- video

- vente

- ønsker

- Vej..

- we

- web

- websites

- GODT

- var

- Hvad

- hvornår

- som

- Hvidbøger

- vilje

- vinduer

- med

- uden

- ord

- Arbejde

- arbejder

- virker

- world

- yaml

- år

- hvilket giver

- Du

- Din

- zephyrnet