Amazon SageMaker Data Wrangler reduziert die Zeit, die zum Sammeln und Vorbereiten von Daten für maschinelles Lernen (ML) in Amazon SageMaker Studio benötigt wird, von Wochen auf Minuten. Data Wrangler ermöglicht Ihnen den Zugriff auf Daten aus einer Vielzahl beliebter Quellen (Amazon S3, Amazonas Athena, Amazon RedShift, Amazon EMR und Snowflake) und über 40 weitere Drittanbieterquellen. Ab heute können Sie sich mit verbinden Amazon EMR Hive als Big-Data-Abfrage-Engine, um große Datasets für ML bereitzustellen.

Das Aggregieren und Vorbereiten großer Datenmengen ist ein entscheidender Teil des ML-Workflows. Data Scientists und Data Engineers verwenden Apache Spark, Apache Hive und Presto, die auf Amazon EMR ausgeführt werden, für die groß angelegte Datenverarbeitung. In diesem Blogbeitrag wird erläutert, wie Datenfachleute die visuelle Benutzeroberfläche von SageMaker Data Wrangler verwenden können, um vorhandene Amazon EMR-Cluster mit Hive-Endpunkten zu lokalisieren und sich mit ihnen zu verbinden. Um sich auf die Modellierung oder Berichterstellung vorzubereiten, können sie die Datenbank, die Tabellen und das Schema visuell analysieren und Hive-Abfragen erstellen, um das ML-Dataset zu erstellen. Anschließend können sie mithilfe der visuellen Benutzeroberfläche von Data Wrangler schnell ein Profil der Daten erstellen, um die Datenqualität zu bewerten, Anomalien und fehlende oder falsche Daten zu erkennen und Ratschläge zum Umgang mit diesen Problemen zu erhalten. Sie können beliebtere und ML-gestützte integrierte Analysen und über 300 integrierte Transformationen nutzen, die von Spark unterstützt werden, um Funktionen zu analysieren, zu bereinigen und zu entwickeln, ohne eine einzige Codezeile zu schreiben. Schließlich können sie auch Modelle mit trainieren und einsetzen SageMaker-Autopilot, planen Sie Jobs oder operationalisieren Sie die Datenvorbereitung in einer SageMaker-Pipeline über die visuelle Benutzeroberfläche von Data Wrangler.

Lösungsüberblick

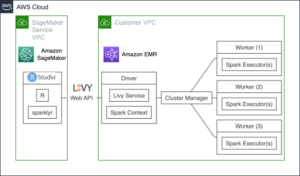

Mit SageMaker Studio-Setups können Datenexperten vorhandene EMR-Cluster schnell identifizieren und sich mit ihnen verbinden. Darüber hinaus können Datenexperten EMR-Cluster entdecken SageMaker Studio mit vordefinierten Vorlagen on demand mit nur wenigen Klicks. Kunden können SageMaker Studio Universal Notebook verwenden und Code hineinschreiben Apache Funken, Bienenstock, Presto or PySpark Datenaufbereitung im großen Maßstab durchzuführen. Allerdings sind nicht alle Datenexperten mit dem Schreiben von Spark-Code zum Vorbereiten von Daten vertraut, da eine steile Lernkurve erforderlich ist. Sie können jetzt schnell und einfach eine Verbindung zu Amazon EMR herstellen, ohne eine einzige Codezeile schreiben zu müssen, da Amazon EMR eine Datenquelle für Amazon SageMaker Data Wrangler ist.

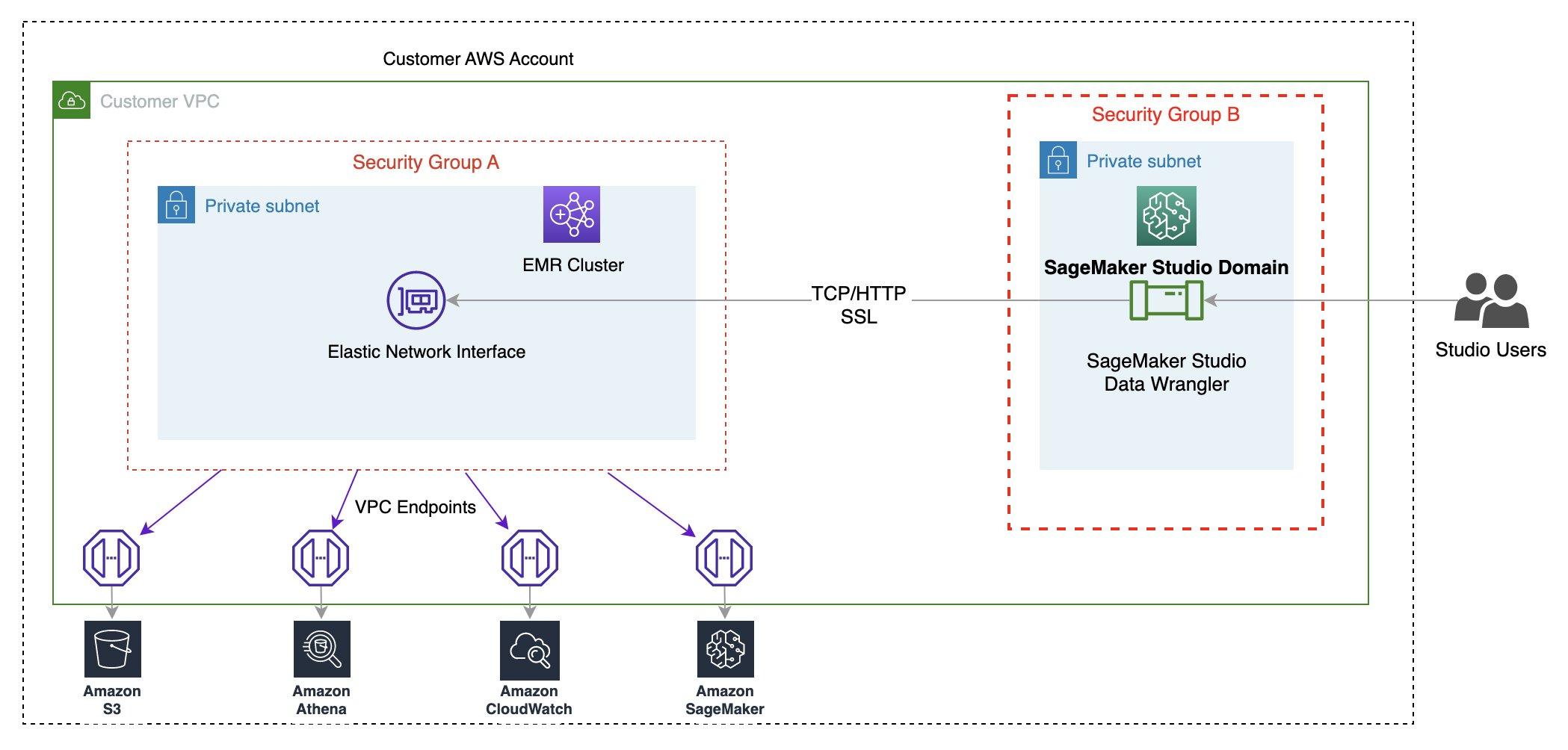

Das folgende Diagramm zeigt die verschiedenen in dieser Lösung verwendeten Komponenten.

Wir demonstrieren zwei Authentifizierungsoptionen, die verwendet werden können, um eine Verbindung zum EMR-Cluster herzustellen. Für jede Option stellen wir einen einzigartigen Stack von bereit AWS CloudFormation Templates.

Die CloudFormation-Vorlage führt die folgenden Aktionen aus, wenn jede Option ausgewählt wird:

- Erstellt eine Studio-Domäne im Nur-VPC-Modus zusammen mit einem Benutzerprofil mit dem Namen

studio-user. - Erstellt Bausteine, einschließlich VPC, Endpunkte, Subnetze, Sicherheitsgruppen, EMR-Cluster und andere erforderliche Ressourcen, um die Beispiele erfolgreich auszuführen.

- Verbindet für den EMR-Cluster den AWS Glue-Datenkatalog als Metastore für EMR Hive und Presto, erstellt eine Hive-Tabelle in EMR und füllt sie mit Daten aus einer US-Flughafendatensatz.

- Erstellt für die LDAP-CloudFormation-Vorlage eine Amazon Elastic Compute-Cloud (Amazon EC2)-Instance zum Hosten des LDAP-Servers zum Authentifizieren des Hive- und Presto-LDAP-Benutzers.

Option 1: Lightweight Access Directory Protocol

Für die CloudFormation-Vorlage für die LDAP-Authentifizierung stellen wir eine Amazon EC2-Instance mit einem LDAP-Server bereit und konfigurieren den EMR-Cluster so, dass dieser Server für die Authentifizierung verwendet wird. Dies ist TLS-fähig.

Option 2: Keine Authentifizierung

In der No-Auth-Authentifizierungs-CloudFormation-Vorlage verwenden wir einen standardmäßigen EMR-Cluster ohne aktivierte Authentifizierung.

Stellen Sie die Ressourcen mit AWS CloudFormation bereit

Führen Sie die folgenden Schritte aus, um die Umgebung bereitzustellen:

- Melden Sie sich bei der an AWS-Managementkonsole als AWS Identity and Access Management and (IAM) Benutzer, vorzugsweise ein Administrator.

- Auswählen

Stack starten um die CloudFormation-Vorlage für das entsprechende Authentifizierungsszenario zu starten. Stellen Sie sicher, dass die Region, die zum Bereitstellen des CloudFormation-Stacks verwendet wird, keine vorhandene Studio-Domäne hat. Wenn Sie bereits eine Studio-Domain in einer Region haben, können Sie eine andere Region auswählen.

LDAP

Kein Auth

- Auswählen Weiter.

- Aussichten für StapelnameGeben Sie einen Namen für den Stapel ein (z. B.

dw-emr-hive-blog). - Belassen Sie die anderen Werte als Standard.

- Um fortzufahren, wählen Sie Weiter von der Stack-Detailseite und den Stack-Optionen.

Der LDAP-Stack verwendet die folgenden Anmeldeinformationen.- Benutzername:

david - Passwort:

welcome123

- Benutzername:

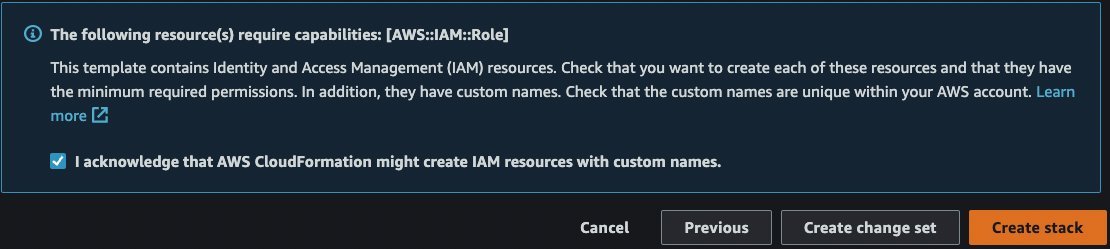

- Aktivieren Sie auf der Überprüfungsseite das Kontrollkästchen, um zu bestätigen, dass AWS CloudFormation möglicherweise Ressourcen erstellt.

- Auswählen

Stapel erstellen. Warten Sie, bis sich der Status des Stacks ändert

CREATE_IN_PROGRESSzuCREATE_COMPLETE. Der Vorgang dauert normalerweise 10 bis 15 Minuten.

Richten Sie Amazon EMR als Datenquelle in Data Wrangler ein

In diesem Abschnitt behandeln wir die Verbindung mit dem vorhandenen Amazon EMR-Cluster, der über die CloudFormation-Vorlage als Datenquelle in Data Wrangler erstellt wurde.

Erstellen Sie einen neuen Datenfluss

Führen Sie die folgenden Schritte aus, um Ihren Datenfluss zu erstellen:

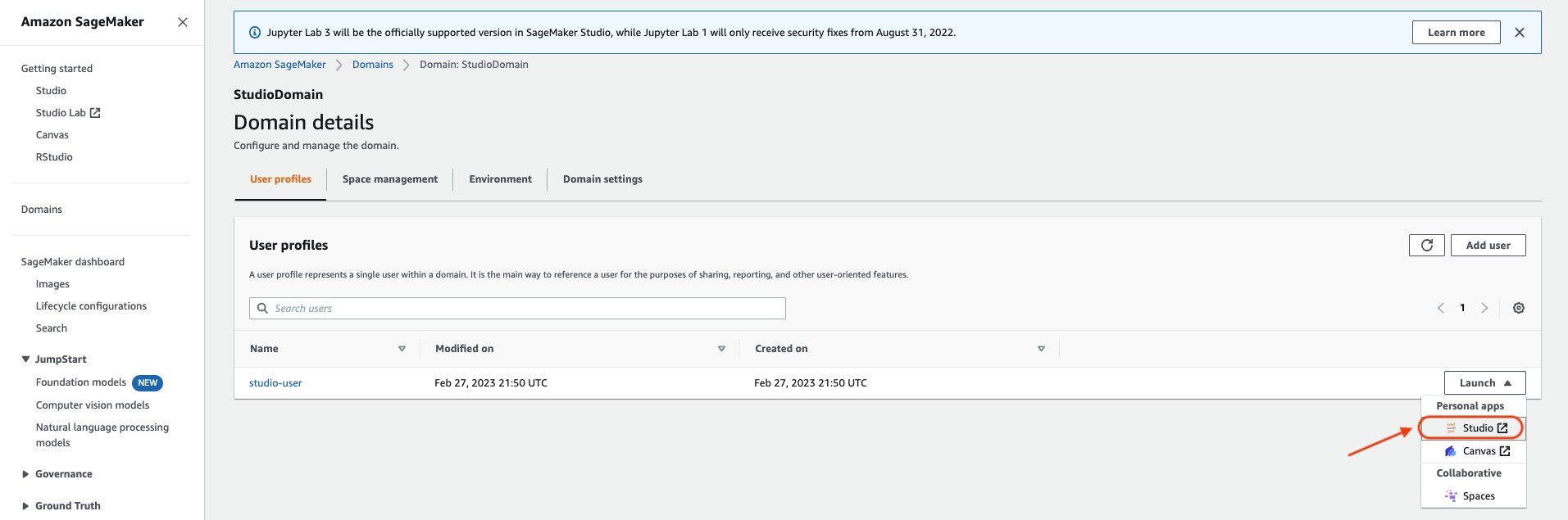

- Klicken Sie in der SageMaker-Konsole auf Domains, dann klicken Sie auf StudioDomain erstellt durch Ausführen über der CloudFormation-Vorlage.

- Auswählen Studio-Benutzer Benutzerprofil und starten Sie Studio.

- Auswählen Offenes Atelier.

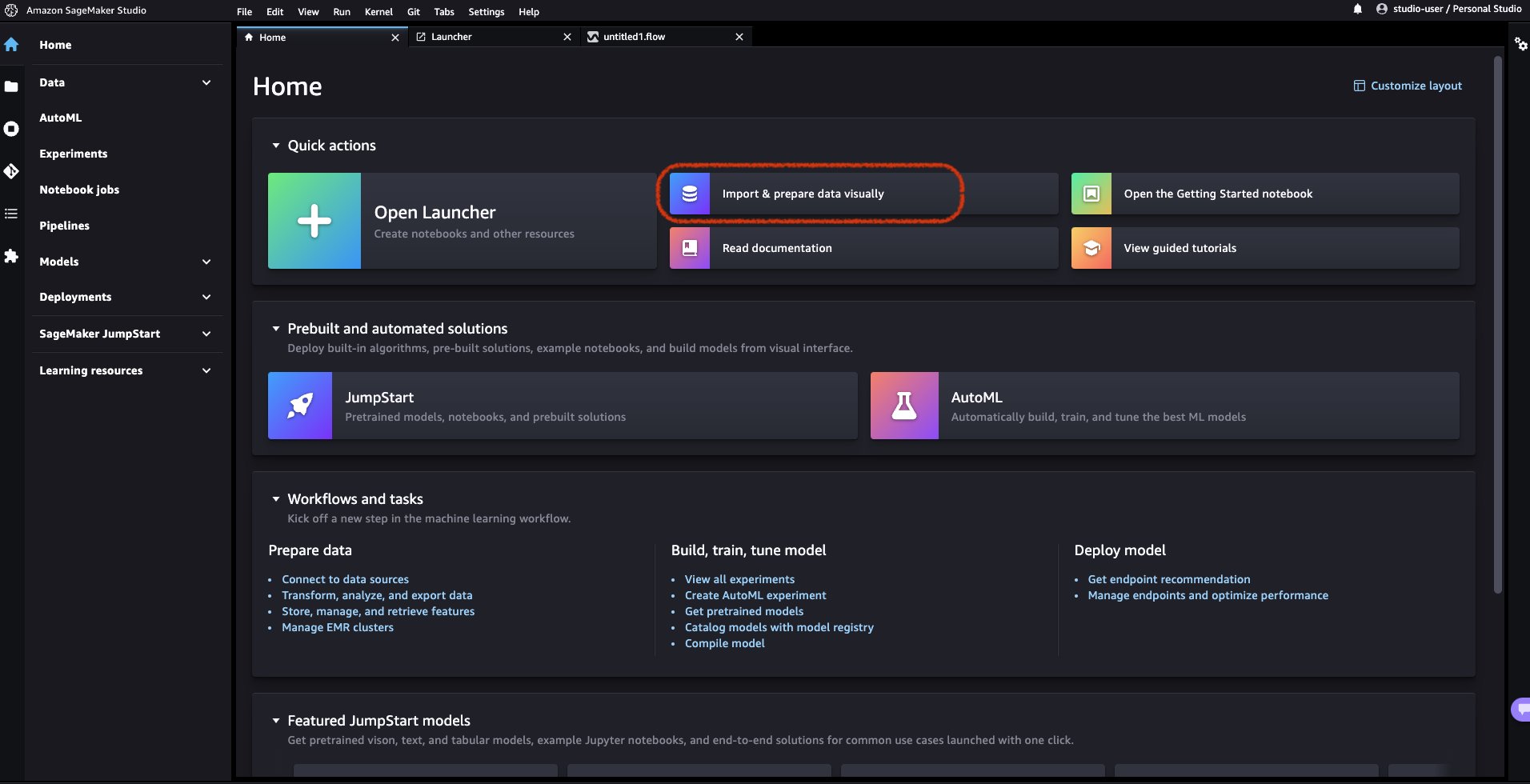

- Wählen Sie in der Studio Home-Konsole aus Daten visuell importieren und aufbereiten. Alternativ auf der Reichen Sie das Dropdown, wählen Sie Neu, Dann wählen Daten-Wrangler-Flow.

- Das Erstellen eines neuen Flows kann einige Minuten dauern. Nachdem der Flow erstellt wurde, sehen Sie die Daten importieren

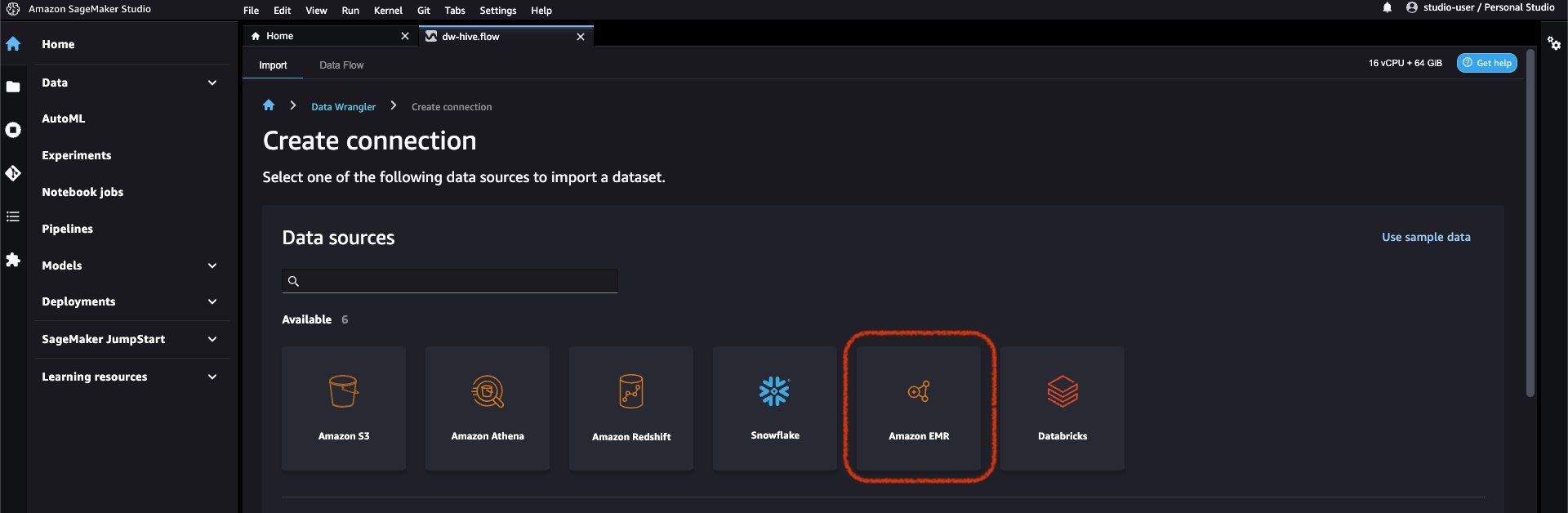

- Fügen Sie Amazon EMR als Datenquelle in Data Wrangler hinzu. Auf der Datenquelle hinzufügen Menü, wählen Sie Amazon EMR.

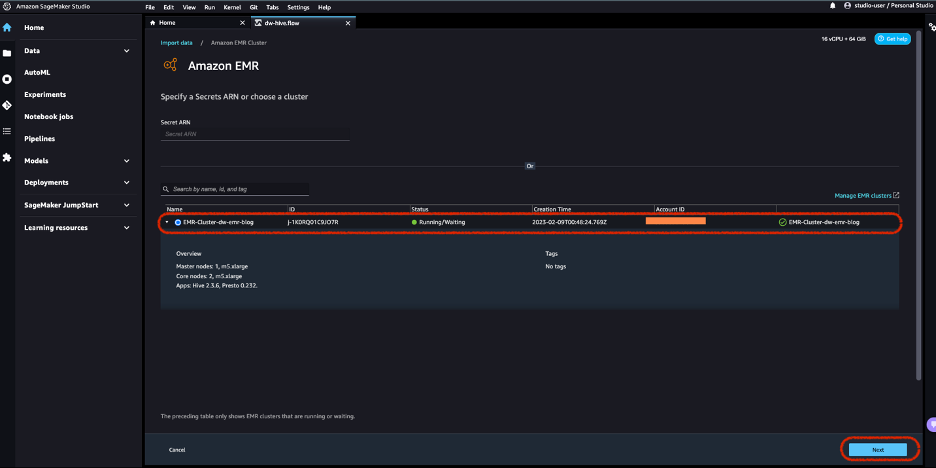

Sie können alle EMR-Cluster durchsuchen, zu deren Anzeige Ihre Studio-Ausführungsrolle berechtigt ist. Sie haben zwei Möglichkeiten, sich mit einem Cluster zu verbinden; eine erfolgt über die interaktive Benutzeroberfläche und die andere über die erste Erstellen Sie ein Geheimnis mit AWS Secrets Manager mit JDBC-URL, einschließlich EMR-Clusterinformationen, und geben Sie dann den gespeicherten geheimen AWS-ARN in der Benutzeroberfläche an, um eine Verbindung zu Hive herzustellen. In diesem Blog folgen wir der ersten Option.

- Wählen Sie einen der folgenden Cluster aus, den Sie verwenden möchten. Klicken Sie auf Weiter, und wählen Sie Endpunkte aus.

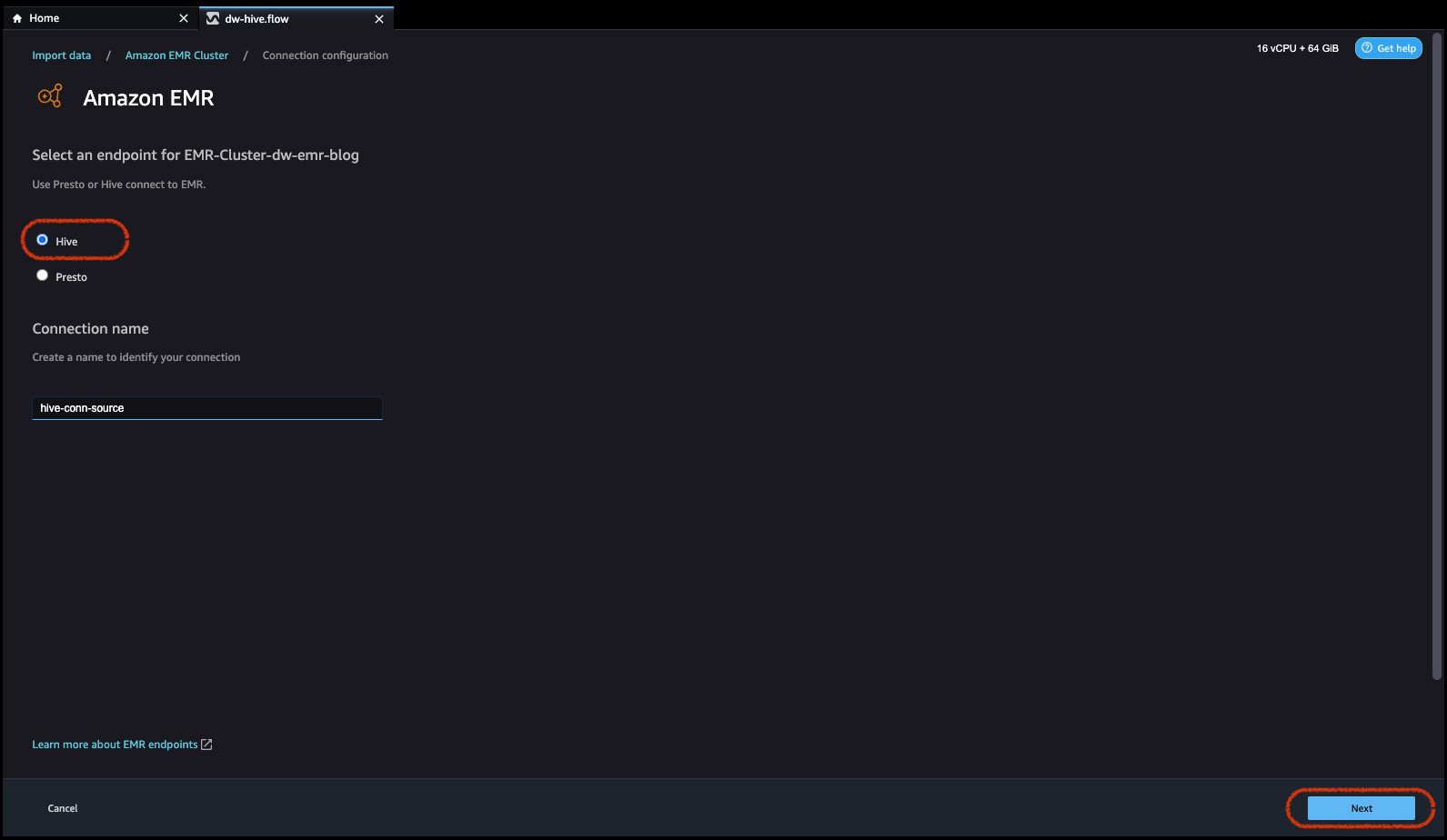

- Auswählen Bienenstock, Stellen Sie eine Verbindung zu Amazon EMR her, erstellen Sie einen Namen, um Ihre Verbindung zu identifizieren, und klicken Sie auf Weiter.

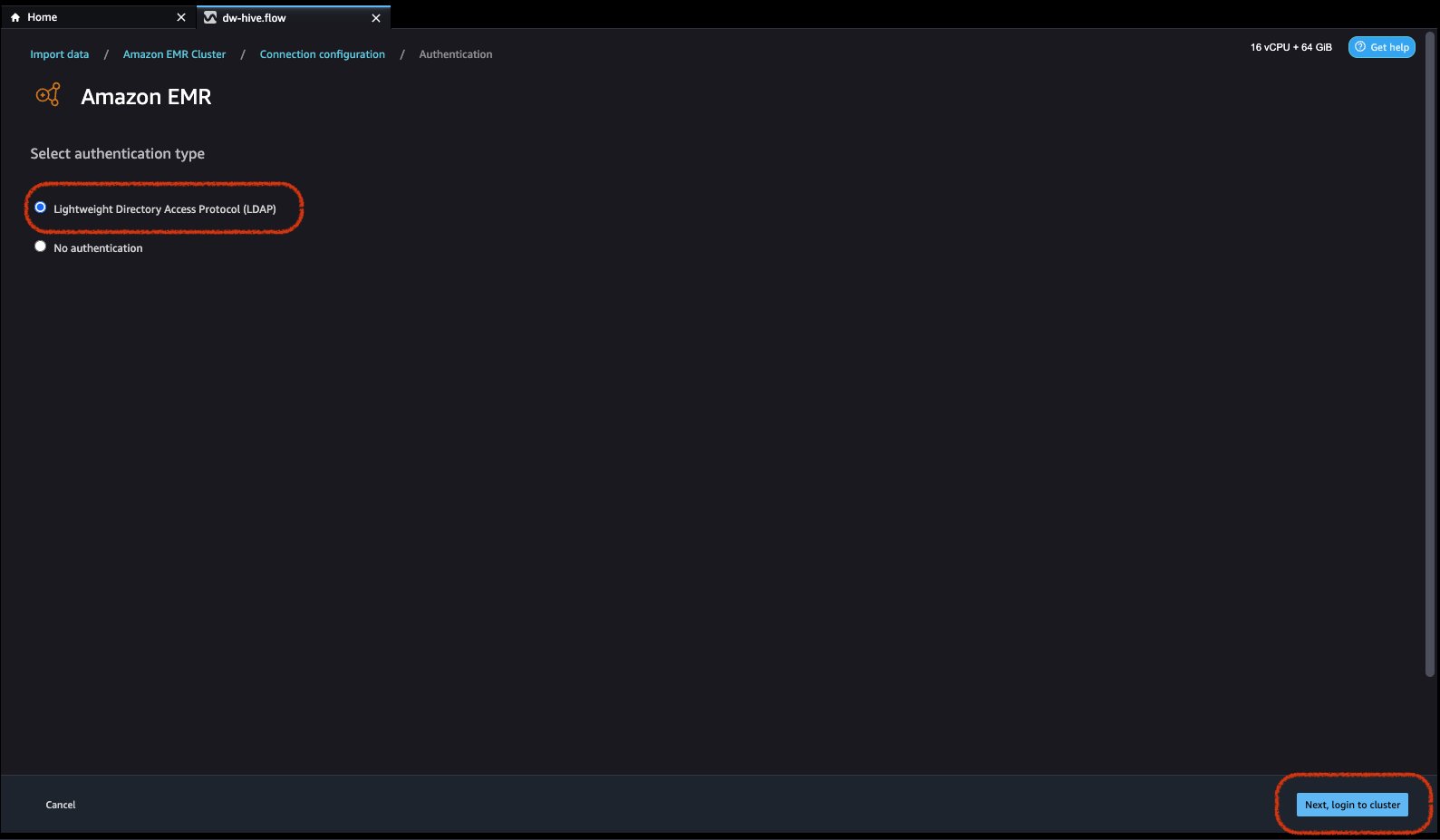

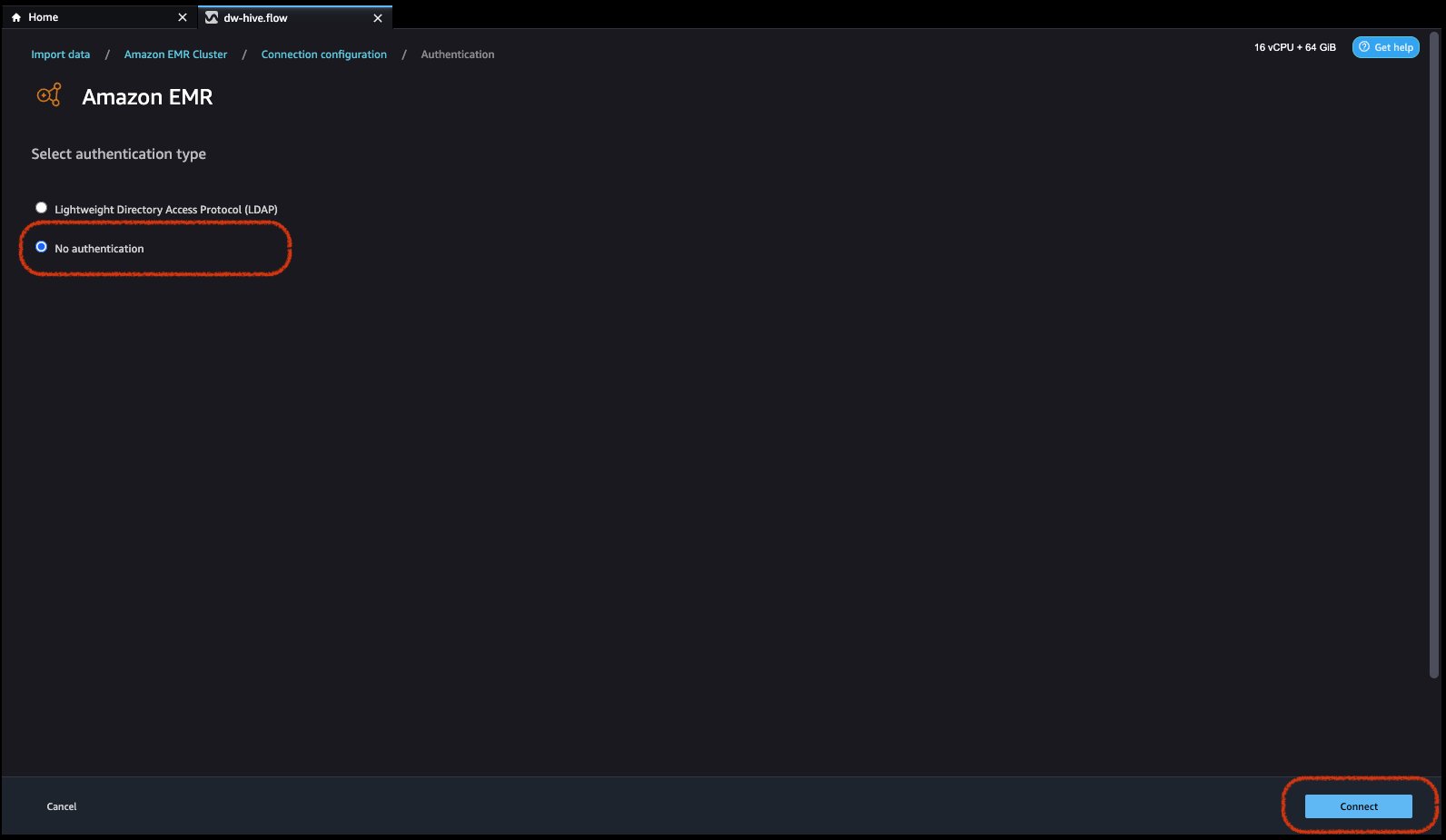

- Wählen Sie entweder den Authentifizierungstyp aus LDAP (Lightweight Directory Access Protocol) or Keine Authentifikation.

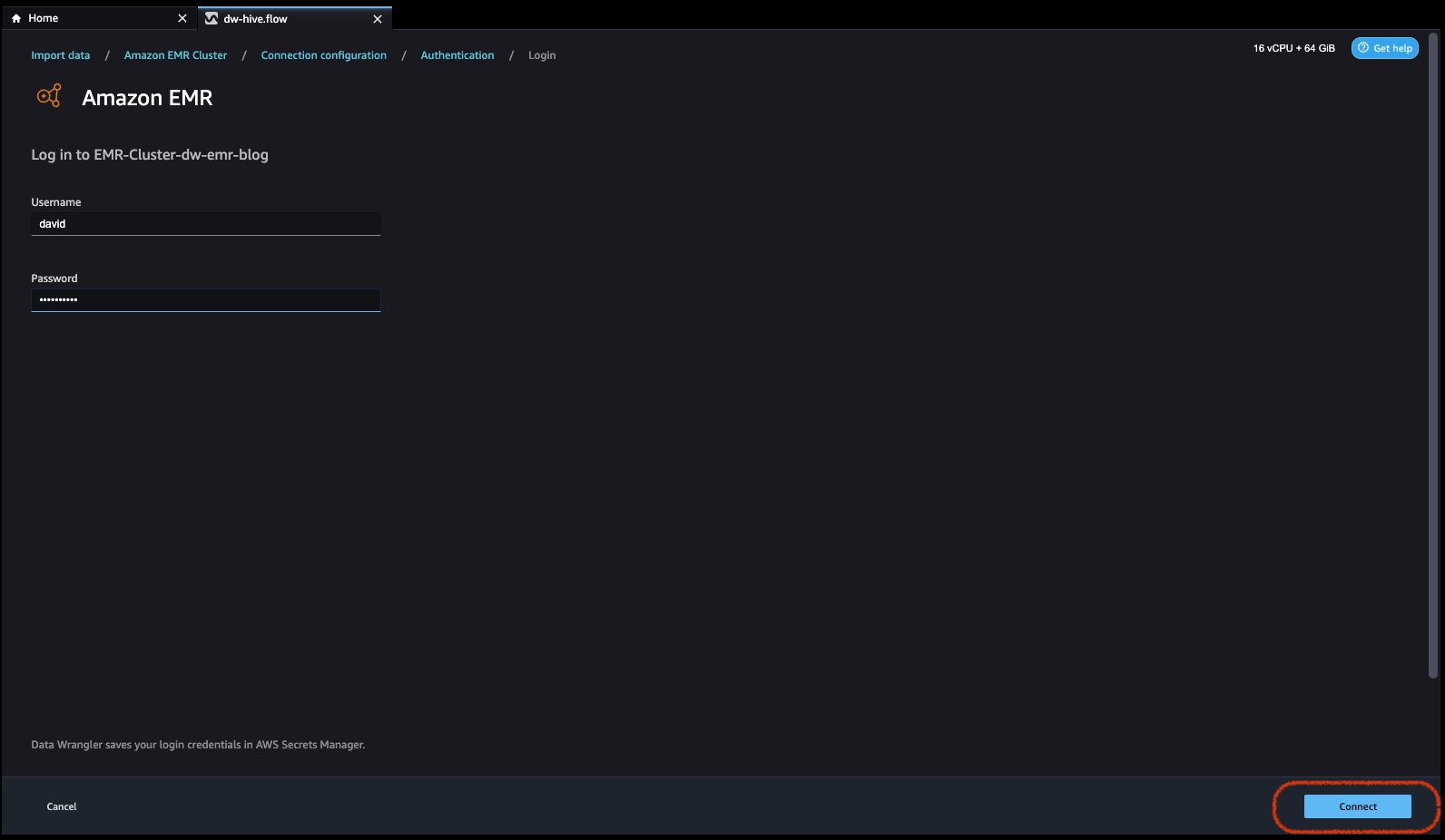

Wählen Sie für Lightweight Directory Access Protocol (LDAP) die Option aus und klicken Sie auf Melden Sie sich als Nächstes beim Cluster anr, geben Sie dann den zu authentifizierenden Benutzernamen und das Kennwort ein und klicken Sie auf Verbinden.

Bei „Keine Authentifizierung“ werden Sie mit EMR Hive verbunden, ohne Benutzeranmeldeinformationen in VPC bereitzustellen. Rufen Sie die SQL-Explorer-Seite von Data Wrangler für EMR auf.

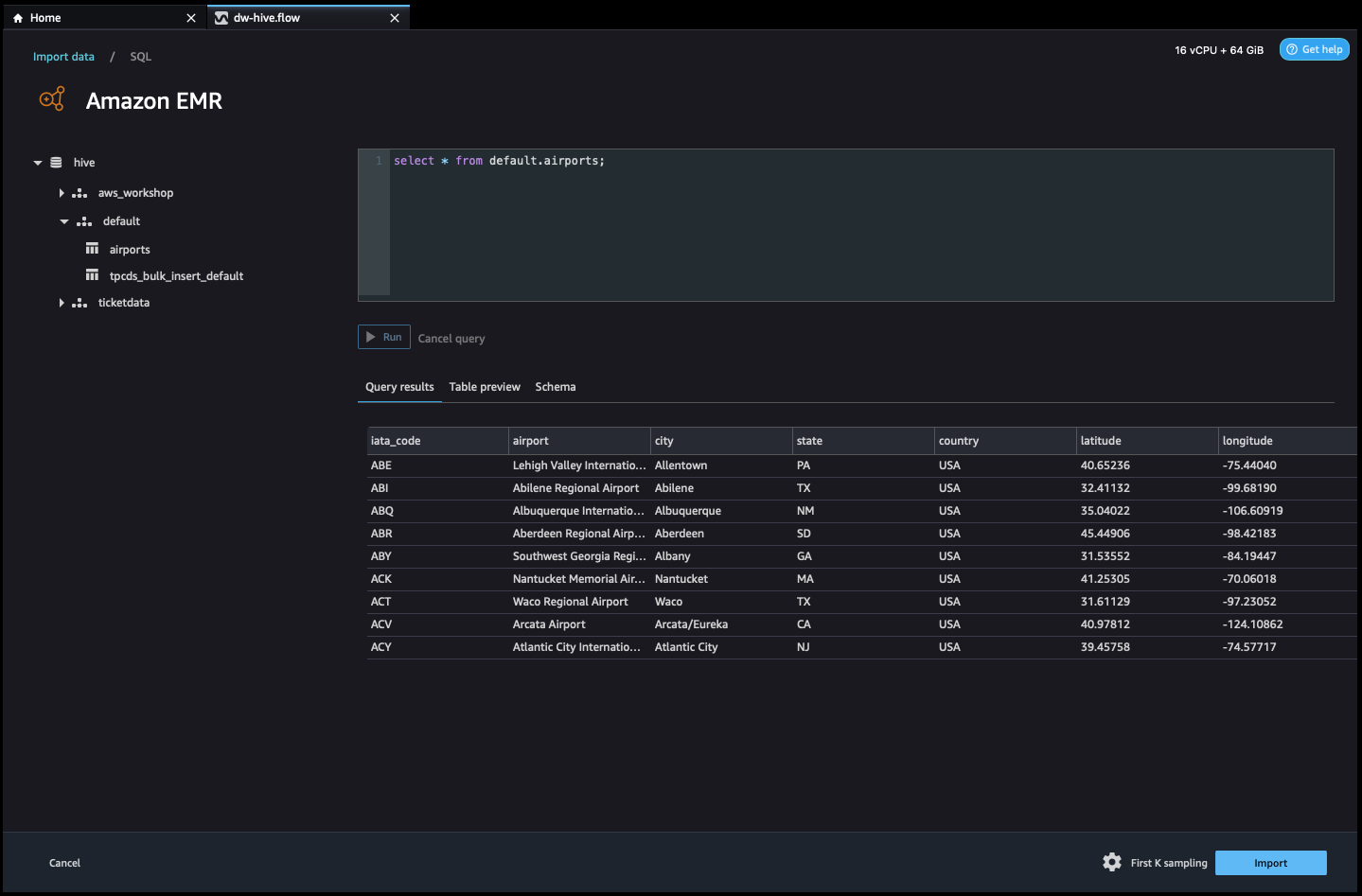

- Sobald die Verbindung hergestellt ist, können Sie interaktiv einen Datenbankbaum und eine Tabellenvorschau oder ein Schema anzeigen. Sie können auch Daten von EMR abfragen, untersuchen und visualisieren. Für die Vorschau sehen Sie standardmäßig ein Limit von 100 Datensätzen. Sobald Sie eine SQL-Anweisung in das Feld des Abfrageeditors eingeben und auf die Schaltfläche klicken Führen Sie klicken, wird die Abfrage auf der Hive-Engine von EMR ausgeführt, um eine Vorschau der Daten anzuzeigen.

Das Abfrage abbrechen Mit der Schaltfläche können laufende Abfragen abgebrochen werden, wenn sie ungewöhnlich lange dauern.

- Der letzte Schritt ist der Import. Sobald Sie mit den abgefragten Daten fertig sind, haben Sie die Möglichkeit, die Stichprobeneinstellungen für die Datenauswahl entsprechend dem Stichprobentyp (FirstK, Random oder Stratified) und der Stichprobengröße für den Import von Daten in Data Wrangler zu aktualisieren.

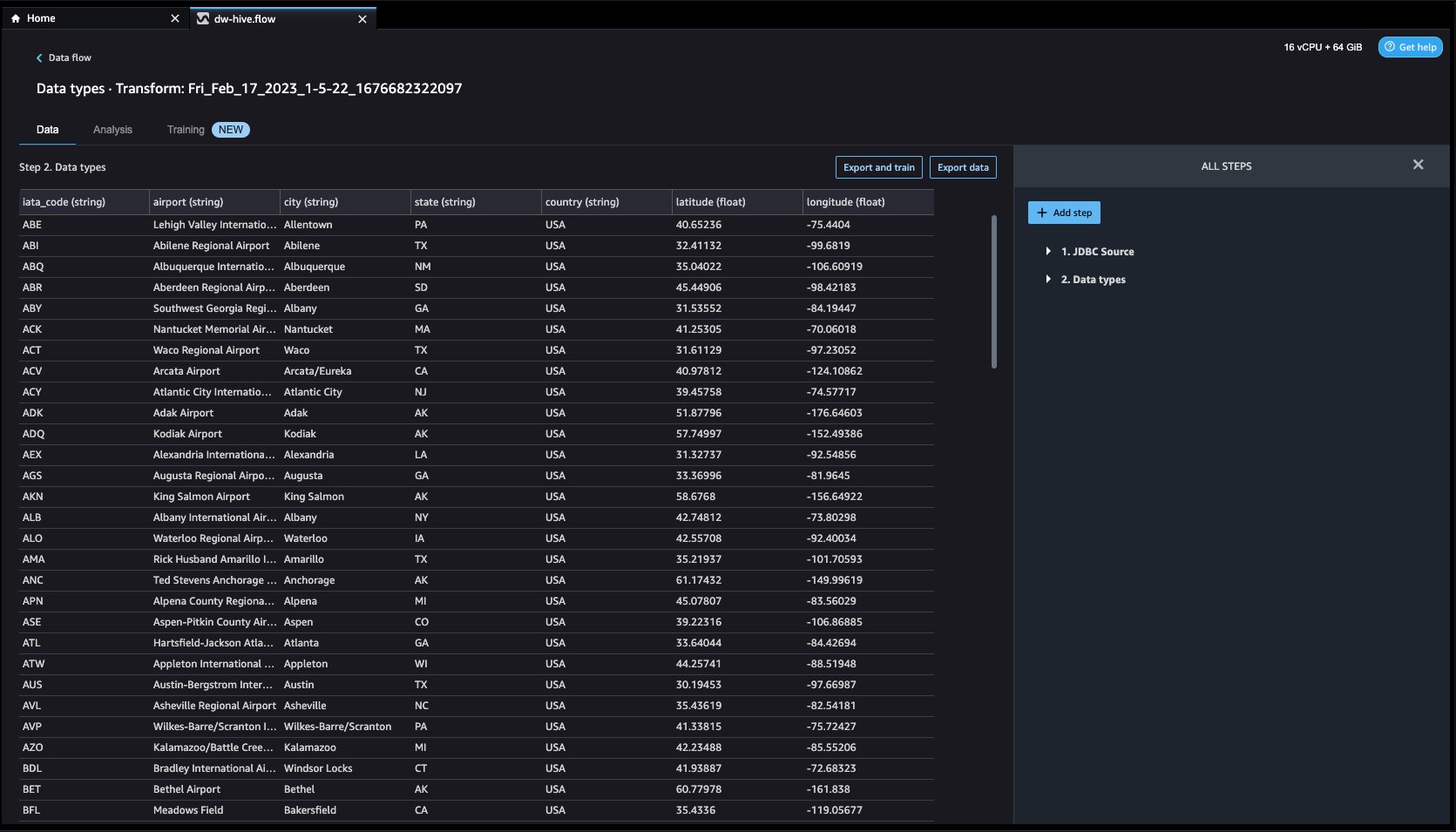

Klicken Sie auf Kostenlos erhalten und dann auf Installieren. Import. Die Vorbereitungsseite wird geladen, sodass Sie dem Datensatz verschiedene Transformationen und grundlegende Analysen hinzufügen können.

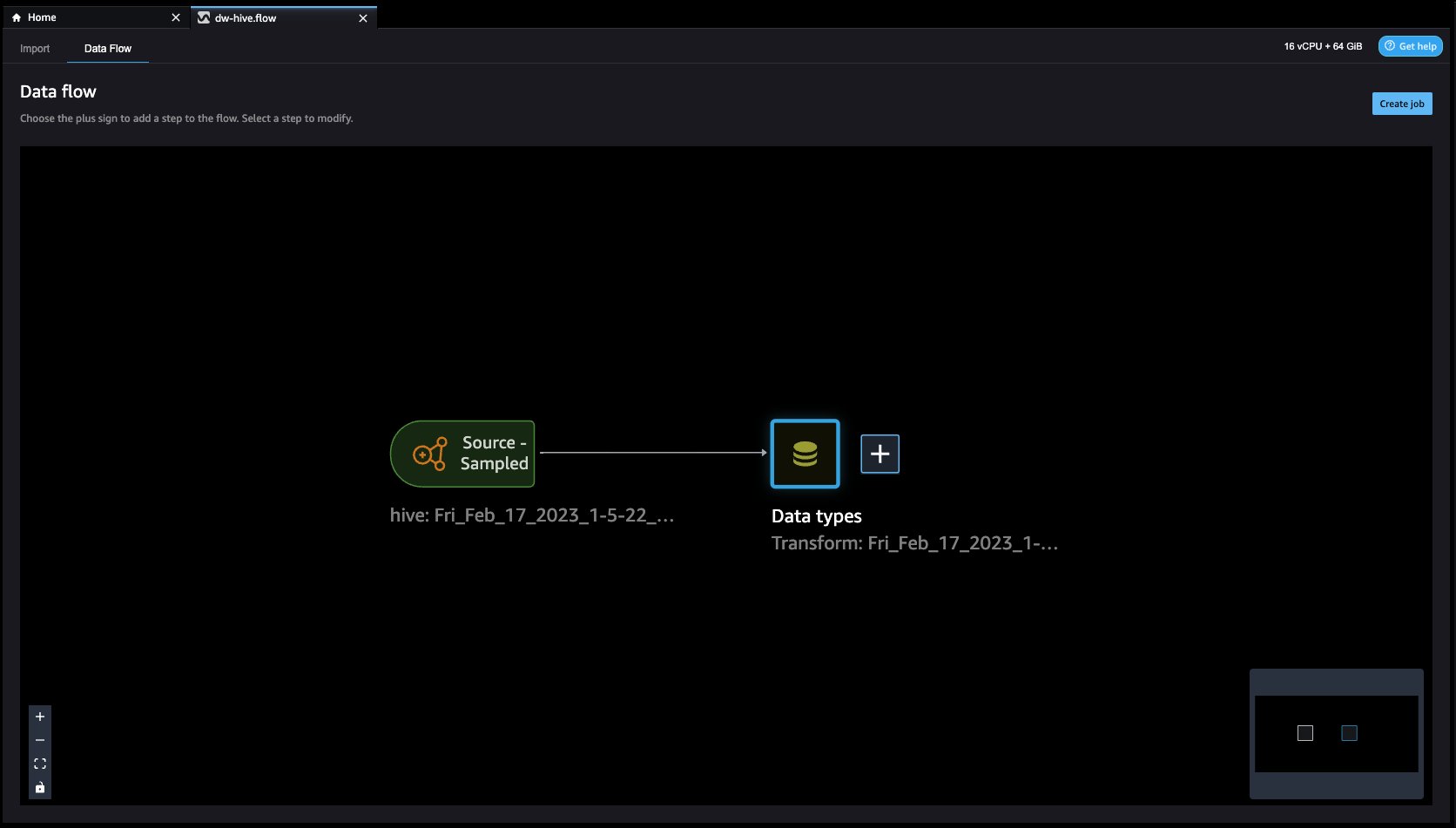

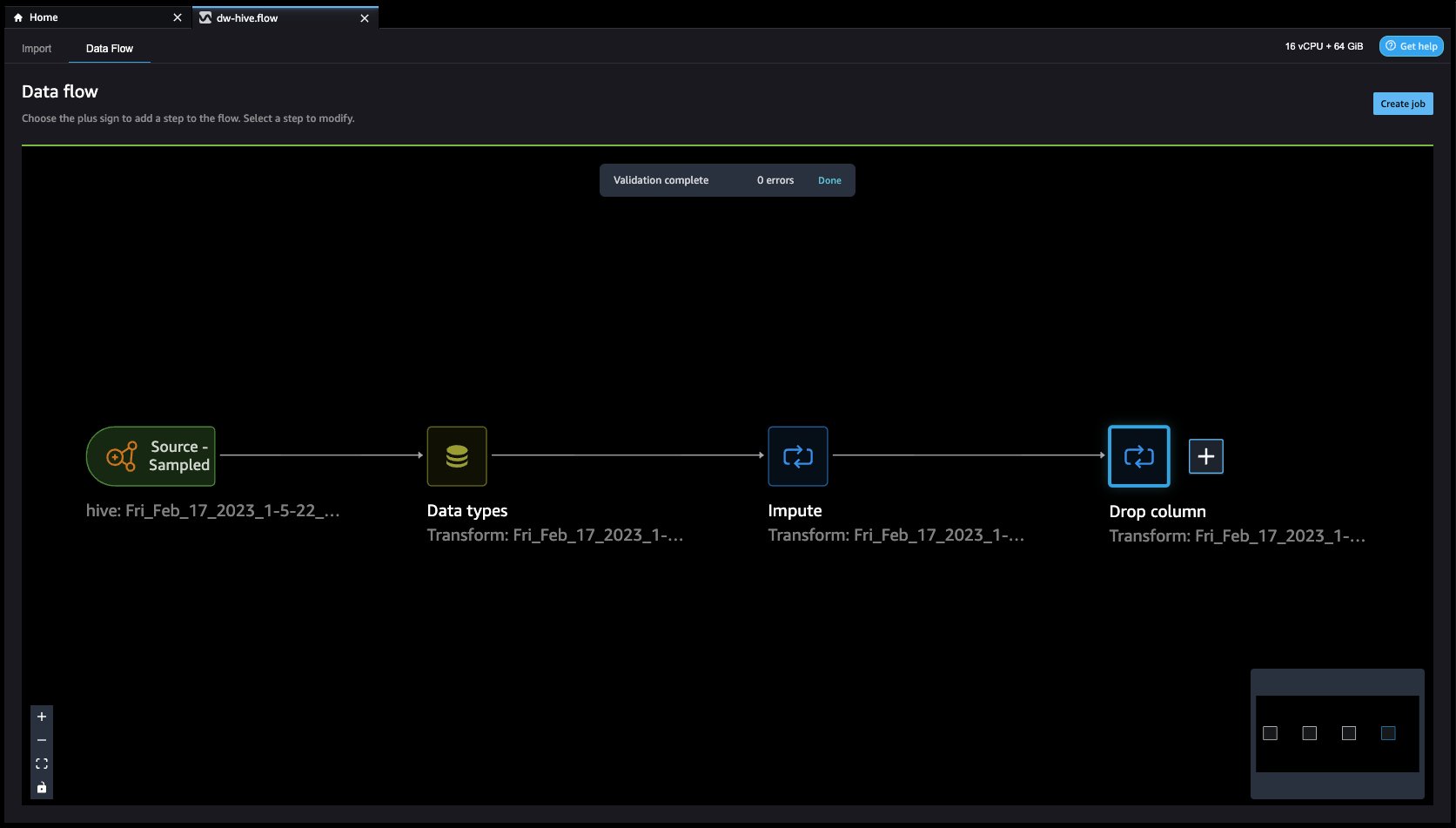

- Navigieren Datenfluss aus dem oberen Bildschirm und fügen Sie dem Ablauf je nach Bedarf weitere Schritte für Transformationen und Analysen hinzu. Sie können eine ausführen Dateneinblicksbericht um Datenqualitätsprobleme zu identifizieren und Empfehlungen zur Behebung dieser Probleme zu erhalten. Sehen wir uns einige Beispieltransformationen an.

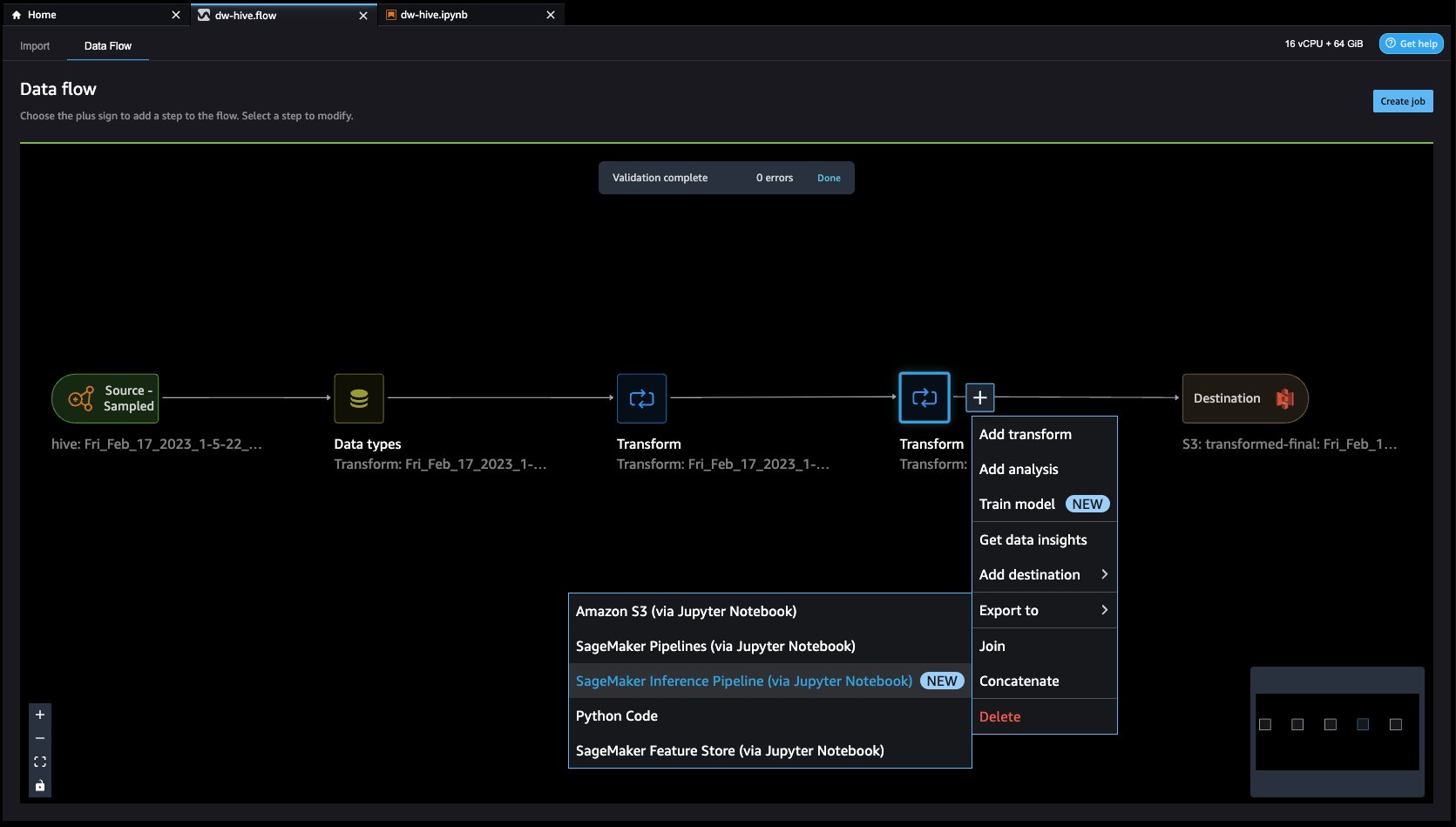

- Im Datenfluss sehen, sollten Sie sehen, dass wir EMR als Datenquelle mit dem Hive-Konnektor verwenden.

- Klicken wir auf die + Knopf rechts neben Datentypen und wählen Sie Transformation hinzufügen. Wenn Sie das tun, kehren Sie zu zurück Daten-Management Aussicht.

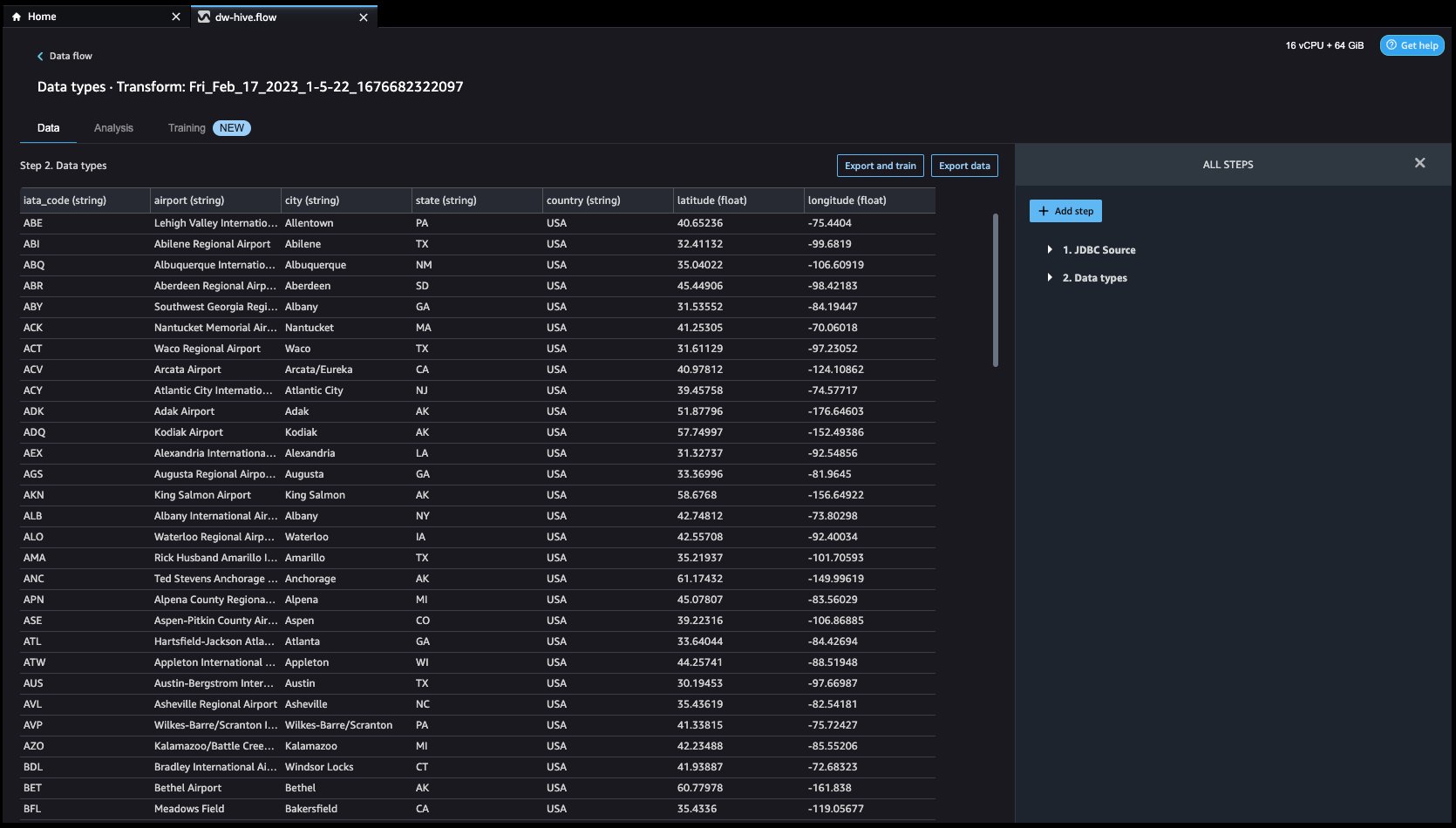

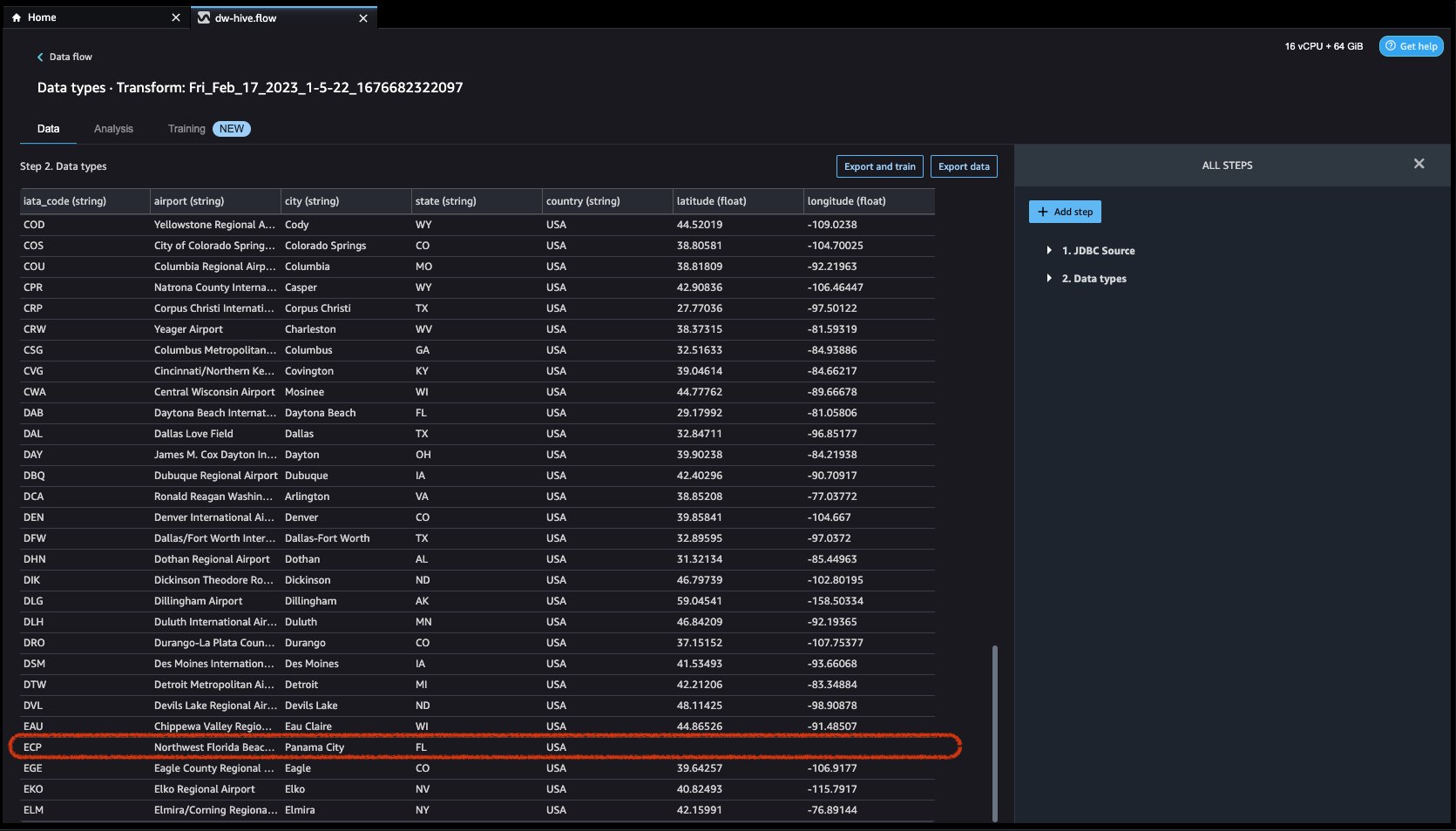

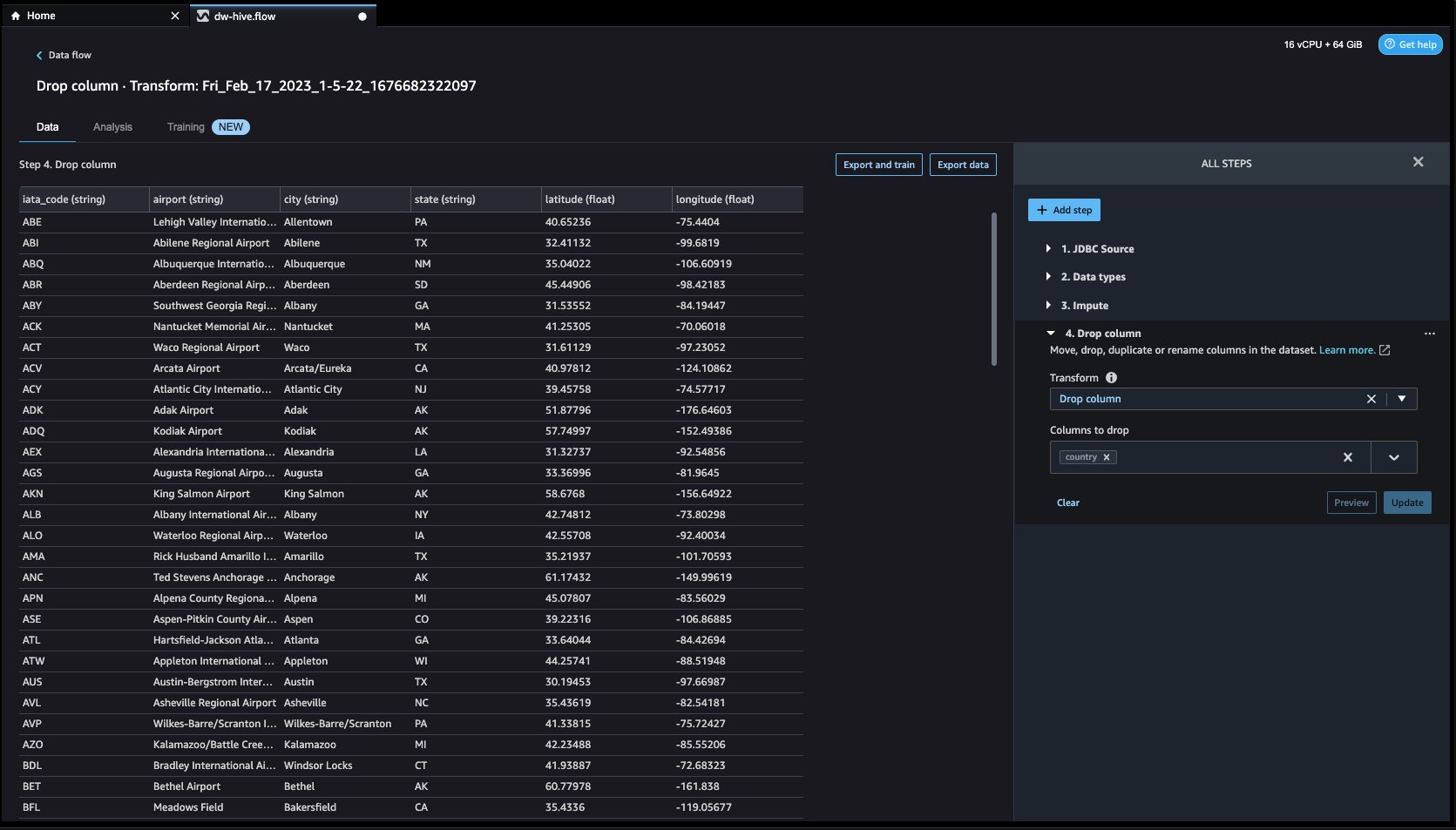

Lassen Sie uns die Daten untersuchen. Wir sehen, dass es mehrere Funktionen hat, wie z iata_code, Flughafen, Stadt, Zustand, Land, Breite und Länge. Wir können sehen, dass der gesamte Datensatz in einem Land basiert, nämlich den USA, und dass dort Werte fehlen Breite und Länge. Fehlende Daten können zu Verzerrungen bei der Schätzung von Parametern führen und die Repräsentativität der Stichproben verringern, sodass wir einige durchführen müssen Anrechnung und behandeln Sie fehlende Werte in unserem Datensatz.

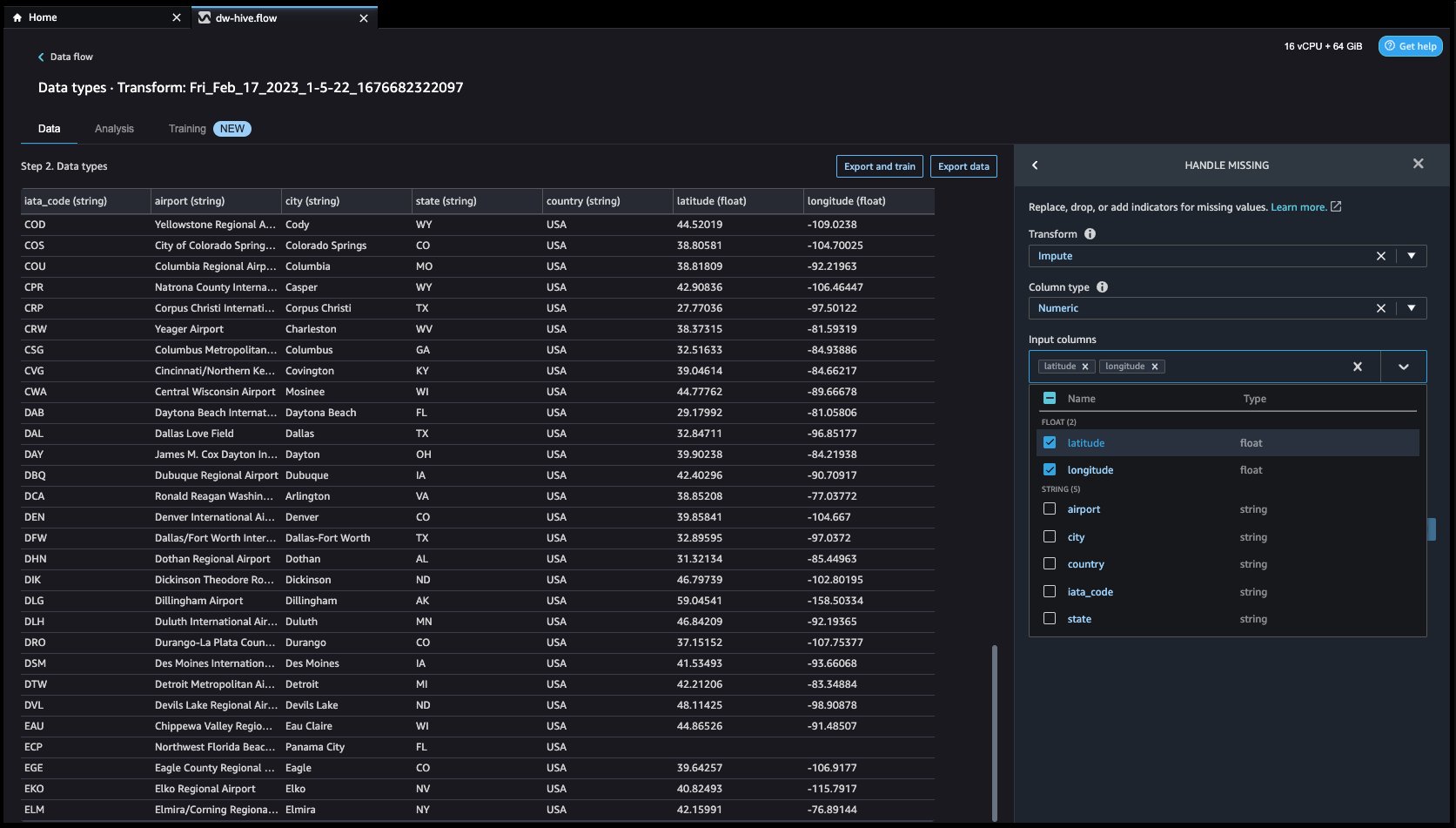

- Klicken wir auf die Schritt hinzufügen Schaltfläche rechts in der Navigationsleiste. Auswählen Griff fehlt. Die Konfigurationen sind in den folgenden Screenshots zu sehen.

Der Verwandeln, wählen unterstellen. Wählen Sie die Spaltentyp as Numerisch und Eingabespalte Namen Breite und Längengrad. Wir werden die fehlenden Werte unter Verwendung eines ungefähren Medianwerts imputieren.

Klicken Sie zuerst auf Vorspann , um den fehlenden Wert anzuzeigen, und klicken Sie dann auf Aktualisieren, um die Transformation hinzuzufügen.

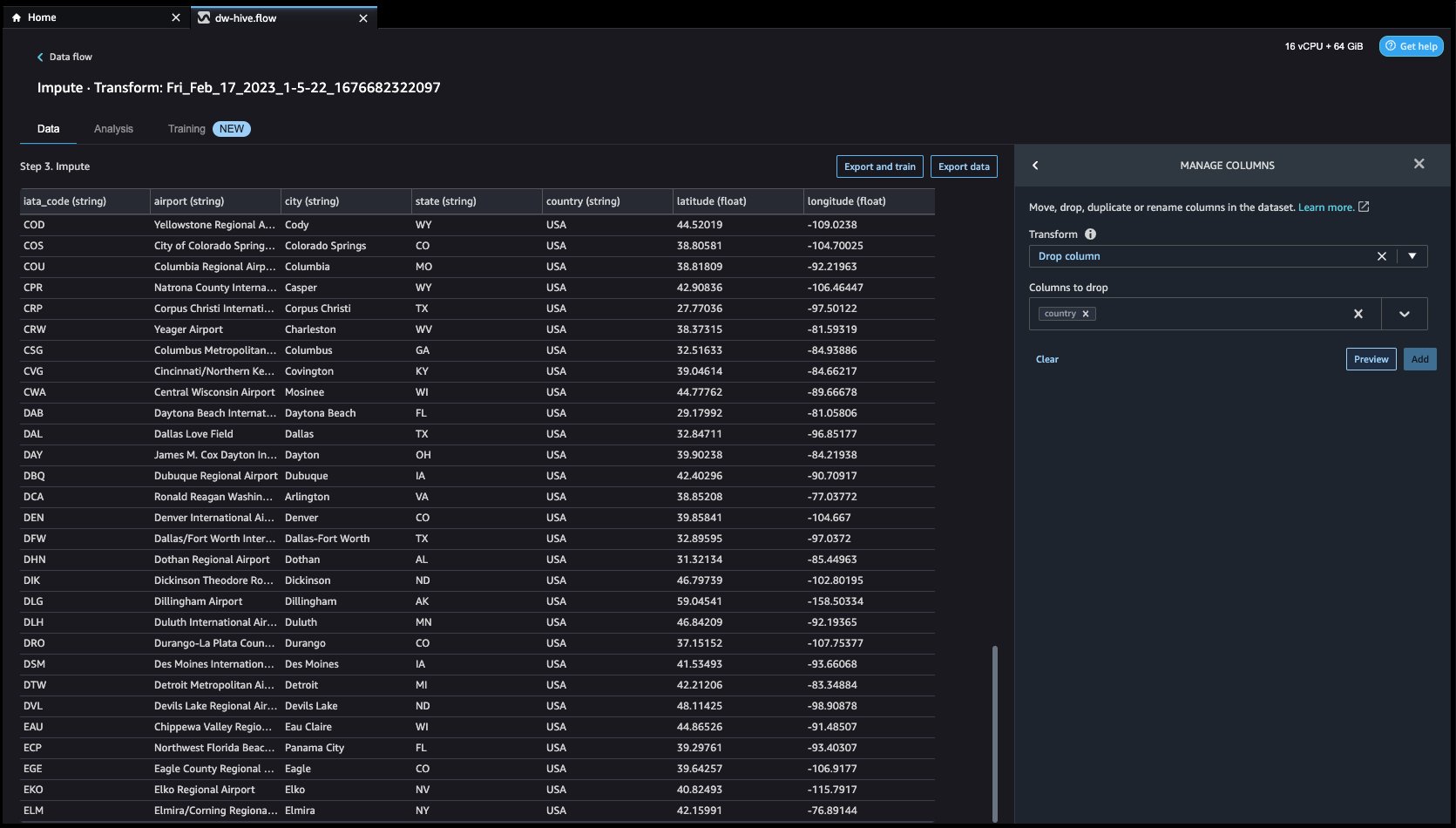

- Sehen wir uns nun eine weitere Beispieltransformation an. Beim Erstellen eines ML-Modells werden Spalten entfernt, wenn sie redundant sind oder Ihrem Modell nicht helfen. Die häufigste Methode zum Entfernen einer Spalte besteht darin, sie zu löschen. In unserem Datensatz ist das Feature Land kann gelöscht werden, da der Datensatz speziell für US-Flughafendaten vorgesehen ist. Um Spalten zu verwalten, klicken Sie auf Schritt hinzufügen Schaltfläche auf der Navigationsleiste rechts und wählen Sie aus Spalten verwalten. Die Konfigurationen sind in den folgenden Screenshots zu sehen. Unter TransformierenWählen Spalte löschen, und unter Spalten zum AblegenWählen Land.

- Klicken Sie auf Vorspann und dann Aktualisierung um die Säule fallen zu lassen.

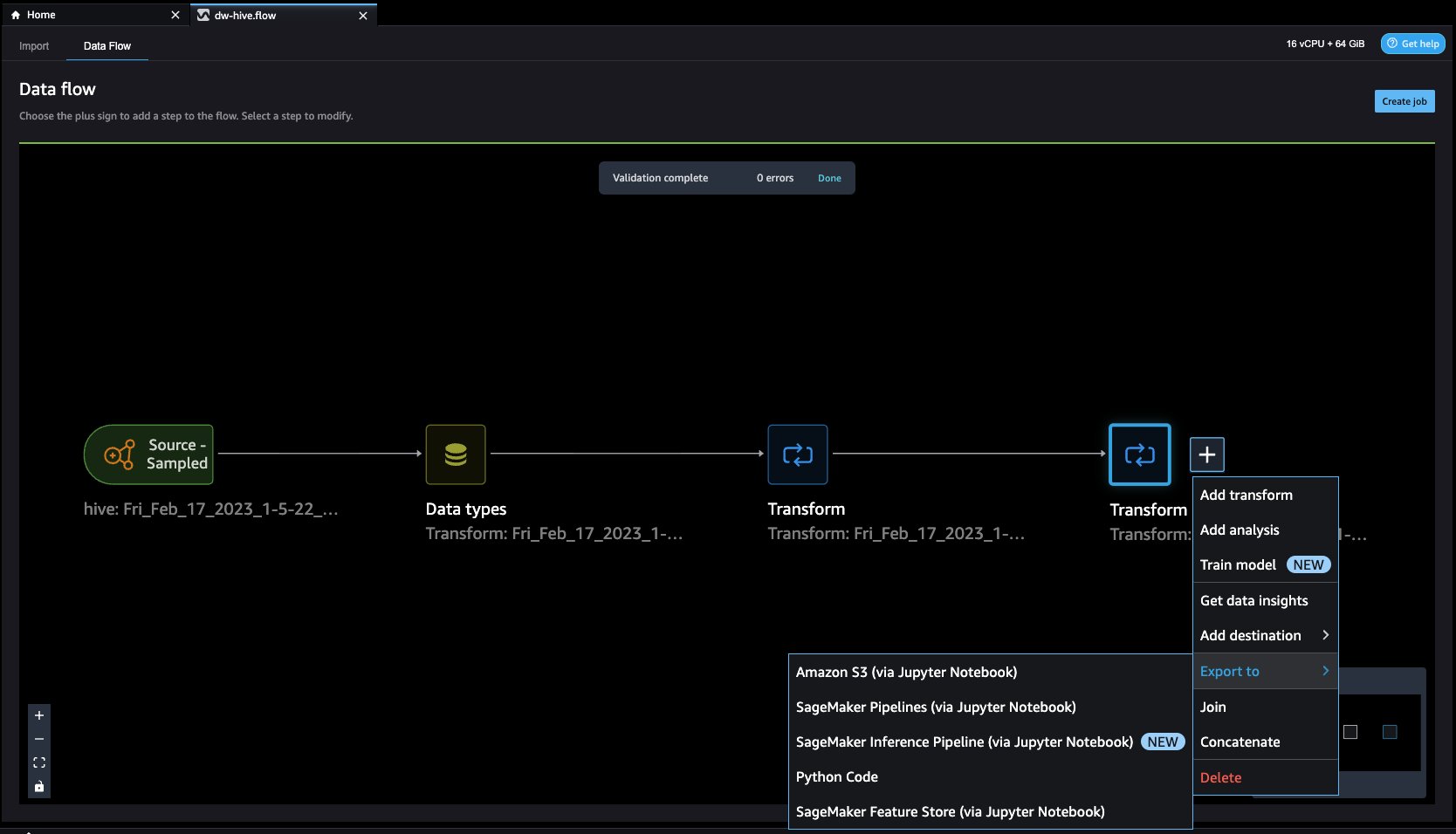

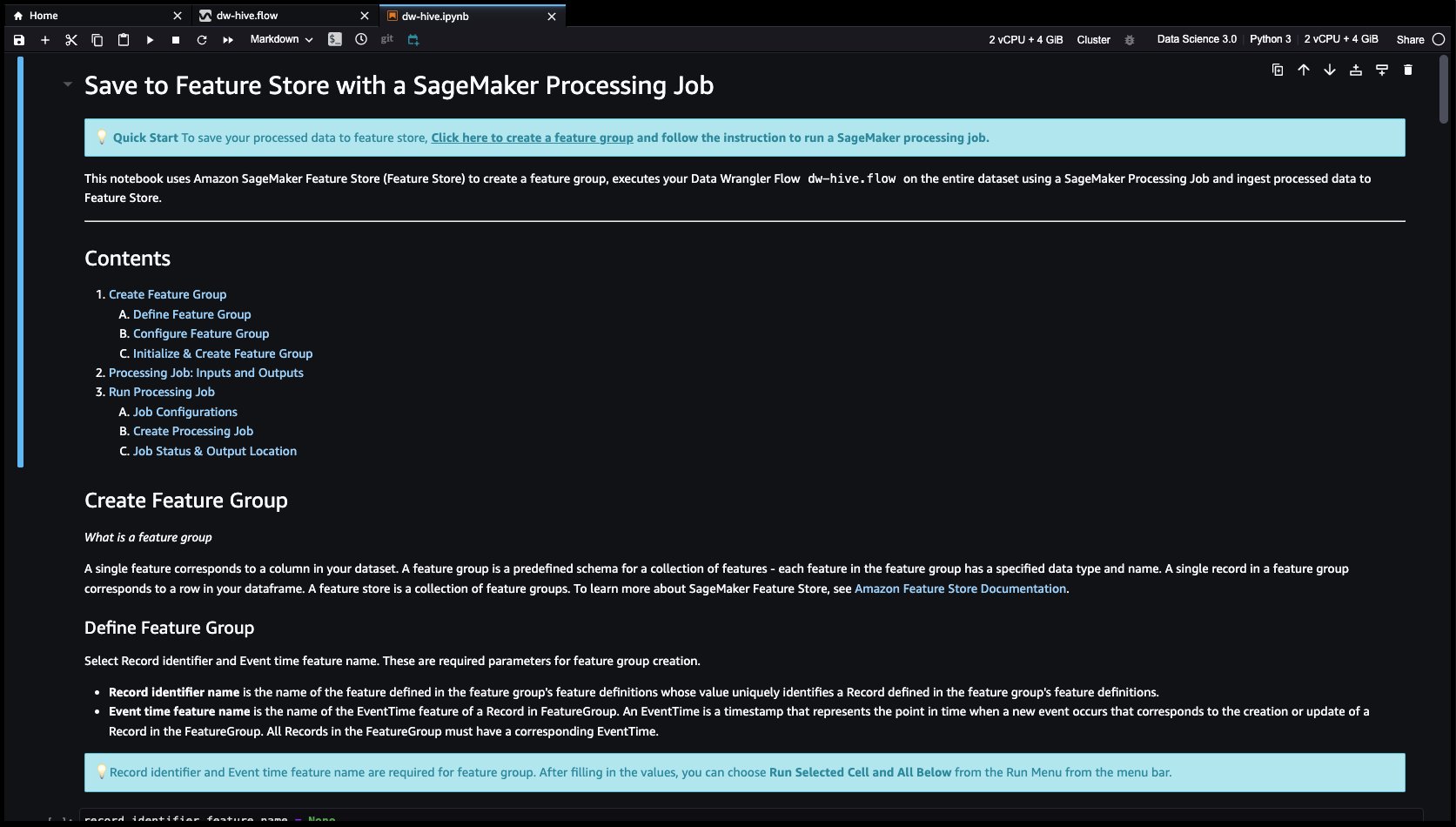

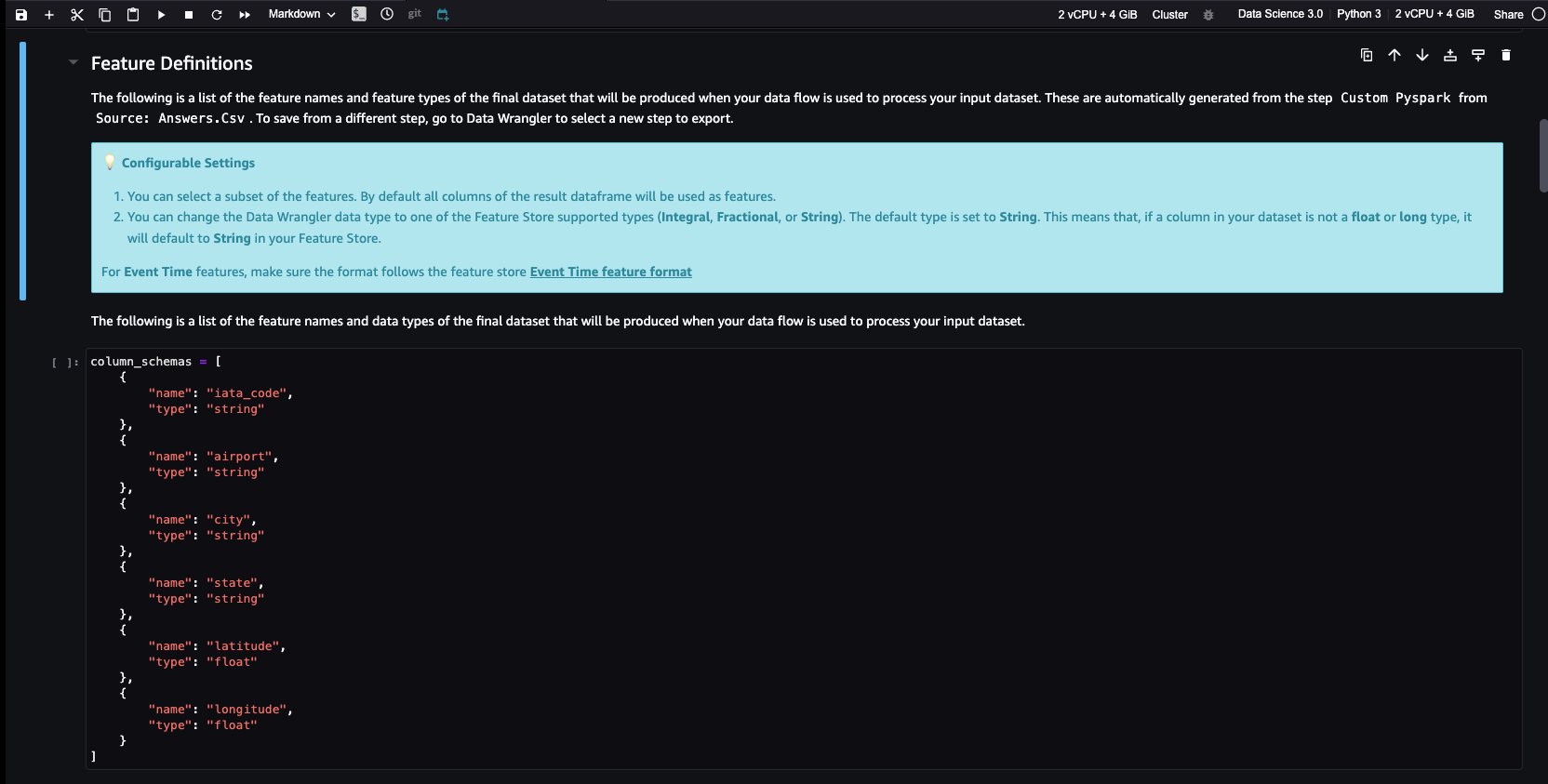

- Feature Store ist ein Repository zum Speichern, Freigeben und Verwalten von Features für ML-Modelle. Klicken wir auf die + Knopf rechts neben Spalte löschen. Wählen Exportieren nach und wählen Sie SageMaker Feature Store (über Jupyter-Notebook).

- Durch die Auswahl SageMaker Feature Store Als Ziel können Sie die Features in einer vorhandenen Feature-Gruppe speichern oder eine neue erstellen.

Wir haben jetzt Features mit Data Wrangler erstellt und diese Features einfach im Feature Store gespeichert. Wir haben einen Beispiel-Workflow für Feature-Engineering in der Data Wrangler-Benutzeroberfläche gezeigt. Dann haben wir diese Features direkt aus Data Wrangler im Feature Store gespeichert, indem wir eine neue Feature-Gruppe erstellt haben. Schließlich haben wir einen Verarbeitungsjob ausgeführt, um diese Features in den Feature Store aufzunehmen. Data Wrangler und Feature Store haben uns zusammen dabei geholfen, automatische und wiederholbare Prozesse zu entwickeln, um unsere Datenvorbereitungsaufgaben mit minimalem Programmieraufwand zu rationalisieren. Data Wrangler bietet uns auch die Flexibilität, denselben Datenvorbereitungsfluss zu automatisieren geplante Jobs. Wir können auch automatisch Trainieren und implementieren Sie Modelle mit SageMaker Autopilot über die visuelle Benutzeroberfläche von Data Wrangler, oder erstellen Sie eine Trainings- oder Feature-Engineering-Pipeline mit SageMaker-Pipelines (über Jupyter Notebook) und stellen Sie sie am Inferenzendpunkt mit der SageMaker-Inferenzpipeline (über Jupyter Notebook) bereit.

Aufräumen

Wenn Ihre Arbeit mit Data Wrangler abgeschlossen ist, helfen Ihnen die folgenden Schritte, die erstellten Ressourcen zu löschen, um zusätzliche Gebühren zu vermeiden.

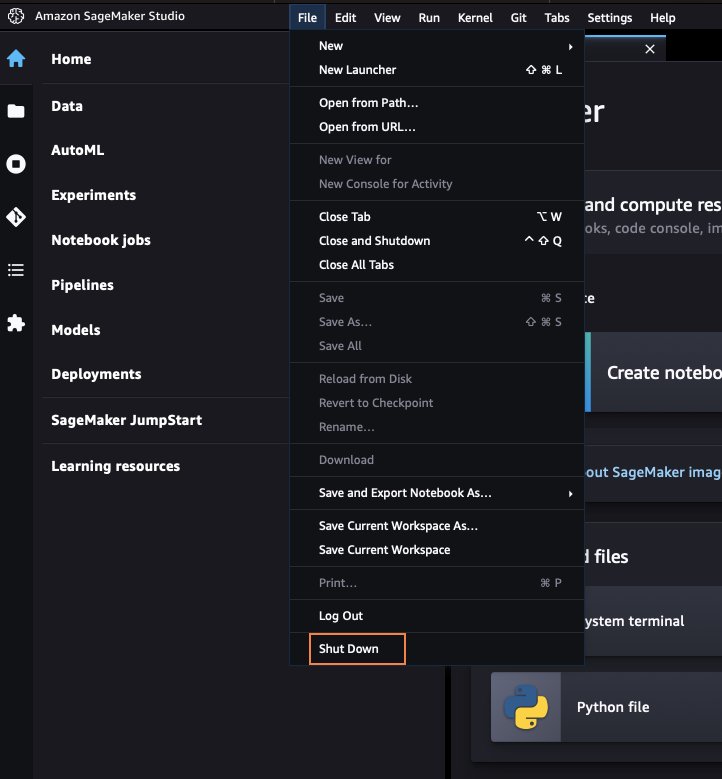

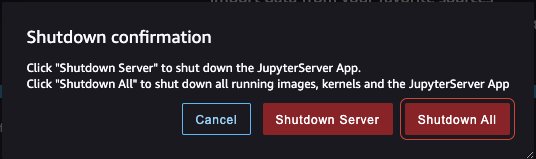

- Beenden Sie SageMaker Studio.

Schließen Sie in SageMaker Studio alle Registerkarten und wählen Sie dann aus Reichen Sie das dann schließen. Sobald Sie dazu aufgefordert werden, wählen Sie aus Alle herunterfahren.

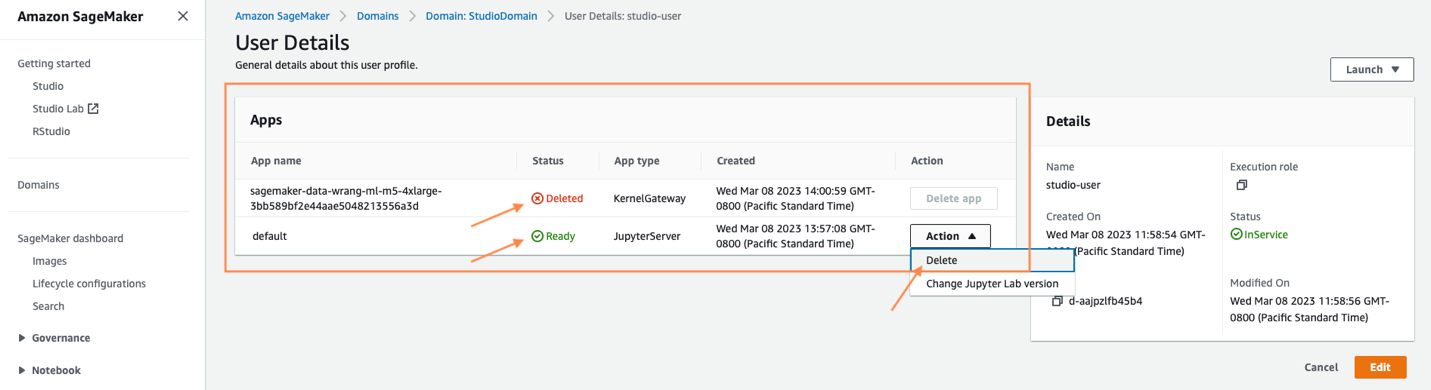

Das Herunterfahren kann je nach Instance-Typ einige Minuten dauern. Stellen Sie sicher, dass alle mit dem Benutzerprofil verknüpften Apps gelöscht wurden. Wenn sie nicht gelöscht wurden, löschen Sie die unter dem Benutzerprofil verknüpfte App manuell.

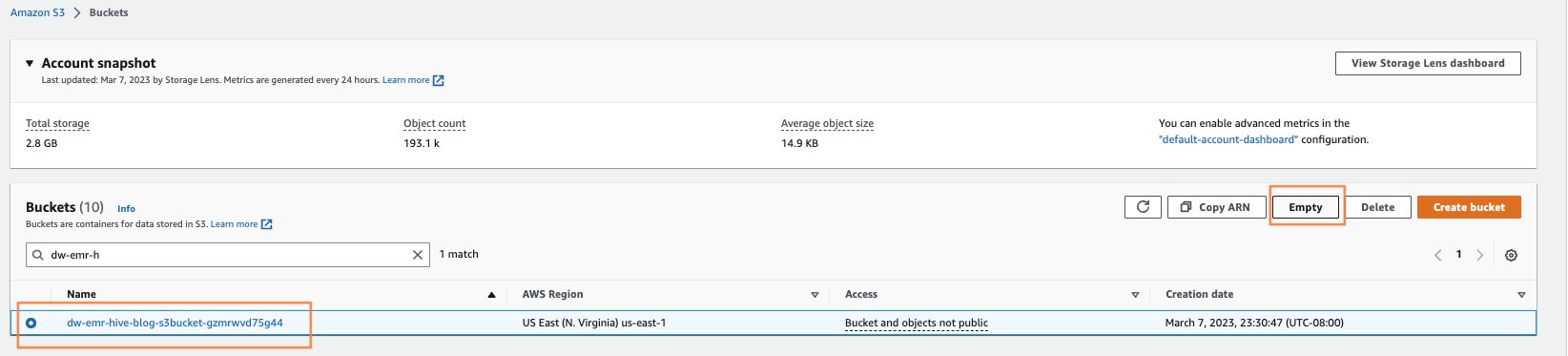

- Leeren Sie alle S3-Buckets, die beim Start von CloudFormation erstellt wurden.

Öffnen Sie die Amazon S3-Seite, indem Sie in der AWS-Konsolensuche nach S3 suchen. Leeren Sie alle S3-Buckets, die beim Bereitstellen von Clustern erstellt wurden. Der Bucket würde das Format haben dw-emr-hive-blog-.

- Löschen Sie das SageMaker Studio-EFS.

Öffnen Sie die EFS-Seite, indem Sie in der AWS-Konsolensuche nach EFS suchen.

Suchen Sie das von SageMaker erstellte Dateisystem. Dies können Sie mit einem Klick auf bestätigen Dateisystem-ID und Bestätigen des Tags ManagedByAmazonSageMakerResource auf die Schlüsselwörter Tab.

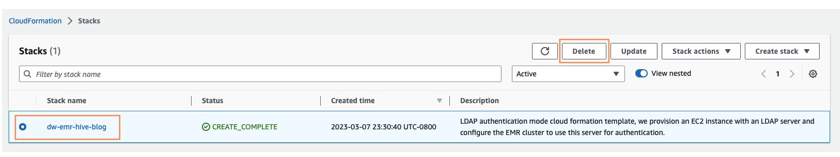

- Löschen Sie die CloudFormation-Stacks. Öffnen Sie CloudFormation, indem Sie in der AWS-Konsole nach dem CloudFormation-Service suchen und ihn öffnen.

Wählen Sie die Vorlage beginnend mit aus dw- wie im folgenden Bildschirm gezeigt und löschen Sie den Stapel wie gezeigt, indem Sie auf klicken Löschen .

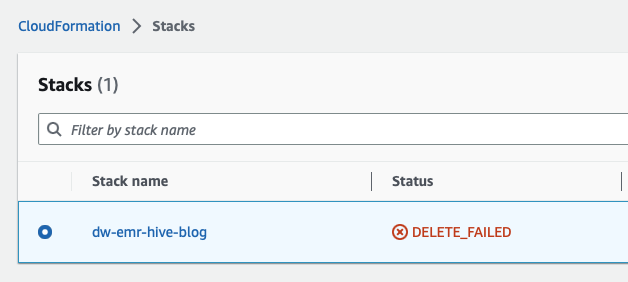

Dies wird erwartet und wir werden darauf zurückkommen und es in den nachfolgenden Schritten bereinigen.

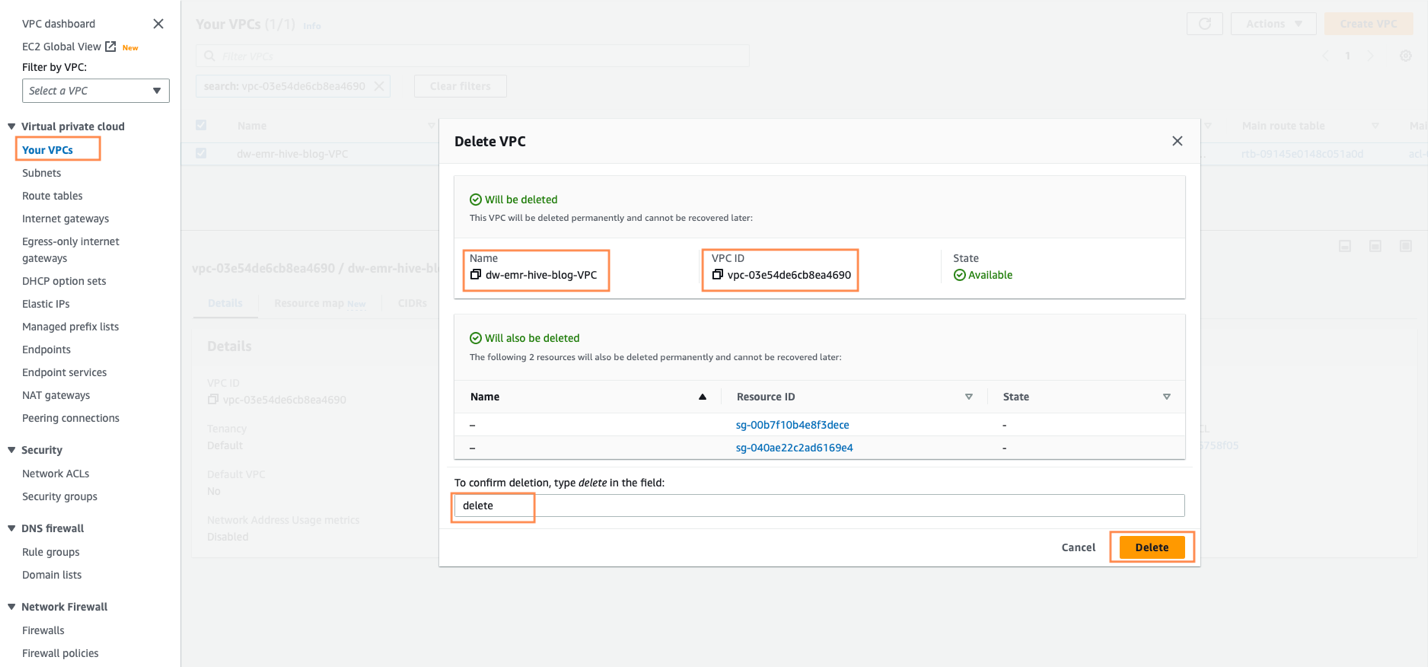

- Löschen Sie die VPC, nachdem der CloudFormation-Stack nicht abgeschlossen werden konnte. Öffnen Sie zuerst VPC über die AWS-Konsole.

- Identifizieren Sie als Nächstes die VPC, die von SageMaker Studio CloudFormation erstellt wurde, mit dem Titel

dw-emr-, und befolgen Sie dann die Eingabeaufforderungen, um die VPC zu löschen.

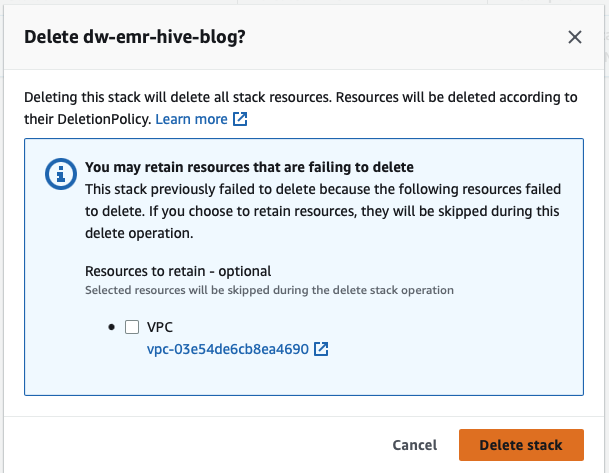

- Löschen Sie den CloudFormation-Stack.

Kehren Sie zu CloudFormation zurück und versuchen Sie erneut, den Stack zu löschen dw-emr-hive-blog.

Vollständig! Alle Ressourcen, die von der in diesem Blogbeitrag beschriebenen CloudFormation-Vorlage bereitgestellt werden, werden nun aus Ihrem Konto entfernt.

Zusammenfassung

In diesem Beitrag haben wir erläutert, wie Sie Amazon EMR als Datenquelle in Data Wrangler einrichten, wie Sie einen Datensatz transformieren und analysieren und wie Sie die Ergebnisse in einen Datenfluss zur Verwendung in einem Jupyter-Notebook exportieren. Nach der Visualisierung unseres Datensatzes mit den integrierten Analysefunktionen von Data Wrangler haben wir unseren Datenfluss weiter verbessert. Die Tatsache, dass wir eine Datenvorbereitungspipeline erstellt haben, ohne eine einzige Codezeile zu schreiben, ist von Bedeutung.

Informationen zu den ersten Schritten mit Data Wrangler finden Sie unter Vorbereiten von ML-Daten mit Amazon SageMaker Data Wrangler und sehen Sie sich die neuesten Informationen an Data Wrangler-Produktseite und Technische AWS-Dokumente.

Über die Autoren

Ajjay Govindaram ist Senior Solutions Architect bei AWS. Er arbeitet mit strategischen Kunden zusammen, die KI/ML einsetzen, um komplexe Geschäftsprobleme zu lösen. Seine Erfahrung liegt in der Bereitstellung von technischer Anleitung sowie Designunterstützung für bescheidene bis große KI/ML-Anwendungsbereitstellungen. Sein Wissen reicht von Anwendungsarchitektur bis hin zu Big Data, Analytik und maschinellem Lernen. Er genießt es, Musik zu hören, während er sich ausruht, die Natur zu erleben und Zeit mit seinen Lieben zu verbringen.

Ajjay Govindaram ist Senior Solutions Architect bei AWS. Er arbeitet mit strategischen Kunden zusammen, die KI/ML einsetzen, um komplexe Geschäftsprobleme zu lösen. Seine Erfahrung liegt in der Bereitstellung von technischer Anleitung sowie Designunterstützung für bescheidene bis große KI/ML-Anwendungsbereitstellungen. Sein Wissen reicht von Anwendungsarchitektur bis hin zu Big Data, Analytik und maschinellem Lernen. Er genießt es, Musik zu hören, während er sich ausruht, die Natur zu erleben und Zeit mit seinen Lieben zu verbringen.

Isha Dua ist ein Senior Solutions Architect mit Sitz in der San Francisco Bay Area. Sie hilft AWS-Unternehmenskunden beim Wachstum, indem sie ihre Ziele und Herausforderungen versteht, und leitet sie an, wie sie ihre Anwendungen auf Cloud-native Weise gestalten und gleichzeitig Ausfallsicherheit und Skalierbarkeit gewährleisten können. Sie interessiert sich leidenschaftlich für maschinelle Lerntechnologien und ökologische Nachhaltigkeit.

Isha Dua ist ein Senior Solutions Architect mit Sitz in der San Francisco Bay Area. Sie hilft AWS-Unternehmenskunden beim Wachstum, indem sie ihre Ziele und Herausforderungen versteht, und leitet sie an, wie sie ihre Anwendungen auf Cloud-native Weise gestalten und gleichzeitig Ausfallsicherheit und Skalierbarkeit gewährleisten können. Sie interessiert sich leidenschaftlich für maschinelle Lerntechnologien und ökologische Nachhaltigkeit.

Varun Metha ist Lösungsarchitekt bei AWS. Er ist leidenschaftlich daran interessiert, Kunden dabei zu helfen, unternehmensweite, gut strukturierte Lösungen in der AWS Cloud zu entwickeln. Er arbeitet mit strategischen Kunden zusammen, die KI/ML einsetzen, um komplexe Geschäftsprobleme zu lösen.

Varun Metha ist Lösungsarchitekt bei AWS. Er ist leidenschaftlich daran interessiert, Kunden dabei zu helfen, unternehmensweite, gut strukturierte Lösungen in der AWS Cloud zu entwickeln. Er arbeitet mit strategischen Kunden zusammen, die KI/ML einsetzen, um komplexe Geschäftsprobleme zu lösen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/accelerate-time-to-insight-with-amazon-sagemaker-data-wrangler-and-the-power-of-apache-hive/

- :Ist

- $UP

- 1

- 10

- 100

- 11

- 7

- a

- Über Uns

- beschleunigen

- Zugang

- Zugriffsprotokoll

- Nach

- Konto

- Aktionen

- Zusatz

- Zusätzliche

- Administrator

- Beratung

- Nach der

- AI / ML

- Flughafen

- Alle

- Zulassen

- erlaubt

- bereits

- Amazon

- Amazon EC2

- Amazon EMR

- Amazon Sage Maker

- Amazon SageMaker Data Wrangler

- Amazon SageMaker-Studio

- Beträge

- Analysen

- Analyse

- Analytische

- Analytik

- analysieren

- und

- Ein anderer

- Apache

- App

- Anwendung

- Anwendungen

- angemessen

- Apps

- Architektur

- SIND

- Bereich

- AS

- Hilfe

- damit verbundenen

- At

- authentifizieren

- authentifiziert

- Authentifizierung

- Autor

- automatisieren

- automatische

- Im Prinzip so, wie Sie es von Google Maps kennen.

- AWS

- AWS CloudFormation

- AWS-Kleber

- Zurück

- Bar

- basierend

- Bucht

- BE

- weil

- Sein

- vorspannen

- Big

- Big Data

- Blockiert

- Blog

- Box

- bringen

- bauen

- Building

- eingebaut

- Geschäft

- Taste im nun erscheinenden Bestätigungsfenster nun wieder los.

- by

- CAN

- Katalog

- Verursachen

- Herausforderungen

- Änderungen

- aus der Ferne überprüfen

- Auswählen

- klicken Sie auf

- Menu

- Cloud

- Cluster

- Code

- Programmierung

- Kolonne

- Spalten

- wie die

- gemeinsam

- abschließen

- Komplex

- Komponenten

- Berechnen

- Schichtannahme

- Vernetz Dich

- Sie

- Sich zusammenschliessen

- Verbindung

- Connects

- Konsul (Console)

- fortsetzen

- Land

- Abdeckung

- erstellen

- erstellt

- schafft

- Erstellen

- Referenzen

- kritischem

- Kurve

- Kunden

- technische Daten

- Datenaufbereitung

- Datenverarbeitung

- Datenbase

- Datensätze

- Deal

- Standard

- Demand

- zeigen

- einsetzen

- Implementierungen

- beschrieben

- Design

- Reiseziel

- Details

- anders

- Richtung

- Direkt

- entdeckt,

- Domain

- Nicht

- nach unten

- Drop

- fallen gelassen

- jeder

- leicht

- Herausgeber

- entweder

- freigegeben

- ermöglicht

- Endpunkt

- Motor

- Ingenieur

- Entwicklung

- Ingenieure

- verbesserte

- Gewährleistung

- Enter

- Unternehmen

- Ganz

- Arbeitsumfeld

- Umwelt-

- essential

- etablieren

- bewerten

- Beispiel

- Beispiele

- Ausführung

- vorhandenen

- erwartet

- ERFAHRUNGEN

- erleben

- ERKUNDEN

- Forscher

- exportieren

- scheitert

- vertraut

- Merkmal

- Eigenschaften

- Honorare

- wenige

- Endlich

- Vorname

- Fixieren

- Fluss

- folgen

- Folgende

- Aussichten für

- Francisco cisco~~POS=HEADCOMP

- für

- weiter

- bekommen

- Go

- Ziele

- Gruppe an

- Gruppen

- Wachsen Sie über sich hinaus

- Anleitungen

- Griff

- Haben

- Hilfe

- dazu beigetragen,

- Unternehmen

- hilft

- Bienenstock

- Startseite

- Gastgeber

- Ultraschall

- Hilfe

- aber

- HTML

- http

- HTTPS

- identifizieren

- Identitätsschutz

- importieren

- Einfuhr

- in

- Einschließlich

- Information

- Einblick

- Instanz

- interaktive

- Schnittstelle

- beteiligt

- Probleme

- IT

- Job

- Jobs

- jpg

- Wissen

- grosse

- großflächig

- Nachname

- neueste

- starten

- lernen

- Hebelwirkung

- liegt

- leicht

- LIMIT

- Line

- Hören

- Lang

- lange Zeit

- aussehen

- geliebt wird

- Maschine

- Maschinelles Lernen

- um

- verwalten

- Management

- Weise

- manuell

- MENÜ

- könnte

- Minimum

- Minuten

- Kommt demnächst...

- ML

- Model

- Modell

- für

- mehr

- vor allem warme

- mehrere

- Musik

- Name

- Namens

- Namen

- Menü

- Need

- Neu

- Notizbuch

- of

- on

- EINEM

- laufend

- XNUMXh geöffnet

- Eröffnung

- Option

- Optionen

- Andere

- im Freien

- Seite

- Parameter

- Teil

- leidenschaftlich

- Passwort

- Ausführen

- führt

- Berechtigungen

- Pipeline

- Plato

- Datenintelligenz von Plato

- PlatoData

- Beliebt

- Post

- Werkzeuge

- Danach

- Vorbereitung

- Vorspann

- Probleme

- Prozessdefinierung

- anpassen

- Verarbeitung

- Produkt

- Profis

- Profil

- Protokoll

- die

- bietet

- Bereitstellung

- Bereitstellung

- Qualität

- schnell

- zufällig

- bereit

- Empfehlungen

- Aufzeichnungen

- Veteran

- reduziert

- Region

- entfernen

- Entfernt

- wiederholbar

- Reporting

- Quelle

- representiert

- falls angefordert

- Elastizität

- Downloads

- Die Ergebnisse

- Überprüfen

- Rollen

- Führen Sie

- Laufen

- sagemaker

- SageMaker-Inferenz

- SageMaker-Pipelines

- gleich

- San

- San Francisco

- Speichern

- Skalierbarkeit

- Skalieren

- Szenario

- Zeitplan

- Wissenschaftler

- Bildschirm

- Screenshots

- Suche

- Suche

- Die Geheime

- Abschnitt

- Sicherheitdienst

- ausgewählt

- Auswahl

- Auswahl

- Senior

- kompensieren

- Einstellungen

- Teilen

- sollte

- gezeigt

- signifikant

- einfach

- da

- Single

- Größe

- So

- Lösung

- Lösungen

- LÖSEN

- einige

- Quelle

- Quellen

- Spark

- speziell

- Ausgabe

- Spot

- Stapel

- Stacks

- Standard

- begonnen

- Beginnen Sie

- Erklärung

- Statistiken

- Status

- Schritt

- Shritte

- speichern

- gelagert

- Strategisch

- rationalisieren

- Studio Adressen

- Subnetze

- Folge

- Erfolgreich

- so

- Unterstützte

- Nachhaltigkeit

- System

- Tabelle

- TAG

- Nehmen

- nimmt

- Einnahme

- und Aufgaben

- Technische

- Technologies

- Vorlage

- Vorlagen

- Vielen Dank

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- Diese

- basierte Online-to-Offline-Werbezuordnungen von anderen gab.

- Durch

- Zeit

- zu

- heute

- gemeinsam

- Top

- Training

- Ausbildung

- Transformieren

- Transformationen

- ui

- für

- Verständnis

- einzigartiges

- Universal-

- Aktualisierung

- URL

- us

- -

- Mitglied

- gewöhnlich

- Wert

- Werte

- Vielfalt

- verschiedene

- Anzeigen

- warten

- Weg..

- Wochen

- GUT

- welche

- während

- WHO

- breit

- Wikipedia

- werden wir

- mit

- .

- ohne

- Arbeiten

- Werk

- würde

- schreiben

- Code schreiben

- Schreiben

- YAML

- Du

- Ihr

- Zephyrnet