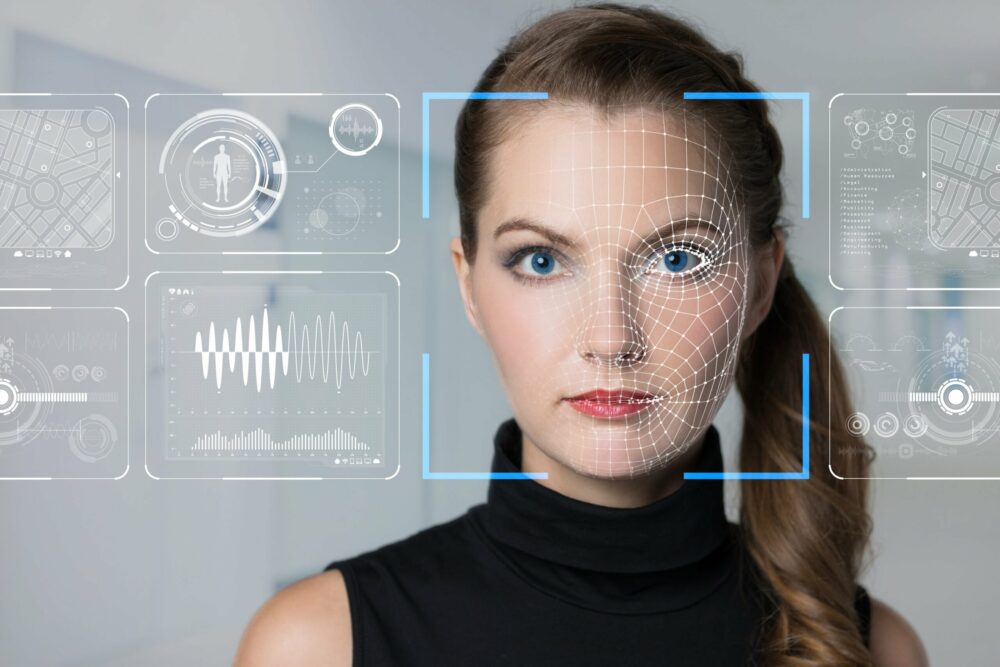

Die Gesichtserkennungstechnologie hat sich schnell in unseren Alltag integriert, vom Entsperren von Smartphones bis hin zu personalisierter Werbung.

Doch je allgegenwärtiger es wird, desto intensiver wird auch die Debatte über die ethischen und rechtlichen Grenzen seiner Verwendung. Ein führender Tech-Reporter, Kashmir Hill von der New York Times, hat kürzlich Licht auf ein besonders geheimnisvolles Unternehmen in diesem Sektor geworfen: Clearview AI. Hills Untersuchung legt nahe, dass dieses heimliche Startup die Datenschutznormen möglicherweise dramatisch neu definiert, und das alles unter dem Radar der öffentlichen Kontrolle.

Wir stehen am Rande einer Welt, in der die Gesichtserkennung Amok läuft und Anonymität unmöglich ist. Ich denke, dass es immer noch möglich ist, einzugreifen, bevor sich das völlig normalisiert.

Lesen Sie dazu mein neues Buch, das in dieser Geschichte eine nette Erwähnung findet! https://t.co/L5Xit64fdH https://t.co/xoMjIbG2iR

— Kashmir Hill (@kashhill) 25. September 2023

Die alarmierenden Fähigkeiten von Clearview AI

Ein leistungsstarkes Gesichtserkennungstool ist das Herzstück des Angebots von Clearview AI. Laden Sie einfach ein Foto einer Person hoch und das Tool verspricht, Ihnen überall dort zu zeigen, wo das Gesicht online auftaucht. Dazu gehören große Plattformen wie Facebook, Instagram und LinkedIn, aber auch noch weniger offensichtliche Plattformen wie Venmo. Es werden nicht nur Profile angezeigt; Es könnte Bilder offenlegen, von denen Sie nicht einmal wussten, dass sie online sind, was möglicherweise eine Gefährdung darstellt Datenschutz in einem noch nie dagewesenen Ausmaß.

Ein Werkzeug voller Kontroversen

Während die Vorteile für Strafverfolgung klar sind – Verbrechen aufklären, Verdächtige ausfindig machen und mehr –, ist der mögliche Missbrauch beunruhigend. Hill malt ein paar erschütternde Hypothesen: Eine Frau, die eine Klinik verlässt, wird von Demonstranten identifiziert und belästigt, oder ein Fremder in einer Bar, der das Tool nutzt, um eine Fülle persönlicher Daten über jemanden zu ermitteln, den sie gerade erst kennengelernt haben. Dieser Mangel an Kontrolle über persönliche Bilder hat in vielen Bereichen die Alarmglocken schrillen lassen.

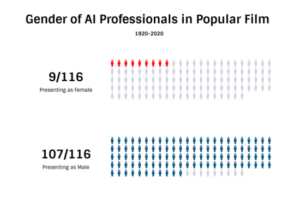

Weitere erschwerende Bedenken sind die Genauigkeit der Technologie – oder ein möglicher Mangel daran. Es wurden Fälle von Fehlidentifikationen, insbesondere bei farbigen Menschen, gemeldet. Dies verstärkt nicht nur rassistische Vorurteile bei der Polizeiarbeit, sondern kann auch schwerwiegende Folgen für die zu Unrecht Angeklagten haben.

Von Googles Labs bis zu den Angeboten von Clearview

Interessanterweise ist Clearview AI nicht der erste, der sich in diesen umstrittenen Bereich vorwagt. Tech-Giganten wie Google und Facebook haben sich bereits zuvor mit ähnlichen Technologien beschäftigt. Da sie jedoch die potenziellen Fallstricke erkannten, beschlossen sie, ihre Versionen der öffentlichen Nutzung vorzuenthalten. Diese selbst auferlegte Zurückhaltung macht die Fortschritte von Clearview AI noch bedeutender.

Clearview AI hat nicht nur innovative Technologie entwickelt; Sie nutzten auch eine einzigartige Datenerfassungsmethode. Sie haben systematisch Milliarden von Fotos aus dem Internet gekratzt und dabei viele Quellen ohne ausdrückliche Genehmigung der Plattformen oder der vorgestellten Personen genutzt.

Die verdeckten Operationen von Clearview

Die meiste Zeit ihres frühen Bestehens blieb Clearview AI rätselhaft. Schon die Suche nach ihrem Büro erwies sich für Hill als schwierig, da die angegebene Adresse zu einem nicht existierenden Gebäude führte. Erste Versuche, Kontakt zu Unternehmensvertretern aufzunehmen, scheiterten. Als Hill jedoch ihre Ermittlungen vertiefte, stellte sie fest, dass Clearview ihre Schritte verfolgte. Jedes Mal, wenn die Strafverfolgungsbehörden versuchten, ihr Bild durch das System von Clearview zu übertragen, wurde das Unternehmen alarmiert und intervenierte häufig, wobei es seine invasiven Überwachungsfähigkeiten unter Beweis stellte.

Der wachsende Drang nach regulatorischer Aufsicht

Mit solchen leistungsstarke Technologie Aufgrund ihrer Verfügbarkeit und der nachweislichen Bereitschaft, sie aggressiv zu nutzen, werden Forderungen nach einer behördlichen Aufsicht über Clearview AI immer lauter. Einige Bundesstaaten in den USA, darunter Kalifornien, Colorado, Virginia und Connecticut, haben gesetzliche Bestimmungen eingeführt, die es Einwohnern ermöglichen, die Löschung ihrer Daten aus der Datenbank von Clearview zu beantragen.

Möglicherweise sind jedoch mehr als diese punktuellen Regelungen erforderlich. Da Clearview AI und ähnliche Unternehmen weiterhin neue Maßstäbe bei der Gesichtserkennung setzen, kann ein umfassender nationaler oder sogar globaler Ansatz für den Schutz der Privatsphäre der Bürger von entscheidender Bedeutung sein.

Die Enthüllungen von Kashmir Hill bezüglich Clearview AI unterstreichen die dringende Notwendigkeit eines öffentlichen Diskurses über die Grenzen der Gesichtserkennungstechnologie. Da die Grenze zwischen öffentlich und privat verschwimmt, muss die Gesellschaft entscheiden, wo die Grenzen liegen und wer sie ziehen kann.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://metanews.com/kashmir-hill-investigates-clearview-ais-stealthy-ascent/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 25

- 9

- a

- Über Uns

- Angeklagte

- Adresse

- Vorteilen

- Marketings

- AI

- Alarm

- Alle

- Zulassen

- ebenfalls

- unter

- verstärkt

- an

- und

- Anonymität

- jedem

- erscheint

- Ansatz

- SIND

- um

- AS

- Aufstieg

- At

- Versuche

- Versuche

- bewusst

- Bar

- BE

- wird

- war

- Bevor

- Ungetüme

- Sein

- Glocken

- zwischen

- Vorurteile

- Milliarden

- Unschärfen

- buchen

- Grenzen

- bringen

- Rand

- Building

- aber

- by

- Kalifornien

- Aufrufe

- CAN

- Fähigkeiten

- kapitalisiert

- herausfordernd

- wählten

- Clearview

- Clearview-KI

- Klinik

- Farbe

- Colorados

- Unternehmen

- Unternehmen

- umfassend

- kompromittierend

- Bedenken

- Kontakt

- fortsetzen

- Smartgeräte App

- umstritten

- könnte

- Verbrechen

- probierte

- technische Daten

- Datenbase

- Debatten.

- entscheidet

- Synergie

- entwickeln

- Diskurs

- die

- Tut nicht

- Dramatisch

- zeichnen

- Früh

- Durchsetzung

- insbesondere

- essential

- ethisch

- Sogar

- Jedes

- jeden Tag

- überall

- Existenz

- Faszinierende

- Gesicht

- Gesichts-

- Gesichtserkennung

- funktions

- wenige

- Fingerspitzen

- Fest

- Vorname

- Aussichten für

- für

- voll

- gegeben

- Global

- habe

- persönlichem Wachstum

- gewachsen

- Haben

- Herz

- hier (auf dänisch)

- GUTE

- Hit

- aber

- HTTPS

- i

- identifiziert

- Image

- Bilder

- Auswirkungen

- unmöglich

- in

- Dazu gehören

- Einschließlich

- zunehmend

- Krankengymnastik

- Einzelpersonen

- innovativ

- innovative Technologie

- Internet

- eingreifen

- in

- invasiv

- untersucht

- Untersuchung

- IT

- SEINE

- jpg

- nur

- Labs

- Mangel

- Recht

- Strafverfolgung

- führenden

- geführt

- Rechtlich

- weniger

- Lüge

- !

- Gefällt mir

- Grenzen

- Line

- Leben

- ausfindig machen

- Dur

- MACHT

- viele

- max-width

- Kann..

- versiegelte

- Methode

- könnte

- Missbrauch

- mehr

- bewegt sich

- viel

- sollen

- my

- National

- Need

- erforderlich

- Neu

- New York

- New York Times

- schön

- Normen

- offensichtlich

- of

- bieten

- Office

- vorgenommen,

- on

- Einsen

- Online

- einzige

- or

- UNSERE

- übrig

- Aufsicht

- besonders

- Personen

- Erlaubnis

- persönliche

- Daten

- Personalisiert

- für Ihre privaten Foto

- Fotos

- Fotos

- Ort

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Polizeiarbeit

- möglich

- Potenzial

- möglicherweise

- größte treibende

- vorher

- Datenschutz

- privat

- Profil

- Promises

- Schutz

- erwies sich

- Öffentlichkeit

- Ziehen

- Push

- setzen

- Radar

- geschafft

- schnell

- RE

- Reich

- kürzlich

- Anerkennung

- erkennen

- Neudefinition

- in Bezug auf

- Vorschriften

- Regulierungsbehörden

- Aufsicht

- blieb

- Berichtet

- Reporter

- Unsere Representatives

- Anforderung

- Bewohner

- Führen Sie

- läuft

- s

- Skalieren

- Überprüfung

- Bibliotheken

- sie

- beleuchtete

- erklären

- präsentiert

- signifikant

- ähnlich

- einfach

- Smartphones

- So

- Gesellschaft

- einige

- Jemand,

- Quellen

- Anfang

- Staaten

- verstohlen

- Immer noch

- Fremder

- Schritte

- so

- Schlägt vor

- Überwachung

- System

- Tech

- Technologies

- Technologie

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Linie

- Die New York Times

- ihr

- Sie

- Diese

- vom Nutzer definierten

- think

- fehlen uns die Worte.

- diejenigen

- Durch

- Zeit

- mal

- zu

- Werkzeug

- Tracking

- was immer dies auch sein sollte.

- uns

- unbedeckt

- für

- einzigartiges

- Entriegelung

- beispiellos

- dringend

- -

- Verwendung von

- Venmo

- wagen

- Versionen

- Virginia

- wurde

- Reichtum

- GUT

- waren

- welche

- während

- WHO

- Bereitschaft

- mit

- ohne

- Frau

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- York

- Du

- Zephyrnet