Dieser Beitrag wurde gemeinsam mit Marc Neumann, Amor Steinberg und Marinus Krommenhoek von der BMW Group verfasst.

Das BMW Group – mit Hauptsitz in München, Deutschland – beschäftigt weltweit 149,000 Mitarbeiter und fertigt in über 30 Produktions- und Montagestätten in 15 Ländern. Heute ist die BMW Group der weltweit führende Hersteller von Premium-Automobilen und -Motorrädern sowie Anbieter hochwertiger Finanz- und Mobilitätsdienstleistungen. Als Innovationsführer setzt die BMW Group mit einem intelligenten Materialmix, einem technologischen Wandel hin zur Digitalisierung und einer ressourceneffizienten Produktion Trends in Produktionstechnik und Nachhaltigkeit.

In einer zunehmend digitalen und sich schnell verändernden Welt basieren die Geschäfts- und Produktentwicklungsstrategien der BMW Group stark auf datengesteuerter Entscheidungsfindung. Damit ist der Bedarf an Datenwissenschaftlern und Ingenieuren für maschinelles Lernen (ML) erheblich gestiegen. Diese Fachkräfte haben die Aufgabe, Modelle zu entwickeln und einzusetzen, die die Qualität und Effizienz der Geschäftsprozesse von BMW verbessern und fundierte Führungsentscheidungen ermöglichen.

Datenwissenschaftler und ML-Ingenieure benötigen für ihre Arbeit leistungsfähige Werkzeuge und ausreichend Rechenleistung. Daher hat BMW vor einigen Jahren eine zentrale ML-/Deep-Learning-Infrastruktur vor Ort aufgebaut und diese kontinuierlich weiterentwickelt. Um den Weg für das Wachstum der KI zu ebnen, musste die BMW Group einen Sprung in Bezug auf Skalierbarkeit und Elastizität machen und gleichzeitig den Betriebsaufwand, die Softwarelizenzierung und das Hardwaremanagement reduzieren.

In diesem Beitrag werden wir darüber sprechen, wie die BMW Group in Zusammenarbeit mit AWS Professional Services ihren Jupyter Managed (JuMa)-Service entwickelt hat, um diese Herausforderungen zu bewältigen. JuMa ist ein Service der KI-Plattform der BMW Group für ihre Datenanalysten, ML-Ingenieure und Datenwissenschaftler, der einen benutzerfreundlichen Arbeitsbereich mit einer integrierten Entwicklungsumgebung (IDE) bietet. Es wird angetrieben von Amazon SageMaker-Studio und stellt JupyterLab für Python und Posit Workbench für R bereit. Dieses Angebot ermöglicht BMW ML-Ingenieuren die Durchführung codezentrierter Datenanalysen und ML, erhöht die Entwicklerproduktivität durch die Bereitstellung von Self-Service-Funktionen und Infrastrukturautomatisierung und lässt sich eng in die zentralisierte IT-Toollandschaft von BMW integrieren.

JuMa steht jetzt allen Datenwissenschaftlern, ML-Ingenieuren und Datenanalysten der BMW Group zur Verfügung. Der Service rationalisiert ML-Entwicklungs- und Produktionsworkflows (MLOps) bei BMW, indem er eine kosteneffiziente und skalierbare Entwicklungsumgebung bereitstellt, die eine nahtlose Zusammenarbeit zwischen Data Science- und Engineering-Teams weltweit erleichtert. Dies führt zu schnelleren Experimenten und kürzeren Ideenvalidierungszyklen. Darüber hinaus basiert die JuMa-Infrastruktur auf AWS serverlos und Managed Services trägt dazu bei, den Betriebsaufwand für DevOps-Teams zu reduzieren und ermöglicht es ihnen, sich auf die Ermöglichung von Anwendungsfällen und die Beschleunigung von KI-Innovationen bei der BMW Group zu konzentrieren.

Herausforderungen beim Aufbau einer lokalen KI-Plattform

Vor der Einführung des JuMa-Dienstes nutzten BMW-Teams weltweit zwei lokale Plattformen, die den Teams JupyterHub- und RStudio-Umgebungen zur Verfügung stellten. Diese Plattformen waren in Bezug auf CPU, GPU und Speicher zu begrenzt, um die Skalierbarkeit von KI bei der BMW Group zu ermöglichen. Die Skalierung dieser Plattformen mit der Verwaltung von mehr Hardware vor Ort, mehr Softwarelizenzen und Supportgebühren würde erhebliche Vorabinvestitionen und einen hohen Aufwand für deren Wartung erfordern. Hinzu kam, dass nur begrenzte Self-Service-Funktionen verfügbar waren, was einen hohen betrieblichen Aufwand für die DevOps-Teams erforderte. Noch wichtiger ist, dass die Nutzung dieser Plattformen nicht mit der IT-Cloud-First-Strategie der BMW Group übereinstimmte. Beispielsweise verpassten Teams, die diese Plattformen nutzen, eine einfache Migration ihrer KI/ML-Prototypen zur Industrialisierung der auf AWS laufenden Lösung. Im Gegensatz dazu mussten sich die Datenwissenschafts- und Analyseteams, die AWS bereits direkt für Experimente nutzen, auch um den Aufbau und Betrieb ihrer AWS-Infrastruktur kümmern und gleichzeitig die Einhaltung der internen Richtlinien, lokalen Gesetze und Vorschriften der BMW Group sicherstellen. Dies umfasste eine Reihe von Konfigurations- und Governance-Aktivitäten, von der Bestellung von AWS-Konten über die Einschränkung des Internetzugriffs, die Verwendung zulässiger aufgelisteter Pakete bis hin zur Aktualisierung ihrer Docker-Images.

Lösungsübersicht

JuMa ist ein vollständig verwalteter, mandantenfähiger, sicherheitsgehärteter KI-Plattformdienst, der auf AWS basiert SageMaker-Studio im Kern. Da sich das JuMa DevOps-Team auf serverlose und verwaltete AWS-Dienste als Hauptbausteine der Infrastruktur verlässt, muss es sich nicht um das Patchen von Servern, die Aktualisierung des Speichers oder die Verwaltung anderer Infrastrukturkomponenten kümmern. Der Dienst wickelt alle diese Prozesse automatisch ab und stellt eine leistungsstarke technische Plattform bereit, die grundsätzlich auf dem neuesten Stand und einsatzbereit ist.

JuMa-Nutzer können über ein Self-Service-Portal mühelos einen Workspace bestellen, um eine sichere und isolierte Entwicklungs- und Experimentierumgebung für ihre Teams zu schaffen. Nachdem ein JuMa-Arbeitsbereich bereitgestellt wurde, können die Benutzer mit nur wenigen Klicks JupyterLab- oder Posit-Workbench-Umgebungen in SageMaker Studio starten und sofort mit der Entwicklung beginnen, indem sie die Tools und Frameworks verwenden, mit denen sie am besten vertraut sind. JuMa ist eng in eine Reihe zentraler IT-Dienste von BMW integriert, darunter Identitäts- und Zugriffsverwaltung, Rollen- und Rechteverwaltung, BMW Cloud Data Hub (BMWs Data Lake auf AWS) und lokale Datenbanken. Letzteres hilft KI/ML-Teams dabei, nahtlos auf die erforderlichen Daten zuzugreifen, sofern sie dazu berechtigt sind, ohne Datenpipelines aufbauen zu müssen. Darüber hinaus können die Notebooks in die Git-Repositories des Unternehmens integriert werden, um mithilfe der Versionskontrolle zusammenzuarbeiten.

Die Lösung abstrahiert alle technischen Komplexitäten, die mit der AWS-Kontoverwaltung, -Konfiguration und -Anpassung für KI/ML-Teams verbunden sind, sodass sie sich voll und ganz auf KI-Innovationen konzentrieren können. Die Plattform stellt sicher, dass die Arbeitsplatzkonfiguration sofort den Sicherheits- und Compliance-Anforderungen von BMW entspricht.

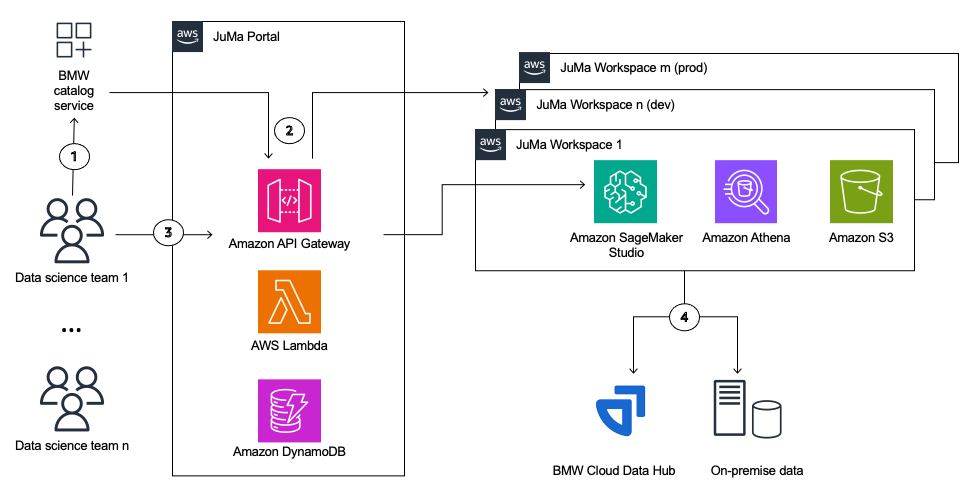

Das folgende Diagramm beschreibt die allgemeine Kontextansicht der Architektur.

Benutzerreise

Mitglieder des BMW AI/ML-Teams können ihren JuMa-Arbeitsplatz über den Standard-Katalogservice von BMW bestellen. Nach Freigabe durch den Vorgesetzten erfolgt die Bereitstellung des bestellten JuMa-Arbeitsplatzes durch die Plattform vollautomatisch. Der Workspace-Bereitstellungsworkflow umfasst die folgenden Schritte (wie im Architekturdiagramm nummeriert).

- Ein Team von Datenwissenschaftlern bestellt einen neuen JuMa-Arbeitsbereich im BMW-Katalog. JuMa stellt automatisch ein neues AWS-Konto für den Arbeitsbereich bereit. Dadurch wird eine vollständige Isolierung zwischen den Arbeitsbereichen gemäß der in erwähnten Kontostruktur des Verbundmodells gewährleistet Best Practices für die Verwaltung von SageMaker Studio.

- JuMa konfiguriert einen Arbeitsbereich (das ist ein Sagemaker-Domäne), die nur Vordefinierte zulässt Amazon Sage Maker Funktionen, die für Experimente und Entwicklung erforderlich sind, spezifische benutzerdefinierte Kernel und Lebenszykluskonfigurationen. Außerdem werden die erforderlichen Subnetze und Sicherheitsgruppen eingerichtet, um sicherzustellen, dass die Notebooks in einer sicheren Umgebung ausgeführt werden.

- Nachdem die Arbeitsbereiche bereitgestellt wurden, melden sich die autorisierten Benutzer beim JuMa-Portal an und greifen in ihrem Arbeitsbereich über eine von SageMaker vorsignierte URL auf die SageMaker Studio-IDE zu. Benutzer können wählen, ob sie einen privaten SageMaker Studio-Bereich oder einen öffnen möchten gemeinsamer Raum. Gemeinsame Räume fördern die Zusammenarbeit zwischen verschiedenen Teammitgliedern, die parallel an denselben Notebooks arbeiten können, während private Räume eine Entwicklungsumgebung für einzelne Arbeitslasten ermöglichen.

- Über das BMW-Datenportal können Benutzer Zugriff auf lokale Datenbanken oder im Cloud Data Hub von BMW gespeicherte Daten anfordern und diese in ihrem Arbeitsbereich für Entwicklung und Experimente verfügbar machen, von der Datenvorbereitung und -analyse bis hin zum Modelltraining und der Validierung.

Nachdem ein KI-Modell in JuMa entwickelt und validiert wurde, können KI-Teams den MLOPs-Dienst der BMW KI-Plattform nutzen, um es schnell und mühelos in der Produktion bereitzustellen. Dieser Service bietet Benutzern mithilfe von SageMaker eine ML-Infrastruktur und Pipelines in Produktionsqualität auf AWS, die in wenigen Minuten mit nur wenigen Klicks eingerichtet werden können. Benutzer müssen lediglich ihr Modell auf der bereitgestellten Infrastruktur hosten und die Pipeline an ihre spezifischen Anwendungsfallanforderungen anpassen. Damit deckt die KI-Plattform den gesamten KI-Lebenszyklus der BMW Group ab.

JuMa-Funktionen

Der JuMa-Service wurde gemäß der Best-Practice-Architektur auf AWS entworfen und implementiert AWS Well-Architated-Framework. Die architektonischen Entscheidungen jeder Well-Architected-Säule werden in den folgenden Abschnitten ausführlich beschrieben.

Sicherheit und Compliance

Um eine vollständige Isolation zwischen den Mandanten zu gewährleisten, erhält jeder Arbeitsbereich ein eigenes AWS-Konto, in dem die autorisierten Benutzer gemeinsam an Analyseaufgaben sowie an der Entwicklung und dem Experimentieren mit KI/ML-Modellen arbeiten können. Das JuMa-Portal selbst erzwingt die Isolation zur Laufzeit mithilfe einer richtlinienbasierten Isolation mit AWS Identity and Access Management and (IAM) und dem Kontext des JuMa-Benutzers. Weitere Informationen zu dieser Strategie finden Sie unter Laufzeitbasierte, richtlinienbasierte Isolation mit IAM.

Datenwissenschaftler können über das BMW-Netzwerk nur über vorsignierte URLs, die vom Portal generiert werden, auf ihre Domain zugreifen. Der direkte Internetzugang ist innerhalb ihrer Domain deaktiviert. Ihre Sagemaker-Domänenberechtigungen werden mithilfe von erstellt Amazon SageMaker-Rollenmanager Personas, um den Zugriff mit den geringsten Privilegien auf die für die Entwicklung erforderlichen AWS-Dienste wie SageMaker zu gewährleisten, Amazonas Athena, Amazon Simple Storage-Service (Amazon S3) und AWS-Kleber. Diese Rolle implementiert ML-Leitlinien (wie die in beschrieben). Governance und Kontrolle), einschließlich der Durchsetzung der ML-Schulung in beiden Fällen Amazon Virtual Private Cloud (Amazon VPC) oder ohne Internet und erlaubt nur die Verwendung der individuell geprüften und aktuellen SageMaker-Bilder von JuMa.

Da JuMa für Entwicklung, Experimente und Ad-hoc-Analysen konzipiert ist, implementiert es Aufbewahrungsrichtlinien, um Daten nach 30 Tagen zu entfernen. Um bei Bedarf auf Daten zugreifen und diese langfristig speichern zu können, lässt sich JuMa nahtlos in den BMW Cloud Data Hub und BMW On-Premises-Datenbanken integrieren.

Schließlich unterstützt JuMa mehrere Regionen bei der Einhaltung besonderer lokaler Gesetzeslagen, die beispielsweise eine lokale Datenverarbeitung erfordern, um die Datensouveränität von BMW zu gewährleisten.

Optimierung der Betriebsabläufe

Sowohl das Backend als auch die Arbeitsbereiche der JuMa-Plattform werden mit implementiert AWS serverlos und Managed Services. Die Nutzung dieser Dienste trägt dazu bei, den Aufwand für die Wartung und den Betrieb der End-to-End-Lösung durch das BMW-Plattformteam zu minimieren und strebt danach, ein No-Ops-Dienst zu sein. Sowohl der Arbeitsbereich als auch das Portal werden mit überwacht Amazon CloudWatch Protokolle, Metriken und Alarme, um wichtige Leistungsindikatoren (KPIs) zu überprüfen und das Plattformteam proaktiv über etwaige Probleme zu informieren. Darüber hinaus ist die AWS-Röntgen Das verteilte Ablaufverfolgungssystem wird verwendet, um Anfragen über mehrere Komponenten hinweg zu verfolgen und CloudWatch-Protokolle mit arbeitsbereichsrelevantem Kontext zu kommentieren.

Alle Änderungen an der JuMa-Infrastruktur werden durch Automatisierung mithilfe von Infrastructure as Code (IaC) verwaltet und implementiert. Dies trägt dazu bei, manuellen Aufwand und menschliche Fehler zu reduzieren, die Konsistenz zu erhöhen und reproduzierbare und versionierte Änderungen in beiden Backend-Arbeitsbereichen der JuMa-Plattform sicherzustellen. Insbesondere werden alle Arbeitsbereiche durch einen darauf aufbauenden Onboarding-Prozess bereitgestellt und aktualisiert AWS Step-Funktionen, AWS CodeBuild, und Terraform. Daher ist keine manuelle Konfiguration erforderlich, um neue Arbeitsbereiche in die JuMa-Plattform einzubinden.

Kostenoptimierung

Durch die Nutzung serverloser AWS-Dienste gewährleistet JuMa bedarfsgerechte Skalierbarkeit, vorab genehmigte Instanzgrößen und ein Pay-as-you-go-Modell für die Ressourcen, die während der Entwicklungs- und Experimentieraktivitäten gemäß den Anforderungen der KI/ML-Teams verwendet werden. Um die Kosten weiter zu optimieren, überwacht und identifiziert die JuMa-Plattform ungenutzte Ressourcen in SageMaker Studio und schaltet sie automatisch ab, um Kosten für nicht genutzte Ressourcen zu vermeiden.

Nachhaltigkeit

JuMa ersetzt die beiden On-Premise-Plattformen von BMW für Analyse- und Deep-Learning-Workloads, die selbst bei Nichtnutzung eine erhebliche Menge Strom verbrauchen und CO2-Emissionen verursachen. Durch die Migration von KI/ML-Workloads von On-Premises zu AWS wird BMW seine Umweltauswirkungen durch die Stilllegung der On-Premise-Plattformen reduzieren.

Darüber hinaus tragen der in JuMa implementierte Mechanismus zum automatischen Herunterfahren inaktiver Ressourcen, Datenaufbewahrungsrichtlinien und die Workspace-Nutzungsberichte an die Eigentümer dazu bei, den ökologischen Fußabdruck der Ausführung von KI/ML-Workloads auf AWS weiter zu minimieren.

Leistungsfähigkeit

Durch die Verwendung von SageMaker Studio profitieren BMW-Teams von einer einfachen Einführung der neuesten SageMaker-Funktionen, die ihnen helfen können, ihre Experimente zu beschleunigen. Sie können zum Beispiel verwenden Amazon SageMaker-JumpStart Funktionen zur Verwendung der neuesten vorab trainierten Open-Source-Modelle. Darüber hinaus trägt es dazu bei, den Aufwand des KI/ML-Teams beim Übergang vom Experimentieren zur Lösungsindustrialisierung zu reduzieren, da die Entwicklungsumgebung dieselben AWS-Kerndienste bereitstellt, jedoch auf Entwicklungsfunktionen beschränkt ist.

Zuverlässigkeit

SageMaker Studio-Domänen werden in einem reinen VPC-Modus bereitgestellt, um den Internetzugriff zu verwalten und nur den Zugriff auf vorgesehene AWS-Dienste zu ermöglichen. Das Netzwerk wird in zwei Availability Zones bereitgestellt, um vor einem Single Point of Failure zu schützen und so eine höhere Ausfallsicherheit und Verfügbarkeit der Plattform für ihre Benutzer zu erreichen.

Änderungen an JuMa-Arbeitsbereichen werden mithilfe von IaC- und CI/CD-Pipelines automatisch bereitgestellt und in Entwicklungs- und Integrationsumgebungen getestet, bevor Kundenumgebungen aktualisiert werden.

Schließlich werden die Daten in gespeichert Amazon Elastic File System (Amazon EFS) für SageMaker Studio-Domänen wird nach dem Löschen von Volumes zu Sicherungszwecken beibehalten.

Zusammenfassung

In diesem Beitrag haben wir beschrieben, wie die BMW Group in Zusammenarbeit mit AWS ProServe mithilfe von SageMaker Studio und anderen serverlosen und verwalteten AWS-Diensten einen vollständig verwalteten KI-Plattformdienst auf AWS entwickelt hat.

Mit JuMa sind die KI/ML-Teams von BMW in der Lage, neuen Geschäftswert zu erschließen, indem sie Experimente und die Markteinführungszeit für bahnbrechende KI-Lösungen beschleunigen. Darüber hinaus kann BMW durch die Migration von seiner On-Premises-Plattform den gesamten betrieblichen Aufwand und die Kosten reduzieren und gleichzeitig die Nachhaltigkeit und die allgemeine Sicherheitslage verbessern.

Weitere Informationen zum Ausführen Ihrer KI/ML-Experimentier- und Entwicklungs-Workloads auf AWS finden Sie unter Amazon SageMaker-Studio.

Über die Autoren

Marc Neumann ist Leiter der zentralen KI-Plattform der BMP Group. Er ist verantwortlich für die Entwicklung und Umsetzung von Strategien zur Nutzung der KI-Technologie zur geschäftlichen Wertschöpfung in der gesamten BMW Group. Sein Hauptziel besteht darin, sicherzustellen, dass der Einsatz von KI nachhaltig und skalierbar ist, sodass sie im gesamten Unternehmen konsistent angewendet werden kann, um langfristiges Wachstum und Innovation voranzutreiben. Durch seine Führung möchte Neumann die BMW Group als führend bei KI-gesteuerter Innovation und Wertschöpfung in der Automobilindustrie und darüber hinaus positionieren.

Marc Neumann ist Leiter der zentralen KI-Plattform der BMP Group. Er ist verantwortlich für die Entwicklung und Umsetzung von Strategien zur Nutzung der KI-Technologie zur geschäftlichen Wertschöpfung in der gesamten BMW Group. Sein Hauptziel besteht darin, sicherzustellen, dass der Einsatz von KI nachhaltig und skalierbar ist, sodass sie im gesamten Unternehmen konsistent angewendet werden kann, um langfristiges Wachstum und Innovation voranzutreiben. Durch seine Führung möchte Neumann die BMW Group als führend bei KI-gesteuerter Innovation und Wertschöpfung in der Automobilindustrie und darüber hinaus positionieren.

Amor Steinberg ist Machine Learning Engineer bei der BMW Group und Serviceleiter von Jupyter Managed, einem neuen Service, der darauf abzielt, Ingenieuren und Datenwissenschaftlern bei der BMW Group eine Code-zentrierte Analyse- und Machine-Learning-Workbench bereitzustellen. Seine frühere Erfahrung als DevOps-Ingenieur bei Finanzinstituten ermöglichte es ihm, ein einzigartiges Verständnis für die Herausforderungen zu entwickeln, mit denen Banken in der Europäischen Union konfrontiert sind, und das Gleichgewicht zwischen dem Streben nach technologischer Innovation, der Einhaltung von Gesetzen und Vorschriften und der Maximierung der Sicherheit für Kunden zu wahren.

Amor Steinberg ist Machine Learning Engineer bei der BMW Group und Serviceleiter von Jupyter Managed, einem neuen Service, der darauf abzielt, Ingenieuren und Datenwissenschaftlern bei der BMW Group eine Code-zentrierte Analyse- und Machine-Learning-Workbench bereitzustellen. Seine frühere Erfahrung als DevOps-Ingenieur bei Finanzinstituten ermöglichte es ihm, ein einzigartiges Verständnis für die Herausforderungen zu entwickeln, mit denen Banken in der Europäischen Union konfrontiert sind, und das Gleichgewicht zwischen dem Streben nach technologischer Innovation, der Einhaltung von Gesetzen und Vorschriften und der Maximierung der Sicherheit für Kunden zu wahren.

Marinus Krommenhoek ist Senior Cloud Solution Architect und Softwareentwickler bei der BMW Group. Ihn begeistert die Modernisierung der IT-Landschaft mit hochmodernen Services, die einen hohen Mehrwert bieten und einfach zu warten und zu betreiben sind. Marinus ist ein großer Verfechter von Microservices, serverlosen Architekturen und agilem Arbeiten. Er kann auf eine langjährige Erfahrung in der Arbeit mit verteilten Teams auf der ganzen Welt in großen Unternehmen zurückblicken.

Marinus Krommenhoek ist Senior Cloud Solution Architect und Softwareentwickler bei der BMW Group. Ihn begeistert die Modernisierung der IT-Landschaft mit hochmodernen Services, die einen hohen Mehrwert bieten und einfach zu warten und zu betreiben sind. Marinus ist ein großer Verfechter von Microservices, serverlosen Architekturen und agilem Arbeiten. Er kann auf eine langjährige Erfahrung in der Arbeit mit verteilten Teams auf der ganzen Welt in großen Unternehmen zurückblicken.

Nicolas Jacob Bär ist Principal Cloud Application Architect bei AWS ProServe mit einem starken Fokus auf Data Engineering und maschinelles Lernen, ansässig in der Schweiz. Er arbeitet eng mit Unternehmenskunden zusammen, um Datenplattformen zu entwerfen und erweiterte Analysen und ML-Anwendungsfälle zu erstellen.

Nicolas Jacob Bär ist Principal Cloud Application Architect bei AWS ProServe mit einem starken Fokus auf Data Engineering und maschinelles Lernen, ansässig in der Schweiz. Er arbeitet eng mit Unternehmenskunden zusammen, um Datenplattformen zu entwerfen und erweiterte Analysen und ML-Anwendungsfälle zu erstellen.

Joaquin Rinaudo ist Principal Security Architect bei AWS ProServe. Seine Leidenschaft gilt der Entwicklung von Lösungen, die Entwicklern helfen, ihre Softwarequalität zu verbessern. Vor seiner Zeit bei AWS arbeitete er in mehreren Bereichen der Sicherheitsbranche, von mobiler Sicherheit bis hin zu Cloud- und Compliance-bezogenen Themen. In seiner Freizeit verbringt Joaquin gerne Zeit mit der Familie und liest Science-Fiction-Romane.

Joaquin Rinaudo ist Principal Security Architect bei AWS ProServe. Seine Leidenschaft gilt der Entwicklung von Lösungen, die Entwicklern helfen, ihre Softwarequalität zu verbessern. Vor seiner Zeit bei AWS arbeitete er in mehreren Bereichen der Sicherheitsbranche, von mobiler Sicherheit bis hin zu Cloud- und Compliance-bezogenen Themen. In seiner Freizeit verbringt Joaquin gerne Zeit mit der Familie und liest Science-Fiction-Romane.

Shukhrat Chodjaev ist Senior Global Engagement Manager bei AWS ProServe. Er ist auf die Bereitstellung wirkungsvoller Big-Data- und KI/ML-Lösungen spezialisiert, die es AWS-Kunden ermöglichen, ihren Geschäftswert durch Datennutzung zu maximieren.

Shukhrat Chodjaev ist Senior Global Engagement Manager bei AWS ProServe. Er ist auf die Bereitstellung wirkungsvoller Big-Data- und KI/ML-Lösungen spezialisiert, die es AWS-Kunden ermöglichen, ihren Geschäftswert durch Datennutzung zu maximieren.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/accelerating-ai-ml-development-at-bmw-group-with-amazon-sagemaker-studio/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 000

- 100

- 120

- 15%

- 30

- 7

- 971

- a

- Über uns

- Abstracts

- beschleunigen

- beschleunigend

- Zugang

- Nach

- Konto

- Kontoverwaltung

- Trading Konten

- Erreichen

- über

- Aktivitäten

- hinzufügen

- zusätzlich

- Adresse

- Verwaltung

- Adoption

- advanced

- Anwalt

- Nach der

- gegen

- agil

- vor

- AI

- KI-Plattform

- AI / ML

- Ziel

- Alle

- erlauben

- erlaubt

- Zulassen

- erlaubt

- bereits

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon SageMaker-Studio

- Amazon Web Services

- Betrag

- an

- Analyse

- Business Analysten

- Analytik

- machen

- und Infrastruktur

- jedem

- Anwendung

- angewandt

- Genehmigung

- architektonisch

- Architektur

- SIND

- AS

- Versammlung

- damit verbundenen

- versichern

- At

- zugelassen

- Auto

- Im Prinzip so, wie Sie es von Google Maps kennen.

- Automation

- Automobilindustrie

- Automobilindustrie

- Verfügbarkeit

- verfügbar

- ein Weg

- AWS

- Professionelle AWS-Services

- Backend

- Sicherungskopie

- Balance

- Banken

- basierend

- BE

- weil

- Bevor

- Nutzen

- BESTE

- zwischen

- Beyond

- Big

- Big Data

- Blockiert

- BMW

- beide

- Box

- bauen

- Building

- erbaut

- Geschäft

- aber

- by

- CAN

- Fähigkeiten

- capability

- fähig

- österreichische Unternehmen

- Häuser

- Fälle

- Katalog

- Hauptgeschäftsstelle

- zentralisierte

- Herausforderungen

- Änderungen

- Ändern

- aus der Ferne überprüfen

- Auswählen

- eng

- Cloud

- Code

- zusammenarbeiten

- Zusammenarbeit

- Komplexität

- Compliance

- entsprechen

- Komponenten

- Berechnen

- Konfiguration

- erheblich

- konsequent

- verbrauchen

- Kontext

- ständig

- Kontrast

- Smartgeräte App

- Kernbereich

- Unternehmen

- Kosten

- Ländern

- Covers

- erstellen

- Schaffung

- Original

- Kunde

- Kunden

- Anpassung

- anpassen

- Zyklen

- technische Daten

- Datenanalyse

- Datensee

- Datenaufbereitung

- Datenwissenschaft

- Datenwissenschaftler

- datengesteuerte

- Datenbanken

- Datum

- Tage

- Decision Making

- Entscheidungen

- tief

- tiefe Lernen

- liefern

- einsetzen

- Einsatz

- Bereitstellen

- beschrieben

- Design

- entworfen

- Detail

- entwickelt

- Entwickler:in / Unternehmen

- Entwickler

- Entwicklung

- Entwicklung

- anders

- digital

- Digitalisierung

- Direkt

- Direkt

- behindert

- störend

- verteilt

- do

- Docker

- Tut nicht

- Domain

- Domains

- nach unten

- Antrieb

- angetrieben

- im

- jeder

- Einfache

- Effizienz

- Anstrengung

- mühelos

- Bemühungen

- entweder

- Strom

- Emissionen

- Mitarbeiter

- ermächtigt

- ermöglichen

- freigegeben

- ermöglicht

- ermöglichen

- ermutigen

- End-to-End

- Durchsetzung

- Engagement

- Ingenieur

- Entwicklung

- Ingenieure

- gewährleisten

- sorgt

- Gewährleistung

- Unternehmen

- Unternehmen

- begeistert

- Ganz

- Arbeitsumfeld

- Umwelt-

- Umgebungen

- Fehler

- etablierten

- Europäische

- Europäische Union

- Sogar

- Beispiel

- Kosten

- ERFAHRUNGEN

- Gesichter

- erleichtert

- Anlagen

- Scheitern

- vertraut

- Familie

- beschleunigt

- Eigenschaften

- Honorare

- wenige

- Reichen Sie das

- Revolution

- Finanzinstitutionen

- Setzen Sie mit Achtsamkeit

- Folgende

- Fußabdruck

- Aussichten für

- Gerüste

- Frei

- für

- voller

- voll

- weiter

- Außerdem

- sammeln

- allgemein

- erzeugt

- Deutschland

- Git

- gegeben

- Global

- Globus

- Kundenziele

- Governance

- GPU

- mehr

- Gruppe an

- Gruppen

- persönlichem Wachstum

- gewachsen

- Wachstum

- Griffe

- Hardware

- he

- ganzer

- Hauptsitz

- schwer

- Hilfe

- hilft

- GUTE

- hochwertig

- High-Level

- ihm

- seine

- Gastgeber

- Ultraschall

- HTML

- http

- HTTPS

- Nabe

- human

- Idee

- identifiziert

- Identitätsschutz

- Leerlauf

- Bilder

- sofort

- Impact der HXNUMXO Observatorien

- schlagkräftig

- umgesetzt

- Umsetzung

- implementiert

- wichtig

- zu unterstützen,

- in

- inklusive

- Dazu gehören

- Einschließlich

- Erhöhung

- Steigert

- zunehmend

- zunehmend

- Anzeigen

- Energiegewinnung

- Information

- informiert

- Infrastruktur

- Innovation

- Instanz

- Institutionen

- integriert

- Integriert

- Integration

- Intelligent

- beabsichtigt

- intern

- Internet

- Internetzugang

- in

- Einführung

- Investments

- isoliert

- Isolierung

- Probleme

- IT

- SEINE

- selbst

- Jacob

- jpg

- nur

- Behalten

- Aufbewahrung

- gehalten

- Wesentliche

- See

- Landschaft

- grosse

- Große Unternehmen

- neueste

- starten

- Gesetze

- Gesetze und Richtlinien

- führen

- Führer

- Leadership

- führenden

- Springen

- LERNEN

- lernen

- am wenigsten

- Rechtlich

- Lizenzen

- Lizenzierung

- Lebenszyklus

- Limitiert

- Begrenzung

- Line

- Gelistet

- aus einer regionalen

- örtlich

- Log

- Lang

- langfristig

- Maschine

- Maschinelles Lernen

- Main

- halten

- Aufrechterhaltung

- Wartung

- um

- Making

- verwalten

- verwaltet

- Management

- Manager

- flächendeckende Gesundheitsprogramme

- manuell

- Hersteller

- Ihres Materials

- Maximieren

- Maximierung

- Bedeutung

- Mechanismus

- Triff

- Trifft

- Mitglieder

- Memory

- erwähnt

- Metrik

- Microservices

- Migration

- Migration

- Minuten

- vermisst

- mischen

- ML

- MLOps

- Mobil

- Mobile Sicherheit

- Mobilität

- Model

- Modell

- für

- Modernisierung

- überwacht

- Monitore

- mehr

- Zudem zeigt

- vor allem warme

- Motorräder

- ziehen um

- mehrere

- Need

- erforderlich

- benötigen

- Bedürfnisse

- Netzwerk

- Neu

- nicht

- jetzt an

- nummerierte

- of

- bieten

- on

- On-Demand

- Onboard

- Einsteigen

- einzige

- XNUMXh geöffnet

- Open-Source-

- Eröffnung

- betreiben

- die

- Betriebs-

- Optimieren

- or

- Auftrag

- Bestellungen

- Organisation

- Andere

- übrig

- Gesamt-

- besitzen

- Besitzer

- Pakete

- Parallel

- leidenschaftlich

- passt

- Patchen

- pflastern

- für

- Ausführen

- Leistung

- Säule

- Pipeline

- Plattform

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Points

- Politik durchzulesen

- Portal

- Position

- Post

- angetriebene

- größte treibende

- Praxis

- Prämie

- Vorbereitung

- verhindern

- primär

- Principal

- Vor

- privat

- Privileg

- Privilegien

- Prozessdefinierung

- anpassen

- produziert

- Produkt

- Produktentwicklung

- Produktion

- PRODUKTIVITÄT

- Professionell

- Profis

- Risiken zu minimieren

- Prototypen

- die

- vorausgesetzt

- Versorger

- bietet

- Bereitstellung

- Zwecke

- Python

- Qualität

- schnell

- R

- Angebot

- schnell

- Lesebrillen

- bereit

- erhält

- Rekord

- Veteran

- Reduzierung

- siehe

- in Bezug auf

- Regionen

- Vorschriften

- verlassen

- sich auf

- entfernen

- Meldungen

- Anforderung

- Zugriffe

- erfordern

- falls angefordert

- Voraussetzungen:

- Downloads

- für ihren Verlust verantwortlich.

- eingeschränkt

- Die Ergebnisse

- Beibehaltung

- Rechte

- Rollen

- Rollen

- Führen Sie

- Laufen

- Laufzeit

- sagemaker

- gleich

- Skalierbarkeit

- skalierbaren

- Skalierung

- Wissenschaft

- Wissenschaftler

- Wissenschaftler

- nahtlos

- nahtlos

- Abschnitte

- Verbindung

- Sicherheitdienst

- Selbstbedienung

- Senior

- Serverlos

- Fertige Server

- Dienstleistungen

- kompensieren

- Sets

- mehrere

- von Locals geführtes

- verschieben

- Schließung

- Schläge

- signifikant

- bedeutend

- Einfacher

- einfach

- Single

- Umstände

- Größen

- erfahren

- So

- Software

- Lösung

- Lösungen

- Quelle

- Souveränität

- Raumfahrt

- Räume

- besondere

- spezialisiert

- spezifisch

- speziell

- Ausgabe

- Standard

- Anfang

- State-of-the-art

- Schritt

- Shritte

- Lagerung

- speichern

- gelagert

- Strategien

- Strategie

- Strafft

- Streben

- stark

- Struktur

- Studio Adressen

- Subnetze

- so

- ausreichend

- Support

- Unterstützt

- Nachhaltigkeit

- nachhaltiger

- Schweiz

- System

- Nehmen

- Reden

- und Aufgaben

- Team

- Teammitglieder

- Teams

- Technische

- technologische

- Technologie

- Begriff

- Terraform

- getestet

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Linie

- ihr

- Sie

- deswegen

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- Durch

- während

- dicht

- Zeit

- zu

- heute

- auch

- Werkzeuge

- Top

- Themen

- gegenüber

- Spur

- Tracing

- Ausbildung

- Trends

- XNUMX

- Verständnis

- Gewerkschaft

- einzigartiges

- öffnen

- auf dem neusten Stand

- aktualisiert

- Upgrade

- URL

- Anwendungsbereich

- -

- Anwendungsfall

- benutzt

- benutzerfreundlich

- Nutzer

- Verwendung von

- validiert

- Bestätigung

- Wert

- Wertschöpfung

- Version

- geprüft

- Anzeigen

- Assistent

- Besuchen Sie

- Volumen

- wurde

- Weg..

- we

- Netz

- Web-Services

- GUT

- waren

- wann

- sobald

- während

- welche

- während

- werden wir

- mit

- .

- ohne

- Arbeiten

- gearbeitet

- Arbeitsablauf.

- Workflows

- arbeiten,

- Werk

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- weltweit

- Das weltweit

- Sorgen

- würde

- Jahr

- Ihr

- Zephyrnet

- Zonen