Amazon Sage Maker hat angekündigt die Unterstützung von drei neuen Abschlusskriterien für Amazon SageMaker automatische Modellabstimmung, das Ihnen einen zusätzlichen Satz von Hebeln zur Verfügung stellt, um die Stoppkriterien des Tuning-Jobs zu steuern, wenn Sie die beste Hyperparameter-Konfiguration für Ihr Modell finden.

In diesem Beitrag diskutieren wir diese neuen Abschlusskriterien, wann sie verwendet werden sollten und einige der Vorteile, die sie mit sich bringen.

Automatische Modellabstimmung von SageMaker

Automatisches Modelltuning, auch genannt Hyperparameter-Tuning, findet die beste Version eines Modells, gemessen an der von uns gewählten Metrik. Es führt viele Trainingsjobs für den bereitgestellten Datensatz aus, wobei der ausgewählte Algorithmus und die angegebenen Hyperparameterbereiche verwendet werden. Jeder Trainingsjob kann vorzeitig abgeschlossen werden, wenn sich die objektive Metrik nicht wesentlich verbessert, was als vorzeitiges Beenden bezeichnet wird.

Bisher gab es nur begrenzte Möglichkeiten, den gesamten Tuning-Job zu steuern, wie z. B. das Festlegen der maximalen Anzahl von Trainingsjobs. Die Auswahl dieses Parameterwerts ist jedoch bestenfalls heuristisch. Ein größerer Wert erhöht die Optimierungskosten, und ein kleinerer Wert ergibt möglicherweise nicht immer die beste Version des Modells.

Das automatische SageMaker-Modelltuning löst diese Herausforderungen, indem es Ihnen mehrere Abschlusskriterien für den Tuning-Job gibt. Es wird auf der Tuning-Ebene und nicht auf der Ebene jedes einzelnen Trainingsjobs angewendet, was bedeutet, dass es auf einer höheren Abstraktionsebene arbeitet.

Vorteile der Optimierung der Abschlusskriterien für Jobs

Mit einer besseren Kontrolle darüber, wann der Optimierungsjob beendet wird, profitieren Sie von Kosteneinsparungen, da der Job nicht für längere Zeit ausgeführt wird und rechenintensiv ist. Außerdem können Sie so sicherstellen, dass der Job nicht zu früh aufhört und Sie ein Modell mit ausreichend guter Qualität erhalten, das Ihren Zielen entspricht. Sie können den Optimierungsauftrag beenden, wenn sich die Modelle nach einer Reihe von Iterationen nicht mehr verbessern oder wenn die geschätzte verbleibende Verbesserung die Rechenressourcen und die Zeit nicht rechtfertigt.

Zusätzlich zu der bestehenden maximalen Anzahl von Ausbildungsberufsabschlusskriterien MaxNumberOfTrainingJobs, führt die automatische Modelloptimierung die Option ein, die Optimierung basierend auf einer maximalen Optimierungszeit, der Verbesserungsüberwachung und der Konvergenzerkennung zu stoppen.

Lassen Sie uns jedes dieser Kriterien untersuchen.

Maximale Einstellzeit

Bisher hatten Sie die Möglichkeit, eine maximale Anzahl von Trainingsjobs als Ressourcenbegrenzungseinstellung zu definieren, um das Optimierungsbudget in Bezug auf die Rechenressourcen zu steuern. Dies kann jedoch zu unnötig längeren oder kürzeren Trainingszeiten als erforderlich oder gewünscht führen.

Mit dem Hinzufügen des Kriteriums für die maximale Optimierungszeit können Sie Ihr Trainingsbudget jetzt in Bezug auf die Zeitdauer zum Ausführen des Optimierungsjobs zuweisen und den Job automatisch nach einer in Sekunden definierten Zeitdauer beenden.

Wie oben gesehen, verwenden wir die MaxRuntimeInSeconds um die Abstimmzeit in Sekunden zu definieren. Durch Festlegen des Optimierungszeitlimits können Sie die Dauer des Optimierungsauftrags und auch die prognostizierten Kosten des Experiments begrenzen.

Die Gesamtkosten vor vertraglichem Rabatt können mit der folgenden Formel geschätzt werden:EstimatedComputeSeconds= MaxRuntimeInSeconds * MaxParallelTrainingJobs * InstanceCost

Die maximale Laufzeit in Sekunden könnte verwendet werden, um Kosten und Laufzeit zu begrenzen. Mit anderen Worten, es handelt sich um ein Abschlusskriterium für die Budgetkontrolle.

Diese Funktion ist Teil eines Ressourcensteuerungskriteriums und berücksichtigt nicht die Konvergenz der Modelle. Wie wir später in diesem Beitrag sehen, kann dieses Kriterium in Kombination mit anderen Stoppkriterien verwendet werden, um eine Kostenkontrolle ohne Einbußen bei der Genauigkeit zu erreichen.

Gewünschte Zielmetrik

Ein weiteres zuvor eingeführtes Kriterium besteht darin, das Zielvorgabeziel im Voraus zu definieren. Die Kriterien überwachen die Leistung des besten Modells basierend auf einer bestimmten objektiven Metrik und stoppen die Optimierung, wenn die Modelle den definierten Schwellenwert in Bezug auf eine bestimmte objektive Metrik erreichen.

Mit der TargetObjectiveMetricValue Kriterien können wir SageMaker anweisen, die Optimierung des Modells zu beenden, nachdem die objektive Metrik des besten Modells den angegebenen Wert erreicht hat:

In diesem Beispiel wird SageMaker angewiesen, die Optimierung des Modells zu beenden, wenn die objektive Metrik des besten Modells 0.95 erreicht hat.

Diese Methode ist nützlich, wenn Sie ein bestimmtes Ziel haben, das Ihr Modell erreichen soll, z. B. ein bestimmtes Maß an Genauigkeit, Präzision, Abruf, F1-Wert, AUC, Protokollverlust usw.

Ein typischer Anwendungsfall für dieses Kriterium wäre ein Benutzer, der bereits mit der Modellleistung bei bestimmten Schwellenwerten vertraut ist. Ein Benutzer in der Explorationsphase kann zuerst das Modell mit einer kleinen Teilmenge eines größeren Datensatzes abstimmen, um einen zufriedenstellenden Evaluierungsmetrikschwellenwert zu identifizieren, der beim Training mit dem vollständigen Datensatz anzustreben ist.

Verbesserungsüberwachung

Dieses Kriterium überwacht die Konvergenz der Modelle nach jeder Iteration und stoppt die Optimierung, wenn sich die Modelle nach einer definierten Anzahl von Trainingsjobs nicht verbessern. Siehe folgende Konfiguration:

In diesem Fall setzen wir die MaxNumberOfTrainingJobsNotImproving auf 10, d. h. wenn sich die objektive Metrik nach 10 Trainingsjobs nicht mehr verbessert, wird die Optimierung gestoppt und das beste Modell und die beste Metrik gemeldet.

Die Verbesserungsüberwachung sollte verwendet werden, um einen Kompromiss zwischen der Modellqualität und der Gesamtdauer des Arbeitsablaufs so abzustimmen, dass er wahrscheinlich zwischen verschiedenen Optimierungsproblemen übertragbar ist.

Konvergenzerkennung

Die Konvergenzerkennung ist ein Abschlusskriterium, mit dem die automatische Modelloptimierung entscheiden kann, wann die Optimierung beendet werden soll. Im Allgemeinen stoppt die automatische Modelloptimierung die Optimierung, wenn sie davon ausgeht, dass keine signifikante Verbesserung erzielt werden kann. Siehe folgende Konfiguration:

Das Kriterium ist am besten geeignet, wenn Sie zunächst nicht wissen, welche Stoppeinstellungen Sie auswählen sollen.

Es ist auch nützlich, wenn Sie nicht wissen, welche Zielmetrik angesichts des vorliegenden Problems und Datensatzes für eine gute Vorhersage angemessen ist, und die Optimierungsaufgabe lieber abgeschlossen haben möchten, wenn sie sich nicht mehr verbessert.

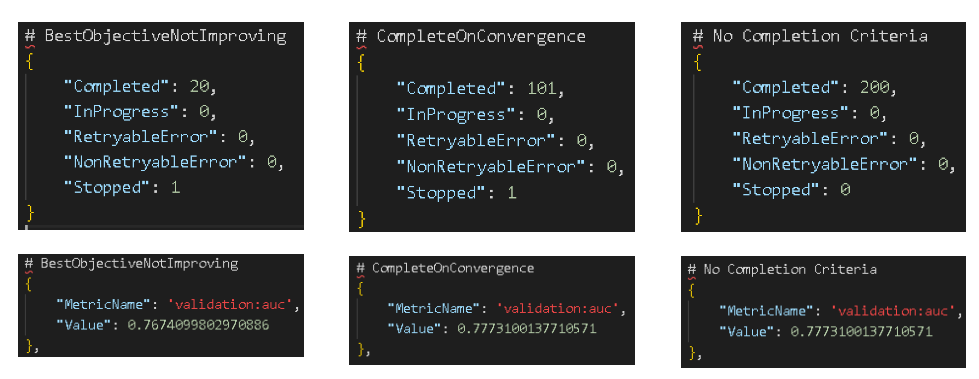

Experimentieren Sie mit einem Vergleich der Abschlusskriterien

In diesem Experiment führen wir bei einer Regressionsaufgabe 3 Tuning-Experimente durch, um das optimale Modell innerhalb eines Suchraums von 2 Hyperparametern mit insgesamt 200 Hyperparameterkonfigurationen unter Verwendung von zu finden Direktmarketing-Datensatz.

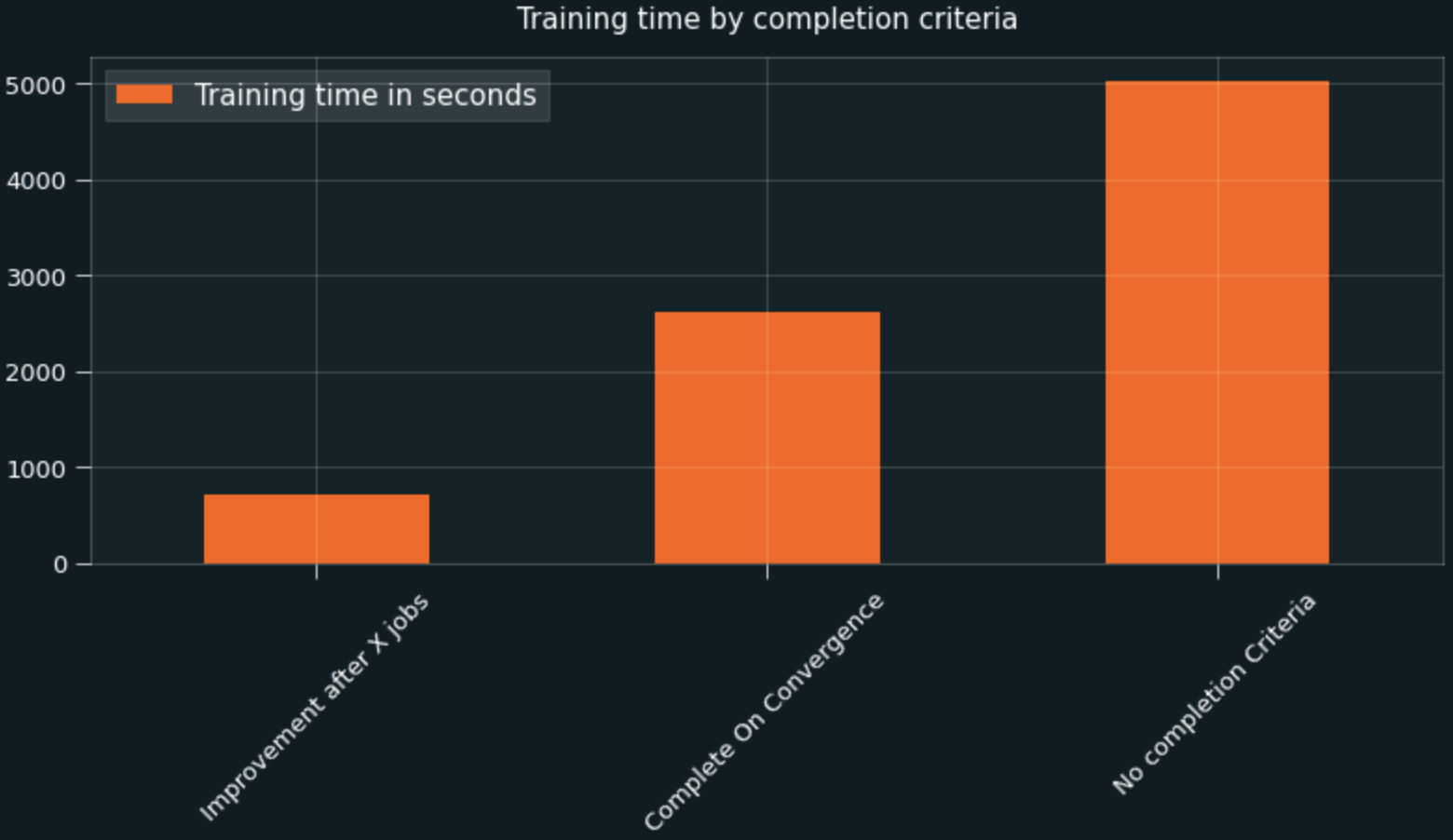

Da alles andere gleich war, wurde das erste Modell mit dem abgestimmt BestObjectiveNotImproving Abschlusskriterien wurde das zweite Modell mit den abgestimmt CompleteOnConvergence und das dritte Modell wurde ohne definierte Abschlusskriterien optimiert.

Bei der Beschreibung der einzelnen Jobs können wir diese Einstellung beobachten BestObjectiveNotImproving Kriterien hat zu den optimalsten Ressourcen und Zeiten im Verhältnis zur Zielmetrik geführt, wobei deutlich weniger Jobs ausgeführt wurden.

Das CompleteOnConvergence Kriterien war auch in der Lage, die Optimierung nach der Hälfte des Experiments zu stoppen, was zu weniger Trainingsjobs und einer kürzeren Trainingszeit im Vergleich dazu führte, dass keine Kriterien festgelegt wurden.

Während das Festlegen eines Abschlusskriteriums zu einem kostspieligen Experiment führte, war das Definieren der MaxRuntimeInSeconds als Teil der Ressourcenbegrenzung wäre eine Möglichkeit, die Kosten zu minimieren.

Die obigen Ergebnisse zeigen, dass Amazon SageMaker beim Definieren eines Abschlusskriteriums in der Lage ist, den Optimierungsprozess intelligent zu stoppen, wenn es erkennt, dass das Modell sich wahrscheinlich nicht über das aktuelle Ergebnis hinaus verbessern wird.

Beachten Sie, dass sich die von der automatischen SageMaker-Modelloptimierung unterstützten Vervollständigungskriterien nicht gegenseitig ausschließen und beim Optimieren eines Modells gleichzeitig verwendet werden können.

Wenn mehr als ein Abschlusskriterium definiert ist, wird der Optimierungsjob abgeschlossen, wenn eines der Kriterien erfüllt ist.

Beispielsweise kann eine Kombination eines Ressourcenbegrenzungskriteriums wie etwa einer maximalen Einstellzeit mit einem Konvergenzkriterium wie etwa einer Verbesserungsüberwachung oder einer Konvergenzerkennung eine optimale Kostenkontrolle und eine optimale Zielmetrik erzeugen.

Zusammenfassung

In diesem Beitrag haben wir besprochen, wie Sie Ihren Tuning-Job jetzt intelligent stoppen können, indem Sie eine Reihe von Abschlusskriterien auswählen, die neu in SageMaker eingeführt wurden, wie z. B. maximale Tuning-Zeit, Verbesserungsüberwachung oder Konvergenzerkennung.

Wir haben mit einem Experiment gezeigt, dass intelligentes Stoppen auf der Grundlage von Verbesserungsbeobachtungen über Iterationen hinweg zu einem deutlich optimierten Budget- und Zeitmanagement führen kann, verglichen mit der Nichtdefinition eines Abschlusskriteriums.

Wir haben auch gezeigt, dass sich diese Kriterien nicht gegenseitig ausschließen und beim Optimieren eines Modells gleichzeitig verwendet werden können, um sowohl Budgetkontrolle als auch optimale Konvergenz zu nutzen.

Weitere Einzelheiten zum Konfigurieren und Ausführen der automatischen Modelloptimierung finden Sie unter Geben Sie die Hyperparameter-Tuning-Job-Einstellungen an.

Über die Autoren

Doug Mbaya ist Senior Partner Solution Architect mit Fokus auf Daten und Analytik. Doug arbeitet eng mit AWS-Partnern zusammen und hilft ihnen bei der Integration von Daten- und Analyselösungen in die Cloud.

Doug Mbaya ist Senior Partner Solution Architect mit Fokus auf Daten und Analytik. Doug arbeitet eng mit AWS-Partnern zusammen und hilft ihnen bei der Integration von Daten- und Analyselösungen in die Cloud.

Chaitra Mathur ist Principal Solutions Architect bei AWS. Sie leitet Kunden und Partner beim Aufbau hochskalierbarer, zuverlässiger, sicherer und kostengünstiger Lösungen auf AWS. Sie interessiert sich leidenschaftlich für maschinelles Lernen und hilft Kunden, ihre ML-Anforderungen mithilfe von AWS AI/ML-Services in Lösungen umzusetzen. Sie besitzt 5 Zertifizierungen, darunter die ML Specialty-Zertifizierung. In ihrer Freizeit liest sie gerne, macht Yoga und verbringt Zeit mit ihren Töchtern.

Chaitra Mathur ist Principal Solutions Architect bei AWS. Sie leitet Kunden und Partner beim Aufbau hochskalierbarer, zuverlässiger, sicherer und kostengünstiger Lösungen auf AWS. Sie interessiert sich leidenschaftlich für maschinelles Lernen und hilft Kunden, ihre ML-Anforderungen mithilfe von AWS AI/ML-Services in Lösungen umzusetzen. Sie besitzt 5 Zertifizierungen, darunter die ML Specialty-Zertifizierung. In ihrer Freizeit liest sie gerne, macht Yoga und verbringt Zeit mit ihren Töchtern.

Iaroslav Shcherbatyi ist Machine Learning Engineer bei AWS. Er arbeitet hauptsächlich an Verbesserungen der Amazon SageMaker-Plattform und hilft Kunden, ihre Funktionen optimal zu nutzen. In seiner Freizeit geht er gerne ins Fitnessstudio, betreibt Outdoor-Sportarten wie Eislaufen oder Wandern und informiert sich über neue KI-Forschung.

Iaroslav Shcherbatyi ist Machine Learning Engineer bei AWS. Er arbeitet hauptsächlich an Verbesserungen der Amazon SageMaker-Plattform und hilft Kunden, ihre Funktionen optimal zu nutzen. In seiner Freizeit geht er gerne ins Fitnessstudio, betreibt Outdoor-Sportarten wie Eislaufen oder Wandern und informiert sich über neue KI-Forschung.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/amazon-sagemaker-automatic-model-tuning-now-supports-three-new-completion-criteria-for-hyperparameter-optimization/

- 10

- 100

- 11

- 7

- 9

- a

- Fähig

- LiveBuzz

- oben

- Konto

- Genauigkeit

- Erreichen

- erreicht

- über

- Zusatz

- Zusätzliche

- Vorteil

- Nach der

- AI

- ai Forschung

- AI / ML

- Algorithmus

- Alle

- bereits

- Amazon

- Amazon Sage Maker

- Betrag

- Analytik

- und

- angewandt

- automatische

- Im Prinzip so, wie Sie es von Google Maps kennen.

- AWS

- basierend

- Bevor

- Sein

- Nutzen

- Vorteile

- BESTE

- Besser

- zwischen

- Beyond

- Bound

- bringen

- Haushalt

- Building

- namens

- Häuser

- Ringen

- sicher

- Zertifizierung

- Zertifizierungen

- Herausforderungen

- Auswählen

- gewählt

- eng

- Cloud

- Kombination

- verglichen

- Vergleich

- abschließen

- Abgeschlossene Verkäufe

- Wird abgeschlossen

- Abschluss

- Berechnen

- Konfiguration

- Smartgeräte App

- Konvergenz

- Kosten

- Einsparmaßnahmen

- kostengünstiger

- Kosten

- könnte

- Kriterien

- Strom

- Kunden

- technische Daten

- definiert

- Definition

- Synergie

- erwünscht

- Details

- Entdeckung

- anders

- Rabatt

- diskutieren

- diskutiert

- Tut nicht

- Nicht

- jeder

- Früh

- freigegeben

- Ingenieur

- gewährleisten

- geschätzt

- Schätzungen

- Auswertung

- alles

- Beispiel

- Exclusive

- vorhandenen

- teuer

- Experiment

- Exploration

- ERKUNDEN

- vertraut

- Merkmal

- Eigenschaften

- Finden Sie

- Suche nach

- findet

- Vorname

- Setzen Sie mit Achtsamkeit

- Folgende

- Formel

- voller

- allgemein

- bekommen

- gegeben

- Unterstützung

- Go

- Kundenziele

- gut

- Anleitungen

- Turnhalle

- mit

- Unternehmen

- hilft

- höher

- hoch

- hält

- Ultraschall

- Hilfe

- aber

- HTML

- HTTPS

- Hyperparameteroptimierung

- Hyperparameter-Tuning

- EIS

- identifizieren

- zu unterstützen,

- Verbesserung

- Verbesserungen

- Verbesserung

- in

- In anderen

- Einschließlich

- Steigert

- Krankengymnastik

- anfänglich

- integrieren

- Intelligent

- eingeführt

- Stellt vor

- IT

- Iteration

- Iterationen

- Job

- Jobs

- Wissen

- bekannt

- größer

- Schicht

- führen

- lernen

- geführt

- Lasst uns

- Niveau

- wahrscheinlich

- LIMIT

- Limitiert

- länger

- Maschine

- Maschinelles Lernen

- Management

- viele

- Marketing

- max

- Maximieren

- maximal

- Mittel

- Trifft

- Methode

- Metrisch

- Metrik

- minimieren

- ML

- Modell

- für

- Überwachung

- Monitore

- mehr

- vor allem warme

- mehrere

- gegenseitig

- Bedürfnisse

- Neu

- Anzahl

- Ziel

- beobachten

- EINEM

- arbeitet

- optimal

- Optimierung

- optimiert

- Option

- Andere

- Gesamt-

- Parameter

- Teil

- Partner

- leidenschaftlich

- Leistung

- Zeiträume

- Phase

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- Post

- Präzision

- Prognose

- vorher

- Principal

- Aufgabenstellung:

- Probleme

- Prozessdefinierung

- produziert

- projektiert

- vorausgesetzt

- Bereitstellung

- Qualität

- erreichen

- erreicht

- Lesebrillen

- vernünftig

- Beziehung

- zuverlässig

- Berichtet

- Forschungsprojekte

- Ressourcen

- Downloads

- Folge

- was zu

- Die Ergebnisse

- Führen Sie

- opfern

- sagemaker

- Automatisches SageMaker-Modelltuning

- Ersparnisse

- skalierbaren

- Suche

- Zweite

- Sekunden

- Verbindung

- Auswahl

- Auswahl

- Senior

- Lösungen

- kompensieren

- Einstellung

- Einstellungen

- sollte

- erklären

- signifikant

- bedeutend

- klein

- kleinere

- So

- Lösung

- Lösungen

- Löst

- einige

- Raumfahrt

- Spezialprodukte

- spezifisch

- angegeben

- Ausgabe

- Spins

- Sports

- Stoppen

- gestoppt

- Einstellung

- Stoppt

- so

- Support

- Unterstützte

- Unterstützt

- Nehmen

- Target

- Aufgabe

- AGB

- Das

- ihr

- Dritte

- nach drei

- Schwelle

- Durch

- Zeit

- mal

- zu

- auch

- Gesamt

- Ausbildung

- Übersetzen

- typisch

- -

- Anwendungsfall

- Mitglied

- Bestätigung

- Wert

- Version

- Wege

- Was

- welche

- WHO

- werden wir

- .

- ohne

- Worte

- Werk

- würde

- Ausbeute

- Yoga

- Du

- Ihr

- Zephyrnet