Im Jahr 2021 haben wir gestartet Proaktive AWS-Support-Services als Teil der AWS Enterprise-Support planen. Seit seiner Einführung haben wir Hunderten von Kunden dabei geholfen, ihre Arbeitslasten zu optimieren, Leitplanken festzulegen und die Transparenz der Kosten und Nutzung ihrer Arbeitslasten für maschinelles Lernen (ML) zu verbessern.

In dieser Beitragsreihe teilen wir unsere Erkenntnisse zur Kostenoptimierung Amazon Sage Maker. in Teil 1Wir haben gezeigt, wie Sie mit der Verwendung beginnen können AWS-Kosten-Explorer um Kostenoptimierungsmöglichkeiten in SageMaker zu identifizieren. In diesem Beitrag konzentrieren wir uns auf SageMaker-Inferenzumgebungen: Echtzeit-Inferenz, Batch-Transformation, asynchrone Inferenz und serverlose Inferenz.

SageMaker bietet mehrere Inferenzoptionen aus denen Sie je nach Arbeitsaufwand auswählen können:

- Echtzeit-Inferenz für Online-Anforderungen, geringe Latenz oder hohen Durchsatz

- Batch-Transformation für die Offline-, geplante Verarbeitung und wenn Sie keinen dauerhaften Endpunkt benötigen

- Asynchrone Inferenz für den Fall, dass Sie große Nutzlasten mit langen Verarbeitungszeiten haben und Anfragen in die Warteschlange stellen möchten

- Serverlose Inferenz für den Fall, dass Ihr Verkehrsaufkommen unregelmäßig oder unvorhersehbar ist und Sie Kaltstarts vertragen

In den folgenden Abschnitten besprechen wir jede Inferenzoption ausführlicher.

SageMaker-Echtzeit-Inferenz

Wenn Sie einen Endpunkt erstellen, fügt SageMaker einen an Amazon Elastic Block-Shop (Amazon EBS) Speichervolumen zum Amazon Elastic Compute-Cloud (Amazon EC2)-Instanz, die den Endpunkt hostet. Dies gilt für alle Instanztypen, die nicht über einen SSD-Speicher verfügen. Da die d*-Instanztypen mit einem NVMe-SSD-Speicher ausgestattet sind, fügt SageMaker diesen ML-Recheninstanzen kein EBS-Speichervolume hinzu. Beziehen auf Speichervolumes der Hostinstanz für die Größe der Speichervolumes, die SageMaker für jeden Instanztyp für einen einzelnen Endpunkt und für einen Endpunkt mit mehreren Modellen anfügt.

Die Kosten für SageMaker-Echtzeitendpunkte basieren auf der verbrauchten Stunde pro Instanz, während der Endpunkt ausgeführt wird, den Kosten für den bereitgestellten Speicher (EBS-Volumen) in GB pro Monat sowie den ein- und ausgehenden verarbeiteten GB-Daten der Endpunktinstanz, wie in beschrieben Amazon SageMaker Preise. Im Cost Explorer können Sie Endpunktkosten in Echtzeit anzeigen, indem Sie einen Filter auf den Nutzungstyp anwenden. Die Namen dieser Nutzungsarten sind wie folgt aufgebaut:

REGION-Host:instanceType(zum Beispiel,USE1-Host:ml.c5.9xlarge)REGION-Host:VolumeUsage.gp2(zum Beispiel,USE1-Host:VolumeUsage.gp2)REGION-Hst:Data-Bytes-Out(zum Beispiel,USE2-Hst:Data-Bytes-In)REGION-Hst:Data-Bytes-Out(zum Beispiel,USW2-Hst:Data-Bytes-Out)

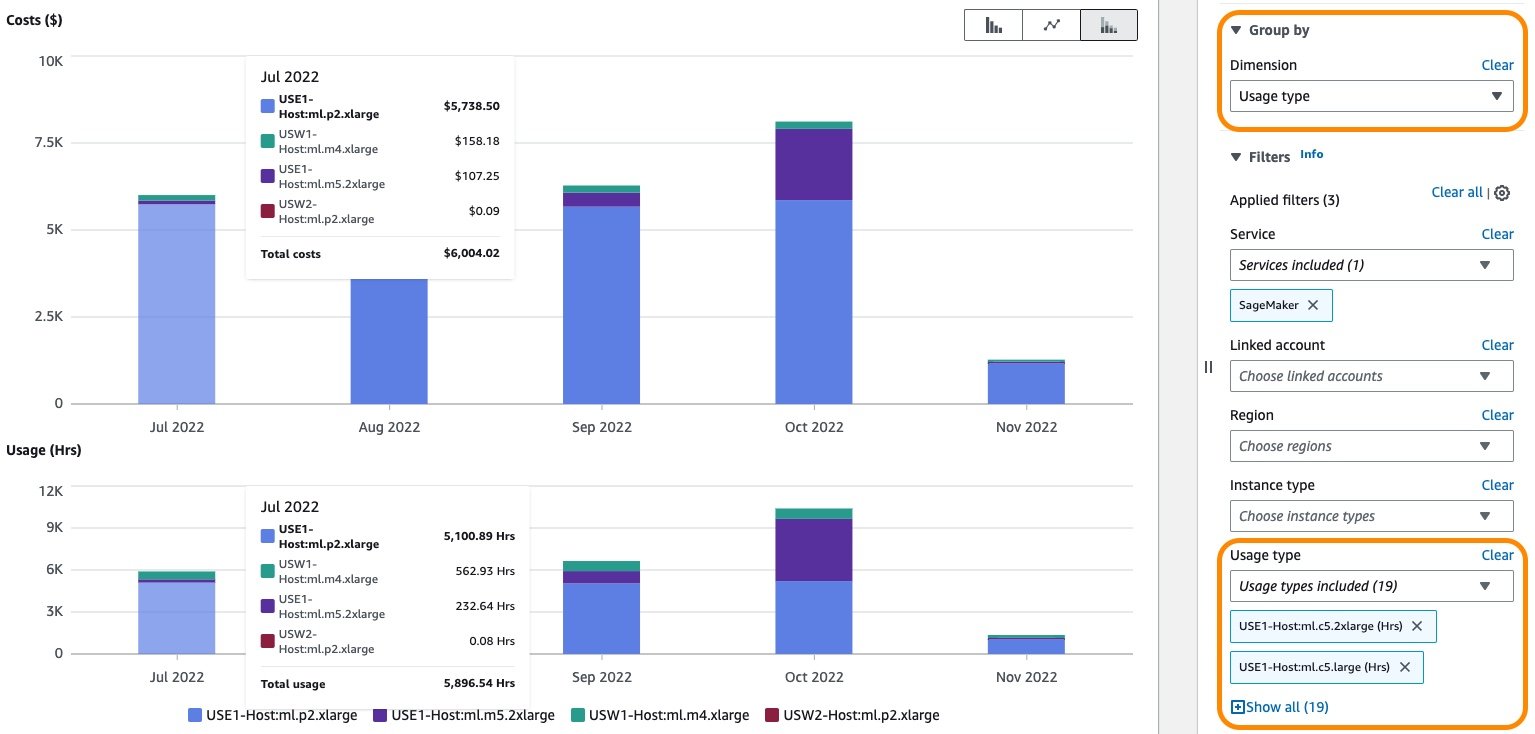

Wie im folgenden Screenshot gezeigt, wird nach der Nutzungsart gefiltert Host: zeigt eine Liste der Echtzeit-Hosting-Nutzungstypen in einem Konto an.

Sie können entweder bestimmte Nutzungsarten auswählen oder auswählen Alle auswählen und wählen Sie Bewerben um die Kostenaufschlüsselung der SageMaker-Echtzeit-Hosting-Nutzung anzuzeigen. Um die Kosten- und Nutzungsaufschlüsselung nach Instanzstunden anzuzeigen, müssen Sie alle Optionen deaktivieren REGION-Host:VolumeUsage.gp2 Nutzungstypen, bevor Sie den Nutzungstypfilter anwenden. Sie können auch zusätzliche Filter wie Kontonummer, EC2-Instance-Typ, Kostenzuordnungs-Tag, Region usw. anwenden mehr. Der folgende Screenshot zeigt Kosten- und Nutzungsdiagramme für die ausgewählten Hosting-Nutzungsarten.

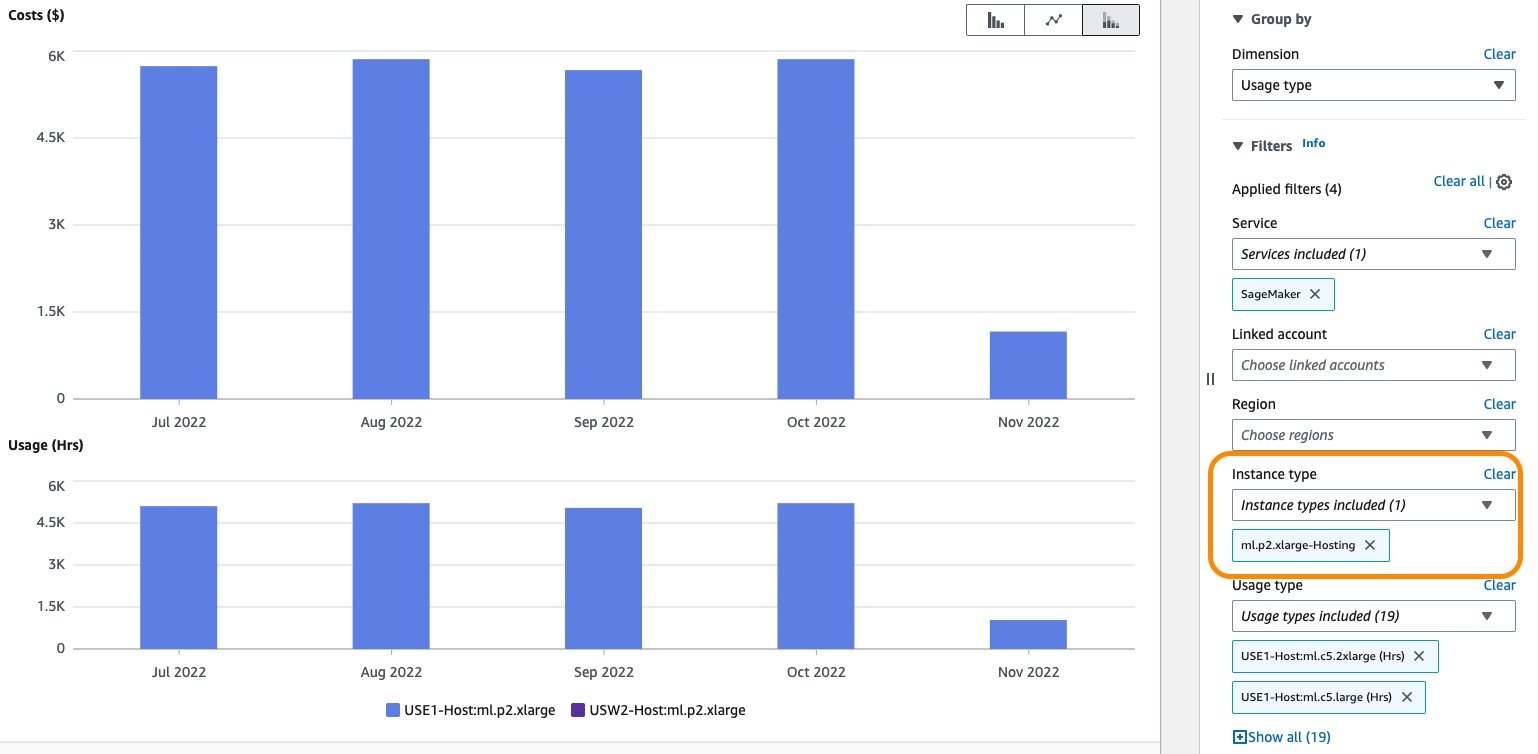

Darüber hinaus können Sie die mit einer oder mehreren Hosting-Instanzen verbundenen Kosten ermitteln, indem Sie Folgendes verwenden Instanztyp Filter. Der folgende Screenshot zeigt die Kosten- und Nutzungsaufschlüsselung für die Hosting-Instanz ml.p2.xlarge.

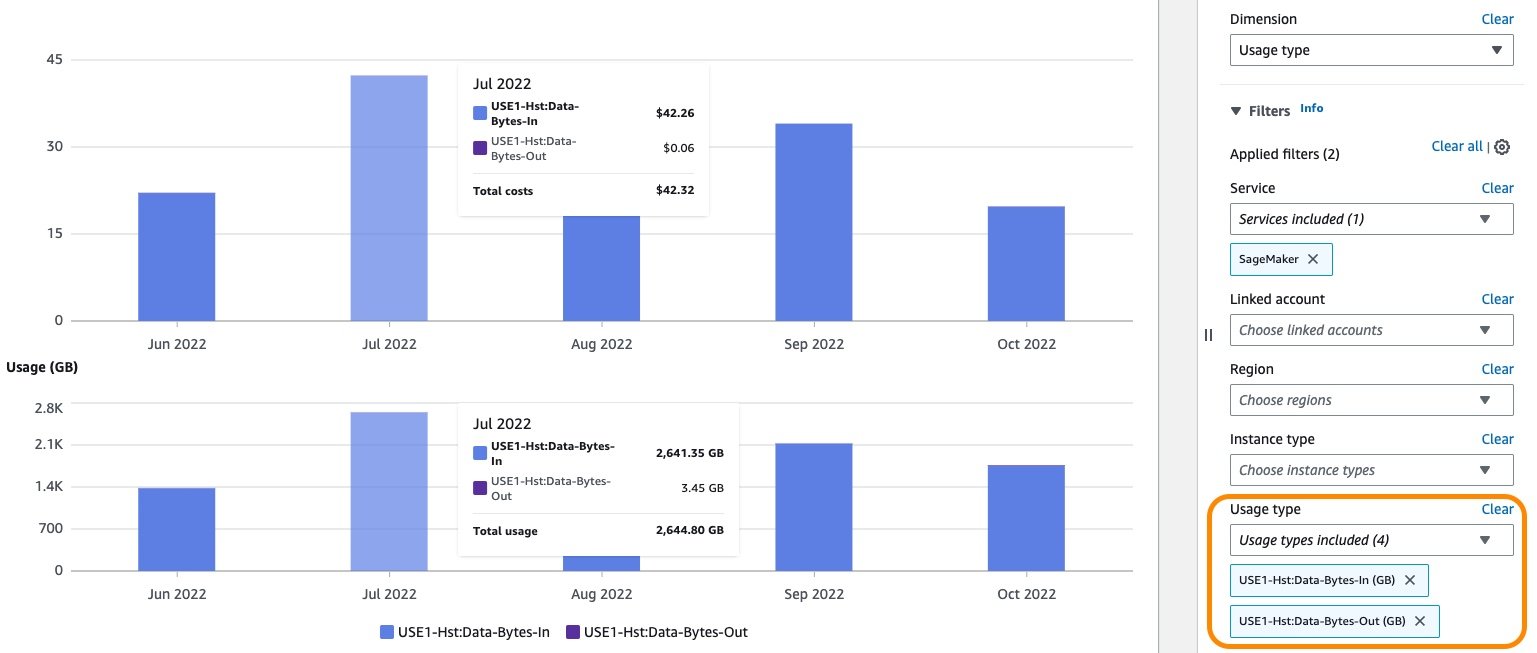

Ebenso können die Kosten für verarbeitete und verarbeitete GB-Daten angezeigt werden, indem die zugehörigen Nutzungstypen als angewendeter Filter ausgewählt werden, wie im folgenden Screenshot gezeigt.

Nachdem Sie mit Filtern und Gruppierungen Ihre gewünschten Ergebnisse erzielt haben, können Sie Ihre Ergebnisse entweder herunterladen, indem Sie wählen Als CSV-Datei herunterladen oder speichern Sie den Bericht, indem Sie wählen In Berichtsbibliothek speichern. Allgemeine Hinweise zur Verwendung von Cost Explorer finden Sie unter Das neue Erscheinungsbild und die häufigen Anwendungsfälle von AWS Cost Explorer.

Optional können Sie aktivieren AWS-Kosten- und Nutzungsberichte (AWS CUR), um Einblicke in die Kosten- und Nutzungsdaten Ihrer Konten zu erhalten. AWS CUR enthält stündliche AWS-Verbrauchsdetails. Es ist darin gespeichert Amazon Simple Storage-Service (Amazon S3) im Zahlerkonto, das die Daten aller verknüpften Konten konsolidiert. Sie können Abfragen ausführen, um Trends in Ihrer Nutzung zu analysieren und geeignete Maßnahmen zur Kostenoptimierung zu ergreifen. Amazonas Athena ist ein serverloser Abfragedienst, mit dem Sie die Daten von AWS CUR in Amazon S3 mithilfe von Standard-SQL analysieren können. Weitere Informationen und Beispielabfragen finden Sie im AWS CUR-Abfragebibliothek.

Sie können auch AWS CUR-Daten einspeisen Amazon QuickSight, wo Sie es für Berichts- oder Visualisierungszwecke beliebig in Stücke schneiden können. Anweisungen finden Sie unter Wie kann ich den AWS Cost and Usage Report (CUR) in Amazon QuickSight aufnehmen und visualisieren.

Sie können Informationen auf Ressourcenebene wie Endpunkt-ARN, Endpunkt-Instanztypen, stündliche Instanzrate, tägliche Nutzungsstunden und mehr von AWS CUR erhalten. Sie können Ihrer Abfrage auch Kostenzuordnungs-Tags hinzufügen, um eine zusätzliche Granularitätsebene zu erreichen. Die folgende Beispielabfrage gibt die Hosting-Ressourcennutzung in Echtzeit für die letzten drei Monate für das angegebene Zahlerkonto zurück:

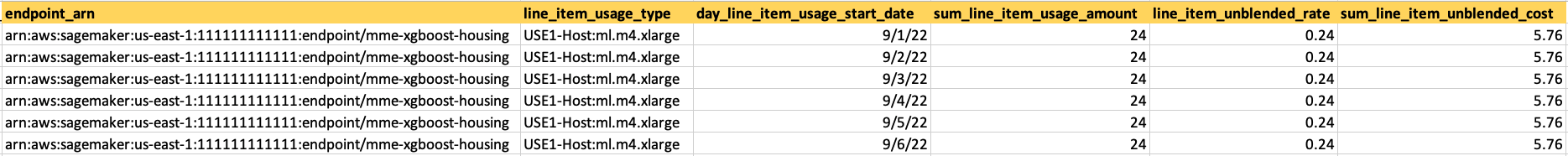

Der folgende Screenshot zeigt die Ergebnisse der Ausführung der Abfrage mit Athena. Weitere Informationen finden Sie unter Abfragen von Kosten- und Nutzungsberichten mit Amazon Athena.

Das Ergebnis der Abfrage zeigt diesen Endpunkt mme-xgboost-housing Mit ml.x4.xlarge meldet die Instanz eine Laufzeit von 24 Stunden an mehreren aufeinanderfolgenden Tagen. Der Instanzpreis beträgt 0.24 $/Stunde und die täglichen Kosten für eine 24-stündige Ausführung betragen 5.76 $.

Mithilfe der AWS CUR-Ergebnisse können Sie Muster von Endpunkten identifizieren, die an aufeinanderfolgenden Tagen in jedem der verknüpften Konten ausgeführt werden, sowie Endpunkte mit den höchsten monatlichen Kosten. Dies kann Ihnen auch bei der Entscheidung helfen, ob die Endpunkte in Nicht-Produktionskonten gelöscht werden können, um Kosten zu sparen.

Optimieren Sie die Kosten für Echtzeit-Endpunkte

Aus Sicht des Kostenmanagements ist es wichtig, nicht ausgelastete (oder übergroße) Instanzen zu identifizieren und die Instanzgröße und -anzahl bei Bedarf an die Arbeitslastanforderungen anzupassen. Es werden allgemeine Systemmetriken wie CPU-/GPU-Auslastung und Speicherauslastung geschrieben Amazon CloudWatch für alle Hosting-Instanzen. Für Echtzeitendpunkte stellt SageMaker mehrere zusätzliche Metriken in CloudWatch zur Verfügung. Zu den häufig überwachten Metriken gehören die Aufrufanzahl und Aufruffehler 4xx/5xx. Eine vollständige Liste der Metriken finden Sie unter Überwachen Sie Amazon SageMaker mit Amazon CloudWatch.

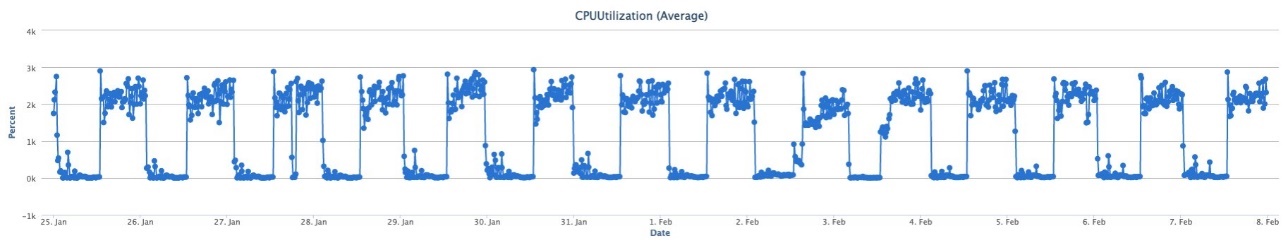

Die Metrik CPUUtilization Gibt die Summe der Auslastung jedes einzelnen CPU-Kerns an. Die CPU-Auslastung jedes Kernbereichs beträgt 0–100. Wenn beispielsweise vier CPUs vorhanden sind, ist die CPUUtilization Der Bereich liegt zwischen 0 und 400 %. Die Metrik MemoryUtilization ist der Prozentsatz des Speichers, der von den Containern einer Instanz verwendet wird. Dieser Wertebereich liegt zwischen 0 und 100 %. Der folgende Screenshot zeigt ein Beispiel für CloudWatch-Metriken CPUUtilization und MemoryUtilization für eine Endpunktinstanz ml.m4.10xlarge, die über 40 vCPUs und 160 GiB Speicher verfügt.

Diese Metrikdiagramme zeigen eine maximale CPU-Auslastung von etwa 3,000 %, was 30 vCPUs entspricht. Das bedeutet, dass dieser Endpunkt nicht mehr als 30 vCPUs der Gesamtkapazität von 40 vCPUs nutzt. Ebenso liegt die Speicherauslastung unter 6 %. Mithilfe dieser Informationen können Sie möglicherweise mit einer kleineren Instanz experimentieren, die diesem Ressourcenbedarf gerecht wird. Darüber hinaus ist die CPUUtilization Die Metrik zeigt ein klassisches Muster periodisch hoher und niedriger CPU-Anforderungen, was diesen Endpunkt zu einem guten Kandidaten für die automatische Skalierung macht. Sie können mit einer kleineren Instanz beginnen und zunächst skalieren, wenn sich Ihr Rechenbedarf ändert. Weitere Informationen finden Sie unter Amazon SageMaker-Modelle automatisch skalieren.

SageMaker eignet sich hervorragend zum Testen neuer Modelle, da Sie diese problemlos in einer A/B-Testumgebung bereitstellen können Produktionsvarianten, und Sie zahlen nur für das, was Sie nutzen. Jede Produktionsvariante wird auf einer eigenen Recheninstanz ausgeführt und Ihnen wird pro Instanzstunde berechnet, die für jede Instanz verbraucht wird, während die Variante ausgeführt wird.

SageMaker unterstützt auch Schattenvarianten, die über die gleichen Komponenten wie eine Produktionsvariante verfügen und auf einer eigenen Recheninstanz laufen. Bei Schattenvarianten stellt SageMaker das Modell automatisch in einer Testumgebung bereit, leitet eine Kopie der vom Produktionsmodell empfangenen Inferenzanforderungen in Echtzeit an das Testmodell weiter und erfasst Leistungsmetriken wie Latenz und Durchsatz. Auf diese Weise können Sie jede neue Kandidatenkomponente Ihres Modellbereitstellungsstapels validieren, bevor Sie sie in die Produktion überführen.

Wenn Sie mit Ihren Tests fertig sind und den Endpunkt oder die Varianten nicht mehr häufig verwenden, sollten Sie ihn löschen, um Kosten zu sparen. Da das Modell in Amazon S3 gespeichert ist, können Sie es bei Bedarf neu erstellen. Mithilfe von können Sie diese Endpunkte automatisch erkennen und Korrekturmaßnahmen ergreifen (z. B. sie löschen). Amazon CloudWatch-Ereignisse und AWS Lambda Funktionen. Sie können zum Beispiel die verwenden Invocations Metrik, um die Gesamtzahl der an einen Modellendpunkt gesendeten Anforderungen abzurufen und dann zu erkennen, ob die Endpunkte in der letzten Anzahl von Stunden im Leerlauf waren (ohne Aufrufe über einen bestimmten Zeitraum, z. B. 24 Stunden).

Wenn Sie über mehrere nicht ausgelastete Endpunktinstanzen verfügen, ziehen Sie Hosting-Optionen in Betracht, z Endpunkte mit mehreren Modellen (MMEs), Multi-Container-Endpunkte (MCEs) und serielle Inferenzpipelines um die Nutzung auf weniger Endpunktinstanzen zu konsolidieren.

Für die Echtzeit- und asynchrone Bereitstellung von Inferenzmodellen können Sie Kosten und Leistung optimieren, indem Sie Modelle auf SageMaker bereitstellen AWS Graviton. AWS Graviton ist eine von AWS entwickelte Prozessorfamilie, die das beste Preis-Leistungs-Verhältnis bietet und energieeffizienter ist als ihre x86-Pendants. Anleitungen zur Bereitstellung eines ML-Modells für AWS Graviton-basierte Instanzen und Einzelheiten zum Preis-Leistungs-Vorteil finden Sie unter Führen Sie Inferenz-Workloads für maschinelles Lernen auf AWS Graviton-basierten Instances mit Amazon SageMaker aus. SageMaker unterstützt auch AWS-Inferenz Beschleuniger durch die ml.inf2 Familie von Instanzen für die Bereitstellung von ML-Modellen für Echtzeit- und asynchrone Inferenz. Sie können diese Instanzen auf SageMaker verwenden, um eine hohe Leistung zu geringen Kosten für generative künstliche Intelligenz (KI)-Modelle zu erzielen, einschließlich großer Sprachmodelle (LLMs) und Vision Transformers.

Darüber hinaus können Sie verwenden Amazon SageMaker Inference Recommender um Auslastungstests durchzuführen und die Preis-Leistungs-Vorteile der Bereitstellung Ihres Modells auf diesen Instanzen zu bewerten. Weitere Anleitungen zur automatischen Erkennung inaktiver SageMaker-Endpunkte sowie zur richtigen Instanzgröße und automatischen Skalierung für SageMaker-Endpunkte finden Sie unter Sorgen Sie für effiziente Rechenressourcen auf Amazon SageMaker.

SageMaker-Batch-Transformation

Batch-Inferenz oder Offline-Inferenzist der Prozess der Generierung von Vorhersagen für eine Reihe von Beobachtungen. Offline-Vorhersagen eignen sich für größere Datensätze und in Fällen, in denen Sie es sich leisten können, mehrere Minuten oder Stunden auf eine Antwort zu warten.

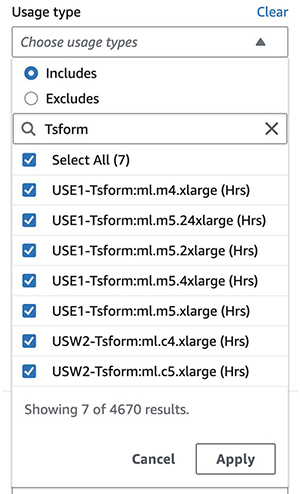

Die Kosten für die SageMaker-Batch-Transformation basieren auf der pro Instanz verbrauchten Stunde, die für jede Instanz während der Ausführung des Batch-Transformationsauftrags verbraucht wird, wie in beschrieben Amazon SageMaker Preise. Im Cost Explorer können Sie die Kosten für Batchtransformationen untersuchen, indem Sie einen Filter auf den Nutzungstyp anwenden. Der Name dieser Nutzungsart ist wie folgt aufgebaut REGION-Tsform:instanceType (zum Beispiel, USE1-Tsform:ml.c5.9xlarge).

Wie im folgenden Screenshot gezeigt, Filterung nach Nutzungstyp Tsform: zeigt eine Liste der SageMaker-Batch-Transformations-Nutzungstypen in einem Konto an.

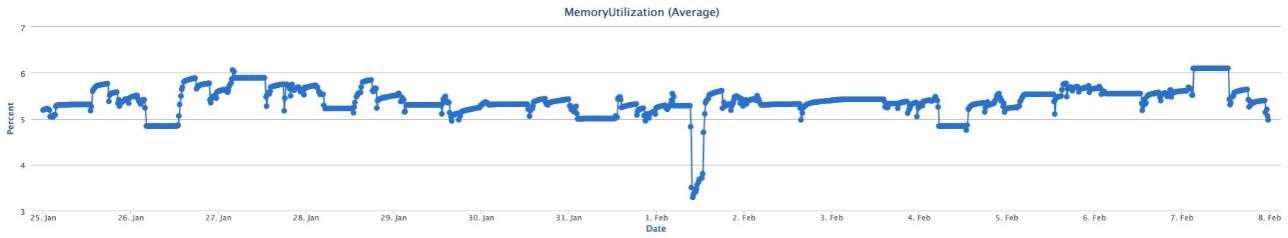

Sie können entweder bestimmte Nutzungsarten auswählen oder auswählen Alle auswählen und wählen Sie Bewerben , um die Kostenaufschlüsselung der Nutzung der Batch-Transformationsinstanzen für die ausgewählten Typen anzuzeigen. Wie bereits erwähnt, können Sie auch zusätzliche Filter anwenden. Der folgende Screenshot zeigt Kosten- und Nutzungsdiagramme für die ausgewählten Batch-Transformation-Nutzungstypen.

Optimieren Sie die Kosten für die Batch-Transformation

Die Batch-Transformation von SageMaker berechnet Ihnen nur die Instanzen, die während der Ausführung Ihrer Jobs verwendet werden. Wenn sich Ihre Daten bereits in Amazon S3 befinden, fallen für das Lesen von Eingabedaten aus Amazon S3 und das Schreiben von Ausgabedaten in Amazon S3 keine Kosten an. Es wird versucht, alle Ausgabeobjekte auf Amazon S3 hochzuladen. Wenn alle erfolgreich sind, wird der Batch-Transformationsauftrag als abgeschlossen markiert. Wenn ein oder mehrere Objekte fehlschlagen, wird der Batch-Transformationsauftrag als fehlgeschlagen markiert.

In den folgenden Szenarien fallen Gebühren für Batch-Transformationsaufträge an:

- Der Job ist erfolgreich

- Fehler aufgrund

ClientErrorund der Modellcontainer ist SageMaker oder ein von SageMaker verwaltetes Framework - Fehler aufgrund

AlgorithmErrororClientErrorund der Modellcontainer ist Ihr eigener benutzerdefinierter Container (BYOC)

Im Folgenden finden Sie einige der Best Practices zur Optimierung eines SageMaker-Batch-Transformationsauftrags. Diese Empfehlungen können die Gesamtlaufzeit Ihres Batch-Transformationsauftrags verkürzen und dadurch die Kosten senken:

- Sept BatchStrategie zu

MultiRecordundSplitTypezuLinewenn Sie den Batch-Transformationsjob benötigen, um Mini-Batches aus der Eingabedatei zu erstellen. Wenn das Dataset nicht automatisch in Mini-Batches aufgeteilt werden kann, können Sie es in Mini-Batches aufteilen, indem Sie jeden Batch in eine separate Eingabedatei einfügen, die im S3-Bucket der Datenquelle abgelegt wird. - Stellen Sie sicher, dass die Stapelgröße in den Speicher passt. SageMaker handhabt dies normalerweise automatisch; Beim manuellen Aufteilen von Stapeln muss dies jedoch basierend auf dem Speicher abgestimmt werden.

- Die Stapeltransformation partitioniert die S3-Objekte in der Eingabe nach Schlüssel und ordnet diese Objekte Instanzen zu. Wenn Sie mehrere Dateien haben, wird möglicherweise eine Instanz verarbeitet

input1.csv, und eine andere Instanz könnte verarbeiteninput2.csv. Wenn Sie über eine Eingabedatei verfügen, aber mehrere Recheninstanzen initialisieren, verarbeitet nur eine Instanz die Eingabedatei und die übrigen Instanzen sind im Leerlauf. Stellen Sie sicher, dass die Anzahl der Dateien gleich oder größer als die Anzahl der Instanzen ist. - Wenn Sie über eine große Anzahl kleiner Dateien verfügen, kann es von Vorteil sein, mehrere Dateien zu einer kleinen Anzahl größerer Dateien zusammenzufassen, um die Interaktionszeit mit Amazon S3 zu verkürzen.

- Wenn Sie das verwenden CreateTransformJob API können Sie die Zeit reduzieren, die zum Abschließen von Batch-Transformationsaufträgen benötigt wird, indem Sie optimale Werte für Parameter wie verwenden MaxPayloadInMB, MaxConcurrentTransforms, oder BatchStrategie:

MaxConcurrentTransformsgibt die maximale Anzahl paralleler Anforderungen an, die an jede Instanz in einem Transformationsauftrag gesendet werden können. Der ideale Wert fürMaxConcurrentTransformsentspricht der Anzahl der vCPU-Kerne in einer Instanz.MaxPayloadInMBist die maximal zulässige Größe der Nutzlast in MB. Der Wert inMaxPayloadInMBmuss größer oder gleich der Größe eines einzelnen Datensatzes sein. Um die Größe eines Datensatzes in MB abzuschätzen, teilen Sie die Größe Ihres Datensatzes durch die Anzahl der Datensätze. Um sicherzustellen, dass die Datensätze in die maximale Nutzlastgröße passen, empfehlen wir die Verwendung eines etwas größeren Werts. Der Standardwert ist 6 MB.MaxPayloadInMBdarf nicht größer als 100 MB sein. Wenn Sie das optionale angebenMaxConcurrentTransformsParameter, dann ist der Wert von (MaxConcurrentTransforms*MaxPayloadInMB) darf ebenfalls 100 MB nicht überschreiten.- In Fällen, in denen die Nutzlast beliebig groß sein kann und mithilfe der HTTP-Chunked-Codierung übertragen wird, legen Sie den Wert „MaxPayloadInMB“ auf 0 fest. Diese Funktion funktioniert nur in unterstützten Algorithmen. Derzeit unterstützen die in SageMaker integrierten Algorithmen keine HTTP-Chunked-Codierung.

- Batch-Inferenzaufgaben eignen sich normalerweise gut für die horizontale Skalierung. Jeder Worker innerhalb eines Clusters kann eine andere Teilmenge von Daten bearbeiten, ohne dass Informationen mit anderen Workern ausgetauscht werden müssen. AWS bietet mehrere Speicher- und Rechenoptionen, die eine horizontale Skalierung ermöglichen. Wenn eine einzelne Instanz nicht ausreicht, um Ihre Leistungsanforderungen zu erfüllen, sollten Sie erwägen, mehrere Instanzen parallel zu verwenden, um die Arbeitslast zu verteilen. Wichtige Überlegungen bei der Architektur von Stapeltransformationsaufträgen finden Sie unter Batch-Inferenz im großen Maßstab mit Amazon SageMaker.

- Überwachen Sie kontinuierlich die Leistungsmetriken Ihrer SageMaker-Batch-Transformationsaufträge mit CloudWatch. Suchen Sie nach Engpässen wie hoher CPU- oder GPU-Auslastung, Speichernutzung oder Netzwerkdurchsatz, um festzustellen, ob Sie Instanzgrößen oder -konfigurationen anpassen müssen.

- SageMaker verwendet Amazon S3 Multipart-Upload-API um Ergebnisse aus einem Batch-Transformationsauftrag in Amazon S3 hochzuladen. Wenn ein Fehler auftritt, werden die hochgeladenen Ergebnisse aus Amazon S3 entfernt. In manchen Fällen, beispielsweise bei einem Netzwerkausfall, kann ein unvollständiger mehrteiliger Upload in Amazon S3 verbleiben. Um Lagergebühren zu vermeiden, empfehlen wir Ihnen, die hinzuzufügen S3-Bucket-Richtlinie zu den S3-Bucket-Lebenszyklusregeln. Diese Richtlinie löscht unvollständige mehrteilige Uploads, die möglicherweise im S3-Bucket gespeichert sind. Weitere Informationen finden Sie unter Verwaltung Ihres Speicherlebenszyklus.

SageMaker asynchrone Inferenz

Asynchrone Inferenz ist eine gute Wahl für kostensensible Workloads mit großen Nutzlasten und Burst-Verkehr. Die Verarbeitung von Anfragen kann bis zu einer Stunde dauern und Nutzlastgrößen von bis zu 1 GB haben. Daher eignet sie sich besser für Arbeitslasten mit geringeren Latenzanforderungen.

Der Aufruf asynchroner Endpunkte unterscheidet sich vom Aufruf von Echtzeitendpunkten. Anstatt eine Anforderungsnutzlast synchron mit der Anforderung zu übergeben, laden Sie die Nutzlast auf Amazon S3 hoch und übergeben einen S3-URI als Teil der Anforderung. Intern verwaltet SageMaker eine Warteschlange mit diesen Anfragen und verarbeitet sie. Während der Endpunkterstellung können Sie optional einen angeben Amazon Simple Notification Service (Amazon SNS)-Thema, um Erfolgs- oder Fehlerbenachrichtigungen zu erhalten. Wenn Sie die Benachrichtigung erhalten, dass Ihre Inferenzanforderung erfolgreich verarbeitet wurde, können Sie am Ausgabeort von Amazon S3 auf das Ergebnis zugreifen.

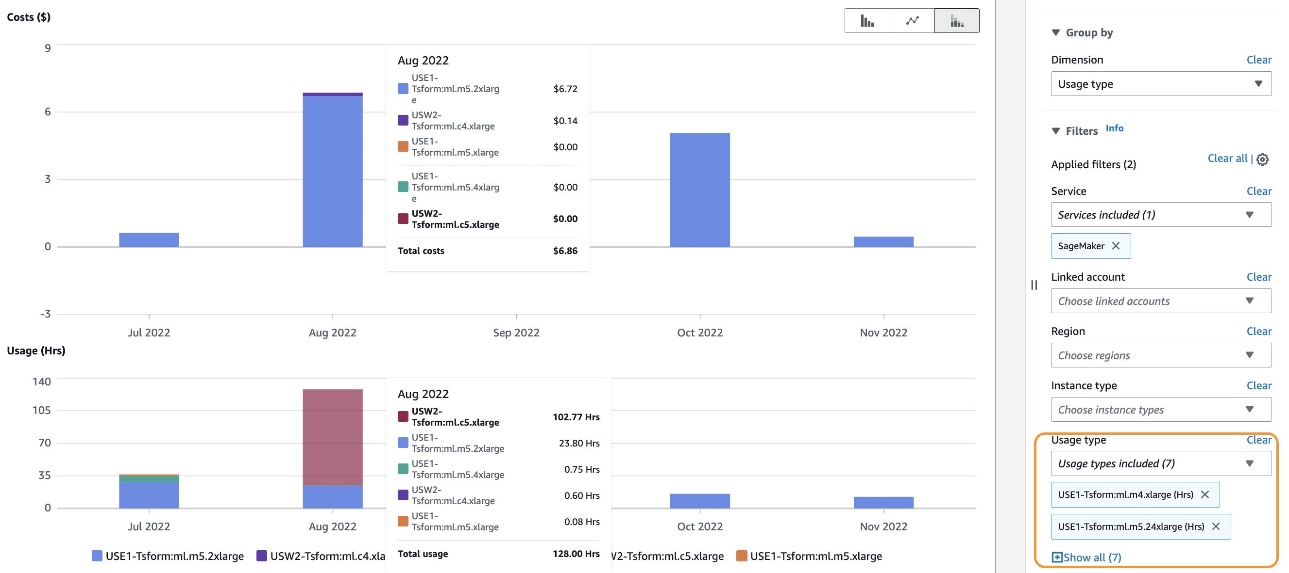

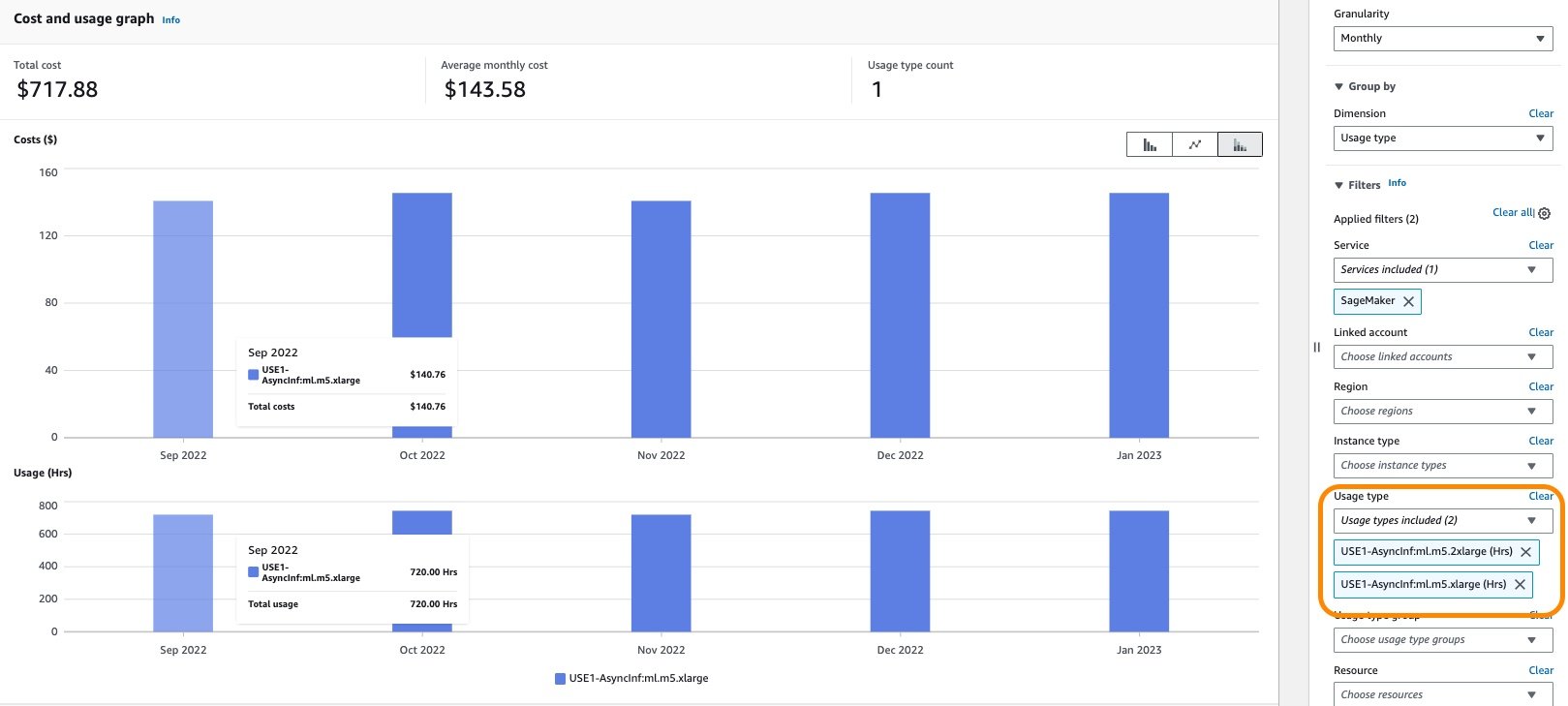

Die Kosten für asynchrone Inferenz basieren auf der verbrauchten Stunde pro Instanz, während der Endpunkt ausgeführt wird, den Kosten für den bereitgestellten Speicher in GB pro Monat sowie auf den Daten, die in GB in und aus der Endpunktinstanz verarbeitet werden, wie in beschrieben Amazon SageMaker Preise. Im Cost Explorer können Sie asynchrone Inferenzkosten filtern, indem Sie einen Filter auf den Nutzungstyp anwenden. Der Name dieser Nutzungsart ist wie folgt aufgebaut REGION-AsyncInf:instanceType (zum Beispiel, USE1-AsyncInf:ml.c5.9xlarge). Beachten Sie, dass die Nutzungsarten „GB-Volumen“ und „GB-Datenverarbeitung“ mit denen von Echtzeitendpunkten identisch sind, wie bereits in diesem Beitrag erwähnt.

Wie im folgenden Screenshot gezeigt, wird nach der Nutzungsart gefiltert AsyncInf: Im Cost Explorer wird eine Kostenaufschlüsselung nach asynchronen Endpunkt-Nutzungstypen angezeigt.

Um die Kosten- und Nutzungsaufschlüsselung nach Instanzstunden anzuzeigen, müssen Sie alle Optionen deaktivieren REGION-Host:VolumeUsage.gp2 Nutzungstypen, bevor Sie den Nutzungstypfilter anwenden. Sie können auch zusätzliche Filter anwenden. Informationen auf Ressourcenebene wie Endpunkt-ARN, Endpunkt-Instanztypen, stündliche Instanzrate und tägliche Nutzungsstunden können von AWS CUR abgerufen werden. Das Folgende ist ein Beispiel für eine AWS CUR-Abfrage, um die asynchrone Hosting-Ressourcennutzung für die letzten 3 Monate zu erhalten:

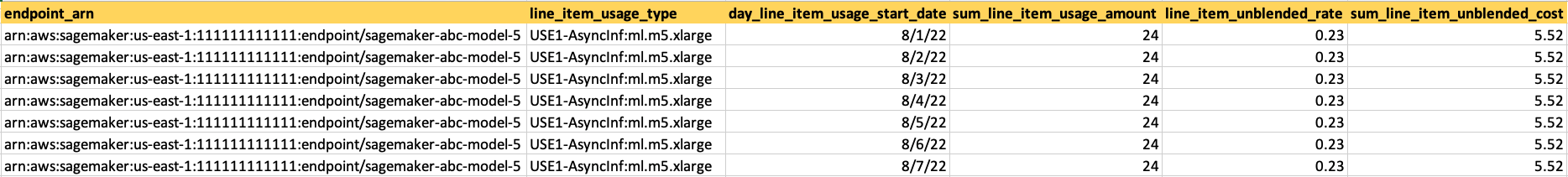

Der folgende Screenshot zeigt die Ergebnisse der Ausführung der AWS CUR-Abfrage mit Athena.

Das Ergebnis der Abfrage zeigt diesen Endpunkt sagemaker-abc-model-5 mit ml.m5.xlarge meldet die Instanz 24 Stunden Laufzeit an mehreren aufeinanderfolgenden Tagen. Der Instanzpreis beträgt 0.23 $/Stunde und die täglichen Kosten für eine 24-stündige Ausführung betragen 5.52 $.

Wie bereits erwähnt, können Sie mithilfe der AWS CUR-Ergebnisse Muster von Endpunkten identifizieren, die an aufeinanderfolgenden Tagen ausgeführt werden, sowie Endpunkte mit den höchsten monatlichen Kosten. Dies kann Ihnen auch bei der Entscheidung helfen, ob die Endpunkte in Nicht-Produktionskonten gelöscht werden können, um Kosten zu sparen.

Optimieren Sie die Kosten für asynchrone Inferenz

Genau wie bei den Echtzeit-Endpunkten basieren die Kosten für asynchrone Endpunkte auf der Nutzung des Instanztyps. Daher ist es wichtig, nicht ausgelastete Instanzen zu identifizieren und deren Größe entsprechend den Arbeitslastanforderungen anzupassen. Um asynchrone Endpunkte zu überwachen, macht SageMaker mehrere Metriken sowie ApproximateBacklogSize, HasBacklogWithoutCapacityund mehr in CloudWatch verfügbar. Diese Metriken können Anforderungen in der Warteschlange für eine Instanz anzeigen und zur automatischen Skalierung eines Endpunkts verwendet werden. Die asynchrone Inferenz von SageMaker umfasst auch Metriken auf Hostebene. Informationen zu Metriken auf Hostebene finden Sie unter SageMaker-Jobs und Endpunktmetriken. Diese Metriken können die Ressourcenauslastung anzeigen und Ihnen dabei helfen, die Instanz richtig zu dimensionieren.

SageMaker unterstützt automatische Skalierung für asynchrone Endpunkte. Im Gegensatz zu in Echtzeit gehosteten Endpunkten unterstützen asynchrone Inferenzendpunkte das Herunterskalieren von Instanzen auf Null, indem die Mindestkapazität auf Null gesetzt wird. Für asynchrone Endpunkte empfiehlt SageMaker dringend, dass Sie eine Richtlinienkonfiguration für die Zielverfolgungsskalierung für ein bereitgestelltes Modell (Variante) erstellen. Sie müssen die Skalierungsrichtlinie definieren, die für die Skalierung verwendet wird ApproximateBacklogPerInstance benutzerdefinierte Metrik und legen Sie die fest MinCapacity Wert auf Null.

Durch die asynchrone Inferenz können Sie Kosten sparen, indem die Instanzanzahl automatisch auf Null skaliert wird, wenn keine Anfragen verarbeitet werden müssen. Sie zahlen also nur, wenn Ihr Endpunkt Anfragen verarbeitet. Anforderungen, die empfangen werden, wenn keine Instanzen vorhanden sind, werden zur Verarbeitung in die Warteschlange gestellt, nachdem der Endpunkt hochskaliert wurde. Daher können Sie für Anwendungsfälle, die eine Kaltstartstrafe von einigen Minuten tolerieren können, optional die Anzahl der Endpunktinstanzen auf Null herunterskalieren, wenn keine ausstehenden Anfragen vorliegen, und wieder hochskalieren, wenn neue Anfragen eingehen. Die Kaltstartzeit hängt von der Zeit ab, die erforderlich ist, um einen neuen Endpunkt von Grund auf zu starten. Wenn das Modell selbst groß ist, kann die Zeit außerdem länger sein. Wenn Ihr Auftrag voraussichtlich länger als die Verarbeitungszeit von einer Stunde dauern wird, sollten Sie die SageMaker-Stapeltransformation in Betracht ziehen.

Darüber hinaus können Sie bei der Auswahl des Instanztyps auch die Wartezeit Ihrer Anfrage in Kombination mit der Bearbeitungszeit berücksichtigen. Wenn Ihr Anwendungsfall beispielsweise stundenlange Wartezeiten toleriert, können Sie eine kleinere Instanz wählen, um Kosten zu sparen.

Weitere Anleitungen zur richtigen Instanzgröße und automatischen Skalierung für SageMaker-Endpunkte finden Sie unter Sorgen Sie für effiziente Rechenressourcen auf Amazon SageMaker.

Serverlose Inferenz

Mit der serverlosen Inferenz können Sie ML-Modelle für die Inferenz bereitstellen, ohne die zugrunde liegende Infrastruktur konfigurieren oder verwalten zu müssen. Basierend auf der Menge an Inferenzanfragen, die Ihr Modell erhält, stellt die serverlose Inferenz von SageMaker automatisch Rechenkapazität bereit, skaliert sie und schaltet sie ab. Dadurch zahlen Sie nur für die Rechenzeit zum Ausführen Ihres Inferenzcodes und die verarbeitete Datenmenge, nicht für Leerlaufzeiten. Für serverlose Endpunkte ist keine Instanzbereitstellung erforderlich. Sie müssen die angeben Speichergröße und maximale Parallelität. Da serverlose Endpunkte Rechenressourcen nach Bedarf bereitstellen, kann es bei Ihrem Endpunkt beim ersten Aufruf nach einer Leerlaufzeit zu einigen zusätzlichen Sekunden Latenz (Kaltstart) kommen. Sie zahlen für die Rechenkapazität, die zur Verarbeitung von Inferenzanfragen verwendet wird. Die Abrechnung erfolgt pro Millisekunde, GB-Monat bereitgestelltem Speicher und der verarbeiteten Datenmenge. Die Rechengebühr hängt von der von Ihnen gewählten Speicherkonfiguration ab.

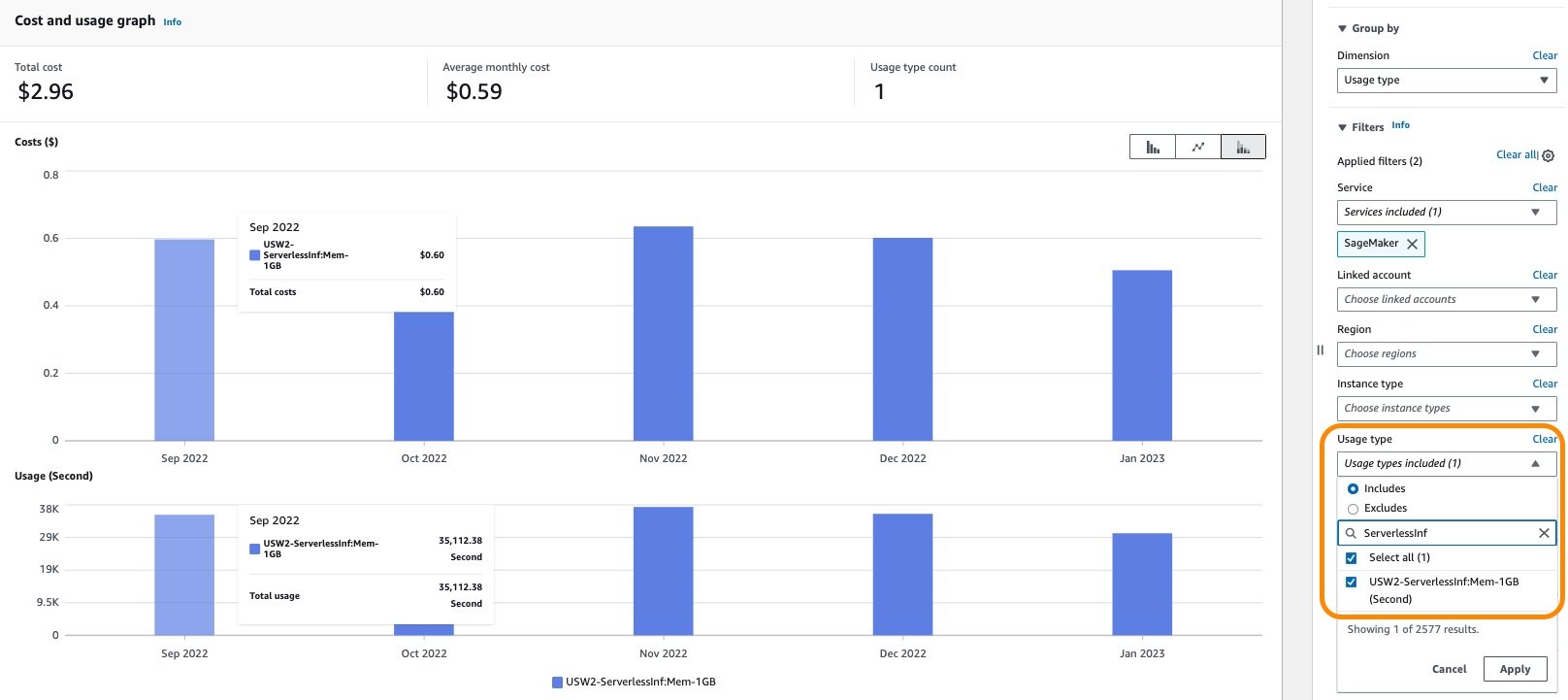

Im Cost Explorer können Sie die Kosten für serverlose Endpunkte filtern, indem Sie einen Filter auf den Nutzungstyp anwenden. Der Name dieser Nutzungsart ist wie folgt aufgebaut REGION-ServerlessInf:Mem-MemorySize (zum Beispiel, USE2-ServerlessInf:Mem-4GB). Beachten Sie, dass die Nutzungstypen „GB-Volumen“ und „GB-Datenverarbeitung“ mit denen von Echtzeitendpunkten identisch sind.

Sie können die Kostenaufschlüsselung anzeigen, indem Sie zusätzliche Filter wie Kontonummer, Instanztyp, Region usw. anwenden. Der folgende Screenshot zeigt die Kostenaufschlüsselung durch Anwenden von Filtern für den Nutzungstyp „Serverlose Inferenz“.

Optimieren Sie die Kosten für serverlose Inferenz

Bei der Konfiguration Ihres serverlosen Endpunkts können Sie die Speichergröße und die maximale Anzahl gleichzeitiger Aufrufe angeben. Die serverlose Inferenz von SageMaker weist Rechenressourcen automatisch proportional zum von Ihnen ausgewählten Speicher zu. Wenn Sie eine größere Speichergröße wählen, hat Ihr Container Zugriff auf mehr vCPUs. Bei serverloser Inferenz zahlen Sie nur für die Rechenkapazität, die zur Verarbeitung von Inferenzanfragen verwendet wird, die pro Millisekunde abgerechnet werden, und für die Menge der verarbeiteten Daten. Die Rechengebühr hängt von der von Ihnen gewählten Speicherkonfiguration ab. Die wählbaren Speichergrößen sind 1024 MB, 2048 MB, 3072 MB, 4096 MB, 5120 MB und 6144 MB. Die Preise steigen mit zunehmender Speichergröße, wie in erläutert Amazon SageMaker PreiseDaher ist es wichtig, die richtige Speichergröße auszuwählen. Als allgemeine Regel gilt, dass die Speichergröße mindestens so groß sein sollte wie die Größe Ihres Modells. Es empfiehlt sich jedoch, bei der Festlegung der Endpunktspeichergröße zusätzlich zur Modellgröße selbst auch die Speichernutzung zu berücksichtigen.

Allgemeine Best Practices zur Optimierung der SageMaker-Inferenzkosten

Die Optimierung der Hosting-Kosten ist kein einmaliges Ereignis. Dabei handelt es sich um einen kontinuierlichen Prozess zur Überwachung der bereitgestellten Infrastruktur, der Nutzungsmuster und der Leistung sowie um ein wachsames Auge auf neue innovative Lösungen, die AWS veröffentlicht und die sich auf die Kosten auswirken könnten. Berücksichtigen Sie die folgenden Best Practices:

- Wählen Sie einen geeigneten Instanztyp – SageMaker unterstützt mehrere Instanztypen mit jeweils unterschiedlichen Kombinationen aus CPU, GPU, Arbeitsspeicher und Speicherkapazitäten. Wählen Sie basierend auf den Ressourcenanforderungen Ihres Modells einen Instanztyp aus, der die erforderlichen Ressourcen ohne Überbereitstellung bereitstellt. Informationen zu den verfügbaren SageMaker-Instanztypen, ihren Spezifikationen und Anleitungen zur Auswahl der richtigen Instanz finden Sie unter Sorgen Sie für effiziente Rechenressourcen auf Amazon SageMaker.

- Testen Sie im lokalen Modus – Um Fehler zu erkennen und schneller zu debuggen, wird empfohlen, den Code und den Container (im Falle von BYOC) zu testen Lokalbetrieb bevor Sie den Inferenz-Workload auf der Remote-SageMaker-Instanz ausführen. Der lokale Modus ist eine großartige Möglichkeit, Ihre Skripte zu testen, bevor Sie sie in einer von SageMaker verwalteten Hosting-Umgebung ausführen.

- Optimieren Sie Modelle, um eine höhere Leistung zu erzielen – Nicht optimierte Modelle können zu längeren Laufzeiten führen und mehr Ressourcen verbrauchen. Sie können mehr oder größere Instanzen verwenden, um die Leistung zu verbessern. Dies führt jedoch zu höheren Kosten. Durch die Optimierung Ihrer Modelle für eine höhere Leistung können Sie möglicherweise die Kosten senken, indem Sie weniger oder kleinere Instanzen verwenden und gleichzeitig die gleichen oder bessere Leistungsmerkmale beibehalten. Sie können verwenden Amazon SageMaker Neo mit SageMaker-Inferenz zur automatischen Optimierung von Modellen. Weitere Einzelheiten und Beispiele finden Sie unter Optimieren Sie die Modellleistung mit Neo.

- Verwenden Sie Tags und Kostenmanagement-Tools – Um den Überblick über Ihre Inferenz-Workloads zu behalten, wird empfohlen, sowohl Tags als auch AWS-Kostenverwaltungstools wie z. B. zu verwenden AWS-Budgets, der AWS-Abrechnungskonsoleund die Prognosefunktion von Cost Explorer. Sie können SageMaker-Sparpläne auch als flexibles Preismodell erkunden. Weitere Informationen zu diesen Optionen finden Sie unter Teil 1 dieser Serie.

Zusammenfassung

In diesem Beitrag haben wir Anleitungen zur Kostenanalyse und Best Practices bei der Verwendung von SageMaker-Inferenzoptionen bereitgestellt. Da sich maschinelles Lernen branchenübergreifend als leistungsstarkes Werkzeug etabliert, müssen Schulung und Ausführung von ML-Modellen weiterhin kosteneffektiv bleiben. SageMaker bietet einen breiten und umfassenden Funktionsumfang zur Erleichterung jedes Schritts in der ML-Pipeline und bietet Möglichkeiten zur Kostenoptimierung, ohne die Leistung oder Agilität zu beeinträchtigen. Wenden Sie sich an Ihr AWS-Team, um eine Kostenberatung für Ihre SageMaker-Workloads zu erhalten.

Über die Autoren

Deepali Rajale ist Senior AI/ML-Spezialist bei AWS. Sie arbeitet mit Unternehmenskunden zusammen und bietet technische Beratung mit Best Practices für die Bereitstellung und Wartung von KI/ML-Lösungen im AWS-Ökosystem. Sie hat mit einer Vielzahl von Organisationen an verschiedenen Deep-Learning-Anwendungsfällen mit NLP und Computer Vision gearbeitet. Ihre Leidenschaft liegt darin, Unternehmen dabei zu unterstützen, generative KI zu nutzen, um ihr Nutzungserlebnis zu verbessern. In ihrer Freizeit genießt sie Filme, Musik und Literatur.

Deepali Rajale ist Senior AI/ML-Spezialist bei AWS. Sie arbeitet mit Unternehmenskunden zusammen und bietet technische Beratung mit Best Practices für die Bereitstellung und Wartung von KI/ML-Lösungen im AWS-Ökosystem. Sie hat mit einer Vielzahl von Organisationen an verschiedenen Deep-Learning-Anwendungsfällen mit NLP und Computer Vision gearbeitet. Ihre Leidenschaft liegt darin, Unternehmen dabei zu unterstützen, generative KI zu nutzen, um ihr Nutzungserlebnis zu verbessern. In ihrer Freizeit genießt sie Filme, Musik und Literatur.

Uri Rosenberg ist der AI & ML Specialist Technical Manager für Europa, den Nahen Osten und Afrika. Uri hat seinen Sitz in Israel und arbeitet daran, Unternehmenskunden in allen ML-Themen dabei zu unterstützen, in großem Maßstab zu entwerfen, zu bauen und zu betreiben. In seiner Freizeit fährt er gerne Rad, wandert und klettert gern.

Uri Rosenberg ist der AI & ML Specialist Technical Manager für Europa, den Nahen Osten und Afrika. Uri hat seinen Sitz in Israel und arbeitet daran, Unternehmenskunden in allen ML-Themen dabei zu unterstützen, in großem Maßstab zu entwerfen, zu bauen und zu betreiben. In seiner Freizeit fährt er gerne Rad, wandert und klettert gern.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoAiStream. Web3-Datenintelligenz. Wissen verstärkt. Hier zugreifen.

- Die Zukunft prägen mit Adryenn Ashley. Hier zugreifen.

- Kaufen und verkaufen Sie Anteile an PRE-IPO-Unternehmen mit PREIPO®. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/part-5-analyze-amazon-sagemaker-spend-and-determine-cost-optimization-opportunities-based-on-usage-part-5-hosting/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 000

- 1

- 100

- 2021

- 24

- 30

- 40

- 500

- 7

- 8

- a

- Fähig

- Über Uns

- Beschleuniger

- Zugang

- Konto

- Trading Konten

- Erreichen

- erreicht

- über

- Action

- Aktionen

- hinzufügen

- Zusatz

- Zusätzliche

- Afrika

- Nach der

- AI

- AI / ML

- Algorithmen

- Alle

- Zuteilung

- erlaubt

- bereits

- ebenfalls

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon Web Services

- Betrag

- an

- Analyse

- analysieren

- und

- Ein anderer

- jedem

- nicht mehr

- Bienen

- angewandt

- Bewerben

- Anwendung

- angemessen

- ca.

- SIND

- künstlich

- künstliche Intelligenz

- Künstliche Intelligenz (AI)

- AS

- damit verbundenen

- At

- anhängen

- Versuche

- Auto

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- vermeiden

- AWS

- Zurück

- basierend

- BE

- weil

- war

- Bevor

- unten

- vorteilhaft

- Nutzen

- Vorteile

- BESTE

- Best Practices

- Besser

- Big

- größer

- Rechnungs-

- Blockieren

- Breakdown

- bringen

- bauen

- eingebaut

- aber

- by

- CAN

- Kandidat

- Kandidaten

- Kapazitäten

- Kapazität

- Häuser

- Fälle

- sicher

- Änderungen

- Charakteristik

- berechnen

- berechnet

- Gebühren

- Wahl

- Auswählen

- Auswahl

- klassisch

- Klettern

- Cluster

- Code

- Kälte

- Kombinationen

- kombinieren

- kombiniert

- wie die

- kommt

- gemeinsam

- häufig

- abschließen

- Komponente

- Komponenten

- Berechnen

- Computer

- Computer Vision

- Wettbewerber

- Konfiguration

- aufeinanderfolgenden

- Geht davon

- Überlegungen

- konsolidieren

- Konsolidiert

- verbraucht

- Verbrauch

- Container

- Behälter

- enthält

- kontinuierlich

- Kernbereich

- und beseitigen Muskelschwäche

- Kosten

- Kostenmanagement

- kostengünstiger

- Kosten

- könnte

- erstellen

- Schaffung

- Zur Zeit

- Original

- Kunden

- Unterricht

- technische Daten

- Datensätze

- Tage

- entscheidet

- Entscheiden

- tief

- tiefe Lernen

- Standard

- Demand

- hängt

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- setzt ein

- Design

- entworfen

- erwünscht

- Detail

- Details

- Bestimmen

- anders

- diskutieren

- Display

- Displays

- verteilen

- do

- Tut nicht

- erledigt

- Nicht

- doppelt

- nach unten

- herunterladen

- zwei

- im

- jeder

- Früher

- leicht

- Osten

- Ökosystem

- effizient

- entweder

- ermächtigen

- Empowerment

- ermöglichen

- ermöglicht

- Endpunkt

- Energie

- zu steigern,

- gewährleisten

- Unternehmen

- Arbeitsumfeld

- Umgebungen

- gleich

- Äquivalent

- Fehler

- Fehler

- etabliert

- schätzen

- Europa

- bewerten

- Event

- Beispiel

- überschreiten

- Austausch-

- erwartet

- ERFAHRUNGEN

- Experiment

- erklärt

- ERKUNDEN

- Forscher

- ausführlich

- extra

- Auge

- erleichtern

- FAIL

- Gescheitert

- Familie

- beschleunigt

- Merkmal

- wenige

- Weniger

- Reichen Sie das

- Mappen

- Filter

- Filterung

- Filter

- Vorname

- passen

- flexibel

- Setzen Sie mit Achtsamkeit

- Folgende

- folgt

- Aussichten für

- gefunden

- vier

- für

- voller

- Funktionen

- Außerdem

- Gewinnen

- Allgemeines

- Erzeugung

- generativ

- Generative KI

- bekommen

- gegeben

- gut

- GPU

- Graphen

- groß

- mehr

- Gruppe an

- die Vermittlung von Kompetenzen,

- Griffe

- Haben

- mit

- he

- Hilfe

- dazu beigetragen,

- hier (auf dänisch)

- GUTE

- höher

- höchste

- seine

- Horizontale

- gehostet

- Hosting

- Hostingkosten

- Gastgeber

- Stunde

- STUNDEN

- Ultraschall

- Hilfe

- aber

- HTML

- http

- HTTPS

- hunderte

- i

- ideal

- identifizieren

- Leerlauf

- if

- Impact der HXNUMXO Observatorien

- Auswirkungen

- wichtig

- zu unterstützen,

- in

- das

- Dazu gehören

- Einschließlich

- Steigert

- zeigt

- Krankengymnastik

- Branchen

- Information

- Infrastruktur

- innovativ

- Varianten des Eingangssignals:

- Einblicke

- Instanz

- Anleitung

- Intelligenz

- Interaktion

- innen

- in

- Einleitung

- Beteiligung

- Israel

- IT

- SEINE

- selbst

- Job

- Jobs

- jpg

- Scharf

- Aufbewahrung

- Wesentliche

- Sprache

- grosse

- größer

- Nachname

- Latency

- starten

- ins Leben gerufen

- führen

- umwandeln

- gelernt

- lernen

- am wenigsten

- Programm

- Lessons Learned

- Niveau

- Hebelwirkung

- Lebenszyklus

- Gefällt mir

- Line

- verknüpft

- Liste

- Kataloge

- Belastung

- aus einer regionalen

- Standorte

- Lang

- länger

- aussehen

- Sneaker

- senken

- Senkung

- Maschine

- Maschinelles Lernen

- halten

- Aufrechterhaltung

- unterhält

- um

- MACHT

- verwalten

- verwaltet

- Management

- Management-Tools

- Manager

- manuell

- Landkarten

- markiert

- Spiel

- maximal

- Kann..

- Mittel

- Triff

- Memory

- erwähnt

- Metrisch

- Metrik

- Mitte

- Mittlerer Osten

- könnte

- Minimum

- Minuten

- ML

- Model

- Modell

- für

- Überwachen

- überwacht

- Überwachung

- Monat

- monatlich

- Monat

- mehr

- Filme

- Multi-Modell-Endpunkt

- mehrere

- Musik

- sollen

- Name

- Namen

- notwendig,

- Need

- erforderlich

- Bedürfnisse

- Netzwerk

- NETZWERKAUSFALL

- Neu

- Nlp

- nicht

- Benachrichtigung

- Benachrichtigungen

- Anzahl

- Objekte

- erhalten

- erhalten

- of

- WOW!

- Angebote

- Offline-Bereich.

- on

- EINEM

- Online

- einzige

- betreiben

- Entwicklungsmöglichkeiten

- optimal

- Optimierung

- Optimieren

- Optimierung

- Option

- Optionen

- or

- Auftrag

- Organisationen

- Andere

- Ausfall

- skizzierte

- Möglichkeiten für das Ausgangssignal:

- hervorragend

- übrig

- besitzen

- Parallel

- Parameter

- Parameter

- Teil

- passieren

- Bestehen

- leidenschaftlich

- passt

- Schnittmuster

- Muster

- AUFMERKSAMKEIT

- Prozentsatz

- Leistung

- Zeit

- periodisch

- Perspektive

- wählen

- Pipeline

- Plan

- Pläne

- Plato

- Datenintelligenz von Plato

- PlatoData

- Datenschutzrichtlinien

- gegebenenfalls

- Post

- BLOG-POSTS

- größte treibende

- Praxis

- Praktiken

- Prognosen

- Preis

- gebühr

- Preismodell

- Proaktives Handeln

- Prozessdefinierung

- Verarbeitet

- anpassen

- Verarbeitung

- Prozessoren

- Produktion

- Die Förderung der

- die

- vorausgesetzt

- bietet

- Bereitstellung

- Bereitstellung

- Zwecke

- Putting

- Abfragen

- Angebot

- Bewerten

- lieber

- erreichen

- Lesebrillen

- echt

- Echtzeit

- erhalten

- Received

- erhält

- empfehlen

- Empfehlungen

- empfohlen

- empfiehlt

- Rekord

- Aufzeichnungen

- Veteran

- Region

- Mitteilungen

- bleiben

- entfernt

- Entfernt

- berichten

- Reporting

- Meldungen

- Anforderung

- Zugriffe

- falls angefordert

- Voraussetzungen:

- Ressourcen

- Downloads

- Antwort

- REST

- Folge

- Die Ergebnisse

- Rückgabe

- Recht

- Rock

- Rollen

- Routen

- Regel

- Ohne eine erfahrene Medienplanung zur Festlegung von Regeln und Strategien beschleunigt der programmatische Medieneinkauf einfach die Rate der verschwenderischen Ausgaben.

- Führen Sie

- Laufen

- sagemaker

- SageMaker-Inferenz

- gleich

- Speichern

- Ersparnisse

- Skalieren

- Waage

- Skalierung

- Szenarien

- vorgesehen

- kratzen

- Skripte

- Sekunden

- Abschnitte

- sehen

- ausgewählt

- Auswahl

- Senior

- geschickt

- getrennte

- Modellreihe

- Serverlos

- Lösungen

- Dienst

- kompensieren

- Einstellung

- mehrere

- Shadow

- Teilen

- sie

- sollte

- erklären

- zeigte

- gezeigt

- Konzerte

- Ähnlich

- Einfacher

- da

- Single

- Größe

- Größen

- Slice

- klein

- kleinere

- So

- Lösungen

- einige

- Quelle

- Spezialist

- spezifisch

- Spezifikationen

- verbringen

- gespalten

- Stapel

- Standard

- Anfang

- begonnen

- Schritt

- Lagerung

- gelagert

- starker

- strukturierte

- Erfolg

- erfolgreich

- Erfolgreich

- so

- ausreichend

- geeignet

- Support

- proaktiv unterstützen

- Unterstützte

- Unterstützt

- System

- TAG

- Nehmen

- nimmt

- und Aufgaben

- Team

- Technische

- Test

- Testen

- Tests

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Dort.

- damit

- deswegen

- Diese

- fehlen uns die Worte.

- diejenigen

- Durch

- Durchsatz

- Zeit

- mal

- zu

- Werkzeug

- Werkzeuge

- Thema

- Gesamt

- der Verkehr

- Ausbildung

- Transformieren

- Transformer

- Trends

- was immer dies auch sein sollte.

- Drehungen

- tippe

- Typen

- zugrunde liegen,

- nicht wie

- unberechenbar

- hochgeladen

- Anwendungsbereich

- -

- Anwendungsfall

- benutzt

- verwendet

- Verwendung von

- gewöhnlich

- Verwendung

- BESTÄTIGEN

- Wert

- Werte

- Variante

- verschiedene

- Anzeigen

- Sichtbarkeit

- Seh-

- Visualisierung

- Volumen

- Volumen

- warten

- wollen

- Weg..

- we

- Netz

- Web-Services

- GUT

- Was

- wann

- ob

- welche

- während

- breit

- Große Auswahl

- werden wir

- mit

- .

- ohne

- gearbeitet

- Arbeiter

- Arbeiter

- Werk

- Schreiben

- geschrieben

- Du

- Ihr

- Zephyrnet

- Null