Technologietrends und Fortschritte bei digitalen Medien in den letzten zehn Jahren haben zu einer starken Verbreitung textbasierter Daten geführt. Die potenziellen Vorteile des Durchsuchens dieses Textes zum Ableiten von Erkenntnissen, sowohl taktischer als auch strategischer Art, sind enorm. Dies wird als Verarbeitung natürlicher Sprache (NLP) bezeichnet. Sie können NLP beispielsweise verwenden, um Ihre Produktbewertungen auf Kundenmeinungen zu analysieren, ein benutzerdefiniertes Entitätserkennungsmodell zu trainieren, um anhand von Kundenkommentaren interessante Produkttypen zu identifizieren, oder ein benutzerdefiniertes Textklassifizierungsmodell trainieren, um die beliebtesten Produktkategorien zu ermitteln.

Amazon verstehen ist ein NLP-Dienst mit vorgefertigter Intelligenz, um Einblicke in den Inhalt von Dokumenten zu gewinnen. Es entwickelt Erkenntnisse, indem es die Entitäten, Schlüsselphrasen, Sprache, Stimmungen und andere gemeinsame Elemente in einem Dokument erkennt. Amazon Comprehend Custom verwendet automatisches maschinelles Lernen (Auto ML), um NLP-Modelle in Ihrem Namen unter Verwendung Ihrer eigenen Daten zu erstellen. Auf diese Weise können Sie für Ihr Unternehmen eindeutige Entitäten erkennen oder Texte oder Dokumente gemäß Ihren Anforderungen klassifizieren. Darüber hinaus können Sie Ihren gesamten NLP-Workflow mit benutzerfreundlichen APIs automatisieren.

Wir freuen uns, heute die Einführung der Kopierfunktion für benutzerdefinierte Amazon Comprehend-Modelle ankündigen zu können, mit der Sie Ihre benutzerdefinierten Amazon Comprehend-Modelle automatisch von einem Quellkonto auf bestimmte Zielkonten in derselben Region kopieren können, ohne dass Sie Zugriff auf die Datensätze des Modells benötigen trainiert und bewertet wurde. Ab heute können Sie die verwenden AWS-Managementkonsole, AWS-Befehlszeilenschnittstelle (AWS CLI) oder die boto3-APIs (Python SDK for AWS), um trainierte benutzerdefinierte Modelle von einem Quellkonto in ein bestimmtes Zielkonto zu kopieren. Diese neue Funktion ist sowohl für benutzerdefinierte Klassifizierungs- als auch für benutzerdefinierte Entitätserkennungsmodelle von Amazon Comprehend verfügbar.

Vorteile der Modellkopierfunktion

Diese neue Funktion hat folgende Vorteile:

- Multi-Account-MLOps-Strategie – Trainieren Sie ein Modell einmal und stellen Sie eine vorhersagbare Bereitstellung in mehreren Umgebungen in verschiedenen Konten sicher.

- Schnellere Bereitstellung – Sie können ein trainiertes Modell schnell zwischen Konten kopieren und so die Zeit sparen, die für das erneute Trainieren in jedem Konto aufgewendet werden muss.

- Schützen Sie sensible Datensätze – Jetzt müssen Sie die Datensätze nicht mehr zwischen verschiedenen Konten oder Benutzern teilen. Die Trainingsdaten müssen nur auf dem Konto verfügbar sein, auf dem das Training durchgeführt wird. Dies ist sehr wichtig für bestimmte Branchen wie Finanzdienstleistungen, in denen Datenisolierung und Sandboxing unerlässlich sind, um regulatorische Anforderungen zu erfüllen.

- Einfache Zusammenarbeit – Partner oder Anbieter können jetzt ganz einfach in Amazon Comprehend Custom trainieren und die Modelle mit ihren Kunden teilen.

So funktioniert die Modellkopie

Mit der neuen Funktion zum Kopieren von Modellen können Sie benutzerdefinierte Modelle in einem zweistufigen Prozess zwischen AWS-Konten in derselben Region kopieren. Zunächst teilt ein Benutzer in einem AWS-Konto (Konto A) ein benutzerdefiniertes Modell, das sich in seinem Konto befindet. Dann importiert ein Benutzer in einem anderen AWS-Konto (Konto B) das Modell in sein Konto.

Teilen Sie ein Modell

Um ein benutzerdefiniertes Modell in Konto A freizugeben, hängt der Benutzer eine an AWS Identity and Access Management and (IAM) ressourcenbasierte Richtlinie in eine Modellversion. Diese Richtlinie autorisiert eine Entität in Konto B, z. B. einen IAM-Benutzer oder eine IAM-Rolle, die Modellversion in Amazon Comprehend in ihrem AWS-Konto zu importieren. Sie können eine ressourcenbasierte Richtlinie entweder über die Konsole oder mit dem benutzerdefinierten Amazon Comprehend konfigurieren PutResourcePolicy API.

Importieren Sie ein Modell

Um das Modell in Konto B zu importieren, stellt der Benutzer dieses Kontos Amazon Comprehend die erforderlichen Details bereit, wie z. B. den Amazon-Ressourcennamen (ARN) des Modells. Beim Importieren des Modells erstellt dieser Benutzer ein neues benutzerdefiniertes Modell in seinem AWS-Konto, das das importierte Modell repliziert. Dieses Modell ist vollständig trainiert und bereit für Inferenzaufträge, wie z. B. die Dokumentenklassifizierung oder die Erkennung benannter Entitäten. Wenn das Modell mit einer verschlüsselt ist AWS-Schlüsselverwaltungsservice (AWS KMS)-Schlüssel in der Quelle, dann muss die beim Importieren des Modells angegebene Servicerolle Zugriff auf den KMS-Schlüssel haben, um das Modell während des Imports zu entschlüsseln. Das Zielkonto kann auch einen KMS-Schlüssel angeben, um das Modell während des Imports zu verschlüsseln. Der Import des freigegebenen Modells ist ebenfalls sowohl auf der Konsole als auch als API verfügbar.

Lösungsüberblick

Um die Funktionalität der Modellkopierfunktion zu demonstrieren, zeigen wir Ihnen, wie Sie ein benutzerdefiniertes Entitätserkennungsmodell von Amazon Comprehend mit der Amazon Comprehend-Konsole und der AWS CLI trainieren, freigeben und importieren. Für diese Demonstration verwenden wir zwei verschiedene Konten. Die Schritte gelten auch für die benutzerdefinierte Amazon Comprehend-Klassifizierung. Die erforderlichen Schritte sind wie folgt:

- Trainieren Sie ein benutzerdefiniertes Entitätserkennungsmodell von Amazon Comprehend im Quellkonto.

- Definieren Sie die IAM-Ressourcenrichtlinie für das trainierte Modell, um den kontoübergreifenden Zugriff zu ermöglichen.

- Kopieren Sie das trainierte Modell aus dem Quellkonto in das Zielkonto.

- Testen Sie das kopierte Modell durch einen Batch-Job.

Trainieren Sie ein benutzerdefiniertes Entitätserkennungsmodell von Amazon Comprehend im Quellkonto

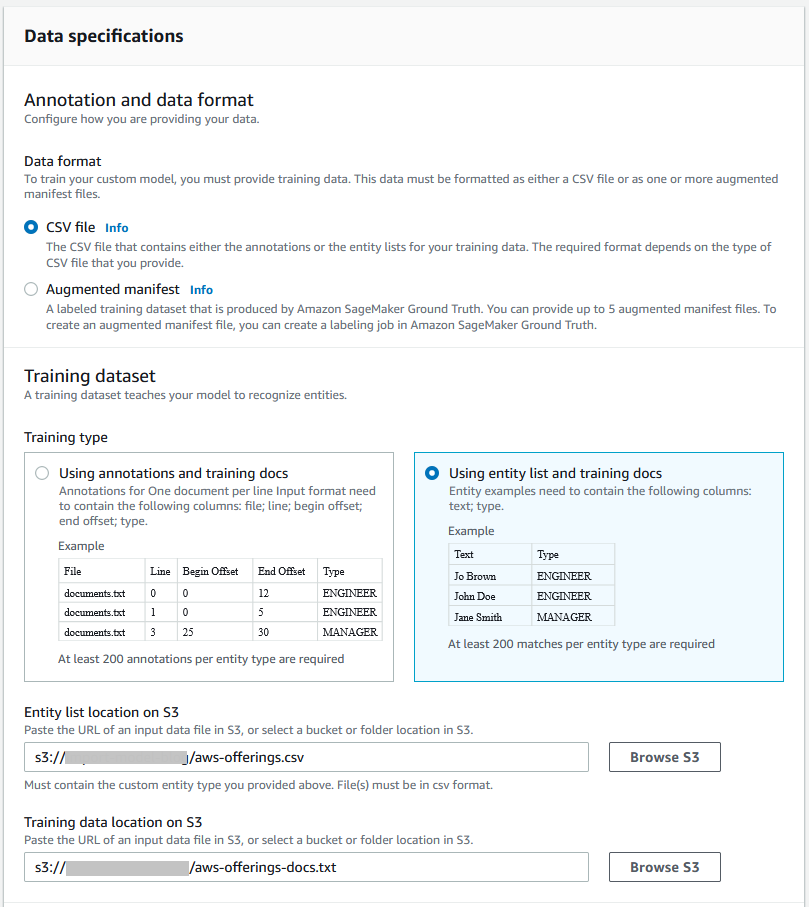

Der erste Schritt besteht darin, ein benutzerdefiniertes Entitätserkennungsmodell von Amazon Comprehend im Quellkonto zu trainieren. Als Eingabedatensatz für das Training verwenden wir eine CSV Entitätsliste und Schulungsunterlagen zum Erkennen von AWS-Serviceangeboten in einem bestimmten Dokument. Stellen Sie sicher, dass sich die Entitätsliste und die Schulungsunterlagen in einer Amazon Simple Storage-Service (Amazon S3)-Bucket im Quellkonto. Anweisungen finden Sie unter Hinzufügen von Dokumenten zu Amazon S3.

Erstellen Sie eine IAM-Rolle für Amazon Comprehend und stellen Sie den erforderlichen Zugriff auf den S3-Bucket mit den Trainingsdaten bereit. Beachten Sie die Rollen-ARN- und S3-Bucket-Pfade, die in späteren Schritten verwendet werden sollen.

Trainieren Sie ein Modell mit der AWS CLI

Erstellen Sie mit dem folgenden AWS CLI-Befehl eine Entitätserkennung. Ersetzen Sie Ihre Parameter für die S3-Pfade, die IAM-Rolle und die Region. Die Antwort gibt die zurück EntityRecognizerArn.

Der Status des Trainingsjobs kann überwacht werden, indem man den describe-entity-recognizer aufruft und den Status in der Antwort überprüft.

Trainieren Sie ein Modell über die Konsole

Führen Sie die folgenden Schritte aus, um ein Modell über die Konsole zu trainieren:

- Auf der Amazon Comprehend-Konsole unter Anpassung, erstellen Sie ein neues benutzerdefiniertes Entitätserkennungsmodell.

- Geben Sie einen Modellnamen und eine Version an.

- Aussichten für Sprache, wählen Englisch.

- Aussichten für Benutzerdefinierter Entitätstyp, Fügen

AWS_OFFERING.

Um ein benutzerdefiniertes Entitätserkennungsmodell zu trainieren, können Sie eine von zwei Möglichkeiten wählen, um Daten an Amazon Comprehend bereitzustellen: Anmerkungen or Entitätslisten. Verwenden Sie der Einfachheit halber die Entitätslistenmethode.

- Aussichten für Datei FormatWählen CSV-Datei.

- Aussichten für TrainingsartWählen Verwenden von Entitätslisten und Schulungsdokumenten.

- Geben Sie die S3-Standortpfade für die CSV- und Trainingsdaten der Entitätsliste an.

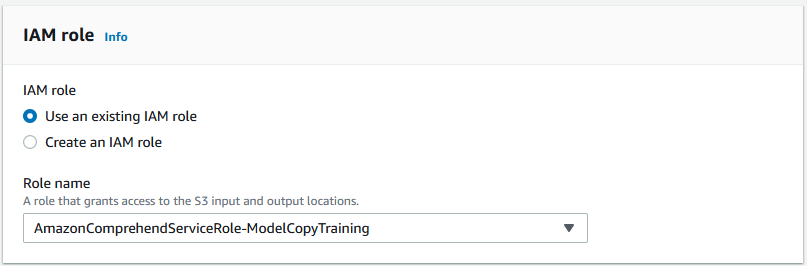

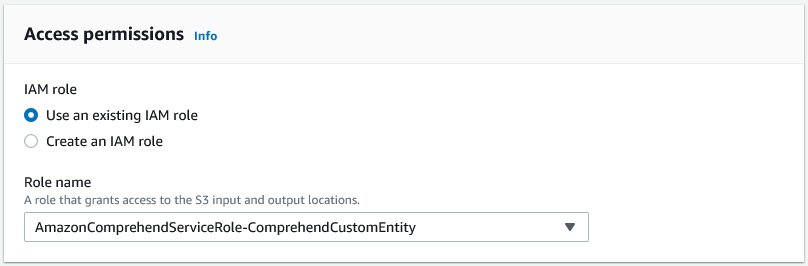

- Um Amazon Comprehend Berechtigungen für den Zugriff auf Ihren S3-Bucket zu erteilen, erstellen Sie eine serviceverknüpfte IAM-Rolle.

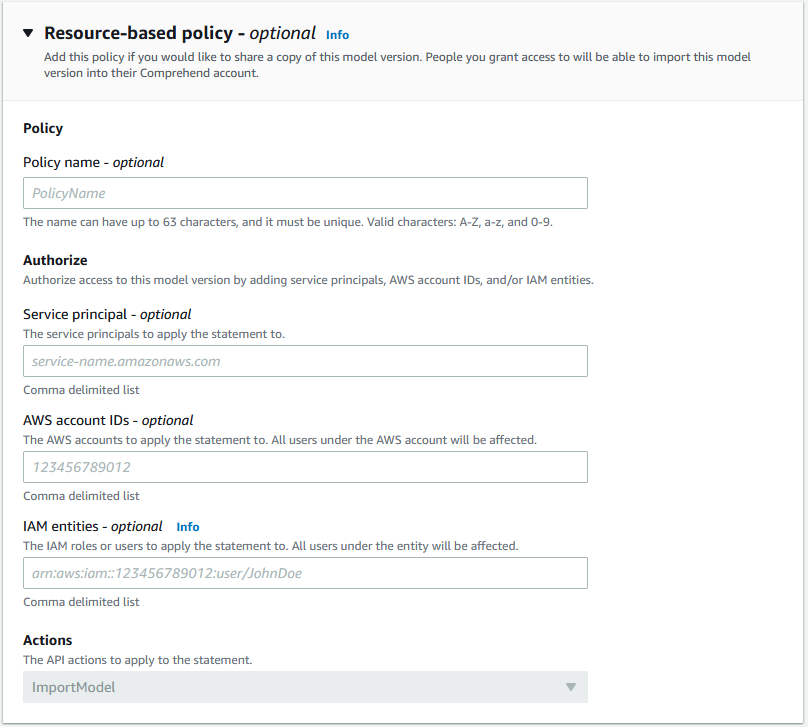

Im Ressourcenbasierte Politik Abschnitt können Sie den Zugriff für die Modellversion autorisieren. Die Konten, denen Sie Zugriff gewähren, können dieses Modell in ihr Konto importieren. Wir überspringen diesen Schritt vorerst und fügen die Richtlinie hinzu, nachdem das Modell trainiert wurde und wir mit der Modellleistung zufrieden sind.

- Auswählen Erstellen.

Dadurch wird Ihre benutzerdefinierte Entitätserkennung übermittelt, die eine Reihe von Modellen durchläuft, Ihre Hyperparameter optimiert und auf Kreuzvalidierung prüft, um sicherzustellen, dass Ihr Modell robust ist. Dies sind alles die gleichen Aktivitäten, die Data Scientists ausführen.

Definieren Sie die IAM-Ressourcenrichtlinie für das trainierte Modell, um den kontoübergreifenden Zugriff zu ermöglichen

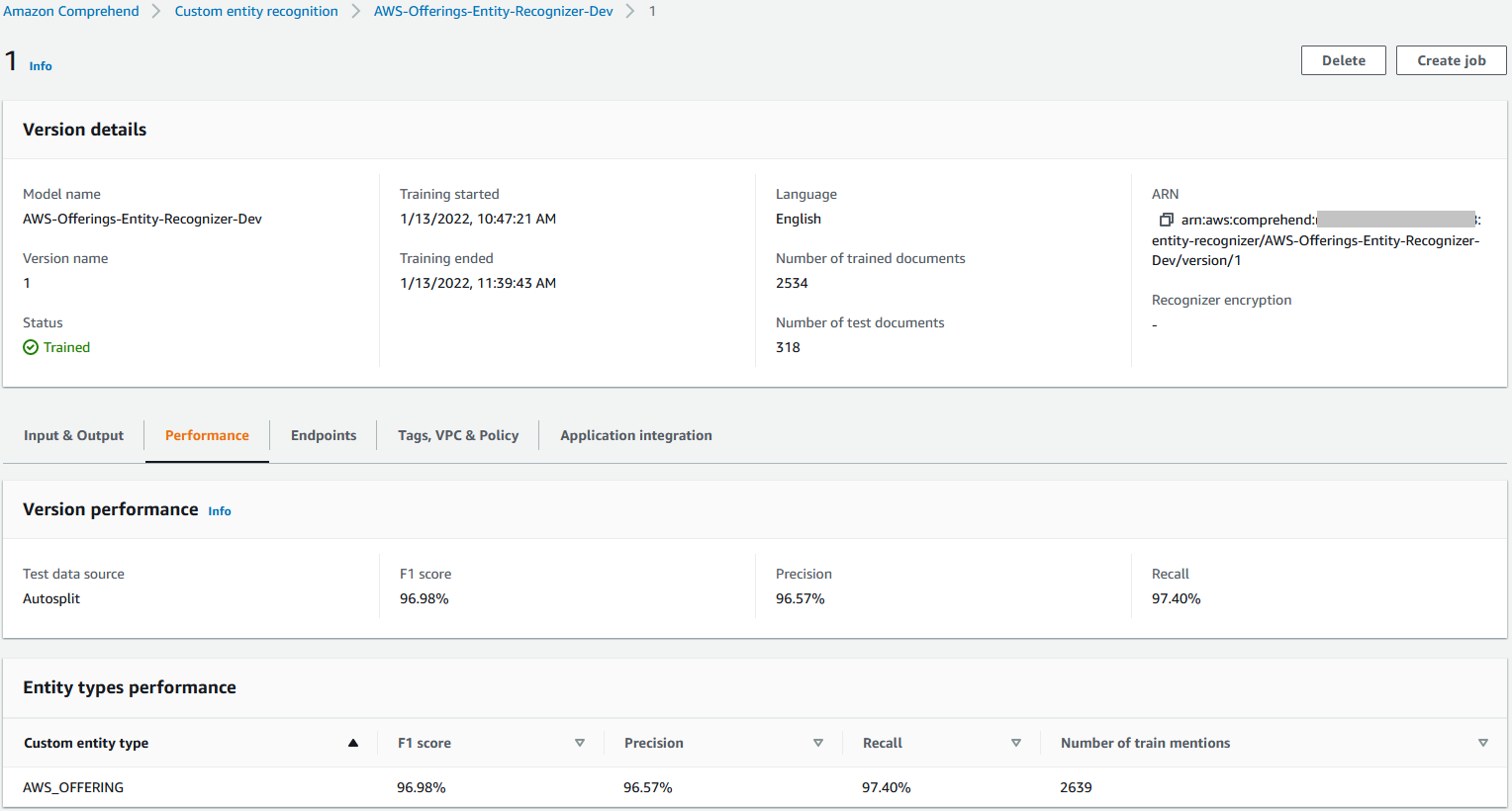

Wenn wir mit der Trainingsleistung zufrieden sind, können wir fortfahren und die spezifische Modellversion freigeben, indem wir eine Ressourcenrichtlinie hinzufügen.

Fügen Sie eine ressourcenbasierte Richtlinie aus der AWS CLI hinzu

Autorisieren Sie den Import des Modells aus dem Zielkonto, indem Sie dem Modell eine Ressourcenrichtlinie hinzufügen, wie im folgenden Code gezeigt. Die Richtlinie kann eng auf eine bestimmte Modellversion und einen bestimmten Zielprinzipal beschränkt werden. Ersetzen Sie Ihren trainierten Entitätserkennungs-ARN und Ihr Zielkonto, um Zugriff zu gewähren.

Fügen Sie über die Konsole eine ressourcenbasierte Richtlinie hinzu

Wenn das Training abgeschlossen ist, wird eine benutzerdefinierte Entitätserkennungsmodellversion generiert. Wir können das trainierte Modell und die Version auswählen, um die Trainingsdetails anzuzeigen, einschließlich der Leistung des trainierten Modells.

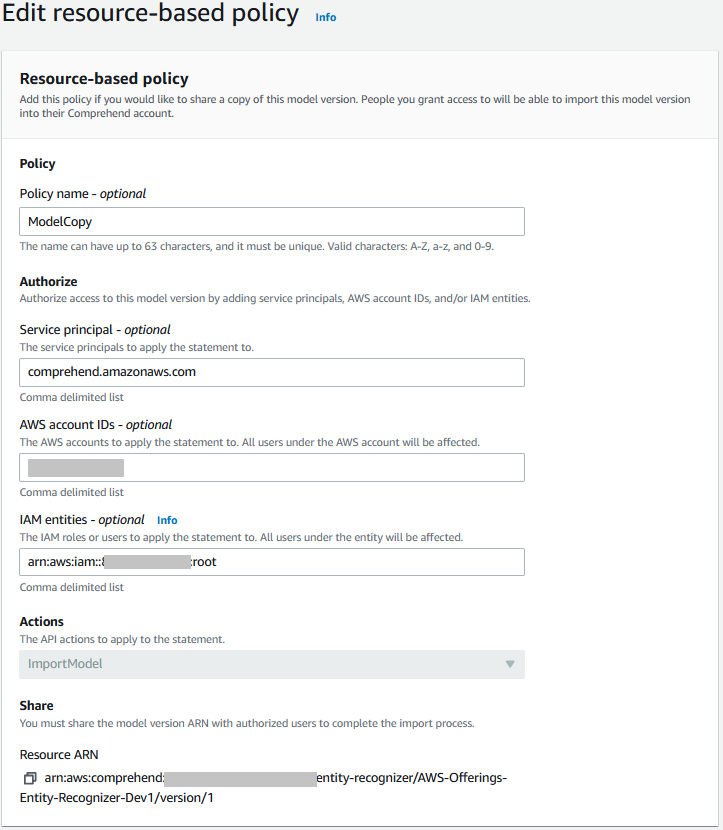

Führen Sie die folgenden Schritte aus, um die Richtlinie zu aktualisieren:

- Auf dem Tags, VPC und Richtlinien Bearbeiten Sie auf der Registerkarte "Ressourcenbasierte Richtlinie".

- Geben Sie den Richtliniennamen, den Amazon Comprehend-Serviceprinzipal (

comprehend.amazonaws.com), Zielkonto-ID und IAM-Benutzer im Zielkonto, die zum Importieren der Modellversion berechtigt sind.

Wir spezifizieren root als IAM-Entität, um alle Benutzer im Zielkonto zu autorisieren.

Kopieren Sie das trainierte Modell aus dem Quellkonto in das Zielkonto

Jetzt wird das Modell trainiert und vom Quellkonto freigegeben. Der autorisierte Benutzer des Zielkontos kann das Modell importieren und eine Kopie des Modells in seinem eigenen Konto erstellen.

Um ein Modell zu importieren, müssen Sie den Quellmodell-ARN und die Servicerolle für Amazon Comprehend angeben, um die Kopieraktion für Ihr Konto auszuführen. Sie können eine optionale AWS KMS-ID angeben, um das Modell in Ihrem Zielkonto zu verschlüsseln.

Importieren Sie das Modell über AWS CLI

Um Ihr Modell mit der AWS CLI zu importieren, geben Sie den folgenden Code ein:

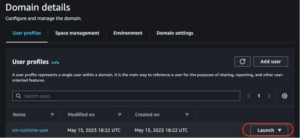

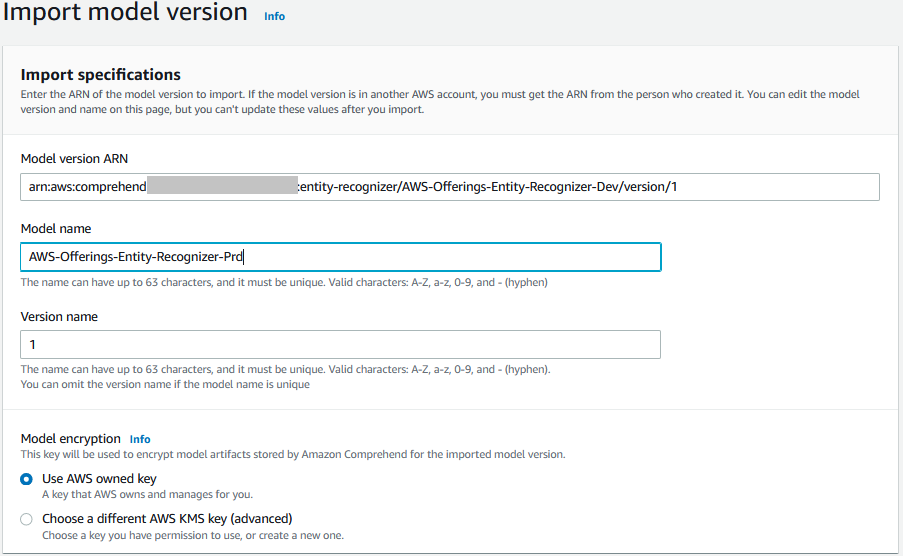

Importieren Sie das Modell über die Konsole

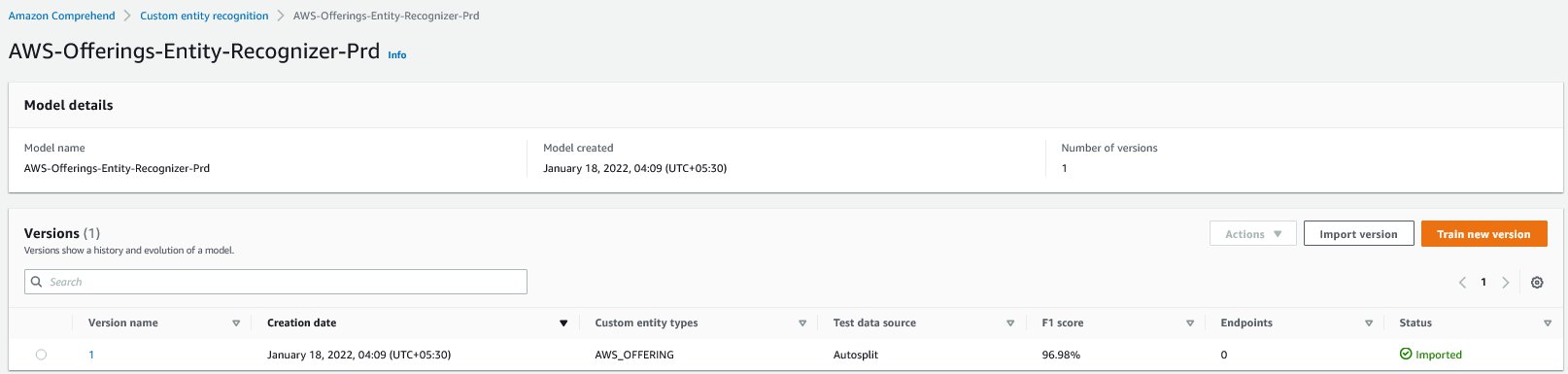

Führen Sie die folgenden Schritte aus, um das Modell über die Konsole zu importieren:

- Auf der Amazon Comprehend-Konsole unter Benutzerdefinierte Entitätserkennung, wählen Version importieren.

- Aussichten für Modellversion ARN, geben Sie den ARN für das im Quellkonto trainierte Modell ein.

- Geben Sie einen Modellnamen und eine Version für das Ziel ein.

- Geben Sie eine Dienstkontorolle an und wählen Sie aus Schichtannahme um den Modellimportvorgang zu starten.

Nachdem sich der Modellstatus in geändert hat Imported, können wir die Modelldetails anzeigen, einschließlich der Leistungsdetails des trainierten Modells.

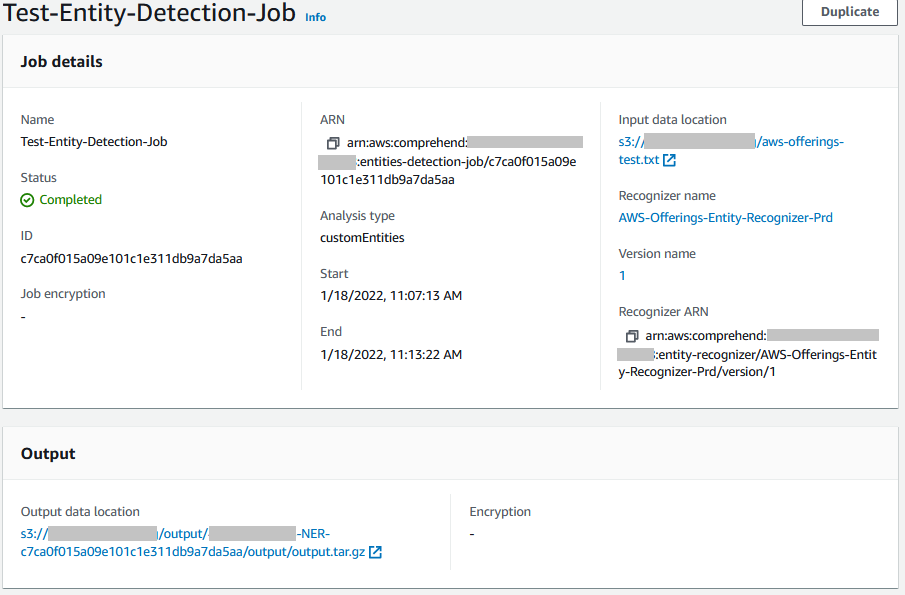

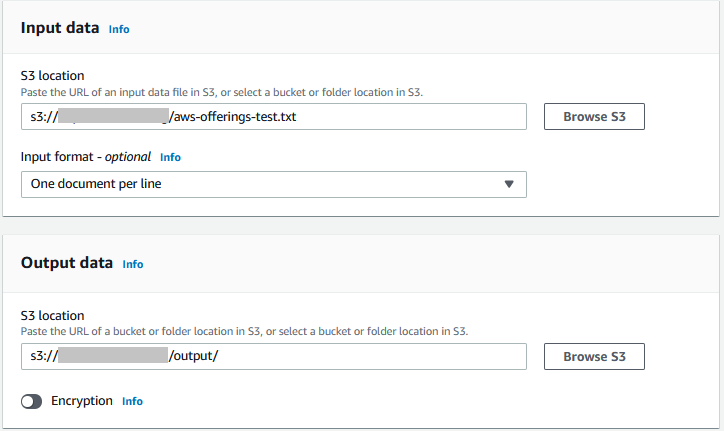

Testen Sie das kopierte Modell durch einen Batch-Job

Wir testen das kopierte Modell im Zielkonto, indem wir benutzerdefinierte Entitäten mit einem Batch-Job erkennen. Um das Modell zu testen, laden Sie die Testdatei und platzieren Sie es in einem S3-Bucket in Ihrem Zielkonto. Erstellen Sie eine IAM-Rolle für Amazon Comprehend und stellen Sie den erforderlichen Zugriff auf den S3-Bucket mit den Testdaten bereit. Sie verwenden die zuvor notierten Rollen-ARN- und S3-Bucket-Pfade.

Wenn der Job abgeschlossen ist, können Sie die Inferenzdaten im angegebenen S3-Ausgabe-Bucket überprüfen.

Testen Sie das Modell mit der AWS CLI

Um das Modell mit der AWS CLI zu testen, geben Sie den folgenden Code ein:

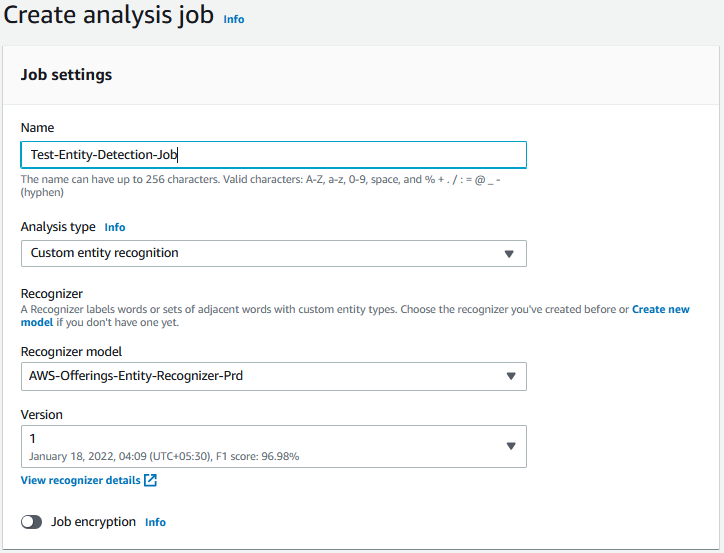

Testen Sie das Modell über die Konsole

Führen Sie die folgenden Schritte aus, um das Modell über die Konsole zu testen:

- Wählen Sie in der Amazon Comprehend-Konsole aus Analysejobs und wählen Sie Job erstellen.

- Aussichten für Name und Vorname, geben Sie einen Namen für den Job ein.

- Aussichten für Analysetypwählen Benutzerdefinierte Entitätserkennung.

- Wählen Sie den Modellnamen und die Version des importierten Modells aus.

- Geben Sie die S3-Pfade für die Testdatei für den Job und den Ausgabespeicherort an, an dem Amazon Comprehend das Ergebnis speichert.

- Wählen oder erstellen Sie eine IAM-Rolle mit der Berechtigung zum Zugriff auf die S3-Buckets.

- Auswählen Job erstellen.

Wenn Ihr Analysejob abgeschlossen ist, haben Sie JSON-Dateien in Ihrem S3-Bucket-Ausgabepfad, die Sie herunterladen können, um die Ergebnisse der Entitätserkennung aus dem importierten Modell zu überprüfen.

Zusammenfassung

In diesem Beitrag haben wir die Kopierfunktion des benutzerdefinierten Entitätsmodells von Amazon Comprehend demonstriert. Diese Funktion gibt Ihnen die Möglichkeit, ein benutzerdefiniertes Entitätserkennungs- oder -klassifizierungsmodell von Amazon Comprehend in einem Konto zu trainieren und das Modell dann mit einem anderen Konto in derselben Region zu teilen. Dies vereinfacht die Multi-Account-Strategie, bei der das Modell einmal trainiert und zwischen Konten innerhalb derselben Region geteilt werden kann, ohne dass die Trainingsdatensätze neu trainiert oder geteilt werden müssen. Dies ermöglicht eine vorhersagbare Bereitstellung in jedem Konto als Teil Ihres MLOps-Workflows. Weitere Informationen finden Sie in unserer Dokumentation unter Benutzerdefinierte Kopie verstehen, oder probieren Sie die exemplarische Vorgehensweise in diesem Beitrag entweder über die Konsole oder mithilfe einer Cloud-Shell mit der AWS CLI aus.

Zum jetzigen Zeitpunkt ist die Modellkopierfunktion in Amazon Comprehend in den folgenden Regionen verfügbar:

- US-Ost (Ohio)

- US-Ost (N. Virginia)

- USA Westen (Oregon)

- Asien-Pazifik (Mumbai)

- Asien-Pazifik (Seoul)

- Asien-Pazifik (Singapur)

- Asien-Pazifik (Sydney)

- Asien-Pazifik (Tokio)

- EU (Frankfurt)

- EU (Irland)

- EU (London)

- AWS GovCloud (USA-West)

Probieren Sie die Funktion aus und senden Sie uns Feedback entweder über die AWS-Forum für Amazon Comprehend oder über Ihre üblichen AWS-Support-Kontakte.

Über die Autoren

Premkumar Rangarajan ist Spezialist für KI/ML-Lösungen bei Amazon Web Services und hat zuvor das Buch Natural Language Processing with AWS AI services verfasst. Er verfügt über 26 Jahre Erfahrung in der IT-Branche in verschiedenen Positionen, darunter Delivery Lead, Integrationsspezialist und Unternehmensarchitekt. Er hilft Unternehmen jeder Größe, KI und ML einzuführen, um ihre realen Herausforderungen zu lösen.

Premkumar Rangarajan ist Spezialist für KI/ML-Lösungen bei Amazon Web Services und hat zuvor das Buch Natural Language Processing with AWS AI services verfasst. Er verfügt über 26 Jahre Erfahrung in der IT-Branche in verschiedenen Positionen, darunter Delivery Lead, Integrationsspezialist und Unternehmensarchitekt. Er hilft Unternehmen jeder Größe, KI und ML einzuführen, um ihre realen Herausforderungen zu lösen.

Chethan Krishna ist Senior Partner Solutions Architect in Indien. Er arbeitet mit strategischen AWS-Partnern zusammen, um eine solide Cloud-Kompetenz aufzubauen, Best Practices von AWS zu übernehmen und Kundenherausforderungen zu lösen. Er ist ein Baumeister und experimentiert gerne mit KI/ML, IoT und Analytik.

Chethan Krishna ist Senior Partner Solutions Architect in Indien. Er arbeitet mit strategischen AWS-Partnern zusammen, um eine solide Cloud-Kompetenz aufzubauen, Best Practices von AWS zu übernehmen und Kundenherausforderungen zu lösen. Er ist ein Baumeister und experimentiert gerne mit KI/ML, IoT und Analytik.

Sriharsha MS ist ein AI / ML-spezialisierter Lösungsarchitekt im Strategic Specialist-Team von Amazon Web Services. Er arbeitet mit strategischen AWS-Kunden zusammen, die AI / ML nutzen, um komplexe Geschäftsprobleme zu lösen. Er bietet technische Anleitungen und Konstruktionsratschläge zur Implementierung von AI / ML-Anwendungen in großem Maßstab. Seine Expertise umfasst Anwendungsarchitektur, BigData, Analytics und maschinelles Lernen.

Sriharsha MS ist ein AI / ML-spezialisierter Lösungsarchitekt im Strategic Specialist-Team von Amazon Web Services. Er arbeitet mit strategischen AWS-Kunden zusammen, die AI / ML nutzen, um komplexe Geschäftsprobleme zu lösen. Er bietet technische Anleitungen und Konstruktionsratschläge zur Implementierung von AI / ML-Anwendungen in großem Maßstab. Seine Expertise umfasst Anwendungsarchitektur, BigData, Analytics und maschinelles Lernen.

- Coinsmart. Europas beste Bitcoin- und Krypto-Börse.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. DEN FREIEN ZUGANG.

- CryptoHawk. Altcoin-Radar. Kostenlose Testphase.

- Quelle: https://aws.amazon.com/blogs/machine-learning/announcing-the-launch-of-the-model-copy-feature-for-amazon-comprehend-custom-models/

- "

- &

- 100

- 9

- Über uns

- Zugang

- Konto

- Action

- Aktivitäten

- Fortschritte

- Vorteil

- Beratung

- AI

- KI-Dienste

- Alle

- Amazon

- Amazon Web Services

- Analyse

- Analytik

- Bekannt geben

- Ankündigung

- Ein anderer

- Bienen

- APIs

- anwendbar

- Anwendung

- Anwendungen

- Architektur

- Auto

- verfügbar

- AWS

- Vorteile

- BESTE

- Best Practices

- Grenze

- bauen

- Baumeister

- Geschäft

- Herausforderungen

- Überprüfung

- Schecks

- Einstufung

- Cloud

- Code

- Bemerkungen

- gemeinsam

- Komplex

- Konsul (Console)

- Inhalt

- Kunden

- technische Daten

- Jahrzehnte

- Lieferanten

- Einsatz

- Design

- anders

- digital

- Unterlagen

- leicht

- bewirken

- enorm

- Unternehmen

- essential

- Beispiel

- ERFAHRUNGEN

- Expertise

- Merkmal

- Feedback

- Revolution

- Finanzdienstleistungen

- Vorname

- Folgende

- Funktionalität

- glücklich

- mit

- hilft

- Ultraschall

- Hilfe

- HTTPS

- identifizieren

- Identitätsschutz

- implementieren

- wichtig

- Einfuhr

- Einschließlich

- Indien

- Branchen

- Energiegewinnung

- Information

- Einblicke

- Integration

- Intelligenz

- Interesse

- iot

- Irland

- Isolierung

- IT

- Job

- Jobs

- Wesentliche

- Sprache

- starten

- führen

- lernen

- Line

- Liste

- Standorte

- London

- Maschine

- Maschinelles Lernen

- Management

- Medien

- Bergbau

- ML

- Modell

- für

- vor allem warme

- Am beliebtesten

- Mumbai

- Natürliche

- Angebote

- Ohio

- Auftrag

- Oregon

- Andere

- Pazifik

- Partner

- Leistung

- Sätze

- Datenschutzrichtlinien

- Beliebt

- Principal

- Probleme

- Prozessdefinierung

- Produkt

- die

- bietet

- schnell

- Regulierungsbehörden

- falls angefordert

- Voraussetzungen:

- Ressourcen

- Antwort

- Die Ergebnisse

- Rückgabe

- Bewertungen

- Skalieren

- Wissenschaftler

- Sdk

- Seoul

- Leistungen

- Teilen

- von Locals geführtes

- Shares

- Schale

- Einfacher

- Singapur

- So

- Lösungen

- LÖSEN

- Anfang

- Erklärung

- Status

- Lagerung

- Läden

- Strategisch

- Strategie

- Support

- Sydney

- Target

- Team

- Technische

- Test

- Die Quelle

- Durch

- Zeit

- heute

- Tokio

- Ausbildung

- Trends

- einzigartiges

- Aktualisierung

- us

- -

- Nutzer

- Anbieter

- Anzeigen

- Virginia

- Netz

- Web-Services

- West

- WHO

- .

- ohne

- Werk

- Schreiben

- Jahr