Amazon SageMaker Data Wrangler reduziert die Zeit, die zum Sammeln und Vorbereiten von Daten für maschinelles Lernen (ML) benötigt wird, von Wochen auf Minuten. Sie können den Prozess des Feature-Engineerings und der Datenvorbereitung mit SageMaker Data Wrangler optimieren und jede Phase des Datenvorbereitungs-Workflows (einschließlich Datenauswahl, -bereinigung, -exploration, -visualisierung und -verarbeitung im großen Maßstab) über eine einzige visuelle Oberfläche abschließen. Daten werden häufig in Data Lakes gespeichert, die von verwaltet werden können AWS Lake-FormationDies gibt Ihnen die Möglichkeit, eine differenzierte Zugriffskontrolle mithilfe eines unkomplizierten Gewährungs- oder Widerrufsverfahrens zu implementieren. SageMaker Data Wrangler unterstützt eine differenzierte Datenzugriffskontrolle mit Lake Formation und Amazonas Athena Verbindungen.

Wir freuen uns, Ihnen mitteilen zu können, dass SageMaker Data Wrangler jetzt die Verwendung von Lake Formation mit unterstützt Amazon EMR um diese fein abgestufte Datenzugriffsbeschränkung bereitzustellen.

Datenprofis wie Datenwissenschaftler möchten die Leistungsfähigkeit von nutzen Apache Funken, Bienenstock und Presto läuft auf Amazon EMR für eine schnelle Datenvorbereitung; Allerdings ist die Lernkurve steil. Unsere Kunden wünschten sich die Möglichkeit, eine Verbindung zu Amazon EMR herzustellen, um Ad-hoc-SQL-Abfragen auf Hive oder Presto auszuführen und Daten im internen oder externen Metastore (z. B AWS Glue-Datenkatalog) und bereiten Sie Daten mit wenigen Klicks vor.

In diesem Beitrag zeigen wir, wie man Lake Formation als zentrale Data-Governance-Funktion und Amazon EMR als Big-Data-Abfrage-Engine nutzt, um den Zugriff für SageMaker Data Wrangler zu ermöglichen. Die Funktionen von Lake Formation vereinfachen die Sicherung und Verwaltung verteilter Datenseen über mehrere Konten hinweg durch einen zentralisierten Ansatz und bieten eine fein abgestufte Zugriffskontrolle.

Lösungsüberblick

Wir demonstrieren diese Lösung mit einem End-to-End-Anwendungsfall unter Verwendung eines Beispieldatensatzes, der TPC-Datenmodell. Diese Daten stellen Transaktionsdaten für Produkte dar und umfassen Informationen wie Kundendemografie, Inventar, Webverkäufe und Werbeaktionen. Um differenzierte Datenzugriffsberechtigungen zu demonstrieren, betrachten wir die folgenden zwei Benutzer:

- David, ein Datenwissenschaftler im Marketingteam. Er hat die Aufgabe, ein Modell zur Kundensegmentierung zu erstellen, und darf nur auf nicht sensible Kundendaten zugreifen.

- Tina, Data Scientist im Vertriebsteam. Sie hat die Aufgabe, das Verkaufsprognosemodell zu erstellen, und benötigt Zugriff auf Verkaufsdaten für die jeweilige Region. Sie hilft dem Produktteam auch bei der Innovation und benötigt daher auch Zugriff auf Produktdaten.

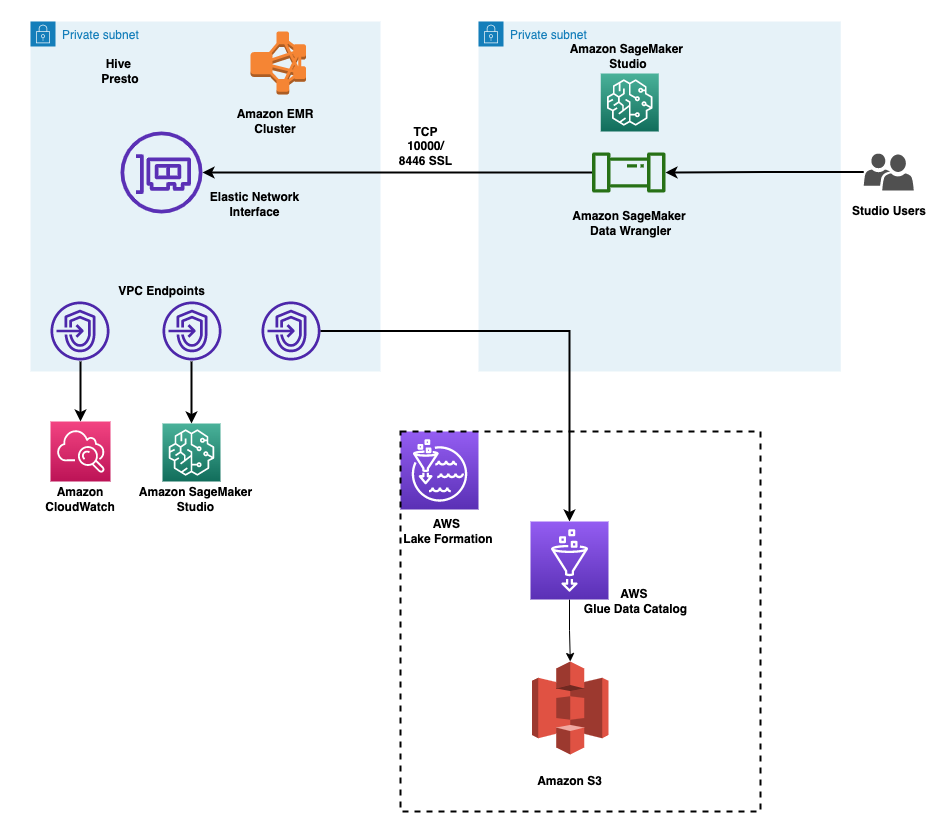

Die Architektur ist wie folgt implementiert:

- Lake Formation verwaltet den Data Lake und die Rohdaten sind verfügbar Amazon Simple Storage-Service (Amazon S3) Eimer

- Amazon EMR wird verwendet, um die Daten aus dem Data Lake abzufragen und die Datenvorbereitung mit Spark durchzuführen

- AWS Identity and Access Management and (IAM)-Rollen werden verwendet, um den Datenzugriff mithilfe von Lake Formation zu verwalten

- SageMaker Data Wrangler wird als einzige visuelle Schnittstelle zur interaktiven Abfrage und Aufbereitung der Daten verwendet

Das folgende Diagramm veranschaulicht diese Architektur. Konto A ist das Data-Lake-Konto, das alle ML-fähigen Daten enthält, die durch Extrahieren, Transformieren und Laden (ETL)-Prozesse erhalten werden. Konto B ist das Data-Science-Konto, bei dem eine Gruppe von Datenwissenschaftlern Datentransformationen mit SageMaker Data Wrangler kompilieren und ausführen. Damit SageMaker Data Wrangler in Konto B über Lake Formation-Berechtigungen Zugriff auf die Datentabellen im Data Lake von Konto A hat, müssen wir die erforderlichen Rechte aktivieren.

Sie können die bereitgestellten verwenden AWS CloudFormation Stack, um die Architekturkomponenten für diese Lösung einzurichten.

Voraussetzungen:

Bevor Sie beginnen, stellen Sie sicher, dass die folgenden Voraussetzungen erfüllt sind:

- An AWS-Konto

- Ein IAM-Benutzer mit Administratorzugriff

- Ein S3-Eimer

Stellen Sie Ressourcen mit AWS CloudFormation bereit

Wir stellen eine CloudFormation-Vorlage bereit, die die Dienste in der Architektur für End-to-End-Tests bereitstellt und wiederholte Bereitstellungen erleichtert. Die Ausgaben dieser Vorlage lauten wie folgt:

- Ein S3-Bucket für den Data Lake.

- Ein EMR-Cluster mit aktivierten EMR-Laufzeitrollen. Weitere Details zur Verwendung von Laufzeitrollen mit Amazon EMR finden Sie unter Konfigurieren Sie Laufzeitrollen für Amazon EMR-Schritte. Das Zuordnen von Laufzeitrollen zu EMR-Clustern wird in Amazon EMR 6.9 unterstützt. Stellen Sie sicher, dass die folgende Konfiguration vorhanden ist:

- Erstellen Sie eine Sicherheitskonfiguration in Amazon EMR.

- Die Vertrauensrichtlinie der EMR-Laufzeitrolle sollte es dem EMR EC2-Instanzprofil ermöglichen, die Rolle zu übernehmen.

- Die Profilrolle der EMR EC2-Instanz sollte in der Lage sein, die EMR-Laufzeitrollen zu übernehmen.

- Der EMR-Cluster sollte mit Verschlüsselung während der Übertragung erstellt werden.

- IAM-Rollen für den Zugriff auf die Daten im Data Lake mit fein abgestuften Berechtigungen:

- Marketing-Datenzugriffsrolle

- Vertriebsdatenzugriffsrolle

- An Amazon SageMaker Studio-Domäne und zwei Benutzerprofile. Die SageMaker Studio-Ausführungsrollen für die Benutzer ermöglichen es den Benutzern, ihre entsprechenden EMR-Laufzeitrollen zu übernehmen.

- Eine Lebenszykluskonfiguration, um die Auswahl der Rolle zu ermöglichen, die für die EMR-Verbindung verwendet werden soll.

- Eine Lake Formation-Datenbank, die mit den TPC-Daten gefüllt ist.

- Für die Einrichtung erforderliche Netzwerkressourcen wie VPC, Subnetze und Sicherheitsgruppen.

Erstellen Sie Amazon EMR-Verschlüsselungszertifikate für die Daten während der Übertragung

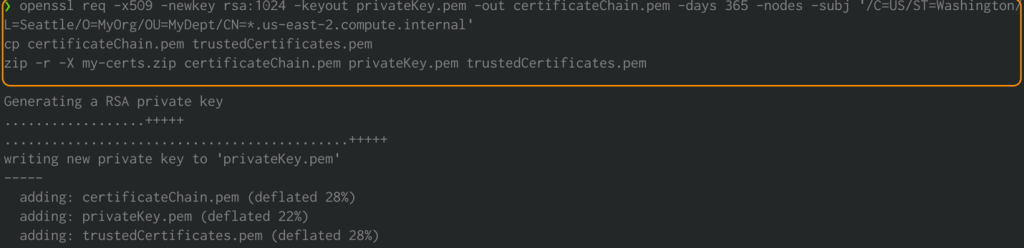

Mit der Amazon EMR-Version 4.8.0 oder höher haben Sie die Möglichkeit, mithilfe einer Sicherheitskonfiguration Artefakte für die Verschlüsselung von Daten während der Übertragung anzugeben. Wir erstellen manuell PEM-Zertifikate, fügen sie in eine ZIP-Datei ein, laden sie in einen S3-Bucket hoch und verweisen dann auf die ZIP-Datei in Amazon S3. Wahrscheinlich möchten Sie die PEM-Datei mit dem privaten Schlüssel als Platzhalterzertifikat konfigurieren, das den Zugriff auf die VPC-Domäne ermöglicht, in der sich Ihre Clusterinstanzen befinden. Wenn sich Ihr Cluster beispielsweise in der Region us-east-1 befindet, können Sie in der Zertifikatkonfiguration einen allgemeinen Namen angeben, der den Zugriff auf den Cluster durch Angabe ermöglicht CN=*.ec2.internal in der Zertifikatssubjektdefinition. Wenn sich Ihr Cluster in befindet us-west-2, könnten Sie angeben CN=*.us-west-2.compute.internal.

Führen Sie die folgenden Befehle über Ihr Systemterminal aus. Dadurch werden PEM-Zertifikate generiert und in einer ZIP-Datei zusammengefasst:

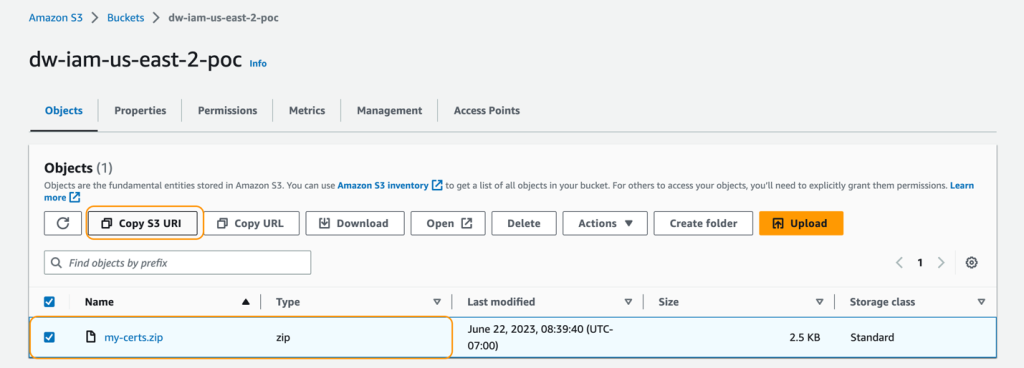

Hochladen my-certs.zip zu einem S3-Bucket in derselben Region, in der Sie diese Übung ausführen möchten. Kopieren Sie den S3-URI für die hochgeladene Datei. Sie benötigen dies beim Starten der CloudFormation-Vorlage.

Bei diesem Beispiel handelt es sich lediglich um eine Proof-of-Concept-Demonstration. Die Verwendung selbstsignierter Zertifikate wird nicht empfohlen und stellt ein potenzielles Sicherheitsrisiko dar. Verwenden Sie für Produktionssysteme eine vertrauenswürdige Zertifizierungsstelle (CA), um Zertifikate auszustellen.

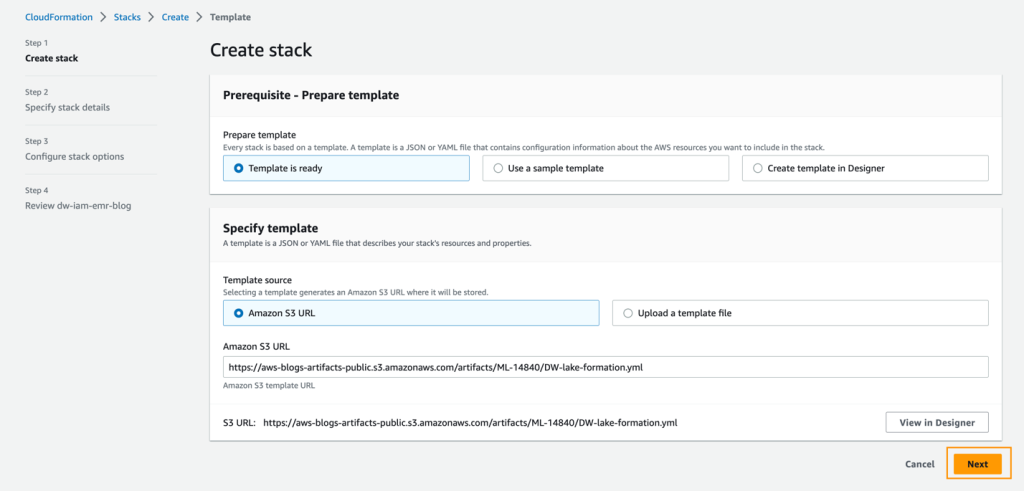

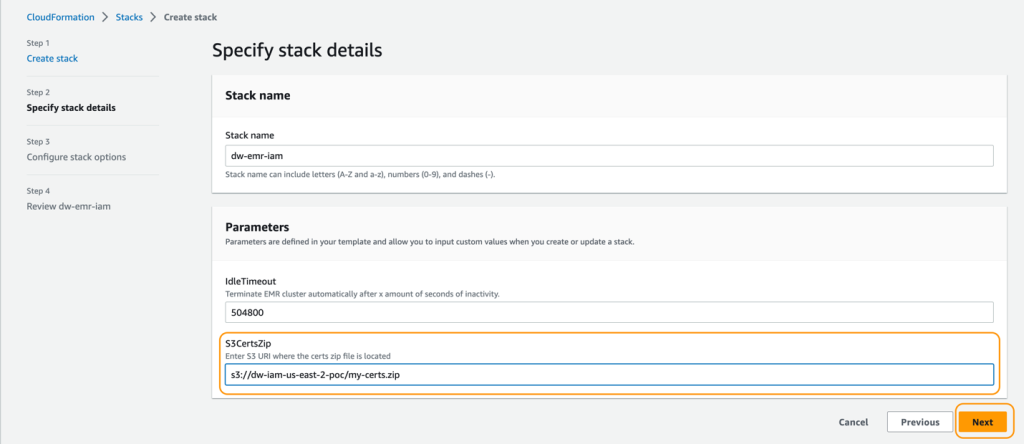

Bereitstellen der CloudFormation-Vorlage

Führen Sie die folgenden Schritte aus, um die Lösung bereitzustellen:

- Melden Sie sich bei der an AWS-Managementkonsole als IAM-Benutzer, vorzugsweise als Admin-Benutzer.

- Auswählen Stack starten So starten Sie die CloudFormation-Vorlage:

- Auswählen Weiter.

- Aussichten für StapelnameGeben Sie einen Namen für den Stapel ein.

- Aussichten für IdleTimeoutGeben Sie einen Wert für das Leerlauf-Timeout für den EMR-Cluster ein (um zu vermeiden, dass für den Cluster bezahlt wird, wenn er nicht verwendet wird).

- Aussichten für S3CertsZipGeben Sie einen S3-URI mit dem EMR-Verschlüsselungsschlüssel ein.

Anweisungen zum Generieren eines Schlüssels und einer ZIP-Datei speziell für Ihre Region finden Sie unter Bereitstellung von Zertifikaten zur Verschlüsselung von Daten während der Übertragung mit Amazon EMR-Verschlüsselung. Wenn Sie die Bereitstellung in den USA Ost (Nord-Virginia) durchführen, denken Sie daran, CN=*.ec2.internal zu verwenden. Weitere Informationen finden Sie unter Erstellen Sie Schlüssel und Zertifikate für die Datenverschlüsselung. Stellen Sie sicher, dass Sie die ZIP-Datei in einen S3-Bucket in derselben Region hochladen wie Ihre CloudFormation-Stack-Bereitstellung.

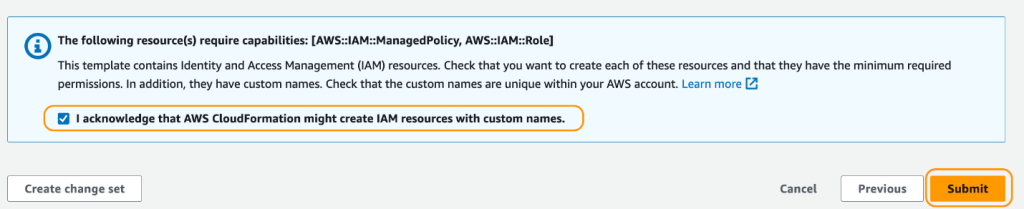

- Aktivieren Sie auf der Überprüfungsseite das Kontrollkästchen, um zu bestätigen, dass AWS CloudFormation möglicherweise Ressourcen erstellt.

- Auswählen Stapel erstellen.

Warten Sie, bis sich der Status des Stapels von ändert CREATE_IN_PROGRESS zu CREATE_COMPLETE. Der Vorgang dauert normalerweise 10 bis 15 Minuten.

Nachdem der Stack erstellt wurde, erlauben Sie Amazon EMR, Lake Formation abzufragen, indem Sie den aktualisieren Externe Datenfilterung Einstellungen auf der Lake Formation. Anweisungen finden Sie unter Erste Schritte mit Lake Formation. Geben Sie Amazon EMR an für Sitzungs-Tag-Werte und geben Sie unten Ihre AWS-Konto-ID ein AWS-Konto-IDs.

Testen Sie die Datenzugriffsberechtigungen

Da nun die erforderliche Infrastruktur vorhanden ist, können Sie überprüfen, ob die beiden SageMaker Studio-Benutzer Zugriff auf granulare Daten haben. Zur Überprüfung sollte David keinen Zugriff auf private Informationen über Ihre Kunden haben. Tina hat Zugriff auf Informationen zum Verkauf. Lassen Sie uns jeden Benutzertyp auf die Probe stellen.

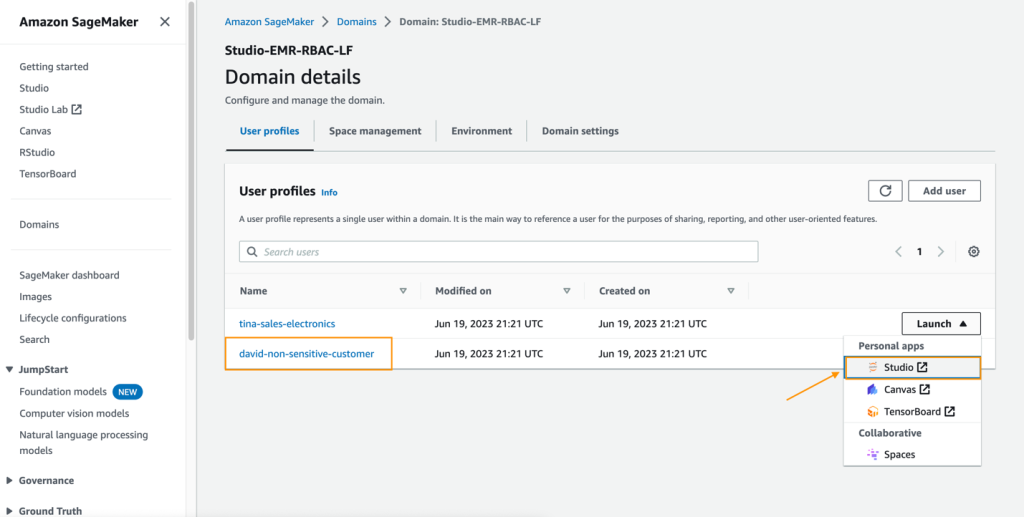

Testen Sie Davids Benutzerprofil

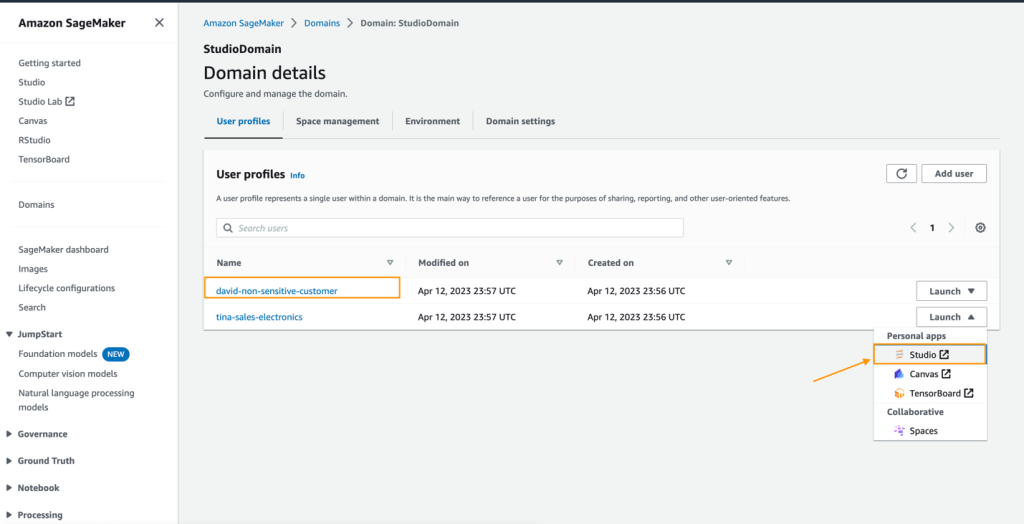

Führen Sie die folgenden Schritte aus, um Ihren Datenzugriff mit Davids Benutzerprofil zu testen:

- Wählen Sie in der SageMaker-Konsole Domains im Navigationsbereich.

- Starten Sie SageMaker Studio in der SageMaker Studio-Domäne über das Benutzerprofil david-non-sensitive-customer.

- Erstellen Sie in Ihrer SageMaker Studio-Umgebung eine Amazon SageMaker Data Wrangler fließen und wählen Daten visuell importieren und aufbereiten.

Alternativ auf der Reichen Sie das Menü, wählen Sie Neu, Dann wählen Data Wrangler-Fluss.

Wir besprechen diese Schritte zum Erstellen eines Datenflusses später in diesem Beitrag ausführlich.

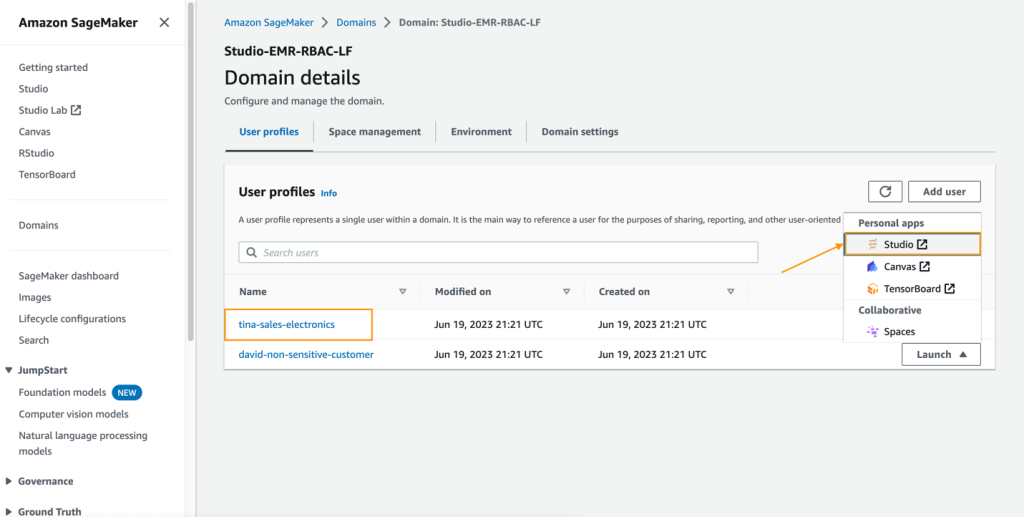

Testen Sie Tinas Benutzerprofil

Tinas SageMaker Studio-Ausführungsrolle ermöglicht ihr den Zugriff auf die Lake Formation-Datenbank mithilfe von zwei EMR-Ausführungsrollen. Dies wird erreicht, indem die Rollen-ARNs in einer Konfigurationsdatei in Tinas Dateiverzeichnis aufgelistet werden. Diese Rollen können mit festgelegt werden SageMaker Studio-Lebenszykluskonfigurationen um die Rollen über App-Neustarts hinweg beizubehalten. Führen Sie die folgenden Schritte aus, um Tinas Zugriff zu testen:

- Navigieren Sie in der SageMaker-Konsole zur SageMaker Studio-Domäne.

- Starten Sie SageMaker Studio über das Benutzerprofil

tina-sales-electronics.

Es empfiehlt sich, alle vorherigen SageMaker Studio-Sitzungen in Ihrem Browser zu schließen, wenn Sie das Benutzerprofil wechseln. Es kann jeweils nur eine aktive SageMaker Studio-Benutzersitzung vorhanden sein.

- Erstellen Sie einen Data Wrangler-Datenfluss.

In den folgenden Abschnitten zeigen wir die Erstellung eines Datenflusses in SageMaker Data Wrangler und die Verbindung mit Amazon EMR als Datenquelle. David und Tina werden ähnliche Erfahrungen mit der Datenaufbereitung machen, mit Ausnahme der Zugriffsberechtigungen, sodass sie unterschiedliche Tabellen sehen werden.

Erstellen Sie einen SageMaker Data Wrangler-Datenfluss

In diesem Abschnitt behandeln wir die Verbindung zum vorhandenen EMR-Cluster, der über die CloudFormation-Vorlage als Datenquelle in SageMaker Data Wrangler erstellt wurde. Zu Demonstrationszwecken nutzen wir Davids Benutzerprofil.

Führen Sie die folgenden Schritte aus, um Ihren Datenfluss zu erstellen:

- Wählen Sie in der SageMaker-Konsole Domains im Navigationsbereich.

- Wählen Sie StudioDomain aus, das durch Ausführen der CloudFormation-Vorlage erstellt wurde.

- Wählen Sie ein Benutzerprofil (in diesem Beispiel das von David) und starten Sie SageMaker Studio.

- Auswählen Open Studio.

- Erstellen Sie in SageMaker Studio einen neuen Datenfluss und wählen Sie Daten visuell importieren und aufbereiten.

Alternativ auf der Reichen Sie das Menü, wählen Sie Neu, Dann wählen Data Wrangler-Fluss.

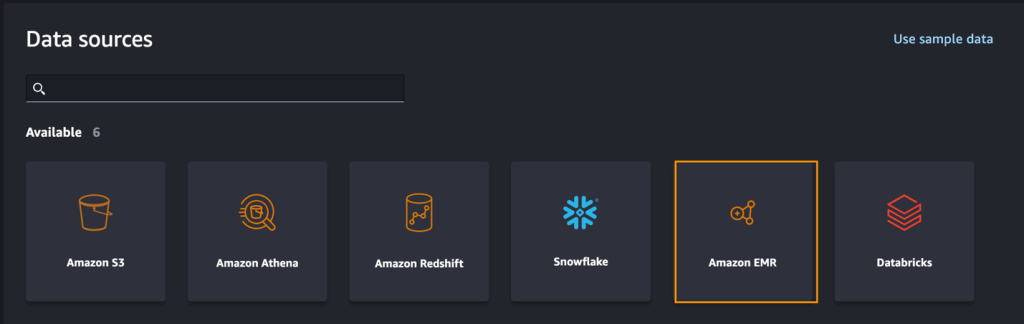

Das Erstellen eines neuen Flows kann einige Minuten dauern. Nachdem der Flow erstellt wurde, sehen Sie die Daten importieren

- Um Amazon EMR als Datenquelle in SageMaker Data Wrangler hinzuzufügen, klicken Sie auf: Datenquelle hinzufügen Menü, wählen Sie Amazon EMR.

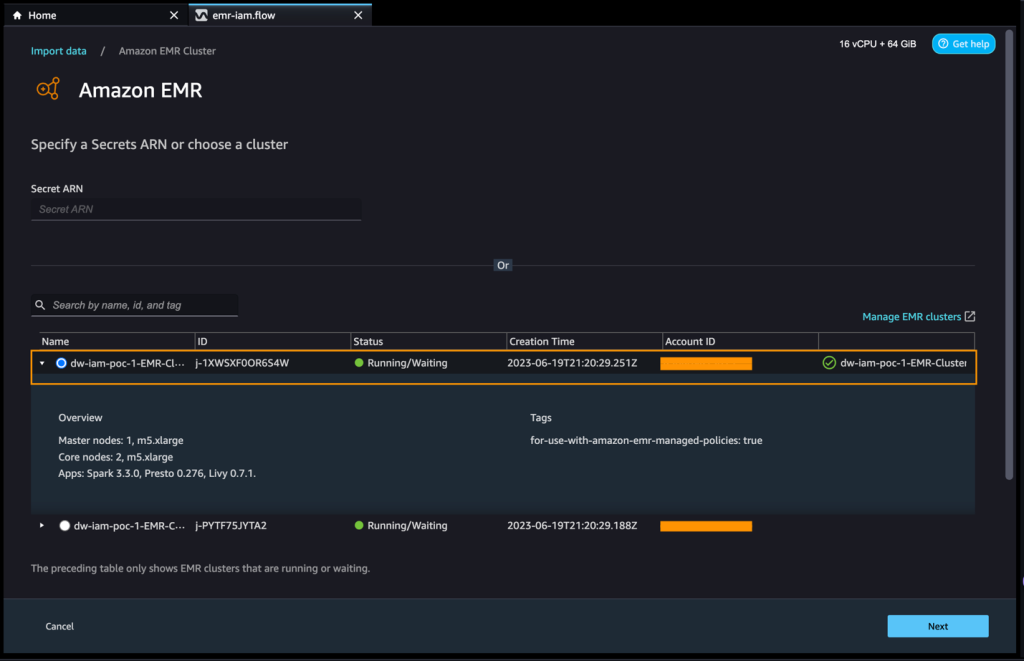

Sie können alle EMR-Cluster durchsuchen, zu deren Anzeige Ihre SageMaker Studio-Ausführungsrolle berechtigt ist. Sie haben zwei Möglichkeiten, eine Verbindung zu einem Cluster herzustellen: eine über die interaktive Benutzeroberfläche und die andere über die erste Verbindung ein Geheimnis erschaffen Verwendung von AWS Secrets Manager mit einer JDBC-URL, einschließlich EMR-Clusterinformationen, und stellen Sie dann den gespeicherten geheimen AWS-ARN in der Benutzeroberfläche bereit, um eine Verbindung zu Presto oder Hive herzustellen. In diesem Beitrag verwenden wir die erste Methode.

- Wählen Sie einen der Cluster aus, die Sie verwenden möchten, und wählen Sie dann Weiter.

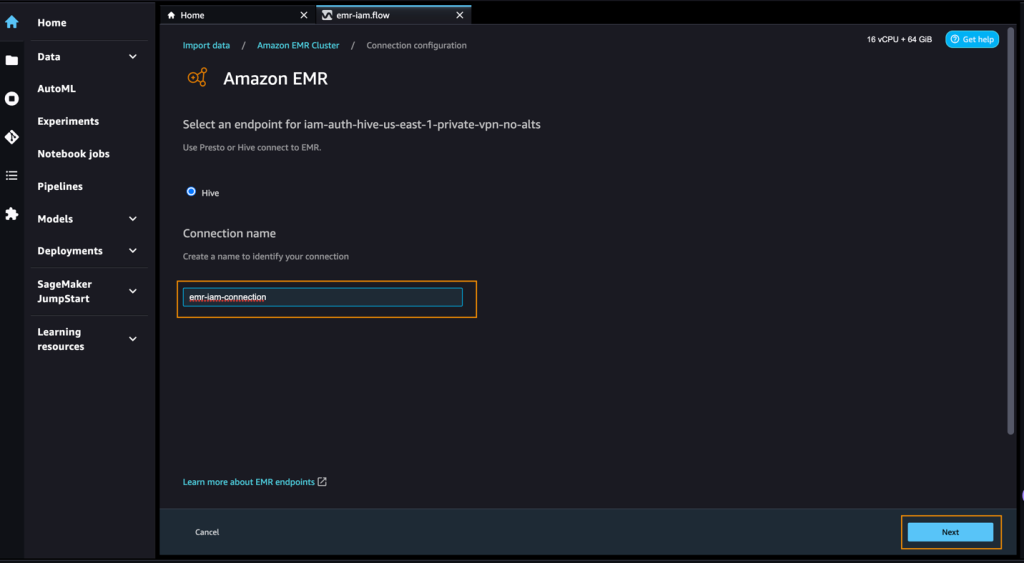

- Wählen Sie aus, welchen Endpunkt Sie verwenden möchten.

- Geben Sie einen Namen ein, um Ihre Verbindung zu identifizieren, z

emr-iam-connection, Dann wählen Weiter.

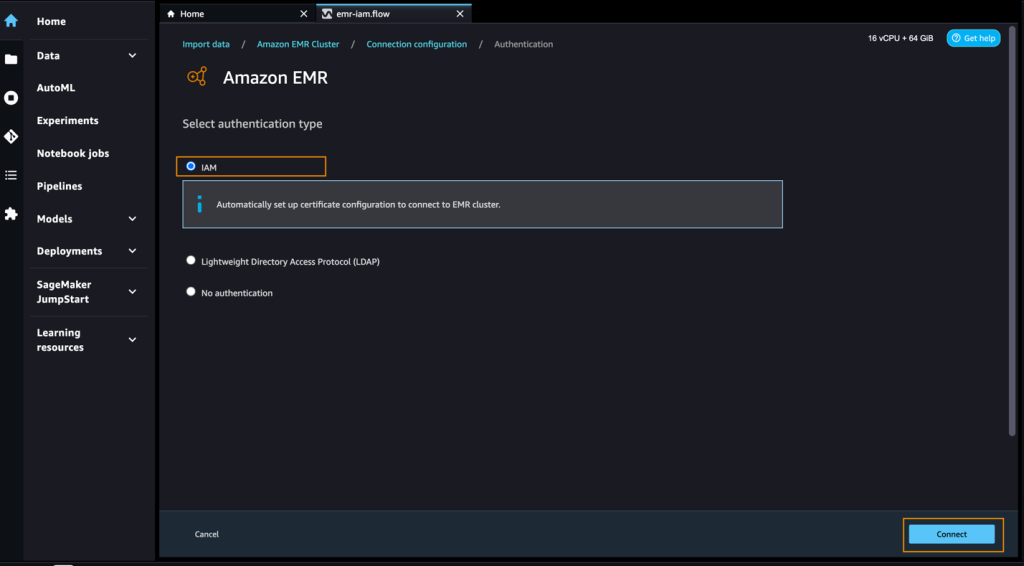

- Auswählen IAM als Authentifizierungstyp und wählen Sie Vernetz Dich.

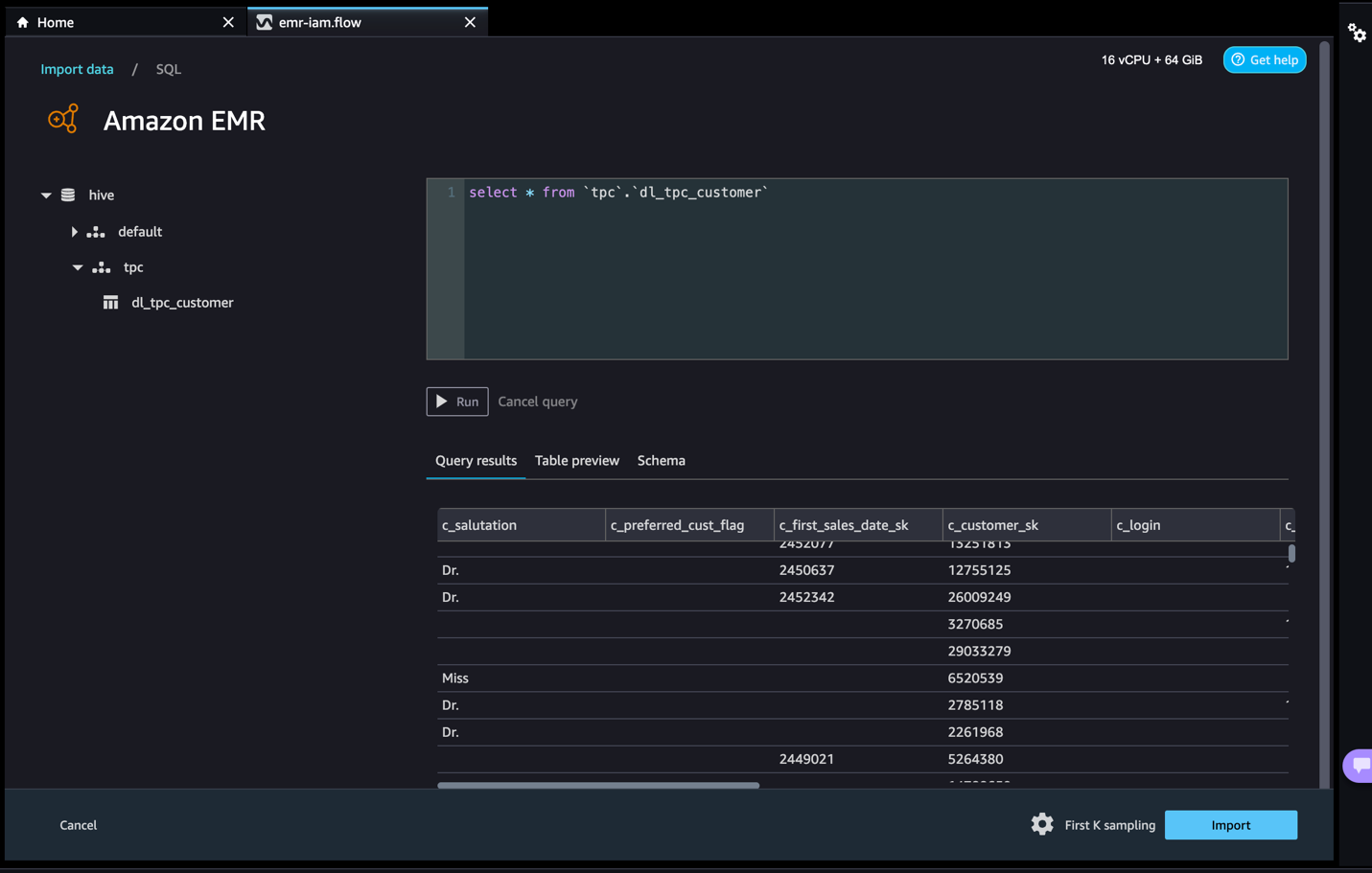

Wenn Sie verbunden sind, können Sie interaktiv einen Datenbankbaum und eine Tabellenvorschau oder ein Schema anzeigen. Sie können auch Daten von Amazon EMR abfragen, untersuchen und visualisieren. Für eine Vorschau sehen Sie standardmäßig ein Limit von 100 Datensätzen. Nachdem Sie im Abfrageeditor eine SQL-Anweisung eingegeben und ausgewählt haben Führen Sie, wird die Abfrage auf der Amazon EMR Hive-Engine ausgeführt, um eine Vorschau der Daten anzuzeigen. Wählen Abfrage abbrechen laufende Abfragen abzubrechen, wenn diese ungewöhnlich lange dauern.

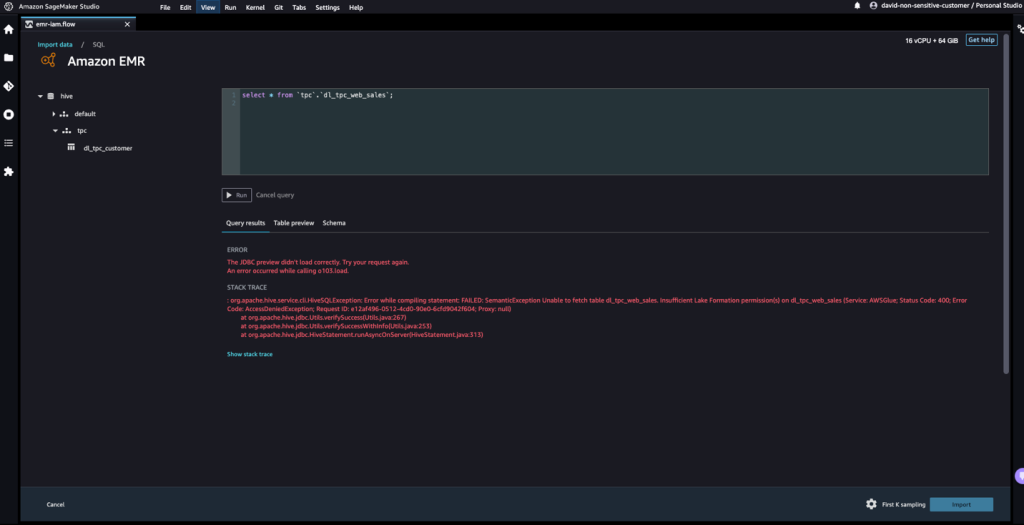

- Greifen wir auf Daten aus der Tabelle zu, für die David keine Berechtigungen hat.

Die Abfrage führt zu einer Fehlermeldung “Unable to fetch table dl_tpc_web_sales. Insufficient Lake Formation permission(s) on dl_tpc_web_sales.”

Der letzte Schritt besteht darin, die Daten zu importieren. Wenn Sie mit den abgefragten Daten fertig sind, haben Sie die Möglichkeit, die Stichprobeneinstellungen für die Datenauswahl entsprechend dem Stichprobentyp (FirstK, Random oder Stratified) und der Stichprobengröße für den Datenimport in Data Wrangler zu aktualisieren.

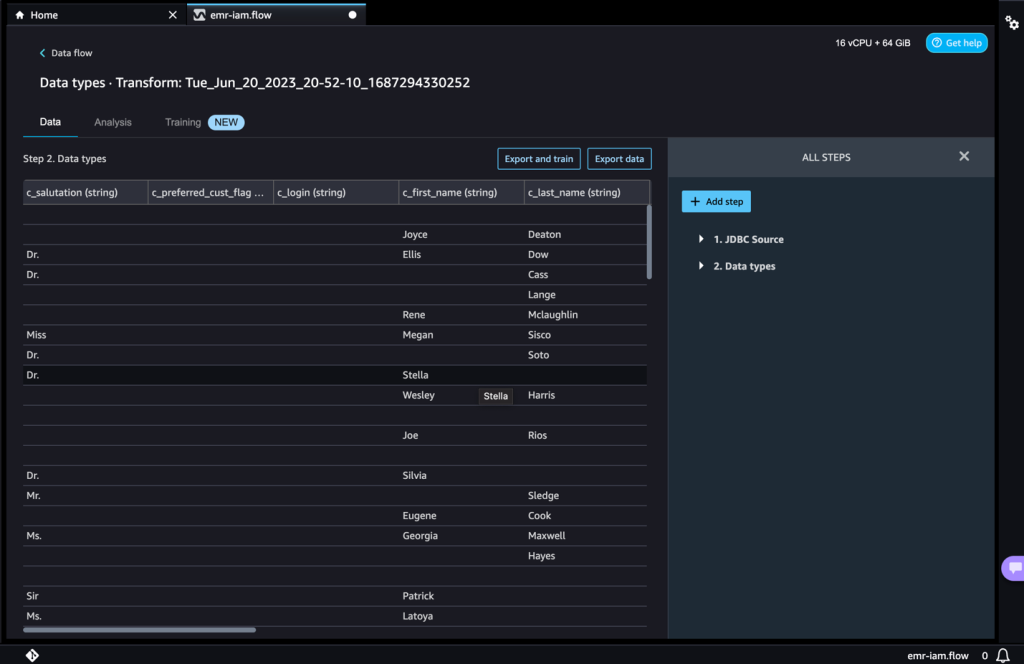

- Auswählen Import um die Daten zu importieren.

Auf der nächsten Seite können Sie dem Datensatz verschiedene Transformationen und wesentliche Analysen hinzufügen.

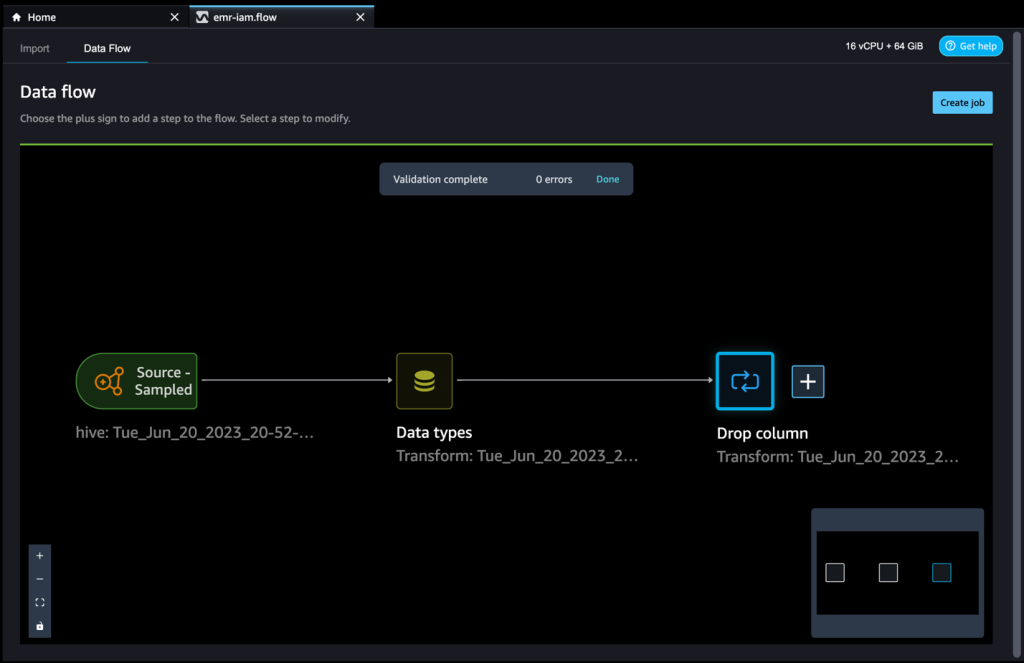

- Navigieren Sie zum Datenfluss und fügen Sie dem Fluss nach Bedarf weitere Schritte für Transformationen und Analysen hinzu.

Sie können eine ausführen Dateneinblicksbericht um Datenqualitätsprobleme zu identifizieren und Empfehlungen zur Behebung dieser Probleme zu erhalten. Sehen wir uns einige Beispieltransformationen an.

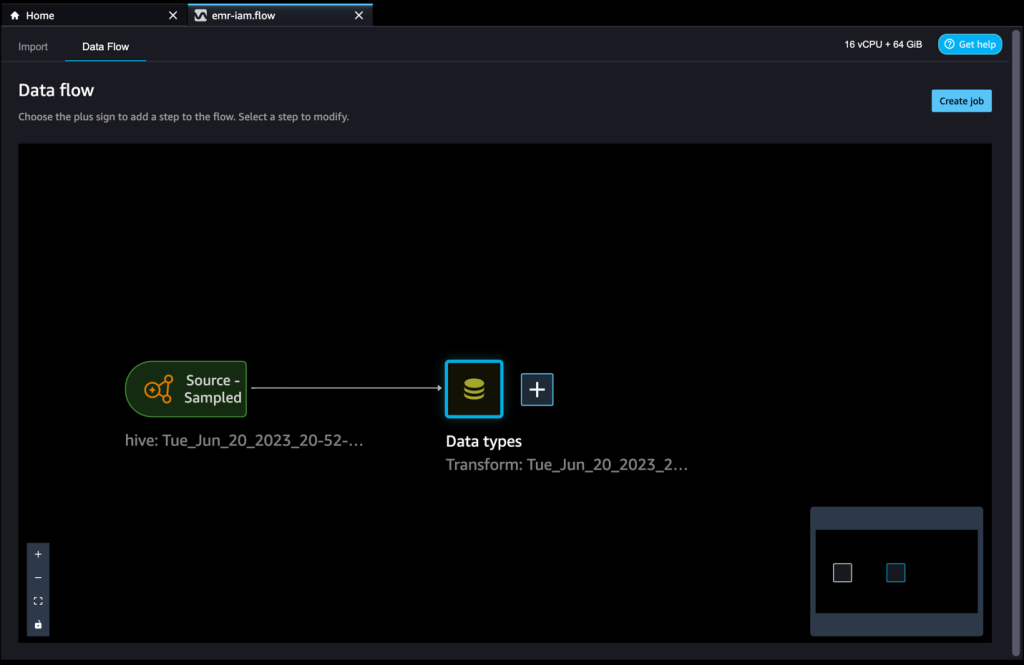

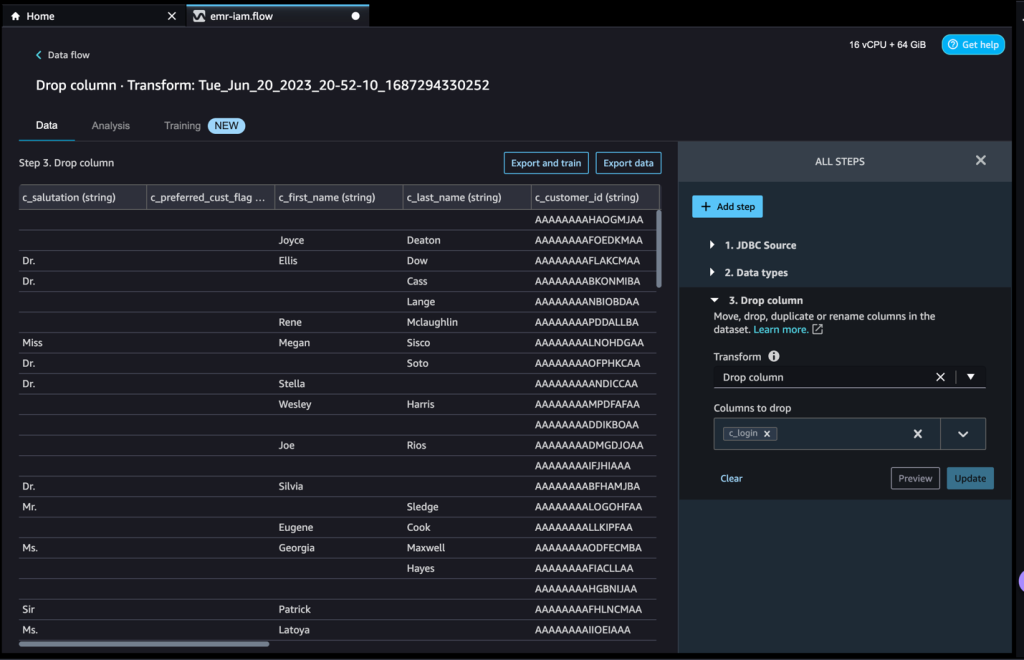

- Im Datenfluss In dieser Ansicht sollten Sie sehen, dass wir Amazon EMR als Datenquelle mithilfe des Hive-Connectors verwenden.

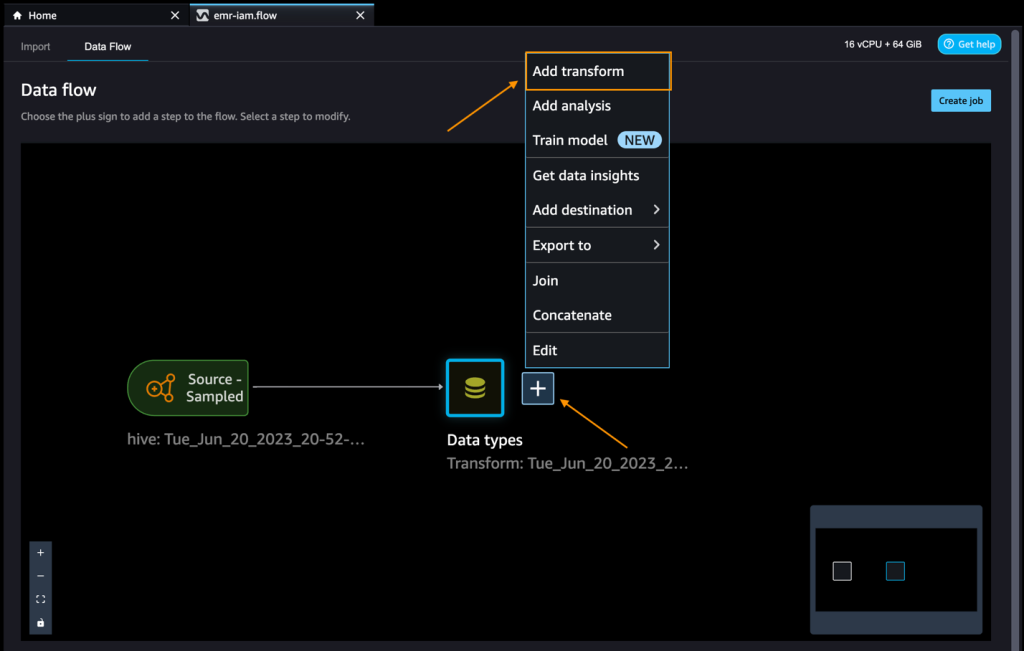

- Wählen Sie das Pluszeichen neben Datentypen und wählen Sie Transformation hinzufügen.

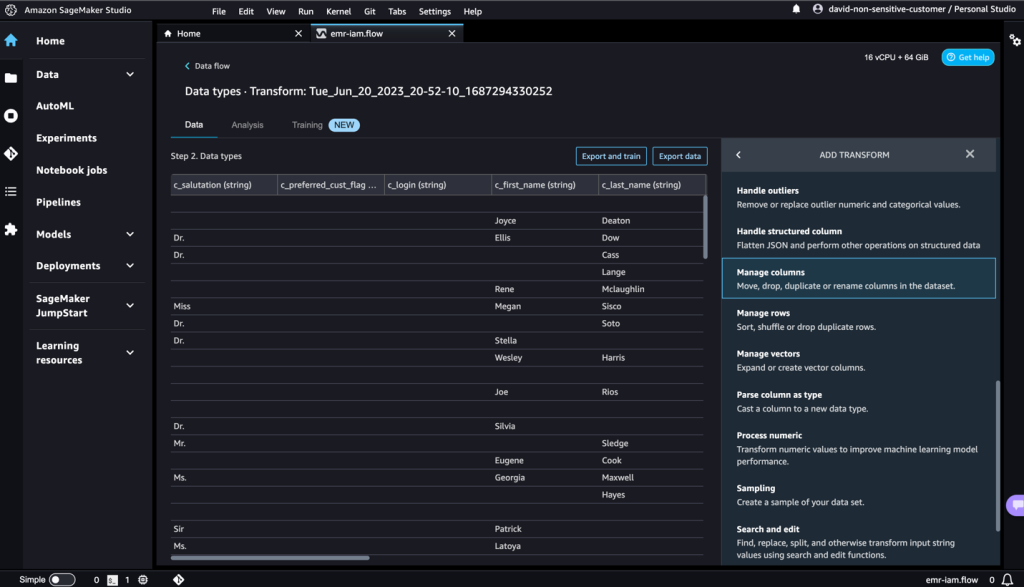

Lassen Sie uns die Daten untersuchen und eine Transformation anwenden. Zum Beispiel die c_login Die Spalte ist leer und bietet als Funktion keinen Mehrwert. Löschen wir die Spalte.

- Im Alle Schritte Fenster, wählen Sie Schritt hinzufügen.

- Auswählen Spalten verwalten.

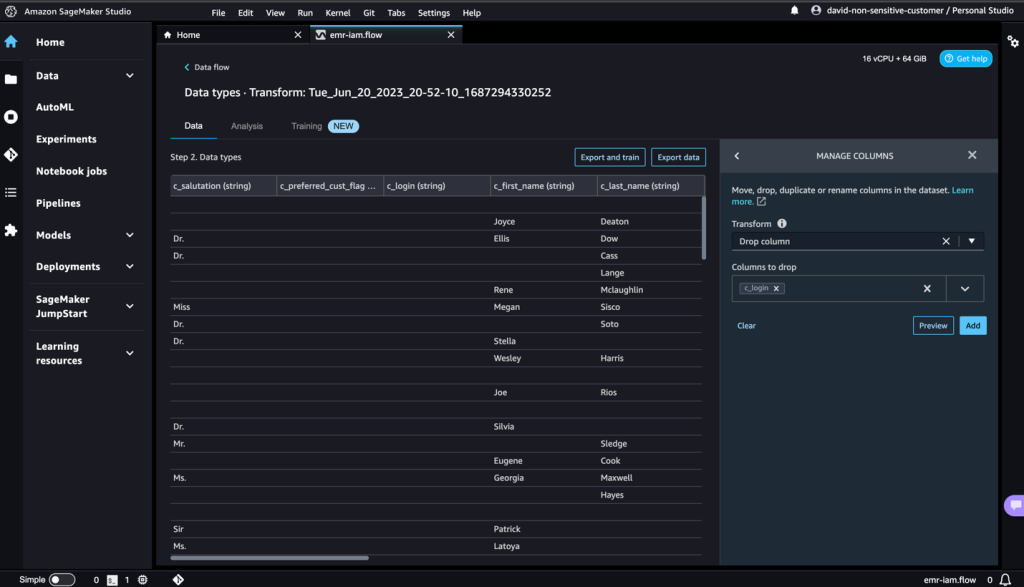

- Aussichten für Transformieren, wählen Spalte löschen.

- Aussichten für Spalten zum Ablegen, wählen Sie das

c_loginSpalte. - Auswählen Vorspann, Dann wählen Speichern.

- Überprüfen Sie den Schritt, indem Sie das erweitern Spalte löschen .

Sie können weiterhin Schritte hinzufügen, die auf den verschiedenen Transformationen basieren, die für Ihren Datensatz erforderlich sind. Kehren wir zu unserem Datenfluss zurück. Sie können jetzt die sehen Spalte löschen Block, der die von uns durchgeführte Transformation zeigt.

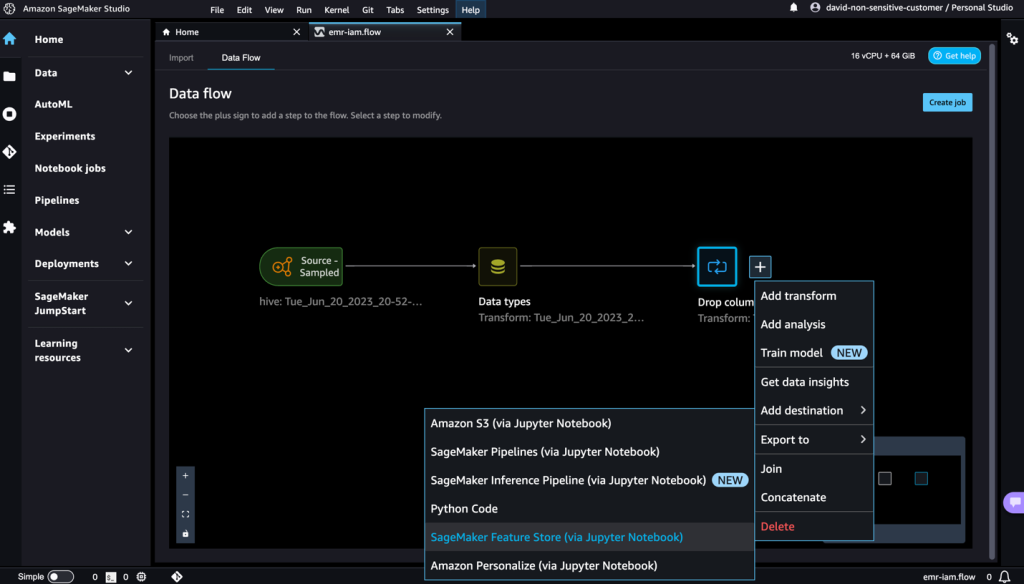

ML-Praktiker verbringen viel Zeit damit, Feature-Engineering-Code zu erstellen, ihn auf ihre ursprünglichen Datensätze anzuwenden, Modelle anhand der entwickelten Datensätze zu trainieren und die Modellgenauigkeit zu bewerten. Angesichts des experimentellen Charakters dieser Arbeit wird selbst das kleinste Projekt zu mehreren Iterationen führen. Derselbe Feature-Engineering-Code wird häufig immer wieder ausgeführt, wodurch Zeit und Rechenressourcen durch die Wiederholung derselben Vorgänge verschwendet werden. In großen Organisationen kann dies zu einem noch größeren Produktivitätsverlust führen, da verschiedene Teams häufig identische Aufgaben ausführen oder sogar doppelten Feature-Engineering-Code schreiben, weil sie keine Kenntnis von früheren Arbeiten haben. Um die erneute Verarbeitung von Features zu vermeiden, können wir unsere transformierten Features nach exportieren Amazon SageMaker Feature Store. Weitere Informationen finden Sie unter Neu - Speichern, entdecken und teilen Sie Funktionen für maschinelles Lernen mit Amazon SageMaker Feature Store.

- Wählen Sie das Pluszeichen neben Spalte löschen.

- Auswählen Exportieren nach und SageMaker Feature Store (über Jupyter Notebook).

Sie können Ihre generierten Features ganz einfach in den SageMaker Feature Store exportieren, indem Sie ihn als Ziel angeben. Sie können die Features in einer vorhandenen Feature-Gruppe speichern oder eine neue erstellen. Weitere Informationen finden Sie unter Einfaches Erstellen und Speichern von Funktionen in Amazon SageMaker ohne Code.

Wir haben jetzt Features mit SageMaker Data Wrangler erstellt und diese Features im SageMaker Feature Store gespeichert. Wir haben einen Beispiel-Workflow für das Feature-Engineering in der SageMaker Data Wrangler-Benutzeroberfläche gezeigt.

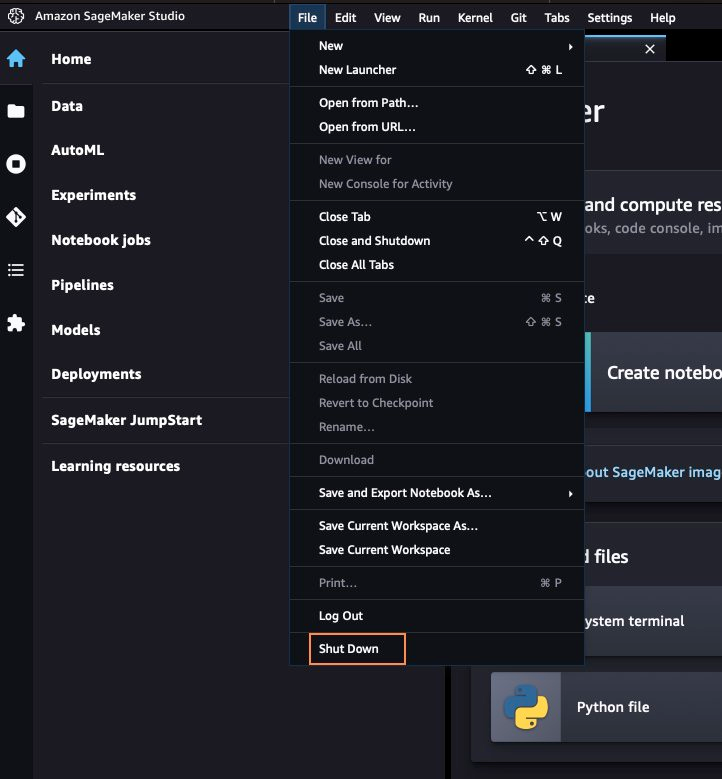

Aufräumen

Wenn Ihre Arbeit mit SageMaker Data Wrangler abgeschlossen ist, löschen Sie die von Ihnen erstellten Ressourcen, um zusätzliche Gebühren zu vermeiden.

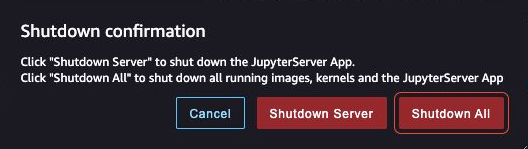

- Schließen Sie in SageMaker Studio alle Registerkarten und dann auf Reichen Sie das Menü, wählen Sie schließen.

- Wenn Sie dazu aufgefordert werden, wählen Sie Alle herunterfahren.

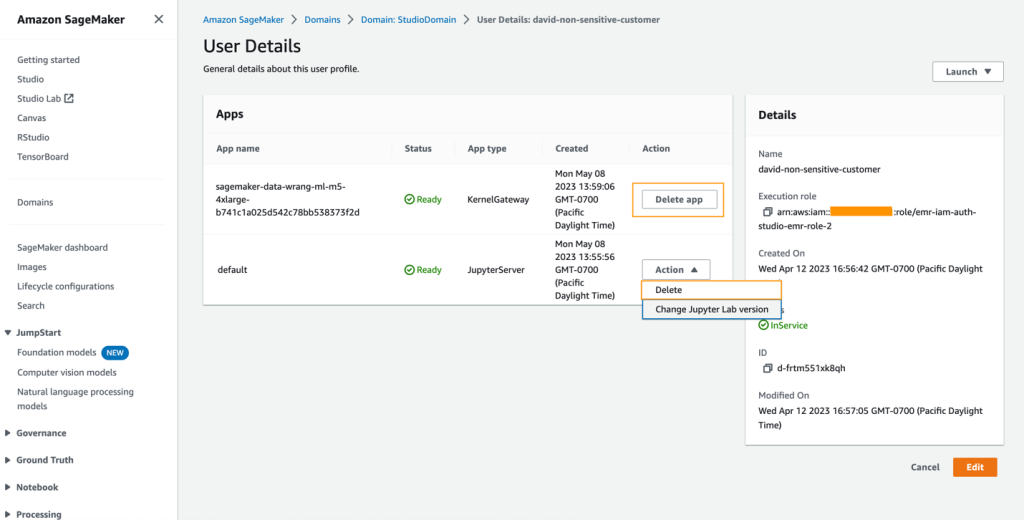

Das Herunterfahren kann je nach Instanztyp einige Minuten dauern. Stellen Sie sicher, dass alle mit jedem Benutzerprofil verknüpften Apps gelöscht wurden. Wenn sie nicht gelöscht wurden, löschen Sie manuell die App, die jedem Benutzerprofil zugeordnet ist, das mit der CloudFormation-Vorlage erstellt wurde.

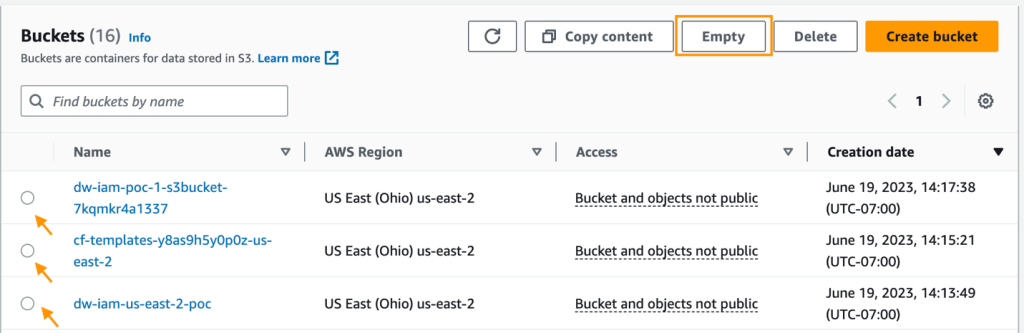

- Leeren Sie auf der Amazon S3-Konsole alle S3-Buckets, die bei der Bereitstellung von Clustern aus der CloudFormation-Vorlage erstellt wurden.

Die Buckets sollten das gleiche Präfix wie der Name des CloudFormation-Startstacks und cf-templates- haben.

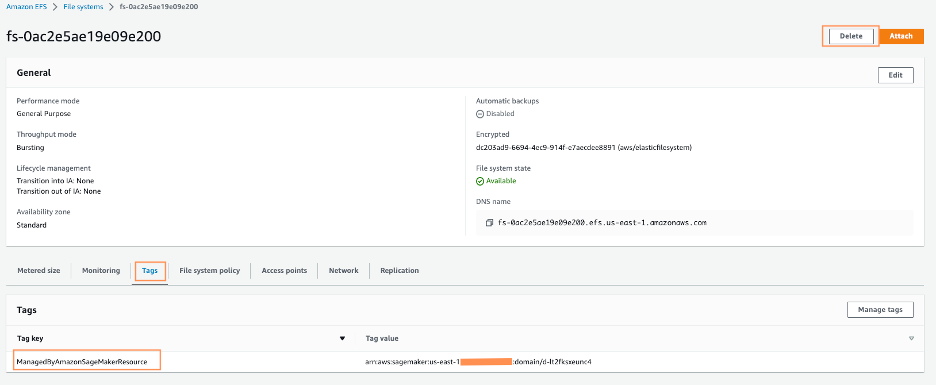

- Löschen Sie auf der Amazon EFS-Konsole das SageMaker Studio-Dateisystem.

Sie können bestätigen, dass Sie über das richtige Dateisystem verfügen, indem Sie die Dateisystem-ID auswählen und das Tag bestätigen ManagedByAmazonSageMakerResource auf die Schlüsselwörter Tab.

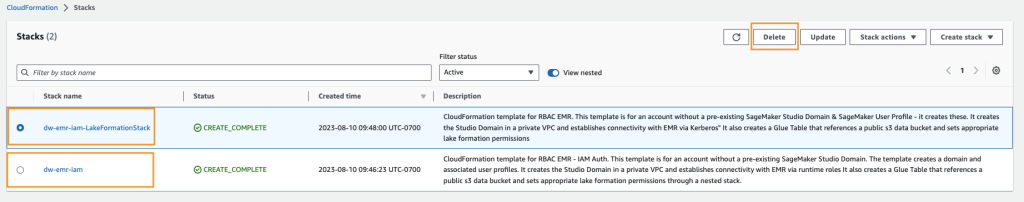

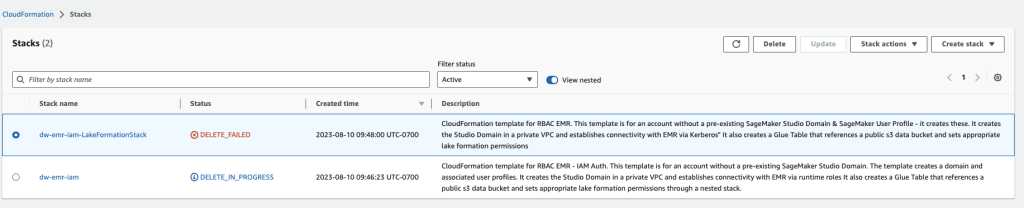

- Wählen Sie in der AWS CloudFormation-Konsole den von Ihnen erstellten Stack aus und wählen Sie ihn aus Löschen.

Sie erhalten eine Fehlermeldung, was erwartet wird. Wir werden darauf zurückkommen und es in den folgenden Schritten bereinigen.

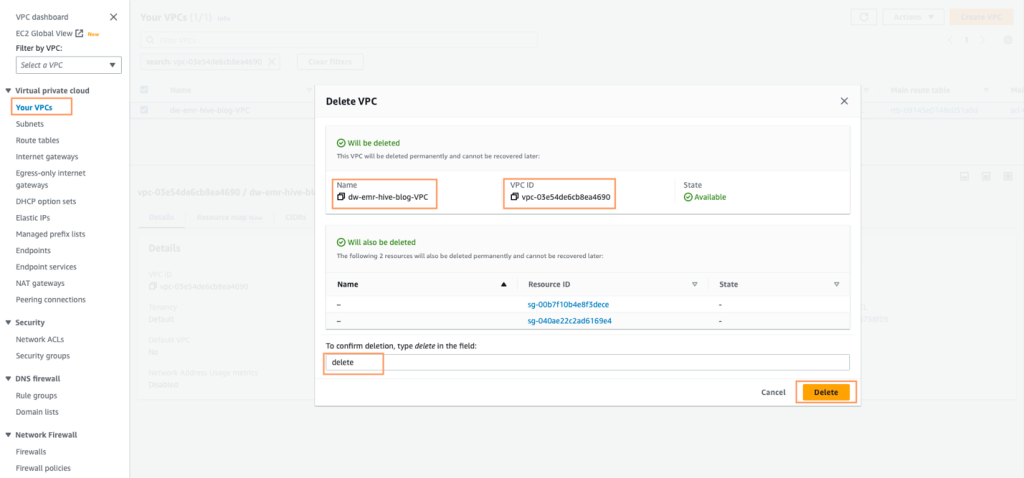

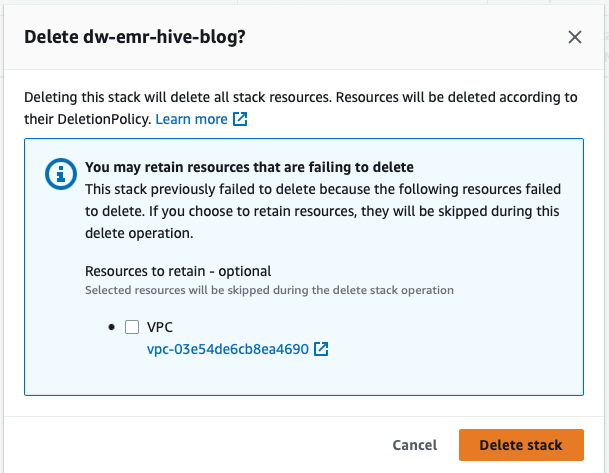

- Identifizieren Sie die VPC, die vom CloudFormation-Stack erstellt wurde, mit dem Namen dw-emr-und befolgen Sie die Anweisungen zum Löschen der VPC.

- Kehren Sie zur AWS CloudFormation-Konsole zurück und versuchen Sie erneut, den Stapel zu löschen dw-emr-.

Alle von der in diesem Beitrag beschriebenen CloudFormation-Vorlage bereitgestellten Ressourcen wurden jetzt aus Ihrem Konto entfernt.

Zusammenfassung

In diesem Beitrag haben wir besprochen, wie man mit Lake Formation eine differenzierte Zugriffskontrolle anwendet und mit Amazon EMR als Datenquelle in SageMaker Data Wrangler auf die Daten zugreift, wie man einen Datensatz umwandelt und analysiert und wie man die Ergebnisse in ein exportiert Datenfluss zur Verwendung in einem Jupyter-Notebook. Nachdem wir unseren Datensatz mithilfe der integrierten Analysefunktionen von SageMaker Data Wrangler visualisiert hatten, verbesserten wir unseren Datenfluss weiter. Die Tatsache, dass wir eine Datenvorbereitungspipeline erstellt haben, ohne eine einzige Codezeile zu schreiben, ist von Bedeutung.

Informationen zu den ersten Schritten mit SageMaker Data Wrangler finden Sie unter Vorbereiten von ML-Daten mit Amazon SageMaker Data Wrangler.

Über die Autoren

Ajjay Govindaram ist Senior Solutions Architect bei AWS. Er arbeitet mit strategischen Kunden zusammen, die KI/ML einsetzen, um komplexe Geschäftsprobleme zu lösen. Seine Erfahrung liegt in der Bereitstellung von technischer Anleitung sowie Designunterstützung für bescheidene bis große KI/ML-Anwendungsbereitstellungen. Sein Wissen reicht von Anwendungsarchitektur bis hin zu Big Data, Analytik und maschinellem Lernen. Er genießt es, Musik zu hören, während er sich ausruht, die Natur zu erleben und Zeit mit seinen Lieben zu verbringen.

Ajjay Govindaram ist Senior Solutions Architect bei AWS. Er arbeitet mit strategischen Kunden zusammen, die KI/ML einsetzen, um komplexe Geschäftsprobleme zu lösen. Seine Erfahrung liegt in der Bereitstellung von technischer Anleitung sowie Designunterstützung für bescheidene bis große KI/ML-Anwendungsbereitstellungen. Sein Wissen reicht von Anwendungsarchitektur bis hin zu Big Data, Analytik und maschinellem Lernen. Er genießt es, Musik zu hören, während er sich ausruht, die Natur zu erleben und Zeit mit seinen Lieben zu verbringen.

Isha Dua ist ein Senior Solutions Architect mit Sitz in der San Francisco Bay Area. Sie hilft AWS-Unternehmenskunden beim Wachstum, indem sie ihre Ziele und Herausforderungen versteht, und leitet sie an, wie sie ihre Anwendungen auf Cloud-native Weise gestalten und gleichzeitig Ausfallsicherheit und Skalierbarkeit gewährleisten können. Sie interessiert sich leidenschaftlich für maschinelle Lerntechnologien und ökologische Nachhaltigkeit.

Isha Dua ist ein Senior Solutions Architect mit Sitz in der San Francisco Bay Area. Sie hilft AWS-Unternehmenskunden beim Wachstum, indem sie ihre Ziele und Herausforderungen versteht, und leitet sie an, wie sie ihre Anwendungen auf Cloud-native Weise gestalten und gleichzeitig Ausfallsicherheit und Skalierbarkeit gewährleisten können. Sie interessiert sich leidenschaftlich für maschinelle Lerntechnologien und ökologische Nachhaltigkeit.

Teil Patel ist Senior Solutions Architect bei AWS in der San Francisco Bay Area. Parth begleitet Unternehmenskunden dabei, ihre Reise in die Cloud zu beschleunigen und hilft ihnen, die AWS Cloud erfolgreich einzuführen und darin zu wachsen. Seine Leidenschaft gilt den Technologien des maschinellen Lernens, der ökologischen Nachhaltigkeit und der Modernisierung von Anwendungen.

Teil Patel ist Senior Solutions Architect bei AWS in der San Francisco Bay Area. Parth begleitet Unternehmenskunden dabei, ihre Reise in die Cloud zu beschleunigen und hilft ihnen, die AWS Cloud erfolgreich einzuführen und darin zu wachsen. Seine Leidenschaft gilt den Technologien des maschinellen Lernens, der ökologischen Nachhaltigkeit und der Modernisierung von Anwendungen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- ChartPrime. Verbessern Sie Ihr Handelsspiel mit ChartPrime. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/apply-fine-grained-data-access-controls-with-aws-lake-formation-in-amazon-sagemaker-data-wrangler/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 20

- 202

- 22

- 7

- 8

- 9

- a

- Fähigkeit

- Fähig

- Über Uns

- beschleunigen

- Zugang

- Zugriff

- Nach

- Konto

- Trading Konten

- Genauigkeit

- erreicht

- über

- aktiv

- Ad

- hinzufügen

- Hinzufügen

- Zusätzliche

- Administrator

- adoptieren

- Nach der

- aufs Neue

- AI / ML

- Alle

- erlauben

- erlaubt

- ebenfalls

- Amazon

- Amazon EMR

- Amazon Sage Maker

- Amazon SageMaker Data Wrangler

- Amazon Web Services

- an

- Analyse

- Analytische

- Analytik

- analysieren

- und

- Bekannt geben

- jedem

- App

- Anwendung

- Anwendungen

- Bewerbung

- Anwendung

- Ansatz

- Apps

- architektonisch

- Architektur

- SIND

- Bereich

- AS

- Hilfe

- damit verbundenen

- annehmen

- At

- Authentifizierung

- Autorität

- verfügbar

- vermeiden

- AWS

- AWS CloudFormation

- AWS Lake-Formation

- Zurück

- basierend

- Bucht

- BE

- weil

- war

- Sein

- Big

- Big Data

- Box

- Browser

- Building

- eingebaut

- Geschäft

- by

- CA

- CAN

- Fähigkeiten

- capability

- Häuser

- Verursachen

- Hauptgeschäftsstelle

- zentralisierte

- Bescheinigung

- Zertifikate

- Zertifizierung

- Herausforderungen

- Änderungen

- aus der Ferne überprüfen

- Auswählen

- Auswahl

- Menu

- Cloud

- Cluster

- Code

- sammeln

- Kolonne

- wie die

- gemeinsam

- abschließen

- Komplex

- Komponenten

- Berechnen

- konzept

- Konfiguration

- Schichtannahme

- Vernetz Dich

- Sie

- Sich zusammenschliessen

- Verbindung

- Verbindungen

- Geht davon

- Konsul (Console)

- fortsetzen

- Smartgeräte App

- Steuerung

- und beseitigen Muskelschwäche

- Dazugehörigen

- könnte

- Abdeckung

- erstellen

- erstellt

- Erstellen

- Kurve

- Kunde

- Kundendaten

- Kunden

- technische Daten

- Datenzugriff

- Datensee

- Datenaufbereitung

- Datenwissenschaft

- Datenwissenschaftler

- Datenbase

- Datensätze

- Christian

- Standard

- Definition

- Demographie

- zeigen

- einsetzen

- Bereitstellen

- Einsatz

- Implementierungen

- setzt ein

- beschrieben

- Design

- Reiseziel

- Detail

- Details

- anders

- Richtung

- entdeckt,

- diskutieren

- verteilt

- Tut nicht

- Domain

- jeder

- leicht

- Osten

- Herausgeber

- ermöglichen

- freigegeben

- ermöglicht

- Verschlüsselung

- End-to-End

- Endpunkt

- Motor

- Entwicklung

- verbesserte

- Gewährleistung

- Enter

- Unternehmen

- Arbeitsumfeld

- Umwelt-

- Umweltverträglichkeit

- Fehler

- essential

- Auswerten

- Sogar

- Beispiel

- Außer

- Ausführung

- Training

- vorhandenen

- Ausbau

- erwartet

- ERFAHRUNGEN

- Erfahrungen

- erleben

- experimentell

- Exploration

- ERKUNDEN

- exportieren

- extern

- Extrakt

- erleichtern

- Tatsache

- FAST

- Merkmal

- Eigenschaften

- Honorare

- wenige

- Reichen Sie das

- Fertig

- Vorname

- Fixieren

- Fluss

- folgen

- Folgende

- folgt

- Aussichten für

- Prognose

- Ausbildung

- Francisco cisco~~POS=HEADCOMP

- häufig

- für

- weiter

- erzeugen

- erzeugt

- bekommen

- gegeben

- Unterstützung

- Go

- Ziele

- gut

- Governance

- gewähren

- mehr

- Gruppe an

- Gruppen

- Wachsen Sie über sich hinaus

- Anleitungen

- glücklich

- Haben

- he

- Hilfe

- Unternehmen

- hilft

- hier (auf dänisch)

- seine

- Bienenstock

- Houses

- Ultraschall

- Hilfe

- aber

- HTML

- http

- HTTPS

- ID

- identisch

- identifizieren

- Identitätsschutz

- Leerlauf

- if

- zeigt

- implementieren

- umgesetzt

- importieren

- Einfuhr

- in

- das

- Dazu gehören

- Einschließlich

- Information

- Infrastruktur

- Anfangs-

- Innovation

- Einblick

- Instanz

- Anleitung

- wollen

- interaktive

- Schnittstelle

- intern

- in

- Inventar

- Problem

- Probleme

- IT

- Iterationen

- Jobs

- Reise

- jpg

- gehalten

- Wesentliche

- Tasten

- Wissen

- See

- grosse

- großflächig

- Nachname

- später

- starten

- Start

- führen

- lernen

- liegt

- Lebenszyklus

- wahrscheinlich

- LIMIT

- Line

- Hören

- listing

- Belastung

- Lang

- lange Zeit

- aussehen

- Verlust

- Los

- geliebt wird

- Maschine

- Maschinelles Lernen

- um

- verwalten

- verwaltet

- Management

- Managed

- flächendeckende Gesundheitsprogramme

- Weise

- manuell

- Marketing

- MENÜ

- Nachricht

- Methode

- könnte

- Minuten

- ML

- Modell

- für

- bescheiden

- mehr

- mehrere

- Musik

- sollen

- Name

- Namens

- Natur

- Navigieren

- Menü

- notwendig,

- Need

- erforderlich

- Bedürfnisse

- Neu

- weiter

- nicht

- Notizbuch

- jetzt an

- erhalten

- of

- vorgenommen,

- on

- EINEM

- Einsen

- laufend

- einzige

- Einkauf & Prozesse

- Option

- Optionen

- or

- Auftrag

- Organisationen

- Andere

- UNSERE

- im Freien

- übrig

- Seite

- Brot

- besondere

- leidenschaftlich

- zahlen

- Ausführen

- durchgeführt

- Berechtigungen

- Pipeline

- Ort

- Plato

- Datenintelligenz von Plato

- PlatoData

- erfahren

- Datenschutzrichtlinien

- besiedelt

- Post

- Potenzial

- Werkzeuge

- Praxis

- Vorbereitung

- Danach

- Voraussetzungen

- Geschenke

- Vorspann

- früher

- Vor

- privat

- private Informationen

- Private Key

- Probleme

- Verfahren

- Prozessdefinierung

- anpassen

- Verarbeitung

- Produkt

- Produktion

- PRODUKTIVITÄT

- Produkte

- Profis

- Profil

- Profil

- Projekt

- Sonderaktionen

- Beweis

- Proof of Concept

- die

- vorausgesetzt

- Bereitstellung

- Zwecke

- setzen

- Qualität

- Abfragen

- zufällig

- Roh

- bereit

- erhalten

- Empfehlungen

- empfohlen

- Aufzeichnungen

- reduziert

- Region

- Release

- merken

- Entfernt

- wiederholt

- representiert

- falls angefordert

- Elastizität

- Downloads

- ruhend

- Einschränkung

- Folge

- Die Ergebnisse

- Überprüfen

- Rechte

- Risiko

- Rollen

- Rollen

- rsa

- Führen Sie

- Laufen

- s

- sagemaker

- Vertrieb

- gleich

- Beispieldatensatz

- San

- San Francisco

- Speichern

- Skalierbarkeit

- Skalieren

- Wissenschaft

- Wissenschaftler

- Wissenschaftler

- Die Geheime

- Abschnitt

- Abschnitte

- Sicherung

- Sicherheitdienst

- sehen

- Segmentierung

- Auswahl

- Senior

- Lösungen

- Sitzung

- Sessions

- kompensieren

- Einstellungen

- Setup

- Teilen

- sie

- sollte

- erklären

- Vitrine

- zeigte

- Schild

- signifikant

- ähnlich

- Einfacher

- vereinfachen

- Single

- Größe

- So

- Lösung

- Lösungen

- LÖSEN

- einige

- Quelle

- spezifisch

- verbringen

- Ausgabe

- Stapel

- Stufe

- begonnen

- Erklärung

- Status

- Schritt

- Shritte

- Lagerung

- speichern

- gelagert

- einfach

- Strategisch

- rationalisieren

- Studio Adressen

- Fach

- Subnetze

- Folge

- Erfolgreich

- so

- Unterstützte

- Unterstützt

- sicher

- Nachhaltigkeit

- System

- Systeme und Techniken

- Tabelle

- TAG

- Nehmen

- nimmt

- Einnahme

- Team

- Teams

- Technische

- Technologies

- Vorlage

- Terminal

- Test

- Testen

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Dort.

- deswegen

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- Durch

- Zeit

- zu

- Ausbildung

- Transaktion

- Transformieren

- Transformation

- Transformationen

- verwandelt

- Transformationen

- Transit

- Baum

- Vertrauen

- vertraut

- XNUMX

- tippe

- ui

- für

- Verständnis

- bis

- Aktualisierung

- Aktualisierung

- hochgeladen

- URL

- us

- -

- Anwendungsfall

- benutzt

- Mitglied

- Nutzer

- Verwendung von

- gewöhnlich

- Wert

- verschiedene

- überprüfen

- Version

- Anzeigen

- Virginia

- Visualisierung

- wollen

- wollte

- wurde

- we

- Netz

- Web-Services

- Wochen

- GUT

- ging

- waren

- wann

- welche

- während

- WHO

- werden wir

- mit

- .

- ohne

- Arbeiten

- Arbeitsablauf.

- Werk

- schreiben

- Schreiben

- Du

- Ihr

- Zephyrnet

- PLZ