Dieser Beitrag wurde gemeinsam mit Ming (Melvin) Qin, David Bericat und Brad Genereaux von NVIDIA verfasst.

KI-Forscher und -Entwickler für medizinische Bildgebung benötigen ein skalierbares Unternehmensframework, um ihre KI-Anwendungen zu erstellen, bereitzustellen und zu integrieren. AWS und NVIDIA haben sich zusammengetan, um diese Vision Wirklichkeit werden zu lassen. AWS, NVIDIA und andere Partner Erstellen Sie Anwendungen und Lösungen, um das Gesundheitswesen durch die Beschleunigung der Cloud-Konnektivität der Unternehmensbildgebung zugänglicher, erschwinglicher und effizienter zu machen. MONAI-Bereitstellung ist eines der Schlüsselmodule darin MONAI (Medical Open Network for Artificial Intelligence), entwickelt von einem Konsortium aus führenden Wissenschaftlern und Branchenführern, darunter NVIDIA. AWS HealthImaging (AHI) ist ein HIPAA-zugelassener, hoch skalierbarer, leistungsstarker und kostengünstiger Shop für medizinische Bilder. Wir haben einen MONAI Deploy-Connector für AHI entwickelt, um medizinische Bildgebungs-KI-Anwendungen mit Bildabruflatenzen von weniger als einer Sekunde in großem Maßstab zu integrieren, der durch Cloud-native APIs unterstützt wird. Die MONAI AI-Modelle und -Anwendungen können auf gehostet werden Amazon Sage Maker, ein vollständig verwalteter Dienst zur Bereitstellung von Modellen für maschinelles Lernen (ML) in großem Maßstab. SageMaker kümmert sich um die Einrichtung und Verwaltung von Inferenzinstanzen und stellt integrierte Metriken und Protokolle für Endpunkte bereit, die Sie zur Überwachung und zum Empfang von Warnungen verwenden können. Es bietet auch eine Vielzahl von NVIDIA GPU-Instanzen für ML-Inferenz sowie mehrere Modellbereitstellungsoptionen mit automatischer Skalierung, einschließlich Echtzeit-Inferenz, Serverlose Schlussfolgerung, asynchrone Inferenz und Batch-Transformation.

In diesem Beitrag zeigen wir, wie Sie ein MONAI-Anwendungspaket (MAP) mit dem Connector zu AWS HealthImaging bereitstellen und dabei einen SageMaker-Multimodell-Endpunkt für Echtzeit-Inferenz und asynchrone Inferenz verwenden. Diese beiden Optionen decken einen Großteil der Anwendungsfälle der Inferenzpipeline für medizinische Bildgebung nahezu in Echtzeit ab.

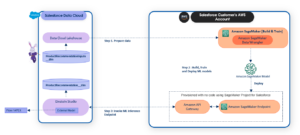

Lösungsüberblick

Das folgende Diagramm zeigt die Lösungsarchitektur.

Voraussetzungen:

Führen Sie die folgenden erforderlichen Schritte aus:

- Verwenden Sie ein AWS-Konto in einer der folgenden Regionen, in denen AWS HealthImaging verfügbar ist: North Virginia (

us-east-1), Oregon (us-west-2), Irland (eu-west-1) und Sydney (ap-southeast-2). - Erstellen Sie ein Amazon SageMaker-Studio Domäne und Benutzerprofil mit AWS Identity and Access Management and (IAM)-Berechtigung für den Zugriff auf AWS HealthImaging.

- Aktivieren Sie die JupyterLab v3-Erweiterung und installieren Sie die Imjoy-Jupyter-Erweiterung, wenn Sie medizinische Bilder interaktiv auf dem SageMaker-Notebook visualisieren möchten itwwidgets.

MAP-Connector zu AWS HealthImaging

AWS HealthImaging importiert DICOM P10-Dateien und konvertiert sie in ImageSets, die eine optimierte Darstellung einer DICOM-Serie darstellen. AHI bietet API-Zugriff auf ImageSet-Metadaten und ImageFrames. Metadaten enthalten alle DICOM-Attribute in einem JSON-Dokument. ImageFrames werden codiert zurückgegeben JPEG2000 mit hohem Durchsatz (HTJ2K) verlustfreies Format, das extrem schnell dekodiert werden kann. ImageSets können mithilfe von abgerufen werden AWS-Befehlszeilenschnittstelle (AWS CLI) oder die AWS-SDKs.

MONAI ist ein KI-Framework für die medizinische Bildgebung, das Forschungsdurchbrüche und KI-Anwendungen in die klinische Praxis umsetzt. MONAI Deploy ist die Verarbeitungspipeline, die den End-to-End-Workflow ermöglicht, einschließlich Packen, Testen, Bereitstellen und Ausführen von KI-Anwendungen für die medizinische Bildgebung in der klinischen Produktion. Es umfasst die MONAI App-SDK bereitstellen, MONAI Deploy Express, Workflow Manager und Informatik-Gateway. Das MONAI Deploy App SDK bietet gebrauchsfertige Algorithmen und ein Framework zur Beschleunigung der Erstellung von KI-Anwendungen für die medizinische Bildgebung sowie Hilfstools zum Packen der Anwendung in einen MAP-Container. Die integrierten standardbasierten Funktionen im App-SDK ermöglichen eine reibungslose Integration des MAP in Gesundheits-IT-Netzwerke, was die Verwendung von Standards wie DICOM, HL7 und FHIR erfordert, sowie in Rechenzentrums- und Cloud-Umgebungen. MAPs können sowohl vordefinierte als auch benutzerdefinierte Operatoren zum Laden von DICOM-Bildern, zur Serienauswahl, zur Modellinferenz und zur Nachbearbeitung verwenden

Wir haben eine entwickelt Python-Modul unter Verwendung des AWS HealthImaging Python SDK Boto3. Sie können es per PIP installieren und die Hilfsfunktion verwenden, um DICOM Service-Object Pair (SOP)-Instanzen wie folgt abzurufen:

!pip install -q AHItoDICOMInterface

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

helper = AHItoDICOM()

instances = helper.DICOMizeImageSet(datastore_id=datastoreId , image_set_id=next(iter(imageSetIds)))Die ausgegebenen SOP-Instanzen können im Folgenden mit dem interaktiven 3D-medizinischen Bildbetrachter itkwidgets visualisiert werden Notizbuchdem „Vermischten Geschmack“. Seine AHItoDICOM Die Klasse nutzt mehrere Prozesse, um Pixelbilder parallel von AWS HealthImaging abzurufen dekodieren HTJ2K-Binärblobs Verwendung der Python OpenJPEG-Bibliothek. Die ImageSetIds stammen aus den Ausgabedateien eines bestimmten AWS HealthImaging-Importauftrags. Mit der DatastoreId und der Import JobId können Sie die ImageSetId, die der UID der DICOM-Serieninstanz entspricht, wie folgt abrufen:

imageSetIds = {}

try: response = s3.head_object(Bucket=OutputBucketName, Key=f"output/{res_createstore['datastoreId']}-DicomImport-{res_startimportjob['jobId']}/job-output-manifest.json") if response['ResponseMetadata']['HTTPStatusCode'] == 200: data = s3.get_object(Bucket=OutputBucketName, Key=f"output/{res_createstore['datastoreId']}-DicomImport-{res_startimportjob['jobId']}/SUCCESS/success.ndjson") contents = data['Body'].read().decode("utf-8") for l in contents.splitlines(): isid = json.loads(l)['importResponse']['imageSetId'] if isid in imageSetIds: imageSetIds[isid]+=1 else: imageSetIds[isid]=1

except ClientError: passMit ImageSetId können Sie die DICOM-Header-Metadaten und Bildpixel mithilfe nativer AWS HealthImaging-API-Funktionen separat abrufen. Der DICOM-Exporter-Aggregate die DICOM-Header und Bildpixel in die Pydicom Datensatz, der von der verarbeitet werden kann MAP DICOM-Datenladeoperator. Mit der Funktion DICOMizeImageSet() haben wir einen Connector zum Laden von Bilddaten von AWS HealthImaging basierend auf dem MAP erstellt DICOM-Datenlader-Operator:

class AHIDataLoaderOperator(Operator): def __init__(self, ahi_client, must_load: bool = True, *args, **kwargs): self.ahi_client = ahi_client … def _load_data(self, input_obj: string): study_dict = {} series_dict = {} sop_instances = self.ahi_client.DICOMizeImageSet(input_obj['datastoreId'], input_obj['imageSetId'])Im vorhergehenden Code ahi_client ist eine Instanz der DICOM-Exportklasse AHItoDICOM mit veranschaulichten Datenabruffunktionen. Wir haben diesen neuen Datenlader-Operator in a integriert 3D-KI-Anwendung zur Milzsegmentierung, erstellt mit dem MONAI Deploy App SDK. Sie können zunächst erkunden, wie Sie diese Anwendung erstellen und ausführen auf einer lokalen Notebook-Instanz, und stellen Sie diese MAP-Anwendung dann in von SageMaker verwalteten Inferenzendpunkten bereit.

SageMaker asynchrone Inferenz

Ein SageMaker asynchrone Inferenz Der Endpunkt wird für Anfragen mit großen Nutzlastgrößen (bis zu 1 GB), langen Verarbeitungszeiten (bis zu 15 Minuten) und Latenzanforderungen nahezu in Echtzeit verwendet. Wenn keine Anfragen verarbeitet werden müssen, kann diese Bereitstellungsoption die Instanzanzahl auf Null reduzieren, um Kosten zu sparen, was ideal für ML-Inferenz-Workloads in der medizinischen Bildgebung ist. Befolgen Sie die Schritte im Beispiel Notizbuch um den asynchronen SageMaker-Inferenzendpunkt zu erstellen und aufzurufen. Zu Erstellen Sie einen asynchronen Inferenzendpunkt, müssen Sie zunächst ein SageMaker-Modell und eine Endpunktkonfiguration erstellen. Um ein SageMaker-Modell zu erstellen, müssen Sie ein model.tar.gz-Paket mit a laden definierte Verzeichnisstruktur in einen Docker-Container. Das Paket „model.tar.gz“ enthält eine vorab trainierte Datei „model.ts“ für die Milzsegmentierung und eine angepasste Datei „inference.py“. Wir haben einen vorgefertigten Container mit den Framework-Versionen Python 3.8 und PyTorch 1.12.1 verwendet, um das Modell zu laden und Vorhersagen auszuführen.

Im kundenspezifischen inference.py In der Datei instanziieren wir eine AHItoDICOM-Hilfsklasse aus AHItoDICOMInterface und erstellen damit eine MAP-Instanz in der Datei model_fn() Funktion, und wir führen die MAP-Anwendung bei jeder Inferenzanforderung in der aus predict_fn() Funktion:

from app import AISpleenSegApp

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

helper = AHItoDICOM()

def model_fn(model_dir, context): … monai_app_instance = AISpleenSegApp(helper, do_run=False,path="/home/model-server") def predict_fn(input_data, model): with open('/home/model-server/inputImageSets.json', 'w') as f: f.write(json.dumps(input_data)) output_folder = "/home/model-server/output" if not os.path.exists(output_folder): os.makedirs(output_folder) model.run(input='/home/model-server/inputImageSets.json', output=output_folder, workdir='/home/model-server', model='/opt/ml/model/model.ts')Zu Rufen Sie den asynchronen Endpunkt auf, müssen Sie die Nutzlast der Anforderungseingabe hochladen Amazon Simple Storage-Service (Amazon S3), eine JSON-Datei, die die AWS HealthImaging-Datenspeicher-ID und ImageSet-ID für die Ausführung der Inferenz angibt:

sess = sagemaker.Session()

InputLocation = sess.upload_data('inputImageSets.json', bucket=sess.default_bucket(), key_prefix=prefix, extra_args={"ContentType": "application/json"})

response = runtime_sm_client.invoke_endpoint_async(EndpointName=endpoint_name, InputLocation=InputLocation, ContentType="application/json", Accept="application/json")

output_location = response["OutputLocation"]Die Ausgabe ist auch in Amazon S3 zu finden.

SageMaker-Echtzeitinferenz mit mehreren Modellen

SageMaker Echtzeit-Inferenz Endpunkte erfüllen interaktive Anforderungen mit geringer Latenz. Mit dieser Option können mehrere Modelle in einem Container hinter einem Endpunkt gehostet werden. Dies ist eine skalierbare und kostengünstige Lösung für die Bereitstellung mehrerer ML-Modelle. A Der SageMaker-Multimodell-Endpunkt verwendet NVIDIA Triton Inference Server mit GPU, um mehrere Deep-Learning-Modellinferenzen auszuführen.

In diesem Abschnitt erfahren Sie, wie Sie einen Endpunkt mit mehreren Modellen erstellen und aufrufen Anpassen Ihres eigenen Inferenzcontainers im Folgenden Beispiel Notizbuch. Verschiedene Modelle können in einem gemeinsamen Container auf derselben Ressourcenflotte bereitgestellt werden. Endpunkte mit mehreren Modellen reduzieren den Bereitstellungsaufwand und skalieren Modellinferenzen basierend auf den Verkehrsmustern zum Endpunkt. Wir verwendeten AWS-Entwicklertools einschließlich Amazon CodeCommit, Amazon CodeBuild und Amazon CodePipeline zu bauen der maßgeschneiderte Container für die SageMaker-Modellinferenz. Wir haben eine vorbereitet model_handler.py um Ihren eigenen Container anstelle der Datei inference.py im vorherigen Beispiel mitzubringen und die Funktionen initialize(), preprocess() und inference() zu implementieren:

from app import AISpleenSegApp

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

class ModelHandler(object): def __init__(self): self.initialized = False self.shapes = None def initialize(self, context): self.initialized = True properties = context.system_properties model_dir = properties.get("model_dir") gpu_id = properties.get("gpu_id") helper = AHItoDICOM() self.monai_app_instance = AISpleenSegApp(helper, do_run=False, path="/home/model-server/") def preprocess(self, request): inputStr = request[0].get("body").decode('UTF8') datastoreId = json.loads(inputStr)['inputs'][0]['datastoreId'] imageSetId = json.loads(inputStr)['inputs'][0]['imageSetId'] with open('/tmp/inputImageSets.json', 'w') as f: f.write(json.dumps({"datastoreId": datastoreId, "imageSetId": imageSetId})) return '/tmp/inputImageSets.json' def inference(self, model_input): self.monai_app_instance.run(input=model_input, output="/home/model-server/output/", workdir="/home/model-server/", model=os.environ["model_dir"]+"/model.ts")Nachdem der Container gebaut und geschoben wurde Amazon Elastic Container-Registrierung (Amazon ECR) können Sie damit ein SageMaker-Modell sowie verschiedene Modellpakete (tar.gz-Dateien) in einem bestimmten Amazon S3-Pfad erstellen:

model_name = "DEMO-MONAIDeployModel" + strftime("%Y-%m-%d-%H-%M-%S", gmtime())

model_url = "s3://{}/{}/".format(bucket, prefix)

container = "{}.dkr.ecr.{}.amazonaws.com/{}:dev".format( account_id, region, prefix )

container = {"Image": container, "ModelDataUrl": model_url, "Mode": "MultiModel"}

create_model_response = sm_client.create_model(ModelName=model_name, ExecutionRoleArn=role, PrimaryContainer=container)Es ist bemerkenswert, dass die model_url Hier wird nur der Pfad zu einem Ordner mit tar.gz-Dateien angegeben, und Sie geben an, welches Modellpaket für die Inferenz verwendet werden soll, wenn Sie den Endpunkt aufrufen, wie im folgenden Code gezeigt:

Payload = {"inputs": [ {"datastoreId": datastoreId, "imageSetId": next(iter(imageSetIds))} ]}

response = runtime_sm_client.invoke_endpoint(EndpointName=endpoint_name, ContentType="application/json", Accept="application/json", TargetModel="model.tar.gz", Body=json.dumps(Payload))Wir können dem vorhandenen Multimodell-Inferenzendpunkt weitere Modelle hinzufügen, ohne den Endpunkt aktualisieren oder einen neuen erstellen zu müssen.

Aufräumen

Vergiss nicht das auszufüllen Löschen Sie die Hosting-Ressourcen Schritt in die Labor-3 und Labor-4 Notebooks, um die SageMaker-Inferenzendpunkte zu löschen. Sie sollten die SageMaker-Notebook-Instanz ebenfalls ablehnen, um Kosten zu sparen. Schließlich können Sie entweder die AWS HealthImaging-API-Funktion aufrufen oder die AWS HealthImaging-Konsole verwenden, um die zuvor erstellten Bildsätze und Datenspeicher zu löschen:

for s in imageSetIds.keys(): medicalimaging.deleteImageSet(datastoreId, s)

medicalimaging.deleteDatastore(datastoreId)Zusammenfassung

In diesem Beitrag haben wir Ihnen gezeigt, wie Sie einen MAP-Connector zu AWS HealthImaging erstellen, der in Anwendungen, die mit dem MONAI Deploy App SDK erstellt wurden, wiederverwendbar ist, um den Abruf von Bilddaten aus einem Cloud-nativen DICOM-Speicher in KI-Workloads für medizinische Bildgebung zu integrieren und zu beschleunigen . Das MONAI Deploy SDK kann zur Unterstützung des Krankenhausbetriebs verwendet werden. Wir haben außerdem zwei Hosting-Optionen für die Bereitstellung von MAP-KI-Anwendungen auf SageMaker in großem Maßstab demonstriert.

Gehen Sie die Beispielnotizbücher im durch GitHub-Repository um mehr darüber zu erfahren, wie Sie MONAI-Anwendungen auf SageMaker mit in AWS HealthImaging gespeicherten medizinischen Bildern bereitstellen. Um zu erfahren, was AWS für Sie tun kann, wenden Sie sich an AWS-Vertreter.

Weitere Ressourcen finden Sie hier:

Über die Autoren

Ming (Melvin) Qin ist ein unabhängiger Mitarbeiter im Healthcare-Team von NVIDIA, der sich auf die Entwicklung eines KI-Inferenzanwendungs-Frameworks und einer Plattform konzentriert, um KI in medizinische Bildgebungs-Workflows zu integrieren. Bevor Ming 2018 als Gründungsmitglied von Clara zu NVIDIA kam, entwickelte er 15 Jahre lang Radiologie-PACS und Workflow-SaaS als leitender Ingenieur/Architekt bei Stentor Inc., das später von Philips Healthcare übernommen wurde, um sein Enterprise Imaging zu gründen.

Ming (Melvin) Qin ist ein unabhängiger Mitarbeiter im Healthcare-Team von NVIDIA, der sich auf die Entwicklung eines KI-Inferenzanwendungs-Frameworks und einer Plattform konzentriert, um KI in medizinische Bildgebungs-Workflows zu integrieren. Bevor Ming 2018 als Gründungsmitglied von Clara zu NVIDIA kam, entwickelte er 15 Jahre lang Radiologie-PACS und Workflow-SaaS als leitender Ingenieur/Architekt bei Stentor Inc., das später von Philips Healthcare übernommen wurde, um sein Enterprise Imaging zu gründen.

David Bericat ist Produktmanager für das Gesundheitswesen bei NVIDIA, wo er die Arbeitsgruppe Project MONAI Deploy leitet, um KI von der Forschung in den klinischen Einsatz zu bringen. Seine Leidenschaft ist es, Gesundheitsinnovationen weltweit voranzutreiben und sie in echte klinische Auswirkungen umzusetzen. Zuvor arbeitete David bei Red Hat und implementierte Open-Source-Prinzipien an der Schnittstelle von KI, Cloud, Edge Computing und IoT. Zu seinen stolzesten Momenten zählen die Wanderung zum Everest-Basislager und das Fußballspielen seit über 20 Jahren.

David Bericat ist Produktmanager für das Gesundheitswesen bei NVIDIA, wo er die Arbeitsgruppe Project MONAI Deploy leitet, um KI von der Forschung in den klinischen Einsatz zu bringen. Seine Leidenschaft ist es, Gesundheitsinnovationen weltweit voranzutreiben und sie in echte klinische Auswirkungen umzusetzen. Zuvor arbeitete David bei Red Hat und implementierte Open-Source-Prinzipien an der Schnittstelle von KI, Cloud, Edge Computing und IoT. Zu seinen stolzesten Momenten zählen die Wanderung zum Everest-Basislager und das Fußballspielen seit über 20 Jahren.

Brad Genereaux ist Global Lead, Healthcare Alliances bei NVIDIA, wo er für Entwicklerbeziehungen mit Schwerpunkt auf medizinischer Bildgebung verantwortlich ist, um künstliche Intelligenz und Deep Learning, Visualisierung, Virtualisierung und Analyselösungen zu beschleunigen. Brad vertritt die allgegenwärtige Einführung und Integration nahtloser Arbeitsabläufe im Gesundheitswesen und in der medizinischen Bildgebung in die alltägliche klinische Praxis und verfügt über mehr als 20 Jahre Erfahrung in der Gesundheits-IT.

Brad Genereaux ist Global Lead, Healthcare Alliances bei NVIDIA, wo er für Entwicklerbeziehungen mit Schwerpunkt auf medizinischer Bildgebung verantwortlich ist, um künstliche Intelligenz und Deep Learning, Visualisierung, Virtualisierung und Analyselösungen zu beschleunigen. Brad vertritt die allgegenwärtige Einführung und Integration nahtloser Arbeitsabläufe im Gesundheitswesen und in der medizinischen Bildgebung in die alltägliche klinische Praxis und verfügt über mehr als 20 Jahre Erfahrung in der Gesundheits-IT.

Gang-Fu ist Healthcare Solutions Architect bei AWS. Er hat einen Doktortitel in Pharmazeutik von der University of Mississippi und verfügt über mehr als 10 Jahre Erfahrung in der Technologie- und biomedizinischen Forschung. Seine Leidenschaft gilt der Technologie und den Auswirkungen, die sie auf das Gesundheitswesen haben kann.

Gang-Fu ist Healthcare Solutions Architect bei AWS. Er hat einen Doktortitel in Pharmazeutik von der University of Mississippi und verfügt über mehr als 10 Jahre Erfahrung in der Technologie- und biomedizinischen Forschung. Seine Leidenschaft gilt der Technologie und den Auswirkungen, die sie auf das Gesundheitswesen haben kann.

JP Leger ist Senior Solutions Architect und unterstützt akademische medizinische Zentren und medizinische Bildgebungs-Workflows bei AWS. Er verfügt über mehr als 20 Jahre Erfahrung in den Bereichen Softwareentwicklung, Gesundheits-IT und medizinische Bildgebung und verfügt über umfassende Erfahrung in der Architektur von Systemen für Leistung, Skalierbarkeit und Sicherheit bei verteilten Bereitstellungen großer Datenmengen vor Ort, in der Cloud und hybrid mit Analysen und KI .

JP Leger ist Senior Solutions Architect und unterstützt akademische medizinische Zentren und medizinische Bildgebungs-Workflows bei AWS. Er verfügt über mehr als 20 Jahre Erfahrung in den Bereichen Softwareentwicklung, Gesundheits-IT und medizinische Bildgebung und verfügt über umfassende Erfahrung in der Architektur von Systemen für Leistung, Skalierbarkeit und Sicherheit bei verteilten Bereitstellungen großer Datenmengen vor Ort, in der Cloud und hybrid mit Analysen und KI .

Chris Hafey ist Principal Solutions Architect bei Amazon Web Services. Er verfügt über mehr als 25 Jahre Erfahrung in der medizinischen Bildgebungsbranche und ist auf den Aufbau skalierbarer Hochleistungssysteme spezialisiert. Er ist der Schöpfer des beliebten Open-Source-Projekts CornerstoneJS, das den beliebten OHIF-Open-Source-Zero-Footprint-Viewer unterstützt. Er hat zur DICOMweb-Spezifikation beigetragen und arbeitet weiterhin daran, deren Leistung für die webbasierte Anzeige zu verbessern.

Chris Hafey ist Principal Solutions Architect bei Amazon Web Services. Er verfügt über mehr als 25 Jahre Erfahrung in der medizinischen Bildgebungsbranche und ist auf den Aufbau skalierbarer Hochleistungssysteme spezialisiert. Er ist der Schöpfer des beliebten Open-Source-Projekts CornerstoneJS, das den beliebten OHIF-Open-Source-Zero-Footprint-Viewer unterstützt. Er hat zur DICOMweb-Spezifikation beigetragen und arbeitet weiterhin daran, deren Leistung für die webbasierte Anzeige zu verbessern.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/build-a-medical-imaging-ai-inference-pipeline-with-monai-deploy-on-aws/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 10

- 100

- 12

- 15 Jahre

- 15%

- 20

- 20 Jahre

- 200

- 2018

- 25

- 3d

- 7

- 8

- a

- Über Uns

- akademisch

- beschleunigen

- beschleunigend

- Zugang

- zugänglich

- Konto

- erworben

- über

- hinzufügen

- Zusätzliche

- Adoption

- Vorteil

- Ranking

- AI

- KI-Modelle

- Warnmeldungen

- Algorithmen

- Alle

- Allianzen

- erlauben

- ebenfalls

- Amazon

- Amazon Web Services

- an

- Analytik

- und

- Bienen

- API-Zugriff

- APIs

- App

- Anwendung

- Anwendungen

- Architektur

- SIND

- künstlich

- künstliche Intelligenz

- AS

- At

- Attribute

- automatische

- verfügbar

- AWS

- Base

- basierend

- BE

- Bevor

- hinter

- biomedizinische

- Körper

- beide

- Stift

- Durchbrüche

- bringen

- bauen

- Building

- erbaut

- eingebaut

- by

- rufen Sie uns an!

- Das Mrčajevci-Freizeitzentrum

- CAN

- österreichische Unternehmen

- Fälle

- Center

- Centers

- Clara

- Klasse

- Klinische

- Cloud

- Code

- wie die

- abschließen

- inbegriffen

- Computing

- Konfiguration

- Konnektivität

- Konsul (Console)

- Konsortium

- Kontakt

- Container

- enthält

- Inhalt

- Kontext

- weiter

- beigetragen

- Beiträger

- Kosten

- Einsparmaßnahmen

- kostengünstiger

- Kosten

- Abdeckung

- mitgeschrieben

- erstellen

- erstellt

- Schöpfer

- maßgeschneiderte

- technische Daten

- Data Center

- Christian

- tief

- tiefe Lernen

- zeigen

- Synergie

- einsetzen

- Bereitstellen

- Einsatz

- Implementierungen

- Entwickler

- entwickelt

- Entwickler:in / Unternehmen

- Entwickler

- Entwicklung

- anders

- verteilt

- do

- Docker

- Dokument

- nach unten

- Früher

- Edge

- Edge-Computing

- effizient

- entweder

- sonst

- ermöglicht

- End-to-End

- Endpunkt

- Entwicklung

- Unternehmen

- Umgebungen

- Äquivalent

- Everest

- Jedes

- jeden Tag

- Beispiel

- Außer

- vorhandenen

- ERFAHRUNGEN

- Expertise

- ERKUNDEN

- umfangreiche

- Langjährige Erfahrung

- äußerst

- falsch

- FAST

- Reichen Sie das

- Mappen

- Endlich

- Vorname

- FLOTTE

- Setzen Sie mit Achtsamkeit

- konzentriert

- folgen

- Folgende

- folgt

- Fußabdruck

- Aussichten für

- unten stehende Formular

- Format

- gefunden

- Gründung

- Unser Ansatz

- für

- fu

- voll

- Funktion

- Funktionsumfang

- Funktionen

- GitHub

- gegeben

- Global

- Global

- GPU

- Gruppe an

- Hut

- Haben

- mit

- he

- Überschriften

- Gesundheit

- Gesundheitswesen

- hier

- Hohe Leistungsfähigkeit

- hoch

- seine

- hält

- Krankenhaus

- Gastgeber

- gehostet

- Hosting

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- Hybrid

- ID

- ideal

- Identitätsschutz

- if

- zeigt

- Image

- Bilder

- Imaging

- Impact der HXNUMXO Observatorien

- umgesetzt

- Umsetzung

- importieren

- Importe

- Verbesserung

- in

- Inc.

- das

- inklusive

- Dazu gehören

- Einschließlich

- unabhängig

- Energiegewinnung

- Innovation

- Varianten des Eingangssignals:

- Eingänge

- installieren

- Instanz

- beantragen müssen

- integrieren

- Integration

- Intelligenz

- interaktive

- Überschneidung

- in

- iot

- Irland

- IT

- SEINE

- Job

- Beitritt

- jpg

- JSON

- Wesentliche

- Wissen

- grosse

- Latency

- später

- führen

- Führung

- umwandeln

- LERNEN

- lernen

- Line

- Belastung

- Ladeprogramm

- Laden

- aus einer regionalen

- Lang

- Maschine

- Maschinelles Lernen

- Mehrheit

- um

- verwaltet

- Manager

- flächendeckende Gesundheitsprogramme

- Karte

- Landkarten

- sowie medizinische

- Triff

- Mitglied

- Metadaten

- Metrik

- Minuten

- ML

- Model

- Modell

- für

- Module

- Moments

- Überwachen

- mehr

- Multi-Modell-Endpunkt

- mehrere

- nativen

- Need

- Netzwerk

- Netzwerke

- Neu

- nicht

- Andere

- Norden

- Notizbuch

- bemerkenswert

- Nvidia

- Objekt

- of

- Angebote

- on

- EINEM

- einzige

- XNUMXh geöffnet

- offenes Netzwerk

- Open-Source-

- Einkauf & Prozesse

- Operator

- Betreiber

- optimiert

- Option

- Optionen

- or

- Oregon

- OS

- Andere

- Möglichkeiten für das Ausgangssignal:

- übrig

- besitzen

- Paket

- Pakete

- Verpackung

- Paar

- Parallel

- Leidenschaft & KREATIVITÄT

- leidenschaftlich

- Weg

- Muster

- Leistung

- Erlaubnis

- Biowissenschaften

- phd

- Pipeline

- Pixel

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielend

- erfahren

- Beliebt

- Post

- angetriebene

- Kräfte

- Praxis

- Prognosen

- bereit

- früher

- vorher

- Principal

- Grundsätze

- Prozessdefinierung

- Verarbeitet

- anpassen

- Verarbeitung

- Produkt

- Produkt-Manager

- Produktion

- Projekt

- immobilien

- bietet

- geschoben

- Python

- Pytorch

- Echtzeit

- Realität

- erhalten

- Rot

- Red Hat

- Veteran

- siehe

- Region

- Regionen

- Verhältnis

- Darstellung

- Anforderung

- Zugriffe

- Voraussetzungen:

- erfordert

- Forschungsprojekte

- Forscher

- Downloads

- Antwort

- für ihren Verlust verantwortlich.

- Rückkehr

- wiederverwendbar

- Führen Sie

- Laufen

- s

- SaaS

- sagemaker

- SageMaker-Inferenz

- gleich

- Speichern

- Ersparnisse

- Skalierbarkeit

- skalierbaren

- Skalieren

- Skalierung

- Wissenschaft

- Sdk

- nahtlos

- Abschnitt

- Sicherheitdienst

- Segmentierung

- Auswahl

- SELF

- Senior

- Modellreihe

- serviert

- Lösungen

- Sets

- Einstellung

- mehrere

- Formen

- von Locals geführtes

- sollte

- zeigte

- gezeigt

- Einfacher

- Größen

- glatt

- Fußball

- Software

- Softwareentwicklung

- Lösung

- Lösungen

- Quelle

- spezialisiert

- Spezifikation

- verbrachte

- Normen

- Schritt

- Shritte

- Lagerung

- speichern

- gelagert

- Schnur

- so

- Support

- Unterstützung

- Sydney

- Systeme und Techniken

- nimmt

- Team

- Technologie

- Testen

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Dort.

- Diese

- fehlen uns die Worte.

- Durch

- mal

- zu

- gemeinsam

- Werkzeuge

- gegenüber

- der Verkehr

- Triton

- was immer dies auch sein sollte.

- versuchen

- WENDE

- XNUMX

- allgegenwärtig

- Universität

- Aktualisierung

- -

- benutzt

- Mitglied

- verwendet

- Verwendung von

- Nutzen

- Vielfalt

- Versionen

- Besichtigung

- Virginia

- Seh-

- Visualisierung

- visualisieren

- Volumen

- W

- Spaziergang

- wollen

- we

- Netz

- Web-Services

- Webbasiert

- GUT

- Was

- wann

- welche

- werden wir

- mit

- .

- ohne

- Arbeiten

- gearbeitet

- Arbeitsablauf.

- Workflows

- arbeiten,

- Arbeitsgruppe

- Jahr

- Du

- Ihr

- Zephyrnet

- Null