Unternehmen möchten das Potenzial generativer KI schnell erschließen, indem sie verschiedenen Geschäftsbereichen (LOBs) Zugang zu Basismodellen (FMs) bieten. Die IT-Teams sind dafür verantwortlich, das LOB bei der schnellen und flexiblen Innovation zu unterstützen und gleichzeitig eine zentralisierte Governance und Beobachtbarkeit bereitzustellen. Beispielsweise müssen sie möglicherweise die Nutzung von FMs in allen Teams verfolgen, die Kosten für Rückbuchungen nachverfolgen und die relevante Kostenstelle im LOB transparent machen. Darüber hinaus müssen sie möglicherweise den Zugriff auf verschiedene Modelle pro Team regeln. Beispielsweise wenn nur bestimmte FMs zur Nutzung freigegeben werden dürfen.

Amazonas Grundgestein ist ein vollständig verwalteter Dienst, der über eine einzige API eine Auswahl leistungsstarker Basismodelle von führenden KI-Unternehmen wie AI21 Labs, Anthropic, Cohere, Meta, Stability AI und Amazon sowie eine breite Palette von Funktionen zum Aufbau generativer KI bietet Anwendungen mit Sicherheit, Datenschutz und verantwortungsvoller KI. Da Amazon Bedrock serverlos ist, müssen Sie keine Infrastruktur verwalten und können mithilfe der AWS-Services, mit denen Sie bereits vertraut sind, generative KI-Funktionen sicher in Ihre Anwendungen integrieren und bereitstellen.

Eine Software-as-a-Service-Schicht (SaaS) für Basismodelle kann eine einfache und konsistente Schnittstelle für Endbenutzer bereitstellen und gleichzeitig eine zentralisierte Steuerung des Zugriffs und der Nutzung aufrechterhalten. API-Gateways können eine lose Kopplung zwischen Modellkonsumenten und dem Modellendpunktdienst sowie Flexibilität zur Anpassung an sich ändernde Modelle, Architekturen und Aufrufmethoden bieten.

In diesem Beitrag zeigen wir Ihnen, wie Sie eine interne SaaS-Schicht aufbauen, um mit Amazon Bedrock in einer mandantenfähigen (Team-)Architektur auf Basismodelle zuzugreifen. Wir konzentrieren uns insbesondere auf die Nutzungs- und Kostenverfolgung pro Mandant sowie auf Kontrollen wie die Nutzungsdrosselung pro Mandant. Wir beschreiben, wie die Lösung und die Amazon Bedrock-Verbrauchspläne dem allgemeinen SaaS-Journey-Framework zugeordnet werden. Der Code für die Lösung und ein AWS Cloud-Entwicklungskit Die Vorlage (AWS CDK) ist im verfügbar GitHub-Repository.

Herausforderungen

Ein KI-Plattformadministrator muss mehreren Entwicklungsteams einen standardisierten und einfachen Zugriff auf FMs ermöglichen.

Im Folgenden sind einige der Herausforderungen aufgeführt, die es bei der Bereitstellung eines kontrollierten Zugriffs auf Stiftungsmodelle zu bewältigen gilt:

- Kosten- und Nutzungsverfolgung – Verfolgen und prüfen Sie die Kosten einzelner Mieter und die Nutzung von Stiftungsmodellen und stellen Sie Rückbuchungskosten für bestimmte Kostenstellen bereit

- Budget- und Nutzungskontrollen – Verwalten Sie API-Kontingente, Budgets und Nutzungsbeschränkungen für die zulässige Nutzung von Basismodellen über eine definierte Häufigkeit pro Mandant

- Zugriffskontrolle und Modellverwaltung – Definieren Sie Zugriffskontrollen für bestimmte zugelassene Modelle pro Mandant

- Standardisierte Multi-Tenant-API – Bieten Sie konsistenten Zugriff auf Fundamentmodelle mit OpenAPI Normen

- Zentralisierte Verwaltung der API – Stellen Sie eine einzige Ebene zur Verwaltung von API-Schlüsseln für den Zugriff auf Modelle bereit

- Modellversionen und Updates – Abwicklung der Rollouts neuer und aktualisierter Modellversionen

Lösungsüberblick

In dieser Lösung beziehen wir uns auf a mandantenfähig Ansatz. EIN Mieter Hier kann es sich um einen einzelnen Benutzer, ein bestimmtes Projekt, ein Team oder sogar eine ganze Abteilung handeln. Während wir den Ansatz diskutieren, verwenden wir den Begriff Team, weil es am häufigsten vorkommt. Wir verwenden API-Schlüssel, um den API-Zugriff für Teams einzuschränken und zu überwachen. Jedem Team wird ein API-Schlüssel für den Zugriff auf die FMs zugewiesen. In einer Organisation können verschiedene Mechanismen zur Benutzerauthentifizierung und -autorisierung eingesetzt werden. Der Einfachheit halber beziehen wir diese nicht in diese Lösung ein. Sie können mit dieser Lösung auch bestehende Identitätsanbieter integrieren.

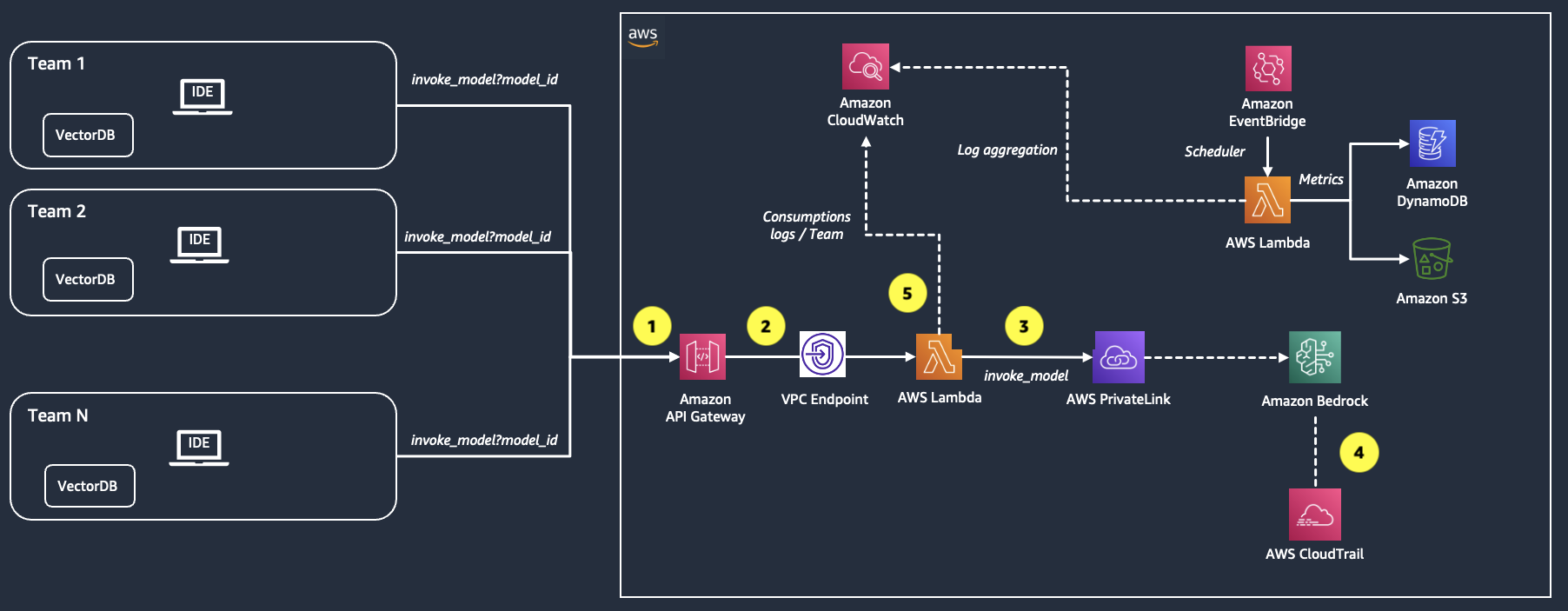

Das folgende Diagramm fasst die Lösungsarchitektur und die Schlüsselkomponenten zusammen. Teams (Mandanten), die separaten Kostenstellen zugewiesen sind, nutzen Amazon Bedrock FMs über einen API-Service. Um den Verbrauch und die Kosten pro Team zu verfolgen, protokolliert die Lösung Daten für jeden einzelnen Aufruf, einschließlich des aufgerufenen Modells, der Anzahl der Token für Textgenerierungsmodelle und der Bildabmessungen für multimodale Modelle. Darüber hinaus werden die Aufrufe pro Modell und die Kosten jedes Teams zusammengefasst.

![]()

Sie können die Lösung mithilfe des AWS CDK in Ihrem eigenen Konto bereitstellen. AWS CDK ist ein Open-Source-Softwareentwicklungsframework zur Modellierung und Bereitstellung Ihrer Cloud-Anwendungsressourcen mithilfe vertrauter Programmiersprachen. Der AWS CDK-Code ist im verfügbar GitHub-Repository.

In den folgenden Abschnitten gehen wir ausführlicher auf die Schlüsselkomponenten der Lösung ein.

Erfassen der Nutzung des Foundation-Modells pro Team

Der Workflow zur Erfassung der FM-Nutzung pro Team besteht aus den folgenden Schritten (wie im vorherigen Diagramm nummeriert):

- Die Anwendung eines Teams sendet eine POST-Anfrage an Amazon API-Gateway mit dem Modell, das im aufgerufen werden soll

model_idAbfrageparameter und die Benutzeraufforderung im Anforderungstext. - API Gateway leitet die Anfrage an eine weiter AWS Lambda Funktion (

bedrock_invoke_model), der für die Protokollierung der Teamnutzungsinformationen verantwortlich ist Amazon CloudWatch und unter Berufung auf das Amazon-Bedrock-Modell. - Amazon Bedrock stellt einen VPC-Endpunkt bereit, der von unterstützt wird AWS PrivateLink. In dieser Lösung sendet die Lambda-Funktion die Anfrage mithilfe von PrivateLink an Amazon Bedrock, um eine private Verbindung zwischen der VPC in Ihrem Konto und dem Amazon Bedrock-Dienstkonto herzustellen. Weitere Informationen zu PrivateLink finden Sie unter Verwenden Sie AWS PrivateLink, um einen privaten Zugriff auf Amazon Bedrock einzurichten.

- Nach der Amazon-Bedrock-Beschwörung Amazon CloudTrail erzeugt a CloudTrail-Ereignis.

- Wenn der Amazon Bedrock-Aufruf erfolgreich ist, protokolliert die Lambda-Funktion je nach Typ des aufgerufenen Modells die folgenden Informationen und gibt die generierte Antwort an die Anwendung zurück:

- team_id – Die eindeutige Kennung für das Team, das die Anfrage stellt.

- Anfrage ID – Die eindeutige Kennung der Anfrage.

- model_id – Die ID des aufzurufenden Modells.

- EingabeTokens – Die Anzahl der Token, die als Teil der Eingabeaufforderung an das Modell gesendet werden (für Textgenerierungs- und Einbettungsmodelle).

- AusgabeTokens – Die maximale Anzahl der vom Modell generierten Token (für Textgenerierungsmodelle).

- Höhe – Die Höhe des angeforderten Bildes (für multimodale Modelle und multimodale Einbettungsmodelle).

- Breite – Die Breite des angeforderten Bildes (nur für multimodale Modelle).

- Schritte – Die angeforderten Schritte (für Stabilitäts-KI-Modelle).

Verfolgung der Kosten pro Team

Ein anderer Ablauf aggregiert die Nutzungsinformationen und berechnet und speichert dann täglich die On-Demand-Kosten pro Team. Durch einen separaten Ablauf stellen wir sicher, dass die Kostenverfolgung keinen Einfluss auf die Latenz und den Durchsatz des Modellaufrufablaufs hat. Die Workflow-Schritte sind wie folgt:

- An Amazon EventBridge Regel löst eine Lambda-Funktion aus (

bedrock_cost_tracking) Täglich. - Die Lambda-Funktion ruft die Nutzungsinformationen von CloudWatch für den Vortag ab, berechnet die damit verbundenen Kosten und speichert die von aggregierten Daten

team_idundmodel_idin Amazon Simple Storage-Service (Amazon S3) im CSV-Format.

Um die in Amazon S3 gespeicherten Daten abzufragen und zu visualisieren, haben Sie verschiedene Möglichkeiten, u.a S3 auswählen und Amazon Athena und Amazon QuickSight.

Kontrolle der Nutzung pro Team

Ein Nutzungsplan gibt an, wer auf eine oder mehrere bereitgestellte APIs zugreifen kann, und legt optional die Zielanfragerate fest, um mit der Drosselung von Anfragen zu beginnen. Der Plan verwendet API-Schlüssel, um API-Clients zu identifizieren, die für jeden Schlüssel auf die zugehörige API zugreifen können. Sie können API Gateway verwenden Nutzungspläne um Anfragen zu drosseln, die vordefinierte Schwellenwerte überschreiten. Sie können auch verwenden API-Schlüssel und Kontingentgrenzen, mit denen Sie die maximale Anzahl von Anfragen pro API-Schlüssel festlegen können, die jedes Team innerhalb eines bestimmten Zeitintervalls stellen darf. Dies ist zusätzlich zu Amazon Bedrock-Servicekontingente die nur auf Kontoebene zugewiesen werden.

Voraussetzungen:

Stellen Sie vor der Bereitstellung der Lösung sicher, dass Sie über Folgendes verfügen:

Stellen Sie den AWS CDK-Stack bereit

Befolgen Sie die Anweisungen in der README Datei des GitHub-Repositorys zum Konfigurieren und Bereitstellen des AWS CDK-Stacks.

Der Stack stellt die folgenden Ressourcen bereit:

- Private Netzwerkumgebung (VPC, private Subnetze, Sicherheitsgruppe)

- IAM-Rolle zur Steuerung des Modellzugriffs

- Lambda-Layer für die notwendigen Python-Module

- Lambda-Funktion

invoke_model - Lambda-Funktion

list_foundation_models - Lambda-Funktion

cost_tracking - Rest-API (API-Gateway)

- API-Gateway-Nutzungsplan

- API-Schlüssel, der dem Nutzungsplan zugeordnet ist

Nehmen Sie ein neues Team an Bord

Um neuen Teams Zugriff zu gewähren, können Sie entweder denselben API-Schlüssel für verschiedene Teams freigeben und den Modellverbrauch verfolgen, indem Sie einen anderen bereitstellen team_id für den API-Aufruf oder erstellen Sie dedizierte API-Schlüssel für den Zugriff auf Amazon Bedrock-Ressourcen, indem Sie den Anweisungen im folgen README.

Der Stack stellt die folgenden Ressourcen bereit:

- API-Gateway-Nutzungsplan, der der zuvor erstellten REST-API zugeordnet ist

- API-Schlüssel, der dem Nutzungsplan für das neue Team zugeordnet ist, mit reservierten Drosselungs- und Burst-Konfigurationen für die API

Weitere Informationen zur API-Gateway-Drosselung und Burst-Konfigurationen finden Sie unter Drosseln Sie API-Anfragen für einen besseren Durchsatz.

Nachdem Sie den Stack bereitgestellt haben, können Sie sehen, dass der neue API-Schlüssel für team-2 wird ebenfalls erstellt.

![]()

Konfigurieren Sie die Modellzugriffskontrolle

Der Plattformadministrator kann den Zugriff auf bestimmte Basismodelle zulassen, indem er die der Lambda-Funktion zugeordnete IAM-Richtlinie bearbeitet invoke_modeldem „Vermischten Geschmack“. Seine

IAM-Berechtigungen werden in der Datei definiert setup/stack_constructs/iam.py. Siehe folgenden Code:

Rufen Sie den Dienst auf

Nachdem Sie die Lösung bereitgestellt haben, können Sie den Dienst direkt über Ihren Code aufrufen. Die folgende

ist ein Beispiel in Python für den Konsum von invoke_model API zur Textgenerierung durch eine POST-Anfrage:

Ausgabe: Amazon Bedrock ist eine interne Technologieplattform, die von Amazon entwickelt wurde, um viele seiner Dienste und Produkte auszuführen und zu betreiben. Einige wichtige Dinge über Bedrock …

Das Folgende ist ein weiteres Beispiel in Python für die Verwendung von invoke_model API zur Generierung von Einbettungen über eine POST-Anfrage:

model_id = "amazon.titan-embed-text-v1" #the model id for the Amazon Titan Embeddings Text model prompt = "What is Amazon Bedrock?" response = requests.post( f"{api_url}/invoke_model?model_id={model_id}", json={"inputs": prompt, "parameters": model_kwargs}, headers={ "x-api-key": api_key, #key for querying the API "team_id": team_id #unique tenant identifier, "embeddings": "true" #boolean value for the embeddings model }

) text = response.json()[0]["embedding"]

Ausgabe: 0.91796875, 0.45117188, 0.52734375, -0.18652344, 0.06982422, 0.65234375, -0.13085938, 0.056884766, 0.092285156, 0.06982422, 1.03125, 0.8515625, 0.16308594, 0.079589844, -0.033935547, 0.796875, -0.15429688, -0.29882812, -0.25585938, 0.45703125, 0.044921875 0.34570312, XNUMX …

Zugriff auf Fundamentmodelle verweigert

Das Folgende ist ein Beispiel in Python für die Verwendung von invoke_model API zur Textgenerierung durch eine POST-Anfrage mit einer Antwort „Zugriff verweigert“:

„Traceback (letzter Aufruf zuletzt):n Datei „/var/task/index.py“, Zeile 213, in lambda_handlern Antwort = _invoke_text(bedrock_client, model_id, body, model_kwargs)n Datei „/var/task/index.py ”, Zeile 146, in _invoke_textn raise en Datei „/var/task/index.py“, Zeile 131, in _invoke_textn Response = bedrock_client.invoke_model(n Datei ”/opt/python/botocore/client.py“, Zeile 535, in _api_calln return self._make_api_call(operation_name, kwargs)n Datei „/opt/python/botocore/client.py“, Zeile 980, in _make_api_calln raise error_class(parsed_response, operation_name)nbotocore.errorfactory.AccessDeniedException: Beim Aufrufen der InvokeModel-Operation ist ein Fehler aufgetreten (AccessDeniedException): Ihr Konto ist nicht berechtigt, diese API-Operation aufzurufen.n“

Beispiel für eine Kostenschätzung

Beim Aufrufen von Amazon Bedrock-Modellen mit On-Demand-Preisgestaltung werden die Gesamtkosten als Summe der Eingabe- und Ausgabekosten berechnet. Die Eingabekosten basieren auf der Anzahl der an das Modell gesendeten Eingabe-Tokens und die Ausgabekosten basieren auf den generierten Tokens. Die Preise gelten pro 1,000 Input-Tokens und pro 1,000 Output-Tokens. Weitere Einzelheiten und spezifische Modellpreise finden Sie unter Amazon Bedrock-Preise.

Sehen wir uns ein Beispiel an, bei dem zwei Teams, Team1 und Team2, über die Lösung in diesem Beitrag auf Amazon Bedrock zugreifen. Die an einem einzigen Tag in Amazon S3 gespeicherten Nutzungs- und Kostendaten sind in der folgenden Tabelle aufgeführt.

Die Spalten input_tokens und output_tokens Speichern Sie die gesamten Eingabe- und Ausgabetokens über Modellaufrufe pro Modell bzw. pro Team für einen bestimmten Tag.

Die Spalten input_cost und output_cost Hinterlegen Sie die jeweiligen Kosten pro Modell und pro Team. Diese werden nach folgenden Formeln berechnet:

input_cost = input_token_count * model_pricing["input_cost"] / 1000output_cost = output_token_count * model_pricing["output_cost"] / 1000

| team_id | model_id | Eingabetokens | Ausgabetokens | Anrufungen | input_cost | Ausgabekosten |

| Team1 | amazon.titan-tg1-large | 24000 | 2473 | 1000 | 0.0072 | 0.00099 |

| Team1 | anthropic.claude-v2 | 2448 | 4800 | 24 | 0.02698 | 0.15686 |

| Team2 | amazon.titan-tg1-large | 35000 | 52500 | 350 | 0.0105 | 0.021 |

| Team2 | ai21.j2-grande-instruct | 4590 | 9000 | 45 | 0.05738 | 0.1125 |

| Team2 | anthropic.claude-v2 | 1080 | 4400 | 20 | 0.0119 | 0.14379 |

End-to-End-Ansicht einer funktionierenden serverlosen SaaS-Umgebung mit mehreren Mandanten

Lassen Sie uns verstehen, wie eine durchgängig funktionale serverlose SaaS-Umgebung mit mehreren Mandanten aussehen könnte. Das Folgende ist ein Referenzarchitekturdiagramm.

![]()

Dieses Architekturdiagramm ist eine verkleinerte Version des vorherigen Architekturdiagramms, das weiter oben in diesem Beitrag erläutert wurde, wobei das vorherige Architekturdiagramm die Details eines der erwähnten Microservices (Grundmodelldienst) erläutert. In diesem Diagramm wird erläutert, dass Sie neben dem grundlegenden Modelldienst auch andere Komponenten in Ihrer mandantenfähigen SaaS-Plattform benötigen, um eine funktionale und skalierbare Plattform zu implementieren.

Gehen wir die Details der Architektur durch.

Mieteranträge

Die Mandantenanwendungen sind die Front-End-Anwendungen, die mit der Umgebung interagieren. Hier zeigen wir mehrere Mandanten, die von verschiedenen lokalen oder AWS-Umgebungen aus zugreifen. Die Frontend-Anwendungen können um eine Registrierungsseite für neue Mieter zur Selbstregistrierung und eine Admin-Konsole für Administratoren der SaaS-Serviceschicht erweitert werden. Wenn die Mandantenanwendungen die Implementierung einer benutzerdefinierten Logik erfordern, die eine Interaktion mit der SaaS-Umgebung erfordert, können sie die Spezifikationen des Anwendungsadapter-Mikrodienstes implementieren. Beispielszenarien könnten das Hinzufügen einer benutzerdefinierten Autorisierungslogik unter Berücksichtigung der Autorisierungsspezifikationen der SaaS-Umgebung sein.

Geteilte Dienstleistungen

Bei den folgenden Diensten handelt es sich um gemeinsam genutzte Dienste:

- Mieter- und Benutzerverwaltungsdienste –Diese Dienste sind für die Registrierung und Verwaltung der Mieter verantwortlich. Sie stellen die übergreifende Funktionalität bereit, die von den Anwendungsdiensten getrennt ist und von allen Mandanten gemeinsam genutzt wird.

- Stiftungsmodellservice –Das am Anfang dieses Beitrags erläuterte Lösungsarchitekturdiagramm stellt diesen Microservice dar, wobei die Interaktion von API Gateway zu Lambda-Funktionen im Rahmen dieses Microservices erfolgt. Alle Mandanten nutzen diesen Microservice, um die Grundlagenmodelle von Anthropic, AI21, Cohere, Stability, Meta und Amazon sowie fein abgestimmte Modelle aufzurufen. Außerdem werden die für die Nutzungsverfolgung erforderlichen Informationen in CloudWatch-Protokollen erfasst.

- Kostenverfolgungsdienst –Dieser Dienst verfolgt die Kosten und Nutzung für jeden Mieter. Dieser Mikroservice wird nach einem Zeitplan ausgeführt, um die CloudWatch-Protokolle abzufragen und die aggregierte Nutzungsverfolgung und die abgeleiteten Kosten an den Datenspeicher auszugeben. Der Kostenverfolgungsdienst kann erweitert werden, um weitere Berichte und Visualisierungen zu erstellen.

Anwendungsadapterdienst

Dieser Dienst stellt eine Reihe von Spezifikationen und APIs bereit, die ein Mandant implementieren kann, um seine benutzerdefinierte Logik in die SaaS-Umgebung zu integrieren. Abhängig davon, wie viel benutzerdefinierte Integration erforderlich ist, kann diese Komponente für Mandanten optional sein.

Mandantenfähiger Datenspeicher

Die gemeinsam genutzten Dienste speichern ihre Daten in einem Datenspeicher, der ein einzelner gemeinsam genutzter Datenspeicher sein kann Amazon DynamoDB Tabelle mit einem Mandantenpartitionierungsschlüssel, der DynamoDB-Elemente einzelnen Mandanten zuordnet. Der gemeinsam genutzte Kostenverfolgungsdienst gibt die aggregierten Nutzungs- und Kostenverfolgungsdaten an Amazon S3 aus. Je nach Anwendungsfall kann es auch einen anwendungsspezifischen Datenspeicher geben.

Eine mandantenfähige SaaS-Umgebung kann viel mehr Komponenten umfassen. Weitere Informationen finden Sie unter Aufbau einer mandantenfähigen SaaS-Lösung mit AWS Serverless Services.

Unterstützung für mehrere Bereitstellungsmodelle

SaaS-Frameworks beschreiben typischerweise zwei Bereitstellungsmodelle: Pool und Silo. Beim Poolmodell greifen alle Mandanten über eine gemeinsame Umgebung mit gemeinsamer Speicher- und Recheninfrastruktur auf FMs zu. Im Silomodell verfügt jeder Mandant über seinen eigenen Satz dedizierter Ressourcen. Informationen zu Isolationsmodellen finden Sie im Whitepaper zu Strategien zur Isolierung von SaaS-Mandanten.

Die vorgeschlagene Lösung kann für beide SaaS-Bereitstellungsmodelle übernommen werden. Beim Pool-Ansatz hostet eine zentralisierte AWS-Umgebung die API-, Speicher- und Rechenressourcen. Im Silomodus greift jedes Team auf APIs, Speicher und Rechenressourcen in einer dedizierten AWS-Umgebung zu.

Die Lösung passt auch zu den verfügbaren Verbrauchsplänen von Amazon Bedrock. AWS bietet eine Auswahl von zwei Verbrauchsplänen für die Schlussfolgerung:

- On-Demand – Dieser Modus ermöglicht Ihnen die Nutzung von Stiftungsmodellen auf Pay-as-you-go-Basis, ohne zeitliche Bindungen eingehen zu müssen

- Bereitgestellter Durchsatz – In diesem Modus können Sie ausreichend Durchsatz bereitstellen, um die Leistungsanforderungen Ihrer Anwendung im Austausch gegen eine zeitlich begrenzte Verpflichtung zu erfüllen

Weitere Informationen zu diesen Optionen finden Sie unter Amazon Bedrock-Preise.

Die in diesem Beitrag beschriebene serverlose SaaS-Referenzlösung kann die Amazon Bedrock-Verbrauchspläne anwenden, um Endbenutzern Basis- und Premium-Stufenoptionen bereitzustellen. „Basic“ kann die On-Demand- oder Provisioned Throughput-Nutzung von Amazon Bedrock umfassen und könnte spezifische Nutzungs- und Budgetgrenzen umfassen. Mandantengrenzen könnten durch Drosselung von Anfragen basierend auf Anfragen, Token-Größen oder Budgetzuweisung aktiviert werden. Mieter der Premium-Stufe könnten über ihre eigenen dedizierten Ressourcen mit bereitgestelltem Durchsatzverbrauch von Amazon Bedrock verfügen. Diese Mandanten sind typischerweise mit Produktions-Workloads verbunden, die einen hohen Durchsatz und einen Zugriff mit geringer Latenz auf Amazon Bedrock FMs erfordern.

Zusammenfassung

In diesem Beitrag haben wir besprochen, wie man eine interne SaaS-Plattform für den Zugriff auf Basismodelle mit Amazon Bedrock in einem Multi-Tenant-Setup aufbaut, wobei der Schwerpunkt auf der Verfolgung von Kosten und Nutzung sowie der Drosselung von Grenzwerten für jeden Mandanten liegt. Zu den weiteren zu untersuchenden Themen gehören die Integration bestehender Authentifizierungs- und Autorisierungslösungen in der Organisation, die Erweiterung der API-Schicht um Web-Sockets für bidirektionale Client-Server-Interaktionen, das Hinzufügen von Inhaltsfilterung und anderen Governance-Leitlinien, die Gestaltung mehrerer Bereitstellungsebenen und die Integration anderer Mikrodienste in SaaS Architektur und vieles mehr.

Der gesamte Code für diese Lösung ist im verfügbar GitHub-Repository.

Weitere Informationen zu SaaS-basierten Frameworks finden Sie unter SaaS Journey Framework: Aufbau einer neuen SaaS-Lösung auf AWS.

Über die Autoren

![]() Hasan Poonawala ist Senior AI/ML Specialist Solutions Architect bei AWS und arbeitet mit Kunden aus dem Gesundheitswesen und den Biowissenschaften zusammen. Hasan hilft beim Entwerfen, Bereitstellen und Skalieren von Anwendungen für generative KI und maschinelles Lernen auf AWS. Er verfügt über mehr als 15 Jahre Berufserfahrung in den Bereichen maschinelles Lernen, Softwareentwicklung und Datenwissenschaft in der Cloud. In seiner Freizeit erkundet Hasan gerne die Natur und verbringt Zeit mit Freunden und Familie.

Hasan Poonawala ist Senior AI/ML Specialist Solutions Architect bei AWS und arbeitet mit Kunden aus dem Gesundheitswesen und den Biowissenschaften zusammen. Hasan hilft beim Entwerfen, Bereitstellen und Skalieren von Anwendungen für generative KI und maschinelles Lernen auf AWS. Er verfügt über mehr als 15 Jahre Berufserfahrung in den Bereichen maschinelles Lernen, Softwareentwicklung und Datenwissenschaft in der Cloud. In seiner Freizeit erkundet Hasan gerne die Natur und verbringt Zeit mit Freunden und Familie.

![]() Anastasia Tzeveleka ist Senior AI/ML Specialist Solutions Architect bei AWS. Im Rahmen ihrer Arbeit unterstützt sie Kunden in der gesamten EMEA-Region beim Aufbau von Basismodellen und bei der Entwicklung skalierbarer Lösungen für generative KI und maschinelles Lernen mithilfe von AWS-Diensten.

Anastasia Tzeveleka ist Senior AI/ML Specialist Solutions Architect bei AWS. Im Rahmen ihrer Arbeit unterstützt sie Kunden in der gesamten EMEA-Region beim Aufbau von Basismodellen und bei der Entwicklung skalierbarer Lösungen für generative KI und maschinelles Lernen mithilfe von AWS-Diensten.

![]() Brukein Kolben ist ein generativer KI- und ML-Spezialist für Lösungsarchitekten für AWS mit Sitz in Mailand. Er arbeitet mit großen Kunden zusammen und hilft ihnen dabei, ihre technischen Anforderungen genau zu verstehen und KI- und maschinelle Lernlösungen zu entwickeln, die die AWS Cloud und den Amazon Machine Learning-Stack optimal nutzen. Zu seinen Fachkenntnissen gehören: End-to-End-Maschinelles Lernen, Industrialisierung des Maschinellen Lernens und Generative KI. Er genießt es, Zeit mit seinen Freunden zu verbringen, neue Orte zu erkunden und zu neuen Zielen zu reisen.

Brukein Kolben ist ein generativer KI- und ML-Spezialist für Lösungsarchitekten für AWS mit Sitz in Mailand. Er arbeitet mit großen Kunden zusammen und hilft ihnen dabei, ihre technischen Anforderungen genau zu verstehen und KI- und maschinelle Lernlösungen zu entwickeln, die die AWS Cloud und den Amazon Machine Learning-Stack optimal nutzen. Zu seinen Fachkenntnissen gehören: End-to-End-Maschinelles Lernen, Industrialisierung des Maschinellen Lernens und Generative KI. Er genießt es, Zeit mit seinen Freunden zu verbringen, neue Orte zu erkunden und zu neuen Zielen zu reisen.

![]() Vikesh Pandey ist ein Architekt für generative KI/ML-Lösungen, der sich auf Finanzdienstleistungen spezialisiert hat und Finanzkunden beim Aufbau und der Skalierung generativer KI/ML-Plattformen und -Lösungen unterstützt, die auf Hunderte oder sogar Tausende von Benutzern skalierbar sind. In seiner Freizeit schreibt Vikesh gerne in verschiedenen Blog-Foren und baut mit seinem Kind Legos.

Vikesh Pandey ist ein Architekt für generative KI/ML-Lösungen, der sich auf Finanzdienstleistungen spezialisiert hat und Finanzkunden beim Aufbau und der Skalierung generativer KI/ML-Plattformen und -Lösungen unterstützt, die auf Hunderte oder sogar Tausende von Benutzern skalierbar sind. In seiner Freizeit schreibt Vikesh gerne in verschiedenen Blog-Foren und baut mit seinem Kind Legos.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/build-an-internal-saas-service-with-cost-and-usage-tracking-for-foundation-models-on-amazon-bedrock/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 000

- 1

- 120

- 15 Jahre

- 15%

- 160

- 26%

- 500

- 7

- a

- Über uns

- Zugang

- Zugriff

- Konto

- über

- automatisch

- Hinzufügen

- Zusatz

- Zusätzliche

- zusätzlich

- Administrator

- Administratoren

- angenommen

- Aggregate

- AI

- KI-Modelle

- KI-Plattform

- AI / ML

- Alle

- Zuteilung

- erlauben

- erlaubt

- entlang

- bereits

- ebenfalls

- Amazon

- Amazon Machine Learning

- Amazon QuickSight

- Amazon Web Services

- an

- und

- Ein anderer

- Anthropisch

- jedem

- auseinander

- Bienen

- API-Zugriff

- API-SCHLÜSSEL

- APIs

- Anwendung

- Anwendungen

- Jetzt bewerben

- Ansatz

- genehmigt

- Architektur

- Architekturen

- SIND

- AS

- zugewiesen

- damit verbundenen

- Mitarbeiter

- At

- Prüfung

- Authentifizierung

- Genehmigung

- zugelassen

- verfügbar

- AWS

- basierend

- basic

- Grundlage

- BE

- weil

- Anfang

- BESTE

- Besser

- zwischen

- Blog

- Körper

- beide

- breit

- Haushalt

- bauen

- Building

- Geschäft

- by

- berechnet

- berechnet

- rufen Sie uns an!

- Aufruf

- CAN

- Fähigkeiten

- Erfassung

- Captures

- Häuser

- Center

- Centers

- zentralisierte

- Herausforderungen

- Ändern

- Wahl

- Auftraggeber

- Kunden

- Cloud

- Code

- Spalten

- kombiniert

- gemeinsam

- Unternehmen

- Komponente

- Komponenten

- Berechnen

- Konfiguration

- Verbindung

- konsistent

- besteht

- Konsul (Console)

- verbrauchen

- KUNDEN

- verbrauchenden

- Verbrauch

- Inhalt

- Smartgeräte App

- Regelung

- Steuerung

- Kosten

- Kosten

- könnte

- erstellen

- erstellt

- Original

- Kunden

- Unterricht

- technische Daten

- Datenwissenschaft

- Datenspeichervorrichtung

- Tag

- gewidmet

- tief

- definieren

- definiert

- verweigert

- Abteilung

- Abhängig

- einsetzen

- Einsatz

- Einsatz

- setzt ein

- beschreiben

- beschrieben

- Design

- Entwerfen

- Reiseziele

- Detail

- Details

- entwickelt

- Entwicklung

- Entwicklungsteams

- Diagramm

- anders

- Größe

- Direkt

- diskutieren

- diskutiert

- do

- Tut nicht

- Nicht

- jeder

- Früher

- Einfache

- bewirken

- entweder

- Einbettung

- EMEA

- ermöglichen

- freigegeben

- Ende

- End-to-End

- Endpunkt

- Eine Verbesserung der

- gewährleisten

- Ganz

- Arbeitsumfeld

- Umgebungen

- Fehler

- etablieren

- Sogar

- Event

- Beispiel

- überschreiten

- Austausch-

- vorhandenen

- ERFAHRUNGEN

- Expertise

- erklärt

- Erklärt

- ERKUNDEN

- Möglichkeiten sondieren

- express

- verlängert

- vertraut

- Familie

- Reichen Sie das

- Filterung

- Revolution

- Finanzdienstleistungen

- fits

- Flexibilität

- Fluss

- Setzen Sie mit Achtsamkeit

- Folgende

- folgt

- Aussichten für

- Format

- Foren

- Foundation

- Gründen

- Foundations

- Unser Ansatz

- Gerüste

- Frequenz

- Freunde

- für

- Materials des

- Vorderes Ende

- voll

- Funktion

- funktional

- Funktionalität

- Funktionen

- weiter

- Tor

- Gateways

- Allgemeines

- erzeugt

- erzeugt

- Generation

- generativ

- Generative KI

- bekommt

- GitHub

- gegeben

- Go

- Governance

- geregelt

- Gruppe an

- Griff

- Los

- Haben

- mit

- he

- Gesundheitswesen

- Höhe

- Unternehmen

- hilft

- hier (auf dänisch)

- hier

- GUTE

- leistungsstark

- seine

- Gastgeber

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- hunderte

- ID

- Kennzeichnung

- identifizieren

- Identitätsschutz

- if

- Image

- Impact der HXNUMXO Observatorien

- implementieren

- umgesetzt

- in

- das

- Einschließlich

- Krankengymnastik

- gefolgert

- Information

- Infrastruktur

- wir innovieren

- Varianten des Eingangssignals:

- Eingänge

- Anleitung

- integrieren

- Integration

- Integration

- interagieren

- Interaktion

- Interaktionen

- Schnittstelle

- intern

- in

- aufgerufen

- Isolierung

- Problem

- Ausgabe

- IT

- Artikel

- SEINE

- Reise

- jpg

- Wesentliche

- Tasten

- Kind

- Labs

- Sprachen

- grosse

- Nachname

- Latency

- Schicht

- Lagen

- führenden

- LERNEN

- lernen

- Niveau

- Lebensdauer

- Biowissenschaften

- Gefällt mir

- Gleichen

- Grenzen

- Line

- Linien

- Gelistet

- aus einer regionalen

- Protokollierung

- Logik

- aussehen

- aussehen wie

- Los

- liebt

- Sneaker

- Maschine

- Maschinelles Lernen

- Aufrechterhaltung

- um

- verwalten

- verwaltet

- Management

- flächendeckende Gesundheitsprogramme

- viele

- Karte

- maximal

- Kann..

- Mechanismen

- Triff

- erwähnt

- Meta

- Methoden

- Microservice

- Microservices

- könnte

- MILAN

- ML

- Model

- Modell

- für

- Überwachen

- mehr

- vor allem warme

- viel

- mehrere

- Natur

- notwendig,

- Need

- erforderlich

- Bedürfnisse

- Vernetzung

- Neu

- Anzahl

- nummerierte

- aufgetreten

- of

- Angebote

- on

- On-Demand

- EINEM

- einzige

- XNUMXh geöffnet

- Open-Source-

- betreiben

- Betrieb

- Optionen

- or

- Auftrag

- Organisation

- Andere

- skizzieren

- Möglichkeiten für das Ausgangssignal:

- Ausgänge

- übrig

- besitzen

- Seite

- Parameter

- Parameter

- Teil

- für

- Leistung

- Berechtigungen

- Länder/Regionen

- Plan

- Pläne

- Plattform

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Datenschutzrichtlinien

- Pool

- Post

- Potenzial

- angetriebene

- vor

- vordefiniert

- Prämie

- Geschenke

- früher

- vorher

- Preise

- gebühr

- Datenschutz

- privat

- Produktion

- Produkte

- Programmierung

- Programmiersprachen

- Projekt

- vorgeschlage

- die

- vorausgesetzt

- Anbieter

- bietet

- Bereitstellung

- Bereitstellung

- Python

- query

- schnell

- erhöhen

- Angebot

- Bewerten

- Lesen Sie mehr

- kürzlich

- siehe

- Referenz

- Registrieren

- Registrieren

- Registrierung:

- Regulieren

- relevant

- Meldungen

- Quelle

- representiert

- Anforderung

- Zugriffe

- erfordern

- Voraussetzungen:

- reserviert

- Downloads

- respektieren

- diejenigen

- beziehungsweise

- Antwort

- für ihren Verlust verantwortlich.

- REST

- eine Beschränkung

- Rückkehr

- Rückgabe

- Rollen

- Routen

- Regel

- Führen Sie

- läuft

- SaaS

- gleich

- Gerettet

- skalierbaren

- Skalieren

- Waage

- Szenarien

- Zeitplan

- Wissenschaft

- WISSENSCHAFTEN

- Umfang

- Abschnitte

- sicher

- Sicherheitdienst

- sehen

- auf der Suche nach

- SELF

- sendet

- Senior

- geschickt

- getrennte

- Server

- Serverlos

- Dienstleistungen

- kompensieren

- Sets

- Setup

- Teilen

- von Locals geführtes

- sie

- erklären

- gezeigt

- Einfacher

- Einfachheit

- Single

- Größen

- Software

- Software als Service

- Software-Entwicklung

- Lösung

- Lösungen

- einige

- Quelle

- Spezialisierung

- Spezialist

- spezifisch

- speziell

- Spezifikationen

- angegeben

- Geschwindigkeit

- verbringen

- Ausgabe

- Stabilität

- Stapel

- Anfang

- Shritte

- Lagerung

- speichern

- gelagert

- Läden

- Strategien

- Subnetze

- erfolgreich

- so

- ausreichend

- sicher

- Tabelle

- Target

- Team

- Teams

- Technische

- Technologie

- Vorlage

- Mieter

- Begriff

- Text

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- die Informationen

- ihr

- Sie

- sich

- dann

- Dort.

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- Tausende

- Durch

- Durchsatz

- Tier

- Zeit

- Titan

- zu

- Zeichen

- Tokens

- Themen

- Gesamt

- verfolgen sind

- Tracking

- Spuren

- was immer dies auch sein sollte.

- XNUMX

- tippe

- typisch

- verstehen

- einzigartiges

- öffnen

- aktualisiert

- Anwendungsbereich

- -

- Anwendungsfall

- benutzt

- Mitglied

- Nutzer

- verwendet

- Verwendung von

- v1

- Wert

- verschiedene

- Version

- Versionen

- Anzeigen

- Sichtbarkeit

- Visualisierung

- visualisieren

- we

- Netz

- Web-Services

- Web-Sockets

- GUT

- Was

- Was ist

- wann

- welche

- während

- WHO

- Breite

- mit

- .

- ohne

- Arbeiten

- Arbeitsablauf.

- arbeiten,

- Werk

- würde

- schreiben

- Jahr

- Du

- Ihr

- Zephyrnet