Dieser Beitrag wurde gemeinsam mit Bernard Paques, CTO von Storm Reply, und Karl Herkt, Senior Strategist bei Dassault Systèmes 3DExcite, verfasst.

Während Computer Vision für industrielle Wartungs-, Fertigungs-, Logistik- und Verbraucheranwendungen von entscheidender Bedeutung sein kann, ist seine Einführung durch die manuelle Erstellung von Trainingsdatensätzen begrenzt. Die Erstellung von beschrifteten Bildern in einem industriellen Kontext erfolgt hauptsächlich manuell, was zu eingeschränkten Erkennungsmöglichkeiten führt, nicht skalierbar ist und zu Arbeitskosten und Verzögerungen bei der Realisierung des Geschäftswerts führt. Dies widerspricht der geschäftlichen Agilität, die durch schnelle Iterationen in Produktdesign, Produktentwicklung und Produktkonfiguration bereitgestellt wird. Dieser Prozess lässt sich nicht für komplexe Produkte wie Autos, Flugzeuge oder moderne Gebäude skalieren, da in diesen Szenarien jedes Etikettierungsprojekt einzigartig ist (bezogen auf einzigartige Produkte). Infolgedessen kann die Computer-Vision-Technologie ohne großen Aufwand bei der Datenvorbereitung nicht einfach auf große, einzigartige Projekte angewendet werden, was manchmal die Bereitstellung von Anwendungsfällen einschränkt.

In diesem Beitrag stellen wir einen neuartigen Ansatz vor, bei dem hochspezialisierte Computer-Vision-Systeme aus Design- und CAD-Dateien erstellt werden. Wir beginnen mit der Erstellung visuell korrekter digitaler Zwillinge und der Generierung synthetisch gekennzeichneter Bilder. Dann schieben wir diese Bilder nach Benutzerdefinierte Etiketten von Amazon Rekognition um ein benutzerdefiniertes Objekterkennungsmodell zu trainieren. Indem wir vorhandenes geistiges Eigentum mit Software nutzen, machen wir Computer Vision erschwinglich und relevant für eine Vielzahl von industriellen Kontexten.

Die Anpassung von Erkennungssystemen hilft, die Geschäftsergebnisse zu verbessern

Spezialisierte Computer-Vision-Systeme, die aus digitalen Zwillingen hergestellt werden, haben spezifische Vorzüge, die in den folgenden Anwendungsfällen veranschaulicht werden können:

- Rückverfolgbarkeit für einzigartige Produkte – Airbus, Boeing und andere Flugzeughersteller vergeben eindeutige Seriennummern des Herstellers (MSNs) an jedes Flugzeug, das sie produzieren. Dies wird während des gesamten Produktionsprozesses verwaltet, um zu generieren Lufttüchtigkeitsdokumentation und Fluggenehmigungen bekommen. EIN digitaler Zwilling (ein virtuelles 3D-Modell, das ein physisches Produkt darstellt) kann aus der Konfiguration jeder MSN abgeleitet werden und erzeugt ein verteiltes Computer-Vision-System, das den Fortschritt dieser MSN über Industrieanlagen hinweg verfolgt. Die kundenspezifische Erkennung automatisiert die den Fluggesellschaften gegebene Transparenz und ersetzt die meisten Kontrollpunkte, die von Fluggesellschaften manuell durchgeführt werden. Die automatisierte Qualitätssicherung einzigartiger Produkte kann für Flugzeuge, Autos, Gebäude und sogar handwerkliche Produktionen gelten.

- Kontextualisierte Augmented Reality – Professionelle Computer-Vision-Systeme können begrenzte Landschaften erfassen, verfügen jedoch über höhere Unterscheidungsfähigkeiten. In der industriellen Instandhaltung ist es beispielsweise nutzlos, einen Schraubendreher auf einem Bild zu finden; Sie müssen das Modell des Schraubendrehers oder sogar seine Seriennummer identifizieren. In solchen begrenzten Kontexten übertreffen benutzerdefinierte Erkennungssysteme generische Erkennungssysteme, da sie in ihren Ergebnissen relevanter sind. Kundenspezifische Erkennungssysteme ermöglichen präzise Feedbackschleifen über dedizierte Augmented Reality geliefert in HMI oder in mobilen Geräten.

- End-to-End-Qualitätskontrolle - Mit System Entwicklungkönnen Sie digitale Zwillinge von Teilkonstrukten erstellen und Computer-Vision-Systeme generieren, die sich an die verschiedenen Phasen von Herstellungs- und Produktionsprozessen anpassen. Visuelle Kontrollen können mit Fertigungsarbeitsplätzen verflochten werden, was eine End-to-End-Inspektion und eine frühzeitige Erkennung von Fehlern ermöglicht. Benutzerdefinierte Erkennung für die End-to-End-Inspektion verhindert effektiv die Kaskadierung von Fehlern an Montagelinien. Die Reduzierung der Ausschussrate und die Maximierung der Produktionsleistung ist das ultimative Ziel.

- Flexible Qualitätsprüfung – Moderne Qualitätsprüfung muss sich an Designvariationen und flexible Fertigung anpassen. Abweichungen im Design ergeben sich aus Feedback-Schleifen zur Produktnutzung und Produktwartung. Flexible Fertigung ist eine Schlüsselfähigkeit für eine Make-to-Order-Strategie und entspricht dem Lean-Manufacturing-Prinzip der Kostenoptimierung. Durch die Integration von Designvarianten und Konfigurationsmöglichkeiten in digitale Zwillinge ermöglicht die kundenspezifische Erkennung die dynamische Anpassung von Computer-Vision-Systemen an die Produktionspläne und Designvarianten.

Verbessern Sie das maschinelle Sehen mit Dassault Systèmes 3DEXCITE powered by Amazon Rekognition

Innerhalb von Dassault Systèmes, einem Unternehmen mit umfassender Expertise im Bereich digitaler Zwillinge, das auch der zweitgrößte europäische Software-Editor ist, beschreitet das 3DEXCITE-Team einen anderen Weg. Wie von Karl Herkt erklärt: „Was wäre, wenn ein aus synthetischen Bildern trainiertes neuronales Modell ein physisches Produkt erkennen könnte?“ 3DEXCITE hat dieses Problem gelöst, indem es seine Technologie mit der AWS-Infrastruktur kombiniert und die Machbarkeit dieses besonderen Ansatzes bewiesen hat. Es ist auch bekannt als domänenübergreifende Objekterkennung, wobei das Erkennungsmodell von markierten Bildern aus der Quelldomäne (synthetische Bilder) lernt und Vorhersagen für die nicht markierte Zieldomäne (physikalische Komponenten) trifft.

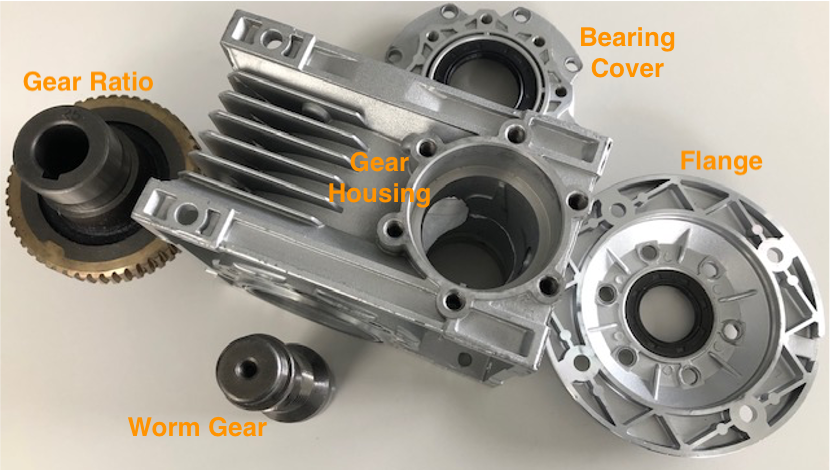

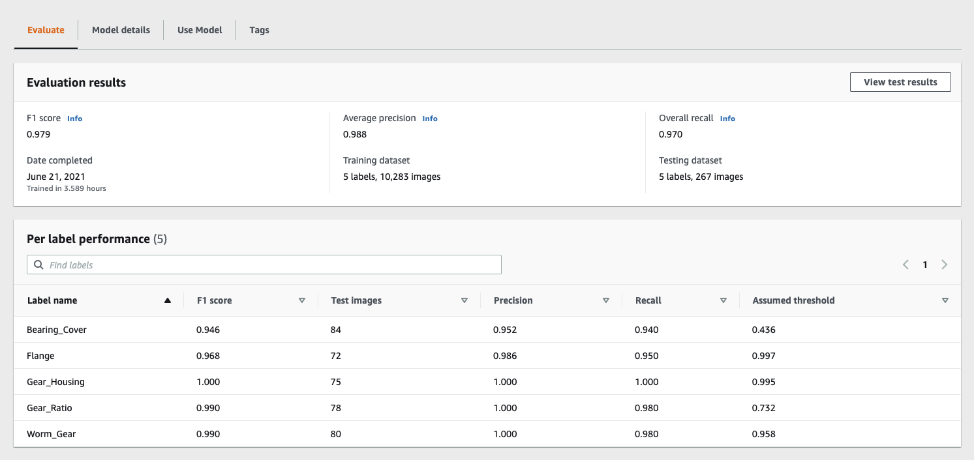

Dassault Systèmes 3DEXCITE und das AWS-Prototyping-Team haben sich zusammengeschlossen, um ein Demonstratorsystem zu bauen, das Teile eines Industriegetriebes erkennt. Dieser Prototyp wurde in 3 Wochen gebaut und das trainierte Modell erreichte eine F98-Punktzahl von 1 %. Das Erkennungsmodell wurde vollständig aus einer Software-Pipeline trainiert, die keine Bilder eines realen Teils enthält. Aus Konstruktions- und CAD-Dateien eines Industriegetriebes hat 3DEXCITE visuell korrekte digitale Zwillinge erstellt. Sie erzeugten auch Tausende von synthetisch gekennzeichneten Bildern aus den digitalen Zwillingen. Dann verwendeten sie Rekognition Custom Labels, um ein hochspezialisiertes neuronales Modell anhand dieser Bilder zu trainieren, und stellten eine zugehörige Erkennungs-API bereit. Sie haben eine Website erstellt, um die Erkennung eines physischen Teils des Getriebes von jeder Webcam aus zu ermöglichen.

Amazon-Anerkennung ist ein KI-Dienst, der Deep-Learning-Technologie verwendet, um es Ihnen zu ermöglichen, aussagekräftige Metadaten aus Bildern und Videos zu extrahieren – einschließlich der Identifizierung von Objekten, Personen, Text, Szenen, Aktivitäten und potenziell unangemessenen Inhalten – ohne dass Fachwissen über maschinelles Lernen (ML) erforderlich ist. Amazon Rekognition bietet außerdem hochpräzise Gesichtsanalyse- und Gesichtssuchfunktionen, mit denen Sie Gesichter für eine Vielzahl von Anwendungsfällen zur Benutzerüberprüfung, Personenzählung und Sicherheit erkennen, analysieren und vergleichen können. Schließlich können Sie mit Rekognition Custom Labels Ihre eigenen Daten verwenden, um Modelle zur Objekterkennung und Bildklassifizierung zu erstellen.

Die Kombination der Technologie von Dassault Systèmes zur Generierung synthetisch gekennzeichneter Bilder mit Rekognition Custom Labels für Computer Vision bietet einen skalierbaren Arbeitsablauf für Erkennungssysteme. Die Benutzerfreundlichkeit ist hier ein wesentlicher positiver Faktor, da das Hinzufügen von Rekognition Custom Labels zur gesamten Software-Pipeline nicht schwierig ist – es ist so einfach wie die Integration einer API in einen Workflow. Sie müssen kein ML-Wissenschaftler sein; Senden Sie einfach erfasste Frames an AWS und erhalten Sie ein Ergebnis, das Sie in eine Datenbank eingeben oder in einem Webbrowser anzeigen können.

Dies unterstreicht weiter die dramatische Verbesserung gegenüber der manuellen Erstellung von Trainingsdatensätzen. Sie können bessere Ergebnisse schneller und mit größerer Genauigkeit erzielen, ohne dass kostspielige, unnötige Arbeitsstunden erforderlich sind. Bei so vielen potenziellen Anwendungsfällen hat die Kombination von Dassault Systèmes und Rekognition Custom Labels das Potenzial, den Unternehmen von heute einen signifikanten und sofortigen ROI zu bieten.

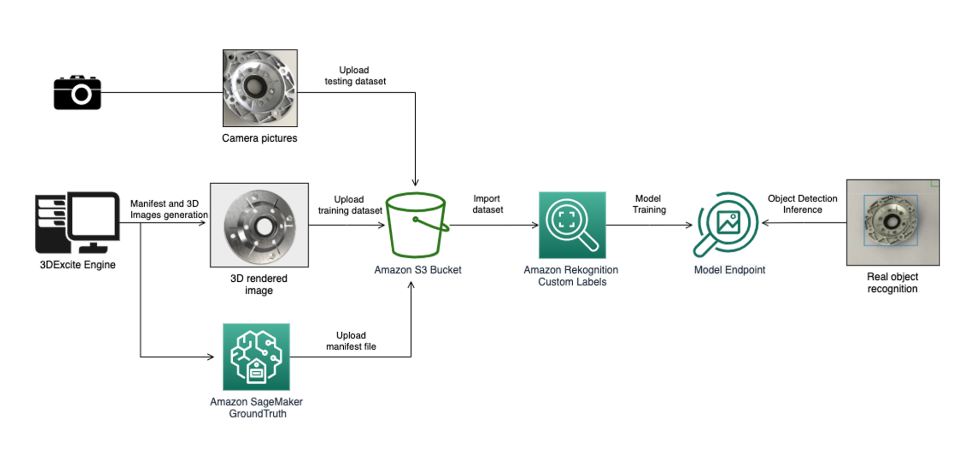

Lösungsüberblick

Der erste Schritt in dieser Lösung besteht darin, die Bilder zu rendern, die das Trainingsdataset erstellen. Dies wird von der 3DEXCITE-Plattform durchgeführt. Wir können die Beschriftungsdaten programmgesteuert mithilfe von Skripten generieren. Amazon Sagemaker Ground Truth bietet ein Anmerkungstool zum einfachen Beschriften von Bildern und Videos für Klassifizierungs- und Objekterkennungsaufgaben. Um ein Modell in Amazon Rekognition zu trainieren, muss die Beschriftungsdatei dem Ground-Truth-Format entsprechen. Diese Beschriftungen sind in JSON, einschließlich Informationen wie Bildgröße, Begrenzungsrahmenkoordinaten und Klassen-IDs.

Laden Sie dann die synthetischen Bilder und das Manifest auf hoch Amazon Simple Storage-Service (Amazon S3), wo sie von Rekognition Custom Labels als Komponenten des Trainingsdatensatzes importiert werden können.

Damit Rekognition Custom Labels die Modelle im Vergleich zu einer Reihe von echten Komponentenbildern testen kann, stellen wir eine Reihe von Bildern der echten Motorteile bereit, die mit einer Kamera aufgenommen wurden, und laden sie auf Amazon S3 hoch, um sie als Testdatensatz zu verwenden.

Schließlich trainiert Rekognition Custom Labels das beste Objekterkennungsmodell mithilfe des synthetischen Trainingsdatensatzes und des Testdatensatzes, der aus Bildern realer Objekte besteht, und erstellt den Endpunkt mit dem Modell, das wir verwenden können, um die Objekterkennung in unserer Anwendung auszuführen.

Das folgende Diagramm veranschaulicht unseren Lösungsworkflow:

Erstellen Sie synthetische Bilder

Die synthetischen Bilder werden von der 3Dexperience-Plattform generiert, die ein Produkt von Dassault Systèmes ist. Mit dieser Plattform können Sie fotorealistische Bilder basierend auf der CAD-Datei (Computer Aided Design) des Objekts erstellen und rendern. Wir können Tausende von Varianten in wenigen Stunden generieren, indem wir die Bildtransformationskonfigurationen auf der Plattform ändern.

In diesem Prototyp haben wir die folgenden fünf visuell unterschiedlichen Getriebeteile für die Objekterkennung ausgewählt. Sie umfassen ein Getriebegehäuse, ein Übersetzungsverhältnis, einen Lagerdeckel, einen Flansch und ein Schneckengetriebe.

Wir haben die folgenden Datenerweiterungsmethoden verwendet, um die Bildvielfalt zu erhöhen und die synthetischen Daten fotorealistischer zu machen. Es hilft, den Modellverallgemeinerungsfehler zu reduzieren.

- Zoom hinein / heraus – Diese Methode vergrößert oder verkleinert das Objekt in Bildern zufällig.

- Rotation – Diese Methode dreht das Objekt in Bildern, und es sieht so aus, als ob eine virtuelle Kamera zufällige Bilder des Objekts aus 360-Grad-Winkeln aufnimmt.

- Verbessern Sie das Aussehen und die Haptik des Materials – Wir haben festgestellt, dass das Aussehen des Materials bei einigen Getriebeteilen im anfänglichen Rendering weniger realistisch ist. Wir haben einen Metallic-Effekt hinzugefügt, um die synthetischen Bilder zu verbessern.

- Verwenden Sie unterschiedliche Beleuchtungseinstellungen – In diesem Prototyp haben wir zwei Lichtverhältnisse simuliert:

- Warehouse – Eine realistische Lichtverteilung. Schatten und Reflexionen sind möglich.

- Studio – Rund um das Objekt wird ein homogenes Licht gelegt. Dies ist nicht realistisch, aber es gibt keine Schatten oder Reflexionen.

- Verwenden Sie eine realistische Position, wie das Objekt in Echtzeit betrachtet wird – Im wirklichen Leben werden einige Objekte, wie z. B. ein Flansch und eine Lagerabdeckung, im Allgemeinen auf einer Oberfläche platziert, und das Modell erkennt die Objekte basierend auf den oberen und unteren Facetten. Daher haben wir die Trainingsbilder entfernt, die die dünne Kante der Teile zeigen, auch als Kantenposition bezeichnet, und die Bilder von Objekten in einer flachen Position erhöht.

- Fügen Sie mehrere Objekte in einem Bild hinzu – In realen Szenarien könnten mehrere Zahnradteile alle in einer Ansicht erscheinen, also haben wir Bilder vorbereitet, die mehrere Zahnradteile enthalten.

Auf der 3Dexperience-Plattform können wir verschiedene Hintergründe auf die Bilder anwenden, was dazu beitragen kann, die Bildvielfalt weiter zu erhöhen. Aus zeitlichen Gründen haben wir dies in diesem Prototyp nicht implementiert.

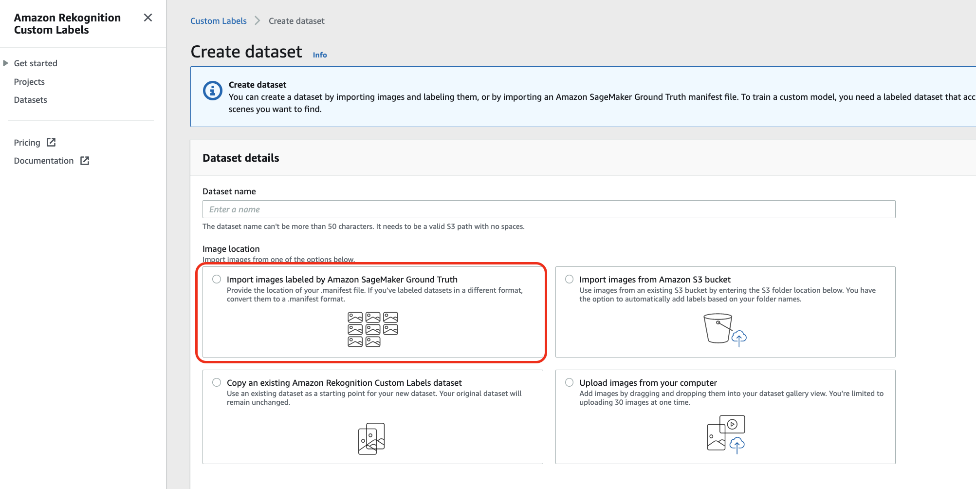

Importieren Sie das synthetische Trainingsdataset

In ML bedeuten beschriftete Daten, dass die Trainingsdaten mit Anmerkungen versehen sind, um das Ziel anzuzeigen, das die Antwort ist, die Ihr ML-Modell vorhersagen soll. Die gekennzeichneten Daten, die von Rekognition Custom Labels verwendet werden können, sollten den Anforderungen an Ground Truth-Manifestdateien entsprechen. Eine Manifestdatei besteht aus einer oder mehreren JSON-Zeilen; Jede Zeile enthält die Informationen für ein einzelnes Bild. Für synthetische Trainingsdaten können die Beschriftungsinformationen programmgesteuert basierend auf den zuvor erwähnten CAD-Datei- und Bildtransformationskonfigurationen generiert werden, was einen erheblichen manuellen Aufwand bei der Beschriftungsarbeit einspart. Weitere Informationen zu den Anforderungen für Label-Dateiformate finden Sie unter Erstellen Sie eine Manifestdatei und Objektlokalisierung in Manifestdateien. Im Folgenden finden Sie ein Beispiel für die Bildbeschriftung:

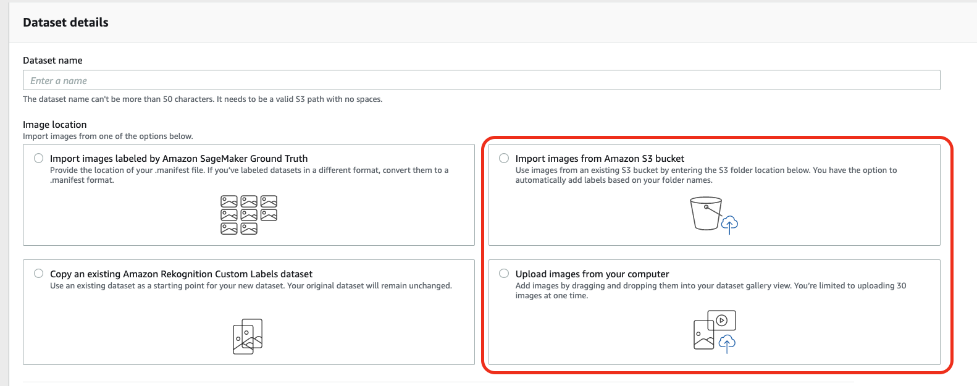

Nachdem die Manifestdatei vorbereitet wurde, laden wir sie in einen S3-Bucket hoch und erstellen dann einen Trainingsdatensatz in Rekognition Custom Labels, indem wir die Option auswählen Importieren Sie Bilder, die mit Amazon SageMaker Ground Truth gekennzeichnet sind.

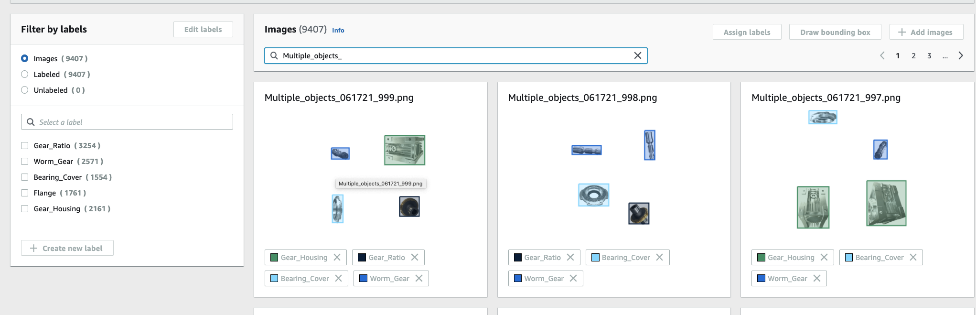

Nachdem die Manifestdatei importiert wurde, können wir die Kennzeichnungsinformationen visuell auf der Amazon Rekognition-Konsole anzeigen. Dies hilft uns zu bestätigen, dass die Manifestdatei generiert und importiert wurde. Genauer gesagt, die Begrenzungsrahmen sollten an den Objekten in Bildern ausgerichtet werden, und die Klassen-IDs der Objekte sollten korrekt zugewiesen werden.

Erstellen Sie das Testdataset

Die Testbilder werden im realen Leben mit einem Telefon oder einer Kamera aus verschiedenen Winkeln und Lichtverhältnissen aufgenommen, da wir die Modellgenauigkeit, die wir mit synthetischen Daten trainiert haben, gegen die realen Szenarien validieren möchten. Sie können diese Testbilder in einen S3-Bucket hochladen und sie dann als Datensätze in Rekognition Custom Labels importieren. Oder Sie können sie direkt von Ihrem lokalen Computer in Datensätze hochladen.

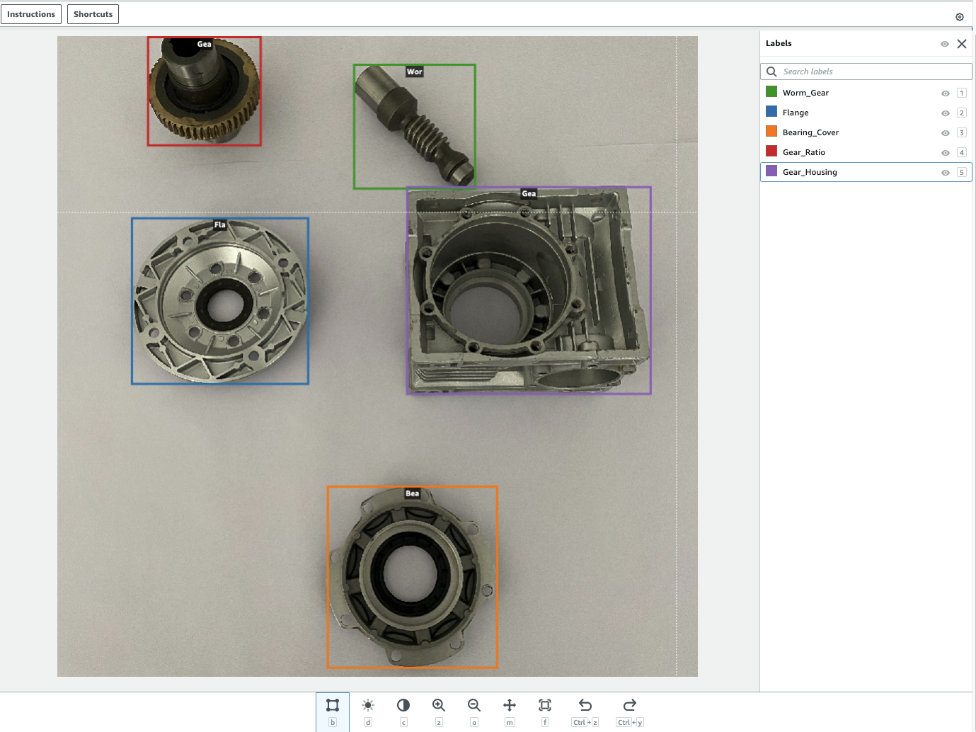

Rekognition Custom Labels bietet eine integrierte Bildanmerkungsfunktion, die eine ähnliche Erfahrung wie Ground Truth hat. Sie können mit der Beschriftungsarbeit beginnen, wenn die Testdaten importiert werden. Für einen Anwendungsfall zur Objekterkennung sollten die Begrenzungsrahmen eng um die interessierenden Objekte herum erstellt werden, was dem Modell hilft, genau die Regionen und Pixel zu lernen, die zu den Zielobjekten gehören. Darüber hinaus sollten Sie jede Instanz der Zielobjekte in allen Bildern kennzeichnen, auch diejenigen, die teilweise außer Sichtweite oder von anderen Objekten verdeckt sind, da das Modell sonst mehr falsche Negative vorhersagt.

Erstellen Sie das domänenübergreifende Objekterkennungsmodell

Rekognition Custom Labels ist ein vollständig verwalteter Dienst; Sie müssen nur die Zug- und Testdatensätze bereitstellen. Es trainiert eine Reihe von Modellen und wählt das Modell mit der besten Leistung basierend auf den bereitgestellten Daten aus. In diesem Prototyp bereiten wir die synthetischen Trainingsdatensätze iterativ vor, indem wir mit verschiedenen Kombinationen der zuvor erwähnten Bildverstärkungsmethoden experimentieren. Für jeden Trainingsdatensatz wird in Rekognition Custom Labels ein Modell erstellt, das es uns ermöglicht, den optimalen Trainingsdatensatz speziell für diesen Anwendungsfall zu vergleichen und zu finden. Jedes Modell hat die minimale Anzahl von Trainingsbildern, enthält eine gute Bilddiversität und bietet die beste Modellgenauigkeit. Nach 15 Iterationen erreichten wir einen F1-Score von 98 % Modellgenauigkeit unter Verwendung von rund 10,000 synthetischen Trainingsbildern, was im Durchschnitt 2,000 Bildern pro Objekt entspricht.

Ergebnisse der Modellinferenz

Das folgende Bild zeigt das Amazon Rekognition-Modell, das in einer Echtzeit-Inferenzanwendung verwendet wird. Alle Komponenten werden mit hoher Zuverlässigkeit korrekt erkannt.

Zusammenfassung

In diesem Beitrag haben wir gezeigt, wie man ein Computer-Vision-Modell mit rein synthetischen Bildern trainiert und wie das Modell reale Objekte dennoch zuverlässig erkennen kann. Dies erspart erheblichen manuellen Aufwand beim Sammeln und Kennzeichnen der Trainingsdaten. Mit dieser Erkundung erweitert Dassault Systèmes den Geschäftswert der von Designern und Ingenieuren erstellten 3D-Produktmodelle, da Sie jetzt CAD-, CAE- und PLM-Daten in Erkennungssystemen für Bilder in der physischen Welt verwenden können.

Weitere Informationen zu den wichtigsten Funktionen und Anwendungsfällen von Rekognition Custom Labels finden Sie unter Benutzerdefinierte Etiketten von Amazon Rekognition. Wenn Ihre Bilder nicht nativ mit Ground Truth gekennzeichnet sind, was bei diesem Projekt der Fall war, siehe Erstellen einer Manifestdatei um Ihre Kennzeichnungsdaten in das Format zu konvertieren, das Rekognition Custom Labels verarbeiten kann.

Über die Autoren

Woody Borraccino ist derzeit Senior Machine Learning Specialist Solution Architect bei AWS. Woody lebt in Mailand, Italien, und arbeitete in der Softwareentwicklung, bevor er 2015 zu AWS kam, wo er seine Leidenschaft für Computer Vision und Spatial Computing (AR/VR/XR)-Technologien ausschöpft. Seine Leidenschaft gilt nun der Metaverse-Innovation. Folge ihm weiter Linkedin.

Woody Borraccino ist derzeit Senior Machine Learning Specialist Solution Architect bei AWS. Woody lebt in Mailand, Italien, und arbeitete in der Softwareentwicklung, bevor er 2015 zu AWS kam, wo er seine Leidenschaft für Computer Vision und Spatial Computing (AR/VR/XR)-Technologien ausschöpft. Seine Leidenschaft gilt nun der Metaverse-Innovation. Folge ihm weiter Linkedin.

Ying Hou, PhD, ist Machine Learning Prototyping Architect bei AWS. Ihre Hauptinteressensgebiete sind Deep Learning, Computer Vision, NLP und Zeitreihendatenvorhersage. In ihrer Freizeit liest sie gerne Romane und wandert in Nationalparks in Großbritannien.

Ying Hou, PhD, ist Machine Learning Prototyping Architect bei AWS. Ihre Hauptinteressensgebiete sind Deep Learning, Computer Vision, NLP und Zeitreihendatenvorhersage. In ihrer Freizeit liest sie gerne Romane und wandert in Nationalparks in Großbritannien.

Bernhard Paques ist derzeit CTO von Storm Reply und konzentriert sich auf industrielle Lösungen, die auf AWS bereitgestellt werden. Bernard lebt in Paris, Frankreich, und arbeitete zuvor als Principal Solution Architect und als Principal Consultant bei AWS. Seine Beiträge zur Unternehmensmodernisierung umfassen AWS for Industrial, AWS CDK, und diese stammen nun aus Green IT und sprachbasierten Systemen. Folge ihm weiter Twitter.

Bernhard Paques ist derzeit CTO von Storm Reply und konzentriert sich auf industrielle Lösungen, die auf AWS bereitgestellt werden. Bernard lebt in Paris, Frankreich, und arbeitete zuvor als Principal Solution Architect und als Principal Consultant bei AWS. Seine Beiträge zur Unternehmensmodernisierung umfassen AWS for Industrial, AWS CDK, und diese stammen nun aus Green IT und sprachbasierten Systemen. Folge ihm weiter Twitter.

Karl Herkt ist derzeit Senior Strategist bei Dassault Systèmes 3DExcite. Er lebt in München, Deutschland, und entwickelt innovative Implementierungen von Computer Vision, die greifbare Ergebnisse liefern. Folge ihm weiter LinkedIn.

Karl Herkt ist derzeit Senior Strategist bei Dassault Systèmes 3DExcite. Er lebt in München, Deutschland, und entwickelt innovative Implementierungen von Computer Vision, die greifbare Ergebnisse liefern. Folge ihm weiter LinkedIn.

- Coinsmart. Europas beste Bitcoin- und Krypto-Börse.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. DEN FREIEN ZUGANG.

- CryptoHawk. Altcoin-Radar. Kostenlose Testphase.

- Quelle: https://aws.amazon.com/blogs/machine-learning/computer-vision-using-synthetic-datasets-with-amazon-rekognition-custom-labels-and-dassault-systemes-3dexcite/

- "

- 000

- 100

- 3d

- Über uns

- genau

- erreicht

- über

- Aktivitäten

- Adoption

- AI

- Fluggesellschaften

- Flugzeuge

- Alle

- Amazon

- Analyse

- Bienen

- Anwendung

- Anwendungen

- Ansatz

- um

- zugewiesen

- Augmented

- Automatisiert

- durchschnittlich

- AWS

- Sein

- BESTE

- Grenze

- Box

- Browser

- bauen

- eingebaut

- Geschäft

- Unternehmen

- CAD

- Fähigkeiten

- Autos

- Fälle

- Einstufung

- Das Sammeln

- Kombination

- Kombinationen

- Unternehmen

- Komplex

- Komponente

- Computing

- Vertrauen

- Konfiguration

- Konsul (Console)

- Berater

- verbrauchen

- Verbraucher

- enthält

- Kosten

- könnte

- schafft

- wichtig

- CTO

- technische Daten

- Datenbase

- Verzögerungen

- Lieferanten

- Design

- erkannt

- Entdeckung

- Entwicklung

- Geräte

- anders

- digital

- Display

- verteilt

- Verteilung

- Diversität

- Tut nicht

- Domain

- dynamisch

- Früh

- leicht

- Edge

- Herausgeber

- bewirken

- ermöglichen

- Endpunkt

- Entwicklung

- Ingenieure

- Unternehmen

- Europäische

- Beispiel

- Ausbau

- ERFAHRUNGEN

- Expertise

- Exploration

- Gesichter

- beschleunigt

- Merkmal

- Eigenschaften

- Feedback

- Vorname

- konzentriert

- folgen

- Folgende

- Format

- Frankreich

- Ausrüstung

- erzeugen

- Generation

- Deutschland

- Kundenziele

- gut

- Grün

- Wachstum

- Höhe

- Hilfe

- hilft

- hier

- High

- hoch

- HMI

- Gehäuse

- Ultraschall

- Hilfe

- HTTPS

- identifizieren

- Image

- unmittelbar

- implementieren

- zu unterstützen,

- das

- Einschließlich

- Erhöhung

- hat

- industriell

- Information

- Infrastruktur

- Innovation

- innovativ

- geistigen

- geistiges Eigentum

- Interesse

- Interessen

- IT

- Italien

- beigetreten

- Wesentliche

- bekannt

- Beschriftung

- Etiketten

- Arbeit

- LERNEN

- lernen

- !

- Limitiert

- Line

- aus einer regionalen

- Logistik

- Maschine

- Maschinelles Lernen

- Making

- verwaltet

- manuell

- manuell

- Herstellung

- Metaverse

- ML

- Mobil

- mobile Geräte

- Modell

- für

- vor allem warme

- MSN

- National

- Anzahl

- Zahlen

- Option

- Optionen

- Auftrag

- Andere

- Andernfalls

- Paris

- Personen

- Fotorealistisch

- physikalisch

- ein Bild

- Plattform

- möglich

- Prognose

- Prognosen

- Gegenwart

- Principal

- Aufgabenstellung:

- Prozessdefinierung

- anpassen

- produziert

- Produziert

- Produkt

- Produktion

- Produktionen

- Produkte

- Projekt

- Projekte

- Resorts

- Prototyping

- die

- bietet

- Qualität

- Lesebrillen

- Echtzeit

- erhalten

- erkennen

- erkennt

- Veteran

- Reduzierung

- falls angefordert

- Voraussetzungen:

- Die Ergebnisse

- ROI

- Führen Sie

- Sicherheit

- skalierbaren

- Skalieren

- Wissenschaftler

- Suche

- ausgewählt

- Modellreihe

- kompensieren

- signifikant

- ähnlich

- Einfacher

- Größe

- So

- Software

- Software-Entwicklung

- Lösungen

- spezialisiert

- speziell

- Anfang

- Vorbau

- Lagerung

- Sturm

- Strategie

- Oberfläche

- System

- Systeme und Techniken

- Target

- und Aufgaben

- Team

- Technologies

- Technologie

- Test

- Testen

- Die Quelle

- Tausende

- während

- Zeit

- heutigen

- Top

- Ausbildung

- schult Ehrenamtliche

- Transformation

- Transparenz

- Uk

- einzigartiges

- us

- -

- Wert

- Verification

- Gegen

- Videos

- Anzeigen

- Assistent

- Seh-

- Netz

- Web-Browser

- Webcam

- Webseite

- Wikipedia

- ohne

- Arbeiten

- gearbeitet

- weltweit wie ausgehandelt und gekauft ausgeführt wird.