In der sich schnell entwickelnden Gesundheitslandschaft von heute sind Ärzte mit riesigen Mengen klinischer Daten aus verschiedenen Quellen konfrontiert, wie z. B. Notizen des Pflegepersonals, elektronischen Gesundheitsakten und Bildgebungsberichten. Diese Fülle an Informationen ist zwar für die Patientenversorgung unerlässlich, kann für medizinische Fachkräfte jedoch auch überwältigend und zeitaufwändig sein, sie durchzusehen und zu analysieren. Die effiziente Zusammenfassung und Gewinnung von Erkenntnissen aus diesen Daten ist für eine bessere Patientenversorgung und Entscheidungsfindung von entscheidender Bedeutung. Zusammengefasste Patienteninformationen können für eine Reihe nachgelagerter Prozesse nützlich sein, etwa für die Datenaggregation, die effektive Codierung von Patienten oder die Gruppierung von Patienten mit ähnlichen Diagnosen zur Überprüfung.

Modelle für künstliche Intelligenz (KI) und maschinelles Lernen (ML) haben sich bei der Bewältigung dieser Herausforderungen als vielversprechend erwiesen. Modelle können trainiert werden, um große Textdatenmengen zu analysieren und zu interpretieren und so Informationen effektiv in prägnanten Zusammenfassungen zu verdichten. Durch die Automatisierung des Zusammenfassungsprozesses können Ärzte schnell auf relevante Informationen zugreifen und sich so auf die Patientenversorgung konzentrieren und fundiertere Entscheidungen treffen. Siehe Folgendes Fallstudie um mehr über einen realen Anwendungsfall zu erfahren.

Amazon Sage Maker, ein vollständig verwalteter ML-Dienst, bietet eine ideale Plattform für das Hosting und die Implementierung verschiedener AI/ML-basierter Zusammenfassungsmodelle und -ansätze. In diesem Beitrag untersuchen wir verschiedene Optionen zur Implementierung von Zusammenfassungstechniken in SageMaker, einschließlich der Verwendung Amazon SageMaker-JumpStart Basismodelle, Feinabstimmung vorab trainierter Modelle von Hugging Face und Erstellung benutzerdefinierter Zusammenfassungsmodelle. Wir diskutieren auch die Vor- und Nachteile jedes Ansatzes, damit medizinisches Fachpersonal die am besten geeignete Lösung für die Erstellung prägnanter und genauer Zusammenfassungen komplexer klinischer Daten auswählen kann.

Zwei wichtige Begriffe, die Sie kennen sollten, bevor wir beginnen: vorgeübt und Feintuning. Ein vorab trainiertes oder Basismodell ist ein Modell, das auf einer großen Datenmenge aufgebaut und trainiert wurde, typischerweise für allgemeine Sprachkenntnisse. Feinabstimmung ist der Prozess, bei dem einem vorab trainierten Modell ein weiterer, domänenspezifischerer Datensatz zugewiesen wird, um seine Leistung bei einer bestimmten Aufgabe zu verbessern. Im Gesundheitswesen würde dies bedeuten, dass dem Modell einige Daten einschließlich Phrasen und Terminologie zur Verfügung gestellt werden, die sich speziell auf die Patientenversorgung beziehen.

Erstellen Sie benutzerdefinierte Zusammenfassungsmodelle auf SageMaker

Obwohl dies der aufwändigste Ansatz ist, ziehen es einige Unternehmen möglicherweise vor, benutzerdefinierte Zusammenfassungsmodelle auf SageMaker von Grund auf zu erstellen. Dieser Ansatz erfordert tiefergehende Kenntnisse über KI-/ML-Modelle und kann die Erstellung einer Modellarchitektur von Grund auf oder die Anpassung vorhandener Modelle an spezifische Anforderungen umfassen. Die Erstellung benutzerdefinierter Modelle kann eine größere Flexibilität und Kontrolle über den Zusammenfassungsprozess bieten, erfordert jedoch im Vergleich zu Ansätzen, die auf vorab trainierten Modellen basieren, auch mehr Zeit und Ressourcen. Es ist wichtig, die Vor- und Nachteile dieser Option sorgfältig abzuwägen, bevor Sie fortfahren, da sie möglicherweise nicht für alle Anwendungsfälle geeignet ist.

SageMaker JumpStart-Grundlagenmodelle

Eine großartige Option zur Implementierung der Zusammenfassung in SageMaker ist die Verwendung von JumpStart-Grundmodellen. Diese von führenden KI-Forschungsorganisationen entwickelten Modelle bieten eine Reihe vorab trainierter Sprachmodelle, die für verschiedene Aufgaben optimiert sind, einschließlich der Textzusammenfassung. SageMaker JumpStart bietet zwei Arten von Basismodellen: proprietäre Modelle und Open-Source-Modelle. SageMaker JumpStart bietet außerdem HIPAA-Berechtigung, was es für Arbeitsbelastungen im Gesundheitswesen nützlich macht. Letztendlich liegt es in der Verantwortung des Kunden, die Einhaltung sicherzustellen. Stellen Sie daher sicher, dass Sie die entsprechenden Schritte unternehmen. Sehen Architektur für HIPAA-Sicherheit und Compliance bei Amazon Web Services für weitere Informationen an.

Proprietäre Stiftungsmodelle

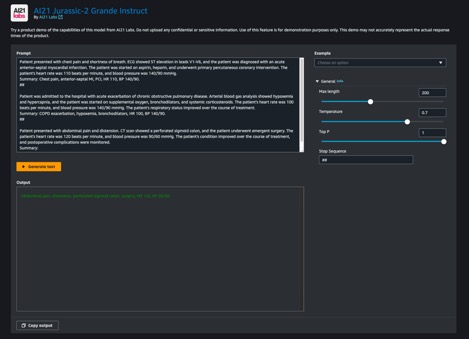

Proprietäre Modelle wie Jurassic-Modelle von AI21 und das Cohere Generate-Modell von Cohere können über SageMaker JumpStart auf der entdeckt werden AWS-Managementkonsole und befinden sich derzeit in der Vorschau. Die Verwendung proprietärer Modelle zur Zusammenfassung ist ideal, wenn Sie Ihr Modell nicht anhand benutzerdefinierter Daten verfeinern müssen. Dies bietet eine benutzerfreundliche, sofort einsatzbereite Lösung, die Ihre Zusammenfassungsanforderungen mit minimaler Konfiguration erfüllen kann. Durch die Nutzung der Funktionen dieser vorab trainierten Modelle können Sie Zeit und Ressourcen sparen, die sonst für das Training und die Feinabstimmung eines benutzerdefinierten Modells aufgewendet würden. Darüber hinaus verfügen proprietäre Modelle in der Regel über benutzerfreundliche APIs und SDKs, die den Integrationsprozess mit Ihren vorhandenen Systemen und Anwendungen optimieren. Wenn Ihre Zusammenfassungsanforderungen durch vorab trainierte proprietäre Modelle erfüllt werden können, ohne dass eine spezifische Anpassung oder Feinabstimmung erforderlich ist, bieten sie eine praktische, kostengünstige und effiziente Lösung für Ihre Textzusammenfassungsaufgaben. Da diese Modelle nicht speziell für Anwendungsfälle im Gesundheitswesen trainiert werden, kann die Qualität der medizinischen Sprache ohne Feinabstimmung nicht garantiert werden.

Jurassic-2 Grande Instruct ist ein großes Sprachmodell (LLM) von AI21 Labs, das für Anweisungen in natürlicher Sprache optimiert und auf verschiedene Sprachaufgaben anwendbar ist. Es bietet eine benutzerfreundliche API und ein Python-SDK, die Qualität und Erschwinglichkeit in Einklang bringen. Zu den beliebten Einsatzmöglichkeiten gehören das Erstellen von Marketingtexten, das Betreiben von Chatbots und das Zusammenfassen von Texten.

Navigieren Sie auf der SageMaker-Konsole zu SageMaker JumpStart, suchen Sie das AI21 Jurassic-2 Grande Instruct-Modell und wählen Sie es aus Modell ausprobieren.

Wenn Sie das Modell auf einem von Ihnen verwalteten SageMaker-Endpunkt bereitstellen möchten, können Sie die Schritte in diesem Beispiel befolgen Notizbuch, das Ihnen zeigt, wie Sie Jurassic-2 Large mit SageMaker bereitstellen.

Open-Source-Grundlagenmodelle

Zu den Open-Source-Modellen gehören FLAN T5-, Bloom- und GPT-2-Modelle, die über SageMaker JumpStart im entdeckt werden können Amazon SageMaker-Studio Benutzeroberfläche, SageMaker JumpStart auf der SageMaker-Konsole und SageMaker JumpStart-APIs. Diese Modelle können fein abgestimmt und auf Endpunkten unter Ihrem AWS-Konto bereitgestellt werden, sodass Sie die volle Kontrolle über Modellgewichtungen und Skriptcodes haben.

Flan-T5 XL ist ein leistungsstarkes und vielseitiges Modell, das für eine Vielzahl von Sprachaufgaben entwickelt wurde. Durch die Feinabstimmung des Modells mit Ihren domänenspezifischen Daten können Sie seine Leistung für Ihren speziellen Anwendungsfall optimieren, beispielsweise für die Textzusammenfassung oder jede andere NLP-Aufgabe. Einzelheiten zur Feinabstimmung von Flan-T5 XL mithilfe der SageMaker Studio-Benutzeroberfläche finden Sie unter Feinabstimmung der Anleitung für FLAN T5 XL mit Amazon SageMaker Jumpstart.

Feinabstimmung vorab trainierter Modelle mit Hugging Face auf SageMaker

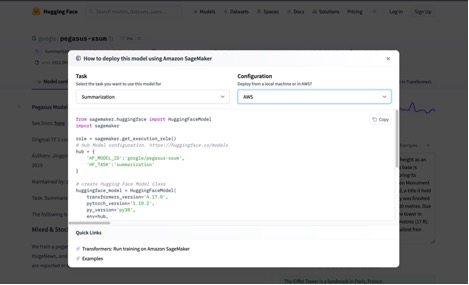

Eine der beliebtesten Optionen zur Implementierung der Zusammenfassung in SageMaker ist die Feinabstimmung vorab trainierter Modelle mithilfe des Hugging Face Transformatoren Bibliothek. Hugging Face bietet eine breite Palette vorab trainierter Transformer-Modelle, die speziell für verschiedene Aufgaben der Verarbeitung natürlicher Sprache (NLP) entwickelt wurden, einschließlich der Textzusammenfassung. Mit der Hugging Face Transformers-Bibliothek können Sie diese vorab trainierten Modelle mit SageMaker ganz einfach an Ihren domänenspezifischen Daten anpassen. Dieser Ansatz bietet mehrere Vorteile, wie z. B. schnellere Trainingszeiten, bessere Leistung in bestimmten Domänen und einfachere Modellpaketierung und -bereitstellung mithilfe der integrierten SageMaker-Tools und -Dienste. Wenn Sie in SageMaker JumpStart kein passendes Modell finden, können Sie ein beliebiges von Hugging Face angebotenes Modell auswählen und es mit SageMaker optimieren.

Um mit einem Modell zu arbeiten und mehr über die Funktionen von ML zu erfahren, müssen Sie lediglich SageMaker Studio öffnen und ein vorab trainiertes Modell finden, das Sie im verwenden möchten Modellhub mit umarmendem Gesichtund wählen Sie SageMaker als Bereitstellungsmethode. Hugging Face gibt Ihnen den Code zum Kopieren, Einfügen und Ausführen in Ihrem Notizbuch. So einfach ist das! Keine ML-Engineering-Erfahrung erforderlich.

Die Hugging Face Transformers-Bibliothek ermöglicht es Entwicklern, mit den vorab trainierten Modellen zu arbeiten und erweiterte Aufgaben wie Feinabstimmungen durchzuführen, die wir in den folgenden Abschnitten untersuchen.

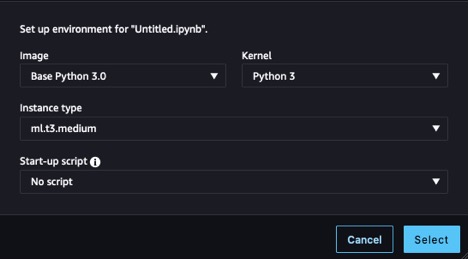

Ressourcen bereitstellen

Bevor wir beginnen können, müssen wir ein Notebook bereitstellen. Anweisungen finden Sie in den Schritten 1 und 2 in Erstellen und trainieren Sie lokal ein Modell für maschinelles Lernen. Für dieses Beispiel haben wir die im folgenden Screenshot gezeigten Einstellungen verwendet.

Wir müssen auch eine erstellen Amazon Simple Storage-Service (Amazon S3) Bucket zum Speichern der Trainingsdaten und Trainingsartefakte. Anweisungen finden Sie unter Einen Eimer erstellen.

Bereiten Sie den Datensatz vor

Um unser Modell so zu verfeinern, dass es über bessere Domänenkenntnisse verfügt, müssen wir Daten erhalten, die für die Aufgabe geeignet sind. Wenn Sie für einen Unternehmensanwendungsfall trainieren, müssen Sie eine Reihe von Data-Engineering-Aufgaben durchlaufen, um Ihre eigenen Daten für die Schulung vorzubereiten. Diese Aufgaben liegen außerhalb des Rahmens dieses Beitrags. Für dieses Beispiel haben wir einige synthetische Daten generiert, um Pflegenotizen zu emulieren, und sie in Amazon S3 gespeichert. Die Speicherung unserer Daten in Amazon S3 ermöglicht uns dies Gestalten Sie unsere Workloads für die HIPAA-Konformität. Wir beginnen damit, diese Notizen abzurufen und sie auf die Instanz zu laden, auf der unser Notebook ausgeführt wird:

Die Notizen bestehen aus einer Spalte mit dem vollständigen Eintrag (Notiz) und einer Spalte mit einer gekürzten Version, die veranschaulicht, was unsere gewünschte Ausgabe sein sollte (Zusammenfassung). Der Zweck der Verwendung dieses Datensatzes besteht darin, das biologische und medizinische Vokabular unseres Modells zu verbessern, damit es besser auf die Zusammenfassung im Gesundheitskontext abgestimmt ist Domain-Feinabstimmungund zeigen Sie unserem Modell, wie es seine zusammengefasste Ausgabe strukturieren kann. In einigen Fällen einer Zusammenfassung möchten wir möglicherweise eine Zusammenfassung aus einem Artikel oder eine einzeilige Zusammenfassung einer Rezension erstellen. In diesem Fall versuchen wir jedoch, unser Modell dazu zu bringen, eine gekürzte Version der Symptome und ergriffenen Maßnahmen auszugeben für einen Patienten bisher.

Laden Sie das Modell

Das Modell, das wir als Grundlage verwenden, ist eine Version von Googles Pegasus, verfügbar im Hugging Face Hub, genannt pegasus-xsum. Es ist bereits für die Zusammenfassung vorab trainiert, sodass sich unser Feinabstimmungsprozess auf die Erweiterung seines Domänenwissens konzentrieren kann. Das Ändern der von unserem Modell ausgeführten Aufgabe ist eine andere Art der Feinabstimmung, die in diesem Beitrag nicht behandelt wird. Die Transformer-Bibliothek stellt uns eine Klasse zum Laden der Modelldefinition aus unserem zur Verfügung model_checkpoint: google/pegasus-xsum. Dadurch wird das Modell vom Hub geladen und in unserem Notebook instanziiert, damit wir es später verwenden können. Weil pegasus-xsum Da es sich um ein Sequenz-zu-Sequenz-Modell handelt, möchten wir den Seq2Seq-Typ verwenden AutoModell Klasse:

Nachdem wir nun unser Modell haben, ist es an der Zeit, unsere Aufmerksamkeit auf die anderen Komponenten zu richten, die es uns ermöglichen, unsere Trainingsschleife auszuführen.

Erstellen Sie einen Tokenizer

Die erste dieser Komponenten ist der Tokenizer. Tokenisierung ist der Prozess, durch den Wörter aus den Eingabedaten in numerische Darstellungen umgewandelt werden, die unser Modell verstehen kann. Auch hier stellt die Transformer-Bibliothek eine Klasse bereit, mit der wir eine Tokenizer-Definition von demselben Prüfpunkt laden können, den wir zum Instanziieren des Modells verwendet haben:

Mit diesem Tokenizer-Objekt können wir eine Vorverarbeitungsfunktion erstellen und sie unserem Datensatz zuordnen, um uns Token zu geben, die für die Einspeisung in das Modell bereit sind. Abschließend formatieren wir die tokenisierte Ausgabe und entfernen die Spalten mit unserem Originaltext, da das Modell diese nicht interpretieren kann. Jetzt steht uns eine tokenisierte Eingabe zur Verfügung, die in das Modell eingespeist werden kann. Siehe den folgenden Code:

Nachdem unsere Daten tokenisiert und unser Modell instanziiert wurden, sind wir fast bereit, eine Trainingsschleife auszuführen. Die nächsten Komponenten, die wir erstellen möchten, sind der Datensammler und der Optimierer. Der Datensammler ist eine weitere Klasse, die von Hugging Face über die Transformers-Bibliothek bereitgestellt wird und mit der wir Stapel unserer tokenisierten Daten für das Training erstellen. Wir können dies ganz einfach mit den Tokenizer- und Modellobjekten erstellen, die wir bereits haben, indem wir einfach den entsprechenden Klassentyp finden, den wir zuvor für unser Modell (Seq2Seq) für die Collator-Klasse verwendet haben. Die Funktion des Optimierers besteht darin, den Trainingszustand aufrechtzuerhalten und die Parameter basierend auf unserem Trainingsverlust zu aktualisieren, während wir die Schleife durchlaufen. Um einen Optimierer zu erstellen, können wir den importieren optim Paket aus dem Brennermodul, in dem eine Reihe von Optimierungsalgorithmen verfügbar sind. Einige häufige Beispiele, auf die Sie möglicherweise schon einmal gestoßen sind, sind Stochastic Gradient Descent und MarcusLetzteres wird in unserem Beispiel angewendet. Adams Konstruktor übernimmt die Modellparameter und die parametrisierte Lernrate für den gegebenen Trainingslauf. Siehe den folgenden Code:

Die letzten Schritte, bevor wir mit dem Training beginnen können, sind der Aufbau des Beschleunigers und des Lernratenplaners. Der Beschleuniger stammt aus einer anderen Bibliothek (wir haben hauptsächlich Transformers verwendet) von Hugging Face mit dem treffenden Namen Accelerate und abstrahiert die Logik, die zum Verwalten von Geräten während des Trainings erforderlich ist (z. B. unter Verwendung mehrerer GPUs). Für die letzte Komponente greifen wir erneut auf die stets nützliche Transformers-Bibliothek zurück, um unseren Lernratenplaner zu implementieren. Durch Angabe des Scheduler-Typs, der Gesamtzahl der Trainingsschritte in unserer Schleife und des zuvor erstellten Optimierers wird der get_scheduler Die Funktion gibt ein Objekt zurück, das es uns ermöglicht, unsere anfängliche Lernrate während des Trainingsprozesses anzupassen:

Wir sind jetzt vollständig für das Training vorbereitet! Lassen Sie uns einen Trainingsjob einrichten und zunächst den instanziieren training_args Verwenden der Transformers-Bibliothek und Auswählen von Parameterwerten. Wir können diese zusammen mit unseren anderen vorbereiteten Komponenten und Datensätzen direkt an die weitergeben Trainerin und beginnen Sie mit dem Training, wie im folgenden Code gezeigt. Abhängig von der Größe Ihres Datensatzes und den gewählten Parametern kann dies viel Zeit in Anspruch nehmen.

Verpacken Sie das Modell zur Inferenz

Nachdem das Training ausgeführt wurde, kann das Modellobjekt für die Inferenz verwendet werden. Als bewährte Methode speichern wir unsere Arbeit für die zukünftige Verwendung. Wir müssen unsere Modellartefakte erstellen, sie komprimieren und unseren Tarball zur Speicherung auf Amazon S3 hochladen. Um unser Modell für das Zippen vorzubereiten, müssen wir das nun fein abgestimmte Modell entpacken und dann die Modellbinärdatei und die zugehörigen Konfigurationsdateien speichern. Wir müssen unseren Tokenizer auch im selben Verzeichnis speichern, in dem wir unsere Modellartefakte gespeichert haben, damit er verfügbar ist, wenn wir das Modell für Inferenzen verwenden. Unser model_dir Der Ordner sollte nun etwa wie der folgende Code aussehen:

Jetzt müssen Sie nur noch einen tar-Befehl ausführen, um unser Verzeichnis zu komprimieren und die tar.gz-Datei auf Amazon S3 hochzuladen:

Unser neu optimiertes Modell ist nun bereit und kann für Inferenzen verwendet werden.

Führen Sie eine Schlussfolgerung durch

Um dieses Modellartefakt für die Inferenz zu verwenden, öffnen Sie eine neue Datei und verwenden Sie den folgenden Code, um ihn zu ändern model_data Parameter passend zum Speicherort Ihres Artefakts in Amazon S3. Der HuggingFaceModel Der Konstruktor erstellt unser Modell von dem Prüfpunkt aus neu, an dem wir es gespeichert haben model.tar.gz, die wir dann mithilfe der Deploy-Methode zur Inferenz bereitstellen können. Die Bereitstellung des Endpunkts dauert einige Minuten.

Nachdem der Endpunkt bereitgestellt wurde, können wir ihn mit dem von uns erstellten Prädiktor testen. Übergeben Sie die predict Methoden Sie eine Datennutzlast und führen Sie die Zelle aus. Sie erhalten dann die Antwort von Ihrem fein abgestimmten Modell:

Um den Nutzen der Feinabstimmung eines Modells zu erkennen, führen wir einen kurzen Test durch. Die folgende Tabelle enthält eine Eingabeaufforderung und die Ergebnisse der Übergabe dieser Eingabeaufforderung an das Modell vor und nach der Feinabstimmung.

| Prompt | Reaktion ohne Feinabstimmung | Reaktion mit Feinabstimmung |

| Fassen Sie die Symptome zusammen, die der Patient verspürt. Der Patient ist ein 45-jähriger Mann mit Beschwerden über substernale Brustschmerzen, die in den linken Arm ausstrahlen. Bei der Gartenarbeit treten plötzlich Schmerzen auf, die mit leichter Kurzatmigkeit und Schwitzen einhergehen. Bei der Ankunft betrug die Herzfrequenz des Patienten 120, die Atemfrequenz 24 und der Blutdruck 170/95. Bei der Ankunft in der Notaufnahme wurde ein 12-Kanal-Elektrokardiogramm erstellt und dreimal sublingual Nitroglycerin verabreicht, ohne dass die Brustschmerzen gelindert wurden. Das Elektrokardiogramm zeigt eine ST-Hebung in den vorderen Ableitungen, was auf einen akuten vorderen Myokardinfarkt hinweist. Wir haben Kontakt zum Herzkatheterlabor aufgenommen und bereiten uns auf die Herzkatheteruntersuchung durch einen Kardiologen vor. | Wir stellen einen Fall eines akuten Myokardinfarkts vor. | Brustschmerzen, vorderer MI, PCI. |

Wie Sie sehen, verwendet unser fein abgestimmtes Modell die Gesundheitsterminologie anders und wir konnten die Struktur der Antwort an unsere Zwecke anpassen. Beachten Sie, dass die Ergebnisse von Ihrem Datensatz und den während des Trainings getroffenen Designentscheidungen abhängen. Ihre Version des Modells könnte sehr unterschiedliche Ergebnisse liefern.

Aufräumen

Wenn Sie mit Ihrem SageMaker-Notebook fertig sind, schalten Sie es unbedingt aus, um Kosten durch Ressourcen mit langer Laufzeit zu vermeiden. Beachten Sie, dass durch das Herunterfahren der Instanz alle im flüchtigen Speicher der Instanz gespeicherten Daten verloren gehen. Sie sollten daher Ihre gesamte Arbeit vor der Bereinigung im persistenten Speicher speichern. Sie müssen auch zum gehen Endpunkte Seite auf der SageMaker-Konsole und löschen Sie alle zur Inferenz bereitgestellten Endpunkte. Um alle Artefakte zu entfernen, müssen Sie auch zur Amazon S3-Konsole gehen, um in Ihren Bucket hochgeladene Dateien zu löschen.

Zusammenfassung

In diesem Beitrag haben wir verschiedene Optionen für die Implementierung von Textzusammenfassungstechniken auf SageMaker untersucht, um medizinisches Fachpersonal dabei zu unterstützen, große Mengen klinischer Daten effizient zu verarbeiten und Erkenntnisse daraus zu gewinnen. Wir haben die Verwendung von SageMaker Jumpstart-Basismodellen, die Feinabstimmung vorab trainierter Modelle von Hugging Face und die Erstellung benutzerdefinierter Zusammenfassungsmodelle besprochen. Jeder Ansatz hat seine eigenen Vor- und Nachteile und geht auf unterschiedliche Bedürfnisse und Anforderungen ein.

Das Erstellen benutzerdefinierter Zusammenfassungsmodelle auf SageMaker bietet viel Flexibilität und Kontrolle, erfordert jedoch mehr Zeit und Ressourcen als die Verwendung vorab trainierter Modelle. Die SageMaker Jumpstart-Grundlagenmodelle bieten eine benutzerfreundliche und kostengünstige Lösung für Unternehmen, die keine spezifische Anpassung oder Feinabstimmung benötigen, sowie einige Optionen für eine vereinfachte Feinabstimmung. Die Feinabstimmung vorab trainierter Modelle von Hugging Face bietet schnellere Trainingszeiten, eine bessere domänenspezifische Leistung und eine nahtlose Integration mit SageMaker-Tools und -Diensten über einen breiten Modellkatalog hinweg, erfordert jedoch einen gewissen Implementierungsaufwand. Zum Zeitpunkt des Verfassens dieses Beitrags hat Amazon eine weitere Option angekündigt: Amazonas Grundgestein, das Zusammenfassungsfunktionen in einer noch besser verwalteten Umgebung bietet.

Durch das Verständnis der Vor- und Nachteile jedes Ansatzes können medizinisches Fachpersonal und Organisationen fundierte Entscheidungen über die am besten geeignete Lösung zur Erstellung prägnanter und genauer Zusammenfassungen komplexer klinischer Daten treffen. Letztendlich kann die Verwendung von AI/ML-basierten Zusammenfassungsmodellen auf SageMaker die Patientenversorgung und Entscheidungsfindung erheblich verbessern, indem es medizinischen Fachkräften ermöglicht, schnell auf relevante Informationen zuzugreifen und sich auf die Bereitstellung einer qualitativ hochwertigen Pflege zu konzentrieren.

Downloads

Das vollständige Skript, das in diesem Beitrag besprochen wird, und einige Beispieldaten finden Sie unter GitHub Repo. Weitere Informationen zum Ausführen von ML-Workloads auf AWS finden Sie in den folgenden Ressourcen:

Über die Autoren

CodyCollins ist ein in New York ansässiger Lösungsarchitekt bei Amazon Web Services. Er arbeitet mit ISV-Kunden zusammen, um branchenführende Lösungen in der Cloud zu entwickeln. Er hat komplexe Projekte für verschiedene Branchen erfolgreich durchgeführt und dabei Effizienz und Skalierbarkeit optimiert. In seiner Freizeit liest er gerne, reist und trainiert Jiu-Jitsu.

CodyCollins ist ein in New York ansässiger Lösungsarchitekt bei Amazon Web Services. Er arbeitet mit ISV-Kunden zusammen, um branchenführende Lösungen in der Cloud zu entwickeln. Er hat komplexe Projekte für verschiedene Branchen erfolgreich durchgeführt und dabei Effizienz und Skalierbarkeit optimiert. In seiner Freizeit liest er gerne, reist und trainiert Jiu-Jitsu.

Ameer Hakme ist ein AWS-Lösungsarchitekt mit Wohnsitz in Pennsylvania. Sein beruflicher Schwerpunkt liegt auf der Zusammenarbeit mit unabhängigen Softwareanbietern im gesamten Nordosten und deren Anleitung beim Entwurf und Aufbau skalierbarer, hochmoderner Plattformen in der AWS Cloud.

Ameer Hakme ist ein AWS-Lösungsarchitekt mit Wohnsitz in Pennsylvania. Sein beruflicher Schwerpunkt liegt auf der Zusammenarbeit mit unabhängigen Softwareanbietern im gesamten Nordosten und deren Anleitung beim Entwurf und Aufbau skalierbarer, hochmoderner Plattformen in der AWS Cloud.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/exploring-summarization-options-for-healthcare-with-amazon-sagemaker/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 10

- 100

- 12

- 14

- 15%

- 24

- 33

- 7

- 8

- 9

- a

- Fähig

- Über Uns

- ABSTRACT

- beschleunigen

- Beschleuniger

- Zugang

- Konto

- genau

- über

- Aktionen

- Marcus

- Adressierung

- verabreicht

- advanced

- Vorteilen

- Nach der

- aufs Neue

- Anhäufung

- AI

- ai Forschung

- AI / ML

- Algorithmen

- Alle

- Zulassen

- erlaubt

- entlang

- bereits

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Betrag

- Beträge

- an

- analysieren

- und

- angekündigt

- Ein anderer

- jedem

- Bienen

- APIs

- anwendbar

- Anwendungen

- angewandt

- Ansatz

- Ansätze

- angemessen

- Architektur

- SIND

- ARM

- Ankunft

- Artikel

- AS

- damit verbundenen

- At

- Aufmerksamkeit

- automatisieren

- verfügbar

- vermeiden

- ein Weg

- AWS

- Balancing

- basierend

- BE

- weil

- war

- Bevor

- beginnen

- Nutzen

- Vorteile

- BESTE

- Besser

- BIN

- Blut

- Ausgleich bei Blutdruckschwankungen

- Blühen

- Box

- Luft

- breit

- bauen

- Bauherren

- Building

- erbaut

- eingebaut

- aber

- by

- rufen Sie uns an!

- namens

- CAN

- Fähigkeiten

- österreichische Unternehmen

- vorsichtig

- Häuser

- Fälle

- Katalog

- Verursachen

- Herausforderungen

- Übernehmen

- Chatbots

- Entscheidungen

- Auswählen

- Auswahl

- gewählt

- Klasse

- Klinische

- Cloud

- Code

- Codes

- Programmierung

- Zusammenarbeit

- Kolonne

- Spalten

- wie die

- kommt

- gemeinsam

- verglichen

- Beschwerden

- Komplex

- Compliance

- Komponente

- Komponenten

- zusammengesetzt

- prägnant

- Konfiguration

- Nachteile

- Konsul (Console)

- Bau

- Kontext

- Smartgeräte App

- Praktische

- Dazugehörigen

- kostengünstiger

- Kosten

- könnte

- bedeckt

- erstellen

- erstellt

- Erstellen

- wichtig

- Zur Zeit

- Original

- Kunde

- Kunden

- Anpassung

- technische Daten

- Datensätze

- Decision Making

- Entscheidungen

- Definition

- geliefert

- demonstrieren

- Abteilung

- abhängig

- Abhängig

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- Design

- entworfen

- Entwerfen

- erwünscht

- Details

- entwickelt

- Geräte

- anders

- Direkt

- entdeckt

- diskutieren

- diskutiert

- verschieden

- do

- Ärzte

- Dabei

- Domain

- Domains

- erledigt

- Nicht

- nach unten

- Nachteile

- im

- jeder

- einfacher

- leicht

- Einfache

- einfach zu bedienende

- effektiv

- Effizienz

- effizient

- effizient

- Anstrengung

- elektronisch

- Elektronische Gesundheitsakten

- Wählbarkeit

- Notfall

- ermöglichen

- ermöglicht

- ermöglichen

- Endpunkt

- Entwicklung

- zu steigern,

- gewährleisten

- Unternehmen

- Eintrag

- Arbeitsumfeld

- Epoche

- essential

- Sogar

- sich entwickelnden

- Beispiel

- vorhandenen

- ERFAHRUNGEN

- erleben

- ERKUNDEN

- Erkundet

- Möglichkeiten sondieren

- Verlängerung

- Extrakt

- Gesicht

- konfrontiert

- weit

- beschleunigt

- Fed

- wenige

- Reichen Sie das

- Mappen

- Finale

- Endlich

- Finden Sie

- Suche nach

- Vorname

- passen

- Flexibilität

- Setzen Sie mit Achtsamkeit

- folgen

- Folgende

- Aussichten für

- Format

- Foundation

- für

- voller

- voll

- Funktion

- Außerdem

- Zukunft

- Gewinnen

- Allgemeines

- erzeugen

- erzeugt

- Erzeugung

- bekommen

- bekommen

- ABSICHT

- gegeben

- Unterstützung

- Go

- GPUs

- groß

- mehr

- garantiert

- Haben

- he

- Gesundheit

- Gesundheitswesen

- Herz

- Hilfe

- seine

- Hosting

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- Nabe

- Umarmendes Gesicht

- ideal

- if

- Imaging

- implementieren

- Implementierung

- Umsetzung

- importieren

- wichtig

- zu unterstützen,

- in

- eingehende

- das

- Dazu gehören

- Einschließlich

- unabhängig

- Branchen

- Energiegewinnung

- Information

- informiert

- Anfangs-

- Varianten des Eingangssignals:

- Eingänge

- Einblicke

- Instanz

- Anleitung

- Integration

- Intelligenz

- in

- beteiligen

- IT

- SEINE

- Job

- JSON

- nur

- Wissen

- Wissen

- Labor

- Labs

- Landschaft

- Sprache

- grosse

- Nachname

- später

- führen

- führenden

- umwandeln

- LERNEN

- lernen

- links

- Bibliothek

- Gefällt mir

- LLM

- Belastung

- Laden

- Standorte

- Logik

- aussehen

- verlieren

- Verlust

- Maschine

- Maschinelles Lernen

- gemacht

- halten

- um

- Making

- verwalten

- verwaltet

- Management

- Karte

- Marketing

- Kann..

- bedeuten

- sowie medizinische

- Triff

- Memory

- versiegelte

- Methode

- könnte

- minimal

- Minuten

- ML

- Modell

- für

- Modul

- mehr

- vor allem warme

- Am beliebtesten

- mehrere

- Namens

- Natürliche

- Verarbeitung natürlicher Sprache

- Navigieren

- Need

- Bedürfnisse

- Neu

- New York

- neu

- weiter

- Nlp

- nicht

- Notizbuch

- Notizen

- jetzt an

- Anzahl

- Objekt

- Objekte

- of

- bieten

- angeboten

- Angebote

- Alt

- on

- EINEM

- Einsen

- Ausbruch

- auf zu

- XNUMXh geöffnet

- Open-Source-

- betreiben

- Optimierung

- Optimieren

- optimiert

- Optimierung

- Option

- Optionen

- or

- Auftrag

- Organisationen

- Original

- Andere

- Andernfalls

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- aussen

- übrig

- besitzen

- Eigentum

- Paket

- Verpackung

- Seite

- Schmerzen

- Parameter

- Parameter

- besondere

- passieren

- Bestehen

- Vertrauen bei Patienten

- Patienten

- Pegasus

- Pennsylvania

- Leistung

- betreffend

- Sätze

- Plattform

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Points

- Beliebt

- Post

- größte treibende

- Powering

- Praxis

- Predictor

- bevorzugen

- Danach

- bereit

- Gegenwart

- Druck

- Vorspann

- vorher

- in erster Linie

- Prozessdefinierung

- anpassen

- Verarbeitung

- Produziert

- Professionell

- Profis

- Projekte

- Versprechen

- Eigentums-

- PROS

- die

- vorausgesetzt

- bietet

- Bereitstellung

- Bereitstellung

- Zweck

- Zwecke

- setzen

- Python

- Qualität

- Direkt

- schnell

- Angebot

- schnell

- Bewerten

- Lesebrillen

- bereit

- realen Welt

- Aufzeichnungen

- relevant

- Erleichterung

- entfernen

- Meldungen

- erfordern

- falls angefordert

- Voraussetzungen:

- erfordert

- Forschungsprojekte

- Downloads

- Antwort

- Die Ergebnisse

- Rückgabe

- Überprüfen

- Rollen

- Führen Sie

- Laufen

- läuft

- sagemaker

- gleich

- Speichern

- Skalierbarkeit

- skalierbaren

- Umfang

- kratzen

- Sdk

- SDKS

- nahtlos

- Abschnitte

- Sicherheitdienst

- sehen

- getrennte

- Lösungen

- kompensieren

- Einstellung

- Einstellungen

- mehrere

- verkürzt

- sollte

- erklären

- gezeigt

- Konzerte

- Herunterfahren

- Sieben

- signifikant

- bedeutend

- ähnlich

- Einfacher

- vereinfachte

- Größe

- So

- bis jetzt

- Software

- Lösung

- Lösungen

- einige

- etwas

- Quellen

- spezifisch

- speziell

- verbrachte

- Anfang

- Beginnen Sie

- Bundesstaat

- State-of-the-art

- Shritte

- Lagerung

- speichern

- gelagert

- Speicherung

- Rationalisierung

- Struktur

- Studio Adressen

- sublingual

- Erfolgreich

- so

- plötzlich

- Anzug

- geeignet

- ZUSAMMENFASSUNG

- sicher

- Symptome

- synopsis

- synthetisch

- synthetische Daten

- Systeme und Techniken

- Tabelle

- Nehmen

- gemacht

- nimmt

- Aufgabe

- und Aufgaben

- Techniken

- Terminologie

- AGB

- Test

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- der Hub

- Sie

- dann

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- nach drei

- Durch

- während

- Zeit

- Zeitaufwendig

- mal

- zu

- heutigen

- gemeinsam

- Tokenisiert

- Tokens

- Werkzeuge

- Fackel

- Gesamt

- Training

- trainiert

- Ausbildung

- verwandelt

- Transformator

- Transformer

- Reise

- XNUMX

- tippe

- Typen

- typisch

- ui

- Letztlich

- nicht fähig

- für

- verstehen

- Verständnis

- Aktualisierung

- hochgeladen

- us

- -

- Anwendungsfall

- benutzt

- benutzerfreundlich

- verwendet

- Verwendung von

- Verwendung

- Bestätigung

- Werte

- verschiedene

- riesig

- Anbieter

- vielseitig

- Version

- sehr

- Volumen

- wollen

- wurde

- we

- Reichtum

- Netz

- Web-Services

- wiegen

- GUT

- Was

- wann

- welche

- während

- breit

- Große Auswahl

- werden wir

- mit

- ohne

- Worte

- Arbeiten

- arbeiten,

- Werk

- würde

- Schreiben

- Jahr

- York

- Du

- Ihr

- Zephyrnet

- PLZ