Kunden in Branchen wie Konsumgüter, Fertigung und Einzelhandel suchen immer nach Möglichkeiten, ihre betrieblichen Prozesse zu stärken, indem sie sie mit Erkenntnissen und Analysen aus Daten bereichern. Aufgaben wie Verkaufsprognosen wirken sich direkt auf Vorgänge wie Rohstoffplanung, Beschaffung, Fertigung, Vertrieb und Eingangs-/Ausgangslogistik aus und können viele Auswirkungen haben, von einem einzelnen Lager bis hin zu großen Produktionsanlagen.

Vertriebsmitarbeiter und Manager verwenden historische Verkaufsdaten, um fundierte Vorhersagen über zukünftige Verkaufstrends zu treffen. Kunden verwenden SAP ERP Central Component (ECC), um die Planung für die Herstellung, den Verkauf und die Verteilung von Waren zu verwalten. Das Sales and Distribution (SD)-Modul in SAP ECC hilft bei der Verwaltung von Kundenaufträgen. SAP-Systeme sind die Hauptquelle für historische Verkaufsdaten.

Vertriebsmitarbeiter und Manager verfügen über das Domänenwissen und ein tiefes Verständnis ihrer Vertriebsdaten. Ihnen fehlen jedoch Datenwissenschafts- und Programmierkenntnisse, um Modelle für maschinelles Lernen (ML) zu erstellen, die Verkaufsprognosen erstellen können. Sie suchen nach intuitiven, einfach zu bedienenden Tools, um ML-Modelle zu erstellen, ohne eine einzige Codezeile schreiben zu müssen.

Um Unternehmen dabei zu helfen, die Agilität und Effektivität zu erreichen, die Business-Analysten anstreben, haben wir eingeführt Amazon SageMaker-Leinwand, eine ML-Lösung ohne Code, mit der Sie die Bereitstellung von ML-Lösungen auf Stunden oder Tage beschleunigen können. Canvas ermöglicht Analysten die einfache Nutzung verfügbarer Daten in Data Lakes, Data Warehouses und Betriebsdatenspeichern; ML-Modelle erstellen; und verwenden Sie sie, um interaktiv Vorhersagen zu treffen und Massendatensätze im Batch zu bewerten – alles ohne eine einzige Codezeile zu schreiben.

In diesem Beitrag zeigen wir, wie Sie Kundenauftragsdaten aus SAP ECC importieren, um mithilfe eines mit Canvas erstellten ML-Modells Verkaufsprognosen zu erstellen.

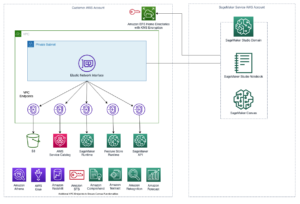

Lösungsüberblick

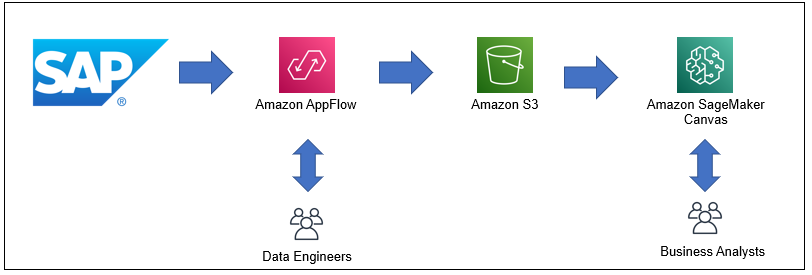

Um Verkaufsprognosen unter Verwendung von SAP-Verkaufsdaten zu erstellen, benötigen wir die Zusammenarbeit von zwei Personas: Data Engineers und Business Analysts (Vertriebsmitarbeiter und Manager). Data Engineers sind für die Konfiguration des Datenexports aus dem SAP-System verantwortlich Amazon Simple Storage-Service (Amazon S3) mit Amazon App-Flow, die Business-Analysten dann entweder nach Bedarf oder automatisch (zeitgesteuert) ausführen können, um SAP-Daten im S3-Bucket zu aktualisieren. Business-Analysten sind dann dafür verantwortlich, Prognosen mit den exportierten Daten mit Canvas zu erstellen. Das folgende Diagramm veranschaulicht diesen Workflow.

Für diesen Beitrag verwenden wir SAP NetWeaver Enterprise-Beschaffungsmodell (EPM) für die Beispieldaten. EPM wird im Allgemeinen zu Demonstrations- und Testzwecken in SAP verwendet. Es verwendet ein allgemeines Geschäftsprozessmodell und folgt dem Geschäftsobjekt (BO)-Paradigma, um eine klar definierte Geschäftslogik zu unterstützen. Wir haben die SAP-Transaktion SEPM_DG (Datengenerator) verwendet, um rund 80,000 historische Verkaufsaufträge zu generieren, und eine HANA-CDS-Ansicht erstellt, um die Daten nach Produkt-ID, Verkaufsdatum und Stadt zu aggregieren, wie im folgenden Code gezeigt:

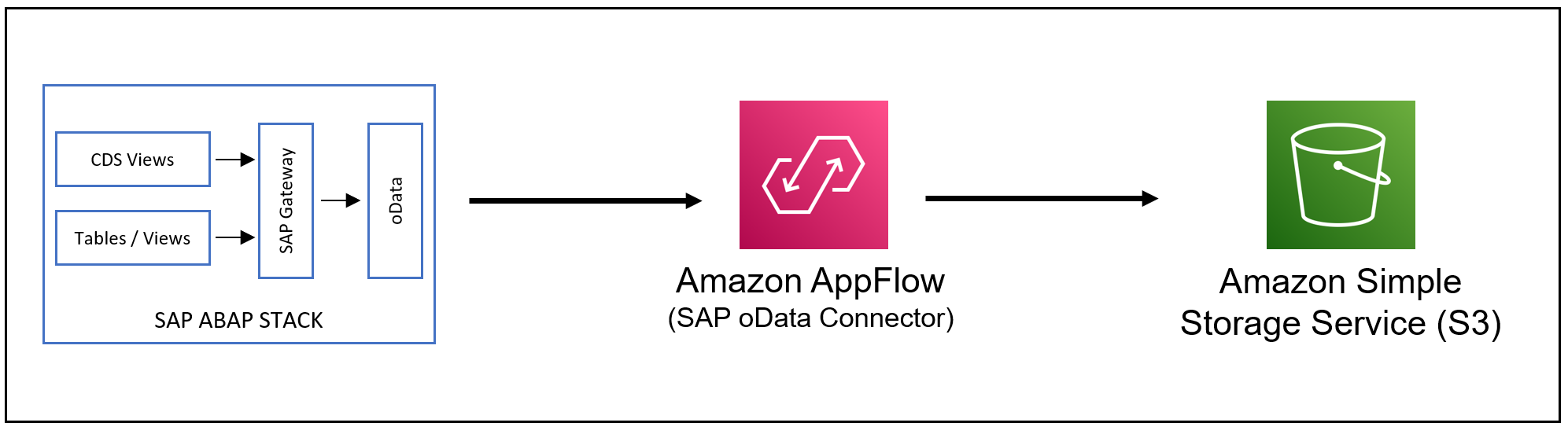

Im nächsten Abschnitt stellen wir diese Ansicht mithilfe von SAP-OData-Services als ABAP-Struktur bereit, die es uns ermöglicht, die Daten mit Amazon AppFlow zu extrahieren.

Die folgende Tabelle zeigt die repräsentativen historischen Verkaufsdaten von SAP, die wir in diesem Beitrag verwenden.

| Produkt ID | Verkaufsdatum | Stadt | Gesamtumsatz |

| P-4 | 2013-01-02 00:00:00 | Quito | 1922.00 |

| P-5 | 2013-01-02 00:00:00 | Santo Domingo | 1903.00 |

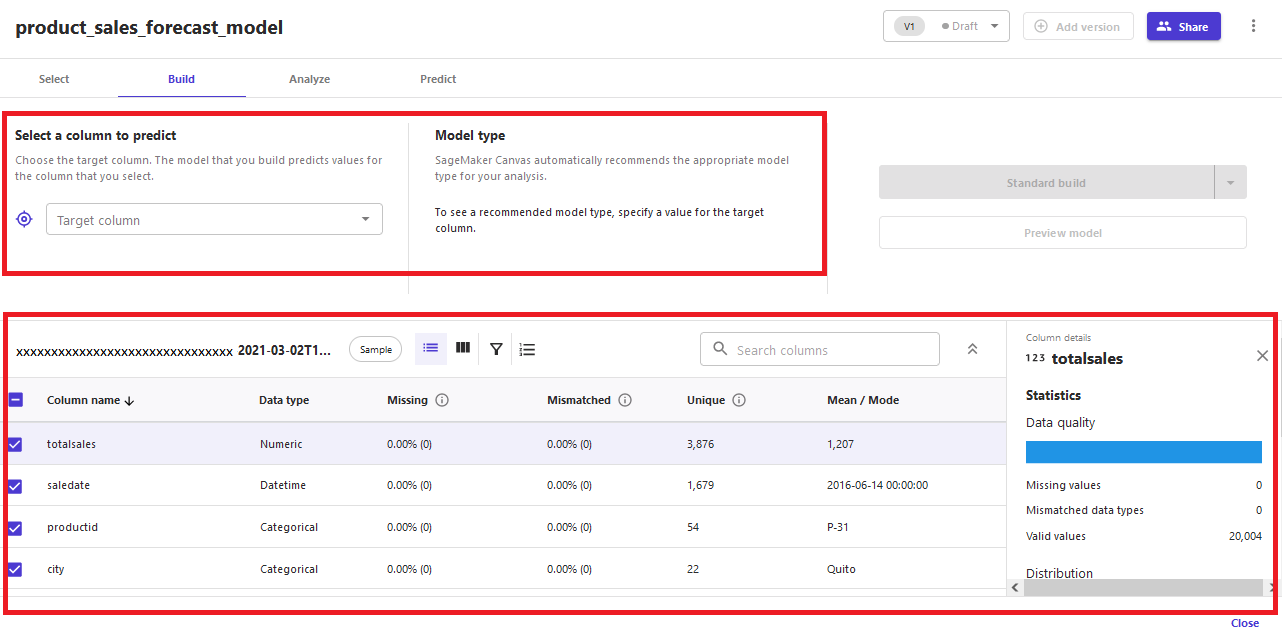

Die Datendatei enthält historische Daten zur täglichen Häufigkeit. Es hat vier Spalten (productid, saledate, city und totalsales). Wir verwenden Canvas, um ein ML-Modell zu erstellen, das für Prognosen verwendet wird totalsales für productid in einer bestimmten Stadt.

Dieser Beitrag wurde organisiert, um die Aktivitäten und Verantwortlichkeiten sowohl für Dateningenieure als auch für Geschäftsanalysten aufzuzeigen, um Produktverkaufsprognosen zu erstellen.

Datentechniker: Extrahieren, transformieren und laden Sie das Dataset mit Amazon AppFlow aus SAP in Amazon S3

Die erste Aufgabe, die Sie als Data Engineer ausführen, besteht darin, einen Job zum Extrahieren, Transformieren und Laden (ETL) für historische Verkaufsdaten aus SAP ECC in einen S3-Bucket auszuführen, den der Business-Analyst als Quelldatensatz für sein Prognosemodell verwendet. Dafür verwenden wir Amazon AppFlow, weil es ein Out-of-the-Box bietet SAP-OData-Konnektor für ETL (wie im folgenden Diagramm gezeigt), mit einer einfachen Benutzeroberfläche, um alles einzurichten, was zum Konfigurieren der Verbindung vom SAP ECC zum S3-Bucket erforderlich ist.

Voraussetzungen:

Die folgenden Anforderungen gelten für die Integration von Amazon AppFlow mit SAP:

- SAP NetWeaver Stack Version 7.40 SP02 oder höher

- Katalogdienst (OData v2.0/v2.0) aktiviert in SAP Gateway für die Diensterkennung

- Unterstützung für clientseitige Paginierung und Abfrageoptionen für SAP OData Service

- HTTPS-fähige Verbindung zu SAP

Authentifizierung

Amazon AppFlow unterstützt zwei Authentifizierungsmechanismen für die Verbindung mit SAP:

- Basic – Authentifiziert mit SAP-OData-Benutzername und -Passwort.

- OAuth 2.0 – Verwendet die OAuth 2.0-Konfiguration mit einem Identitätsanbieter. OAuth 2.0 muss für OData v2.0/v2.0-Dienste aktiviert sein.

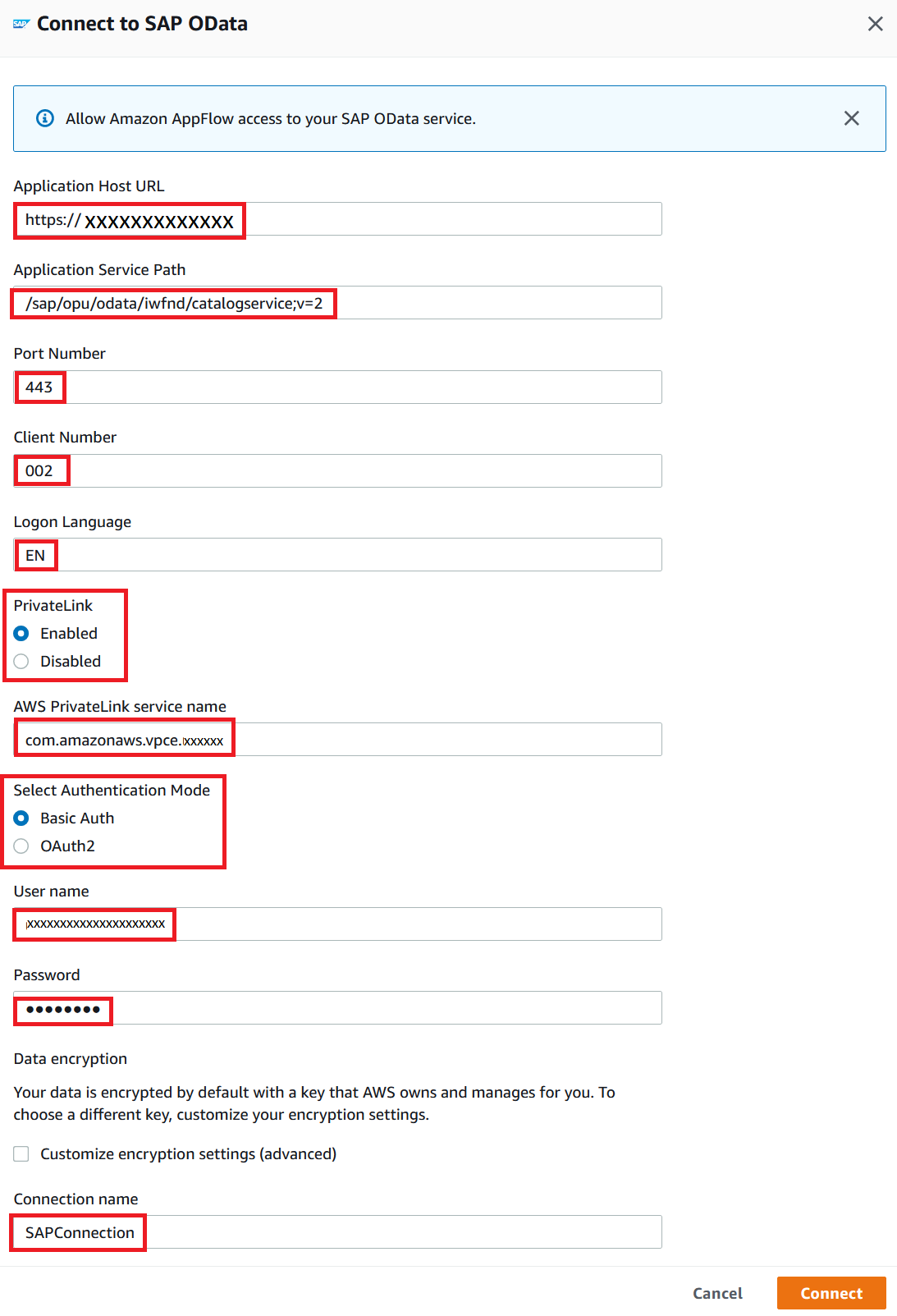

Sichere

Amazon AppFlow kann über eine öffentliche SAP-OData-Schnittstelle oder eine private Verbindung eine Verbindung zu SAP ECC herstellen. Eine private Verbindung verbessert den Datenschutz und die Sicherheit, indem Daten über das private AWS-Netzwerk statt über das öffentliche Internet übertragen werden. Eine private Verbindung verwendet den VPC-Endpunktdienst für die SAP-OData-Instanz, die in einer VPC ausgeführt wird. Der VPC-Endpunktdienst muss über den Amazon AppFlow-Dienstprinzipal verfügen appflow.amazonaws.com als zulässiger Prinzipal und muss in mindestens mehr als 50 % der Availability Zones in einer AWS-Region verfügbar sein.

Richten Sie einen Flow in Amazon AppFlow ein

Wir konfigurieren einen neuen Flow in Amazon AppFlow, um einen ETL-Job für Daten von SAP zu einem S3-Bucket auszuführen. Dieser Ablauf ermöglicht die Konfiguration von SAP OData Connector als Quelle, S3-Bucket als Ziel, OData-Objektauswahl, Datenzuordnung, Datenvalidierung und Datenfilterung.

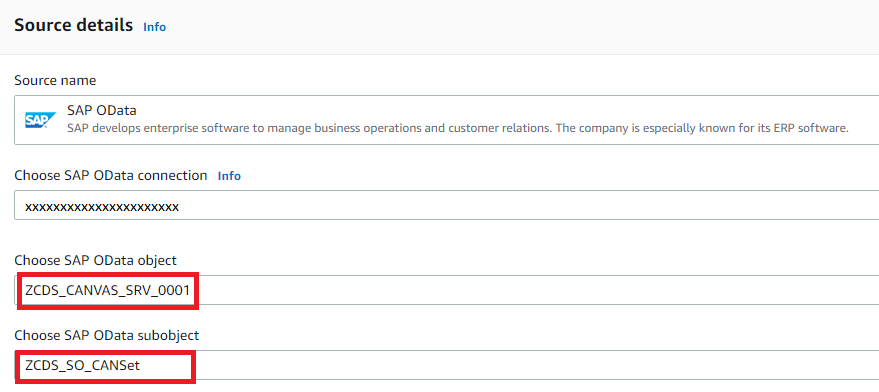

- Konfigurieren Sie den SAP OData Connector als Datenquelle, indem Sie die folgenden Informationen bereitstellen:

- Nachdem Sie die Quelle konfiguriert haben, wählen Sie das OData-Objekt und Unterobjekt für die Verkaufsaufträge aus.

Im Allgemeinen werden Verkaufsdaten aus SAP in einer bestimmten Häufigkeit exportiert, z. B. monatlich oder vierteljährlich für die volle Größe. Wählen Sie für diesen Beitrag die Unterobjektoption für den Export in voller Größe.

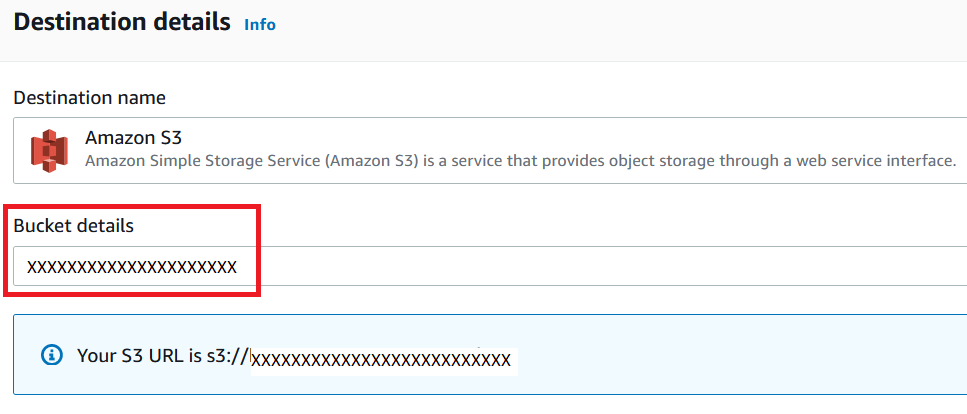

- Wählen Sie den S3-Bucket als Ziel aus.

Der Flow exportiert Daten in diesen Bucket.

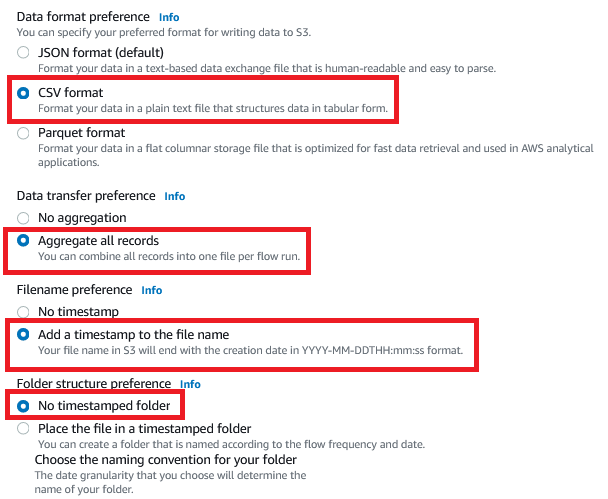

- Aussichten für Bevorzugtes DatenformatWählen CSV-Format.

- Aussichten für DatenübertragungspräferenzWählen Aggregieren Sie alle Datensätze.

- Aussichten für Voreinstellung für DateinamenWählen Fügen Sie dem Dateinamen einen Zeitstempel hinzu.

- Aussichten für Bevorzugte OrdnerstrukturWählen Kein Ordner mit Zeitstempel.

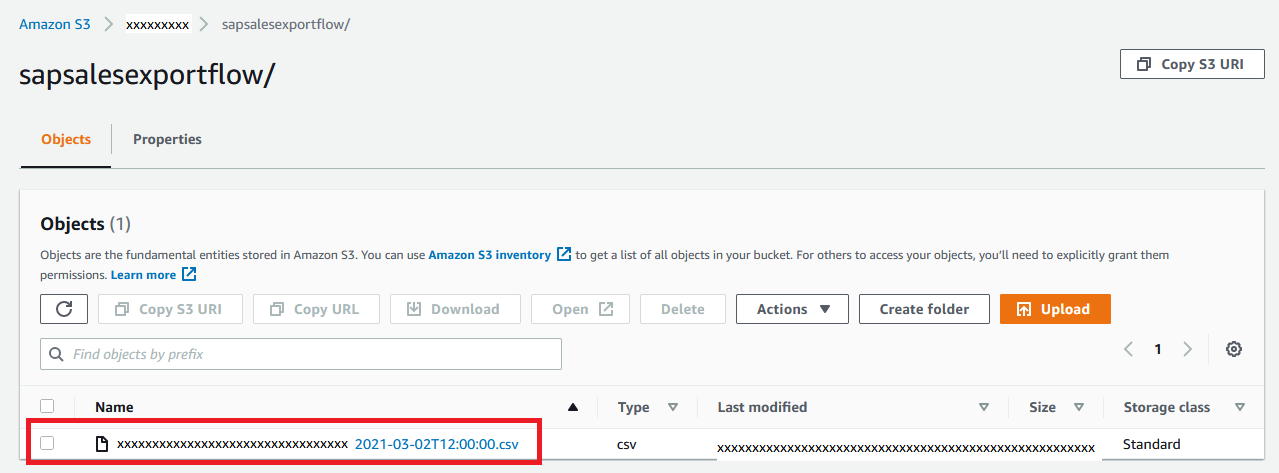

Die Datensatzaggregationskonfiguration exportiert die vollständigen Verkaufsdaten aus SAP kombiniert in einer einzigen Datei. Der Dateiname endet mit einem Zeitstempel im Format YYYY-MM-DDTHH:mm:ss in einem einzelnen Ordner (Flow-Name) innerhalb des S3-Buckets. Canvas importiert Daten aus dieser einzelnen Datei für das Modelltraining und die Prognose.

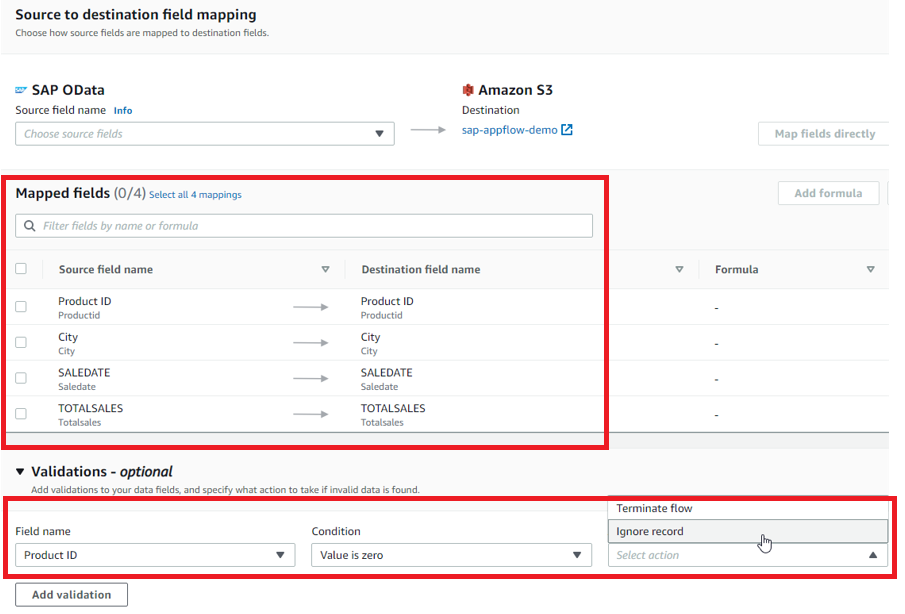

- Konfigurieren Sie die Datenzuordnung und -validierung, um die Quelldatenfelder den Zieldatenfeldern zuzuordnen, und aktivieren Sie Datenvalidierungsregeln nach Bedarf.

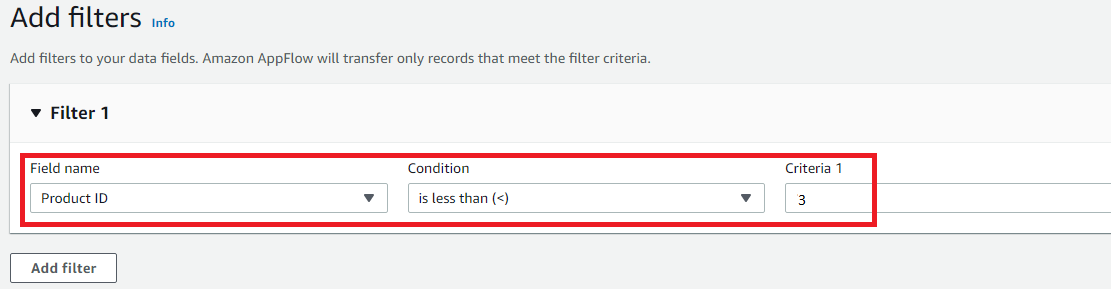

- Sie konfigurieren auch Datenfilterbedingungen, um bestimmte Datensätze herauszufiltern, wenn Ihre Anforderung dies erfordert.

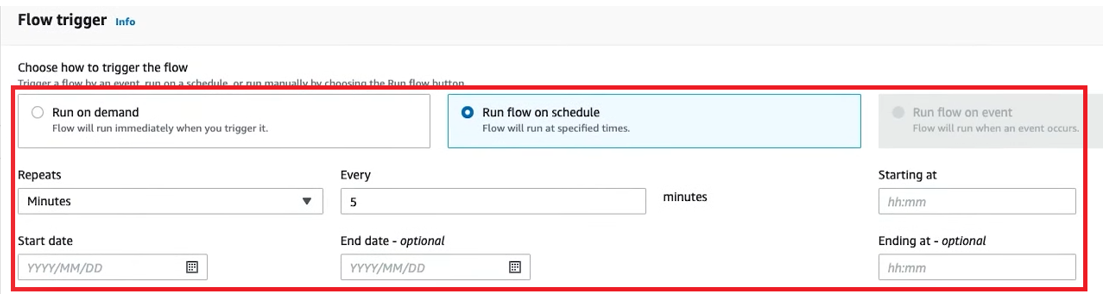

- Konfigurieren Sie Ihren Flow-Auslöser, um zu entscheiden, ob der Flow manuell bei Bedarf oder automatisch basierend auf einem Zeitplan ausgeführt wird.

Bei der Konfiguration für einen Zeitplan basiert die Häufigkeit darauf, wie oft die Prognose generiert werden muss (im Allgemeinen monatlich, vierteljährlich oder halbjährlich).

Nachdem der Flow konfiguriert wurde, können die Business-Analysten ihn bei Bedarf oder basierend auf dem Zeitplan ausführen, um einen ETL-Job für die Kundenauftragsdaten von SAP zu einem S3-Bucket auszuführen.

Nachdem der Flow konfiguriert wurde, können die Business-Analysten ihn bei Bedarf oder basierend auf dem Zeitplan ausführen, um einen ETL-Job für die Kundenauftragsdaten von SAP zu einem S3-Bucket auszuführen. - Zusätzlich zur Amazon AppFlow-Konfiguration müssen die Datentechniker auch eine konfigurieren AWS Identity and Access Management and (IAM)-Rolle für Canvas, damit es auf andere AWS-Services zugreifen kann. Anweisungen finden Sie unter Erteilen Sie Ihren Benutzern Berechtigungen zum Durchführen von Zeitreihenprognosen.

Business Analyst: Verwenden Sie die historischen Verkaufsdaten, um ein Prognosemodell zu trainieren

Lassen Sie uns den Gang wechseln und auf die Seite der Business-Analysten wechseln. Als Business Analyst suchen wir nach einem visuellen Point-and-Click-Service, der es einfach macht, ML-Modelle zu erstellen und genaue Vorhersagen zu generieren, ohne eine einzige Codezeile zu schreiben oder ML-Expertise zu haben. Canvas erfüllt die Anforderungen als No-Code-ML-Lösung.

Stellen Sie zunächst sicher, dass Ihre IAM-Rolle so konfiguriert ist, dass Canvas auf andere AWS-Services zugreifen kann. Weitere Informationen finden Sie unter Erteilen Sie Ihren Benutzern Berechtigungen zum Durchführen von Zeitreihenprognosen, oder Sie können Ihr Cloud Engineering-Team um Hilfe bitten.

Wenn der Dateningenieur die Amazon AppFlow-basierte ETL-Konfiguration eingerichtet hat, stehen Ihnen die historischen Verkaufsdaten in einem S3-Bucket zur Verfügung.

Jetzt können Sie ein Modell mit Canvas trainieren! Dies umfasst normalerweise vier Schritte: Importieren von Daten in den Dienst, Konfigurieren des Modelltrainings durch Auswählen des geeigneten Modelltyps, Trainieren des Modells und schließlich Generieren von Prognosen mithilfe des Modells.

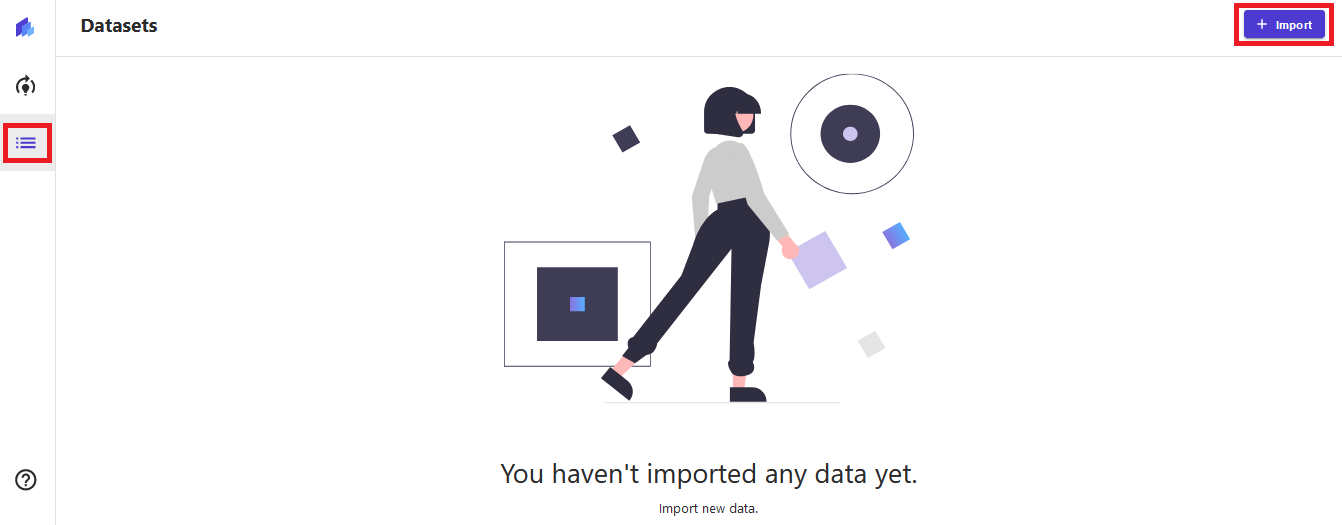

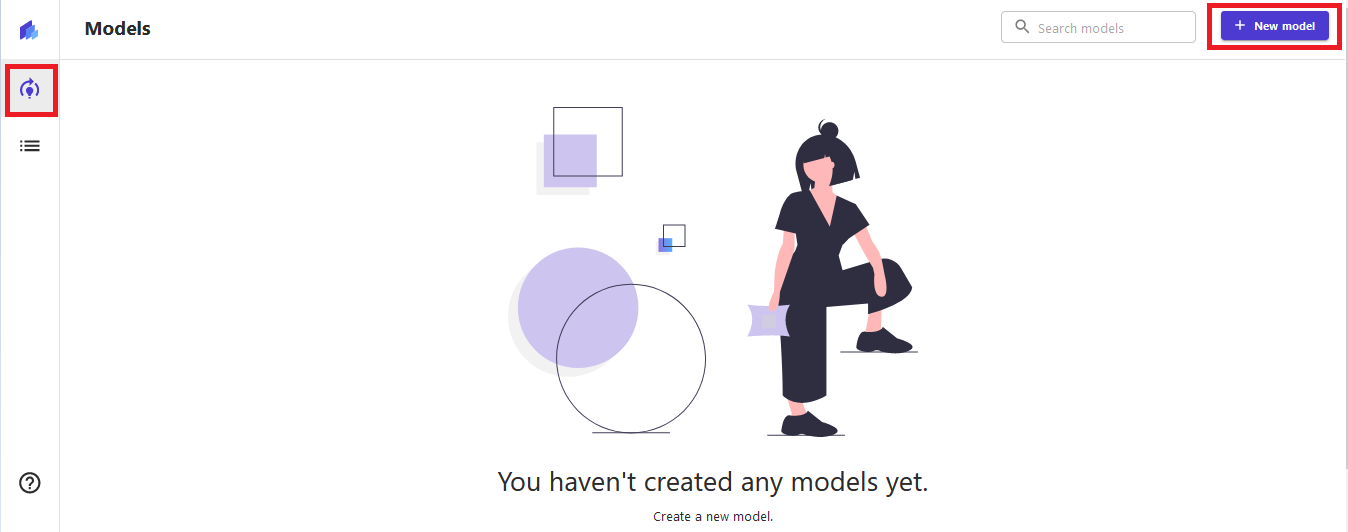

Importieren Sie Daten in Canvas

Starten Sie zunächst die Canvas-App über die Amazon Sage Maker -Konsole oder über Ihren Single-Sign-On-Zugang. Wenn Sie nicht wissen, wie das geht, wenden Sie sich an Ihren Administrator, damit er Sie durch den Einrichtungsprozess von Canvas führen kann. Stellen Sie sicher, dass Sie auf den Service in derselben Region zugreifen wie der S3-Bucket, der das historische Dataset von SAP enthält. Sie sollten einen Bildschirm wie den folgenden sehen.

Führen Sie dann die folgenden Schritte aus:

- Wählen Sie im Canvas-Bereich aus Datensätze im Navigationsbereich.

- Auswählen

Import um mit dem Importieren von Daten aus dem S3-Bucket zu beginnen.

- Wählen Sie auf dem Importbildschirm die Datendatei oder das Objekt aus dem S3-Bucket aus, um die Trainingsdaten zu importieren.

Sie können mehrere Datensätze in Canvas importieren. Es unterstützt auch das Erstellen von Joins zwischen den Datensätzen durch Auswählen Daten verbinden, was besonders nützlich ist, wenn die Trainingsdaten auf mehrere Dateien verteilt sind.

Konfigurieren und trainieren Sie das Modell

Führen Sie nach dem Importieren der Daten die folgenden Schritte aus:

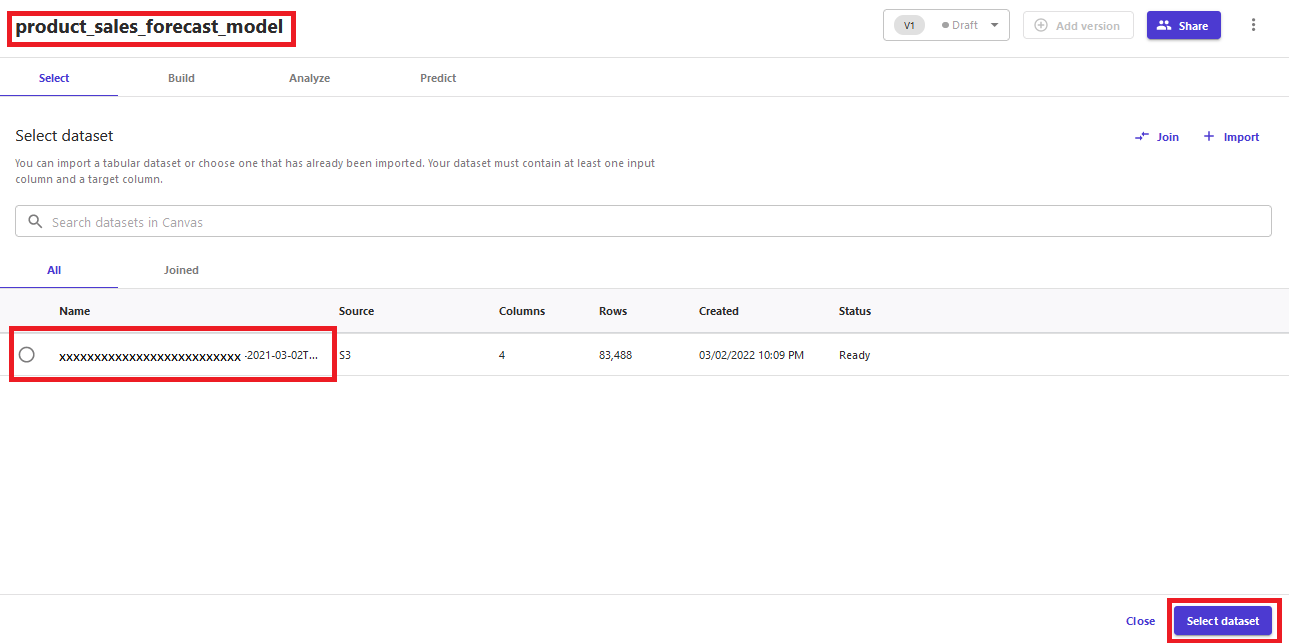

- Auswählen Modelle im Navigationsbereich.

- Auswählen

Neues Modell um die Konfiguration zum Trainieren des Prognosemodells zu starten.

- Geben Sie dem neuen Modell einen passenden Namen, z

product_sales_forecast_model. - Markieren Sie den Verkaufsdatensatz und wählen Sie Datensatz auswählen.

Nachdem das Dataset ausgewählt wurde, können Sie Datenstatistiken anzeigen und das Modelltraining auf der Registerkarte „Build“ konfigurieren.

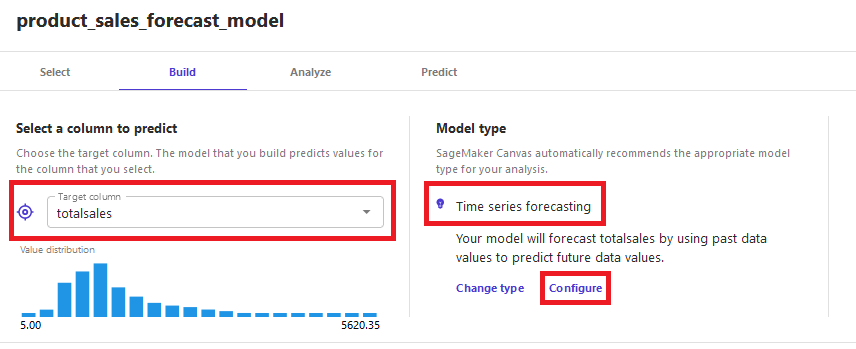

- Auswählen Gesamtumsatz als Zielspalte für die Vorhersage.

Du kannst sehen Zeitreihenprognosen wird automatisch als Modelltyp ausgewählt. - Auswählen

Einrichtung.

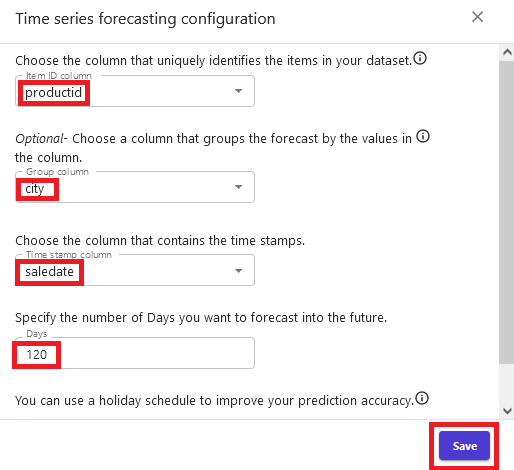

- Im Konfiguration der Zeitreihenprognose Wählen Sie im Abschnitt Produkt ID für Spalte Artikel-ID.

- Auswählen Stadt für Spalte Gruppe.

- Auswählen Verkaufsdatum für Spalte Zeitstempel.

- Aussichten für Tage

, eingeben

120. - Auswählen

Speichern.

Dadurch wird das Modell konfiguriert, für das Prognosen erstellt werdentotalsalesfür 120 tage mitsaledatebasierend auf historischen Daten, die abgefragt werden könnenproductidundcity.

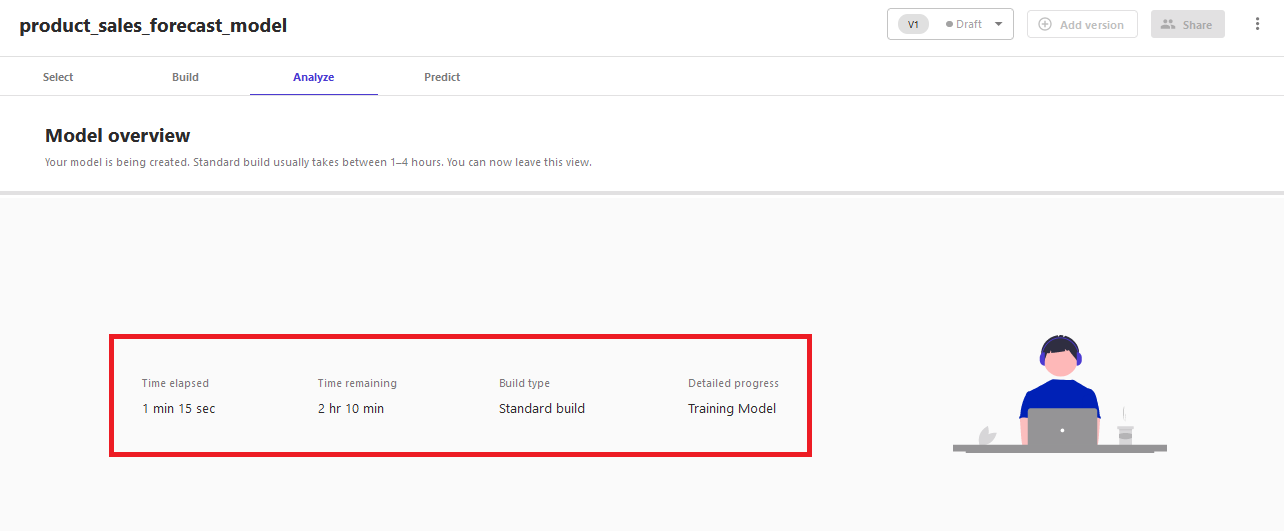

- Wenn die Konfiguration des Modelltrainings abgeschlossen ist, wählen Sie aus Standardaufbau um mit der Modelausbildung zu beginnen.

Das Vorschaumodell Die Option ist für den Modelltyp Zeitreihenprognose nicht verfügbar. Sie können die voraussichtliche Zeit für das Modelltraining auf der einsehen Analysieren Tab.

Das Modelltraining kann je nach Datengröße 1–4 Stunden dauern. Wenn das Modell fertig ist, können Sie es zum Generieren der Prognose verwenden.

Erstellen Sie eine Prognose

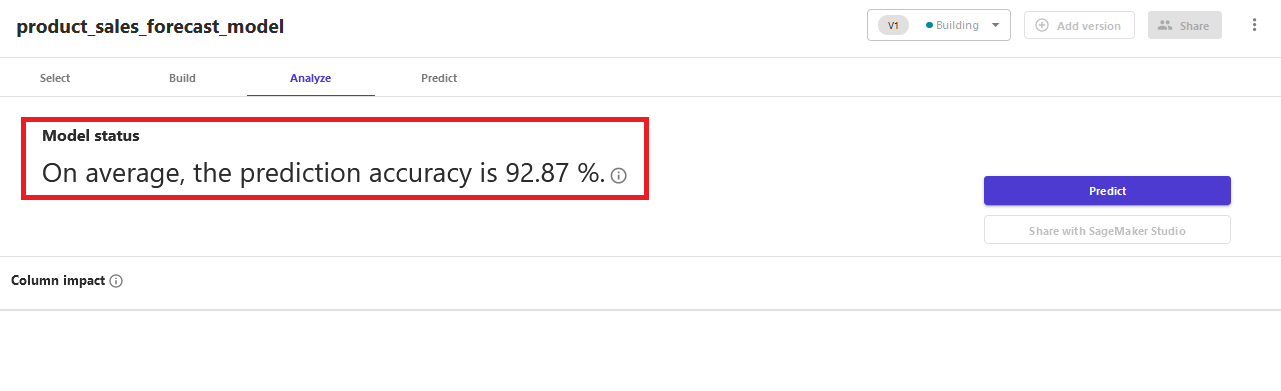

Wenn das Modelltraining abgeschlossen ist, zeigt es die Vorhersagegenauigkeit des Modells auf der Analysieren Tab. In diesem Beispiel zeigt es beispielsweise eine Vorhersagegenauigkeit von 92.87 %.

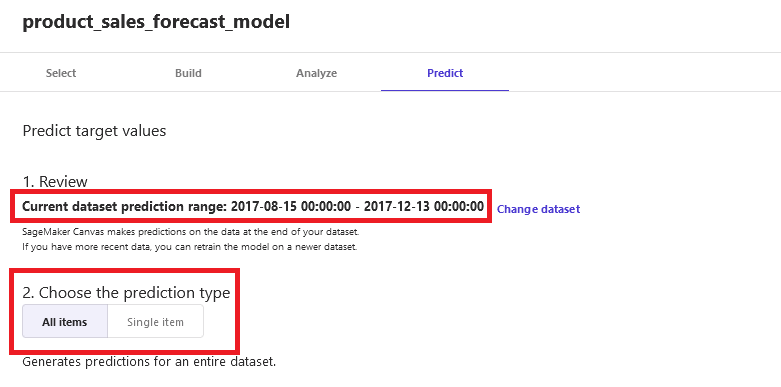

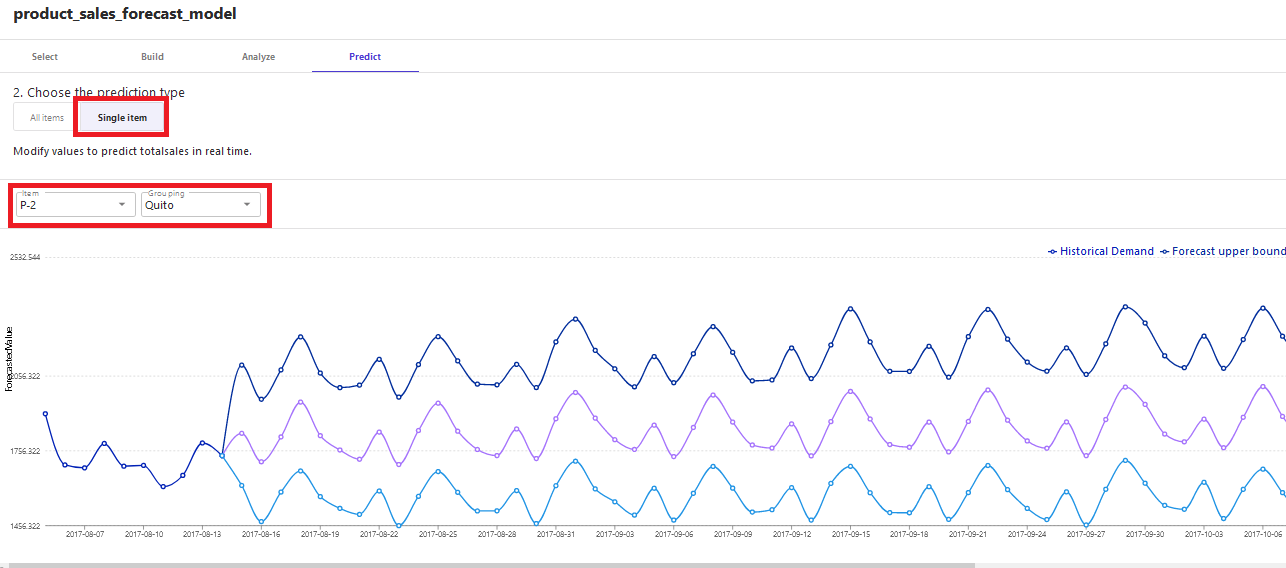

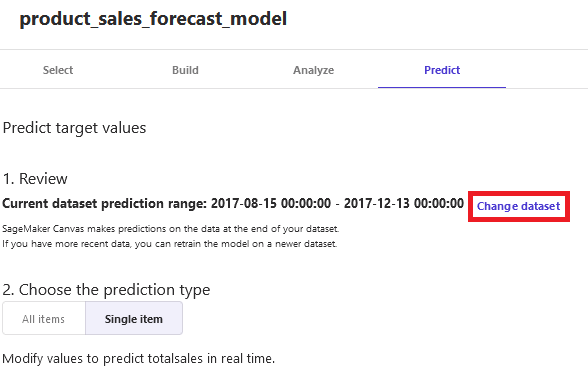

Die Prognose wird auf der generiert Vorhersagen Tab. Sie können Prognosen für alle Artikel oder einen ausgewählten einzelnen Artikel erstellen. Außerdem wird der Datumsbereich angezeigt, für den die Prognose erstellt werden kann.

Wählen Sie als Beispiel die Einzelposten Möglichkeit. Wählen P-2 für Artikel und Quito für Gruppe an um eine Vorhersage für Produkt P-2 für die Stadt Quito für den Datumsbereich 2017-08-15 00:00:00 bis 2017-12-13 00:00:00 zu erstellen.

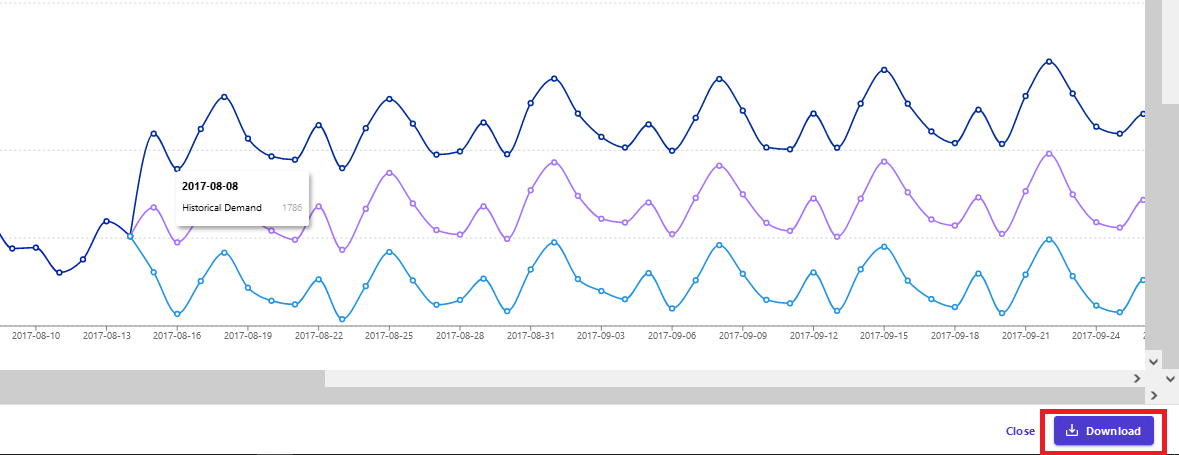

Die generierte Prognose zeigt die durchschnittliche Prognose sowie die obere und untere Grenze der Prognose. Die Prognosegrenzen helfen bei der Konfiguration eines aggressiven oder ausgewogenen Ansatzes für die Prognosebehandlung.

Sie können die generierte Prognose auch als CSV-Datei oder Bild herunterladen. Die generierte Prognose-CSV-Datei wird im Allgemeinen verwendet, um offline mit den Prognosedaten zu arbeiten.

Die Prognose wird nun für die Zeitreihendaten generiert. Wenn eine neue Baseline von Daten für die Prognose verfügbar wird, können Sie das Dataset in Canvas ändern, um das Prognosemodell mit der neuen Baseline neu zu trainieren.

Sie können das Modell mehrmals neu trainieren, wenn sich die Trainingsdaten ändern.

Zusammenfassung

In diesem Beitrag haben Sie erfahren, wie der Amazon AppFlow SAP OData Connector Kundenauftragsdaten aus dem SAP-System in einen S3-Bucket exportiert und wie Sie dann mit Canvas ein Modell für Prognosen erstellen.

Sie können Canvas für beliebige SAP-Zeitreihendatenszenarien verwenden, z. B. Ausgaben- oder Einnahmenvorhersage. Der gesamte Prozess der Prognoseerstellung ist konfigurationsgesteuert. Vertriebsleiter und -vertreter können wiederholt pro Monat oder Quartal Verkaufsprognosen mit einem aktualisierten Datensatz auf schnelle, unkomplizierte und intuitive Weise erstellen, ohne eine einzige Codezeile schreiben zu müssen. Dies trägt zur Steigerung der Produktivität bei und ermöglicht schnelle Planungen und Entscheidungen.

Erfahren Sie zunächst mehr über Canvas und Amazon AppFlow, indem Sie die folgenden Ressourcen verwenden:

- Amazon SageMaker Canvas-Entwicklerhandbuch

- Ankündigung von Amazon SageMaker Canvas – eine visuelle maschinelle Lernfunktion ohne Code für Business-Analysten

- Extrahieren Sie Daten aus SAP ERP und BW mit Amazon AppFlow

- Konfiguration des SAP OData Connectors

Über die Autoren

Brajendra Singh ist Lösungsarchitekt bei Amazon Web Services und arbeitet mit Unternehmenskunden zusammen. Er hat einen starken Entwicklerhintergrund und ist ein begeisterter Enthusiast für Daten- und maschinelle Lernlösungen.

Brajendra Singh ist Lösungsarchitekt bei Amazon Web Services und arbeitet mit Unternehmenskunden zusammen. Er hat einen starken Entwicklerhintergrund und ist ein begeisterter Enthusiast für Daten- und maschinelle Lernlösungen.

David Gallitelli ist ein Specialist Solutions Architect für AI/ML in der EMEA-Region. Er hat seinen Sitz in Brüssel und arbeitet eng mit Kunden in den Benelux-Ländern zusammen. Er ist Entwickler, seit er sehr jung war und begann im Alter von 7 Jahren zu programmieren. Er begann an der Universität AI/ML zu lernen und hat sich seitdem darin verliebt.

David Gallitelli ist ein Specialist Solutions Architect für AI/ML in der EMEA-Region. Er hat seinen Sitz in Brüssel und arbeitet eng mit Kunden in den Benelux-Ländern zusammen. Er ist Entwickler, seit er sehr jung war und begann im Alter von 7 Jahren zu programmieren. Er begann an der Universität AI/ML zu lernen und hat sich seitdem darin verliebt.

- Coinsmart. Europas beste Bitcoin- und Krypto-Börse.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. DEN FREIEN ZUGANG.

- CryptoHawk. Altcoin-Radar. Kostenlose Testphase.

- Quelle: https://aws.amazon.com/blogs/machine-learning/extract-insights-from-sap-erp-with-no-code-ml-solutions-with-amazon-appflow-and-amazon-sagemaker- Leinwand/

- '

- "

- 000

- 100

- 7

- a

- Über uns

- beschleunigen

- Zugang

- genau

- Erreichen

- über

- Aktivitäten

- Zusatz

- beeinflussen

- Alle

- erlaubt

- immer

- Amazon

- Amazon Web Services

- Analytiker

- Analytik

- App

- Ansatz

- angemessen

- um

- authentifiziert

- Authentifizierung

- Im Prinzip so, wie Sie es von Google Maps kennen.

- Verfügbarkeit

- verfügbar

- durchschnittlich

- AWS

- Hintergrund

- Baseline

- weil

- zwischen

- Grenze

- bringen

- Brüssel

- bauen

- Geschäft

- Leinwand

- Hauptgeschäftsstelle

- sicher

- Übernehmen

- Auswählen

- Stadt

- Cloud

- Code

- Zusammenarbeit

- Kolonne

- kombiniert

- gemeinsam

- abschließen

- Komponente

- Bedingungen

- Konfiguration

- Vernetz Dich

- Verbindung

- Konsul (Console)

- Verbraucher

- Kontakt

- erstellen

- erstellt

- Erstellen

- Kunden

- Unterricht

- technische Daten

- Datenschutz

- Datenschutz und Sicherheit

- Datenwissenschaft

- Entscheidungen

- Lieferanten

- Demand

- Anforderungen

- Abhängig

- Reiseziel

- Entwickler:in / Unternehmen

- Direkt

- Verteilung

- Domain

- nach unten

- herunterladen

- angetrieben

- leicht

- Wirksamkeit

- ermächtigen

- ermöglichen

- ermöglicht

- Endpunkt

- endet

- Ingenieur

- Entwicklung

- Ingenieure

- Enter

- Unternehmen

- geschätzt

- alles

- Beispiel

- Expertise

- FAST

- Felder

- Filterung

- Endlich

- Vorname

- Fluss

- Folgende

- folgt

- Format

- für

- voller

- Zukunft

- Tor

- allgemein

- erzeugen

- Erzeugung

- Generation

- Generator

- Waren

- Gruppe an

- Guide

- Handling

- mit

- Höhe

- Hilfe

- hilft

- historisch

- Ultraschall

- Hilfe

- aber

- HTTPS

- Identitätsschutz

- Image

- Impact der HXNUMXO Observatorien

- Einfuhr

- zu unterstützen,

- Branchen

- Information

- informiert

- Einblicke

- Instanz

- integrieren

- Schnittstelle

- Internet

- intuitiv

- IT

- Job

- join

- Joins

- Wesentliche

- Wissen

- Wissen

- Label

- starten

- LERNEN

- gelernt

- lernen

- Cholesterinspiegel

- Line

- LINK

- Belastung

- Logistik

- suchen

- ich liebe

- Maschine

- Maschinelles Lernen

- um

- MACHT

- verwalten

- Manager

- manuell

- Herstellung

- Karte

- Mapping

- Ihres Materials

- könnte

- ML

- Modell

- für

- Monat

- monatlich

- mehr

- schlauer bewegen

- mehrere

- Navigation

- Bedürfnisse

- Netzwerk

- Offline-Bereich.

- Einkauf & Prozesse

- Option

- Optionen

- Auftrag

- Bestellungen

- Organisationen

- Organisiert

- Andere

- Paradigma

- besondere

- besonders

- Passwort

- Planung

- Prognose

- Prognosen

- Vorspann

- primär

- Principal

- Datenschutz

- Datenschutz und Sicherheit

- privat

- Prozessdefinierung

- anpassen

- Produkt

- Produktion

- PRODUKTIVITÄT

- Programmierung

- Versorger

- bietet

- Bereitstellung

- Öffentlichkeit

- veröffentlichen

- Zwecke

- Quartal

- Direkt

- Angebot

- Roh

- Rekord

- Aufzeichnungen

- Region

- Vertreter

- falls angefordert

- Voraussetzungen:

- Downloads

- Verantwortlichkeiten

- für ihren Verlust verantwortlich.

- Einzelhandel

- Einnahmen

- Überprüfen

- Rollen

- Ohne eine erfahrene Medienplanung zur Festlegung von Regeln und Strategien beschleunigt der programmatische Medieneinkauf einfach die Rate der verschwenderischen Ausgaben.

- Führen Sie

- Laufen

- Salz

- Vertrieb

- gleich

- Saft

- Wissenschaft

- Wertung

- Bildschirm

- Sicherheitdienst

- ausgewählt

- Auswahl

- Modellreihe

- Dienstleistungen

- kompensieren

- Einstellung

- gezeigt

- Einfacher

- da

- Single

- Größe

- Fähigkeiten

- So

- solide

- Lösung

- Lösungen

- Spezialist

- spezifisch

- Verbreitung

- Stapel

- Anfang

- begonnen

- Statistiken

- Lagerung

- Läden

- stark

- Support

- Unterstützt

- Schalter

- System

- Systeme und Techniken

- Target

- und Aufgaben

- Team

- Testen

- Das

- Die Quelle

- Durch

- während

- Zeit

- mal

- Werkzeuge

- Ausbildung

- Transaktion

- privaten Transfer

- Übertragen

- Transformieren

- Trends

- typisch

- ui

- Verständnis

- Universität

- us

- -

- Nutzer

- Bestätigung

- Version

- Anzeigen

- Wege

- Netz

- Web-Services

- gut definiert

- ob

- .

- ohne

- Arbeiten

- arbeiten,

- Werk

- Schreiben

- jung

- Ihr