Wir freuen uns, die Open-Source-Veröffentlichung von bekannt zu geben GraphStorm 0.1, ein Low-Code-Framework für maschinelles Lernen (Graph Machine Learning) für Unternehmen, um Graph-ML-Lösungen für komplexe Diagramme im Unternehmensmaßstab in Tagen statt Monaten zu erstellen, zu trainieren und bereitzustellen. Mit GraphStorm können Sie Lösungen erstellen, die die Struktur von Beziehungen oder Interaktionen zwischen Milliarden von Entitäten direkt berücksichtigen, die von Natur aus in den meisten realen Daten eingebettet sind, einschließlich Betrugserkennungsszenarien, Empfehlungen, Community-Erkennung und Such-/Abrufproblemen.

Bisher war es bekanntermaßen schwierig, Graph-ML-Lösungen für komplexe Unternehmensgraphen zu erstellen, zu trainieren und bereitzustellen, die leicht über Milliarden von Knoten, Hunderten von Milliarden Kanten und Dutzenden von Attributen verfügen – denken Sie nur an einen Graphen, der Amazon.com-Produkte erfasst , Produktattribute, Kunden und mehr. Mit GraphStorm veröffentlichen wir die Tools, die Amazon intern verwendet, um umfangreiche Graph-ML-Lösungen in die Produktion zu bringen. Für GraphStorm müssen Sie kein Experte für Graph ML sein und ist unter der Apache v2.0-Lizenz auf GitHub verfügbar. Um mehr über GraphStorm zu erfahren, besuchen Sie die GitHub-Repository.

In diesem Beitrag bieten wir eine Einführung in GraphStorm, seine Architektur und einen Beispielanwendungsfall für die Verwendung.

Wir stellen GraphStorm vor

Graph-Algorithmen und Graph-ML erweisen sich als hochmoderne Lösungen für viele wichtige Geschäftsprobleme wie die Vorhersage von Transaktionsrisiken, die Antizipation von Kundenpräferenzen, die Erkennung von Eindringlingen, die Optimierung von Lieferketten, die Analyse sozialer Netzwerke und die Verkehrsvorhersage. Zum Beispiel, Amazon-Wachdienst, der native AWS-Bedrohungserkennungsdienst, verwendet ein Diagramm mit Milliarden von Kanten, um die Abdeckung und Genauigkeit seiner Bedrohungsinformationen zu verbessern. Dadurch kann GuardDuty bisher unbekannte Domänen aufgrund ihrer Verbindung zu bekannten bösartigen Domänen als höchstwahrscheinlich bösartig oder harmlos kategorisieren. Durch den Einsatz von Graph Neural Networks (GNNs) ist GuardDuty in der Lage, seine Fähigkeit zur Kundenwarnung zu verbessern.

Die Entwicklung, Einführung und der Betrieb von Graph-ML-Lösungen dauert jedoch Monate und erfordert Fachwissen über Graph-ML. Als ersten Schritt muss ein Graph-ML-Wissenschaftler mithilfe eines Frameworks wie der Deep Graph Library (DGL) ein Graph-ML-Modell für einen bestimmten Anwendungsfall erstellen. Das Training solcher Modelle ist aufgrund der Größe und Komplexität von Diagrammen in Unternehmensanwendungen, die routinemäßig Milliarden von Knoten, Hunderte von Milliarden Kanten, verschiedene Knoten- und Kantentypen sowie Hunderte von Knoten- und Kantenattributen erreichen, eine Herausforderung. Unternehmensgraphen können Terabytes an Speicher erfordern, sodass Graph-ML-Wissenschaftler komplexe Trainingspipelines aufbauen müssen. Nachdem ein Modell schließlich trainiert wurde, muss es für die Inferenz bereitgestellt werden, was Inferenzpipelines erfordert, die genauso schwierig zu erstellen sind wie die Trainingspipelines.

GraphStorm 0.1 ist ein Low-Code-Graph-ML-Framework für Unternehmen, das es ML-Anwendern ermöglicht, ganz einfach vordefinierte Graph-ML-Modelle auszuwählen, die sich als effektiv erwiesen haben, verteiltes Training für Graphen mit Milliarden von Knoten durchzuführen und die Modelle in der Produktion bereitzustellen. GraphStorm bietet eine Sammlung integrierter Graph-ML-Modelle wie Relational Graph Convolutional Networks (RGCN), Relational Graph Attention Networks (RGAT) und Heterogeneous Graph Transformer (HGT) für Unternehmensanwendungen mit heterogenen Graphen, die ML-Ingenieuren mit wenig Aufwand ermöglichen Zeichnen Sie ML-Expertise auf, um verschiedene Modelllösungen für ihre Aufgabe auszuprobieren und schnell die richtige auszuwählen. End-to-End-Pipelines für verteiltes Training und Inferenz, die sich auf Unternehmensdiagramme im Milliardenmaßstab skalieren lassen, erleichtern das Training, die Bereitstellung und die Ausführung von Inferenzen. Wenn Sie neu bei GraphStorm oder Graph ML im Allgemeinen sind, werden Sie von den vordefinierten Modellen und Pipelines profitieren. Wenn Sie ein Experte sind, haben Sie alle Möglichkeiten, die Trainingspipeline und die Modellarchitektur zu optimieren, um die beste Leistung zu erzielen. GraphStorm basiert auf DGL, einem weit verbreiteten Framework zur Entwicklung von GNN-Modellen, und ist als Open-Source-Code unter der Apache v2.0-Lizenz verfügbar.

„GraphStorm soll Kunden beim Experimentieren und der Operationalisierung von Graph-ML-Methoden für Industrieanwendungen unterstützen, um die Einführung von Graph-ML zu beschleunigen“, sagt George Karypis, Senior Principal Scientist in der Amazon AI/ML-Forschung. „Seit seiner Veröffentlichung bei Amazon hat GraphStorm den Aufwand zum Erstellen von Graph-ML-basierten Lösungen um das Fünffache reduziert.“

„GraphStorm ermöglicht es unserem Team, die GNN-Einbettung auf selbstüberwachte Weise in einem Diagramm mit 288 Millionen Knoten und 2 Milliarden Kanten zu trainieren“, sagt Haining Yu, leitender angewandter Wissenschaftler bei Amazon Measurement, Ad Tech und Data Science. „Die vorab trainierten GNN-Einbettungen zeigen eine 24-prozentige Verbesserung bei einer Aufgabe zur Vorhersage der Käuferaktivität im Vergleich zu einer hochmodernen BERT-basierten Basislinie; Es übertrifft auch die Benchmark-Leistung anderer Werbeanwendungen.“

„Vor GraphStorm konnten Kunden nur vertikal skalieren, um Diagramme mit 500 Millionen Kanten zu verarbeiten“, sagt Brad Bebee, GM für Amazon Neptune und Amazon Timestream. „GraphStorm ermöglicht es Kunden, das GNN-Modelltraining auf riesigen Amazon Neptune-Graphen mit Dutzenden Milliarden Kanten zu skalieren.“

Technische Architektur von GraphStorm

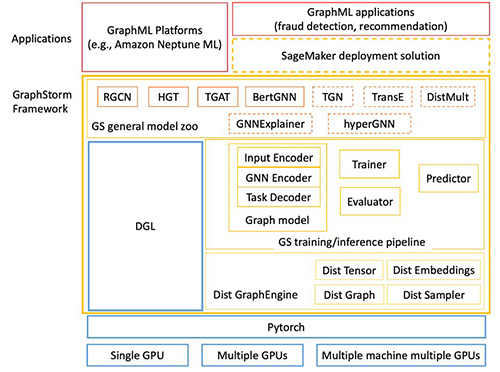

Die folgende Abbildung zeigt die technische Architektur von GraphStorm.

GraphStorm basiert auf PyTorch und kann auf einer einzelnen GPU, mehreren GPUs und mehreren GPU-Maschinen ausgeführt werden. Es besteht aus drei Schichten (in der vorherigen Abbildung in den gelben Kästchen markiert):

- Unterste Ebene (Dist GraphEngine) – Die unterste Ebene stellt die Grundkomponenten bereit, um verteiltes Graphen-ML zu ermöglichen, einschließlich verteilter Graphen, verteilter Tensoren, verteilter Einbettungen und verteilter Sampler. GraphStorm bietet effiziente Implementierungen dieser Komponenten, um das Graph-ML-Training auf Graphen mit Milliarden Knoten zu skalieren.

- Mittlere Schicht (GS-Trainings-/Inferenzpipeline) – Die mittlere Schicht stellt Trainer, Evaluatoren und Prädiktoren bereit, um das Modelltraining und die Inferenz sowohl für integrierte Modelle als auch für Ihre benutzerdefinierten Modelle zu vereinfachen. Grundsätzlich können Sie sich durch die Verwendung der API dieser Ebene auf die Modellentwicklung konzentrieren, ohne sich Gedanken über die Skalierung des Modelltrainings machen zu müssen.

- Obere Schicht (GS allgemeiner Modellzoo) – Die oberste Ebene ist ein Modellzoo mit beliebten GNN- und Nicht-GNN-Modellen für verschiedene Diagrammtypen. Zum jetzigen Zeitpunkt werden RGCN, RGAT und HGT für heterogene Diagramme und BERTGNN für Textdiagramme bereitgestellt. In Zukunft werden wir Unterstützung für zeitliche Diagrammmodelle wie TGAT für zeitliche Diagramme sowie TransE und DistMult für Wissensdiagramme hinzufügen.

So verwenden Sie GraphStorm

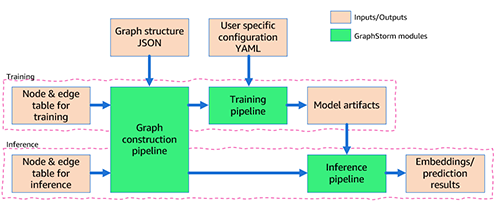

Nach der Installation von GraphStorm benötigen Sie nur drei Schritte, um GML-Modelle für Ihre Anwendung zu erstellen und zu trainieren.

Zunächst verarbeiten Sie Ihre Daten vor (möglicherweise einschließlich Ihres benutzerdefinierten Feature-Engineerings) und wandeln sie in ein für GraphStorm erforderliches Tabellenformat um. Für jeden Knotentyp definieren Sie eine Tabelle, die alle Knoten dieses Typs und ihre Funktionen auflistet und für jeden Knoten eine eindeutige ID bereitstellt. Für jeden Kantentyp definieren Sie auf ähnliche Weise eine Tabelle, in der jede Zeile die Quell- und Zielknoten-IDs für eine Kante dieses Typs enthält (weitere Informationen finden Sie unter Nutzen Sie Ihr eigenes Daten-Tutorial). Darüber hinaus stellen Sie eine JSON-Datei bereit, die die gesamte Diagrammstruktur beschreibt.

Zweitens nutzen Sie über die Befehlszeilenschnittstelle (CLI) die integrierte Funktion von GraphStorm construct_graph Komponente für einige GraphStorm-spezifische Datenverarbeitung, die effizientes verteiltes Training und Inferenz ermöglicht.

Drittens konfigurieren Sie das Modell und das Training in einer YAML-Datei (Beispiel) und rufen Sie erneut über die CLI eine der fünf integrierten Komponenten auf (gs_node_classification, gs_node_regression, gs_edge_classification, gs_edge_regression, gs_link_prediction) als Trainingspipelines zum Trainieren des Modells. Dieser Schritt führt zu den trainierten Modellartefakten. Um Rückschlüsse zu ziehen, müssen Sie die ersten beiden Schritte wiederholen, um die Rückschlussdaten mit derselben GraphStorm-Komponente (construct_graph) wie vorher.

Schließlich können Sie eine der fünf integrierten Komponenten, dieselbe, die für das Modelltraining verwendet wurde, als Inferenzpipeline aufrufen, um Einbettungen oder Vorhersageergebnisse zu generieren.

Der Gesamtfluss ist auch in der folgenden Abbildung dargestellt.

Im folgenden Abschnitt stellen wir einen Beispielanwendungsfall vor.

Machen Sie Vorhersagen anhand von OAG-Rohdaten

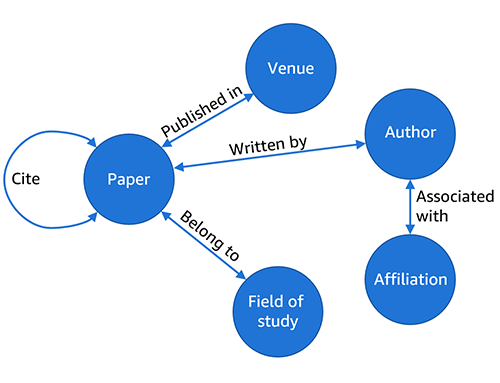

In diesem Beitrag zeigen wir, wie einfach GraphStorm das Training und die Inferenz von Graph-ML für einen großen Rohdatensatz ermöglichen kann. Der Öffnen Sie den akademischen Graphen (OAG) umfasst fünf Einheiten (Artikel, Autoren, Veranstaltungsorte, Zugehörigkeiten und Studienfach). Der Rohdatensatz wird in JSON-Dateien mit über 500 GB gespeichert.

Unsere Aufgabe besteht darin, ein Modell zu erstellen, um das Fachgebiet einer Arbeit vorherzusagen. Um das Fachgebiet vorherzusagen, können Sie es als Klassifizierungsaufgabe mit mehreren Bezeichnungen formulieren. Es ist jedoch schwierig, die Bezeichnungen mit One-Hot-Codierung zu speichern, da es Hunderttausende von Feldern gibt. Daher sollten Sie Fachgebietsknoten erstellen und dieses Problem als Linkvorhersageaufgabe formulieren, um vorherzusagen, mit welchen Fachgebietsknoten ein Papierknoten verbunden werden soll.

Um diesen Datensatz mit einer Diagrammmethode zu modellieren, besteht der erste Schritt darin, den Datensatz zu verarbeiten und Entitäten und Kanten zu extrahieren. Sie können fünf Arten von Kanten aus den JSON-Dateien extrahieren, um ein Diagramm zu definieren, wie in der folgenden Abbildung dargestellt. Sie können das Jupyter-Notebook im GraphStorm verwenden Beispielcode um den Datensatz zu verarbeiten und fünf Entitätstabellen für jeden Entitätstyp und fünf Kantentabellen für jeden Kantentyp zu generieren. Das Jupyter-Notizbuch generiert auch BERT-Einbettungen für Entitäten mit Textdaten, z. B. Papiere.

Nachdem Sie die Elemente und Kanten zwischen den Elementen definiert haben, können Sie erstellen mag_bert.json, das das Diagrammschema definiert, und die integrierte Diagrammkonstruktionspipeline aufrufen construct_graph in GraphStorm, um das Diagramm zu erstellen (siehe den folgenden Code). Auch wenn die GraphStorm-Graphkonstruktionspipeline auf einem einzigen Computer ausgeführt wird, unterstützt sie die Mehrfachverarbeitung, um Knoten und Kantenmerkmale parallel zu verarbeiten (--num_processes) und kann Entitäts- und Kantenmerkmale im externen Speicher speichern (--ext-mem-workspace), um auf große Datensätze zu skalieren.

Um ein so großes Diagramm zu verarbeiten, benötigen Sie eine CPU-Instanz mit großem Speicher, um das Diagramm zu erstellen. Sie können eine verwenden Amazon Elastic Compute-Cloud (Amazon EC2) r6id.32xlarge-Instanz (128 vCPU und 1 TB RAM) oder r6a.48xlarge-Instanzen (192 vCPU und 1.5 TB RAM) zum Erstellen des OAG-Diagramms.

Nachdem Sie ein Diagramm erstellt haben, können Sie es verwenden gs_link_prediction um ein Linkvorhersagemodell auf vier g5.48xlarge-Instanzen zu trainieren. Wenn Sie die integrierten Modelle verwenden, rufen Sie nur eine Befehlszeile auf, um den verteilten Trainingsjob zu starten. Siehe den folgenden Code:

Nach dem Modelltraining wird das Modellartefakt im Ordner gespeichert /data/mag_lp_model.

Jetzt können Sie eine Link-Vorhersage-Inferenz ausführen, um GNN-Einbettungen zu generieren und die Modellleistung zu bewerten. GraphStorm bietet mehrere integrierte Bewertungsmetriken zur Bewertung der Modellleistung. Bei Linkvorhersageproblemen gibt GraphStorm beispielsweise automatisch den metrischen mittleren reziproken Rang (MRR) aus. MRR ist eine wertvolle Metrik für die Bewertung von Diagramm-Link-Vorhersagemodellen, da sie beurteilt, wie hoch die tatsächlichen Links unter den vorhergesagten Links eingestuft werden. Dadurch wird die Qualität der Vorhersagen erfasst und sichergestellt, dass unser Modell echte Zusammenhänge richtig priorisiert, was hier unser Ziel ist.

Sie können Inferenz mit einer Befehlszeile ausführen, wie im folgenden Code gezeigt. In diesem Fall erreicht das Modell einen MRR von 0.31 im Testsatz des erstellten Diagramms.

Beachten Sie, dass die Inferenzpipeline Einbettungen aus dem Linkvorhersagemodell generiert. Um das Problem zu lösen, das Fachgebiet für eine bestimmte Arbeit zu finden, führen Sie einfach eine Suche nach k-nächsten Nachbarn für die Einbettungen durch.

Zusammenfassung

GraphStorm ist ein neues Graph-ML-Framework, das das Erstellen, Trainieren und Bereitstellen von Graph-ML-Modellen für Branchengraphen vereinfacht. Es befasst sich mit einigen wichtigen Herausforderungen bei Graph ML, einschließlich Skalierbarkeit und Benutzerfreundlichkeit. Es bietet integrierte Komponenten zur Verarbeitung milliardenschwerer Diagramme von Roheingabedaten bis hin zu Modelltraining und Modellinferenz und hat es mehreren Amazon-Teams ermöglicht, modernste Diagramm-ML-Modelle in verschiedenen Anwendungen zu trainieren. Schauen Sie sich unsere an GitHub-Repository um mehr zu erfahren.

Über die Autoren

Da Zheng ist ein leitender angewandter Wissenschaftler bei AWS AI/ML Research und leitet ein Team für maschinelles Lernen von Graphen, um Techniken und Frameworks zu entwickeln, um maschinelles Lernen von Graphen in die Produktion umzusetzen. Da erhielt seinen Doktortitel in Informatik von der Johns Hopkins University.

Da Zheng ist ein leitender angewandter Wissenschaftler bei AWS AI/ML Research und leitet ein Team für maschinelles Lernen von Graphen, um Techniken und Frameworks zu entwickeln, um maschinelles Lernen von Graphen in die Produktion umzusetzen. Da erhielt seinen Doktortitel in Informatik von der Johns Hopkins University.

Florian Saupe ist leitender technischer Produktmanager bei AWS AI/ML Research, der fortgeschrittene Wissenschaftsteams wie die Graph Machine Learning Group unterstützt und Produkte wie Amazon DataZone mit ML-Funktionen verbessert. Bevor er zu AWS kam, leitete Florian das technische Produktmanagement für automatisiertes Fahren bei Bosch, war Strategieberater bei McKinsey & Company und arbeitete als Wissenschaftler für Steuerungssysteme/Robotik – ein Bereich, in dem er promoviert hat.

Florian Saupe ist leitender technischer Produktmanager bei AWS AI/ML Research, der fortgeschrittene Wissenschaftsteams wie die Graph Machine Learning Group unterstützt und Produkte wie Amazon DataZone mit ML-Funktionen verbessert. Bevor er zu AWS kam, leitete Florian das technische Produktmanagement für automatisiertes Fahren bei Bosch, war Strategieberater bei McKinsey & Company und arbeitete als Wissenschaftler für Steuerungssysteme/Robotik – ein Bereich, in dem er promoviert hat.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- EVM-Finanzen. Einheitliche Schnittstelle für dezentrale Finanzen. Hier zugreifen.

- Quantum Media Group. IR/PR verstärkt. Hier zugreifen.

- PlatoAiStream. Web3-Datenintelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/fast-track-graph-ml-with-graphstorm-a-new-way-to-solve-problems-on-enterprise-scale-graphs/

- :hast

- :Ist

- $UP

- 1

- 1 TB

- 100

- 16

- 31

- 500

- 7

- 8

- 9

- a

- Fähig

- LiveBuzz

- akademisch

- beschleunigen

- Konto

- Genauigkeit

- Aktivität

- präsentieren

- Ad

- hinzufügen

- Zusatz

- Adressen

- Adoption

- Siehe Werbung

- advanced

- Zugehörigkeiten

- Nach der

- aufs Neue

- AI / ML

- Aufmerksam

- Algorithmen

- Alle

- erlauben

- erlaubt

- ebenfalls

- Amazon

- Amazon EC2

- Amazon Neptun

- Amazon-Timestream

- Amazon Web Services

- Amazon.com

- unter

- an

- Analyse

- und

- Bekannt geben

- vorwegnehmen

- jedem

- Apache

- Bienen

- Anwendung

- Anwendungen

- angewandt

- Architektur

- SIND

- AS

- Verein

- At

- Aufmerksamkeit

- Attribute

- Autoren

- Automatisiert

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- AWS

- basierend

- Baseline

- basic

- Grundsätzlich gilt

- BE

- weil

- war

- Bevor

- Benchmark

- Nutzen

- BESTE

- zwischen

- Milliarde

- Milliarden

- beide

- Boden

- Boxen

- Stift

- bringen

- bauen

- erbaut

- eingebaut

- Geschäft

- aber

- by

- CAN

- Fähigkeiten

- Captures

- Capturing

- Häuser

- Ketten

- Herausforderungen

- herausfordernd

- aus der Ferne überprüfen

- Einstufung

- Code

- Sammlung

- COM

- community

- Unternehmen

- Komplex

- Komplexität

- Komponente

- Komponenten

- Berechnen

- Computer

- Computerwissenschaften

- Vernetz Dich

- Verbindungen

- besteht

- konstruieren

- Bau

- Baugewerbe

- Berater

- enthält

- Smartgeräte App

- könnte

- Berichterstattung

- erstellen

- Original

- Kunde

- Kunden

- da

- technische Daten

- Datenverarbeitung

- Datenwissenschaft

- Datensätze

- Tage

- tief

- Definiert

- Definition

- zeigen

- einsetzen

- Einsatz

- entworfen

- Reiseziel

- Entdeckung

- entwickeln

- Entwicklung

- Entwicklung

- DGL

- anders

- schwer

- Direkt

- verteilt

- verteiltes Training

- do

- Tut nicht

- Domains

- Dutzende

- Fahren

- zwei

- jeder

- leicht

- Einfache

- Edge

- Effektiv

- effizient

- Anstrengung

- eingebettet

- Einbettung

- aufstrebenden

- ermöglichen

- freigegeben

- ermöglicht

- End-to-End

- Entwicklung

- Ingenieure

- zu steigern,

- Unternehmen

- Entitäten

- Einheit

- bewerten

- Auswerten

- Auswertung

- Sogar

- Beispiel

- übersteigt

- aufgeregt

- Experiment

- Experte

- Expertise

- extern

- Extrakt

- Merkmal

- Eigenschaften

- Feld

- Felder

- Abbildung

- Reichen Sie das

- Mappen

- Endlich

- Suche nach

- Vorname

- Fluss

- Setzen Sie mit Achtsamkeit

- Folgende

- Aussichten für

- Format

- vier

- Unser Ansatz

- Gerüste

- Betrug

- Betrugserkennung

- für

- Zukunft

- Allgemeines

- erzeugen

- erzeugt

- Michael

- bekommen

- GitHub

- gegeben

- GM

- GPU

- GPUs

- Graph

- Graphen

- Gruppe an

- Griff

- hart

- Haben

- he

- Hilfe

- hier

- GUTE

- hoch

- seine

- hält

- Ultraschall

- Wie hoch

- Hilfe

- http

- HTTPS

- hunderte

- ID

- ids

- if

- wichtig

- zu unterstützen,

- Verbesserung

- Verbesserung

- in

- In anderen

- Einschließlich

- Energiegewinnung

- Information

- von Natur aus

- Varianten des Eingangssignals:

- Installieren

- Instanz

- beantragen müssen

- Intelligenz

- Interaktionen

- Schnittstelle

- innen

- in

- Einleitung

- IT

- SEINE

- Job

- Johns Hopkins University

- Beitritt

- jpg

- JSON

- nur

- Wesentliche

- Wissen

- bekannt

- Etiketten

- grosse

- großflächig

- starten

- Start

- Schicht

- Lagen

- führen

- führenden

- LERNEN

- lernen

- Bibliothek

- Lizenz

- Gefällt mir

- wahrscheinlich

- Line

- LINK

- Links

- Listen

- wenig

- Maschine

- Maschinelles Lernen

- Maschinen

- Mai

- um

- MACHT

- Making

- Management

- Manager

- Weise

- viele

- markiert

- massiv

- McKinsey

- McKinsey & Company

- bedeuten

- Messung

- Memory

- Methode

- Methoden

- Metrisch

- Metrik

- Mitte

- Million

- ML

- Modell

- für

- Monat

- mehr

- vor allem warme

- mehrere

- nativen

- Need

- Neptun

- Netzwerk

- Netzwerke

- Neuronale Netze

- Neu

- Knoten

- Fiber Node

- Notizbuch

- jetzt an

- Ziel

- of

- Angebote

- on

- EINEM

- einzige

- Open-Source-

- Open-Source-Code

- die

- Optimierung

- Optionen

- or

- Andere

- UNSERE

- übrig

- Gesamt-

- besitzen

- Papier

- Papiere

- Parallel

- Ausführen

- Leistung

- wählen

- Pipeline

- Plato

- Datenintelligenz von Plato

- PlatoData

- Beliebt

- Post

- möglicherweise

- vorhersagen

- vorhergesagt

- Vorhersage

- Prognose

- Prognosen

- Vorlieben

- vorher

- Principal

- Aufgabenstellung:

- Probleme

- Prozessdefinierung

- Verarbeitung

- Produkt

- Produktmanagement

- Produkt-Manager

- Produktion

- Produkte

- zuverlässig

- die

- bietet

- Bereitstellung

- setzen

- Pytorch

- Qualität

- schnell

- RAM

- Platz

- Roh

- erreichen

- Erreicht

- realen Welt

- Empfehlungen

- Reduziert

- Beziehungen

- Release

- wiederholen

- erfordern

- falls angefordert

- erfordert

- Forschungsprojekte

- Die Ergebnisse

- Recht

- Risiken

- regelmäßig

- REIHE

- Führen Sie

- gleich

- sagt

- Skalierbarkeit

- Skalieren

- Szenarien

- Wissenschaft

- Wissenschaftler

- Wissenschaftler

- Suche

- Abschnitt

- sehen

- Senior

- Lösungen

- kompensieren

- sollte

- erklären

- gezeigt

- Konzerte

- Ähnlich

- vereinfachen

- einfach

- Single

- Größe

- Social Media

- Social Network

- Lösungen

- LÖSEN

- einige

- Quelle

- State-of-the-art

- Schritt

- Shritte

- Lagerung

- speichern

- gelagert

- Strategie

- Struktur

- Studie

- so

- liefern

- Lieferketten

- Support

- Unterstützung

- Unterstützt

- Tabelle

- Nehmen

- nimmt

- Aufgabe

- Team

- Teams

- Tech

- Technische

- Techniken

- Zehn

- Test

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Zukunft

- Der Graph

- Die Quelle

- ihr

- Dort.

- deswegen

- Diese

- vom Nutzer definierten

- think

- fehlen uns die Worte.

- obwohl?

- Tausende

- Bedrohung

- nach drei

- mal

- zu

- Werkzeuge

- Top

- der Verkehr

- Training

- trainiert

- Ausbildung

- Transaktion

- Transformieren

- Transformator

- was immer dies auch sein sollte.

- versuchen

- XNUMX

- tippe

- Typen

- für

- einzigartiges

- Universität

- Nutzbarkeit

- -

- Anwendungsfall

- benutzt

- verwendet

- Verwendung von

- wertvoll

- verschiedene

- Veranstaltungsorte

- vertikal

- Besuchen Sie

- wurde

- Weg..

- we

- Netz

- Web-Services

- GUT

- wann

- welche

- weit

- werden wir

- mit

- ohne

- gearbeitet

- Schreiben

- YAML

- Du

- Ihr

- Zephyrnet

- ZOO