Möchten Sie Daten aus gedruckten oder handschriftlichen Formularen extrahieren? Kasse Nanonetze™ Formulardatenextraktor kostenlos & automatisieren Sie den Export von Informationen aus beliebigen Formularen!

Formulare sind überall; Sie sind definiert als Dokumente, die zum Sammeln von Informationen erstellt wurden, indem die Teilnehmer gebeten wurden, die erforderlichen Informationen in einem bestimmten Format auszufüllen. Sie sind hilfreich, weil sie in kurzer Zeit viele Daten sammeln können. Allerdings haben nicht alle Formulare die gleiche Kapazität zum Sammeln von Daten und erfordern später oft manuelle Arbeit. Daher setzen wir auf Tools und Algorithmen, um den Prozess der Formulardatenextraktion intelligent zu automatisieren. Dieser Blogbeitrag wird tief in verschiedene Szenarien und Techniken eintauchen, um Daten aus Formularen mit OCR und Deep Learning zu extrahieren.

- Was ist Formulardatenextraktion?

- Was macht das Problem herausfordernd?

- Die Tiefe des Formularextraktionsproblems

- Wie haben sich die Formulardatenextraktionslösungen entwickelt?

- Formulardatenextraktion mit OCRs

- Lösung der Formulardatenextraktion mit Deep Learning

- Geben Sie Nanonets ein

Was ist Formulardatenextraktion?

Formulardatenextraktion ist der Prozess des Extrahierens von Daten aus Formularen – sowohl online als auch offline. Diese Daten können in einem beliebigen Format gefunden werden, das normalerweise ein Formular mit den relevanten Informationen enthält. Das Extrahieren dieser Daten ist jedoch nicht immer einfach, da viele Layouts und Designs eine einfache Textauswahl nicht zulassen. Es gibt keine native Möglichkeit, Daten von ihnen zu kopieren. Daher verlassen wir uns auf automatisierte Techniken, um Daten aus Formularen zu extrahieren, die effektiver und weniger fehleranfällig sind.

Heutzutage beispielsweise verlassen sich viele Benutzer auf PDF-basierte Formulare, um Kontaktinformationen zu sammeln. Dies ist eine sehr effiziente Methode zum Sammeln von Informationen, da Sender und Empfänger keine Eingaben machen müssen. Das Extrahieren dieser Daten aus einem PDF-Formular kann jedoch schwierig und teuer sein.

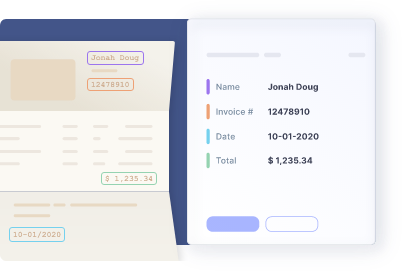

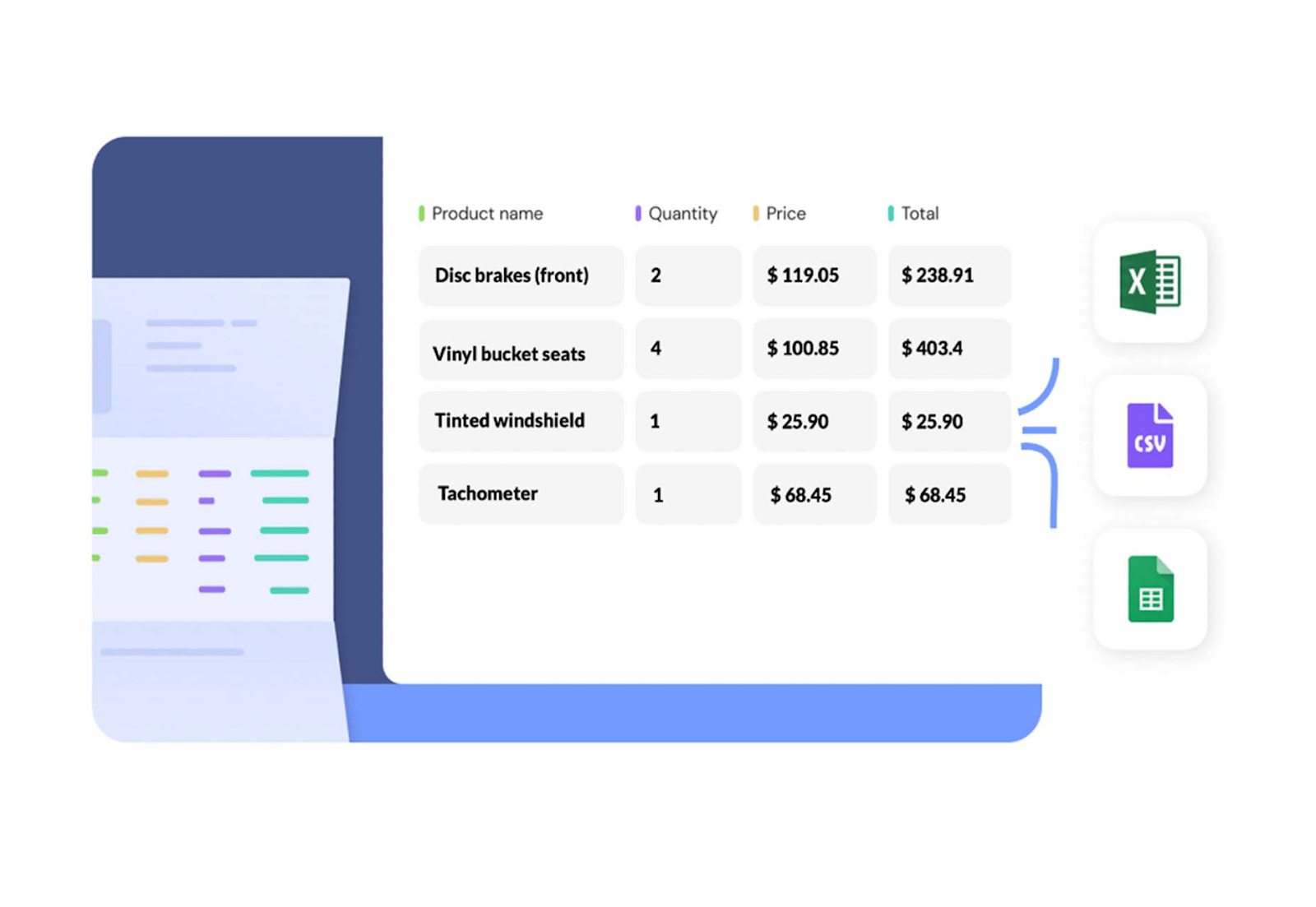

Hier kann die Formulardatenextraktion helfen, Daten aus einem PDF-Formular zu extrahieren, z. B. Name, E-Mail-Adresse, Telefonnummer usw. Sie können in eine andere Anwendung wie Excel, Sheets oder ein anderes strukturiertes Format importiert werden. Die Funktionsweise besteht darin, dass die Extraktionswerkzeuge die PDF-Datei lesen, automatisch herausziehen, was benötigt wird, und sie in einem leicht lesbaren Format organisieren. Diese Daten können in andere Formate wie Excel, CSV, JSON und andere gut strukturierte Datenformate exportiert werden. Sehen wir uns im nächsten Abschnitt einige der häufig auftretenden Herausforderungen beim Erstellen von Formulardatenextraktionsalgorithmen an.

Möchten Sie Daten aus gedruckten oder handschriftlichen Formularen extrahieren? Schauen Sie sich Nanonets an™ Form Data Extractor kostenlos & automatisieren Sie den Export von Informationen aus jedem Formular!

Was macht die Extraktion von Formulardaten schwierig?

Die Datenextraktion ist aus verschiedenen Gründen ein spannendes Problem. Zum einen ist es ein Bilderkennungsproblem, aber es muss auch den möglicherweise im Bild vorhandenen Text und das Layout des Formulars berücksichtigen, was den Aufbau eines Algorithmus komplexer macht. In diesem Abschnitt werden einige der häufigsten Herausforderungen erörtert, auf die Menschen beim Erstellen von Formulardatenextraktionsalgorithmen stoßen.

- Unvollständige Daten: Datenextraktionsalgorithmen werden normalerweise mit leistungsstarken Deep-Learning- und Computer-Vision-basierten Algorithmen erstellt. Diese stützen sich in der Regel auf riesige Datenmengen, um eine Leistung auf dem neuesten Stand der Technik zu erreichen. Daher ist es für jede Form von Datenextraktionswerkzeug oder -software entscheidend, einen konsistenten und zuverlässigen Datensatz zu finden und zu verarbeiten. Angenommen, wir haben Formulare mit mehreren Vorlagen, dann sollten diese Algorithmen in der Lage sein, eine Vielzahl von Formularen zu verstehen. Daher würde das Training mit einem robusten Datensatz eine genauere Leistung erbringen.

- Umgang mit Schriftarten, Sprachen und Layouts: Es gibt eine schwindelerregende Menge an verschiedenen Schriftarten, Designs und Vorlagen für verschiedene Arten von Formulardaten. Sie können in mehrere völlig unterschiedliche Klassifikationen fallen, was es schwierig macht, eine genaue Erkennung sicherzustellen, wenn eine große Anzahl unterschiedlicher Zeichentypen berücksichtigt werden muss. Daher ist es wichtig, die Schriftartensammlung auf eine bestimmte Sprache und einen bestimmten Typ zu beschränken, da dadurch viele Prozesse erstellt werden, die reibungslos ablaufen, sobald Sie diese Dokumente entsprechend verarbeitet haben. In mehrsprachigen Fällen muss das Jonglieren zwischen Zeichen aus mehreren Sprachen vorbereitet und auch auf komplexe Typografie geachtet werden.

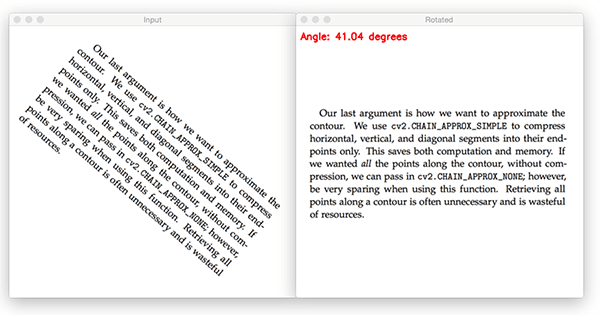

- Ausrichtung und Schräglage (Rotation): Während der Datenpflege scannen wir oft Bilder, um Algorithmen für die Eingabedatenerfassung zu trainieren. Wenn Sie jemals einen Scanner oder eine Digitalkamera verwendet haben, ist Ihnen vielleicht aufgefallen, dass der Winkel, in dem Sie Bilder von Dokumenten erfassen, dazu führen kann, dass diese manchmal verzerrt erscheinen. Dies ist als Schiefe bekannt, die sich auf den Grad des Winkels bezieht. Diese Schiefe kann die Genauigkeit des Modells verringern. Glücklicherweise können verschiedene Techniken verwendet werden, um dieses Problem zu beheben, indem einfach geändert wird, wie unsere Software Merkmale in bestimmten Bereichen des Bildes erkennt. Ein Beispiel für eine solche Technik sind Projektionsprofilverfahren oder Fourier-Transformationsverfahren, die viel sauberere Ergebnisse bei der Form-, Dimensions- und Texturerkennung ermöglichen! Obwohl Ausrichtung und Schiefe einfache Fehler sein können, können diese die Genauigkeit des Modells in großer Zahl beeinträchtigen.

- Datensicherheit: Wenn Sie Daten aus verschiedenen Quellen zur Datenerfassung extrahieren, ist es wichtig, sich der vorhandenen Sicherheitsmaßnahmen bewusst zu sein. Andernfalls riskieren Sie, die übertragenen Informationen zu gefährden. Dies kann zu Situationen führen, in denen personenbezogene Daten verletzt werden oder die an eine API gesendeten Informationen nicht sicher sind. Daher muss man sich bei der Arbeit mit ETL-Skripten und Online-APIs für die Datenextraktion auch der Datensicherheit bewusst sein.

- Tabellenextraktion: Manchmal sehen wir Formulardaten in Tabellen; Das Erstellen eines robusten Algorithmus, der sowohl die Formularextraktion als auch die Tabellenextraktion handhaben kann, kann eine Herausforderung darstellen. Der übliche Ansatz besteht darin, diese Algorithmen unabhängig zu erstellen und auf die Daten anzuwenden, aber dies führt zu einer höheren Rechenleistung, was die Kosten erhöht. Daher sollte eine ideale Formularextraktion in der Lage sein, sowohl Formulardaten als auch Daten aus einem gegebenen Dokument zu extrahieren.

- Nachbearbeitung / Ausgabe exportieren: Die Ausgabedaten einer beliebigen Datenextraktion sind nicht gerade. Daher verlassen sich Entwickler auf Nachbearbeitungstechniken, um die Ergebnisse in ein strukturierteres Format zu filtern. Nach der Verarbeitung der Daten werden diese in ein strukturierteres Format wie CSV, Excel oder eine Datenbank exportiert. Unternehmen verlassen sich auf Integrationen von Drittanbietern oder entwickeln APIs, um diesen wiederum zeitaufwändigen Prozess zu automatisieren. Daher sollten ideale Datenextraktionsalgorithmen flexibel und einfach mit externen Datenquellen zu kommunizieren sein.

Möchten Sie Daten aus gedruckten oder handschriftlichen Formularen extrahieren? Schauen Sie sich Nanonets an™ Form Data Extractor kostenlos & automatisieren Sie den Export von Informationen aus jedem Formular!

Verstehen der Tiefe der Formularextraktion mit verschiedenen Szenarien

Bisher haben wir die Grundlagen und Herausforderungen der Formulardatenextraktion besprochen. In diesem Abschnitt werden wir tief in verschiedene Szenarien eintauchen und die Tiefe der Formulardatenextraktion verstehen. Wir werden uns auch ansehen, wie wir den Extraktionsprozess für diese spezifischen Szenarien automatisieren können.

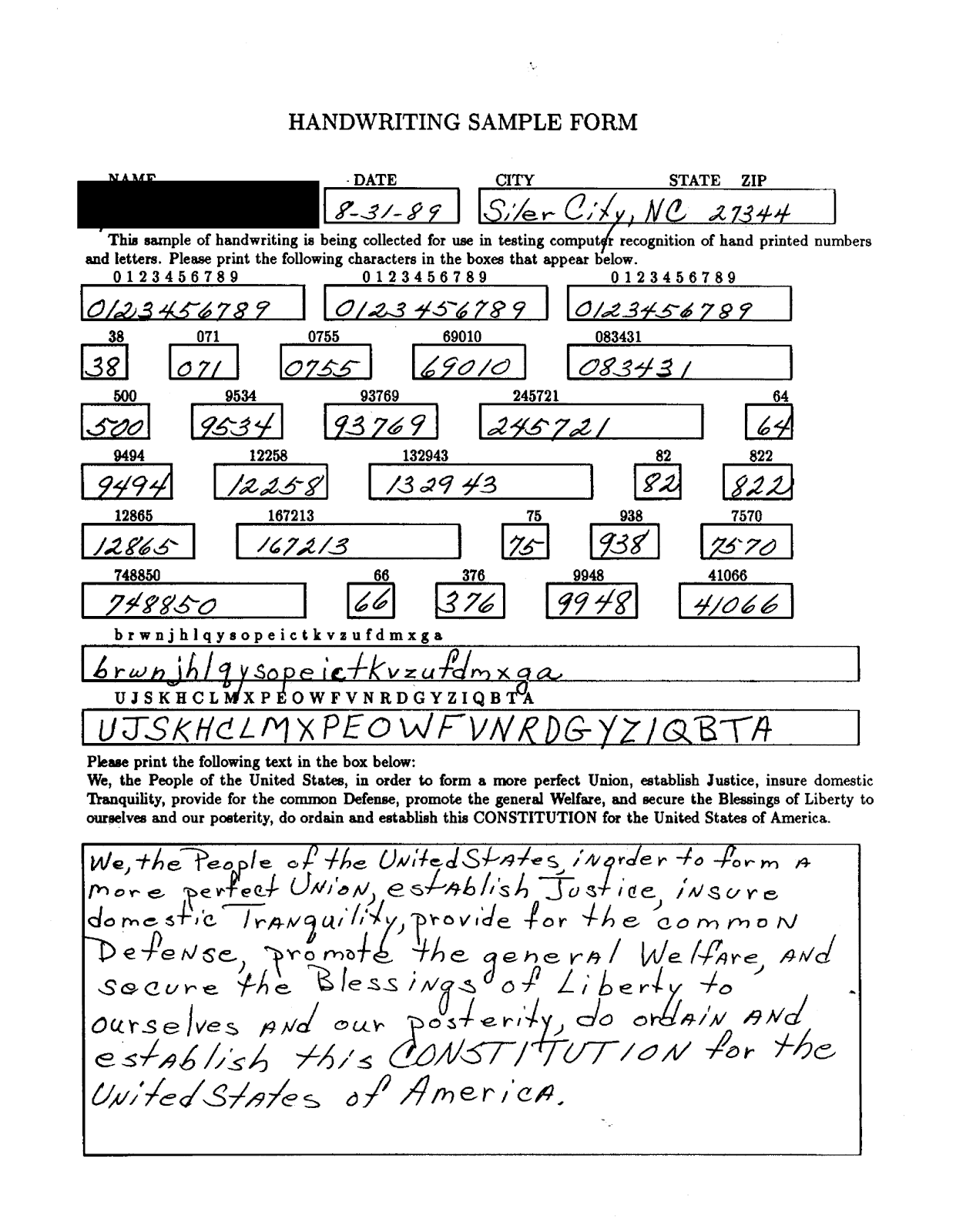

Szenario Nr. 1: Handschriftliche Erkennung für Offline-Formulare

Offline-Formulare sind im täglichen Leben häufig anzutreffen. Es ist zwingend erforderlich, dass die Formulare einfach auszufüllen und abzusenden sind. Die manuelle Digitalisierung von Offline-Formularen kann eine hektische und teure Aufgabe sein, weshalb Deep-Learning-Algorithmen benötigt werden. Handgeschriebene Dokumente sind aufgrund der Komplexität der handschriftlichen Zeichen eine große Herausforderung bei der Extraktion von Daten. Daher werden Datenerkennungsalgorithmen stark verwendet, durch die eine Maschine lernt, den handgeschriebenen Text zu lesen und zu interpretieren. Dabei werden Bilder von handgeschriebenen Wörtern gescannt und in Daten umgewandelt, die von einem Algorithmus verarbeitet und analysiert werden können. Der Algorithmus erstellt dann anhand von Strichen eine Zeichentabelle und erkennt entsprechende Buchstaben, um den Text zu extrahieren.

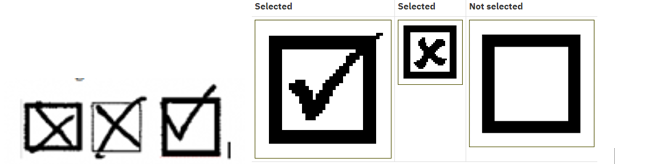

Szenario Nr. 2: Checkbox-Identifikation auf Formularen

Checkbox-Formulare sind eine Form der Dateneingabe, die verwendet wird, um Informationen von einem Benutzer in einem Eingabefeld zu sammeln. Diese Art von Daten findet sich normalerweise in Listen und Tabellen, in denen der Benutzer ein oder mehrere Elemente auswählen muss, z. B. Elemente, mit denen er kontaktiert werden möchte. Es kann an vielen Stellen gefunden werden – Online-Formulare, Fragebögen und Umfragen und so weiter. Heutzutage können einige Algorithmen den Datenextraktionsprozess sogar aus den Kontrollkästchen automatisieren. Das Hauptziel dieses Algorithmus besteht darin, die Eingaberegionen unter Verwendung von Computer-Vision-Techniken zu identifizieren. Dazu gehören das Identifizieren von Linien (horizontal und vertikal), das Anwenden von Filtern, Konturen und das Erkennen von Kanten auf den Bildern. Nachdem der Eingabebereich identifiziert wurde, ist es einfach, die Inhalte der Kontrollkästchen zu extrahieren, die entweder markiert oder nicht markiert sind.

Szenario #3: Layoutänderungen des Formulars von Zeit zu Zeit

Beim Ausfüllen von Formularen gibt es normalerweise zwei verschiedene Arten von Optionen. Bei einigen Formularen müssen wir unsere Informationen angeben, indem wir in alle relevanten Felder schreiben, während wir bei anderen die Informationen angeben können, indem wir aus einigen Kontrollkästchen auswählen. Auch das Layout des Formulars ändert sich je nach Formulartyp und Kontext. Daher ist es wichtig, einen Algorithmus zu entwickeln, der mehrere unstrukturierte Dokumente verarbeiten und Inhalte in Abhängigkeit von den Formularbezeichnungen intelligent extrahieren kann. Eine beliebte Technik der Deep-Learning-Architektur zur Handhabung von Dokumentlayouts sind Graph-CNNs. Die Idee hinter Graph Convolutional Networks (GCNs) ist es, sicherzustellen, dass die Neuronenaktivierungen datengesteuert sind. Sie sind so konzipiert, dass sie auf Graphen funktionieren, die aus Knoten und Kanten bestehen. Eine Graph-Faltungsschicht ist in der Lage, Muster in Abwesenheit eines aufgabenspezifischen Trainingssignals zu erkennen. Daher sind diese geeignet, wenn die Daten robust sind.

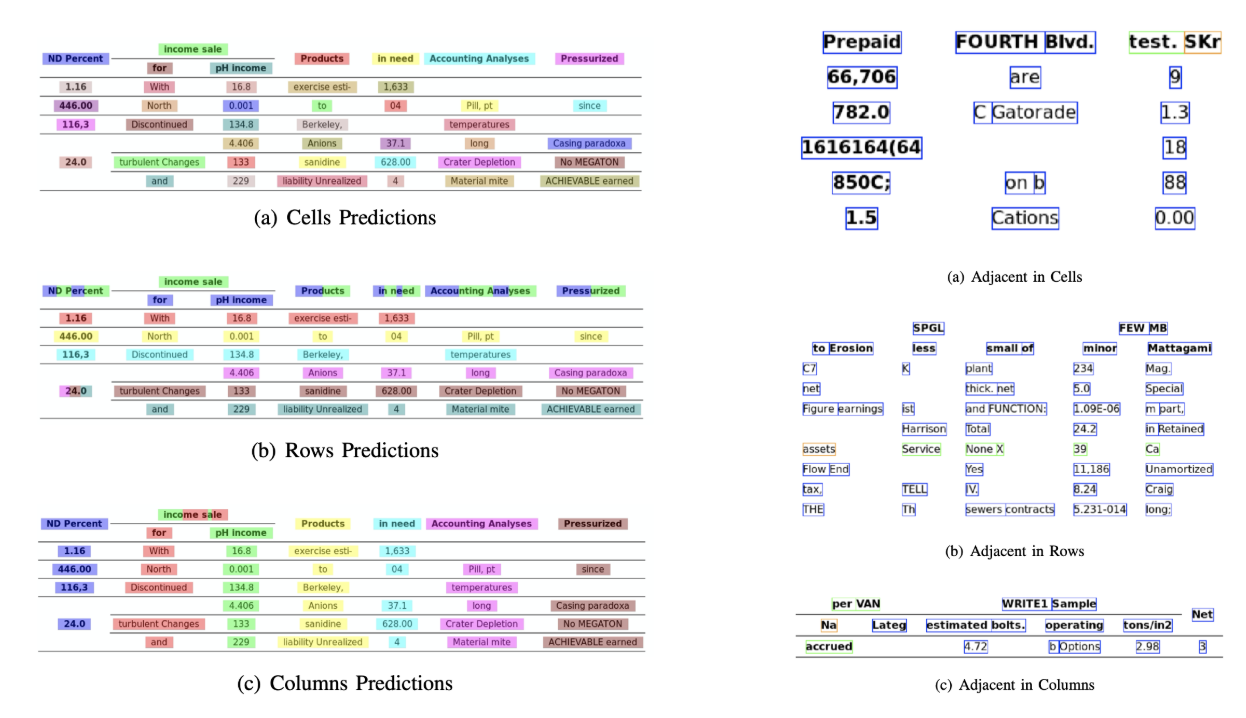

Szenario Nr. 4: Erkennung von Tabellenzellen

In einigen Fällen stoßen Unternehmen auf spezielle Arten von Formularen, die aus Tabellenzellen bestehen. Tabellenzellen sind rechteckige Bereiche innerhalb einer Tabelle, in denen Daten gespeichert werden. Sie können als Kopfzeilen, Zeilen oder Spalten klassifiziert werden. Ein idealer Algorithmus sollte alle diese Zelltypen und ihre Grenzen identifizieren, um die Daten daraus zu extrahieren. Einige beliebte Techniken für die Tabellenextraktion sind Stream und Lattice; Dies sind Algorithmen, die helfen können, Linien, Formen und Polygone zu erkennen, indem sie einfache isomorphe Operationen an Bildern verwenden.

Wie haben sich die Lösungen zur Formulardatenextraktion entwickelt?

Die Extraktion von Formulardaten hat ihren Ursprung in den Tagen vor dem Computer, als Menschen mit Papierformularen umgingen. Mit dem Aufkommen der Computertechnik wurde es möglich, Daten elektronisch zu speichern. Die Computerprogramme könnten die Daten verwenden, um Berichte zu erstellen, beispielsweise Verkaufsstatistiken. Diese Software könnte auch verwendet werden, um Versandetiketten zu drucken, wie z. B. den Namen und die Adresse von Kunden, und Rechnungen auszudrucken, wie z. B. den fälligen Betrag und die Adresse, an die sie gesendet werden sollen. Heute sehen wir jedoch eine andere Version der Formulardatenextraktionssoftware; Diese sind hochpräzise, schneller und liefern die Daten in einer hochgradig organisierten und strukturierten Weise. Lassen Sie uns nun kurz verschiedene Arten von Techniken zum Extrahieren von Formulardaten erörtern.

- Regelbasierte Datenextraktion: Die regelbasierte Extraktion ist eine Technik, die automatisch Daten aus einem bestimmten Vorlagenformular extrahiert. Es kann Daten ohne menschliches Eingreifen extrahieren. Sie arbeiten, indem sie verschiedene Felder auf der Seite untersuchen und anhand des umgebenden Textes, der Beschriftungen und anderer kontextbezogener Hinweise entscheiden, welche extrahiert werden sollen. Diese Algorithmen werden normalerweise mithilfe von ETL-Skripten oder Web Scraping entwickelt und automatisiert. Wenn sie jedoch mit unsichtbaren Daten getestet werden, versagen sie vollständig.

- Formulardatenextraktion mit OCR: OCR ist eine ideale Lösung für alle Arten von Datenextraktionsproblemen. Man muss jedoch zusätzliche Skripte und Programme schreiben, um eine genaue Leistung zu erzielen. Damit OCR funktioniert, muss ein Bild mit Text eingegeben werden. Die Software liest dann jedes Pixel und vergleicht jedes Pixel mit seinem entsprechenden Buchstaben. Wenn es übereinstimmt, wird es diesen Buchstaben und alle Zahlen oder Symbole ausgeben, die nahe genug am Buchstaben liegen. Die größte Herausforderung bei OCR besteht darin, herauszufinden, wie man Buchstaben trennt. Zum Beispiel, wenn die Noten nahe beieinander liegen oder sich überlappen, wie „a“ und „e“. Daher funktionieren diese möglicherweise nicht, wenn wir Offline-Formulare extrahieren.

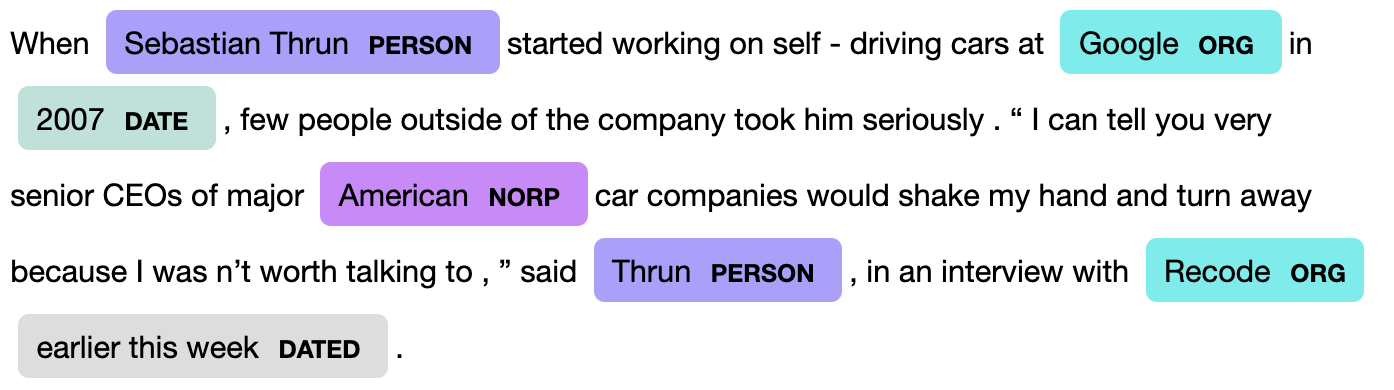

- NER für die Formulardatenextraktion: Die Erkennung benannter Entitäten ist die Aufgabe, vordefinierte Entitäten in Text in natürlicher Sprache zu identifizieren und zu klassifizieren. Es wird häufig verwendet, um Informationen aus Formularen zu extrahieren, in die Personen Namen, Adressen, Kommentare usw. eingeben. Die Aufgabe des Erkennens benannter Entitäten ist eng mit der umfassenderen Aufgabe der Auflösung von Koreferenzen verbunden, die bestimmt, ob Erwähnungen derselben Entitäten auf die verweisen dieselben realen Entitäten. Mit fortschrittlichen Programmiertools und Frameworks könnten wir heute vortrainierte Modelle nutzen, um NER-basierte Modelle für Informationsextraktionsaufgaben zu erstellen.

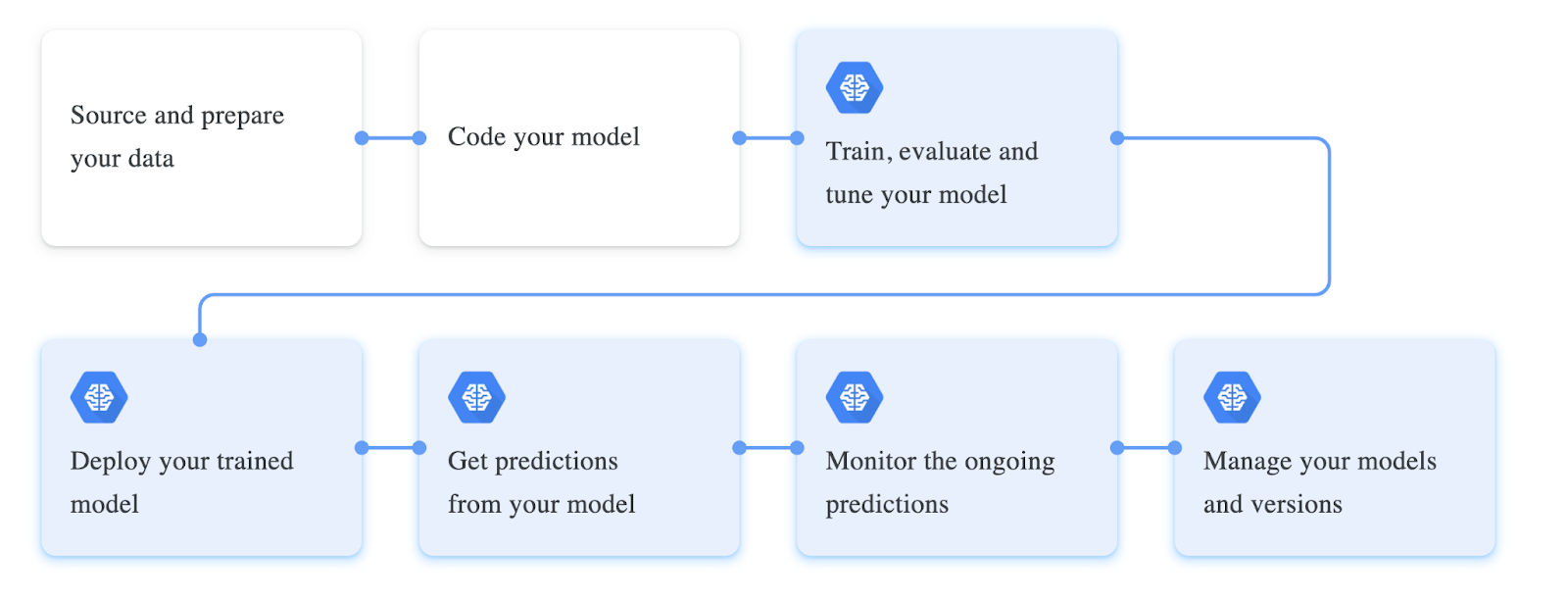

- Verwenden von Deep Learning für die Formulardatenextraktion: Deep Learning ist nicht neu, es gibt es schon seit Jahrzehnten, aber die jüngsten Entwicklungen bei Deep-Learning-Architekturen und Rechenleistung haben zu bahnbrechenden Ergebnissen geführt. Die Formulardatenextraktion mit Deep Learning erzielte in nahezu jedem Format, ob digital oder handschriftlich, eine hochmoderne Leistung. Der Prozess beginnt damit, dass das Deep Neural Network (DNN) mit Tausenden oder Millionen verschiedener Beispiele gespeist wird, die mit dem gekennzeichnet sind, was sie sind. Zum Beispiel Etiketten in Bildform mit ihren Entitäten wie Name, E-Mail, ID usw. Das DNN verarbeitet all diese Informationen und lernt selbst, wie diese Teile miteinander verbunden sind. Der Aufbau eines hochpräzisen Modells erfordert jedoch viel Fachwissen und Experimente.

Möchten Sie Daten aus gedruckten oder handschriftlichen Formularen extrahieren? Schauen Sie sich Nanonets an™ Form Data Extractor kostenlos & automatisieren Sie den Export von Informationen aus jedem Formular!

Formulardatenextraktion mit OCRs

Es gibt viele verschiedene Bibliotheken zum Extrahieren von Daten aus Formularen. Aber was ist, wenn Sie Daten aus einem Bild eines Formulars extrahieren möchten? Hier kommt Tesseract OCR (Optical Character Recognition) ins Spiel. Tesseract ist eine von HP entwickelte Open-Source-OCR-Engine (Optical Character Recognition). Mit Tesseract OCR ist es möglich, gescannte Dokumente wie Papierrechnungen, Quittungen und Schecks in durchsuchbare, bearbeitbare digitale Dateien umzuwandeln. Es ist in mehreren Sprachen verfügbar und kann Zeichen in verschiedenen Bildformaten erkennen. Tesseract wird normalerweise in Kombination mit anderen Bibliotheken verwendet, um Bilder zu verarbeiten, um Text zu extrahieren.

Um dies zu testen, stellen Sie sicher, dass Sie Tesseract auf Ihrem lokalen Computer installieren. Sie können entweder die Tesseract-CLI oder Python-Bindungen zum Ausführen der OCR verwenden. Python-tesseract ist ein Wrapper für die Tesseract-OCR-Engine von Google. Es kann verwendet werden, um alle Bildtypen zu lesen, die von den Pillow- und Leptonica-Bildbibliotheken unterstützt werden, einschließlich jpeg, png, gif, bmp, tiff und andere. Sie können es einfach als eigenständiges Aufrufskript verwenden, um bei Bedarf zu tesserieren.

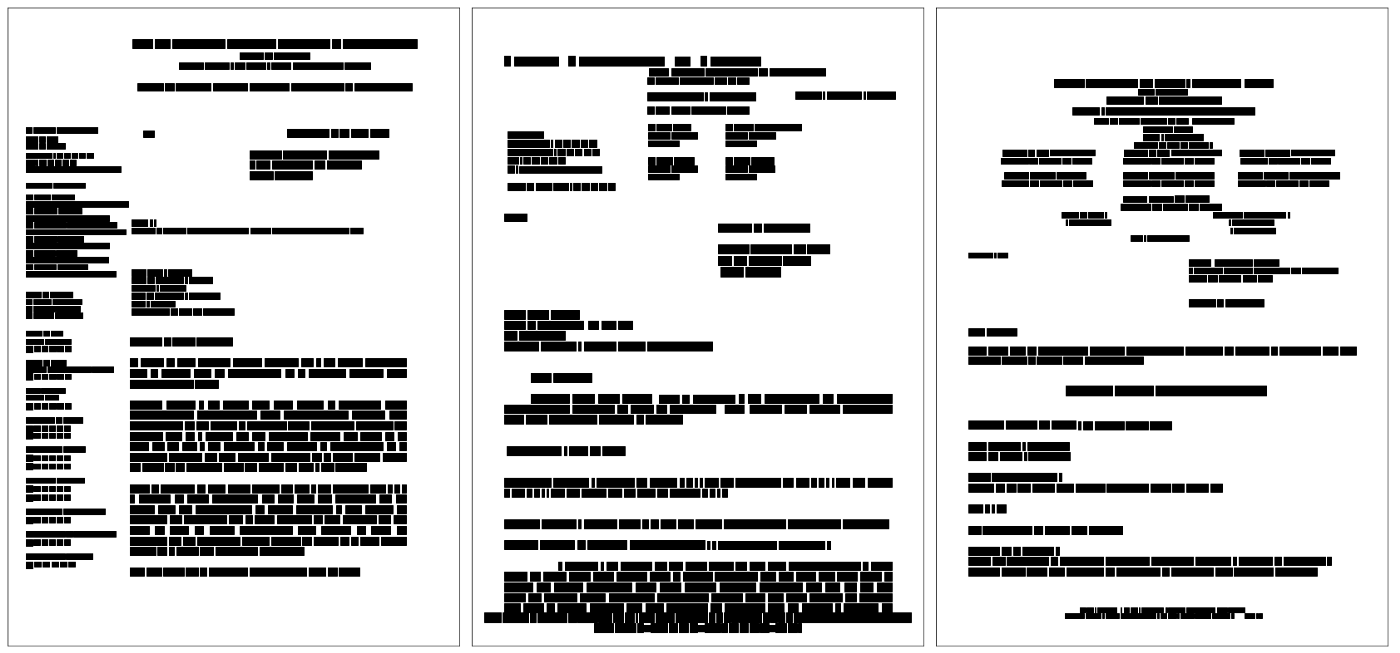

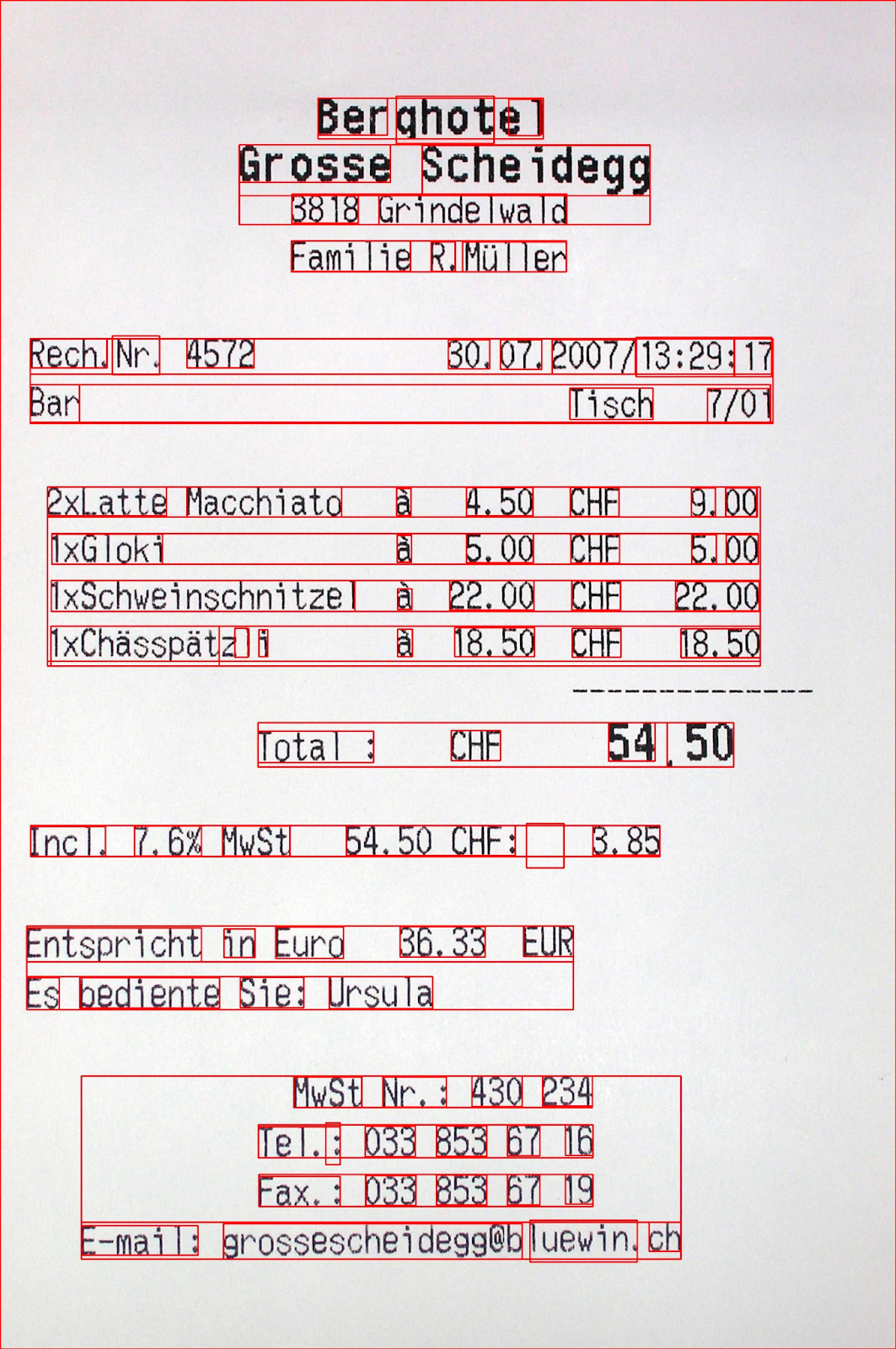

Nehmen wir nun eine Quittung mit Formulardaten und versuchen, die Position des Textes mithilfe von Computer Vision und Tesseract zu identifizieren.

import pytesseract

from pytesseract import Output

import cv2 img = cv2.imread('receipt.jpg')

d = pytesseract.image_to_data(img, output_type=Output.DICT)

n_boxes = len(d['level'])

for i in range(n_boxes): (x, y, w, h) = (d['left'][i], d['top'][i], d['width'][i], d['height'][i]) img = cv2.rectangle(img, (x, y), (x + w, y + h), (0, 0, 255), 2) cv2.imshow(img,'img')

Hier, in der Ausgabe, konnte das Programm, wie wir sehen können, den gesamten Text im Formular identifizieren. Wenden wir nun OCR darauf an, um alle Informationen zu extrahieren. Wir können dies einfach tun, indem wir die verwenden image_to_string Funktion in Python.

extracted_text = pytesseract.image_to_string(img, lang = 'deu')

Ausgang:

Berghotel

Grosse Scheidegg

3818 Grindelwald

Familie R.Müller Rech.Nr. 4572 30.07.2007/13:29: 17

Bar Tisch 7/01

2xLatte Macchiato &ä 4.50 CHF 9,00

1xGloki a 5.00 CH 5.00

1xSchweinschnitzel ä 22.00 CHF 22.00

IxChässpätz 1 a 18.50 CHF 18.50 Total: CHF 54.50 Incl. 7.6% MwSt 54.50 CHF: 3.85 Entspricht in Euro 36.33 EUR

Es bediente Sie: Ursula MwSt Nr. : 430 234

Tel.: 033 853 67 16

Fax.: 033 853 67 19

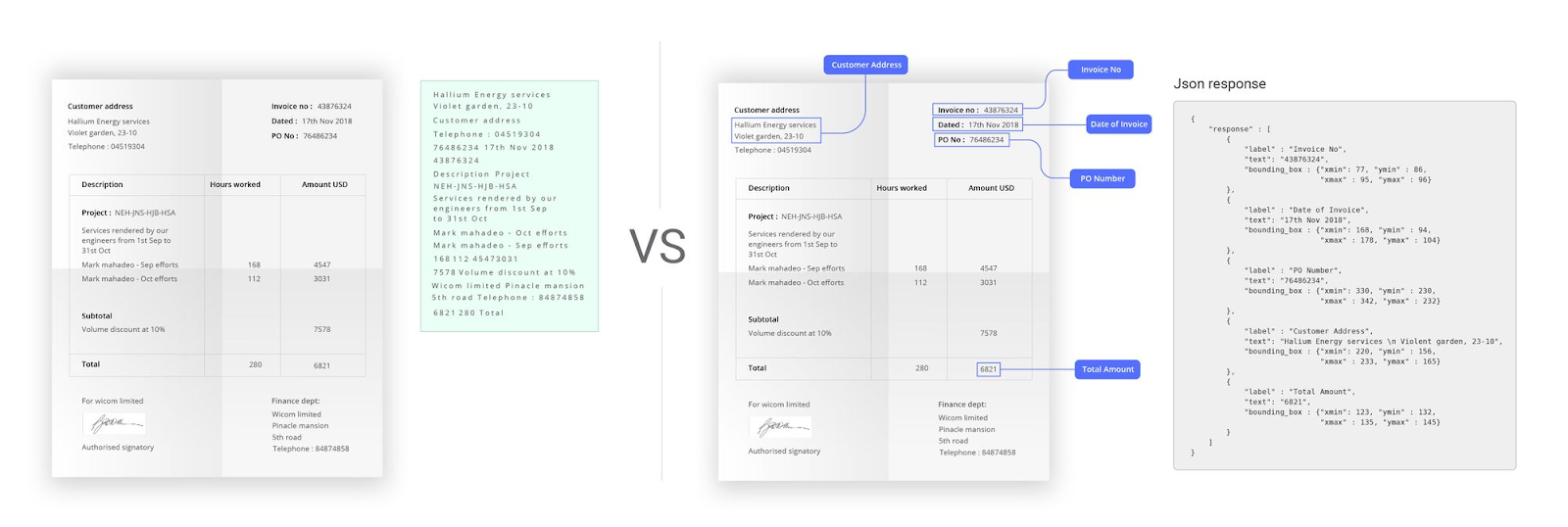

E-mail: grossescheidegs@b luewin. Ch Hier können wir alle Informationen aus dem Formular extrahieren. In den meisten Fällen hilft es jedoch nicht, nur OCR zu verwenden, da die extrahierten Daten völlig unstrukturiert sind. Daher verlassen sich Benutzer auf die Extraktion von Schlüssel-Wert-Paaren auf Formularen, die nur bestimmte Entitäten wie ID, Daten, Steuerbetrag usw. identifizieren können. Dies ist nur mit Deep Learning möglich. Im nächsten Abschnitt sehen wir uns an, wie wir verschiedene Deep-Learning-Techniken nutzen können, um Informationsextraktionsalgorithmen zu erstellen.

Lösung der Formulardatenextraktion mit Deep Learning

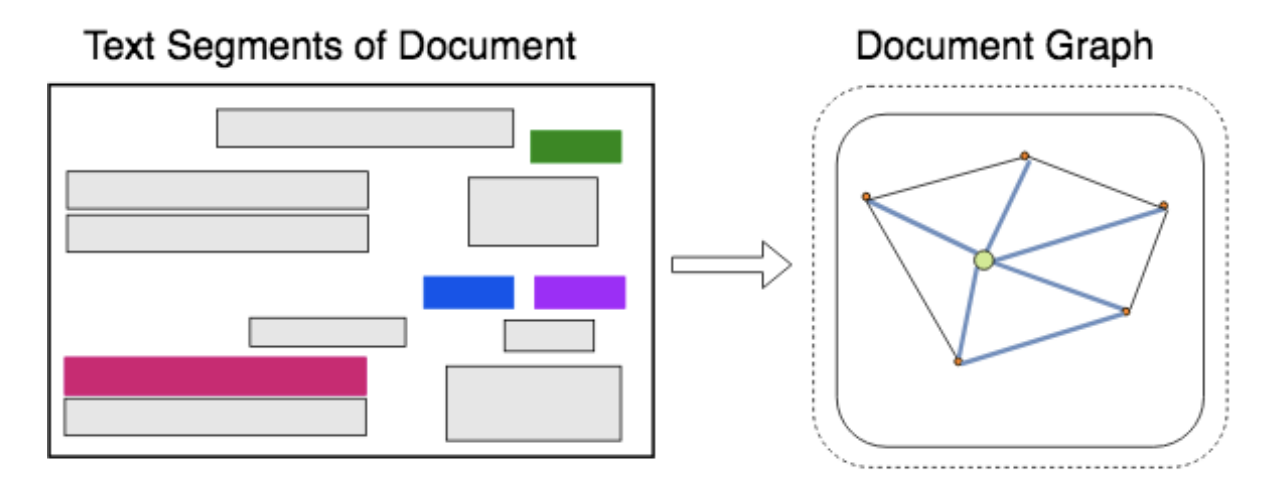

Diagrammfaltung für die multimodale Informationsextraktion aus visuell umfangreichen Dokumenten

Graph-Faltungsnetzwerke (Graph-CNNs) sind eine Klasse von Deep Convolutional Neural Networks (CNNs), die in der Lage sind, stark nichtlineare Merkmale in Graphdatenstrukturen effektiv zu lernen und gleichzeitig die Knoten- und Kantenstruktur beizubehalten. Sie können graphische Datenstrukturen als Input nehmen und „Feature-Maps“ für Knoten und Kanten generieren. Die resultierenden Merkmale können für die Graphklassifizierung, das Clustering oder die Community-Erkennung verwendet werden. GCNs bieten eine leistungsstarke Lösung zum Extrahieren von Informationen aus großen, optisch ansprechenden Dokumenten wie Rechnungen und Quittungen. Um diese zu verarbeiten, muss jedes Bild in einen Graphen umgewandelt werden, der aus Knoten und Kanten besteht. Jedes Wort auf dem Bild wird durch einen eigenen Knoten dargestellt; Die Visualisierung der restlichen Daten ist im Merkmalsvektor des Knotens kodiert.

Dieses Modell kodiert zunächst jedes Textsegment im Dokument in eine Diagrammeinbettung. Dadurch wird der visuelle und textuelle Kontext erfasst, der jedes Textelement umgibt, zusammen mit seiner Position oder Position innerhalb eines Textblocks. Anschließend werden diese Diagramme mit Texteinbettungen kombiniert, um eine Gesamtdarstellung der Struktur des Dokuments und dessen Inhalt zu erstellen. Das Modell lernt, Texten, die wahrscheinlich Entitäten sind, höhere Gewichte zuzuweisen, basierend auf ihrer relativen Position zueinander und dem Kontext, in dem sie innerhalb eines größeren Leserblocks erscheinen. Schließlich wendet es ein standardmäßiges BiLSTM-CRF-Modell für die Entitätsextraktion an. Die Ergebnisse zeigen, dass dieser Algorithmus das Basismodell (BiLSTM-CRF) bei weitem übertrifft.

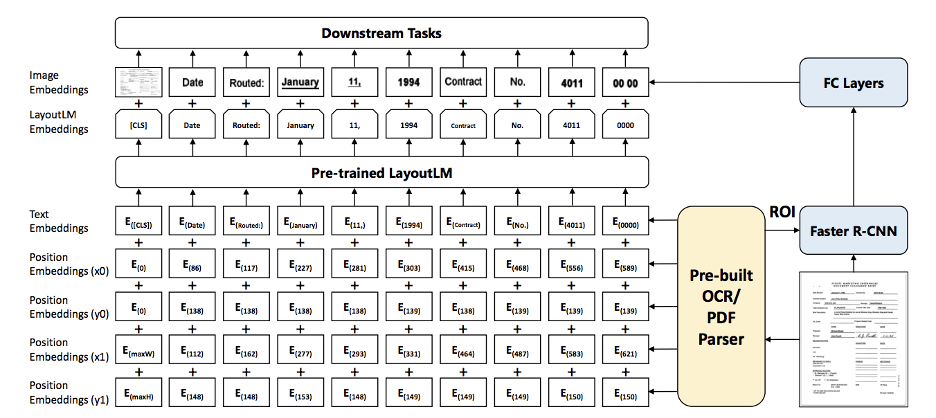

LayoutLM: Vortraining von Text und Layout für das Verständnis von Dokumentenbildern

Die Architektur des LayoutLM-Modells ist stark von BERT inspiriert und enthält Bildeinbettungen von einem Faster R-CNN. LayoutLM-Eingabeeinbettungen werden als Kombination aus Text- und Positionseinbettungen generiert und dann mit den vom Faster R-CNN-Modell generierten Bildeinbettungen kombiniert. Maskierte visuelle Sprachmodelle und Multi-Label-Dokumentklassifizierung werden hauptsächlich als Vortrainingsaufgaben für LayoutLM verwendet. Das LayoutLM-Modell ist wertvoll, dynamisch und stark genug für alle Aufgaben, die ein Layout-Verständnis erfordern, wie z. B. Formular-/Quittungsextraktion, Dokumentbildklassifizierung oder sogar die visuelle Beantwortung von Fragen, die mit diesem Trainingsmodell durchgeführt werden können.

Das LayoutLM-Modell wurde auf der IIT-CDIP Test Collection 1.0 trainiert, die über 6 Millionen Dokumente und mehr als 11 Millionen gescannte Dokumentenbilder mit insgesamt über 12 GB Daten umfasst. Dieses Modell hatte mehrere vortrainierte SOTA-Modelle in Bezug auf das Verstehen von Formularen, das Verstehen von Belegen und die Klassifizierung von gescannten Dokumentenbildern deutlich übertroffen.

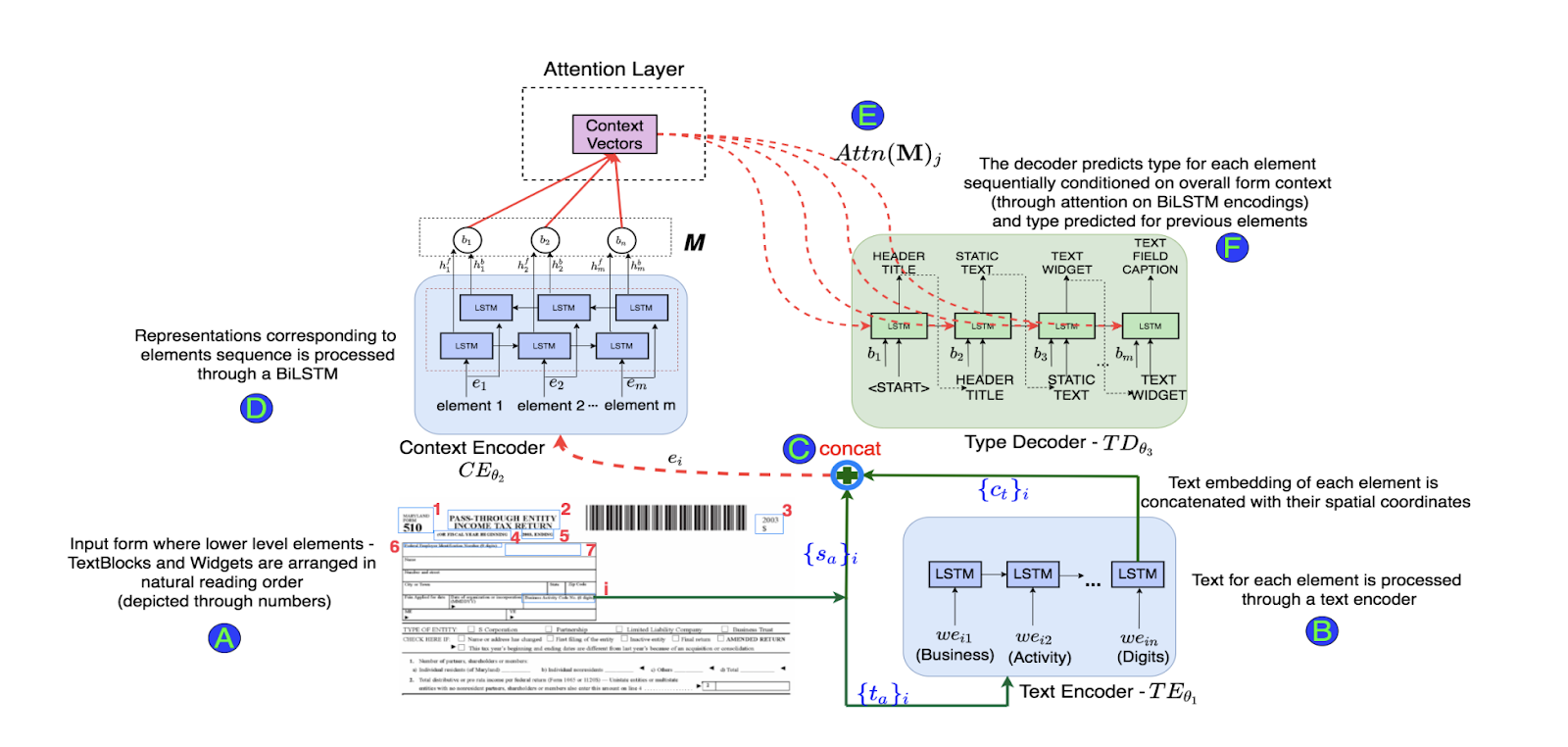

Form2Seq: Ein Framework für die Extraktion von Formularstrukturen höherer Ordnung

Form2Seq ist ein Framework, das sich auf das Extrahieren von Strukturen aus Eingabetext mithilfe von Positionssequenzen konzentriert. Im Gegensatz zu herkömmlichen seq2seq-Frameworks nutzt Form2Seq die relativen räumlichen Positionen der Strukturen und nicht ihre Reihenfolge.

Bei dieser Methode klassifizieren wir zunächst Elemente auf niedriger Ebene, die eine bessere Verarbeitung und Organisation ermöglichen. Es gibt 10 Arten von Formularen, z. B. Feldbeschriftungen, Listenelemente usw. Als Nächstes gruppieren wir Elemente auf niedrigerer Ebene, wie z. B. Textfelder und Auswahlfelder, in Konstrukten höherer Ordnung, die als Auswahlgruppen bezeichnet werden. Diese werden als Informationserfassungsmechanismen verwendet, um eine bessere Benutzererfahrung zu erreichen. Elemente auf niedrigerer Ebene in Konstrukte höherer Ordnung, wie z. B. Textfelder, Auswahlfelder und Auswahlgruppen, die als Informationserfassungsmechanismen in Formularen verwendet werden. Dies ist möglich, indem die konstituierenden Elemente in einer linearen Reihenfolge in natürlicher Lesereihenfolge angeordnet und ihre räumlichen und textuellen Darstellungen in das Seq2Seq-Framework eingespeist werden. Das Seq2Seq-Framework macht sequentiell Vorhersagen für jedes Element eines Satzes, abhängig vom Kontext. Dadurch kann es mehr Informationen verarbeiten und zu einem besseren Verständnis der anstehenden Aufgabe gelangen.

Das Modell erreichte bei der Klassifizierungsaufgabe eine Genauigkeit von 90 %, was höher war als die von auf Segmentierung basierenden Basismodellen. Die F1 bei Textblöcken, Textfeldern und Auswahlfeldern betrug 86.01 % bzw. 61.63 %. Dieses Framework erreichte den Stand der Ergebnisse zum ICDAR-Datensatz zur Erkennung von Tabellenstrukturen.

Möchten Sie Daten aus gedruckten oder handschriftlichen Formularen extrahieren? Schauen Sie sich Nanonets an™ Form Data Extractor kostenlos & automatisieren Sie den Export von Informationen aus jedem Formular!

Warum die KI-basierte OCR von Nanonets die beste Option ist

Obwohl OCR-Software gescannte Textbilder in formatierte digitale Dateien wie PDFs, DOCs und PPTs konvertieren kann, ist sie nicht immer genau. Die heutige Spitzensoftware wie das KI-basierte OCR-Deep-Learning-System von Nanonets hat viele Herausforderungen gemeistert, denen herkömmliche OCR-Systeme beim Erstellen einer bearbeitbaren Datei aus einem gescannten Dokument gegenüberstanden. Es ist zur besten Option für die Datenextraktion geworden, da es hohe Genauigkeitsraten und hohe Toleranzniveaus für Rauschen, grafische Elemente und Formatierungsänderungen bieten kann. Lassen Sie uns nun einige Punkte besprechen, inwiefern KI-basierte OCR die beste Option ist.

- OCR ist, wie bereits erwähnt, eine unkomplizierte Technik zum Extrahieren von Daten. Sie funktionieren jedoch nicht konsistent, wenn sie auf unsichtbare/neue Daten übertragen werden. KI-basierte OCR könnte jedoch Situationen wie diese bewältigen, da sie auf einer Vielzahl von Daten trainieren.

- Normale OCRs können keine komplexen Layouts für Formulardatenextraktionen verarbeiten. Wenn sie mit Deep Learning oder KI betrieben werden, liefern sie daher die besten Ergebnisse, indem sie das Layout, den Text und den Kontext der Daten verstehen.

- OCRs können leistungsschwach sein, wenn Rauschen in Daten vorhanden ist, wie z. B. Schiefe, bei schwachem Licht gescannte Bilder usw., während Deep-Learning-Modelle mit solchen Bedingungen umgehen können und dennoch hochgenaue Ergebnisse liefern.

- KI-basierte OCRs sind im Vergleich zu herkömmlichen OCRs hochgradig anpassbar und flexibel; Sie können auf verschiedenen Arten von Daten aufgebaut werden, um unstrukturierte Daten in ein beliebiges strukturiertes Format umzuwandeln.

- Nachbearbeitungsausgaben von KI-basierter OCR sind im Vergleich zu reiner OCR zugänglich; Sie können direkt aus dem Modell in beliebige Datenformate wie JSON, CSV, Excel Sheets oder sogar eine Datenbank wie Postgres exportiert werden.

- KI-basierte OCR kann als einfache API mit vortrainierten Modellen exportiert werden. Dies ist bei anderen traditionellen Methoden immer noch möglich, aber es könnte schwierig sein, die Modelle zeitnah konsistent zu verbessern. Bei KI-basierter OCR kann sie bei Fehlern automatisch angepasst werden.

- Tabellenextraktion ist mit direkter OCR höchst unmöglich. Mit der Leistungsfähigkeit von AI/DL ist dies jedoch problemlos möglich. Heute können KI-basierte OCRs tabellenbasierte Formulare in Dokumenten positiv verweisen und Informationen extrahieren.

- Wenn Dokumente finanzielle oder vertrauliche Daten enthalten, können KI-Modelle auch Betrugsprüfungen durchführen. Es sucht grundsätzlich nach bearbeitetem/unscharfem Text in den gescannten Dokumenten und benachrichtigt die Administratoren. Durch diese Modelle können auch doppelte Dokumente oder Informationen identifiziert werden. Während OCR in solchen Fällen einfach versagt.

- &

- 67

- 7

- 9

- Konto

- genau

- erreicht

- über

- Zusätzliche

- Adresse

- advanced

- AI

- Algorithmus

- Algorithmen

- Alle

- Obwohl

- Betrag

- Beträge

- Ein anderer

- Bienen

- APIs

- Anwendung

- Anwendung

- Ansatz

- Architektur

- um

- Automatisiert

- verfügbar

- Hintergrund

- Baseline

- Grundsätzlich gilt

- Grundlage

- werden

- Sein

- BESTE

- Größte

- Blockieren

- Blog

- Grenze

- bauen

- Building

- Unternehmen

- Kapazität

- Bildunterschriften

- österreichische Unternehmen

- Fälle

- Verursachen

- challenges

- Herausforderungen

- Schecks

- Einstufung

- sammeln

- Das Sammeln

- Sammlung

- Kombination

- kombiniert

- Bemerkungen

- gemeinsam

- community

- verglichen

- Komplex

- Computing

- Rechenleistung

- Inhalt

- Inhalt

- Kosten

- könnte

- schafft

- Erstellen

- wichtig

- Kunden

- technische Daten

- Datensicherheit

- Datenbase

- Datum

- Designs

- Entdeckung

- entwickeln

- entwickelt

- Entwickler

- Entwicklungen

- anders

- digital

- Abmessungen

- diskutieren

- Unterlagen

- dynamisch

- leicht

- Edge

- Effektiv

- effizient

- essential

- Euro

- Beispiel

- Excel

- ERFAHRUNGEN

- Expertise

- KONZENTRAT

- konfrontiert

- beschleunigt

- Merkmal

- Eigenschaften

- Felder

- Filter

- Endlich

- Revolution

- Vorname

- Fixieren

- Fluss

- unten stehende Formular

- Format

- Formen

- gefunden

- Unser Ansatz

- Betrug

- Frei

- Funktion

- Grundlagen

- erzeugen

- Kundenziele

- Gruppe an

- Hilfe

- hilfreich

- High

- hoch

- Ultraschall

- Hilfe

- HTTPS

- Idee

- Login

- identifizieren

- Image

- Impact der HXNUMXO Observatorien

- wichtig

- unmöglich

- zu unterstützen,

- In anderen

- das

- Einschließlich

- Information

- inspirierte

- Integrationen

- Probleme

- IT

- Job

- bekannt

- Etiketten

- Sprache

- Sprachen

- grosse

- größer

- führen

- lernen

- geführt

- Hebelwirkung

- Hebelwirkungen

- Liste

- Listen

- aus einer regionalen

- Standorte

- Standorte

- Maschine

- Dur

- manuell

- manuell

- Karte

- Erwähnungen

- Million

- Millionen

- Modell

- für

- vor allem warme

- Namen

- Natürliche

- Netzwerk

- Netzwerke

- Fiber Node

- Lärm

- Notizen

- Zahlen

- Online

- Einkauf & Prozesse

- Option

- Optionen

- Auftrag

- Organisation

- Organisationen

- Andere

- Andernfalls

- Papier

- Teilnehmer

- Personen

- Leistung

- persönliche

- Beliebt

- möglich

- Werkzeuge

- größte treibende

- Prognosen

- Gegenwart

- primär

- Aufgabenstellung:

- Prozessdefinierung

- anpassen

- Profil

- Programm

- Programmierung

- Programme

- Projektion

- die

- Frage

- Angebot

- Honorar

- RE

- Leser

- Lesebrillen

- Gründe

- erkennt

- Veteran

- Meldungen

- erfordern

- REST

- Die Ergebnisse

- Risiko

- Laufen

- Vertrieb

- Scan

- Scannen

- Verbindung

- Sicherheitdienst

- Segmentierung

- ausgewählt

- Formen

- Short

- Einfacher

- So

- Software

- Lösungen

- begonnen

- Bundesstaat

- State-of-the-art

- Statistiken

- speichern

- Strom

- stark

- Unterstützte

- System

- Systeme und Techniken

- und Aufgaben

- Steuer

- Techniken

- Test

- basierte Online-to-Offline-Werbezuordnungen von anderen gab.

- Tausende

- Durch

- Zeit

- Zeitaufwendig

- heute

- gemeinsam

- Toleranz

- Werkzeuge

- traditionell

- Ausbildung

- Transformation

- verstehen

- -

- Nutzer

- gewöhnlich

- Seh-

- Visualisierung

- W

- Netz

- Was

- Was ist

- ob

- .

- ohne

- Worte

- Arbeiten

- arbeiten,

- Werk

- Schreiben

- X