Dieser Beitrag wurde gemeinsam mit Santosh Waddi und Nanda Kishore Thatikonda von BigBasket verfasst.

BigBasket ist Indiens größter Online-Lebensmittel- und Lebensmittelladen. Sie agieren in mehreren E-Commerce-Kanälen wie Quick Commerce, zeitgesteuerter Lieferung und Tagesabonnements. Sie können auch in den physischen Geschäften und Verkaufsautomaten einkaufen. Sie bieten ein großes Sortiment von über 50,000 Produkten von 1,000 Marken und sind in mehr als 500 Städten und Gemeinden tätig. BigBasket bedient über 10 Millionen Kunden.

In diesem Beitrag besprechen wir die Verwendung von BigBasket Amazon Sage Maker Ihr Computer-Vision-Modell für die Produktidentifizierung von Fast Moving Consumer Goods (FMCG) zu trainieren, was ihnen dabei half, die Schulungszeit um etwa 50 % zu reduzieren und die Kosten um 20 % zu senken.

Kundenherausforderungen

Heutzutage bieten die meisten Supermärkte und physischen Geschäfte in Indien die manuelle Bezahlung an der Kasse an. Dies hat zwei Probleme:

- Es erfordert zusätzliche Arbeitskräfte, Gewichtsaufkleber und wiederholte Schulungen für das Betriebsteam im Geschäft bei der Skalierung.

- In den meisten Geschäften unterscheidet sich die Kasse vom Wiegeschalter, was den Kaufprozess des Kunden zusätzlich erschwert. Kunden verlieren häufig den Wiegeaufkleber und müssen ihn erneut an den Wiegetischen abholen, bevor sie mit dem Bezahlvorgang fortfahren können.

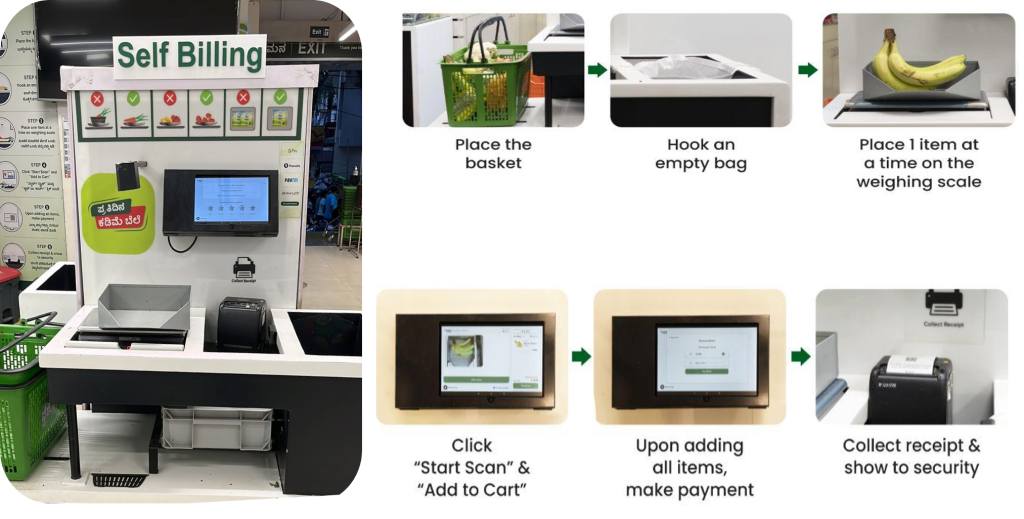

Self-Checkout-Prozess

BigBasket hat in seinen physischen Geschäften ein KI-gestütztes Kassensystem eingeführt, das Kameras verwendet, um Artikel eindeutig zu unterscheiden. Die folgende Abbildung gibt einen Überblick über den Checkout-Prozess.

Das BigBasket-Team führte interne Open-Source-ML-Algorithmen für die Computer-Vision-Objekterkennung aus, um KI-gestützte Kassen an ihrem Standort zu ermöglichen frisch (physische) Geschäfte. Wir standen beim Betrieb ihres bestehenden Setups vor den folgenden Herausforderungen:

- Mit der kontinuierlichen Einführung neuer Produkte musste das Computer-Vision-Modell kontinuierlich neue Produktinformationen integrieren. Das System musste einen großen Katalog von über 12,000 Stock Keeping Units (SKUs) verwalten, wobei kontinuierlich neue SKUs mit einer Rate von über 600 pro Monat hinzugefügt wurden.

- Um mit neuen Produkten Schritt zu halten, wurde jeden Monat ein neues Modell unter Verwendung der neuesten Trainingsdaten erstellt. Es war kostspielig und zeitaufwändig, die Modelle häufig zu trainieren, um sie an neue Produkte anzupassen.

- BigBasket wollte außerdem die Trainingszykluszeit verkürzen, um die Markteinführungszeit zu verkürzen. Aufgrund des Anstiegs der SKUs nahm die vom Modell benötigte Zeit linear zu, was sich auf die Markteinführungszeit auswirkte, da die Schulungshäufigkeit sehr hoch war und lange dauerte.

- Die Datenerweiterung für das Modelltraining und die manuelle Verwaltung des gesamten End-to-End-Trainingszyklus verursachten einen erheblichen Mehraufwand. BigBasket betrieb dies auf einer Drittanbieterplattform, was erhebliche Kosten verursachte.

Lösungsüberblick

Wir haben BigBasket empfohlen, seine bestehende FMCG-Produkterkennungs- und -klassifizierungslösung mithilfe von SageMaker neu zu gestalten, um diese Herausforderungen zu bewältigen. Bevor BigBasket zur Serienproduktion überging, testete BigBasket einen Pilotversuch mit SageMaker, um Leistungs-, Kosten- und Komfortkennzahlen zu bewerten.

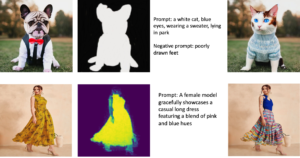

Ihr Ziel war die Feinabstimmung eines bestehenden Modells für maschinelles Lernen (Computer Vision, maschinelles Lernen) für die SKU-Erkennung. Wir haben eine CNN-Architektur (Convolutional Neural Network) verwendet ResNet152 zur Bildklassifizierung. Für das Modelltraining wurde ein umfangreicher Datensatz von etwa 300 Bildern pro SKU geschätzt, was insgesamt über 4 Millionen Trainingsbilder ergab. Für bestimmte SKUs haben wir die Daten erweitert, um ein breiteres Spektrum an Umweltbedingungen abzudecken.

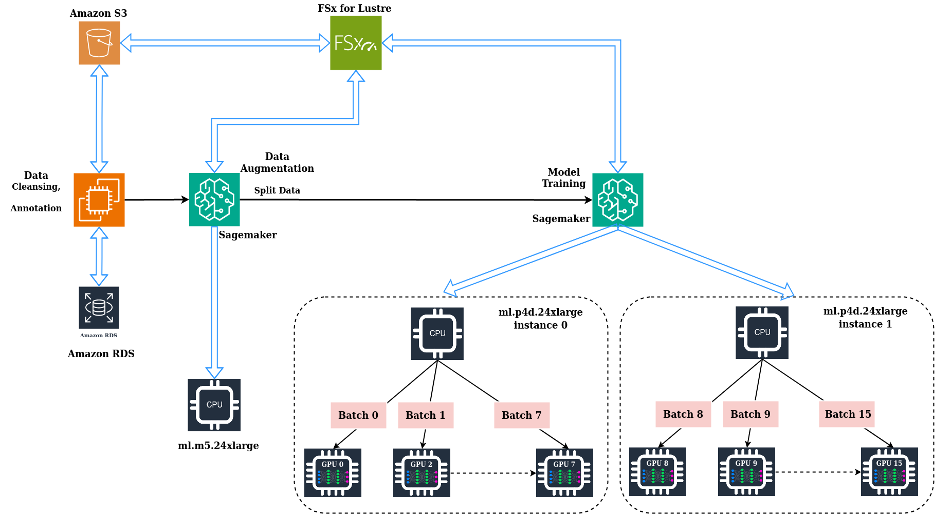

Das folgende Diagramm zeigt die Lösungsarchitektur.

Der gesamte Prozess kann in die folgenden allgemeinen Schritte zusammengefasst werden:

- Führen Sie Datenbereinigung, Annotation und Erweiterung durch.

- Speichern Sie Daten in einem Amazon Simple Storage-Service (Amazon S3) Eimer.

- Verwenden Sie SageMaker und Amazon FSx für Lustre für eine effiziente Datenerweiterung.

- Teilen Sie Daten in Trainings-, Validierungs- und Testsätze auf. Wir haben FSx für Lustre und verwendet Relationaler Amazon-Datenbankdienst (Amazon RDS) für schnellen parallelen Datenzugriff.

- Verwenden Sie eine benutzerdefinierte PyTorch Docker-Container einschließlich anderer Open-Source-Bibliotheken.

- Verwenden Sie die Verteilte Datenparallelität von SageMaker (SMDDP) für beschleunigtes verteiltes Training.

- Protokollieren Sie die Trainingsmetriken des Modells.

- Kopieren Sie das endgültige Modell in einen S3-Bucket.

BigBasket gebraucht SageMaker-Notizbücher um ihre ML-Modelle zu trainieren und konnten ihr vorhandenes Open-Source-PyTorch und andere Open-Source-Abhängigkeiten problemlos auf einen SageMaker PyTorch-Container portieren und die Pipeline nahtlos ausführen. Dies war der erste Vorteil, den das BigBasket-Team sah, da kaum Änderungen am Code erforderlich waren, um ihn für die Ausführung in einer SageMaker-Umgebung kompatibel zu machen.

Das Modellnetzwerk besteht aus einer ResNet 152-Architektur, gefolgt von vollständig verbundenen Schichten. Wir haben die Low-Level-Feature-Layer eingefroren und die Gewichtungen beibehalten, die wir durch Transferlernen aus dem ImageNet-Modell erhalten haben. Die gesamten Modellparameter betrugen 66 Millionen, bestehend aus 23 Millionen trainierbaren Parametern. Dieser auf Transferlernen basierende Ansatz half ihnen, zum Zeitpunkt des Trainings weniger Bilder zu verwenden, ermöglichte außerdem eine schnellere Konvergenz und verkürzte die gesamte Trainingszeit.

Aufbau und Training des Modells im Inneren Amazon SageMaker-Studio Bereitstellung einer integrierten Entwicklungsumgebung (IDE) mit allem, was zum Vorbereiten, Erstellen, Trainieren und Optimieren von Modellen erforderlich ist. Durch die Erweiterung der Trainingsdaten mithilfe von Techniken wie Zuschneiden, Drehen und Spiegeln von Bildern konnten die Modelltrainingsdaten und die Modellgenauigkeit verbessert werden.

Das Modelltraining wurde durch den Einsatz der SMDDP-Bibliothek, die optimierte Kommunikationsalgorithmen enthält, die speziell für die AWS-Infrastruktur entwickelt wurden, um 50 % beschleunigt. Um die Lese-/Schreibleistung von Daten während des Modelltrainings und der Datenerweiterung zu verbessern, haben wir FSx für Lustre für einen hohen Leistungsdurchsatz verwendet.

Ihre anfängliche Trainingsdatengröße betrug über 1.5 TB. Wir haben zwei verwendet Amazon Elastic Compute-Cloud (Amazon EC2) p4d.24 große Instanzen mit 8 GPU und 40 GB GPU-Speicher. Für verteilte SageMaker-Schulungen müssen sich die Instanzen in derselben AWS-Region und Verfügbarkeitszone befinden. Außerdem müssen sich die in einem S3-Bucket gespeicherten Trainingsdaten in derselben Availability Zone befinden. Diese Architektur ermöglicht BigBasket auch den Wechsel zu anderen Instanztypen oder das Hinzufügen weiterer Instanzen zur aktuellen Architektur, um auf ein erhebliches Datenwachstum zu reagieren oder eine weitere Reduzierung der Trainingszeit zu erreichen.

Wie die SMDDP-Bibliothek dazu beitrug, Schulungszeit, -kosten und -komplexität zu reduzieren

Beim herkömmlichen verteilten Datentraining weist das Trainingsframework den GPUs (Workern) Ränge zu und erstellt auf jeder GPU eine Replik Ihres Modells. Während jeder Trainingsiteration wird der globale Datenstapel in Teile (Batch-Shards) aufgeteilt und ein Teil wird an jeden Arbeiter verteilt. Jeder Worker fährt dann mit dem Vorwärts- und Rückwärtsdurchlauf fort, der in Ihrem Trainingsskript auf jeder GPU definiert ist. Schließlich werden Modellgewichte und -verläufe aus den verschiedenen Modellreplikaten am Ende der Iteration durch eine kollektive Kommunikationsoperation namens AllReduce synchronisiert. Nachdem jeder Worker und jede GPU über eine synchronisierte Replik des Modells verfügt, beginnt die nächste Iteration.

Die SMDDP-Bibliothek ist eine kollektive Kommunikationsbibliothek, die die Leistung dieses parallelen Trainingsprozesses für verteilte Daten verbessert. Die SMDDP-Bibliothek reduziert den Kommunikationsaufwand der wichtigsten kollektiven Kommunikationsoperationen wie AllReduce. Die Implementierung von AllReduce ist für die AWS-Infrastruktur konzipiert und kann das Training beschleunigen, indem der AllReduce-Vorgang mit dem Rückwärtsdurchlauf überlappt wird. Dieser Ansatz erreicht eine nahezu lineare Skalierungseffizienz und eine schnellere Trainingsgeschwindigkeit durch die Optimierung der Kernel-Operationen zwischen CPUs und GPUs.

Beachten Sie die folgenden Berechnungen:

- Die Größe des globalen Batches beträgt (Anzahl der Knoten in einem Cluster) * (Anzahl der GPUs pro Knoten) * (pro Batch-Shard)

- Ein Batch-Shard (kleiner Batch) ist eine Teilmenge des Datensatzes, der jeder GPU (Worker) pro Iteration zugewiesen wird

BigBasket nutzte die SMDDP-Bibliothek, um die gesamte Schulungszeit zu verkürzen. Mit FSx für Lustre haben wir den Datenlese-/Schreibdurchsatz während des Modelltrainings und der Datenerweiterung reduziert. Durch die Datenparallelität konnte BigBasket im Vergleich zu anderen Alternativen ein fast 50 % schnelleres und 20 % günstigeres Training erreichen und so die beste Leistung auf AWS liefern. SageMaker fährt die Trainingspipeline nach Abschluss automatisch herunter. Das Projekt wurde mit einer um 50 % kürzeren Schulungszeit in AWS erfolgreich abgeschlossen (4.5 Tage in AWS gegenüber 9 Tagen auf der alten Plattform).

Zum Zeitpunkt des Verfassens dieses Beitrags hat BigBasket die Komplettlösung seit mehr als 6 Monaten in Produktion und skaliert das System, indem es neue Städte bedient, und wir fügen jeden Monat neue Geschäfte hinzu.

„Unsere Partnerschaft mit AWS bei der Migration zu verteilten Schulungen mithilfe ihres SMDDP-Angebots war ein großer Gewinn. Dadurch konnten wir nicht nur unsere Schulungszeiten um 50 % verkürzen, sondern waren auch 20 % günstiger. In unserer gesamten Partnerschaft hat AWS die Messlatte auf Kundenorientierung und die Bereitstellung von Ergebnissen gelegt und dabei auf dem gesamten Weg mit uns zusammengearbeitet, um die versprochenen Vorteile zu realisieren.“

– Keshav Kumar, technischer Leiter bei BigBasket.

Zusammenfassung

In diesem Beitrag haben wir besprochen, wie BigBasket SageMaker verwendet hat, um sein Computer-Vision-Modell für die Identifizierung von FMCG-Produkten zu trainieren. Die Implementierung eines KI-gestützten automatisierten Self-Checkout-Systems sorgt durch Innovation für ein verbessertes Kundenerlebnis im Einzelhandel und eliminiert gleichzeitig menschliche Fehler im Checkout-Prozess. Die Beschleunigung des Onboardings neuer Produkte durch verteilte SageMaker-Schulungen reduziert die Zeit und die Kosten für das SKU-Onboarding. Die Integration von FSx für Lustre ermöglicht einen schnellen parallelen Datenzugriff für eine effiziente Modellumschulung mit Hunderten neuer SKUs pro Monat. Insgesamt bietet diese KI-basierte Self-Checkout-Lösung ein verbessertes Einkaufserlebnis ohne Frontend-Checkout-Fehler. Die Automatisierung und Innovation haben ihre Kassen- und Onboarding-Abläufe im Einzelhandel verändert.

SageMaker bietet End-to-End-ML-Entwicklungs-, Bereitstellungs- und Überwachungsfunktionen wie eine SageMaker Studio-Notebook-Umgebung zum Schreiben von Code, Datenerfassung, Datenkennzeichnung, Modellschulung, Modelloptimierung, Bereitstellung, Überwachung und vielem mehr. Wenn Ihr Unternehmen vor einer der in diesem Beitrag beschriebenen Herausforderungen steht und Zeit bis zur Markteinführung sparen und die Kosten senken möchte, wenden Sie sich an das AWS-Account-Team in Ihrer Region und beginnen Sie mit SageMaker.

Über die Autoren

Santosh Waddi ist leitender Ingenieur bei BigBasket und bringt über ein Jahrzehnt Erfahrung in der Lösung von KI-Herausforderungen mit. Er verfügt über fundierte Kenntnisse in den Bereichen Computer Vision, Datenwissenschaft und Deep Learning und verfügt über einen Postgraduiertenabschluss vom IIT Bombay. Santosh ist Autor bedeutender IEEE-Publikationen und hat als erfahrener Tech-Blog-Autor während seiner Zeit bei Samsung auch bedeutende Beiträge zur Entwicklung von Computer-Vision-Lösungen geleistet.

Santosh Waddi ist leitender Ingenieur bei BigBasket und bringt über ein Jahrzehnt Erfahrung in der Lösung von KI-Herausforderungen mit. Er verfügt über fundierte Kenntnisse in den Bereichen Computer Vision, Datenwissenschaft und Deep Learning und verfügt über einen Postgraduiertenabschluss vom IIT Bombay. Santosh ist Autor bedeutender IEEE-Publikationen und hat als erfahrener Tech-Blog-Autor während seiner Zeit bei Samsung auch bedeutende Beiträge zur Entwicklung von Computer-Vision-Lösungen geleistet.

Nanda Kishore Thatikonda ist Engineering Manager und leitet die Bereiche Data Engineering und Analytics bei BigBasket. Nanda hat mehrere Anwendungen zur Anomalieerkennung entwickelt und in einem ähnlichen Bereich ein Patent angemeldet. Er hat an der Entwicklung von Unternehmensanwendungen, dem Aufbau von Datenplattformen in mehreren Organisationen und Berichtsplattformen gearbeitet, um datengestützte Entscheidungen zu rationalisieren. Nanda verfügt über mehr als 18 Jahre Erfahrung in der Arbeit mit Java/J2EE, Spring-Technologien und Big-Data-Frameworks unter Verwendung von Hadoop und Apache Spark.

Nanda Kishore Thatikonda ist Engineering Manager und leitet die Bereiche Data Engineering und Analytics bei BigBasket. Nanda hat mehrere Anwendungen zur Anomalieerkennung entwickelt und in einem ähnlichen Bereich ein Patent angemeldet. Er hat an der Entwicklung von Unternehmensanwendungen, dem Aufbau von Datenplattformen in mehreren Organisationen und Berichtsplattformen gearbeitet, um datengestützte Entscheidungen zu rationalisieren. Nanda verfügt über mehr als 18 Jahre Erfahrung in der Arbeit mit Java/J2EE, Spring-Technologien und Big-Data-Frameworks unter Verwendung von Hadoop und Apache Spark.

Sudhanshu-Hass ist Principal AI & ML Specialist bei AWS und arbeitet mit Kunden zusammen, um sie auf ihrem Weg zu MLOps und generativer KI zu beraten. In seiner vorherigen Rolle konzipierte, gründete und leitete er Teams zum Aufbau einer grundlegenden, Open-Source-basierten KI- und Gamification-Plattform und vermarktete diese erfolgreich mit über 100 Kunden. Sudhanshu verfügt über mehrere Patente; hat zwei Bücher, mehrere Aufsätze und Blogs geschrieben; und hat seinen Standpunkt in verschiedenen Foren dargelegt. Er ist ein Vordenker und Redner und seit fast 2 Jahren in der Branche tätig. Er hat mit Fortune-25-Kunden auf der ganzen Welt zusammengearbeitet und arbeitet zuletzt mit Digital-Native-Kunden in Indien.

Sudhanshu-Hass ist Principal AI & ML Specialist bei AWS und arbeitet mit Kunden zusammen, um sie auf ihrem Weg zu MLOps und generativer KI zu beraten. In seiner vorherigen Rolle konzipierte, gründete und leitete er Teams zum Aufbau einer grundlegenden, Open-Source-basierten KI- und Gamification-Plattform und vermarktete diese erfolgreich mit über 100 Kunden. Sudhanshu verfügt über mehrere Patente; hat zwei Bücher, mehrere Aufsätze und Blogs geschrieben; und hat seinen Standpunkt in verschiedenen Foren dargelegt. Er ist ein Vordenker und Redner und seit fast 2 Jahren in der Branche tätig. Er hat mit Fortune-25-Kunden auf der ganzen Welt zusammengearbeitet und arbeitet zuletzt mit Digital-Native-Kunden in Indien.

Ayush Kumar ist Lösungsarchitekt bei AWS. Er arbeitet mit einer Vielzahl von AWS-Kunden zusammen und hilft ihnen dabei, die neuesten modernen Anwendungen einzuführen und mit Cloud-nativen Technologien schneller Innovationen zu entwickeln. In seiner Freizeit experimentiert er in der Küche.

Ayush Kumar ist Lösungsarchitekt bei AWS. Er arbeitet mit einer Vielzahl von AWS-Kunden zusammen und hilft ihnen dabei, die neuesten modernen Anwendungen einzuführen und mit Cloud-nativen Technologien schneller Innovationen zu entwickeln. In seiner Freizeit experimentiert er in der Küche.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/how-bigbasket-improved-ai-enabled-checkout-at-their-physical-stores-using-amazon-sagemaker/

- :hast

- :Ist

- :nicht

- 10 Mio. US$

- $UP

- 000

- 1

- 10

- 100

- 12

- 120

- 13

- 152

- 23

- 24

- 25

- 300

- 40

- 50

- 500

- 600

- 66

- 7

- 8

- 80

- 9

- 98

- a

- Fähig

- beschleunigt

- beschleunigend

- Zugang

- Konto

- Genauigkeit

- Erreichen

- Erreicht

- erworben

- Erwerb

- über

- automatisch

- hinzufügen

- hinzugefügt

- Hinzufügen

- Zusätzliche

- Adresse

- Fügt

- adoptieren

- beraten

- Nach der

- aufs Neue

- AI

- AI-powered

- Algorithmen

- erlaubt

- fast

- ebenfalls

- Alternativen

- Amazon

- Amazon EC2

- Amazon RDS

- Amazon Sage Maker

- Amazon Web Services

- an

- Analytik

- und

- Anomalieerkennung

- jedem

- Apache

- Anwendungen

- Ansatz

- ca.

- Architektur

- SIND

- um

- AS

- zugewiesen

- Sortiment

- At

- Augmented

- Autor

- verfassten

- Automatisiert

- Im Prinzip so, wie Sie es von Google Maps kennen.

- Automation

- Verfügbarkeit

- AWS

- Zurück

- unterstützt

- Hintergrund

- Bar

- BE

- weil

- war

- Bevor

- beginnt

- Sein

- Nutzen

- Vorteile

- BESTE

- zwischen

- Big

- Big Data

- Blog

- Blogs

- Bücher

- Marken

- Brings

- breiteres

- bauen

- Building

- erbaut

- Geschäft

- Kaufe

- by

- Berechnungen

- namens

- Kameras

- CAN

- Fähigkeiten

- Katalog

- sorgen

- Catering

- sicher

- Herausforderungen

- Übernehmen

- Änderungen

- Kanäle

- billiger

- Kasse

- Orte

- Einstufung

- Kunden

- Cluster

- CNN

- Code

- sammeln

- Collective

- Geschäfte

- Kommunikation

- verglichen

- kompatibel

- abschließen

- Abgeschlossene Verkäufe

- Berechnen

- Computer

- Computer Vision

- Bedingungen

- Sie

- Bestehend

- besteht

- Verbraucher

- verbrauchenden

- Container

- ständig

- kontinuierlich

- ständig

- Beiträge

- sehr beliebtes Sprach- und Freizeitprogramm

- Konvergenz

- Kosten

- teuer werden

- Kosten

- Counter

- Zähler

- Paar

- erstellt

- schafft

- Kredit

- Strom

- Original

- Kunde

- Customer Experience

- Kunden

- Schneiden

- Zyklus

- Unterricht

- technische Daten

- Datenzugriff

- Datenwissenschaft

- Datenbase

- Tage

- Jahrzehnte

- Entscheidungen

- tief

- tiefe Lernen

- definiert

- Grad

- liefern

- liefert

- Lieferanten

- Abhängigkeiten

- Einsatz

- beschrieben

- entworfen

- Entdeckung

- Entwicklung

- Diagramm

- DID

- anders

- digital

- diskutieren

- diskutiert

- unterscheiden

- verteilt

- verteiltes Training

- geteilt

- Docker

- nach unten

- zwei

- im

- jeder

- leicht

- E-EINKAUF

- Effizienz

- effizient

- eliminieren

- freigegeben

- ermöglicht

- umfassen

- Ende

- End-to-End

- Ingenieur

- Entwicklung

- verbesserte

- Unternehmensqualität

- Ganz

- Arbeitsumfeld

- Umwelt-

- Fehler

- geschätzt

- bewerten

- Jedes

- alles

- vorhandenen

- ERFAHRUNGEN

- Experimentieren

- Expertise

- zugewandt

- FAST

- Schnell - bewegend

- beschleunigt

- Merkmal

- Weniger

- Abbildung

- eingereicht

- Finale

- Endlich

- Finden Sie

- Vorname

- fmcg

- gefolgt

- Folgende

- Nahrung,

- Aussichten für

- Vermögen

- Foren

- vorwärts

- Unser Ansatz

- Gerüste

- Frequenz

- häufig

- Reibung

- für

- Frontend

- volle Skala

- voll

- weiter

- gamification

- generativ

- Generative KI

- bekommen

- Global

- Globus

- Go

- Waren

- GPU

- GPUs

- Steigungen

- groß

- Wachstum

- Griff

- Haben

- he

- ganzer

- dazu beigetragen,

- Unternehmen

- GUTE

- High-Level

- Hohe Leistungsfähigkeit

- ihm

- seine

- hält

- Ultraschall

- HTML

- http

- HTTPS

- human

- hunderte

- Login

- IEEE

- if

- zeigt

- Image

- Bildklassifizierung

- Bilder

- wirkt

- Implementierung

- zu unterstützen,

- verbessert

- verbessert

- in

- auf Lager

- Dazu gehören

- Einschließlich

- integrieren

- Steigert

- zunehmend

- angefallen

- Indien

- Energiegewinnung

- Information

- Infrastruktur

- wir innovieren

- Innovation

- Instanz

- integriert

- Integration

- in

- eingeführt

- Einleitung

- Probleme

- IT

- Artikel

- Iteration

- SEINE

- Reise

- jpg

- Behalten

- Aufbewahrung

- Wesentliche

- kumar

- grosse

- höchste

- neueste

- Lagen

- Führer

- führenden

- lernen

- geführt

- Legacy

- Bibliotheken

- Bibliothek

- Gefällt mir

- Lang

- lange Zeit

- verlieren

- Maschine

- Maschinelles Lernen

- Maschinen

- gemacht

- um

- Manager

- flächendeckende Gesundheitsprogramme

- manuell

- manuell

- Markt

- Memory

- Metrik

- Migration

- Million

- ML

- MLOps

- Modell

- für

- modern

- Überwachung

- Monat

- monatlich

- Monat

- mehr

- vor allem warme

- ziehen um

- viel

- mehrere

- nativen

- fast

- Need

- erforderlich

- Bedürfnisse

- Netzwerk

- Nerven-

- neuronale Netzwerk

- Neu

- neue Produkt

- neue Produkte

- weiter

- Knoten

- Fiber Node

- bemerkenswert

- Notizbuch

- Anzahl

- Objekt

- Ziel

- of

- bieten

- bieten

- vorgenommen,

- on

- Einsteigen

- EINEM

- Online

- einzige

- XNUMXh geöffnet

- Open-Source-

- betreiben

- die

- Betrieb

- Betriebs-

- Einkauf & Prozesse

- optimiert

- Optimierung

- or

- Organisationen

- Andere

- UNSERE

- übrig

- Gesamt-

- oben

- Überblick

- Frieden

- Papiere

- Parallel

- Parameter

- Partnerschaft

- passieren

- Patent

- Patente

- für

- Leistung

- physikalisch

- Stück

- Stücke

- Pilot

- Pipeline

- Plattform

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Points

- Perspektive

- Post

- Doktorand

- Werkzeuge

- Danach

- vorgeführt

- früher

- Principal

- Erlös

- Prozessdefinierung

- Produziert

- Produkt

- Produktinformationen

- Produktion

- Produkte

- Projekt

- versprochen

- die

- vorausgesetzt

- bietet

- Publikationen

- Kauf

- Pytorch

- Direkt

- Angebot

- Rangstufen

- Bewerten

- erreichen

- realisieren

- kürzlich

- Anerkennung

- empfohlen

- Veteran

- Reduziert

- reduziert

- Reduktion

- Region

- wiederholt

- antworten

- Reporting

- erfordert

- was zu

- Einzelhandel

- Rollen

- Führen Sie

- Laufen

- sagemaker

- gleich

- Samsung

- Speichern

- Skalieren

- Skalierung

- Wissenschaft

- Skript

- nahtlos

- gewürzt

- gesehen

- dient

- Lösungen

- kompensieren

- Sets

- Setup

- mehrere

- Shopping

- Schläge

- signifikant

- ähnlich

- Einfacher

- beträchtlich

- Größe

- klein

- Lösung

- Lösungen

- Auflösung

- Quelle

- Raumfahrt

- Spark

- Speaker

- Spezialist

- speziell

- Geschwindigkeit

- Feder

- begonnen

- Beginnen Sie

- Shritte

- Aufkleber

- -bestands-

- Lagerung

- speichern

- gelagert

- Läden

- rationalisieren

- stark

- Studio Adressen

- Abos aktualisiert

- Erfolgreich

- so

- System

- gemacht

- Team

- Teams

- Tech

- Techniken

- Technologies

- Test

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Dort.

- Diese

- vom Nutzer definierten

- basierte Online-to-Offline-Werbezuordnungen von anderen gab.

- fehlen uns die Worte.

- dachte

- Durch

- Durchsatz

- Zeit

- mal

- zu

- nahm

- Gesamt

- Städte

- traditionell

- Training

- Ausbildung

- privaten Transfer

- verwandelt

- versucht

- Melodie

- Abstimmung

- XNUMX

- Typen

- einzigartig

- Bereiche

- us

- -

- benutzt

- verwendet

- Verwendung von

- Bestätigung

- Vielfalt

- verschiedene

- sehr

- Anzeigen

- Seh-

- vs

- wollte

- will

- wurde

- Weg..

- we

- Netz

- Web-Services

- Wiegen

- Gewicht

- waren

- welche

- während

- ganze

- breit

- gewinnen

- mit

- .

- gearbeitet

- Arbeiter

- Arbeiter

- arbeiten,

- Werk

- Schreiben

- geschrieben

- Jahr

- Du

- Ihr

- Zephyrnet

- Zone