Dieser Beitrag wurde gemeinsam von Ramdev Wudali und Kiran Mantripragada von Thomson Reuters verfasst.

In 1992, Thomson Reuters (TR) veröffentlichte seinen ersten KI-Rechtsrecherchedienst, WIN (Westlaw Is Natural), eine Innovation zu dieser Zeit, da die meisten Suchmaschinen nur boolesche Begriffe und Konnektoren unterstützten. Seitdem hat TR viele weitere Meilensteine erreicht, da seine KI-Produkte und -Dienstleistungen in Anzahl und Vielfalt kontinuierlich wachsen und Rechts-, Steuer-, Buchhaltungs-, Compliance- und Nachrichtendienstfachleute weltweit unterstützen, wobei jedes Jahr Milliarden von Erkenntnissen aus maschinellem Lernen (ML) generiert werden .

Mit dieser enormen Zunahme von KI-Diensten bestand der nächste Meilenstein für TR darin, Innovationen zu rationalisieren und die Zusammenarbeit zu erleichtern. Standardisieren Sie den Aufbau und die Wiederverwendung von KI-Lösungen über Geschäftsfunktionen und die Personas von KI-Praktikern hinweg und stellen Sie gleichzeitig die Einhaltung der Best Practices des Unternehmens sicher:

- Automatisieren und standardisieren Sie den sich wiederholenden undifferenzierten Engineering-Aufwand

- Stellen Sie die erforderliche Isolierung und Kontrolle sensibler Daten gemäß gemeinsamen Governance-Standards sicher

- Bieten Sie einfachen Zugriff auf skalierbare Rechenressourcen

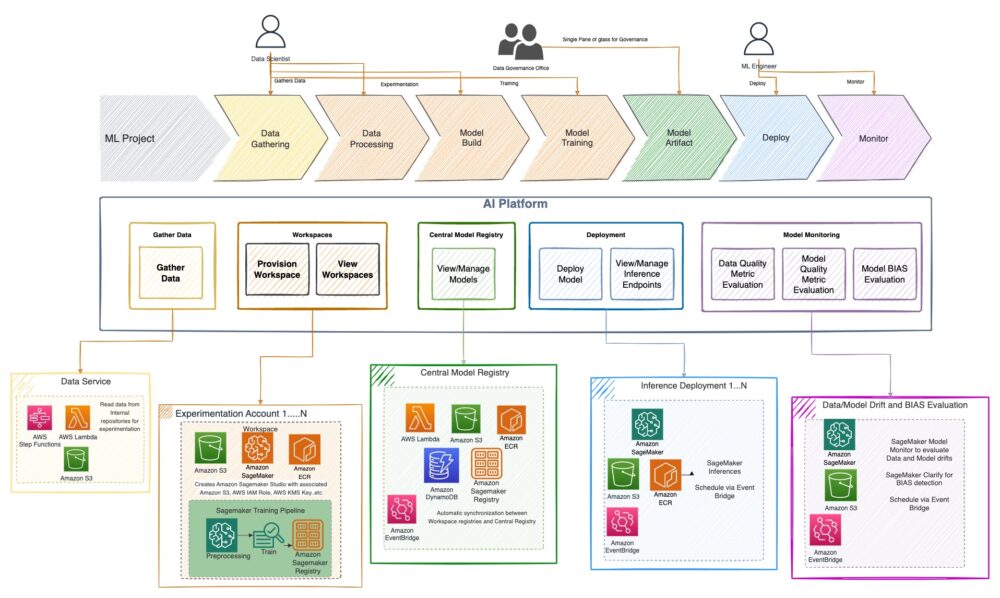

Um diese Anforderungen zu erfüllen, hat TR die Enterprise AI-Plattform um die folgenden fünf Säulen herum aufgebaut: einen Datendienst, einen Arbeitsbereich für Experimente, eine zentrale Modellregistrierung, einen Modellbereitstellungsdienst und eine Modellüberwachung.

In diesem Beitrag erörtern wir, wie TR und AWS zusammengearbeitet haben, um die allererste Unternehmens-KI-Plattform von TR zu entwickeln, ein webbasiertes Tool, das Funktionen von ML-Experimenten, Schulungen, einer zentralen Modellregistrierung, Modellbereitstellung und Modellüberwachung bietet. All diese Funktionen wurden entwickelt, um den sich ständig weiterentwickelnden Sicherheitsstandards von TR gerecht zu werden und Endbenutzern einfache, sichere und konforme Dienste bereitzustellen. Wir teilen auch, wie TR die Überwachung und Governance für ML-Modelle ermöglicht hat, die in verschiedenen Geschäftsbereichen mit einer einzigen Konsole erstellt wurden.

Die Herausforderungen

In der Vergangenheit war ML bei TR eine Fähigkeit für Teams mit fortgeschrittenen Datenwissenschaftlern und Ingenieuren. Teams mit hochqualifizierten Ressourcen waren in der Lage, komplexe ML-Prozesse gemäß ihren Anforderungen zu implementieren, wurden jedoch schnell sehr isoliert. Silo-Ansätze boten keine Transparenz, um extrem kritische Vorhersagen zur Entscheidungsfindung zu steuern.

TR-Geschäftsteams verfügen über umfassendes Domänenwissen; Die technischen Fähigkeiten und der hohe technische Aufwand, die für ML erforderlich sind, machen es jedoch schwierig, ihr tiefes Fachwissen zu nutzen, um Geschäftsprobleme mit der Leistungsfähigkeit von ML zu lösen. TR möchte die Fähigkeiten demokratisieren und sie mehr Menschen innerhalb der Organisation zugänglich machen.

Verschiedene Teams in TR folgen ihren eigenen Praktiken und Methoden. TR möchte die Fähigkeiten aufbauen, die sich über den gesamten ML-Lebenszyklus für ihre Benutzer erstrecken, um die Bereitstellung von ML-Projekten zu beschleunigen, indem es den Teams ermöglicht wird, sich auf die Geschäftsziele und nicht auf den sich wiederholenden undifferenzierten Entwicklungsaufwand zu konzentrieren.

Darüber hinaus entwickeln sich die Vorschriften zu Daten und ethischer KI weiter und erfordern gemeinsame Governance-Standards für alle KI-Lösungen von TR.

Lösungsüberblick

Die Enterprise AI Platform von TR sollte einfache und standardisierte Dienste für verschiedene Personen bereitstellen und Funktionen für jede Phase des ML-Lebenszyklus bieten. TR hat fünf Hauptkategorien identifiziert, die alle Anforderungen von TR modularisieren:

- Datendienst – Um einen einfachen und sicheren Zugriff auf Unternehmensdatenbestände zu ermöglichen

- Experimentierarbeitsplatz – Bereitstellung von Möglichkeiten zum Experimentieren und Trainieren von ML-Modellen

- Zentrale Modellregistrierung – Ein Unternehmenskatalog für Modelle, die in verschiedenen Geschäftsbereichen erstellt wurden

- Modellbereitstellungsdienst – Bereitstellung verschiedener Inferenzbereitstellungsoptionen gemäß den CI/CD-Unternehmenspraktiken von TR

- Modellüberwachungsdienste – Bereitstellung von Funktionen zur Überwachung von Daten und Modellabweichungen und Abweichungen

Wie im folgenden Diagramm dargestellt, werden diese Microservices unter Berücksichtigung einiger wichtiger Prinzipien erstellt:

- Entfernen Sie den undifferenzierten Engineering-Aufwand von Benutzern

- Stellen Sie die erforderlichen Funktionen auf Knopfdruck bereit

- Sichern und steuern Sie alle Funktionen gemäß den Unternehmensstandards von TR

- Bringen Sie eine einzige Glasscheibe für ML-Aktivitäten mit

Die Microservices der AI-Plattform von TR werden mit erstellt Amazon Sage Maker als Kern-Engine, serverlose AWS-Komponenten für Workflows und AWS DevOps-Services für CI/CD-Praktiken. SageMaker-Studio wird zum Experimentieren und Trainieren verwendet, und die SageMaker-Modellregistrierung wird zum Registrieren von Modellen verwendet. Die zentrale Modellregistrierung besteht aus der SageMaker-Modellregistrierung und einer Amazon DynamoDB Tabelle. SageMaker-Hosting-Dienste werden verwendet, um Modelle bereitzustellen, während SageMaker Modellmonitor und SageMaker klären werden verwendet, um Modelle auf Drift, Bias, benutzerdefinierte Metrikrechner und Erklärbarkeit zu überwachen.

In den folgenden Abschnitten werden diese Dienste im Detail beschrieben.

Datendienst

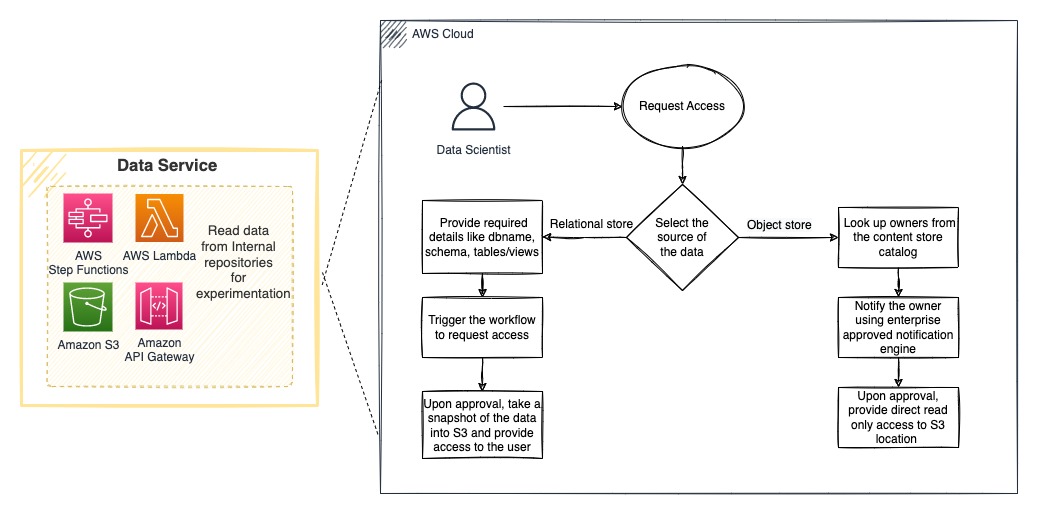

Ein traditioneller ML-Projektlebenszyklus beginnt mit der Suche nach Daten. Im Allgemeinen verbringen Data Scientists 60 % oder mehr ihrer Zeit damit, die richtigen Daten zu finden, wenn sie sie brauchen. Wie jedes Unternehmen verfügt TR über mehrere Datenspeicher, die als Single Point of Truth für verschiedene Datendomänen dienen. TR identifizierte zwei wichtige Unternehmensdatenspeicher, die Daten für die meisten ihrer ML-Anwendungsfälle bereitstellen: einen Objektspeicher und einen relationalen Datenspeicher. TR baute einen AI Platform-Datendienst auf, um einen nahtlosen Zugriff auf beide Datenspeicher von den Experimentierarbeitsbereichen der Benutzer bereitzustellen und den Benutzern die Last zu nehmen, komplexe Prozesse zu navigieren, um Daten selbst zu erfassen. Die KI-Plattform des TR befolgt alle vom Daten- und Modell-Governance-Team definierten Compliances und Best Practices. Dazu gehört eine obligatorische Datenfolgenabschätzung, die ML-Praktikern hilft, die ethische und angemessene Verwendung von Daten zu verstehen und zu befolgen, mit formellen Genehmigungsprozessen, um einen angemessenen Zugriff auf die Daten sicherzustellen. Der Kern dieses Dienstes sowie aller Plattformdienste ist die Sicherheit und Compliance gemäß den von TR und der Branche festgelegten Best Practices.

Amazon Simple Storage-Service (Amazon S3) Object Storage fungiert als Content Data Lake. TR baute Prozesse auf, um sicher auf Daten aus dem Content Data Lake zu den Experimentierarbeitsbereichen der Benutzer zuzugreifen und gleichzeitig die erforderliche Autorisierung und Überprüfbarkeit aufrechtzuerhalten. Snowflake wird als primärer relationaler Unternehmensdatenspeicher verwendet. Auf Benutzeranfrage und basierend auf der Genehmigung des Dateneigentümers stellt der AI Platform-Datendienst dem Benutzer eine Momentaufnahme der Daten bereit, die in seinem Experimentierarbeitsbereich bereitsteht.

Der Zugriff auf Daten aus verschiedenen Quellen ist ein technisches Problem, das leicht gelöst werden kann. Aber die Komplexität, die TR gelöst hat, besteht darin, Genehmigungsworkflows zu erstellen, die die Identifizierung des Dateneigentümers automatisieren, eine Zugriffsanforderung senden, sicherstellen, dass der Dateneigentümer benachrichtigt wird, dass er eine ausstehende Zugriffsanforderung hat, und basierend auf dem Genehmigungsstatus Maßnahmen ergreifen, um Daten bereitzustellen der Anforderer. Alle Ereignisse während dieses Prozesses werden nachverfolgt und protokolliert, um Auditierbarkeit und Compliance zu gewährleisten.

Wie im folgenden Diagramm gezeigt, verwendet TR AWS Step-Funktionen um den Workflow zu orchestrieren und AWS Lambda um die Funktionalität auszuführen. Amazon API-Gateway wird verwendet, um die Funktionalität mit einem API-Endpunkt bereitzustellen, der von ihrem Webportal genutzt werden soll.

Modellversuche und Entwicklung

Eine wesentliche Fähigkeit zur Standardisierung des ML-Lebenszyklus ist eine Umgebung, die es Datenwissenschaftlern ermöglicht, mit verschiedenen ML-Frameworks und Datengrößen zu experimentieren. Das Aktivieren einer solchen sicheren, konformen Umgebung in der Cloud innerhalb von Minuten entlastet Data Scientists von der Last, sich um die Cloud-Infrastruktur, Netzwerkanforderungen und Sicherheitsstandards zu kümmern, und sich stattdessen auf das Data-Science-Problem zu konzentrieren.

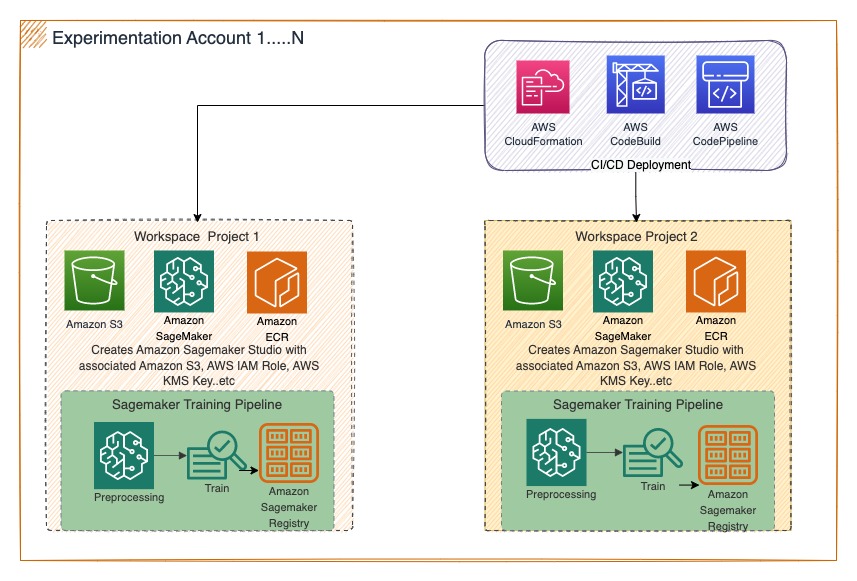

TR baut einen Experimentierarbeitsbereich auf, der Zugang zu Diensten wie z AWS-Kleber, Amazon EMR, und SageMaker Studio, um Datenverarbeitungs- und ML-Funktionen zu ermöglichen, die den Cloud-Sicherheitsstandards von Unternehmen und der erforderlichen Kontoisolation für jede Geschäftseinheit entsprechen. TR ist bei der Implementierung der Lösung auf die folgenden Herausforderungen gestoßen:

- Die Orchestrierung war zu Beginn nicht vollständig automatisiert und umfasste mehrere manuelle Schritte. Nachzuverfolgen, wo Probleme auftraten, war nicht einfach. TR überwand diesen Fehler, indem es die Arbeitsabläufe mithilfe von Step Functions orchestrierte. Mit der Verwendung von Step Functions wurde das Erstellen komplexer Workflows, das Verwalten von Zuständen und die Fehlerbehandlung viel einfacher.

- Proper AWS Identity and Access Management and (IAM) Rollendefinition für den Experimentierarbeitsbereich war schwer zu definieren. Um den internen Sicherheitsstandards und dem Least-Privilege-Modell von TR zu entsprechen, wurde die Workspace-Rolle ursprünglich mit Inline-Richtlinien definiert. Folglich wuchs die Inline-Richtlinie mit der Zeit und wurde ausführlich, wodurch die für die IAM-Rolle zulässige Richtliniengrößenbeschränkung überschritten wurde. Um dies abzumildern, wechselte TR dazu, mehr vom Kunden verwaltete Richtlinien zu verwenden und diese in der Workspace-Rollendefinition zu referenzieren.

- TR hat gelegentlich die auf AWS-Kontoebene angewendeten Standardressourcenlimits erreicht. Dies führte gelegentlich zu Fehlern beim Starten von SageMaker-Jobs (z. B. Trainingsjobs), da das gewünschte Ressourcentyplimit erreicht war. TR arbeitete bei diesem Problem eng mit dem SageMaker-Serviceteam zusammen. Dieses Problem wurde gelöst, nachdem das AWS-Team SageMaker als unterstützten Dienst in eingeführt hatte Servicekontingente im Juni 2022.

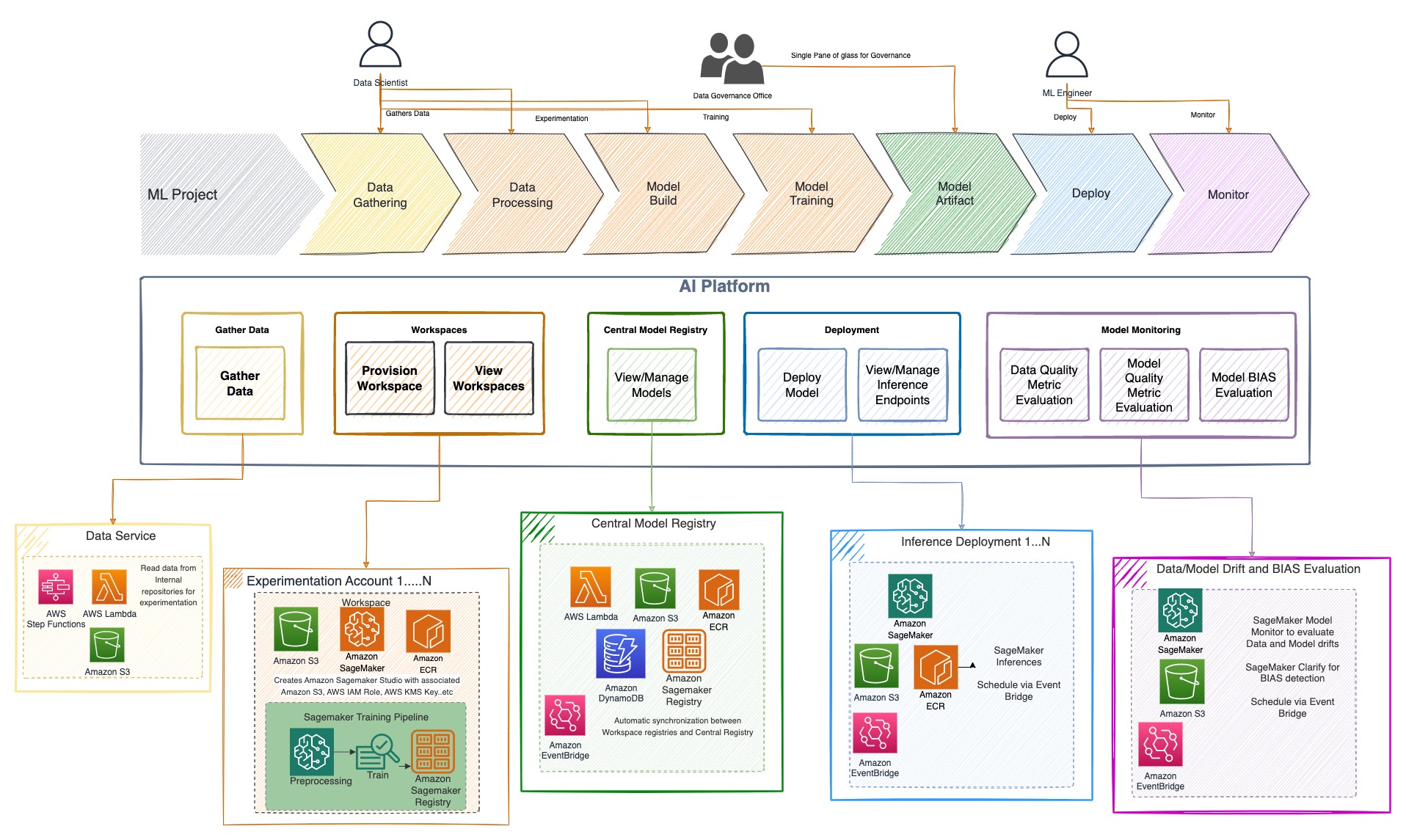

Heute können Datenwissenschaftler bei TR ein ML-Projekt starten, indem sie einen unabhängigen Arbeitsbereich erstellen und die erforderlichen Teammitglieder für die Zusammenarbeit hinzufügen. Die unbegrenzte Skalierbarkeit von SageMaker steht ihnen zur Verfügung, indem sie ihnen benutzerdefinierte Kernel-Images mit unterschiedlichen Größen zur Verfügung stellen. SageMaker Studio wurde schnell zu einer entscheidenden Komponente in der KI-Plattform von TR und hat das Benutzerverhalten von der Verwendung eingeschränkter Desktop-Anwendungen zu skalierbaren und kurzlebigen, speziell entwickelten Engines geändert. Das folgende Diagramm veranschaulicht diese Architektur.

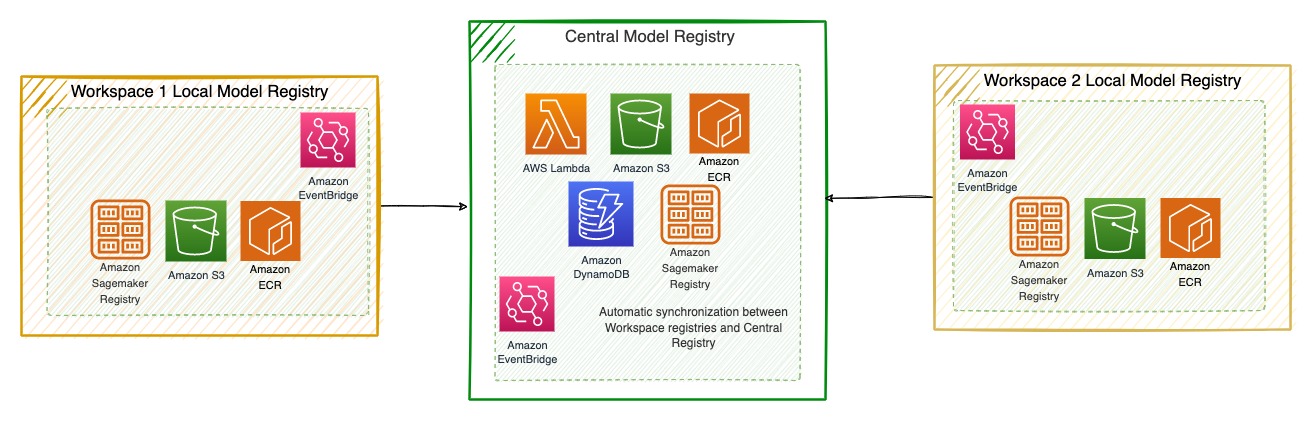

Zentrale Modellregistrierung

Die Modellregistrierung bietet ein zentrales Repository für alle maschinellen Lernmodelle von TR, ermöglicht ein standardisiertes Risiko- und Gesundheitsmanagement für diese Modelle über alle Geschäftsfunktionen hinweg und optimiert die Wiederverwendung potenzieller Modelle. Daher musste der Dienst Folgendes tun:

- Bieten Sie die Möglichkeit, sowohl neue als auch ältere Modelle zu registrieren, unabhängig davon, ob sie innerhalb oder außerhalb von SageMaker entwickelt wurden

- Implementieren Sie Governance-Workflows, die es Data Scientists, Entwicklern und Stakeholdern ermöglichen, den Lebenszyklus von Modellen anzuzeigen und gemeinsam zu verwalten

- Erhöhen Sie die Transparenz und Zusammenarbeit, indem Sie neben Metadaten und Gesundheitsmetriken eine zentralisierte Ansicht aller Modelle in TR erstellen

TR begann das Design nur mit der SageMaker-Modellregistrierung, aber eine der wichtigsten Anforderungen von TR ist die Bereitstellung der Möglichkeit, Modelle zu registrieren, die außerhalb von SageMaker erstellt wurden. TR evaluierte verschiedene relationale Datenbanken, entschied sich aber schließlich für DynamoDB, da das Metadatenschema für Modelle aus Legacy-Quellen sehr unterschiedlich sein wird. TR wollte den Benutzern auch keine zusätzliche Arbeit auferlegen und implementierte daher eine nahtlose automatische Synchronisierung zwischen den SageMaker-Registrys des AI Platform-Arbeitsbereichs und der zentralen SageMaker-Registry Amazon EventBridge Regeln und erforderliche IAM-Rollen. TR hat die zentrale Registry mit DynamoDB erweitert, um die Möglichkeiten zur Registrierung von Legacy-Modellen zu erweitern, die auf den Desktops der Benutzer erstellt wurden.

Die zentrale AI Platform-Modellregistrierung von TR ist in das AI Platform-Portal integriert und bietet eine visuelle Schnittstelle zum Suchen von Modellen, Aktualisieren von Modellmetadaten und zum Verstehen von Modell-Baseline-Metriken und periodischen benutzerdefinierten Überwachungsmetriken. Das folgende Diagramm veranschaulicht diese Architektur.

Modellbereitstellung

TR identifizierte zwei Hauptmuster zur Automatisierung der Bereitstellung:

- Modelle, die mit SageMaker über SageMaker-Batch-Transformationsaufträge entwickelt wurden, um Rückschlüsse nach einem bevorzugten Zeitplan zu erhalten

- Modelle, die außerhalb von SageMaker auf lokalen Desktops unter Verwendung von Open-Source-Bibliotheken entwickelt wurden, durch den Bring-Your-Own-Container-Ansatz unter Verwendung von SageMaker-Verarbeitungsaufträgen zum Ausführen von benutzerdefiniertem Inferenzcode als effiziente Möglichkeit, diese Modelle ohne Refactoring des Codes zu migrieren

Mit dem AI Platform-Bereitstellungsservice können TR-Benutzer (Datenwissenschaftler und ML-Ingenieure) ein Modell aus dem Katalog identifizieren und einen Inferenzjob in ihrem ausgewählten AWS-Konto bereitstellen, indem sie die erforderlichen Parameter über einen UI-gesteuerten Workflow bereitstellen.

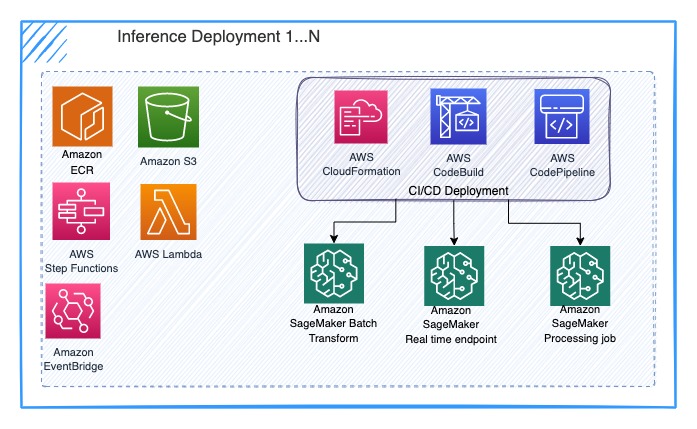

TR automatisierte diese Bereitstellung mit AWS DevOps-Diensten wie AWS CodePipeline und AWS CodeBuild. TR verwendet Step Functions, um den Workflow des Lesens und Vorverarbeitens von Daten zum Erstellen von SageMaker-Inferenzaufträgen zu orchestrieren. TR stellt die erforderlichen Komponenten mithilfe von Code als Code bereit AWS CloudFormation Vorlagen. Das folgende Diagramm veranschaulicht diese Architektur.

Modellüberwachung

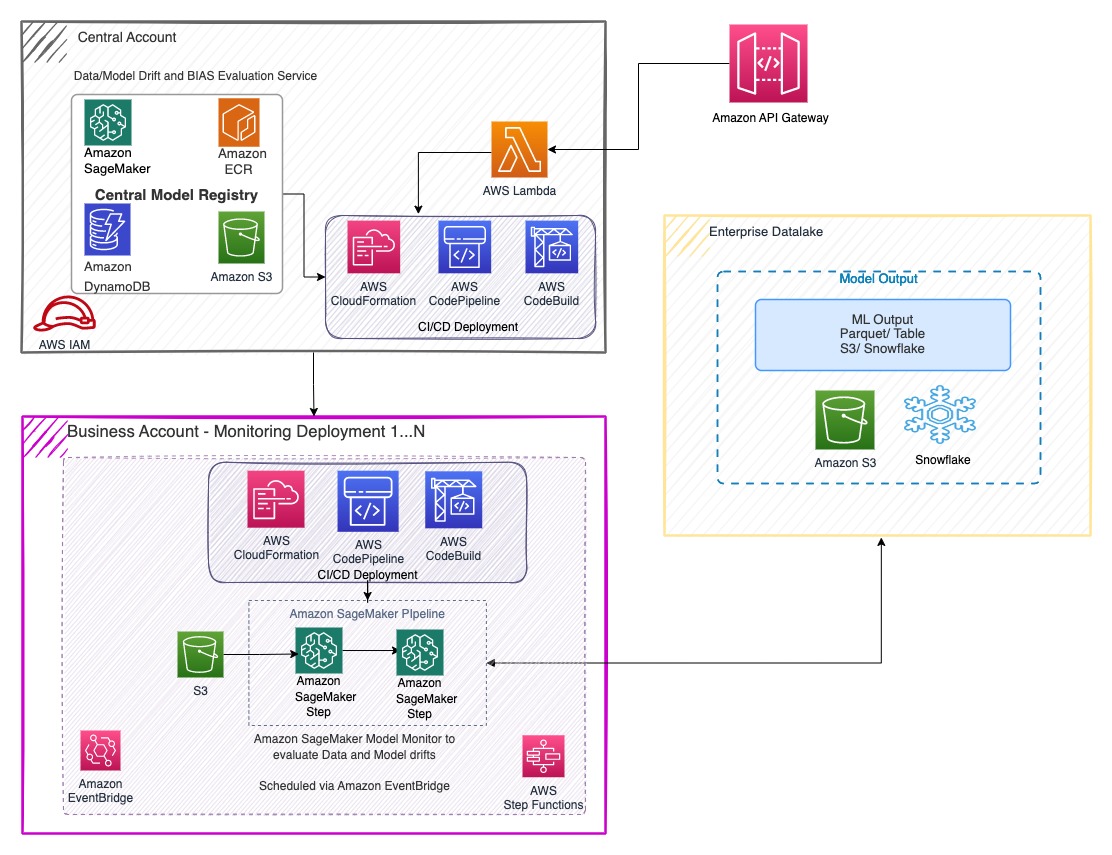

Der ML-Lebenszyklus ist nicht vollständig, ohne Modelle überwachen zu können. Das Enterprise-Governance-Team von TR beauftragt und ermutigt auch Geschäftsteams, ihre Modellleistung im Laufe der Zeit zu überwachen, um alle regulatorischen Herausforderungen anzugehen. TR begann mit der Überwachung von Modellen und Driftdaten. TR verwendete SageMaker Model Monitor, um eine Datenbankbasis und Inferenzgrundwahrheit bereitzustellen, um regelmäßig zu überwachen, wie sich die Daten und Inferenzen von TR verändern. Zusammen mit SageMaker-Modellüberwachungsmetriken verbesserte TR die Überwachungsfunktion durch die Entwicklung benutzerdefinierter Metriken speziell für ihre Modelle. Dies hilft den Datenwissenschaftlern von TR zu verstehen, wann sie ihr Modell neu trainieren müssen.

Neben der Driftüberwachung möchte TR auch die Verzerrung in den Modellen verstehen. Die sofort einsatzbereiten Funktionen von SageMaker Clarify werden verwendet, um den Bias-Service von TR aufzubauen. TR überwacht sowohl Daten- als auch Modellabweichungen und stellt diese Metriken seinen Benutzern über das AI Platform-Portal zur Verfügung.

Um allen Teams bei der Übernahme dieser Unternehmensstandards zu helfen, hat TR diese Dienste unabhängig und über das AI Platform-Portal leicht verfügbar gemacht. Die Geschäftsteams von TR können in das Portal gehen und selbst einen Modellüberwachungsjob oder Bias-Überwachungsjob bereitstellen und sie nach ihrem bevorzugten Zeitplan ausführen. Sie werden über den Status des Jobs und die Metriken für jede Ausführung benachrichtigt.

TR verwendete AWS-Services für die CI/CD-Bereitstellung, Workflow-Orchestrierung, serverlose Frameworks und API-Endpunkte, um Microservices zu erstellen, die unabhängig ausgelöst werden können, wie in der folgenden Architektur gezeigt.

Ergebnisse und zukünftige Verbesserungen

Die KI-Plattform von TR ging im dritten Quartal 3 mit allen fünf Hauptkomponenten in Betrieb: einem Datendienst, einem Arbeitsbereich für Experimente, einer zentralen Modellregistrierung, einer Modellbereitstellung und einer Modellüberwachung. TR führte interne Schulungen für seine Geschäftsbereiche durch, um die Plattform zu integrieren, und bot ihnen selbstgesteuerte Schulungsvideos an.

Die KI-Plattform hat den Teams von TR Funktionen zur Verfügung gestellt, die noch nie zuvor existierten; Es hat dem Enterprise-Governance-Team von TR eine Vielzahl von Möglichkeiten eröffnet, um die Compliance-Standards zu verbessern und das Register zu zentralisieren, wodurch eine zentrale Ansicht aller ML-Modelle innerhalb von TR bereitgestellt wird.

TR erkennt an, dass kein Produkt bei der Erstveröffentlichung am besten ist. Alle Komponenten von TR befinden sich auf unterschiedlichen Reifegraden, und das Team der Enterprise AI Platform von TR befindet sich in einer kontinuierlichen Verbesserungsphase, um die Produktfunktionen iterativ zu verbessern. Die aktuelle Entwicklungspipeline von TR umfasst das Hinzufügen zusätzlicher SageMaker-Inferenzoptionen wie Echtzeit-, asynchrone und Multi-Modell-Endpunkte. TR plant außerdem, Modellerklärbarkeit als Funktion zu seinem Modellüberwachungsdienst hinzuzufügen. TR plant, die Erklärbarkeitsfunktionen von SageMaker Clarify zu nutzen, um seinen internen Erklärbarkeitsdienst zu entwickeln.

Zusammenfassung

TR kann jetzt riesige Datenmengen sicher verarbeiten und erweiterte AWS-Funktionen nutzen, um ein ML-Projekt innerhalb von Wochen von der Idee bis zur Produktion zu führen, im Vergleich zu den Monaten, die es zuvor dauerte. Mit den sofort einsatzbereiten Funktionen von AWS-Services können Teams innerhalb von TR zum ersten Mal überhaupt ML-Modelle registrieren und überwachen und so die Einhaltung ihrer sich entwickelnden Modell-Governance-Standards erreichen. TR befähigte Datenwissenschaftler und Produktteams, ihre Kreativität effektiv zu entfalten, um die komplexesten Probleme zu lösen.

Um mehr über die Enterprise AI Platform von TR auf AWS zu erfahren, besuchen Sie die AWS re:Invent 2022-Sitzung. Wenn Sie erfahren möchten, wie TR den Einsatz von maschinellem Lernen mit dem beschleunigt hat AWS-Datenlabor Programm finden Sie unter Fallstudie.

Über die Autoren

Ramdev Wudali ist ein Datenarchitekt, der beim Entwurf und Aufbau der KI/ML-Plattform hilft, damit Datenwissenschaftler und Forscher Lösungen für maschinelles Lernen entwickeln können, indem sie sich auf die Datenwissenschaft und nicht auf die Infrastrukturanforderungen konzentrieren. In seiner Freizeit liebt er es, Papier zu falten, um Origami-Tessellationen zu erstellen, und trägt respektlose T-Shirts.

Ramdev Wudali ist ein Datenarchitekt, der beim Entwurf und Aufbau der KI/ML-Plattform hilft, damit Datenwissenschaftler und Forscher Lösungen für maschinelles Lernen entwickeln können, indem sie sich auf die Datenwissenschaft und nicht auf die Infrastrukturanforderungen konzentrieren. In seiner Freizeit liebt er es, Papier zu falten, um Origami-Tessellationen zu erstellen, und trägt respektlose T-Shirts.

Kiran Mantripragada ist Senior Director der AI-Plattform bei Thomson Reuters. Das AI Platform-Team ist dafür verantwortlich, KI-Softwareanwendungen in Produktionsqualität zu ermöglichen und die Arbeit von Datenwissenschaftlern und Forschern für maschinelles Lernen zu ermöglichen. Mit einer Leidenschaft für Wissenschaft, KI und Technik überbrückt Kiran gerne die Lücke zwischen Forschung und Produktion, um die wirkliche Innovation der KI den Endverbrauchern näher zu bringen.

Kiran Mantripragada ist Senior Director der AI-Plattform bei Thomson Reuters. Das AI Platform-Team ist dafür verantwortlich, KI-Softwareanwendungen in Produktionsqualität zu ermöglichen und die Arbeit von Datenwissenschaftlern und Forschern für maschinelles Lernen zu ermöglichen. Mit einer Leidenschaft für Wissenschaft, KI und Technik überbrückt Kiran gerne die Lücke zwischen Forschung und Produktion, um die wirkliche Innovation der KI den Endverbrauchern näher zu bringen.

Bhavana Chirumamilla ist Senior Resident Architect bei AWS. Sie hat eine Leidenschaft für Daten- und ML-Operationen und bringt viel Enthusiasmus mit, um Unternehmen beim Aufbau von Daten- und ML-Strategien zu unterstützen. In ihrer Freizeit verbringt sie gerne Zeit mit ihrer Familie auf Reisen, beim Wandern, im Garten und beim Anschauen von Dokumentationen.

Bhavana Chirumamilla ist Senior Resident Architect bei AWS. Sie hat eine Leidenschaft für Daten- und ML-Operationen und bringt viel Enthusiasmus mit, um Unternehmen beim Aufbau von Daten- und ML-Strategien zu unterstützen. In ihrer Freizeit verbringt sie gerne Zeit mit ihrer Familie auf Reisen, beim Wandern, im Garten und beim Anschauen von Dokumentationen.

Srinivasa Shaik ist ein Lösungsarchitekt bei AWS mit Sitz in Boston. Er hilft Unternehmenskunden, ihren Weg in die Cloud zu beschleunigen. Er interessiert sich leidenschaftlich für Container und maschinelle Lerntechnologien. In seiner Freizeit verbringt er gerne Zeit mit seiner Familie, kocht und reist.

Srinivasa Shaik ist ein Lösungsarchitekt bei AWS mit Sitz in Boston. Er hilft Unternehmenskunden, ihren Weg in die Cloud zu beschleunigen. Er interessiert sich leidenschaftlich für Container und maschinelle Lerntechnologien. In seiner Freizeit verbringt er gerne Zeit mit seiner Familie, kocht und reist.

Qingwei Li ist Spezialist für maschinelles Lernen bei Amazon Web Services. Er promovierte in Operations Research, nachdem er das Konto seines Beraters für Forschungsstipendien aufgelöst und den versprochenen Nobelpreis nicht erhalten hatte. Derzeit unterstützt er Kunden in der Finanzdienstleistungs- und Versicherungsbranche beim Aufbau von Lösungen für maschinelles Lernen auf AWS. In seiner Freizeit liest und unterrichtet er gerne.

Qingwei Li ist Spezialist für maschinelles Lernen bei Amazon Web Services. Er promovierte in Operations Research, nachdem er das Konto seines Beraters für Forschungsstipendien aufgelöst und den versprochenen Nobelpreis nicht erhalten hatte. Derzeit unterstützt er Kunden in der Finanzdienstleistungs- und Versicherungsbranche beim Aufbau von Lösungen für maschinelles Lernen auf AWS. In seiner Freizeit liest und unterrichtet er gerne.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/how-thomson-reuters-built-an-ai-platform-using-amazon-sagemaker-to-accelerate-delivery-of-ml-projects/

- 100

- 2022

- 7

- a

- Fähig

- Über Uns

- beschleunigen

- beschleunigt

- Zugang

- zugänglich

- Nach

- Konto

- Buchhaltung

- erreicht

- Erreichen

- erwerben

- über

- Action

- Handlungen

- Zusätzliche

- Adresse

- adoptieren

- advanced

- Nach der

- AI

- KI-Plattform

- KI-Dienste

- AI / ML

- Alle

- erlaubt

- neben

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Beträge

- und

- Bienen

- Anwendungen

- angewandt

- Ansatz

- Ansätze

- Genehmigung

- Architektur

- um

- Genehmigung

- automatisieren

- Automatisiert

- automatische

- verfügbar

- AWS

- basierend

- Baseline

- weil

- Bevor

- Sein

- BESTE

- Best Practices

- zwischen

- vorspannen

- Milliarden

- Boston

- BRIDGE

- bringen

- Brings

- Pleite

- bauen

- Building

- baut

- erbaut

- Last

- Geschäft

- Geschäftsfunktionen

- Fähigkeiten

- Fälle

- Katalog

- Kategorien

- verursacht

- Hauptgeschäftsstelle

- zentralisierte

- Herausforderungen

- aus der Ferne überprüfen

- Auswahl

- gewählt

- eng

- Cloud

- Cloud-Infrastruktur

- Cloud-Sicherheit

- Code

- zusammenarbeiten

- arbeitete zusammen

- Zusammenarbeit

- gemeinsam

- Kommen

- gemeinsam

- verglichen

- abschließen

- Komplex

- Komplexität

- Compliance

- konform

- Komponente

- Komponenten

- Bestehend

- Computing

- verbraucht

- KUNDEN

- Container

- Behälter

- Inhalt

- fortsetzen

- kontinuierlich

- Smartgeräte App

- Kernbereich

- erstellen

- erstellt

- Erstellen

- Kreativität

- kritischem

- wichtig

- Strom

- Zur Zeit

- Original

- Kunden

- technische Daten

- Datensee

- Datenverarbeitung

- Datenwissenschaft

- Datenbanken

- Decision Making

- tief

- tiefes Fachwissen

- Standard

- Übergeben

- Lieferanten

- demokratisieren

- einsetzen

- Einsatz

- setzt ein

- beschreiben

- Design

- Desktop

- Detail

- entschlossen

- entwickeln

- entwickelt

- Entwickler

- Entwicklung

- Entwicklung

- anders

- schwer

- Direktor

- diskutieren

- Dokumentationen

- Domain

- Domains

- nach unten

- Früh

- einfacher

- leicht

- effektiv

- effizient

- Anstrengung

- ermächtigt

- ermöglichen

- freigegeben

- ermöglicht

- ermöglichen

- ermutigt

- Endpunkt

- Motor

- Entwicklung

- Ingenieure

- Motor (en)

- verbesserte

- gewährleisten

- Gewährleistung

- Unternehmen

- Unternehmen

- Begeisterung

- Arbeitsumfeld

- Fehler

- essential

- ethisch

- Bewerten

- Veranstaltungen

- ÜBERHAUPT

- entwickelt sich

- sich entwickelnden

- Beispiel

- Experiment

- Expertise

- erweitern

- äußerst

- erleichtern

- Gescheitert

- Familie

- Merkmal

- Eigenschaften

- wenige

- Finale

- Revolution

- Finanzdienstleistung

- Finden Sie

- Suche nach

- Vorname

- erstes Mal

- Setzen Sie mit Achtsamkeit

- Fokussierung

- folgen

- Folgende

- folgt

- formal

- Gerüste

- für

- Erfüllen

- voll

- Funktionalität

- Funktionen

- Zukunft

- Lücke

- Allgemeines

- erzeugt

- bekommen

- Glas

- Go

- Ziele

- Governance

- gewähren

- Boden

- persönlichem Wachstum

- Handling

- hart

- Gesundheit

- Hilfe

- Unternehmen

- hilft

- hoch

- Hosting

- Ultraschall

- aber

- HTML

- HTTPS

- identifiziert

- identifizieren

- Identifizierung

- Identitätsschutz

- Bilder

- Impact der HXNUMXO Observatorien

- implementieren

- umgesetzt

- Umsetzung

- auferlegte

- zu unterstützen,

- in

- Dazu gehören

- Erhöhung

- unabhängig

- unabhängig

- Energiegewinnung

- Infrastruktur

- Anfangs-

- Innovation

- Einblicke

- beantragen müssen

- Versicherung

- integriert

- Schnittstelle

- intern

- beteiligt

- Isolierung

- Problem

- IT

- Job

- Jobs

- Reise

- Wesentliche

- Wissen

- Wissen

- See

- starten

- ins Leben gerufen

- Start

- LERNEN

- lernen

- Legacy

- Rechtlich

- Niveau

- Cholesterinspiegel

- Bibliotheken

- LIMIT

- Grenzen

- leben

- aus einer regionalen

- Maschine

- Maschinelles Lernen

- gemacht

- Dur

- MACHT

- Making

- verwalten

- Management

- flächendeckende Gesundheitsprogramme

- Mandate

- Weise

- manuell

- viele

- Reife

- Maßnahmen

- Mitglieder

- Metadaten

- Methodologien

- Metrisch

- Metrik

- Microservices

- migriert

- Meilenstein

- Meilensteine

- Geist / Bewusstsein

- Minuten

- Mildern

- ML

- Modell

- für

- Überwachen

- Überwachung

- Monitore

- Monat

- mehr

- vor allem warme

- mehrere

- Natürliche

- Navigieren

- Need

- Bedürfnisse

- Vernetzung

- Neu

- News

- weiter

- nobel outlet

- Anzahl

- Objekt

- gelegentlich

- angeboten

- bieten

- Angebote

- Onboard

- EINEM

- Open-Source-

- geöffnet

- Einkauf & Prozesse

- Optionen

- Orchesterbearbeitung

- Organisation

- ursprünglich

- aussen

- besitzen

- Eigentümer

- Brot

- Papier

- Parameter

- Leidenschaft & KREATIVITÄT

- leidenschaftlich

- Muster

- Personen

- Leistung

- periodisch

- Phase

- Pipeline

- Planung

- Pläne

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- Points

- Politik durchzulesen

- Datenschutzrichtlinien

- Portal

- Möglichkeiten

- Post

- Potenzial

- Werkzeuge

- Praktiken

- Prognosen

- bevorzugt

- primär

- Grundsätze

- Preis

- Aufgabenstellung:

- Probleme

- Prozessdefinierung

- anpassen

- Verarbeitung

- Produkt

- Produktion

- Produkte

- Profis

- Programm

- Projekt

- Projekte

- versprochen

- die

- vorausgesetzt

- bietet

- Bereitstellung

- Q3

- q3 2022

- schnell

- Angebot

- Bereich

- RE

- erreicht

- Lesebrillen

- echt

- Echtzeit

- Received

- Registrieren

- Registratur

- Vorschriften

- Regulierungsbehörden

- Release

- freigegeben

- entfernen

- Quelle

- Anforderung

- falls angefordert

- Voraussetzungen:

- Forschungsprojekte

- Forscher

- Ressourcen

- Downloads

- für ihren Verlust verantwortlich.

- Reuters

- Risiko

- Rollen

- Rollen

- Ohne eine erfahrene Medienplanung zur Festlegung von Regeln und Strategien beschleunigt der programmatische Medieneinkauf einfach die Rate der verschwenderischen Ausgaben.

- Führen Sie

- sagemaker

- SageMaker-Inferenz

- skalierbaren

- Skalieren

- Zeitplan

- Wissenschaft

- Wissenschaftler

- nahtlos

- nahtlos

- Suche

- Suchmaschinen

- Abschnitte

- Verbindung

- Gesicherte

- sicher

- Sicherheitdienst

- Sendung

- Senior

- empfindlich

- brauchen

- Serverlos

- Lösungen

- Sessions

- mehrere

- Teilen

- gezeigt

- Einfacher

- da

- Single

- Größe

- Größen

- erfahren

- Fähigkeiten

- Schnappschuss

- So

- Software

- Lösung

- Lösungen

- LÖSEN

- Quellen

- Spezialist

- spezifisch

- verbringen

- Ausgabe

- Stufe

- Stakeholder

- Standardisierung

- Normen

- begonnen

- beginnt

- Staaten

- Status

- Schritt

- Shritte

- Lagerung

- speichern

- Läden

- Strategien

- rationalisieren

- Studio Adressen

- so

- Unterstützte

- Unterstützung

- schaltet

- Synchronisation

- Tabelle

- Nehmen

- Steuer

- Einführungen

- Team

- Teams

- Technische

- technische Fähigkeiten

- Technologies

- Vorlagen

- AGB

- Das

- ihr

- deswegen

- Thomson Reuters

- Durch

- während

- Zeit

- zu

- Werkzeug

- Tracking

- traditionell

- Training

- Ausbildung

- Transformieren

- Transparenz

- Reise

- enorm

- ausgelöst

- verstehen

- Einheit

- Bereiche

- entfesseln

- unbegrenzt

- Aktualisierung

- -

- Mitglied

- Nutzer

- Vielfalt

- verschiedene

- riesig

- Videos

- Anzeigen

- Sichtbarkeit

- beobachten

- Netz

- Web-Services

- Webbasiert

- Wochen

- ob

- während

- breit

- Große Auswahl

- werden wir

- gewinnen

- .

- ohne

- Arbeiten

- gearbeitet

- Workflows

- Das weltweit

- würde

- Jahr

- Ihr

- Zephyrnet