Dieser Beitrag wurde gemeinsam mit Daniele Chiappalupi, Teilnehmer des AWS-Studenten-Hackathon-Teams an der ETH Zürich, verfasst.

Jeder kann problemlos mit maschinellem Lernen (ML) beginnen Amazon SageMaker-JumpStart. In diesem Beitrag zeigen wir Ihnen, wie ein Hackathon-Team einer Universität SageMaker JumpStart nutzte, um schnell eine Anwendung zu erstellen, die Benutzern hilft, Vorurteile zu erkennen und zu beseitigen.

„Amazon SageMaker war maßgeblich an unserem Projekt beteiligt. Es erleichterte die Bereitstellung und Verwaltung einer vorab trainierten Flan-Instanz und bot uns eine solide Grundlage für unsere Anwendung. Die automatische Skalierungsfunktion erwies sich in Zeiten mit hohem Datenverkehr als entscheidend und stellte sicher, dass unsere App reaktionsfähig blieb und die Benutzer eine stetige und schnelle Bias-Analyse erhielten. Indem wir die schwere Aufgabe der Abfrage des Flan-Modells auf einen verwalteten Dienst verlagern konnten, konnten wir unsere Anwendung außerdem leichtgewichtig und schnell halten und so die Benutzererfahrung auf verschiedenen Geräten verbessern. Dank der Funktionen von SageMaker konnten wir unsere Zeit beim Hackathon optimal nutzen, sodass wir uns auf die Optimierung unserer Eingabeaufforderungen und Apps konzentrieren konnten, statt uns um die Verwaltung der Leistung und Infrastruktur des Modells zu kümmern.“

– Daniele Chiappalupi, Teilnehmer des AWS-Studenten-Hackathon-Teams an der ETH Zürich.

Lösungsüberblick

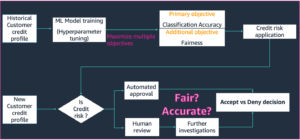

Das Thema des Hackathons besteht darin, mit KI-Technologie einen Beitrag zu den nachhaltigen Zielen der UN zu leisten. Wie in der folgenden Abbildung dargestellt, trägt die beim Hackathon erstellte Anwendung zu drei der Ziele für nachhaltige Entwicklung bei (hochwertige Bildung, gezielte Bekämpfung geschlechtsspezifischer Diskriminierung und Verringerung von Ungleichheiten), indem sie Benutzern dabei hilft, Vorurteile aus ihren Texten zu erkennen und zu entfernen, um faire Inhalte zu fördern und inklusive Sprache.

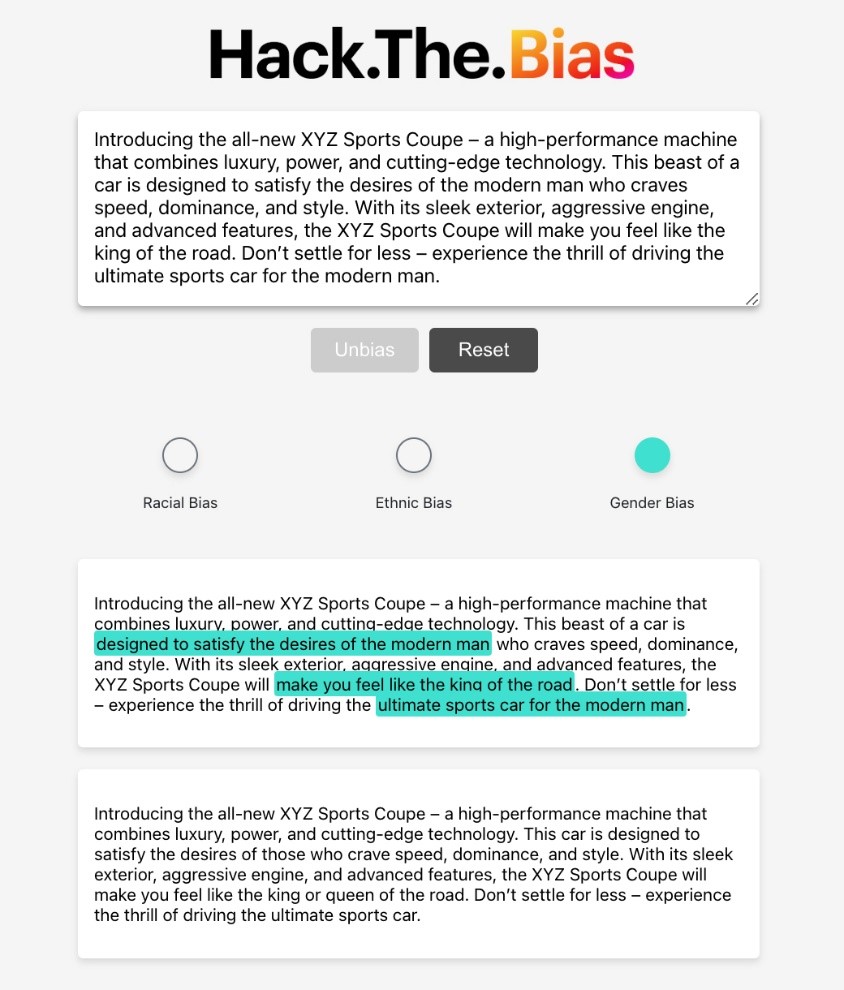

Wie im folgenden Screenshot gezeigt, generiert die Anwendung nach der Eingabe des Textes eine neue Version, die frei von rassischen, ethnischen und geschlechtsspezifischen Vorurteilen ist. Darüber hinaus werden die spezifischen Teile Ihres Eingabetextes hervorgehoben, die sich auf die jeweilige Voreingenommenheitskategorie beziehen.

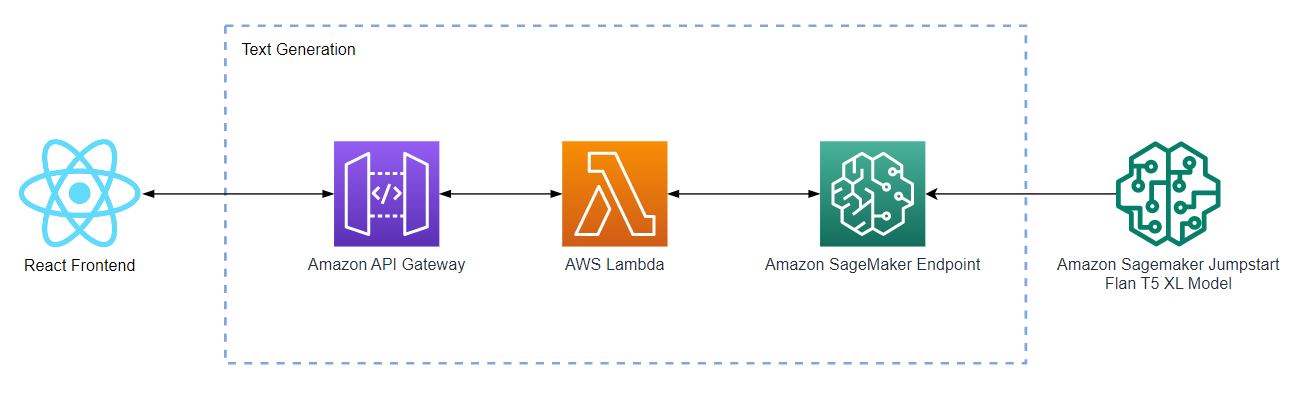

In der im folgenden Diagramm gezeigten Architektur geben Benutzer Text in das ein Reagieren-basierte Web-App, die auslöst Amazon API-Gateway, was wiederum ein aufruft AWS Lambda Funktion abhängig von der Voreingenommenheit im Benutzertext. Die Lambda-Funktion ruft den Flan-Modellendpunkt in SageMaker JumpStart auf, der das unverzerrte Textergebnis über denselben Weg zurück an die Front-End-Anwendung zurückgibt.

Anwendungsentwicklungsprozess

Der Entwicklungsprozess dieser Anwendung war iterativ und konzentrierte sich auf zwei Hauptbereiche: Benutzeroberfläche und ML-Modellintegration.

Wir haben uns für React für die Frontend-Entwicklung aufgrund seiner Flexibilität, Skalierbarkeit und leistungsstarken Tools zur Erstellung interaktiver Benutzeroberflächen entschieden. Angesichts der Art unserer Anwendung – Benutzereingaben verarbeiten und verfeinerte Ergebnisse präsentieren – erwies sich die komponentenbasierte Architektur von React als ideal. Mit React konnten wir effizient eine Single-Page-Anwendung erstellen, die es Benutzern ermöglichte, Text einzureichen und unvoreingenommene Ergebnisse anzuzeigen, ohne dass ständige Seitenaktualisierungen erforderlich waren.

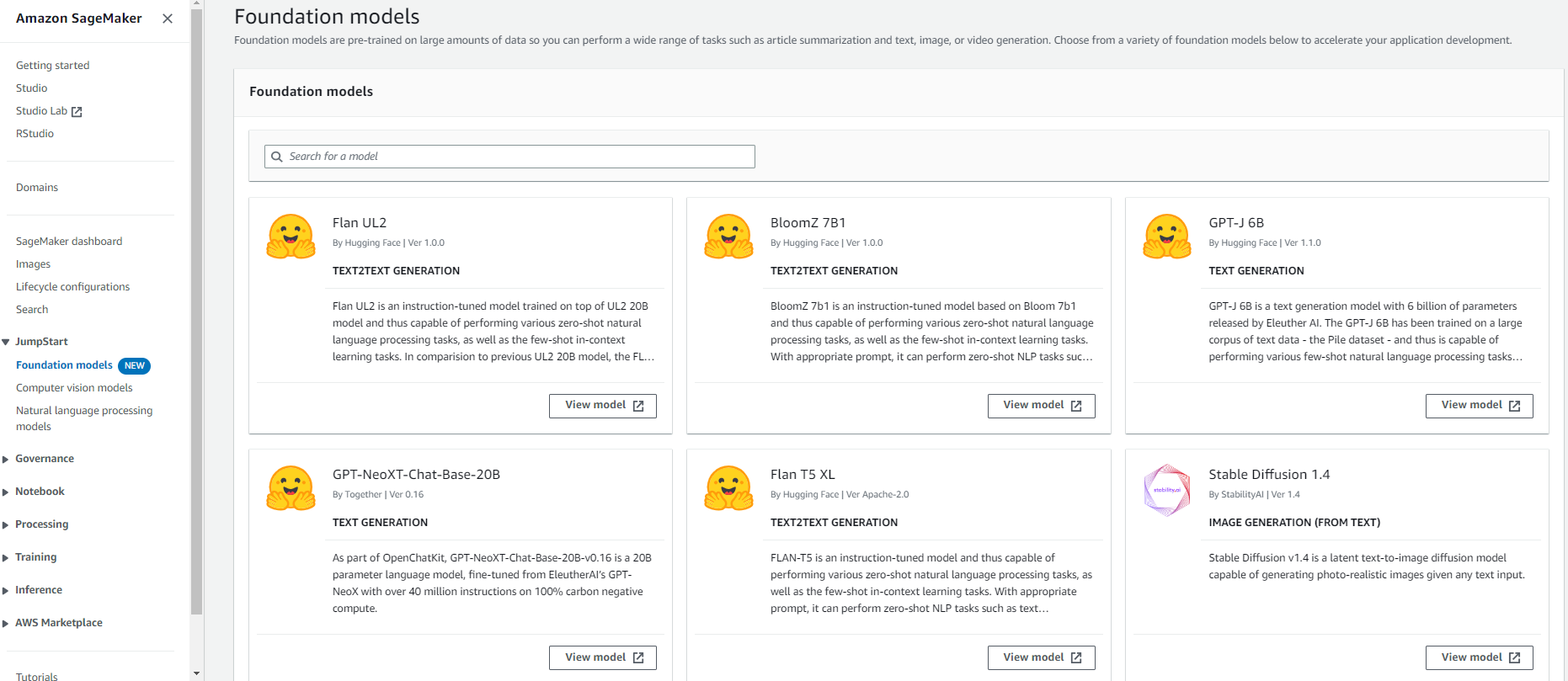

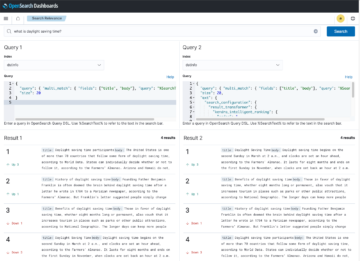

Der vom Benutzer eingegebene Text musste von einem leistungsstarken Sprachmodell verarbeitet werden, um ihn auf Verzerrungen zu untersuchen. Wir haben uns für Flan aufgrund seiner Robustheit, Effizienz und Skalierbarkeit entschieden. Um Flan zu nutzen, haben wir SageMaker JumpStart verwendet, wie im folgenden Screenshot gezeigt. Amazon Sage Maker machte es einfach, eine vorab trainierte Flan-Instanz bereitzustellen und zu verwalten, sodass wir uns auf die Optimierung unserer Eingabeaufforderungen und Abfragen konzentrieren konnten, anstatt die Leistung und Infrastruktur des Modells zu verwalten.

Die Verbindung des Flan-Modells mit unserer Front-End-Anwendung erforderte eine robuste und sichere Integration, die mithilfe von Lambda und API Gateway erreicht wurde. Mit Lambda haben wir eine serverlose Funktion erstellt, die direkt mit unserem SageMaker-Modell kommuniziert. Anschließend haben wir API Gateway verwendet, um einen sicheren, skalierbaren und leicht zugänglichen Endpunkt für unsere React-App zum Aufrufen der Lambda-Funktion zu erstellen. Wenn ein Benutzer einen Text übermittelte, löste die App eine Reihe von API-Aufrufen an das Gateway aus – zunächst, um festzustellen, ob eine Verzerrung vorliegt, und dann, falls erforderlich, zusätzliche Abfragen, um die Verzerrung zu identifizieren, zu lokalisieren und zu neutralisieren. Alle diese Anfragen wurden über die Lambda-Funktion und dann an unser SageMaker-Modell weitergeleitet.

Unsere letzte Aufgabe im Entwicklungsprozess war die Auswahl von Eingabeaufforderungen zur Abfrage des Sprachmodells. Hier spielte der CrowS-Pairs-Datensatz eine entscheidende Rolle, da er uns echte Beispiele für voreingenommenen Text lieferte, die wir zur Feinabstimmung unserer Anfragen nutzten. Wir haben die Eingabeaufforderungen durch einen iterativen Prozess ausgewählt, mit dem Ziel, die Genauigkeit bei der Erkennung von Verzerrungen innerhalb dieses Datensatzes zu maximieren.

Zum Abschluss des Prozesses stellten wir einen nahtlosen Betriebsablauf in der fertigen Anwendung fest. Der Prozess beginnt damit, dass ein Benutzer Text zur Analyse übermittelt, der dann über eine POST-Anfrage an unseren sicheren API-Gateway-Endpunkt gesendet wird. Dadurch wird die Lambda-Funktion ausgelöst, die mit dem SageMaker-Endpunkt kommuniziert. Folglich erhält das Flan-Modell eine Reihe von Abfragen. Zunächst wird geprüft, ob der Text voreingenommen ist. Wenn Verzerrungen erkannt werden, werden zusätzliche Abfragen eingesetzt, um diese verzerrten Elemente zu lokalisieren, zu identifizieren und zu neutralisieren. Die Ergebnisse werden dann über denselben Pfad zurückgegeben – zuerst an die Lambda-Funktion, dann über das API-Gateway und schließlich zurück an den Benutzer. Wenn im Originaltext eine Voreingenommenheit vorhanden war, erhält der Benutzer eine umfassende Analyse mit Angabe der Art der festgestellten Vorurteile, sei es rassistisch, ethnisch oder geschlechtsspezifisch. Bestimmte Textabschnitte, in denen diese Verzerrungen festgestellt wurden, werden hervorgehoben, sodass Benutzer die vorgenommenen Änderungen klar erkennen können. Parallel zu dieser Analyse wird eine neue, unvoreingenommene Version ihres Textes präsentiert, die potenziell voreingenommene Beiträge effektiv in eine umfassendere Erzählung umwandelt.

In den folgenden Abschnitten beschreiben wir die Schritte zur Implementierung dieser Lösung.

Richten Sie die React-Umgebung ein

Wir begannen mit der Einrichtung unserer Entwicklungsumgebung für React. Zum Bootstrapping einer neuen React-Anwendung mit minimaler Konfiguration haben wir create-react-app verwendet:

npx create-react-app my-app

Erstellen Sie die Benutzeroberfläche

Mithilfe von React haben wir eine einfache Benutzeroberfläche für die Texteingabe entworfen, mit einer Übermittlungsschaltfläche, einer Reset-Schaltfläche und überlagerten Anzeigen zur Präsentation der verarbeiteten Ergebnisse, sobald diese verfügbar sind.

Starten Sie das Flan-Modell auf SageMaker

Wir haben SageMaker verwendet, um eine vorab trainierte Instanz des Flan-Sprachmodells mit einem Endpunkt für Echtzeit-Inferenz zu erstellen. Das Modell kann für jede JSON-strukturierte Nutzlast wie die folgende verwendet werden:

Erstellen Sie eine Lambda-Funktion

Wir haben eine Lambda-Funktion entwickelt, die direkt mit unserem SageMaker-Endpunkt interagiert. Die Funktion wurde entwickelt, um eine Anfrage mit dem Text des Benutzers zu empfangen, sie an den SageMaker-Endpunkt weiterzuleiten und die verfeinerten Ergebnisse zurückzugeben, wie im folgenden Code gezeigt (ENDPOINT_NAME wurde als SageMaker-Instanzendpunkt eingerichtet):

API-Gateway einrichten

Wir haben im API Gateway eine neue REST-API konfiguriert und mit unserer Lambda-Funktion verknüpft. Diese Verbindung ermöglichte es unserer React-Anwendung, HTTP-Anfragen an das API-Gateway zu stellen, was anschließend die Lambda-Funktion auslöste.

Integrieren Sie die React-App mit der API

Wir haben die React-Anwendung aktualisiert, um beim Klicken auf die Schaltfläche „Senden“ eine POST-Anfrage an das API-Gateway zu stellen, wobei der Text der Anfrage der Text des Benutzers ist. Der JavaScript-Code, den wir zum Ausführen des API-Aufrufs verwendet haben, lautet wie folgt (REACT_APP_AWS_ENDPOINT entspricht dem API-Gateway-Endpunkt, der an den Lambda-Aufruf gebunden ist):

Optimieren Sie die Eingabeaufforderungsauswahl

Um die Genauigkeit der Bias-Erkennung zu verbessern, haben wir verschiedene Eingabeaufforderungen anhand des CrowS-Pairs-Datensatzes getestet. Durch diesen iterativen Prozess wählten wir die Eingabeaufforderungen aus, die uns die höchste Genauigkeit lieferten.

Stellen Sie die React-App auf Vercel bereit und testen Sie sie

Nachdem wir die Anwendung erstellt hatten, stellten wir sie auf Vercel bereit, um sie öffentlich zugänglich zu machen. Wir haben umfangreiche Tests durchgeführt, um sicherzustellen, dass die Anwendung wie erwartet funktioniert, von der Benutzeroberfläche bis zu den Antworten des Sprachmodells.

Diese Schritte legten den Grundstein für die Erstellung unserer Anwendung zur Analyse und Entzerrung von Texten. Trotz der inhärenten Komplexität des Prozesses wurde die Entwicklung durch den Einsatz von Tools wie SageMaker, Lambda und API Gateway rationalisiert, sodass wir uns auf das Kernziel des Projekts konzentrieren konnten – die Identifizierung und Beseitigung von Vorurteilen im Text.

Zusammenfassung

SageMaker JumpStart bietet eine bequeme Möglichkeit, die Funktionen und Fähigkeiten von SageMaker zu erkunden. Es bietet kuratierte One-Step-Lösungen, Beispiel-Notebooks und einsetzbare vorab trainierte Modelle. Mit diesen Ressourcen können Sie SageMaker schnell erlernen und verstehen. Darüber hinaus haben Sie die Möglichkeit, die Modelle zu verfeinern und entsprechend Ihren spezifischen Anforderungen bereitzustellen. Der Zugriff auf JumpStart erfolgt über Amazon SageMaker-Studio oder programmgesteuert mithilfe der SageMaker-APIs.

In diesem Beitrag haben Sie erfahren, wie ein studentisches Hackathon-Team mithilfe von SageMaker JumpStart in kurzer Zeit eine Lösung entwickelt hat, die das Potenzial von AWS und SageMaker JumpStart zeigt, eine schnelle Entwicklung und Bereitstellung anspruchsvoller KI-Lösungen selbst durch kleine Teams oder Einzelpersonen zu ermöglichen.

Weitere Informationen zur Verwendung von SageMaker JumpStart finden Sie unter Feinabstimmung der Anleitung für FLAN T5 XL mit Amazon SageMaker Jumpstart und Zero-Shot-Eingabeaufforderung für das Flan-T5-Basismodell in Amazon SageMaker JumpStart.

Der ETH Analytics Club war Gastgeber des „ETH Datathon“, eines KI/ML-Hackathons, an dem mehr als 150 Teilnehmer von der ETH Zürich, der Universität Zürich und der EPFL teilnahmen. Die Veranstaltung bietet von Branchenführern geleitete Workshops, eine 24-Stunden-Coding-Challenge und wertvolle Networking-Möglichkeiten mit Kommilitonen und Branchenexperten. Großer Dank geht an das ETH-Hackathon-Team: Daniele Chiappalupi, Athina Nisioti und Francesco Ignazio Re, sowie an den Rest des AWS-Organisationsteams: Alice Morano, Demir Catovic, Iana Peix, Jan Oliver Seidenfuss, Lars Nettemann und Markus Winterholer.

Der Inhalt und die Meinungen in diesem Beitrag sind die des Drittautors und AWS ist nicht für den Inhalt oder die Richtigkeit dieses Beitrags verantwortlich.

Über die Autoren

Jun Zhang ist ein Lösungsarchitekt mit Sitz in Zürich. Er unterstützt Schweizer Kunden bei der Entwicklung cloudbasierter Lösungen, um ihr Geschäftspotenzial auszuschöpfen. Er hat eine Leidenschaft für Nachhaltigkeit und ist bestrebt, aktuelle Nachhaltigkeitsherausforderungen mit Technologie zu lösen. Er ist außerdem ein großer Tennisfan und spielt sehr gerne Brettspiele.

Jun Zhang ist ein Lösungsarchitekt mit Sitz in Zürich. Er unterstützt Schweizer Kunden bei der Entwicklung cloudbasierter Lösungen, um ihr Geschäftspotenzial auszuschöpfen. Er hat eine Leidenschaft für Nachhaltigkeit und ist bestrebt, aktuelle Nachhaltigkeitsherausforderungen mit Technologie zu lösen. Er ist außerdem ein großer Tennisfan und spielt sehr gerne Brettspiele.

Mohan Gowda leitet das Team für maschinelles Lernen bei AWS Schweiz. Er arbeitet hauptsächlich mit Automobilkunden zusammen, um innovative KI/ML-Lösungen und Plattformen für Fahrzeuge der nächsten Generation zu entwickeln. Vor seiner Tätigkeit bei AWS arbeitete Mohan bei einem globalen Managementberatungsunternehmen mit Schwerpunkt auf Strategie und Analyse. Seine Leidenschaft gilt vernetzten Fahrzeugen und autonomem Fahren.

Mohan Gowda leitet das Team für maschinelles Lernen bei AWS Schweiz. Er arbeitet hauptsächlich mit Automobilkunden zusammen, um innovative KI/ML-Lösungen und Plattformen für Fahrzeuge der nächsten Generation zu entwickeln. Vor seiner Tätigkeit bei AWS arbeitete Mohan bei einem globalen Managementberatungsunternehmen mit Schwerpunkt auf Strategie und Analyse. Seine Leidenschaft gilt vernetzten Fahrzeugen und autonomem Fahren.

EssenThias Egli ist Leiterin Bildung in der Schweiz. Er ist ein enthusiastischer Teamleiter mit umfassender Erfahrung in den Bereichen Geschäftsentwicklung, Vertrieb und Marketing.

EssenThias Egli ist Leiterin Bildung in der Schweiz. Er ist ein enthusiastischer Teamleiter mit umfassender Erfahrung in den Bereichen Geschäftsentwicklung, Vertrieb und Marketing.

Kemeng Zhang ist ein ML-Ingenieur mit Sitz in Zürich. Sie unterstützt globale Kunden beim Entwurf, der Entwicklung und der Skalierung ML-basierter Anwendungen, um ihre digitalen Fähigkeiten zu stärken und so den Geschäftsumsatz zu steigern und Kosten zu senken. Sie legt außerdem großen Wert darauf, Anwendungen zu entwickeln, die den Menschen in den Mittelpunkt stellen, indem sie Erkenntnisse aus der Verhaltenswissenschaft nutzt. Sie treibt gerne Wassersport und geht gerne mit Hunden spazieren.

Kemeng Zhang ist ein ML-Ingenieur mit Sitz in Zürich. Sie unterstützt globale Kunden beim Entwurf, der Entwicklung und der Skalierung ML-basierter Anwendungen, um ihre digitalen Fähigkeiten zu stärken und so den Geschäftsumsatz zu steigern und Kosten zu senken. Sie legt außerdem großen Wert darauf, Anwendungen zu entwickeln, die den Menschen in den Mittelpunkt stellen, indem sie Erkenntnisse aus der Verhaltenswissenschaft nutzt. Sie treibt gerne Wassersport und geht gerne mit Hunden spazieren.

Daniele Chiappalupi ist Absolvent der ETH Zürich. Er genießt jeden Aspekt der Softwareentwicklung, vom Entwurf bis zur Implementierung und von der Bereitstellung bis zur Wartung. Er hat eine tiefe Leidenschaft für KI und freut sich darauf, die neuesten Fortschritte auf diesem Gebiet zu erforschen, zu nutzen und zu ihnen beizutragen. In seiner Freizeit geht er in den kälteren Monaten gerne Snowboarden und spielt bei wärmerem Wetter Basketball.

Daniele Chiappalupi ist Absolvent der ETH Zürich. Er genießt jeden Aspekt der Softwareentwicklung, vom Entwurf bis zur Implementierung und von der Bereitstellung bis zur Wartung. Er hat eine tiefe Leidenschaft für KI und freut sich darauf, die neuesten Fortschritte auf diesem Gebiet zu erforschen, zu nutzen und zu ihnen beizutragen. In seiner Freizeit geht er in den kälteren Monaten gerne Snowboarden und spielt bei wärmerem Wetter Basketball.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/innovation-for-inclusion-hack-the-bias-with-amazon-sagemaker/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 100

- 13

- 150

- 17

- 25

- 7

- 8

- 87

- 97

- 990

- a

- Fähig

- Über Uns

- Zugang

- zugänglich

- Nach

- Genauigkeit

- Erreichen

- erreicht

- über

- Zusätzliche

- zusätzlich

- Fortschritte

- Nach der

- gegen

- AI

- AI / ML

- Alice

- Alle

- erlauben

- erlaubt

- Zulassen

- neben

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- Analyse

- Analytik

- Analyse

- und

- und Infrastruktur

- antizipiert

- jedem

- Bienen

- APIs

- App

- Anwendung

- Anwendungen

- Architektur

- SIND

- Bereiche

- AS

- Aussehen

- At

- Autor

- Auto

- Automobilindustrie

- Autonom

- verfügbar

- AWS

- Axios

- Zurück

- basierend

- Basketball

- BE

- weil

- Bevor

- begann

- Sein

- vorspannen

- voreingenommen

- Vorurteile

- Tafel

- Brettspiele

- Körper

- Bound

- breit

- bauen

- Building

- erbaut

- Geschäft

- Geschäftsentwicklung

- Taste im nun erscheinenden Bestätigungsfenster nun wieder los.

- by

- rufen Sie uns an!

- Aufrufe

- CAN

- Fähigkeiten

- Kategorie

- zentriert

- challenges

- Herausforderungen

- Änderungen

- Schecks

- wählten

- klar

- Club

- Code

- Programmierung

- Komplexität

- umfassend

- durchgeführt

- Konfiguration

- konfiguriert

- Sie

- Verbindung

- Folglich

- konstante

- Consulting

- Inhalt

- Kontext

- beitragen

- trägt dazu bei

- Beitrag

- Praktische

- Kernbereich

- entspricht

- Kosten

- könnte

- erstellen

- erstellt

- Erstellen

- wichtig

- kuratiert

- Strom

- Kunden

- technische Daten

- tief

- Abhängig

- einsetzen

- Einsatz

- Einsatz

- Design

- entworfen

- Trotz

- Detail

- erkannt

- Entdeckung

- entwickeln

- entwickelt

- Entwicklung

- Entwicklung

- Geräte

- anders

- digital

- Direkt

- Displays

- zieht

- Fahren

- zwei

- im

- jeder

- eifrig

- leicht

- Einfache

- Bildungswesen

- effektiv

- Effizienz

- effizient

- Elemente

- eliminieren

- ermächtigen

- ermächtigt

- ermöglichen

- Endpunkt

- Ingenieur

- Entwicklung

- Eine Verbesserung der

- gewährleisten

- Gewährleistung

- eingegeben

- begeistert

- Arbeitsumfeld

- ETH

- Sogar

- Event

- Jedes

- Beispiel

- Beispiele

- erwartet

- ERFAHRUNGEN

- ERKUNDEN

- Möglichkeiten sondieren

- umfangreiche

- Messe

- Fan

- FAST

- Merkmal

- Eigenschaften

- Kerl

- Feld

- Abbildung

- Finale

- Fest

- Vorname

- Flexibilität

- Fluss

- Setzen Sie mit Achtsamkeit

- Folgende

- folgt

- Aussichten für

- vorwärts

- gefunden

- Foundation

- Frei

- für

- Funktion

- weiter

- Games

- Tor

- gab

- Geschlecht

- erzeugt

- Generation

- bekommen

- gegeben

- Unterstützung

- Global

- Kundenziele

- Ziele

- gehen

- greifen

- Abschluss

- groß

- Grundlage

- hacken

- hackathon

- Haben

- he

- ganzer

- schwer

- Unternehmen

- hilft

- hier

- höchste

- Besondere

- Highlights

- seine

- gehostet

- Ultraschall

- HTML

- http

- HTTPS

- riesig

- ideal

- identifizieren

- if

- implementieren

- Implementierung

- importieren

- zu unterstützen,

- in

- Aufnahme

- Inklusive

- Erhöhung

- Einzelpersonen

- Energiegewinnung

- Ungleichheiten

- Infrastruktur

- inhärent

- Innovation

- innovativ

- Varianten des Eingangssignals:

- Instanz

- instrumental

- Integration

- interaktive

- Schnittstelle

- Schnittstellen

- in

- ruft auf

- IT

- SEINE

- Januar

- JavaScript

- jpg

- JSON

- Behalten

- Wissen

- Sprache

- neueste

- führen

- Führung

- umwandeln

- LERNEN

- gelernt

- lernen

- geführt

- Nutzung

- liegt

- leicht

- Gefällt mir

- Gleichen

- verknüpft

- Los

- liebt

- Maschine

- Maschinelles Lernen

- gemacht

- Main

- Wartung

- um

- verwalten

- verwaltet

- Management

- flächendeckende Gesundheitsprogramme

- Marketing

- Maximieren

- Maximierung

- minimal

- ML

- Modell

- für

- Monat

- mehr

- NARRATIVE

- Natur

- notwendig,

- Need

- erforderlich

- Bedürfnisse

- Vernetzung

- Vernetzungsmöglichkeiten

- Neu

- weiter

- Ziel

- of

- bieten

- Angebote

- on

- Betriebs-

- Meinungen

- Entwicklungsmöglichkeiten

- Optimierung

- Option

- or

- Auftrag

- Organisieren

- Original

- OS

- UNSERE

- Seite

- Teilnehmer

- Teile

- Leidenschaft & KREATIVITÄT

- leidenschaftlich

- Ausführen

- Leistung

- Zeiträume

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- gespielt

- spielend

- Post

- Potenzial

- möglicherweise

- größte treibende

- Präsenz

- Gegenwart

- vorgeführt

- in erster Linie

- Prozessdefinierung

- Verarbeitet

- Profis

- Projekt

- fördern

- immobilien

- erwies sich

- die

- vorausgesetzt

- bietet

- öffentlich

- Qualität

- Abfragen

- schnell

- schnell

- lieber

- RE

- Reagieren

- leicht

- echt

- Echtzeit

- erhalten

- Received

- erhält

- kürzlich

- Veteran

- Reduziert

- siehe

- raffiniert

- bezogene

- blieb

- entfernen

- Anforderung

- Zugriffe

- falls angefordert

- Downloads

- Antworten

- für ihren Verlust verantwortlich.

- ansprechbar

- REST

- Folge

- Die Ergebnisse

- Rückkehr

- Rückgabe

- Einnahmen

- robust

- Robustheit

- Rollen

- Straße

- sagemaker

- Vertrieb

- gleich

- Skalierbarkeit

- skalierbaren

- Skalieren

- Skalierung

- Wissenschaft

- nahtlos

- Abschnitte

- Verbindung

- sehen

- Samen

- ausgewählt

- Auswahl

- geschickt

- Modellreihe

- Serverlos

- Lösungen

- kompensieren

- Einstellung

- sie

- Short

- erklären

- gezeigt

- Konzerte

- Einfacher

- klein

- Software

- Softwareentwicklung

- solide

- Lösung

- Lösungen

- LÖSEN

- anspruchsvoll

- spezifisch

- Sports

- begonnen

- stetig

- Shritte

- Strategie

- gestrafft

- strebt

- Schüler und Studenten

- Die Kursteilnehmer

- Einreichung

- abschicken

- eingereicht

- Anschließend

- Nachhaltigkeit

- nachhaltiger

- Nachhaltige Entwicklung

- SWIFT

- Schweiz

- Schweiz

- Targeting

- Aufgabe

- Team

- Teams

- Technologie

- Test

- getestet

- Tests

- Text

- als

- Vielen Dank

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- Thema

- dann

- Diese

- basierte Online-to-Offline-Werbezuordnungen von anderen gab.

- fehlen uns die Worte.

- diejenigen

- nach drei

- Durch

- Zeit

- zu

- Werkzeuge

- Transformieren

- ausgelöst

- WENDE

- XNUMX

- Typen

- Letztlich

- UN

- verstehen

- Universität

- aktualisiert

- us

- -

- benutzt

- Mitglied

- Benutzererfahrung

- Benutzerschnittstelle

- Nutzer

- Verwendung von

- Nutzen

- seit

- Verwendung

- wertvoll

- verschiedene

- Fahrzeuge

- Version

- sehr

- Anzeigen

- Gehen

- Wärmt

- wurde

- Wasser

- Weg..

- we

- Wetter

- Netz

- Web-Services

- GUT

- waren

- wann

- ob

- welche

- mit

- .

- ohne

- gearbeitet

- arbeiten,

- Werk

- Workshops

- Du

- Ihr

- Zephyrnet

- Zürich