Der Aufbau von Basismodellen (FMs) erfordert den Aufbau, die Wartung und die Optimierung großer Cluster, um Modelle mit Dutzenden bis Hunderten Milliarden Parametern auf riesigen Datenmengen zu trainieren. Die Schaffung einer widerstandsfähigen Umgebung, die Fehler und Umgebungsänderungen bewältigen kann, ohne dass Tage oder Wochen des Modellschulungsfortschritts verloren gehen, ist eine betriebliche Herausforderung, die die Implementierung von Clusterskalierung, proaktiver Zustandsüberwachung, Job-Checkpointing und Funktionen zur automatischen Wiederaufnahme des Trainings bei Fehlern oder Problemen erfordert .

Wir freuen uns, das zu teilen Amazon SageMaker HyperPod ist jetzt allgemein verfügbar, um das Training von Fundamentmodellen mit Tausenden von Beschleunigern um bis zu 40 % schneller zu ermöglichen, indem es eine äußerst belastbare Trainingsumgebung bietet und gleichzeitig die undifferenzierte schwere Arbeit eliminiert, die mit dem Betrieb großer Trainingscluster verbunden ist. Mit SageMaker HyperPod können Praktiker des maschinellen Lernens (ML) FMs wochen- und monatelang ohne Unterbrechung trainieren, ohne sich mit Hardwarefehlern auseinandersetzen zu müssen.

Kunden wie Stability AI verwenden SageMaker HyperPod, um ihre Grundlagenmodelle, einschließlich Stable Diffusion, zu trainieren.

„Als führendes Open-Source-Unternehmen für generative KI ist es unser Ziel, die Zugänglichkeit moderner KI zu maximieren. Wir erstellen Basismodelle mit Dutzenden Milliarden Parametern, die eine Infrastruktur benötigen, um die Trainingsleistung optimal zu skalieren. Mit der verwalteten Infrastruktur und den Optimierungsbibliotheken von SageMaker HyperPod können wir Schulungszeit und -kosten um über 50 % reduzieren. Dadurch wird unser Modelltraining belastbarer und leistungsfähiger, sodass wir schneller hochmoderne Modelle erstellen können.“

– Emad Mostaque, Gründer und CEO von Stability AI.

Um den gesamten FM-Entwicklungszyklus widerstandsfähig gegenüber Hardwareausfällen zu machen, hilft Ihnen SageMaker HyperPod dabei, Cluster zu erstellen, den Cluster-Zustand zu überwachen, fehlerhafte Knoten im laufenden Betrieb zu reparieren und zu ersetzen, häufige Prüfpunkte zu speichern und das Training automatisch fortzusetzen, ohne den Fortschritt zu verlieren. Darüber hinaus ist SageMaker HyperPod mit vorkonfiguriert Amazon Sage Maker verteilte Schulungsbibliotheken, einschließlich der SageMaker-Datenparallelitätsbibliothek (SMDDP) machen SageMaker-Modellparallelitätsbibliothek (SMP), um die FM-Trainingsleistung zu verbessern, indem die Aufteilung von Trainingsdaten und -modellen in kleinere Blöcke und deren parallele Verarbeitung auf den Clusterknoten vereinfacht wird, während gleichzeitig die Rechen- und Netzwerkinfrastruktur des Clusters vollständig genutzt wird. SageMaker HyperPod integriert den Slurm Workload Manager für die Cluster- und Trainingsjob-Orchestrierung.

Übersicht über Slurm Workload Manager

Schlummern, früher bekannt als Simple Linux Utility for Resource Management, ist ein Jobplaner zum Ausführen von Jobs auf einem verteilten Computercluster. Es bietet auch ein Framework zum Ausführen paralleler Jobs mithilfe von NVIDIA Collective Communications Library (NCCL) or Message Passing Interface (MPI) Standards. Slurm ist ein beliebtes Open-Source-Cluster-Ressourcenverwaltungssystem, das häufig für High-Performance-Computing (HPC) und generative KI- und FM-Trainings-Workloads verwendet wird. SageMaker HyperPod bietet eine unkomplizierte Möglichkeit, innerhalb weniger Minuten einen Slurm-Cluster einzurichten und in Betrieb zu nehmen.

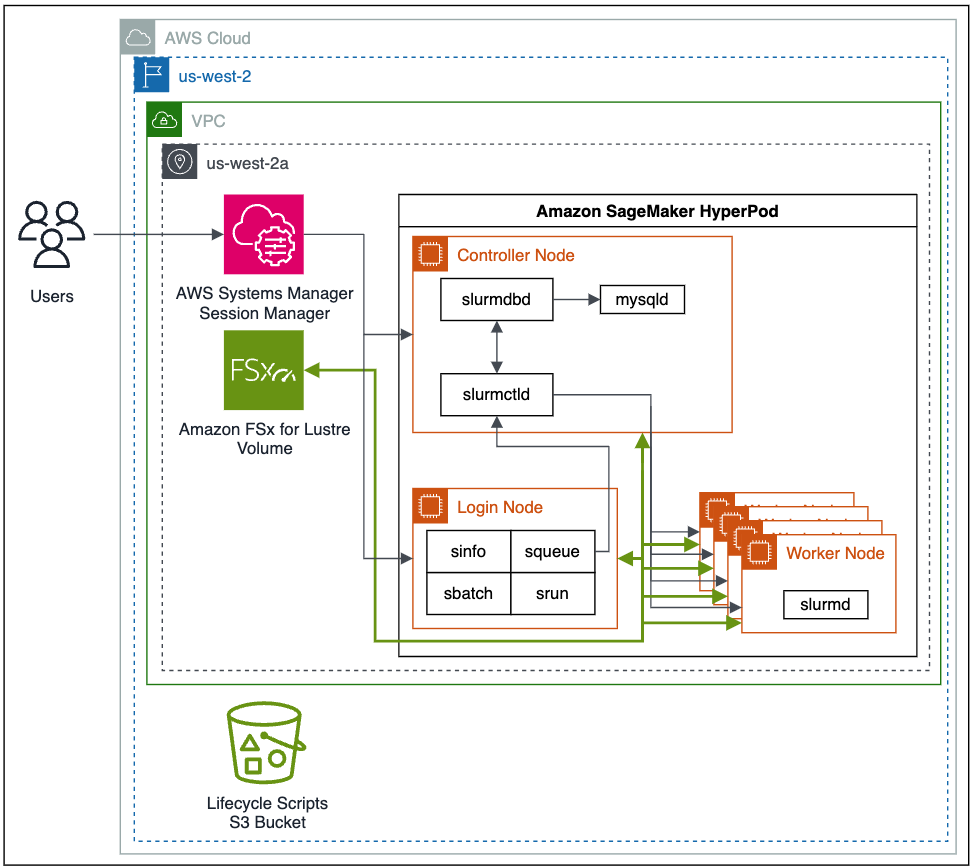

Das Folgende ist ein allgemeines Architekturdiagramm, das zeigt, wie Benutzer mit SageMaker HyperPod interagieren und wie die verschiedenen Clusterkomponenten miteinander und mit anderen AWS-Diensten interagieren, z Amazon FSx für Lustre machen Amazon Simple Storage-Service (Amazon S3).

Slurm-Jobs werden durch Befehle in der Befehlszeile übermittelt. Die Befehle zum Ausführen von Slurm-Jobs sind: srun machen sbatchdem „Vermischten Geschmack“. Seine srun Der Befehl führt den Trainingsjob im interaktiven und blockierenden Modus aus und sbatch läuft im Stapelverarbeitungs- und nicht blockierenden Modus. srun wird hauptsächlich zum Ausführen sofortiger Jobs verwendet, while sbatch kann für spätere Ausführungen von Jobs verwendet werden.

Informationen zu zusätzlichen Slurm-Befehlen und -Konfiguration finden Sie im Slurm Workload Manager-Dokumentation.

Automatische Wiederaufnahme- und Heilungsfunktionen

Eine der neuen Funktionen von SageMaker HyperPod ist die Möglichkeit, Ihre Aufträge automatisch fortzusetzen. Wenn ein Worker-Knoten während der Ausführung eines Trainings- oder Feinabstimmungsjobs ausfiel, war es bisher Sache des Benutzers, den Jobstatus zu überprüfen, den Job vom letzten Prüfpunkt aus neu zu starten und den Job während der gesamten Ausführung weiter zu überwachen. Wenn Schulungs- oder Feinabstimmungsjobs tagelang, wochenlang oder sogar monatelang ausgeführt werden müssen, wird dies kostspielig, da der Benutzer zusätzliche Verwaltungsaufwand hat und Zyklen für die Überwachung und Wartung des Jobs aufwenden muss, falls a Knotenabstürze sowie die Kosten für die Leerlaufzeit teurer beschleunigter Recheninstanzen.

SageMaker HyperPod sorgt für Job-Ausfallsicherheit durch automatisierte Zustandsprüfungen, Knotenaustausch und Job-Wiederherstellung. Slurm-Jobs in SageMaker HyperPod werden mithilfe eines benutzerdefinierten Slurm-Plugins von SageMaker überwacht SPANK-Framework. Wenn ein Trainingsjob fehlschlägt, überprüft SageMaker HyperPod den Clusterzustand durch eine Reihe von Zustandsprüfungen. Wenn im Cluster ein fehlerhafter Knoten gefunden wird, entfernt der SageMaker HyperPod den Knoten automatisch aus dem Cluster, ersetzt ihn durch einen fehlerfreien Knoten und startet den Trainingsjob neu. Bei der Verwendung von Prüfpunkten in Trainingsjobs kann jeder unterbrochene oder fehlgeschlagene Job am letzten Prüfpunkt fortgesetzt werden.

Lösungsüberblick

Um Ihren SageMaker HyperPod bereitzustellen, bereiten Sie zunächst Ihre Umgebung vor, indem Sie Ihre Umgebung konfigurieren Amazon Virtual Private Cloud (Amazon VPC) Netzwerk- und Sicherheitsgruppen, Bereitstellung unterstützender Dienste wie FSx für Lustre in Ihrer VPC und Veröffentlichung Ihrer Slurm-Lebenszyklusskripte in einem S3-Bucket. Anschließend stellen Sie Ihren SageMaker HyperPod bereit und konfigurieren ihn und stellen eine Verbindung zum Hauptknoten her, um Ihre Trainingsjobs zu starten.

Voraussetzungen:

Bevor Sie Ihren SageMaker HyperPod erstellen, müssen Sie zunächst Ihre VPC konfigurieren, ein FSx für Lustre-Dateisystem erstellen und einen S3-Bucket mit Ihren gewünschten Cluster-Lebenszyklusskripten einrichten. Sie benötigen außerdem die neueste Version von AWS-Befehlszeilenschnittstelle (AWS CLI) und das für installierte CLI-Plugin AWS-Sitzungsmanager, eine Fähigkeit von AWS-Systemmanager.

SageMaker HyperPod ist vollständig in Ihre VPC integriert. Informationen zum Erstellen einer neuen VPC finden Sie unter Erstellen Sie eine Standard-VPC or Erstellen Sie eine VPC. Um eine nahtlose Verbindung mit höchster Leistung zwischen Ressourcen zu ermöglichen, sollten Sie alle Ihre Ressourcen in derselben Region und Verfügbarkeitszone erstellen und sicherstellen, dass die zugehörigen Sicherheitsgruppenregeln eine Verbindung zwischen Clusterressourcen zulassen.

Als Nächstes du Erstellen Sie ein FSx für Lustre-Dateisystem. Dies wird als Hochleistungsdateisystem für die Verwendung während unseres gesamten Modelltrainings dienen. Stellen Sie sicher, dass die FSx for Lustre- und Cluster-Sicherheitsgruppen eingehende und ausgehende Kommunikation zwischen Clusterressourcen und dem FSx for Lustre-Dateisystem zulassen.

Um Ihre Cluster-Lebenszyklus-Skripts einzurichten, die ausgeführt werden, wenn Ereignisse wie eine neue Cluster-Instanz auftreten, erstellen Sie einen S3-Bucket und kopieren dann die Standard-Lebenszyklus-Skripts und passen diese optional an. In diesem Beispiel speichern wir alle Lebenszyklusskripte in einem Bucket-Präfix von lifecycle-scripts.

Zuerst laden Sie die Beispiel-Lebenszyklusskripte von herunter GitHub Repo. Sie sollten diese an Ihr gewünschtes Clusterverhalten anpassen.

Erstellen Sie als Nächstes einen S3-Bucket zum Speichern der angepassten Lebenszyklusskripte.

Kopieren Sie als Nächstes die Standard-Lebenszyklusskripte aus Ihrem lokalen Verzeichnis in den gewünschten Bucket und verwenden Sie das Präfix aws s3 sync:

Schließlich sollten Sie den Client für eine vereinfachte Verbindung zum Hauptknoten des Clusters einrichten Installieren oder aktualisieren Sie die AWS CLI und installiere die AWS Session Manager CLI-Plugin um interaktive Terminalverbindungen zur Verwaltung des Clusters und zur Ausführung von Trainingsjobs zu ermöglichen.

Sie können einen SageMaker HyperPod-Cluster entweder mit verfügbaren On-Demand-Ressourcen erstellen oder indem Sie eine Kapazitätsreservierung bei SageMaker anfordern. Um eine Kapazitätsreservierung zu erstellen, erstellen Sie eine Anfrage zur Kontingenterhöhung, um bestimmte Compute-Instanztypen und Kapazitätszuweisungen im Servicekontingent-Dashboard zu reservieren.

Richten Sie Ihren Trainingscluster ein

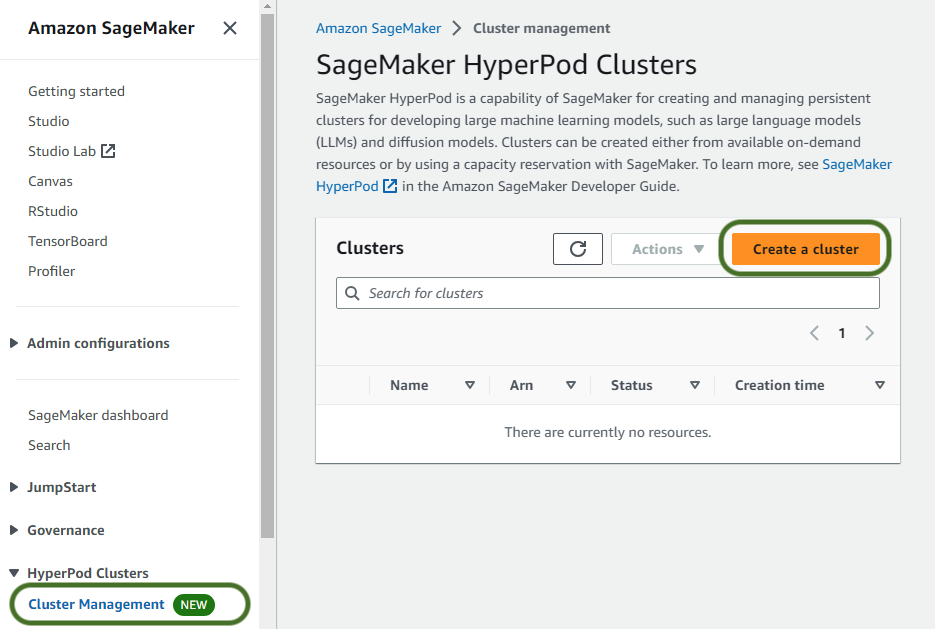

Führen Sie die folgenden Schritte aus, um Ihren SageMaker HyperPod-Cluster zu erstellen:

- Wählen Sie in der SageMaker-Konsole Cluster-Management für HyperPod-Cluster im Navigationsbereich.

- Auswählen

Cluster erstellen.

- Geben Sie einen Clusternamen und optional alle Tags ein, die auf Clusterressourcen angewendet werden sollen, und wählen Sie dann aus Weiter.

- Auswählen Instanzgruppe erstellen und geben Sie den Namen der Instanzgruppe, den benötigten Instanztyp, die Anzahl der gewünschten Instanzen sowie den S3-Bucket und den Präfixpfad an, in den Sie zuvor Ihre Cluster-Lebenszyklusskripte kopiert haben.

Es wird empfohlen, unterschiedliche Instanzgruppen für die Controller-Knoten zu haben, die zum Verwalten des Clusters und zum Senden von Jobs verwendet werden, und für die Worker-Knoten, die zum Ausführen von Trainingsjobs mithilfe beschleunigter Recheninstanzen verwendet werden. Sie können optional eine zusätzliche Instanzgruppe für Anmeldeknoten konfigurieren.

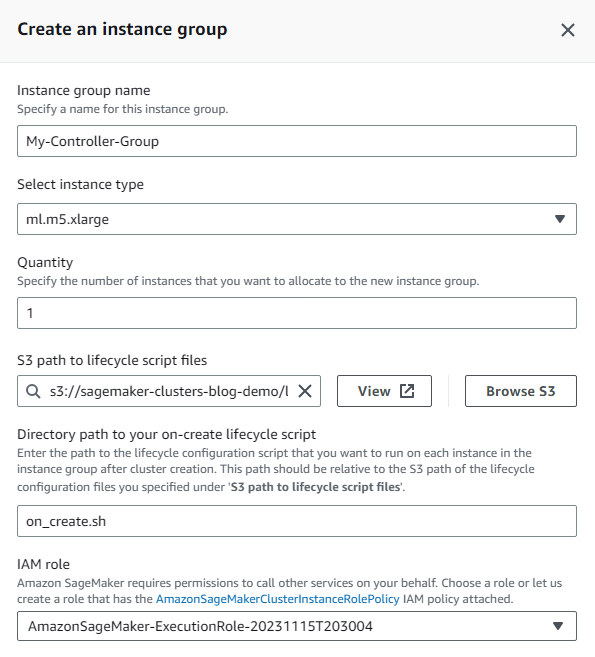

- Sie erstellen zunächst die Controller-Instanzgruppe, die den Cluster-Hauptknoten enthält.

- Für diese Instanzgruppe AWS Identity and Access Management and (IAM) Rolle, wählen Sie Erstellen Sie eine neue Rolle und geben Sie alle S3-Buckets an, auf die die Cluster-Instanzen in der Instanzgruppe Zugriff haben sollen.

Der generierten Rolle wird standardmäßig schreibgeschützter Zugriff auf die angegebenen Buckets gewährt.

- Auswählen Rolle erstellen.

- Geben Sie den Skriptnamen ein, der bei jeder Instanzerstellung ausgeführt werden soll, in die Eingabeaufforderung für das Skript beim Erstellen. In diesem Beispiel wird das On-Create-Skript aufgerufen

on_create.sh.

- Auswählen Speichern.

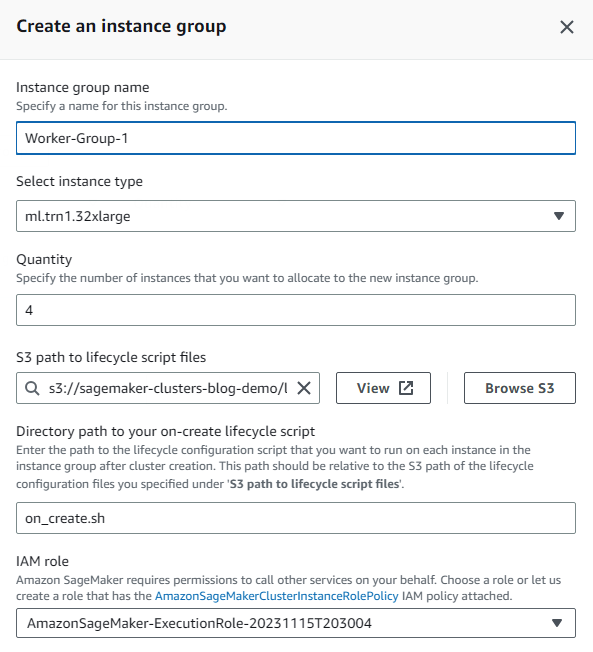

- Auswählen Instanzgruppe erstellen um Ihre Worker-Instanzgruppe zu erstellen.

- Geben Sie alle angeforderten Details an, einschließlich des Instanztyps und der gewünschten Menge.

In diesem Beispiel werden vier beschleunigte ml.trn1.32xl-Instanzen verwendet, um unseren Trainingsjob auszuführen. Sie können dieselbe IAM-Rolle wie zuvor verwenden oder die Rolle für die Worker-Instanzen anpassen. Ebenso können Sie für diese Worker-Instanzgruppe andere On-Create-Lebenszyklusskripts verwenden als für die vorherige Instanzgruppe.

- Auswählen Weiter fortfahren.

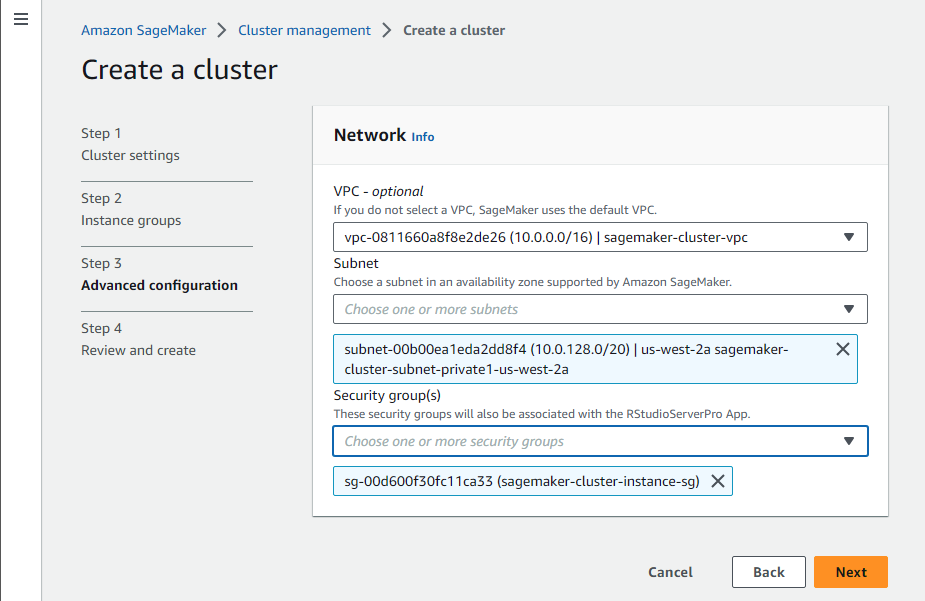

- Wählen Sie die gewünschte VPC, das Subnetz und die Sicherheitsgruppen für Ihre Cluster-Instanzen aus.

Wir hosten die Cluster-Instanzen in einer einzigen Availability Zone und einem Subnetz, um eine geringe Latenz zu gewährleisten.

Beachten Sie: Wenn Sie häufig auf S3-Daten zugreifen, empfiehlt es sich, einen VPC-Endpunkt zu erstellen, der mit der Routing-Tabelle des privaten Subnetzes verknüpft ist, um potenzielle Datenübertragungskosten zu reduzieren.

- Auswählen

Weiter.

- Überprüfen Sie die Zusammenfassung der Clusterdetails und wählen Sie dann aus Absenden.

Um Ihren SageMaker HyperPod alternativ mit der AWS CLI zu erstellen, passen Sie zunächst die JSON-Parameter an, die zum Erstellen des Clusters verwendet werden:

Verwenden Sie dann den folgenden Befehl, um den Cluster mit den bereitgestellten Eingaben zu erstellen:

Führen Sie Ihren ersten Trainingsjob mit Llama 2 durch

Beachten Sie, dass die Nutzung des Llama 2-Modells der Meta-Lizenz unterliegt. Um die Modellgewichte und den Tokenizer herunterzuladen, besuchen Sie die Website und akzeptieren Sie die Lizenz, bevor Sie den Zugriff anfordern Metas Hugging Face-Website.

Nachdem der Cluster ausgeführt wurde, melden Sie sich mit Session Manager unter Verwendung der Cluster-ID, des Instanzgruppennamens und der Instanz-ID an. Verwenden Sie den folgenden Befehl, um Ihre Clusterdetails anzuzeigen:

Notieren Sie sich die Cluster-ID, die im Cluster-ARN in der Antwort enthalten ist.

Verwenden Sie den folgenden Befehl, um den Instanzgruppennamen und die Instanz-ID abzurufen, die für die Anmeldung beim Cluster erforderlich sind.

Merken Sie sich die InstanceGroupName und für InstanceId in der Antwort, da diese verwendet werden, um mit Session Manager eine Verbindung zur Instanz herzustellen.

Jetzt melden Sie sich mit Session Manager beim Hauptknoten oder einem der Anmeldeknoten an und führen Ihren Trainingsjob aus:

Als Nächstes bereiten wir die Umgebung vor und laden Llama 2 und den RedPajama-Datensatz herunter. Für den vollständigen Code und eine Schritt-für-Schritt-Anleitung befolgen Sie die Anweisungen auf der AWSome verteilte Schulung GitHub Repo.

Befolgen Sie die Schritte im 2.test_cases/8.neuronx-nemo-megatron/README.md Datei. Nachdem Sie die Schritte zum Vorbereiten der Umgebung, zum Vorbereiten des Modells, zum Herunterladen und Tokenisieren des Datensatzes und zum Vorkompilieren des Modells ausgeführt haben, sollten Sie die bearbeiten 6.pretrain-model.sh Skript und die sbatch Fügen Sie dem Auftragsübermittlungsbefehl einen Parameter hinzu, mit dem Sie die automatische Wiederaufnahmefunktion von SageMaker HyperPod nutzen können.

Bearbeiten Sie das sbatch Zeile so aussehen:

Nach dem Absenden des Auftrags erhalten Sie eine JobID mit dem Sie den Jobstatus mithilfe des folgenden Codes überprüfen können:

Darüber hinaus können Sie den Job überwachen, indem Sie das Job-Ausgabeprotokoll mit dem folgenden Code verfolgen:

Aufräumen

Um Ihren SageMaker HyperPod-Cluster zu löschen, verwenden Sie entweder die SageMaker-Konsole oder den folgenden AWS CLI-Befehl:

Zusammenfassung

In diesem Beitrag erfahren Sie, wie Sie Ihre AWS-Umgebung vorbereiten, Ihren ersten SageMaker HyperPod-Cluster bereitstellen und ein 7-Milliarden-Parameter-Llama-2-Modell trainieren. SageMaker HyperPod ist heute allgemein in den Regionen Amerika (Nord-Virginia, Ohio und Oregon), Asien-Pazifik (Singapur, Sydney und Tokio) und Europa (Frankfurt, Irland und Stockholm) verfügbar. Sie können über die SageMaker-Konsole, AWS CLI und AWS SDKs bereitgestellt werden und unterstützen die Instanzfamilien p4d, p4de, p5, trn1, inf2, g5, c5, c5n, m5 und t3.

Um mehr über SageMaker HyperPod zu erfahren, besuchen Sie Amazon SageMaker HyperPod.

Über die Autoren

Brad Doran ist Senior Technical Account Manager bei Amazon Web Services mit Schwerpunkt auf generativer KI. Er ist für die Lösung technischer Herausforderungen für generative KI-Kunden im Marktsegment Digital Native Business verantwortlich. Er hat einen Hintergrund in der Infrastruktur- und Softwareentwicklung und betreibt derzeit ein Doktoratsstudium und Forschung in den Bereichen künstliche Intelligenz und maschinelles Lernen.

Brad Doran ist Senior Technical Account Manager bei Amazon Web Services mit Schwerpunkt auf generativer KI. Er ist für die Lösung technischer Herausforderungen für generative KI-Kunden im Marktsegment Digital Native Business verantwortlich. Er hat einen Hintergrund in der Infrastruktur- und Softwareentwicklung und betreibt derzeit ein Doktoratsstudium und Forschung in den Bereichen künstliche Intelligenz und maschinelles Lernen.

Keita Watanabe ist Senior GenAI Specialist Solutions Architect bei Amazon Web Services, wo er bei der Entwicklung von Lösungen für maschinelles Lernen mithilfe von OSS-Projekten wie Slurm und Kubernetes hilft. Sein Hintergrund liegt in der Forschung und Entwicklung im Bereich maschinelles Lernen. Bevor er zu AWS kam, arbeitete Keita in der E-Commerce-Branche als Forschungswissenschaftler und entwickelte Bildabrufsysteme für die Produktsuche. Keita hat einen Doktortitel in Naturwissenschaften von der Universität Tokio.

Keita Watanabe ist Senior GenAI Specialist Solutions Architect bei Amazon Web Services, wo er bei der Entwicklung von Lösungen für maschinelles Lernen mithilfe von OSS-Projekten wie Slurm und Kubernetes hilft. Sein Hintergrund liegt in der Forschung und Entwicklung im Bereich maschinelles Lernen. Bevor er zu AWS kam, arbeitete Keita in der E-Commerce-Branche als Forschungswissenschaftler und entwickelte Bildabrufsysteme für die Produktsuche. Keita hat einen Doktortitel in Naturwissenschaften von der Universität Tokio.

Justin Pirtle ist Principal Solutions Architect bei Amazon Web Services. Er berät regelmäßig Kunden im Bereich generative KI bei der Gestaltung, Bereitstellung und Skalierung ihrer Infrastruktur. Er ist regelmäßiger Redner auf AWS-Konferenzen, darunter re:Invent, sowie anderen AWS-Veranstaltungen. Justin hat einen Bachelor-Abschluss in Management Information Systems von der University of Texas in Austin und einen Master-Abschluss in Software Engineering von der Seattle University.

Justin Pirtle ist Principal Solutions Architect bei Amazon Web Services. Er berät regelmäßig Kunden im Bereich generative KI bei der Gestaltung, Bereitstellung und Skalierung ihrer Infrastruktur. Er ist regelmäßiger Redner auf AWS-Konferenzen, darunter re:Invent, sowie anderen AWS-Veranstaltungen. Justin hat einen Bachelor-Abschluss in Management Information Systems von der University of Texas in Austin und einen Master-Abschluss in Software Engineering von der Seattle University.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/introducing-amazon-sagemaker-hyperpod-to-train-foundation-models-at-scale/

- :Ist

- :Wo

- $UP

- 1

- 100

- 12

- 14

- 24

- 7

- a

- Fähigkeit

- Über uns

- beschleunigt

- Beschleuniger

- Akzeptieren

- Zugang

- Zugänglichkeit

- Zugriff

- Konto

- über

- Zusatz

- Zusätzliche

- Adressen

- verwalten

- administrativ

- Vorteil

- Nach der

- AI

- Alle

- Zuteilung

- erlauben

- erlaubt

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Amerika

- Beträge

- an

- machen

- jedem

- Jetzt bewerben

- architektonisch

- SIND

- entstehen

- künstlich

- künstliche Intelligenz

- Künstliche Intelligenz und maschinelles Lernen

- AS

- Asien

- Asien-Pazifik-

- damit verbundenen

- At

- Austin

- Automatisiert

- Im Prinzip so, wie Sie es von Google Maps kennen.

- Verfügbarkeit

- verfügbar

- AWS

- Hintergrund

- BE

- wird

- Bevor

- Verhaltensweisen

- zwischen

- Milliarden

- Sperrung

- bauen

- Building

- Geschäft

- by

- namens

- CAN

- Fähigkeiten

- capability

- Kapazität

- CEO

- challenges

- Herausforderungen

- Änderungen

- aus der Ferne überprüfen

- Schecks

- Auswählen

- Auftraggeber

- Cluster

- Code

- Collective

- kommt

- Kommunikation

- Kommunikation

- Unternehmen

- abschließen

- Komponenten

- Berechnen

- Computing

- Kongressbegleitung

- Konfiguration

- konfigurieren

- Vernetz Dich

- Verbindung

- Verbindungen

- Konsul (Console)

- fortsetzen

- Controller

- Kosten

- teuer werden

- Kosten

- erstellen

- Erstellen

- Schaffung

- Zur Zeit

- Original

- Kunden

- anpassen

- maßgeschneiderte

- Zyklus

- Zyklen

- Armaturenbrett

- technische Daten

- Tage

- Deal

- Standard

- Grad

- einsetzen

- Einsatz

- Bereitstellen

- Entwerfen

- erwünscht

- detailliert

- Details

- entwickeln

- Entwicklung

- Entwicklung

- anders

- Rundfunk

- digital

- Störung

- verteilt

- Verteiltes rechnen

- verteiltes Training

- herunterladen

- zwei

- im

- jeder

- E-EINKAUF

- entweder

- eliminieren

- ermöglichen

- Endpunkt

- Entwicklung

- gewährleisten

- Ganz

- Arbeitsumfeld

- Umwelt-

- etablieren

- Europa

- Sogar

- Event

- Veranstaltungen

- Beispiel

- aufgeregt

- teuer

- extra

- Gesicht

- Gescheitert

- scheitert

- Scheitern

- Ausfälle

- Familien

- beschleunigt

- fehlerhaft

- Merkmal

- Eigenschaften

- Reichen Sie das

- Vorname

- konzentriert

- folgen

- Folgende

- Aussichten für

- früher

- gefunden

- Foundation

- Gründer

- Unternehmensgründer und CEO

- vier

- Unser Ansatz

- Frankfurt

- häufig

- häufig

- für

- voller

- voll

- allgemein

- erzeugt

- generativ

- Generative KI

- bekommen

- GitHub

- Kundenziele

- gehen

- geregelt

- erteilt

- Gruppe an

- Gruppen

- Griff

- Hardware

- Haben

- mit

- he

- ganzer

- Heilung.

- Gesundheit

- gesund

- schwer

- schweres Heben

- hilft

- GUTE

- High-Level

- Hohe Leistungsfähigkeit

- höchste

- hoch

- seine

- hält

- Gastgeber

- Ultraschall

- Hilfe

- hpc

- HTML

- http

- HTTPS

- hunderte

- ID

- Identitätsschutz

- Leerlauf

- if

- Image

- unmittelbar

- implementieren

- zu unterstützen,

- in

- das

- inklusive

- Einschließlich

- Erhöhung

- Energiegewinnung

- Information

- Information Systems

- Infrastruktur

- Eingänge

- installieren

- installiert

- Instanz

- Anleitung

- integriert

- Integriert

- Intelligenz

- interagieren

- interaktive

- Schnittstelle

- unterbrochen

- in

- Einführung

- beteiligt

- Irland

- Probleme

- IT

- Job

- Jobs

- Beitritt

- jpg

- JSON

- Niklas

- bekannt

- grosse

- großflächig

- Latency

- später

- neueste

- führenden

- LERNEN

- lernen

- Bibliotheken

- Bibliothek

- Lizenz

- Lebenszyklus

- Facelift

- Gefällt mir

- Line

- linux

- Lama

- aus einer regionalen

- Log

- login

- aussehen

- aussehen wie

- verlieren

- Sneaker

- Maschine

- Maschinelles Lernen

- halten

- Aufrechterhaltung

- um

- MACHT

- Making

- verwaltet

- Management

- Manager

- Markt

- Meister

- Materie

- Maximieren

- Meta

- Minuten

- ML

- Model

- Modell

- für

- modern

- Überwachen

- überwacht

- Überwachung

- Monat

- mehr

- meist

- Name

- nativen

- Navigation

- Need

- erforderlich

- benötigen

- Netzwerk

- Neu

- Neue Funktionen

- Knoten

- Fiber Node

- beachten

- jetzt an

- Nvidia

- of

- Ohio

- on

- On-Demand

- EINEM

- XNUMXh geöffnet

- Open-Source-

- die

- Betriebs-

- Optimierung

- Optimierung

- or

- Orchesterbearbeitung

- Oregon

- Uns

- Andere

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- übrig

- Pazifik

- Brot

- Parallel

- Parameter

- Parameter

- Bestehen

- Weg

- Ausführen

- Leistung

- phd

- Plato

- Datenintelligenz von Plato

- PlatoData

- Plugin

- Beliebt

- Post

- Potenzial

- Danach

- früher

- vorher

- Principal

- Vor

- privat

- Proaktives Handeln

- vorgehen

- Verarbeitung

- Produkt

- Fortschritt

- Projekte

- vorausgesetzt

- bietet

- Bereitstellung

- Publishing

- Menge

- RE

- empfohlen

- Erholung

- Veteran

- siehe

- Region

- Regionen

- regulär

- regelmäßig

- entfernen

- Knorpel zu reparieren,

- ersetzen

- Ersatz

- Anforderung

- erfordern

- erfordert

- Forschungsprojekte

- Forschung und Entwicklung

- Reservierung

- RESERVE

- federnde

- Ressourcen

- Downloads

- Antwort

- für ihren Verlust verantwortlich.

- fortsetzen

- Rollen

- Routing

- Ohne eine erfahrene Medienplanung zur Festlegung von Regeln und Strategien beschleunigt der programmatische Medieneinkauf einfach die Rate der verschwenderischen Ausgaben.

- Führen Sie

- Laufen

- läuft

- sagemaker

- gleich

- Speichern

- Skalieren

- Skalierung

- Wissenschaft

- Wissenschaftler

- Skript

- Skripte

- SDKS

- nahtlos

- Suche

- Seattle

- Sicherheitdienst

- sehen

- Segment

- Senior

- brauchen

- Dienstleistungen

- Sitzung

- kompensieren

- Teilen

- sollte

- zeigte

- Ähnlich

- Einfacher

- vereinfachte

- Singapur

- Single

- kleinere

- Software

- Software-Entwicklung

- Softwareentwicklung

- Lösungen

- Auflösung

- Quelle

- Speaker

- Spezialist

- spezifisch

- angegeben

- verbringen

- gespalten

- Stabilität

- stabil

- Normen

- Anfang

- State-of-the-art

- Status

- Shritte

- Lagerung

- speichern

- einfach

- Es wurden Studien

- Einreichung

- abschicken

- eingereicht

- Subnetz

- so

- Anzug

- Suite

- ZUSAMMENFASSUNG

- Support

- Unterstützung

- sicher

- Sydney

- synchronisieren

- System

- Systeme und Techniken

- Tabelle

- Nehmen

- Technische

- Zehn

- Terminal

- Texas

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- Tausende

- Durch

- während

- Zeit

- zu

- heute

- tokenisieren

- Tokio

- Training

- Ausbildung

- privaten Transfer

- tippe

- Typen

- für

- Universität

- University of Tokyo

- Aktualisierung

- -

- benutzt

- Mitglied

- Nutzer

- verwendet

- Verwendung von

- Nutzen

- Verwendung

- verschiedene

- riesig

- Version

- Anzeigen

- Virginia

- Assistent

- Besuchen Sie

- Walkthrough

- wurde

- Weg..

- we

- Netz

- Web-Services

- Wochen

- GUT

- wann

- welche

- während

- weit

- Wikipedia

- werden wir

- mit

- .

- ohne

- gearbeitet

- Arbeiter

- würde

- Du

- Ihr

- Zephyrnet