Dieser Beitrag wurde in Zusammenarbeit mit Brad Duncan, Rachel Johnson und Richard Alcock von MathWorks verfasst.

MATLAB ist ein beliebtes Programmierwerkzeug für eine Vielzahl von Anwendungen wie Datenverarbeitung, paralleles Rechnen, Automatisierung, Simulation, maschinelles Lernen und künstliche Intelligenz. Es wird in vielen Branchen wie der Automobilindustrie, der Luft- und Raumfahrtindustrie, der Kommunikation und der Fertigung stark genutzt. In den letzten Jahren hat MathWorks vor allem viele Produktangebote in die Cloud gebracht Amazon Web Services (AWS). Weitere Einzelheiten zu den Cloud-Produkten von MathWorks finden Sie unter MATLAB und Simulink in der Cloud or E-Mail an Mathworks.

In diesem Beitrag stellen wir die maschinellen Lernfunktionen von MATLAB vor Amazon Sage Maker, was mehrere wesentliche Vorteile hat:

- Rechenressourcen: Die Verwendung der von SageMaker angebotenen Hochleistungscomputerumgebung kann das Training für maschinelles Lernen beschleunigen.

- Zusammenarbeit: MATLAB und SageMaker bieten zusammen eine robuste Plattform, die Teams für die effektive Zusammenarbeit beim Erstellen, Testen und Bereitstellen von Modellen für maschinelles Lernen nutzen können.

- Bereitstellung und Zugänglichkeit: Modelle können als SageMaker-Echtzeitendpunkte bereitgestellt werden, sodass sie für andere Anwendungen zur Verarbeitung von Live-Streaming-Daten leicht zugänglich sind.

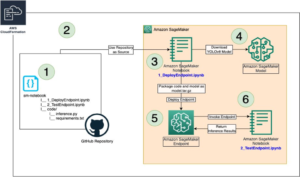

Wir zeigen Ihnen, wie Sie ein MATLAB-Modell für maschinelles Lernen als SageMaker-Trainingsjob trainieren und das Modell dann als SageMaker-Echtzeitendpunkt bereitstellen, damit es Live-Streaming-Daten verarbeiten kann.

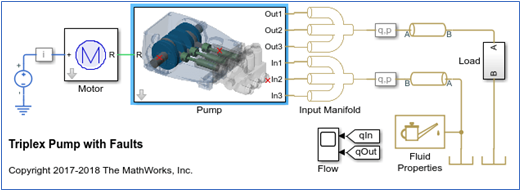

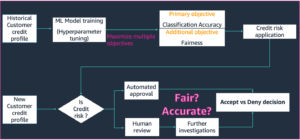

Dazu verwenden wir ein Beispiel für vorausschauende Wartung, bei dem wir Fehler in einer betriebsbereiten Pumpe klassifizieren, die Live-Sensordaten überträgt. Wir haben Zugriff auf ein großes Repository mit gekennzeichneten Daten, die aus a generiert wurden Simulink Simulation, die drei mögliche Fehlertypen in verschiedenen möglichen Kombinationen aufweist (z. B. einen fehlerfreien und sieben fehlerhafte Zustände). Da wir über ein Modell des Systems verfügen und Fehler im Betrieb selten sind, können wir simulierte Daten nutzen, um unseren Algorithmus zu trainieren. Das Modell kann mithilfe von Parameterschätzungstechniken in MATLAB und Simulink so abgestimmt werden, dass es mit den Betriebsdaten unserer realen Pumpe übereinstimmt.

Unser Ziel ist es, die kombinierte Leistungsfähigkeit von MATLAB und Amazon SageMaker anhand dieses Fehlerklassifizierungsbeispiels zu demonstrieren.

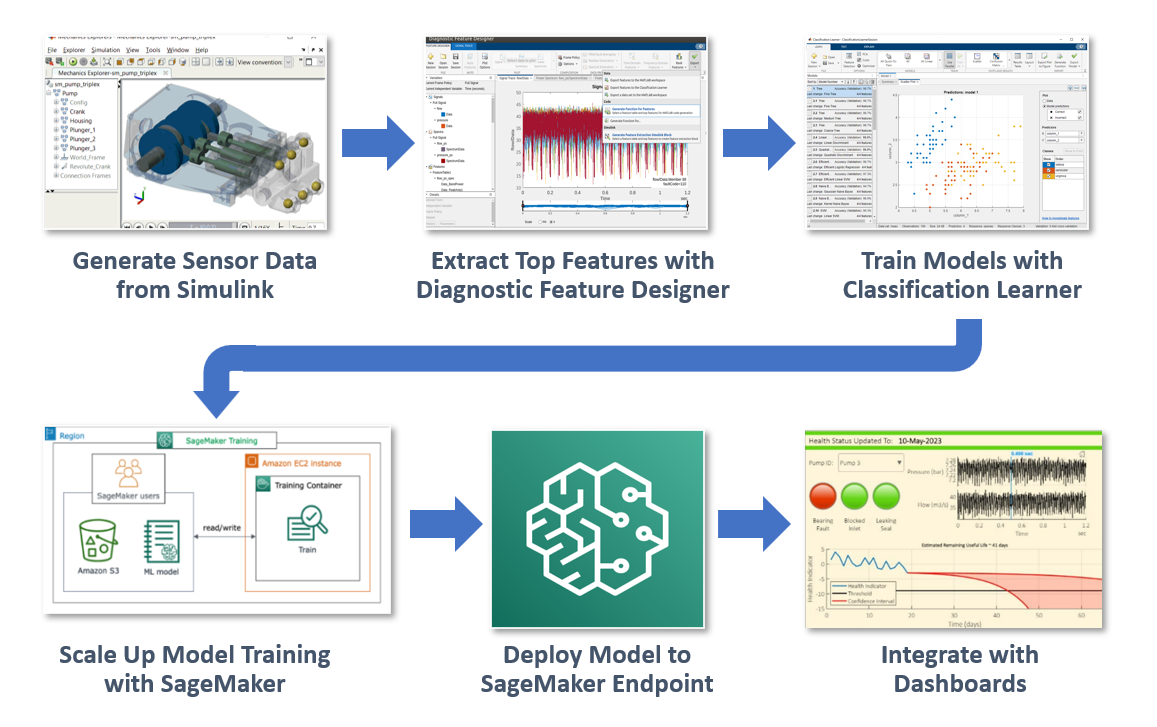

Wir beginnen mit dem Training eines Klassifikatormodells auf unserem Desktop mit MATLAB. Zuerst extrahieren wir mithilfe von Features aus einer Teilmenge des gesamten Datensatzes Diagnosefunktionsdesigner App und führen Sie dann das Modelltraining lokal mit einem MATLAB-Entscheidungsbaummodell aus. Sobald wir mit den Parametereinstellungen zufrieden sind, können wir eine MATLAB-Funktion generieren und den Job zusammen mit dem Datensatz an SageMaker senden. Dies ermöglicht es uns, den Trainingsprozess zu skalieren, um viel größere Datensätze zu verarbeiten. Nachdem wir unser Modell trainiert haben, stellen wir es als Live-Endpunkt bereit, der in eine nachgelagerte App oder ein nachgelagertes Dashboard, beispielsweise eine MATLAB-Web-App, integriert werden kann.

Dieses Beispiel fasst jeden Schritt zusammen und vermittelt ein praktisches Verständnis dafür, wie MATLAB und Amazon SageMaker für maschinelle Lernaufgaben genutzt werden können. Den vollständigen Code und die Beschreibung für das Beispiel finden Sie hier Quelle.

Voraussetzungen:

- Arbeitsumgebung von MATLAB 2023a oder höher mit MATLAB Compiler und der Statistics and Machine Learning Toolbox unter Linux. Hier ist ein Kurzanleitung zur Ausführung von MATLAB auf AWS.

- Docker in einem eingerichtet Amazon Elastic Compute Cloud (Amazon EC2) Instanz, in der MATLAB ausgeführt wird. Entweder Ubuntu or Linux.

- Installation AWS-Befehlszeilenschnittstelle (AWS CLI), AWS-Konfiguration und Python3.

- AWS CLI sollte bereits installiert sein, wenn Sie der Installationsanleitung von gefolgt sind Step.

- Richten Sie AWSConfigure ein um mit AWS-Ressourcen zu interagieren.

- Überprüfen Sie Ihre Python3-Installation, indem Sie Folgendes ausführen

python -Vorpython --versionBefehl auf Ihrem Terminal. Installieren Sie bei Bedarf Python.

- Kopieren Sie dieses Repo in einen Ordner auf Ihrem Linux-Computer, indem Sie Folgendes ausführen:

- Überprüfen Sie die Berechtigung für den Repo-Ordner. Wenn es keine Schreibberechtigung hat, führen Sie den folgenden Shell-Befehl aus:

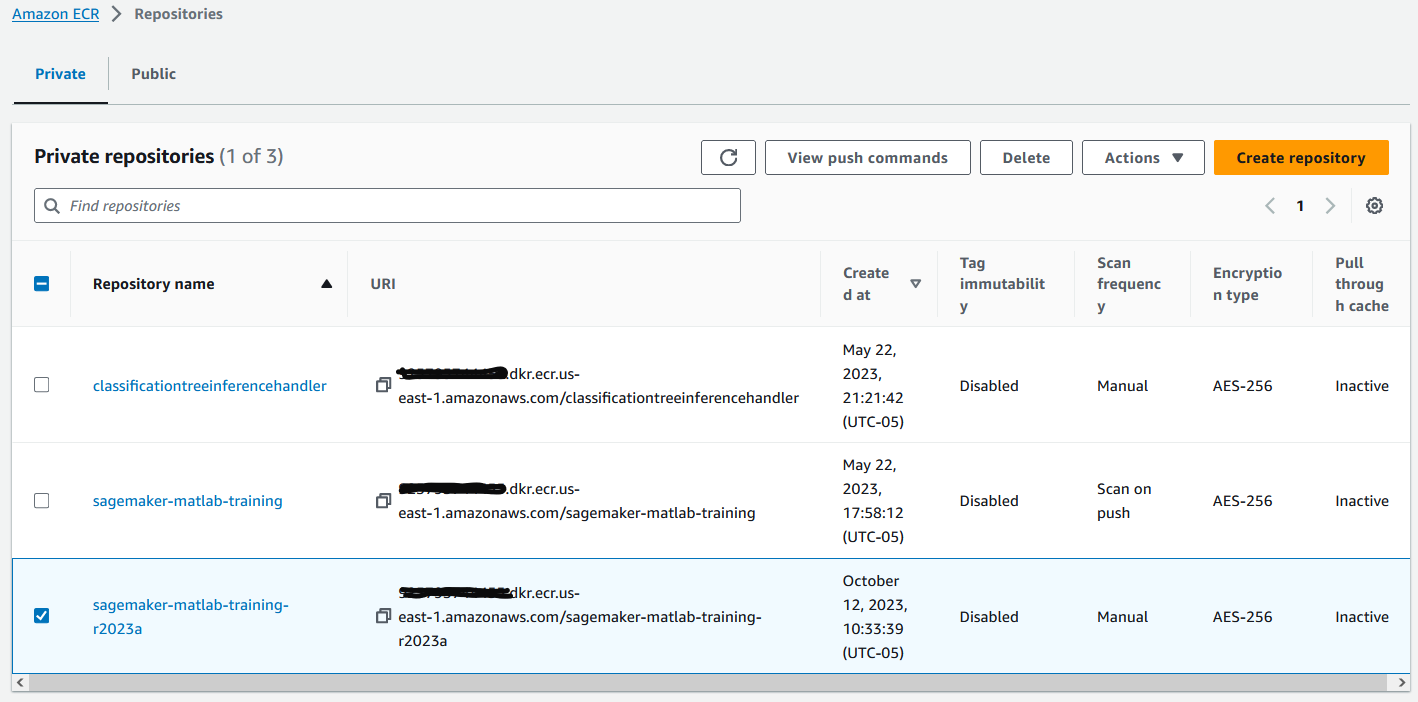

- Erstellen Sie den MATLAB-Trainingscontainer und verschieben Sie ihn Amazon Elastic Container Registry (Amazon ECR).

- Navigieren Sie zum Ordner

docker - Erstellen Sie ein Amazon ECR-Repository mit der AWS CLI (ersetzen Sie REGION durch Ihre bevorzugte AWS-Region).

- Führen Sie den folgenden Docker-Befehl aus:

- Navigieren Sie zum Ordner

- Öffnen Sie MATLAB und öffnen Sie das aufgerufene Live-Skript

PumpFaultClassificationMATLABSageMaker.mlxim Ordnerexamples/PumpFaultClassification. Machen Sie diesen Ordner zu Ihrem aktuellen Arbeitsordner in MATLAB.

Teil 1: Datenvorbereitung und Merkmalsextraktion

Der erste Schritt in jedem maschinellen Lernprojekt ist die Vorbereitung Ihrer Daten. MATLAB bietet eine breite Palette von Tools zum Importieren, Bereinigen und Extrahieren von Funktionen aus Ihren Daten:

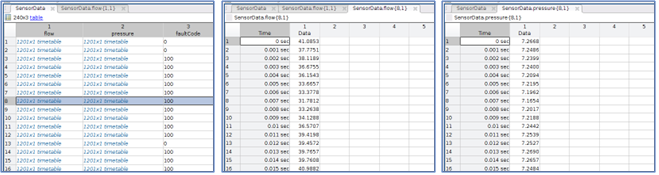

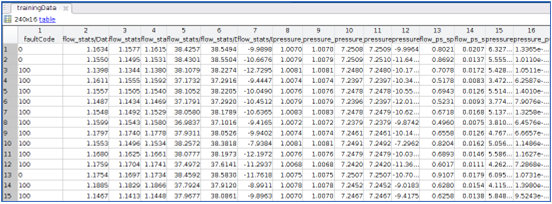

Das SensorData.mat Der Datensatz enthält 240 Datensätze. Jeder Datensatz verfügt über zwei Zeitpläne: flow und pressure. Die Zielspalte ist faultcode, eine binäre Darstellung von drei möglichen Fehlerkombinationen in der Pumpe. Für diese Zeitreihentabellen verfügt jede Tabelle über 1,201 Zeilen, die 1.2 Sekunden Pumpenfluss- und Druckmessung mit Schritten von 0.001 Sekunden nachahmen.

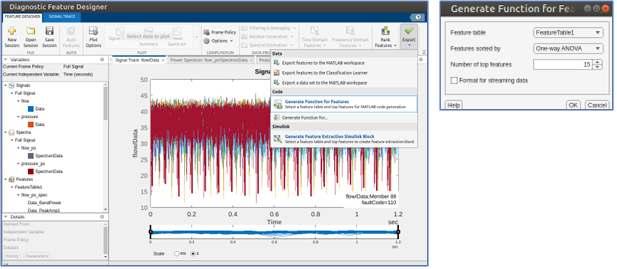

Anschließend können Sie mit der Diagnostic Feature Designer-App eine Vielzahl von Features aus den Daten extrahieren, visualisieren und bewerten. Hier verwenden Sie Automatische Funktionen, das schnell eine breite Palette von Zeit- und Frequenzbereichsmerkmalen aus dem Datensatz extrahiert und die Top-Kandidaten für das Modelltraining einstuft. Anschließend können Sie eine MATLAB-Funktion exportieren, die die 15 am besten bewerteten Features aus neuen Eingabedaten neu berechnet. Rufen wir diese Funktion auf extractFeaturesTraining. Diese Funktion kann so konfiguriert werden, dass sie alle Daten in einem Stapel oder als Streaming-Daten aufnimmt.

Diese Funktion erstellt eine Funktionstabelle mit zugehörigen Fehlercodes, wie in der folgenden Abbildung dargestellt:

Teil 2: Daten für SageMaker organisieren

Als Nächstes müssen Sie die Daten so organisieren, dass SageMaker sie für das Training des maschinellen Lernens verwenden kann. Typischerweise umfasst dies die Aufteilung der Daten in Trainings- und Validierungssätze sowie die Aufteilung der Prädiktordaten von der Zielantwort.

In dieser Phase sind möglicherweise weitere komplexere Datenbereinigungs- und Filtervorgänge erforderlich. In diesem Beispiel sind die Daten bereits sauber. Wenn die Datenverarbeitung sehr komplex und zeitaufwändig ist, können möglicherweise SageMaker-Verarbeitungsjobs verwendet werden, um diese Jobs unabhängig von der SageMaker-Schulung auszuführen, sodass sie in zwei Schritte unterteilt werden können.

trainPredictors = trainingData(:,2:end);

trainResponse = trainingData(:,1);

Teil 3: Trainieren und testen Sie ein Modell für maschinelles Lernen in MATLAB

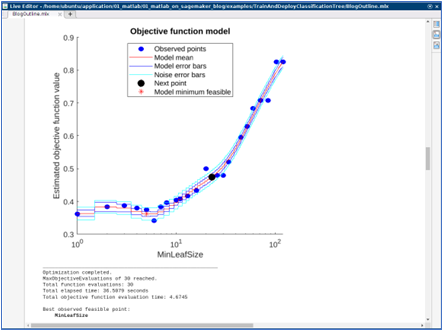

Bevor Sie zu SageMaker wechseln, empfiehlt es sich, das Modell für maschinelles Lernen lokal in MATLAB zu erstellen und zu testen. Dadurch können Sie das Modell schnell iterieren und debuggen. Sie können einen einfachen Entscheidungsbaumklassifikator lokal einrichten und trainieren.

classifierModel = fitctree(... trainPredictors,... trainResponse,... OptimizeHyperparameters='auto');

Der Trainingsauftrag hier sollte weniger als eine Minute in Anspruch nehmen und es werden einige Diagramme generiert, die den Trainingsfortschritt anzeigen. Nach Abschluss des Trainings wird ein MATLAB-Modell für maschinelles Lernen erstellt. Der Klassifizierungslerner Die App kann verwendet werden, um viele Arten von Klassifizierungsmodellen auszuprobieren und sie für die beste Leistung zu optimieren. Anschließend kann der erforderliche Code erstellt werden, um den oben genannten Modelltrainingscode zu ersetzen.

Nachdem wir die Genauigkeitsmetriken für das lokal trainierte Modell überprüft haben, können wir das Training in Amazon SageMaker verschieben.

Teil 4: Trainieren Sie das Modell in Amazon SageMaker

Wenn Sie mit dem Modell zufrieden sind, können Sie es mit SageMaker maßstabsgetreu trainieren. Um mit dem Aufrufen von SageMaker SDKs zu beginnen, müssen Sie eine SageMaker-Sitzung starten.

session = sagemaker.Session();

Geben Sie eine SageMaker-Ausführung an IAM-Rolle dass Trainingsjobs und Endpunkt-Hosting verwendet werden.

role = "arn:aws:iam::ACCOUNT:role/service-role/AmazonSageMaker-ExecutionRole-XXXXXXXXXXXXXXX";

Speichern Sie die Trainingsdaten in MATLAB als CSV-Datei in einem Einfacher Amazon-Speicherdienst (Amazon S3) Eimer.

writetable(trainingData,'pump_training_data.csv');

trainingDataLocation = "s3:// "+session.DefaultBucket+ +"/cooling_system/input/pump_training";

copyfile("pump_training_data.csv", trainingDataLocation);

Erstellen Sie einen SageMaker-Schätzer

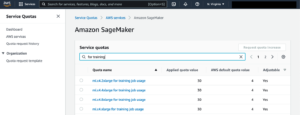

Als Nächstes müssen Sie einen SageMaker-Schätzer erstellen und ihm alle erforderlichen Parameter übergeben, z. B. ein Trainings-Docker-Image, eine Trainingsfunktion, Umgebungsvariablen, die Größe der Trainingsinstanz usw. Der Trainingsbild-URI sollte der Amazon ECR-URI sein, den Sie im Voraussetzungsschritt mit dem Format erstellt haben ACCOUNT.dkr.ecr.us-east-1.amazonaws.com/sagemaker-matlab-training-r2023a:latest. Die Trainingsfunktion sollte am Ende des MATLAB-Live-Skripts bereitgestellt werden.

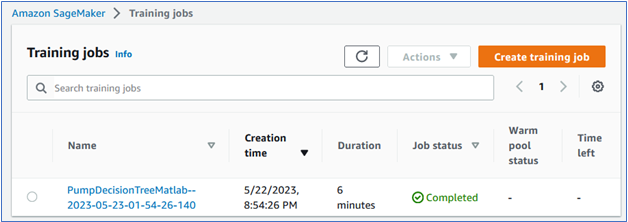

Senden Sie einen SageMaker-Schulungsauftrag

Durch Aufrufen der Fit-Methode vom Schätzer wird der Trainingsauftrag an SageMaker übermittelt.

est.fit(training=struct(Location=trainingDataLocation, ContentType="text/csv"))

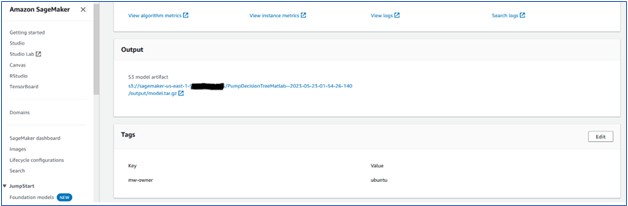

Sie können den Trainingsauftragsstatus auch über die SageMaker-Konsole überprüfen:

Nachdem die Schulungsjobs abgeschlossen sind, gelangen Sie durch Auswahl des Job-Links zur Seite mit der Jobbeschreibung, auf der Sie das MATLAB-Modell sehen können, das im dedizierten S3-Bucket gespeichert ist:

Teil 5: Stellen Sie das Modell als Echtzeit-SageMaker-Endpunkt bereit

Nach dem Training können Sie das Modell als Echtzeit-SageMaker-Endpunkt bereitstellen, mit dem Sie Vorhersagen in Echtzeit treffen können. Rufen Sie dazu die Deploy-Methode vom Schätzer aus auf. Hier können Sie je nach Arbeitslast die gewünschte Instanzgröße für das Hosting einstellen.

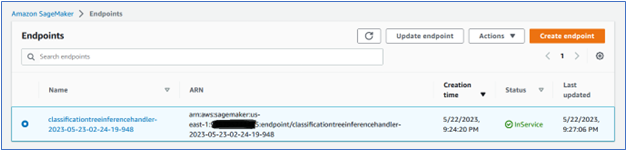

Hinter den Kulissen erstellt dieser Schritt ein Inferenz-Docker-Image und überträgt es an das Amazon ECR-Repository. Für die Erstellung des Inferenzcontainers ist vom Benutzer nichts erforderlich. Das Bild enthält alle notwendigen Informationen, um die Inferenzanforderung zu bedienen, wie z. B. den Standort des Modells, MATLAB-Authentifizierungsinformationen und Algorithmen. Anschließend erstellt Amazon SageMaker eine SageMaker-Endpunktkonfiguration und stellt schließlich den Echtzeit-Endpunkt bereit. Der Endpunkt kann in der SageMaker-Konsole überwacht und jederzeit beendet werden, wenn er nicht mehr verwendet wird.

Teil 6: Testen Sie den Endpunkt

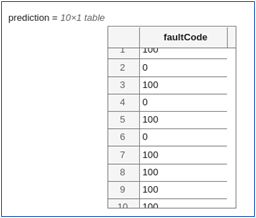

Da der Endpunkt nun betriebsbereit ist, können Sie ihn testen, indem Sie ihm einige Datensätze zur Vorhersage geben. Verwenden Sie den folgenden Code, um 10 Datensätze aus den Trainingsdaten auszuwählen und sie zur Vorhersage an den Endpunkt zu senden. Das Vorhersageergebnis wird vom Endpunkt zurückgesendet und im folgenden Bild angezeigt.

Teil 7: Dashboard-Integration

Der SageMaker-Endpunkt kann von vielen nativen AWS-Diensten aufgerufen werden. Es kann auch als Standard-REST-API verwendet werden, wenn es zusammen mit einem bereitgestellt wird AWS Lambda Funktion und API-Gateway, die in beliebige Webanwendungen integriert werden können. Für diesen speziellen Anwendungsfall können Sie die Streaming-Aufnahme mit Amazon SageMaker Feature Store und Amazon Managed Streaming für Apache Kafka, MSK, verwenden, um durch maschinelles Lernen unterstützte Entscheidungen nahezu in Echtzeit zu treffen. Eine weitere mögliche Integration ist die Verwendung einer Kombination von Amazon Kinesis, SageMaker und Apache Flink, um eine verwaltete, zuverlässige, skalierbare und hochverfügbare Anwendung zu erstellen, die in der Lage ist, Echtzeit-Rückschlüsse auf einen Datenstrom zu ziehen.

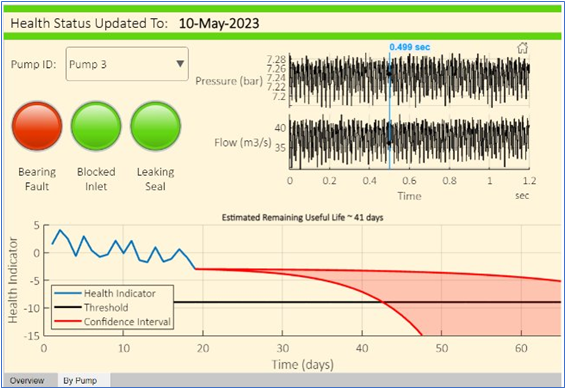

Nachdem Algorithmen auf einem SageMaker-Endpunkt bereitgestellt wurden, möchten Sie sie möglicherweise mithilfe eines Dashboards visualisieren, das Streaming-Vorhersagen in Echtzeit anzeigt. In der folgenden benutzerdefinierten MATLAB-Web-App können Sie Druck- und Durchflussdaten nach Pumpe sowie Live-Fehlervorhersagen aus dem bereitgestellten Modell anzeigen.

Dieses Dashboard enthält ein Modell der verbleibenden Nutzungsdauer (RUL), um die Zeit bis zum Ausfall für jede betreffende Pumpe vorherzusagen. Informationen zum Trainieren von RUL-Algorithmen finden Sie unter Predictive Maintenance Toolbox.

Aufräumen

Stellen Sie nach der Ausführung dieser Lösung sicher, dass Sie alle nicht benötigten AWS-Ressourcen bereinigen, um unerwartete Kosten zu vermeiden. Sie können diese Ressourcen mit bereinigen SageMaker Python-SDK oder die AWS-Managementkonsole für die hier verwendeten spezifischen Dienste (SageMaker, Amazon ECR und Amazon S3). Durch das Löschen dieser Ressourcen vermeiden Sie weitere Gebühren für Ressourcen, die Sie nicht mehr nutzen.

Zusammenfassung

Wir haben gezeigt, wie Sie MATLAB für einen Anwendungsfall zur vorausschauenden Pumpenwartung mit dem gesamten maschinellen Lernlebenszyklus in SageMaker integrieren können. SageMaker bietet eine vollständig verwaltete Umgebung zum Ausführen von Workloads für maschinelles Lernen und zum Bereitstellen von Modellen mit einer großen Auswahl an Recheninstanzen, die verschiedene Anforderungen erfüllen.

Haftungsausschluss: Der in diesem Beitrag verwendete Code ist Eigentum von MathWorks und wird von MathWorks verwaltet. Weitere Informationen finden Sie in den Lizenzbedingungen im GitHub-Repo. Bei Problemen mit dem Code oder Funktionsanfragen öffnen Sie bitte ein GitHub-Issue im Repository

Bibliographie

Über die Autoren

Brad Duncan ist Produktmanager für maschinelle Lernfunktionen in der Statistics and Machine Learning Toolbox bei MathWorks. Er arbeitet mit Kunden zusammen, um KI in neuen Bereichen der Technik anzuwenden, beispielsweise bei der Integration virtueller Sensoren in technische Systeme, dem Aufbau erklärbarer Modelle für maschinelles Lernen und der Standardisierung von KI-Workflows mithilfe von MATLAB und Simulink. Bevor er zu MathWorks kam, leitete er Teams für 3D-Simulation und Optimierung der Fahrzeugaerodynamik, Benutzererfahrung für 3D-Simulation und Produktmanagement für Simulationssoftware. Brad ist außerdem Gastdozent an der Tufts University im Bereich Fahrzeugaerodynamik.

Brad Duncan ist Produktmanager für maschinelle Lernfunktionen in der Statistics and Machine Learning Toolbox bei MathWorks. Er arbeitet mit Kunden zusammen, um KI in neuen Bereichen der Technik anzuwenden, beispielsweise bei der Integration virtueller Sensoren in technische Systeme, dem Aufbau erklärbarer Modelle für maschinelles Lernen und der Standardisierung von KI-Workflows mithilfe von MATLAB und Simulink. Bevor er zu MathWorks kam, leitete er Teams für 3D-Simulation und Optimierung der Fahrzeugaerodynamik, Benutzererfahrung für 3D-Simulation und Produktmanagement für Simulationssoftware. Brad ist außerdem Gastdozent an der Tufts University im Bereich Fahrzeugaerodynamik.

Richard Alcock ist Senior Development Manager für Cloud Platform Integrations bei MathWorks. In dieser Rolle ist er maßgeblich an der nahtlosen Integration von MathWorks-Produkten in Cloud- und Containerplattformen beteiligt. Er entwickelt Lösungen, die es Ingenieuren und Wissenschaftlern ermöglichen, das volle Potenzial von MATLAB und Simulink in cloudbasierten Umgebungen auszuschöpfen. Zuvor war er als Software-Ingenieur bei MathWorks tätig und entwickelte Lösungen zur Unterstützung paralleler und verteilter Computer-Workflows.

Richard Alcock ist Senior Development Manager für Cloud Platform Integrations bei MathWorks. In dieser Rolle ist er maßgeblich an der nahtlosen Integration von MathWorks-Produkten in Cloud- und Containerplattformen beteiligt. Er entwickelt Lösungen, die es Ingenieuren und Wissenschaftlern ermöglichen, das volle Potenzial von MATLAB und Simulink in cloudbasierten Umgebungen auszuschöpfen. Zuvor war er als Software-Ingenieur bei MathWorks tätig und entwickelte Lösungen zur Unterstützung paralleler und verteilter Computer-Workflows.

Rachel Johnson ist Produktmanager für Predictive Maintenance bei MathWorks und verantwortlich für die gesamte Produktstrategie und das Marketing. Zuvor war sie als Anwendungsingenieurin tätig und unterstützte die Luft- und Raumfahrtindustrie direkt bei Projekten zur vorausschauenden Wartung. Vor MathWorks war Rachel Aerodynamik- und Antriebssimulationsingenieurin für die US Navy. Außerdem unterrichtete sie mehrere Jahre lang Mathematik, Physik und Ingenieurwissenschaften.

Rachel Johnson ist Produktmanager für Predictive Maintenance bei MathWorks und verantwortlich für die gesamte Produktstrategie und das Marketing. Zuvor war sie als Anwendungsingenieurin tätig und unterstützte die Luft- und Raumfahrtindustrie direkt bei Projekten zur vorausschauenden Wartung. Vor MathWorks war Rachel Aerodynamik- und Antriebssimulationsingenieurin für die US Navy. Außerdem unterrichtete sie mehrere Jahre lang Mathematik, Physik und Ingenieurwissenschaften.

Meide Mao ist Senior AI/ML Partner Solutions Architect im Emerging Technologies-Team bei Amazon Web Services. Seine Leidenschaft liegt in der Zusammenarbeit mit Unternehmenskunden und Partnern, um KI/ML-Anwendungen zu entwerfen, bereitzustellen und zu skalieren, um deren Geschäftswerte abzuleiten. Außerhalb der Arbeit geht er gerne angeln, reisen und Tischtennis spielen.

Meide Mao ist Senior AI/ML Partner Solutions Architect im Emerging Technologies-Team bei Amazon Web Services. Seine Leidenschaft liegt in der Zusammenarbeit mit Unternehmenskunden und Partnern, um KI/ML-Anwendungen zu entwerfen, bereitzustellen und zu skalieren, um deren Geschäftswerte abzuleiten. Außerhalb der Arbeit geht er gerne angeln, reisen und Tischtennis spielen.

Ramesh Jatiya ist Lösungsarchitekt im Independent Software Vendor (ISV)-Team bei Amazon Web Services. Er arbeitet leidenschaftlich gerne mit ISV-Kunden zusammen, um deren Anwendungen in der Cloud zu entwerfen, bereitzustellen und zu skalieren, um daraus Geschäftswerte abzuleiten. Er absolviert außerdem einen MBA in maschinellem Lernen und Business Analytics am Babson College in Boston. Außerhalb der Arbeit geht er gerne laufen, Tennis spielen und kochen.

Ramesh Jatiya ist Lösungsarchitekt im Independent Software Vendor (ISV)-Team bei Amazon Web Services. Er arbeitet leidenschaftlich gerne mit ISV-Kunden zusammen, um deren Anwendungen in der Cloud zu entwerfen, bereitzustellen und zu skalieren, um daraus Geschäftswerte abzuleiten. Er absolviert außerdem einen MBA in maschinellem Lernen und Business Analytics am Babson College in Boston. Außerhalb der Arbeit geht er gerne laufen, Tennis spielen und kochen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/machine-learning-with-matlab-and-amazon-sagemaker/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 001

- 1

- 10

- 100

- 15%

- 152

- 19

- 20

- 3d

- 7

- 8

- a

- Über Uns

- oben

- Zugang

- zugänglich

- unterbringen

- Konto

- Genauigkeit

- Vorteil

- Luft- und Raumfahrt

- Nach der

- AI

- AI / ML

- Algorithmus

- Algorithmen

- Alle

- erlaubt

- entlang

- bereits

- ebenfalls

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon Web Services

- an

- Analytik

- und

- Ein anderer

- jedem

- Apache

- auseinander

- Bienen

- App

- App erlaubt

- Anwendung

- Anwendungen

- Bewerbung

- SIND

- Bereich

- Bereiche

- künstlich

- künstliche Intelligenz

- AS

- damit verbundenen

- At

- Authentifizierung

- Auto

- Automation

- Automobilindustrie

- verfügbar

- vermeiden

- AWS

- AWS-Managementkonsole

- Babson

- Zurück

- BE

- weil

- Bevor

- beginnen

- Vorteile

- BESTE

- Boston

- Boden

- Stift

- bringen

- breit

- gebracht

- bauen

- Building

- baut

- Geschäft

- by

- rufen Sie uns an!

- namens

- Aufruf

- CAN

- Kandidaten

- Fähigkeiten

- fähig

- Häuser

- Gebühren

- aus der Ferne überprüfen

- Überprüfung

- Einstufung

- klassifizieren

- reinigen

- Reinigung

- Cloud

- Cloud-Plattform

- Code

- Codes

- zusammenarbeiten

- Zusammenarbeit

- Hochschule

- Kolonne

- COM

- Kombination

- Kombinationen

- kombiniert

- Kommen

- Kommunikation

- Komplex

- Berechnen

- Computing

- Konfiguration

- konfiguriert

- Konsul (Console)

- verbrauchenden

- Container

- enthält

- Kosten

- erstellen

- erstellt

- schafft

- Strom

- Original

- Kunden

- Armaturenbrett

- technische Daten

- Datenaufbereitung

- Datenverarbeitung

- Datensätze

- Entscheidung

- Entscheidungen

- gewidmet

- zeigen

- Synergie

- Abhängig

- einsetzen

- Einsatz

- Bereitstellen

- setzt ein

- ableiten

- Beschreibung

- Design

- Designer

- erwünscht

- Desktop

- Details

- Entwicklung

- Entwicklung

- Diagnose

- Direkt

- Displays

- verteilt

- Verteiltes rechnen

- do

- Docker

- die

- Domain

- Duncan

- jeder

- effektiv

- entweder

- aufstrebenden

- aufkommende Technologien

- ermöglichen

- Ende

- Endpunkt

- Ingenieur

- entwickelt

- Entwicklung

- Ingenieure

- Unternehmen

- Ganz

- Arbeitsumfeld

- Umgebungen

- insbesondere

- Beispiel

- Ausführung

- ERFAHRUNGEN

- exportieren

- Extrakt

- KONZENTRAT

- Scheitern

- Fehler

- fehlerhaft

- Merkmal

- Eigenschaften

- wenige

- Abbildung

- Reichen Sie das

- Filterung

- Endlich

- Fertig

- Vorname

- Fischen

- passen

- Fluss

- gefolgt

- Folgende

- folgt

- Aussichten für

- Format

- Frequenz

- für

- voller

- voll

- Funktion

- weiter

- Tor

- erzeugen

- erzeugt

- erzeugt

- GitHub

- Unterstützung

- gut

- Graphen

- groß

- GUEST

- Guide

- Geschirr

- Haben

- he

- Gesundheit

- gesund

- schwer

- hier

- Hohe Leistungsfähigkeit

- hoch

- Hosting

- Ultraschall

- Hilfe

- HTML

- HTTPS

- Idee

- if

- Image

- Einfuhr

- in

- Dazu gehören

- einarbeiten

- Zuwachs

- unabhängig

- zeigen

- Branchen

- Energiegewinnung

- Information

- initiieren

- Varianten des Eingangssignals:

- installieren

- Installation

- installiert

- Instanz

- instrumental

- integriert

- Integration

- Integration

- Integrationen

- Intelligenz

- interagieren

- Schnittstelle

- in

- Problem

- Probleme

- Isv

- IT

- Job

- Jobs

- Johnson

- jpg

- grosse

- größer

- später

- neueste

- LERNEN

- lernen

- geführt

- weniger

- Hebelwirkung

- Lizenz

- Lebensdauer

- Lebenszyklus

- LINK

- linux

- leben

- örtlich

- Standorte

- login

- länger

- Maschine

- Maschinelles Lernen

- Wartung

- um

- Making

- verwaltet

- Management

- Manager

- Herstellung

- viele

- Marketing

- Spiel

- Mathe

- Messung

- Methode

- Metrik

- könnte

- Minute

- ML

- Modell

- für

- Überwachen

- überwacht

- mehr

- schlauer bewegen

- ziehen um

- viel

- Namens

- nativen

- In der Nähe von

- notwendig,

- Need

- erforderlich

- Bedürfnisse

- Neu

- nicht

- nichts

- Ziel

- of

- angeboten

- Angebote

- on

- einmal

- EINEM

- XNUMXh geöffnet

- Betrieb

- Betriebs-

- Einkauf & Prozesse

- Optimierung

- or

- Andere

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- aussen

- Gesamt-

- Besitz

- Seite

- Parallel

- Parameter

- Parameter

- besondere

- Partner

- passieren

- leidenschaftlich

- Leistung

- Erlaubnis

- Physik

- Plattform

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielend

- Bitte

- Beliebt

- möglich

- Post

- Potenzial

- möglicherweise

- Werkzeuge

- Praktisch

- vorhersagen

- Prognose

- Prognosen

- Predictor

- bevorzugt

- Vorbereitung

- Danach

- Druck

- verhindern

- vorher

- Vor

- Prozessdefinierung

- Verarbeitung

- produziert

- Produziert

- produziert

- Produkt

- Produktmanagement

- Produkt-Manager

- Produkte

- Programmierung

- Fortschritt

- Projekt

- Projekte

- Antrieb

- die

- vorausgesetzt

- bietet

- Bereitstellung

- Pumpe

- Push

- schiebt

- Python

- Frage

- schnell

- Angebot

- Rang

- Platz

- Rangstufen

- RARE

- leicht

- echt

- Echtzeit

- kürzlich

- Rekord

- Aufzeichnungen

- siehe

- Region

- Registratur

- zuverlässig

- verbleibenden

- ersetzen

- Quelle

- Darstellung

- Anforderung

- Zugriffe

- falls angefordert

- Downloads

- Antwort

- für ihren Verlust verantwortlich.

- REST

- Folge

- Daniel

- robust

- Rollen

- Führen Sie

- Laufen

- sagemaker

- zufrieden

- zufrieden

- Speichern

- Gerettet

- skalierbaren

- Skalieren

- Szenen

- Wissenschaftler

- Skript

- SDKS

- nahtlos

- Sekunden

- sehen

- Auswahl

- Auswahl

- senden

- Senior

- Sensoren

- geschickt

- Modellreihe

- brauchen

- Lösungen

- Dienst

- Sitzung

- kompensieren

- Sets

- Einstellungen

- sieben

- mehrere

- sie

- Schale

- sollte

- erklären

- gezeigt

- signifikant

- Einfacher

- Simulation

- Größe

- So

- Software

- Softwareentwicklung

- Lösung

- Lösungen

- einige

- spezifisch

- Geschwindigkeit

- verbrachte

- Stufe

- Standard

- Standardisierung

- Anfang

- Staaten

- Statistiken

- Status

- Schritt

- Shritte

- Lagerung

- speichern

- Strategie

- Strom

- Streaming

- so

- zusammenfassen

- Support

- Unterstützung

- sicher

- System

- Systeme und Techniken

- Tabelle

- TAG

- Nehmen

- nimmt

- Target

- und Aufgaben

- Einführungen

- Team

- Teams

- Techniken

- Technologies

- Terminal

- AGB

- Test

- Testen

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Gegend

- ihr

- Sie

- dann

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- nach drei

- Zeit

- Zeitfolgen

- zu

- gemeinsam

- Werkzeug

- Tools

- Werkzeuge

- Top

- Training

- Ausbildung

- Reise

- Baum

- versuchen

- Melodie

- abgestimmt

- XNUMX

- Typen

- typisch

- Verständnis

- Unerwartet

- Universität

- us

- -

- Anwendungsfall

- benutzt

- Mitglied

- Benutzererfahrung

- Verwendung von

- Bestätigung

- Werte

- Vielfalt

- verschiedene

- Fahrzeug

- Verkäufer

- sehr

- Assistent

- visualisieren

- wollen

- wurde

- Weg..

- we

- Netz

- Web Applikationen

- Web-Services

- welche

- breit

- Große Auswahl

- werden wir

- mit

- Arbeiten

- Workflows

- arbeiten,

- Werk

- schreiben

- geschrieben

- Jahr

- Du

- Ihr

- Zephyrnet