Wir haben kürzlich eine neue Funktion in eingeführt Amazon SageMaker Python-SDK Dadurch können Data Scientists ihren Machine Learning (ML)-Code, der in ihrer bevorzugten integrierten Entwicklerumgebung (IDE) und Notebooks erstellt wurde, zusammen mit den zugehörigen Laufzeitabhängigkeiten als ausführen Amazon Sage Maker Trainingsjobs mit minimalen Codeänderungen an den lokal durchgeführten Experimenten. Data Scientists führen in der Regel mehrere Iterationen von Experimenten in der Datenverarbeitung durch und trainieren Modelle, während sie an einem beliebigen ML-Problem arbeiten. Sie möchten diesen ML-Code ausführen und die Experimente mit Benutzerfreundlichkeit und minimaler Codeänderung durchführen. Amazon SageMaker-Modellschulung unterstützt Datenwissenschaftler bei der Ausführung vollständig verwalteter umfangreicher Schulungsaufträge auf der Recheninfrastruktur von AWS. SageMaker Training hilft Datenwissenschaftlern auch mit fortschrittlichen Tools wie z Amazon SageMaker-Debugger und Profiler zum Debuggen und Analysieren ihrer umfangreichen Trainingsjobs.

Bei Kunden mit kleinen Budgets, kleinen Teams und knappen Zeitplänen macht jedes einzelne neue Konzept und jede Codezeile, die für die Ausführung auf SageMaker neu geschrieben wurde, sie weniger produktiv bei ihren Kernaufgaben, nämlich der Datenverarbeitung und dem Training von ML-Modellen. Sie möchten Code einmal im Framework ihrer Wahl schreiben und in der Lage sein, mithilfe von SageMaker-Funktionen nahtlos von der Ausführung von Code in ihren Notebooks oder Laptops zur Ausführung von Code in großem Maßstab überzugehen.

Mit dieser neuen Funktion des SageMaker Python SDK können Data Scientists ihren ML-Code in wenigen Minuten in die SageMaker-Schulungsplattform integrieren. Sie müssen Ihrem ML-Code nur eine einzige Codezeile hinzufügen, und SageMaker versteht Ihren Code auf intelligente Weise zusammen mit den Datensätzen und der Einrichtung der Arbeitsbereichsumgebung und führt ihn als SageMaker-Schulungsjob aus. Sie können dann die wichtigsten Funktionen der SageMaker-Schulungsplattform nutzen, z. B. die Möglichkeit, Jobs einfach zu skalieren, und andere zugehörige Tools wie Debugger und Profiler. In dieser Version können Sie Ihren lokalen Python-Code für maschinelles Lernen (ML) als Einzelknoten-Amazon SageMaker-Trainingsauftrag oder als mehrere parallele Aufträge ausführen. Verteilte Trainingsjobs (über mehrere Knoten) werden von Remote-Funktionen nicht unterstützt.

In diesem Beitrag zeigen wir Ihnen, wie Sie diese neue Funktion verwenden, um lokalen ML-Code als SageMaker-Schulungsjob auszuführen.

Lösungsüberblick

Sie können jetzt Ihren in Ihrer IDE oder Ihrem Notebook geschriebenen ML-Code als SageMaker-Schulungsjob ausführen, indem Sie die Funktion, die als Einstiegspunkt in die Codebasis des Benutzers fungiert, mit einem einfachen Decorator kommentieren. Beim Aufrufen erstellt diese Funktion automatisch einen Snapshot aller zugeordneten Variablen, Funktionen, Pakete, Umgebungsvariablen und anderer Laufzeitanforderungen aus Ihrem ML-Code, serialisiert sie und übermittelt sie als SageMaker-Schulungsjob. Es integriert sich in das kürzlich angekündigte SageMaker Python SDK-Funktion zum Festlegen von Standardwerten für Parameter. Diese Funktion vereinfacht die SageMaker-Konstrukte, die Sie lernen müssen, um Code mit SageMaker Training ausführen zu können. Data Scientists können ihren Code in jeder bevorzugten IDE schreiben, debuggen und iterieren (z Amazon SageMaker-Studio, Notebooks, VS Code oder PyCharm). Wenn Sie fertig sind, können Sie Ihre Python-Funktion mit kommentieren @remote decorator und führen Sie ihn als SageMaker-Job in großem Umfang aus.

Diese Funktion verwendet bekannte Open-Source-Python-Objekte als Argumente und Ausgaben. Darüber hinaus müssen Sie sich nicht mit dem Lebenszyklusmanagement von Containern auskennen und können Ihre Workloads einfach über verschiedene Rechenkontexte (z. B. eine lokale IDE, Studio oder Schulungsaufträge) mit minimalem Konfigurationsaufwand ausführen. Um einen beliebigen lokalen Code als SageMaker-Schulungsjob auszuführen, leitet diese Funktion die Konfigurationen ab, die zum Ausführen von Jobs erforderlich sind, wie z AWS Identity and Access Management and (IAM)-Rolle, Verschlüsselungsschlüssel und Netzwerkkonfiguration aus den Studio- oder IDE-Einstellungen (die die Standardeinstellungen) und übergibt sie standardmäßig an die Plattform. Sie haben die Flexibilität, Ihre Laufzeit in der von SageMaker verwalteten Infrastruktur mithilfe der abgeleiteten Konfiguration anzupassen oder sie auf SDK-Ebene zu überschreiben, indem Sie sie als Argumente an den Decorator übergeben.

Diese neue Funktion des SageMaker Python SDK wandelt Ihren ML-Code in einer vorhandenen Arbeitsbereichsumgebung und alle zugehörigen Datenverarbeitungscodes und Datensätze in einen SageMaker-Schulungsjob um. Diese Funktion sucht nach ML-Code, der in a eingeschlossen ist @remote decorator und übersetzt sie automatisch in einen Job, der entweder in Studio oder einer lokalen IDE wie PyCharm ausgeführt wird.

In den folgenden Abschnitten gehen wir durch die Funktionen dieser neuen Funktion und wie Python-Funktionen als SageMaker-Schulungsjobs gestartet werden.

Voraussetzungen:

Um diese neue SageMaker-Python-SDK-Funktion zu verwenden und den mit diesem Beitrag verknüpften Code auszuführen, benötigen Sie die folgenden Voraussetzungen:

- Ein AWS-Konto, das alle Ihre AWS-Ressourcen enthält

- Eine IAM-Rolle für den Zugriff auf SageMaker

- Zugriff auf Studio oder eine SageMaker-Notebook-Instanz oder eine IDE wie PyCharm

Verwenden Sie das SDK von Studio- und SageMaker-Notebooks

Sie können diese Funktion von Studio aus verwenden, indem Sie ein Notebook starten und Ihren Code mit a umschließen @remote Dekorateur im Notizbuch. Sie müssen zuerst die Remote-Funktion mit dem folgenden Code importieren:

from sagemaker.remote_function import remoteWenn Sie die Decorator-Funktion verwenden, interpretiert diese Funktion automatisch die Funktion Ihres Codes und führt sie als SageMaker-Schulungsjob aus.

Sie können diese Funktion auch von einer SageMaker-Notebook-Instance aus verwenden. Sie müssen zuerst eine Notebook-Instance starten, darauf Jupyter oder Jupyter Lab öffnen und ein Notebook starten. Importieren Sie dann die Remote-Funktion wie im vorherigen Code gezeigt und umschließen Sie Ihren Code mit der @remote Dekorateur. Ein Beispiel für die Verwendung der Decorator-Funktion und die zugehörigen Einstellungen finden Sie später in diesem Beitrag.

Verwenden Sie das SDK aus Ihrer lokalen Umgebung

Sie können diese Funktion auch von Ihrer lokalen IDE aus verwenden. Als Voraussetzung müssen Sie die haben AWS-Befehlszeilenschnittstelle (AWS CLI), SageMaker Python SDK und AWS SDK für Python (Boto3) in Ihrer lokalen Umgebung installiert. Sie müssen diese Bibliotheken in Ihren Code importieren, die SageMaker-Sitzung festlegen, Einstellungen festlegen und Ihre Funktion mit der @remote Dekorateur. Im folgenden Beispielcode führen wir eine einfache Teilungsfunktion als SageMaker-Schulungsjob aus:

import boto3

import sagemaker

from sagemaker.remote_function import remote sm_session = sagemaker.Session(boto_session=boto3.session.Session(region_name="us-west-2"))

settings = dict(

sagemaker_session=sm_session,

role=<IAM_ROLE_NAME>

instance_type="ml.m5.xlarge",

)

@remote(**settings)

def divide(x, y):

return x / y

if __name__ == "__main__":

print(divide(2, 3.0))Wir können eine ähnliche Methodik verwenden, um erweiterte Funktionen als Trainingsjobs auszuführen, wie im nächsten Abschnitt gezeigt.

Starten Sie Python-Funktionen als SageMaker-Jobs

Mit der neuen SageMaker Python SDK-Funktion können Sie Python-Funktionen als ausführen SageMaker-Schulungsjobs. Jeder Python-Code, ML-Trainingscode, der von Data Scientists mit ihren bevorzugten lokalen IDEs (PyCharm, VS Code), SageMaker-Notebooks oder Studio-Notebooks entwickelt wurde, kann als verwalteter SageMaker-Job gestartet werden.

In ML-Arbeitslasten, die diese Funktion verwenden, werden zugehörige Datasets, Abhängigkeiten und Arbeitsbereichsumgebungs-Setups unter Verwendung des ML-Codes serialisiert und als SageMaker-Job synchron und asynchron ausgeführt.

Sie können ein hinzufügen @remote decorator-Anmerkung für beliebigen Python-Code, einschließlich einer lokalen ML-Verarbeitungs- oder Trainingsfunktion, um ihn als verwalteten SageMaker-Trainingsjob zu starten und so die Skalierbarkeit, Leistung und Kostenvorteile von SageMaker zu nutzen. Dies kann mit minimalen Codeänderungen erreicht werden, indem dem Python-Funktionscode ein Decorator hinzugefügt wird. Der Aufruf der dekorierten Funktion wird synchron ausgeführt, und die Funktionsausführung wartet, bis der SageMaker-Job abgeschlossen ist.

Im folgenden Beispiel verwenden wir die @remote decorator, um SageMaker-Jobs im Decorator-Modus mit einer ml.m5.large-Instanz zu starten. SageMaker verwendet Trainingsjobs, um diese Funktion als verwalteten Job zu starten.

from sagemaker.remote_function import remote

from numpy as np @remote(instance_type="ml.m5.large")

def matrix_multiply(a, b): return np.matmul(a, b) a = np.array([[1, 0], [0, 1]])

b = np.array([1, 2]) assert matrix_multiply(a, b) == np.array([1,2])Sie können den Decorator-Modus auch verwenden, um SageMaker-Jobs, Python-Pakete und Abhängigkeiten zu starten. Sie können Umgebungsvariablen wie VPC, Subnetze und Sicherheitsgruppen einbeziehen, um SageMaker-Schulungsjobs in der zu starten environment.yml Datei. Auf diese Weise können ML-Ingenieure und -Administratoren diese Umgebungsvariablen konfigurieren, sodass sich Data Scientists auf die Erstellung von ML-Modellen konzentrieren und schneller iterieren können. Siehe folgenden Code:

from sagemaker.remote_function import remote @remote(instance_type="ml.g4dn.xlarge",dependencies = "./environment.yml")

def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

... <TRUCNATED>

return os.path.join(s3_output_path, model_dir), eval_resultSie können verwenden RemoteExecutor zum asynchronen Starten von Python-Funktionen als SageMaker-Jobs. Der Executor fragt SageMaker-Schulungsjobs asynchron ab, um den Status des Jobs zu aktualisieren. Der RemoteExecutor Klasse ist eine Implementierung der concurrent.futures.Executor, das zum asynchronen Senden von SageMaker-Schulungsjobs verwendet wird. Siehe folgenden Code:

from sagemaker.remote_function import RemoteExecutor def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

...<TRUNCATED>

return os.path.join(s3_output_path, model_dir), eval_result with RemoteExecutor(instance_type="ml.g4dn.xlarge", dependencies = './requirements.txt') as e:

future = e.submit(train_hf_model, train_input_path,test_input_path,s3_output_path,

epochs, train_batch_size, eval_batch_size,warmup_steps,learning_rate)Passen Sie die Laufzeitumgebung an

Decorator-Modus und RemoteExecutor ermöglichen es Ihnen, die Laufzeitumgebungen für den SageMaker-Job zu definieren und anzupassen. Die Laufzeitabhängigkeiten, einschließlich Python-Pakete und Umgebungsvariablen für SageMaker-Jobs, können angegeben werden, um die Laufzeit anzupassen. Um lokalen Python-Code als von SageMaker verwaltete Jobs auszuführen, müssen das Python-Paket und die Abhängigkeiten für SageMaker verfügbar gemacht werden. ML-Ingenieure oder Data-Science-Administratoren können Netzwerk- und Sicherheitskonfigurationen wie VPC, Subnetze und Sicherheitsgruppen für SageMaker-Jobs konfigurieren, sodass Data Scientists diese zentral verwalteten Konfigurationen beim Starten von SageMaker-Jobs verwenden können. Sie können entweder a requirements.txt Datei oder a Conda environment.yaml Datei.

Wenn Abhängigkeiten mit definiert werden requirements.txt, werden die Pakete mit pip in der Joblaufzeit installiert. Wenn das zum Ausführen des Jobs verwendete Image mit Conda-Umgebungen geliefert wird, werden Pakete in der Conda-Umgebung installiert, die für die Verwendung für Jobs deklariert ist. Der folgende Code zeigt ein Beispiel requirements.txt Datei:

datasets

transformers

torch

scikit-learn

s3fs==0.4.2

sagemaker>=2.148.0Sie können Ihre übergeben Conda environment.yaml -Datei, um die Conda-Umgebung zu erstellen, in der Ihr Code während des Trainingsauftrags ausgeführt werden soll. Wenn das zum Ausführen des Jobs verwendete Image eine Conda-Umgebung zum Ausführen des Codes deklariert, aktualisieren wir die deklarierte Conda-Umgebung mit der angegebenen Spezifikation. Der folgende Code ist ein Beispiel für a Conda environment.yaml Datei:

name: sagemaker_example

channels: - conda-forge

dependencies: - python=3.10 - pandas - pip: - sagemakerAlternativ können Sie einstellen dependencies=”auto_capture” um das SageMaker Python SDK die installierten Abhängigkeiten in der aktiven Conda-Umgebung erfassen zu lassen. Sie müssen über eine aktive Conda-Umgebung verfügen auto_capture arbeiten. Beachten Sie, dass es Voraussetzungen für gibt auto_capture arbeiten; Wir empfehlen, dass Sie Ihre Abhängigkeiten als übergeben requirement.txt or Conda environment.yml Datei wie im vorherigen Abschnitt beschrieben.

Weitere Einzelheiten finden Sie unter Führen Sie Ihren lokalen Code als SageMaker-Schulungsjob aus.

Konfigurationen für SageMaker-Jobs

Infrastrukturbezogene Einstellungen können in eine Konfigurationsdatei ausgelagert werden, die Administratorbenutzer bei der Einrichtung unterstützen können. Sie müssen es nur einmal einrichten. Infrastruktureinstellungen umfassen die Netzwerkkonfiguration, IAM-Rollen, Amazon Simple Storage-Service (Amazon S3) Ordner für Eingabe-, Ausgabedaten und Tags. Beziehen auf Konfigurieren und Verwenden von Standardeinstellungen mit dem SageMaker Python SDK für weitere Informationen an.

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

Dependencies: path/to/requirements.txt

EnvironmentVariables: {"EnvVarKey": "EnvVarValue"}

ImageUri: 366666666666.dkr.ecr.us-west-2.amazonaws.com/my-image:latest

InstanceType: ml.m5.large

RoleArn: arn:aws:iam::366666666666:role/MyRole

S3KmsKeyId: somekmskeyid

S3RootUri: s3://my-bucket/my-project

SecurityGroupIds:

- sg123

Subnets:

- subnet-1234

Tags:

- {"Key": "someTagKey", "Value": "someTagValue"}

VolumeKmsKeyId: somekmskeyidSytemimplementierung

Deep-Learning-Modelle wie PyTorch oder TensorFlow können auch in Studio ausgeführt werden, indem der Code als Trainingsjob im Notebook ausgeführt wird. Um diese Funktion in Studio zu demonstrieren, können Sie dieses Repository in Ihr Studio klonen und das Notebook ausführen, das sich in der befindet GitHub Repository.

Dieses Beispiel zeigt einen Anwendungsfall für die End-to-End-Klassifizierung von binärem Text. Wir verwenden die Transformer- und Datensatzbibliothek von Hugging Face, um einen vortrainierten Transformer für die binäre Textklassifizierung zu optimieren. Insbesondere wird das vortrainierte Modell mit dem verfeinert IMDb-Datensatz.

Wenn Sie das Repository klonen, sollten Sie die folgenden Dateien finden:

- config.yaml – Die meisten Decorator-Argumente können in die Konfigurationsdatei ausgelagert werden, um die infrastrukturbezogenen Einstellungen von der Codebasis zu trennen

- Huggingface.ipynb – Dies enthält den Code zum Trainieren eines vortrainierten HuggingFace-Modells, das mithilfe des IMDB-Datensatzes verfeinert wird

- requirements.txt – Diese Datei enthält alle Abhängigkeiten zum Ausführen der Funktion, die in diesem Notebook verwendet wird, um den Code auszuführen und das Training remote in einer GPU-Instanz als Trainingsjob auszuführen

Wenn Sie das Notebook öffnen, werden Sie aufgefordert, die Notebook-Umgebung einzurichten. Sie können das Data Science 3.0-Image mit dem Python 3-Kernel und ml.m5.large als Schnellstart-Instance-Typ zum Ausführen des Notebook-Codes auswählen. Dieser Instanztyp ist wesentlich schneller beim Hochfahren einer Umgebung.

Der Trainingsjob wird in einer ml.g4dn.xlarge-Instanz ausgeführt, wie in definiert config.yaml Datei:

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

# role arn is not required if in SageMaker Notebook instance or SageMaker Studio

# Uncomment the following line and replace with the right execution role if in a local IDE

# RoleArn: <IAM_ROLE_ARN>

InstanceType: ml.g4dn.xlarge

Dependencies: ./requirements.txtDas requirements.txt Dateiabhängigkeiten zum Ausführen der Funktion zum Trainieren des Hugging Face-Modells umfassen Folgendes:

datasets

transformers

torch

scikit-learn

# lock s3fs to this specific version as more recent ones introduce dependency on aiobotocore, which is not compatible with botocore

s3fs==0.4.2

sagemaker>=2.148.0,<3Das Hugging Face-Notizbuch zeigt, wie Sie das Training remote über das ausführen können @remote Funktion, die synchron ausgeführt wird. Daher wartet die zum Trainieren des Modells ausgeführte Funktion, bis der SageMaker-Trainingsjob abgeschlossen ist. Das Training wird remote mit einer GPU-Instanz ausgeführt, wobei der Instanztyp in der vorherigen Konfigurationsdatei definiert ist.

Nachdem Sie den Trainingsauftrag ausgeführt haben, können Sie die restlichen Zellen im Notebook ausführen, um die Bewertungsmetriken zu überprüfen und den Text in unserem trainierten Modell zu klassifizieren.

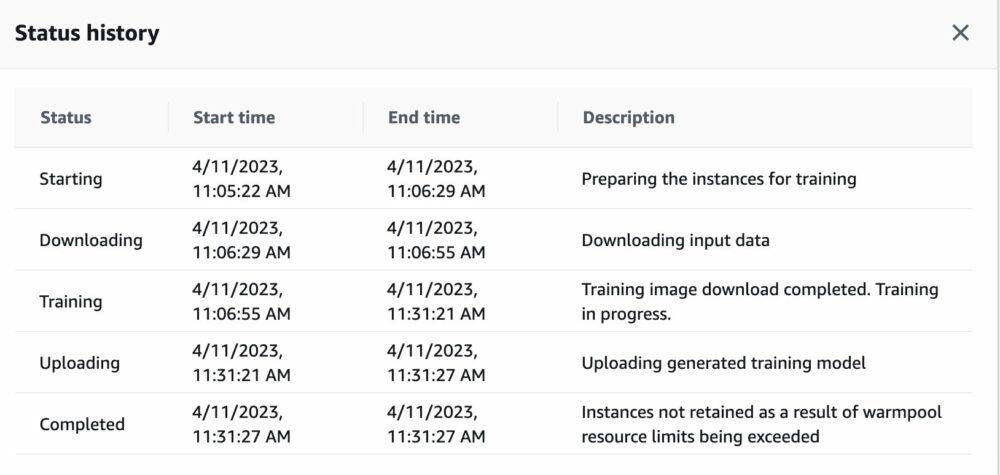

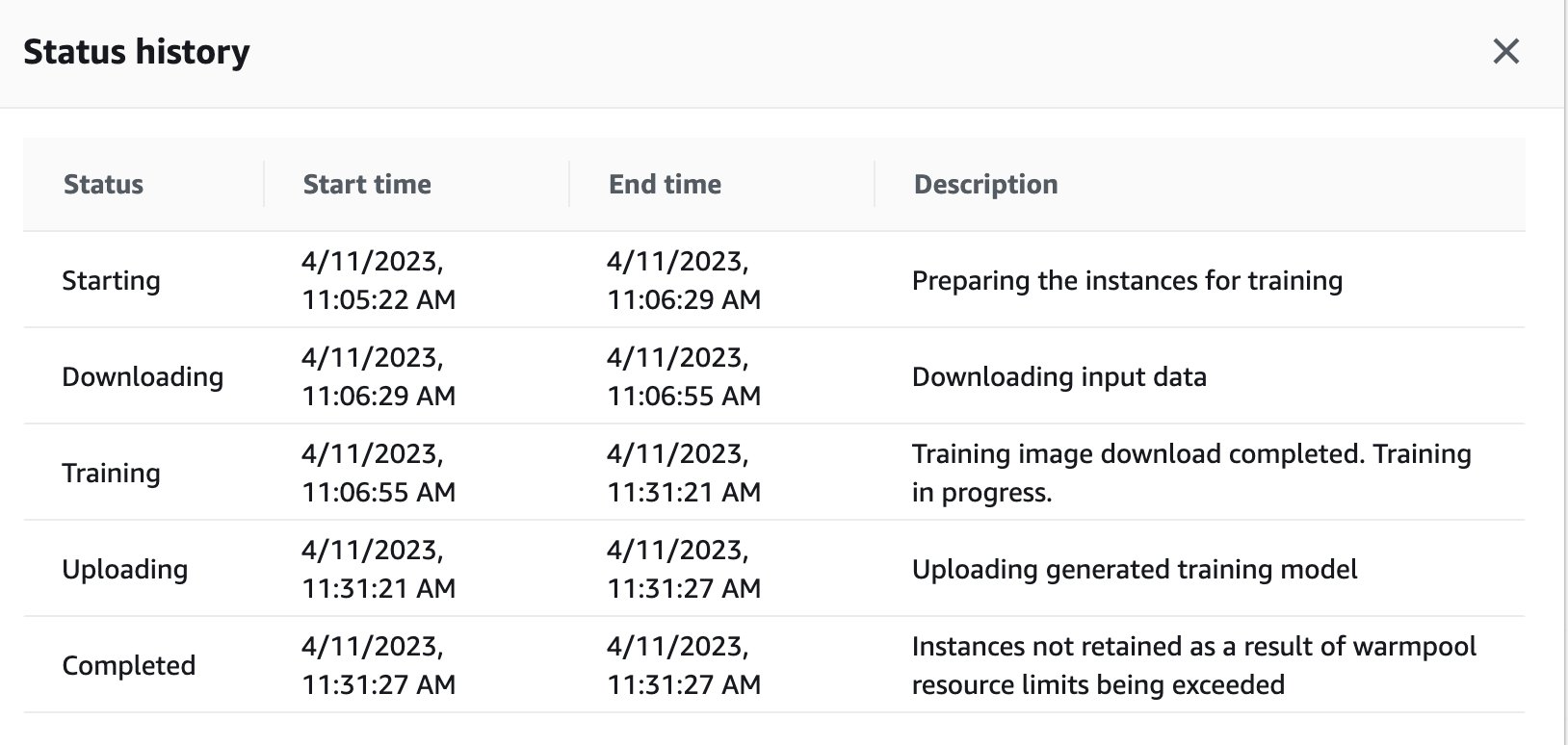

Sie können den Trainingsauftragsstatus, der in der GPU-Instanz remote ausgelöst wurde, auch im SageMaker-Dashboard anzeigen, indem Sie zurück zur SageMaker-Konsole navigieren.

Sobald der Trainingsauftrag abgeschlossen ist, führt er die Anweisungen im Notebook zur Bewertung und Klassifizierung weiter aus. Ähnliche Jobs können über die in Studio-Notebooks eingebettete Remote-Executor-Funktion trainiert und ausgeführt werden, um die Läufe asynchron auszuführen.

Integration mit SageMaker-Experimenten innerhalb einer @remote-Funktion

Sie können Ihren Experimentnamen, Laufnamen und andere Parameter an Ihre Remote-Funktion übergeben, um einen SageMaker-Experimentlauf zu erstellen. Das folgende Codebeispiel importiert den Namen des Experiments, den Namen des Laufs und die Parameter, die für jeden Lauf protokolliert werden sollen:

from sagemaker.remote_function import remote

from sagemaker.experiments.run import Run

# Define your remote function

@remote

def train(value_1, value_2, exp_name, run_name):

...

...

#Creates the experiment

with Run( experiment_name=exp_name, run_name=run_name, sagemaker_session=sagemaker_session

) as run:

...

...

#Define values for the parameters to log

run.log_parameter("param_1", value_1)

run.log_parameter("param_2", value_2)

...

...

#Define metrics to log

run.log_metric("metric_a", 0.5)

run.log_metric("metric_b", 0.1) # Invoke your remote function

train(1.0, 2.0, "my-exp-name", "my-run-name") Im vorherigen Beispiel die Parameter p1 und p2 werden über die Zeit innerhalb einer Trainingsschleife protokolliert. Zu den allgemeinen Parametern können die Stapelgröße oder Epochen gehören. Im Beispiel die Metriken A und B werden für einen Lauf über die Zeit innerhalb einer Trainingsschleife protokolliert. Übliche Metriken können Genauigkeit oder Verlust beinhalten. Weitere Informationen finden Sie unter Erstellen Sie ein Amazon SageMaker-Experiment.

Zusammenfassung

In diesem Beitrag haben wir eine neue SageMaker-Python-SDK-Funktion vorgestellt, die es Data Scientists ermöglicht, ihren ML-Code in ihrer bevorzugten IDE als SageMaker-Schulungsjobs auszuführen. Wir haben die Voraussetzungen besprochen, die für die Verwendung dieser Funktion zusammen mit ihren Funktionen erforderlich sind. Wir haben auch gezeigt, wie Sie diese Funktion in Studio, SageMaker-Notebook-Instanzen und Ihrer lokalen IDE verwenden können. Darüber hinaus haben wir Beispielcodebeispiele bereitgestellt, um zu demonstrieren, wie diese Funktion verwendet wird. Als nächsten Schritt empfehlen wir, diese Funktion in Ihrer IDE oder SageMaker auszuprobieren, indem Sie den Anweisungen folgen Codebeispiele in diesem Beitrag verwiesen.

Über die Autoren

Dipankar Patro ist ein Softwareentwicklungsingenieur bei AWS SageMaker, der MLOps-Lösungen innoviert und entwickelt, um Kunden bei der Einführung von KI/ML-Lösungen in großem Maßstab zu unterstützen. Er hat einen MS in Informatik und seine Interessengebiete sind Computersicherheit, verteilte Systeme und KI/ML.

Dipankar Patro ist ein Softwareentwicklungsingenieur bei AWS SageMaker, der MLOps-Lösungen innoviert und entwickelt, um Kunden bei der Einführung von KI/ML-Lösungen in großem Maßstab zu unterstützen. Er hat einen MS in Informatik und seine Interessengebiete sind Computersicherheit, verteilte Systeme und KI/ML.

Farooq Sabir ist ein leitender Lösungsarchitekt für künstliche Intelligenz und maschinelles Lernen bei AWS. Er hat einen PhD- und MS-Abschluss in Elektrotechnik von der University of Texas at Austin und einen MS in Informatik vom Georgia Institute of Technology. Er hat über 15 Jahre Berufserfahrung und unterrichtet und betreut auch gerne College-Studenten. Bei AWS hilft er Kunden bei der Formulierung und Lösung ihrer Geschäftsprobleme in den Bereichen Datenwissenschaft, maschinelles Lernen, Computer Vision, künstliche Intelligenz, numerische Optimierung und verwandte Bereiche. Er lebt in Dallas, Texas, und seine Familie liebt es zu reisen und lange Autofahrten zu unternehmen.

Farooq Sabir ist ein leitender Lösungsarchitekt für künstliche Intelligenz und maschinelles Lernen bei AWS. Er hat einen PhD- und MS-Abschluss in Elektrotechnik von der University of Texas at Austin und einen MS in Informatik vom Georgia Institute of Technology. Er hat über 15 Jahre Berufserfahrung und unterrichtet und betreut auch gerne College-Studenten. Bei AWS hilft er Kunden bei der Formulierung und Lösung ihrer Geschäftsprobleme in den Bereichen Datenwissenschaft, maschinelles Lernen, Computer Vision, künstliche Intelligenz, numerische Optimierung und verwandte Bereiche. Er lebt in Dallas, Texas, und seine Familie liebt es zu reisen und lange Autofahrten zu unternehmen.

Manoj Ravi ist Senior Product Manager für Amazon SageMaker. Er entwickelt leidenschaftlich KI-Produkte der nächsten Generation und arbeitet an Software und Tools, um das maschinelle Lernen in großem Umfang für Kunden zu vereinfachen. Er hat einen MBA der Haas School of Business und einen Master in Information Systems Management der Carnegie Mellon University. In seiner Freizeit spielt Manoj gerne Tennis und betreibt Landschaftsfotografie.

Manoj Ravi ist Senior Product Manager für Amazon SageMaker. Er entwickelt leidenschaftlich KI-Produkte der nächsten Generation und arbeitet an Software und Tools, um das maschinelle Lernen in großem Umfang für Kunden zu vereinfachen. Er hat einen MBA der Haas School of Business und einen Master in Information Systems Management der Carnegie Mellon University. In seiner Freizeit spielt Manoj gerne Tennis und betreibt Landschaftsfotografie.

Shichar Kwatra ist AI/ML Specialist Solutions Architect bei Amazon Web Services und arbeitet mit einem führenden globalen Systemintegrator zusammen. Mit über 500 Patenten in den Bereichen KI/ML und IoT hat er sich den Titel eines der jüngsten indischen Meistererfinder verdient. Shikhar hilft bei der Architektur, dem Aufbau und der Wartung kosteneffizienter, skalierbarer Cloud-Umgebungen für die Organisation und unterstützt den GSI-Partner beim Aufbau strategischer Branchenlösungen auf AWS. In seiner Freizeit spielt Shikhar gerne Gitarre, komponiert Musik und praktiziert Achtsamkeit.

Shichar Kwatra ist AI/ML Specialist Solutions Architect bei Amazon Web Services und arbeitet mit einem führenden globalen Systemintegrator zusammen. Mit über 500 Patenten in den Bereichen KI/ML und IoT hat er sich den Titel eines der jüngsten indischen Meistererfinder verdient. Shikhar hilft bei der Architektur, dem Aufbau und der Wartung kosteneffizienter, skalierbarer Cloud-Umgebungen für die Organisation und unterstützt den GSI-Partner beim Aufbau strategischer Branchenlösungen auf AWS. In seiner Freizeit spielt Shikhar gerne Gitarre, komponiert Musik und praktiziert Achtsamkeit.

Vikram Elango ist Senior AI/ML Specialist Solutions Architect bei AWS mit Sitz in Virginia, USA. Derzeit konzentriert er sich auf generative KI, LLMs, Prompt Engineering, Inferenzoptimierung für große Modelle und unternehmensübergreifende Skalierung von ML. Vikram unterstützt Kunden aus der Finanz- und Versicherungsbranche mit Design und Vordenkerrolle bei der Erstellung und Bereitstellung von Anwendungen für maschinelles Lernen in großem Maßstab. In seiner Freizeit reist er gerne, wandert, kocht und campt.

Vikram Elango ist Senior AI/ML Specialist Solutions Architect bei AWS mit Sitz in Virginia, USA. Derzeit konzentriert er sich auf generative KI, LLMs, Prompt Engineering, Inferenzoptimierung für große Modelle und unternehmensübergreifende Skalierung von ML. Vikram unterstützt Kunden aus der Finanz- und Versicherungsbranche mit Design und Vordenkerrolle bei der Erstellung und Bereitstellung von Anwendungen für maschinelles Lernen in großem Maßstab. In seiner Freizeit reist er gerne, wandert, kocht und campt.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoAiStream. Web3-Datenintelligenz. Wissen verstärkt. Hier zugreifen.

- Die Zukunft prägen mit Adryenn Ashley. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/run-your-local-machine-learning-code-as-amazon-sagemaker-training-jobs-with-minimal-code-changes/

- :hast

- :Ist

- :nicht

- $UP

- 1

- 10

- 100

- 15 Jahre

- 500

- 7

- a

- Fähigkeit

- Fähig

- Über Uns

- Zugang

- Konto

- Genauigkeit

- erreicht

- über

- aktiv

- Handlungen

- hinzufügen

- Hinzufügen

- Zusatz

- Administrator

- Administratoren

- adoptieren

- advanced

- Vorteil

- AI

- AI / ML

- AIDS

- Alle

- erlaubt

- entlang

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- analysieren

- und

- angekündigt

- jedem

- Anwendungen

- SIND

- Bereiche

- Argumente

- künstlich

- künstliche Intelligenz

- Künstliche Intelligenz und maschinelles Lernen

- AS

- damit verbundenen

- At

- Austin

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- AWS

- Zurück

- Base

- basierend

- BE

- Vorteile

- Budgets

- bauen

- Building

- Geschäft

- by

- CAN

- Fähigkeiten

- Erfassung

- Carnegie Mellon

- tragen

- Häuser

- Die Zellen

- Übernehmen

- Änderungen

- Kanäle

- Wahl

- Klasse

- Einstufung

- klassifizieren

- Cloud

- Code

- Codebasis

- Hochschule

- kommt

- gemeinsam

- kompatibel

- abschließen

- Berechnen

- Computer

- Computerwissenschaften

- Computersicherheit

- Computer Vision

- konzept

- Konfiguration

- Konsul (Console)

- enthalten

- Container

- enthält

- Kontexte

- weiter

- Kernbereich

- Kosten

- könnte

- Abdeckung

- erstellen

- Zur Zeit

- Kunden

- anpassen

- Dallas

- Armaturenbrett

- technische Daten

- Datenverarbeitung

- Datenwissenschaft

- Datensätze

- erklärt

- Standard

- defaults

- definiert

- zeigen

- zeigt

- Abhängigkeit

- einsetzen

- beschrieben

- Design

- Details

- entwickelt

- Entwickler:in / Unternehmen

- Entwicklung

- anders

- diskutiert

- verteilt

- verteilte Systeme

- verteiltes Training

- Domains

- erledigt

- Nicht

- im

- e

- jeder

- verdient

- Benutzerfreundlichkeit

- einfacher

- leicht

- entweder

- eingebettet

- ermöglicht

- Verschlüsselung

- End-to-End

- Ingenieur

- Entwicklung

- Ingenieure

- Unternehmen

- Eintrag

- Arbeitsumfeld

- Umgebungen

- Epoche

- Epochen

- Auswertung

- Jedes

- Beispiel

- Beispiele

- Ausführung

- vorhandenen

- ERFAHRUNGEN

- Experiment

- Gesicht

- vertraut

- Familie

- FAST

- beschleunigt

- Merkmal

- Eigenschaften

- wenige

- Reichen Sie das

- Mappen

- Revolution

- Vorname

- Flexibilität

- Setzen Sie mit Achtsamkeit

- konzentriert

- Folgende

- Aussichten für

- Unser Ansatz

- für

- voll

- Funktion

- Funktionen

- Außerdem

- Zukunft

- Futures

- generativ

- Generative KI

- Georgien

- gegeben

- Global

- Go

- GPU

- Gruppen

- Haben

- he

- Hilfe

- hilft

- seine

- hält

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- Umarmendes Gesicht

- Identitätsschutz

- if

- Image

- Implementierung

- importieren

- Importe

- in

- das

- Einschließlich

- Indisch

- Energiegewinnung

- Information

- Information Systems

- Infrastruktur

- innovativ

- Varianten des Eingangssignals:

- installiert

- Instanz

- Institut

- Anleitung

- Versicherung

- integriert

- Integriert

- Intelligenz

- Interesse

- in

- einführen

- eingeführt

- Erfinder

- iot

- IT

- Iterationen

- SEINE

- Job

- Jobs

- jpg

- nur

- Wesentliche

- Labor

- Landschaft

- Laptops

- grosse

- großflächig

- neueste

- starten

- ins Leben gerufen

- Start

- Leadership

- führenden

- LERNEN

- lernen

- lassen

- Lasst uns

- Bibliotheken

- Bibliothek

- Lebenszyklus

- Gefällt mir

- Gleichen

- Line

- aus einer regionalen

- örtlich

- located

- Log

- protokolliert

- Lang

- SIEHT AUS

- Verlust

- ich liebe

- Maschine

- Maschinelles Lernen

- gemacht

- Aufrechterhaltung

- um

- MACHT

- verwaltet

- Management

- Manager

- Master

- Kann..

- Mellon

- Methodik

- Metrik

- Achtsamkeit

- minimal

- Minuten

- ML

- MLOps

- Model

- Modell

- für

- Module

- mehr

- vor allem warme

- schlauer bewegen

- MS

- mehrere

- Musik

- Name

- nämlich

- navigieren

- Need

- erforderlich

- Netzwerk

- Vernetzung

- Neu

- weiter

- Fiber Node

- Notizbuch

- jetzt an

- numpig

- Objekte

- of

- on

- Onboard

- einmal

- EINEM

- einzige

- XNUMXh geöffnet

- Open-Source-

- Optimierung

- or

- Auftrag

- Organisation

- OS

- Andere

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- übrig

- Override

- Paket

- Pakete

- Pandas

- Parallel

- Parameter

- besondere

- Partner

- passieren

- leitet

- Bestehen

- leidenschaftlich

- Patente

- Weg

- Leistung

- Fotografie

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielend

- Points

- Post

- bevorzugt

- Voraussetzungen

- früher

- Aufgabenstellung:

- Probleme

- Verarbeitung

- Produkt

- Produkt-Manager

- produktiv

- Produkte

- vorausgesetzt

- Python

- Pytorch

- bereit

- kürzlich

- kürzlich

- empfehlen

- bezogene

- Release

- entfernt

- ersetzen

- Quelle

- falls angefordert

- Voraussetzungen:

- REST

- Rückkehr

- Straße

- Rollen

- Rollen

- Führen Sie

- Laufen

- sagemaker

- skalierbaren

- Skalieren

- Skalierung

- Schule

- Wissenschaft

- Wissenschaftler

- scikit-lernen

- Sdk

- nahtlos

- Abschnitt

- Abschnitte

- Sicherheitdienst

- sehen

- Senior

- getrennte

- Lösungen

- Sitzung

- kompensieren

- Einstellung

- Einstellungen

- Setup

- mehrere

- sollte

- erklären

- Vitrine

- gezeigt

- Konzerte

- bedeutend

- ähnlich

- Einfacher

- einfach

- Single

- Größe

- klein

- Schnappschuss

- So

- Software

- Software-Entwicklung

- Lösungen

- LÖSEN

- Spezialist

- spezifisch

- Spezifikation

- angegeben

- Anfang

- Beginnen Sie

- Status

- Schritt

- Lagerung

- Strategisch

- Die Kursteilnehmer

- Studio Adressen

- abschicken

- Subnetze

- so

- Unterstützte

- Unterstützt

- System

- Systeme und Techniken

- Nehmen

- nimmt

- Einnahme

- und Aufgaben

- Teams

- Technologie

- Tensorfluss

- Texas

- Textklassifizierung

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Dort.

- damit

- deswegen

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- dachte

- Gedankenführung

- Durch

- Zeit

- Titel

- zu

- Werkzeuge

- Fackel

- gegenüber

- Training

- trainiert

- Ausbildung

- Transformer

- reisen

- Reise

- ausgelöst

- tippe

- typisch

- für

- verstehen

- Universität

- Aktualisierung

- us

- -

- Anwendungsfall

- benutzt

- Nutzer

- Verwendung von

- Wert

- Werte

- Version

- Anzeigen

- Virginia

- Seh-

- vs

- gegen Code

- warten

- wollen

- we

- Netz

- Web-Services

- wann

- welche

- während

- werden wir

- mit

- .

- Arbeiten

- arbeiten,

- Werk

- würde

- wickeln

- Eingehüllt

- schreiben

- Code schreiben

- geschrieben

- X

- Jahr

- Du

- Jüngste

- Ihr

- Zephyrnet