Dieser Beitrag wurde gemeinsam mit Anthony Medeiros, Manager of Solutions Engineering and Architecture für North America Artificial Intelligence, und Blake Santschi, Business Intelligence Manager, von Schneider Electric verfasst. Weitere Experten von Schneider Electric sind Jesse Miller, Somik Chowdhury, Shaswat Babhulgaonkar, David Watkins, Mark Carlson und Barbara Sleczkowski.

Enterprise-Resource-Planning-Systeme (ERP) werden von Unternehmen genutzt, um mehrere Geschäftsfunktionen wie Buchhaltung, Vertrieb oder Auftragsverwaltung in einem System zu verwalten. Insbesondere werden sie routinemäßig zur Speicherung von Informationen im Zusammenhang mit Kundenkonten verwendet. Verschiedene Organisationen innerhalb eines Unternehmens verwenden möglicherweise unterschiedliche ERP-Systeme und deren Zusammenführung ist eine komplexe technische Herausforderung im großen Maßstab, die domänenspezifisches Wissen erfordert.

Schneider Electric ist führend in der digitalen Transformation des Energiemanagements und der industriellen Automatisierung. Um die Bedürfnisse seiner Kunden bestmöglich zu erfüllen, muss Schneider Electric die Verknüpfungen zwischen den Konten verknüpfter Kunden in seinen ERP-Systemen im Auge behalten. Während ihr Kundenstamm wächst, kommen täglich neue Kunden hinzu, und ihre Account-Teams müssen diese neuen Kunden manuell sortieren und sie mit der richtigen übergeordneten Einheit verknüpfen.

Die Verknüpfungsentscheidung basiert auf den neuesten Informationen, die öffentlich im Internet oder in den Medien verfügbar sind, und kann durch kürzliche Akquisitionen, Marktnachrichten oder Geschäftsbereichsumstrukturierungen beeinflusst werden. Ein Beispiel für die Kontoverknüpfung wäre die Identifizierung der Beziehung zwischen Amazon und seiner Tochtergesellschaft Whole Foods Market [Quelle].

Schneider Electric setzt große Sprachmodelle ein, um Fragen in verschiedenen wissensspezifischen Bereichen zu beantworten. Das Datum, an dem das Modell trainiert wurde, schränkt sein Wissen ein. Sie haben sich dieser Herausforderung gestellt, indem sie ein großes Open-Source-Sprachmodell der Retriever-Augmented Generation verwendet haben, das auf verfügbar ist Amazon SageMaker-JumpStart um große Mengen an externem Wissen zu verarbeiten und Unternehmens- oder öffentliche Beziehungen zwischen ERP-Datensätzen aufzuzeigen.

Als Schneider Electric Anfang 2023 beschloss, einen Teil seines Kontoverknüpfungsprozesses mithilfe künstlicher Intelligenz (KI) zu automatisieren, ging das Unternehmen eine Partnerschaft mit dem AWS Machine Learning Solutions Lab (MLSL) ein. Mit der Expertise von MLSL in der ML-Beratung und -Ausführung war Schneider Electric in der Lage, eine KI-Architektur zu entwickeln, die den manuellen Aufwand in ihren Verknüpfungsworkflows reduziert und ihren nachgelagerten Analyseteams einen schnelleren Datenzugriff ermöglicht.

Generative KI

Generative KI und große Sprachmodelle (LLMs) verändern die Art und Weise, wie Unternehmensorganisationen traditionell komplexe Herausforderungen im Zusammenhang mit der Verarbeitung und dem Verständnis natürlicher Sprache lösen können. Zu den Vorteilen, die LLMs bieten, gehört die Fähigkeit, große Textteile zu verstehen und verwandte Fragen durch menschenähnliche Antworten zu beantworten. AWS macht es Kunden einfach, mit LLM-Workloads zu experimentieren und diese zu produzieren, indem viele Optionen über Amazon SageMaker JumpStart verfügbar gemacht werden. Amazonas Grundgestein und Amazonas-Titan.

Externer Wissenserwerb

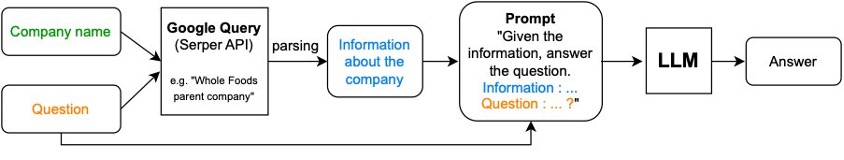

LLMs sind für ihre Fähigkeit bekannt, menschliches Wissen zu komprimieren und haben bemerkenswerte Fähigkeiten bei der Beantwortung von Fragen in verschiedenen wissensspezifischen Bereichen bewiesen, ihr Wissen ist jedoch durch das Datum begrenzt, an dem das Modell trainiert wurde. Wir begegnen dieser Informationslücke, indem wir das LLM mit einer Google-Such-API koppeln, um ein leistungsstarkes Retrieval Augmented LLM (RAG) bereitzustellen, das die Herausforderungen von Schneider Electric bewältigt. Das RAG ist in der Lage, große Mengen an externem Wissen aus der Google-Suche zu verarbeiten und Unternehmens- oder öffentliche Beziehungen zwischen ERP-Datensätzen aufzuzeigen.

Siehe folgendes Beispiel:

Frage: Wer ist die Muttergesellschaft von One Medical?

Google-Anfrage: „One Medical Muttergesellschaft“ → Informationen → LLM

Antworten: One Medical, eine Tochtergesellschaft von Amazon…

Das vorangehende Beispiel (entnommen aus der Kundendatenbank von Schneider Electric) betrifft eine Akquisition, die im Februar 2023 stattfand und daher aufgrund von Wissenskürzungen nicht allein vom LLM erfasst würde. Die Ergänzung des LLM mit der Google-Suche garantiert die aktuellsten Informationen.

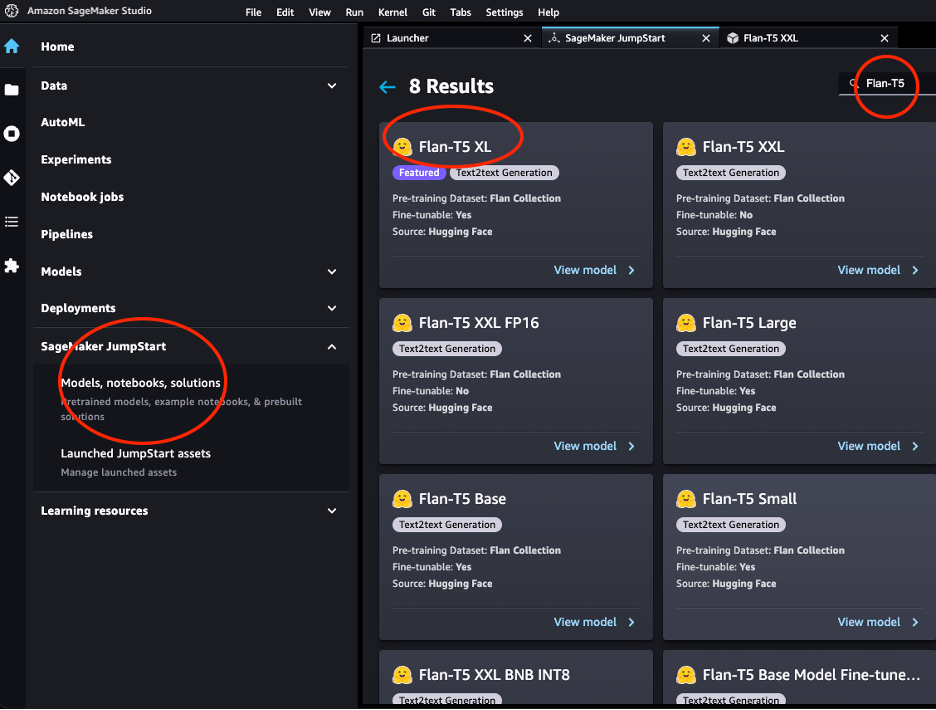

Flan-T5-Modell

In diesem Projekt haben wir das Flan-T5-XXL-Modell von verwendet Flan-T5 Modellfamilie.

Die Flan-T5-Modelle sind auf Anweisungen abgestimmt und daher in der Lage, verschiedene Zero-Shot-NLP-Aufgaben auszuführen. In unserer nachgelagerten Aufgabe war es nicht erforderlich, eine große Menge an Weltwissen unterzubringen, sondern vielmehr eine gute Leistung bei der Beantwortung von Fragen in einem Kontext von Texten zu erbringen, die durch Suchergebnisse bereitgestellt wurden, und daher schnitt das 11B-Parameter-T5-Modell gut ab.

JumpStart bietet eine komfortable Bereitstellung dieser Modellfamilie durch Amazon SageMaker-Studio und das SageMaker SDK. Dazu gehören Flan-T5 Small, Flan-T5 Base, Flan-T5 Large, Flan-T5 XL und Flan-T5 XXL. Darüber hinaus bietet JumpStart einige Versionen von Flan-T5 XXL mit unterschiedlichen Quantisierungsstufen an. Wir haben Flan-T5-XXL zur Inferenzverwendung an einem Endpunkt bereitgestellt Amazon SageMaker Studio-Jumpstart.

Retrieval Augmented LLM mit LangChain

LangChain ist ein beliebtes und schnell wachsendes Framework, das die Entwicklung von Anwendungen auf Basis von LLMs ermöglicht. Es basiert auf dem Konzept von KettenHierbei handelt es sich um Kombinationen verschiedener Komponenten, die die Funktionalität von LLMs für eine bestimmte Aufgabe verbessern sollen. Es ermöglicht uns zum Beispiel, Anpassungen vorzunehmen Eingabeaufforderungen und LLMs mit verschiedenen Tools wie externen Suchmaschinen oder Datenquellen integrieren. In unserem Anwendungsfall haben wir Google verwendet Serper Komponente zum Durchsuchen des Webs und stellte das verfügbare Flan-T5-XXL-Modell bereit Amazon SageMaker Studio-Jumpstart. LangChain übernimmt die Gesamtorchestrierung und ermöglicht die Einspeisung der Suchergebnisseiten in die Flan-T5-XXL-Instanz.

Die Retrieval-Augmented Generation (RAG) besteht aus zwei Schritten:

- Abruf relevanter Textteile aus externen Quellen

- Augmentation der Chunks mit Kontext in der Eingabeaufforderung an den LLM.

Für den Anwendungsfall von Schneider Electric geht das RAG wie folgt vor:

- Der angegebene Firmenname wird mit einer Frage wie „Wer ist die Muttergesellschaft von

- Die extrahierten Informationen werden mit der Eingabeaufforderung und der Originalfrage kombiniert und zur Beantwortung an das LLM weitergeleitet.

Das folgende Diagramm veranschaulicht diesen Vorgang.

Verwenden Sie den folgenden Code, um einen Endpunkt zu erstellen:

Suchtool instanziieren:

Im folgenden Code verketten wir die Abruf- und Erweiterungskomponenten:

Das prompte Engineering

Die Kombination aus Kontext und Frage wird als Eingabeaufforderung bezeichnet. Wir haben festgestellt, dass die von uns verwendete pauschale Eingabeaufforderung (Variationen rund um die Frage nach der Muttergesellschaft) für die meisten öffentlichen Sektoren (Domänen) gut funktionierte, sich jedoch nicht gut auf Bildung oder Gesundheitswesen übertragen ließ, da der Begriff der Muttergesellschaft dort keine Bedeutung hat. Für Bildung haben wir „X“ verwendet, während wir für das Gesundheitswesen „Y“ verwendet haben.

Um diese domänenspezifische Eingabeaufforderungsauswahl zu ermöglichen, mussten wir auch die Domäne identifizieren, zu der ein bestimmtes Konto gehört. Hierzu verwendeten wir auch eine RAG, bei der eine Multiple-Choice-Frage „Was ist die Domain von {account}?“ lautete. Als ersten Schritt erkundigten wir uns und auf der Grundlage der Antwort erkundigten wir uns im zweiten Schritt über die entsprechende Eingabeaufforderung beim übergeordneten Konto. Siehe den folgenden Code:

Die branchenspezifischen Eingabeaufforderungen haben die Gesamtleistung von 55 % auf 71 % der Genauigkeit gesteigert. Insgesamt ist der Aufwand und die Zeit, die in die Entwicklung investiert werden, effektiv Eingabeaufforderungen scheinen die Qualität der LLM-Antwort deutlich zu verbessern.

RAG mit tabellarischen Daten (SEC-10k)

Die SEC 10K-Einreichungen sind eine weitere zuverlässige Informationsquelle für Tochtergesellschaften und Unterabteilungen, die jährlich von börsennotierten Unternehmen eingereicht werden. Diese Einreichungen sind direkt bei der SEC verfügbar EDGAR Oder durch BodyWatch API.

Wir gehen davon aus, dass die Informationen tabellarisch vorliegen. Unten ist ein Pseudo csv Datensatz, der das Originalformat des SEC-10K-Datensatzes nachahmt. Es ist möglich, mehrere zusammenzuführen csv Datenquellen in einen kombinierten Pandas-Datenrahmen:

# A pseudo dataset similar by schema to the CorpWatch API dataset

df.head()

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/schneider-electric-leverages-retrieval-augmented-llms-on-sagemaker-to-ensure-real-time-updates-in-their-erp-systems/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 10

- 100

- 10k

- 11

- 15 Jahre

- 15%

- 160

- 17

- 2023

- 7

- 710

- a

- Fähigkeit

- Fähig

- Über Uns

- oben

- Abstraktion

- beschleunigen

- Zugang

- unterbringen

- Konto

- Buchhaltung

- Trading Konten

- Genauigkeit

- genau

- Erwerb

- Akquisitionen

- über

- Action

- hinzugefügt

- Zusatz

- Zusätzliche

- Adresse

- angesprochen

- Adressen

- Vorteilen

- betroffen

- Makler

- AI

- AI / ML

- Zulassen

- erlaubt

- allein

- ebenfalls

- Amazon

- Amazon Machine Learning

- Amazon Sage Maker

- Amazon SageMaker-JumpStart

- Amazon Web Services

- Amerika

- unter

- Betrag

- Beträge

- an

- Analytik

- und

- Jährlich

- Ein anderer

- beantworten

- Heinrich

- Bienen

- erscheinen

- Anwendungen

- angewandt

- Anwendung

- Architektur

- SIND

- um

- künstlich

- künstliche Intelligenz

- Künstliche Intelligenz (AI)

- AS

- fragen

- fragen

- annehmen

- At

- vermehren

- Augmented

- automatisieren

- Automation

- verfügbar

- direkt verfügbar

- AWS

- AWS Maschinelles Lernen

- Bankinggg

- Base

- basierend

- BE

- war

- Bevor

- gehört

- unten

- Vorteile

- BESTE

- zwischen

- Blockiert

- Boosted

- Brings

- bauen

- Building

- Geschäft

- Geschäftsfunktionen

- Business Intelligence

- aber

- by

- namens

- CAN

- Fähigkeiten

- fähig

- Carlson

- gefangen

- Kette

- challenges

- Herausforderungen

- Wahl

- Stadt

- klassifizieren

- CNBC

- Code

- Kolonne

- Kombination

- Kombinationen

- kombiniert

- Unternehmen

- Unternehmen

- Komplex

- Komponente

- Komponenten

- begreifen

- konzept

- Bedenken

- besteht

- Consulting

- Verbraucher

- Kontext

- Praktische

- Unternehmen

- erstellen

- Wert schaffen

- Kunde

- Kunden

- Unterricht

- technische Daten

- Datenzugriff

- datengesteuerte

- Datenbase

- Datensätze

- Datum

- Christian

- entschieden

- Entscheidung

- Übergeben

- liefern

- Synergie

- Einsatz

- Bereitstellen

- Einsatz

- Design

- entworfen

- Detail

- detailliert

- entwickeln

- Entwicklung

- Entwicklung

- anders

- digital

- Digitale Transformation

- Direkt

- do

- Dokument

- Domain

- Domains

- zwei

- Früh

- Einfache

- Bildungswesen

- Anstrengung

- Die elektrische

- ermöglichen

- Endpunkt

- Energie

- Entwicklung

- Motor (en)

- gewährleisten

- Eingabe

- Unternehmen

- Einheit

- ERP

- Beispiel

- Ausführung

- zeigen

- ERFAHRUNGEN

- Experiment

- Expertise

- Experten

- erweitern

- extern

- Exxon Mobil

- Familie

- FAST

- beschleunigt

- Februar

- Fed

- wenige

- eingereicht

- Einreichungen

- Finale

- Finden Sie

- Vorname

- Setzen Sie mit Achtsamkeit

- konzentriert

- Folgende

- folgt

- Lebensmittel

- Aussichten für

- Format

- Unser Ansatz

- für

- Funktionalität

- Funktionen

- weiter

- Außerdem

- GAS

- Generation

- generativ

- Generative KI

- gegeben

- Global

- Google-Suche

- Graphen

- persönlichem Wachstum

- Wächst

- Garantien

- hätten

- passiert

- Haben

- he

- Gesundheitswesen

- hilft

- hier (auf dänisch)

- höher

- seine

- Ultraschall

- HTML

- http

- HTTPS

- human

- i

- Login

- identifizieren

- zeigt

- zu unterstützen,

- Verbesserung

- in

- das

- Dazu gehören

- Inkubator

- industriell

- Energiegewinnung

- Information

- Anfangs-

- Initiativen

- Varianten des Eingangssignals:

- Einblicke

- Instanz

- integrieren

- Intelligenz

- interagieren

- Interessen

- Internet

- in

- investiert

- IT

- SEINE

- Joshua

- jpg

- Behalten

- Wesentliche

- Wissen

- Wissen

- bekannt

- Labor

- Sprache

- grosse

- Schicht

- Führer

- führenden

- lernen

- Cholesterinspiegel

- Hebelwirkungen

- Abgaben

- Gefällt mir

- Limitiert

- Begrenzung

- LINK

- Linking

- Links

- LLM

- Maschine

- Maschinelles Lernen

- halten

- MACHT

- Making

- verwalten

- Management

- Manager

- manuell

- manuell

- viele

- Kennzeichen

- Markt

- Market News

- sinnvoll

- Medien

- sowie medizinische

- medizinische Daten

- Merge

- Verschmelzung

- Methoden

- könnte

- Müller

- ML

- Modell

- für

- mehr

- vor allem warme

- mehrere

- Name

- Benennung

- Natürliche

- Verarbeitung natürlicher Sprache

- Need

- Bedürfnisse

- Neu

- New York

- New York City

- News

- Nlp

- nicht

- Norden

- Nordamerika

- Notion

- jetzt an

- Beobachtung

- of

- angeboten

- ÖL

- Öl un Gas

- on

- EINEM

- Ein Arzt

- XNUMXh geöffnet

- Open-Source-

- Optionen

- or

- Orchesterbearbeitung

- Auftrag

- Organisation

- organisatorisch

- Organisationen

- Original

- Andere

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- Gesamt-

- besitzen

- Seiten

- Pandas

- Parameter

- Muttergesellschaft

- Teil

- besondere

- Partnerschaft

- Bestanden

- leidenschaftlich

- Weg

- Ausführen

- Leistung

- durchgeführt

- Durchführung

- führt

- Pharma

- phd

- Pipeline

- Planung

- Plato

- Datenintelligenz von Plato

- PlatoData

- Beliebt

- möglich

- Post

- angetriebene

- größte treibende

- vorher

- Principal

- Probleme

- Erlös

- Prozessdefinierung

- Verarbeitung

- Herstellung

- Projekt

- ordnungsgemäße

- vorausgesetzt

- bietet

- Öffentlichkeit

- öffentlich

- Qualität

- Frage

- Fragen

- lieber

- Echtzeit

- kürzlich

- Aufzeichnungen

- Veteran

- bezogene

- Beziehung

- Beziehungen

- relevant

- zuverlässig

- bemerkenswert

- erfordert

- Forschungsprojekte

- Forscher

- Ressourcen

- Antwort

- Antworten

- Folge

- Die Ergebnisse

- Rückkehr

- robust

- regelmäßig

- REIHE

- Führen Sie

- sagemaker

- Vertrieb

- Skalieren

- Schneider Electric

- Wissenschaft

- Wissenschaftler

- Sdk

- Suche

- Suchmaschinen

- SEK

- Zweite

- Bibliotheken

- Sektoren

- Verbindung

- sehen

- Auswahl

- Senior

- brauchen

- Lösungen

- mehrere

- sie

- bedeutend

- ähnlich

- da

- klein

- Lösung

- Lösungen

- LÖSEN

- einige

- Quelle

- Quellen

- spezialisiert

- spezifisch

- Wirbelsäule ... zu unterstützen.

- gesponnen

- State-of-the-art

- statistisch

- Schritt

- Shritte

- speichern

- Strukturen

- Studio Adressen

- Unterteilungen

- Tochtergesellschaft

- so

- Unterstützung

- System

- Systeme und Techniken

- gemacht

- Aufgabe

- und Aufgaben

- Team

- Teams

- Technische

- Text

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- die Informationen

- ihr

- Sie

- theoretisch

- Dort.

- deswegen

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- dachte

- Durch

- So

- Zeit

- zu

- gemeinsam

- Werkzeug

- Werkzeuge

- Top

- verfolgen sind

- gehandelt

- traditionell

- trainiert

- Transformation

- Transformieren

- vertrauenswürdig

- Twitch

- XNUMX

- aufdecken

- Verständnis

- öffnen

- auf dem neusten Stand

- Updates

- us

- -

- benutzt

- Verwendung von

- Wert

- verschiedene

- riesig

- Versionen

- Vertikalen

- wurde

- Weg..

- Wege

- we

- Reichtum

- Netz

- Web-Services

- GUT

- Was

- Was ist

- wann

- welche

- während

- WHO

- ganze

- werden wir

- mit

- .

- Arbeitsablauf.

- Workflows

- Werk

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- würde

- X

- Jahr

- York

- Du

- Zephyrnet

Antonius Medeiros ist Manager für Solutions Engineering und Architektur bei Schneider Electric. Er ist auf die Bereitstellung hochwertiger KI/ML-Initiativen für viele Geschäftsfunktionen in Nordamerika spezialisiert. Mit 17 Jahren Erfahrung bei Schneider Electric bringt er umfangreiche Branchenkenntnisse und technisches Fachwissen in das Team ein.

Antonius Medeiros ist Manager für Solutions Engineering und Architektur bei Schneider Electric. Er ist auf die Bereitstellung hochwertiger KI/ML-Initiativen für viele Geschäftsfunktionen in Nordamerika spezialisiert. Mit 17 Jahren Erfahrung bei Schneider Electric bringt er umfangreiche Branchenkenntnisse und technisches Fachwissen in das Team ein. Blake Sanstchi ist Business Intelligence Manager bei Schneider Electric und leitet ein Analyseteam, das sich auf die Unterstützung der Vertriebsorganisation durch datengesteuerte Erkenntnisse konzentriert.

Blake Sanstchi ist Business Intelligence Manager bei Schneider Electric und leitet ein Analyseteam, das sich auf die Unterstützung der Vertriebsorganisation durch datengesteuerte Erkenntnisse konzentriert. Joshua Levy ist Senior Applied Science Manager im Amazon Machine Learning Solutions-Labor, wo er Kunden beim Entwerfen und Erstellen von KI/ML-Lösungen zur Lösung wichtiger Geschäftsprobleme unterstützt.

Joshua Levy ist Senior Applied Science Manager im Amazon Machine Learning Solutions-Labor, wo er Kunden beim Entwerfen und Erstellen von KI/ML-Lösungen zur Lösung wichtiger Geschäftsprobleme unterstützt. Kosta Belz ist Senior Applied Scientist bei AWS MLSL mit Schwerpunkt auf generativer KI und Dokumentenverarbeitung. Seine Leidenschaft gilt der Entwicklung von Anwendungen mithilfe von Knowledge Graphs und NLP. Er verfügt über rund 10 Jahre Erfahrung im Aufbau von Daten- und KI-Lösungen, um Mehrwert für Kunden und Unternehmen zu schaffen.

Kosta Belz ist Senior Applied Scientist bei AWS MLSL mit Schwerpunkt auf generativer KI und Dokumentenverarbeitung. Seine Leidenschaft gilt der Entwicklung von Anwendungen mithilfe von Knowledge Graphs und NLP. Er verfügt über rund 10 Jahre Erfahrung im Aufbau von Daten- und KI-Lösungen, um Mehrwert für Kunden und Unternehmen zu schaffen. Aude Genevay ist Angewandte Wissenschaftlerin im Amazon GenAI Incubator, wo sie Kunden bei der Lösung wichtiger Geschäftsprobleme durch ML und KI unterstützt. Zuvor war sie als Forscherin im Bereich theoretisches ML tätig und genießt es, ihr Wissen anzuwenden, um Kunden hochmoderne Lösungen zu liefern.

Aude Genevay ist Angewandte Wissenschaftlerin im Amazon GenAI Incubator, wo sie Kunden bei der Lösung wichtiger Geschäftsprobleme durch ML und KI unterstützt. Zuvor war sie als Forscherin im Bereich theoretisches ML tätig und genießt es, ihr Wissen anzuwenden, um Kunden hochmoderne Lösungen zu liefern. MD Sirajus Salekin ist angewandter Wissenschaftler am AWS Machine Learning Solution Lab. Er hilft AWS-Kunden, ihr Geschäft durch die Entwicklung von KI/ML-Lösungen zu beschleunigen. Seine Forschungsinteressen sind multimodales maschinelles Lernen, generative KI und ML-Anwendungen im Gesundheitswesen.

MD Sirajus Salekin ist angewandter Wissenschaftler am AWS Machine Learning Solution Lab. Er hilft AWS-Kunden, ihr Geschäft durch die Entwicklung von KI/ML-Lösungen zu beschleunigen. Seine Forschungsinteressen sind multimodales maschinelles Lernen, generative KI und ML-Anwendungen im Gesundheitswesen. Zichen Wang, PhD, ist Senior Applied Scientist bei AWS. Mit mehrjähriger Forschungserfahrung in der Entwicklung von ML und statistischen Methoden unter Verwendung biologischer und medizinischer Daten arbeitet er mit Kunden aus verschiedenen Branchen zusammen, um ihre ML-Probleme zu lösen.

Zichen Wang, PhD, ist Senior Applied Scientist bei AWS. Mit mehrjähriger Forschungserfahrung in der Entwicklung von ML und statistischen Methoden unter Verwendung biologischer und medizinischer Daten arbeitet er mit Kunden aus verschiedenen Branchen zusammen, um ihre ML-Probleme zu lösen. Anton Gridin ist ein Principal Solutions Architect mit Sitz in New York City, der globale Industriekunden unterstützt. Er verfügt über mehr als 15 Jahre Erfahrung in der Entwicklung sicherer Anwendungen und in der Leitung von Engineering-Teams.

Anton Gridin ist ein Principal Solutions Architect mit Sitz in New York City, der globale Industriekunden unterstützt. Er verfügt über mehr als 15 Jahre Erfahrung in der Entwicklung sicherer Anwendungen und in der Leitung von Engineering-Teams.