Generative künstliche Intelligenz (generative KI)-Modelle haben beeindruckende Fähigkeiten bei der Generierung hochwertiger Texte, Bilder und anderer Inhalte bewiesen. Allerdings erfordern diese Modelle riesige Mengen an sauberen, strukturierten Trainingsdaten, um ihr volles Potenzial auszuschöpfen. Die meisten realen Daten liegen in unstrukturierten Formaten wie PDFs vor, die eine Vorverarbeitung erfordern, bevor sie effektiv genutzt werden können.

Laut IDCHeute machen unstrukturierte Daten über 80 % aller Geschäftsdaten aus. Dazu gehören Formate wie E-Mails, PDFs, gescannte Dokumente, Bilder, Audio, Video und mehr. Obwohl diese Daten wertvolle Erkenntnisse enthalten, ist es aufgrund ihrer unstrukturierten Natur für KI-Algorithmen schwierig, sie zu interpretieren und daraus zu lernen. Laut a Umfrage 2019 von DeloitteNur 18 % der Unternehmen gaben an, unstrukturierte Daten nutzen zu können.

Da die Einführung von KI immer schneller voranschreitet, wird die Entwicklung effizienter Mechanismen zur Verarbeitung und zum Lernen aus unstrukturierten Daten in Zukunft noch wichtiger. Dies könnte bessere Vorverarbeitungswerkzeuge, halbüberwachte Lerntechniken und Fortschritte bei der Verarbeitung natürlicher Sprache beinhalten. Unternehmen, die ihre unstrukturierten Daten am effektivsten nutzen, werden durch KI erhebliche Wettbewerbsvorteile erzielen. Saubere Daten sind wichtig für eine gute Modellleistung. Extrahierte Texte enthalten immer noch große Mengen an Kauderwelsch und Textbausteinen (z. B. HTML lesen). Aus dem Internet entnommene Daten enthalten oft viele Duplikate. Daten aus sozialen Medien, Rezensionen oder benutzergenerierten Inhalten können ebenfalls giftige und voreingenommene Inhalte enthalten, die Sie möglicherweise mithilfe einiger Vorverarbeitungsschritte herausfiltern müssen. Es könnte auch viele minderwertige Inhalte oder von Bots generierte Texte geben, die mithilfe begleitender Metadaten herausgefiltert werden können (z. B. Kundenservice-Antworten herausfiltern, die niedrige Kundenbewertungen erhalten haben).

Die Datenvorbereitung ist in mehreren Phasen der Retrieval Augmented Generation wichtig (RAG) Modelle. Die Wissensquellendokumente müssen vorverarbeitet werden, etwa Text bereinigen und semantische Einbettungen generieren, damit sie effizient indiziert und abgerufen werden können. Auch die Anfrage des Benutzers in natürlicher Sprache erfordert eine Vorverarbeitung, damit sie in einen Vektor kodiert und mit Dokumenteneinbettungen verglichen werden kann. Nach dem Abrufen relevanter Kontexte benötigen sie möglicherweise eine zusätzliche Vorverarbeitung, z. B. Kürzung, bevor sie mit der Abfrage des Benutzers verkettet werden, um die endgültige Eingabeaufforderung für das Basismodell zu erstellen. Amazon SageMaker-Leinwand Unterstützt jetzt umfassende Datenvorbereitungsfunktionen powered by Amazon SageMaker Data Wrangler. Mit dieser Integration bietet SageMaker Canvas Kunden einen durchgängigen No-Code-Arbeitsbereich, um Daten vorzubereiten, ML- und Foundation-Modelle zu erstellen und zu verwenden, um die Zeit von den Daten zu Geschäftserkenntnissen zu verkürzen. Sie können jetzt problemlos Daten aus über 50 Datenquellen ermitteln und aggregieren sowie Daten mithilfe von über 300 integrierten Analysen und Transformationen in der visuellen Benutzeroberfläche von SageMaker Canvas untersuchen und vorbereiten.

Lösungsüberblick

In diesem Beitrag arbeiten wir mit einem PDF-Dokumentationsdatensatz –Amazonas Grundgestein Benutzerhandbuch. Darüber hinaus zeigen wir, wie ein Datensatz für RAG vorverarbeitet wird. Konkret bereinigen wir die Daten und erstellen RAG-Artefakte, um die Fragen zum Inhalt des Datensatzes zu beantworten. Betrachten Sie das folgende Problem des maschinellen Lernens (ML): Der Benutzer stellt eine Frage zu einem großen Sprachmodell (LLM): „Wie filtere und suche ich Modelle in Amazon Bedrock?“. LLM hat die Dokumentation während der Schulungs- oder Feinabstimmungsphase nicht gesehen und wäre daher nicht in der Lage, die Frage zu beantworten, und wird höchstwahrscheinlich halluzinieren. Unser Ziel mit diesem Beitrag ist es, einen relevanten Textabschnitt aus dem PDF (z. B. RAG) zu finden und ihn an die Eingabeaufforderung anzuhängen, damit LLM spezifische Fragen zu diesem Dokument beantworten kann.

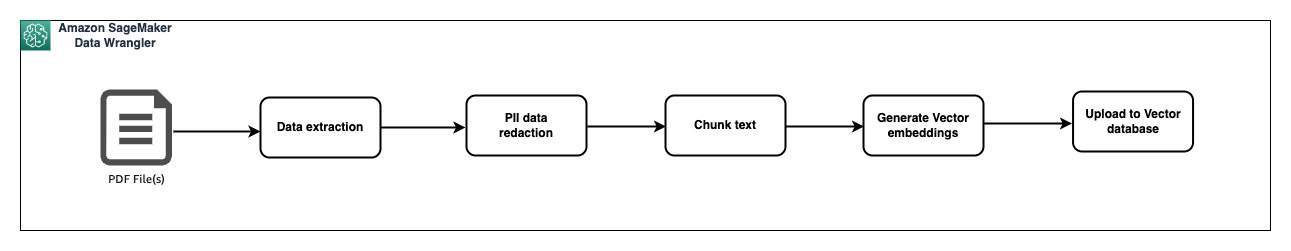

Im Folgenden zeigen wir, wie Sie alle diese wichtigen Vorverarbeitungsschritte ausführen können Amazon SageMaker-Leinwand (bereitgestellt von Amazon SageMaker Data Wrangler):

- Extrahieren von Text aus einem PDF-Dokument (unterstützt von Textract)

- Vertrauliche Informationen entfernen (unterstützt von Comprehend)

- Text in Stücke zerteilen.

- Erstellen Sie Einbettungen für jedes Teil (unterstützt von Bedrock).

- Einbettung in eine Vektordatenbank hochladen (unterstützt von OpenSearch)

Voraussetzungen:

Für diese exemplarische Vorgehensweise sollten Sie Folgendes haben:

Note: Erstellen Sie OpenSearch Service-Domänen gemäß den Anweisungen hier. Wählen wir der Einfachheit halber die Option mit einem Master-Benutzernamen und einem Passwort für eine differenzierte Zugriffskontrolle. Sobald die Domäne erstellt ist, erstellen Sie einen Vektorindex mit den folgenden Zuordnungen, und die Vektordimension 1536 richtet sich nach den Amazon Titan-Einbettungen:

Lösungsweg

Erstellen Sie einen Datenfluss

In diesem Abschnitt behandeln wir, wie wir einen Datenfluss aufbauen können, um Text und Metadaten aus PDFs zu extrahieren, die Daten zu bereinigen und zu verarbeiten, Einbettungen mit Amazon Bedrock zu generieren und die Daten in Amazon OpenSearch zu indizieren.

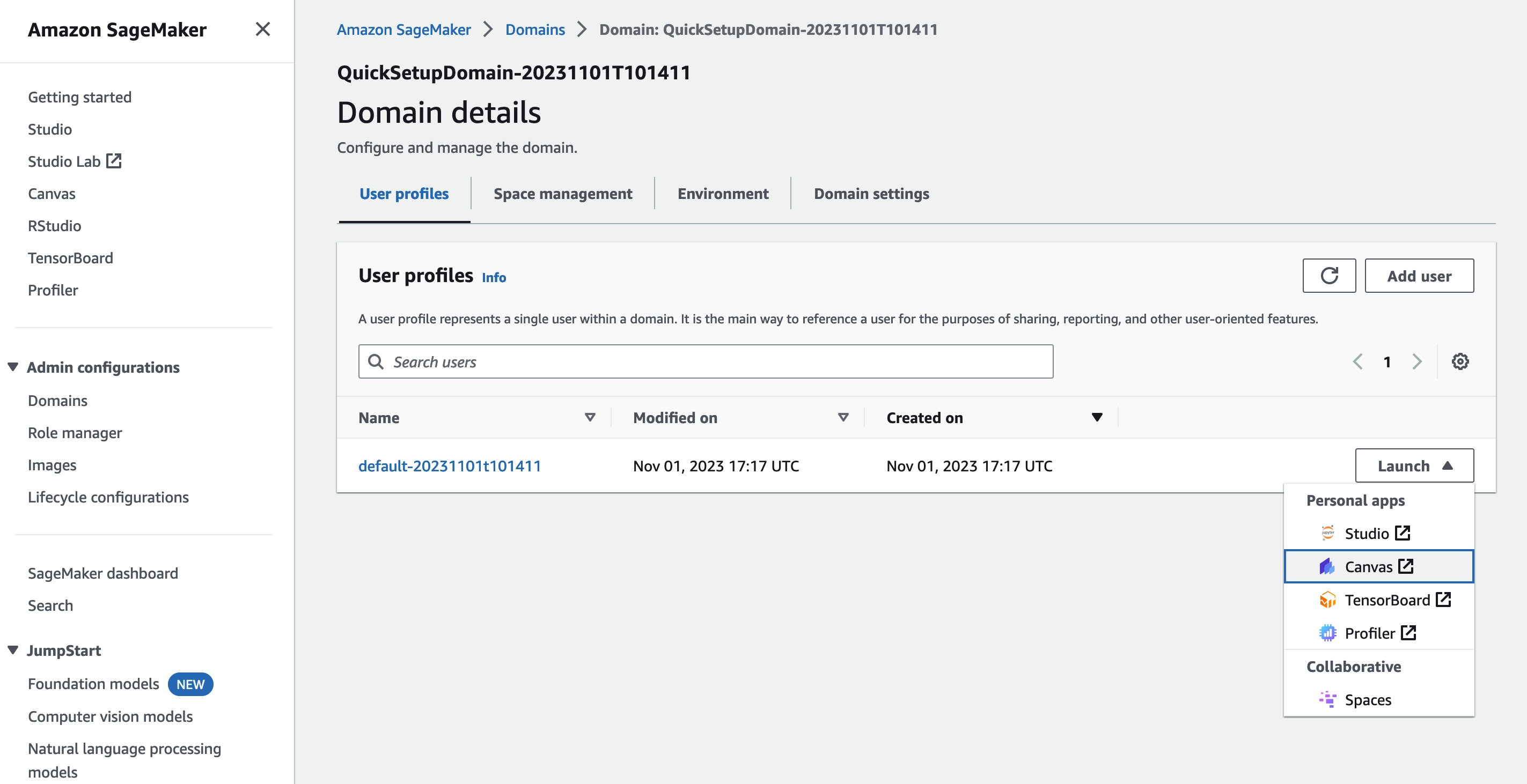

Starten Sie SageMaker Canvas

Führen Sie die folgenden Schritte aus, um SageMaker Canvas zu starten:

- Auf dem Amazonas SageMaker-Konsole, wählen Domains im Navigationsbereich.

- Wählen Sie Ihre Domäne.

- Wählen Sie im Startmenü die Option Canvas.

Erstellen Sie einen Datenfluss

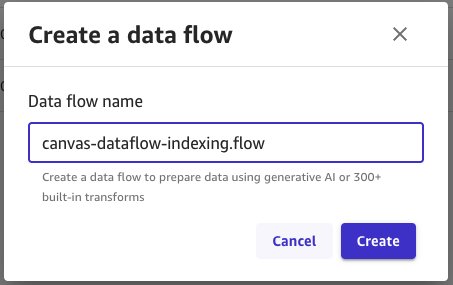

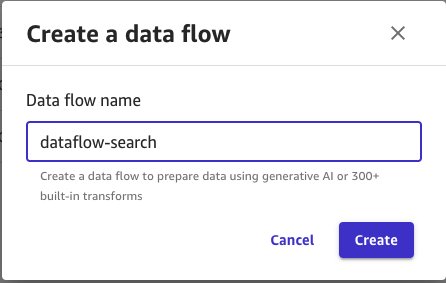

Führen Sie die folgenden Schritte aus, um einen Datenfluss in SageMaker Canvas zu erstellen:

- Wählen Sie auf der Startseite von SageMaker Canvas die Option aus Daten-Wrangler.

- Auswählen

Erstellen auf der rechten Seite der Seite, geben Sie dann einen Datenflussnamen ein und wählen Sie aus Erstellen.

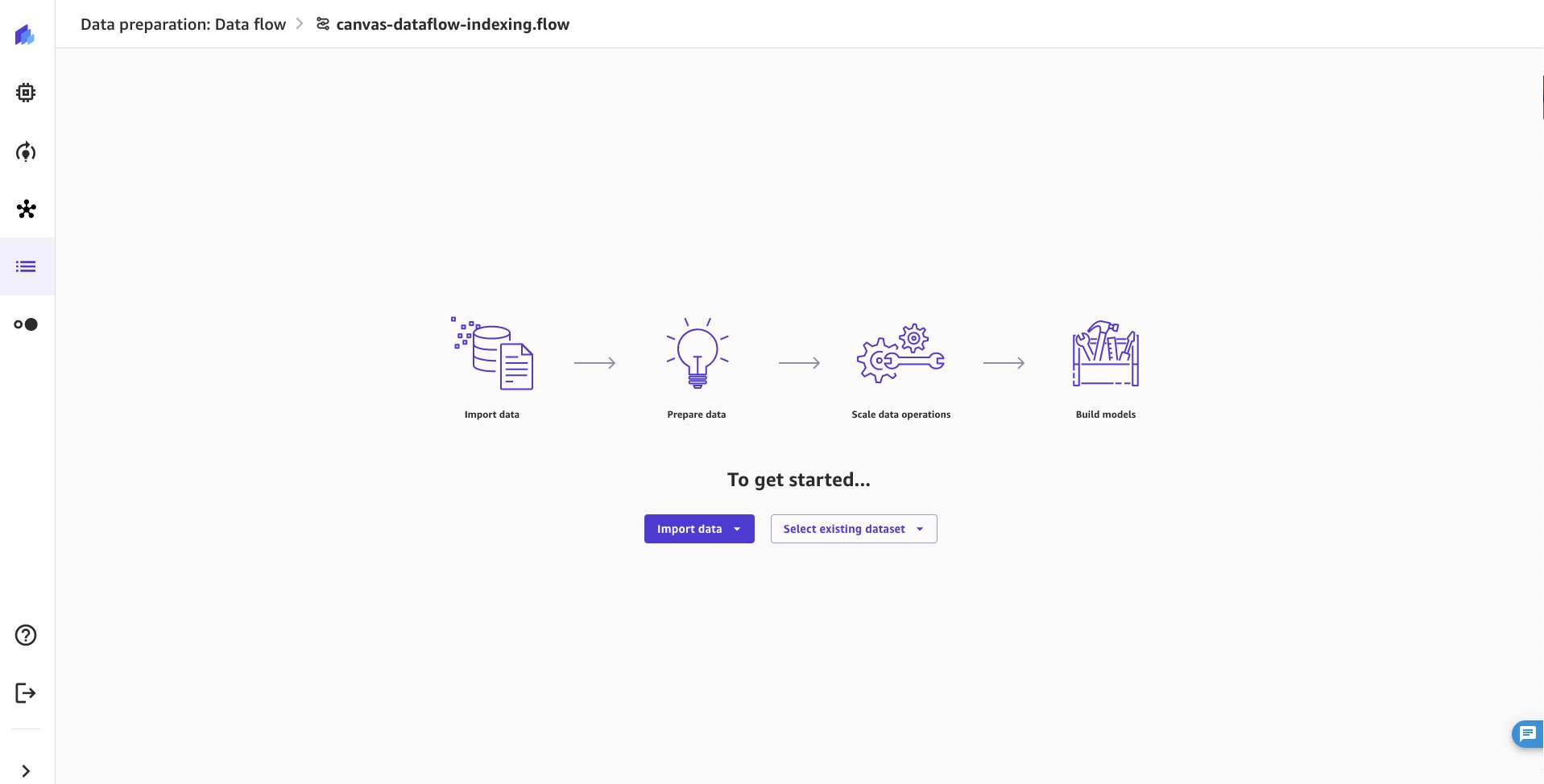

- Dies führt zu einer Datenflussseite.

- Auswählen

Daten importieren, wählen Sie tabellarische Daten aus.

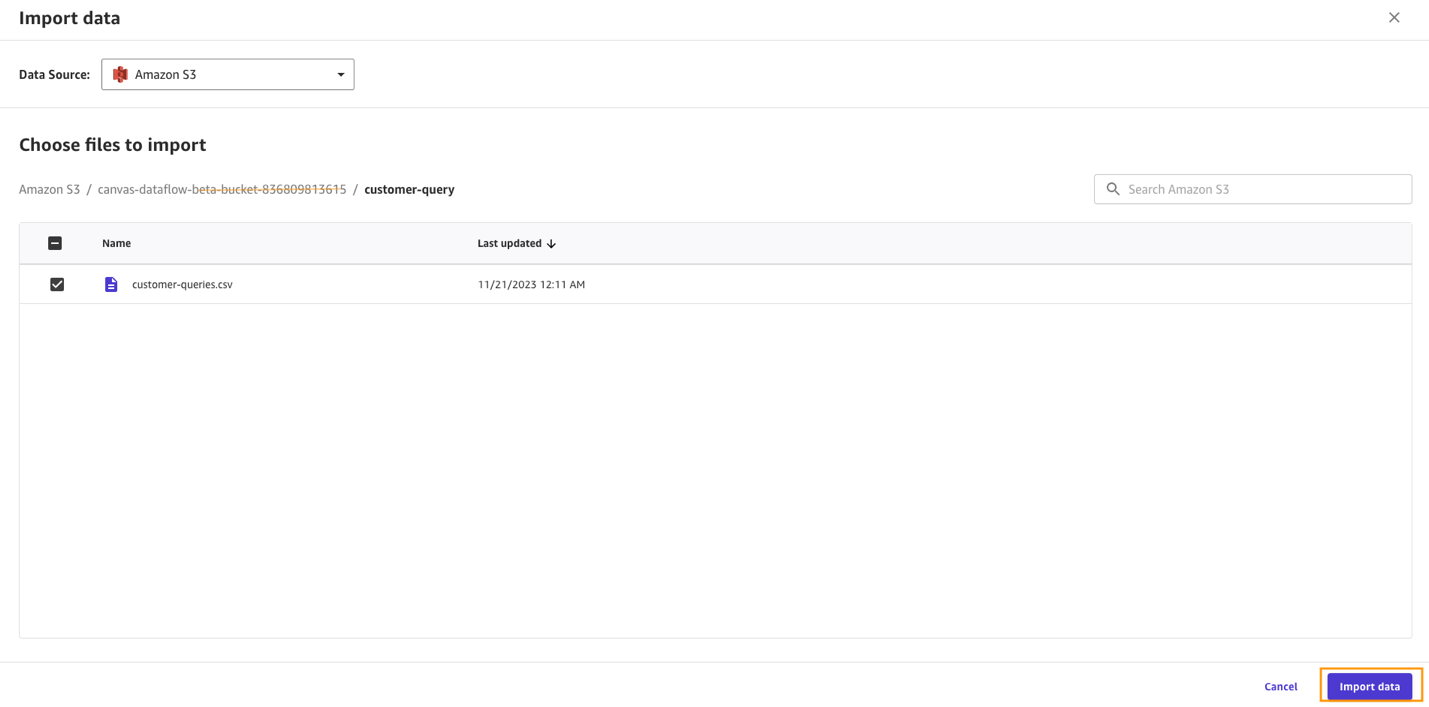

Jetzt importieren wir die Daten aus dem Amazon S3-Bucket:

- Auswählen Daten importieren und wählen Sie Tabellarisch aus der Dropdown-Liste.

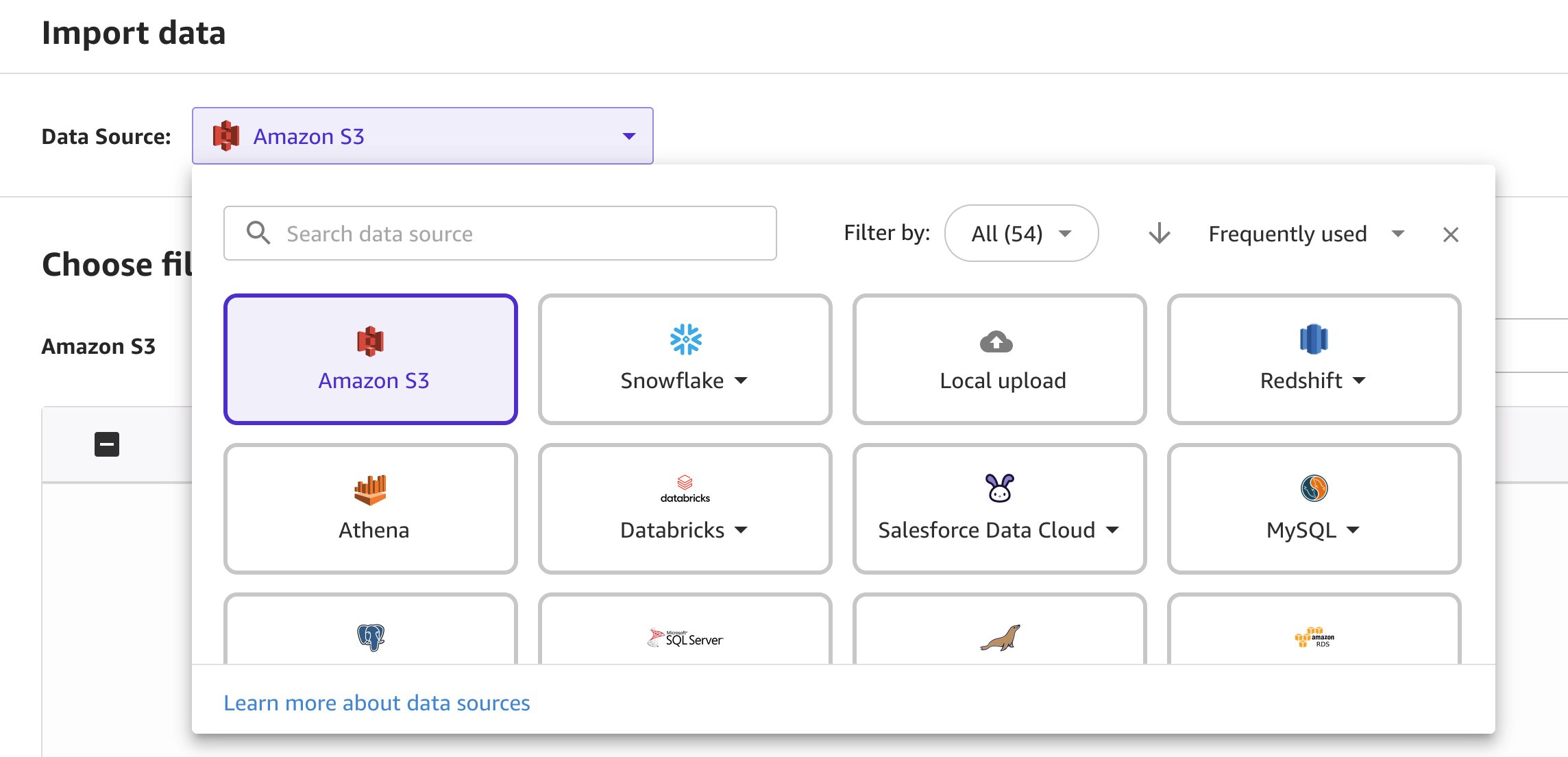

- Datenquelle und wählen Sie Amazon S3 aus der Dropdown-Liste.

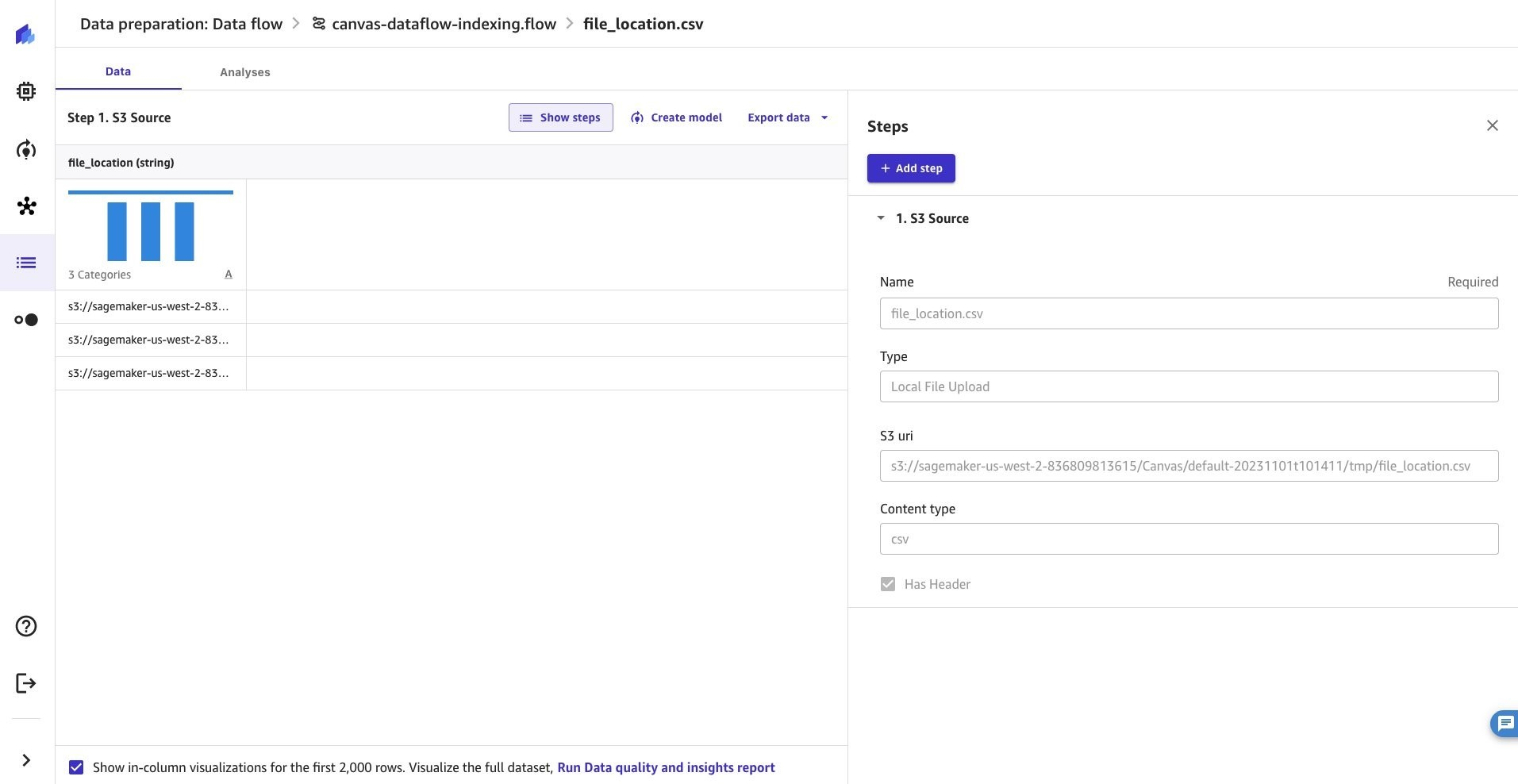

- Navigieren Sie zur Metadatendatei mit den Speicherorten der PDF-Dateien und wählen Sie die Datei aus.

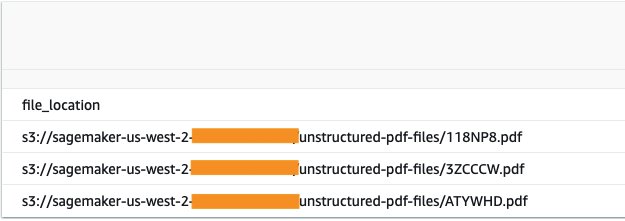

- Jetzt wird die Metadatendatei in den Datenvorbereitungsdatenfluss geladen und wir können mit dem Hinzufügen der nächsten Schritte zur Umwandlung der Daten und des Index in Amazon fortfahren Öffnet die Suche. In diesem Fall verfügt die Datei über die folgenden Metadaten mit dem Speicherort jeder Datei im Amazon S3-Verzeichnis.

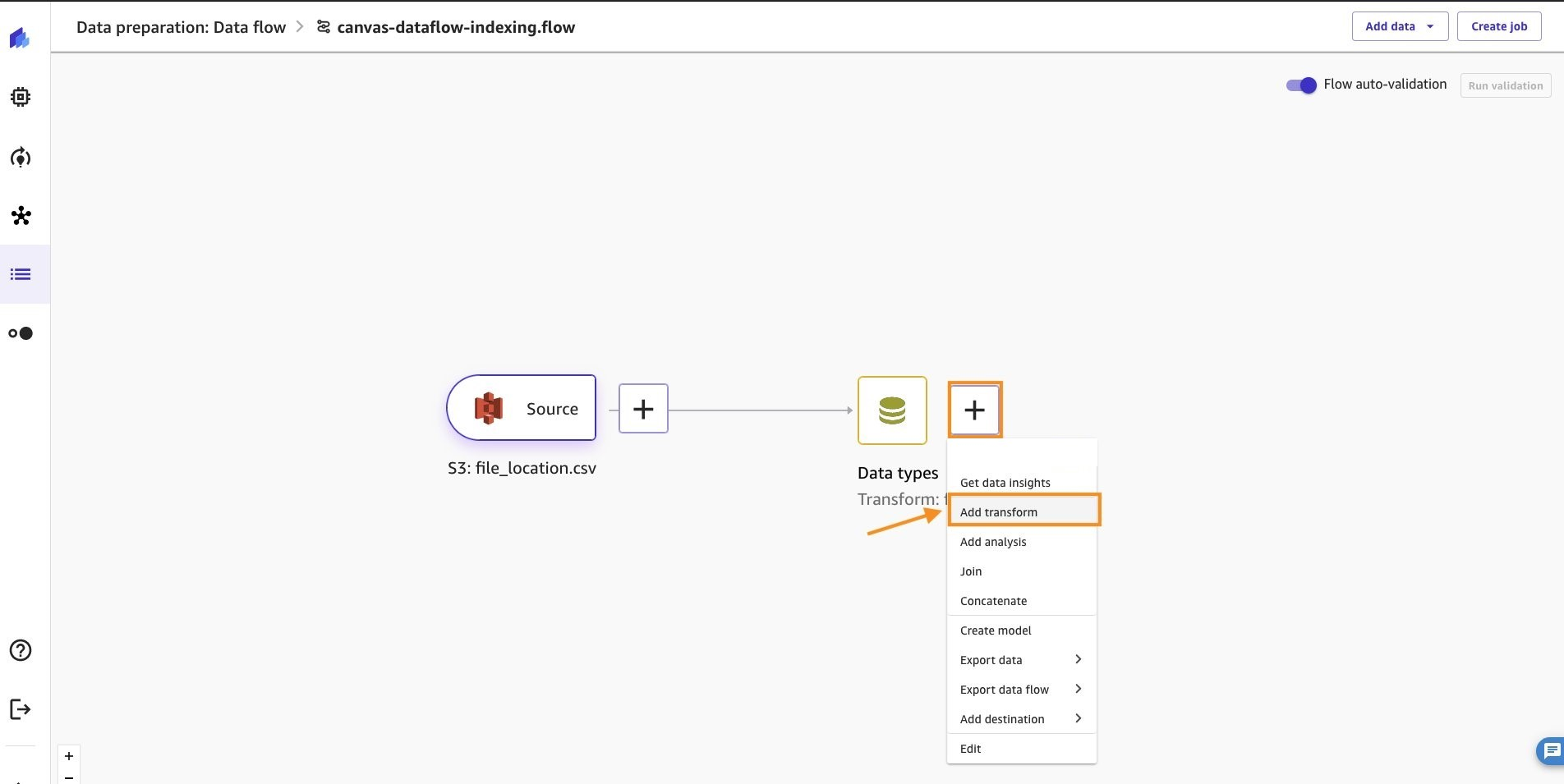

Führen Sie die folgenden Schritte aus, um eine neue Transformation hinzuzufügen:

- Wählen Sie das Pluszeichen und wählen Sie aus Transformation hinzufügen.

- Auswählen Schritt hinzufügen und wählen Sie Benutzerdefinierte Transformation.

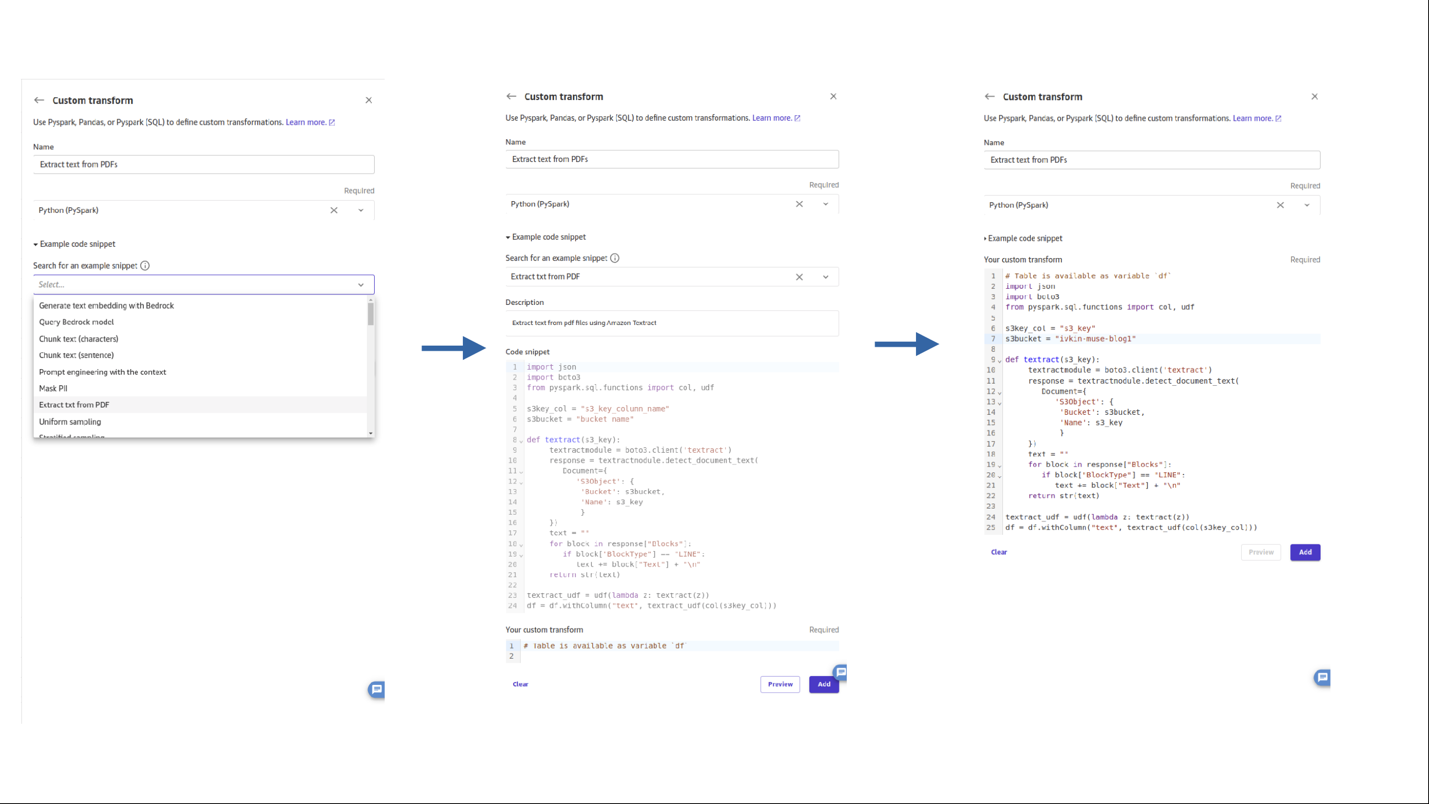

- Sie können eine benutzerdefinierte Transformation mit Pandas, PySpark, benutzerdefinierten Python-Funktionen und SQL PySpark erstellen. Wählen Python (PySpark) für diesen Anwendungsfall.

- Geben Sie einen Namen für den Schritt ein. Durchsuchen Sie die Beispielcodeausschnitte und wählen Sie sie aus Text aus pdf extrahieren. Nehmen Sie die erforderlichen Änderungen am Code-Snippet vor und wählen Sie es aus Speichern.

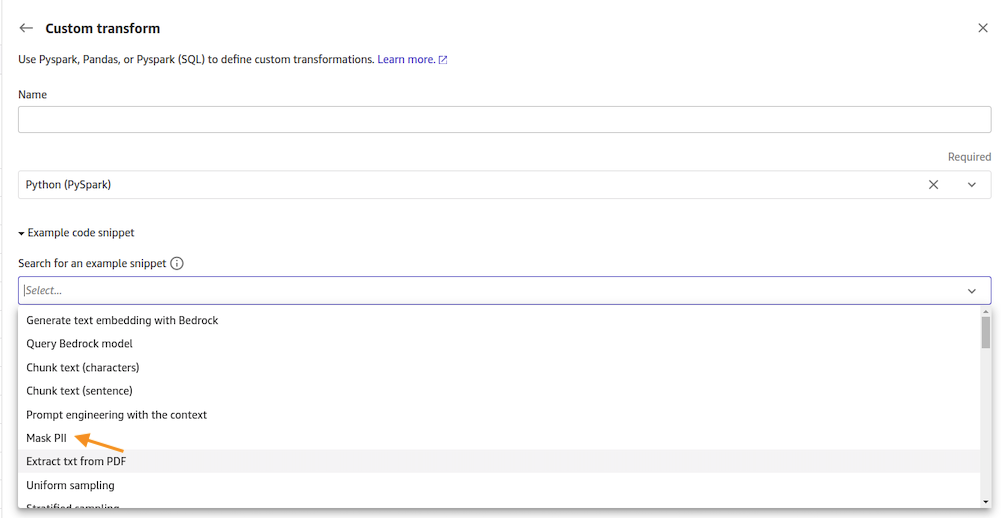

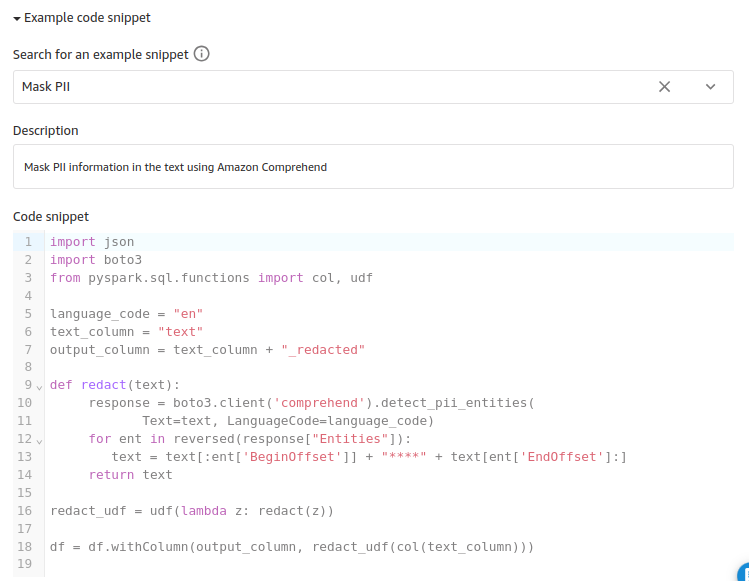

- Fügen wir einen Schritt hinzu, um personenbezogene Daten (Personal Identifiable Information, PII) durch Nutzung aus den extrahierten Daten zu entfernen Amazon verstehen. Wählen Sie Schritt hinzufügen und wählen Sie Benutzerdefinierte Transformation. Und wählen Sie aus Python (PySpark).

Durchsuchen Sie die Beispielcodeausschnitte und wählen Sie sie aus Maske PII. Nehmen Sie die erforderlichen Änderungen am Code-Snippet vor und wählen Sie es aus Hinzufügen.

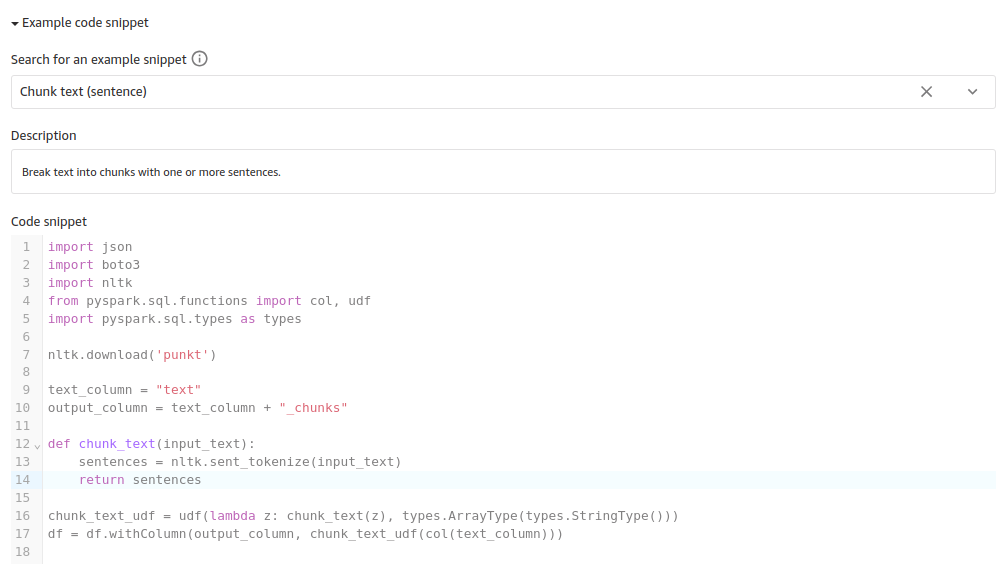

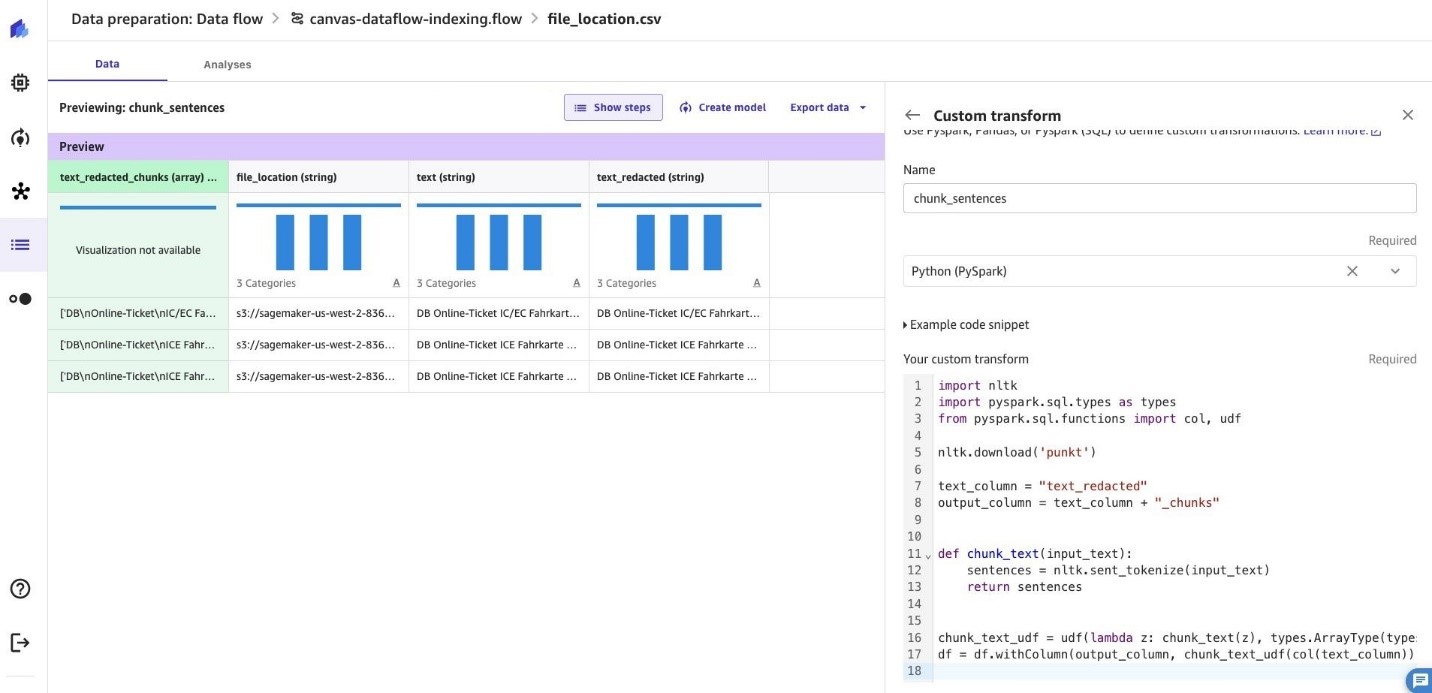

- Der nächste Schritt besteht darin, den Textinhalt aufzuteilen. Wählen Schritt hinzufügen und wählen Sie Benutzerdefinierte Transformation. Und wählen Sie aus Python (PySpark).

Durchsuchen Sie die Beispielcodeausschnitte und wählen Sie sie aus Chunk-Text. Nehmen Sie die erforderlichen Änderungen am Code-Snippet vor und wählen Sie es aus Hinzufügen.

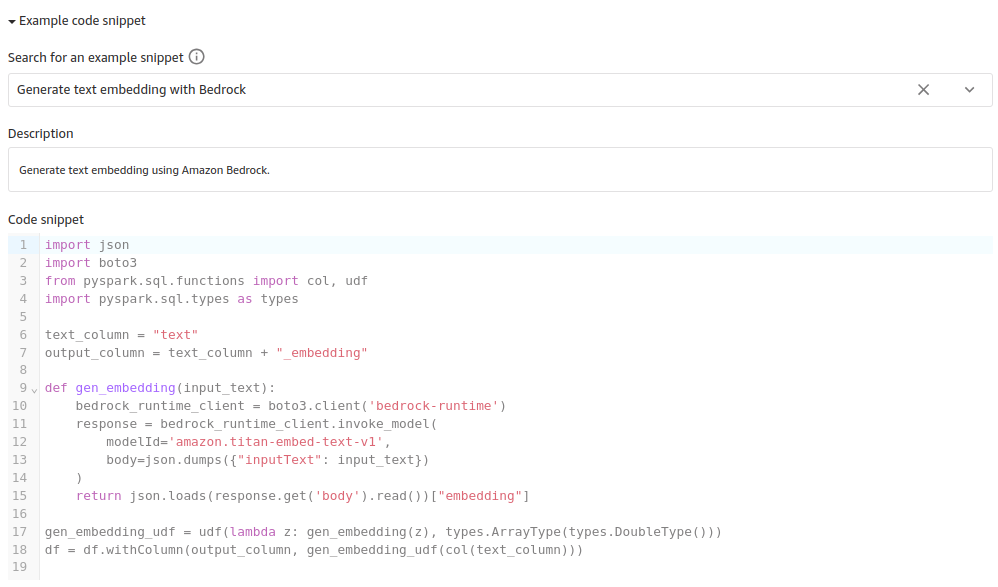

- Konvertieren wir den Textinhalt mithilfe von in Vektoreinbettungen Amazonas Grundgestein Titan Embeddings-Modell. Wählen Schritt hinzufügen und wählen Sie Benutzerdefinierte Transformation. Und wählen Sie aus Python (PySpark).

Durchsuchen Sie die Beispielcodeausschnitte und wählen Sie sie aus Generieren Sie Texteinbettungen mit Bedrock. Nehmen Sie die erforderlichen Änderungen am Code-Snippet vor und wählen Sie es aus Hinzufügen.

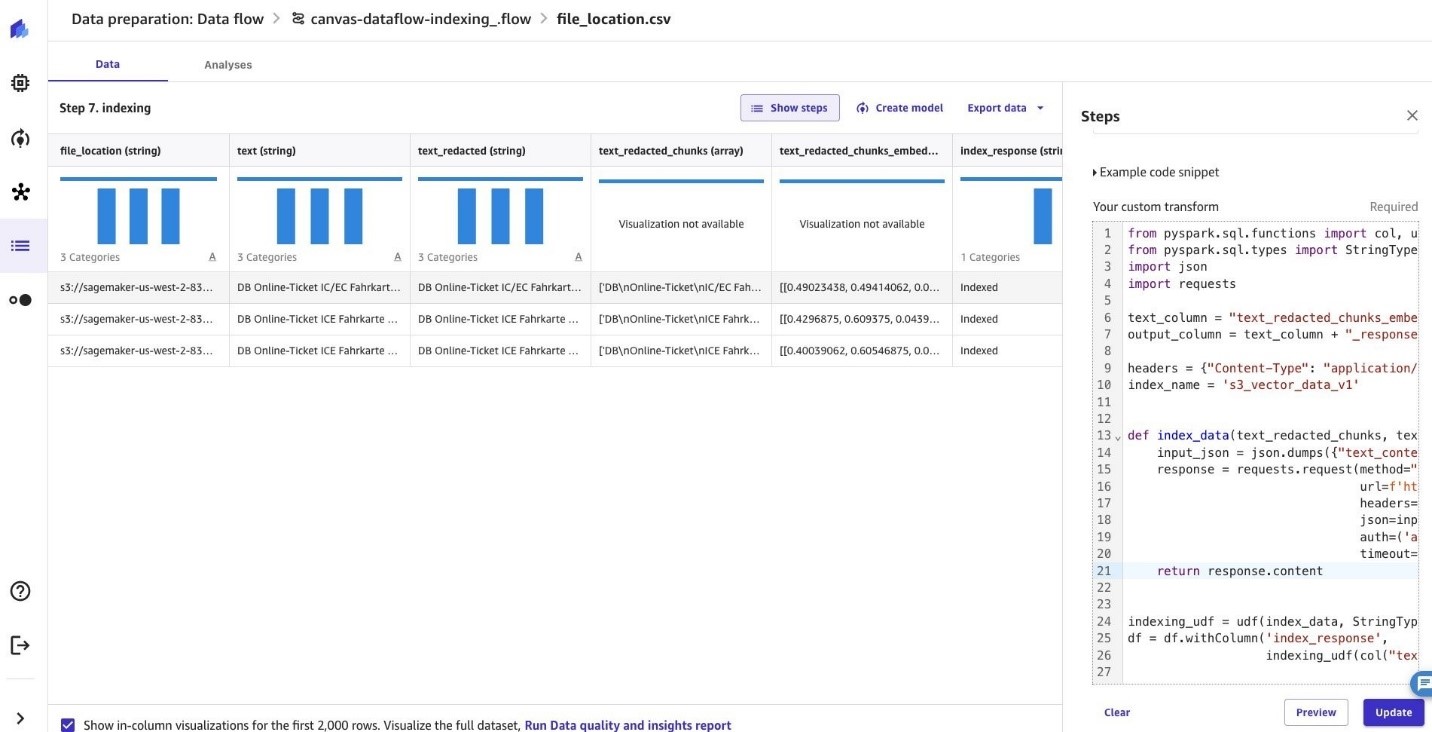

- Jetzt sind Vektoreinbettungen für den Inhalt der PDF-Datei verfügbar. Lassen Sie uns fortfahren und die Daten in Amazon OpenSearch indizieren. Wählen Schritt hinzufügen und wählen Sie Benutzerdefinierte Transformation. Und wählen Sie aus Python (PySpark). Es steht Ihnen frei, den folgenden Code umzuschreiben, um Ihre bevorzugte Vektordatenbank zu verwenden. Der Einfachheit halber verwenden wir den Master-Benutzernamen und das Passwort für den Zugriff auf die OpenSearch-APIs. Für Produktions-Workloads wählen Sie die Option entsprechend den Richtlinien Ihrer Organisation aus.

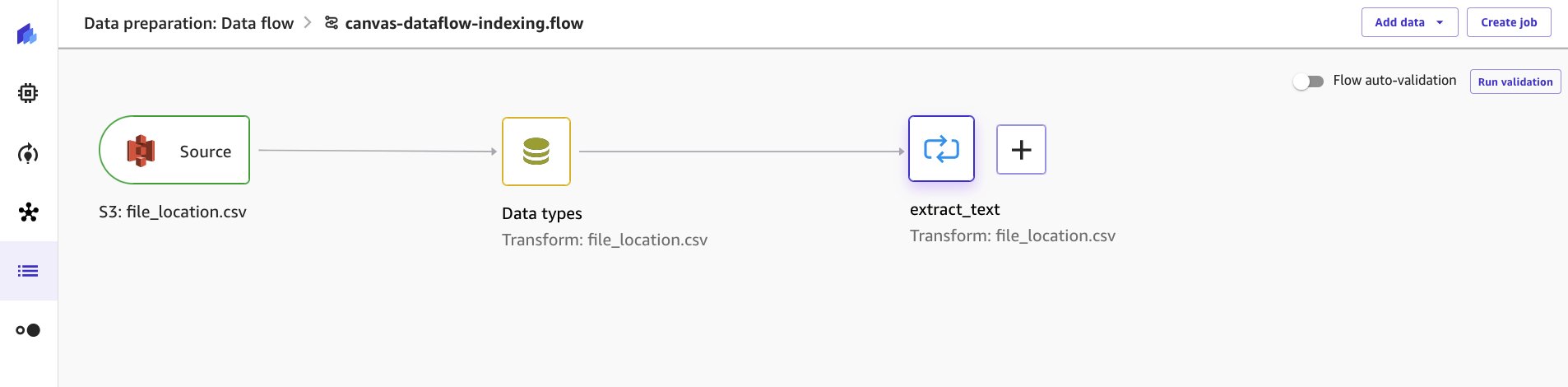

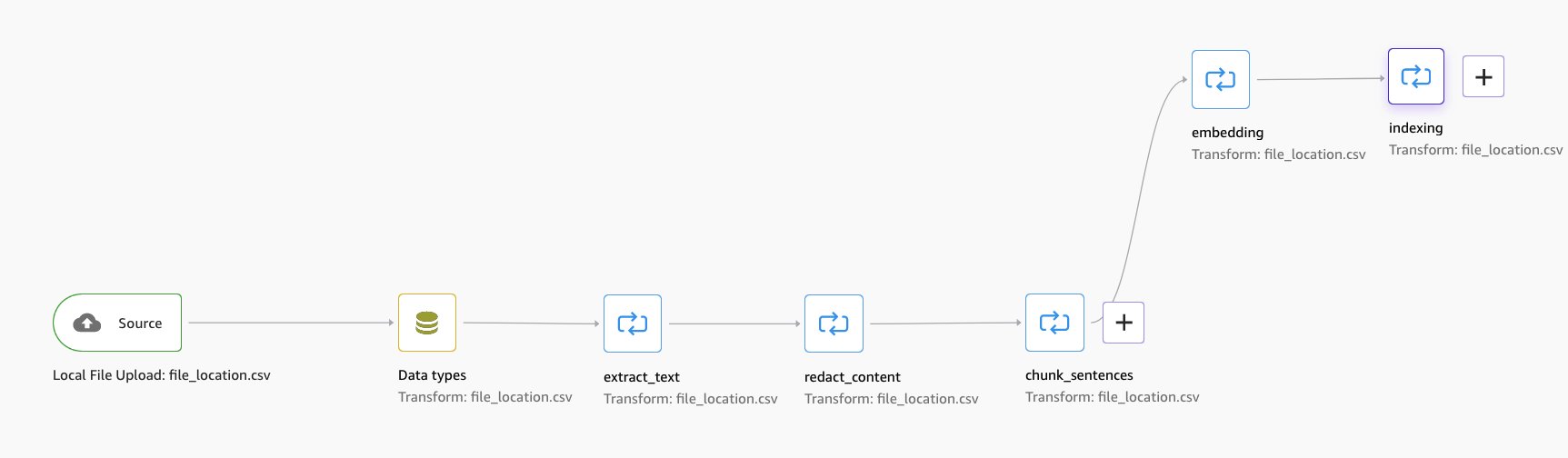

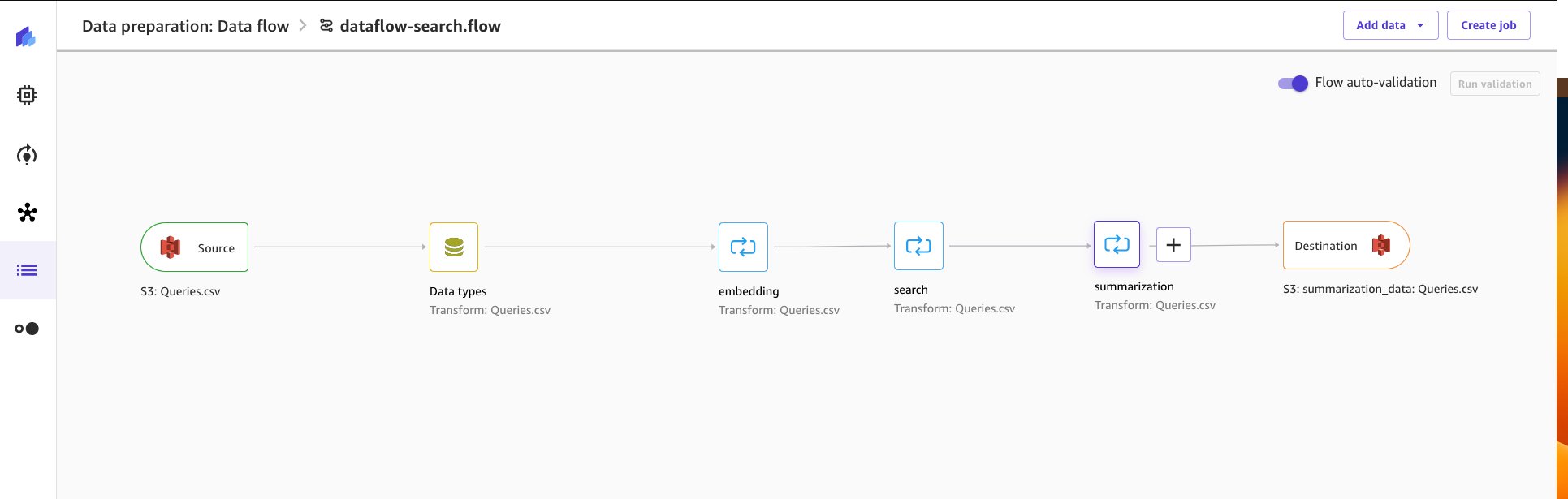

Abschließend würde der erstellte Datenfluss wie folgt aussehen:

Mit diesem Datenfluss wurden die Daten aus der PDF-Datei gelesen und mit Vektoreinbettungen in Amazon OpenSearch indiziert. Jetzt ist es an der Zeit, eine Datei mit Abfragen zu erstellen, um die indizierten Daten abzufragen und sie am Amazon S3-Speicherort zu speichern. Wir richten unseren Suchdatenfluss auf die Datei und geben eine Datei mit entsprechenden Ergebnissen in einer neuen Datei an einem Amazon S3-Speicherort aus.

Vorbereiten einer Eingabeaufforderung

Nachdem wir aus unserem PDF eine Wissensdatenbank erstellt haben, können wir diese testen, indem wir die Wissensdatenbank nach einigen Beispielabfragen durchsuchen. Wir verarbeiten jede Anfrage wie folgt:

- Einbettung für die Abfrage generieren (unterstützt von Amazon Bedrock)

- Abfragevektordatenbank für den Kontext des nächsten Nachbarn (unterstützt von Amazon OpenSearch)

- Kombinieren Sie die Abfrage und den Kontext in der Eingabeaufforderung.

- LLM mit einer Eingabeaufforderung abfragen (unterstützt von Amazon Bedrock)

- Wählen Sie auf der Startseite von SageMaker Canvas die Option aus Datenaufbereitung.

- Auswählen

Erstellen auf der rechten Seite der Seite, geben Sie dann einen Datenflussnamen ein und wählen Sie aus Erstellen.

Laden wir nun die Benutzerfragen und erstellen Sie dann eine Eingabeaufforderung, indem wir die Frage und ähnliche Dokumente kombinieren. Diese Eingabeaufforderung wird dem LLM zur Verfügung gestellt, um eine Antwort auf die Benutzerfrage zu generieren.

- Laden wir eine CSV-Datei mit Benutzerfragen. Wählen Daten importieren und wählen Sie Tabellarisch aus der Dropdown-Liste.

- Datenquelle, und wählen Sie Amazon S3 aus der Dropdown-Liste. Alternativ können Sie eine Datei mit Benutzeranfragen hochladen.

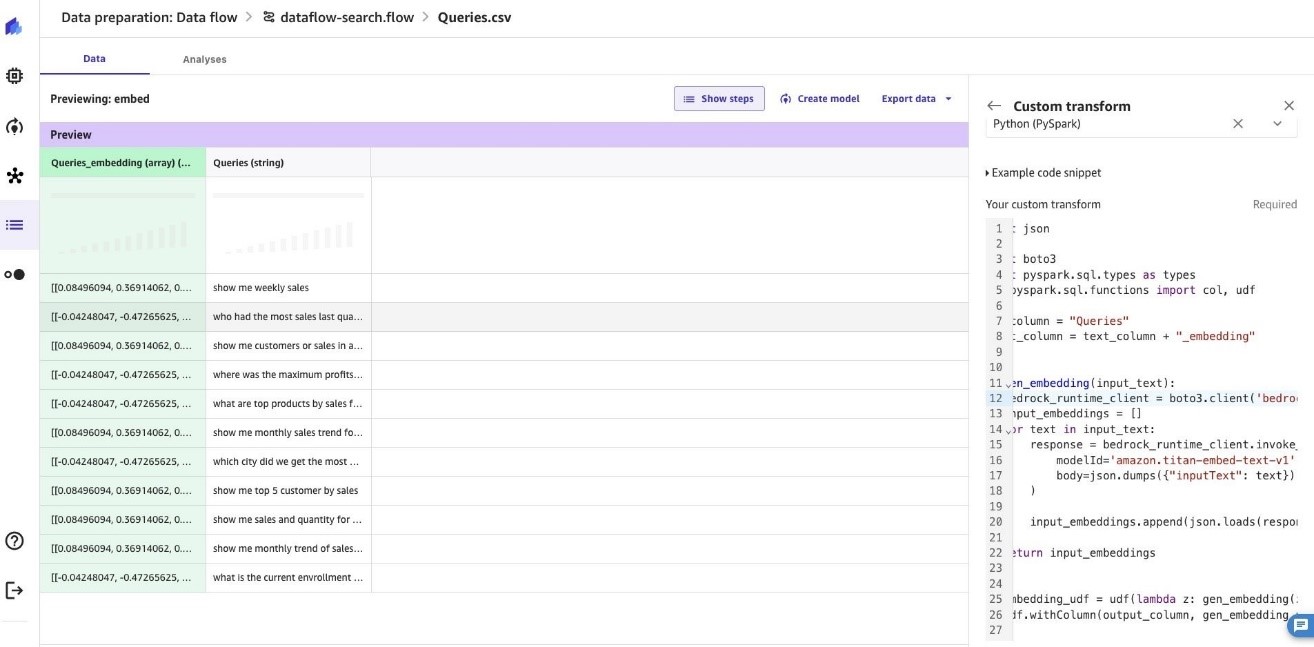

- Fügen wir eine benutzerdefinierte Transformation hinzu, um die Daten in Vektoreinbettungen umzuwandeln, und suchen anschließend nach verwandten Einbettungen in Amazon OpenSearch, bevor wir eine Eingabeaufforderung mit der Abfrage und dem Kontext aus der Wissensdatenbank an Amazon Bedrock senden. Um Einbettungen für die Abfrage zu generieren, können Sie dasselbe Beispielcode-Snippet verwenden Generieren Sie Texteinbettungen mit Bedrock siehe Schritt Nr. 7 oben.

Rufen wir die Amazon OpenSearch-API auf, um relevante Dokumente nach den generierten Vektoreinbettungen zu durchsuchen. Fügen Sie eine benutzerdefinierte Transformation mit Python (PySpark) hinzu.

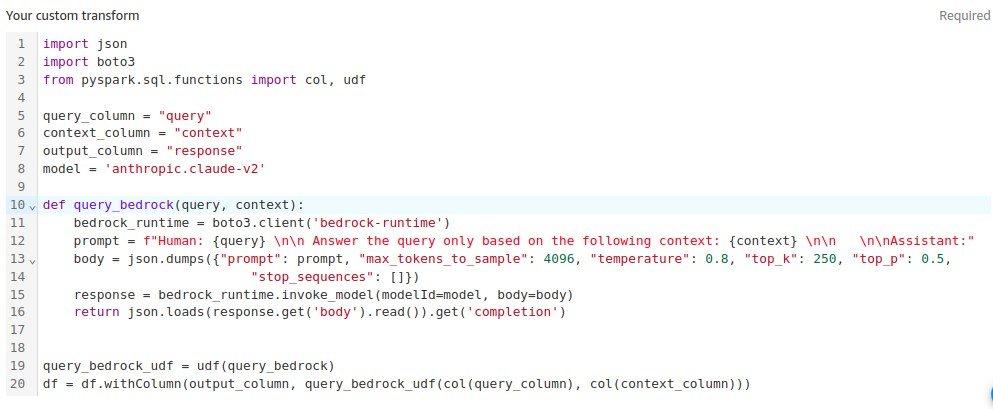

Fügen wir eine benutzerdefinierte Transformation hinzu, um die Amazon Bedrock-API für die Abfrageantwort aufzurufen und dabei die Dokumente aus der Amazon OpenSearch-Wissensdatenbank zu übergeben. Durchsuchen Sie die Beispielcodeausschnitte und wählen Sie sie aus Fragen Sie Bedrock mit Kontext ab. Nehmen Sie die erforderlichen Änderungen am Code-Snippet vor und wählen Sie es aus Hinzufügen.

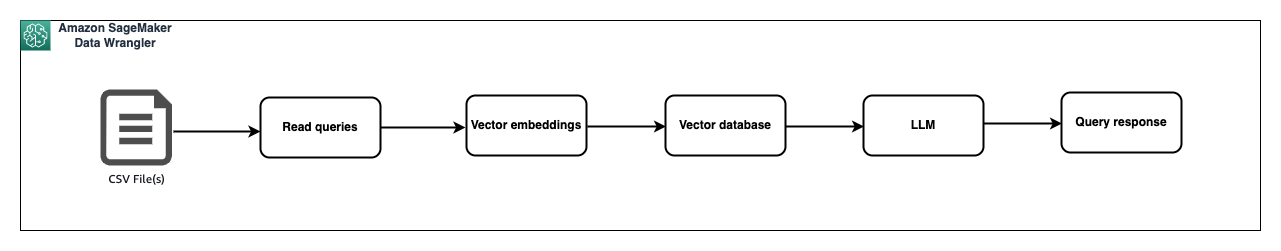

Zusammenfassend sieht der RAG-basierte Frage-Antwort-Datenfluss wie folgt aus:

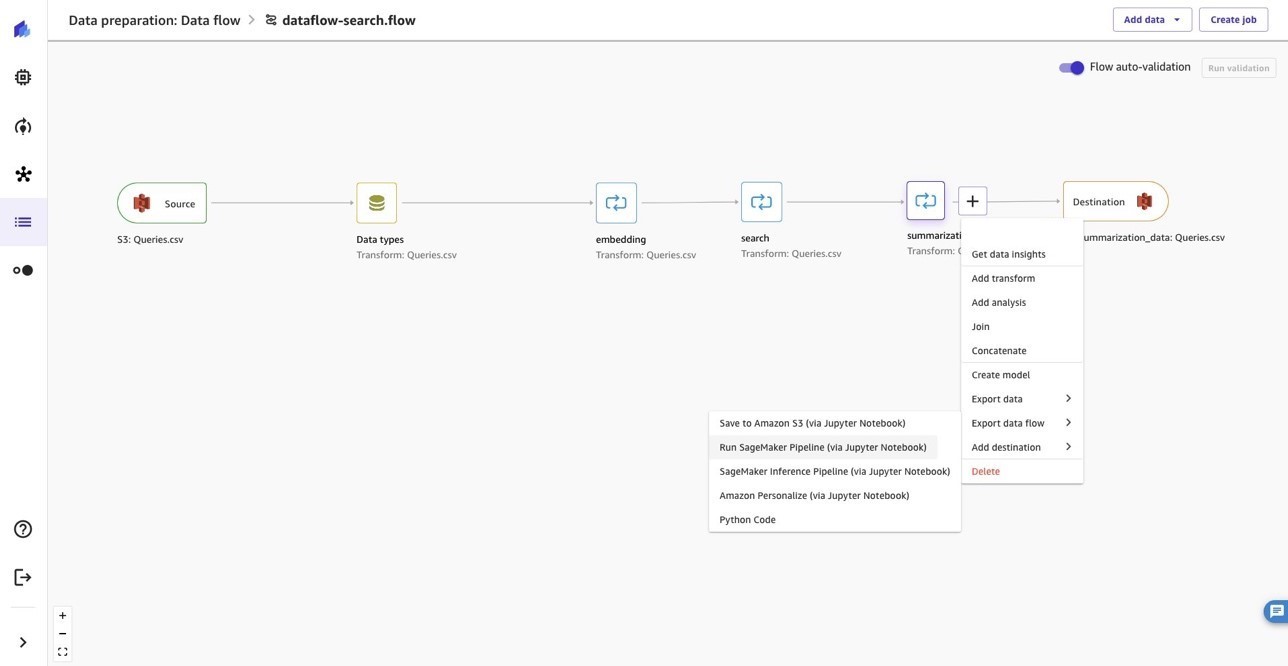

ML-Praktiker verbringen viel Zeit damit, Feature-Engineering-Code zu erstellen, ihn auf ihre ursprünglichen Datensätze anzuwenden, Modelle anhand der entwickelten Datensätze zu trainieren und die Modellgenauigkeit zu bewerten. Angesichts des experimentellen Charakters dieser Arbeit führt selbst das kleinste Projekt zu mehreren Iterationen. Derselbe Feature-Engineering-Code wird häufig immer wieder ausgeführt, wodurch Zeit und Rechenressourcen durch die Wiederholung derselben Vorgänge verschwendet werden. In großen Organisationen kann dies zu einem noch größeren Produktivitätsverlust führen, da verschiedene Teams häufig identische Aufgaben ausführen oder sogar doppelten Feature-Engineering-Code schreiben, weil sie keine Kenntnis von früheren Arbeiten haben. Um die erneute Verarbeitung von Features zu vermeiden, exportieren wir unseren Datenfluss in ein Amazon SageMaker-Pipeline. Lass uns das auswählen +-Schaltfläche rechts neben der Abfrage. Wählen Sie Datenfluss exportieren und wählen Sie Führen Sie die SageMaker-Pipeline aus (über Jupyter-Notizbuch).

Aufräumen

Um zukünftige Gebühren zu vermeiden, löschen oder schließen Sie die Ressourcen, die Sie beim Verfolgen dieses Beitrags erstellt haben. Beziehen auf Abmelden von Amazon SageMaker Canvas für weitere Informationen an.

Zusammenfassung

In diesem Beitrag haben wir Ihnen die End-to-End-Funktionen von Amazon SageMaker Canvas gezeigt, indem wir die Rolle eines Datenprofis übernommen haben, der Daten für ein LLM vorbereitet. Die interaktive Datenaufbereitung ermöglichte eine schnelle Bereinigung, Transformation und Analyse der Daten, um informative Funktionen zu entwickeln. Durch die Eliminierung der Codierungskomplexität ermöglichte SageMaker Canvas eine schnelle Iteration zur Erstellung eines hochwertigen Trainingsdatensatzes. Dieser beschleunigte Arbeitsablauf führte direkt zur Entwicklung, Schulung und Bereitstellung eines leistungsstarken Modells für maschinelles Lernen für geschäftliche Auswirkungen. Mit seiner umfassenden Datenaufbereitung und der einheitlichen Erfahrung von Daten bis hin zu Erkenntnissen ermöglicht SageMaker Canvas Benutzern, ihre ML-Ergebnisse zu verbessern.

Wir ermutigen Sie, durch Erkunden mehr zu erfahren Amazon SageMaker Data Wrangler, Amazon SageMaker-Leinwand, Amazonas-Titan Modelle, Amazonas Grundgesteinund Amazon OpenSearch-Dienst um eine Lösung mithilfe der in diesem Beitrag bereitgestellten Beispielimplementierung und eines für Ihr Unternehmen relevanten Datensatzes zu erstellen. Wenn Sie Fragen oder Anregungen haben, hinterlassen Sie bitte einen Kommentar.

Über die Autoren

Ajjay Govindaram ist Senior Solutions Architect bei AWS. Er arbeitet mit strategischen Kunden zusammen, die KI/ML einsetzen, um komplexe Geschäftsprobleme zu lösen. Seine Erfahrung liegt in der Bereitstellung von technischer Anleitung sowie Designunterstützung für bescheidene bis große KI/ML-Anwendungsbereitstellungen. Sein Wissen reicht von Anwendungsarchitektur bis hin zu Big Data, Analytik und maschinellem Lernen. Er genießt es, Musik zu hören, während er sich ausruht, die Natur zu erleben und Zeit mit seinen Lieben zu verbringen.

Ajjay Govindaram ist Senior Solutions Architect bei AWS. Er arbeitet mit strategischen Kunden zusammen, die KI/ML einsetzen, um komplexe Geschäftsprobleme zu lösen. Seine Erfahrung liegt in der Bereitstellung von technischer Anleitung sowie Designunterstützung für bescheidene bis große KI/ML-Anwendungsbereitstellungen. Sein Wissen reicht von Anwendungsarchitektur bis hin zu Big Data, Analytik und maschinellem Lernen. Er genießt es, Musik zu hören, während er sich ausruht, die Natur zu erleben und Zeit mit seinen Lieben zu verbringen.

Nikita Iwkin ist Senior Applied Scientist bei Amazon SageMaker Data Wrangler mit Interesse an maschinellem Lernen und Datenbereinigungsalgorithmen.

Nikita Iwkin ist Senior Applied Scientist bei Amazon SageMaker Data Wrangler mit Interesse an maschinellem Lernen und Datenbereinigungsalgorithmen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/simplify-data-prep-for-gen-ai-with-amazon-sagemaker-data-wrangler/

- :hast

- :Ist

- :nicht

- 100

- 14

- 20

- 25

- 28

- 50

- 7

- 8

- 804

- a

- Fähig

- LiveBuzz

- oben

- beschleunigen

- beschleunigt

- Zugang

- Nach

- Trading Konten

- Genauigkeit

- hinzufügen

- Zusätzliche

- Adoption

- Vorschüsse

- Vorteil

- Vorteilen

- Nach der

- aufs Neue

- Aggregat

- voraus

- AI

- AI / ML

- Algorithmen

- Richtet sich aus

- Alle

- erlaubt

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon SageMaker Data Wrangler

- Amazon Web Services

- Beträge

- an

- Analysen

- Analytik

- Analyse

- und

- beantworten

- jedem

- Bienen

- Anwendung

- angewandt

- Anwendung

- Architektur

- SIND

- künstlich

- künstliche Intelligenz

- AS

- Hilfe

- At

- anhängen

- Audio-

- Augmented

- verfügbar

- vermeiden

- AWS

- Base

- basierend

- BE

- weil

- wird

- war

- Bevor

- Sein

- Besser

- voreingenommen

- Big

- Big Data

- bauen

- Building

- eingebaut

- Geschäft

- Unternehmen

- Taste im nun erscheinenden Bestätigungsfenster nun wieder los.

- by

- rufen Sie uns an!

- CAN

- Leinwand

- Fähigkeiten

- Häuser

- Verursachen

- Änderungen

- Gebühren

- Auswählen

- reinigen

- Reinigung

- Code

- Programmierung

- Vereinigung

- Kommentar

- Unternehmen

- verglichen

- wettbewerbsfähig

- abschließen

- Komplex

- Komplexität

- begreifen

- umfassend

- Berechnen

- Geht davon

- Konsul (Console)

- enthalten

- enthält

- Inhalt

- Inhalt

- Kontext

- Kontexte

- weiter

- Smartgeräte App

- verkaufen

- Dazugehörigen

- könnte

- Abdeckung

- erstellen

- erstellt

- kritischem

- Original

- Kunde

- Kundenservice

- Kunden

- technische Daten

- Datenaufbereitung

- Datenbase

- Datensätze

- deloitte

- Synergie

- Bereitstellen

- Implementierungen

- Design

- Details

- Entwicklung

- anders

- schwer

- Abmessungen

- Richtung

- Direkt

- entdeckt,

- do

- Dokument

- Dokumentation

- Unterlagen

- Domain

- Domains

- nach unten

- im

- e

- jeder

- leicht

- effektiv

- effizient

- effizient

- E-Mails

- Einbettung

- befähigt

- freigegeben

- ermöglichen

- ermutigen

- End-to-End

- Ingenieur

- entwickelt

- Entwicklung

- Auswerten

- Sogar

- Beispiel

- existiert

- ERFAHRUNGEN

- erleben

- experimentell

- ERKUNDEN

- Möglichkeiten sondieren

- exportieren

- Extrakt

- Merkmal

- Eigenschaften

- wenige

- Felder

- Reichen Sie das

- Filter

- Finale

- Finden Sie

- Fluss

- gefolgt

- Folgende

- folgt

- Aussichten für

- Forbes

- Foundation

- Foundations

- Frei

- für

- voller

- Funktionen

- weiter

- Zukunft

- Gewinnen

- erzeugen

- erzeugt

- Erzeugung

- Generation

- generativ

- Generative KI

- bekommen

- ABSICHT

- gegeben

- Global

- Go

- Kundenziele

- gut

- mehr

- Haben

- he

- Überschriften

- hochwertige

- seine

- hält

- Startseite

- Ultraschall

- Hilfe

- aber

- HTML

- HTTPS

- i

- identisch

- if

- Bilder

- Impact der HXNUMXO Observatorien

- Implementierung

- importieren

- wichtig

- beeindruckend

- zu unterstützen,

- in

- Dazu gehören

- Index

- indiziert

- Information

- informativ

- Anfangs-

- Einblicke

- Anleitung

- Integration

- Intelligenz

- interaktive

- Interessen

- Schnittstelle

- Internet

- in

- beteiligen

- IT

- Iteration

- Iterationen

- SEINE

- Jobs

- jpg

- JSON

- Wissen

- Land

- Sprache

- grosse

- großflächig

- starten

- umwandeln

- LERNEN

- lernen

- Verlassen

- geführt

- Nutzung

- liegt

- Gefällt mir

- Liste

- Hören

- LLM

- Belastung

- Standorte

- Standorte

- Verlust

- Los

- geliebt wird

- Sneaker

- Maschine

- Maschinelles Lernen

- Main

- um

- MACHT

- Maske"

- massiv

- Master

- Kann..

- Mechanismen

- Medien

- MENÜ

- Meta

- Metadaten

- ML

- Modell

- für

- bescheiden

- mehr

- vor allem warme

- mehrere

- Musik

- Name

- Natürliche

- Verarbeitung natürlicher Sprache

- Natur

- Menü

- notwendig,

- Need

- Neu

- weiter

- nicht

- Notizbuch

- jetzt an

- of

- vorgenommen,

- on

- einmal

- Einsen

- einzige

- Einkauf & Prozesse

- Option

- or

- Organisation

- Organisationen

- Andere

- UNSERE

- Ergebnisse

- im Freien

- Möglichkeiten für das Ausgangssignal:

- übrig

- Seite

- Pandas

- Brot

- Bestehen

- Passwort

- Leistung

- persönliche

- wählen

- Stück

- Stücke

- Pipeline

- Plato

- Datenintelligenz von Plato

- PlatoData

- Bitte

- erfahren

- Points

- Politik durchzulesen

- Post

- Potenzial

- angetriebene

- bevorzugt

- Vorbereitung

- Danach

- Vorbereitung

- Vor

- wahrscheinlich

- Aufgabenstellung:

- Probleme

- vorgehen

- Prozessdefinierung

- Verarbeitung

- Produktion

- PRODUKTIVITÄT

- Professionell

- Projekt

- immobilien

- vorausgesetzt

- bietet

- Bereitstellung

- Python

- Abfragen

- Frage

- Fragen

- schnell

- Bereiche

- schnell

- Bewertungen

- erreichen

- Lesen Sie mehr

- realen Welt

- Received

- siehe

- bezogene

- relevant

- Entfernen

- Berichtet

- Zugriffe

- erfordern

- erfordert

- Downloads

- Antwort

- Antworten

- ruhend

- Die Ergebnisse

- Rückkehr

- Bewertungen

- Recht

- Rollen

- Führen Sie

- sagemaker

- gleich

- Speichern

- Wissenschaftler

- Suche

- Suche

- Abschnitt

- gesehen

- wählen

- Sendung

- Senior

- empfindlich

- Lösungen

- Einstellungen

- sollte

- erklären

- zeigte

- geschlossen

- schließen

- Seite

- Schild

- signifikant

- ähnlich

- Einfachheit

- vereinfachen

- Größe

- Schnipsel

- So

- Social Media

- Social Media

- Lösung

- Lösungen

- LÖSEN

- einige

- Quelle

- Quellen

- spezifisch

- speziell

- verbringen

- Ausgabe

- Stufe

- Stufen

- Schritt

- Shritte

- Immer noch

- Strategisch

- strukturierte

- ZUSAMMENFASSUNG

- Unterstützt

- Umfrage

- Nehmen

- Teams

- Technische

- Techniken

- Test

- Text

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Zukunft

- ihr

- Sie

- dann

- Dort.

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- So

- Zeit

- Titan

- zu

- heute

- Werkzeuge

- Ausbildung

- Transformieren

- Transformation

- Transformationen

- Transformieren

- was immer dies auch sein sollte.

- Kürzung

- tippe

- Typen

- einheitlich

- us

- -

- benutzt

- Mitglied

- Nutzer

- Verwendung von

- wertvoll

- Video

- visuell

- Walkthrough

- we

- Netz

- Web-Services

- GUT

- welche

- während

- WHO

- werden wir

- mit

- Arbeiten

- Arbeitsablauf.

- Werk

- würde

- schreiben

- Du

- Ihr

- Zephyrnet