Mit dem Aufkommen der generativen KI können heutige Basismodelle (FMs), wie die großen Sprachmodelle (LLMs) Claude 2 und Llama 2, eine Reihe generativer Aufgaben wie die Beantwortung von Fragen, Zusammenfassungen und die Erstellung von Inhalten für Textdaten ausführen. Allerdings liegen reale Daten in mehreren Modalitäten vor, beispielsweise als Text, Bilder, Video und Audio. Nehmen Sie zum Beispiel ein PowerPoint-Foliendeck. Es kann Informationen in Form von Text enthalten oder in Grafiken, Tabellen und Bilder eingebettet sein.

In diesem Beitrag stellen wir eine Lösung vor, die multimodale FMs wie das verwendet Multimodale Einbettungen von Amazon Titan Modell und LLaVA 1.5 und AWS-Dienste einschließlich Amazonas Grundgestein und Amazon Sage Maker um ähnliche generative Aufgaben an multimodalen Daten durchzuführen.

Lösungsüberblick

Die Lösung bietet eine Implementierung zur Beantwortung von Fragen mithilfe von Informationen, die im Text und in visuellen Elementen eines Foliendecks enthalten sind. Das Design basiert auf dem Konzept der Retrieval Augmented Generation (RAG). Traditionell wird RAG mit Textdaten in Verbindung gebracht, die von LLMs verarbeitet werden können. In diesem Beitrag erweitern wir RAG auch um Bilder. Dies bietet eine leistungsstarke Suchfunktion, um kontextrelevante Inhalte aus visuellen Elementen wie Tabellen und Grafiken zusammen mit Text zu extrahieren.

Es gibt verschiedene Möglichkeiten, eine RAG-Lösung zu entwerfen, die Bilder enthält. Wir haben hier einen Ansatz vorgestellt und werden im zweiten Beitrag dieser dreiteiligen Serie einen alternativen Ansatz vorstellen.

Diese Lösung umfasst die folgenden Komponenten:

- Amazon Titan Multimodal Embeddings-Modell – Dieses FM wird verwendet, um Einbettungen für den Inhalt des in diesem Beitrag verwendeten Foliendecks zu generieren. Als multimodales Modell kann dieses Titan-Modell Text, Bilder oder eine Kombination davon als Eingabe verarbeiten und Einbettungen generieren. Das Titan Multimodal Embeddings-Modell generiert Vektoren (Einbettungen) mit 1,024 Dimensionen und ist über Amazon Bedrock zugänglich.

- Großer Sprach- und Sehassistent (LLaVA) – LLaVA ist ein multimodales Open-Source-Modell für das visuelle und sprachliche Verständnis und wird zur Interpretation der Daten in den Folien verwendet, einschließlich visueller Elemente wie Grafiken und Tabellen. Wir verwenden die 7-Milliarden-Parameter-Version LLaVA 1.5-7b in dieser Lösung.

- Amazon Sage Maker – Das LLaVA-Modell wird mithilfe von SageMaker-Hostingdiensten auf einem SageMaker-Endpunkt bereitgestellt, und wir verwenden den resultierenden Endpunkt, um Rückschlüsse auf das LLaVA-Modell zu ziehen. Wir verwenden auch SageMaker-Notebooks, um diese Lösung durchgängig zu orchestrieren und zu demonstrieren.

- Amazon OpenSearch ohne Server – OpenSearch Serverless ist eine serverlose On-Demand-Konfiguration für Amazon OpenSearch-Dienst. Wir verwenden OpenSearch Serverless als Vektordatenbank zum Speichern von Einbettungen, die vom Titan Multimodal Embeddings-Modell generiert wurden. Ein in der OpenSearch Serverless-Sammlung erstellter Index dient als Vektorspeicher für unsere RAG-Lösung.

- Amazon OpenSearch Ingestion (OSI) – OSI ist ein vollständig verwalteter, serverloser Datensammler, der Daten an OpenSearch Service-Domänen und serverlose OpenSearch-Sammlungen liefert. In diesem Beitrag verwenden wir eine OSI-Pipeline, um Daten an den OpenSearch Serverless-Vektorspeicher zu liefern.

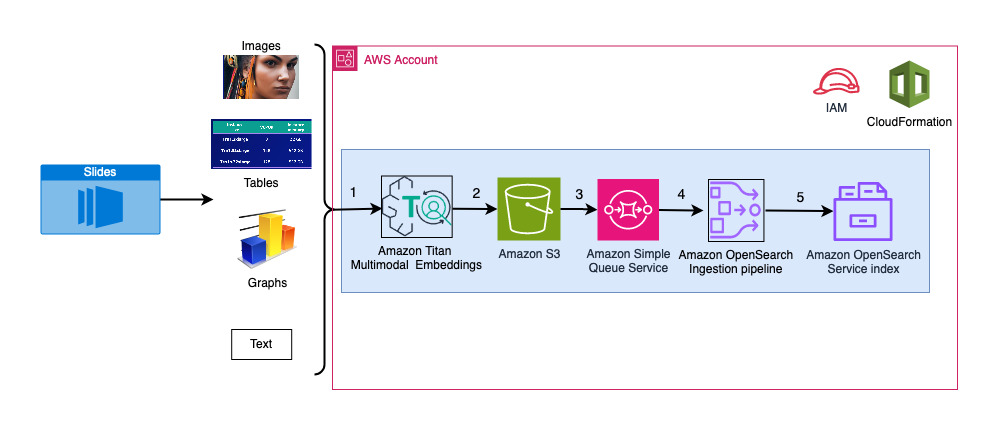

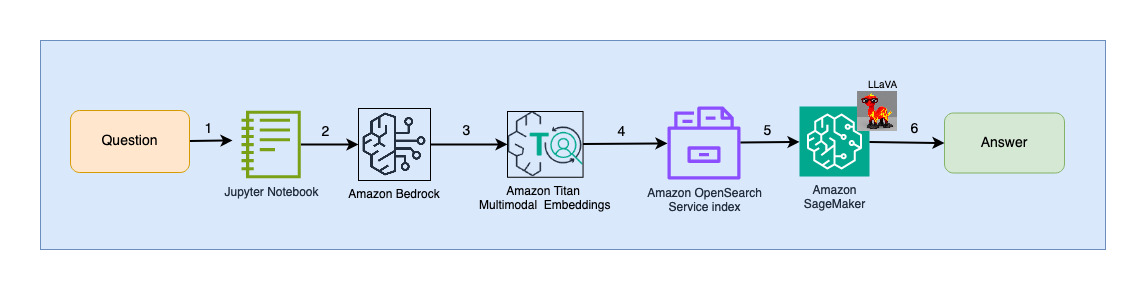

Lösungsarchitektur

Das Lösungsdesign besteht aus zwei Teilen: Aufnahme und Benutzerinteraktion. Während der Aufnahme verarbeiten wir den Eingabe-Folienstapel, indem wir jede Folie in ein Bild konvertieren, Einbettungen für diese Bilder generieren und dann den Vektordatenspeicher füllen. Diese Schritte werden vor den Schritten zur Benutzerinteraktion abgeschlossen.

In der Benutzerinteraktionsphase wird eine Frage des Benutzers in Einbettungen umgewandelt und eine Ähnlichkeitssuche in der Vektordatenbank durchgeführt, um eine Folie zu finden, die möglicherweise Antworten auf die Benutzerfrage enthalten könnte. Anschließend stellen wir diese Folie (in Form einer Bilddatei) dem LLaVA-Modell und der Benutzerfrage als Aufforderung zur Verfügung, um eine Antwort auf die Anfrage zu generieren. Der gesamte Code für diesen Beitrag ist im verfügbar GitHub Repo.

Das folgende Diagramm veranschaulicht die Aufnahmearchitektur.

Die Arbeitsschritte sind wie folgt:

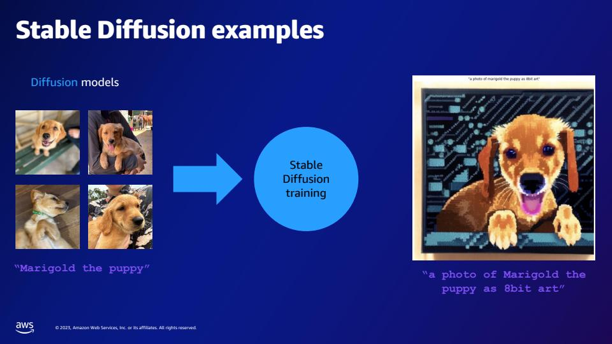

- Folien werden in Bilddateien (eine pro Folie) im JPG-Format konvertiert und an das Titan Multimodal Embeddings-Modell übergeben, um Einbettungen zu generieren. In diesem Beitrag verwenden wir das Foliendeck mit dem Titel Trainieren und implementieren Sie Stable Diffusion mit AWS Trainium und AWS Inferentia vom AWS Summit in Toronto im Juni 2023, um die Lösung zu demonstrieren. Das Beispieldeck verfügt über 31 Folien, sodass wir 31 Sätze Vektoreinbettungen mit jeweils 1,024 Dimensionen generieren. Wir fügen diesen generierten Vektoreinbettungen zusätzliche Metadatenfelder hinzu und erstellen eine JSON-Datei. Diese zusätzlichen Metadatenfelder können verwendet werden, um umfangreiche Suchabfragen mithilfe der leistungsstarken Suchfunktionen von OpenSearch durchzuführen.

- Die generierten Einbettungen werden in einer einzigen JSON-Datei zusammengefasst, die hochgeladen wird Amazon Simple Storage-Service (Amazon S3).

- Weitere Informationen zur Stelle und den Ansprechpartner in unserem Hause finden Sie hier: Amazon S3-Ereignisbenachrichtigungen, ein Ereignis wird in eine eingefügt Amazon Simple Queue-Dienst Warteschlange (Amazon SQS).

- Dieses Ereignis in der SQS-Warteschlange fungiert als Auslöser für die Ausführung der OSI-Pipeline, die wiederum die Daten (JSON-Datei) als Dokumente in den OpenSearch Serverless-Index aufnimmt. Beachten Sie, dass der OpenSearch Serverless-Index als Senke für diese Pipeline konfiguriert und als Teil der OpenSearch Serverless-Sammlung erstellt wird.

Das folgende Diagramm veranschaulicht die Benutzerinteraktionsarchitektur.

Die Arbeitsschritte sind wie folgt:

- Ein Benutzer sendet eine Frage im Zusammenhang mit dem aufgenommenen Foliensatz.

- Die Benutzereingaben werden mithilfe des Titan Multimodal Embeddings-Modells, auf das über Amazon Bedrock zugegriffen wird, in Einbettungen umgewandelt. Mithilfe dieser Einbettungen wird eine OpenSearch-Vektorsuche durchgeführt. Wir führen eine Suche nach k-nächsten Nachbarn (k=1) durch, um die relevanteste Einbettung abzurufen, die der Benutzeranfrage entspricht. Durch die Einstellung k=1 wird die Folie abgerufen, die für die Benutzerfrage am relevantesten ist.

- Die Metadaten der Antwort von OpenSearch Serverless enthalten einen Pfad zu dem Bild, das der relevantesten Folie entspricht.

- Durch die Kombination der Benutzerfrage und des Bildpfads wird eine Eingabeaufforderung erstellt und an LLaVA bereitgestellt, das auf SageMaker gehostet wird. Das LLaVA-Modell ist in der Lage, die Benutzerfrage zu verstehen und durch Untersuchung der Daten im Bild zu beantworten.

- Das Ergebnis dieser Schlussfolgerung wird an den Benutzer zurückgegeben.

Diese Schritte werden in den folgenden Abschnitten ausführlich erläutert. Siehe die Die Ergebnisse Abschnitt für Screenshots und Details zur Ausgabe.

Voraussetzungen:

Um die in diesem Beitrag bereitgestellte Lösung zu implementieren, sollten Sie über eine AWS-Konto und Vertrautheit mit FMs, Amazon Bedrock, SageMaker und OpenSearch Service.

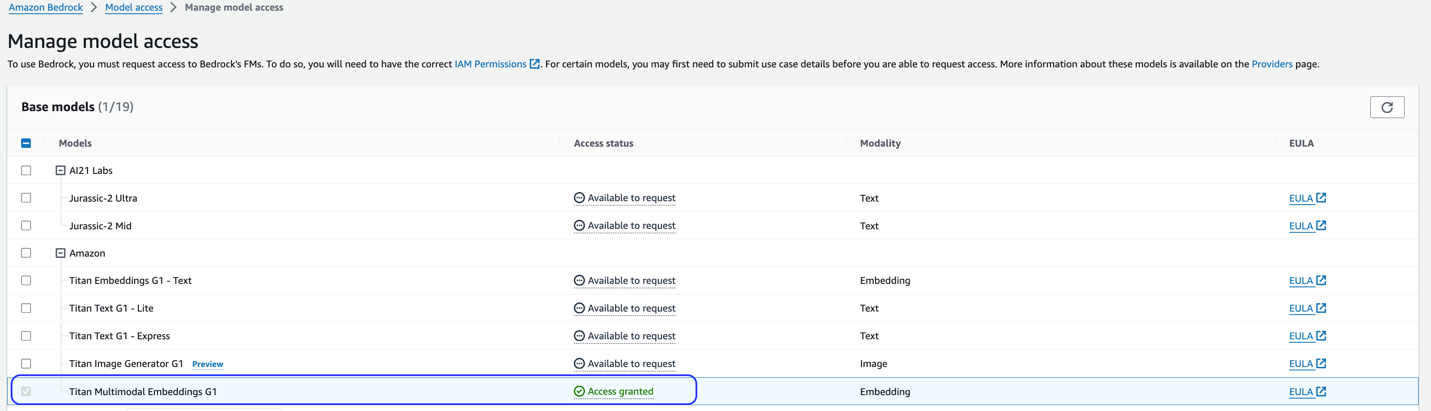

Diese Lösung verwendet das Titan Multimodal Embeddings-Modell. Stellen Sie sicher, dass dieses Modell für die Verwendung in Amazon Bedrock aktiviert ist. Wählen Sie auf der Amazon Bedrock-Konsole Modellzugriff im Navigationsbereich. Wenn Titan Multimodal Embeddings aktiviert ist, wird der Zugriffsstatus angezeigt Zugang gewährt.

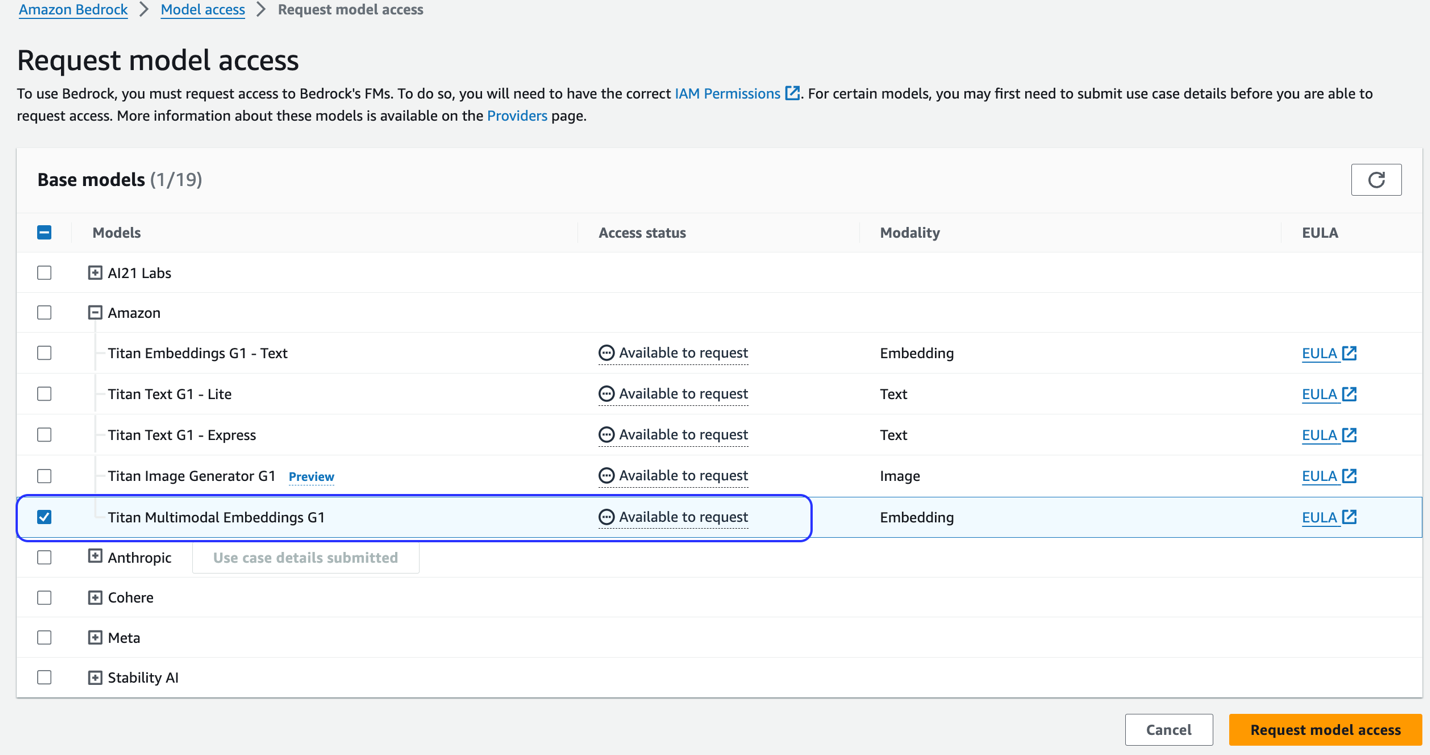

Wenn das Modell nicht verfügbar ist, aktivieren Sie den Zugriff auf das Modell, indem Sie wählen Modellzugriff verwalten, auswählend Titan Multimodale Einbettungen G1und wählen Modellzugang anfordern. Das Modell ist sofort betriebsbereit.

Verwenden Sie eine AWS CloudFormation-Vorlage, um den Lösungsstapel zu erstellen

Verwenden Sie eine der folgenden Optionen AWS CloudFormation Vorlagen (abhängig von Ihrer Region), um die Lösungsressourcen zu starten.

| AWS-Region | Link |

|---|---|

us-east-1 |

|

us-west-2 |

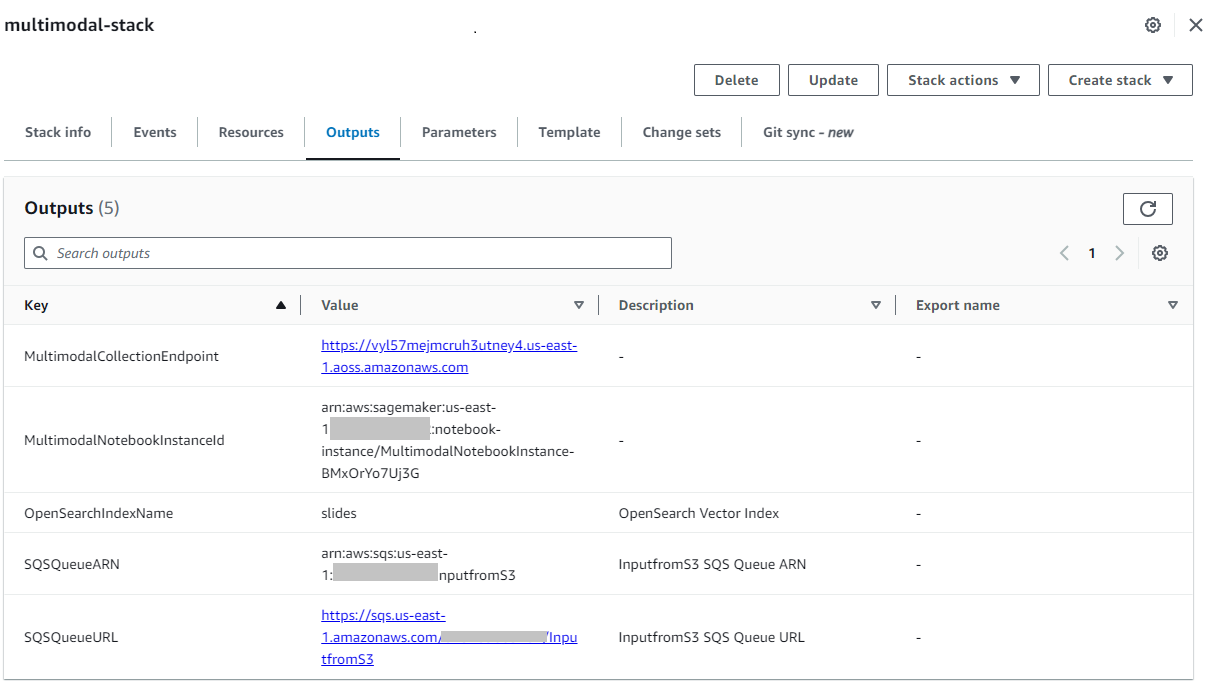

Nachdem der Stapel erfolgreich erstellt wurde, navigieren Sie zu den Stapeln Ausgänge Klicken Sie auf die Registerkarte „AWS CloudFormation“ und notieren Sie sich den Wert für MultimodalCollectionEndpoint, die wir in den folgenden Schritten verwenden.

Die CloudFormation-Vorlage erstellt die folgenden Ressourcen:

- IAM-Rollen - Die folgende AWS Identity and Access Management and (IAM-)Rollen werden erstellt. Aktualisieren Sie diese Rollen, um sie anzuwenden Berechtigungen mit den geringsten Privilegien.

SMExecutionRolemit Amazon S3, SageMaker, OpenSearch Service und Bedrock-Vollzugriff.OSPipelineExecutionRolemit Zugriff auf bestimmte Amazon SQS- und OSI-Aktionen.

- SageMaker-Notizbuch – Der gesamte Code für diesen Beitrag wird über dieses Notebook ausgeführt.

- Serverlose OpenSearch-Sammlung – Dies ist die Vektordatenbank zum Speichern und Abrufen von Einbettungen.

- OSI-Pipeline – Dies ist die Pipeline für die Datenaufnahme in OpenSearch Serverless.

- S3-Eimer – Alle Daten für diesen Beitrag werden in diesem Bucket gespeichert.

- SQS-Warteschlange – Die Ereignisse zum Auslösen des OSI-Pipeline-Laufs werden in diese Warteschlange gestellt.

Die CloudFormation-Vorlage konfiguriert die OSI-Pipeline mit Amazon S3- und Amazon SQS-Verarbeitung als Quelle und einem OpenSearch Serverless-Index als Senke. Alle im angegebenen S3-Bucket und Präfix erstellten Objekte (multimodal/osi-embeddings-json) löst SQS-Benachrichtigungen aus, die von der OSI-Pipeline verwendet werden, um Daten in OpenSearch Serverless aufzunehmen.

Die CloudFormation-Vorlage erstellt auch Netzwerk, Verschlüsselung und Datenzugriff Richtlinien, die für die OpenSearch Serverless-Sammlung erforderlich sind. Aktualisieren Sie diese Richtlinien, um Berechtigungen mit den geringsten Rechten anzuwenden.

Beachten Sie, dass in SageMaker-Notizbüchern auf den Namen der CloudFormation-Vorlage verwiesen wird. Wenn der Name der Standardvorlage geändert wird, stellen Sie sicher, dass Sie ihn aktualisieren globals.py

Testen Sie die Lösung

Nachdem die erforderlichen Schritte abgeschlossen sind und der CloudFormation-Stack erfolgreich erstellt wurde, können Sie nun die Lösung testen:

- Wählen Sie in der SageMaker-Konsole Notizbücher im Navigationsbereich.

- Wähle aus

MultimodalNotebookInstanceNotebook-Instanz und wählen Sie Öffnen Sie JupyterLab.

- In Datei-Browser, wechseln Sie zum Ordner „Notebooks“, um die Notebooks und unterstützenden Dateien anzuzeigen.

Die Notebooks werden in der Reihenfolge nummeriert, in der sie ausgeführt werden. Anweisungen und Kommentare in jedem Notizbuch beschreiben die von diesem Notizbuch ausgeführten Aktionen. Wir führen diese Notebooks einzeln aus.

- Auswählen 0_deploy_llava.ipynb um es in JupyterLab zu öffnen.

- Auf dem Führen Sie Menü, wählen Sie Führen Sie alle Zellen aus um den Code in diesem Notebook auszuführen.

Dieses Notebook stellt das LLaVA-v1.5-7B-Modell auf einem SageMaker-Endpunkt bereit. In diesem Notizbuch laden wir das Modell LLaVA-v1.5-7B von HuggingFace Hub herunter und ersetzen das Skript inference.py durch llava_inference.py, und erstellen Sie eine model.tar.gz-Datei für dieses Modell. Die Datei „model.tar.gz“ wird auf Amazon S3 hochgeladen und für die Bereitstellung des Modells auf dem SageMaker-Endpunkt verwendet. Der llava_inference.py Das Skript verfügt über zusätzlichen Code, der das Lesen einer Bilddatei aus Amazon S3 und das Ausführen von Inferenzen darauf ermöglicht.

- Auswählen 1_data_prep.ipynb um es in JupyterLab zu öffnen.

- Auf dem Führen Sie Menü, wählen Sie Führen Sie alle Zellen aus um den Code in diesem Notebook auszuführen.

Dieses Notizbuch lädt das herunter Rutsche Deck, konvertiert jede Folie in das JPG-Dateiformat und lädt diese in den für diesen Beitrag verwendeten S3-Bucket hoch.

- Auswählen 2_data_ingestion.ipynb um es in JupyterLab zu öffnen.

- Auf dem Führen Sie Menü, wählen Sie Führen Sie alle Zellen aus um den Code in diesem Notebook auszuführen.

In diesem Notizbuch machen wir Folgendes:

- Wir erstellen einen Index in der OpenSearch Serverless-Sammlung. In diesem Index werden die Einbettungsdaten für das Foliendeck gespeichert. Siehe den folgenden Code:

- Wir verwenden das Titan Multimodal Embeddings-Modell, um die im vorherigen Notizbuch erstellten JPG-Bilder in Vektoreinbettungen umzuwandeln. Diese Einbettungen und zusätzliche Metadaten (z. B. der S3-Pfad der Bilddatei) werden in einer JSON-Datei gespeichert und auf Amazon S3 hochgeladen. Beachten Sie, dass eine einzelne JSON-Datei erstellt wird, die Dokumente für alle in Einbettungen konvertierten Folien (Bilder) enthält. Der folgende Codeausschnitt zeigt, wie ein Bild (in Form einer Base64-codierten Zeichenfolge) in Einbettungen umgewandelt wird:

- Diese Aktion löst die OpenSearch-Ingestion-Pipeline aus, die die Datei verarbeitet und in den OpenSearch Serverless-Index aufnimmt. Im Folgenden sehen Sie ein Beispiel der erstellten JSON-Datei. (Im Beispielcode wird ein Vektor mit vier Dimensionen gezeigt. Das Titan Multimodal Embeddings-Modell generiert 1,024 Dimensionen.)

- Auswählen 3_rag_inference.ipynb um es in JupyterLab zu öffnen.

- Auf dem Führen Sie Menü, wählen Sie Führen Sie alle Zellen aus um den Code in diesem Notebook auszuführen.

Dieses Notebook implementiert die RAG-Lösung: Wir wandeln die Benutzerfrage in Einbettungen um, suchen ein ähnliches Bild (Folie) aus der Vektordatenbank und stellen das abgerufene Bild LLaVA zur Verfügung, um eine Antwort auf die Benutzerfrage zu generieren. Wir verwenden die folgende Eingabeaufforderungsvorlage:

Der folgende Codeausschnitt stellt den RAG-Workflow bereit:

Die Ergebnisse

Im Folgenden finden Sie eine Zusammenstellung einiger Benutzerfragen und -antworten, die durch unsere Implementierung generiert wurden. Der Fragen (FAQ) Die Spalte erfasst die Benutzerfrage und die Antworten Spalte ist die von LLaVA generierte Textantwort. Bild ist die k-nächste (k=1) Folienübereinstimmung, die von der OpenSearch Serverless-Vektorsuche zurückgegeben wird. Diese Folie wird von LLaVA interpretiert, um die Antwort zu geben.

Multimodale RAG-Ergebnisse

| Fragen (FAQ) | Antworten | Bild |

|---|---|---|

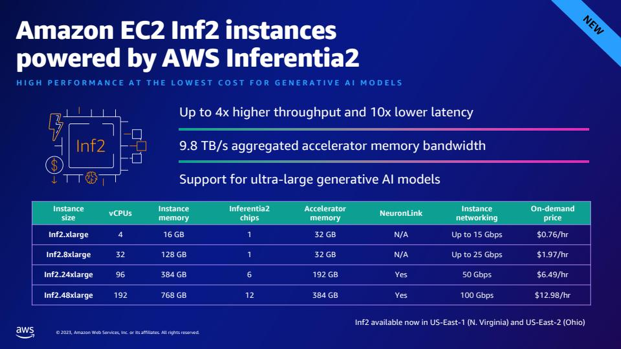

| Wie schneidet Inf2 in der Leistung mit vergleichbaren EC2-Instanzen ab? Ich brauche Zahlen. | Laut Slide-Deck bieten Inf2-Instanzen von AWS Inferentia2 einen bis zu 4-mal höheren Durchsatz und eine 10-mal geringere Latenz im Vergleich zu vergleichbaren EC2-Instanzen. |  |

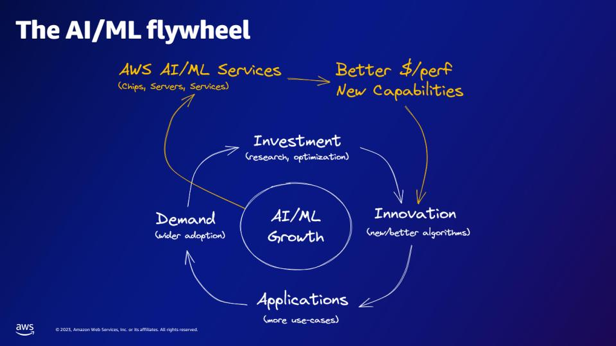

| Was bieten die AWS AI/ML-Services im Hinblick auf das AI/ML-Schwungrad? | Die AWS AI/ML-Services bieten bessere $/perfer-Funktionen, neue Funktionen und Investitionen in Innovation. |  |

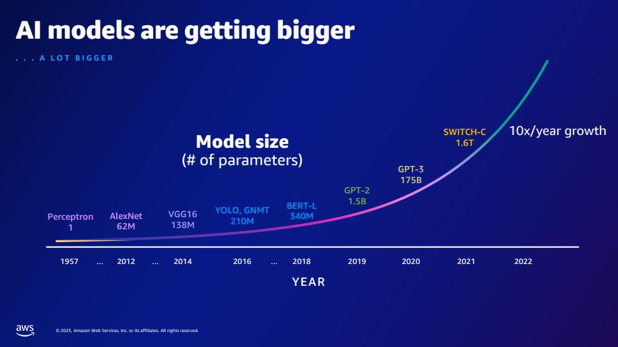

| Wie viele Parameter hat GPT-2 im Vergleich zu GPT-3 mehr? Was ist der numerische Unterschied zwischen der Parametergröße von GPT-2 und GPT-3? | Der Folie zufolge verfügt GPT-3 über 175 Milliarden Parameter, während GPT-2 über 1.5 Milliarden Parameter verfügt. Der numerische Unterschied zwischen der Parametergröße von GPT-2 und GPT-3 beträgt 173.5 Milliarden. |  |

| Was sind Quarks in der Teilchenphysik? | Die Antwort auf diese Frage habe ich im Dia-Deck nicht gefunden. |  |

Erweitern Sie diese Lösung gerne auf Ihre Foliendecks. Aktualisieren Sie einfach die Variable SLIDE_DECK in globals.py mit einer URL zu Ihrem Foliendeck und führen Sie die im vorherigen Abschnitt beschriebenen Aufnahmeschritte aus.

Tipp

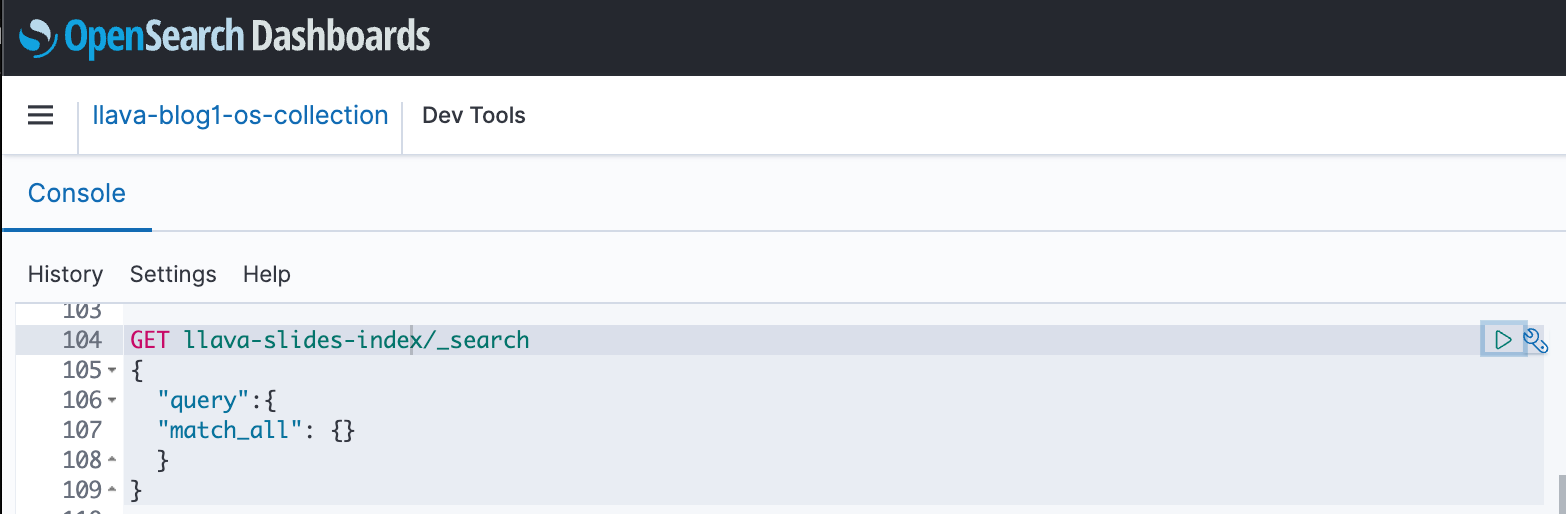

Sie können OpenSearch-Dashboards verwenden, um mit der OpenSearch-API zu interagieren und schnelle Tests für Ihren Index und die aufgenommenen Daten durchzuführen. Der folgende Screenshot zeigt ein OpenSearch-Dashboard-GET-Beispiel.

Aufräumen

Um künftige Kosten zu vermeiden, löschen Sie die von Ihnen erstellten Ressourcen. Sie können dies tun, indem Sie den Stack über die CloudFormation-Konsole löschen.

Löschen Sie außerdem den SageMaker-Inferenzendpunkt, der für die LLaVA-Inferenzierung erstellt wurde. Sie können dies tun, indem Sie den Bereinigungsschritt auskommentieren 3_rag_inference.ipynb und Ausführen der Zelle oder durch Löschen des Endpunkts über die SageMaker-Konsole: Wählen Sie Inferenz und Endpunkte im Navigationsbereich, wählen Sie dann den Endpunkt aus und löschen Sie ihn.

Zusammenfassung

Unternehmen generieren ständig neue Inhalte, und Foliendecks sind ein gängiger Mechanismus, um Informationen intern mit der Organisation und extern mit Kunden oder auf Konferenzen zu teilen und zu verbreiten. Im Laufe der Zeit können umfangreiche Informationen in Nicht-Text-Modalitäten wie Grafiken und Tabellen in diesen Foliensätzen vergraben und verborgen bleiben. Sie können diese Lösung und die Leistungsfähigkeit multimodaler FMs wie des Titan Multimodal Embeddings-Modells und LLaVA nutzen, um neue Informationen zu entdecken oder neue Perspektiven auf Inhalte in Foliendecks zu entdecken.

Wir ermutigen Sie, durch Erkunden mehr zu erfahren Amazon SageMaker-JumpStart, Amazon Titan-Modelle, Amazon Bedrock und OpenSearch Service sowie das Erstellen einer Lösung mithilfe der in diesem Beitrag bereitgestellten Beispielimplementierung.

Halten Sie Ausschau nach zwei weiteren Beiträgen im Rahmen dieser Serie. Teil 2 behandelt einen anderen Ansatz, den Sie wählen können, um mit Ihrem Foliendeck zu sprechen. Dieser Ansatz generiert und speichert LLaVA-Schlussfolgerungen und verwendet diese gespeicherten Schlussfolgerungen, um auf Benutzeranfragen zu antworten. Teil 3 vergleicht die beiden Ansätze.

Über die Autoren

Amit Arora ist ein KI- und ML-Spezialistenarchitekt bei Amazon Web Services und unterstützt Unternehmenskunden bei der Nutzung cloudbasierter maschineller Lerndienste, um ihre Innovationen schnell zu skalieren. Er ist außerdem außerordentlicher Dozent im MS Data Science and Analytics-Programm an der Georgetown University in Washington DC

Amit Arora ist ein KI- und ML-Spezialistenarchitekt bei Amazon Web Services und unterstützt Unternehmenskunden bei der Nutzung cloudbasierter maschineller Lerndienste, um ihre Innovationen schnell zu skalieren. Er ist außerdem außerordentlicher Dozent im MS Data Science and Analytics-Programm an der Georgetown University in Washington DC

Manju Prasad ist Senior Solutions Architect im Bereich Strategic Accounts bei Amazon Web Services. Sie konzentriert sich auf die Bereitstellung technischer Beratung in verschiedenen Bereichen, einschließlich KI/ML, für einen bedeutenden M&E-Kunden. Bevor sie zu AWS kam, entwarf und baute sie Lösungen für Unternehmen im Finanzdienstleistungssektor und auch für ein Startup.

Manju Prasad ist Senior Solutions Architect im Bereich Strategic Accounts bei Amazon Web Services. Sie konzentriert sich auf die Bereitstellung technischer Beratung in verschiedenen Bereichen, einschließlich KI/ML, für einen bedeutenden M&E-Kunden. Bevor sie zu AWS kam, entwarf und baute sie Lösungen für Unternehmen im Finanzdienstleistungssektor und auch für ein Startup.

Archana Inapudi ist Senior Solutions Architect bei AWS und unterstützt strategische Kunden. Sie verfügt über mehr als ein Jahrzehnt Erfahrung in der Unterstützung von Kunden beim Entwerfen und Erstellen von Datenanalyse- und Datenbanklösungen. Ihre Leidenschaft gilt dem Einsatz von Technologie, um Kunden einen Mehrwert zu bieten und Geschäftsergebnisse zu erzielen.

Archana Inapudi ist Senior Solutions Architect bei AWS und unterstützt strategische Kunden. Sie verfügt über mehr als ein Jahrzehnt Erfahrung in der Unterstützung von Kunden beim Entwerfen und Erstellen von Datenanalyse- und Datenbanklösungen. Ihre Leidenschaft gilt dem Einsatz von Technologie, um Kunden einen Mehrwert zu bieten und Geschäftsergebnisse zu erzielen.

Antara Raisa ist KI- und ML-Lösungsarchitekt bei Amazon Web Services und unterstützt strategische Kunden mit Sitz in Dallas, Texas. Sie verfügt außerdem über Erfahrung in der Zusammenarbeit mit großen Unternehmenspartnern bei AWS, wo sie als Partner Success Solutions Architect für Digital-Native-Kunden tätig war.

Antara Raisa ist KI- und ML-Lösungsarchitekt bei Amazon Web Services und unterstützt strategische Kunden mit Sitz in Dallas, Texas. Sie verfügt außerdem über Erfahrung in der Zusammenarbeit mit großen Unternehmenspartnern bei AWS, wo sie als Partner Success Solutions Architect für Digital-Native-Kunden tätig war.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/talk-to-your-slide-deck-using-multimodal-foundation-models-hosted-on-amazon-bedrock-and-amazon-sagemaker-part-1/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 10

- 100

- 13

- 15%

- 16

- 173

- 20

- 2023

- 26%

- 29

- 31

- 7

- 8

- 9

- a

- Fähig

- LiveBuzz

- Zugang

- Zugriff

- Trading Konten

- Erreichen

- Action

- Aktionen

- Handlungen

- hinzufügen

- Zusätzliche

- Zusatz

- Advent

- gegen

- AI

- AI / ML

- Alle

- erlauben

- entlang

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- Analytik

- und

- Ein anderer

- beantworten

- Beantwortung

- Antworten

- jedem

- Bienen

- Bewerben

- Ansatz

- Ansätze

- Architektur

- SIND

- AS

- fragen

- Assistentin

- damit verbundenen

- At

- Audio-

- Augmented

- Auth

- verfügbar

- vermeiden

- AWS

- AWS CloudFormation

- basierend

- BE

- war

- Besser

- zwischen

- Milliarde

- Körper

- bauen

- Building

- erbaut

- Geschäft

- by

- CAN

- Fähigkeiten

- capability

- Captures

- Zelle

- geändert

- Gebühren

- Auswählen

- Auswahl

- Auftraggeber

- Code

- Sammlung

- Produktauswahl

- Sammler

- Kolonne

- Kombination

- Vereinigung

- Bemerkungen

- gemeinsam

- Unternehmen

- vergleichbar

- vergleichen

- verglichen

- abschließen

- Abgeschlossene Verkäufe

- Komponenten

- konzept

- Kongressbegleitung

- Konfiguration

- konfiguriert

- besteht

- Konsul (Console)

- enthalten

- enthalten

- enthält

- Inhalt

- Inhaltserstellung

- verkaufen

- umgewandelt

- Umwandlung

- Dazugehörigen

- könnte

- Covers

- erstellen

- erstellt

- schafft

- Erstellen

- Schaffung

- Referenzen

- Kunde

- Kunden

- Dallas

- Armaturenbrett

- Dashboards

- technische Daten

- Datenanalyse

- Datenwissenschaft

- Datenbase

- Jahrzehnte

- Deck

- Standard

- Übergeben

- liefert

- zeigen

- Abhängig

- einsetzen

- Einsatz

- Bereitstellen

- setzt ein

- beschreiben

- Design

- entworfen

- Detail

- detailliert

- Details

- DICT

- DID

- Unterschied

- anders

- Rundfunk

- digital

- Abmessungen

- Größe

- entdeckt,

- diskutiert

- Display

- do

- Unterlagen

- die

- Domains

- herunterladen

- Downloads

- im

- e

- jeder

- Elemente

- eingebettet

- Einbettung

- ermöglichen

- freigegeben

- codiert

- ermutigen

- Ende

- Endpunkt

- Motor

- gewährleisten

- Unternehmen

- Fehler

- Event

- Veranstaltungen

- Untersuchen

- Beispiel

- Außer

- Ausnahme

- existiert

- ERFAHRUNGEN

- Möglichkeiten sondieren

- erweitern

- äußerlich

- Extrakt

- Vertrautheit

- Felder

- Reichen Sie das

- Mappen

- Revolution

- Finanzdienstleistungen

- Finden Sie

- konzentriert

- folgen

- Folgende

- folgt

- Aussichten für

- unten stehende Formular

- Format

- Foundation

- vier

- Frei

- für

- voller

- voll

- Zukunft

- erzeugen

- erzeugt

- erzeugt

- Generation

- generativ

- Generative KI

- georgetown

- bekommen

- GitHub

- gehen

- Graphen

- die Vermittlung von Kompetenzen,

- Haben

- he

- hilfreich

- Unternehmen

- hier

- versteckt

- höher

- Treffer

- Gastgeber

- gehostet

- Hosting

- Hosting-Dienste

- Gastgeber

- Ultraschall

- aber

- HTML

- http

- HTTPS

- Nabe

- Umarmendes Gesicht

- i

- Identitätsschutz

- if

- zeigt

- Image

- Bilder

- sofort

- implementieren

- Implementierung

- implementiert

- in

- das

- Dazu gehören

- Einschließlich

- Index

- Indizes

- Information

- Innovation

- Innovationen

- Varianten des Eingangssignals:

- Instanz

- Anleitung

- interagieren

- Interaktion

- innen

- in

- Investition

- IT

- Beitritt

- jpg

- JSON

- Juni

- Sprache

- grosse

- Latency

- starten

- LERNEN

- lernen

- Gefällt mir

- LINK

- Lama

- aus einer regionalen

- senken

- Maschine

- Maschinelles Lernen

- um

- verwalten

- verwaltet

- viele

- Spiel

- Abstimmung

- Mechanismus

- MENÜ

- Metadaten

- Methode

- ML

- Modell

- für

- mehr

- vor allem warme

- MS

- mehrere

- Name

- nativen

- Navigieren

- Menü

- Need

- Neu

- Andere

- beachten

- Notizbuch

- Benachrichtigungen

- jetzt an

- nummerierte

- Zahlen

- Objekte

- of

- bieten

- on

- On-Demand

- EINEM

- einzige

- XNUMXh geöffnet

- Open-Source-

- or

- Organisation

- OS

- UNSERE

- Ergebnisse

- Möglichkeiten für das Ausgangssignal:

- übrig

- Brot

- Parameter

- Parameter

- Teil

- Partner

- Teile

- Bestanden

- leidenschaftlich

- Weg

- für

- Ausführen

- Leistung

- durchgeführt

- Berechtigungen

- Perspektiven

- Phase

- Physik

- Fotos

- Pipeline

- Plato

- Datenintelligenz von Plato

- PlatoData

- Politik durchzulesen

- Post

- BLOG-POSTS

- möglicherweise

- Werkzeuge

- größte treibende

- Predictor

- Gegenwart

- vorgeführt

- früher

- Vor

- Prozessdefinierung

- Verarbeitet

- anpassen

- Verarbeitung

- Programm

- immobilien

- die

- vorausgesetzt

- bietet

- Bereitstellung

- setzen

- Quarks

- Abfragen

- Frage

- Fragen

- Direkt

- Lappen

- Angebot

- schnell

- Lesebrillen

- bereit

- realen Welt

- Received

- referenziert

- Region

- bezogene

- relevant

- bleiben

- ersetzen

- Anforderung

- falls angefordert

- Downloads

- Reagieren

- Antwort

- Antworten

- Folge

- was zu

- Die Ergebnisse

- Abruf

- Rückkehr

- Reiches

- Rollen

- Führen Sie

- Laufen

- sagemaker

- SageMaker-Inferenz

- gleich

- Skalieren

- Wissenschaft

- Screenshots

- Skript

- Suche

- Zweite

- Abschnitt

- Abschnitte

- Bibliotheken

- sehen

- wählen

- Auswahl

- Senior

- Reihenfolge

- Modellreihe

- Serverlos

- dient

- Lösungen

- Sitzung

- Sets

- Einstellung

- Einstellungen

- Teilen

- sie

- sollte

- gezeigt

- Konzerte

- ähnlich

- Einfacher

- einfach

- Single

- Größe

- Schlitten

- Slides

- Schnipsel

- So

- Lösung

- Lösungen

- einige

- Quelle

- Spezialist

- spezifisch

- angegeben

- stabil

- Stapel

- Anfang

- Bundesstaat

- Status

- Schritt

- Shritte

- Lagerung

- speichern

- gelagert

- Läden

- Speicherung

- Strategisch

- Schnur

- Folge

- Erfolg

- Erfolgreich

- so

- Gipfel

- Unterstützung

- sicher

- Tabelle

- Nehmen

- Reden

- und Aufgaben

- Technische

- Technologie

- Vorlage

- Vorlagen

- Test

- Tests

- Texas

- Text

- textuell

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- die Informationen

- ihr

- dann

- Diese

- fehlen uns die Worte.

- diejenigen

- Durchsatz

- Zeit

- Titan

- betitelt

- zu

- heutigen

- gemeinsam

- toronto

- traditionell

- Traverse

- auslösen

- Auslösen

- was immer dies auch sein sollte.

- versuchen

- WENDE

- XNUMX

- tippe

- aufdecken

- verstehen

- Verständnis

- Universität

- Aktualisierung

- hochgeladen

- URL

- -

- benutzt

- Mitglied

- verwendet

- Verwendung von

- Wert

- Variable

- Vielfalt

- Version

- Video

- Anzeigen

- Seh-

- visuell

- Washington

- Wege

- we

- Netz

- Web-Services

- GUT

- Was

- Was ist

- welche

- während

- werden wir

- mit

- .

- gearbeitet

- Arbeitsablauf.

- arbeiten,

- Du

- Ihr

- Zephyrnet