Δεδομένα χρηστών: LLMs’ Vital Food

Ναί! RT @Bryce Λατρεύω αυτό το απόσπασμα "Εάν δεν πληρώνετε για αυτό, δεν είστε ο πελάτης. είσαι το προϊόν που πωλείται». http://bit.ly/93JYCJ

— Tim O'Reilly (@timoreilly) Σεπτέμβριος 2, 2010

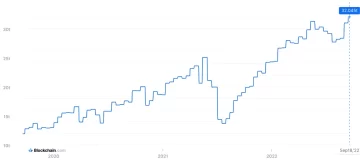

Μείνετε ενημερωμένοι για τα νέα κρυπτογράφησης, λάβετε καθημερινές ενημερώσεις στα εισερχόμενά σας.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- PlatoHealth. Ευφυΐα βιοτεχνολογίας και κλινικών δοκιμών. Πρόσβαση εδώ.

- πηγή: https://decrypt.co/211846/anthropic-says-it-wont-use-your-private-data-to-train-its-ai

- :έχει

- :είναι

- :δεν

- 7

- 8

- a

- ικανότητα

- Απόλυτος

- Σύμφωνα με

- ακριβής

- προσαρμογή

- διευθυνσιοδότηση

- Προσθέτει

- προηγμένες

- πριν

- συμφωνεί

- AI

- Υπηρεσίες AI

- Συστήματα AI

- στόχοι

- Alexa

- Ευθυγραμμίζει

- Όλα

- επιτρέπει

- Επίσης

- πάντοτε

- Amazon

- an

- και

- Ανθρωπικός

- προσδοκώ

- κάθε

- εφαρμόσιμος

- ΕΙΝΑΙ

- AS

- υποθέτω

- At

- διαθέσιμος

- αποφεύγοντας

- επίγνωση

- βασίζονται

- BE

- επειδή

- είναι

- Πιστεύεται

- ευεργετική

- Καλύτερα

- μεταξύ

- by

- CAN

- αξιώσεις

- πελάτες

- εμπορικός

- δέσμευση

- δεσμεύεται

- Εταιρείες

- εταίρα

- ανταγωνιστική

- έννοια

- Πιθανά ερωτήματα

- συνεχώς

- περιεχόμενο

- συμφραζόμενα

- συνεχώς

- έλεγχος

- Βολικός

- συνομιλίες

- πνευματική ιδιοκτησία

- θα μπορούσε να

- κρίσιμος

- κρυπτο

- Crypto Νέα

- Ρεύμα

- πελάτης

- Πελάτες

- καθημερινά

- σκοτάδι

- ημερομηνία

- Προστασία προσωπικών δεδομένων

- δημόσια συζήτηση

- δεκαετίες

- Αποκρυπτογράφηση

- βαθύς

- βαθιά μάθηση

- Προεπιλογή

- Υπερασπίζοντας

- παράδοση

- εξαρτάται

- αποποιήσεις

- διαφορών

- Ποικιλία

- do

- έγγραφο

- κάνει

- δολάρια

- Μην

- κατά την διάρκεια

- Κερδίστε

- άκρη

- αποτελεσματικότητα

- είτε

- δέσμευση

- ενίσχυση

- εξασφαλίζει

- ουσιώδης

- ηθικά

- δεοντολογία

- παράδειγμα

- ανταλλαγή

- εμπειρία

- εκτενής

- έκταση

- εξωτερικός

- αντιμέτωπος

- Για

- Πρώην

- Ίδρυση

- Δωρεάν

- από

- κερδίζει

- παράγουν

- παράγεται

- δημιουργεί

- γενετική

- Παραγωγική τεχνητή νοημοσύνη

- παίρνω

- να πάρει

- γίγαντες

- Δώστε

- Go

- χορηγεί

- πιάσιμο

- μεγαλώνει

- βαριά

- τίμιος

- τιμή

- Ωστόσο

- http

- HTTPS

- ανθρώπινος

- ιδανικά

- if

- βελτίωση

- in

- ατομικές

- πληροφορίες

- διανοούμενος

- πνευματικής ιδιοκτησίας

- προθέσεις

- αλληλεπιδράσεις

- εσωτερικός

- IP

- IT

- ΤΟΥ

- εαυτό

- Κλειδί

- Γλώσσα

- large

- αργότερο

- Νόμος

- οδηγήσει

- ΜΑΘΑΊΝΩ

- μάθηση

- Νομικά

- Μόχλευση

- Μου αρέσει

- Είδος μικρής καμήλας

- LLM

- αγάπη

- κάνω

- Κατασκευή

- Ενδέχεται..

- Εικόνες / Βίντεο

- Meta

- εκατομμύρια

- μοντέλο

- μοντέλα

- περισσότερο

- πλέον

- δίκτυα

- νευρικός

- νευρωνικά δίκτυα

- Νέα

- νέα

- την απόκτηση

- of

- on

- OpenAI

- or

- φαινομενικά

- αλλιώς

- δικός μας

- έξω

- εξόδους

- επί

- δική

- ανήκει

- καταβλήθηκε

- μέρη

- κόμμα

- πρότυπα

- Πληρωμή

- πληρώνουν

- προσωπικός

- εξατομίκευση

- Εξατομικευμένη

- Φωτογραφίες

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- πολιτική

- δυναμικού

- δύναμη

- ισχυρός

- πρακτικές

- προβλέψει

- Προβλέψεις

- προτιμήσεις

- επικρατών

- μυστικότητα

- ιδιωτικός

- Παράγεται

- Προϊόν

- προτρέπει

- περιουσία

- παρέχουν

- παρέχει

- δημόσιο

- δημόσια εμπιστοσύνη

- δημοσίως

- παραθέτω

- ιπποδρομίες

- RE

- πραγματικό κόσμο

- λαμβάνει

- τελειοποίηση

- σχέση

- σχετικής

- απελευθερώνουν

- αναφέρθηκαν

- αιτήματα

- ερευνητές

- υπεύθυνος

- Αποκαλυφθε'ντα

- δικαιώματα

- αντιπάλων

- rt

- Ryan

- s

- λένε

- λέει

- σκηνή

- υπηρεσία

- Υπηρεσίες

- σειρά

- Κοινοποίηση

- θα πρέπει να

- Σκεπτικισμός

- So

- Μ.Κ.Δ

- social media

- πωλούνται

- ΣΗΜΑΙΝΩ

- εκπρόσωπος

- εκκίνηση

- Δήλωση

- παραμονή

- Βήμα

- συστήματα

- Tandem

- tech

- tech γίγαντες

- τεχνικές

- όροι

- κείμενο

- ότι

- Η

- τους

- Τους

- Αυτοί

- αυτοί

- αυτό

- Tim

- προς την

- σήμερα

- κορυφή

- Τρένο

- εκπαιδευμένο

- Εκπαίδευση

- Διαφάνεια

- Τάσεις

- Εμπιστευθείτε

- υπό

- καταλαβαίνω

- κατανόηση

- ανερχόμενος

- ενημερώθηκε

- ενημερώσεις

- αναβαθμιστεί

- Φορτώθηκε

- χρήση

- μεταχειρισμένος

- Χρήστες

- Χρήστες

- χρησιμοποιώντας

- Πολύτιμος

- διάφορα

- εκδοχή

- Βίντεο

- ζωτικής σημασίας

- Φωνή

- τόμος

- ήταν

- we

- ήταν

- πότε

- αν

- Ποιό

- WHY

- θα

- με

- λέξη

- θα

- Εσείς

- Σας

- zephyrnet