Σε 2021, η Η φαρμακευτική βιομηχανία απέφερε έσοδα 550 δισεκατομμυρίων δολαρίων στις ΗΠΑ. Οι φαρμακευτικές εταιρείες πωλούν μια ποικιλία διαφορετικών, συχνά καινοτόμων, φαρμάκων στην αγορά, όπου μερικές φορές μπορεί να συμβούν ακούσια αλλά σοβαρά ανεπιθύμητα συμβάντα.

Αυτά τα συμβάντα μπορούν να αναφερθούν οπουδήποτε, από νοσοκομεία ή στο σπίτι, και πρέπει να παρακολουθούνται υπεύθυνα και αποτελεσματικά. Η παραδοσιακή χειροκίνητη επεξεργασία των ανεπιθύμητων ενεργειών καθίσταται δύσκολη λόγω του αυξανόμενου όγκου δεδομένων υγείας και κόστους. Συνολικά, 384 δισεκατομμύρια δολάρια προβλέπονται ως το κόστος των δραστηριοτήτων φαρμακοεπαγρύπνησης για τη συνολική βιομηχανία υγειονομικής περίθαλψης έως το 2022. Για να υποστηρίξουν γενικές δραστηριότητες φαρμακοεπαγρύπνησης, οι φαρμακευτικοί πελάτες μας θέλουν να χρησιμοποιήσουν τη δύναμη της μηχανικής μάθησης (ML) για να αυτοματοποιήσουν τον εντοπισμό ανεπιθύμητων συμβάντων από διάφορες πηγές δεδομένων , όπως ροές μέσων κοινωνικής δικτύωσης, τηλεφωνικές κλήσεις, μηνύματα ηλεκτρονικού ταχυδρομείου και χειρόγραφες σημειώσεις και ενεργοποιήστε τις κατάλληλες ενέργειες.

Σε αυτήν την ανάρτηση, δείχνουμε πώς να αναπτύξετε μια λύση που βασίζεται σε ML χρησιμοποιώντας Amazon Sage Maker για τον εντοπισμό ανεπιθύμητων συμβάντων χρησιμοποιώντας το σύνολο δεδομένων ανεπιθύμητων αντιδράσεων φαρμάκου που είναι διαθέσιμο στο κοινό στο Πρόσωπο αγκαλιάς. Σε αυτήν τη λύση, προσαρμόζουμε μια ποικιλία μοντέλων στο Hugging Face που ήταν προεκπαιδευμένα σε ιατρικά δεδομένα και χρησιμοποιούμε το μοντέλο BioBERT, το οποίο ήταν προεκπαιδευμένο στο Δημοσιευμένο σύνολο δεδομένων και αποδίδει το καλύτερο από αυτά που δοκιμάστηκαν.

Υλοποιήσαμε τη λύση χρησιμοποιώντας το Κιτ ανάπτυξης AWS Cloud (AWS CDK). Ωστόσο, δεν καλύπτουμε τις ιδιαιτερότητες της κατασκευής της λύσης σε αυτήν την ανάρτηση. Για περισσότερες πληροφορίες σχετικά με την εφαρμογή αυτής της λύσης, ανατρέξτε στο Δημιουργήστε ένα σύστημα για τη σύλληψη ανεπιθύμητων συμβάντων σε πραγματικό χρόνο χρησιμοποιώντας το Amazon SageMaker και το Amazon QuickSight.

Αυτή η ανάρτηση εμβαθύνει σε πολλούς βασικούς τομείς, παρέχοντας μια ολοκληρωμένη εξερεύνηση των ακόλουθων θεμάτων:

- Οι προκλήσεις δεδομένων που αντιμετωπίζει η AWS Professional Services

- Το τοπίο και η εφαρμογή μεγάλων γλωσσικών μοντέλων (LLM):

- Transformers, BERT και GPT

- Αγκαλιάζοντας το πρόσωπο

- Η τελειοποιημένη λύση LLM και τα συστατικά της:

- Προετοιμασία δεδομένων

- Εκπαίδευση μοντέλων

Πρόκληση δεδομένων

Η ασάφεια των δεδομένων είναι συχνά ένα πρόβλημα κατά την επίλυση εργασιών ταξινόμησης. Θα θέλατε ιδανικά να έχετε ένα ισορροπημένο σύνολο δεδομένων και αυτή η περίπτωση χρήσης δεν αποτελεί εξαίρεση.

Αντιμετωπίζουμε αυτό το λοξό με γενετική AI μοντέλα (Falcon-7B και Falcon-40B), στα οποία ζητήθηκε να δημιουργήσουν δείγματα συμβάντων με βάση πέντε παραδείγματα από το σετ εκπαίδευσης για να αυξήσουν τη σημασιολογική ποικιλομορφία και να αυξήσουν το μέγεθος του δείγματος των επισημασμένων ανεπιθύμητων συμβάντων. Είναι πλεονεκτικό για εμάς να χρησιμοποιούμε τα μοντέλα Falcon εδώ, επειδή, σε αντίθεση με ορισμένα LLM στο Hugging Face, το Falcon σας παρέχει το σύνολο δεδομένων εκπαίδευσης που χρησιμοποιούν, ώστε να είστε βέβαιοι ότι κανένα από τα παραδείγματα του σετ δοκιμής δεν περιέχεται στο σετ εκπαίδευσης Falcon και να αποφύγετε δεδομένα μόλυνση.

Η άλλη πρόκληση δεδομένων για τους πελάτες υγειονομικής περίθαλψης είναι οι απαιτήσεις συμμόρφωσης με το HIPAA. Η κρυπτογράφηση σε κατάσταση ηρεμίας και κατά τη μεταφορά πρέπει να ενσωματωθεί στη λύση για να πληρούνται αυτές οι απαιτήσεις.

Transformers, BERT και GPT

Η αρχιτεκτονική του μετασχηματιστή είναι μια αρχιτεκτονική νευρωνικού δικτύου που χρησιμοποιείται για εργασίες επεξεργασίας φυσικής γλώσσας (NLP). Εισήχθη για πρώτη φορά στην εφημερίδα «Η προσοχή είναι ό, τι χρειάζεστε» από τους Vaswani et al. (2017). Η αρχιτεκτονική του μετασχηματιστή βασίζεται στον μηχανισμό προσοχής, ο οποίος επιτρέπει στο μοντέλο να μάθει εξαρτήσεις μεγάλης εμβέλειας μεταξύ των λέξεων. Οι μετασχηματιστές, όπως παρουσιάζονται στο αρχικό χαρτί, αποτελούνται από δύο κύρια στοιχεία: τον κωδικοποιητή και τον αποκωδικοποιητή. Ο κωδικοποιητής παίρνει την ακολουθία εισόδου ως είσοδο και παράγει μια ακολουθία κρυφών καταστάσεων. Στη συνέχεια, ο αποκωδικοποιητής παίρνει αυτές τις κρυφές καταστάσεις ως είσοδο και παράγει την ακολουθία εξόδου. Ο μηχανισμός προσοχής χρησιμοποιείται τόσο στον κωδικοποιητή όσο και στον αποκωδικοποιητή. Ο μηχανισμός προσοχής επιτρέπει στο μοντέλο να παρακολουθεί συγκεκριμένες λέξεις στην ακολουθία εισόδου κατά τη δημιουργία της ακολουθίας εξόδου. Αυτό επιτρέπει στο μοντέλο να μάθει εξαρτήσεις μεγάλης εμβέλειας μεταξύ λέξεων, κάτι που είναι απαραίτητο για πολλές εργασίες NLP, όπως η αυτόματη μετάφραση και η σύνοψη κειμένου.

Μία από τις πιο δημοφιλείς και χρήσιμες από τις αρχιτεκτονικές μετασχηματιστών, οι Αναπαραστάσεις Κωδικοποιητή Αμφίδρομης Χρήσης από τους Μετασχηματιστές (BERT), είναι ένα μοντέλο αναπαράστασης γλώσσας που ήταν εισήχθη στο 2018. Το BERT εκπαιδεύεται σε ακολουθίες όπου ορισμένες από τις λέξεις μιας πρότασης είναι καλυμμένες και πρέπει να συμπληρώσει αυτές τις λέξεις λαμβάνοντας υπόψη τόσο τις λέξεις πριν όσο και μετά τις καλυμμένες λέξεις. Το BERT μπορεί να ρυθμιστεί με ακρίβεια για μια ποικιλία εργασιών NLP, συμπεριλαμβανομένης της απάντησης σε ερωτήσεις, των συμπερασμάτων φυσικής γλώσσας και της ανάλυσης συναισθημάτων.

Η άλλη δημοφιλής αρχιτεκτονική μετασχηματιστών που έχει κατακλύσει τον κόσμο είναι ο Generative Pre-trained Transformer (GPT). Το πρώτο μοντέλο GPT ήταν εισήχθη το 2018 από την OpenAI. Λειτουργεί με το να εκπαιδεύεται να προβλέπει αυστηρά την επόμενη λέξη σε μια σειρά, έχοντας μόνο επίγνωση του συμφραζομένου πριν από τη λέξη. Τα μοντέλα GPT εκπαιδεύονται σε ένα τεράστιο σύνολο δεδομένων κειμένου και κώδικα και μπορούν να ρυθμιστούν με ακρίβεια για μια σειρά εργασιών NLP, συμπεριλαμβανομένης της δημιουργίας κειμένου, της απάντησης ερωτήσεων και της σύνοψης.

Γενικά, ο BERT είναι καλύτερος σε εργασίες που απαιτούν βαθύτερη κατανόηση του πλαισίου των λέξεων, ενώ Το GPT είναι πιο κατάλληλο για εργασίες που απαιτούν τη δημιουργία κειμένου.

Αγκαλιάζοντας το πρόσωπο

Η Hugging Face είναι μια εταιρεία τεχνητής νοημοσύνης που ειδικεύεται στο NLP. Παρέχει μια πλατφόρμα με εργαλεία και πόρους που επιτρέπουν στους προγραμματιστές να δημιουργήσουν, να εκπαιδεύσουν και να αναπτύξουν μοντέλα ML που επικεντρώνονται σε εργασίες NLP. Μία από τις βασικές προσφορές του Hugging Face είναι η βιβλιοθήκη του, transformers, το οποίο περιλαμβάνει προεκπαιδευμένα μοντέλα που μπορούν να βελτιωθούν για διάφορες γλωσσικές εργασίες, όπως ταξινόμηση κειμένου, μετάφραση, σύνοψη και απάντηση ερωτήσεων.

Το Hugging Face ενσωματώνεται απρόσκοπτα με το SageMaker, το οποίο είναι μια πλήρως διαχειριζόμενη υπηρεσία που επιτρέπει στους προγραμματιστές και τους επιστήμονες δεδομένων να δημιουργούν, να εκπαιδεύουν και να αναπτύσσουν μοντέλα ML σε κλίμακα. Αυτή η συνέργεια ωφελεί τους χρήστες παρέχοντας μια ισχυρή και επεκτάσιμη υποδομή για τη διαχείριση εργασιών NLP με τα τελευταίας τεχνολογίας μοντέλα που προσφέρει το Hugging Face, σε συνδυασμό με τις ισχυρές και ευέλικτες υπηρεσίες ML από το AWS. Μπορείτε επίσης να αποκτήσετε πρόσβαση στα μοντέλα Hugging Face απευθείας από Amazon SageMaker JumpStart, καθιστώντας βολικό να ξεκινήσετε με προκατασκευασμένες λύσεις.

Επισκόπηση λύσεων

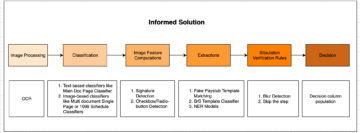

Χρησιμοποιήσαμε τη βιβλιοθήκη Hugging Face Transformers για να τελειοποιήσουμε τα μοντέλα μετασχηματιστών στο SageMaker για την ταξινόμηση των ανεπιθύμητων συμβάντων. Η εργασία εκπαίδευσης δημιουργείται χρησιμοποιώντας τον εκτιμητή SageMaker PyTorch. Το SageMaker JumpStart έχει επίσης ορισμένες συμπληρωματικές ενσωματώσεις με το Hugging Face που καθιστά εύκολη την εφαρμογή. Σε αυτή την ενότητα, περιγράφουμε τα κύρια βήματα που εμπλέκονται στην προετοιμασία δεδομένων και στην εκπαίδευση μοντέλων.

Προετοιμασία δεδομένων

Χρησιμοποιήσαμε τα δεδομένα ανεπιθύμητων αντιδράσεων στο φάρμακο (ade_corpus_v2) στο σύνολο δεδομένων Hugging Face με διαχωρισμό εκπαίδευσης/δοκιμών 80/20. Η απαιτούμενη δομή δεδομένων για την εκπαίδευση του μοντέλου και τα συμπεράσματά μας έχει δύο στήλες:

- Μία στήλη για περιεχόμενο κειμένου ως δεδομένα εισαγωγής μοντέλου.

- Μια άλλη στήλη για την κατηγορία ετικετών. Έχουμε δύο πιθανές τάξεις για ένα κείμενο:

Not_AEκαιAdverse_Event.

Πρότυπη εκπαίδευση και πειραματισμός

Προκειμένου να εξερευνήσουμε αποτελεσματικά τον χώρο των πιθανών μοντέλων Hugging Face για να τελειοποιήσουμε τα συνδυασμένα δεδομένα ανεπιθύμητων συμβάντων, δημιουργήσαμε μια εργασία βελτιστοποίησης υπερπαραμέτρων (HPO) του SageMaker και περάσαμε σε διαφορετικά μοντέλα Hugging Face ως υπερπαράμετρος, μαζί με άλλες σημαντικές υπερπαράμετρους όπως μέγεθος παρτίδας εκπαίδευσης, μήκος ακολουθίας, μοντέλα και ρυθμός εκμάθησης. Οι εργασίες εκπαίδευσης χρησιμοποίησαν ένα παράδειγμα ml.p3dn.24xlarge και χρειάστηκαν κατά μέσο όρο 30 λεπτά ανά εργασία με αυτόν τον τύπο παρουσίας. Οι μετρήσεις προπόνησης καταγράφηκαν ωστόσο Πειράματα Amazon SageMaker εργαλείο και κάθε εργασία εκπαίδευσης διήρκεσε 10 εποχές.

Στον κώδικά μας καθορίζουμε τα εξής:

- Μέγεθος παρτίδας εκπαίδευσης – Αριθμός δειγμάτων που υποβάλλονται σε επεξεργασία μαζί πριν από την ενημέρωση των βαρών του μοντέλου

- Μήκος ακολουθίας – Μέγιστο μήκος της ακολουθίας εισόδου που μπορεί να επεξεργαστεί το BERT

- Ποσοστό εκμάθησης – Πόσο γρήγορα το μοντέλο ενημερώνει τα βάρη του κατά τη διάρκεια της προπόνησης

- Μοντέλα – Προεκπαιδευμένα μοντέλα Hugging Face

Αποτελέσματα

Το μοντέλο που απέδωσε τα καλύτερα στην περίπτωση χρήσης μας ήταν το monologg/biobert_v1.1_pubmed μοντέλο που φιλοξενείται στο Hugging Face, το οποίο είναι μια έκδοση της αρχιτεκτονικής BERT που έχει προεκπαιδευτεί στο σύνολο δεδομένων Pubmed, το οποίο αποτελείται από 19,717 επιστημονικές δημοσιεύσεις. Η προεκπαίδευση του BERT σε αυτό το σύνολο δεδομένων παρέχει σε αυτό το μοντέλο επιπλέον τεχνογνωσία όσον αφορά τον εντοπισμό του πλαισίου γύρω από ιατρικά σχετικούς επιστημονικούς όρους. Αυτό ενισχύει την απόδοση του μοντέλου για την εργασία ανίχνευσης ανεπιθύμητων συμβάντων, επειδή έχει εκπαιδευτεί εκ των προτέρων σε ιατρικά συγκεκριμένη σύνταξη που εμφανίζεται συχνά στο σύνολο δεδομένων μας.

Ο παρακάτω πίνακας συνοψίζει τις μετρήσεις αξιολόγησής μας.

| Μοντέλο | Ακρίβεια | Ανάκληση | F1 |

| Βάση BERT | 0.87 | 0.95 | 0.91 |

| BioBert | 0.89 | 0.95 | 0.92 |

| BioBERT με HPO | 0.89 | 0.96 | 0.929 |

| BioBERT με HPO και συνθετικά δημιουργημένη ανεπιθύμητη ενέργεια | 0.90 | 0.96 | 0.933 |

Αν και πρόκειται για σχετικά μικρές και σταδιακές βελτιώσεις σε σχέση με το βασικό μοντέλο BERT, αυτό ωστόσο δείχνει ορισμένες βιώσιμες στρατηγικές για τη βελτίωση της απόδοσης του μοντέλου μέσω αυτών των μεθόδων. Η δημιουργία συνθετικών δεδομένων με το Falcon φαίνεται να έχει πολλές υποσχέσεις και δυνατότητες για βελτιώσεις απόδοσης, ειδικά καθώς αυτά τα μοντέλα παραγωγής τεχνητής νοημοσύνης βελτιώνονται με την πάροδο του χρόνου.

εκκαθάριση

Για να αποφύγετε μελλοντικές χρεώσεις, διαγράψτε τυχόν πόρους που δημιουργήθηκαν όπως το μοντέλο και τα τελικά σημεία του μοντέλου που δημιουργήσατε με τον ακόλουθο κώδικα:

Συμπέρασμα

Πολλές φαρμακευτικές εταιρείες σήμερα θα ήθελαν να αυτοματοποιήσουν τη διαδικασία εντοπισμού ανεπιθύμητων συμβάντων από τις αλληλεπιδράσεις με τους πελάτες τους με συστηματικό τρόπο, προκειμένου να συμβάλουν στη βελτίωση της ασφάλειας και των αποτελεσμάτων των πελατών. Όπως δείξαμε σε αυτήν την ανάρτηση, το τελειοποιημένο LLM BioBERT με συνθετικά δημιουργούμενα ανεπιθύμητα συμβάντα που προστίθενται στα δεδομένα ταξινομεί τα ανεπιθύμητα συμβάντα με υψηλές βαθμολογίες F1 και μπορεί να χρησιμοποιηθεί για τη δημιουργία μιας λύσης συμβατής με το HIPAA για τους πελάτες μας.

Όπως πάντα, η AWS καλωσορίζει τα σχόλιά σας. Αφήστε τις σκέψεις και τις ερωτήσεις σας στην ενότητα σχολίων.

Σχετικά με τους συγγραφείς

Ζακ Πίτερσον είναι επιστήμονας δεδομένων στο AWS Professional Services. Ασχολείται με την παροχή λύσεων μηχανικής εκμάθησης σε πελάτες για πολλά χρόνια και έχει μεταπτυχιακό στα Οικονομικά.

Ζακ Πίτερσον είναι επιστήμονας δεδομένων στο AWS Professional Services. Ασχολείται με την παροχή λύσεων μηχανικής εκμάθησης σε πελάτες για πολλά χρόνια και έχει μεταπτυχιακό στα Οικονομικά.

Δρ Adewale Akinfaderin είναι ανώτερος επιστήμονας δεδομένων στο Healthcare and Life Sciences στο AWS. Η τεχνογνωσία του είναι σε αναπαραγώγιμες και από άκρο σε άκρο μεθόδους AI/ML, πρακτικές εφαρμογές και βοήθεια σε παγκόσμιους πελάτες υγειονομικής περίθαλψης να διαμορφώσουν και να αναπτύξουν επεκτάσιμες λύσεις σε διεπιστημονικά προβλήματα. Έχει δύο μεταπτυχιακά στη Φυσική και ένα διδακτορικό στη Μηχανική.

Δρ Adewale Akinfaderin είναι ανώτερος επιστήμονας δεδομένων στο Healthcare and Life Sciences στο AWS. Η τεχνογνωσία του είναι σε αναπαραγώγιμες και από άκρο σε άκρο μεθόδους AI/ML, πρακτικές εφαρμογές και βοήθεια σε παγκόσμιους πελάτες υγειονομικής περίθαλψης να διαμορφώσουν και να αναπτύξουν επεκτάσιμες λύσεις σε διεπιστημονικά προβλήματα. Έχει δύο μεταπτυχιακά στη Φυσική και ένα διδακτορικό στη Μηχανική.

Ekta Walia Bhullar, PhD, είναι ανώτερος σύμβουλος AI/ML στην επιχειρηματική μονάδα AWS Healthcare and Life Sciences (HCLS) Professional Services. Έχει μεγάλη εμπειρία στην εφαρμογή της AI/ML στον τομέα της υγειονομικής περίθαλψης, ιδιαίτερα στην ακτινολογία. Εκτός δουλειάς, όταν δεν συζητά την τεχνητή νοημοσύνη στην ακτινολογία, της αρέσει να τρέχει και να πεζοπορεί.

Ekta Walia Bhullar, PhD, είναι ανώτερος σύμβουλος AI/ML στην επιχειρηματική μονάδα AWS Healthcare and Life Sciences (HCLS) Professional Services. Έχει μεγάλη εμπειρία στην εφαρμογή της AI/ML στον τομέα της υγειονομικής περίθαλψης, ιδιαίτερα στην ακτινολογία. Εκτός δουλειάς, όταν δεν συζητά την τεχνητή νοημοσύνη στην ακτινολογία, της αρέσει να τρέχει και να πεζοπορεί.

Χαν Μαν είναι Ανώτερος Διευθυντής Επιστήμης Δεδομένων & Μηχανικής Μάθησης με AWS Professional Services με έδρα το Σαν Ντιέγκο, Καλιφόρνια. Έχει διδακτορικό στη Μηχανική από το Πανεπιστήμιο Northwestern και έχει αρκετά χρόνια εμπειρίας ως σύμβουλος διαχείρισης που συμβουλεύει πελάτες στον τομέα της μεταποίησης, των χρηματοοικονομικών υπηρεσιών και της ενέργειας. Σήμερα, εργάζεται με πάθος με βασικούς πελάτες από διάφορους κλάδους της βιομηχανίας για την ανάπτυξη και την εφαρμογή λύσεων ML και τεχνητής νοημοσύνης στο AWS.

Χαν Μαν είναι Ανώτερος Διευθυντής Επιστήμης Δεδομένων & Μηχανικής Μάθησης με AWS Professional Services με έδρα το Σαν Ντιέγκο, Καλιφόρνια. Έχει διδακτορικό στη Μηχανική από το Πανεπιστήμιο Northwestern και έχει αρκετά χρόνια εμπειρίας ως σύμβουλος διαχείρισης που συμβουλεύει πελάτες στον τομέα της μεταποίησης, των χρηματοοικονομικών υπηρεσιών και της ενέργειας. Σήμερα, εργάζεται με πάθος με βασικούς πελάτες από διάφορους κλάδους της βιομηχανίας για την ανάπτυξη και την εφαρμογή λύσεων ML και τεχνητής νοημοσύνης στο AWS.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- PlatoHealth. Ευφυΐα βιοτεχνολογίας και κλινικών δοκιμών. Πρόσβαση εδώ.

- πηγή: https://aws.amazon.com/blogs/machine-learning/deploy-large-language-models-for-a-healthtech-use-case-on-amazon-sagemaker/

- :έχει

- :είναι

- :δεν

- :που

- $UP

- 1

- 10

- 100

- 16

- 19

- 2017

- 2018

- 2021

- 2022

- 30

- 32

- 7

- a

- πρόσβαση

- Λογαριασμός

- ACM

- ενεργειών

- δραστηριοτήτων

- προστιθέμενη

- διεύθυνση

- επωφελής

- δυσμενής

- συμβουλεύοντας

- Μετά το

- AI

- Μοντέλα AI

- AI / ML

- AL

- Όλα

- επιτρέπει

- κατά μήκος

- Επίσης

- πάντοτε

- Amazon

- Amazon Sage Maker

- Amazon υπηρεσίες Web

- ποσό

- an

- ανάλυση

- και

- απάντηση

- κάθε

- οπουδήποτε

- Εφαρμογή

- κατάλληλος

- αρχιτεκτονική

- αρχιτεκτονικές

- ΕΙΝΑΙ

- περιοχές

- γύρω

- τεχνητός

- τεχνητή νοημοσύνη

- AS

- At

- παραβρίσκομαι

- προσοχή

- αυτοματοποίηση

- διαθέσιμος

- μέσος

- αποφύγετε

- επίγνωση

- AWS

- Επαγγελματικές υπηρεσίες AWS

- ισόρροπη

- βάση

- βασίζονται

- BE

- επειδή

- ήταν

- πριν

- είναι

- οφέλη

- ΚΑΛΎΤΕΡΟΣ

- Καλύτερα

- μεταξύ

- αμφίδρομος

- Δισεκατομμύριο

- ενισχύει

- και οι δύο

- όρια

- χτίζω

- Κτίριο

- χτισμένο

- επιχείρηση

- αλλά

- by

- CA

- κλήσεις

- CAN

- συλλαμβάνονται

- περίπτωση

- πρόκληση

- προκλήσεις

- πρόκληση

- φορτία

- τάξη

- τάξεις

- ταξινόμηση

- πελάτες

- Backup

- κωδικός

- Στήλη

- Στήλες

- σε συνδυασμό

- έρχεται

- ερχομός

- σχόλια

- Εταιρείες

- εταίρα

- συμπληρωματικός

- Συμμόρφωση

- εξαρτήματα

- περιεκτικός

- αποτελείται

- κατασκευαστεί

- σύμβουλος

- που περιέχονται

- περιεχόμενο

- συμφραζόμενα

- Βολικός

- Κόστος

- Δικαστικά έξοδα

- κάλυμμα

- δημιουργία

- δημιουργήθηκε

- πελάτης

- Πελάτες

- ημερομηνία

- Προετοιμασία δεδομένων

- επιστημονικά δεδομένα

- επιστήμονας δεδομένων

- Δομή δεδομένων

- βαθύτερη

- ορίζεται

- Πτυχίο

- παράδοση

- ντελ

- καταδεικνύει

- εξαρτήσεις

- παρατάσσω

- περιγράφουν

- Ανίχνευση

- ανάπτυξη

- προγραμματιστές

- Ανάπτυξη

- Ντιέγκο

- διαφορετικές

- κατευθείαν

- συζητώντας

- Ποικιλία

- τομέα

- Μην

- φάρμακο

- Ναρκωτικά

- κατά την διάρκεια

- Ε & Τ

- κάθε

- Οικονομικά

- αποτελεσματικά

- ενεργοποιήσετε

- δίνει τη δυνατότητα

- κρυπτογράφηση

- από άκρη σε άκρη

- ενέργεια

- Μηχανική

- εποχές

- ειδικά

- ουσιώδης

- εκτίμηση

- Συμβάν

- εκδηλώσεις

- παραδείγματα

- εξαίρεση

- εμπειρία

- εξειδίκευση

- εξερεύνηση

- διερευνήσει

- εκτενής

- Εκτεταμένη εμπειρία

- επιπλέον

- f1

- Πρόσωπο

- ανατροφοδότηση

- συμπληρώστε

- οικονομικός

- των χρηματοπιστωτικών υπηρεσιών

- Όνομα

- πέντε

- εύκαμπτος

- επικεντρώθηκε

- Εξής

- Για

- από

- πλήρως

- μελλοντικός

- General

- παράγουν

- παράγεται

- παραγωγής

- γενεά

- γενετική

- Παραγωγική τεχνητή νοημοσύνη

- παίρνω

- δίνει

- Παγκόσμιο

- αποφοιτήσουν

- λαβή

- τα χέρια

- Έχω

- he

- Υγεία

- υγειονομική περίθαλψη

- στον τομέα της υγείας

- HealthTech

- βοήθεια

- βοήθεια

- εδώ

- κρυμμένο

- Ψηλά

- Πεζοπορία

- του

- κρατήστε

- Αρχική

- νοσοκομεία

- φιλοξενείται

- Πως

- Πώς να

- Ωστόσο

- HTTPS

- Βελτιστοποίηση υπερπαραμέτρων

- ιδανικά

- προσδιορισμό

- εφαρμογή

- εκτέλεση

- υλοποιήσεις

- εφαρμοστεί

- εισαγωγή

- σημαντικό

- βελτίωση

- βελτιώσεις

- in

- περιλαμβάνει

- Συμπεριλαμβανομένου

- Συσσωματωμένος

- Αυξάνουν

- αύξηση

- οριακό

- βιομηχανία

- πληροφορίες

- Υποδομή

- εισαγωγή

- παράδειγμα

- Ενσωματώνει

- ολοκληρώσεις

- Νοημοσύνη

- αλληλεπιδράσεις

- σε

- εισήγαγε

- συμμετέχουν

- IT

- ΤΟΥ

- Δουλειά

- Θέσεις εργασίας

- jpg

- Κλειδί

- Περιοχές κλειδιά

- επιγραφή

- στρωτός

- τοπίο

- Γλώσσα

- large

- ΜΑΘΑΊΝΩ

- μάθηση

- Άδεια

- Μήκος

- Βιβλιοθήκη

- ζωή

- Επιστήμες της Ζωής

- Μου αρέσει

- συμπαθεί

- LLM

- Παρτίδα

- μηχανή

- μάθηση μηχανής

- που

- Κυρίως

- μεγάλες

- ΚΑΝΕΙ

- Κατασκευή

- άνδρας

- διαχειρίζεται

- διαχείριση

- διευθυντής

- Ταχύτητες

- κατασκευής

- πολοί

- αγορά

- μαζική

- κύριοι

- Αυξάνω στον ανώτατο βαθμό

- ανώτατο όριο

- μηχανισμός

- Εικόνες / Βίντεο

- ιατρικών

- ιατρικά δεδομένα

- Γνωρίστε

- μέθοδοι

- Metrics

- Λεπτ.

- ML

- μοντέλο

- μοντέλα

- παρακολούθηση

- περισσότερο

- πρέπει

- όνομα

- Φυσικό

- Επεξεργασία φυσικής γλώσσας

- δίκτυο

- νευρικός

- νευρικό σύστημα

- παρ 'όλα αυτά

- επόμενη

- nlp

- Όχι.

- Ν/Α

- Notes

- μυθιστόρημα

- αριθμός

- συμβούν

- of

- Offerings

- προσφορές

- συχνά

- on

- ONE

- αποκλειστικά

- βελτιστοποίηση

- or

- τάξη

- πρωτότυπο

- ΑΛΛΑ

- δικός μας

- έξω

- αποτελέσματα

- παραγωγή

- εκτός

- επί

- φόρμες

- γενικά

- Χαρτί

- πέρασε

- για

- επίδοση

- εκτελούνται

- εκτελεί

- Φαρμακευτικά

- phd

- τηλέφωνο

- τηλεφωνικές κλήσεις

- Φυσική

- πλατφόρμες

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- σας παρακαλούμε

- Δημοφιλής

- δυνατός

- Θέση

- δυναμικού

- δύναμη

- ισχυρός

- Πρακτικός

- προβλέψει

- προετοιμασία

- Πρόβλημα

- προβλήματα

- διαδικασια μας

- Επεξεργασμένο

- μεταποίηση

- παράγει

- επαγγελματίας

- προβλέπεται

- υπόσχεση

- παρέχει

- χορήγηση

- δημοσιεύσεις

- δημοσίως

- pytorch

- ερώτηση

- Ερωτήσεις

- γρήγορα

- σειρά

- Τιμή

- αντίδραση

- σε πραγματικό χρόνο

- παραπέμπω

- ρεγεξ

- σχετίζεται με

- σχετικά

- αναφέρθηκαν

- αντιπροσώπευση

- απαιτούν

- απαιτείται

- απαιτήσεις

- Υποστηρικτικό υλικό

- αξιοπίστως

- ΠΕΡΙΦΕΡΕΙΑ

- εύρωστος

- τρέξιμο

- Ασφάλεια

- σοφός

- δείγμα

- Σαν

- Σαν Ντιέγκο

- επεκτάσιμη

- Κλίμακα

- Επιστήμη

- ΕΠΙΣΤΗΜΕΣ

- επιστημονικός

- Επιστήμονας

- επιστήμονες

- άψογα

- Τμήμα

- φαίνεται

- πωλούν

- σημασιολογικός

- αρχαιότερος

- ποινή

- συναίσθημα

- Ακολουθία

- σοβαρός

- υπηρεσία

- Υπηρεσίες

- σειρά

- διάφοροι

- αυτή

- δείχνουν

- έδειξε

- Δείχνει

- Μέγεθος

- λοξότητα

- small

- So

- Μ.Κ.Δ

- social media

- λύση

- Λύσεις

- μερικοί

- μερικές φορές

- Πηγές

- Χώρος

- ειδικεύεται

- συγκεκριμένες

- ειδικότητες

- διαίρεση

- Εκκίνηση

- state-of-the-art

- Μελών

- Βήματα

- καταιγίδα

- ειλικρινής

- στρατηγικές

- δομή

- τέτοιος

- υποστήριξη

- βέβαιος

- συνεργία

- σύνταξη

- συνθετικός

- συνθετικά δεδομένα

- συνθετικώς

- σύστημα

- τραπέζι

- λαμβάνεται

- παίρνει

- λήψη

- Έργο

- εργασίες

- όροι

- δοκιμή

- κείμενο

- Ταξινόμηση κειμένου

- ότι

- Η

- ο κόσμος

- τους

- τότε

- Αυτοί

- αυτοί

- αυτό

- εκείνοι

- αν και?

- Μέσω

- ώρα

- προς την

- σήμερα

- μαζι

- πήρε

- εργαλείο

- εργαλεία

- Θέματα

- παραδοσιακός

- Τρένο

- εκπαιδευμένο

- Εκπαίδευση

- μετασχηματιστής

- μετασχηματιστές

- διαμετακόμιση

- Μετάφραση

- Προσπάθησα

- ενεργοποιούν

- δύο

- τύπος

- κατανόηση

- μονάδα

- πανεπιστήμιο

- διαφορετικός

- ενημερώσεις

- us

- χρήση

- περίπτωση χρήσης

- μεταχειρισμένος

- χρήσιμος

- Χρήστες

- χρησιμοποιώντας

- ποικιλία

- διάφορα

- εκδοχή

- κατακόρυφα

- βιώσιμος

- θέλω

- ήταν

- Τρόπος..

- we

- ιστός

- διαδικτυακές υπηρεσίες

- Καλωσορίζει

- ήταν

- πότε

- ενώ

- Ποιό

- με

- εντός

- λέξη

- λόγια

- Εργασία

- εργαζόμενος

- λειτουργεί

- κόσμος

- θα

- χρόνια

- Εσείς

- Σας

- zephyrnet