Τα τελευταία χρόνια έχουν δείξει εκπληκτική ανάπτυξη στα νευρωνικά δίκτυα βαθιάς μάθησης (DNN). Αυτή η ανάπτυξη μπορεί να φανεί σε πιο ακριβή μοντέλα και ακόμη και στο άνοιγμα νέων δυνατοτήτων με τη γενετική τεχνητή νοημοσύνη: μεγάλα γλωσσικά μοντέλα (LLM) που συνθέτουν φυσική γλώσσα, γεννήτριες κειμένου σε εικόνα και πολλά άλλα. Αυτές οι αυξημένες δυνατότητες των DNN συνοδεύονται από το κόστος της ύπαρξης τεράστιων μοντέλων που απαιτούν σημαντικούς υπολογιστικούς πόρους προκειμένου να εκπαιδευτούν. Η κατανεμημένη εκπαίδευση αντιμετωπίζει αυτό το πρόβλημα με δύο τεχνικές: τον παραλληλισμό δεδομένων και τον παραλληλισμό μοντέλων. Ο παραλληλισμός δεδομένων χρησιμοποιείται για την κλιμάκωση της διαδικασίας εκπαίδευσης σε πολλούς κόμβους και εργαζόμενους, και ο παραλληλισμός μοντέλων διαχωρίζει ένα μοντέλο και το προσαρμόζει στην καθορισμένη υποδομή. Amazon Sage Maker κατανεμημένη εκπαίδευση οι εργασίες σάς επιτρέπουν με ένα κλικ (ή μια κλήση API) να ρυθμίσετε ένα κατανεμημένο σύμπλεγμα υπολογιστών, να εκπαιδεύσετε ένα μοντέλο και να αποθηκεύσετε το αποτέλεσμα σε Απλή υπηρεσία αποθήκευσης Amazon (Amazon S3) και τερματίστε τη λειτουργία του συμπλέγματος όταν ολοκληρωθεί. Επιπλέον, το SageMaker καινοτομεί συνεχώς στον κατανεμημένο χώρο εκπαίδευσης λανσάροντας χαρακτηριστικά όπως ετερογενείς συστάδες και διένειμε εκπαιδευτικές βιβλιοθήκες για παραλληλισμός δεδομένων και μοντέλο παραλληλισμού.

Η αποτελεσματική εκπαίδευση σε ένα κατανεμημένο περιβάλλον απαιτεί προσαρμογή υπερπαραμέτρων. Ένα κοινό παράδειγμα καλής πρακτικής κατά την εκπαίδευση σε πολλές GPU είναι ο πολλαπλασιασμός του μεγέθους παρτίδας (ή μίνι-παρτίδας) με τον αριθμό GPU, προκειμένου να διατηρηθεί το ίδιο μέγεθος παρτίδας ανά GPU. Ωστόσο, η προσαρμογή των υπερπαραμέτρων συχνά επηρεάζει τη σύγκλιση του μοντέλου. Επομένως, η κατανεμημένη εκπαίδευση πρέπει να εξισορροπεί τρεις παράγοντες: την κατανομή, τις υπερπαράμετρους και την ακρίβεια του μοντέλου.

Σε αυτήν την ανάρτηση, διερευνούμε την επίδραση της κατανεμημένης εκπαίδευσης στη σύγκλιση και τον τρόπο χρήσης Αυτόματος συντονισμός μοντέλων Amazon SageMaker να τελειοποιήσουν τις υπερπαραμέτρους του μοντέλου για κατανεμημένη εκπαίδευση χρησιμοποιώντας παραλληλισμό δεδομένων.

Ο πηγαίος κώδικας που αναφέρεται σε αυτήν την ανάρτηση βρίσκεται στο Αποθετήριο GitHub (συνιστάται μια εμφάνιση m5.xlarge).

Κλιμακώστε την εκπαίδευση από ένα ενιαίο σε κατανεμημένο περιβάλλον

Ο παραλληλισμός δεδομένων είναι ένας τρόπος για να κλιμακωθεί η διαδικασία εκπαίδευσης σε πολλαπλούς υπολογιστικούς πόρους και να επιτευχθεί ταχύτερος χρόνος εκπαίδευσης. Με τον παραλληλισμό δεδομένων, τα δεδομένα κατανέμονται μεταξύ των κόμβων υπολογισμού και κάθε κόμβος υπολογίζει τις διαβαθμίσεις με βάση την κατάτμησή τους και ενημερώνει το μοντέλο. Αυτές οι ενημερώσεις μπορούν να γίνουν χρησιμοποιώντας έναν ή πολλούς διακομιστές παραμέτρων με ασύγχρονο, ένα προς πολλά ή από όλους. Ένας άλλος τρόπος μπορεί να είναι να χρησιμοποιήσετε έναν αλγόριθμο AllReduce. Για παράδειγμα, στον αλγόριθμο ring-allreduce, κάθε κόμβος επικοινωνεί μόνο με δύο από τους γειτονικούς του κόμβους, μειώνοντας έτσι τις συνολικές μεταφορές δεδομένων. Για να μάθετε περισσότερα σχετικά με τους διακομιστές παραμέτρων και το ring-allreduce, βλ Εύκολη εκκίνηση κατανεμημένης εκπαίδευσης TensorFlow με Horovod ή διακομιστές παραμέτρων στο Amazon SageMaker. Όσον αφορά την κατάτμηση δεδομένων, εάν υπάρχει n Υπολογίστε τους κόμβους, τότε κάθε κόμβος θα πρέπει να λάβει ένα υποσύνολο δεδομένων, περίπου 1/n στο μέγεθος.

Για να δείξουμε την επίδραση της κλιμάκωσης της εκπαίδευσης στη σύγκλιση μοντέλων, εκτελούμε δύο απλά πειράματα:

Κάθε εκπαίδευση μοντέλου διεξήχθη δύο φορές: σε μία μόνο παρουσία και κατανεμημένη σε πολλές περιπτώσεις. Για την κατανεμημένη εκπαίδευση DNN, προκειμένου να αξιοποιηθούν πλήρως οι κατανεμημένοι επεξεργαστές, πολλαπλασιάσαμε το μέγεθος της μίνι παρτίδας με τον αριθμό των περιπτώσεων (τέσσερα). Ο παρακάτω πίνακας συνοψίζει τη ρύθμιση και τα αποτελέσματα.

| Τύπος προβλήματος | Ταξινόμηση εικόνας | Δυαδική ταξινόμηση | ||

| Μοντέλο | DNN | XGBoost | ||

| Παράδειγμα | ml.c4.xlarge | ml.m5.2xlarge | ||

| Σετ δεδομένων |

(Εικόνες με ετικέτα) |

Direct Marketing (κατηγορίες πίνακα, αριθμητικές και διανυσματικές) |

||

| Μέτρηση επικύρωσης | Ακρίβεια | AUC | ||

| Εποχές/Γύροι | 20 | 150 | ||

| Αριθμός περιπτώσεων | 1 | 4 | 1 | 3 |

| Τύπος διανομής | N / A | Διακομιστής παραμέτρων | N / A | AllReduce |

| Χρόνος προπόνησης (λεπτά) | 8 | 3 | 3 | 1 |

| Τελική βαθμολογία επικύρωσης | 0.97 | 0.11 | 0.78 | 0.63 |

Και για τα δύο μοντέλα, ο χρόνος εκπαίδευσης μειώθηκε σχεδόν γραμμικά από τον παράγοντα κατανομής. Ωστόσο, η σύγκλιση του μοντέλου υπέστη σημαντική πτώση. Αυτή η συμπεριφορά είναι συνεπής για τα δύο διαφορετικά μοντέλα, τις διαφορετικές περιπτώσεις υπολογισμού, τις διαφορετικές μεθόδους διανομής και τους διαφορετικούς τύπους δεδομένων. Λοιπόν, γιατί η διανομή της εκπαιδευτικής διαδικασίας επηρέασε την ακρίβεια του μοντέλου;

Υπάρχουν διάφορες θεωρίες που προσπαθούν να εξηγήσουν αυτό το αποτέλεσμα:

- Όταν οι ενημερώσεις τανυστή είναι μεγάλου μεγέθους, η κυκλοφορία μεταξύ των εργαζομένων και του διακομιστή παραμέτρων μπορεί να συμφορηθεί. Επομένως, οι ασύγχρονοι διακομιστές παραμέτρων θα υποστούν σημαντικά χειρότερη σύγκλιση λόγω καθυστερήσεων στις ενημερώσεις βαρών [1].

- Η αύξηση του μεγέθους της παρτίδας μπορεί να οδηγήσει σε υπερβολική προσαρμογή και κακή γενίκευση, μειώνοντας έτσι την ακρίβεια επικύρωσης [2].

- Κατά την ασύγχρονη ενημέρωση των παραμέτρων του μοντέλου, ορισμένα DNN ενδέχεται να μην χρησιμοποιούν τα πιο πρόσφατα ενημερωμένα βάρη μοντέλων. Ως εκ τούτου, θα υπολογίζουν διαβαθμίσεις με βάση τα βάρη που είναι μερικές επαναλήψεις πίσω. Αυτό οδηγεί σε μπαγιάτικο βάρος [3] και μπορεί να προκληθεί από διάφορους λόγους.

- Ορισμένες υπερπαράμετροι είναι συγκεκριμένες για μοντέλο ή βελτιστοποιητή. Για παράδειγμα, η επίσημη τεκμηρίωση του XGBoost λέει ότι το

exactαξία για τοtree_modeΗ υπερπαράμετρος δεν υποστηρίζει κατανεμημένη εκπαίδευση επειδή το XGBoost χρησιμοποιεί διανομή δεδομένων διαχωρισμού σειρών, ενώ ηexactΗ μέθοδος δέντρου λειτουργεί σε μια ταξινομημένη μορφή στήλης. - Ορισμένοι ερευνητές πρότειναν ότι η διαμόρφωση μιας μεγαλύτερης μίνι παρτίδας μπορεί να οδηγήσει σε κλίσεις με λιγότερη στοχαστικότητα. Αυτό μπορεί να συμβεί όταν η συνάρτηση απώλειας περιέχει τοπικά ελάχιστα και σημεία σέλας και δεν γίνεται καμία αλλαγή στο μέγεθος του βήματος, ώστε η βελτιστοποίηση να κολλήσει σε τέτοια τοπικά ελάχιστα ή σημεία σέλας [4].

Βελτιστοποίηση για κατανεμημένη εκπαίδευση

Η βελτιστοποίηση υπερπαραμέτρων (HPO) είναι η διαδικασία αναζήτησης και επιλογής ενός συνόλου υπερπαραμέτρων που είναι βέλτιστες για έναν αλγόριθμο εκμάθησης. Το SageMaker Automatic Model Tuning (AMT) παρέχει HPO ως διαχειριζόμενη υπηρεσία εκτελώντας πολλαπλές εργασίες εκπαίδευσης στο παρεχόμενο σύνολο δεδομένων. Το SageMaker AMT αναζητά το εύρος των υπερπαραμέτρων που καθορίζετε και επιστρέφει τις καλύτερες τιμές, όπως μετρώνται από μια μέτρηση που επιλέγετε. Μπορείτε να χρησιμοποιήσετε το SageMaker AMT με τους ενσωματωμένους αλγόριθμους ή να χρησιμοποιήσετε τους προσαρμοσμένους αλγόριθμους και τα κοντέινερ.

Ωστόσο, η βελτιστοποίηση για κατανεμημένη εκπαίδευση διαφέρει από την κοινή HPO, επειδή αντί να ξεκινήσει μια μεμονωμένη παρουσία ανά εργασία εκπαίδευσης, κάθε εργασία εκκινεί στην πραγματικότητα ένα σύμπλεγμα παρουσιών. Αυτό σημαίνει μεγαλύτερο αντίκτυπο στο κόστος (ειδικά αν λάβετε υπόψη δαπανηρές περιπτώσεις επιτάχυνσης της GPU, οι οποίες είναι τυπικές για το DNN). Επιπρόσθετα Όρια AMT, θα μπορούσατε ενδεχομένως να χτυπήσετε Όρια λογαριασμού SageMaker για ταυτόχρονο αριθμό περιπτώσεων εκπαίδευσης. Τέλος, τα συμπλέγματα εκτόξευσης μπορούν να εισάγουν λειτουργικά έξοδα λόγω μεγαλύτερου χρόνου εκκίνησης. Το SageMaker AMT διαθέτει συγκεκριμένες δυνατότητες για την αντιμετώπιση αυτών των προβλημάτων. Υπερζώνη με πρόωρη διακοπή διασφαλίζει ότι οι διαμορφώσεις υπερπαραμέτρων με καλή απόδοση ρυθμίζονται με ακρίβεια και ότι αυτές που έχουν χαμηλή απόδοση διακόπτονται αυτόματα. Αυτό επιτρέπει την αποτελεσματική χρήση του χρόνου εκπαίδευσης και μειώνει το περιττό κόστος. Επίσης, το SageMaker AMT υποστηρίζει πλήρως τη χρήση των Amazon EC2 Spot Instances, τα οποία μπορούν να βελτιστοποιήσουν την κόστος εκπαίδευσης έως και 90% σε περιπτώσεις κατά παραγγελία. Όσον αφορά τους μεγάλους χρόνους εκκίνησης, το SageMaker AMT επαναχρησιμοποιεί αυτόματα στιγμιότυπα εκπαίδευσης σε κάθε εργασία συντονισμού, μειώνοντας έτσι τον μέσο χρόνο εκκίνησης κάθε εργασίας εργασία εκπαίδευσης κατά 20 φορές. Επιπλέον, θα πρέπει να ακολουθήσετε βέλτιστες πρακτικές AMT, όπως η επιλογή των σχετικών υπερπαραμέτρων, οι κατάλληλες περιοχές και κλίμακες, και ο καλύτερος αριθμός ταυτόχρονων εργασιών εκπαίδευσης και ο ορισμός ενός τυχαίου σπόρου για την αναπαραγωγή των αποτελεσμάτων.

Στην επόμενη ενότητα, βλέπουμε αυτές τις δυνατότητες σε δράση καθώς διαμορφώνουμε, εκτελούμε και αναλύουμε μια εργασία AMT χρησιμοποιώντας το παράδειγμα XGBoost που συζητήσαμε νωρίτερα.

Διαμορφώστε, εκτελέστε και αναλύστε μια εργασία συντονισμού

Όπως αναφέρθηκε προηγουμένως, ο πηγαίος κώδικας βρίσκεται στο GitHub repo. Στα Βήματα 1–5, κατεβάζουμε και προετοιμάζουμε τα δεδομένα, δημιουργούμε τα xgb3 εκτιμητής (ο κατανεμημένος εκτιμητής XGBoost έχει ρυθμιστεί να χρησιμοποιεί τρεις περιπτώσεις), εκτελέστε τις εργασίες εκπαίδευσης και παρατηρήστε τα αποτελέσματα. Σε αυτήν την ενότητα, περιγράφουμε πώς να ρυθμίσετε την εργασία συντονισμού για αυτόν τον εκτιμητή, υποθέτοντας ότι έχετε ήδη περάσει από τα Βήματα 1–5.

Μια εργασία συντονισμού υπολογίζει τις βέλτιστες υπερπαραμέτρους για τις εργασίες εκπαίδευσης που ξεκινά χρησιμοποιώντας μια μέτρηση για την αξιολόγηση της απόδοσης. Μπορείς διαμορφώστε τη δική σας μέτρηση, το οποίο θα αναλύσει το SageMaker με βάση το regex που ρυθμίζετε και εκπέμπετε stdoutή χρησιμοποιήστε τις μετρήσεις του Ενσωματωμένοι αλγόριθμοι SageMaker. Σε αυτό το παράδειγμα, χρησιμοποιούμε το ενσωματωμένη αντικειμενική μέτρηση XGBoost, επομένως δεν χρειάζεται να ρυθμίσουμε ένα regex. Για βελτιστοποίηση για σύγκλιση μοντέλων, βελτιστοποιούμε με βάση τη μέτρηση AUC επικύρωσης:

Συντονίζουμε επτά υπερπαραμέτρους:

- αριθμός_στρογγυλός – Αριθμός γύρων για ενίσχυση κατά τη διάρκεια της προπόνησης.

- eta – Συρρίκνωση μεγέθους βήματος που χρησιμοποιείται στις ενημερώσεις για την αποφυγή υπερβολικής προσαρμογής.

- άλφα – L1 όρος τακτοποίησης στα βάρη.

- ελάχιστο_βάρος_παιδιού – Ελάχιστο άθροισμα βάρους (hessian) που απαιτείται σε ένα παιδί. Εάν το βήμα διαμερίσματος δέντρου έχει ως αποτέλεσμα έναν κόμβο φύλλου με το άθροισμα του βάρους της περίπτωσης μικρότερο από

min_child_weight, η διαδικασία δόμησης εγκαταλείπει περαιτέρω διαχωρισμό. - max_depth – Μέγιστο βάθος δέντρου.

- colsample_bylevel – Υποδειγματική αναλογία στηλών για κάθε διαίρεση, σε κάθε επίπεδο. Αυτή η υποδειγματοληψία πραγματοποιείται μία φορά για κάθε νέο επίπεδο βάθους που επιτυγχάνεται σε ένα δέντρο.

- colsample_bytree – Υποδειγματική αναλογία στηλών κατά την κατασκευή κάθε δέντρου. Για κάθε δέντρο που κατασκευάζεται, η υποδειγματοληψία πραγματοποιείται μία φορά.

Για να μάθετε περισσότερα σχετικά με τις υπερπαραμέτρους XGBoost, βλ Υπερπαραμέτρους XGBoost. Ο παρακάτω κώδικας δείχνει τις επτά υπερπαράμετρους και τις περιοχές τους:

Στη συνέχεια, παρέχουμε το διαμόρφωση για τη στρατηγική Hyperband και τη διαμόρφωση αντικειμένου δέκτη χρησιμοποιώντας το SageMaker SDK. HyperbandStrategyConfig μπορεί να χρησιμοποιήσει δύο παραμέτρους: max_resource (προαιρετικό) για τον μέγιστο αριθμό επαναλήψεων που θα χρησιμοποιηθούν για μια εργασία εκπαίδευσης για την επίτευξη του στόχου, και min_resource – ο ελάχιστος αριθμός επαναλήψεων που πρέπει να χρησιμοποιηθούν από μια εργασία εκπαίδευσης πριν από τη διακοπή της εκπαίδευσης. Χρησιμοποιούμε HyperbandStrategyConfig για να ρυθμίσετε StrategyConfig, το οποίο χρησιμοποιείται αργότερα από τον ορισμό της εργασίας συντονισμού. Δείτε τον παρακάτω κώδικα:

Τώρα δημιουργούμε ένα HyperparameterTuner αντικείμενο, στο οποίο διαβιβάζουμε τις ακόλουθες πληροφορίες:

- Ο εκτιμητής XGBoost, ρυθμίστηκε να εκτελείται με τρεις παρουσίες

- Το αντικειμενικό μετρικό όνομα και ορισμός

- Το εύρος των υπερπαραμέτρων μας

- Συντονισμός διαμορφώσεων πόρων, όπως ο αριθμός των εργασιών εκπαίδευσης που θα εκτελεστούν συνολικά και πόσες εργασίες εκπαίδευσης μπορούν να εκτελεστούν παράλληλα

- Ρυθμίσεις υπερζώνης (η στρατηγική και η διαμόρφωση που διαμορφώσαμε στο τελευταίο βήμα)

- πρόωρη διακοπή (

early_stopping_type) οριστεί σεOff

Γιατί ορίζουμε την πρόωρη στάση σε Απενεργοποίηση; Οι εργασίες εκπαίδευσης μπορούν να διακοπούν νωρίς όταν είναι απίθανο να βελτιώσουν την αντικειμενική μέτρηση της εργασίας συντονισμού υπερπαραμέτρων. Αυτό μπορεί να βοηθήσει στη μείωση του χρόνου υπολογισμού και στην αποφυγή υπερβολικής προσαρμογής του μοντέλου σας. Ωστόσο, η Hyperband χρησιμοποιεί έναν προηγμένο ενσωματωμένο μηχανισμό για την εφαρμογή πρόωρης διακοπής. Επομένως, η παράμετρος early_stopping_type πρέπει να ρυθμιστεί σε Off όταν χρησιμοποιείτε τη δυνατότητα εσωτερικής πρόωρης διακοπής υπερζώνης. Δείτε τον παρακάτω κώδικα:

Τέλος, ξεκινάμε την εργασία αυτόματου συντονισμού μοντέλου καλώντας το ταιριάζουν μέθοδος. Εάν θέλετε να ξεκινήσετε την εργασία με ασύγχρονο τρόπο, ορίστε wait προς την False. Δείτε τον ακόλουθο κώδικα:

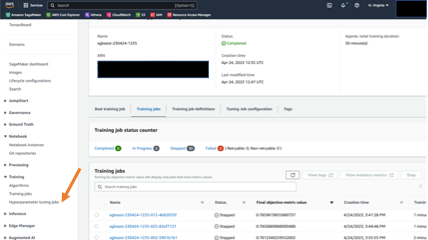

Μπορείτε να παρακολουθήσετε την πρόοδο και τη σύνοψη της εργασίας στην κονσόλα SageMaker. Στο παράθυρο πλοήγησης, κάτω Εκπαίδευση, επιλέξτε Εργασίες συντονισμού υπερπαραμέτρων, στη συνέχεια επιλέξτε τη σχετική εργασία συντονισμού. Το ακόλουθο στιγμιότυπο οθόνης δείχνει την εργασία συντονισμού με λεπτομέρειες σχετικά με την κατάσταση και την απόδοση των εργασιών εκπαίδευσης.

Όταν ολοκληρωθεί η εργασία συντονισμού, μπορούμε να ελέγξουμε τα αποτελέσματα. Στο παράδειγμα του σημειωματάριου, δείχνουμε πώς να εξαγάγετε αποτελέσματα χρησιμοποιώντας το SageMaker SDK. Αρχικά, εξετάζουμε πώς η εργασία συντονισμού αύξησε τη σύγκλιση του μοντέλου. Μπορείτε να επισυνάψετε το HyperparameterTuner αντιταχθείτε χρησιμοποιώντας το όνομα εργασίας και καλέστε το περιγράφουν μέθοδος. Η μέθοδος επιστρέφει ένα λεξικό που περιέχει μεταδεδομένα εργασίας συντονισμού και αποτελέσματα.

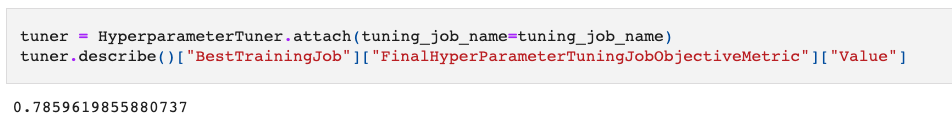

Στον ακόλουθο κώδικα, ανακτούμε την τιμή της εργασίας εκπαίδευσης με την καλύτερη απόδοση, όπως μετράται από τη μέτρηση του στόχου μας (AUC επικύρωσης):

Το αποτέλεσμα είναι 0.78 σε AUC στο σετ επικύρωσης. Αυτή είναι μια σημαντική βελτίωση σε σχέση με το αρχικό 0.63!

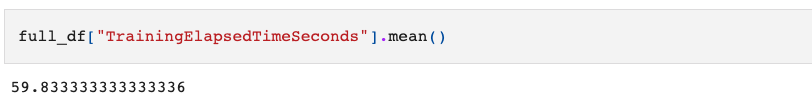

Στη συνέχεια, ας δούμε πόσο γρήγορα έτρεξε η προπονητική μας εργασία. Για αυτό, χρησιμοποιούμε το HyperparameterTuningJobAnalytics μέθοδος στο SDK για ανάκτηση αποτελεσμάτων σχετικά με την εργασία συντονισμού και ανάγνωση σε ένα πλαίσιο δεδομένων Pandas για ανάλυση και οπτικοποίηση:

Ας δούμε τον μέσο χρόνο που χρειάστηκε μια εργασία εκπαίδευσης με τη στρατηγική Hyperband:

Ο μέσος χρόνος χρειάστηκε περίπου 1 λεπτό. Αυτό είναι σύμφωνο με τον μηχανισμό στρατηγικής Hyperband που σταματά νωρίς την κακή απόδοση των εργασιών εκπαίδευσης. Όσον αφορά το κόστος, η δουλειά του συντονισμού μας χρέωσε συνολικά 30 λεπτά χρόνου εκπαίδευσης. Χωρίς την πρόωρη διακοπή της Hyperband, η συνολική χρεώσιμη διάρκεια εκπαίδευσης αναμενόταν να είναι 90 λεπτά (30 θέσεις εργασίας * 1 λεπτό ανά εργασία * 3 περιπτώσεις ανά εργασία). Αυτό είναι τρεις φορές καλύτερο σε εξοικονόμηση κόστους! Τέλος, βλέπουμε ότι η εργασία συντονισμού έτρεξε 30 εργασίες εκπαίδευσης και χρειάστηκε συνολικά 12 λεπτά. Αυτός είναι σχεδόν 50% λιγότερος από τον αναμενόμενο χρόνο (30 θέσεις εργασίας/4 εργασίες παράλληλα * 3 λεπτά ανά εργασία).

Συμπέρασμα

Σε αυτήν την ανάρτηση, περιγράψαμε ορισμένα παρατηρούμενα ζητήματα σύγκλισης κατά την εκπαίδευση μοντέλων με κατανεμημένα περιβάλλοντα. Είδαμε ότι το SageMaker AMT χρησιμοποιώντας Hyperband αντιμετώπισε τις κύριες ανησυχίες που εισήγαγε η βελτιστοποίηση της παράλληλης κατανεμημένης εκπαίδευσης δεδομένων: σύγκλιση (η οποία βελτιώθηκε περισσότερο από 10%), λειτουργική αποτελεσματικότητα (η εργασία συντονισμού χρειάστηκε 50% λιγότερο χρόνο από μια διαδοχική, μη βελτιστοποιημένη εργασία έχουν λάβει) και οικονομική αποδοτικότητα (30 έναντι των 90 χρεώσιμων λεπτών χρόνου εργασίας εκπαίδευσης). Ο παρακάτω πίνακας συνοψίζει τα αποτελέσματά μας:

| Μετρική βελτίωσης | Χωρίς συντονισμό/Αφελής εφαρμογή συντονισμού μοντέλου | Αυτόματος συντονισμός μοντέλου SageMaker Hyperband | Μετρημένη Βελτίωση |

| Ποιότητα μοντέλου (Μετρήθηκε με AUC επικύρωσης) |

0.63 | 0.78 | 15% |

| Κόστος (Μετράται με χρεώσιμα λεπτά εκπαίδευσης) |

90 | 30 | 66% |

| Λειτουργική αποδοτικότητα (Μετράται με τον συνολικό χρόνο λειτουργίας) |

24 | 12 | 50% |

Για να βελτιστοποιήσετε την κλιμάκωση (μέγεθος συμπλέγματος), μπορείτε να επαναλάβετε την εργασία συντονισμού με πολλαπλές διαμορφώσεις συμπλέγματος και να συγκρίνετε τα αποτελέσματα για να βρείτε τις βέλτιστες υπερπαραμέτρους που ικανοποιούν την ταχύτητα και την ακρίβεια του μοντέλου.

Συμπεριλάβαμε τα βήματα για να το πετύχουμε αυτό στην τελευταία ενότητα του σημειωματάριο.

αναφορές

[1] Lian, Xiangru, et al. "Ασύγχρονη αποκεντρωμένη παράλληλη στοχαστική κλίση". Διεθνές Συνέδριο για τη Μηχανική Μάθηση. PMLR, 2018.

[2] Keskar, Nitish Shirish, et al. «Σχετικά με την εκπαίδευση μεγάλης παρτίδας για βαθιά μάθηση: χάσμα γενίκευσης και αιχμηρά ελάχιστα». προ-εκτύπωση arXiv arXiv: 1609.04836 (2016).

[3] Dai, Wei, et al. "Προς την κατανόηση του αντίκτυπου της αδράνειας στην κατανεμημένη μηχανική μάθηση." προ-εκτύπωση arXiv arXiv: 1810.03264 (2018).

[4] Dauphin, Yann N., et al. "Εντοπισμός και επίθεση στο πρόβλημα του σημείου σέλας στη βελτιστοποίηση μη κυρτών υψηλών διαστάσεων." Πρόοδοι σε συστήματα επεξεργασίας νευρωνικών πληροφοριών 27 (2014).

Σχετικά με το Συγγραφέας

Ο Uri Rosenberg είναι ο Ειδικός Τεχνικός Διευθυντής AI & ML για την Ευρώπη, τη Μέση Ανατολή και την Αφρική. Με έδρα το Ισραήλ, η Uri εργάζεται για να ενδυναμώσει τους εταιρικούς πελάτες να σχεδιάζουν, να δημιουργούν και να λειτουργούν φόρτους εργασίας ML σε κλίμακα. Στον ελεύθερο χρόνο του, του αρέσει η ποδηλασία, η πεζοπορία και τα παράπονα για την προετοιμασία δεδομένων.

Ο Uri Rosenberg είναι ο Ειδικός Τεχνικός Διευθυντής AI & ML για την Ευρώπη, τη Μέση Ανατολή και την Αφρική. Με έδρα το Ισραήλ, η Uri εργάζεται για να ενδυναμώσει τους εταιρικούς πελάτες να σχεδιάζουν, να δημιουργούν και να λειτουργούν φόρτους εργασίας ML σε κλίμακα. Στον ελεύθερο χρόνο του, του αρέσει η ποδηλασία, η πεζοπορία και τα παράπονα για την προετοιμασία δεδομένων.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Αυτοκίνητο / EVs, Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- BlockOffsets. Εκσυγχρονισμός της περιβαλλοντικής αντιστάθμισης ιδιοκτησίας. Πρόσβαση εδώ.

- πηγή: https://aws.amazon.com/blogs/machine-learning/effectively-solve-distributed-training-convergence-issues-with-amazon-sagemaker-hyperband-automatic-model-tuning/

- :έχει

- :είναι

- :δεν

- $UP

- 1

- 10

- 100

- 12

- 15%

- 20

- 200

- 2014

- 2016

- 2018

- 24

- 27

- 30

- 7

- 8

- 9

- a

- ΠΛΗΡΟΦΟΡΙΕΣ

- Λογαριασμός

- ακρίβεια

- ακριβής

- Κατορθώνω

- Ενέργειες

- πραγματικά

- Επιπλέον

- Επιπλέον

- διεύθυνση

- διευθύνσεις

- προηγμένες

- επηρεάζουν

- Αφρική

- AI

- AL

- αλγόριθμος

- αλγόριθμοι

- Άλφα

- ήδη

- Επίσης

- καταπληκτικό

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon υπηρεσίες Web

- μεταξύ των

- an

- ανάλυση

- analytics

- αναλύσει

- και

- Άλλος

- api

- Εφαρμογή

- κατάλληλος

- περίπου

- ΕΙΝΑΙ

- AS

- At

- αποδίδουν

- Επιθετικός

- Αυτόματο

- αυτομάτως

- μέσος

- αποφύγετε

- AWS

- Υπόλοιπο

- βασίζονται

- BE

- επειδή

- πριν

- συμπεριφορά

- πίσω

- ΚΑΛΎΤΕΡΟΣ

- Καλύτερα

- μεταξύ

- Μεγάλος

- ενίσχυση

- και οι δύο

- χτίζω

- Κτίριο

- ενσωματωμένο

- by

- υπολογισμό

- κλήση

- κλήση

- CAN

- Μπορεί να πάρει

- δυνατότητες

- κατηγορίες

- προκαλούνται

- αλλαγή

- φορτισμένα

- παιδί

- Επιλέξτε

- επιλέγοντας

- κλικ

- συστάδα

- κωδικός

- Στήλη

- Στήλες

- Ελάτε

- Κοινός

- συγκρίνουν

- πλήρης

- Υπολογίστε

- Πιθανά ερωτήματα

- ανταγωνιστής

- Διάσκεψη

- διαμόρφωση

- έχει ρυθμιστεί

- Εξετάστε

- συνεπής

- πρόξενος

- κατασκευή

- Εμπορευματοκιβώτια

- Περιέχει

- συνεχώς

- Σύγκλιση

- Κόστος

- δαπανηρός

- Δικαστικά έξοδα

- θα μπορούσε να

- δημιουργία

- έθιμο

- Πελάτες

- DAI

- ημερομηνία

- Προετοιμασία δεδομένων

- Αποκεντρωμένη

- βαθύς

- βαθιά μάθηση

- ορισμός

- καθυστερήσεις

- αποδεικνύουν

- βάθος

- περιγράφουν

- περιγράφεται

- Υπηρεσίες

- καθορισμένο

- καθέκαστα

- DID

- διαφορετικές

- συζήτηση

- διανέμονται

- κατανεμημένη εκπαίδευση

- διανομή

- διανομή

- do

- τεκμηρίωση

- Όχι

- γίνεται

- Μην

- κάτω

- κατεβάσετε

- Πτώση

- δυο

- διάρκεια

- κατά την διάρκεια

- Ε & Τ

- κάθε

- Νωρίτερα

- Νωρίς

- εύκολα

- Ανατολή

- αποτέλεσμα

- αποτελεσματικά

- αποδοτικότητα

- αποτελεσματικός

- απασχολεί

- εξουσιοδοτώ

- ενεργοποιήσετε

- δίνει τη δυνατότητα

- εξασφαλίζει

- Εταιρεία

- Περιβάλλον

- περιβάλλοντα

- ειδικά

- Ευρώπη

- αξιολογήσει

- Even

- Κάθε

- εξετάζω

- παράδειγμα

- αναμένεται

- πειράματα

- Εξηγήστε

- διερευνήσει

- εκχύλισμα

- παράγοντας

- παράγοντες

- Μόδα

- FAST

- γρηγορότερα

- Χαρακτηριστικό

- Χαρακτηριστικά

- λίγοι

- Τελικά

- Εύρεση

- Όνομα

- ταιριάζουν

- ακολουθήστε

- Εξής

- Για

- μορφή

- Βρέθηκαν

- τέσσερα

- ΠΛΑΙΣΙΟ

- από

- πλήρως

- λειτουργία

- περαιτέρω

- Επί πλέον

- χάσμα

- γενετική

- Παραγωγική τεχνητή νοημοσύνη

- Γεννήτριες

- παίρνω

- να πάρει

- δίνει

- καλός

- GPU

- GPU

- κλίσεις

- μεγαλύτερη

- Ανάπτυξη

- συμβαίνω

- Έχω

- που έχει

- he

- βοήθεια

- του

- Επιτυχία

- Πως

- Πώς να

- Ωστόσο

- HTML

- http

- HTTPS

- Ρύθμιση υπερπαραμέτρων

- if

- εικόνες

- Επίπτωση

- Επιπτώσεις

- βελτίωση

- βελτιωθεί

- βελτίωση

- in

- περιλαμβάνονται

- αυξημένη

- πληροφορίες

- Υποδομή

- αρχικός

- παράδειγμα

- αντί

- εσωτερικός

- σε

- εισαγάγει

- εισήγαγε

- Ισραήλ

- θέματα

- IT

- επαναλήψεις

- ΤΟΥ

- Δουλειά

- Θέσεις εργασίας

- Διατήρηση

- L1

- Γλώσσα

- large

- μεγαλύτερος

- Επίθετο

- αργότερα

- ξεκινήσει

- ξεκινάει

- δρομολόγηση

- οδηγήσει

- Οδηγεί

- ΜΑΘΑΊΝΩ

- μάθηση

- μείον

- Επίπεδο

- βιβλιοθήκες

- Μου αρέσει

- τοπικός

- Μακριά

- πλέον

- off

- μηχανή

- μάθηση μηχανής

- που

- Κυρίως

- διαχειρίζεται

- διευθυντής

- πολοί

- μαζική

- ανώτατο όριο

- Ενδέχεται..

- μέσα

- μηχανισμός

- που αναφέρθηκαν

- Μεταδεδομένα

- μέθοδος

- μέθοδοι

- μετρικός

- Metrics

- Μέσο

- Μέση Ανατολή

- ενδέχεται να

- ελάχιστο

- λεπτό

- Λεπτ.

- ML

- μοντέλο

- μοντέλα

- περισσότερο

- πλέον

- πολλαπλούς

- πολλαπλασιάζεται

- πρέπει

- όνομα

- Φυσικό

- Πλοήγηση

- Ανάγκη

- που απαιτούνται

- ανάγκες

- δίκτυα

- νευρωνικά δίκτυα

- Νέα

- επόμενη

- Όχι.

- κόμβος

- κόμβων

- σημειωματάριο

- αριθμός

- αντικείμενο

- σκοπός

- παρατηρούμε

- of

- off

- επίσημος ανώτερος υπάλληλος

- συχνά

- on

- Κατα παραγγελια

- μια φορά

- ONE

- αποκλειστικά

- άνοιγμα

- λειτουργούν

- επιχειρήσεων

- βέλτιστη

- βελτιστοποίηση

- Βελτιστοποίηση

- βελτιστοποίηση

- or

- τάξη

- δικός μας

- έξω

- επί

- φόρμες

- δική

- Πάντα

- παράθυρο

- Παράλληλο

- παράμετρος

- παράμετροι

- passieren

- για

- επίδοση

- Μέρος

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- Σημείο

- σημεία

- φτωχός

- δυνατότητες

- πιθανώς

- Θέση

- πρακτική

- προετοιμασία

- Προετοιμάστε

- πρόληψη

- Πρόβλημα

- διαδικασια μας

- μεταποίηση

- επεξεργαστές

- Πρόοδος

- προτείνεται

- παρέχουν

- παρέχεται

- παρέχει

- τυχαίος

- αναλογία

- φθάσει

- Διάβασε

- λόγους

- πρόσφατος

- συνιστάται

- μείωση

- Μειωμένος

- μειώνει

- μείωση

- αφορά

- ρεγεξ

- επαναλαμβάνω

- απαιτούν

- Απαιτεί

- ερευνητές

- πόρος

- Υποστηρικτικό υλικό

- αποτέλεσμα

- Αποτελέσματα

- Επιστροφές

- ανασκόπηση

- γύρους

- ΣΕΙΡΑ

- τρέξιμο

- τρέξιμο

- σοφός

- Αυτόματος συντονισμός μοντέλων SageMaker

- ίδιο

- Αποθήκευση

- πριόνι

- λέει

- SC

- Κλίμακα

- Ζυγός

- απολέπιση

- SDK

- αναζήτηση

- Τμήμα

- δείτε

- σπόρος

- δει

- επιλογή

- Διακομιστές

- υπηρεσία

- Υπηρεσίες

- σειρά

- τον καθορισμό

- ρυθμίσεις

- setup

- επτά

- αιχμηρά

- θα πρέπει να

- δείχνουν

- παρουσιάζεται

- Δείχνει

- τερματίστε

- σημαντικός

- σημαντικά

- Απλούς

- ενιαίας

- Μέγεθος

- So

- SOLVE

- μερικοί

- Πηγή

- πρωτογενής κώδικας

- Χώρος

- ειδικός

- συγκεκριμένες

- ταχύτητα

- διαίρεση

- Διαχωρίστε

- Spot

- Εκκίνηση

- Ξεκινήστε

- εκκίνηση

- Κατάσταση

- Βήμα

- Βήματα

- σταμάτησε

- στάθμευση

- Διακόπτει

- χώρος στο δίσκο

- Στρατηγική

- τέτοιος

- υπέφερε

- ΠΕΡΙΛΗΨΗ

- υποστήριξη

- Υποστηρίζει

- τραπέζι

- λαμβάνεται

- παίρνει

- Τεχνικός

- τεχνικές

- tensorflow

- όρος

- όροι

- από

- ότι

- Η

- Η Πηγη

- τους

- Τους

- τότε

- Εκεί.

- εκ τούτου

- επομένως

- Αυτοί

- αυτοί

- αυτό

- εκείνοι

- τρία

- Μέσω

- ώρα

- φορές

- προς την

- πήρε

- Σύνολο

- ΚΙΝΗΣΗ στους ΔΡΟΜΟΥΣ

- Τρένο

- εκπαιδευμένο

- Εκπαίδευση

- μεταβιβάσεις

- δέντρο

- προσπαθώ

- Δυο φορές

- δύο

- τύποι

- τυπικός

- υπό

- κατανόηση

- απίθανος

- περιττός

- ενημερώθηκε

- ενημερώσεις

- ενημέρωση

- us

- χρήση

- μεταχειρισμένος

- χρησιμοποιεί

- χρησιμοποιώντας

- χρησιμοποιώ

- επικύρωση

- αξία

- Αξίες

- οραματισμός

- vs

- θέλω

- ήταν

- Τρόπος..

- we

- ιστός

- διαδικτυακές υπηρεσίες

- βάρος

- πήγε

- πότε

- ενώ

- Ποιό

- WHY

- Wikipedia

- θα

- με

- εντός

- χωρίς

- εργαζομένων

- λειτουργεί

- χειρότερος

- θα

- XGBoost

- χρόνια

- Εσείς

- Σας

- zephyrnet