Αυτή η ανάρτηση ιστολογίου συνυπογράφεται με την Tuana Çelik από βαθιά.

Η αναζήτηση επιχειρήσεων είναι ένα κρίσιμο στοιχείο της οργανωτικής αποτελεσματικότητας μέσω της ψηφιοποίησης εγγράφων και της διαχείρισης γνώσης. Η εταιρική αναζήτηση καλύπτει την αποθήκευση εγγράφων όπως ψηφιακά αρχεία, την ευρετηρίαση των εγγράφων για αναζήτηση και την παροχή σχετικών αποτελεσμάτων με βάση τα ερωτήματα των χρηστών. Με την έλευση των μεγάλων γλωσσικών μοντέλων (LLM), μπορούμε να εφαρμόσουμε εμπειρίες συνομιλίας στην παροχή των αποτελεσμάτων στους χρήστες. Ωστόσο, πρέπει να διασφαλίσουμε ότι τα LLMs περιορίζουν τις απαντήσεις στα δεδομένα της εταιρείας, μετριάζοντας έτσι τις παραισθήσεις του μοντέλου.

Σε αυτήν την ανάρτηση, παρουσιάζουμε πώς να δημιουργήσετε μια ολοκληρωμένη εφαρμογή τεχνητής νοημοσύνης για επιχειρησιακή αναζήτηση με Retrieval Augmented Generation (RAG) χρησιμοποιώντας Haystack pipelines και το μοντέλο Falcon-40b-instruct από Amazon SageMaker JumpStart και Amazon OpenSearch Service. Ο πηγαίος κώδικας για το δείγμα που παρουσιάζεται σε αυτήν την ανάρτηση είναι διαθέσιμος στο Αποθετήριο GitHub

Επισκόπηση λύσεων

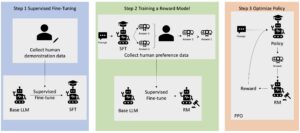

Για να περιορίσουμε τις απαντήσεις των γενετικών εφαρμογών AI μόνο σε εταιρικά δεδομένα, πρέπει να χρησιμοποιήσουμε μια τεχνική που ονομάζεται Augmented Generation (RAG). Μια εφαρμογή που χρησιμοποιεί την προσέγγιση RAG ανακτά τις πιο σχετικές με το αίτημα του χρήστη πληροφορίες από τη γνωσιακή βάση ή το περιεχόμενο της επιχείρησης, τις ομαδοποιεί ως πλαίσιο μαζί με το αίτημα του χρήστη ως προτροπή και στη συνέχεια τις στέλνει στο LLM για να λάβει απάντηση. Τα LLM έχουν περιορισμούς σχετικά με τον μέγιστο αριθμό λέξεων για τα μηνύματα εισαγωγής, επομένως η επιλογή των σωστών αποσπασμάτων μεταξύ χιλιάδων ή εκατομμυρίων εγγράφων στην επιχείρηση έχει άμεσο αντίκτυπο στην ακρίβεια του LLM.

Η τεχνική RAG έχει γίνει όλο και πιο σημαντική στην αναζήτηση επιχειρήσεων. Σε αυτήν την ανάρτηση, δείχνουμε μια ροή εργασιών που εκμεταλλεύεται το SageMaker JumpStart για την ανάπτυξη ενός μοντέλου οδηγιών Falcon-40b και χρησιμοποιεί το Haystack για να σχεδιάσει και να εκτελέσει μια διοχέτευση επαυξημένης απάντησης ερωτήσεων ανάκτησης. Η ροή εργασιών αύξησης της τελικής ανάκτησης καλύπτει τα ακόλουθα βήματα υψηλού επιπέδου:

- Το ερώτημα χρήστη χρησιμοποιείται για ένα στοιχείο ανάκτησης, το οποίο κάνει μια διανυσματική αναζήτηση, για να ανακτήσει το πιο σχετικό περιβάλλον από τη βάση δεδομένων μας.

- Αυτό το πλαίσιο είναι ενσωματωμένο σε μια προτροπή που έχει σχεδιαστεί για να δώσει εντολή σε ένα LLM να δημιουργήσει μια απάντηση μόνο από το παρεχόμενο πλαίσιο.

- Το LLM δημιουργεί μια απάντηση στο αρχικό ερώτημα λαμβάνοντας υπόψη μόνο το περιβάλλον που είναι ενσωματωμένο στην προτροπή που έλαβε.

SageMaker JumpStart

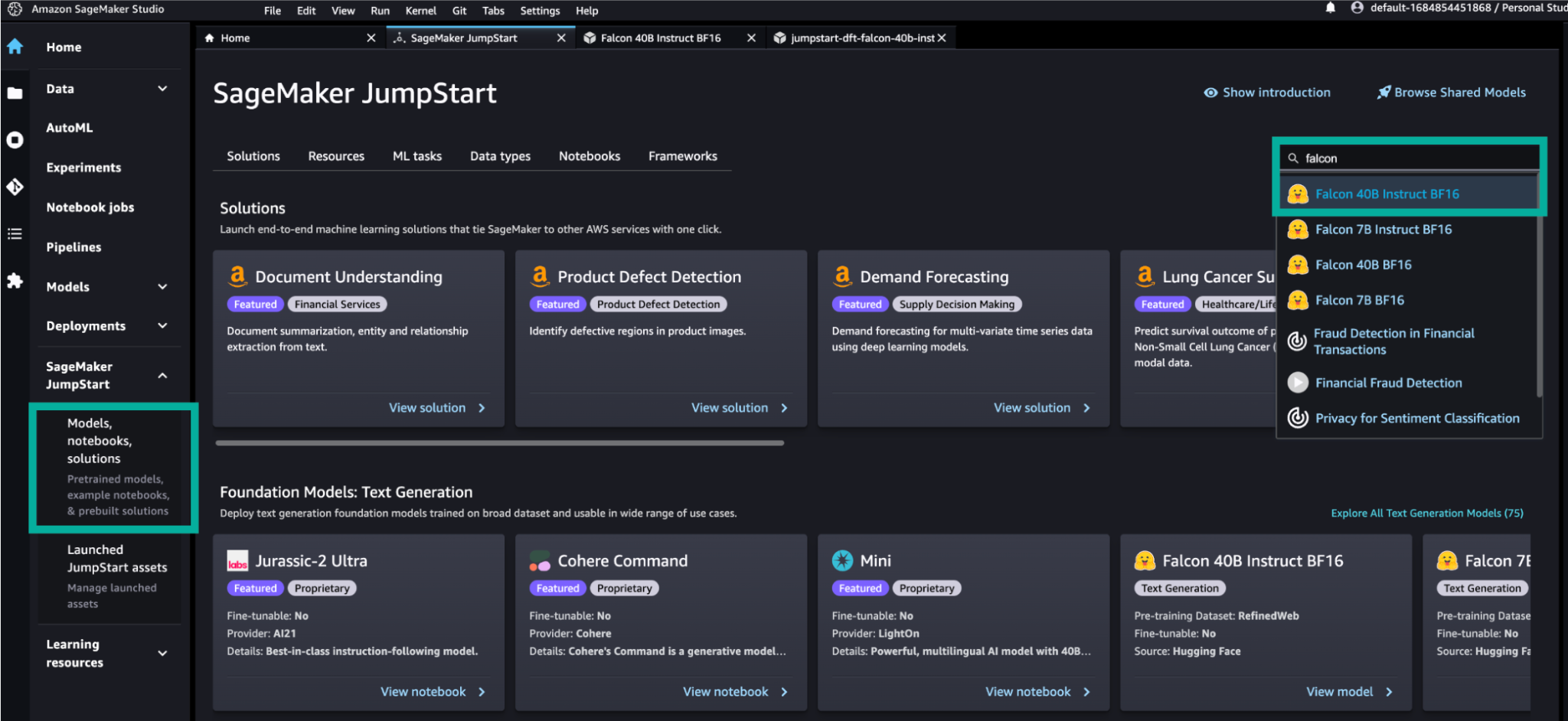

Το SageMaker JumpStart χρησιμεύει ως κόμβος μοντέλων που περικλείει ένα ευρύ φάσμα μοντέλων βαθιάς εκμάθησης για περιπτώσεις χρήσης κειμένου, όρασης, ήχου και ενσωμάτωσης. Με περισσότερα από 500 μοντέλα, ο κόμβος μοντέλων του περιλαμβάνει τόσο δημόσια όσο και ιδιόκτητα μοντέλα από συνεργάτες της AWS όπως AI21, Stability AI, Cohere και LightOn. Φιλοξενεί επίσης μοντέλα θεμελίωσης που έχουν αναπτυχθεί αποκλειστικά από την Amazon, όπως το AlexaTM. Μερικά από τα μοντέλα προσφέρουν δυνατότητες για να τα προσαρμόσετε με τα δικά σας δεδομένα. Το SageMaker JumpStart παρέχει επίσης πρότυπα λύσεων που δημιουργούν υποδομές για περιπτώσεις κοινής χρήσης και εκτελέσιμα παραδείγματα σημειωματάρια για μηχανική μάθηση (ML) με το SageMaker.

Σιτάρι

Σιτάρι είναι ένα πλαίσιο ανοιχτού κώδικα από το deepset που επιτρέπει στους προγραμματιστές να ενορχηστρώνουν εφαρμογές LLM που αποτελούνται από διαφορετικά στοιχεία όπως μοντέλα, διανυσματικά DB, μετατροπείς αρχείων και αμέτρητες άλλες ενότητες. Η θημωνιά παρέχει αγωγών και Πράκτορες, δύο ισχυρές δομές για το σχεδιασμό εφαρμογών LLM για διάφορες περιπτώσεις χρήσης, όπως η αναζήτηση, η απάντηση σε ερωτήσεις και η τεχνητή νοημοσύνη συνομιλίας. Με μεγάλη εστίαση σε μεθόδους ανάκτησης αιχμής και σταθερές μετρήσεις αξιολόγησης, σας παρέχει όλα όσα χρειάζεστε για να στείλετε μια αξιόπιστη, αξιόπιστη εφαρμογή. Μπορείτε να σειριοποιήσετε αγωγούς σε Αρχεία YAML, εκθέστε τους μέσω α REST APIκαι κλιμακώστε τα με ευελιξία ανάλογα με τον φόρτο εργασίας σας, διευκολύνοντας τη μεταφορά της εφαρμογής σας από το στάδιο του πρωτοτύπου στην παραγωγή.

Amazon OpenSearch

Η Υπηρεσία OpenSearch είναι μια πλήρως διαχειριζόμενη υπηρεσία που διευκολύνει την ανάπτυξη, την κλίμακα και τη λειτουργία του OpenSearch στο AWS Cloud. Το OpenSearch είναι μια επεκτάσιμη, ευέλικτη και επεκτάσιμη σουίτα λογισμικού ανοιχτού κώδικα για εφαρμογές αναζήτησης, αναλυτικών στοιχείων, παρακολούθησης ασφάλειας και παρατηρησιμότητας, με άδεια χρήσης βάσει της άδειας Apache 2.0.

Τα τελευταία χρόνια, οι τεχνικές ML έχουν γίνει όλο και πιο δημοφιλείς για τη βελτίωση της αναζήτησης. Μεταξύ αυτών είναι η χρήση του μοντέλα ενσωμάτωσης, ένας τύπος μοντέλου που μπορεί να κωδικοποιήσει ένα μεγάλο σώμα δεδομένων σε ένα χώρο ν-διάστατων όπου κάθε οντότητα κωδικοποιείται σε ένα διάνυσμα, ένα σημείο δεδομένων σε αυτόν τον χώρο και οργανωμένο έτσι ώστε παρόμοιες οντότητες να είναι πιο κοντά μεταξύ τους. Μια διανυσματική βάση δεδομένων παρέχει αποτελεσματική αναζήτηση ομοιότητας διανυσμάτων παρέχοντας εξειδικευμένα ευρετήρια όπως ευρετήρια k-NN.

Με τις δυνατότητες διανυσματικής βάσης δεδομένων του OpenSearch Service, μπορείτε να εφαρμόσετε σημασιολογική αναζήτηση, RAG με LLM, μηχανές προτάσεων και εμπλουτισμένα μέσα αναζήτησης. Σε αυτήν την ανάρτηση, χρησιμοποιούμε το RAG για να μας επιτρέψει να συμπληρώσουμε τα γενετικά LLM με μια εξωτερική βάση γνώσεων που συνήθως δημιουργείται χρησιμοποιώντας μια διανυσματική βάση δεδομένων ενυδατωμένη με άρθρα γνώσης που κωδικοποιούνται με διανύσματα.

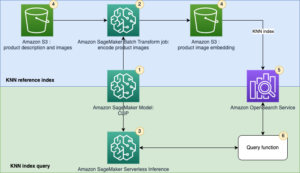

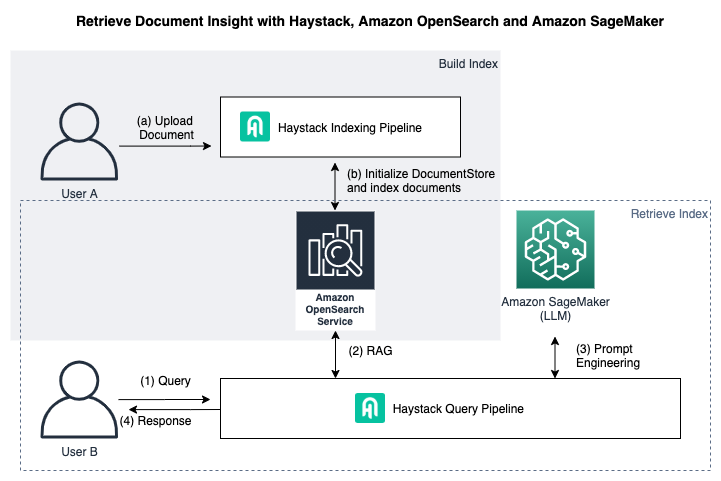

Επισκόπηση εφαρμογής

Το παρακάτω διάγραμμα απεικονίζει τη δομή της τελικής εφαρμογής.

Σε αυτήν την εφαρμογή, χρησιμοποιούμε το Haystack Indexing Pipeline για τη διαχείριση των μεταφορτωμένων εγγράφων και των εγγράφων ευρετηρίου και το Haystack Query Pipeline για την ανάκτηση γνώσεων από έγγραφα με ευρετήριο.

Το Haystack Indexing Pipeline περιλαμβάνει τα ακόλουθα βήματα υψηλού επιπέδου:

- Ανεβάστε ένα έγγραφο.

- αρχικοποίηση

DocumentStoreκαι ευρετήρια εγγράφων.

Χρησιμοποιούμε το OpenSearch ως δικό μας DocumentStore και μια θημωνιά αγωγός ευρετηρίασης για προεπεξεργασία και ευρετηρίαση των αρχείων μας στο OpenSearch. θημωνιά Μετατροπείς αρχείων και Προεπεξεργαστής σας επιτρέπει να καθαρίζετε και να προετοιμάζετε τα ακατέργαστα αρχεία σας ώστε να είναι σε σχήμα και μορφή που μπορεί να αντιμετωπίσει η διοχέτευση επεξεργασίας φυσικής γλώσσας (NLP) και το μοντέλο γλώσσας της επιλογής σας. Ο αγωγός ευρετηρίασης που χρησιμοποιήσαμε εδώ χρησιμοποιεί επίσης sentence-transformers/all-MiniLM-L12-v2 για να δημιουργήσουμε ενσωματώσεις για κάθε έγγραφο, τις οποίες χρησιμοποιούμε για αποτελεσματική ανάκτηση.

Το Haystack Query Pipeline περιλαμβάνει τα ακόλουθα βήματα υψηλού επιπέδου:

- Στέλνουμε ένα ερώτημα στον αγωγό RAG.

- An EmbeddingRetriever συστατικό λειτουργεί ως φίλτρο που ανακτά τα πιο σχετικά

top_kέγγραφα από τα ευρετηριασμένα έγγραφά μας στο OpenSearch. Χρησιμοποιούμε την επιλογή του μοντέλου ενσωμάτωσης για να ενσωματώσουμε τόσο το ερώτημα όσο και τα έγγραφα (κατά την ευρετηρίαση) για να το πετύχουμε αυτό. - Τα έγγραφα που ανακτήθηκαν είναι ενσωματωμένα στην προτροπή μας για το μοντέλο Falcon-40b-instruct.

- Το LLM επιστρέφει με μια απάντηση που βασίζεται στα ανακτημένα έγγραφα.

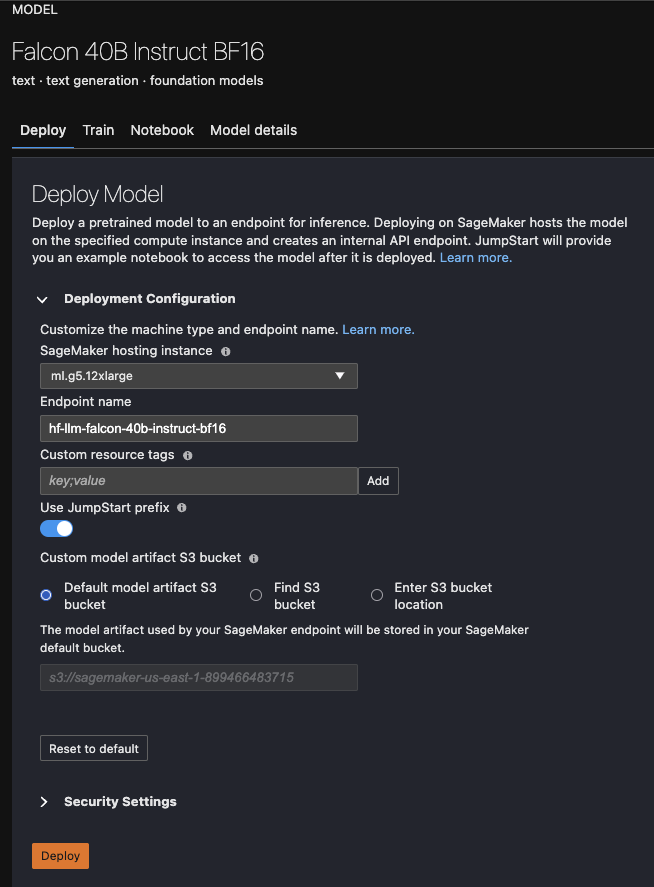

Για την ανάπτυξη μοντέλων, χρησιμοποιούμε το SageMaker JumpStart, το οποίο απλοποιεί την ανάπτυξη μοντέλων με ένα απλό πάτημα ενός κουμπιού. Αν και χρησιμοποιήσαμε και δοκιμάσαμε την οδηγία Falcon-40b για αυτό το παράδειγμα, μπορείτε να χρησιμοποιήσετε οποιοδήποτε μοντέλο Hugging Face που είναι διαθέσιμο στο SageMaker.

Η τελική λύση είναι διαθέσιμη στο θημωνιά-φασκόμηλος αποθετήριο και χρησιμοποιεί τον ιστότοπο και την τεκμηρίωση του OpenSearch (για το OpenSearch 2.7) ως παράδειγμα δεδομένων μας για να εκτελέσει την ανάκτηση επαυξημένης απάντησης ερωτήσεων.

Προϋποθέσεις

Το πρώτο πράγμα που πρέπει να κάνουμε προτού μπορέσουμε να χρησιμοποιήσουμε οποιαδήποτε υπηρεσία AWS είναι να βεβαιωθούμε ότι έχουμε εγγραφεί και έχουμε δημιουργήσει έναν λογαριασμό AWS. Στη συνέχεια, θα πρέπει να δημιουργήσετε έναν διαχειριστή χρήστη και ομάδα. Για οδηγίες και για τα δύο βήματα, ανατρέξτε στο Ρυθμίστε τις προϋποθέσεις του Amazon SageMaker.

Για να μπορείτε να χρησιμοποιήσετε το Haystack, θα πρέπει να εγκαταστήσετε το farm-haystack πακέτο με τις απαιτούμενες εξαρτήσεις. Για να το πετύχετε αυτό, χρησιμοποιήστε το requirements.txt αρχείο στο Αποθετήριο GitHub τρέχοντας pip install requirements.txt.

Ευρετηρίαση εγγράφων στο OpenSearch

Το Haystack προσφέρει έναν αριθμό συνδέσεων σε βάσεις δεδομένων, οι οποίες καλούνται DocumentStores. Για αυτήν τη ροή εργασίας RAG, χρησιμοποιούμε το OpenSearchDocumentStore. Το παράδειγμα Αποθήκη περιλαμβάνει έναν αγωγό ευρετηρίασης και AWS CloudFormation πρότυπο να στήσει ένα OpenSearchDocumentStore με έγγραφα που ανιχνεύονται από τον ιστότοπο του OpenSearch και τις σελίδες τεκμηρίωσης.

Συχνά, για να λειτουργήσει μια εφαρμογή NLP για περιπτώσεις χρήσης παραγωγής, καταλήγουμε να σκεφτόμαστε την προετοιμασία και τον καθαρισμό δεδομένων. Αυτό καλύπτεται με Αγωγοί ευρετηρίασης άχυρων, που σας επιτρέπει να σχεδιάσετε τα δικά σας βήματα προετοιμασίας δεδομένων, τα οποία τελικά εγγράφουν τα έγγραφά σας στη βάση δεδομένων της επιλογής σας.

Μια διοχέτευση ευρετηρίου μπορεί επίσης να περιλαμβάνει ένα βήμα για τη δημιουργία ενσωματώσεων για τα έγγραφά σας. Αυτό είναι πολύ σημαντικό για το βήμα ανάκτησης. Στο παράδειγμά μας, χρησιμοποιούμε πρόταση-μετασχηματιστές/όλα-MiniLM-L12-v2 ως μοντέλο ενσωμάτωσης. Αυτό το μοντέλο χρησιμοποιείται για τη δημιουργία ενσωματώσεων για όλα τα ευρετηριασμένα έγγραφά μας, αλλά και για το ερώτημα του χρήστη τη στιγμή του ερωτήματος.

Για την ευρετηρίαση εγγράφων στο OpenSearchDocumentStore, παρέχουμε δύο επιλογές με λεπτομερείς οδηγίες στο README του αποθετηρίου παραδειγμάτων. Εδώ, ακολουθούμε τα βήματα για την ευρετηρίαση σε μια υπηρεσία OpenSearch που αναπτύσσεται στο AWS.

Ξεκινήστε μια υπηρεσία OpenSearch

Χρησιμοποιήστε το παρεχόμενο Πρότυπο CloudFormation για να ρυθμίσετε μια υπηρεσία OpenSearch στο AWS. Εκτελώντας την ακόλουθη εντολή, θα έχετε μια κενή υπηρεσία OpenSearch. Στη συνέχεια, μπορείτε είτε να επιλέξετε την ευρετηρίαση των παραδειγμάτων δεδομένων που έχουμε παράσχει είτε να χρησιμοποιήσετε τα δικά σας δεδομένα, τα οποία μπορείτε να καθαρίσετε και να προεπεξεργαστείτε χρησιμοποιώντας το Haystack Indexing Pipeline. Σημειώστε ότι αυτό δημιουργεί ένα στιγμιότυπο που είναι ανοιχτό στο διαδίκτυο, το οποίο δεν συνιστάται για χρήση παραγωγής.

Αφήστε περίπου 30 λεπτά για να ολοκληρωθεί η εκκίνηση της στοίβας. Μπορείτε να ελέγξετε την πρόοδό του στην κονσόλα AWS CloudFormation μεταβαίνοντας στο Στοίβες σελίδα και αναζητήστε τη στοίβα με το όνομα HaystackOpensearch.

Ευρετηριάστε έγγραφα στο OpenSearch

Τώρα που έχουμε μια υπηρεσία OpenSearch που εκτελείται, μπορούμε να χρησιμοποιήσουμε την κλάση OpenSearchDocumentStore για να συνδεθούμε σε αυτήν και να γράψουμε τα έγγραφά μας σε αυτήν.

Για να λάβετε το όνομα κεντρικού υπολογιστή για το OpenSearch, εκτελέστε την ακόλουθη εντολή:

Αρχικά, εξάγετε τα ακόλουθα:

Στη συνέχεια, μπορείτε να χρησιμοποιήσετε το opensearch_indexing_pipeline.py σενάριο για προεπεξεργασία και ευρετηρίαση των παρεχόμενων δεδομένων επίδειξης.

Εάν θέλετε να χρησιμοποιήσετε τα δικά σας δεδομένα, τροποποιήστε τη διοχέτευση ευρετηρίου opensearch_indexing_pipeline.py να συμπεριλάβει το FileConverter και Προεπεξεργαστής βήματα εγκατάστασης που χρειάζεστε.

Εφαρμόστε τον αγωγό ανάκτησης επαυξημένης απάντησης ερωτήσεων

Τώρα που έχουμε ευρετηριάσει δεδομένα στο OpenSearch, μπορούμε να απαντήσουμε σε ερωτήσεις σε αυτά τα έγγραφα. Για αυτόν τον αγωγό RAG, χρησιμοποιούμε το μοντέλο Falcon-40b-instruct που έχουμε αναπτύξει στο SageMaker JumpStart.

Έχετε επίσης την επιλογή να αναπτύξετε το μοντέλο μέσω προγραμματισμού από ένα σημειωματάριο Jupyter. Για οδηγίες, ανατρέξτε στο GitHub repo.

- Αναζητήστε το μοντέλο Falcon-40b-instruct στο SageMaker JumpStart.

- Αναπτύξτε το μοντέλο σας στο SageMaker JumpStart και σημειώστε το όνομα του τελικού σημείου.

- Εξαγάγετε τις ακόλουθες τιμές:

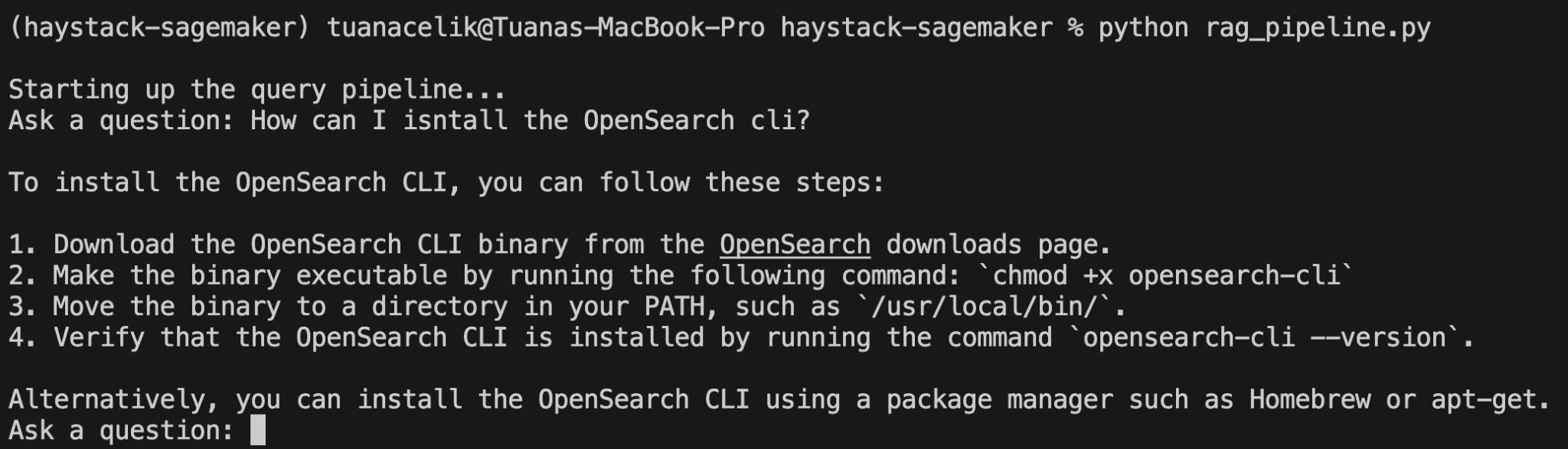

- τρέξιμο

python rag_pipeline.py.

Αυτό θα ξεκινήσει ένα βοηθητικό πρόγραμμα γραμμής εντολών που περιμένει την ερώτηση ενός χρήστη. Για παράδειγμα, ας ρωτήσουμε "Πώς μπορώ να εγκαταστήσω το cli OpenSearch;"

Αυτό το αποτέλεσμα επιτυγχάνεται επειδή έχουμε ορίσει την προτροπή μας στο Πρότυπο προτροπής για άχυρα να είναι το εξής:

Περαιτέρω προσαρμογές

Μπορείτε να κάνετε πρόσθετες προσαρμογές σε διαφορετικά στοιχεία της λύσης, όπως τα ακόλουθα:

- Τα δεδομένα – Παρέχουμε το OpenSearch τεκμηρίωση και δεδομένα ως παραδείγματα δεδομένων. Θυμηθείτε να τροποποιήσετε το

opensearch_indexing_pipeline.pyσενάριο για να ταιριάζει στις ανάγκες σας εάν επιλέξετε να χρησιμοποιήσετε τα δικά σας δεδομένα. - Το μοντέλο – Σε αυτό το παράδειγμα, χρησιμοποιήσαμε το μοντέλο Falcon-40b-instruct. Είστε ελεύθεροι να αναπτύξετε και να χρησιμοποιήσετε οποιοδήποτε άλλο μοντέλο Hugging Face στο SageMaker. Σημειώστε ότι η αλλαγή ενός μοντέλου πιθανότατα σημαίνει ότι θα πρέπει να προσαρμόσετε την προτροπή σας σε κάτι που έχει σχεδιαστεί να χειρίζεται.

- η προτροπή – Για αυτήν την ανάρτηση, δημιουργήσαμε τη δική μας

PromptTemplateπου καθοδηγεί το μοντέλο να απαντήσει σε ερωτήσεις με βάση το παρεχόμενο πλαίσιο και να απαντήσει "Δεν ξέρω" εάν το πλαίσιο δεν περιλαμβάνει σχετικές πληροφορίες. Μπορείτε να αλλάξετε αυτήν την προτροπή για να πειραματιστείτε με διαφορετικές προτροπές με το Falcon-40b-instruct. Μπορείτε επίσης απλά να τραβήξετε μερικές από τις προτροπές μας από το PromptHub. - Το μοντέλο ενσωμάτωσης – Για το βήμα ανάκτησης, χρησιμοποιούμε ένα ελαφρύ μοντέλο ενσωμάτωσης: πρόταση-μετασχηματιστές/όλα-MiniLM-L12-v2. Ωστόσο, μπορείτε επίσης να το αλλάξετε στις ανάγκες σας. Θυμηθείτε να τροποποιήσετε τις αναμενόμενες διαστάσεις ενσωμάτωσης στο δικό σας

DocumentStoreαναλόγως. - Ο αριθμός των ανακτημένων εγγράφων – Μπορείτε επίσης να επιλέξετε να παίξετε με τον αριθμό των εγγράφων που ζητάτε

EmbeddingRetrieverγια ανάκτηση για κάθε ερώτημα. Στις ρυθμίσεις μας, αυτό έχει οριστεί σε top_k=5. Μπορείτε να πειραματιστείτε με την αλλαγή αυτού του αριθμού για να δείτε εάν η παροχή περισσότερων πλαισίου βελτιώνει την ακρίβεια των αποτελεσμάτων σας.

Ετοιμότητα παραγωγής

Η προτεινόμενη λύση σε αυτήν την ανάρτηση μπορεί να επιταχύνει τον χρόνο έως την αξία της διαδικασίας ανάπτυξης του έργου. Μπορείτε να δημιουργήσετε ένα έργο που είναι εύκολο να κλιμακωθεί με το περιβάλλον ασφάλειας και απορρήτου στο AWS Cloud.

Για ασφάλεια και απόρρητο, η Υπηρεσία OpenSearch παρέχει προστασία δεδομένων με διαχείριση ταυτότητας και πρόσβασης και πρόληψη σύγχυσης μεσολάβησης μεταξύ υπηρεσιών. Μπορείτε να χρησιμοποιήσετε λεπτομερή έλεγχο πρόσβασης χρήστη, έτσι ώστε ο χρήστης να έχει πρόσβαση μόνο στα δεδομένα στα οποία έχει εξουσιοδότηση πρόσβασης. Επιπλέον, το SageMaker παρέχει παραμετροποιήσιμες ρυθμίσεις ασφαλείας για έλεγχο πρόσβασης, την προστασία των δεδομένων, να καταγραφή και παρακολούθηση. Μπορείτε να προστατεύσετε τα δεδομένα σας σε κατάσταση ηρεμίας και κατά τη μεταφορά με Υπηρεσία διαχείρισης κλειδιών AWS πλήκτρα (AWS KMS). Μπορείτε επίσης να παρακολουθείτε το αρχείο καταγραφής ανάπτυξης του μοντέλου SageMaker ή την πρόσβαση στο τελικό σημείο χρησιμοποιώντας amazoncloudwatch. Για περισσότερες πληροφορίες, ανατρέξτε στο Παρακολουθήστε το Amazon SageMaker με το Amazon CloudWatch.

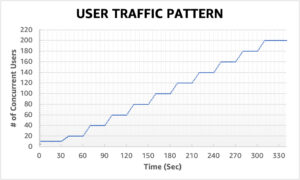

Για την υψηλή επεκτασιμότητα στην Υπηρεσία OpenSearch, μπορείτε να την προσαρμόσετε κατά το μέγεθος των τομέων της Υπηρεσίας OpenSearch και την απασχόληση λειτουργικές βέλτιστες πρακτικές. Μπορείτε επίσης να επωφεληθείτε από την αυτόματη κλιμάκωση του τελικού σημείου του SageMaker — μπορείτε αυτόματη κλίμακα μοντέλων SageMaker για να προσαρμόσετε το τελικό σημείο τόσο όταν αυξάνεται η επισκεψιμότητα ή όταν δεν χρησιμοποιούνται οι πόροι.

εκκαθάριση

Για να εξοικονομήσετε κόστος, διαγράψτε όλους τους πόρους που χρησιμοποιήσατε ως μέρος αυτής της ανάρτησης. Εάν ξεκινήσατε τη στοίβα CloudFormation, μπορείτε να τη διαγράψετε μέσω της κονσόλας AWS CloudFormation. Ομοίως, μπορείτε να διαγράψετε τυχόν τελικά σημεία του SageMaker που έχετε δημιουργήσει μέσω της κονσόλας SageMaker.

Συμπέρασμα

Σε αυτήν την ανάρτηση, παρουσιάσαμε πώς να δημιουργήσετε μια εφαρμογή τεχνητής νοημοσύνης από άκρο σε άκρο για επιχειρηματική αναζήτηση με το RAG χρησιμοποιώντας αγωγούς Haystack και το μοντέλο οδηγιών Falcon-40b από το SageMaker JumpStart και το OpenSearch Service. Η προσέγγιση RAG είναι κρίσιμης σημασίας στην αναζήτηση της επιχείρησης, επειδή διασφαλίζει ότι οι απαντήσεις που παράγονται είναι εντός τομέα και επομένως μετριάζουν τις παραισθήσεις. Χρησιμοποιώντας αγωγούς Haystack, είμαστε σε θέση να ενορχηστρώνουμε εφαρμογές LLM που αποτελούνται από διαφορετικά στοιχεία, όπως μοντέλα και διανυσματικές βάσεις δεδομένων. Το SageMaker JumpStart μας παρέχει μια λύση με ένα κλικ για την ανάπτυξη LLM και χρησιμοποιήσαμε την Υπηρεσία OpenSearch ως τη διανυσματική βάση δεδομένων για τα ευρετηριασμένα δεδομένα μας. Μπορείτε να αρχίσετε να πειραματίζεστε και να δημιουργείτε αποδείξεις RAG για τις εφαρμογές τεχνητής νοημοσύνης που δημιουργούνται στην επιχείρηση σας, χρησιμοποιώντας τα βήματα που περιγράφονται σε αυτήν την ανάρτηση και τον πηγαίο κώδικα που είναι διαθέσιμος στο Αποθετήριο GitHub.

Σχετικά με τους Συγγραφείς

Τουάνα Τσελίκ είναι η Lead Developer Advocate στο deepset, όπου εστιάζει στην κοινότητα ανοιχτού κώδικα για το Haystack. Διευθύνει τη λειτουργία σχέσεων προγραμματιστών και μιλά τακτικά σε εκδηλώσεις για το NLP και δημιουργεί εκπαιδευτικό υλικό για την κοινότητα.

Τουάνα Τσελίκ είναι η Lead Developer Advocate στο deepset, όπου εστιάζει στην κοινότητα ανοιχτού κώδικα για το Haystack. Διευθύνει τη λειτουργία σχέσεων προγραμματιστών και μιλά τακτικά σε εκδηλώσεις για το NLP και δημιουργεί εκπαιδευτικό υλικό για την κοινότητα.

Ρόι Αλέλα είναι Senior AI/ML Specialist Solutions Architect στην AWS με έδρα το Μόναχο της Γερμανίας. Ο Roy βοηθά τους πελάτες της AWS —από μικρές νεοφυείς επιχειρήσεις έως μεγάλες επιχειρήσεις— να εκπαιδεύουν και να αναπτύσσουν μεγάλα μοντέλα γλώσσας αποτελεσματικά στο AWS. Ο Roy είναι παθιασμένος με τα προβλήματα υπολογιστικής βελτιστοποίησης και τη βελτίωση της απόδοσης των φόρτων εργασίας AI.

Ρόι Αλέλα είναι Senior AI/ML Specialist Solutions Architect στην AWS με έδρα το Μόναχο της Γερμανίας. Ο Roy βοηθά τους πελάτες της AWS —από μικρές νεοφυείς επιχειρήσεις έως μεγάλες επιχειρήσεις— να εκπαιδεύουν και να αναπτύσσουν μεγάλα μοντέλα γλώσσας αποτελεσματικά στο AWS. Ο Roy είναι παθιασμένος με τα προβλήματα υπολογιστικής βελτιστοποίησης και τη βελτίωση της απόδοσης των φόρτων εργασίας AI.

Μία Τσανγκ είναι Αρχιτέκτονας ML Specialist Solutions για τις Υπηρεσίες Ιστού της Amazon. Συνεργάζεται με πελάτες στην EMEA και μοιράζεται τις βέλτιστες πρακτικές για την εκτέλεση φόρτου εργασίας AI/ML στο cloud με το υπόβαθρό της στα εφαρμοσμένα μαθηματικά, την επιστήμη των υπολογιστών και την AI/ML. Επικεντρώνεται σε συγκεκριμένους φόρτους εργασίας για το NLP και μοιράζεται την εμπειρία της ως ομιλήτρια συνεδρίων και συγγραφέας βιβλίων. Στον ελεύθερο χρόνο της, της αρέσει η πεζοπορία, τα επιτραπέζια παιχνίδια και η παρασκευή καφέ.

Μία Τσανγκ είναι Αρχιτέκτονας ML Specialist Solutions για τις Υπηρεσίες Ιστού της Amazon. Συνεργάζεται με πελάτες στην EMEA και μοιράζεται τις βέλτιστες πρακτικές για την εκτέλεση φόρτου εργασίας AI/ML στο cloud με το υπόβαθρό της στα εφαρμοσμένα μαθηματικά, την επιστήμη των υπολογιστών και την AI/ML. Επικεντρώνεται σε συγκεκριμένους φόρτους εργασίας για το NLP και μοιράζεται την εμπειρία της ως ομιλήτρια συνεδρίων και συγγραφέας βιβλίων. Στον ελεύθερο χρόνο της, της αρέσει η πεζοπορία, τα επιτραπέζια παιχνίδια και η παρασκευή καφέ.

Inaam Syed είναι αρχιτέκτονας λύσεων εκκίνησης στην AWS, με ιδιαίτερη έμφαση στην παροχή βοήθειας σε νεοφυείς επιχειρήσεις B2B και SaaS στην κλιμάκωση και την επίτευξη ανάπτυξης. Έχει ένα βαθύ πάθος για αρχιτεκτονικές χωρίς διακομιστές και AI/ML. Στον ελεύθερο χρόνο του, ο Inaam απολαμβάνει ποιοτικές στιγμές με την οικογένειά του και επιδίδεται στην αγάπη του για την ποδηλασία και το μπάντμιντον.

Inaam Syed είναι αρχιτέκτονας λύσεων εκκίνησης στην AWS, με ιδιαίτερη έμφαση στην παροχή βοήθειας σε νεοφυείς επιχειρήσεις B2B και SaaS στην κλιμάκωση και την επίτευξη ανάπτυξης. Έχει ένα βαθύ πάθος για αρχιτεκτονικές χωρίς διακομιστές και AI/ML. Στον ελεύθερο χρόνο του, ο Inaam απολαμβάνει ποιοτικές στιγμές με την οικογένειά του και επιδίδεται στην αγάπη του για την ποδηλασία και το μπάντμιντον.

Ντέιβιντ Τίπετ είναι ο Senior Developer Advocate που εργάζεται στο OpenSearch ανοιχτού κώδικα στο AWS. Η δουλειά του περιλαμβάνει όλους τους τομείς της OpenSearch από την αναζήτηση και τη συνάφεια έως την παρατηρησιμότητα και την ανάλυση ασφαλείας.

Ντέιβιντ Τίπετ είναι ο Senior Developer Advocate που εργάζεται στο OpenSearch ανοιχτού κώδικα στο AWS. Η δουλειά του περιλαμβάνει όλους τους τομείς της OpenSearch από την αναζήτηση και τη συνάφεια έως την παρατηρησιμότητα και την ανάλυση ασφαλείας.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Αυτοκίνητο / EVs, Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- PlatoHealth. Ευφυΐα βιοτεχνολογίας και κλινικών δοκιμών. Πρόσβαση εδώ.

- ChartPrime. Ανεβάστε το Trading Game σας με το ChartPrime. Πρόσβαση εδώ.

- BlockOffsets. Εκσυγχρονισμός της περιβαλλοντικής αντιστάθμισης ιδιοκτησίας. Πρόσβαση εδώ.

- πηγή: https://aws.amazon.com/blogs/machine-learning/build-production-ready-generative-ai-applications-for-enterprise-search-using-haystack-pipelines-and-amazon-sagemaker-jumpstart-with-llms/

- :έχει

- :είναι

- :δεν

- :που

- $UP

- 100

- 12

- 13

- 30

- 500

- 7

- 8

- a

- Ικανός

- Σχετικα

- επιταχύνουν

- πρόσβαση

- ολοκληρώσει

- αναλόγως

- Λογαριασμός

- ακρίβεια

- Κατορθώνω

- επιτευχθεί

- την επίτευξη

- πράξεις

- προσαρμόσει

- Πρόσθετος

- Επιπλέον

- διοικητικός

- Πλεονέκτημα

- έλευση

- συνήγορος

- AI

- AI / ML

- Όλα

- επιτρέπουν

- επιτρέπει

- κατά μήκος

- Επίσης

- Αν και

- Amazon

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon υπηρεσίες Web

- μεταξύ των

- an

- analytics

- και

- απάντηση

- κάθε

- Apache

- Εφαρμογή

- εφαρμογές

- εφαρμοσμένος

- πλησιάζω

- περίπου

- ΕΙΝΑΙ

- περιοχές

- γύρω

- Παράταξη

- Τέχνη

- εμπορεύματα

- AS

- βοηθώντας

- At

- ήχου

- επαυξημένης

- συγγραφέας

- εξουσιοδοτημένο

- αυτόματη

- διαθέσιμος

- AWS

- AWS CloudFormation

- B2B

- φόντο

- βάση

- βασίζονται

- BE

- επειδή

- γίνονται

- πριν

- είναι

- παρακάτω

- ΚΑΛΎΤΕΡΟΣ

- βέλτιστες πρακτικές

- Μεγάλος

- Μπλοκ

- επιτροπή

- Επιτραπέζια παιχνίδια

- σώμα

- βιβλίο

- και οι δύο

- ευρύς

- χτίζω

- Κτίριο

- χτισμένο

- δέσμες

- αλλά

- κουμπί

- by

- που ονομάζεται

- CAN

- δυνατότητες

- περιπτώσεις

- αλλαγή

- αλλαγή

- έλεγχος

- επιλογή

- Επιλέξτε

- επιλέγοντας

- επέλεξε

- τάξη

- Καθάρισμα

- πιο κοντά

- Backup

- κωδικός

- Καφές

- Κοινός

- κοινότητα

- εταίρα

- Συμπλήρωμα

- πλήρης

- συστατικό

- εξαρτήματα

- περιλαμβάνει

- υπολογιστή

- Πληροφορική

- έννοια

- Διάσκεψη

- συγχέεται

- Connect

- θεωρώντας

- πρόξενος

- που περιέχονται

- περιεχόμενο

- συμφραζόμενα

- έλεγχος

- ομιλητικός

- συνομιλία AI

- Δικαστικά έξοδα

- καλύπτονται

- Καλύμματα

- δημιουργία

- δημιουργήθηκε

- δημιουργεί

- κρίσιμης

- Πελάτες

- ημερομηνία

- Προετοιμασία δεδομένων

- την προστασία των δεδομένων

- βάση δεδομένων

- βάσεις δεδομένων

- DBS

- συμφωνία

- βαθύς

- βαθιά μάθηση

- ορίζεται

- διαδήλωση

- εξαρτήσεις

- παρατάσσω

- αναπτυχθεί

- ανάπτυξη

- ανάπτυξη

- Υπηρεσίες

- σχεδιασμένα

- σχέδιο

- λεπτομερής

- αναπτύχθηκε

- Εργολάβος

- προγραμματιστές

- Ανάπτυξη

- διαφορετικές

- ψηφιακό

- ψηφιοποίηση

- Διαστάσεις

- κατευθύνει

- do

- έγγραφο

- τεκμηρίωση

- έγγραφα

- κάνει

- Όχι

- Don

- Μην

- κάθε

- εύκολος

- αποδοτικότητα

- αποτελεσματικός

- αποτελεσματικά

- είτε

- στοιχεία

- embed

- ενσωματωμένο

- ενσωμάτωση

- ΕΜΕΑ

- ενεργοποιήσετε

- τέλος

- από άκρη σε άκρη

- Τελικό σημείο

- Κινητήρες

- ενίσχυση

- εξασφαλίζω

- εξασφαλίζει

- Εταιρεία

- οντότητες

- οντότητα

- Περιβάλλον

- εκτίμηση

- εκδηλώσεις

- πάντα

- παράδειγμα

- αναμένεται

- εμπειρία

- Δραστηριοτητες

- πείραμα

- εξαγωγή

- εξωτερικός

- Πρόσωπο

- οικογένεια

- Εικόνα

- Αρχεία

- Αρχεία

- φιλτράρισμα

- τελικός

- Όνομα

- ταιριάζουν

- εύκαμπτος

- εύκαμπτα

- Συγκέντρωση

- εστιάζει

- Εξής

- Για

- μορφή

- Θεμέλιο

- Πλαίσιο

- Δωρεάν

- από

- πλήρως

- λειτουργία

- Games

- παράγουν

- παράγεται

- δημιουργεί

- γενεά

- γενετική

- Παραγωγική τεχνητή νοημοσύνη

- Germany

- παίρνω

- δεδομένου

- Group

- Ανάπτυξη

- λαβή

- Έχω

- που έχει

- he

- βοηθά

- αυτήν

- εδώ

- Ψηλά

- υψηλού επιπέδου

- υψηλά

- του

- οικοδεσπότες

- Πως

- Πώς να

- Ωστόσο

- HTML

- http

- HTTPS

- Hub

- i

- Ταυτότητα

- if

- Επίπτωση

- εφαρμογή

- σημαντικό

- βελτίωση

- in

- περιλαμβάνουν

- περιλαμβάνει

- Συμπεριλαμβανομένου

- αυξημένη

- όλο και περισσότερο

- ευρετήριο

- ευρετήριο

- δείκτες

- πληροφορίες

- Υποδομή

- εισαγωγή

- εγκαθιστώ

- παράδειγμα

- οδηγίες

- Internet

- σε

- IT

- ΤΟΥ

- jpg

- Κλειδί

- πλήκτρα

- Ξέρω

- γνώση

- Διαχείριση γνώσης

- Γλώσσα

- large

- ξεκινήσει

- ξεκίνησε

- οδηγήσει

- Οδηγεί

- μάθηση

- Άδεια

- Άδεια

- πυγμάχος ελαφρού βάρους

- Μου αρέσει

- Πιθανός

- LIMIT

- περιορισμούς

- γραμμή

- LLM

- κούτσουρο

- ξύλευση

- κοιτάζοντας

- αγάπη

- μηχανή

- μάθηση μηχανής

- που

- κάνω

- ΚΑΝΕΙ

- Κατασκευή

- διαχείριση

- διαχειρίζεται

- διαχείριση

- υλικά

- μαθηματικά

- ανώτατο όριο

- Ενδέχεται..

- εννοώ

- Εικόνες / Βίντεο

- μέθοδοι

- Metrics

- εκατομμύρια

- Λεπτ.

- μετριασμός

- ML

- μοντέλο

- μοντέλα

- τροποποιήσει

- ενότητες

- Στιγμές

- παρακολούθηση

- περισσότερο

- πλέον

- μετακινήσετε

- όνομα

- Ονομάστηκε

- Φυσικό

- Επεξεργασία φυσικής γλώσσας

- πλοήγηση

- Ανάγκη

- ανάγκες

- nlp

- σημειωματάριο

- αριθμός

- of

- προσφορά

- προσφορές

- on

- αποκλειστικά

- ανοίξτε

- ανοικτού κώδικα

- Λογισμικό ανοικτού κώδικα

- λειτουργούν

- βελτιστοποίηση

- Επιλογή

- Επιλογές

- or

- οργανωτικός

- Οργανωμένος

- πρωτότυπο

- ΑΛΛΑ

- δικός μας

- σκιαγραφείται

- επί

- δική

- πακέτο

- σελίδα

- σελίδες

- μέρος

- Συνεργάτες

- πάθος

- παθιασμένος

- Εκτελέστε

- επίδοση

- αγωγού

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- Δοκιμάστε να παίξετε

- σας παρακαλούμε

- Σημείο

- Δημοφιλής

- Θέση

- ισχυρός

- πρακτικές

- προετοιμασία

- Προετοιμάστε

- μυστικότητα

- προβλήματα

- διαδικασια μας

- μεταποίηση

- παραγωγή

- Πρόοδος

- σχέδιο

- αποδείξεις

- προτείνεται

- ιδιόκτητο

- προστασία

- προστασία

- πρωτότυπο

- παρέχουν

- παρέχεται

- παρέχει

- χορήγηση

- πληρεξούσιο

- δημόσιο

- Σπρώξτε

- ποιότητα

- ερωτήματα

- ερώτηση

- Ερωτήσεις

- Ακατέργαστος

- έλαβε

- πρόσφατος

- Σύσταση

- συνιστάται

- τακτικά

- συγγένειες

- συνάφεια

- αξιόπιστος

- θυμάμαι

- Αποθήκη

- ζητήσει

- απαιτούν

- απαιτείται

- απαιτήσεις

- Υποστηρικτικό υλικό

- απάντησης

- απαντήσεις

- ΠΕΡΙΦΕΡΕΙΑ

- περιορίζω

- αποτέλεσμα

- Αποτελέσματα

- Επιστροφές

- Πλούσιος

- δεξιά

- Roy

- τρέξιμο

- τρέξιμο

- SaaS

- σοφός

- Αποθήκευση

- λένε

- Απεριόριστες δυνατότητες

- επεκτάσιμη

- Κλίμακα

- απολέπιση

- Επιστήμη

- Αναζήτηση

- ασφάλεια

- δείτε

- στείλετε

- αποστέλλει

- αρχαιότερος

- Χωρίς διακομιστή

- εξυπηρετεί

- υπηρεσία

- Υπηρεσίες

- σειρά

- ρυθμίσεις

- setup

- Shape

- Μερίδια

- αυτή

- ΠΛΟΙΟ

- θα πρέπει να

- δείχνουν

- βιτρίνα

- παρουσιάστηκε

- υπογραφεί

- παρόμοιες

- Ομοίως

- Απλούς

- απλά

- small

- So

- λογισμικό

- μόνο

- στέρεο

- λύση

- Λύσεις

- μερικοί

- κάτι

- Πηγή

- πρωτογενής κώδικας

- Χώρος

- Ομιλητής

- Μιλάει

- ειδικός

- ειδικευμένος

- σταθερότητα

- σωρός

- Στάδιο

- Εκκίνηση

- εκκίνηση

- Startups

- Βήμα

- Βήματα

- εναποθήκευση

- ισχυρός

- δομή

- τέτοιος

- σουίτα

- βέβαιος

- Πάρτε

- παίρνει

- τεχνικές

- πρότυπα

- δοκιμαστεί

- ότι

- Η

- Η Πηγη

- Τους

- τότε

- εκ τούτου

- επομένως

- Αυτοί

- αυτοί

- πράγμα

- νομίζω

- αυτό

- χιλιάδες

- Μέσω

- ώρα

- προς την

- μαζι

- τροχιά

- ΚΙΝΗΣΗ στους ΔΡΟΜΟΥΣ

- διαμετακόμιση

- αξιόπιστος

- δύο

- τύπος

- συνήθως

- τελικά

- υπό

- Φορτώθηκε

- us

- χρήση

- μεταχειρισμένος

- Χρήστες

- Χρήστες

- χρησιμοποιεί

- χρησιμοποιώντας

- χρησιμότητα

- αξία

- Αξίες

- διάφορα

- μέσω

- όραμα

- περιμένει

- we

- ιστός

- διαδικτυακές υπηρεσίες

- Ιστοσελίδα : www.example.gr

- πότε

- Ποιό

- θα

- με

- εντός

- λέξη

- Εργασία

- ροής εργασίας

- εργαζόμενος

- λειτουργεί

- θα

- γράφω

- γιαμ

- χρόνια

- Εσείς

- Σας

- zephyrnet