- Ιούνιος 30, 2014

- Βασίλης Βρυνιώτης

- . Χωρίς σχόλια

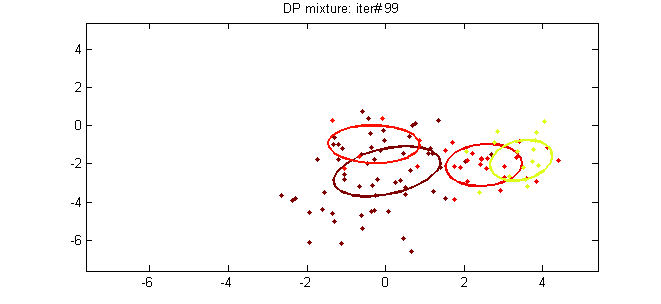

Αυτό το άρθρο είναι το πέμπτο μέρος του σεμιναρίου Ομαδοποίηση με DPMM. Στις προηγούμενες δημοσιεύσεις καλύψαμε λεπτομερώς το θεωρητικό υπόβαθρο της μεθόδου και περιγράψαμε τις μαθηματικές παραστάσεις της και τρόπους για την κατασκευή της. Σε αυτήν την ανάρτηση θα προσπαθήσουμε να συνδέσουμε τη θεωρία με την πρακτική, εισάγοντας δύο μοντέλα DPMM: το Dirichlet Multivariate Normal Mixture Model, το οποίο μπορεί να χρησιμοποιηθεί για την ομαδοποίηση δεδομένων Gaussian και το Dirichlet-Multinomial Mixture Model που χρησιμοποιείται για την ομαδοποίηση εγγράφων.

Ενημέρωση: Το Datumbox Machine Learning Framework είναι τώρα ανοιχτού κώδικα και δωρεάν κατεβάσετε. Ρίξτε μια ματιά στο πακέτο com.datumbox.framework.machinelearning.clustering για να δείτε την υλοποίηση Dirichlet Process Mixture Models στην Java.

1. Το μοντέλο Dirichlet Multivariate Normal Mixture

Το πρώτο μοντέλο μείγματος διεργασίας Dirichlet που θα εξετάσουμε είναι το Dirichlet Multivariate Normal Mixture Model που μπορεί να χρησιμοποιηθεί για την ομαδοποίηση σε συνεχή σύνολα δεδομένων. Το μοντέλο μείγματος ορίζεται ως εξής:

![]()

![]()

![]()

Εξίσωση 1: Μοντέλο Dirichlet Multivariate Normal Mixture

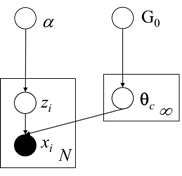

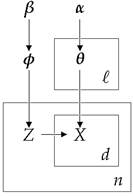

Όπως μπορούμε να δούμε παραπάνω, το συγκεκριμένο μοντέλο υποθέτει ότι η Γενετική Διανομή είναι η Πολυεθνική Gaussian Distribution και χρησιμοποιεί τη διαδικασία του Κινέζικου εστιατορίου ως προηγούμενη για τις αναθέσεις συμπλέγματος. Επιπλέον για τη βασική διανομή G0 χρησιμοποιεί το Normal-Inverse-Wishart πριν που είναι σύζευξη πριν Πολυμεταβλητής Κανονικής κατανομής με άγνωστο μέσο και συντεταγμένο πίνακα. Παρακάτω παρουσιάζουμε το Γραφικό Μοντέλο του μοντέλου μείγματος:

Σχήμα 1: Γραφικό μοντέλο του Dirichlet Multivariate Normal Mixture Model

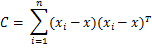

Όπως συζητήσαμε νωρίτερα, για να μπορέσουμε να εκτιμήσουμε τις αναθέσεις συμπλέγματος, θα χρησιμοποιήσουμε το Σύμπτυξη δειγματοληψίας Gibbs που απαιτεί την επιλογή του κατάλληλα συζευγμένα προγενέστερα. Επιπλέον, θα πρέπει να ενημερώσουμε τις παραμέτρους που δίνονται μεταγενέστερα το προηγούμενο και τα αποδεικτικά στοιχεία. Παρακάτω βλέπουμε το Εκτιμήσεις MAP των παραμέτρων για μία από τις συστάδες:

![]()

![]()

![]()

![]()

![]()

Εξίσωση 2: Εκτιμήσεις MAP σχετικά με τις παραμέτρους συμπλέγματος

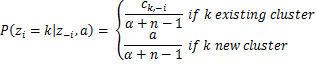

Όπου d είναι η διαστατικότητα των δεδομένων μας και ![]() είναι το μέσο δείγμα. Επιπλέον έχουμε αρκετές υπερπαραμέτρους του Normal-Inverse-Wishart όπως το μ0 που είναι ο αρχικός μέσος όρος, κ0 είναι το μέσο κλάσμα που λειτουργεί ως παράμετρο εξομάλυνσης, ν0 είναι οι βαθμοί ελευθερίας που ορίζονται στον αριθμό των διαστάσεων και Ψ0 είναι το προϊόν απόκλισης κατά ζεύγη που έχει ρυθμιστεί στον πίνακα ταυτότητας dxd πολλαπλασιασμένο με μια σταθερά. Από τώρα και στο εξής όλες οι προηγούμενες υπερπαραμέτρους του G0 θα συμβολίζεται με λ για απλοποίηση της σημειογραφίας. Τέλος, έχοντας όλα τα παραπάνω, μπορούμε να εκτιμήσουμε τις πιθανότητες που απαιτούνται από το Sampler Collapsed Gibbs. Η πιθανότητα παρατήρησης i να ανήκει στο σύμπλεγμα k λαμβάνοντας υπόψη τις αντιστοιχίσεις συμπλέγματος, το σύνολο δεδομένων και όλες τις υπερπαραμέτρους α και λ των DP και G0 δίνεται παρακάτω:

είναι το μέσο δείγμα. Επιπλέον έχουμε αρκετές υπερπαραμέτρους του Normal-Inverse-Wishart όπως το μ0 που είναι ο αρχικός μέσος όρος, κ0 είναι το μέσο κλάσμα που λειτουργεί ως παράμετρο εξομάλυνσης, ν0 είναι οι βαθμοί ελευθερίας που ορίζονται στον αριθμό των διαστάσεων και Ψ0 είναι το προϊόν απόκλισης κατά ζεύγη που έχει ρυθμιστεί στον πίνακα ταυτότητας dxd πολλαπλασιασμένο με μια σταθερά. Από τώρα και στο εξής όλες οι προηγούμενες υπερπαραμέτρους του G0 θα συμβολίζεται με λ για απλοποίηση της σημειογραφίας. Τέλος, έχοντας όλα τα παραπάνω, μπορούμε να εκτιμήσουμε τις πιθανότητες που απαιτούνται από το Sampler Collapsed Gibbs. Η πιθανότητα παρατήρησης i να ανήκει στο σύμπλεγμα k λαμβάνοντας υπόψη τις αντιστοιχίσεις συμπλέγματος, το σύνολο δεδομένων και όλες τις υπερπαραμέτρους α και λ των DP και G0 δίνεται παρακάτω:

![]()

![]()

Εξίσωση 3: Πιθανότητες που χρησιμοποιεί ο Gibbs Sampler για το MNMM

Όπου zi είναι η ανάθεση συμπλέγματος της παρατήρησης xi, Χ1: ν είναι το πλήρες σύνολο δεδομένων, z-i είναι το σύνολο των αντιστοιχίσεων συμπλέγματος χωρίς αυτό του ith παρατήρηση, x-i είναι το πλήρες σύνολο δεδομένων εκτός από το ith παρατήρηση, γk,-Εγώ είναι ο συνολικός αριθμός των παρατηρήσεων που έχουν ανατεθεί στο σύμπλεγμα k εκτός του ith παρατήρηση ενώ ![]() και

και ![]() είναι ο μέσος και ο πίνακας συνδιακύμανσης του συμπλέγματος k εκτός του ith παρατήρηση.

είναι ο μέσος και ο πίνακας συνδιακύμανσης του συμπλέγματος k εκτός του ith παρατήρηση.

2. Το μοντέλο Dirichlet-Multinomial Campuran

Το Dirichlet-Multinomial Mixture Model χρησιμοποιείται για την ανάλυση συστάδων εγγράφων. Το συγκεκριμένο μοντέλο έχει μια ελαφρώς πιο περίπλοκη ιεραρχία δεδομένου ότι μοντελοποιεί τα θέματα / κατηγορίες των εγγράφων, τις πιθανότητες λέξεων σε κάθε θέμα, τις αναθέσεις συμπλέγματος και τη γενετική διανομή των εγγράφων. Στόχος του είναι η εκτέλεση μη εποπτευόμενης μάθησης και ομαδοποίηση μιας λίστας εγγράφων με την ανάθεση τους σε ομάδες. Το μοντέλο μείγματος ορίζεται ως εξής:

![]()

![]()

![]()

![]()

Εξίσωση 4: Μοντέλο Dirichlet-Multinomial Mixture

Όπου φ μοντελοποιεί τις πιθανότητες θέματος, zi είναι ένας επιλογέας θέματος, θk είναι οι πιθανότητες λέξεων σε κάθε σύμπλεγμα και xεγώ, j αντιπροσωπεύει τις λέξεις του εγγράφου. Πρέπει να σημειώσουμε ότι αυτή η τεχνική χρησιμοποιεί το πλαίσιο τσάντα-λέξεων που αντιπροσωπεύει τα έγγραφα ως μια μη ταξινομημένη συλλογή λέξεων, αγνοώντας τη γραμματική και τη σειρά λέξεων. Αυτή η απλοποιημένη αναπαράσταση χρησιμοποιείται συνήθως στην επεξεργασία φυσικής γλώσσας και στην ανάκτηση πληροφοριών. Παρακάτω παρουσιάζουμε το Γραφικό Μοντέλο του μοντέλου μείγματος:

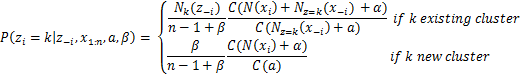

Σχήμα 2: Γραφικό μοντέλο του Dirichlet-Multinomial Mixture Model

Το συγκεκριμένο μοντέλο χρησιμοποιεί Πολυεθνική Διακριτή κατανομή για τη γενετική διανομή και τις διανομές Dirichlet για τα προηγούμενα. Το ℓ είναι το μέγεθος των ενεργών συστάδων μας, ο n ο συνολικός αριθμός εγγράφων, το β ελέγχει τον a priori αναμενόμενο αριθμό συστάδων ενώ το α ελέγχει τον αριθμό των λέξεων που έχουν εκχωρηθεί σε κάθε ομάδα. Για να εκτιμήσετε τις πιθανότητες που απαιτούνται από το Συμπτυγμένο δείγμα Gibbs χρησιμοποιούμε το μετά την εξίσωση:

![]()

Εξίσωση 5: Πιθανότητες που χρησιμοποιούνται από τον Gibbs Sampler για DMMM

Όπου Γ είναι η συνάρτηση γάμμα, zi είναι η εκχώρηση συμπλέγματος του εγγράφου xi, Χ1: ν είναι το πλήρες σύνολο δεδομένων, z-i είναι το σύνολο των αντιστοιχίσεων συμπλέγματος χωρίς αυτό του ith έγγραφο, x-i είναι το πλήρες σύνολο δεδομένων εκτός από το ith έγγραφο, Νk(z-i) είναι ο αριθμός των παρατηρήσεων που έχουν ανατεθεί στο σύμπλεγμα k εκτός του ith έγγραφο, Νz=k(x-i) είναι ένα διάνυσμα με το άθροισμα των μετρήσεων για κάθε λέξη για όλα τα έγγραφα που έχουν ανατεθεί στο σύμπλεγμα k εκτός από το ith έγγραφο και N (xi) είναι ο αραιός φορέας με τις μετρήσεις κάθε λέξης στο έγγραφο xi. Τέλος, όπως μπορούμε να δούμε παραπάνω, χρησιμοποιώντας το Collapsed Gibbs Sampler with the Chinese Restaurant Process the θjk μεταβλητή που αποθηκεύει την πιθανότητα της λέξης j στο θέμα k μπορεί να ενσωματωθεί.

- AI

- αι τέχνη

- ι γεννήτρια τέχνης

- ρομπότ ai

- τεχνητή νοημοσύνη

- πιστοποίηση τεχνητής νοημοσύνης

- ρομπότ τεχνητής νοημοσύνης

- ρομπότ τεχνητής νοημοσύνης

- λογισμικό τεχνητής νοημοσύνης

- blockchain

- συνέδριο blockchain ai

- Coingenius

- συνομιλητική τεχνητή νοημοσύνη

- κρυπτοσυνεδριο αι

- του νταλ

- Databox

- βαθιά μάθηση

- έχεις google

- μάθηση μηχανής

- Μηχανική εκμάθηση και στατιστικές

- Πλάτων

- πλάτων αι

- Πληροφορία δεδομένων Plato

- Παιχνίδι Πλάτωνας

- Πλάτωνα δεδομένα

- platogaming

- κλίμακα αι

- σύνταξη

- zephyrnet