Για να ευχαριστήσει τους πελάτες και να ελαχιστοποιήσει τα απόβλητα συσκευασίας, η Amazon πρέπει να επιλέξει τον βέλτιστο τύπο συσκευασίας για δισεκατομμύρια συσκευασίες που αποστέλλονται κάθε χρόνο. Εάν χρησιμοποιηθεί πολύ λίγη προστασία για ένα εύθραυστο αντικείμενο, όπως μια κούπα καφέ, το αντικείμενο θα φτάσει κατεστραμμένο και η Amazon διακινδυνεύει την εμπιστοσύνη των πελατών της. Η χρήση υπερβολικής προστασίας θα έχει ως αποτέλεσμα αυξημένο κόστος και υπερβολικούς γεμάτους κάδους ανακύκλωσης. Με εκατοντάδες εκατομμύρια διαθέσιμα προϊόντα, απαιτείται ένας επεκτάσιμος μηχανισμός λήψης αποφάσεων για να μαθαίνουμε συνεχώς από τις δοκιμές προϊόντων και τα σχόλια των πελατών.

Για να λύσει αυτά τα προβλήματα, η ομάδα Amazon Packaging Innovation ανέπτυξε μοντέλα μηχανικής εκμάθησης (ML) που ταξινομούν εάν τα προϊόντα είναι κατάλληλα για τύπους συσκευασίας Amazon, όπως ταχυδρομικά, τσάντες ή κιβώτια, ή ακόμη και να αποστέλλονται χωρίς πρόσθετη συσκευασία. Προηγουμένως, η ομάδα ανέπτυξε έναν προσαρμοσμένο αγωγό με βάση Λειτουργίες βημάτων AWS να εκτελεί εβδομαδιαία εκπαίδευση και ημερήσιες ή μηνιαίες εργασίες συμπερασμάτων. Ωστόσο, με την πάροδο του χρόνου ο αγωγός δεν παρείχε επαρκή ευελιξία για την κυκλοφορία μοντέλων με νέες αρχιτεκτονικές. Η ανάπτυξη για τους νέους αγωγούς παρουσίασε ένα γενικό κόστος και απαιτούσε συντονισμό μεταξύ των επιστημόνων δεδομένων και των προγραμματιστών. Για να ξεπεραστούν αυτές οι δυσκολίες και να βελτιωθεί η ταχύτητα ανάπτυξης νέων μοντέλων και αρχιτεκτονικών, η ομάδα επέλεξε να ενορχηστρώσει την εκπαίδευση μοντέλων και το συμπέρασμα με Αγωγοί Amazon SageMaker.

Σε αυτήν την ανάρτηση, συζητάμε την προηγούμενη αρχιτεκτονική ενορχήστρωσης με βάση τις Λειτουργίες Βήματος, περιγράφουμε τις αρχιτεκτονικές εκπαίδευσης και συμπερασμάτων χρησιμοποιώντας Pipelines και υπογραμμίζουμε την ευελιξία που πέτυχε η ομάδα της Amazon Packaging Innovation.

Οι προκλήσεις του πρώην αγωγού ML στο Amazon Packaging Innovation

Για την ενσωμάτωση συνεχών σχολίων σχετικά με την απόδοση των πακέτων, ένα νέο μοντέλο εκπαιδεύεται κάθε εβδομάδα χρησιμοποιώντας έναν αυξανόμενο αριθμό ετικετών. Το συμπέρασμα για ολόκληρο το απόθεμα των προϊόντων εκτελείται μηνιαίως και ένα ημερήσιο συμπέρασμα για την παροχή έγκαιρων προβλέψεων για το απόθεμα που προστέθηκε πρόσφατα.

Για να αυτοματοποιήσει τη διαδικασία εκπαίδευσης πολλαπλών μοντέλων και να παρέχει προβλέψεις, η ομάδα είχε αναπτύξει μια προσαρμοσμένη διοχέτευση βασισμένη στις Λειτουργίες Βήματος για να ενορχηστρώσει τα ακόλουθα βήματα:

- Προετοιμασία δεδομένων για εργασίες εκπαίδευσης και συμπερασμάτων και φόρτωση προβλέψεων στη βάση δεδομένων (Amazon RedShift) με Κόλλα AWS.

- Μοντέλο εκπαίδευσης και συμπερασμάτων με Amazon Sage Maker.

- Υπολογισμός μετρήσεων απόδοσης μοντέλου στο σύνολο επικύρωσης με Παρτίδα AWS.

- Χρησιμοποιώντας Amazon DynamoDB για την αποθήκευση διαμορφώσεων μοντέλων (όπως αναλογία διαχωρισμού δεδομένων για εκπαίδευση και επικύρωση, τοποθεσία τεχνουργήματος μοντέλου, τύπος μοντέλου και αριθμό παρουσιών για εκπαίδευση και συμπέρασμα), μετρήσεις απόδοσης μοντέλων και την τελευταία επιτυχώς εκπαιδευμένη έκδοση μοντέλου.

- Υπολογισμός των διαφορών στις βαθμολογίες απόδοσης του μοντέλου, αλλαγές στην κατανομή των εκπαιδευτικών ετικετών και σύγκριση του μεγέθους των δεδομένων εισόδου μεταξύ της προηγούμενης και της νέας έκδοσης μοντέλου με AWS Lambda λειτουργίες.

- Δεδομένου του μεγάλου αριθμού βημάτων, ο αγωγός απαιτούσε επίσης ένα αξιόπιστο σύστημα συναγερμού σε κάθε βήμα για να ειδοποιεί τους ενδιαφερόμενους για τυχόν ζητήματα. Αυτό επιτεύχθηκε μέσω ενός συνδυασμού των Υπηρεσία απλής ουράς Amazon (Amazon SQS) και Υπηρεσία απλών ειδοποιήσεων Amazon (Amazon SNS). Οι συναγερμοί δημιουργήθηκαν για να ειδοποιούν τα ενδιαφερόμενα μέρη της επιχείρησης, τους επιστήμονες δεδομένων και τους προγραμματιστές για τυχόν αποτυχημένα βήματα και μεγάλες αποκλίσεις στο μοντέλο και τις μετρήσεις δεδομένων.

Μετά τη χρήση αυτής της λύσης για σχεδόν 2 χρόνια, η ομάδα συνειδητοποίησε ότι αυτή η υλοποίηση λειτούργησε καλά μόνο για μια τυπική ροή εργασίας ML όπου ένα μεμονωμένο μοντέλο εκπαιδεύτηκε και βαθμολογήθηκε σε ένα σύνολο δεδομένων επικύρωσης. Ωστόσο, η λύση δεν ήταν αρκετά ευέλικτη για πολύπλοκα μοντέλα και δεν ήταν ανθεκτική σε αστοχίες. Για παράδειγμα, η αρχιτεκτονική δεν εξυπηρετούσε εύκολα τη διαδοχική εκπαίδευση μοντέλων. Ήταν δύσκολο να προσθέσετε ή να αφαιρέσετε ένα βήμα χωρίς να αντιγράψετε ολόκληρο τον αγωγό και να τροποποιήσετε την υποδομή. Ακόμη και απλές αλλαγές στα βήματα επεξεργασίας δεδομένων, όπως η προσαρμογή της αναλογίας διαχωρισμού δεδομένων ή η επιλογή διαφορετικού συνόλου χαρακτηριστικών απαιτούσαν συντονισμό τόσο από έναν επιστήμονα δεδομένων όσο και από έναν προγραμματιστή. Όταν ο αγωγός απέτυχε σε οποιοδήποτε βήμα, έπρεπε να επανεκκινηθεί από την αρχή, κάτι που είχε ως αποτέλεσμα επαναλαμβανόμενες εργασίες και αυξημένο κόστος. Για να αποφευχθούν οι επαναλαμβανόμενες εκτελέσεις και η επανεκκίνηση από το αποτυχημένο βήμα, η ομάδα θα δημιουργούσε ένα νέο αντίγραφο μιας μηχανής συντομευμένης κατάστασης. Αυτή η αντιμετώπιση προβλημάτων οδήγησε σε έναν πολλαπλασιασμό των κρατικών μηχανών, καθεμία από τις οποίες ξεκινούσε από τα συνήθως αποτυχημένα βήματα. Τέλος, εάν μια εργασία εκπαίδευσης αντιμετώπιζε απόκλιση στην κατανομή των ετικετών, στη βαθμολογία του μοντέλου ή στον αριθμό των ετικετών, ένας επιστήμονας δεδομένων έπρεπε να επανεξετάσει το μοντέλο και τις μετρήσεις του με μη αυτόματο τρόπο. Στη συνέχεια, ένας επιστήμονας δεδομένων θα είχε πρόσβαση σε έναν πίνακα DynamoDB με τις εκδόσεις του μοντέλου και θα ενημερώσει τον πίνακα για να διασφαλίσει ότι το σωστό μοντέλο χρησιμοποιήθηκε για την επόμενη εργασία συμπερασμάτων.

Η συντήρηση αυτής της αρχιτεκτονικής απαιτούσε τουλάχιστον έναν αποκλειστικό πόρο και έναν πρόσθετο πόρο πλήρους απασχόλησης για ανάπτυξη. Δεδομένων των δυσκολιών επέκτασης του αγωγού για την υποδοχή νέων περιπτώσεων χρήσης, οι επιστήμονες δεδομένων είχαν αρχίσει να αναπτύσσουν τις δικές τους ροές εργασίας, οι οποίες με τη σειρά τους οδήγησαν σε μια αυξανόμενη βάση κώδικα, πολλαπλούς πίνακες δεδομένων με παρόμοια σχήματα δεδομένων και αποκεντρωμένη παρακολούθηση μοντέλων. Η συσσώρευση αυτών των προβλημάτων είχε ως αποτέλεσμα χαμηλότερη παραγωγικότητα της ομάδας και αυξημένα έξοδα.

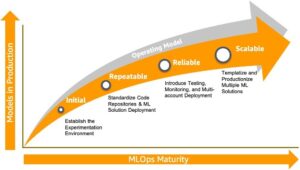

Για να αντιμετωπίσει αυτές τις προκλήσεις, η ομάδα της Amazon Packaging Innovation αξιολόγησε άλλες υπάρχουσες λύσεις για MLOps, συμπεριλαμβανομένων των SageMaker Pipelines (Ανακοίνωση κυκλοφορίας Δεκεμβρίου 2020). Το Pipelines είναι μια δυνατότητα του SageMaker για δημιουργία, διαχείριση, αυτοματοποίηση και κλιμάκωση ροών εργασιών ML από άκρο σε άκρο. Το Pipelines σάς επιτρέπει να μειώσετε τον αριθμό των βημάτων σε ολόκληρη τη ροή εργασίας ML και είναι αρκετά ευέλικτο ώστε να επιτρέπει στους επιστήμονες δεδομένων να ορίζουν μια προσαρμοσμένη ροή εργασίας ML. Φροντίζει για την παρακολούθηση και την καταγραφή των βημάτων. Έρχεται επίσης με ένα μητρώο μοντέλων που εκδίδει αυτόματα νέα μοντέλα. Το μητρώο μοντέλων έχει ενσωματωμένες ροές εργασιών έγκρισης για την επιλογή μοντέλων για συμπέρασμα στην παραγωγή. Το Pipelines επιτρέπει επίσης την προσωρινή αποθήκευση βημάτων που καλούνται με τα ίδια ορίσματα. Εάν βρεθεί μια προηγούμενη εκτέλεση, δημιουργείται μια προσωρινή μνήμη, η οποία επιτρέπει την εύκολη επανεκκίνηση αντί για τον επανυπολογισμό των βημάτων που ολοκληρώθηκαν με επιτυχία.

Στη διαδικασία αξιολόγησης, η Pipelines ξεχώρισε από τις άλλες λύσεις για την ευελιξία και τη διαθεσιμότητα λειτουργιών για την υποστήριξη και επέκταση των τρεχουσών και μελλοντικών ροών εργασίας. Η μετάβαση στο Pipelines απελευθέρωσε τον χρόνο των προγραμματιστών από τη συντήρηση και την αντιμετώπιση προβλημάτων της πλατφόρμας και ανακατεύθυνε την προσοχή προς την προσθήκη των νέων λειτουργιών. Σε αυτήν την ανάρτηση, παρουσιάζουμε τη σχεδίαση για ροές εργασίας εκπαίδευσης και συμπερασμάτων στην ομάδα καινοτομίας συσκευασίας του Amazon χρησιμοποιώντας Pipelines. Συζητάμε επίσης τα οφέλη και τη μείωση του κόστους που πραγματοποίησε η ομάδα με τη μετάβαση σε Pipelines.

Εκπαιδευτικός αγωγός

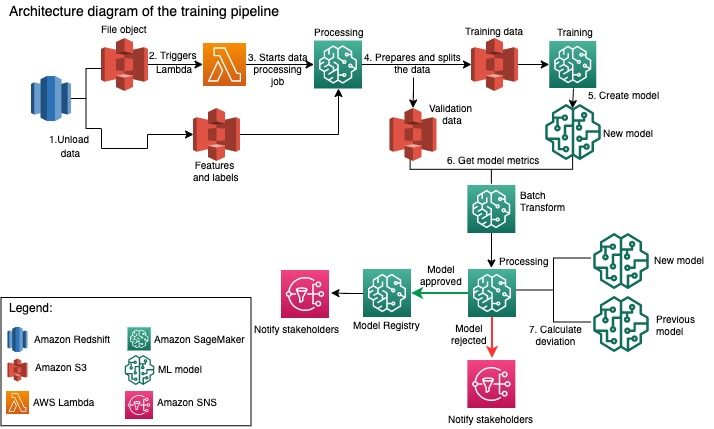

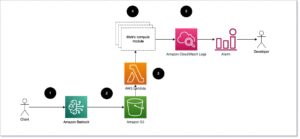

Η ομάδα της Amazon Packaging Innovation εκπαιδεύει μοντέλα για κάθε τύπο συσκευασίας χρησιμοποιώντας έναν αυξανόμενο αριθμό ετικετών. Το παρακάτω διάγραμμα περιγράφει την όλη διαδικασία.

Η ροή εργασίας ξεκινά με την εξαγωγή ετικετών και χαρακτηριστικών από μια βάση δεδομένων Redshift του Amazon και εκφόρτωση των δεδομένων σε Απλή υπηρεσία αποθήκευσης Amazon (Amazon S3) μέσω προγραμματισμένης εργασίας εξαγωγής, μετασχηματισμού και φόρτωσης (ETL). Μαζί με τα δεδομένα εισόδου, ένα αντικείμενο αρχείου με τον τύπο μοντέλου και τις παραμέτρους τοποθετείται στον κάδο S3. Αυτό το αρχείο χρησιμεύει ως έναυσμα διοχέτευσης μέσω μιας συνάρτησης Lambda.

Τα επόμενα βήματα είναι πλήρως προσαρμόσιμα και καθορίζονται εξ ολοκλήρου από έναν επιστήμονα δεδομένων που χρησιμοποιεί το SageMaker Python SDK for Pipelines. Στο σενάριο που παρουσιάζουμε σε αυτήν την ανάρτηση, τα δεδομένα εισόδου χωρίζονται σε σύνολα εκπαίδευσης και επικύρωσης και αποθηκεύονται ξανά σε έναν κάδο S3 ξεκινώντας μια εργασία Επεξεργασίας SageMaker.

Όταν τα δεδομένα είναι έτοιμα στο Amazon S3, ξεκινά μια εργασία εκπαίδευσης του SageMaker. Μετά την επιτυχή εκπαίδευση και δημιουργία του μοντέλου, το βήμα αξιολόγησης μοντέλου εκτελείται στα δεδομένα επικύρωσης μέσω μιας εργασίας μετασχηματισμού παρτίδας του SageMaker. Στη συνέχεια, οι μετρήσεις του μοντέλου συγκρίνονται με τις μετρήσεις του μοντέλου της προηγούμενης εβδομάδας χρησιμοποιώντας μια εργασία επεξεργασίας SageMaker. Η ομάδα έχει ορίσει πολλαπλά προσαρμοσμένα κριτήρια για την αξιολόγηση των αποκλίσεων στην απόδοση του μοντέλου. Το μοντέλο είτε απορρίπτεται είτε εγκρίνεται με βάση αυτά τα κριτήρια. Εάν το μοντέλο απορριφθεί, το προηγούμενο εγκεκριμένο μοντέλο χρησιμοποιείται για τις επόμενες εργασίες συμπερασμάτων. Εάν το μοντέλο εγκριθεί, η έκδοσή του καταχωρείται και αυτό το μοντέλο χρησιμοποιείται για εργασίες συμπερασμάτων. Οι ενδιαφερόμενοι λαμβάνουν ειδοποίηση για το αποτέλεσμα μέσω amazoncloudwatch συναγερμός.

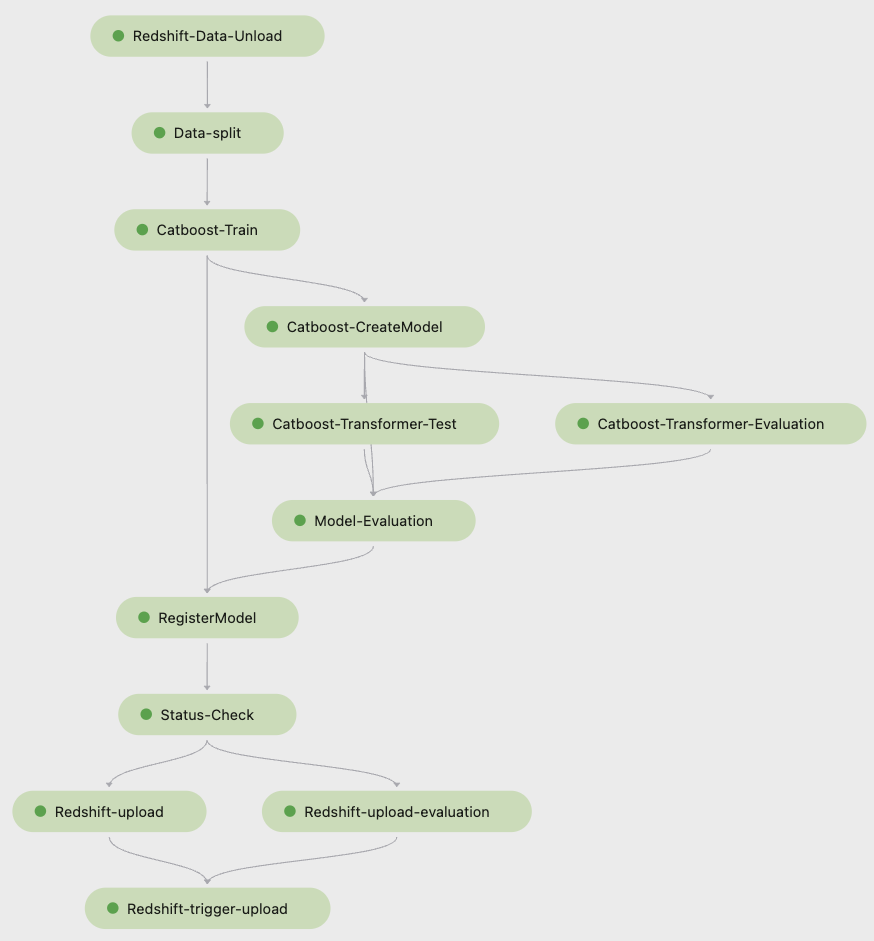

Το παρακάτω στιγμιότυπο οθόνης από Στούντιο Amazon SageMaker δείχνει τα βήματα του αγωγού εκπαίδευσης.

Το Pipelines παρακολουθεί κάθε εκτέλεση του αγωγού, το οποίο μπορείτε να παρακολουθείτε στο Studio. Εναλλακτικά, μπορείτε να ρωτήσετε την πρόοδο της εκτέλεσης χρησιμοποιώντας Boto3 ή η Διεπαφή γραμμής εντολών AWS (AWS CLI). Μπορείτε να οπτικοποιήσετε τις μετρήσεις του μοντέλου στο Studio και να συγκρίνετε διαφορετικές εκδόσεις μοντέλων.

Σωλήνας συμπερασμάτων

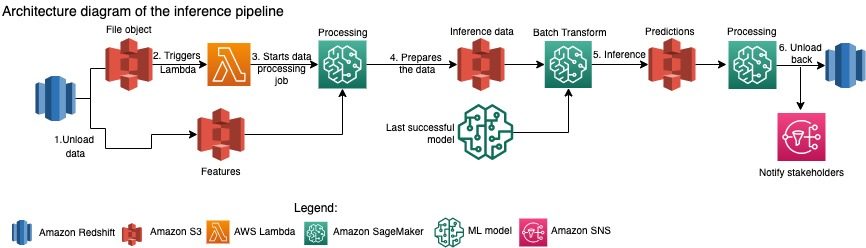

Η ομάδα της Amazon Packaging Innovation ανανεώνει τις προβλέψεις για ολόκληρο το απόθεμα προϊόντων κάθε μήνα. Δημιουργούνται ημερήσιες προβλέψεις για την παροχή έγκαιρων συσκευασιών για το νέο απόθεμα που προστέθηκε χρησιμοποιώντας το πιο πρόσφατο εκπαιδευμένο μοντέλο. Αυτό απαιτεί ο αγωγός συμπερασμάτων να εκτελείται καθημερινά με διαφορετικούς όγκους δεδομένων. Το παρακάτω διάγραμμα απεικονίζει αυτή τη ροή εργασίας.

Παρόμοια με τον αγωγό εκπαίδευσης, το συμπέρασμα ξεκινά με την εκφόρτωση των δεδομένων από το Amazon Redshift σε έναν κάδο S3. Ένα αντικείμενο αρχείου που τοποθετείται στο Amazon S3 ενεργοποιεί τη συνάρτηση Lambda που εκκινεί τη διοχέτευση συμπερασμάτων. Οι δυνατότητες προετοιμάζονται για συμπέρασμα και τα δεδομένα χωρίζονται σε αρχεία κατάλληλου μεγέθους χρησιμοποιώντας μια εργασία επεξεργασίας SageMaker. Στη συνέχεια, ο αγωγός προσδιορίζει το πιο πρόσφατο εγκεκριμένο μοντέλο για να εκτελέσει τις προβλέψεις και να τις φορτώσει σε έναν κάδο S3. Τέλος, οι προβλέψεις φορτώνονται πίσω στο Amazon Redshift χρησιμοποιώντας το boto3-data API στην εργασία επεξεργασίας SageMaker.

Το ακόλουθο στιγμιότυπο οθόνης από το Studio εμφανίζει τις λεπτομέρειες του αγωγού συμπερασμάτων.

Οφέλη από την επιλογή της αρχιτεκτονικής ροών εργασιών ML με το SageMaker Pipelines

Σε αυτήν την ενότητα, συζητάμε τα κέρδη που πραγματοποίησε η ομάδα της Amazon Packaging Innovation με τη μετάβαση σε Pipelines για εκπαίδευση μοντέλων και συμπέρασμα.

Out-of-the-box χαρακτηριστικά MLOps σε επίπεδο παραγωγής

Κατά τη σύγκριση διαφορετικών εσωτερικών και εξωτερικών λύσεων για την επόμενη λύση αγωγού ML, ένας επιστήμονας δεδομένων μπόρεσε να πρωτοτυπήσει και να αναπτύξει μια πλήρη έκδοση μιας ροής εργασίας ML με Pipelines σε περιβάλλον Studio Jupyter σε λιγότερο από 3 εβδομάδες. Ακόμη και στο στάδιο της δημιουργίας πρωτοτύπων, έγινε σαφές ότι οι Pipelines παρείχαν όλα τα απαραίτητα στοιχεία υποδομής που απαιτούνται για μια ροή εργασιών σε επίπεδο παραγωγής: έκδοση εκδόσεων μοντέλου, προσωρινή αποθήκευση και συναγερμοί. Η άμεση διαθεσιμότητα αυτών των λειτουργιών σήμαινε ότι δεν θα δαπανηθεί επιπλέον χρόνος για την ανάπτυξη και την προσαρμογή τους. Αυτή ήταν μια σαφής απόδειξη αξίας, η οποία έπεισε την ομάδα της Amazon Packaging Innovation ότι η Pipelines ήταν η σωστή λύση.

Ευελιξία στην ανάπτυξη μοντέλων ML

Το μεγαλύτερο κέρδος για τους επιστήμονες δεδομένων της ομάδας ήταν η ικανότητα να πειραματίζονται εύκολα και να επαναλαμβάνονται μέσω διαφορετικών μοντέλων. Ανεξάρτητα από το πλαίσιο που προτιμούσαν για την εργασία τους σε ML και τον αριθμό των βημάτων και των χαρακτηριστικών που περιλάμβανε, οι Pipelines κάλυψαν τις ανάγκες τους. Οι επιστήμονες δεδομένων είχαν την εξουσία να πειραματιστούν χωρίς να χρειάζεται να περιμένουν να ξεκινήσουν το σπριντ ανάπτυξης λογισμικού για να προσθέσουν ένα επιπλέον χαρακτηριστικό ή βήμα.

Μειωμένα έξοδα

Η δυνατότητα Pipelines του SageMaker είναι δωρεάν: πληρώνετε μόνο για τους υπολογιστικούς πόρους και την αποθήκευση που σχετίζεται με την εκπαίδευση και τα συμπεράσματα. Ωστόσο, όταν σκέφτεστε το κόστος, πρέπει να λάβετε υπόψη όχι μόνο το κόστος των υπηρεσιών που χρησιμοποιούνται, αλλά και τις ώρες προγραμματιστή που απαιτούνται για τη διατήρηση της ροής εργασίας, τον εντοπισμό σφαλμάτων και την επιδιόρθωση της. Η ενορχήστρωση με Pipelines είναι πιο απλή γιατί αποτελείται από λιγότερα κομμάτια και οικεία υποδομή. Προηγουμένως, η προσθήκη μιας νέας δυνατότητας απαιτούσε τουλάχιστον δύο άτομα (επιστήμονα δεδομένων και μηχανικό λογισμικού) στην ομάδα της Amazon Packaging Innovation για την εφαρμογή της. Με τον επανασχεδιασμένο αγωγό, οι προσπάθειες μηχανικής κατευθύνονται πλέον προς πρόσθετη προσαρμοσμένη υποδομή γύρω από τον αγωγό, όπως η δημιουργία ενός ενιαίου αποθετηρίου για την παρακολούθηση του κώδικα μηχανικής εκμάθησης, η απλοποίηση της ανάπτυξης του μοντέλου σε λογαριασμούς AWS, η ανάπτυξη των ενσωματωμένων εργασιών ETL και κοινών επαναχρησιμοποιήσιμες λειτουργίες.

Η δυνατότητα αποθήκευσης των βημάτων στην κρυφή μνήμη με παρόμοια είσοδο συνέβαλε επίσης στη μείωση του κόστους, επειδή οι ομάδες ήταν λιγότερο πιθανό να εκτελέσουν ξανά ολόκληρο τον αγωγό. Αντίθετα, θα μπορούσαν εύκολα να το ξεκινήσουν από το σημείο της αποτυχίας.

Συμπέρασμα

Η ομάδα της Amazon Packaging Innovation εκπαιδεύει μοντέλα ML σε μηνιαία βάση και ενημερώνει τακτικά τις προβλέψεις για τους προτεινόμενους τύπους συσκευασίας προϊόντων. Αυτές οι συστάσεις τους βοήθησαν να επιτύχουν πολλαπλούς στόχους σε επίπεδο ομάδας και εταιρείας, μειώνοντας τη σπατάλη και ευχαριστώντας τους πελάτες με κάθε παραγγελία. Οι αγωγοί εκπαίδευσης και συμπερασμάτων πρέπει να λειτουργούν αξιόπιστα σε τακτική βάση, αλλά να επιτρέπουν τη συνεχή βελτίωση των μοντέλων.

Η μετάβαση στο Pipelines επέτρεψε στην ομάδα να αναπτύξει τέσσερις νέες αρχιτεκτονικές πολυτροπικών μοντέλων στην παραγωγή κάτω από 2 μήνες. Η ανάπτυξη ενός νέου μοντέλου χρησιμοποιώντας την προηγούμενη αρχιτεκτονική θα απαιτούσε 5 ημέρες (με την ίδια αρχιτεκτονική μοντέλου) έως 1 μήνα (με μια νέα αρχιτεκτονική μοντέλου). Η ανάπτυξη του ίδιου μοντέλου χρησιμοποιώντας Pipelines επέτρεψε στην ομάδα να μειώσει το χρόνο ανάπτυξης σε 4 ώρες με την ίδια αρχιτεκτονική μοντέλου και σε 5 ημέρες με μια νέα αρχιτεκτονική μοντέλου. Αυτό ισοδυναμεί με εξοικονόμηση σχεδόν 80% των ωρών εργασίας.

Επιπρόσθετο υλικό

Για περισσότερες πληροφορίες, ανατρέξτε στους ακόλουθους πόρους:

Σχετικά με τους Συγγραφείς

Ανκούρ Σούκλα είναι Κύριος Επιστήμονας Δεδομένων στο AWS-ProServe με έδρα το Πάλο Άλτο. Η Ankur έχει περισσότερα από 15 χρόνια συμβουλευτικής εμπειρίας που εργάζεται απευθείας με τον πελάτη και τον βοηθά να λύσει το επιχειρηματικό πρόβλημα με την τεχνολογία. Είναι επικεφαλής πολλαπλών παγκόσμιων πρωτοβουλιών εφαρμοσμένης επιστήμης και ML-Ops στο πλαίσιο του AWS. Στον ελεύθερο χρόνο του, του αρέσει να διαβάζει και να περνά χρόνο με την οικογένεια.

Ανκούρ Σούκλα είναι Κύριος Επιστήμονας Δεδομένων στο AWS-ProServe με έδρα το Πάλο Άλτο. Η Ankur έχει περισσότερα από 15 χρόνια συμβουλευτικής εμπειρίας που εργάζεται απευθείας με τον πελάτη και τον βοηθά να λύσει το επιχειρηματικό πρόβλημα με την τεχνολογία. Είναι επικεφαλής πολλαπλών παγκόσμιων πρωτοβουλιών εφαρμοσμένης επιστήμης και ML-Ops στο πλαίσιο του AWS. Στον ελεύθερο χρόνο του, του αρέσει να διαβάζει και να περνά χρόνο με την οικογένεια.

Άκας Σίνγκλα είναι Sr. System Dev Engineer με την ομάδα Amazon Packaging Innovation. Έχει περισσότερα από 17 χρόνια εμπειρίας στην επίλυση κρίσιμων επιχειρηματικών προβλημάτων μέσω τεχνολογίας για πολλούς κλάδους επιχειρήσεων. Επί του παρόντος εστιάζει στην αναβάθμιση της υποδομής NAWS για ποικιλία εφαρμογών με επίκεντρο τη συσκευασία, ώστε να τις κλιμακώνει καλύτερα.

Άκας Σίνγκλα είναι Sr. System Dev Engineer με την ομάδα Amazon Packaging Innovation. Έχει περισσότερα από 17 χρόνια εμπειρίας στην επίλυση κρίσιμων επιχειρηματικών προβλημάτων μέσω τεχνολογίας για πολλούς κλάδους επιχειρήσεων. Επί του παρόντος εστιάζει στην αναβάθμιση της υποδομής NAWS για ποικιλία εφαρμογών με επίκεντρο τη συσκευασία, ώστε να τις κλιμακώνει καλύτερα.

Vitalina Komashko είναι Επιστήμονας Δεδομένων με AWS Professional Services. Είναι κάτοχος διδακτορικού διπλώματος στη Φαρμακολογία και την Τοξικολογία, αλλά πέρασε στην επιστήμη των δεδομένων από την πειραματική εργασία επειδή ήθελε «να κατέχει τη δημιουργία δεδομένων και την ερμηνεία των αποτελεσμάτων». Νωρίτερα στην καριέρα της συνεργάστηκε με εταιρείες βιοτεχνολογίας και φαρμακευτικών εταιρειών. Στην AWS της αρέσει να λύνει προβλήματα για πελάτες από διάφορους κλάδους και να μαθαίνει για τις μοναδικές προκλήσεις τους.

Vitalina Komashko είναι Επιστήμονας Δεδομένων με AWS Professional Services. Είναι κάτοχος διδακτορικού διπλώματος στη Φαρμακολογία και την Τοξικολογία, αλλά πέρασε στην επιστήμη των δεδομένων από την πειραματική εργασία επειδή ήθελε «να κατέχει τη δημιουργία δεδομένων και την ερμηνεία των αποτελεσμάτων». Νωρίτερα στην καριέρα της συνεργάστηκε με εταιρείες βιοτεχνολογίας και φαρμακευτικών εταιρειών. Στην AWS της αρέσει να λύνει προβλήματα για πελάτες από διάφορους κλάδους και να μαθαίνει για τις μοναδικές προκλήσεις τους.

Prasanth Meiyappan είναι Sr. Applied Scientist με την Amazon Packaging Innovation για 4+ χρόνια. Έχει 6+ χρόνια εμπειρίας στον κλάδο στη μηχανική εκμάθηση και έχει αποστείλει προϊόντα για τη βελτίωση της εμπειρίας των πελατών αναζήτησης και τη βελτίωση της εμπειρίας συσκευασίας πελατών. Ο Prasanth είναι παθιασμένος με τη βιωσιμότητα και έχει διδακτορικό στη στατιστική μοντελοποίηση της κλιματικής αλλαγής.

Prasanth Meiyappan είναι Sr. Applied Scientist με την Amazon Packaging Innovation για 4+ χρόνια. Έχει 6+ χρόνια εμπειρίας στον κλάδο στη μηχανική εκμάθηση και έχει αποστείλει προϊόντα για τη βελτίωση της εμπειρίας των πελατών αναζήτησης και τη βελτίωση της εμπειρίας συσκευασίας πελατών. Ο Prasanth είναι παθιασμένος με τη βιωσιμότητα και έχει διδακτορικό στη στατιστική μοντελοποίηση της κλιματικής αλλαγής.

Μάθιου Μπέιλς είναι ένας Sr. Research Scientist που εργάζεται για τη βελτιστοποίηση της επιλογής τύπου πακέτου χρησιμοποιώντας σχόλια πελατών και μηχανική εκμάθηση. Πριν από την Amazon, ο Matt εργάστηκε ως μεταδιδακτορικός υπάλληλος εκτελώντας προσομοιώσεις σωματιδιακής φυσικής στη Γερμανία και σε μια προηγούμενη ζωή, διευθυντής παραγωγής ραδιενεργών ιατρικών εμφυτευμάτων σε μια startup. Είναι κάτοχος Ph.D. στη Φυσική από το Πανεπιστήμιο του Μίσιγκαν.

Μάθιου Μπέιλς είναι ένας Sr. Research Scientist που εργάζεται για τη βελτιστοποίηση της επιλογής τύπου πακέτου χρησιμοποιώντας σχόλια πελατών και μηχανική εκμάθηση. Πριν από την Amazon, ο Matt εργάστηκε ως μεταδιδακτορικός υπάλληλος εκτελώντας προσομοιώσεις σωματιδιακής φυσικής στη Γερμανία και σε μια προηγούμενη ζωή, διευθυντής παραγωγής ραδιενεργών ιατρικών εμφυτευμάτων σε μια startup. Είναι κάτοχος Ph.D. στη Φυσική από το Πανεπιστήμιο του Μίσιγκαν.

- AI

- αι τέχνη

- ι γεννήτρια τέχνης

- ρομπότ ai

- Amazon Sage Maker

- τεχνητή νοημοσύνη

- πιστοποίηση τεχνητής νοημοσύνης

- τεχνητή νοημοσύνη στον τραπεζικό τομέα

- ρομπότ τεχνητής νοημοσύνης

- ρομπότ τεχνητής νοημοσύνης

- λογισμικό τεχνητής νοημοσύνης

- Μηχανική εκμάθηση AWS

- blockchain

- συνέδριο blockchain ai

- Coingenius

- συνομιλητική τεχνητή νοημοσύνη

- κρυπτοσυνεδριο αι

- Λύσεις πελατών

- του νταλ

- βαθιά μάθηση

- έχεις google

- μάθηση μηχανής

- Πλάτων

- πλάτων αι

- Πληροφορία δεδομένων Plato

- Παιχνίδι Πλάτωνας

- Πλάτωνα δεδομένα

- platogaming

- κλίμακα αι

- Βιωσιμότητα

- σύνταξη

- zephyrnet