Παρά τη φαινομενικά ασταμάτητη υιοθέτηση των LLM σε όλες τις βιομηχανίες, αποτελούν ένα στοιχείο ενός ευρύτερου τεχνολογικού οικοσυστήματος που τροφοδοτεί το νέο κύμα AI. Πολλές περιπτώσεις χρήσης τεχνητής νοημοσύνης συνομιλίας απαιτούν LLM όπως το Llama 2, το Flan T5 και το Bloom να απαντούν σε ερωτήματα των χρηστών. Αυτά τα μοντέλα βασίζονται σε παραμετρικές γνώσεις για να απαντήσουν σε ερωτήσεις. Το μοντέλο μαθαίνει αυτή τη γνώση κατά τη διάρκεια της εκπαίδευσης και την κωδικοποιεί στις παραμέτρους του μοντέλου. Για να ενημερώσουμε αυτή τη γνώση, πρέπει να επανεκπαιδεύσουμε το LLM, το οποίο απαιτεί πολύ χρόνο και χρήμα.

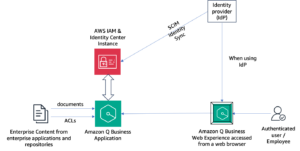

Ευτυχώς, μπορούμε επίσης να χρησιμοποιήσουμε τη γνώση της πηγής για να ενημερώσουμε τους LLMs μας. Η γνώση της πηγής είναι πληροφορίες που τροφοδοτούνται στο LLM μέσω μιας προτροπής εισαγωγής. Μια δημοφιλής προσέγγιση για την παροχή γνώσης πηγής είναι η Ανάκτηση Αυξημένης Γενιάς (RAG). Χρησιμοποιώντας το RAG, ανακτούμε σχετικές πληροφορίες από μια εξωτερική πηγή δεδομένων και τροφοδοτούμε αυτές τις πληροφορίες στο LLM.

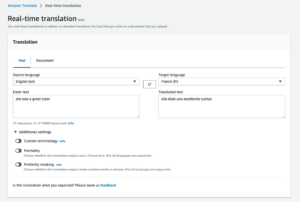

Σε αυτήν την ανάρτηση ιστολογίου, θα εξερευνήσουμε πώς να αναπτύξουμε LLM όπως το Llama-2 χρησιμοποιώντας το Amazon Sagemaker JumpStart και θα διατηρήσουμε τα LLM μας ενημερωμένα με σχετικές πληροφορίες μέσω του Retrieval Augmented Generation (RAG) χρησιμοποιώντας τη βάση δεδομένων διανυσμάτων Pinecone, προκειμένου να αποτραπεί η ψευδαίσθηση AI .

Ανάκτηση Augmented Generation (RAG) στο Amazon SageMaker

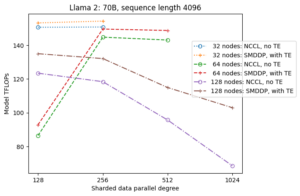

Το Pinecone θα χειριστεί το στοιχείο ανάκτησης του RAG, αλλά χρειάζεστε δύο ακόμη κρίσιμα στοιχεία: κάπου για να εκτελέσετε το συμπέρασμα LLM και κάπου για να εκτελέσετε το μοντέλο ενσωμάτωσης.

Το Amazon SageMaker Studio είναι ένα ολοκληρωμένο περιβάλλον ανάπτυξης (IDE) που παρέχει μια ενιαία οπτική διεπαφή βασισμένη στον ιστό, όπου μπορείτε να έχετε πρόσβαση σε ειδικά κατασκευασμένα εργαλεία για την εκτέλεση όλης της ανάπτυξης μηχανικής μάθησης (ML). Παρέχει το SageMaker JumpStart το οποίο είναι ένας κόμβος μοντέλων όπου οι χρήστες μπορούν να εντοπίσουν, να κάνουν προεπισκόπηση και να ξεκινήσουν ένα συγκεκριμένο μοντέλο στον δικό τους λογαριασμό SageMaker. Παρέχει προεκπαιδευμένα, διαθέσιμα στο κοινό και ιδιόκτητα μοντέλα για ένα ευρύ φάσμα τύπων προβλημάτων, συμπεριλαμβανομένων των μοντέλων θεμελίωσης.

Το Amazon SageMaker Studio παρέχει το ιδανικό περιβάλλον για την ανάπτυξη αγωγών LLM με δυνατότητα RAG. Αρχικά, χρησιμοποιώντας την κονσόλα AWS, μεταβείτε στο Amazon SageMaker και δημιουργήστε έναν τομέα SageMaker Studio και ανοίξτε ένα σημειωματάριο Jupyter Studio.

Προϋποθέσεις

Ολοκληρώστε τα παρακάτω προαπαιτούμενα βήματα:

- Ρυθμίστε το Amazon SageMaker Studio.

- Ενσωματωμένος σε έναν τομέα Amazon SageMaker.

- Εγγραφείτε για μια δωρεάν βάση δεδομένων Pinecone Vector.

- Προαπαιτούμενες βιβλιοθήκες: SageMaker Python SDK, Pinecone Client

Λύση Walkthrough

Χρησιμοποιώντας το φορητό υπολογιστή SageMaker Studio, πρέπει πρώτα να εγκαταστήσουμε τις προαπαιτούμενες βιβλιοθήκες:

Ανάπτυξη ενός LLM

Σε αυτήν την ανάρτηση, συζητάμε δύο προσεγγίσεις για την ανάπτυξη ενός LLM. Το πρώτο είναι μέσω του HuggingFaceModel αντικείμενο. Μπορείτε να το χρησιμοποιήσετε κατά την ανάπτυξη LLM (και την ενσωμάτωση μοντέλων) απευθείας από τον κόμβο μοντέλων Hugging Face.

Για παράδειγμα, μπορείτε να δημιουργήσετε μια διαμόρφωση με δυνατότητα ανάπτυξης για το google/flan-t5-xl μοντέλο όπως φαίνεται στην ακόλουθη λήψη οθόνης:

Κατά την ανάπτυξη μοντέλων απευθείας από το Hugging Face, αρχικοποιήστε το my_model_configuration με τα εξής:

- An

envconfig μας λέει ποιο μοντέλο θέλουμε να χρησιμοποιήσουμε και για ποια εργασία. - Η εκτέλεση του SageMaker μας

roleμας δίνει δικαιώματα για την ανάπτυξη του μοντέλου μας. - An

image_uriείναι μια διαμόρφωση εικόνας ειδικά για την ανάπτυξη LLM από το Hugging Face.

Εναλλακτικά, το SageMaker διαθέτει ένα σύνολο μοντέλων που είναι άμεσα συμβατά με ένα απλούστερο JumpStartModel αντικείμενο. Πολλά δημοφιλή LLM όπως το Llama 2 υποστηρίζονται από αυτό το μοντέλο, το οποίο μπορεί να αρχικοποιηθεί όπως φαίνεται στην ακόλουθη λήψη οθόνης:

Και για τις δύο εκδόσεις του my_model, αναπτύξτε τα όπως φαίνεται στην ακόλουθη λήψη οθόνης:

Με το αρχικοποιημένο τελικό σημείο LLM, μπορείτε να ξεκινήσετε την αναζήτηση. Η μορφή των ερωτήσεών μας μπορεί να διαφέρει (ιδιαίτερα μεταξύ LLM συνομιλίας και μη), αλλά η διαδικασία είναι γενικά η ίδια. Για το μοντέλο Hugging Face, κάντε τα εξής:

Μπορείτε να βρείτε τη λύση στο Αποθετήριο GitHub.

Η απάντηση που λαμβάνουμε εδώ δεν έχει πολύ νόημα — πρόκειται για παραίσθηση.

Παροχή πρόσθετου πλαισίου στο LLM

Το Llama 2 επιχειρεί να απαντήσει στην ερώτησή μας βασιζόμενο αποκλειστικά στην εσωτερική παραμετρική γνώση. Σαφώς, οι παράμετροι του μοντέλου δεν αποθηκεύουν τη γνώση για το ποιες περιπτώσεις μπορούμε με την εκπαίδευση διαχειριζόμενων σποτ στο SageMaker.

Για να απαντήσουμε σωστά σε αυτή την ερώτηση, πρέπει να χρησιμοποιήσουμε τη γνώση της πηγής. Δηλαδή, δίνουμε πρόσθετες πληροφορίες στο LLM μέσω της προτροπής. Ας προσθέσουμε αυτές τις πληροφορίες απευθείας ως πρόσθετο πλαίσιο για το μοντέλο.

Βλέπουμε τώρα τη σωστή απάντηση στην ερώτηση. αυτό ήταν εύκολο! Ωστόσο, ένας χρήστης είναι απίθανο να εισαγάγει περιβάλλοντα στις προτροπές του, θα γνωρίζει ήδη την απάντηση στην ερώτησή του.

Αντί να εισάγετε χειροκίνητα ένα ενιαίο πλαίσιο, προσδιορίστε αυτόματα τις σχετικές πληροφορίες από μια πιο εκτεταμένη βάση δεδομένων πληροφοριών. Για αυτό, θα χρειαστείτε το Retrieval Augmented Generation.

Ανάκτηση επαυξημένης γενιάς

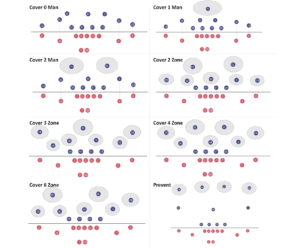

Με το Retrieval Augmented Generation, μπορείτε να κωδικοποιήσετε μια βάση δεδομένων πληροφοριών σε ένα διανυσματικό χώρο όπου η εγγύτητα μεταξύ των διανυσμάτων αντιπροσωπεύει τη συνάφεια/σημασιολογική τους ομοιότητα. Με αυτόν τον διανυσματικό χώρο ως βάση γνώσεων, μπορείτε να μετατρέψετε ένα νέο ερώτημα χρήστη, να το κωδικοποιήσετε στον ίδιο διανυσματικό χώρο και να ανακτήσετε τις πιο σχετικές εγγραφές που είχαν καταχωριστεί στο ευρετήριο.

Αφού ανακτήσετε αυτές τις σχετικές εγγραφές, επιλέξτε μερικές από αυτές και συμπεριλάβετέ τις στη γραμμή εντολών LLM ως πρόσθετο πλαίσιο, παρέχοντας στο LLM πολύ σχετική γνώση πηγών. Αυτή είναι μια διαδικασία δύο σταδίων όπου:

- Η ευρετηρίαση συμπληρώνει το διανυσματικό ευρετήριο με πληροφορίες από ένα σύνολο δεδομένων.

- Η ανάκτηση πραγματοποιείται κατά τη διάρκεια ενός ερωτήματος και είναι όπου ανακτούμε σχετικές πληροφορίες από το διανυσματικό ευρετήριο.

Και τα δύο βήματα απαιτούν ένα μοντέλο ενσωμάτωσης για να μεταφράσει το αναγνώσιμο από τον άνθρωπο απλό κείμενό μας σε σημασιολογικό διανυσματικό χώρο. Χρησιμοποιήστε τον εξαιρετικά αποδοτικό μετασχηματιστή προτάσεων MiniLM από το Hugging Face, όπως φαίνεται στην παρακάτω λήψη οθόνης. Αυτό το μοντέλο δεν είναι LLM και επομένως δεν προετοιμάζεται με τον ίδιο τρόπο όπως το μοντέλο μας Llama 2.

Στο hub_config, καθορίστε το αναγνωριστικό μοντέλου όπως φαίνεται στην παραπάνω λήψη οθόνης, αλλά για την εργασία, χρησιμοποιήστε την εξαγωγή χαρακτηριστικών επειδή δημιουργούμε ενσωματώσεις διανυσμάτων και όχι κείμενο όπως το LLM μας. Μετά από αυτό, αρχικοποιήστε τη διαμόρφωση του μοντέλου με HuggingFaceModel όπως πριν, αλλά αυτή τη φορά χωρίς την εικόνα LLM και με κάποιες παραμέτρους έκδοσης.

Μπορείτε να αναπτύξετε ξανά το μοντέλο με deploy, χρησιμοποιώντας τη μικρότερη (μόνο CPU) παρουσία του ml.t2.large. Το μοντέλο MiniLM είναι μικροσκοπικό, επομένως δεν απαιτεί πολλή μνήμη και δεν χρειάζεται GPU επειδή μπορεί να δημιουργήσει γρήγορα ενσωματώσεις ακόμη και σε μια CPU. Εάν προτιμάτε, μπορείτε να εκτελέσετε το μοντέλο πιο γρήγορα σε GPU.

Για να δημιουργήσετε ενσωματώσεις, χρησιμοποιήστε το predict μέθοδο και περάστε μια λίστα περιεχομένων για κωδικοποίηση μέσω του inputs κλειδί όπως φαίνεται:

Δύο περιβάλλοντα εισόδου μεταβιβάζονται, επιστρέφοντας δύο ενσωματώσεις διανυσμάτων περιβάλλοντος όπως φαίνεται:

len(out)

2

Η διάσταση ενσωμάτωσης του μοντέλου MiniLM είναι 384 πράγμα που σημαίνει ότι κάθε διάνυσμα που ενσωματώνει εξόδους MiniLM θα πρέπει να έχει διαστάσεις 384. Ωστόσο, κοιτάζοντας το μήκος των ενσωματώσεών μας, θα δείτε τα εξής:

len(out[0]), len(out[1])

(8, 8)

Δύο λίστες περιέχουν οκτώ στοιχεία η καθεμία. Το MiniLM επεξεργάζεται πρώτα το κείμενο σε ένα βήμα διακριτοποίησης. Αυτό το tokenization μετατρέπει το αναγνώσιμο από τον άνθρωπο απλό κείμενο σε μια λίστα αναγνωριστικών διακριτικών με δυνατότητα ανάγνωσης από μοντέλα. Στις δυνατότητες εξόδου του μοντέλου, μπορείτε να δείτε τις ενσωματώσεις σε επίπεδο διακριτικού. μία από αυτές τις ενσωματώσεις δείχνει την αναμενόμενη διάσταση του 384 όπως φαίνεται:

len(out[0][0])

384

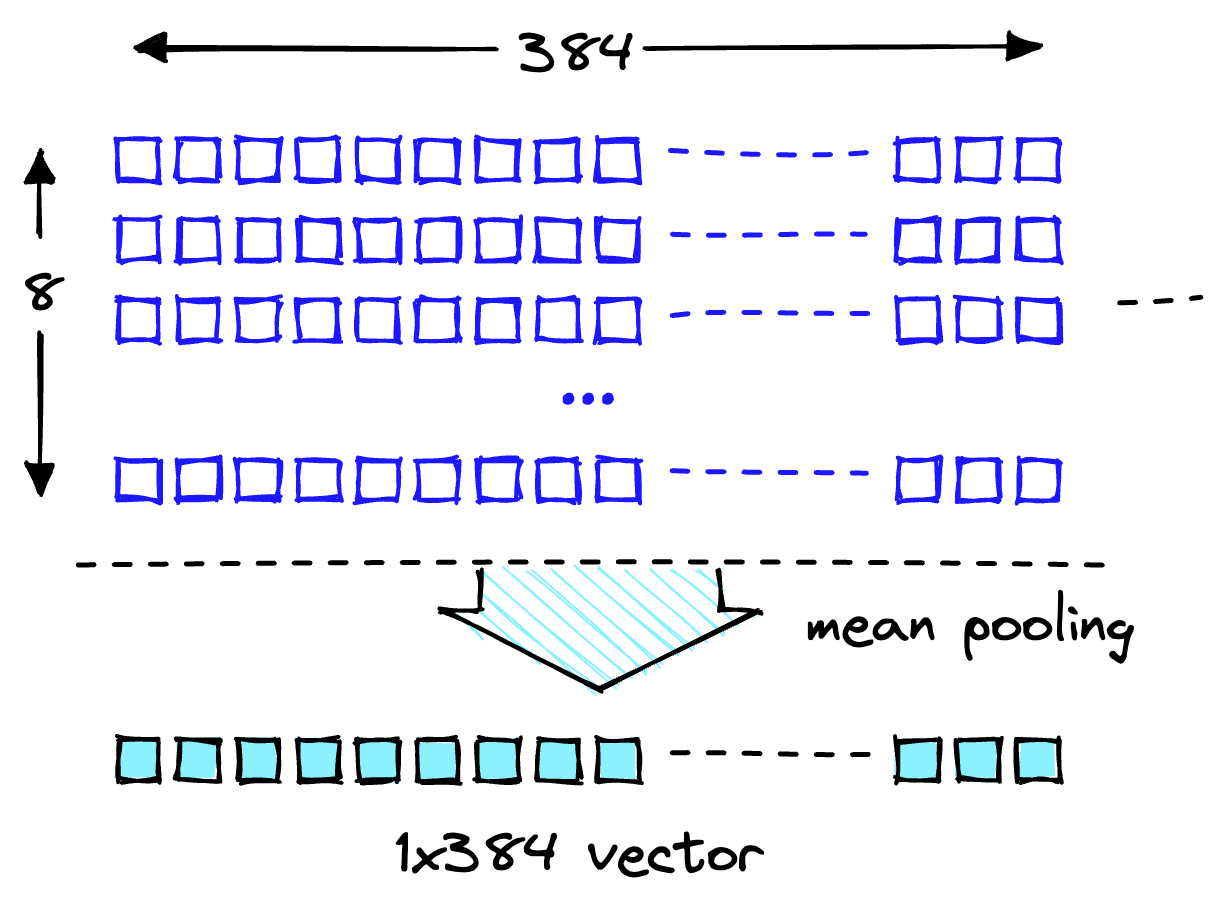

Μετατρέψτε αυτές τις ενσωματώσεις σε επίπεδο διακριτικού σε ενσωματώσεις σε επίπεδο εγγράφου χρησιμοποιώντας τις μέσες τιμές σε κάθε διανυσματική διάσταση, όπως φαίνεται στην παρακάτω εικόνα.

Μέση λειτουργία συγκέντρωσης για τη λήψη ενός ενιαίου διανύσματος 384 διαστάσεων.

Με δύο διανυσματικές ενσωματώσεις 384 διαστάσεων, μία για κάθε κείμενο εισαγωγής. Για να κάνετε τη ζωή μας πιο εύκολη, τυλίξτε τη διαδικασία κωδικοποίησης σε μια ενιαία λειτουργία όπως φαίνεται στην ακόλουθη λήψη οθόνης:

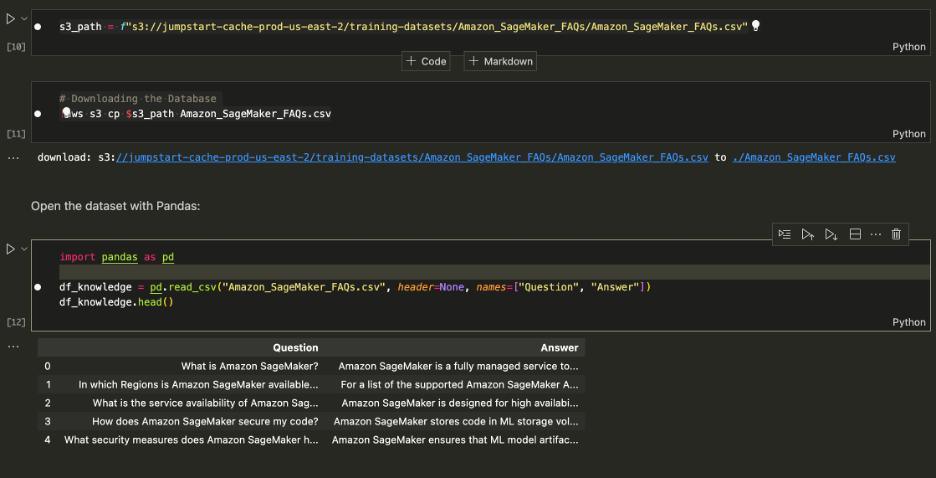

Λήψη του συνόλου δεδομένων

Κατεβάστε τις Συχνές Ερωτήσεις του Amazon SageMaker ως βάση γνώσεων για να λάβετε τα δεδομένα που περιέχουν και τις δύο στήλες ερωτήσεων και απαντήσεων.

Κατεβάστε τις Συχνές Ερωτήσεις του Amazon SageMaker

Κατά την εκτέλεση της αναζήτησης, αναζητήστε μόνο απαντήσεις, ώστε να μπορείτε να αποθέσετε τη στήλη Ερώτηση. Δείτε το σημειωματάριο για λεπτομέρειες.

Το σύνολο δεδομένων μας και ο αγωγός ενσωμάτωσης είναι έτοιμοι. Τώρα το μόνο που χρειαζόμαστε είναι κάπου να αποθηκεύσουμε αυτές τις ενσωματώσεις.

Ευρετηρίαση

Η βάση δεδομένων διάνυσμα Pinecone αποθηκεύει ενσωματώσεις διανυσμάτων και τις αναζητά αποτελεσματικά σε κλίμακα. Για να δημιουργήσετε μια βάση δεδομένων, θα χρειαστείτε ένα δωρεάν κλειδί API από το Pinecone.

Αφού συνδεθείτε στη βάση δεδομένων διάνυσμα Pinecone, δημιουργήστε ένα ενιαίο διανυσματικό ευρετήριο (παρόμοιο με έναν πίνακα σε παραδοσιακά DB). Ονομάστε το ευρετήριο retrieval-augmentation-aws και ευθυγραμμίστε το ευρετήριο dimension και metric παραμέτρους με αυτές που απαιτούνται από το μοντέλο ενσωμάτωσης (το MiniLM σε αυτήν την περίπτωση).

Για να ξεκινήσετε την εισαγωγή δεδομένων, εκτελέστε τα εξής:

Μπορείτε να αρχίσετε να ρωτάτε το ευρετήριο με την ερώτηση από νωρίτερα σε αυτήν την ανάρτηση.

Η παραπάνω έξοδος δείχνει ότι επιστρέφουμε σχετικά περιβάλλοντα για να μας βοηθήσουν να απαντήσουμε στην ερώτησή μας. Απο τοτε που εμεις top_k = 1, index.query επέστρεψε το κορυφαίο αποτέλεσμα δίπλα στα μεταδεδομένα που διαβάζονται Managed Spot Training can be used with all instances supported in Amazon.

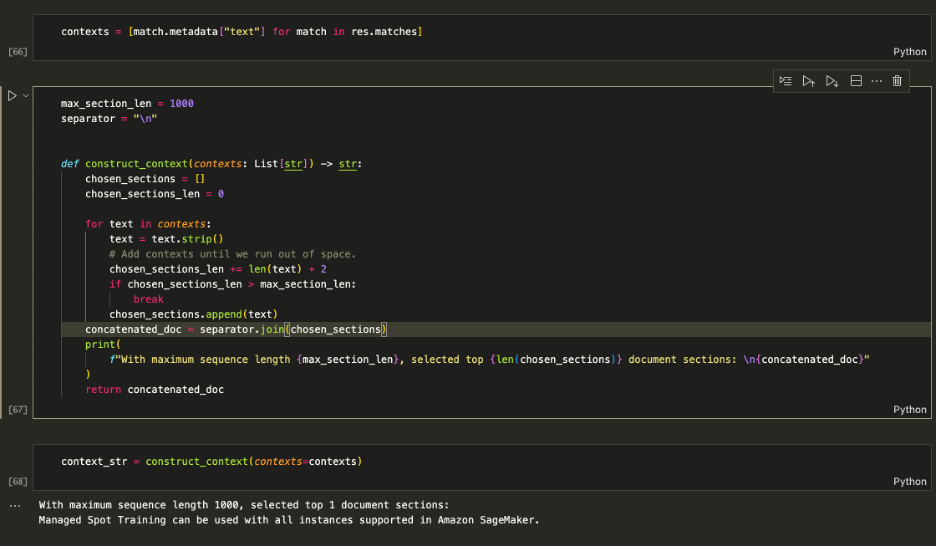

Αύξηση της Προτροπής

Χρησιμοποιήστε τα ανακτημένα περιβάλλοντα για να αυξήσετε την προτροπή και να αποφασίσετε για ένα μέγιστο ποσό περιβάλλοντος που θα τροφοδοτηθεί στο LLM. Χρησιμοποιήστε το 1000 περιορισμός χαρακτήρων στην επαναληπτική προσθήκη κάθε επιστρεφόμενου περιβάλλοντος στην προτροπή μέχρι να υπερβείτε το μήκος περιεχομένου.

Αύξηση της Προτροπής

Τροφοδοτήστε το context_str στη γραμμή εντολών LLM όπως φαίνεται στην ακόλουθη λήψη οθόνης:

[Εισαγωγή]: Ποιες περιπτώσεις μπορώ να χρησιμοποιήσω με την Εκπαίδευση Managed Spot στο SageMaker; [Έξοδος]: Με βάση το παρεχόμενο πλαίσιο, μπορείτε να χρησιμοποιήσετε την Εκπαίδευση Managed Spot με όλες τις παρουσίες που υποστηρίζονται στο Amazon SageMaker. Επομένως, η απάντηση είναι: Όλες οι περιπτώσεις υποστηρίζονται στο Amazon SageMaker.

Η λογική λειτουργεί, οπότε τυλίξτε την σε μια ενιαία λειτουργία για να διατηρήσετε τα πράγματα καθαρά.

Τώρα μπορείτε να κάνετε ερωτήσεις όπως αυτές που εμφανίζονται παρακάτω:

εκκαθάριση

Για να σταματήσετε να επιβαρύνεστε με ανεπιθύμητες χρεώσεις, διαγράψτε το μοντέλο και το τελικό σημείο.

Συμπέρασμα

Σε αυτήν την ανάρτηση, σας παρουσιάσαμε το RAG με LLM ανοιχτής πρόσβασης στο SageMaker. Δείξαμε επίσης πώς να αναπτύξετε μοντέλα Amazon SageMaker Jumpstart με το Llama 2, Hugging Face LLM με Flan T5 και ενσωμάτωση μοντέλων με MiniLM.

Υλοποιήσαμε έναν πλήρη αγωγό RAG από άκρο σε άκρο χρησιμοποιώντας τα μοντέλα ανοιχτής πρόσβασης και έναν διανυσματικό δείκτη Pinecone. Χρησιμοποιώντας αυτό, δείξαμε πώς να ελαχιστοποιήσουμε τις παραισθήσεις και να διατηρήσουμε ενημερωμένες τις γνώσεις LLM και τελικά να βελτιώσουμε την εμπειρία του χρήστη και την εμπιστοσύνη στα συστήματά μας.

Για να εκτελέσετε αυτό το παράδειγμα μόνοι σας, κλωνοποιήστε αυτό το αποθετήριο GitHub και ακολουθήστε τα προηγούμενα βήματα χρησιμοποιώντας το Σημειωματάριο απαντήσεων ερωτήσεων στο GitHub.

Σχετικά με τους συγγραφείς

Vedant Jain είναι Sr. Specialist AI/ML, που εργάζεται σε στρατηγικές πρωτοβουλίες Generative AI. Πριν από την ένταξή του στην AWS, η Vedant κατείχε θέσεις ML/Data Science Specialty σε διάφορες εταιρείες όπως η Databricks, η Hortonworks (τώρα Cloudera) και η JP Morgan Chase. Εκτός από τη δουλειά του, ο Vedant είναι παθιασμένος με τη μουσική, την αναρρίχηση, τη χρήση της επιστήμης για μια ουσιαστική ζωή και την εξερεύνηση κουζινών από όλο τον κόσμο.

Vedant Jain είναι Sr. Specialist AI/ML, που εργάζεται σε στρατηγικές πρωτοβουλίες Generative AI. Πριν από την ένταξή του στην AWS, η Vedant κατείχε θέσεις ML/Data Science Specialty σε διάφορες εταιρείες όπως η Databricks, η Hortonworks (τώρα Cloudera) και η JP Morgan Chase. Εκτός από τη δουλειά του, ο Vedant είναι παθιασμένος με τη μουσική, την αναρρίχηση, τη χρήση της επιστήμης για μια ουσιαστική ζωή και την εξερεύνηση κουζινών από όλο τον κόσμο.

Τζέιμς Μπριγκς είναι Υπεύθυνος Προγραμματιστή Προσωπικού στην Pinecone, που ειδικεύεται στην αναζήτηση διανυσμάτων και την AI/ML. Καθοδηγεί προγραμματιστές και επιχειρήσεις στην ανάπτυξη των δικών τους λύσεων GenAI μέσω της διαδικτυακής εκπαίδευσης. Πριν από το Pinecone, ο James εργάστηκε στο AI για μικρές νεοσύστατες εταιρείες τεχνολογίας σε καθιερωμένες χρηματοοικονομικές εταιρείες. Εκτός δουλειάς, ο Τζέιμς έχει πάθος να ταξιδεύει και να αγκαλιάζει νέες περιπέτειες, που κυμαίνονται από σέρφινγκ και καταδύσεις μέχρι Muay Thai και BJJ.

Τζέιμς Μπριγκς είναι Υπεύθυνος Προγραμματιστή Προσωπικού στην Pinecone, που ειδικεύεται στην αναζήτηση διανυσμάτων και την AI/ML. Καθοδηγεί προγραμματιστές και επιχειρήσεις στην ανάπτυξη των δικών τους λύσεων GenAI μέσω της διαδικτυακής εκπαίδευσης. Πριν από το Pinecone, ο James εργάστηκε στο AI για μικρές νεοσύστατες εταιρείες τεχνολογίας σε καθιερωμένες χρηματοοικονομικές εταιρείες. Εκτός δουλειάς, ο Τζέιμς έχει πάθος να ταξιδεύει και να αγκαλιάζει νέες περιπέτειες, που κυμαίνονται από σέρφινγκ και καταδύσεις μέχρι Muay Thai και BJJ.

Σιν Χουάνγκ είναι Senior Applied Scientist για τους ενσωματωμένους αλγόριθμους Amazon SageMaker JumpStart και Amazon SageMaker. Επικεντρώνεται στην ανάπτυξη κλιμακωτών αλγορίθμων μηχανικής μάθησης. Τα ερευνητικά του ενδιαφέροντα είναι στον τομέα της επεξεργασίας φυσικής γλώσσας, της εξηγήσιμης βαθιάς μάθησης σε δεδομένα πινάκων και της ισχυρής ανάλυσης της μη παραμετρικής ομαδοποίησης του χωροχρόνου. Έχει δημοσιεύσει πολλές εργασίες σε συνέδρια ACL, ICDM, KDD και Royal Statistical Society: Series A.

Σιν Χουάνγκ είναι Senior Applied Scientist για τους ενσωματωμένους αλγόριθμους Amazon SageMaker JumpStart και Amazon SageMaker. Επικεντρώνεται στην ανάπτυξη κλιμακωτών αλγορίθμων μηχανικής μάθησης. Τα ερευνητικά του ενδιαφέροντα είναι στον τομέα της επεξεργασίας φυσικής γλώσσας, της εξηγήσιμης βαθιάς μάθησης σε δεδομένα πινάκων και της ισχυρής ανάλυσης της μη παραμετρικής ομαδοποίησης του χωροχρόνου. Έχει δημοσιεύσει πολλές εργασίες σε συνέδρια ACL, ICDM, KDD και Royal Statistical Society: Series A.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- PlatoHealth. Ευφυΐα βιοτεχνολογίας και κλινικών δοκιμών. Πρόσβαση εδώ.

- πηγή: https://aws.amazon.com/blogs/machine-learning/mitigate-hallucinations-through-retrieval-augmented-generation-using-pinecone-vector-database-llama-2-from-amazon-sagemaker-jumpstart/

- :έχει

- :είναι

- :δεν

- :που

- $UP

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 16

- 17

- 19

- 23

- 32

- 7

- 8

- 9

- a

- Σχετικα

- πάνω από

- πρόσβαση

- Σύμφωνα με

- Λογαριασμός

- απέναντι

- προσθέτω

- Πρόσθετος

- Επιπλέον πληροφορίες

- Υιοθεσία

- περιπέτειες

- συνήγορος

- πάλι

- AI

- αι περιπτώσεις χρήσης

- AI / ML

- αλγόριθμοι

- ευθυγράμμιση

- Όλα

- κατά μήκος

- ήδη

- Επίσης

- Amazon

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Στούντιο Amazon SageMaker

- Amazon υπηρεσίες Web

- ποσό

- an

- ανάλυση

- και

- απάντηση

- απαντήσεις

- κάθε

- api

- app

- εφαρμοσμένος

- πλησιάζω

- προσεγγίσεις

- ΕΙΝΑΙ

- ΠΕΡΙΟΧΗ

- γύρω

- AS

- ζητώ

- At

- Προσπάθειες

- αυξάνω

- επαυξημένης

- αυτόματη

- αυτομάτως

- διαθέσιμος

- AWS

- βάση

- βασίζονται

- BE

- επειδή

- πριν

- αρχίζουν

- μεταξύ

- Μπλοκ

- άνθηση

- και οι δύο

- ευρύτερη

- χτίζω

- ενσωματωμένο

- επιχειρήσεις

- αλλά

- by

- CAN

- πιάνω

- περίπτωση

- περιπτώσεις

- χαρακτήρες

- φορτία

- κυνηγητό

- καθαρός

- σαφώς

- Ορειβασία

- Cloudera

- ομαδοποίηση

- Στήλη

- Στήλες

- Εταιρείες

- σύμφωνος

- πλήρης

- συστατικό

- εξαρτήματα

- συνέδρια

- συνδεδεμένος

- πρόξενος

- περιέχουν

- Περιέχει

- περιεχόμενο

- συμφραζόμενα

- πλαίσια

- ομιλητικός

- συνομιλία AI

- μετατρέψετε

- Εταιρείες

- διορθώσει

- σωστά

- δημιουργία

- κρίσιμης

- Τη στιγμή

- ημερομηνία

- βάση δεδομένων

- Ημερομηνία

- DBS

- αποφασίζει

- βαθύς

- βαθιά μάθηση

- παρατάσσω

- ανάπτυξη

- Εργολάβος

- προγραμματιστές

- ανάπτυξη

- Ανάπτυξη

- Διάσταση

- κατευθείαν

- συζητήσουν

- do

- κάνει

- doesn

- Όχι

- τομέα

- Don

- Πτώση

- κατά την διάρκεια

- κάθε

- Νωρίτερα

- ευκολότερη

- οικοσύστημα

- Εκπαίδευση

- αποτελεσματικός

- αποτελεσματικά

- ενσωμάτωση

- αγκαλιάζει

- κωδικοποίησης

- τέλος

- από άκρη σε άκρη

- Τελικό σημείο

- ενίσχυση

- Περιβάλλον

- εγκατεστημένος

- Even

- παράδειγμα

- υπερβαίνω

- εκτέλεση

- αναμένεται

- εμπειρία

- διερευνήσει

- Εξερευνώντας

- εκτενής

- εξωτερικός

- εκχύλισμα

- Πρόσωπο

- γρηγορότερα

- Χαρακτηριστικά

- Fed

- λίγοι

- χρηματοδότηση

- Εύρεση

- φινίρισμα

- Όνομα

- φλοτέρ

- εστιάζει

- Εξής

- Για

- μορφή

- Θεμέλιο

- Δωρεάν

- από

- λειτουργία

- γενικά

- παράγεται

- παραγωγής

- γενεά

- γενετική

- Παραγωγική τεχνητή νοημοσύνη

- παίρνω

- GitHub

- Δώστε

- δεδομένου

- δίνει

- Go

- πηγαίνει

- GPU

- Οδηγοί

- λαβή

- συμβαίνει

- Έχω

- he

- Ήρωας

- βοήθεια

- εδώ

- υψηλά

- του

- Πως

- Πώς να

- Ωστόσο

- HTTPS

- huang

- Hub

- Πρόσωπο αγκαλιάς

- αναγνώσιμη από άνθρωπο

- i

- ID

- ιδανικό

- προσδιορίσει

- ids

- if

- εικόνα

- εφαρμοστεί

- εισαγωγή

- in

- περιλαμβάνουν

- Συμπεριλαμβανομένου

- Αυξάνουν

- ευρετήριο

- ευρετήριο

- βιομηχανίες

- πληροφορώ

- πληροφορίες

- πρωτοβουλίες

- εισαγωγή

- είσοδοι

- εγκαθιστώ

- παράδειγμα

- ενσωματωθεί

- συμφέροντα

- περιβάλλον λειτουργίας

- εσωτερικός

- σε

- εισήγαγε

- IT

- αντικειμένων

- james

- ενώνει

- jp

- jp morgan

- JP Morgan Chase

- jpg

- Διατήρηση

- Κλειδί

- Ξέρω

- γνώση

- Γλώσσα

- large

- μεγαλύτερος

- ξεκινήσει

- οδηγήσει

- μάθηση

- μαθαίνει

- Μήκος

- βιβλιοθήκες

- ζωή

- Μου αρέσει

- LIMIT

- Λιστα

- Λίστες

- ζωές

- Είδος μικρής καμήλας

- LLM

- λογική

- ματιά

- κοιτάζοντας

- Παρτίδα

- μηχανή

- μάθηση μηχανής

- κάνω

- Κατασκευή

- διαχειρίζεται

- χειροκίνητα

- πολοί

- Ταίριασμα

- σπίρτα

- ανώτατο όριο

- μέγιστο ποσό

- Ενδέχεται..

- εννοώ

- νόημα

- μέσα

- Μνήμη

- Μεταδεδομένα

- μέθοδος

- Μετριάζω

- ML

- μοντέλο

- μοντέλα

- χρήματα

- περισσότερο

- Morgan

- πλέον

- πολύ

- πολλαπλούς

- Μουσική

- πρέπει

- όνομα

- Φυσικό

- Επεξεργασία φυσικής γλώσσας

- Ανάγκη

- ανάγκες

- Νέα

- επόμενη

- nlp

- σημειωματάριο

- τώρα

- πολλοί

- αντικείμενο

- of

- on

- ONE

- διαδικτυακά (online)

- αποκλειστικά

- ανοίξτε

- λειτουργία

- or

- τάξη

- OS

- αλλιώς

- δικός μας

- έξω

- παραγωγή

- εξόδους

- εκτός

- δική

- χαρτιά

- παράμετροι

- Ειδικότερα

- ιδιαίτερα

- passieren

- πέρασε

- πάθος

- παθιασμένος

- Εκτελέστε

- εκτέλεση

- δικαιώματα

- εικόνα

- αγωγού

- Σκέτη

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- Δημοφιλής

- θέσεις

- Θέση

- Ενεργοποίηση

- πρόβλεψη

- Προβλέψεις

- Predictor

- προτιμάται

- πρόληψη

- Προβολή

- προηγούμενος

- προηγουμένως

- Πριν

- Πρόβλημα

- διαδικασια μας

- Διεργασίες

- μεταποίηση

- Προφίλ ⬇️

- προτρέπει

- ιδιόκτητο

- παρέχεται

- παρέχει

- χορήγηση

- δημοσίως

- δημοσιεύθηκε

- Python

- pytorch

- ερωτήματα

- ερώτηση

- Ερωτήσεις

- γρήγορα

- σειρά

- κυμαίνεται

- έτοιμος

- λήψη

- αρχεία

- περιοχές

- βασίζονται

- Αποθήκη

- αντιπροσωπεύει

- απαιτούν

- απαιτείται

- έρευνα

- Απάντηση

- αποτέλεσμα

- Αποτελέσματα

- απόδοση

- επιστροφή

- εύρωστος

- βράχος

- Ρόλος

- βασιλικός

- τρέξιμο

- τρέχει

- σοφός

- ίδιο

- λένε

- επεκτάσιμη

- Κλίμακα

- Επιστήμη

- Επιστήμονας

- σκορ

- Οθόνη

- SDK

- Αναζήτηση

- αναζητήσεις

- δείτε

- φαινομενικώς

- επιλέξτε

- αρχαιότερος

- αίσθηση

- ποινή

- Σειρές

- Σειρά Α

- Υπηρεσίες

- σειρά

- θα πρέπει να

- δείχνουν

- έδειξε

- παρουσιάζεται

- Δείχνει

- πλευρά

- παρόμοιες

- απλούστερη

- αφού

- ενιαίας

- Μέγεθος

- small

- μικρότερος

- So

- Κοινωνία

- μόνο

- λύση

- Λύσεις

- μερικοί

- κάπου

- Πηγή

- Χώρος

- ειδικός

- ειδικευμένη

- Ειδικότητα

- ειδικά

- Spot

- Προσωπικό

- Startups

- στατιστικός

- Βήμα

- Βήματα

- στάση

- κατάστημα

- καταστήματα

- Στρατηγική

- Σπάγγος

- στούντιο

- τέτοιος

- υποστήριξη

- υποστηριζόνται!

- Υποστηρίζει

- σύστημα

- συστήματα

- τραπέζι

- παίρνει

- Έργο

- tech

- tech ξεκινήματα

- Τεχνολογία

- λέει

- κείμενο

- ταϊλανδικά

- από

- ότι

- Η

- Η περιοχή

- ο κόσμος

- τους

- Τους

- επομένως

- Αυτοί

- αυτοί

- πράγματα

- αυτό

- εκείνοι

- Μέσω

- ώρα

- προς την

- ένδειξη

- Τεκμηρίωση

- πολύ

- εργαλεία

- κορυφή

- παραδοσιακός

- Εκπαίδευση

- μετασχηματιστής

- μετασχηματιστές

- μετασχηματισμών

- μεταφράζω

- Ταξίδια

- Εμπιστευθείτε

- δύο

- τύποι

- τελικά

- απίθανος

- ασταμάτητη.

- μέχρι

- ανεπιθύμητος

- Ενημέρωση

- us

- χρήση

- μεταχειρισμένος

- Χρήστες

- Η εμπειρία χρήστη

- Χρήστες

- χρησιμοποιώντας

- Αξίες

- διάφορα

- εκδοχή

- εκδόσεις

- μέσω

- οπτικές

- περιμένετε

- περιδιάβαση

- θέλω

- ήταν

- WAVE

- Τρόπος..

- we

- ιστός

- διαδικτυακές υπηρεσίες

- Web-based

- Τι

- πότε

- Ποιό

- ενώ

- ευρύς

- Ευρύ φάσμα

- θα

- με

- χωρίς

- Εργασία

- εργάστηκαν

- εργαζόμενος

- λειτουργεί

- κόσμος

- θα

- τυλίξτε

- X

- Ναί

- Εσείς

- Σας

- zephyrnet