Οι ερευνητές ανακάλυψαν πάνω από 100 κακόβουλα μοντέλα μηχανικής μάθησης (ML) στην πλατφόρμα Hugging Face AI που μπορούν να επιτρέψουν στους εισβολείς να εισάγουν κακόβουλο κώδικα σε μηχανές χρηστών.

Αν και το Hugging Face εφαρμόζει μέτρα ασφαλείας, τα ευρήματα υπογραμμίζουν τον αυξανόμενο κίνδυνο «οπλισμού» μοντέλων που είναι διαθέσιμα στο κοινό, καθώς μπορούν να δημιουργήσουν μια κερκόπορτα για τους εισβολείς.

Τα ευρήματα της JFrog Security Research αποτελούν μέρος μιας συνεχιζόμενης μελέτης για την ανάλυση του τρόπου με τον οποίο οι χάκερ μπορούν να χρησιμοποιήσουν την ML για να επιτεθούν στους χρήστες.

Επιβλαβές περιεχόμενο

Σύμφωνα με ένα άρθρο του Πληροφορική, οι ερευνητές ανέπτυξαν ένα προηγμένο σύστημα σάρωσης για τον έλεγχο μοντέλων που φιλοξενούνται στην πλατφόρμα Hugging Face AI, όπως τα PyTorch και Tensorflow Keras.

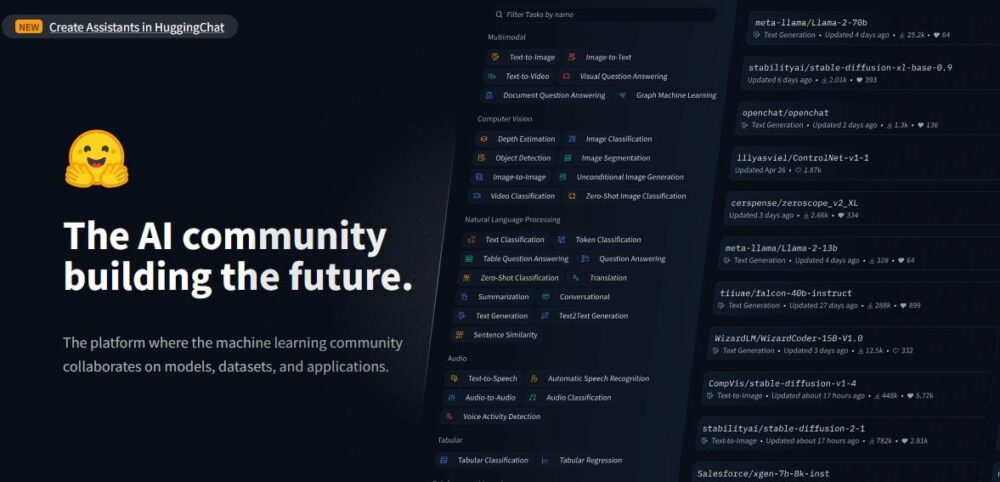

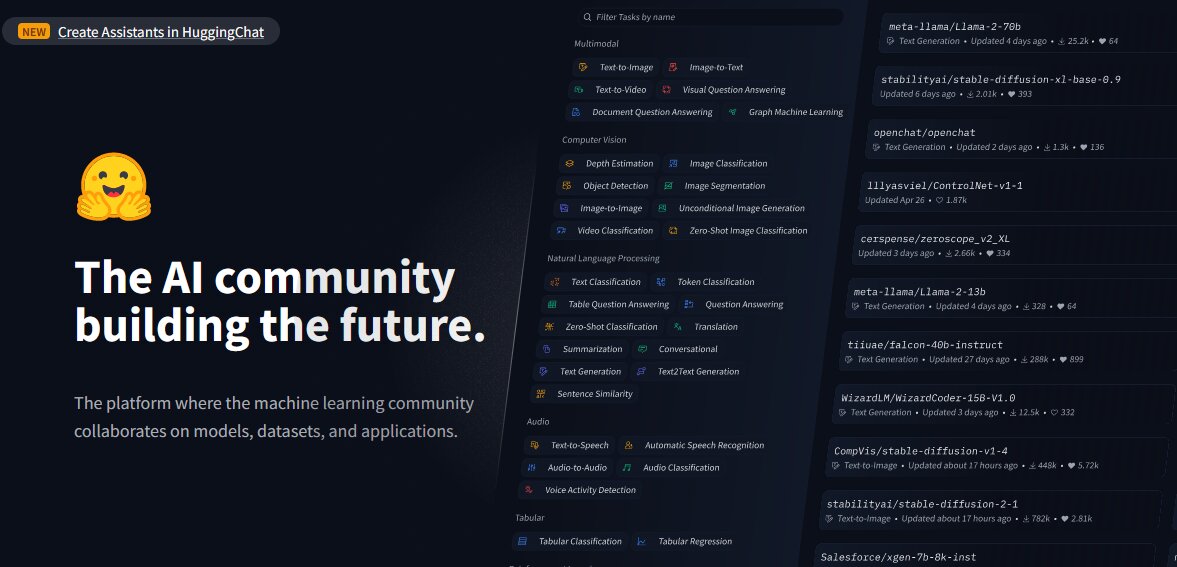

Το Hugging Face είναι μια πλατφόρμα που αναπτύχθηκε για την κοινή χρήση μοντέλων, συνόλων δεδομένων και εφαρμογών AI. Κατά την ανάλυση των μοντέλων, οι ερευνητές ανακάλυψαν επιβλαβή ωφέλιμα φορτία «μέσα σε φαινομενικά αβλαβή μοντέλα».

Αυτό συμβαίνει παρά το γεγονός ότι το Hugging Face εκτελεί μέτρα ασφαλείας όπως κακόβουλο λογισμικό και σάρωση τουρσί. Ωστόσο, η πλατφόρμα δεν περιορίζει τη λήψη μοντέλων που θα μπορούσαν να είναι δυνητικά επιβλαβή και επίσης επιτρέπει τη δημόσια διαθεσιμότητα Μοντέλα AI να γίνει κατάχρηση και οπλοφορία από τους χρήστες.

Εξετάζοντας την πλατφόρμα και τα υπάρχοντα μοντέλα, οι ερευνητές ασφαλείας του JFrog ανακάλυψαν περίπου 100 μοντέλα τεχνητής νοημοσύνης με κακόβουλη λειτουργικότητα, σύμφωνα με τους αναφέρουν.

Κάποια από αυτά τα μοντέλα, υποδεικνύει η έκθεση, είναι ικανά να εκτελούν κώδικα σε μηχανές χρηστών, «δημιουργώντας έτσι μια μόνιμα κερκόπορτα για τους εισβολείς».

Οι ερευνητές ανέφεραν επίσης ότι τέτοια ευρήματα αποκλείουν τα ψευδώς θετικά. Αυτά, είπαν, είναι μια ακριβής αναπαράσταση της επικράτησης κακόβουλων μοντέλων στην πλατφόρμα.

Διαβάστε επίσης: Η Apple ανακατευθύνει την ομάδα αυτοκινήτου στην επιβράδυνση της αγοράς AI Post-EV

Τα παραδείγματα

Σύμφωνα με την αναφορά του JFrog, μία από τις «ανησυχητικές» περιπτώσεις αφορά α PyTorch μοντέλο. Το μοντέλο φέρεται να ανέβηκε από έναν χρήστη που προσδιορίστηκε ως "baller423", το οποίο στη συνέχεια διαγράφηκε από την πλατφόρμα Hugging Face.

Κατά την περαιτέρω εξέταση του μοντέλου, οι ερευνητές παρατήρησαν ότι περιείχε ένα κακόβουλο ωφέλιμο φορτίο, επιτρέποντάς του να δημιουργήσει ένα αντίστροφο κέλυφος σε έναν καθορισμένο κεντρικό υπολογιστή (210.117.212.93).

Ο ανώτερος ερευνητής ασφάλειας της JFrog, Ντέιβιντ Κοέν, δήλωσε: «(Είναι) πιο παρεμβατικό και δυνητικά κακόβουλο, καθώς δημιουργεί μια άμεση σύνδεση με έναν εξωτερικό διακομιστή, υποδεικνύοντας μια πιθανή απειλή για την ασφάλεια και όχι μια απλή επίδειξη ευπάθειας», έγραψε.

Αυτό αξιοποιεί τη «μέθοδο '_reduce_' της μονάδας pickle της Python για την εκτέλεση αυθαίρετου κώδικα κατά τη φόρτωση του αρχείου μοντέλου, παρακάμπτοντας ουσιαστικά τις συμβατικές μεθόδους ανίχνευσης."

Οι ερευνητές αναγνώρισαν επίσης ότι το ίδιο ωφέλιμο φορτίο δημιουργούσε συνδέσεις με διαφορετικές διευθύνσεις IP, «υποδηλώνοντας ότι οι χειριστές μπορεί να είναι ερευνητές και όχι κακόβουλοι χάκερ».

Μια κλήση αφύπνισης

Η ομάδα του JFrog σημείωσε ότι τα ευρήματα είναι μια κλήση αφύπνισης για το Hugging Face, δείχνοντας ότι η πλατφόρμα του είναι επιρρεπής σε χειραγώγηση και πιθανές απειλές.

«Αυτά τα περιστατικά χρησιμεύουν ως οδυνηρές υπενθυμίσεις των συνεχιζόμενων απειλών που αντιμετωπίζουν τα αποθετήρια Hugging Face και άλλα δημοφιλή αποθετήρια όπως το Kaggle, τα οποία θα μπορούσαν ενδεχομένως να θέσουν σε κίνδυνο το απόρρητο και την ασφάλεια των οργανισμών που χρησιμοποιούν αυτούς τους πόρους, εκτός από προκλήσεις για τους μηχανικούς AI/ML», είπε. οι ερευνητές.

Αυτό έρχεται ως η κυβερνοασφάλεια απειλεί την παγκοσμίως αυξάνονται, τροφοδοτούμενοι από τον πολλαπλασιασμό των εργαλείων τεχνητής νοημοσύνης, με κακούς ηθοποιούς να τα καταχρώνται για κακόβουλες προθέσεις. Οι χάκερ χρησιμοποιούν επίσης τεχνητή νοημοσύνη για να προωθήσουν επιθέσεις phishing και να ξεγελάσουν τους ανθρώπους.

Ωστόσο, η ομάδα JFrog έκανε άλλες ανακαλύψεις.

Μια παιδική χαρά για ερευνητές

Οι ερευνητές σημείωσαν επίσης ότι Αγκαλιάζοντας το πρόσωπο έχει εξελιχθεί σε μια παιδική χαρά για τους ερευνητές «που επιθυμούν να καταπολεμήσουν τις αναδυόμενες απειλές, όπως αποδεικνύεται από την ποικιλία των τακτικών για την παράκαμψη των μέτρων ασφαλείας της».

Για παράδειγμα, το ωφέλιμο φορτίο που ανέβηκε από το "baller423" ξεκίνησε μια αντίστροφη σύνδεση κελύφους σε μια περιοχή διευθύνσεων IP που ανήκει στο Kreonet (Κορέα Ερευνητικό Περιβάλλον Ανοικτό Δίκτυο).

Σύμφωνα με Σκοτεινή ανάγνωση, Το Kreonet είναι ένα δίκτυο υψηλής ταχύτητας στη Νότια Κορέα που υποστηρίζει προηγμένες ερευνητικές και εκπαιδευτικές δραστηριότητες. «Ως εκ τούτου, είναι πιθανό ερευνητές ή επαγγελματίες τεχνητής νοημοσύνης να βρίσκονται πίσω από το μοντέλο».

«Μπορούμε να δούμε ότι τα περισσότερα «κακόβουλα» ωφέλιμα φορτία είναι στην πραγματικότητα απόπειρες ερευνητών ή/και bug bounty για την εκτέλεση κώδικα για φαινομενικά νόμιμους σκοπούς», είπε ο Cohen.

Παρά τους νόμιμους σκοπούς, η ομάδα του JFrog, ωστόσο, προειδοποίησε ότι οι στρατηγικές που εφαρμόζουν οι ερευνητές αποδεικνύουν ξεκάθαρα ότι πλατφόρμες όπως το Hugging Face είναι ανοιχτές σε επιθέσεις εφοδιαστικής αλυσίδας. Αυτά, σύμφωνα με την ομάδα, μπορούν να προσαρμοστούν για να επικεντρωθούν σε συγκεκριμένα δημογραφικά στοιχεία, όπως μηχανικοί τεχνητής νοημοσύνης ή ML.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- PlatoHealth. Ευφυΐα βιοτεχνολογίας και κλινικών δοκιμών. Πρόσβαση εδώ.

- πηγή: https://metanews.com/over-100-malicious-code-execution-models-on-hugging-face-backdoors-users-devices/

- :έχει

- :είναι

- :δεν

- 100

- 210

- 212

- 7

- 9

- a

- Σχετικα

- Σύμφωνα με

- ακριβής

- δραστηριοτήτων

- φορείς

- πραγματικά

- Επιπλέον

- διεύθυνση

- διευθύνσεις

- εκ των προτέρων

- προηγμένες

- AI

- Μοντέλα AI

- Πλατφόρμα AI

- AI / ML

- Επίσης

- an

- αναλύσει

- αναλύοντας

- και

- εφαρμογές

- αυθαίρετος

- ΕΙΝΑΙ

- Παράταξη

- άρθρο

- AS

- επίθεση

- Επιθέσεις

- Προσπάθειες

- διαθέσιμος

- κερκόπορτα

- Κακός

- BE

- ήταν

- πίσω

- ανήκει

- γενναιοδωρία

- Έντομο

- bug bounty

- by

- παρακάμψει

- κλήση

- CAN

- ικανός

- αυτοκίνητο

- περιπτώσεις

- προκλήσεις

- σαφώς

- CO

- κωδικός

- Cohen

- την καταπολέμηση της

- έρχεται

- συμβιβασμός

- χρήση υπολογιστή

- σύνδεση

- Διασυνδέσεις

- που περιέχονται

- συμβατικός

- θα μπορούσε να

- δημιουργία

- δημιουργία

- προσαρμοσμένη

- σύνολα δεδομένων

- Δαβίδ

- Δημογραφικά στοιχεία

- αποδεικνύουν

- κατέδειξε

- Παρά

- Ανίχνευση

- αναπτύχθηκε

- διαφορετικές

- κατευθύνει

- ανακάλυψαν

- διάφορα

- κάνει

- κατεβάσετε

- εκπαιδευτικών

- αποτελεσματικά

- σμυριδόπετρα

- μισθωτών

- ενεργοποιήσετε

- δίνει τη δυνατότητα

- ενεργοποίηση

- Μηχανικοί

- Περιβάλλον

- εγκαθιδρύω

- καθιερώνει

- εξελίχθηκε

- Εξετάζοντας

- εκτελέσει

- εκτέλεσης

- εκτέλεση

- υφιστάμενα

- εξωτερικός

- Πρόσωπο

- αντιμέτωπος

- γεγονός

- ψευδής

- Αρχεία

- ευρήματα

- Συγκέντρωση

- Για

- μορφή

- από

- τροφοδοτούνται

- λειτουργικότητα

- περαιτέρω

- παίρνω

- Μεγαλώνοντας

- χάκερ

- επιβλαβής

- Έχω

- he

- Ψηλά

- Επισημάνετε

- οικοδεσπότης

- φιλοξενείται

- Πως

- Ωστόσο

- HTTPS

- προσδιορίζονται

- υλοποιεί

- in

- Αυξάνουν

- υποδεικνύεται

- υποδηλώνει

- υποδεικνύοντας

- ξεκίνησε

- κάνω ένεση

- παράδειγμα

- προθέσεις

- σε

- ενοχλητικό

- περιλαμβάνει

- IP

- Διεύθυνση IP

- Διευθύνσεις IP

- IT

- ΤΟΥ

- jpg

- keras

- Κορέα

- μάθηση

- νόμιμος

- μόχλευσης

- Μου αρέσει

- φόρτωση

- μηχανή

- μάθηση μηχανής

- μηχανήματα

- που

- κακόβουλο

- malware

- Χειρισμός

- αγορά

- max-width

- Ενδέχεται..

- μέτρα

- καταναλωτές

- μέθοδος

- μέθοδοι

- ML

- μοντέλο

- μοντέλα

- περισσότερο

- πλέον

- δίκτυο

- ιδιαίτερα

- Σημειώνεται

- of

- on

- ONE

- συνεχή

- επάνω σε

- ανοίξτε

- ανοιχτό δίκτυο

- φορείς

- or

- οργανώσεις

- ΑΛΛΑ

- έξω

- επί

- μέρος

- People

- Phishing

- επιθέσεις ηλεκτρονικού ψαρέματος

- πλατφόρμες

- Πλατφόρμες

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- παιδική χαρά

- Δημοφιλής

- δυνατός

- δυναμικού

- ενδεχομένως

- επικράτηση

- μυστικότητα

- Απορρήτου και Ασφάλεια

- δημοσίως

- σκοποί

- pytorch

- σειρά

- μάλλον

- Διάβασε

- αναγνωρισμένος

- αναφέρουν

- σύμφωνα με πληροφορίες

- αντιπροσώπευση

- έρευνα

- ερευνητής

- ερευνητές

- Υποστηρικτικό υλικό

- περιορίζω

- αντιστρέψει

- Κίνδυνος

- Είπε

- ίδιο

- σάρωσης

- ασφάλεια

- Μέτρα ασφαλείας

- δείτε

- φαινομενικώς

- αρχαιότερος

- εξυπηρετούν

- διακομιστής

- μοιράζονται

- κέλυφος

- επίδειξη

- Νότος

- Νότια Κορέα

- συγκεκριμένες

- καθορίζεται

- στρατηγικές

- Μελέτη

- Ακολούθως

- τέτοιος

- Στήριξη

- σύστημα

- τακτική

- tensorflow

- από

- ότι

- Η

- τους

- Τους

- Αυτοί

- αυτοί

- απειλή

- απειλές

- προς την

- εργαλεία

- τέχνασμα

- Φορτώθηκε

- επάνω σε

- χρήση

- Χρήστες

- Χρήστες

- χρησιμοποιώντας

- αξιοποιώντας

- ευπάθεια

- προειδοποίησε

- ήταν

- Ποιό

- επιθυμώ

- με

- κόσμος

- Έγραψε

- zephyrnet