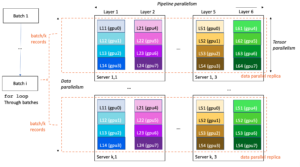

Η προεκπαίδευση του σύγχρονου μοντέλου συχνά απαιτεί μεγαλύτερη ανάπτυξη συμπλέγματος για μείωση του χρόνου και του κόστους. Σε επίπεδο διακομιστή, τέτοιοι φόρτοι εργασίας εκπαίδευσης απαιτούν ταχύτερους υπολογισμούς και αυξημένη κατανομή μνήμης. Καθώς τα μοντέλα αυξάνονται σε εκατοντάδες δισεκατομμύρια παραμέτρους, απαιτούν έναν κατανεμημένο μηχανισμό εκπαίδευσης που εκτείνεται σε πολλούς κόμβους (στιγμιότυπα).

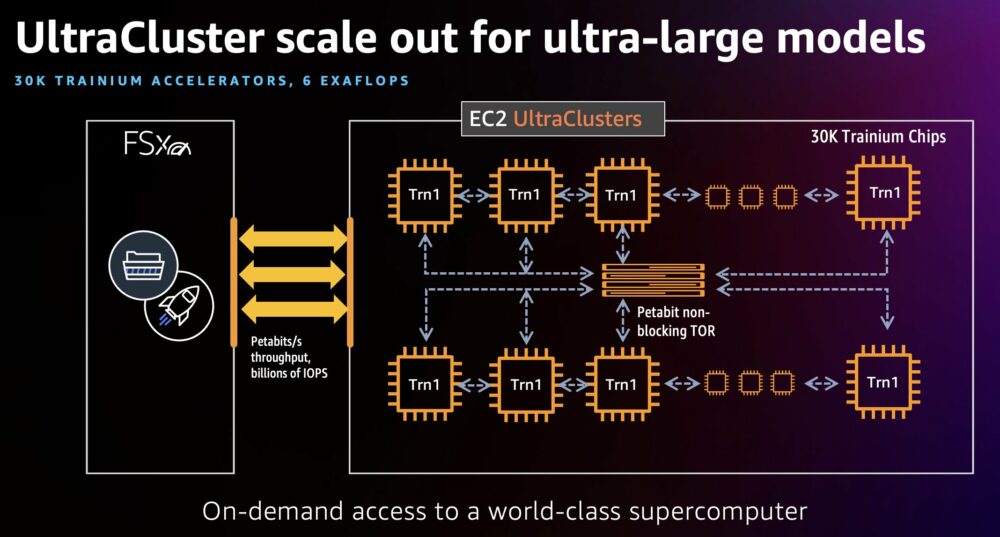

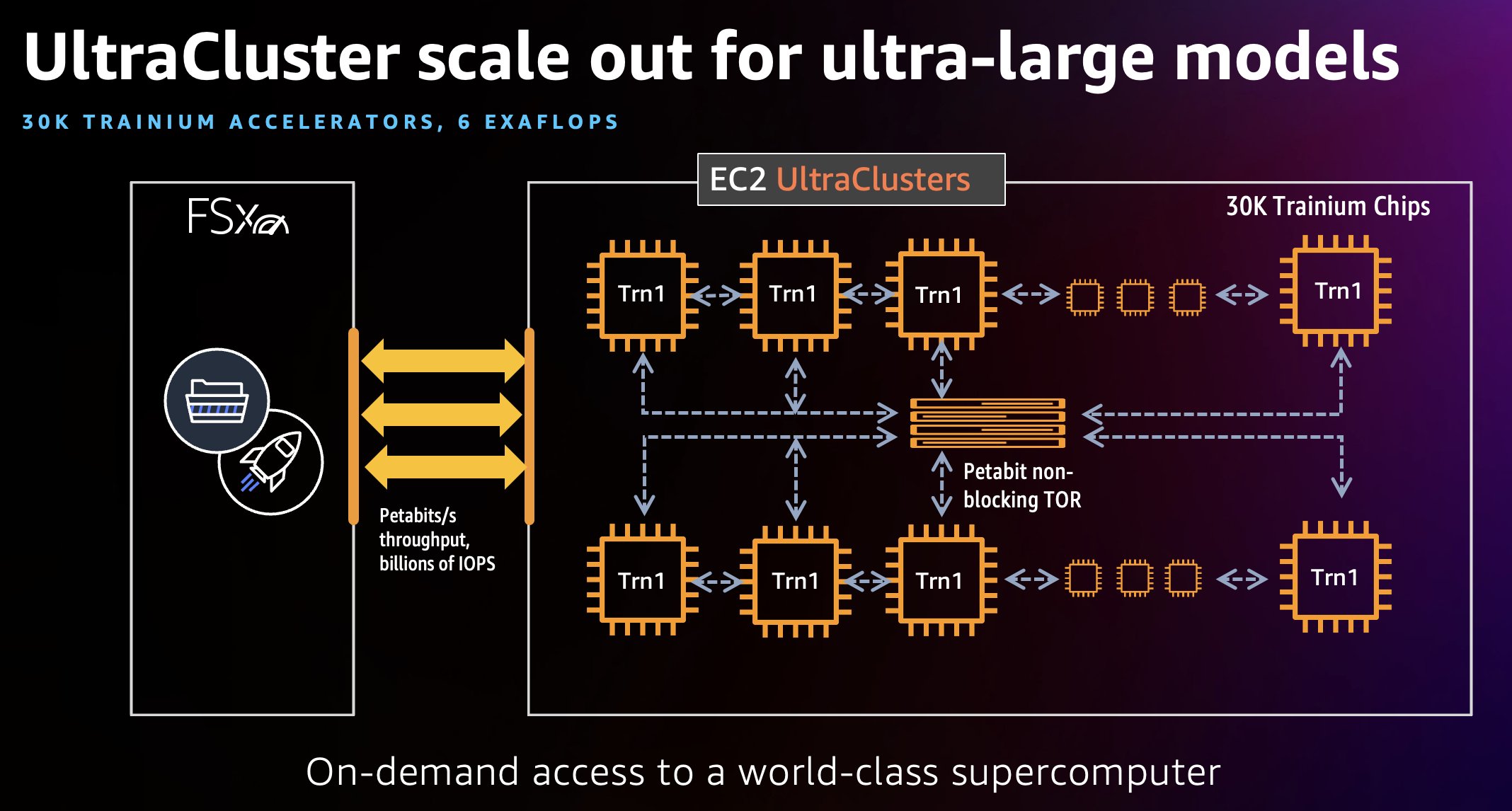

Τον Οκτώβριο του 2022 ξεκινήσαμε Περιπτώσεις Amazon EC2 Trn1, Τροφοδοτείται από Aws trainium, που είναι ο επιταχυντής μηχανικής μάθησης δεύτερης γενιάς που σχεδιάστηκε από την AWS. Τα στιγμιότυπα Trn1 έχουν κατασκευαστεί για σκοπούς εκπαίδευσης μοντέλων βαθιάς μάθησης υψηλής απόδοσης, ενώ προσφέρουν έως και 50% εξοικονόμηση κόστους-εκπαίδευσης σε σύγκριση με συγκρίσιμες παρουσίες που βασίζονται σε GPU. Προκειμένου να μειωθεί ο χρόνος εκπαίδευσης από εβδομάδες σε ημέρες ή από ημέρες σε ώρες και να διανεμηθεί η εργασία εκπαίδευσης ενός μεγάλου μοντέλου, μπορούμε να χρησιμοποιήσουμε ένα EC2 Trn1 UltraCluster, το οποίο αποτελείται από πυκνά συσκευασμένα, συστηματικά τοποθετημένα ράφια υπολογιστικών παρουσιών Trn1 όλα διασυνδεδεμένα με μη αποκλειστική δικτύωση κλίμακας petabyte. Είναι το μεγαλύτερο UltraCluster μέχρι σήμερα, που προσφέρει 6 exaflops υπολογιστικής ισχύος κατ' απαίτηση με έως και 30,000 τσιπ Trainium.

Σε αυτήν την ανάρτηση, χρησιμοποιούμε ένα φόρτο εργασίας προεκπαίδευσης μοντέλου Hugging Face BERT-Large ως απλό παράδειγμα για να εξηγήσουμε πώς να χρησιμοποιείτε τα Trn1 UltraClusters.

Trn1 UltraClusters

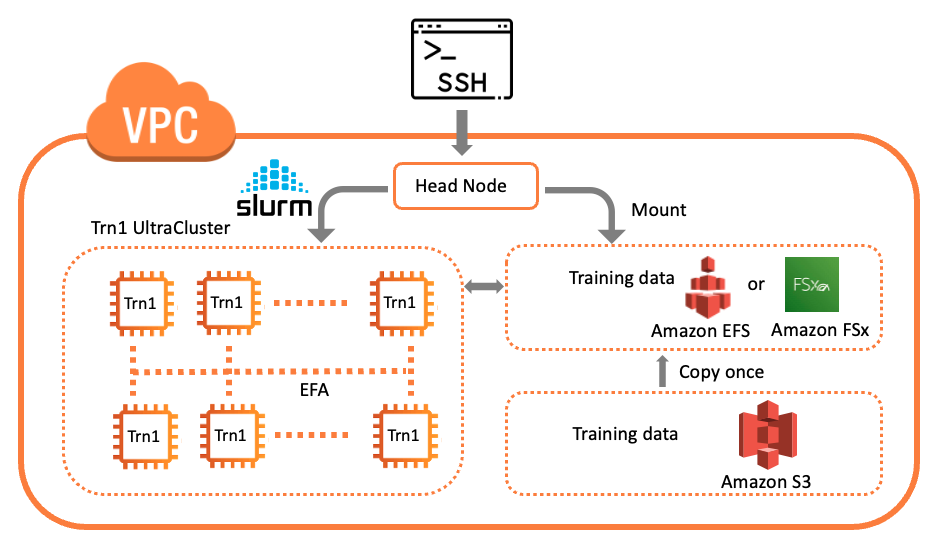

Το Trn1 UltraCluster είναι μια ομάδα τοποθέτησης παρουσιών Trn1 σε ένα κέντρο δεδομένων. Ως μέρος μιας μεμονωμένης εκτέλεσης συμπλέγματος, μπορείτε να περιστρέψετε ένα σύμπλεγμα παρουσιών Trn1 με επιταχυντές Trainium. Το παρακάτω διάγραμμα δείχνει ένα παράδειγμα.

Τα UltraClusters των παρουσιών Trn1 συγκεντρώνονται σε ένα κέντρο δεδομένων και διασυνδέονται χρησιμοποιώντας Elastic Fabric Adapter (EFA), η οποία είναι μια διεπαφή δικτύου χωρίς αποκλεισμό κλίμακας petabyte, με εύρος ζώνης δικτύου έως και 800 Gbps, που είναι διπλάσιο από το εύρος ζώνης που υποστηρίζεται από παρουσίες AWS P4d (1.6 Tbps, τέσσερις φορές μεγαλύτερο με τις επερχόμενες παρουσίες Trn1n). Αυτές οι διεπαφές EFA βοηθούν στην εκτέλεση φόρτων εργασίας μοντέλων εκπαίδευσης που χρησιμοποιούν τις συλλογικές βιβλιοθήκες επικοινωνίας Neuron σε κλίμακα. Τα Trn1 UltraClusters περιλαμβάνουν επίσης υπηρεσίες αποθήκευσης που συνδέονται με το δίκτυο, όπως Amazon FSx για λάμψη για να επιτραπεί η πρόσβαση υψηλής απόδοσης σε μεγάλα σύνολα δεδομένων, διασφαλίζοντας ότι τα cluster λειτουργούν αποτελεσματικά. Τα Trn1 UltraClusters μπορούν να φιλοξενήσουν έως και 30,000 συσκευές Trainium και να προσφέρουν έως και 6 exaflops υπολογισμού σε ένα μόνο σύμπλεγμα. Τα EC2 Trn1 UltraClusters παρέχουν έως και 6 exaflops υπολογισμού, κυριολεκτικά έναν υπερυπολογιστή κατ' απαίτηση, με ένα μοντέλο χρήσης pay-as-you-go. Σε αυτήν την ανάρτηση, χρησιμοποιούμε ορισμένα εργαλεία HPC όπως το Slurm για να ενισχύσουμε ένα UltraCluster και να διαχειριστούμε φόρτους εργασίας.

Επισκόπηση λύσεων

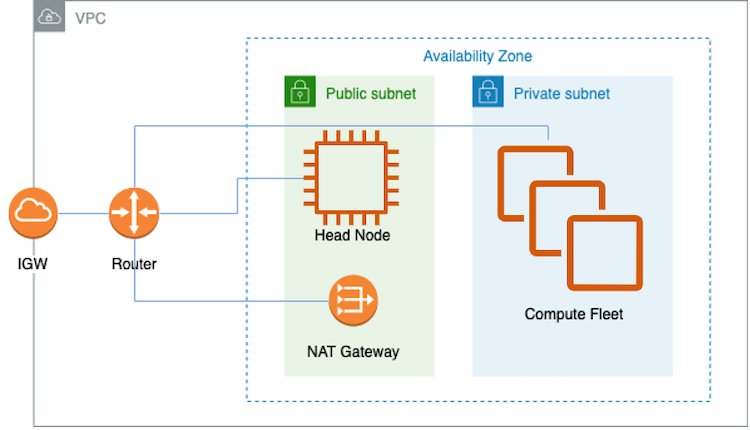

Το AWS προσφέρει μια μεγάλη ποικιλία υπηρεσιών για εκπαίδευση κατανεμημένων μοντέλων ή εξαγωγή συμπερασμάτων φόρτου εργασίας σε κλίμακα, συμπεριλαμβανομένων Παρτίδα AWS, Υπηρεσία Amazon Elastic Kubernetes (Amazon EKS) και UltraClusters. Αυτή η ανάρτηση εστιάζει στην εκπαίδευση μοντέλων σε ένα UltraCluster. Η λύση μας χρησιμοποιεί το AWS ParallelCluster εργαλείο διαχείρισης για τη δημιουργία της απαραίτητης υποδομής και περιβάλλοντος για την ανάπτυξη ενός Trn1 UltraCluster. Η υποδομή αποτελείται από έναν επικεφαλής κόμβο και πολλούς κόμβους υπολογισμού Trn1 μέσα σε ένα εικονικό ιδιωτικό σύννεφο (VPC). Χρησιμοποιούμε το Slurm ως σύστημα διαχείρισης συμπλέγματος και προγραμματισμού εργασιών. Το παρακάτω διάγραμμα απεικονίζει την αρχιτεκτονική λύσης μας.

Για περισσότερες λεπτομέρειες και τον τρόπο ανάπτυξης αυτής της λύσης, βλ Εκπαιδεύστε ένα μοντέλο στο AWS Trn1 ParallelCluster.

Ας δούμε μερικά σημαντικά βήματα αυτής της λύσης:

- Δημιουργήστε ένα VPC και υποδίκτυα.

- Διαμόρφωση του στόλου υπολογιστών.

- Δημιουργήστε το σύμπλεγμα.

- Επιθεωρήστε το σύμπλεγμα.

- Ξεκινήστε την εκπαιδευτική σας εργασία.

Προϋποθέσεις

Για να ακολουθήσετε μαζί με αυτήν την ανάρτηση, μια ευρεία εξοικείωση με βασικές υπηρεσίες AWS, όπως π.χ Amazon Elastic Compute Cloud (Amazon EC2) υπονοείται και η βασική εξοικείωση με τη βαθιά μάθηση και το PyTorch θα ήταν χρήσιμη.

Δημιουργήστε VPC και υποδίκτυα

Ένας εύκολος τρόπος για να δημιουργήσετε το VPC και τα υποδίκτυα είναι μέσω του Εικονικό ιδιωτικό σύννεφο Amazon Κονσόλα (Amazon VPC). Μπορείτε να βρείτε πλήρεις οδηγίες στο GitHub. Αφού εγκατασταθούν το VPC και τα υποδίκτυα, πρέπει να ρυθμίσετε τις παραμέτρους των παρουσιών στον στόλο υπολογιστών. Εν συντομία, αυτό γίνεται δυνατό από ένα σενάριο εγκατάστασης που καθορίζεται από το CustomActions στο αρχείο YAML που χρησιμοποιείται για τη δημιουργία του ParallelCluster (βλ. Δημιουργία ParallelCluster). Ένα ParallelCluster απαιτεί ένα VPC που έχει δύο υποδίκτυα και μια πύλη μετάφρασης διεύθυνσης δικτύου (NAT), όπως φαίνεται στο προηγούμενο διάγραμμα αρχιτεκτονικής. Αυτό το VPC πρέπει να βρίσκεται στις Ζώνες Διαθεσιμότητας όπου είναι διαθέσιμες οι παρουσίες Trn1. Επίσης, σε αυτό το VPC, πρέπει να έχετε ένα δημόσιο υποδίκτυο και ένα ιδιωτικό υποδίκτυο για να συγκρατούν τον κόμβο κεφαλής και τον κόμβο υπολογισμού Trn1, αντίστοιχα. Χρειάζεστε επίσης μια πύλη NAT πρόσβαση στο Διαδίκτυο, έτσι ώστε οι υπολογιστικοί κόμβοι Trn1 να μπορούν να κάνουν λήψη AWS Neuron πακέτα. Γενικά, οι κόμβοι υπολογιστών θα λαμβάνουν ενημερώσεις για τα πακέτα λειτουργικού συστήματος, το πρόγραμμα οδήγησης Neuron και το χρόνο εκτέλεσης και το πρόγραμμα οδήγησης EFA για εκπαίδευση πολλαπλών περιπτώσεων.

Όσον αφορά τον κόμβο κεφαλής, εκτός από τα προαναφερθέντα στοιχεία για τους κόμβους υπολογισμού, λαμβάνει επίσης τον μεταγλωττιστή PyTorch-NeuronX και NeuronX, ο οποίος επιτρέπει τη διαδικασία μεταγλώττισης μοντέλων σε συσκευές XLA όπως το Trainium.

Διαμόρφωση του στόλου υπολογιστών

Στο αρχείο YAML για τη δημιουργία του Trn1 UltraCluster, InstanceType καθορίζεται ως trn1.32xlarge. MaxCount και MinCount χρησιμοποιούνται για να υποδείξουν το εύρος μεγέθους υπολογιστικού στόλου σας. Μπορείτε να χρησιμοποιήσετε MinCount για να διατηρήσετε κάποιες ή όλες τις παρουσίες Trn1 διαθέσιμες ανά πάσα στιγμή. MinCount μπορεί να οριστεί στο μηδέν, έτσι ώστε αν δεν υπάρχει εργασία που εκτελείται, οι παρουσίες Trn1 απελευθερώνονται από αυτό το σύμπλεγμα.

Το Trn1 μπορεί επίσης να αναπτυχθεί σε ένα UltraCluster με πολλαπλές ουρές. Στο παρακάτω παράδειγμα, δημιουργείται μόνο μία ουρά για την υποβολή εργασίας Slurm:

Εάν χρειάζεστε περισσότερες από μία ουρές, μπορείτε να καθορίσετε πολλές InstanceType, το καθένα με το δικό του MaxCount, MinCount, να Name:

Εδώ, δημιουργούνται δύο ουρές, έτσι ώστε ο χρήστης να έχει την ευελιξία να επιλέξει τους πόρους για την εργασία του Slurm.

Δημιουργήστε το σύμπλεγμα

Για να εκκινήσετε ένα Trn1 UltraCluster, χρησιμοποιήστε τα παρακάτω pcluster εντολή από όπου σας Εργαλείο ParallelCluster είναι εγκατεστημένο:

Χρησιμοποιούμε τις ακόλουθες επιλογές σε αυτήν την εντολή:

--cluster-configuration– Αυτή η επιλογή αναμένει ένα αρχείο YAML που περιγράφει τη διαμόρφωση του συμπλέγματος-n(Ή--cluster-name) – Το όνομα αυτού του συμπλέγματος

Αυτή η εντολή δημιουργεί ένα σύμπλεγμα Trn1 στον λογαριασμό σας AWS. Μπορείτε να ελέγξετε την πρόοδο της δημιουργίας συμπλέγματος στο AWS CloudFormation κονσόλα. Για περισσότερες πληροφορίες, ανατρέξτε στο Χρησιμοποιώντας την κονσόλα AWS CloudFormation.

Εναλλακτικά, μπορείτε να χρησιμοποιήσετε την ακόλουθη εντολή για να δείτε την κατάσταση του αιτήματός σας:

και η εντολή θα δείξει την κατάσταση, για παράδειγμα:

Οι παρακάτω είναι παράμετροι που ενδιαφέρουν την έξοδο:

- InstanceId – Αυτό είναι το αναγνωριστικό παρουσίας του κύριου κόμβου, το οποίο θα εμφανίζεται στην κονσόλα Amazon EC2

- computeFleetStatus – Αυτό το χαρακτηριστικό υποδεικνύει την ετοιμότητα των κόμβων υπολογισμού

- Ετικέτες – Αυτό το χαρακτηριστικό υποδεικνύει την έκδοση του

pclusterεργαλείο που χρησιμοποιήθηκε για τη δημιουργία αυτού του συμπλέγματος

Επιθεωρήστε το σύμπλεγμα

Μπορείτε να χρησιμοποιήσετε τα προαναφερθέντα pcluster describe-cluster εντολή για έλεγχο του συμπλέγματος. Αφού δημιουργηθεί το σύμπλεγμα, θα παρατηρήσετε τα εξής στην έξοδο:

Σε αυτό το σημείο, μπορείτε να SSH στον κόμβο κεφαλής (που προσδιορίζεται από το αναγνωριστικό παράδειγμα στην κονσόλα Amazon EC2). Το παρακάτω είναι ένα λογικό διάγραμμα του συμπλέγματος.

Αφού εισαγάγετε το SSH στον κόμβο κεφαλής, μπορείτε να επαληθεύσετε τον στόλο υπολογιστών και την κατάστασή του με μια εντολή Slurm, όπως π.χ. sinfo για να δείτε τις πληροφορίες κόμβου για το σύστημα. Το παρακάτω είναι ένα παράδειγμα εξόδου:

Αυτό δείχνει ότι υπάρχει μία ουρά όπως φαίνεται από ένα μεμονωμένο διαμέρισμα. Υπάρχουν 16 διαθέσιμοι κόμβοι και διατίθενται πόροι. Από τον επικεφαλής κόμβο, μπορείτε να SSH σε οποιονδήποτε δεδομένο κόμβο υπολογισμού:

Χρήση exit για να επιστρέψετε στον κόμβο της κεφαλής.

Ομοίως, μπορείτε να SSH σε έναν κόμβο υπολογισμού από έναν άλλο κόμβο υπολογιστών. Κάθε υπολογιστικός κόμβος έχει εγκατεστημένα εργαλεία Neuron, όπως π.χ neuron-top. Μπορείτε να επικαλεστείτε neuron-top κατά τη διάρκεια της εκτέλεσης του σεναρίου εκπαίδευσης για να επιθεωρήσετε τη χρήση του NeuronCore σε κάθε κόμβο.

Ξεκινήστε την εκπαιδευτική σας εργασία

Χρησιμοποιούμε το Hugging Face BERT-Μεγάλο φροντιστήριο προπόνησης ως παράδειγμα για εκτέλεση σε αυτό το σύμπλεγμα. Μετά τη λήψη των δεδομένων εκπαίδευσης και των σεναρίων στο σύμπλεγμα, χρησιμοποιούμε τον ελεγκτή Slurm για να διαχειριστούμε και να ενορχηστρώσουμε τον φόρτο εργασίας μας. Υποβάλλουμε την εργασία εκπαίδευσης με το sbatch εντολή. Το σενάριο φλοιού καλεί το σενάριο Python μέσω του neuron_parallel_compile API για τη μεταγλώττιση του μοντέλου σε γραφήματα χωρίς πλήρη εκτέλεση εκπαίδευσης. Δείτε τον παρακάτω κώδικα:

Χρησιμοποιούμε τις ακόλουθες επιλογές σε αυτήν την εντολή:

--exclusive– Αυτή η εργασία θα χρησιμοποιεί όλους τους κόμβους και δεν θα μοιράζεται κόμβους με άλλες εργασίες κατά την εκτέλεση της τρέχουσας εργασίας.--nodes– Ο αριθμός των κόμβων για αυτήν την εργασία.--wrap– Αυτό ορίζει μια συμβολοσειρά εντολών που εκτελείται από τον ελεγκτή Slurm. Σε αυτή την περίπτωση, απλώς μεταγλωττίζει το μοντέλο παράλληλα χρησιμοποιώντας όλους τους κόμβους.

Μετά την επιτυχή μεταγλώττιση του μοντέλου, μπορείτε να ξεκινήσετε την πλήρη εργασία εκπαίδευσης με την ακόλουθη εντολή:

Αυτή η εντολή θα ξεκινήσει την εργασία εκπαίδευσης για το μοντέλο BERT-Large Hugging Face. Με 16 κόμβους Trn1.32xlarge, μπορείτε να περιμένετε να ολοκληρωθεί σε λιγότερο από 8 ώρες.

Σε αυτό το σημείο, μπορείτε να χρησιμοποιήσετε μια εντολή Slurm όπως π.χ squeue να επιθεωρήσει την υποβληθείσα εργασία. Ένα παράδειγμα εξόδου είναι το εξής:

Αυτή η έξοδος δείχνει ότι η εργασία εκτελείται (R) σε 16 κόμβους υπολογισμού.

Καθώς η εργασία εκτελείται, τα αποτελέσματα καταγράφονται και προστίθενται σε ένα αρχείο καταγραφής Slurm. Από το τερματικό του κύριου κόμβου, μπορείτε να το επιθεωρήσετε σε πραγματικό χρόνο.

Επίσης, στον ίδιο κατάλογο με το αρχείο καταγραφής Slurm, υπάρχει ένας αντίστοιχος κατάλογος για αυτήν την εργασία. Αυτός ο κατάλογος περιλαμβάνει τα ακόλουθα (για παράδειγμα):

Αυτός ο κατάλογος είναι προσβάσιμος σε όλους τους κόμβους υπολογιστών. results.json καταγράφει τα μεταδεδομένα αυτής της συγκεκριμένης εκτέλεσης εργασίας, όπως τη διαμόρφωση του μοντέλου, το μέγεθος παρτίδας, τα συνολικά βήματα, τα βήματα συσσώρευσης διαβάθμισης και το όνομα συνόλου δεδομένων εκπαίδευσης. Το σημείο ελέγχου μοντέλου και το αρχείο καταγραφής εξόδου ανά κάθε κόμβο υπολογιστών καταγράφονται επίσης σε αυτόν τον κατάλογο.

Εξετάστε την επεκτασιμότητα του συμπλέγματος

Σε ένα Trn1 UltraCluster, πολλαπλές διασυνδεδεμένες περιπτώσεις Trn1 εκτελούν παράλληλα μεγάλο φόρτο εργασίας εκπαίδευσης μοντέλων και μειώνουν τον συνολικό χρόνο υπολογισμού ή τον χρόνο σύγκλισης. Υπάρχουν δύο μέτρα επεκτασιμότητας ενός συμπλέγματος: ισχυρή απολέπιση και αδύναμη απολέπιση. Τυπικά, για την εκπαίδευση μοντέλων, η ανάγκη είναι να επιταχυνθεί η εκτέλεση της εκπαίδευσης, επειδή το κόστος χρήσης καθορίζεται από την απόδοση δείγματος για γύρους ενημερώσεων κλίσης. Η ισχυρή κλιμάκωση αναφέρεται στο σενάριο όπου το συνολικό μέγεθος του προβλήματος παραμένει το ίδιο καθώς αυξάνεται ο αριθμός των επεξεργαστών, η ισχυρή κλιμάκωση είναι ένα σημαντικό μέτρο επεκτασιμότητας για την εκπαίδευση μοντέλων. Κατά την αξιολόγηση της ισχυρής κλιμάκωσης, (δηλ. τον αντίκτυπο της παραλληλοποίησης), θέλουμε να διατηρήσουμε το παγκόσμιο μέγεθος παρτίδας ίδιο και να δούμε πόσο χρόνο χρειάζεται για τη σύγκλιση. Σε ένα τέτοιο σενάριο, πρέπει να προσαρμόσουμε το μικρο-βήμα συσσώρευσης κλίσης σύμφωνα με τον αριθμό των κόμβων υπολογισμού. Αυτό επιτυγχάνεται με τα ακόλουθα στο σενάριο του κελύφους εκπαίδευσης run_dp_bert_large_hf_pretrain_bf16_s128.sh:

Από την άλλη πλευρά, εάν θέλετε να αξιολογήσετε πόσοι περισσότεροι φόρτοι εργασίας μπορούν να εκτελεστούν σε καθορισμένο χρόνο προσθέτοντας περισσότερους κόμβους, χρησιμοποιήστε ασθενή κλίμακα για να μετρήσετε την επεκτασιμότητα. Σε ασθενή κλιμάκωση, το μέγεθος του προβλήματος αυξάνεται με τον ίδιο ρυθμό με τον αριθμό των NeuronCoress, διατηρώντας έτσι την ποσότητα εργασίας ανά NeuronCores ίδια. Για να αξιολογήσετε την ασθενή κλιμάκωση ή την επίδραση της προσθήκης περισσότερων κόμβων στον αυξημένο φόρτο εργασίας, απλώς αφαιρέστε την παραπάνω γραμμή από το σενάριο εκπαίδευσης και διατηρήστε τον αριθμό των βημάτων για τη συσσώρευση διαβάθμισης σταθερό με μια προεπιλεγμένη τιμή (32) που παρέχεται στο σενάριο εκπαίδευσης.

Αξιολογήστε τα αποτελέσματά σας

Παρέχουμε ορισμένα αποτελέσματα αναφοράς στο Σελίδα απόδοσης νευρώνων για να δείξετε την επίδραση της κλιμάκωσης. Τα δεδομένα καταδεικνύουν το όφελος από τη χρήση πολλαπλών περιπτώσεων για τον παραλληλισμό της εργασίας εκπαίδευσης για πολλά διαφορετικά μεγάλα μοντέλα για εκπαίδευση σε κλίμακα.

Καθαρίστε την υποδομή σας

Για να διαγράψετε όλη την υποδομή αυτού του UltraCluster, χρησιμοποιήστε το pcluster εντολή για τη διαγραφή του συμπλέγματος και των πόρων του:

Συμπέρασμα

Σε αυτήν την ανάρτηση, συζητήσαμε πώς η κλιμάκωση της εργασίας προπόνησής σας σε ένα Trn1-UltraCluster, το οποίο τροφοδοτείται από επιταχυντές Trainium στο AWS, μειώνει τον χρόνο εκπαίδευσης ενός μοντέλου. Δώσαμε επίσης έναν σύνδεσμο προς το Αποθήκη δειγμάτων νευρώνων, το οποίο περιέχει οδηγίες για τον τρόπο ανάπτυξης μιας κατανεμημένης εργασίας εκπαίδευσης για ένα μοντέλο BERT-Large. Το Trn1-UltraCluster εκτελεί κατανεμημένους φόρτους εργασίας εκπαίδευσης για να εκπαιδεύσει εξαιρετικά μεγάλα μοντέλα βαθιάς εκμάθησης σε κλίμακα. Μια κατανεμημένη διάταξη εκπαίδευσης έχει ως αποτέλεσμα πολύ πιο γρήγορη σύγκλιση μοντέλων σε σύγκριση με την εκπαίδευση σε μία μόνο παρουσία Trn1.

Για να μάθετε περισσότερα σχετικά με το πώς να ξεκινήσετε με παρουσίες Trn1 που τροφοδοτούνται από Trainium, επισκεφθείτε τη διεύθυνση Τεκμηρίωση νευρώνων.

Σχετικά με τους Συγγραφείς

KC Tung είναι Senior Solution Architect στα AWS Annapurna Labs. Ειδικεύεται στην εκπαίδευση και ανάπτυξη μοντέλων μεγάλης βαθιάς μάθησης σε κλίμακα στο cloud. Έχει Ph.D. στη μοριακή βιοφυσική από το University of Texas Southwestern Medical Center στο Ντάλας. Έχει μιλήσει σε AWS Summits και AWS Reinvent. Σήμερα βοηθά τους πελάτες να εκπαιδεύσουν και να αναπτύξουν μεγάλα μοντέλα PyTorch και TensorFlow στο AWS cloud. Είναι συγγραφέας δύο βιβλίων: Μάθετε το TensorFlow Enterprise και Αναφορά TensorFlow 2 Pocket.

KC Tung είναι Senior Solution Architect στα AWS Annapurna Labs. Ειδικεύεται στην εκπαίδευση και ανάπτυξη μοντέλων μεγάλης βαθιάς μάθησης σε κλίμακα στο cloud. Έχει Ph.D. στη μοριακή βιοφυσική από το University of Texas Southwestern Medical Center στο Ντάλας. Έχει μιλήσει σε AWS Summits και AWS Reinvent. Σήμερα βοηθά τους πελάτες να εκπαιδεύσουν και να αναπτύξουν μεγάλα μοντέλα PyTorch και TensorFlow στο AWS cloud. Είναι συγγραφέας δύο βιβλίων: Μάθετε το TensorFlow Enterprise και Αναφορά TensorFlow 2 Pocket.

Jeffrey Huynh είναι Κύριος Μηχανικός στο AWS Annapurna Labs. Είναι παθιασμένος με το να βοηθά τους πελάτες να εκτελούν τον φόρτο εργασίας τους εκπαίδευσης και συμπερασμάτων σε συσκευές επιτάχυνσης Trainium και Inferentia χρησιμοποιώντας AWS Neuron SDK. Είναι απόφοιτος του Caltech/Stanford με πτυχία Φυσικής και EE. Του αρέσει το τρέξιμο, το τένις, η μαγειρική και η ανάγνωση για την επιστήμη και την τεχνολογία.

Jeffrey Huynh είναι Κύριος Μηχανικός στο AWS Annapurna Labs. Είναι παθιασμένος με το να βοηθά τους πελάτες να εκτελούν τον φόρτο εργασίας τους εκπαίδευσης και συμπερασμάτων σε συσκευές επιτάχυνσης Trainium και Inferentia χρησιμοποιώντας AWS Neuron SDK. Είναι απόφοιτος του Caltech/Stanford με πτυχία Φυσικής και EE. Του αρέσει το τρέξιμο, το τένις, η μαγειρική και η ανάγνωση για την επιστήμη και την τεχνολογία.

Shruti Koparkar είναι Ανώτερος Διευθυντής Μάρκετινγκ Προϊόντων στην AWS. Βοηθά τους πελάτες να εξερευνήσουν, να αξιολογήσουν και να υιοθετήσουν υποδομή υπολογιστών EC2 για τις ανάγκες μηχανικής εκμάθησης.

Shruti Koparkar είναι Ανώτερος Διευθυντής Μάρκετινγκ Προϊόντων στην AWS. Βοηθά τους πελάτες να εξερευνήσουν, να αξιολογήσουν και να υιοθετήσουν υποδομή υπολογιστών EC2 για τις ανάγκες μηχανικής εκμάθησης.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- Platoblockchain. Web3 Metaverse Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- πηγή: https://aws.amazon.com/blogs/machine-learning/scaling-large-language-model-llm-training-with-amazon-ec2-trn1-ultraclusters/

- 000

- 1

- 10

- 100

- 2022

- 7

- 9

- a

- ΠΛΗΡΟΦΟΡΙΕΣ

- πάνω από

- επιτάχυνση

- επιταχυντής

- επιταχυντές

- πρόσβαση

- προσιτός

- Σύμφωνα με

- Λογαριασμός

- συσσώρευση

- επιτευχθεί

- απέναντι

- Επιπλέον

- διεύθυνση

- ενστερνίζομαι

- Μετά το

- Όλα

- διατεθεί

- κατανομή

- Amazon

- Amazon EC2

- ποσό

- και

- Άλλος

- api

- αρχιτεκτονική

- συγγραφέας

- διαθεσιμότητα

- διαθέσιμος

- AWS

- AWS CloudFormation

- πίσω

- εύρος ζώνης

- βασικός

- επειδή

- είναι

- αναφοράς

- όφελος

- δισεκατομμύρια

- Βιοφυσικής

- Βιβλία

- εν συντομία

- φέρω

- ευρύς

- χτισμένο

- κλήσεις

- συλλαμβάνει

- περίπτωση

- Κέντρο

- έλεγχος

- τσιπ

- Επιλέξτε

- Backup

- συστάδα

- κωδικός

- Συλλογική

- Επικοινωνία

- συγκρίσιμος

- σύγκριση

- πλήρης

- εξαρτήματα

- υπολογισμός

- Υπολογίστε

- χρήση υπολογιστή

- διαμόρφωση

- πρόξενος

- σταθερός

- Περιέχει

- ελεγκτής

- Σύγκλιση

- πυρήνας

- Αντίστοιχος

- Κόστος

- δημιουργία

- δημιουργήθηκε

- δημιουργεί

- δημιουργία

- δημιουργία

- Ρεύμα

- Πελάτες

- Ντάλας

- ημερομηνία

- Κέντρο δεδομένων

- σύνολα δεδομένων

- Ημερομηνία

- Ημ.

- βαθύς

- βαθιά μάθηση

- Προεπιλογή

- Ορίζει

- παραδώσει

- Ζήτηση

- αποδεικνύουν

- καταδεικνύει

- παρατάσσω

- αναπτυχθεί

- ανάπτυξη

- σχεδιασμένα

- καθέκαστα

- αποφασισμένος

- Συσκευές

- διαφορετικές

- συζήτηση

- διανέμω

- διανέμονται

- κατανεμημένη εκπαίδευση

- κάτω

- κατεβάσετε

- οδηγός

- κατά την διάρκεια

- κάθε

- αποτέλεσμα

- αποτελεσματικά

- ενεργοποιήσετε

- δίνει τη δυνατότητα

- μηχανικός

- εξασφαλίζοντας

- Περιβάλλον

- αξιολογήσει

- αξιολογώντας

- παράδειγμα

- αναμένω

- αναμένει

- Εξηγήστε

- διερευνήσει

- ύφασμα

- Πρόσωπο

- Εξοικείωση

- γρηγορότερα

- Αρχεία

- καθορίζεται

- ΣΤΟΛΟΣ

- Ευελιξία

- εστιάζει

- ακολουθήστε

- Εξής

- εξής

- Βρέθηκαν

- από

- πλήρη

- πύλη

- General

- γενεά

- παίρνω

- Git

- δεδομένου

- Παγκόσμιο

- γραφικές παραστάσεις

- μεγαλύτερη

- Group

- Grow

- χέρι

- κεφάλι

- βοήθεια

- χρήσιμο

- βοήθεια

- βοηθά

- Ψηλά

- υψηλή απόδοση

- κρατήστε

- οικοδεσπότης

- ΩΡΕΣ

- Πως

- Πώς να

- hpc

- HTML

- HTTPS

- Εκατοντάδες

- ID

- προσδιορίζονται

- Επίπτωση

- σιωπηρή

- σημαντικό

- in

- περιλαμβάνουν

- περιλαμβάνει

- Συμπεριλαμβανομένου

- αυξημένη

- Αυξήσεις

- υποδεικνύω

- υποδηλώνει

- Άπειρος

- πληροφορίες

- Υποδομή

- εγκατασταθεί

- παράδειγμα

- οδηγίες

- διασυνδεδεμένα

- τόκος

- περιβάλλον λειτουργίας

- διεπαφές

- Internet

- Πρόσβαση στο Ίντερνετ

- επικαλείται

- IT

- Ιανουάριος

- Δουλειά

- Θέσεις εργασίας

- json

- Διατήρηση

- τήρηση

- Κλειδί

- Labs

- Γλώσσα

- large

- μεγαλύτερος

- μεγαλύτερη

- ξεκινήσει

- ξεκίνησε

- ΜΑΘΑΊΝΩ

- μάθηση

- Επίπεδο

- βιβλιοθήκες

- γραμμή

- LINK

- Εισηγμένες

- LLM

- λογικός

- ματιά

- μηχανή

- μάθηση μηχανής

- που

- διαχείριση

- διαχείριση

- διευθυντής

- πολοί

- Μάρκετινγκ

- μέτρο

- μέτρα

- μηχανισμός

- ιατρικών

- Μνήμη

- Μεταδεδομένα

- μοντέλο

- μοντέλα

- μοριακός

- περισσότερο

- πολλαπλούς

- όνομα

- απαραίτητος

- Ανάγκη

- ανάγκες

- δίκτυο

- δικτύωσης

- κόμβος

- κόμβων

- αριθμός

- παρατηρούμε

- Οκτώβριος

- προσφορά

- προσφορές

- ONE

- λειτουργούν

- Επιλογή

- Επιλογές

- τάξη

- OS

- ΑΛΛΑ

- δική

- Packages

- συσκευασμένα

- Παράλληλο

- παράμετροι

- μέρος

- Ειδικότερα

- παθιασμένος

- επίδοση

- Φυσική

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- Σημείο

- δυνατός

- Θέση

- δύναμη

- τροφοδοτείται

- Κύριος

- ιδιωτικός

- Πρόβλημα

- διαδικασια μας

- επεξεργαστές

- Προϊόν

- Πρόοδος

- παρέχουν

- παρέχεται

- δημόσιο

- σκοπός

- Python

- pytorch

- Αναβαθμίδα

- σειρά

- Τιμή

- Ετοιμότητα

- Ανάγνωση

- πραγματικός

- σε πραγματικό χρόνο

- λόγος

- λαμβάνω

- λαμβάνει

- μείωση

- μειώνει

- αναφέρεται

- περιοχή

- κυκλοφόρησε

- αφαιρέστε

- ζητήσει

- απαιτούν

- Απαιτεί

- Υποστηρικτικό υλικό

- Αποτελέσματα

- γύρους

- τρέξιμο

- τρέξιμο

- ίδιο

- Οικονομίες

- Απεριόριστες δυνατότητες

- Κλίμακα

- απολέπιση

- σενάριο

- Επιστήμη

- Επιστήμη και Τεχνολογία

- Εφαρμογές

- Δεύτερος

- Δεύτερη γενιά

- αρχαιότερος

- Υπηρεσίες

- σειρά

- setup

- Κοινοποίηση

- κέλυφος

- παρουσιάζεται

- Δείχνει

- Απλούς

- απλά

- ενιαίας

- Μέγεθος

- So

- λύση

- μερικοί

- εκτείνεται

- ειδικεύεται

- καθορίζεται

- ταχύτητα

- Γνέθω

- Εκκίνηση

- ξεκίνησε

- Κατάσταση

- Κατάσταση

- Βήματα

- χώρος στο δίσκο

- ισχυρός

- υποβολή

- υποβάλουν

- υποβάλλονται

- υποδίκτυο

- υποδίκτυα

- Επιτυχώς

- τέτοιος

- Σύνοδοι Κορυφής

- υπερυπολογιστής

- υποστηριζόνται!

- σύστημα

- παίρνει

- Τεχνολογία

- tensorflow

- τερματικό

- Τέξας

- Η

- τους

- εκ τούτου

- Μέσω

- διακίνηση

- ώρα

- φορές

- προς την

- σήμερα

- εργαλείο

- εργαλεία

- Σύνολο

- Τρένο

- Εκπαίδευση

- Μετάφραση

- συνήθως

- Ubuntu

- πανεπιστήμιο

- ανερχόμενος

- ενημερώσεις

- URL

- Χρήση

- χρήση

- Χρήστες

- αξία

- ποικιλία

- επαληθεύει

- εκδοχή

- μέσω

- Δες

- Πραγματικός

- Εβδ.

- Ποιό

- ενώ

- ευρύς

- θα

- εντός

- χωρίς

- Εργασία

- θα

- τυλίξτε

- γιαμ

- Εσείς

- Σας

- zephyrnet

- μηδέν

- ζώνες